Spędziłeś wiele godzin na opracowywaniu „idealnej” podpowiedzi. Masz wizję, model i potencjał do osiągnięcia ogromnego wzrostu wydajności. Jednak jedna drobna zmiana sprawia, że wyniki zbaczają z kursu. Bez standardowego sposobu oceny wyników nie jesteś w stanie stwierdzić, czy Twoja AI faktycznie się poprawia, czy tylko zmienia.

W rzeczywistości, zgodnie z raportem Wharton’s Prompting Science Report, samo przeformułowanie podpowiedzi może wpłynąć na wydajność nawet o 60 punktów procentowych.

Ten przewodnik przedstawia najlepsze szablony do testów wydajności promptów w ClickUp. Są to gotowe do powtórzenia schematy, które pozwolą Ci oceniać wyniki, prowadzić śledzenie każdej iteracji i wreszcie przeprowadzić połączenie danych z oceny z pracą w Twoim obszarze roboczym. ✨

Szablony testów porównawczych wydajności poleceń w skrócie

Oto krótki przegląd szablonów do testów wydajności promptów omówionych w tym przewodniku oraz części cyklu pracy, której każdy z nich zapewnia wsparcie 👇

| Szablon | Link do pobrania | Idealne do | Najważniejsze funkcje |

|---|---|---|---|

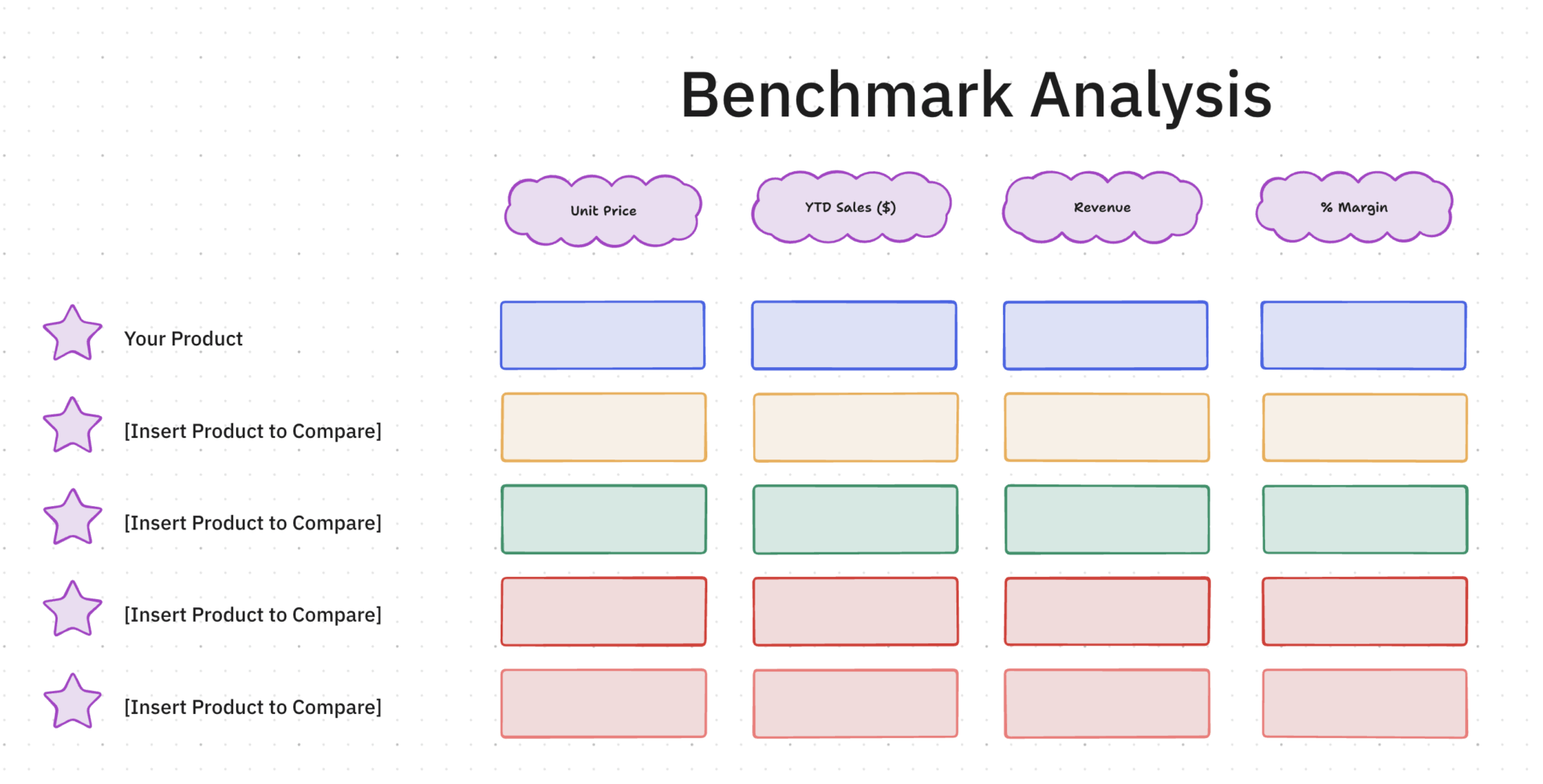

| Szablon analizy porównawczej autorstwa ClickUp | Pobierz darmowy szablon | Porównanie wariantów podpowiedzii i ocena wyników | Wizualne środowisko do testów porównawczych, pola punktacji, analiza wielowidokowa |

| Szablon planu eksperymentu i wyników autorstwa ClickUp | Pobierz darmowy szablon | Przeprowadzanie ustrukturyzowanych eksperymentów z podpowiedziami | Śledzenie hipotez, rejestrowanie ustawień testów, dokumentowanie wyników |

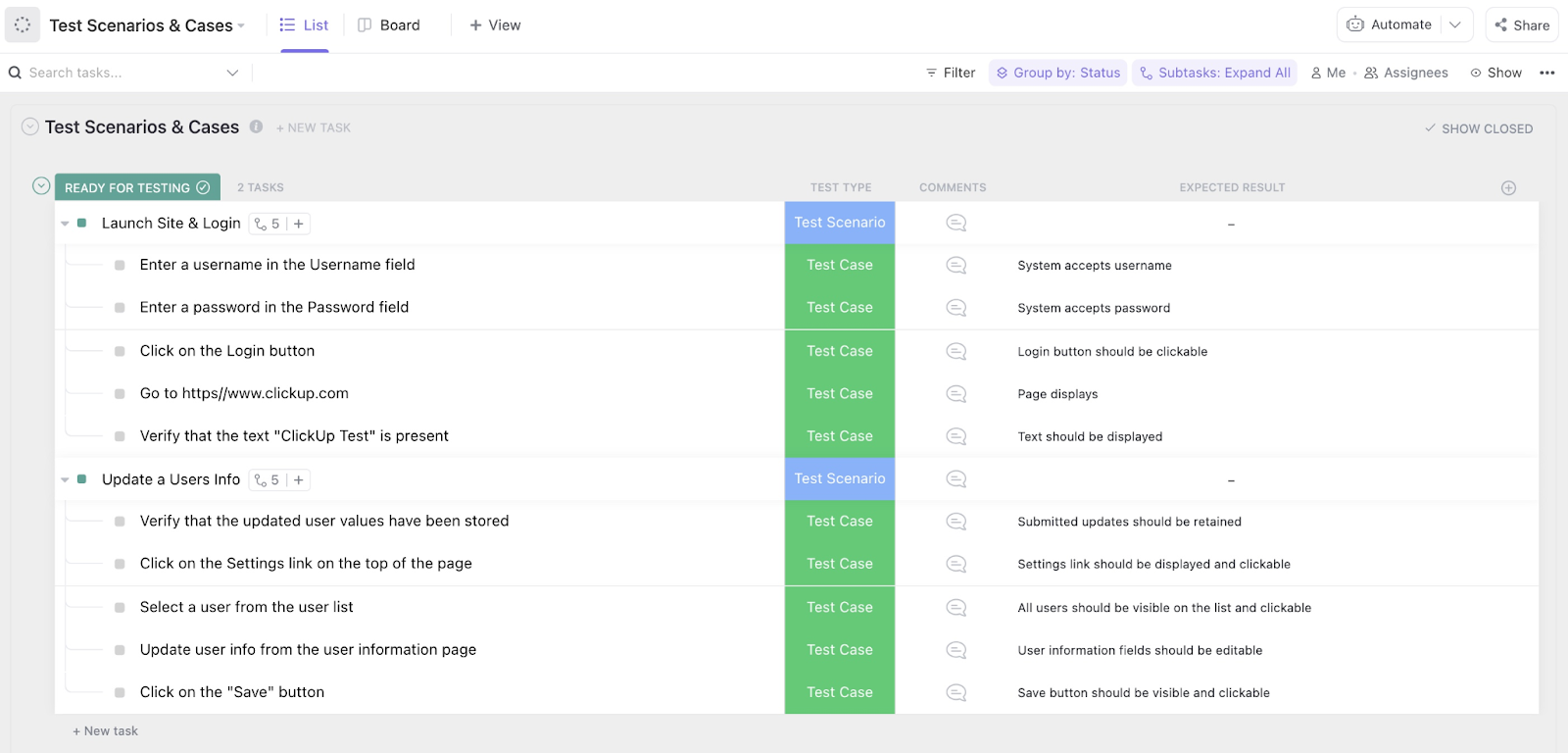

| Szablon zarządzania testami autorstwa ClickUp | Pobierz darmowy szablon | Zarządzanie cyklami pracy oceny na dużą skalę | Śledzenie przypadków testowych, statusy wykonania, wyzwalacze automatyzacji |

| Szablon przypadku testowego autorstwa ClickUp | Pobierz darmowy szablon | Dokumentowanie szczegółowych błędów w podpowiedziach | Rejestrowanie danych wejściowych/wyjściowych, porównanie wyników oczekiwanych z rzeczywistymi, śledzenie wyników pozytywnych/negatywnych |

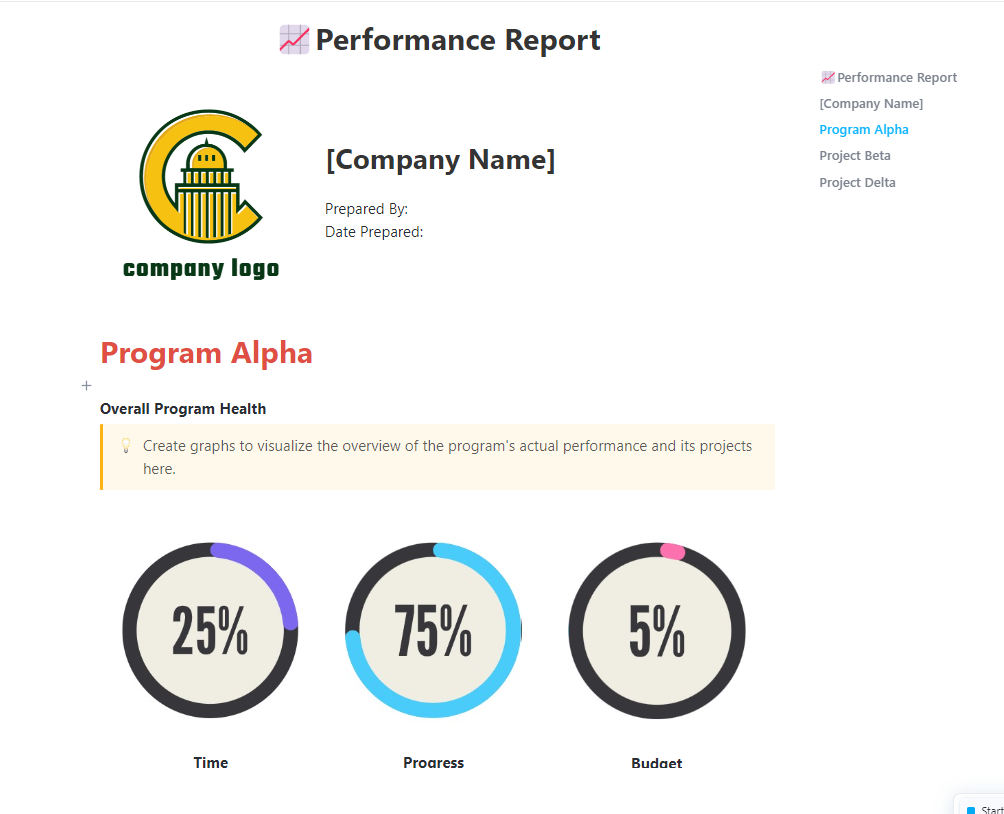

| Szablon raportu wydajności autorstwa ClickUp | Pobierz darmowy szablon | Przekazywanie wyników testów porównawczych interesariuszom | Streszczenia, wizualizacja danych, sekcje z zaleceniami |

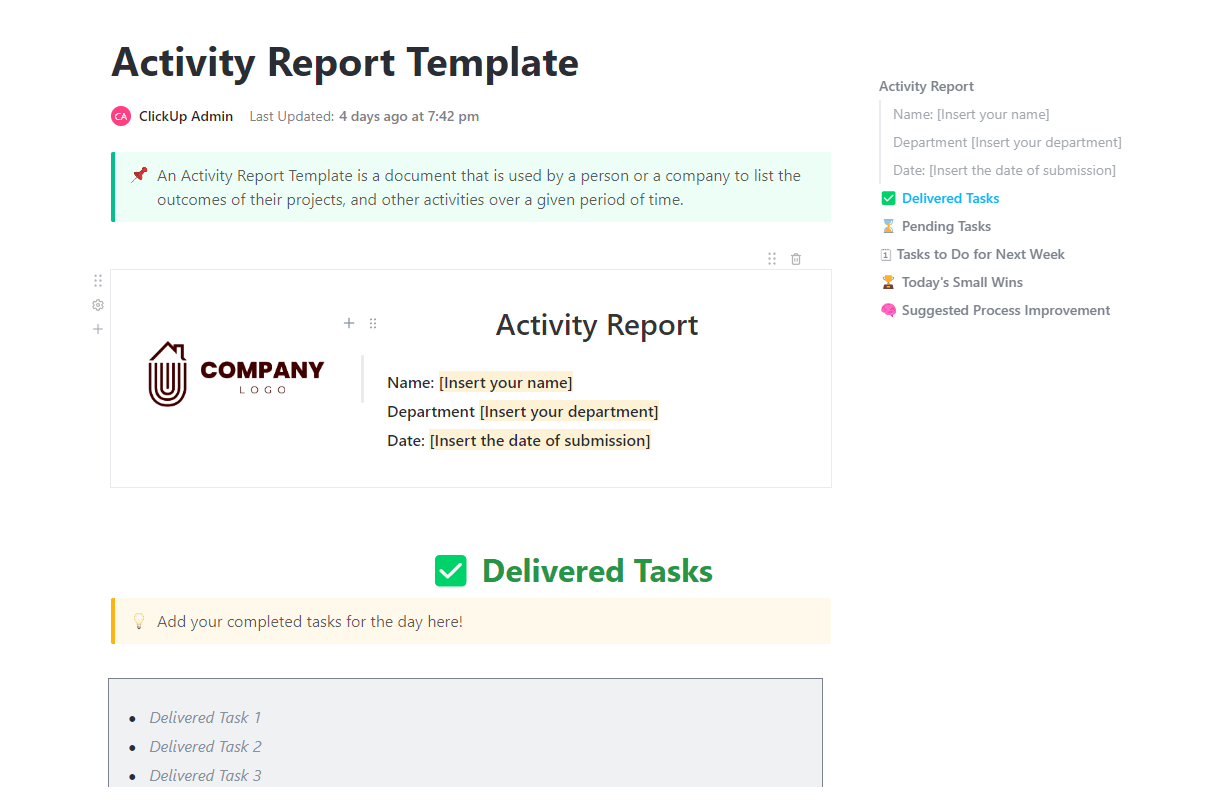

| Szablon raportu aktywności autorstwa ClickUp | Pobierz darmowy szablon | Śledzenie postępów w ocenie i obciążenie pracą | Dzienniki aktywności, filtrowanie według czasu, widoczność obciążenia pracą |

| Szablon zrównoważonej karty wyników autorstwa ClickUp | Pobierz darmowy szablon | Dostosowanie wydajności podpowiedzi do celów biznesowych | Wielowymiarowa ocena, wskaźniki ważone, mapowanie strategii |

| Szablon oceny projektu autorstwa ClickUp | Pobierz darmowy szablon | Ulepszanie procesów benchmarkingu w miarę upływu czasu | Ocena procesów, wnioski, śledzenie ryzyka |

| Szablon przeglądu heurystycznego autorstwa ClickUp | Pobierz darmowy szablon | Przeprowadzanie jakościowej oceny wyników AI | Kategorie heurystyczne, oceny ważności, rejestrowanie opinii ekspertów |

| Szablon OKR i celów firmy autorstwa ClickUp | Pobierz darmowy szablon | Połączenie wyników testów porównawczych z celami strategicznymi | Hierarchia OKR, śledzenie postępów, widoczność między zespołami |

🧠 Ciekawostka: Termin „benchmark” nie powstał w środowisku zespołów programistycznych czy produktowych. Pierwotnie, w XIX wieku, oznaczał punkt odniesienia dla geodetów – na długo przed tym, zanim stał się standardem do mierzenia wszystkiego, od eksperymentów na stronach internetowych po wydajność promptów.

Czym jest szablon testów porównawczych wydajności?

Szablon benchmarku wydajności promptów to narzędzie służące do oceny, porównywania i punktowania wyników generowanych przez AI. Służy on do sprawdzania, czy prompt sztucznej inteligencji faktycznie działa, czy też jego wydajność po cichu pogarsza się wraz z każdą aktualizacją modelu.

Potraktuj to jako standardowe ustawienia eksperymentu:

- Określa, co testujesz

- Jak mierzysz powodzenie

- Jakie dane wejściowe przetwarzasz

- Jak rejestrujesz wyniki

👀 Czy wiesz, że... Jeden z najsłynniejszych eksperymentów w statystyce rozpoczął się od dyskusji na temat tego, czy najpierw należy nalać mleko, czy herbatę. Ronald Fisher przekształcił tę drobną różnicę zdań w formalny test z losowo rozmieszczonymi filiżankami, a historia ta stała się jedną z klasycznych opowieści leżących u podstaw współczesnego projektowania eksperymentów.

Co sprawia, że szablon do testów wydajnościowych jest dobry

Dobry szablon podpowiedzi musi dobrze spełniać określone zadania, w przeciwnym razie po pierwszym sprincie pokryje się kurzem:

- Standardowe kryteria oceny: Zdefiniuj wymiary, takie jak dokładność, trafność, ton i wskaźnik halucynacji, zanim ktokolwiek rozpocznie testowanie. Bez z góry określonych rubryk każdy recenzent udziela innej oceny, a wyniki są nieporównywalne

- Śledzenie wersji: Każde uruchomienie testu porównawczego musi być powiązane z konkretną wersją polecenia, modelem i zestawem parametrów, aby można było prześledzić, co się zmieniło i dlaczego

- Ocena zarówno liczbowa, jak i jakościowa: Odpowiedź zgodna z faktami może nadal brzmieć sztucznie. Najlepsze szablony łączą oceny liczbowe ze strukturalnymi notatkami tekstowymi, umieszczając je obok siebie

- Struktura gotowa do porównania: Powinieneś mieć możliwość umieszczenia dwóch wersji podpowiedzi obok siebie i natychmiastowego dostrzeżenia różnic

- Wynik przydatny do działania: Test porównawczy zakończony wynikiem „ocena: 7/10” jest niekompletny. Oceniający muszą sporządzić notatkę, w której odnotują, dlaczego wynik jest taki, a nie inny, oraz co należy zmienić w następnej kolejności.

- Połączenie z pracą: Wyniki testów porównawczych przechowywane w izolowanym miejscu szybko tracą kontekst. Szablon działa najlepiej, gdy jest połączony z zadaniami i cyklami pracy, w ramach których faktycznie odbywa się tworzenie podpowiedzi.

📮ClickUp Insight: 92% pracowników umysłowych naraża się na utratę ważnych decyzji rozproszonych po czacie, e-mailach i arkuszach kalkulacyjnych. Bez ujednoliconego systemu rejestrowania i śledzenia decyzji kluczowe informacje biznesowe giną w cyfrowym szumie. Dzięki funkcjom zarządzania zadaniami w ClickUp nigdy nie musisz się tym martwić. Twórz zadania z czatu, komentarzy do zadań, dokumentów i e-maili za pomocą jednego kliknięcia!

📮ClickUp Insight: 92% pracowników umysłowych naraża się na utratę ważnych decyzji rozproszonych po czacie, e-mailach i arkuszach kalkulacyjnych. Bez ujednoliconego systemu rejestrowania i śledzenia decyzji kluczowe informacje biznesowe giną w cyfrowym szumie. Dzięki funkcjom zarządzania zadaniami w ClickUp nigdy nie musisz się tym martwić. Twórz zadania z czatu, komentarzy do zadań, dokumentów i e-maili za pomocą jednego kliknięcia!

10 szablonów do testowania wydajności poleceń dla Twojego zespołu

Każdy z poniższych szablonów zajmuje się innym aspektem testów porównawczych wydajności podpowiedzi — od szczegółowych przypadków testowych po raportowanie strategiczne. Niektóre z nich zostały stworzone specjalnie do testów porównawczych, inne to elastyczne struktury, które zespoły inżynierów mogą dostosować do cykli pracy.

Przyjrzyjmy się temu:

1. Szablon analizy porównawczej autorstwa ClickUp™

Ocena wydajności podpowiedzi zazwyczaj zamienia się w subiektywny chaos bez ustalonej podstawy do porównania. Jeśli tylko przeglądasz wyniki, nigdy nie dowiesz się, która zmiana w logice wyeliminowała halucynację lub poprawiła odpowiedź.

Szablon analizy porównawczej ClickUp™ działa jak wizualne laboratorium ewaluacyjne na Tablicy ClickUp. Pozwala on na przedstawienie wariantów podpowiedzi, rubryk oceny oraz wyników modeli na jednym nieograniczonym obszarze roboczym, dzięki czemu można dostrzec wzorce w logice modeli, które byłyby ukryte w standardowym widoku listy.

✨ Dlaczego pokochasz ten szablon

- Pola niestandardowe oceny: Przypisz każdy wymiar oceny (dokładność faktów, długość odpowiedzi i częstotliwość halucynacji) do dedykowanego pola niestandardowego ClickUp

- Wiele widoków: Przełączaj się między widokiem tabeli ClickUp do porównywania surowych danych, widokiem tablicowym ClickUp do śledzenia na podstawie statusu (Oczekuje na przegląd → Ocenione → Wymaga iteracji) oraz ponad 15 konfigurowalnymi widokami ClickUp

- Śledzenie historii: Każde uruchomienie testu porównawczego to zadanie z pełną historią, dzięki czemu możesz przewijać poprzednie oceny bez konieczności przeszukiwania arkuszy kalkulacyjnych nazwanych według wersji

✅ Idealne dla: badaczy AI i inżynierów podpowiedzi koordynujących rygorystyczne testy A/B obejmujące wiele wariantów modeli, logikę produkcyjną oraz przypadki użycia danych wrażliwych.

⚡️ Chcesz mieć do wyboru więcej szablonów analiz porównawczych? Przygotowaliśmy dla Ciebie listę tutaj: Darmowe szablony analiz porównawczych dla Teams

2. Szablon planu eksperymentu i wyników autorstwa ClickUp

Jak przeprowadzić test porównawczy podpowiedzi bez zacierania warunków wpływających na jej wydajność? Szablon „Plan eksperymentu i wyniki” od ClickUp zapewnia rygor metodologiczny tego zadania. W tym szablonie każda próba z podpowiedzią rozpoczyna się od sformułowanej hipotezy, ustawień testowych oraz zapisu zmian, które zaszły między kolejnymi przebiegami.

W miarę napływania wyników szablon przekształca rozproszone obserwacje w ciąg dowodów. Warianty podpowiedzi, kryteria porównawcze i notatki dotyczące wyników pozostają powiązane z tym samym cyklem pracy, zapewniając Twojemu zespołowi jaśniejszy obraz wydajności.

✨ Dlaczego pokochasz ten szablon

- Ujednolicenie procesu przesyłania przesłanych wyników testów porównawczych: Skorzystaj z ClickUp Forms, aby zebrać wszystkie warianty podpowiedzi, cele testów, rubryki i scenariusze skrajne w ramach jednego spójnego przepływu gromadzenia danych przed rozpoczęciem oceny

- Zmień każde uruchomienie polecenia w zadanie podlegające rozliczeniu: Używaj zadań ClickUp, aby przypisywać właścicieli, ustalać etapy przeglądu, śledzić zależności i zapewnić płynny przebieg każdego cyklu testów porównawczych dzięki widocznej ścieżce realizacji

- Zachowaj logikę stojącą za każdym wynikiem: Zapisz hipotezę, warunki testu i końcowe obserwacje w jednym zapisie eksperymentu

✅ Idealne dla: osób odpowiedzialnych za zawartość lub wsparcie techniczne, które tworzą bardziej niezawodną bibliotekę podpowiedzi do użytku produkcyjnego.

👀 Czy wiesz, że...? Ponieważ przewiduje się, że do końca tego roku 40% aplikacji korporacyjnych będzie działać w oparciu o agenty AI, nasz zespół w ClickUp przeniósł już cały system zawartości do Super Agents.

Ci autonomiczni współpracownicy zajmują się całym procesem tworzenia, przekazywania i publikowania, dzięki czemu możemy skupić się wyłącznie na strategii wysokiego szczebla.

Zobacz poniżej, jak działają one w naszym obszarze roboczym:

3. Szablon zarządzania testami autorstwa ClickUp

Skalowanie biblioteki promptów zazwyczaj kończy się niepowodzeniem, ponieważ nikt nie wie, które testy zostały faktycznie zakończone. Jeśli ręcznie prowadzisz śledzenie statusów „zaliczone” lub „niezaliczone” w losowym dokumencie, prawdopodobnie tracisz dni na zbędne testy i pętle komunikacyjne.

Szablon zarządzania testami od ClickUp zapewnia warstwę koordynacyjną wysokiego poziomu dla Twoich zestawów testowych. Przekształca rozproszone pary podpowiedzi i danych wejściowych w uporządkowany proces, w którym każdy przypadek testowy ma jasno określonego właściciela i aktualny status, co pozwala utrzymać harmonogram wdrożeń na właściwym torze.

✨ Dlaczego pokochasz ten szablon

- Monitoruj stan realizacji: Korzystaj z niestandardowych statusów ClickUp, takich jak „Wymaga ponownego testu” lub „Zaliczone”, aby na pierwszy rzut oka śledzić postępy w zestawie testów porównawczych

- Synchronizacja cykli iteracji: Skonfiguruj automatyzacje ClickUp tak, aby oznaczano konkretne przypadki testowe do nowego przebiegu za każdym razem, gdy zmodyfikowana zostanie podstawowa logika podpowiedzi

- Zdecentralizuj proces oceny: przydziel partie testów różnym członkom zespołu, aby wyeliminować wąskie gardła i zmniejszyć ryzyko stronniczości oceniających

✅ Idealne dla: kierowników ds. kontroli jakości i menedżerów ds. operacji podpowiedzi koordynujących obszerne zestawy testów obejmujące wiele wersji modeli i strumieni pracy technicznej.

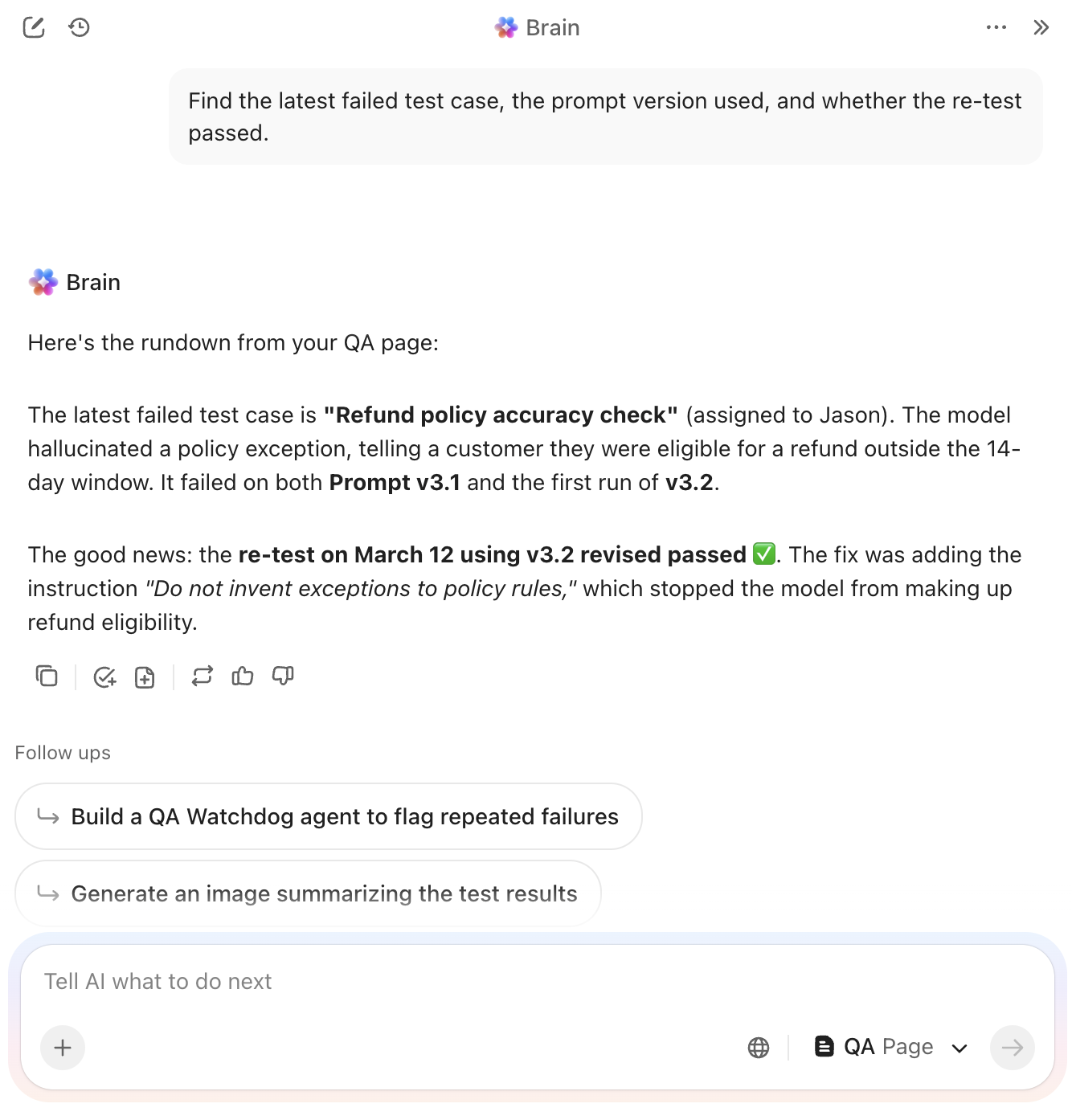

💡 Porada dla profesjonalistów: Potrzebujesz szybkich odpowiedzi? Skorzystaj z ClickUp Brain. Może on pobierać notatki z testów, nieudane przypadki, podpowiedzi i kontekst ponownego uruchomienia z Twojego obszaru roboczego i połączonych aplikacji. Dzięki temu możesz sprawdzić, co się wydarzyło, zanim przeprowadzisz kolejną ocenę.

4. Szablon przypadku testowego autorstwa ClickUp

Błędy atomowe w logice Twoich podpowiedzi są prawie niemożliwe do naprawienia, jeśli są ukryte w ogólnej aktualizacji statusu. Musisz dokładnie zobaczyć, gdzie model popełnił błąd lub zignorował konkretne ograniczenie, bez konieczności przeglądania godzin ręcznej historii czatu.

Szablon przypadku testowego ClickUp pełni funkcję szczegółowej warstwy dokumentacyjnej dla Twojego zestawu narzędzi ewaluacyjnych. Rozbija każdą kombinację podpowiedzi i danych wejściowych na zadania o minimalnym zakresie, umożliwiając bezpośrednie porównanie oczekiwanych wyników z rzeczywistymi wynikami modelu.

✨ Dlaczego pokochasz ten szablon

- Ujednolicenie ścieżek audytu: Rejestruj zmienne wejściowe, oczekiwane wyniki i notatki dotyczące różnic w ustrukturyzowanych polach, aby wyeliminować subiektywną interpretację podczas przeglądów

- Natychmiastowa klasyfikacja wyników: Oznacz każdy przypadek testowy za pomocą binarnych wskaźników „zaliczony/niezaliczony”, aby oddzielić bezpośrednie błędy logiczne od drobnych problemów z formatowaniem

- Twórz identyfikowalne powiązania: Połącz poszczególne przypadki testowe z zadaniami nadrzędnymi za pomocą relacji zadań ClickUp, aby dokładnie zobaczyć, jak awarie w skrajnych przypadkach wpływają na Twoje zbiorcze wyniki testów porównawczych

✅ Idealne dla: analityków ds. kontroli jakości i głównych inżynierów zajmujących się podpowiedziami, zarządzających testami regresji dla aplikacji AI o wysokim ryzyku lub wrażliwych cyklach pracy związanych z obsługą klienta.

🔮 Znalazłeś błąd, który warto naprawić? Skorzystaj z agenta ClickUp do odtwarzania błędów. Pomaga on przekształcić nieudany przypadek testowy w jasne kroki odtwarzania, dzięki czemu inżynierowie mogą szybciej go debugować. Jest to szczególnie przydatne, gdy dany prompt zawodzi tylko przy określonych danych wejściowych lub warunkach.

📚 Przeczytaj również: Szablony cyklu pracy z podpowiedziami AI

5. Szablon raportu wydajności autorstwa ClickUp™

Interesariusze rzadko mają cierpliwość, by przeglądać surowe logi testów lub techniczne arkusze ocen. Po zakończeniu rundy testów porównawczych zazwyczaj pozostaje Ci ręczne przekształcenie tych liczb w opis uzasadniający kolejne wdrożenie.

Szablon raportu wydajności od ClickUp™ stanowi nieodzowny pomost komunikacyjny dla Twoich operacji związanych ze sztuczną inteligencją. Porządkuje on Twoje ustalenia w postaci ogólnego podsumowania w formacie dokumentu, które podkreśla ulepszenia modelu oraz ryzyko regresji.

✨ Dlaczego pokochasz ten szablon

- Sekcje podsumowujące: gotowe obszary na kluczowe wnioski, najlepsze i najgorsze wyniki oraz zalecane kolejne kroki

- Wizualizacja danych na żywo : Pobieraj dane w czasie rzeczywistym z zadań porównawczych do pulpitów nawigacyjnych ClickUp — to wysokopoziomowa wizualizacja danych z Twojego obszaru roboczego ClickUp, która aktualizuje się po zakończeniu ocen.

- Uprość przegląd danych: Wykorzystaj wykresy i wskaźniki statusu, aby skomplikowane trendy porównawcze były zrozumiałe dla zespołów nietechnicznych

✅ Idealne dla: menedżerów programów AI i właścicieli produktów technicznych, którzy przedstawiają kierownictwu wyższego szczebla informacje dotyczące niezawodności modeli i gotowości wersji.

6. Szablon raportu aktywności autorstwa ClickUp™

Procedura benchmarkingu ma wartość tylko wtedy, gdy Twój zespół faktycznie ją stosuje. Gdy zadania testowe się piętrzą, łatwo jest pominąć kroki dokumentacji, które pozwalają zachować ścieżkę audytu.

Szablon raportu aktywności ClickUp™ stanowi operacyjne serce cyklu testowego. Śledzi, które oceny zostały już dostarczone, a które nadal znajdują się w kolejce. Ta widoczność pomaga utrzymać cały proces zarządzania zgodnie z harmonogramem.

✨ Dlaczego pokochasz ten szablon

- Rejestrowanie aktywności: Automatyczne rejestrowanie aktualizacji zadań, zmian statusu oraz komentarzy w ClickUp powiązanych z cyklami pracy benchmarkowymi

- Filtrowanie według okresu: widok aktywności według tygodnia, sprintu lub rundy testów porównawczych, aby dostrzec trendy w przepustowości

- Widoczność obciążenia pracą: Sprawdź, którzy oceniający są przeciążeni, a którzy mają wolne moce przerobowe, dzięki widokowi obciążenia pracą w ClickUp

✅ Idealne dla: kierowników zespołów AI i menedżerów operacyjnych, którzy muszą zadbać o to, by cykle pracy benchmarkingu nie były pomijane ani opóźniane.

💡 Porada dla profesjonalistów: Zaplanuj cotygodniowe 15-minutowe spotkanie „standupowe” poświęcone przeglądowi aktywności, aby przejrzeć raport aktywności i oznaczyć oceny, które utknęły w tym samym statusie na ponad 3 dni. Skorzystaj z ClickUp AI Notetaker, aby automatycznie rejestrować elementy do wykonania i przeszkody omówione podczas spotkania.

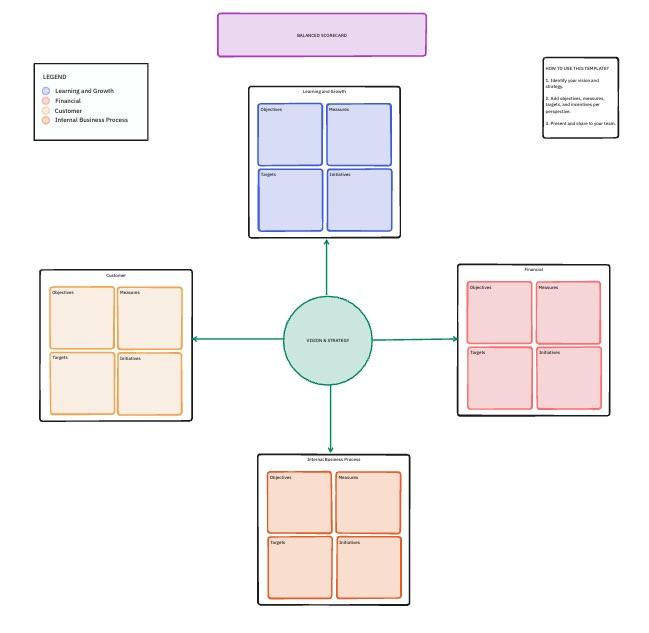

7. Szablon zrównoważonej karty wyników autorstwa ClickUp

Podpowiedź, która osiąga 98% dokładności, może nadal być zbyt kosztowna lub zbyt wolna, by faktycznie ją wykorzystać. Potrzebujesz sposobu, aby sprawdzić, czy wprowadzane przez inżynierów poprawki spełniają techniczne wymagania, a jednocześnie zapewniają wsparcie dla szerszych celów biznesowych.

Szablon zrównoważonej karty wyników autorstwa ClickUp wykorzystuje Tablicę do przedstawienia tych połączeń. Jest to przestrzeń do współpracy, służąca do połączania danych technicznych z kategoriami strategicznymi, takimi jak wpływ finansowy, zadowolenie klientów i rozwój wewnętrzny.

✨ Dlaczego pokochasz ten szablon

- Wielowymiarowa ocena: Cztery perspektywy strategiczne z wskaźnikami na poziomie podpowiedzi ujętymi w każdej z nich

- Mapowanie zgodności: wizualnie połącz poszczególne wyniki testów porównawczych z celami na poziomie zespołu lub produktu

- Pola ważone: Zdefiniuj wyniki ważone dla poszczególnych wymiarów za pomocą pól niestandardowych ClickUp, aby zagregowane wyniki odzwierciedlały priorytety strategiczne

✅ Idealne dla: menedżerów produktu oraz kierowników ds. AI/ML, którzy muszą dostosować wydajność inżynierii podpowiedzi do ogólnych celów biznesowych i alokacji zasobów.

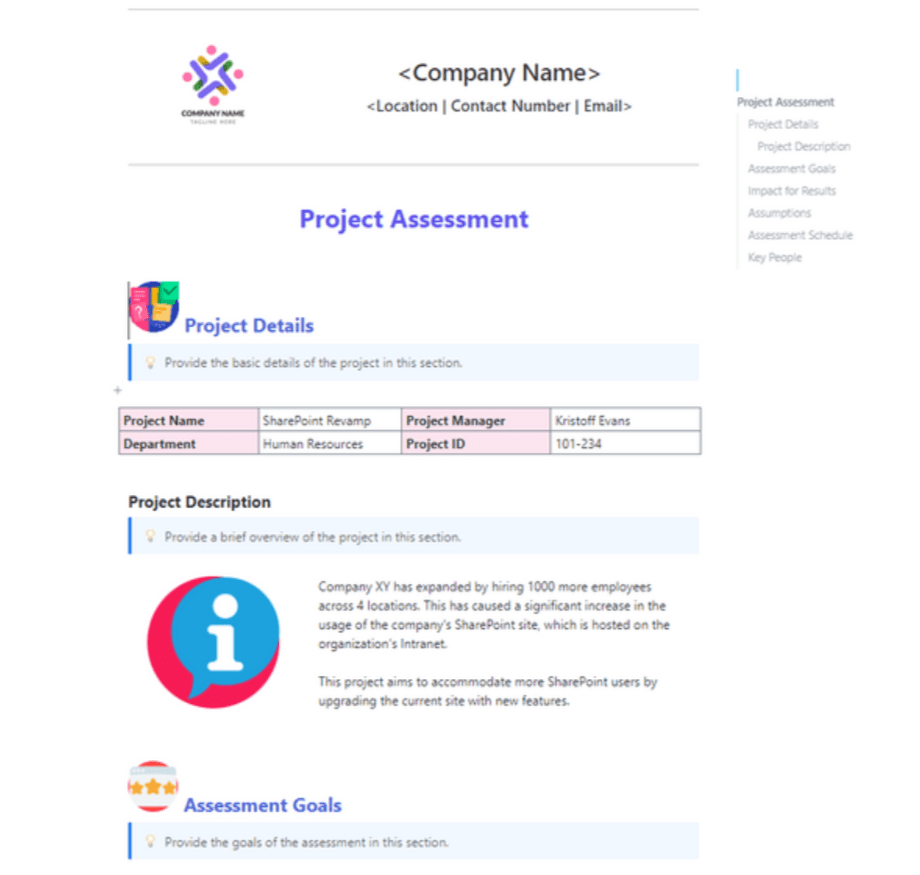

8. Szablon oceny projektu autorstwa ClickUp

Pominięcie analizy po zakończeniu cyklu testów porównawczych to stracona szansa na usunięcie wąskich gardeł w testowaniu. Przed rozpoczęciem kolejnej rundy wdrożeń musisz wiedzieć, czy Twoje przypadki testowe były rzeczywiście reprezentatywne, czy też kryteria oceny były zbyt niejasne.

Szablon oceny projektu od ClickUp pomaga w ocenie samej oceny. Pozwala wyjść poza surowe wyniki podpowiedzi i zbadać ogólny stan Twojego procesu testowania, dzięki czemu każdy cykl prowadzi do rzeczywistych ulepszeń logiki.

✨ Dlaczego pokochasz ten szablon

- Ocena stanu procesu: Korzystaj z pól statusu oznaczonych kolorami, aby na pierwszy rzut oka ocenić zakres testów, oś czasu i efektywność wykorzystania zasobów

- Zbieraj wnioski: Zapisz, co się sprawdziło, a co nie, w uporządkowanej sekcji dokumentu, aby usprawnić kolejną rundę oceny

- Zidentyfikuj przyszłe zagrożenia: Rejestruj konkretne przeszkody, takie jak przerwy w działaniu API lub luki w danych, aby zapobiec ich wpływowi na Twój następny sprint promptowy

✅ Idealne dla: menedżerów ds. operacji AI i kierowników ds. kontroli jakości, którzy muszą udoskonalić swoje metodyki testowania i wykazać zwrot z inwestycji w wysiłek związany z benchmarkingiem.

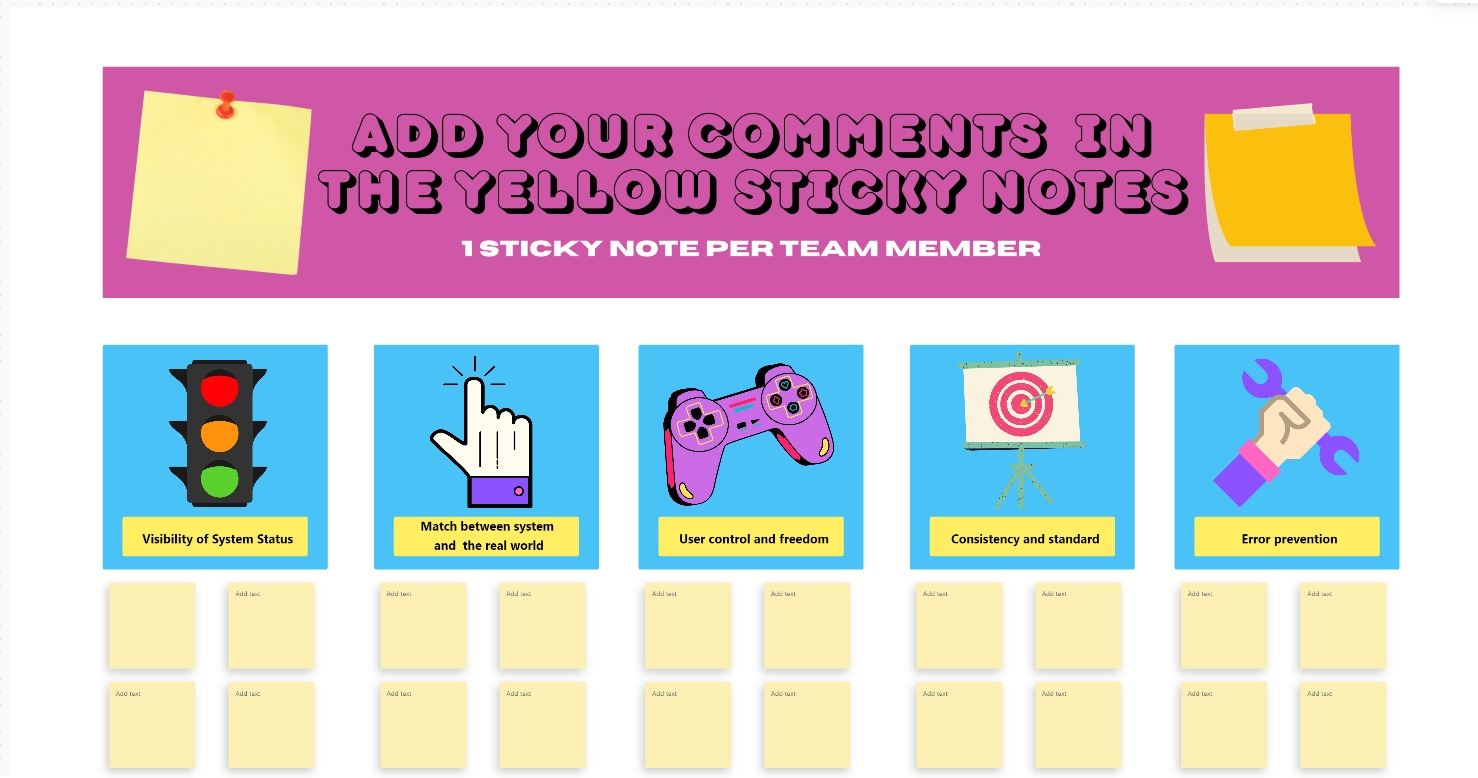

9. Szablon przeglądu heurystycznego autorstwa ClickUp

Wyniki liczbowe pokazują tylko część obrazu podczas oceny wyników działania AI. Podpowiedź może przejść test dokładności merytorycznej, ale nadal wydawać się robotyczny, mylący lub nieco niezgodny z wizerunkiem marki dla użytkowników.

Szablon przeglądu heurystycznego od ClickUp wnosi ekspercką intuicję do Twojego cyklu pracy PromptOps. Wykorzystuje on wspólną Tablicę, aby zestawiać wyniki z podstawowymi zasadami, takimi jak przejrzystość i zapobieganie błędom. Twój zespół może przypinać konkretne uwagi do różnych kategorii heurystycznych za pomocą cyfrowych karteczek samoprzylepnych, aby utrzymać porządek w audycie.

✨ Dlaczego pokochasz ten szablon

- Ujednolicenie kontroli jakości: Oceniaj wyniki w oparciu o niestandardowe zasady, aby zachować spójność tonu marki i przydatności w całej generowanej zawartości

- Ustal priorytety poprawek logicznych: Kategoryzuj problemy według ważności, aby oddzielić krytyczne zagrożenia bezpieczeństwa od drobnych błędów kosmetycznych

- Zbierz spostrzeżenia ekspertów: Zapisuj notatki recenzentów na karteczkach samoprzylepnych na Tablicy, aby ułatwić przeglądanie danych jakościowych i podejmowanie działań na ich podstawie

✅ Idealne dla: autorów treści UX i zespołów PromptOps przeprowadzających specjalistyczne audyty ręczne w celu zapewnienia, że zawartość generowana przez AI spełnia wysokie standardy jakości i bezpieczeństwa.

📮ClickUp Insight: Podczas gdy 34% użytkowników działa z pełnym zaufaniem do systemów AI, nieco większa grupa (38%) stosuje podejście „ufaj, ale weryfikuj”. Samodzielne narzędzie, które nie jest zaznajomione z kontekstem Twojej pracy, często wiąże się z większym ryzykiem generowania niedokładnych lub niezadowalających odpowiedzi.

Właśnie dlatego stworzyliśmy ClickUp Brain – sztuczną inteligencję, która łączy zarządzanie projektami, zarządzanie wiedzą i współpracę w całym Twoim obszarze roboczym oraz zintegrowanych narzędziach innych firm. Uzyskaj odpowiedzi kontekstowe bez konieczności przełączania się między aplikacjami i doświadcz 2–3-krotnego wzrostu wydajności pracy, tak jak nasi klienci z firmy Seequent.

📮ClickUp Insight: Podczas gdy 34% użytkowników korzysta z systemów AI z pełnym zaufaniem, nieco większa grupa (38%) stosuje podejście „ufaj, ale weryfikuj”. Samodzielne narzędzie, które nie jest zaznajomione z kontekstem Twojej pracy, często wiąże się z większym ryzykiem generowania niedokładnych lub niezadowalających odpowiedzi.

Właśnie dlatego stworzyliśmy ClickUp Brain – sztuczną inteligencję, która łączy zarządzanie projektami, zarządzanie wiedzą i współpracę w całym Twoim obszarze roboczym oraz zintegrowanych narzędziach innych firm. Uzyskaj odpowiedzi kontekstowe bez konieczności przełączania się między aplikacjami i doświadcz 2–3-krotnego wzrostu wydajności pracy, tak jak nasi klienci z firmy Seequent.

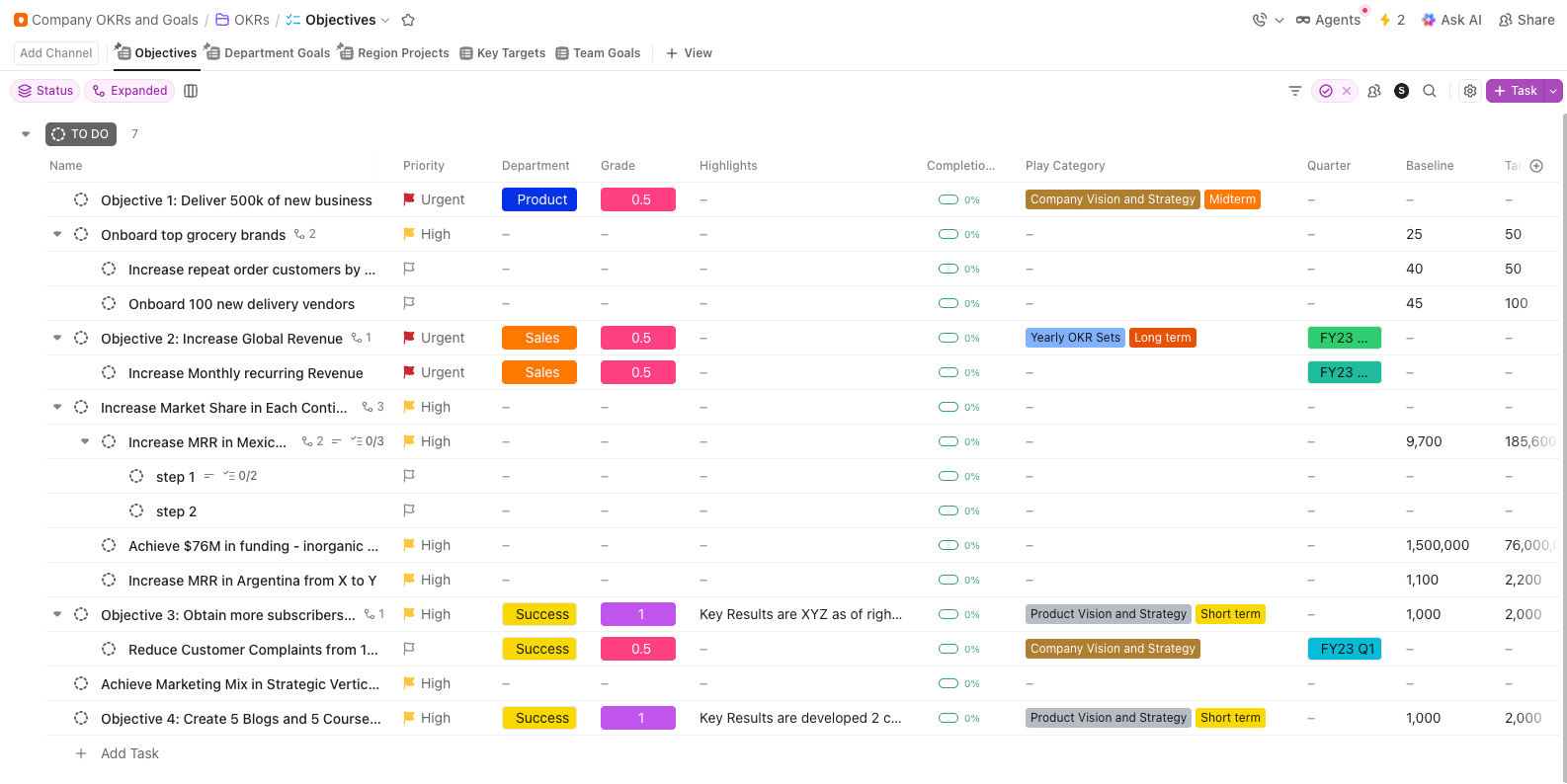

10. Szablon OKR i celów firmy autorstwa ClickUp

Poprawa dokładności podpowiedzi z 72% do 88% to ogromne osiągnięcie techniczne. Jednak liczba ta ma znaczenie tylko wtedy, gdy kierownictwo rozumie, w jaki sposób te ulepszenia bezpośrednio wpływają na kwartalny wzrost firmy.

Szablon OKR i celów firmy autorstwa ClickUp wypełnia lukę między benchmarkingiem technicznym a strategią wysokiego szczebla. Pozwala on na umieszczenie konkretnych celów wydajnościowych w ramach głównych celów produktowych. Dzięki temu zespół pozostaje skupiony na wynikach technicznych, które mają decydujący wpływ na działalność firmy.

✨ Dlaczego pokochasz ten szablon

- Hierarchia celów i kluczowych wyników: Umieść cele benchmarkingu na poziomie promptów w ramach celów zespołu lub produktu, aby zapewnić jasną spójność

- Śledzenie postępów: Wizualne wskaźniki postępów, które aktualizują się wraz z poprawą wyników testów porównawczych w kolejnych cyklach oceny

- Wielofunkcyjna widoczność: Planuj cele OKR firmy i udostępniaj cele porównawcze zespołom ds. produktu, inżynierii i kierownictwu, aby wszyscy widzieli, jak jakość promptów łączy się z priorytetami planu działania

✅ Idealne dla: zespołów zajmujących się AI i uczeniem maszynowym, które traktują benchmarking jako powtarzający się cel z mierzalnymi wynikami.

Zwiększ jakość swojej AI dzięki ClickUp

Więcej podpowiedzi oznacza więcej zmiennych elementów, więcej iteracji i większe ryzyko spadku jakości wyników.

Dzięki ClickUp tworzysz zintegrowany obszar roboczy, w którym benchmarking rozpoczyna się od ustrukturyzowanej oceny w zadaniach, a udoskonalenia są spójne dzięki dokumentom i Tablicom. Ponadto sztuczna inteligencja jest wbudowana w każdy szablon i rozwiązanie, automatycznie zarządzając powtarzalnymi analizami i wersjonowaniem.

Na co więc czekasz? Zacznij korzystać z ClickUp za darmo i zamień swoje benchmarki w wyniki.

Często zadawane pytania

Podstawowe wskaźniki obejmują dokładność, trafność, spójność i opóźnienie. Należy również śledzić wskaźnik halucynacji, zgodność z tonem oraz wskaźnik realizacji zadań. Odpowiednia kombinacja zależy ostatecznie od konkretnego przypadku użycia. Na przykład w przypadku wyników przeznaczonych dla klientów priorytetem jest ton i bezpieczeństwo, podczas gdy wewnętrzne podpowiedzi skupiają się bardziej na dokładności i szybkości.

Aby dostosować szablon, zacznij od dodania pól na nazwę modelu, wersję i ustawienia parametrów, takie jak temperatura i limity tokenów. Powinieneś również uwzględnić sekcję służącą do porównania wyników oczekiwanych z rzeczywistymi w celu pomiaru wydajności. Na koniec dodaj śledzenie wersji do każdego uruchomienia. Dzięki temu każdy test wydajności będzie powiązany z konkretną iteracją polecenia, co umożliwi dokładną długoterminową ocenę.

Benchmarking ilościowy wykorzystuje wyniki liczbowe (np. procentową dokładność, czas odpowiedzi) do obiektywnego porównania. Natomiast benchmarking jakościowy opiera się na ocenie ekspertów pod kątem takich zasad, jak przejrzystość, przydatność i ton komunikacji marki — najskuteczniejsze programy do testowania podpowiedzi wykorzystują oba podejścia.

Strukturalne testy porównawcze wykrywają regresje w podpowiedziach, zanim dotrą one do użytkowników. Tworzą one ciągłą pętlę informacji zwrotnej między oceną a iteracją, umożliwiając stopniowe udoskonalanie wydajności. Proces ten stanowi solidną podstawę dowodową dla decyzji inżynierów zajmujących się podpowiedziami.