Tre fornitori, dodici varianti di prompt e nessuna possibilità di riprodurre i risultati migliori: ecco come finiscono la maggior parte degli esperimenti multi-LLM senza un sistema di monitoraggio.

Questi modelli ClickUp offrono al tuo team un framework di condivisione e coerenza per pianificare, eseguire e confrontare esperimenti multi-LLM. E la parte migliore? Coprono tutto, dalla registrazione delle ipotesi e dalla valutazione della qualità fino all'approvazione da parte degli stakeholder e ai rapporti di ricerca finali.

Cominciamo! 👀

Panoramica dei modelli per il monitoraggio degli esperimenti multi-LLM

Ecco una breve panoramica dei modelli per il monitoraggio degli esperimenti multi-LLM trattati in questa guida:

| Modello | Link per scaricare | Ideale per | Caratteristiche principali |

|---|---|---|---|

| Modello ClickUp per il piano e i risultati degli esperimenti | Ottieni il modello gratis | Piano e documentazione degli esperimenti LLM dall'inizio alla fine | Registrazione delle ipotesi, campi di configurazione dei test, riepiloghi delle decisioni |

| Modello di lavagna online per esperimenti di crescita su ClickUp | Ottieni il modello gratis | Gestione e definizione delle priorità delle idee per gli esperimenti | Backlog visivo, sistema di votazione, conversione delle idee in attività |

| Modello di foglio di calcolo ClickUp | Ottieni il modello gratis | Registrazione di esecuzioni di esperimenti ripetibili su larga scala | Colonne strutturate, filtri e ordinamento, trigger di automazione |

| Modello di confronto software ClickUp | Ottieni il modello gratis | Confronto tra provider di LLM in base a diversi criteri | Confronto affiancato, grafici della dashboard, punteggi di valutazione |

| Modello di dashboard per il project management di ClickUp | Ottieni il modello gratis | Monitoraggio delle prestazioni degli esperimenti tra i team | Monitoraggio dello stato, confronto tra provider, visibilità del carico di lavoro |

| Modello di rapporto settimanale su ClickUp | Ottieni il modello gratis | Reportistica sullo stato degli esperimenti e sugli ostacoli | Riepiloghi settimanali, aggiornamenti generati dall'IA, monitoraggio dei blocchi |

| Modello di modello di report sulle attività di ClickUp | Ottieni il modello gratis | Conservazione della cronologia degli esperimenti e delle tracce di audit | Registri delle attività, registrazioni con data e ora, monitoraggio dei progressi |

| Modello di lista di controllo per il controllo qualità di ClickUp | Ottieni il modello gratis | Convalida della configurazione dell'esperimento prima dell'esecuzione | Controlli dei parametri, valutazione della prontezza, flussi di lavoro a fasi |

| Modello ClickUp per l'approvazione UAT | Ottieni il modello gratis | Documentazione delle decisioni finali sui modelli e delle approvazioni | Monitoraggio delle approvazioni, audit trail, approvazioni da parte degli stakeholder |

| Modello di report di ricerca ClickUp | Ottieni il modello gratis | Presentazione dei risultati degli esperimenti e delle raccomandazioni | Report strutturati, riepiloghi assistiti dall'IA, modifica collaborativa |

📚 Leggi anche: Modelli ClickUp PromptOps per i flussi di lavoro di IA

Che cos'è il monitoraggio degli esperimenti multi-LLM?

Il monitoraggio degli esperimenti multi-LLM consiste nel registrare, confrontare e analizzare sistematicamente i risultati di due o più modelli linguistici di grandi dimensioni rispetto agli stessi prompt o criteri di valutazione. Qualsiasi team che debba decidere quale LLM implementare, o che utilizzi modelli diversi per attività diverse, ha bisogno di un metodo ripetibile per registrare cosa è successo, cosa ha funzionato e perché.

Senza una struttura, i team si ritrovano con note frammentate sparse tra diversi strumenti. Nessuno è in grado di dire quale versione del modello sia stata testata con quale prompt, e la condivisione dei risultati con chi non era presente diventa un gioco d'ipotesi.

Questa proliferazione incontrollata dell'IA — ovvero la diffusione non pianificata di strumenti, modelli e piattaforme di IA senza supervisione né strategia — colpisce ogni team che si trova a destreggiarsi tra più strumenti di IA senza un'area di lavoro unificata.

Ecco cosa comprende il monitoraggio degli esperimenti multi-LLM:

| Componente | Esempi |

|---|---|

| Modelli | ClickUp Brain, Claude 3.7, GPT-4o, Gemini 1.5 |

| Prompt | Prompt di sistema, prompt utente, esempi few-shot |

| Parametri | Temperatura, token massimi, top-p |

| Risultati | Risposte grezze, latenza, utilizzo dei token |

| Metriche di valutazione | Accuratezza, punteggi BLEU/ROUGE, valutazioni umane, costo |

| Metadati | Timestamp, versioni dei set di dati, informazioni sull'ambiente |

📝 Nota veloce: Il monitoraggio degli esperimenti e l'osservabilità del ML non sono la stessa cosa. Il monitoraggio è il livello di registrazione strutturata. L'osservabilità gestisce il monitoraggio e gli avvisi in tempo reale. I modelli coprono l'aspetto del monitoraggio senza richiedere configurazioni tecniche.

Cosa cercare nei modelli per il monitoraggio degli esperimenti multi-LLM

Prima di scegliere un modello, è necessario definire criteri di valutazione chiari. ✨

- Campi strutturati per gli esperimenti: campi dedicati per il nome del modello, la versione del prompt, i parametri e l'output: non un documento vuoto che devi compilare da solo

- Layout di confronto affiancato: visualizza i risultati del Modello A e del Modello B nella stessa schermata senza dover attivare/disattivare le schede

- Monitoraggio delle metriche di valutazione: colonne integrate per il punteggio di accuratezza, rilevanza, latenza, costo per token e tasso di allucinazioni

- Stato e flusso di lavoro decisionale: contrassegna gli esperimenti come pianificati, in corso, completati o rifiutati, in modo che chiunque possa vedere a che punto sono le cose

- Funzionalità di collaborazione: commenti, menzioni e assegnatari mantengono la sincronizzazione tra lo sperimentatore e il decisore

- Dashboard o livello di reportistica: raggruppa i singoli risultati in una vista di riepilogo/riassunto per le revisioni da parte della dirigenza

- Flessibilità per diversi tipi di esperimenti: gestisci sia i confronti tra due modelli che le variazioni dei prompt di un singolo modello senza dover riprogettare nulla

🧠 Curiosità: Il Transformer è stato presentato con uno dei titoli di articolo più audaci di sempre: “Attention Is All You Need”. L’articolo proponeva un modello basato esclusivamente su meccanismi di attenzione, eliminando completamente ricorrenza e convoluzioni — e quell’architettura è poi diventata la base dei moderni LLM.

📚 Leggi anche: Modelli gratis per il flusso di lavoro dei prompt IA

10 modelli ClickUp per il monitoraggio degli esperimenti multi-LLM

Tutti i modelli qui elencati si trovano nella Libreria dei modelli di ClickUp. Puoi personalizzare ciascuno di essi con campi personalizzati, stati, visualizzazioni, automazioni e molto altro ancora.

1. Modello ClickUp per il piano e i risultati degli esperimenti

Gli esperimenti multi-LLM sono facili da eseguire, ma molto più difficili da interpretare in seguito. Un risultato può sembrare promettente sul momento, ma perde rapidamente valore quando il team non è in grado di ricostruire cosa è stato testato, quali impostazioni sono state utilizzate o come è stata presa la decisione finale.

Il modello ClickUp per il piano e i risultati degli esperimenti offre ai team un unico punto in cui definire l'esperimento prima di eseguirlo e acquisire i dati dopo la sua conclusione. Ciò semplifica il confronto tra modelli, prompt e configurazioni tra i vari esperimenti senza perdere il ragionamento alla base della decisione finale.

✨ Perché adorerai questo modello:

- Campo Ipotesi: Indica la tua previsione prima di eseguire qualsiasi test per evitare il bias di conferma

- Sezione configurazione test: registra il provider, la versione del modello e l'impostazione della temperatura con i campi personalizzati di ClickUp

- Registro delle decisioni: Lascia che ClickUp Brain generi automaticamente i riepiloghi degli esperimenti dai dati dei risultati

✅ Ideale per: product manager nel campo dell'IA che eseguono valutazioni strutturate di modelli LLM.

💡 Suggerimento da esperto: gli esperimenti multi-LLM possono generare rapidamente una montagna di output. ClickUp Brain ti aiuta a dare un senso a tutto ciò riiepilogando i risultati, standardizzando i punti chiave e trasformando i risultati in attività tracciabili in un unico spazio di lavoro convergente. In questo modo, l'esperimento non si conclude con un mucchio di risposte, ma diventa qualcosa che il tuo team può esaminare, su cui agire e su cui costruire.

2. Modello di lavagna online per esperimenti di crescita su ClickUp

Quando il tuo team ha più idee di esperimenti di quante ne possa effettivamente eseguire, la sfida passa dal testare al scegliere. Il confronto di un prompt ne porta ad altri tre, provider diversi introducono nuove variabili e ben presto il backlog inizia a crescere più velocemente di quanto il team riesca a valutarlo.

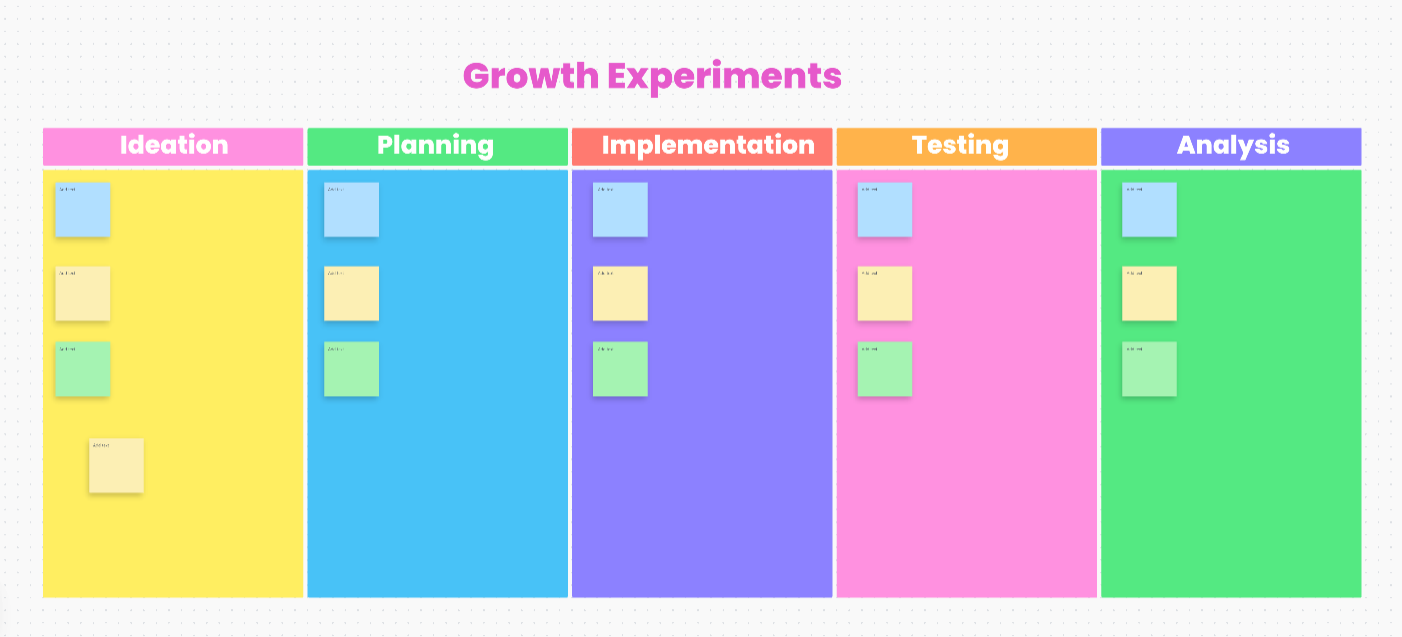

Il modello di lavagna online "Growth Experiments" di ClickUp ti offre uno spazio visivo per mettere ordine nelle idee iniziali. Basato su una tela visiva, aiuta i team a mappare le idee, individuare i confronti più significativi e mettere in pratica quelli migliori.

✨ Perché ti piacerà questo modello:

- Backlog visivo degli esperimenti: raggruppa i test per caso d'uso o provider su una tela libera con ClickUp Lavagne online

- Votazione per la definizione delle priorità: Consenti ai membri del team di votare quali confronti sono più importanti

- Brainstorming sull'IA: usa ClickUp Brain per generare idee per esperimenti o riformulare ipotesi

✅ Ideale per: Project Manager e responsabili della ricerca che gestiscono un backlog di esperimenti di grandi dimensioni.

📚 Leggi anche: Modelli personalizzabili gratis per esperimenti di crescita per far crescere la tua attività

3. Modello di foglio di calcolo ClickUp

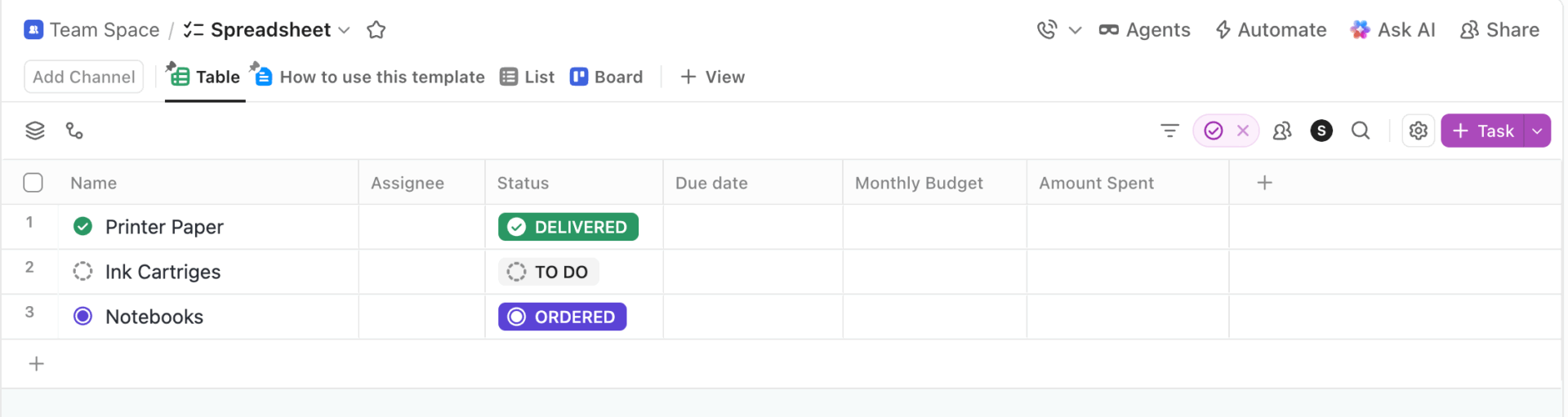

Se il tuo team ha registrato gli esperimenti su Fogli Google o Excel, il modello di foglio di calcolo di ClickUp ti sembrerà molto simile. Si basa sulla vista Tabella di ClickUp.

Ogni riga rappresenta un'esecuzione dell'esperimento (modello + prompt + parametri), mentre le colonne riportano output, punteggi, latenza, costi e note, il tutto con funzionalità di collaborazione e automazione integrate.

✨ Perché ti piacerà questo modello:

- Colonne digitate e filtrabili: utilizza i campi personalizzati di ClickUp per gli elenchi a discesa (provider del modello), i numeri (latenza) e le valutazioni (punteggio di qualità)

- Ordinamento e filtraggio in blocco: ordina centinaia di esecuzioni di esperimenti in base a qualsiasi campo senza problemi di prestazioni del foglio di calcolo

- Notifiche automatiche: attiva avvisi quando lo stato di un esperimento passa a "Completato" utilizzando le automazioni di ClickUp

✅ Ideale per: team di IA ops che gestiscono registri di esperimenti ripetibili.

🧠 Curiosità: Le reti neurali sono più antiche del termine “IA”. Nel 1943, Warren McCulloch e Walter Pitts pubblicarono il primo modello matematico di un neurone artificiale

4. Modello ClickUp per il confronto tra software

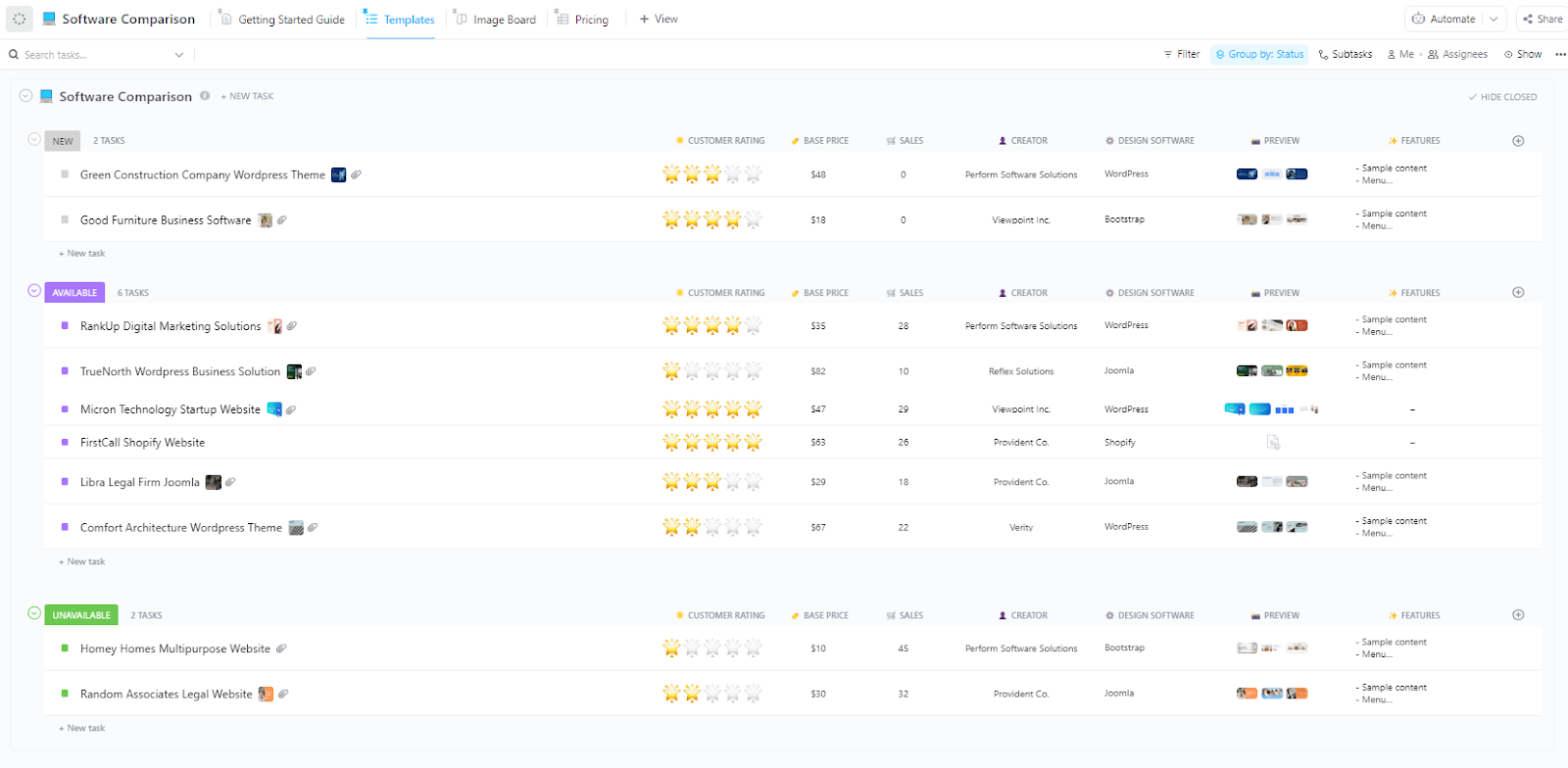

Progettato originariamente per valutare gli strumenti in base a criteri condivisi, il modello di confronto software di ClickUp funziona perfettamente per confrontare i provider di LLM testa a testa.

Invece di confrontare i fornitori, stai confrontando OpenAI, Anthropic, Google e Mistral in base a qualità dell'output, velocità, costo, dimensione della finestra di contesto e funzionalità di sicurezza.

Quando più modelli sembrano validi per motivi diversi, questo modello ti aiuta a confrontarli in base agli stessi criteri decisionali e a prendere la decisione finale con maggiore sicurezza.

✨ Perché ti piacerà questo modello:

- Valuta i pro e i contro dei provider da diverse prospettive: usa le viste di ClickUp per passare da un formato di confronto all'altro

- Grafici di confronto visivo: trasforma i dati in grafici o schede di riepilogo/riassunto per le presentazioni agli stakeholder utilizzando i dashboard di ClickUp

- Sintesi assistita dall'IA: lascia che ClickUp Brain estragga il contesto dai documenti degli esperimenti esistenti per compilare le note di confronto

✅ Ideale per: responsabili di prodotto e ingegneri che valutano i compromessi dei modelli con gli stakeholder della sicurezza o dell'approvvigionamento.

📮 ClickUp Insight: Il 45% degli intervistati nel nostro sondaggio afferma di tenere aperte per settimane le schede relative alla ricerca sul lavoro. Per un altro 23%, queste preziose schede includono thread di chat con l'IA ricchi di contesto.

In sostanza, la stragrande maggioranza esternalizza la memoria e il contesto a fragili schede del browser. Ripeti dopo di noi: le schede non sono basi di conoscenza. 👀

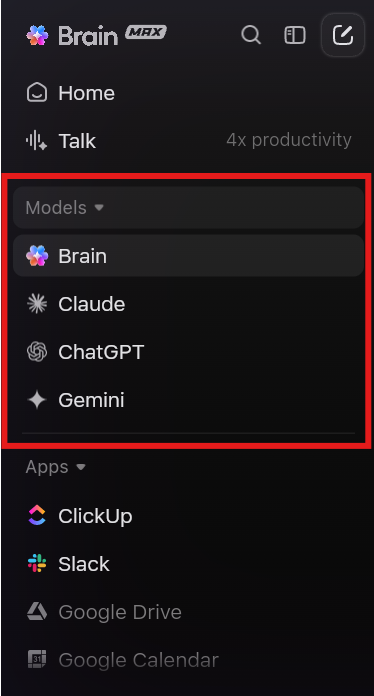

ClickUp Brain MAX cambia le regole del gioco.

Questa super app per l'IA ti consente di effettuare ricerche nel tuo spazio di lavoro, interagire con più modelli di IA e persino utilizzare comandi vocali per recuperare il contesto da un'unica interfaccia. Poiché MAX risiede sul tuo PC, non occupa spazio nelle schede e può salvare le conversazioni finché non le elimini!

📮 ClickUp Insight: Il 45% degli intervistati nel nostro sondaggio afferma di tenere aperte per settimane le schede relative alla ricerca sul lavoro. Per un altro 23%, queste preziose schede includono thread di chat sull'IA ricchi di contesto.

In sostanza, la stragrande maggioranza sta affidando la memoria e il contesto a fragili schede del browser. Ripeti con noi: le schede non sono basi di conoscenza. 👀

ClickUp Brain MAX cambia le regole del gioco.

Questa super app per l'IA ti consente di effettuare ricerche nella tua area di lavoro, interagire con più modelli di IA e persino utilizzare comandi vocali per recuperare il contesto da un'unica interfaccia. Poiché MAX risiede sul tuo PC, non occupa spazio nelle schede e può salvare le conversazioni finché non le elimini!

5. Modello di dashboard per la gestione dei progetti ClickUp per il project management

Quando devi gestire più di 50 sessioni di esperimenti su quattro fornitori diversi, le viste delle singole attività non sono sufficienti. Il modello di dashboard per il project management di ClickUp aggrega i dati delle attività relative ai tuoi esperimenti in widget e li visualizza tutti su un'unica schermata.

Questo lo rende incredibilmente utile quando il tuo programma di esperimenti inizia ad andare oltre qualche test isolato. Invece di esaminare ogni esecuzione separatamente, puoi monitorare lo stato dell'intera pipeline di test e individuare dove il ritmo sta rallentando.

✨ Perché ti piacerà questo modello:

- Distribuzione dello stato degli esperimenti: scopri a colpo d'occhio quanti esperimenti sono pianificati, in corso o completati

- Risultati per provider di modelli: confronta quale modello sta ottenendo i migliori risultati in tutti gli esperimenti completati

- Visibilità del carico di lavoro: monitora chi nel tuo team è sovraccarico di attività relative agli esperimenti con la vista Carico di lavoro di ClickUp

✅ Ideale per: responsabili dell'IA applicata che gestiscono il flusso di lavoro degli esperimenti tra ricercatori, ingegneri dei prompt e revisori.

🔮 Bonus: la visibilità è solo una parte del processo di scalabilità degli esperimenti multi-LLM. I Super Agent di ClickUp forniscono al tuo team dei colleghi IA a cui è possibile inviare messaggi direttamente, assegnare lavoro e impostare con le loro conoscenze e la loro memoria.

Ulteriori informazioni qui:

6. Modello di rapporto settimanale su ClickUp

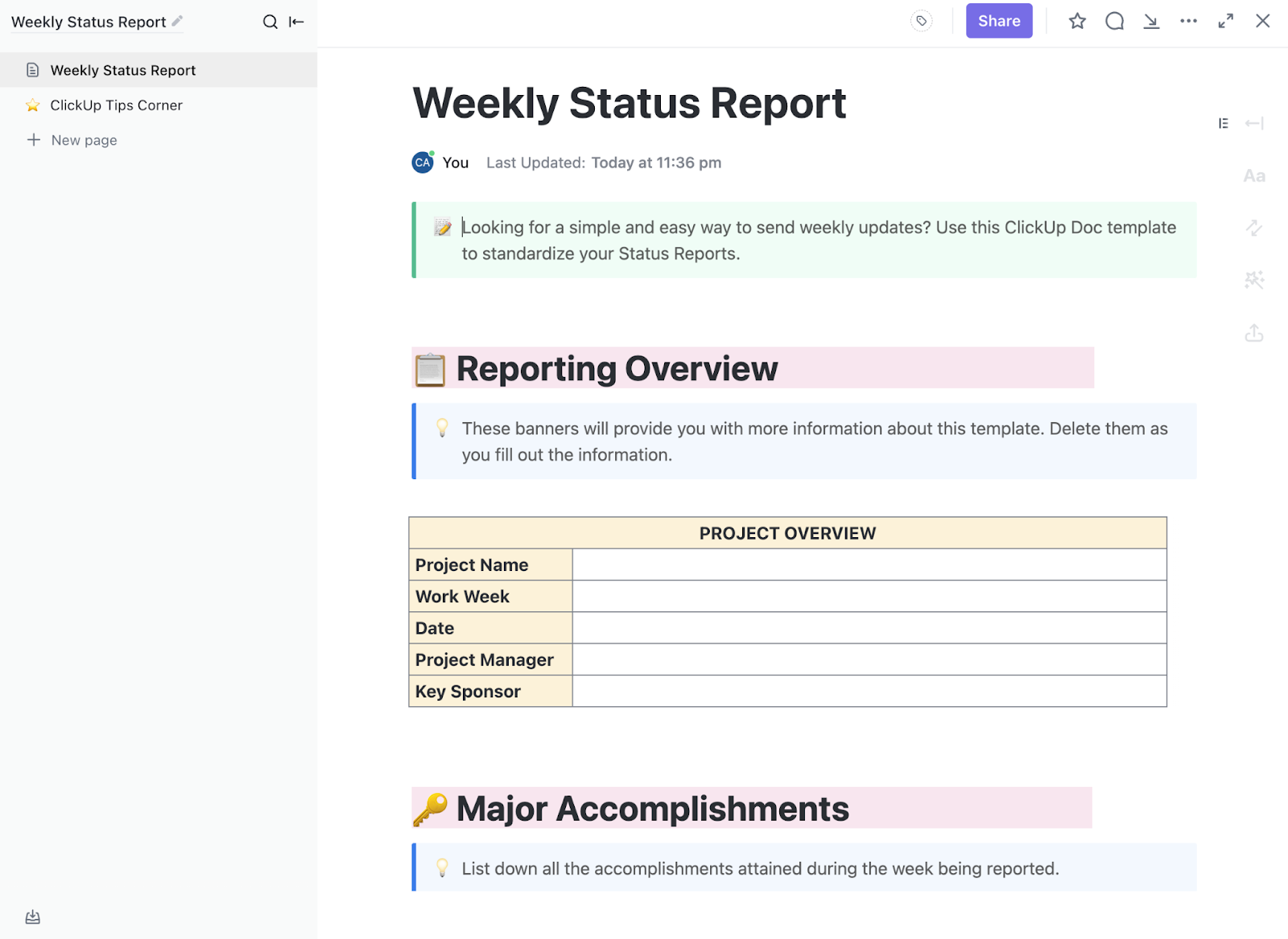

Il modello di rapporto settimanale su ClickUp è utile per il monitoraggio dei test completati e dei primi risultati. Inoltre, ti aiuta a individuare eventuali ostacoli, come ritardi nell'accesso alle API, set di dati mancanti o l'attesa del feedback dei revisori.

Sezioni come la panoramica del progetto, i risultati principali e gli aggiornamenti settimanali rendono più facile mostrare lo stato del progetto senza dover ricreare il report ogni volta.

Funziona incredibilmente bene quando gli esperimenti procedono rapidamente e la dirigenza ha bisogno di un quadro chiaro su cosa è cambiato questa settimana.

✨ Perché ti piacerà questo modello:

- Attività di report generate automaticamente: crea una nuova attività di report ogni settimana con il modello predefinito utilizzando ClickUp Automazioni

- Sintesi redatte dall'IA: Lascia che ClickUp Brain attinga dalle attività completate e rediga il riassunto dello stato in pochi minuti

- Monitoraggio dei blocchi: contrassegna le dipendenze in modo che la dirigenza sappia cosa deve essere sbloccato

✅ Ideale per: team di valutazione che eseguono cicli di test ricorrenti su prompt, provider e casi d'uso.

💟 Bonus: Lavora in modo più intelligente: lascia che un Super Agent si occupi della preparazione dei rapporti di stato giornalieri per i tuoi esperimenti! Ecco un video che ti mostra cosa fare.

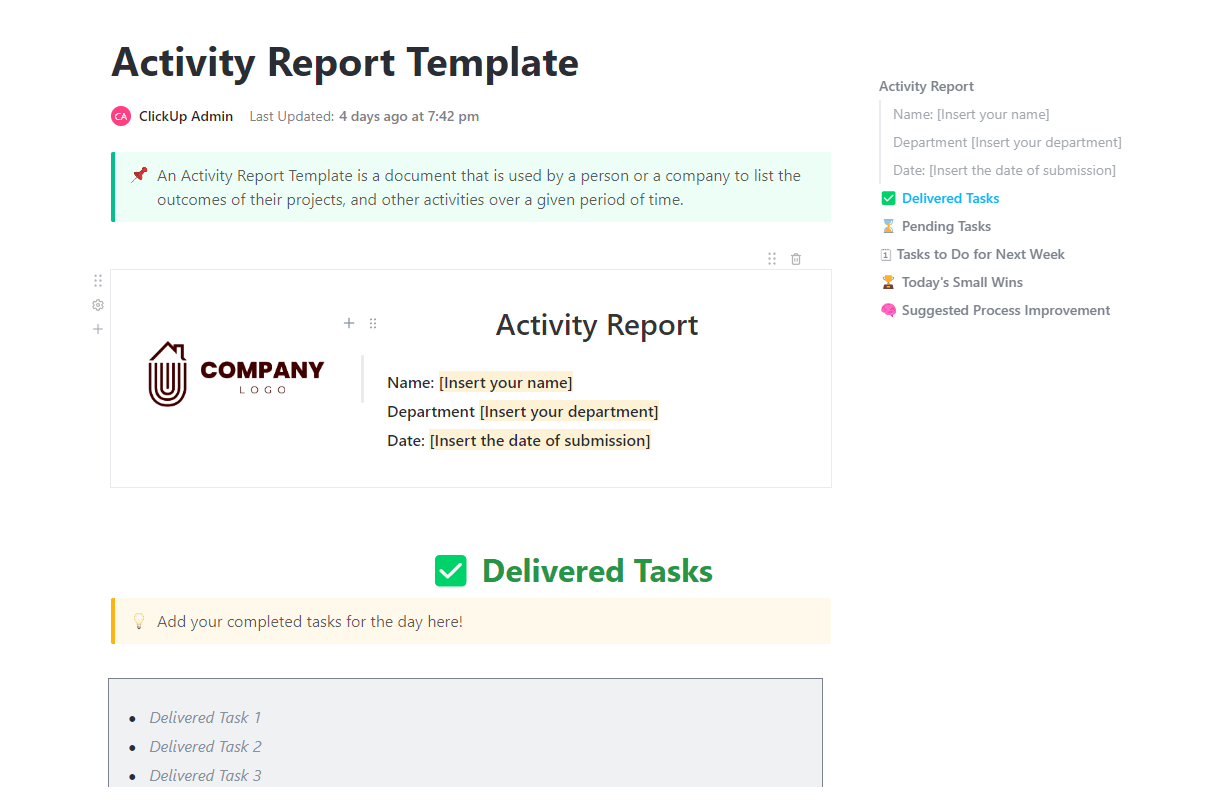

7. Modello di report delle attività di ClickUp

Viene implementata una modifica al modello. Due settimane dopo, qualcuno chiede perché il prompt sia stato modificato, chi abbia approvato la nuova versione e se il team abbia registrato il risultato da qualche parte. Se la cronologia è sparpagliata tra commenti, attività e note sparse, la risposta richiede più tempo del dovuto.

Il modello di report delle attività di ClickUp fornisce ai team una registrazione chiara di ciò che è accaduto durante un ciclo di esperimenti. Puoi utilizzarlo per registrare in un unico posto le attività completate e quelle in sospeso, i passaggi successivi, i piccoli successi e i problemi di processo. Per i team che operano in ambienti regolamentati o in qualsiasi flusso di lavoro che richieda tracciabilità, tale registrazione è fondamentale.

✨ Perché ti piacerà questo modello:

- Registro di controllo auto-compilato: registra automaticamente le modifiche alle attività, l'aggiunta di commenti e gli aggiornamenti di stato grazie al monitoraggio delle attività integrato in ClickUp

- Mantieni la cronologia della reportistica leggibile: usa ClickUp Docs per registrare il lavoro consegnato, gli elementi in sospeso, i passaggi successivi e le note di processo in un unico registro continuo

- Registrazioni con data e ora: assicurati che ogni voce riporti data e ora per una tracciabilità completa

✅ Ideale per: team di governance dell'IA che esaminano la cronologia di prompt, modelli e approvazioni nei vari cicli di sperimentazione.

💡 Suggerimento da esperto: Eseguire esperimenti multi-LLM significa solitamente destreggiarsi tra troppe schede. ClickUp Brain MAX riunisce ChatGPT, Claude e Gemini in un unico strumento desktop, così puoi passare da un modello all'altro senza dover suddividere note, domande e attività di follow-up tra diversi strumenti.

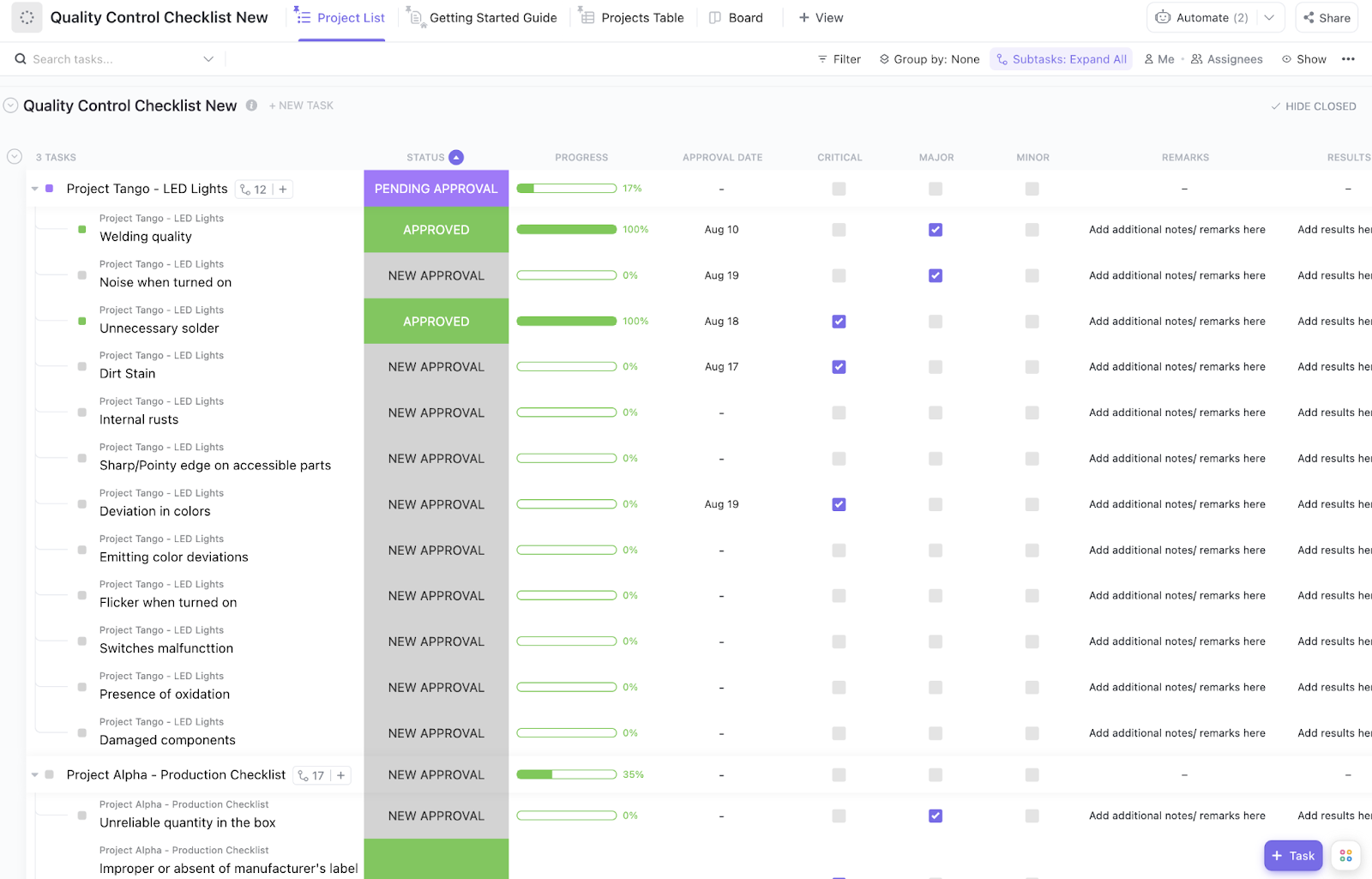

8. Modello di lista di controllo per il controllo qualità di ClickUp

Una configurazione errata può compromettere un confronto accurato tra i modelli. Un'impostazione della temperatura trascurata, un prompt modificato o una griglia di valutazione definita troppo tardi possono distorcere il risultato prima ancora che te ne accorga. Quando ciò accade, l'esperimento sembra completo sulla carta, ma è difficile fidarsi dei risultati.

Il modello di lista di controllo per il controllo qualità di ClickUp offre ai team un metodo strutturato per verificare la qualità della configurazione prima che un esperimento proceda. Nella vista Elenco di ClickUp, ogni esperimento può avere la propria lista di controllo ClickUp per garantire la coerenza dei prompt, la revisione dei parametri, la preparazione del punteggio e l'approvazione finale.

✨ Perché ti piacerà questo modello:

- Controlli di coerenza dei parametri: verifica che i prompt, la temperatura, il numero massimo di token e gli altri parametri corrispondano in tutti i modelli sottoposti a test

- Conferma della griglia di valutazione: assicurati che i criteri di valutazione siano stati definiti prima di esaminare i risultati

- Controllo dello stato: impedisci a un esperimento di passare allo stato "Completato" finché tutte le voci della lista di controllo non sono state spuntate utilizzando le automazioni di ClickUp

✅ Ideale per: responsabili QA nel campo dell'IA che necessitano di un controllo pre-lancio ripetibile per il confronto tra modelli.

📚 Leggi anche: Come mitigare i pregiudizi dell'IA?

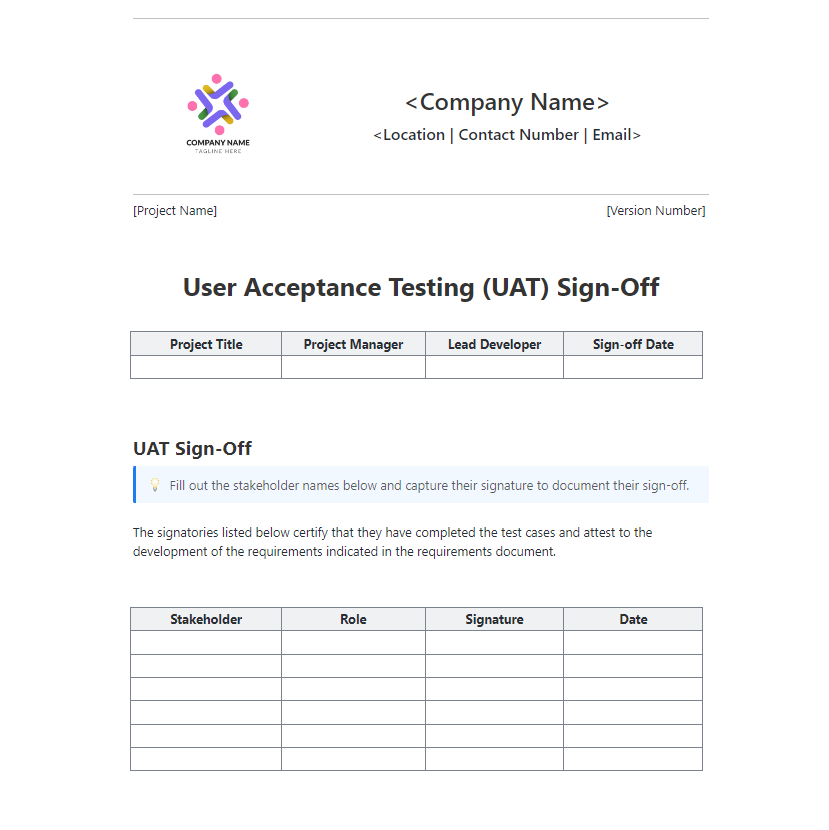

9. Modello ClickUp per l'approvazione UAT

Un modello può vincere l'esperimento e non essere ancora pronto per la produzione. Qualcuno deve comunque confermare la raccomandazione, esaminare i rischi noti e approvare l'implementazione.

Il modello ClickUp per l'approvazione UAT offre ai team un modo formale per colmare tale lacuna. Utilizzalo per documentare in un unico posto il riepilogo/riassunto dell'esperimento, la configurazione del modello raccomandata, i risultati chiave, i limiti noti e le approvazioni finali.

Funziona bene per i programmi multi-LLM in cui la decisione finale richiede più di un semplice "sì" verbale.

✨ Perché ti piacerà questo modello:

- Monitoraggio dello stato di approvazione: registra la decisione di ciascun stakeholder (approvato, rifiutato, in sospeso) tramite i campi personalizzati di ClickUp

- Notifiche di approvazione automatizzate: attiva avvisi quando è necessaria l'approvazione utilizzando le automazioni di ClickUp

- Aggiungi contesto prima della decisione finale: usa ClickUp Clips per registrare una breve panoramica dei risultati, dei casi limite o dei limiti del modello vincente, in modo che i revisori possano valutare la decisione più rapidamente

✅ Ideale per: responsabili di prodotto, ingegneri e responsabili della conformità che necessitano di una traccia documentata delle approvazioni per modifiche all'IA ad alto impatto.

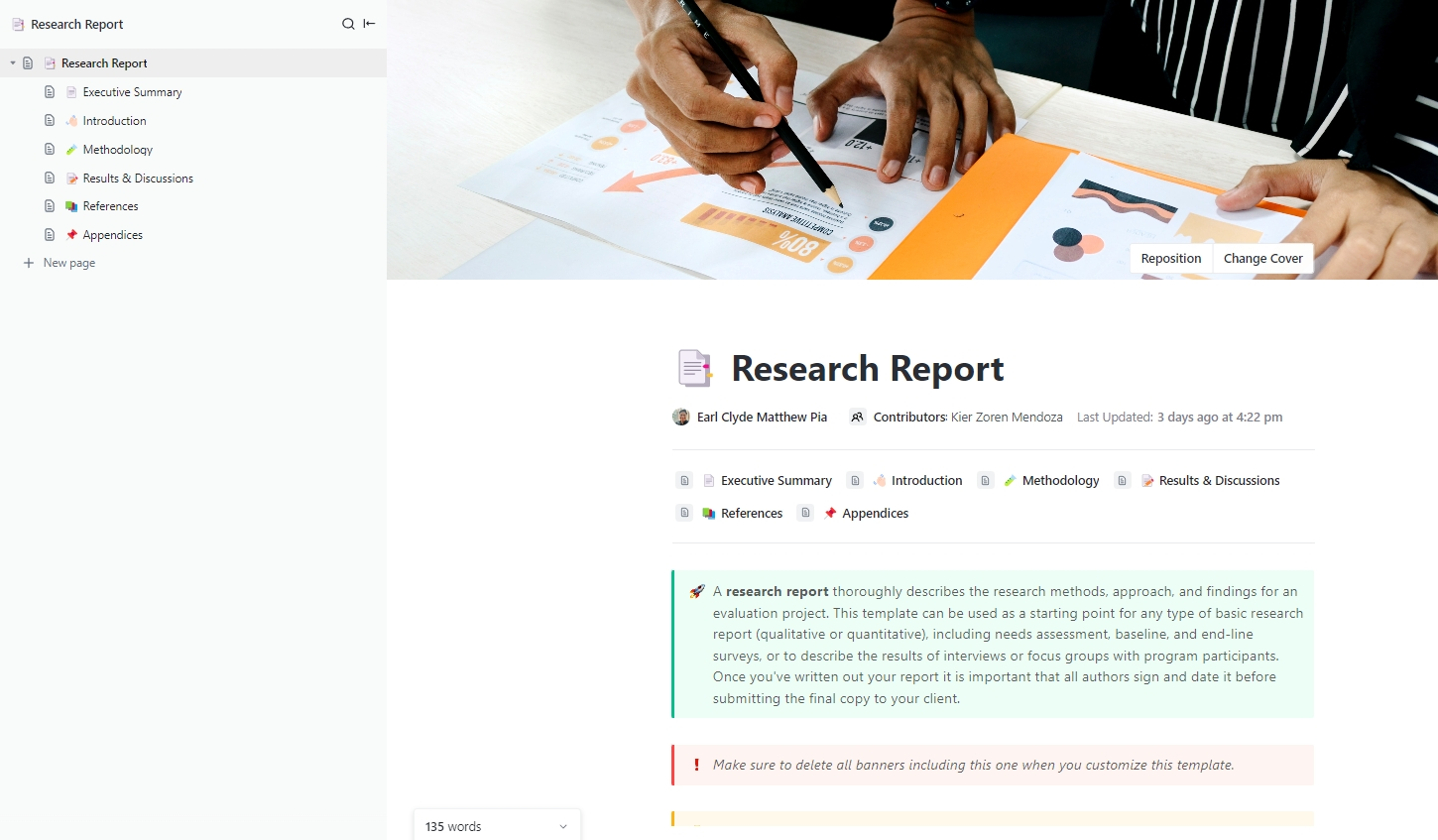

10. Modello di report di ricerca ClickUp

Puoi portare a termine una serie di esperimenti LLM di successo e avere comunque difficoltà a spiegare cosa ha imparato il team. I dati potrebbero trovarsi nelle attività, nelle schede di valutazione, nei dashboard e nei commenti. I suggerimenti potrebbero trovarsi altrove. Questo rallenta la revisione e rende più difficile riutilizzare il lavoro in seguito.

Il modello di rapporto di ricerca di ClickUp ti consente di trasformare il lavoro sperimentale in un documento chiaro e strutturato. Basato su ClickUp Docs, include sezioni dedicate all'executive summary, alla metodologia, ai risultati, ai riferimenti bibliografici e altro ancora.

È particolarmente utile per le valutazioni interne in cui i team devono documentare perché un modello è stato testato, come è stato valutato e quali risultati ha mostrato.

✨ Perché ti piacerà questo modello:

- Mantieni gli input del report collegati all'esecuzione: usa le attività di ClickUp per collegare le esecuzioni degli esperimenti, i titolari, gli stati e i dati dei risultati al report finale

- Redazione assistita dall'IA: lascia che ClickUp Brain estragga i dati dalle attività sperimentali completate e riepiloghi i risultati, riducendo notevolmente il tempo necessario per la stesura del resoconto

- Modifica collaborativa: ricevi feedback tramite commenti e menzioni direttamente all'interno del documento

✅ Ideale per: ricercatori nel campo dell'IA o responsabili di prodotto che presentano metodologie, risultati e raccomandazioni di implementazione alla dirigenza.

Inizia al monitoraggio dei tuoi esperimenti multi-LLM

Man mano che il tuo team passa dalla valutazione di uno o due modelli LLM alla gestione di strategie multimodello in diversi casi d'uso, il monitoraggio strutturato diventa piuttosto indispensabile.

Hai visto come ogni modello gestisce una fase diversa del ciclo di vita dell'esperimento. Inizia con il modello "Piano e risultati dell'esperimento" per il tuo prossimo confronto tra modelli, poi aggiungi il modello "Dashboard" man mano che si espande.

Il vero ostacolo al monitoraggio efficace degli esperimenti è la mancanza di una struttura condivisa per registrare ciò che hai testato, scoperto e, in definitiva, deciso. Quando quei dati sono sparsi tra notebook, thread di chat e fogli di calcolo personali, il tuo team non può imparare dai test passati e prendere decisioni sui modelli con sicurezza.

È qui che entra in gioco lo spazio di lavoro AI convergente di ClickUp. Mantenendo le attività degli esperimenti, i dati e le conversazioni del team in un unico posto, tutti collegati dall'IA, ClickUp offre al tuo team la struttura unificata di cui ha bisogno.

Inizia gratis con ClickUp e configura oggi stesso il tuo primo modello di monitoraggio degli esperimenti. ✅

Domande frequenti sugli esperimenti multi-LLM

In che modo i modelli di monitoraggio degli esperimenti multi-LLM differiscono dagli strumenti di osservabilità ML come Langfuse o Arize?

I modelli forniscono strutture organizzate per documentare gli esperimenti, garantendo che tutti i dettagli importanti vengano registrati per analisi future. Nel frattempo, gli strumenti di osservabilità consentono il monitoraggio in tempo reale delle prestazioni del sistema, con avvisi automatici in caso di anomalie e dati di telemetria completi adatti agli ambienti di produzione. Molti team utilizzano entrambi gli strumenti insieme, combinando l'approccio organizzato dei modelli con le informazioni immediate fornite dagli strumenti di osservabilità.

Posso effettuare il monitoraggio degli esperimenti su OpenAI, Anthropic e provider di LLM open source nello stesso modello ClickUp?

Sì, certo! In ClickUp sono disponibili i campi personalizzati che consentono di definire metadati specifici per ogni provider per ogni voce dell'esperimento. Ciò permette di registrare e confrontare i risultati di qualsiasi provider senza dover cambiare strumento. Inoltre, è possibile integrare le dashboard per ottenere una vista dettagliata e di alto livello di ogni esperimento.

Quali metriche dovrei registrare quando confronto più LLM fianco a fianco in ClickUp?

Quando si confrontano più LLM in ClickUp, le metriche chiave da registrare coprono quattro aree: prestazioni (latenza, token al secondo, utilizzo della finestra di contesto), qualità (accuratezza, tasso di allucinazioni, punteggio di rilevanza e coerenza nel seguire le istruzioni), costo (conteggio dei token di input/output e costo per richiesta) e affidabilità (tasso di errore, numero di tentativi e timeout). Per le valutazioni specifiche per attività, includi anche i punteggi BLEU/ROUGE per la sintesi, Pass@k per la generazione di codice o l'accuratezza delle chiamate agli strumenti per le attività agentiche.

È necessaria una competenza ingegneristica per configurare il monitoraggio degli esperimenti multi-LLM in ClickUp?

No: i modelli in ClickUp sono pre-strutturati, quindi puoi iniziare a registrare gli esperimenti immediatamente, e ClickUp Brain può aiutarti a personalizzare i campi e impostare automazioni utilizzando il linguaggio naturale.