I pregiudizi dell'IA possono sembrare un problema tecnologico. Tuttavia, i loro effetti si manifestano nel mondo reale e spesso possono essere devastanti.

Quando un sistema di IA si inclina nella direzione sbagliata, anche solo leggermente, può portare a risultati ingiusti.

E col tempo, questi piccoli problemi possono trasformarsi in clienti insoddisfatti, problemi di reputazione o persino questioni di conformità che non avevate previsto.

La maggior parte dei team non ha intenzione di creare un'IA parziale. Ciò accade perché i dati sono disordinati, il mondo reale è irregolare e gli strumenti che utilizziamo non sempre ragionano come ci aspettiamo. La buona notizia è che non è necessario essere un data scientist per capire cosa sta succedendo.

In questo blog ti spiegheremo cos'è effettivamente il bias dell'IA, perché si verifica e come può manifestarsi negli strumenti aziendali di uso quotidiano.

Che cos'è il bias dell'IA?

Il pregiudizio dell'IA si verifica quando un sistema di IA produce risultati sistematici e ingiusti che favoriscono o svantaggiano costantemente determinati gruppi di persone. Non si tratta solo di errori casuali, ma di modelli prevedibili che influenzano il modo in cui l'IA prende le decisioni. La causa? L'IA apprende dai dati che riflettono i pregiudizi umani esistenti, altri pregiudizi inconsci e le disuguaglianze sociali.

Pensateci in questi termini: se addestrate un algoritmo di assunzione su dieci anni di dati aziendali in cui il 90% dei manager era costituito da uomini, l'IA potrebbe erroneamente apprendere che essere maschio è un requisito fondamentale per ricoprire un ruolo dirigenziale. L'IA non è maliziosa, ma semplicemente identifica e ripete i modelli che le sono stati mostrati.

Ecco cosa rende così complessi i pregiudizi dell'IA:

- È sistematico, non casuale: l'ingiustizia non è un errore occasionale, ma un modello ripetibile nei risultati dell'IA.

- Spesso è invisibile: i risultati distorti possono nascondersi dietro la complessa matematica di un algoritmo apparentemente neutrale, rendendoli difficili da individuare.

- È radicato nei dati e nella progettazione: il bias entra nel sistema attraverso le scelte che noi esseri umani facciamo quando costruiamo e addestriamo l'IA.

⭐ Modello in primo piano

Il modello di rapporto di risposta agli incidenti di ClickUp fornisce una struttura pronta all'uso per documentare, monitorare e risolvere gli incidenti dall'inizio alla fine. Registra tutti i dettagli rilevanti dell'incidente, mantieni stati chiaramente categorizzati e acquisisci attributi importanti come la gravità, i gruppi interessati e le misure correttive. Supporta campi personalizzati per elementi quali Approvato da, Note sull'incidente e Documenti di supporto, che aiutano a far emergere la responsabilità e le prove durante tutto il processo di revisione.

📖 Per saperne di più: Come eseguire una valutazione dei rischi: strumenti e tecniche

Perché è importante mitigare i pregiudizi dell'IA

Quando i tuoi sistemi di IA sono ingiusti, rischi di danneggiare la vita delle persone reali.

Questo, a sua volta, espone la tua organizzazione a serie sfide aziendali e può persino distruggere la fiducia che hai faticosamente costruito con i tuoi clienti.

Una IA parziale che nega un prestito a qualcuno, rifiuta la sua domanda di lavoro o fornisce una raccomandazione errata comporta gravi conseguenze nel mondo reale.

Gli standard e i framework emergenti del settore incoraggiano ora le organizzazioni a identificare e affrontare attivamente i pregiudizi nei loro sistemi di IA. I rischi colpiscono la tua organizzazione da ogni angolazione:

- Rischio normativo: il mancato rispetto dei nuovi standard di IA può comportare notevoli difficoltà aziendali.

- Danno alla reputazione: una volta che il pubblico viene a sapere che la tua IA è soggetta a pregiudizi, è incredibilmente difficile riconquistare la sua fiducia.

- Inefficienza operativa: i modelli distorti producono risultati inaffidabili o allucinazioni dell'IA che portano a decisioni sbagliate e richiedono costose correzioni.

- Responsabilità etica: la tua organizzazione dovrebbe garantire che la tecnologia implementata tratti tutti gli utenti in modo equo.

Quando si riesce a mitigare correttamente i pregiudizi, si creano sistemi di IA su cui le persone possono davvero fare affidamento. Un'IA equa apre le porte a nuovi mercati, migliora la qualità delle vostre decisioni e dimostra a tutti il vostro impegno a condurre un'attività etica.

📮 ClickUp Insight: il 22% dei nostri intervistati è ancora diffidente nei confronti dell'uso dell'IA sul lavoro. Di questo 22%, la metà è preoccupata per la privacy dei propri dati, mentre l'altra metà semplicemente non è sicura di potersi fidare di ciò che l'IA dice loro.

ClickUp affronta entrambe le preoccupazioni in modo diretto con solide misure di sicurezza e generando collegamenti dettagliati alle attività e alle fonti con ogni risposta.

Ciò significa che anche i team più cauti possono iniziare a godere dell'aumento di produttività senza preoccuparsi della protezione delle loro informazioni o dell'affidabilità dei risultati ottenuti.

📖 Per saperne di più: IA Compliance Assistant: come l'IA sta trasformando la conformità e gli audit

Tipi e fonti di pregiudizi dell'IA

I pregiudizi possono insinuarsi nei tuoi sistemi di IA da più direzioni.

Dal momento in cui inizi a raccogliere dati fino a molto tempo dopo l'implementazione del sistema, questo elemento rimane piuttosto costante. Ma se sai dove cercare, puoi concentrare il tuo lavoro richiesto e smettere di giocare a un gioco infinito di "acchiappa la talpa" con risultati ingiusti.

Pregiudizi di campionamento

Il bias di campionamento si verifica quando i dati utilizzati per addestrare l'IA non rappresentano accuratamente il mondo reale in cui l'IA verrà utilizzata.

Ad esempio, se si crea un sistema di riconoscimento vocale addestrato principalmente su dati provenienti da parlanti di inglese americano, esso avrà naturalmente difficoltà a comprendere persone con accenti scozzesi o indiani, analogamente a come gli LLM favoriscono nomi associati ai bianchi nell'85,1% dei casi nella selezione dei curriculum. Questa sottorappresentazione crea enormi punti ciechi, lasciando il modello impreparato a servire interi gruppi di persone.

Pregiudizi algoritmici

Il bias algoritmico si verifica quando il design del modello o il processo matematico amplificano modelli ingiusti, anche se i dati sembrano neutri.

Il codice postale di una persona non dovrebbe determinare la concessione di un prestito, ma se i codici postali nei dati di addestramento sono fortemente correlati alla razza, l'algoritmo potrebbe imparare a utilizzare la posizione come proxy per la discriminazione.

Questo problema diventa ancora più grave con i feedback loop: quando una previsione distorta (come il rifiuto di un prestito) viene reimmessa nel sistema come nuovo dato, il pregiudizio si intensifica nel tempo.

Pregiudizi nelle decisioni umane

Ogni scelta che una persona compie durante la creazione di un sistema di IA può introdurre pregiudizi.

Ciò include decidere quali dati raccogliere, come etichettarli e come definire l'esito positivo del modello. Ad esempio, un team potrebbe inconsciamente privilegiare i dati che supportano ciò in cui già crede (pregiudizio di conferma) o dare troppo peso alla prima informazione che vede (pregiudizio di ancoraggio).

Anche i team più ben intenzionati possono accidentalmente codificare le proprie supposizioni e la propria visione del mondo in un sistema di IA.

📖 Per saperne di più: 10 modelli di governance di progetto per gestire le attività

Esempi di pregiudizi dell'IA nel mondo reale

Aziende reali hanno subito gravi conseguenze quando i loro sistemi di IA hanno mostrato pregiudizi, causando loro danni per milioni di dollari e la perdita della fiducia dei clienti. Ecco alcuni esempi documentati:

1. Strumenti di reclutamento distorti

Uno dei casi più citati ha riguardato una grande azienda tecnologica che ha eliminato un sistema interno di reclutamento basato sull'IA dopo aver scoperto che favoriva i candidati maschi rispetto alle donne. Il sistema era stato addestrato su un decennio di curriculum in cui la maggior parte dei candidati con esito positivo erano uomini. Così ha iniziato a penalizzare i curriculum che contenevano parole come "donne", arrivando persino a declassare le laureate provenienti da college femminili.

Questo dimostra come i pregiudizi dei dati storici, quando i modelli passati riflettono le disuguaglianze esistenti, possano insinuarsi nell'automazione se non vengono attentamente controllati. Tuttavia, con la diffusione del reclutamento automatizzato basato sull'IA, la portata del problema diventa ancora più grande.

🌼 Lo sapevate? Dati recenti mostrano che il 37% delle organizzazioni sta ora "integrando attivamente" o "sperimentando" strumenti di IA di nuova generazione nel reclutamento, rispetto al 27% di un anno fa.

2. Riconoscimento facciale che non rileva metà della popolazione

Una ricerca condotta da Joy Buolamwini e documentata nello studio Gender Shades ha rivelato che i sistemi commerciali di riconoscimento facciale avevano tassi di errore fino al 34,7% per le donne di pelle scura, rispetto a meno dell'1% per gli uomini di pelle chiara.

Anche in questo caso si tratta di un riflesso di set di dati di addestramento sbilanciati. I pregiudizi negli strumenti biometrici hanno effetti ancora più di vasta portata.

Anche la polizia e le agenzie governative hanno riscontrato problemi di pregiudizi nel riconoscimento facciale. Le indagini condotte dal Washington Post hanno rilevato che alcuni di questi sistemi erano molto più inclini a identificare erroneamente le persone appartenenti a gruppi emarginati. In diversi casi reali, ciò ha portato ad arresti ingiustificati, reazioni negative da parte dell'opinione pubblica e grandi preoccupazioni su come questi strumenti influenzano i diritti delle persone.

📖 Per saperne di più: L'IA sul posto di lavoro: modi per migliorare la produttività e l'efficienza

3. Algoritmi sanitari che sottovalutano l'importanza dell'assistenza

Anche i sistemi di IA sanitari progettati per prevedere quali pazienti necessitano di cure extra hanno mostrato pregiudizi.

In un caso ben documentato, un algoritmo di previsione sanitaria ampiamente utilizzato ha commesso un errore significativo. Doveva aiutare a decidere quali pazienti dovessero ricevere cure extra, ma ha finito per assegnare sistematicamente una priorità inferiore ai pazienti di colore, anche quando erano ugualmente o più malati dei pazienti bianchi.

Ciò è accaduto perché il modello utilizzava la spesa sanitaria come indicatore delle esigenze mediche. Poiché i pazienti di colore avevano storicamente una spesa sanitaria inferiore a causa dell'accesso ineguale alle cure, l'algoritmo li trattava come meno bisognosi. Come risultato, ha sottratto risorse sanitarie a coloro che ne avevano effettivamente più bisogno. I ricercatori hanno scoperto che la semplice correzione di questo indicatore potrebbe aumentare significativamente l'accesso a programmi di assistenza equi.

Le preoccupazioni relative a questi problemi hanno spinto i gruppi per i diritti civili a sollecitare l'adozione di standard che privilegino l'equità nell'IA applicata all'assistenza sanitaria. Nel dicembre 2025, la NAACP ha pubblicato un piano dettagliato in cui invita ospedali, aziende tecnologiche e responsabili politici ad adottare audit sui pregiudizi, pratiche di progettazione trasparenti, strutture inclusive e strumenti di governance dell'IA per evitare l'aggravarsi delle disuguaglianze sanitarie razziali.

4. Algoritmi di credito con risultati diseguali

L'IA e il processo decisionale automatizzato non solo influenzano ciò che vedete sui social media, ma determinano anche chi ha accesso al denaro e a quali condizioni.

Uno degli esempi reali più discussi è quello della Apple Card , una carta di credito digitale emessa da Goldman Sachs.

Nel 2019, alcuni clienti hanno condiviso sui social media che l'algoritmo di limite di credito della scheda assegnava limiti molto più elevati ad alcuni uomini rispetto alle loro mogli o compagne. Ciò accadeva anche quando le coppie dichiaravano profili finanziari simili. Un ingegnere informatico ha affermato di aver ricevuto un limite di credito 20 volte superiore a quello di sua moglie e persino il cofondatore di Apple Steve Wozniak ha confermato un'esperienza simile con sua moglie.

Questi modelli hanno suscitato un'indignazione pubblica e hanno portato a un'indagine normativa da parte del Dipartimento dei servizi finanziari dello Stato di New York per verificare se l'algoritmo discriminasse le donne, evidenziando come gli strumenti finanziari automatizzati possano produrre risultati iniqui.

📖 Per saperne di più: Come utilizzare l'IA per la governance dei dati (casi d'uso e strumenti)

5. Sottotitoli automatici e riconoscimento vocale che escludono alcune voci

I sistemi di riconoscimento vocale e di sottotitolazione automatica spesso non ascoltano tutti allo stesso modo. Diversi studi hanno dimostrato che questi strumenti tendono a funzionare meglio per alcuni parlanti rispetto ad altri, a seconda di fattori quali l'accento, il dialetto, la razza e il fatto che l'inglese sia o meno la lingua madre del parlante.

Ciò accade perché i sistemi commerciali sono solitamente addestrati su set di dati dominati da determinati modelli linguistici, spesso l'inglese occidentale standard, lasciando sottorappresentate altre voci.

Ad esempio, i ricercatori di Stanford hanno testato cinque sistemi di conversione da voce a testo leader (di Amazon, Google, Microsoft, IBM e Apple) e hanno scoperto che commettevano quasi il doppio degli errori nella trascrizione dei discorsi dei parlanti di colore rispetto a quelli dei parlanti bianchi. Il problema si verificava anche quando i soggetti pronunciavano le stesse parole nelle stesse condizioni.

Quando i sottotitoli sono imprecisi per determinati oratori, ciò può portare a esperienze utente scadenti e all'inaccessibilità per le persone che fanno affidamento sui sottotitoli. Peggio ancora, può contribuire a risultati distorti nei sistemi che utilizzano il riconoscimento vocale in contesti lavorativi, educativi o sanitari.

Ciascuno di questi esempi illustra un modo distinto in cui il pregiudizio può essere incorporato nei sistemi automatizzati, attraverso dati di addestramento distorti, proxy scelti in modo errato o test non rappresentativi. In ogni caso, i risultati non sono solo tecnici: essi danno forma alle opportunità, minano la fiducia e comportano rischi reali dal punto di vista aziendale ed etico.

📖 Per saperne di più: Rischi e problemi: qual è la differenza?

Riassunto: Come si manifesta il bias dell'IA e chi ne risente

| Dove si è manifestato il pregiudizio | Chi è stato colpito | Impatto nel mondo reale |

|---|---|---|

| Algoritmi di reclutamento (strumento di assunzione basato sull'IA scartato) | Donne | I curriculum sono stati declassati sulla base di parole chiave legate al genere, riducendo l'accesso ai colloqui e alle opportunità di lavoro. |

| Sistemi di riconoscimento facciale (Gender Shades + casi di arresti illegittimi) | Donne dalla pelle scura; gruppi razziali emarginati | Tassi di errata identificazione molto più elevati hanno portato ad arresti ingiustificati, danni alla reputazione e preoccupazioni relative ai diritti civili. |

| Algoritmi di previsione dei rischi sanitari (studio dell'Università di Chicago) | Pazienti di colore | Ai pazienti è stata negata la priorità per cure extra perché la spesa sanitaria è stata utilizzata come indicatore errato delle esigenze mediche, aggravando le disuguaglianze sanitarie. |

| Algoritmi di limite di credito (indagine Apple Card) | Donne | Gli uomini hanno ricevuto limiti di credito notevolmente più elevati rispetto alle loro partner donne con qualifiche equivalenti, influenzando l'accesso finanziario e il potere di indebitamento. |

| Riconoscimento vocale e sottotitoli automatici (studio ASR di Stanford) | Relatori con accenti non standard; relatori di colore | Errori quasi raddoppiati hanno creato barriere all'accessibilità, comunicazioni errate e risultati distorti negli strumenti utilizzati nelle assunzioni, nell'istruzione e nell'accesso digitale quotidiano. |

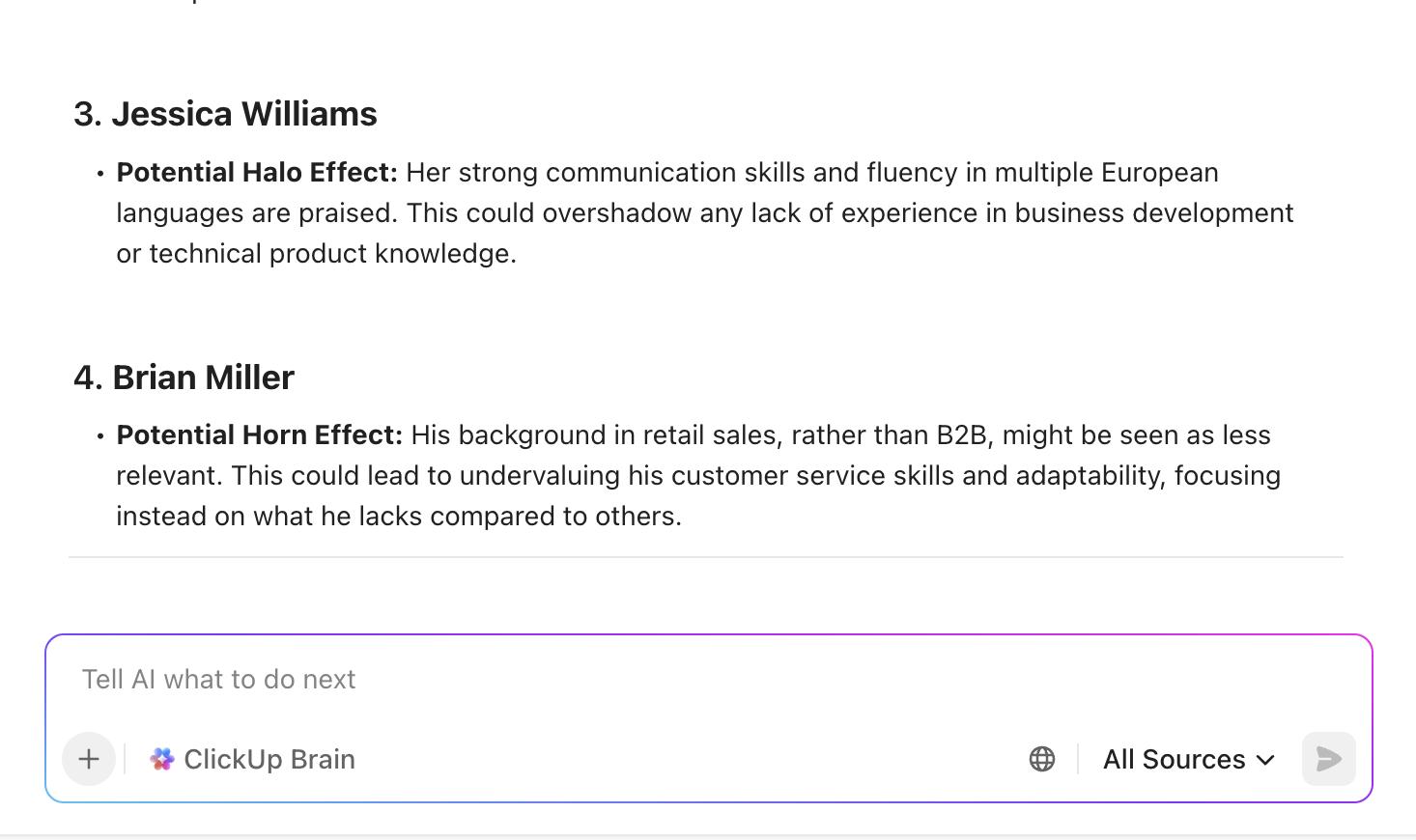

📖 Per saperne di più: Come evitare l'effetto alone e l'effetto corno per mitigare i pregiudizi

Strategie efficaci per mitigare i pregiudizi

Non esiste una soluzione miracolosa per eliminare i pregiudizi dell'IA.

Una mitigazione efficace dei pregiudizi richiede una difesa multilivello da applicare durante l'intero ciclo di vita dell'IA. Combinando queste strategie comprovate, è possibile ridurre drasticamente il rischio di risultati ingiusti.

Raccogli dati di addestramento diversificati

I dati rappresentativi sono il fondamento assoluto di un'IA equa.

Il tuo modello non può imparare a servire gruppi di persone che non ha mai visto durante la sua formazione. Inizia verificando i tuoi set di dati esistenti per individuare eventuali lacune demografiche. Quindi, impegnati in un lavoro richiesto per reperire nuovi dati da quelle popolazioni sottorappresentate.

Quando è difficile trovare dati reali, puoi utilizzare tecniche come l'aumento dei dati (creazione di copie modificate dei dati esistenti) o la generazione di dati sintetici per colmare le lacune.

🚧 Toolkit: utilizza il modello di lista di controllo per l'audit interno di ClickUp per mappare il tuo processo di audit.

Modelli di test per i pregiudizi

È necessario testare sistematicamente i pregiudizi per individuarli prima che causino danni reali. Utilizza metriche di equità per misurare le prestazioni del tuo modello su diversi gruppi.

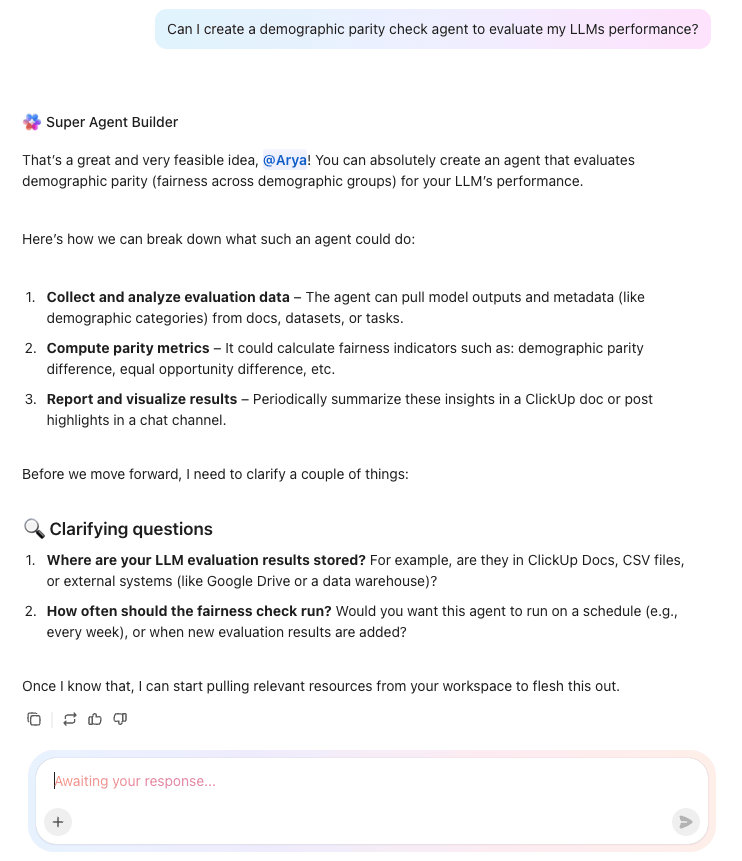

Ad esempio, la parità demografica verifica se il modello produce un risultato positivo (come l'approvazione di un prestito) a tassi uguali tra i vari gruppi, mentre la parità delle probabilità verifica se i tassi di errore sono uguali.

Analizza le prestazioni del tuo modello in base a ogni dato demografico possibile (razza, sesso, età, area geografica) per individuare dove diminuisce l'accuratezza o dove si insinuano le ingiustizie.

Mantieni l'intervento umano nel ciclo

I sistemi automatizzati possono non rilevare sottili ingiustizie specifiche del contesto che una persona individuerebbe immediatamente. Un approccio che coinvolga l'intervento umano è fondamentale per le decisioni ad alto rischio, in cui l'IA può fornire una raccomandazione, ma è una persona a prendere la decisione finale.

Ciò è particolarmente importante in settori quali le assunzioni, i prestiti e le diagnosi mediche. Affinché ciò funzioni, i revisori umani devono essere formati per riconoscere i pregiudizi e avere l'autorità di ignorare i suggerimenti dell'IA.

📖 Per saperne di più: Come utilizzare l'IA incentrata sull'uomo sul posto di lavoro: la guida definitiva

Applica tecniche di equità algoritmica

È inoltre possibile utilizzare metodi tecnici per intervenire direttamente e ridurre i pregiudizi. Queste tecniche si dividono in tre categorie principali:

- Pre-elaborazione: comporta la regolazione dei dati di addestramento prima che il modello li veda, spesso attraverso una nuova ponderazione o un nuovo campionamento dei dati per creare una rappresentazione più equilibrata dei diversi gruppi.

- In-processing: in questo caso, si aggiungono vincoli di equità direttamente nel processo di addestramento del modello, insegnandogli a ottimizzare contemporaneamente sia l'accuratezza che l'equità.

- Post-elaborazione: significa regolare le previsioni finali del modello dopo che sono state formulate, per garantire che i risultati siano equi tra i vari gruppi.

Queste tecniche comportano spesso un compromesso, in cui può essere necessaria una leggera diminuzione della precisione complessiva per ottenere un significativo aumento dell'equità.

💟 Bonus: BrainGPT è il tuo compagno desktop basato sull'IA che porta i test di parzialità dell'IA a un livello superiore, offrendoti l'accesso a diversi modelli leader, tra cui GPT-5, Claude, Gemini e altri, tutti in un unico posto.

Ciò significa che puoi facilmente eseguire gli stessi prompt o scenari su modelli diversi, confrontare le loro capacità di ragionamento e individuare dove le risposte divergono o mostrano pregiudizi. Questa super app di IA ti consente anche di utilizzare la funzione talk-to-text per impostare casi di test, documentare i tuoi risultati e organizzare i risultati per un'analisi comparativa.

I suoi strumenti avanzati di ragionamento e sensibili al contesto ti aiutano a risolvere i problemi, evidenziare modelli e comprendere come ogni modello affronta argomenti delicati. Centralizzando il tuo flusso di lavoro e consentendo test trasparenti e multimodello, Brain MAX ti consente di verificare, confrontare e affrontare i pregiudizi dell'IA con sicurezza e precisione.

Aumenta la trasparenza e la spiegabilità

Se non sai come il tuo modello prende le decisioni, non puoi correggerlo quando sbaglia. Le tecniche di IA spiegabile (XAI) ti aiutano a sbirciare all'interno della "scatola nera" e vedere quali funzionalità dei dati stanno guidando le previsioni.

Puoi anche creare schede modello, simili alle etichette nutrizionali per la tua IA, che documentano l'uso previsto, i dati sulle prestazioni e i limiti noti.

📮ClickUp Insight: il 13% dei partecipanti al nostro sondaggio desidera utilizzare l'IA per prendere decisioni difficili e risolvere problemi complessi. Tuttavia, solo il 28% dichiara di utilizzare regolarmente l'IA sul lavoro. Una possibile ragione: preoccupazioni relative alla sicurezza!

Gli utenti potrebbero non voler effettuare la condivisione di dati sensibili relativi al processo decisionale con un'IA esterna.

ClickUp risolve questo problema portando la risoluzione dei problemi basata sull'IA direttamente nell'area di lavoro sicura. Dagli standard SOC 2 agli standard ISO, ClickUp è conforme ai più elevati standard di sicurezza dei dati e ti aiuta a utilizzare in modo sicuro la tecnologia di IA generativa in tutto il tuo spazio di lavoro.

Politiche di governance e responsabilità dell'IA

Un solido programma di governance dell'IA crea una chiara titolarità e standard coerenti che tutti i membri del team possono seguire.

La tua organizzazione ha bisogno di strutture di governance chiare per garantire che qualcuno sia sempre responsabile della creazione e dell'implementazione etica dell'IA.

Ecco gli elementi essenziali di un programma di governance dell'IA efficace:

| Elemento di governance | Cosa significa | Passaggi concreti per la tua organizzazione |

|---|---|---|

| Chiara titolarità | Persone o team dedicati sono responsabili dell'etica, della supervisione e della conformità dell'IA. | • Nomina un responsabile dell'etica dell'IA o un comitato interfunzionale • Definisci le responsabilità relative a dati, qualità dei modelli, conformità e rischi • Includi le opinioni dei reparti legale, tecnico, prodotti e DEI nella supervisione |

| Politiche documentate | Linee guida scritte che definiscono come i dati vengono raccolti, utilizzati e monitorati durante tutto il ciclo di vita dell'IA. | • Crea politiche interne per l'origine dati, l'etichettatura, la privacy e la conservazione dei dati • Documenta gli standard per lo sviluppo, la convalida e l'implementazione dei modelli • Richiedi ai team di seguire le liste di controllo prima di distribuire qualsiasi sistema di IA |

| Percorsi di audit | Una registrazione trasparente delle decisioni, delle versioni dei modelli, dei set di dati e delle modifiche | • Implementa il controllo delle versioni per i set di dati e i modelli • Registra le decisioni chiave, i parametri dei modelli e rivedi i risultati • Archivia le tracce di audit in un repository centrale e accessibile |

| Revisioni periodiche | Valutazioni continue dei sistemi di IA per verificare la presenza di pregiudizi, derive e lacune di conformità | • Pianifica valutazioni trimestrali o semestrali dei pregiudizi tramite una solida valutazione LLM • Riqualifica o ricalibra i modelli quando le prestazioni diminuiscono o il comportamento cambia • Rivedi i modelli dopo importanti aggiornamenti dei dati o modifiche ai prodotti |

| Piano di risposta agli incidenti | Un protocollo chiaro per identificare, effettuare la reportistica e correggere i pregiudizi o i danni causati dall'IA. | • Crea un flusso di lavoro interno per la segnalazione dei pregiudizi • Definisci come vengono esaminati i problemi e chi approva le soluzioni • Delinea i passaggi di comunicazione per utenti, clienti o autorità di regolamentazione, quando necessario |

💡Suggerimento professionale: framework come il NIST AI Risk Management Framework e l'Unione europea AI Act, con multe fino al 7% del fatturato annuo, possono fornire ottimi modelli per sviluppare il tuo programma di governance.

Come implementare la mitigazione dei pregiudizi con ClickUp

L'area di lavoro AI convergente di ClickUp riunisce tutte le parti mobili del tuo programma di governance dell'IA in un unico spazio di lavoro organizzato.

I tuoi team possono gestire le attività, archiviare le politiche, esaminare i risultati degli audit, discutere i rischi e effettuare il monitoraggio degli incidenti senza dover passare da uno strumento all'altro o perdere il contesto. Ogni record del modello, registro delle decisioni e piano di correzione rimane collegato, in modo da sapere sempre chi ha fatto cosa e perché.

E poiché l'IA di ClickUp comprende il lavoro all'interno del tuo spazio di lavoro, può riportare in superficie valutazioni passate, riepilogare lunghi rapporti e aiutare il tuo team a rimanere allineato man mano che gli standard evolvono. Il risultato è un sistema di governance più facile da seguire, più facile da controllare e molto più affidabile man mano che la tua impronta IA cresce.

Analizziamolo come un flusso di lavoro!

Passaggio 1: configura il tuo spazio di lavoro per la governance dell'IA

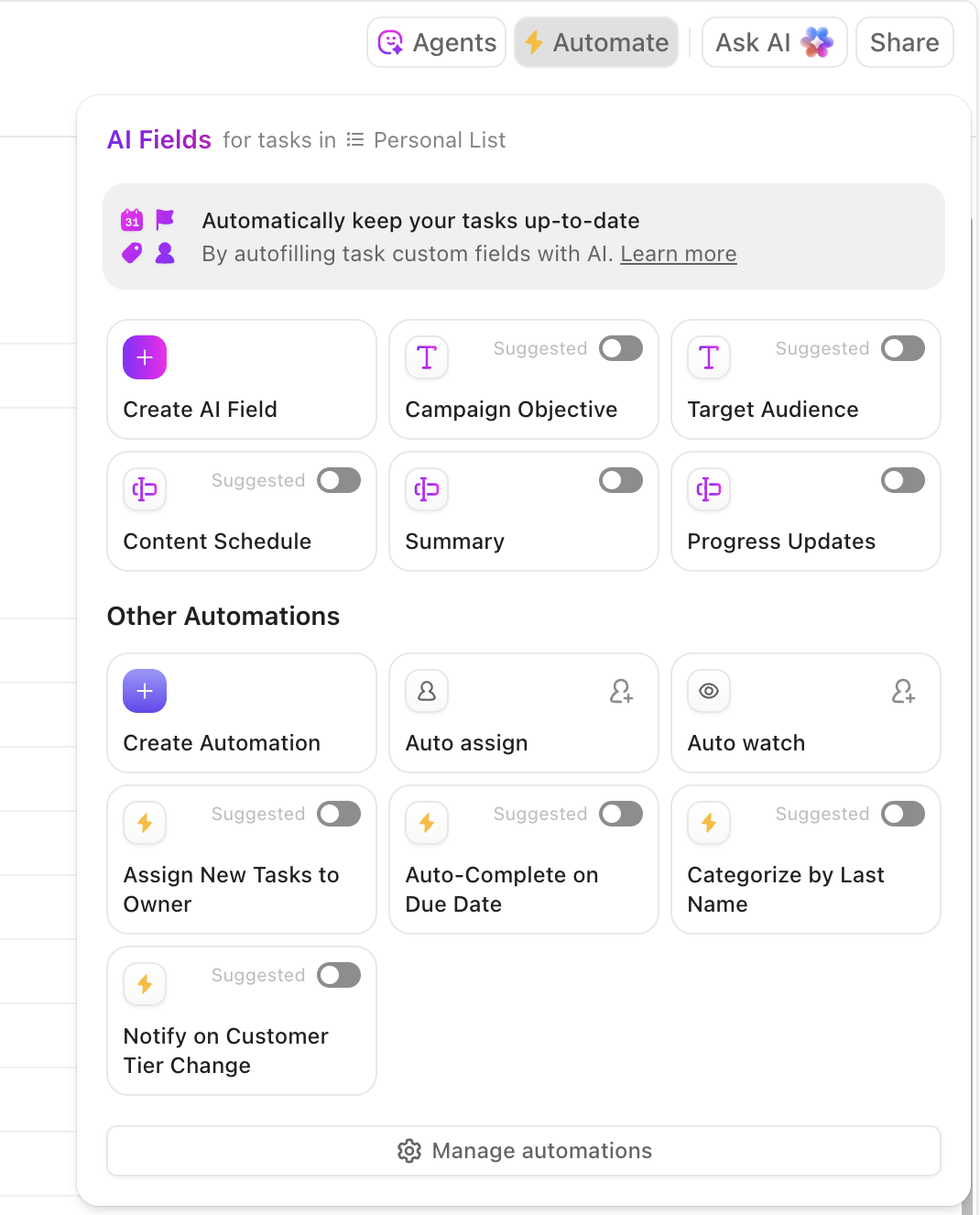

Inizia creando uno spazio dedicato in ClickUp per tutto il lavoro relativo alla governance. Aggiungi elenchi per l'inventario dei modelli, le valutazioni dei pregiudizi, i rapporti sugli incidenti, i documenti relativi alle politiche e le revisioni programmate, in modo che ogni elemento del programma risieda in un unico ambiente controllato.

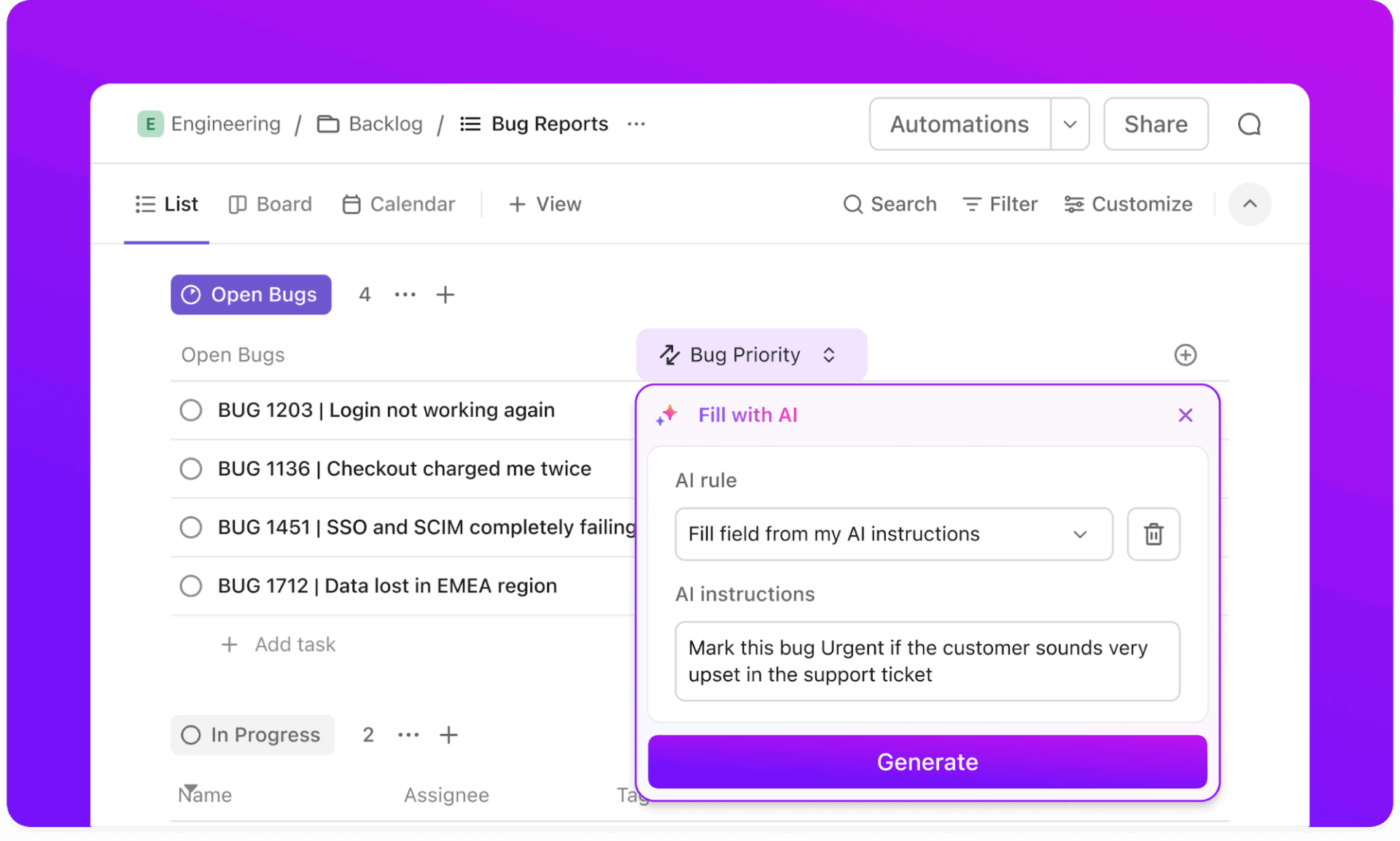

Configura campi personalizzati o campi con l'IA per effettuare il monitoraggio di metriche di equità, punteggi di distorsione, versioni dei modelli, stato delle revisioni e livelli di rischio. Utilizza autorizzazioni basate sui ruoli per garantire che solo revisori, ingegneri e responsabili della conformità autorizzati possano accedere a lavori sensibili relativi all'IA. Ciò crea una base strutturale che gli strumenti specifici della concorrenza e le piattaforme di progetto generiche non sono in grado di offrire.

Passaggio 2: crea il tuo quadro di governance

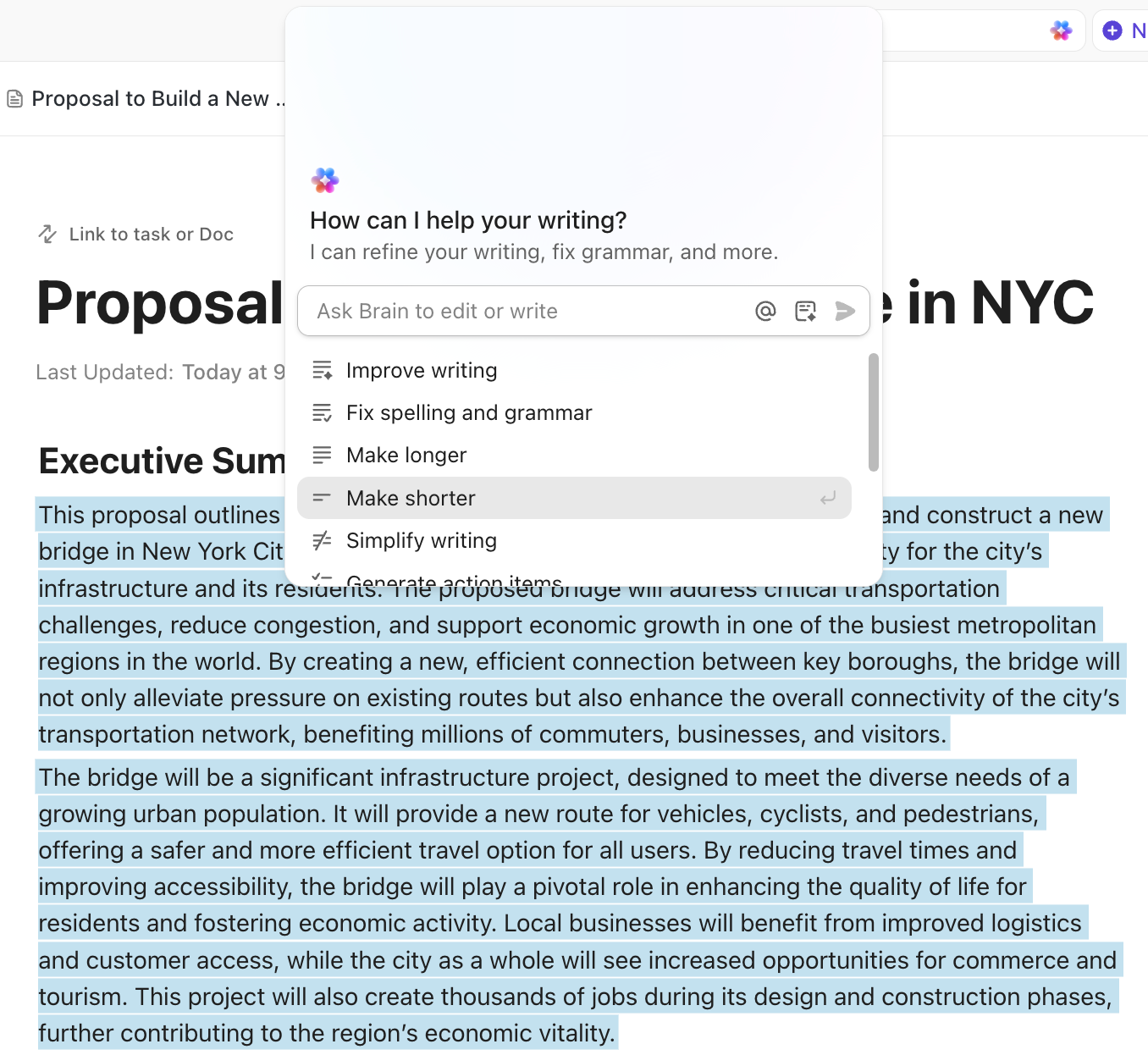

Successivamente, crea un documento ClickUp che fungerà da manuale di governance dinamico. Qui potrai delineare le procedure di valutazione dei pregiudizi, le soglie di equità, le linee guida per la documentazione dei modelli, i passaggi di intervento umano e i protocolli di escalation.

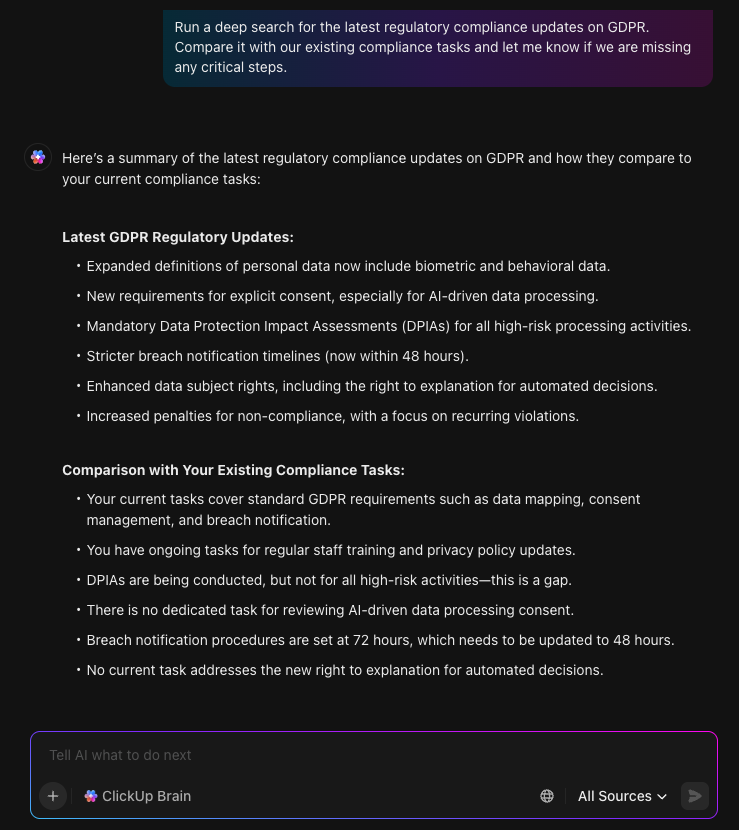

Poiché i documenti rimangono collegati alle attività e ai record dei modelli, i tuoi team possono collaborare senza perdere la cronologia delle versioni o disperdere i file tra diversi strumenti. Inoltre, ClickUp Brain può aiutare a riepilogare le normative esterne, redigere nuove bozze di politiche o riportare alla luce i risultati di precedenti audit, rendendo la creazione delle politiche più coerente e tracciabile.

Grazie alla possibilità di effettuare ricerche sul web, passare da un modello di IA all'altro e sintetizzare le informazioni in indicazioni chiare, il tuo team rimane al passo con gli standard emergenti e i cambiamenti del settore senza lasciare l'area di lavoro. Tutto ciò di cui hai bisogno, aggiornamenti delle politiche, approfondimenti normativi e decisioni passate, è riunito in un unico posto, rendendo il tuo sistema di governance più stabile e molto più facile da mantenere.

Passaggio 3: Registrare ogni modello

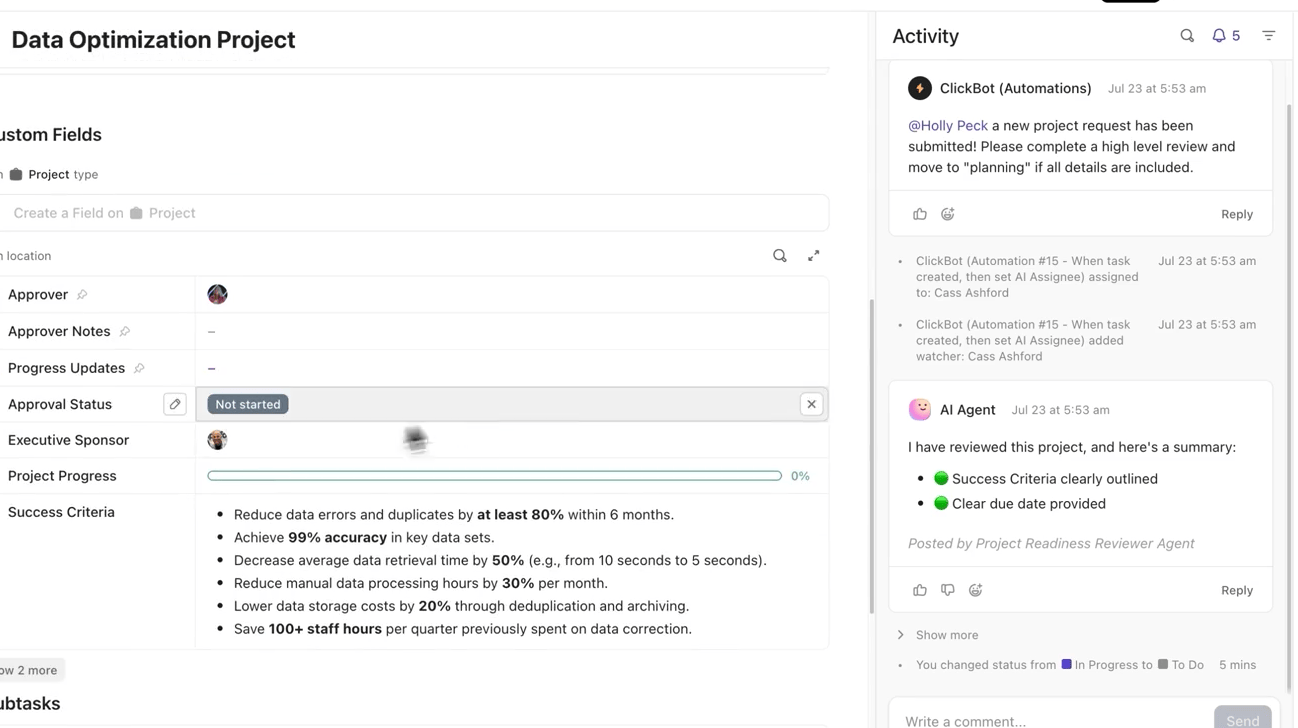

Ogni modello dovrebbe avere una propria attività nell'elenco "Inventario dei modelli", in modo che la titolarità e la responsabilità siano sempre chiare.

Effettua facilmente il monitoraggio di ogni incidente di pregiudizio come elemento utilizzabile utilizzando le attività di ClickUp e i campi personalizzati per strutturare i tuoi flussi di lavoro di valutazione dei pregiudizi e catturare ogni dettaglio importante.

In questo modo, potrai effettuare il monitoraggio del tipo di pregiudizio, del livello di gravità, dello stato della correzione, del membro del team responsabile e della data della prossima revisione, assicurandoti che ogni problema abbia una titolarità chiara e una scadenza.

Allega set di dati, riepiloghi di valutazione e note di provenienza in modo che tutto sia raccolto in un unico posto. Le automazioni possono quindi avvisare i revisori ogni volta che un modello passa alla fase di staging o produzione.

Passaggio 4: Eseguire audit di parzialità programmati e basati sugli eventi

Gli audit sui pregiudizi dovrebbero essere effettuati sia con cadenza regolare sia in risposta a specifici trigger.

Imposta regole semplici tramite ClickUp Automazioni che triggerano automaticamente attività di revisione ogni volta che un modello raggiunge una nuova attività cardine di implementazione o è prevista una verifica programmata. Non perderai mai più una valutazione trimestrale dei pregiudizi, poiché Automazioni può assegnare i revisori giusti, impostare le scadenze corrette e persino inviare promemoria quando si avvicinano le date di scadenza.

Per gli audit basati sugli eventi, ClickUp Forms semplifica la raccolta di segnalazioni di incidenti di pregiudizio o feedback umani, mentre i revisori utilizzano i campi personalizzati per registrare le lacune in termini di equità, i risultati dei test e le raccomandazioni. Ogni modulo inviato viene inoltrato al tuo team come attività, creando un percorso di audit ripetibile.

Passaggio 5: Indagare e risolvere gli incidenti di pregiudizio

Quando viene identificato un problema di pregiudizio, crea un'attività di incidente che ne catturi la gravità, i gruppi interessati, la versione del modello e il lavoro di mitigazione richiesto. Gli agenti di IA possono segnalare i risultati ad alto rischio ai responsabili della conformità e assegnare i revisori e gli ingegneri appropriati.

Ogni azione di mitigazione, risultato dei test e passaggio di convalida rimane collegato alla registrazione dell'incidente. ClickUp Brain può generare riassunti per la leadership o aiutare a preparare note di correzione per la tua documentazione di governance, mantenendo tutto trasparente e tracciabile.

Passaggio 6: monitorare lo stato di salute del programma di governance dell'IA

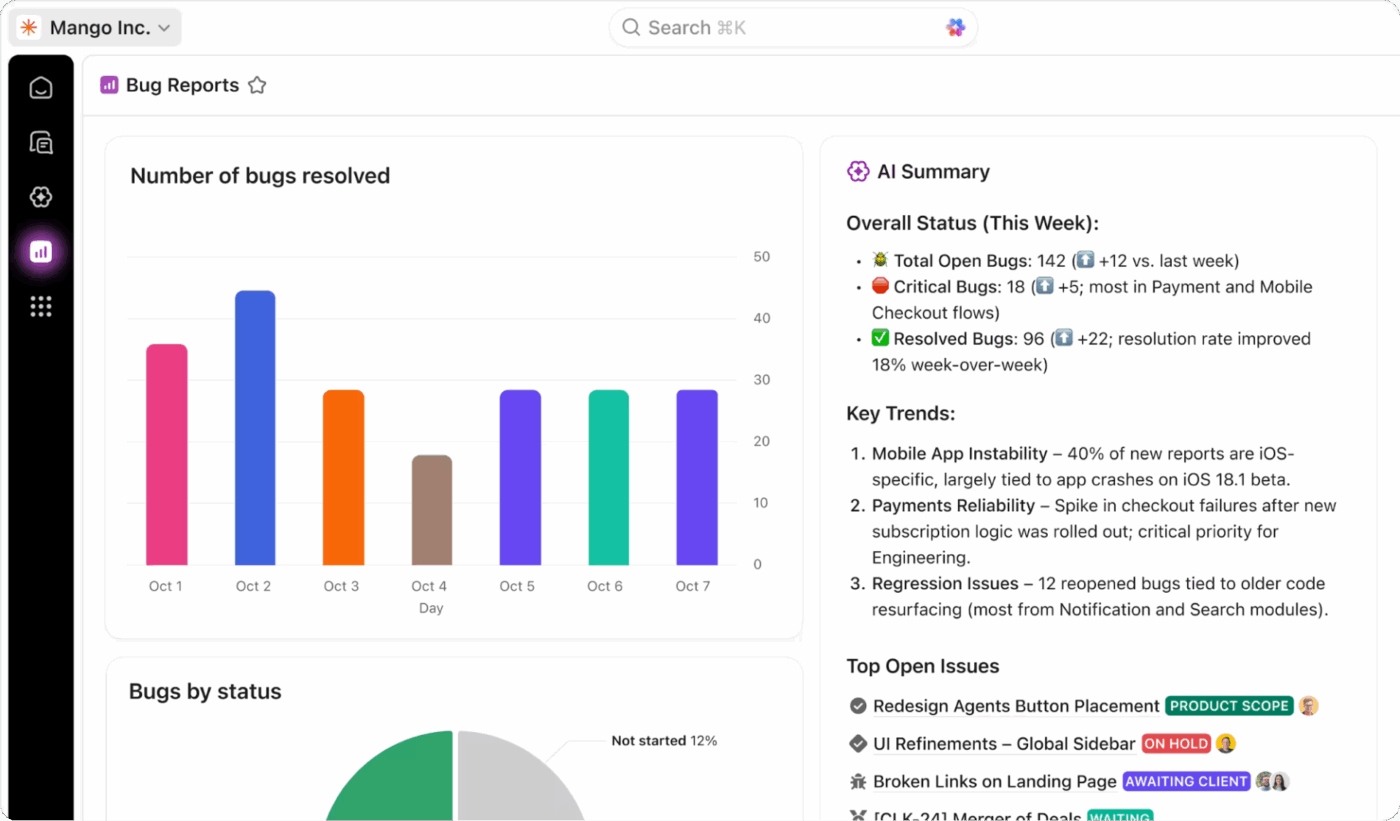

Infine, crea dashboard che permettano ai leader di visualizzare in tempo reale il tuo programma di mitigazione dei pregiudizi.

Includi pannelli che mostrano gli incidenti aperti, i tempi di risoluzione, i tassi di completamento degli audit, le metriche di equità e lo stato di conformità di tutti i modelli attivi. Le dashboard senza codice di ClickUp possono estrarre automaticamente i dati e aggiornare le attività man mano che il lavoro procede, con riepiloghi dell'IA integrati nella vista della dashboard.

📖 Per saperne di più: Come superare le sfide comuni dell'IA

Controlli di parzialità post-implementazione

Il tuo lavoro non è terminato quando il modello di IA diventa operativo.

In realtà, è proprio qui che inizia la vera sfida. I modelli possono "derivare" e sviluppare nuovi pregiudizi nel tempo, man mano che i dati reali che vedono iniziano a cambiare. Il monitoraggio continuo è l'unico modo per individuare questi pregiudizi emergenti prima che causino danni diffusi.

Ecco cosa dovrebbe includere il tuo monitoraggio continuo:

| Pratica | Cosa garantisce |

|---|---|

| Monitoraggio delle prestazioni per gruppo | Misura continuamente l'accuratezza e l'equità del modello in tutti i segmenti demografici, in modo da individuare tempestivamente eventuali disparità. |

| Rilevamento della deriva dei dati | Monitora i cambiamenti nei dati di input che potrebbero introdurre nuovi pregiudizi o indebolire le prestazioni del modello nel tempo. |

| Feedback loop degli utenti | Fornisce canali chiari agli utenti per segnalare risultati distorti o errati, migliorando la supervisione nel mondo reale. |

| Audit programmati | Garantisce analisi approfondite trimestrali o semestrali sul comportamento dei modelli, sulle metriche di equità e sui requisiti di conformità. |

| Risposta agli incidenti | Definisce un processo strutturato per indagare, correggere e documentare eventuali eventi di pregiudizio segnalati. |

💟 Bonus: i sistemi di IA generativa, in particolare, richiedono una maggiore vigilanza perché i loro risultati sono molto meno prevedibili rispetto ai modelli tradizionali di apprendimento automatico. Una tecnica molto efficace in questo senso è il red teaming, in cui un team dedicato cerca attivamente di provocare risposte distorte o dannose dal modello per identificarne i punti deboli.

Ad esempio, il progetto Lighthouse di Airbnb è un ottimo esempio nel settore di un'azienda che implementa un monitoraggio sistematico dei pregiudizi post-implementazione.

Si tratta di un'iniziativa di ricerca che esamina come la percezione della razza possa influenzare i risultati delle prenotazioni, aiutando l'azienda a identificare e ridurre la discriminazione sulla piattaforma. Utilizza metodi che garantiscono la privacy, collabora con gruppi per i diritti civili e traduce i risultati in modifiche ai prodotti e alle politiche, consentendo a un maggior numero di ospiti di navigare sulla piattaforma senza incontrare ostacoli invisibili.

📖 Per saperne di più: IA generativa vs IA predittiva: comprendere le loro differenze e applicazioni

Mitiga i pregiudizi dell'IA con ClickUp

La creazione di un'IA equa e responsabile è un impegno organizzativo.

Quando le tue politiche, le persone, i processi e gli strumenti lavorano in armonia, crei un sistema di governance in grado di adattarsi ai nuovi rischi, rispondere rapidamente agli incidenti e guadagnare la fiducia delle persone che si affidano ai tuoi prodotti.

Grazie a revisioni strutturate, documentazione chiara e un flusso di lavoro ripetibile per la gestione dei pregiudizi, i team rimangono allineati e responsabili, invece di reagire in modalità di crisi.

Centralizzando tutto all'interno di ClickUp, dai record dei modelli ai risultati degli audit ai rapporti sugli incidenti, crei un unico livello operativo in cui le decisioni sono trasparenti, le responsabilità sono chiare e i miglioramenti non vanno mai persi nel trambusto.

Una governance forte non rallenta l'innovazione, ma la stabilizza. Sei pronto a integrare la mitigazione dei pregiudizi nei tuoi flussi di lavoro di IA? Inizia gratis con ClickUp e crea oggi stesso il tuo programma di governance dell'IA.

Domande frequenti

Un ottimo primo passaggio è quello di condurre una verifica dei pregiudizi dei tuoi attuali sistemi di IA. Questa valutazione di base ti mostrerà dove esistono attualmente delle ingiustizie e ti aiuterà a stabilire le priorità dei tuoi sforzi di mitigazione.

I teams utilizzano metriche di equità specifiche, come la parità demografica, le probabilità equalizzate e il rapporto di impatto disparato, per quantificare il bias. La metrica giusta dipende dal tuo caso d'uso specifico e dal tipo di equità più importante in quel contesto.

È sempre opportuno aggiungere un passaggio di revisione umana per le decisioni ad alto rischio che influenzano in modo significativo la vita o le opportunità di una persona, come nell'assunzione, nella concessione di prestiti o nell'assistenza sanitaria. È inoltre consigliabile utilizzarlo durante la fase iniziale di implementazione di qualsiasi nuovo modello, quando il suo comportamento è ancora imprevedibile.

Poiché l'IA generativa può produrre un intervallo quasi infinito di risposte imprevedibili, non è possibile limitarsi a verificarne l'accuratezza. È necessario utilizzare tecniche di analisi attiva come il red teaming e il campionamento su larga scala dei risultati per scoprire se il modello produce contenuti distorti in condizioni diverse.