Sie haben Stunden damit verbracht, den „perfekten“ Prompt zu entwickeln. Sie haben die Vision, das Modell und das Potenzial für einen enormen Gewinn bei der Produktivität. Doch eine kleine Änderung bringt Ihre Ergebnisse aus der Bahn. Ohne eine standardisierte Methode zur Bewertung der Ergebnisse können Sie nicht feststellen, ob sich Ihre KI tatsächlich verbessert oder nur verändert.

Tatsächlich kann laut dem „Prompting Science Report“ der Wharton School bereits eine einfache Umformulierung einer Eingabeaufforderung die Leistung um bis zu 60 Prozentpunkte verändern.

Dieser Leitfaden führt Sie durch die besten Vorlagen für Leistungsbenchmarks von Prompts in ClickUp. Dies sind Ihre wiederverwendbaren Vorlagen, um Ergebnisse zu bewerten, die Nachverfolgung jeder Iteration durchzuführen und schließlich Ihre Bewertungsdaten mit der Arbeit in Ihrem ClickUp-Workspace zu verbinden. ✨

Vorlagen für Leistungsbenchmarks für Prompts auf einen Blick

Hier finden Sie einen kurzen Überblick über die in diesem Leitfaden behandelten Vorlagen für Leistungsbenchmarks von Prompts und den Teil des Workflows zur Bewertung, den jede einzelne unterstützt 👇

| Vorlage | Download-Link | Ideal für | Wichtigste Features |

|---|---|---|---|

| Vorlage für Benchmark-Analysen von ClickUp | Kostenlose Vorlage herunterladen | Vergleich von Prompt-Varianten und Bewertung der Ergebnisse | Visuelle Benchmarking-Arbeitsfläche, Bewertungsfelder, Analyse mit mehreren Ansichten |

| Vorlage für den Versuchsplan und die Ergebnisse von ClickUp | Kostenlose Vorlage herunterladen | Durchführung strukturierter Prompt-Experimente | Nachverfolgung der Hypothesen, Protokollierung des Setups, Dokumentation der Ergebnisse |

| Vorlage für das Testmanagement von ClickUp | Kostenlose Vorlage herunterladen | Verwaltung umfangreicher Bewertungsworkflows | Testfall-Nachverfolgung, Status der Ausführungsphase, Auslöser der Automatisierung |

| Testfall-Vorlage von ClickUp | Kostenlose Vorlage herunterladen | Dokumentation detaillierter Prompt-Fehler | Protokollierung von Ein- und Ausgabedaten, Vergleich von Soll- und Ist-Werten, Nachverfolgung von Bestanden/Nicht bestanden |

| Vorlage für Leistungsberichte von ClickUp | Kostenlose Vorlage herunterladen | Kommunikation der Benchmark-Ergebnisse an die Stakeholder | Zusammenfassungen, Datenvisualisierung, Empfehlungsabschnitte |

| Vorlage für Aktivitätsberichte von ClickUp | Kostenlose Vorlage herunterladen | Nachverfolgung des Fortschritts bei der Bewertung und des Workloads | Aktivitätsprotokolle, zeitbasierte Filterung, Sichtbarkeit der Workload |

| Vorlage für Balanced Scorecards von ClickUp | Kostenlose Vorlage herunterladen | Abstimmung der Prompt-Leistung auf die Geschäftsziele | Mehrdimensionale Bewertung, gewichtete Metriken, Strategie-Mapping |

| Vorlage zur Bewertung von Projekten von ClickUp | Kostenlose Vorlage herunterladen | Verbesserung der Benchmarking-Prozesse im Laufe der Zeit | Prozessbewertung, gewonnene Erkenntnisse, Nachverfolgung des Risikos |

| Vorlage für heuristische Überprüfungen von ClickUp | Kostenlose Vorlage herunterladen | Durchführung qualitativer Bewertungen von KI-Ergebnissen | Heuristische Kategorien, Bewertungen des Schweregrads, Erfassung von Expertenfeedback |

| Vorlage für Unternehmens-OKRs und -Ziele von ClickUp | Kostenlose Vorlage herunterladen | Verknüpfung von Benchmark-Ergebnissen mit strategischen Zielen | OKR-Hierarchie, Nachverfolgung des Fortschritts, teamübergreifende Sichtbarkeit |

🧠 Wissenswertes: Der Begriff „Benchmark“ stammt ursprünglich nicht aus Teams in der Software- oder Produktentwicklung. Im 19. Jahrhundert bezeichnete er zunächst einen Bezugspunkt für Vermessungsingenieure – lange bevor er zum Standard für die Messung von Alles wurde, von Website-Experimenten bis hin zur Leistung von Prompts.

Was ist eine Vorlage für Leistungsbenchmarks?

Eine Vorlage für einen Leistungsvergleich von Prompts ist ein Rahmenwerk zur Bewertung, zum Vergleich und zur Einstufung von KI-Prompt-Ergebnissen. Sie dient dazu, zu messen, ob ein KI-Prompt tatsächlich funktioniert oder sich mit jedem Modell-Update unbemerkt verschlechtert.

Stellen Sie sich das als standardisiertes Setup vor:

- Es definiert, was Sie testen

- Wie Sie Erfolg messen

- Welche Eingaben Sie verwenden

- So erfassen Sie Ergebnisse

👀 Wussten Sie schon? Eines der berühmtesten Experimente in der Statistik begann mit einer Debatte darüber, ob zuerst Milch oder Tee eingegossen werden sollte. Ronald Fisher verwandelte diese kleine Meinungsverschiedenheit in einen formalen Test mit zufällig angeordneten Tassen, und so entstand eine der klassischen Geschichten hinter dem modernen Versuchsdesign.

Was macht eine gute Vorlage für einen Leistungsvergleich von Prompts aus?

Eine gute Prompt-Vorlage muss bestimmte Aufgaben gut erledigen, sonst verstaubt sie nach dem ersten Sprint:

- Standardisierte Bewertungskriterien: Definieren Sie Dimensionen wie Genauigkeit, Relevanz, Tonfall und Halluzinationsrate, bevor mit den Tests begonnen wird. Ohne vordefinierte Bewertungsrubriken bewertet jeder Prüfer anders, und die Ergebnisse sind nicht vergleichbar.

- Nachverfolgung der Versionen: Jeder Benchmark-Lauf muss mit einer bestimmten Prompt-Version, einem bestimmten Modell und einem bestimmten Satz an Parametern verknüpft sein, damit Sie nachvollziehen können, was sich geändert hat und warum.

- Sowohl numerische als auch qualitative Bewertung: Eine sachlich korrekte Antwort kann dennoch roboterhaft klingen. Die besten Vorlagen kombinieren numerische Bewertungen mit strukturierten schriftlichen Notizen, die nebeneinander stehen.

- Vergleichsfähige Struktur: Sie sollten zwei Prompt-Versionen nebeneinander platzieren und Unterschiede sofort erkennen können

- Umsetzbare Ergebnisse: Ein Benchmark, der mit „Bewertung: 7/10“ endet, ist unvollständig. Die Bewerter müssen eine Notiz machen, warum eine Bewertung zu diesem Ergebnis geführt hat und was als Nächstes geändert werden sollte.

- Verbindung zur Arbeit: Benchmark-Ergebnisse verlieren in einem Silo schnell ihren Kontext. Die Vorlage funktioniert am besten, wenn sie mit den Aufgaben und Workflows verknüpft ist, in denen die Prompt-Entwicklung tatsächlich stattfindet.

📮ClickUp Insight: 92 % der Wissensarbeiter laufen Gefahr, wichtige Entscheidungen zu verlieren, die über Chats, E-Mails und Tabellenkalkulationen verstreut sind. Ohne ein einheitliches System zur Erfassung und Nachverfolgung von Entscheidungen gehen wichtige geschäftliche Erkenntnisse im digitalen Rauschen unter. Mit den Funktionen für die Aufgabenverwaltung von ClickUp müssen Sie sich darüber keine Sorgen mehr machen. Erstellen Sie Aufgaben aus Chats, Aufgabenkommentaren, Dokumenten und E-Mails mit einem einzigen Klick!

📮ClickUp Insight: 92 % der Wissensarbeiter laufen Gefahr, wichtige Entscheidungen zu verlieren, die über Chats, E-Mails und Tabellenkalkulationen verstreut sind. Ohne ein einheitliches System zur Erfassung und Nachverfolgung von Entscheidungen gehen wichtige geschäftliche Erkenntnisse im digitalen Rauschen unter. Mit den Aufgabenverwaltungsfunktionen von ClickUp müssen Sie sich darüber keine Sorgen mehr machen. Erstellen Sie Aufgaben aus Chats, Aufgabenkommentaren, Dokumenten und E-Mails mit einem einzigen Klick!

10 Vorlagen für Leistungsbenchmarks für Ihr Team

Jede der unten aufgeführten Vorlagen behandelt einen anderen Aspekt des Leistungsbenchmarkings für Prompts – von detaillierten Testfällen bis hin zur strategischen Berichterstellung. Einige sind speziell für das Benchmarking entwickelt worden; andere sind anpassungsfähige Frameworks, die Engineering-Teams dazu anregen, sie für Workflows zur Bewertung umzufunktionieren.

Schauen wir uns das einmal an:

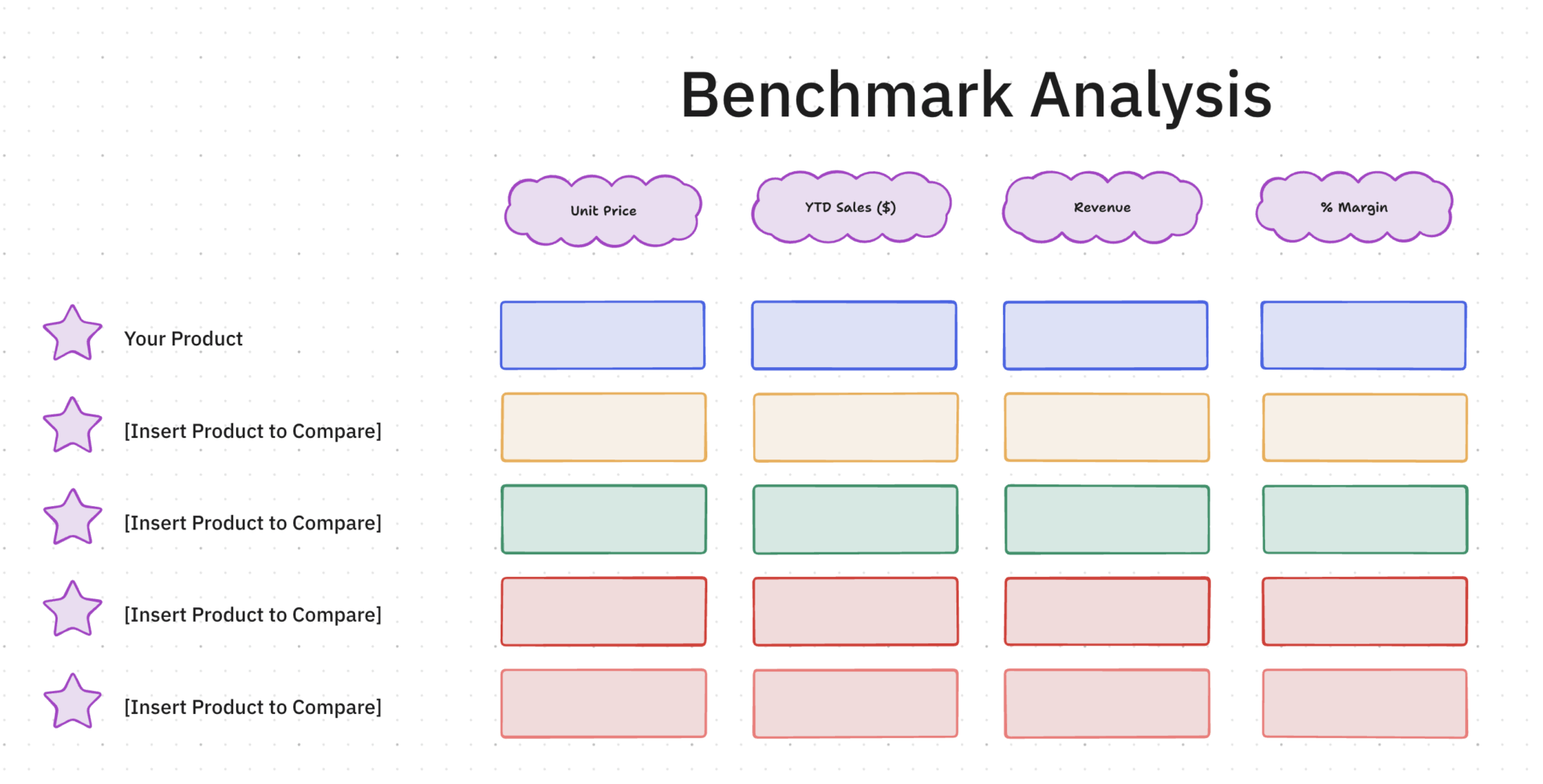

1. Vorlage für Benchmark-Analysen von ClickUp™

Die Bewertung der Prompt-Leistung wird ohne eine feste Vergleichsbasis meist zu einem subjektiven Durcheinander. Wenn Sie sich die Ausgaben nur durchlesen, werden Sie nie wirklich wissen, welche logische Anpassung eine Halluzination behoben oder eine Antwort verbessert hat.

Die Benchmark-Analysevorlage von ClickUp™ fungiert als visuelles Auswertungslabor auf einem ClickUp-Whiteboard. Damit können Sie Prompt-Varianten, Bewertungsrubriken und Modellergebnisse auf einer einzigen unendlichen Leinwand darstellen, sodass Sie Muster in der Modelllogik erkennen können, die in einer Standard-Listenansicht verborgen blieben.

✨ Warum dir diese Vorlage gefallen wird

- Benutzerdefinierte Bewertungsfelder: Ordnen Sie jede Bewertungsdimension (sachliche Genauigkeit, Antwortlänge und Häufigkeit von Halluzinationen) einem eigenen benutzerdefinierten ClickUp-Feld zu.

- Mehrere Ansichten: Wechseln Sie zwischen der ClickUp-Tabellenansicht zum Vergleich von Rohdaten, der ClickUp-Board-Ansicht zur statusbasierten Nachverfolgung (Zur Überprüfung ausstehend → Bewertet → Iteration erforderlich) und über 15 anpassbaren ClickUp-Ansichten.

- Nachverfolgung: Jeder Benchmark-Lauf ist eine Aufgabe mit vollständigem Verlauf, sodass Sie durch vergangene Bewertungen scrollen können, ohne sich durch nach Versionen benannte Tabellenkalkulationen wühlen zu müssen

✅ Ideal für: KI-Forscher und Prompt-Engineers, die strenge A/B-Tests über mehrere Modellvarianten, Produktionslogik und Anwendungsfälle mit sensiblen Daten hinweg koordinieren.

⚡️ Möchten Sie aus weiteren Vorlagen für Benchmark-Analysen wählen? Wir haben hier eine Liste für Sie zusammengestellt: Kostenlose Vorlagen für Benchmark-Analysen für Teams

2. Vorlage für den Versuchsplan und die Ergebnisse von ClickUp

Wie führt man einen Benchmark für einen Prompt durch, ohne die Bedingungen hinter seiner Leistung zu verschleiern? Die Vorlage „Experimentplan und Ergebnisse“ von ClickUp verleiht der Übung methodische Stringenz. In dieser Vorlage beginnt jeder Prompt-Versuch mit einer formulierten Hypothese, einem Setup und einer Aufzeichnung der Änderungen zwischen den Durchläufen.

Sobald Ergebnisse eintreffen, verwandelt die Vorlage vereinzelte Beobachtungen in eine lückenlose Nachverfolgungskette. Prompt-Varianten, Benchmark-Kriterien und Ergebnisnotizen bleiben mit demselben Workflow verknüpft, sodass Ihr Team einen klareren Überblick über die Leistung erhält.

✨ Warum dir diese Vorlage gefallen wird

- Standardisieren Sie die Übermittlung von Benchmarks: Nutzen Sie ClickUp Formulare, um jede Prompt-Variante, jedes Testziel, jede Bewertungsrubrik und jedes Randfallszenario in einem einheitlichen Übermittlungsflow zu sammeln, bevor die Bewertung beginnt.

- Machen Sie jeden Prompt-Lauf zu einer nachverfolgbaren Aufgabe: Nutzen Sie ClickUp-Aufgaben, um Eigentümer zuzuweisen, Überprüfungsphasen festzulegen, Abhängigkeiten zu verfolgen und jeden Benchmark-Zyklus über einen sichtbaren Ausführungsweg zu steuern.

- Bewahren Sie die Logik hinter jedem Ergebnis: Erfassen Sie die Hypothese, die Bedingungen und die abschließenden Beobachtungen in einem einzigen Versuchsprotokoll.

✅ Ideal für: Leiter des Inhalts oder des Supports, die eine zuverlässigere Prompt-Bibliothek für den produktiven Einsatz aufbauen möchten.

👀 Wussten Sie schon? Da voraussichtlich 40 % der Apps von Unternehmen bis Ende dieses Jahres auf KI-Agenten laufen werden, hat unser Team bei ClickUp bereits unser gesamtes Content-System auf Super Agents umgestellt.

Diese autonomen Teamkollegen übernehmen den gesamten Prozess vom Entwurf über die Weiterleitung bis zur Veröffentlichung, sodass wir uns ganz auf die übergeordnete Strategie konzentrieren können.

Sehen Sie sich unten an, wie sie unseren Workspace nutzen:

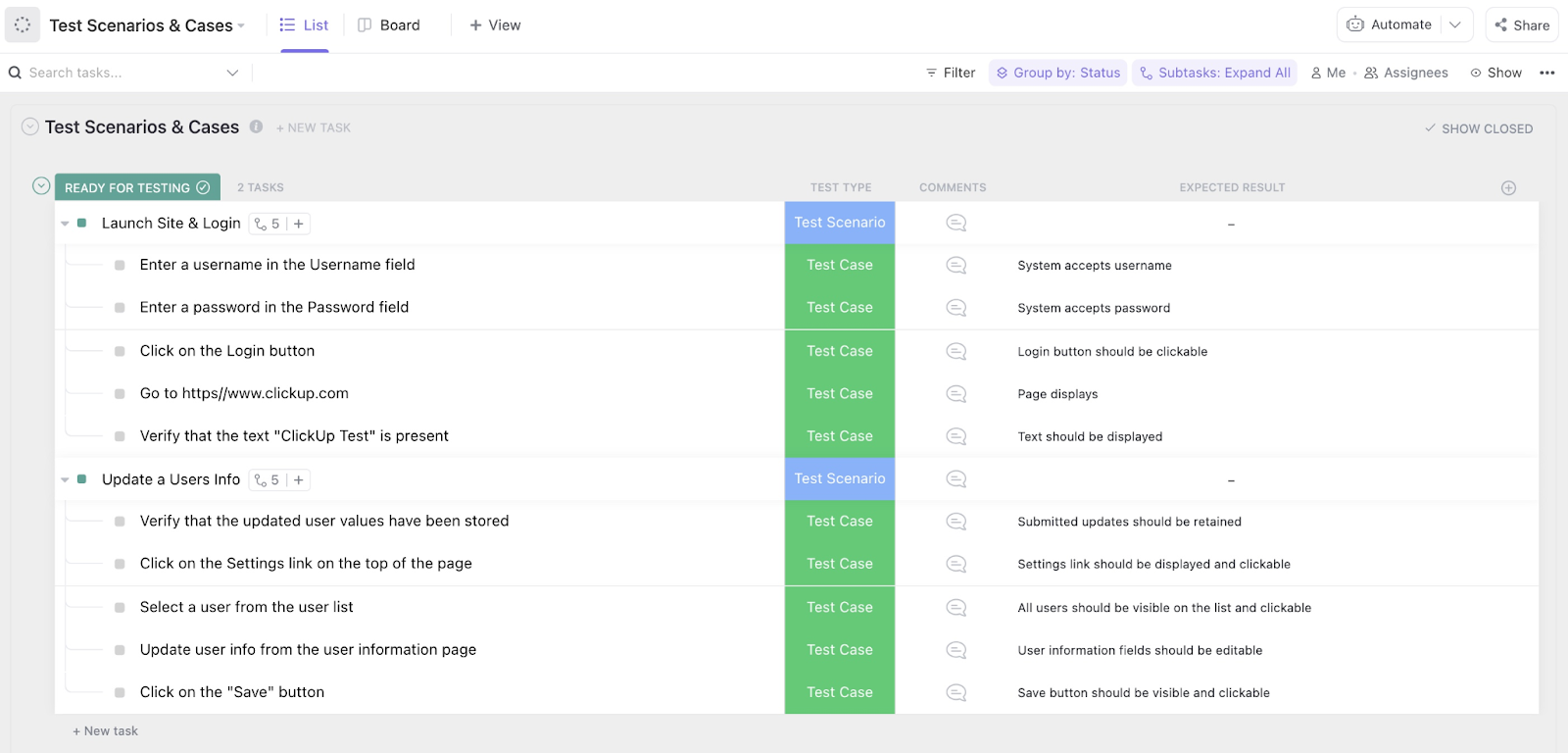

3. Vorlage für das Testmanagement von ClickUp

Die Skalierung einer Prompt-Bibliothek scheitert meist daran, dass niemand weiß, welche Tests tatsächlich abgeschlossen sind. Wenn Sie die Status-Angaben „bestanden“ oder „nicht bestanden“ manuell in einem zufälligen Dokument verfolgen, verlieren Sie wahrscheinlich Tage durch redundante Tests und Kommunikationsschleifen.

Die Testmanagement-Vorlage von ClickUp bietet eine übergeordnete Koordinationsschicht für Ihre Testsuiten. Sie verwandelt verstreute Prompt-Input-Paare in eine geregelte Pipeline, in der jeder Testfall einen klaren Eigentümer und einen Live-Status hat, sodass Ihr Bereitstellungsplan planmäßig verläuft.

✨ Warum dir diese Vorlage gefallen wird

- Überwachen Sie den Ausführungsstatus: Nutzen Sie benutzerdefinierte ClickUp-Status wie „Muss erneut getestet werden“ oder „Bestanden“, um den Fortschritt Ihrer Benchmark-Suite auf einen Blick zu verfolgen

- Zyklen der Synchronisierung: Richten Sie ClickUp-Automatisierungen ein, um bestimmte Testfälle für einen neuen Durchlauf zu markieren, sobald die Kernlogik der Prompts geändert wird

- Dezentralisieren Sie die Bewertungsarbeit: Weisen Sie Testchargen verschiedenen Mitgliedern des Teams zu, um Engpässe zu beseitigen und die Voreingenommenheit menschlicher Bewerter zu verringern.

✅ Ideal für: QA-Leiter und Prompt-Operations-Manager, die umfangreiche Evaluierungssuiten über mehrere Versionen und technische Arbeitsabläufe hinweg koordinieren.

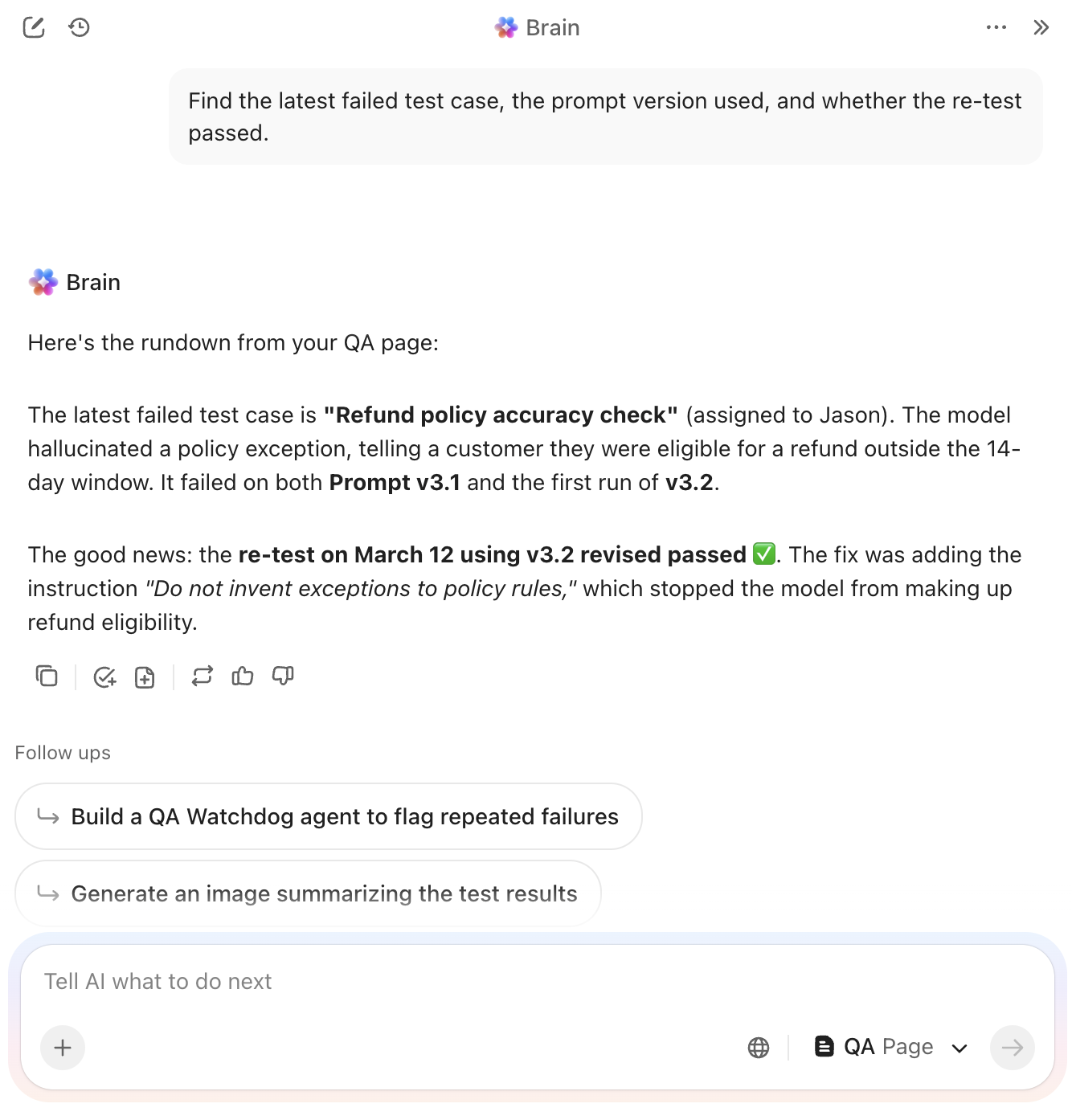

💡 Profi-Tipp: Brauchst du schnell Antworten? Nutze ClickUp Brain. Es kann Notizen zum Test, fehlgeschlagene Fälle, Änderungen an Prompts und den Kontext für erneute Ausführungen aus deinem Workspace und den verbundenen Apps abrufen. So kannst du sehen, was passiert ist, bevor du die nächste Bewertung durchführst.

4. Testfall-Vorlage von ClickUp

Atomare Fehler in Ihrer Prompt-Logik lassen sich kaum beheben, wenn sie in einem allgemeinen Status-Update verborgen sind. Sie müssen genau erkennen, wo das Modell eine Halluzination erzeugt oder eine bestimmte Einschränkung ignoriert hat, ohne stundenlang manuell den Chat-Verlauf durchforsten zu müssen.

Die Testfall-Vorlage von ClickUp dient als detaillierte Dokumentationsschicht für Ihre Testsuite. Sie zerlegt jede Kombination aus Prompt und Eingabe in eine atomare Aufgabe und ermöglicht so einen direkten Vergleich zwischen Ihren erwarteten Ergebnissen und der tatsächlichen Ausgabe des Modells.

✨ Warum dir diese Vorlage gefallen wird

- Standardisieren Sie Prüfpfade: Protokollieren Sie Eingabevariablen, erwartete Ergebnisse und Delta-Notizen in strukturierten Feldern, um subjektive Interpretationen bei Überprüfungen zu vermeiden.

- Ergebnisse sofort bewerten: Markieren Sie jeden Testfall mit binären Pass/Fail-Indikatoren, um unmittelbare Logikfehler von geringfügigen Format-Problemen zu unterscheiden.

- Erstellen Sie nachvollziehbare Verknüpfungen: Verbinden Sie einzelne Testfälle über ClickUp-Aufgabenbeziehungen mit übergeordneten Aufgaben, um genau zu sehen, wie sich Fehler in Randfällen auf Ihre aggregierten Benchmark-Ergebnisse auswirken

✅ Ideal für: QA-Analysten und leitende Prompt-Ingenieure, die Regressionstests für hochkritische KI-Anwendungen oder sensible kundenorientierte Workflows verwalten.

🔮 Haben Sie einen Fehler gefunden, der behoben werden sollte? Setzen Sie den Bug Reproduction Replicator Agent von ClickUp ein. Er hilft dabei, einen fehlgeschlagenen Testfall in klare Reproduktionsschritte umzuwandeln, damit die Entwickler ihn schneller beheben können. Das ist besonders nützlich, wenn ein Prompt nur unter bestimmten Eingaben oder Bedingungen fehlschlägt.

📚 Lesen Sie auch: Vorlagen für KI-Prompt-Workflows

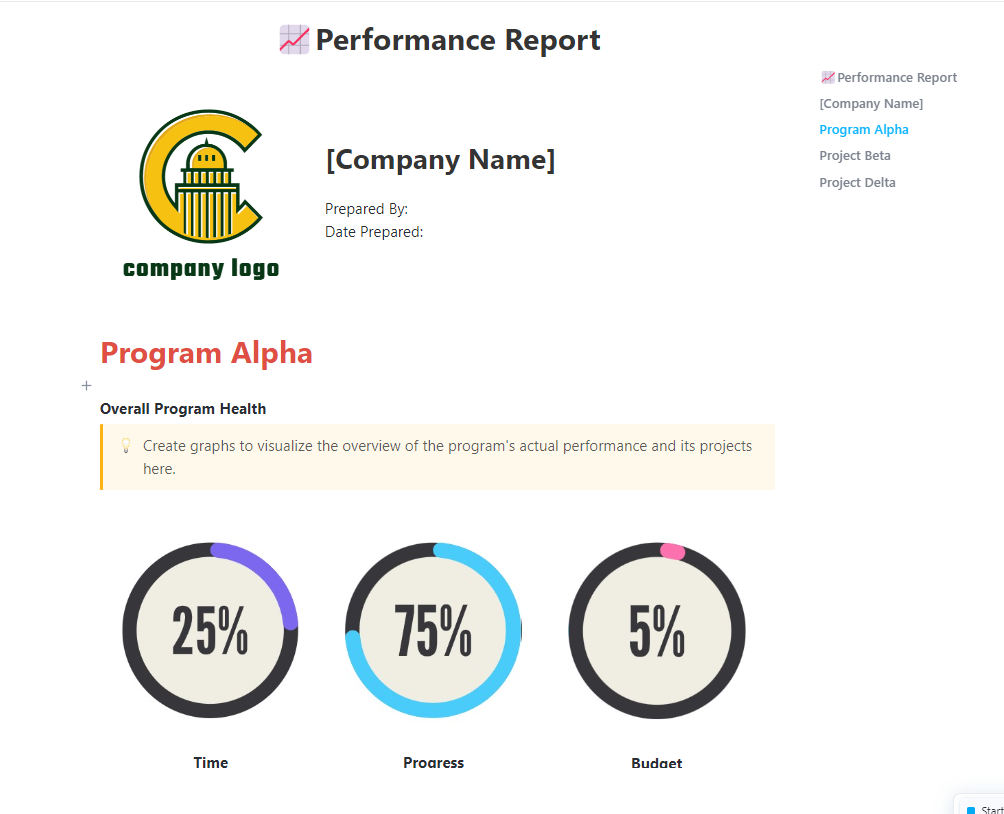

5. Vorlage für Leistungsberichte von ClickUp™

Stakeholder haben selten die Geduld, sich durch rohe Testprotokolle oder technische Bewertungsbögen zu wühlen. Wenn eine Benchmark-Runde endet, bleibt Ihnen meist die mühsame Aufgabe, diese Zahlen manuell in eine Erzählung zu übersetzen, die Ihre nächste Bereitstellung rechtfertigt.

Die Leistungsberichtsvorlage von ClickUp™ dient als zentrale Kommunikationsbrücke für Ihre KI-Abläufe. Sie fasst Ihre Ergebnisse in einem übersichtlichen Dokument zusammen, das Modellverbesserungen und Regressionsrisiken hervorhebt.

✨ Warum dir diese Vorlage gefallen wird

- Zusammenfassungsabschnitte: Vordefinierte Bereiche für Schlüssel-Erkenntnisse, Top- und Bottom-Performer sowie empfohlene nächste Schritte

- Live -Datenvisualisierung: Importieren Sie Echtzeitdaten aus Benchmark-Aufgaben in ClickUp-Dashboards – eine übersichtliche visuelle Darstellung Ihrer ClickUp-Workspace-Daten, die sich nach Abschließen der Bewertungen aktualisiert

- Vereinfachen Sie die Datenüberprüfung: Nutzen Sie Diagramme und Status-Indikatoren, um komplexe Benchmarking-Trends für nicht-technische Teams übersichtlich darzustellen.

✅ Ideal für: KI-Programmmanager und technische Product Owner, die der Geschäftsleitung die Zuverlässigkeit von Modellen und die Bereitschaft für eine Version präsentieren.

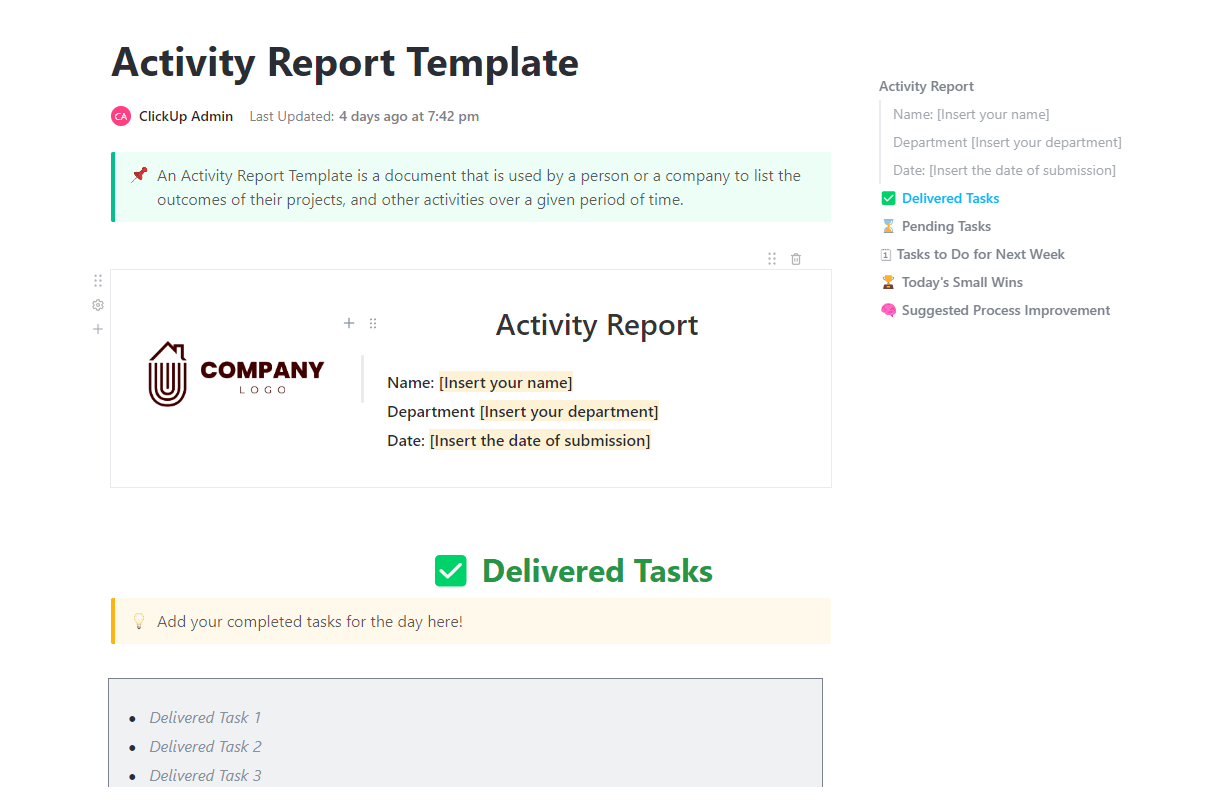

6. Vorlage für Aktivitätsberichte von ClickUp™

Eine Benchmarking-Routine ist nur dann sinnvoll, wenn Ihr Team sie auch tatsächlich befolgt. Wenn sich die Aufgaben häufen, ist es leicht, die Dokumentationsschritte zu überspringen, die Ihren Prüfpfad aufrechterhalten.

Die Vorlage für den Aktivitätsbericht von ClickUp™ fungiert als operatives Herzstück Ihres Testzyklus. Sie übernimmt die Nachverfolgung der Bewertungen, die bereits geliefert wurden, sowie der Bewertungen, die noch in der Warteschlange stehen. Diese Sichtbarkeit hilft Ihnen dabei, Ihren gesamten Governance-Prozess im Zeitplan zu halten.

✨ Warum dir diese Vorlage gefallen wird

- Aktivitätsprotokollierung: Automatische Erfassung von Aktualisierungen von Aufgaben, Statusänderungen und ClickUp-Kommentaren, die mit Benchmark-Workflows verknüpft sind

- Zeitraumfilterung: Zeigen Sie Aktivitäten nach Woche, Sprint oder Benchmark-Runde an, um Durchsatztrends zu erkennen

- Sichtbarkeit der Workload: Sehen Sie mit der ClickUp-Workload-Ansicht, welche Bewerter überlastet sind und welche noch Kapazitäten haben.

✅ Ideal für: Leiter von KI-Teams und Betriebsleiter, die sicherstellen müssen, dass Benchmarking-Workflows nicht ignoriert oder verzögert werden.

💡 Profi-Tipp: Planen Sie wöchentlich ein 15-minütiges „StandUp zur Aktivitätsüberprüfung“ ein, um den Aktivitätsbericht durchzugehen und Bewertungen zu markieren, die seit mehr als 3 Tagen im gleichen Status feststecken. Nutzen Sie ClickUp AI Notetaker, um Aktionspunkte und Hindernisse, die während des Standups besprochen werden, automatisch zu erfassen.

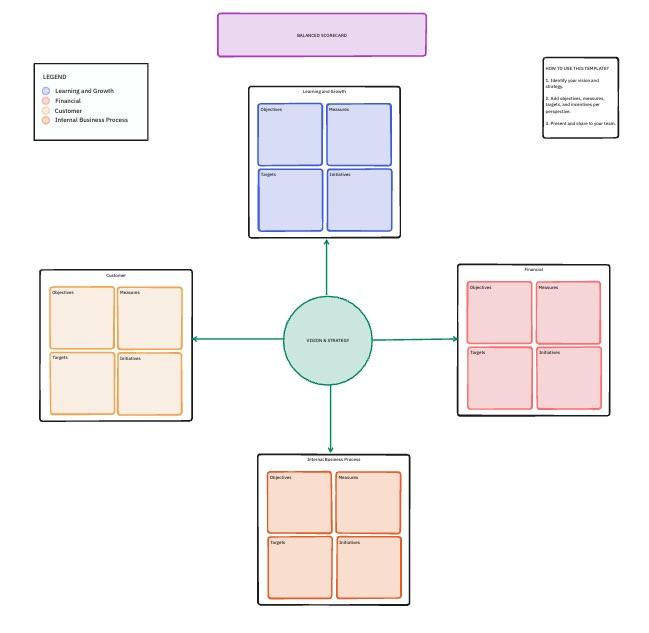

7. Vorlage für Balanced Scorecards von ClickUp

Ein Prompt, der bei der Genauigkeit 98 % erreicht, kann dennoch zu teuer oder zu langsam sein, um tatsächlich eingesetzt zu werden. Sie benötigen eine Möglichkeit, um zu überprüfen, ob Ihre technischen Optimierungen die technischen Benchmarks erfüllen und gleichzeitig Ihre übergeordneten Geschäftsziele unterstützen.

Die Balanced-Scorecard-Vorlage von ClickUp nutzt ein Whiteboard, um diese Verbindungen darzustellen. Es handelt sich um einen kollaborativen Raum, in dem technische Daten mit strategischen Kategorien wie finanziellen Auswirkungen, Kundenzufriedenheit und internem Wachstum verknüpft werden können.

✨ Warum dir diese Vorlage gefallen wird

- Mehrdimensionale Bewertung: Vier strategische Perspektiven mit Metriken auf Prompt-Ebene, die jeweils zusammengefasst sind

- Alignment-Mapping: Verknüpfen Sie einzelne Benchmark-Ergebnisse visuell mit Zielen auf Team- oder Produktebene

- Gewichtete Felder: Definieren Sie gewichtete Bewertungen pro Dimension mithilfe von ClickUp-Benutzerdefinierten Feldern, damit die aggregierte Leistung strategische Prioritäten widerspiegelt

✅ Ideal für: Produktmanager und Verantwortliche für KI/ML, die die Leistung des Prompt-Engineering mit übergeordneten Geschäftszielen und der Ressourcenzuweisung in Einklang bringen müssen.

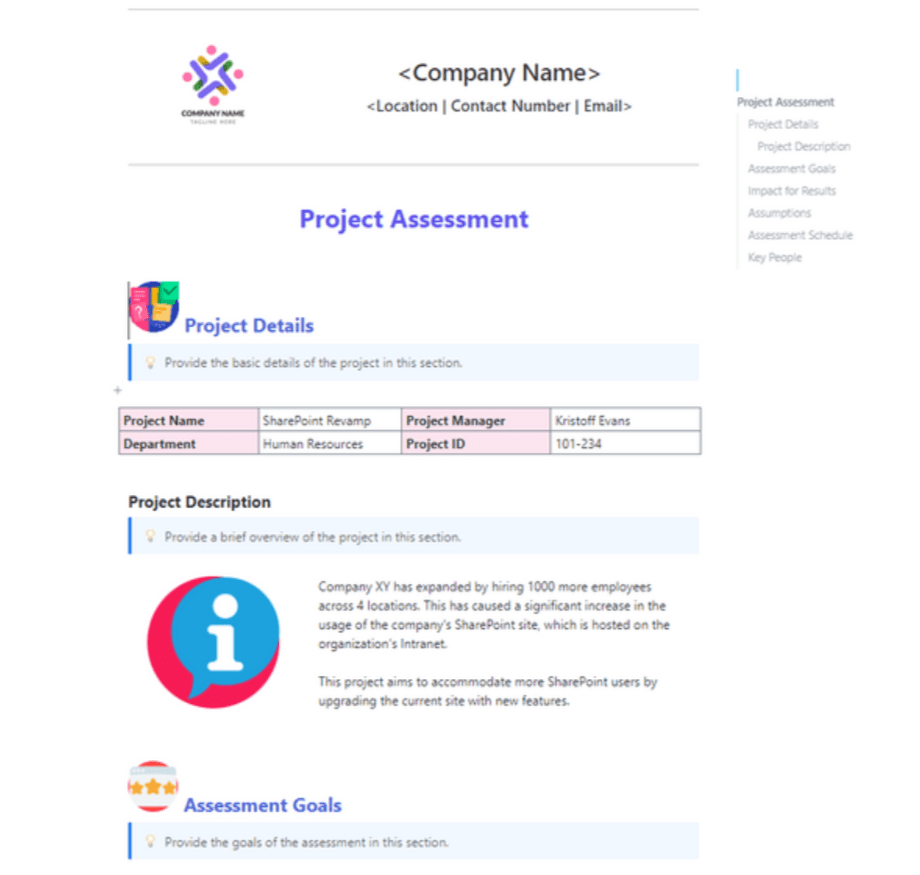

8. Vorlage zur Projektbewertung von ClickUp

Wenn Sie die Nachbetrachtung in Ihrem Benchmarking-Zyklus auslassen, verpassen Sie die Gelegenheit, Ihre Testengpässe zu beheben. Sie müssen wissen, ob Ihre Testfälle wirklich repräsentativ waren oder ob Ihre Bewertungskriterien zu vage waren, bevor Sie mit der nächsten Deployment-Runde beginnen.

Die Vorlage für die Projektbewertung von ClickUp hilft Ihnen dabei, die Bewertung selbst zu bewerten. Sie geht über reine Prompt-Bewertungen hinaus und untersucht den Gesamtzustand Ihrer Testpipeline, sodass jeder Zyklus zu tatsächlichen logischen Verbesserungen führt.

✨ Warum dir diese Vorlage gefallen wird

- Überprüfen Sie den Zustand des Prozesses: Nutzen Sie farbcodierte Status-Felder, um Ihren Testumfang, Ihre Zeitleiste und Ihre Ressourceneffizienz auf einen Blick zu bewerten

- Erfahrungen festhalten: Halten Sie in einem strukturierten Dokumentabschnitt fest, was funktioniert hat und was nicht, um Ihre nächste Bewertungsrunde zu verbessern.

- Zukünftige Risiken identifizieren: Protokollieren Sie spezifische Hindernisse wie API-Ausfälle oder Datenlücken, um zu verhindern, dass diese Ihren nächsten Prompt-Sprint verzögern.

✅ Ideal für: AI-Betriebsleiter und QA-Leiter, die ihre Testmethoden verfeinern und den ROI ihres Benchmarking-Aufwands nachweisen müssen.

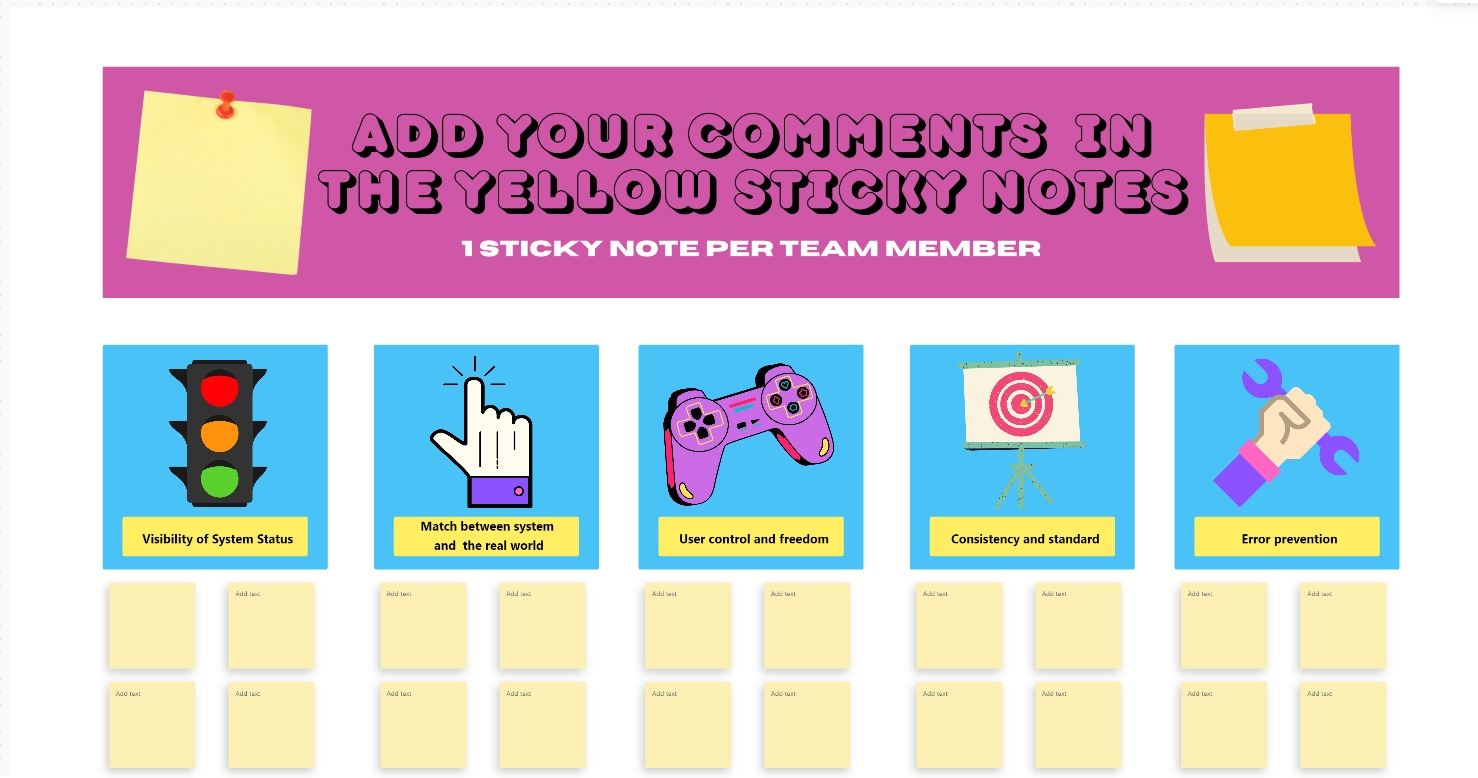

9. Heuristische Überprüfungsvorlage von ClickUp

Numerische Bewertungen geben bei der Beurteilung Ihrer KI-Ergebnisse nur einen Teil der Gesamtbildes wieder. Ein Prompt kann zwar einen Test zur sachlichen Genauigkeit bestehen, wirkt für Ihre Benutzer aber dennoch roboterhaft, verwirrend oder leicht markenfremd.

Die Heuristic Review-Vorlage von ClickUp bringt die Intuition von Experten in Ihren PromptOps-Workflow ein. Sie nutzt ein kollaboratives Whiteboard, um Ergebnisse anhand von Kernprinzipien wie Klarheit und Fehlervermeidung abzubilden. Ihr Team kann spezifisches Feedback mithilfe digitaler Haftnotizen verschiedenen heuristischen Kategorien zuordnen, um die Überprüfung übersichtlich zu gestalten.

✨ Warum dir diese Vorlage gefallen wird

- Standardisieren Sie qualitative Prüfungen: Bewerten Sie die Ergebnisse anhand benutzerdefinierter Richtlinien, um die Markenstimme und die Nützlichkeit in allen generierten Inhalten konsistent zu halten.

- Priorisieren Sie Logikfehlerbehebungen: Kategorisieren Sie Probleme nach Schweregrad, um kritische Sicherheitsrisiken von geringfügigen kosmetischen Fehlern zu unterscheiden

- Bündeln Sie Expertenerkenntnisse: Erfassen Sie Notizen von Prüfern auf Whiteboard-Haftnotizen, um qualitative Daten leicht zu überblicken und entsprechend zu handeln

✅ Ideal für: UX-Autoren und PromptOps-Teams, die fachkundige manuelle Prüfungen durchführen, um sicherzustellen, dass KI-generierte Inhalte hohen Qualitäts- und Sicherheitsstandards entsprechen.

📮ClickUp Insight: Während 34 % der Benutzer volles Vertrauen in KI-Systeme haben, verfolgt eine etwas größere Gruppe (38 %) den Ansatz „Vertrauen ist gut, Kontrolle ist besser“. Ein eigenständiges Tool, das mit Ihrem Arbeitskontext nicht vertraut ist, birgt oft ein höheres Risiko, ungenaue oder unbefriedigende Antworten zu liefern.

Aus diesem Grund haben wir ClickUp Brain entwickelt, die KI, die Ihr Projektmanagement, Ihr Wissensmanagement und Ihre Zusammenarbeit über Ihren gesamten Arbeitsbereich und integrierte Tools von Drittanbietern hinweg miteinander verbindet. Erhalten Sie kontextbezogene Antworten ohne umständliches Umschalten und erleben Sie eine 2- bis 3-fache Steigerung Ihrer Arbeitseffizienz, genau wie unsere Clients bei Seequent.

📮ClickUp Insight: Während 34 % der Benutzer volles Vertrauen in KI-Systeme haben, verfolgt eine etwas größere Gruppe (38 %) den Ansatz „Vertrauen ist gut, Kontrolle ist besser“. Ein eigenständiges tool, das mit Ihrem Arbeitskontext nicht vertraut ist, birgt oft ein höheres Risiko, ungenaue oder unbefriedigende Antworten zu liefern.

Aus diesem Grund haben wir ClickUp Brain entwickelt, die KI, die Ihr Projektmanagement, Ihr Wissensmanagement und Ihre Zusammenarbeit über Ihren gesamten Arbeitsbereich und integrierte Tools von Drittanbietern hinweg miteinander verbindet. Erhalten Sie kontextbezogene Antworten ohne umständliches Umschalten und erleben Sie eine 2- bis 3-fache Steigerung Ihrer Arbeitseffizienz, genau wie unsere Clients bei Seequent.

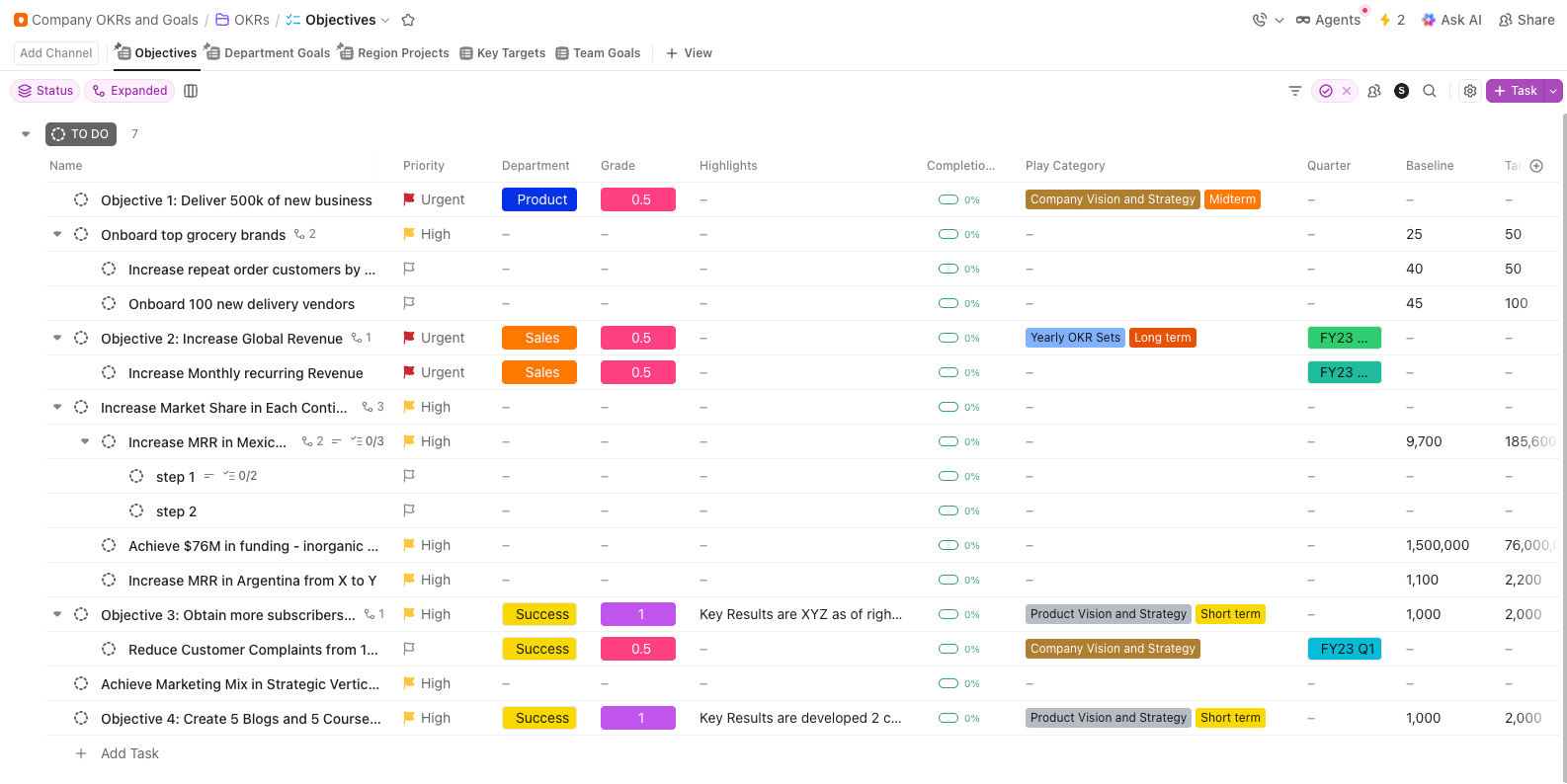

10. Vorlage für Unternehmens-OKRs und -Ziele von ClickUp

Die Verbesserung der Prompt-Genauigkeit von 72 % auf 88 % ist ein enormer technischer Erfolg. Diese Nummer hat jedoch nur dann Gewicht, wenn die Unternehmensleitung versteht, wie sich diese Verbesserungen direkt auf Ihr vierteljährliches Wachstum auswirken.

Die Vorlage „Unternehmens-OKRs und Ziele“ von ClickUp schließt die Lücke zwischen technischem Benchmarking und übergeordneter Strategie. Damit können Sie spezifische Einzelziele unter Ihren Hauptproduktzielen anlegen. So bleibt das Team auf die technischen Ergebnisse fokussiert, die für das Geschäft entscheidend sind.

✨ Warum dir diese Vorlage gefallen wird

- Hierarchie von Zielen und Schlüsselergebnissen: Ordnen Sie Benchmarking-Einzelziele auf Prompt-Ebene den Team- oder Produktzielen zu, um eine klare Ausrichtung zu gewährleisten

- Nachverfolgung des Fortschritts: Visuelle Anzeigen des Fortschritts, die sich aktualisieren, wenn sich die Benchmark-Ergebnisse im Laufe der Zyklen der Bewertung verbessern

- Funktionsübergreifende Sichtbarkeit: Planen Sie die OKRs des Unternehmens und geben Sie Benchmarking-Ziele an die Bereiche Produkt, Technik und Führung frei, damit jeder sieht, wie die Verbindung zwischen der Qualität der Prompts und den Prioritäten der Roadmap aussieht

✅ Ideal für: KI-/ML-Teams, die Benchmarking als wiederkehrendes Ziel mit messbaren Ergebnissen festlegen.

Steigern Sie Ihre KI-Qualität mit ClickUp

Mehr Prompts bedeuten mehr bewegliche Teile, mehr Iterationen und ein höheres Risiko, dass die Ausgabequalität nachlässt.

Mit ClickUp erstellen Sie einen konvergenten Arbeitsbereich, in dem das Benchmarking mit einer strukturierten Bewertung in Aufgaben beginnt und die Verfeinerung über Dokumente und Whiteboards hinweg koordiniert bleibt. Darüber hinaus ist jede Vorlage und Lösung mit KI ausgestattet, die die sich wiederholenden Analysen und die Versionsverwaltung automatisch übernimmt.

Worauf warten Sie also noch? Starten Sie kostenlos mit ClickUp und verwandeln Sie Ihre Benchmarks in Ergebnisse.

Häufig gestellte Fragen

Zu den wichtigsten Metriken gehören Genauigkeit, Relevanz, Kohärenz und Latenz. Sie sollten außerdem die Halluzinationsrate, die Einhaltung des Tons und die Rate des Abschlusses der Aufgaben verfolgen. Die richtige Mischung hängt letztendlich von Ihrem spezifischen Anwendungsfall ab. Bei kundenorientierten Ausgaben stehen beispielsweise Ton und Sicherheit im Vordergrund, während interne Prompts sich eher auf Genauigkeit und Geschwindigkeit konzentrieren.

Um Ihre Vorlage anzupassen, fügen Sie zunächst Felder für den Modellnamen, die Version und die Parameter-Einstellungen wie Temperatur und Token-Limits hinzu. Sie sollten außerdem einen Abschnitt für den Vergleich zwischen erwarteter und tatsächlicher Ausgabe einfügen, um die Leistung zu messen. Fügen Sie schließlich jedem Durchlauf eine Nachverfolgung der Version hinzu. Dadurch wird sichergestellt, dass jeder Benchmark mit einer bestimmten Prompt-Iteration verknüpft ist, was eine genaue Langzeitbewertung ermöglicht.

Beim quantitativen Benchmarking werden numerische Werte (z. B. Genauigkeitsprozentsatz, Reaktionszeit) für einen objektiven Vergleich herangezogen. Im Gegensatz dazu stützt sich das qualitative Benchmarking auf Expertenbewertungen anhand von Kriterien wie Klarheit, Nützlichkeit und Markenstimme – die effektivsten Programme zum Testen von Prompts nutzen beide Ansätze.

Durch strukturiertes Benchmarking lassen sich Regressionen bei Prompts erkennen, bevor sie Ihre Benutzer erreichen. Es entsteht eine kontinuierliche Feedbackschleife zwischen Bewertung und Iteration, die es Ihnen ermöglicht, die Leistung im Laufe der Zeit zu optimieren. Dieser Prozess schafft eine solide Faktengrundlage für Ihre Entscheidungen im Bereich Prompt Engineering.