Stronniczość AI może wydawać się problemem technicznym. Jednak jej skutki są widoczne w rzeczywistości i często mogą być katastrofalne.

Kiedy system AI wykazuje choćby niewielką tendencję do błędów, może to prowadzić do niesprawiedliwych wyników.

Z czasem te drobne problemy mogą przerodzić się w frustrację klientów, problemy z reputacją, a nawet kwestie zgodności z przepisami, których nie przewidziałeś.

Większość zespołów nie zamierza tworzyć stronniczych systemów AI. Dzieje się tak, ponieważ dane są nieuporządkowane, rzeczywistość jest nierówna, a narzędzia, których używamy, nie zawsze działają tak, jak tego oczekujemy. Dobrą wiadomością jest to, że nie trzeba być analitykiem danych, aby zrozumieć, co się dzieje.

W tym blogu wyjaśnimy, czym właściwie jest stronniczość sztucznej inteligencji, dlaczego występuje i jak może przejawiać się w codziennych narzędziach biznesowych.

Czym jest stronniczość AI?

Stronniczość AI ma miejsce, gdy system AI generuje systematyczne, niesprawiedliwe wyniki, które konsekwentnie faworyzują lub dyskryminują określone grupy osób. Nie są to tylko losowe błędy; są to przewidywalne wzorce, które są wpisane w sposób podejmowania decyzji przez AI. Przyczyna? AI uczy się na podstawie danych, które odzwierciedlają istniejące ludzkie uprzedzenia, inne nieświadome uprzedzenia i nierówności społeczne.

Pomyśl o tym w ten sposób: jeśli trenujesz algorytm rekrutacyjny na podstawie dziesięciu lat danych firmy, w której 90% menedżerów stanowili mężczyźni, AI może błędnie uznać, że bycie mężczyzną jest kluczową kwalifikacją do pełnienia roli kierowniczej. AI nie działa w złej wierze; po prostu identyfikuje i powtarza wzorce, które jej pokazano.

Oto, co sprawia, że stronniczość AI jest tak trudna:

- Jest to zjawisko systematyczne, a nie losowe: niesprawiedliwość nie jest jednorazową usterką, ale powtarzalnym wzorcem w wynikach AI.

- Często jest to niewidoczne: Stronnicze wyniki mogą kryć się za złożoną matematyką pozornie neutralnego algorytmu, co utrudnia ich wykrycie.

- Ma to swoje źródło w danych i projekcie: Stronniczość dostaje się do systemu poprzez wybory dokonywane przez ludzi podczas tworzenia i szkolenia AI.

⭐ Polecany szablon

Szablon raportu dotyczącego reagowania na incydenty ClickUp zapewnia gotową strukturę do dokumentowania, śledzenia i rozwiązywania incydentów od początku do końca. Rejestruj wszystkie istotne szczegóły dotyczące incydentów, utrzymuj jasno skategoryzowane statusy i rejestruj ważne atrybuty, takie jak powaga, grupy, na które incydent miał wpływ, oraz kroki naprawcze. Obsługuje pola niestandardowe, takie jak Zatwierdzone przez, Notatki dotyczące incydentu i Dokumenty uzupełniające, które pomagają ujawnić odpowiedzialność i dowody w całym procesie przeglądu.

📖 Więcej informacji: Jak przeprowadzić ocenę ryzyka: narzędzia i techniki

Dlaczego ograniczanie stronniczości AI ma znaczenie

Kiedy systemy AI są niesprawiedliwe, ryzykujesz wyrządzenie szkody w życiu prawdziwych ludzi.

To z kolei naraża Twoją organizację na poważne wyzwania biznesowe, a nawet może zniszczyć zaufanie, które z trudem budowałeś wśród klientów.

Stronnicza AI, która odmawia komuś kredytu, odrzuca jego podanie o pracę lub wydaje błędną rekomendację, pociąga za sobą poważne konsekwencje w świecie rzeczywistym.

Pojawiające się standardy branżowe i ramy zachęcają obecnie organizacje do aktywnego identyfikowania i eliminowania stronniczości w swoich systemach AI. Ryzyko dotyka Twoją organizację z każdej strony:

- Ryzyko regulacyjne: Nieprzestrzeganie nowych standardów dotyczących AI może mieć poważne konsekwencje dla biznesu.

- Uszkodzenie reputacji: Gdy opinia publiczna dowie się, że Twoja AI jest stronnicza, niezwykle trudno będzie odzyskać jej zaufanie.

- Niewydajność operacyjna: Stronnicze modele generują niewiarygodne wyniki lub halucynacje AI, które prowadzą do złych decyzji i wymagają kosztownych poprawek.

- Odpowiedzialność etyczna: Twoja organizacja powinna zapewnić, że wdrażana technologia traktuje wszystkich użytkowników sprawiedliwie.

Kiedy odpowiednio ograniczysz stronniczość, zbudujesz systemy AI, na których ludzie mogą naprawdę polegać. Sprawiedliwa sztuczna inteligencja otwiera drzwi do nowych rynków, poprawia jakość podejmowanych decyzji i pokazuje wszystkim, że jesteś committed do prowadzenia etycznej działalności.

📮 ClickUp Insight: 22% naszych respondentów nadal podchodzi ostrożnie do wykorzystania AI w pracy. Spośród tych 22% połowa martwi się o prywatność swoich danych, a druga połowa po prostu nie jest pewna, czy może ufać informacjom przekazywanym przez AI.

ClickUp rozwiązuje oba problemy, stosując solidne środki bezpieczeństwa i generując szczegółowe linki do zadań i źródeł wraz z każdą odpowiedzią.

Oznacza to, że nawet najbardziej ostrożne zespoły mogą zacząć cieszyć się wzrostem wydajności, nie martwiąc się o bezpieczeństwo swoich informacji ani o wiarygodność wyników.

📖 Więcej informacji: Asystent ds. zgodności AI: Jak sztuczna inteligencja zmienia zgodność i audyty

Rodzaje i źródła stronniczości AI

Stronniczość może wkradnąć się do systemów AI z wielu stron.

Od momentu rozpoczęcia gromadzenia danych aż do długo po wdrożeniu systemu element ten pozostaje w miarę stały. Jeśli jednak wiesz, gdzie szukać, możesz skierować swoje wysiłki w celu i przestać grać w niekończącą się grę w „bij mole” z niesprawiedliwymi wynikami.

Błąd próby

Błąd próby występuje, gdy próbki danych wykorzystywane do szkolenia AI nie odzwierciedlają dokładnie rzeczywistego świata, w którym AI będzie wykorzystywana.

Na przykład, jeśli zbudujesz system rozpoznawania głosu, który został wyszkolony głównie na danych pochodzących od osób mówiących amerykańskim angielskim, będzie on miał naturalne trudności ze zrozumieniem osób z akcentem szkockim lub indyjskim, podobnie jak w przypadku modeli LLM, które w 85,1% przypadków preferują nazwiska kojarzone z osobami rasy białej podczas przeglądu CV. Ta niedostateczna reprezentacja powoduje ogromne luki, przez co model nie jest przygotowany do obsługi całych grup osób.

Błąd algorytmiczny

Stronniczość algorytmiczna występuje, gdy konstrukcja modelu lub proces matematyczny wzmacnia nieuczciwe wzorce, nawet jeśli dane wydają się neutralne.

Kod pocztowy danej osoby nie powinien decydować o tym, czy otrzyma ona kredyt, ale jeśli kody pocztowe w danych szkoleniowych są silnie skorelowane z rasą, algorytm może nauczyć się wykorzystywać lokalizację jako podstawę do dyskryminacji.

Problem ten pogłębia się w przypadku pętli sprzężenia zwrotnego — gdy stronnicza prognoza (np. odmowa udzielenia kredytu) jest wprowadzana do systemu jako nowe dane, stronniczość z czasem tylko się nasila.

Błąd decyzyjny człowieka

Każdy wybór dokonywany przez osobę podczas tworzenia systemu AI może wprowadzać stronniczość.

Obejmuje to podejmowanie decyzji dotyczących tego, jakie dane należy gromadzić, jak je oznaczać i jak definiować „powodzenie” modelu. Na przykład zespół może nieświadomie faworyzować dane, które świadczą o jego dotychczasowych przekonaniach (błąd potwierdzenia) lub przywiązywać zbyt dużą wagę do pierwszej informacji, którą zobaczy (błąd kotwiczenia).

Nawet zespoły o najlepszych intencjach mogą przypadkowo zakodować swoje własne założenia i światopogląd w systemie AI.

📖 Więcej informacji: 10 szablonów zarządzania projektami do zarządzania zadaniami

Przykłady stronniczości AI w świecie rzeczywistym

Prawdziwe firmy poniosły poważne konsekwencje, gdy ich systemy AI wykazały stronniczość, co kosztowało je miliony w odszkodowaniach i utratę zaufania klientów. Oto kilka udokumentowanych przykładów:

1. Niesprawiedliwe narzędzia rekrutacyjne

Jednym z najczęściej cytowanych przypadków była sytuacja, w której duża firma technologiczna zrezygnowała z wewnętrznego systemu rekrutacyjnego opartego na AI po tym, jak okazało się, że faworyzował on kandydatów płci męskiej. System został przeszkolony na podstawie dziesięciu lat CV, w których większość osób osiągających powodzenie to mężczyźni. W rezultacie zaczął on dyskryminować CV zawierające słowa takie jak „kobiety”, a nawet obniżał oceny absolwentek uczelni dla kobiet.

Pokazuje to, jak błędy danych historycznych, gdy przeszłe wzorce odzwierciedlają istniejącą nierówność, mogą wkradnąć się do automatyzacji, jeśli nie zostaną dokładnie sprawdzone. Jednak wraz z upowszechnianiem się automatycznej rekrutacji z wykorzystaniem AI skala problemu staje się jeszcze większa.

🌼 Czy wiesz, że: Najnowsze dane pokazują, że 37% organizacji „aktywnie integruje” lub „eksperymentuje” z narzędziami AI w procesie rekrutacji, co stanowi wzrost z 27% rok temu.

2. Rozpoznawanie twarzy, które pomija połowę populacji

Badania przeprowadzone przez Joy Buolamwini i udokumentowane w opracowaniu Gender Shades wykazały, że komercyjne systemy rozpoznawania twarzy miały wskaźnik błędów sięgający 34,7% w przypadku kobiet o ciemnej karnacji, w porównaniu z mniej niż 1% w przypadku mężczyzn o jasnej karnacji.

Jest to ponownie odzwierciedlenie niezrównoważonych zbiorów danych szkoleniowych. Stronniczość narzędzi biometrycznych ma jeszcze bardziej daleko idące skutki.

Policja i agencje rządowe również napotkały problemy związane z tendencyjnością systemów rozpoznawania twarzy. Dochodzenia przeprowadzone przez The Washington Post wykazały , że niektóre z tych systemów znacznie częściej błędnie identyfikowały osoby z grup marginalizowanych. W kilku rzeczywistych przypadkach doprowadziło to do bezpodstawnych aresztowań, negatywnej reakcji opinii publicznej i poważnych obaw dotyczących wpływu tych narzędzi na prawa obywateli.

📖 Więcej informacji: AI w miejscu pracy: sposoby na poprawę wydajności i produktywności

3. Algorytmy zdrowotne, które nie traktują opieki jako priorytetu

Systemy AI w służbie zdrowia, zaprojektowane w celu przewidywania, którzy pacjenci wymagają dodatkowej opieki, również wykazały tendencyjność.

W jednym z dobrze udokumentowanych przypadków powszechnie stosowany algorytm prognozowania opieki zdrowotnej popełnił poważny błąd. Miał on pomagać w podejmowaniu decyzji, którzy pacjenci powinni otrzymać dodatkową opiekę, ale ostatecznie systematycznie przypisywał niższy priorytet pacjentom czarnoskórym, nawet jeśli byli oni równie chorzy lub bardziej chorzy niż pacjenci rasy białej.

Stało się tak, ponieważ model wykorzystywał wydatki na opiekę zdrowotną jako wskaźnik potrzeb medycznych. Ponieważ czarnoskórzy pacjenci historycznie mieli niższe wydatki na opiekę zdrowotną z powodu nierównego dostępu do niej, algorytm traktował ich jako mniej potrzebujących. W wyniku odebrał zasoby opieki tym, którzy faktycznie najbardziej ich potrzebowali. Naukowcy odkryli, że samo naprawienie tego wskaźnika mogłoby znacznie zwiększyć dostęp do sprawiedliwych programów opieki.

Obawy związane z tymi problemami skłoniły organizacje zajmujące się prawami obywatelskimi do nacisku na wprowadzenie standardów „equity-first” w AI stosowanej w służbie zdrowia. W grudniu 2025 r. organizacja NAACP opublikowała szczegółowy plan działania, w którym wezwała szpitale, firmy technologiczne i decydentów politycznych do wprowadzenia audytów stronniczości, przejrzystych praktyk projektowych, ram integracyjnych i narzędzi AI, aby zapobiec pogłębianiu się nierówności rasowych w zakresie zdrowia.

4. Algorytmy kredytowe o nierównych wynikach

AI i automatyzacja podejmowania decyzji nie tylko kształtują to, co widzisz w mediach społecznościowych, ale także wpływają na to, kto ma dostęp do pieniędzy i na jakich warunkach.

Jednym z najczęściej omawianych przykładów z życia wziętych jest Apple Card , cyfrowa karta kredytowa wydawana przez Goldman Sachs.

W 2019 roku klienci w mediach społecznościowych udostępniali informacje, że algorytm ustalający limit kredytowy karty przyznawał niektórym mężczyznom znacznie wyższe limity niż ich żonom lub partnerkom. Miało to miejsce nawet w przypadku par o podobnych profilach finansowych. Jeden z inżynierów oprogramowania powiedział, że otrzymał limit kredytowy 20 razy wyższy niż jego żona, a nawet współzałożyciel Apple, Steve Wozniak, potwierdził podobne doświadczenie dotyczące jego małżonki.

Te wzorce wywołały publiczne oburzenie i doprowadziły do wszczęcia dochodzenia regulacyjnego przez Departament Usług Finansowych stanu Nowy Jork w sprawie tego, czy algorytm dyskryminował kobiety, podkreślając, w jaki sposób narzędzia finansowe w procesie automatyzacji mogą generować nierówne wyniki.

📖 Więcej informacji: Jak wykorzystać AI do zarządzania danymi (przykłady zastosowań i narzędzia)

5. Automatyczne napisy i rozpoznawanie głosu, które wykluczają głosy

Systemy rozpoznawania mowy i automatycznego tworzenia napisów często nie słyszą wszystkich jednakowo. Liczne badania wykazały, że narzędzia te działają lepiej w przypadku niektórych mówców niż innych, w zależności od takich czynników, jak akcent, dialekt, rasa oraz to, czy angielski jest językiem ojczystym mówcy.

Dzieje się tak, ponieważ systemy komercyjne są zazwyczaj szkolone na zbiorach danych zdominowanych przez określone wzorce językowe — często zachodni, standardowy angielski — co powoduje, że inne głosy są niedostatecznie reprezentowane.

Na przykład naukowcy ze Stanford przetestowali pięć wiodących systemów zamiany mowy na tekst (firmy Amazon, Google, Microsoft, IBM i Apple) i odkryli, że popełniają one prawie dwa razy więcej błędów podczas transkrypcji mowy osób czarnoskórych w porównaniu z osobami rasy białej. Problem występował nawet wtedy, gdy badani wypowiadali te same słowa w tych samych warunkach.

Niedokładne napisy dla niektórych mówców mogą prowadzić do złych doświadczeń użytkowników i niedostępności dla osób, które polegają na napisach. Co gorsza, może to przyczynić się do stronniczych wyników w systemach wykorzystujących rozpoznawanie mowy w procesach rekrutacji, edukacji lub opieki zdrowotnej.

Każdy z tych przykładów ilustruje inny sposób, w jaki stronniczość może zostać wbudowana w systemy automatyczne poprzez tendencyjne dane szkoleniowe, źle dobrane proxy lub niereprezentatywne testy. W każdym przypadku wyniki nie mają charakteru wyłącznie technicznego — kształtują one możliwości, podważają zaufanie i niosą ze sobą realne ryzyko biznesowe i etyczne.

📖 Więcej informacji: Ryzyko a problemy – jaka jest różnica?

Podsumowanie: Jak przejawia się stronniczość AI i komu szkodzi

| Gdzie pojawiły się tendencje | Kogo to dotyczyło | Wpływ na rzeczywistość |

|---|---|---|

| Algorytmy rekrutacyjne (zniesione narzędzie rekrutacyjne oparte na AI) | Kobiety | CV były obniżane na podstawie słów kluczowych związanych z płcią, co ograniczało dostęp do rozmów kwalifikacyjnych i możliwości zatrudnienia. |

| Systemy rozpoznawania twarzy (Gender Shades + przypadki bezpodstawnych aresztowań) | Kobiety o ciemnej karnacji; marginalizowane grupy rasowe | Znacznie wyższy odsetek błędnych identyfikacji prowadził do niesłusznych aresztowań, utraty reputacji i problemów związanych z prawami obywatelskimi. |

| Algorytmy przewidywania ryzyka w opiece zdrowotnej (badanie Uniwersytetu Chicagowskiego) | Czarni pacjenci | Pacjenci zostali pozbawieni priorytetowego traktowania w zakresie dodatkowej opieki, ponieważ wydatki na opiekę zdrowotną były wykorzystywane jako wadliwy wskaźnik potrzeb medycznych, co pogłębiało nierówności w zakresie zdrowia. |

| Algorytmy limitów kredytowych (badanie Apple Card) | Kobiety | Mężczyźni otrzymywali znacznie wyższe limity kredytowe niż partnerki o takich samych kwalifikacjach, co miało wpływ na dostęp do finansowania i zdolność kredytową. |

| Rozpoznawanie mowy i automatyczne napisy (badanie Stanford ASR) | Prelegenci z niestandardowymi akcentami; czarnoskórzy prelegenci | Prawie dwukrotnie wyższy wskaźnik błędów spowodował bariery dostępności, nieporozumienia i stronnicze wyniki w narzędziach wykorzystywanych w rekrutacji, edukacji i codziennym dostępie do technologii cyfrowych. |

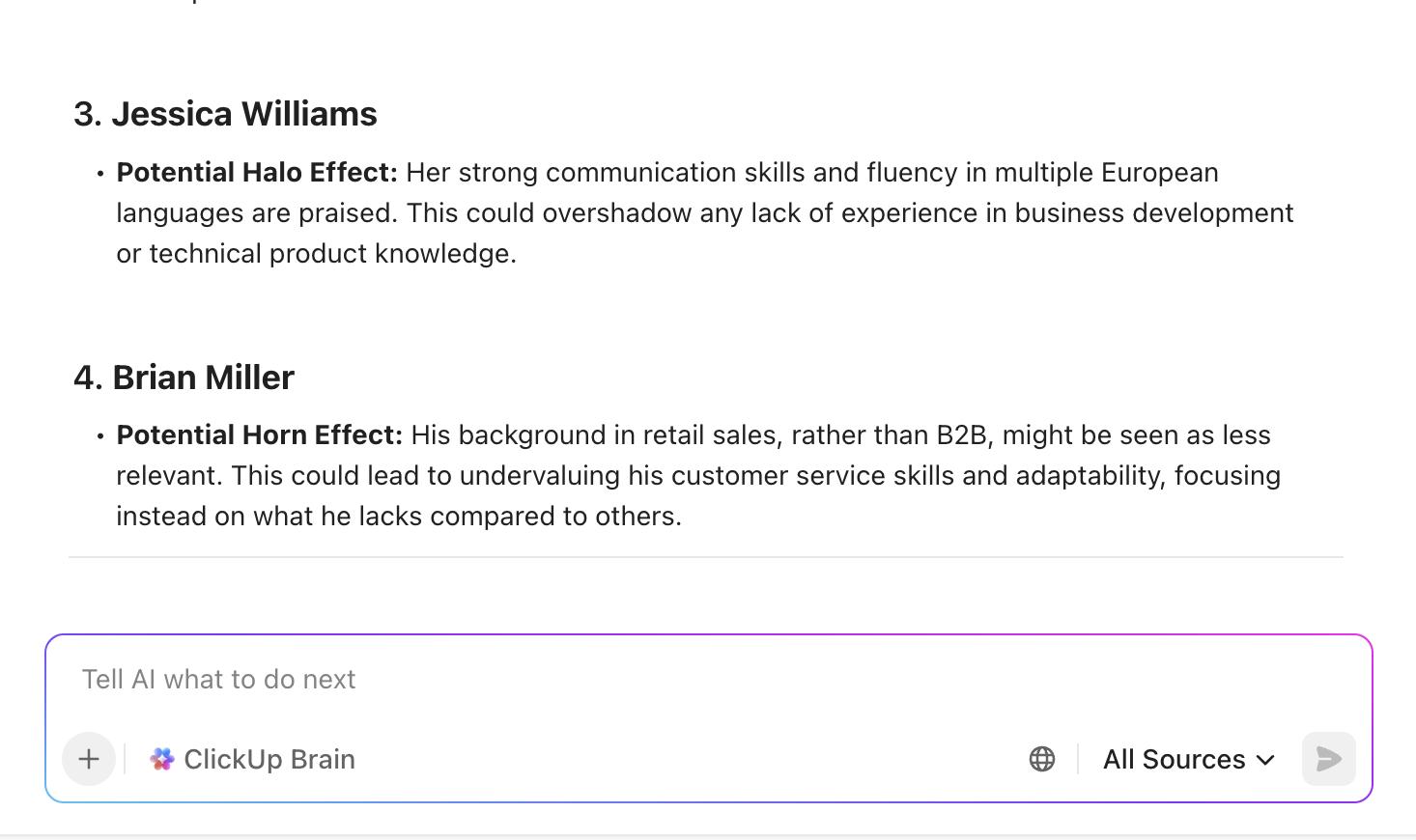

📖 Więcej informacji: Jak uniknąć efektu aureoli i rogu, aby ograniczyć stronniczość

Skuteczne strategie ograniczania stronniczości

Nie ma jednego magicznego rozwiązania, które pozwoliłoby wyeliminować stronniczość AI.

Skuteczne ograniczanie stronniczości wymaga wielopoziomowej ochrony, którą należy stosować przez cały cykl życia AI. Łącząc te sprawdzone strategie, można znacznie zmniejszyć ryzyko wystąpienia niesprawiedliwych wyników.

Zbieraj zróżnicowane dane szkoleniowe

Reprezentatywne dane są absolutną podstawą sprawiedliwej AI.

Twój model nie może nauczyć się obsługiwać grup osób, których nigdy nie widział podczas szkolenia. Zacznij od audytu istniejących zbiorów danych, aby znaleźć wszelkie luki demograficzne. Następnie podejmij świadomy wysiłek, aby pozyskać nowe dane od tych niedostatecznie reprezentowanych populacji.

Gdy trudno jest znaleźć dane z rzeczywistego świata, można skorzystać z technik takich jak augmentacja danych (tworzenie zmodyfikowanych kopii istniejących danych) lub generowanie danych syntetycznych, aby wypełnić luki.

🚧 Zestaw narzędzi: Skorzystaj z szablonu listy kontrolnej audytu wewnętrznego ClickUp, aby zaplanować proces audytu.

Testuj modele pod kątem stronniczości

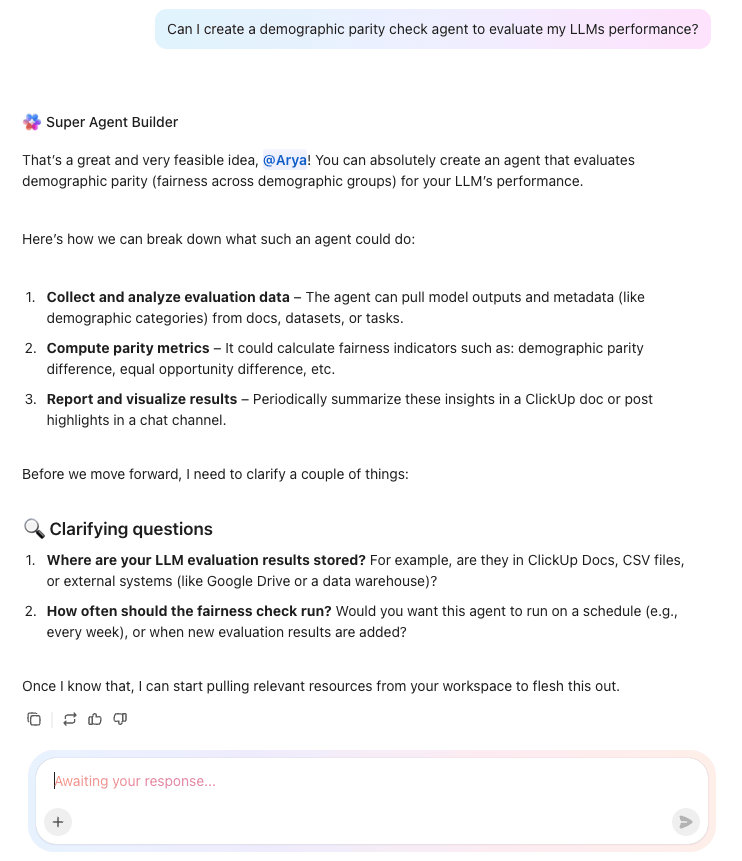

Musisz systematycznie testować model pod kątem stronniczości, aby wykryć ją, zanim wyrządzi rzeczywistą szkodę. Wykorzystaj wskaźniki sprawiedliwości, aby zmierzyć wydajność modelu w różnych grupach.

Na przykład parytet demograficzny sprawdza, czy model daje pozytywny wynik (np. zatwierdzenie kredytu) przy równych wskaźnikach dla wszystkich grup, natomiast wyrównane szanse sprawdzają, czy wskaźniki błędów są równe.

Podziel wydajność swojego modelu według wszystkich możliwych danych demograficznych — rasy, płci, wieku, położenia geograficznego — aby wykryć miejsca, w których spada dokładność lub pojawiają się nieprawidłowości.

Zachowaj udział człowieka w procesie

Zautomatyzowane systemy mogą przeoczyć subtelne, specyficzne dla kontekstu niesprawiedliwości, które człowiek dostrzegłby od razu. Podejście oparte na udziale człowieka jest kluczowe w przypadku decyzji o wysokiej stawce, gdzie AI może przedstawić rekomendację, ale ostateczną decyzję podejmuje człowiek.

Jest to szczególnie ważne w takich obszarach, jak zatrudnianie, udzielanie kredytów i diagnostyka medyczna. Aby to zadziałało, recenzenci muszą być przeszkoleni w zakresie rozpoznawania stronniczości i mieć uprawnienia do odrzucania sugestii AI.

📖 Więcej informacji: Jak wykorzystać AI zorientowaną na człowieka w miejscu pracy: kompletny przewodnik

Zastosuj techniki algorytmicznej sprawiedliwości.

Możesz też użyć metod technicznych, żeby bezpośrednio interweniować i zmniejszyć stronniczość. Te techniki dzielą się na trzy główne kategorie:

- Wstępne przetwarzanie: polega na dostosowaniu danych szkoleniowych przed ich wyświetleniem w modelu, często poprzez ponowne zważenie lub ponowne próbkowanie danych w celu uzyskania bardziej zrównoważonej reprezentacji różnych grup.

- W trakcie przetwarzania: w tym przypadku dodajesz ograniczenia dotyczące sprawiedliwości bezpośrednio do procesu szkolenia modelu, ucząc go optymalizacji zarówno pod kątem dokładności, jak i sprawiedliwości.

- Przetwarzanie końcowe: Oznacza to dostosowanie ostatecznych prognoz modelu po ich sporządzeniu, aby zapewnić sprawiedliwe wyniki dla wszystkich grup.

Techniki te często wiążą się z kompromisem, w ramach którego konieczne może być nieznaczne obniżenie ogólnej dokładności, aby osiągnąć znaczną poprawę sprawiedliwości.

💟 Bonus: BrainGPT to oparty na AI towarzysz na pulpicie, który przenosi testowanie stronniczości AI na wyższy poziom, zapewniając dostęp do wielu wiodących modeli — w tym GPT-5, Claude, Gemini i innych — w jednym miejscu.

Oznacza to, że możesz łatwo uruchamiać te same podpowiedzi lub scenariusze w różnych modelach, porównywać ich zdolności rozumowania i wykrywać miejsca, w których odpowiedzi się różnią lub wykazują stronniczość. Ta superaplikacja AI umożliwia również korzystanie z funkcji zamiany mowy na tekst w celu konfigurowania przypadków testowych, dokumentowania wyników i organizowania wyników do analizy porównawczej.

Zaawansowane narzędzia do wnioskowania i rozpoznawania kontekstu pomagają rozwiązywać problemy, wykrywać wzorce i zrozumieć, w jaki sposób każdy model podchodzi do wrażliwych tematów. Dzięki centralizacji cyklu pracy i umożliwieniu przejrzystego testowania wielu modeli Brain MAX pozwala z pewnością i precyzją kontrolować, porównywać i eliminować stronniczość AI.

Zwiększ przejrzystość i zrozumiałość

Jeśli nie wiesz, w jaki sposób Twój model podejmuje decyzje, nie możesz go naprawić, gdy popełnia błąd. Techniki wyjaśnialnej sztucznej inteligencji (XAI) pomagają zajrzeć do „czarnej skrzynki” i sprawdzić, które funkcje danych wpływają na prognozy.

Możesz również tworzyć karty modeli, które są jak etykiety z informacjami o wartościach odżywczych dla Twojej AI, dokumentujące jej przeznaczenie, dane dotyczące wydajności i znane ograniczenia.

📮ClickUp Insight: 13% respondentów naszej ankiety chce wykorzystywać AI do podejmowania trudnych decyzji i rozwiązywania złożonych problemów. Jednak tylko 28% twierdzi, że regularnie korzysta ze AI w pracy. Możliwy powód: obawy dotyczące bezpieczeństwa!

Użytkownicy mogą nie chcieć udostępniać wrażliwych danych dotyczących podejmowania decyzji zewnętrznej AI.

ClickUp rozwiązuje ten problem, wprowadzając rozwiązania oparte na AI bezpośrednio do Twojego bezpiecznego obszaru roboczego. Od SOC 2 po normy ISO, ClickUp jest zgodny z najwyższymi standardami bezpieczeństwa danych i pomaga w bezpiecznym korzystaniu z generatywnej technologii AI w całym obszarze roboczym.

Polityka zarządzania AI i odpowiedzialności

Solidny program zarządzania AI tworzy jasną strukturę własności i spójne standardy, których mogą przestrzegać wszyscy członkowie zespołu.

Twoja organizacja potrzebuje jasnych struktur zarządzania, aby zapewnić, że zawsze ktoś będzie odpowiedzialny za etyczne tworzenie i wdrażanie AI.

Oto podstawowe elementy skutecznego programu zarządzania AI:

| Element zarządzania | Co to oznacza | Kroki, które możesz podjąć w swojej organizacji |

|---|---|---|

| Jasny podział własności | Za etykę, nadzór i zgodność z przepisami w zakresie AI odpowiedzialne są wyznaczone osoby lub zespoły. | • Powołaj kierownika ds. etyki AI lub komitet międzyfunkcyjny. • Określ obowiązki w zakresie danych, jakości modeli, zgodności i ryzyka. • Uwzględnij opinie działów prawnego, inżynieryjnego, produktowego i DEI w procesie nadzoru. |

| Udokumentowane zasady | Pisemne wytyczne określające sposób gromadzenia, wykorzystywania i monitorowania danych w całym cyklu życia AI. | • Stwórz wewnętrzne zasady dotyczące źródeł danych, etykietowania, prywatności i przechowywania • Udokumentuj standardy dotyczące opracowywania, walidacji i wdrażania modeli • Wymagaj od zespołów przestrzegania list kontrolnych przed wprowadzeniem jakiegokolwiek systemu AI |

| Ścieżki audytu | Przejrzysty rejestr decyzji, wersji modeli, zbiorów danych i zmian | • Wprowadź kontrolę wersji dla zbiorów danych i modeli • Rejestruj kluczowe decyzje, parametry modeli i wyniki przeglądów • Przechowuj ścieżki audytu w centralnym, dostępnym repozytorium |

| Regularne przeglądy | Bieżące oceny systemów AI w celu sprawdzenia tendencyjności, odchyleń i luk w zgodności z przepisami. | • Planuj kwartalne lub półroczne oceny stronniczości za pomocą solidnej oceny LLM • Przeprowadzaj ponowne szkolenia lub kalibrację modeli w przypadku spadku wydajności lub zmiany zachowania • Sprawdzaj modele po większych aktualizacjach danych lub zmianach produktów |

| Plan reagowania na incydenty | Jasny protokół identyfikacji, raportowania i korygowania stronniczości lub szkód spowodowanych przez AI. | • Stwórz wewnętrzny cykl pracy eskalacji stronniczości • Określ, w jaki sposób badane są problemy i kto zatwierdza poprawki • Nakreśl kroki komunikacyjne dla użytkowników, klientów lub organów regulacyjnych w razie potrzeby |

💡Wskazówka dla profesjonalistów: Ramy takie jak NIST AI Risk Management Framework i UE AI Act, przewidujące kary w wysokości do 7% rocznego obrotu, mogą stanowić doskonały wzór do stworzenia własnego programu zarządzania.

Jak wdrożyć ograniczanie stronniczości za pomocą ClickUp

Zintegrowany obszar roboczy ClickUp AI łączy wszystkie elementy programu zarządzania AI w jednym, uporządkowanym miejscu.

Twoje zespoły mogą zarządzać zadaniami, przechowywać zasady, przeglądać wyniki audytów, omawiać ryzyko i śledzić incydenty bez konieczności przełączania się między narzędziami lub utraty kontekstu. Każdy zapis modelu, dziennik decyzji i plan naprawczy pozostają połączone, dzięki czemu zawsze wiesz, kto co zrobił i dlaczego.

Ponieważ sztuczna inteligencja ClickUp rozumie pracę w Twoim obszarze roboczym, może ona wyświetlać poprzednie oceny, podsumowywać długie raporty i pomagać zespołowi w dostosowywaniu się do zmieniających się standardów. W rezultacie powstaje system zarządzania, który jest łatwiejszy do przestrzegania, łatwiejszy do kontroli i znacznie bardziej niezawodny w miarę rozwoju sztucznej inteligencji.

Rozbijmy to na poszczególne etapy cyklu pracy!

Krok 1: Skonfiguruj obszar roboczy zarządzania AI

Zacznij od utworzenia w ClickUp dedykowanej przestrzeni dla wszystkich zadań związanych z zarządzaniem. Dodaj listy zawierające wykaz modeli, oceny stronniczości, raporty dotyczące incydentów, dokumenty dotyczące polityki i zaplanowane przeglądy, aby wszystkie elementy programu znajdowały się w jednym kontrolowanym środowisku.

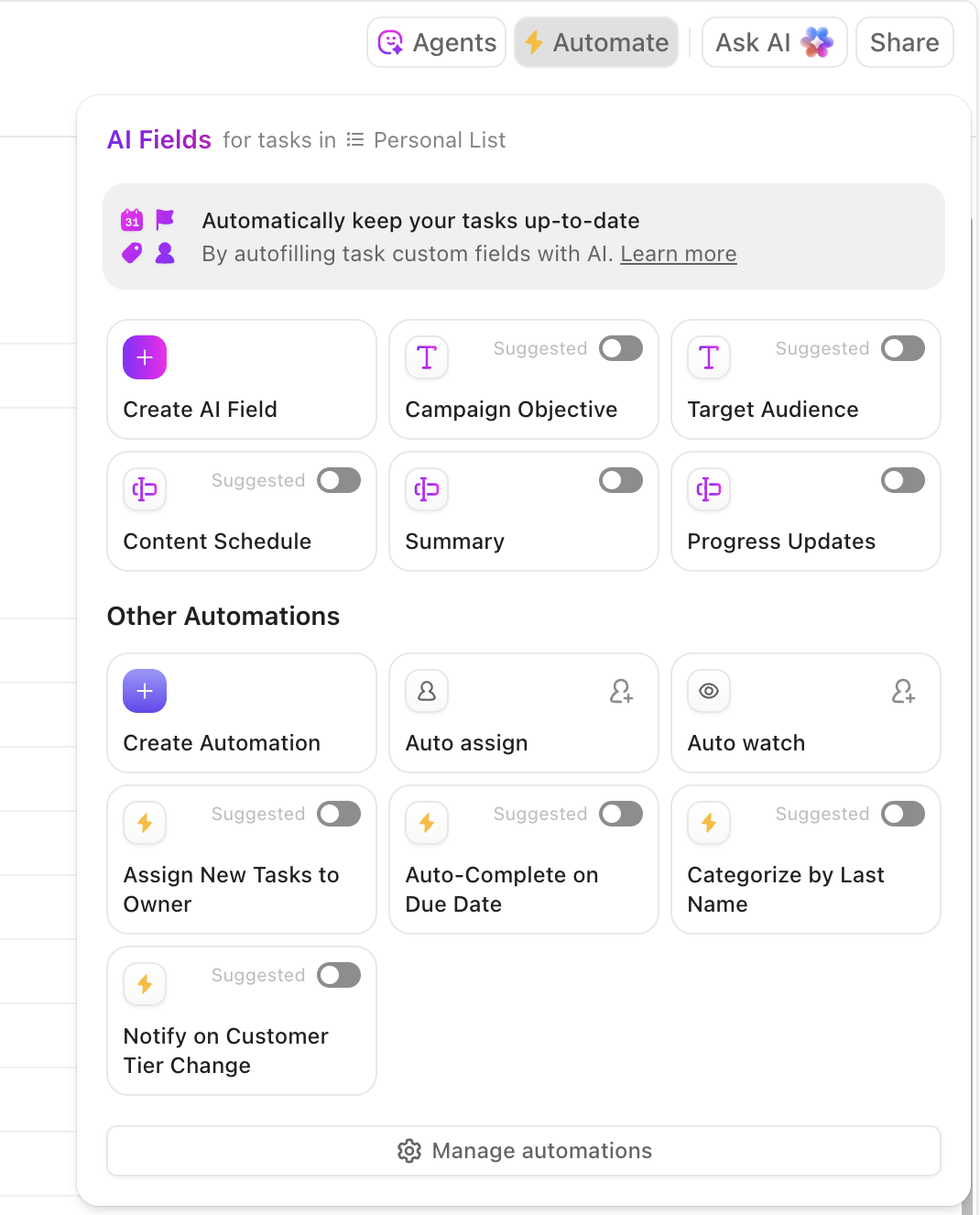

Skonfiguruj pola niestandardowe lub pola AI, aby śledzić wskaźniki sprawiedliwości, wyniki stronniczości, wersje modeli, status przeglądu i poziomy ryzyka. Korzystaj z uprawnień opartych na rolach, aby zapewnić, że tylko upoważnieni recenzenci, inżynierowie i kierownicy ds. zgodności mają dostęp do wrażliwych zadań związanych ze sztuczną inteligencją. Tworzy to podstawę strukturalną, której nie mogą zaoferować narzędzia punktowe konkurencji i ogólne platformy projektowe.

Krok 2: Stwórz ramy zarządzania

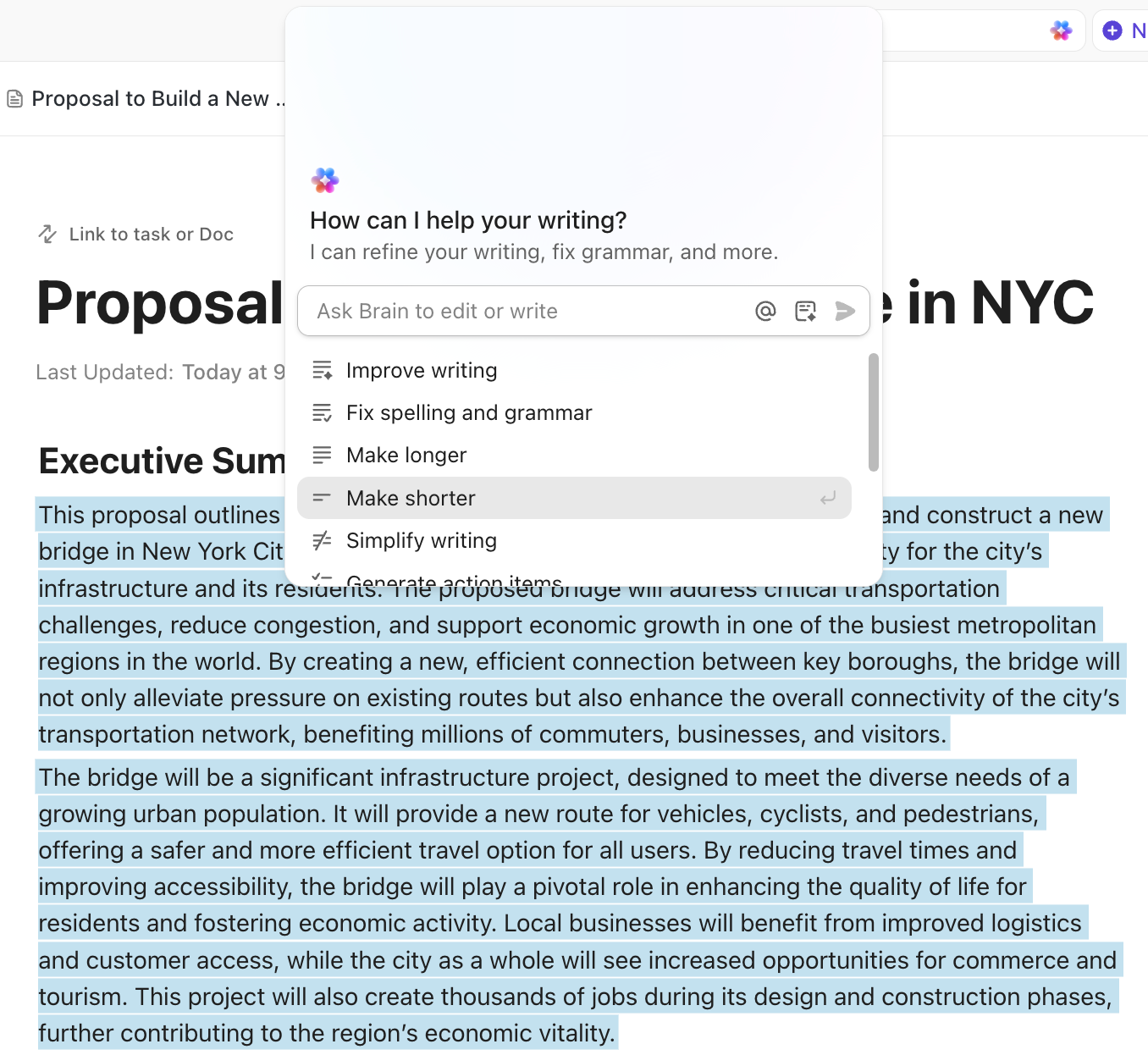

Następnie utwórz dokument ClickUp Doc, który posłuży jako podręcznik zarządzania. W tym miejscu nakreśl procedury oceny stronniczości, progi sprawiedliwości, wytyczne dotyczące dokumentacji modeli, kroki związane z udziałem człowieka w procesie oraz protokoły eskalacji.

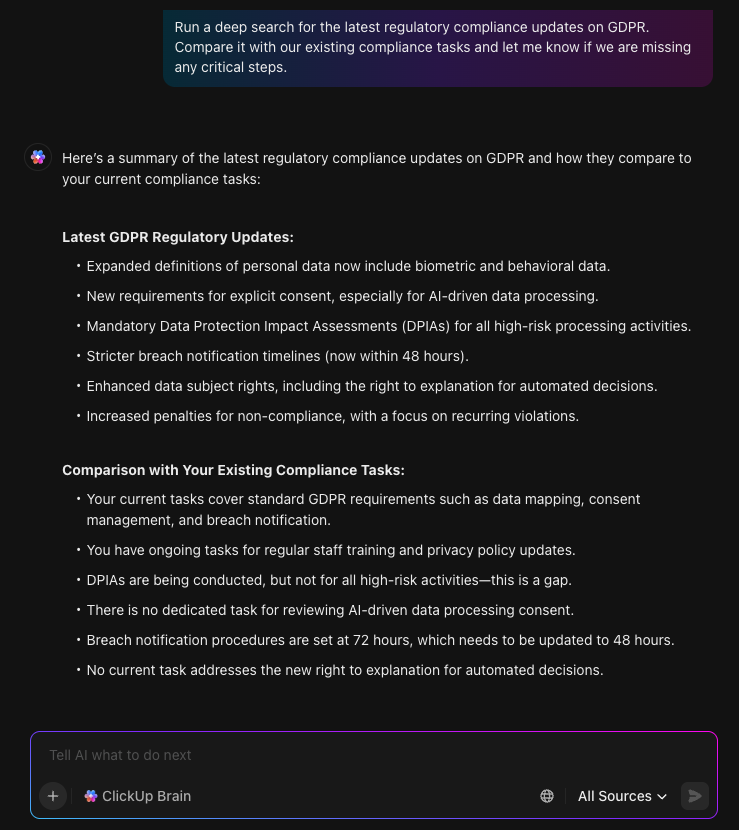

Ponieważ dokumenty pozostają połączone z zadaniami i rekordami modeli, Twoje zespoły mogą współpracować bez utraty historii wersji lub rozpraszania plików między różnymi narzędziami. Następnie ClickUp Brain może pomóc w podsumowaniu zewnętrznych regulacji, opracowaniu nowych treści polityki lub ujawnieniu wcześniejszych wyników audytu, dzięki czemu tworzenie polityki będzie bardziej spójne i możliwe do prześledzenia.

Dzięki możliwości przeszukiwania sieci, przełączania się między wieloma modelami AI i syntetyzowania informacji w jasne wytyczne, Twój zespół jest na bieżąco z pojawiającymi się standardami i zmianami w branży bez opuszczania obszaru roboczego. Wszystko, czego potrzebujesz — aktualizacje zasad, informacje dotyczące przepisów i poprzednie decyzje — znajduje się w jednym miejscu, dzięki czemu system zarządzania jest bardziej stabilny i znacznie łatwiejszy w utrzymaniu.

Krok 3: Zarejestruj każdy model

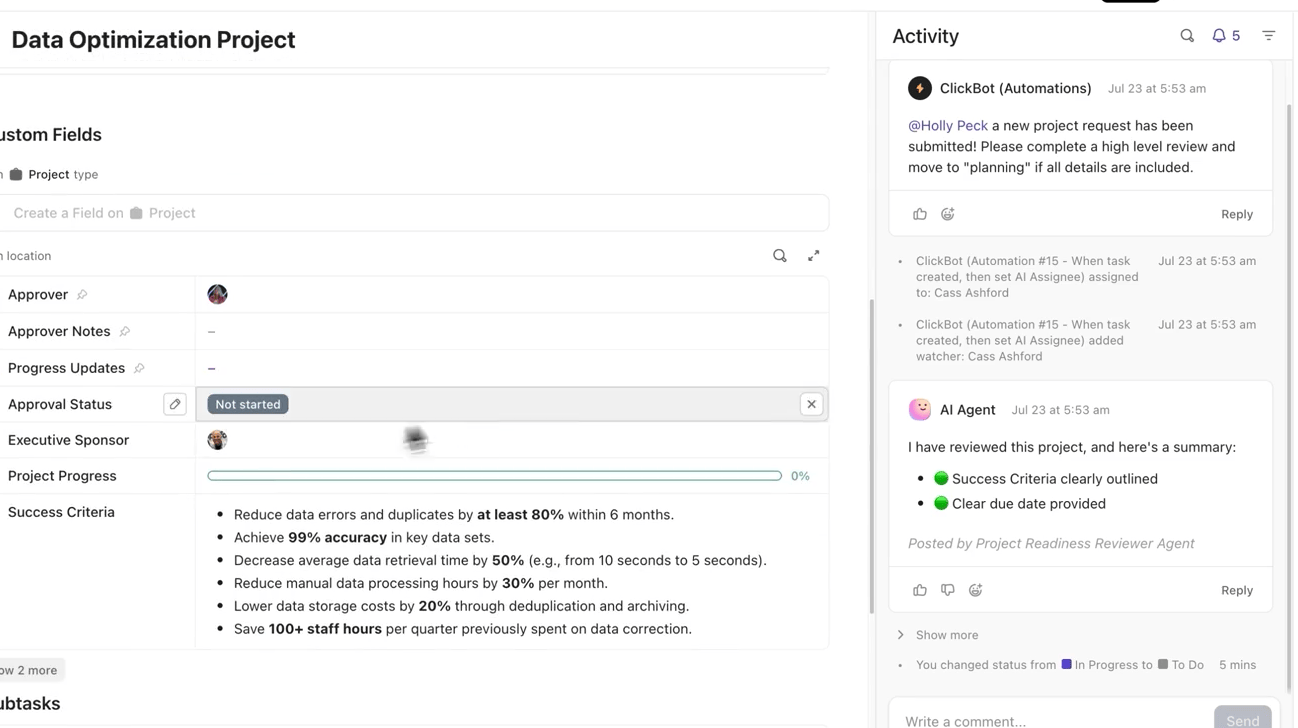

Każdy model powinien mieć swoje własne zadanie na liście „Inwentarz modeli”, aby zawsze było jasne, kto jest jego właścicielem i kto ponosi za niego odpowiedzialność.

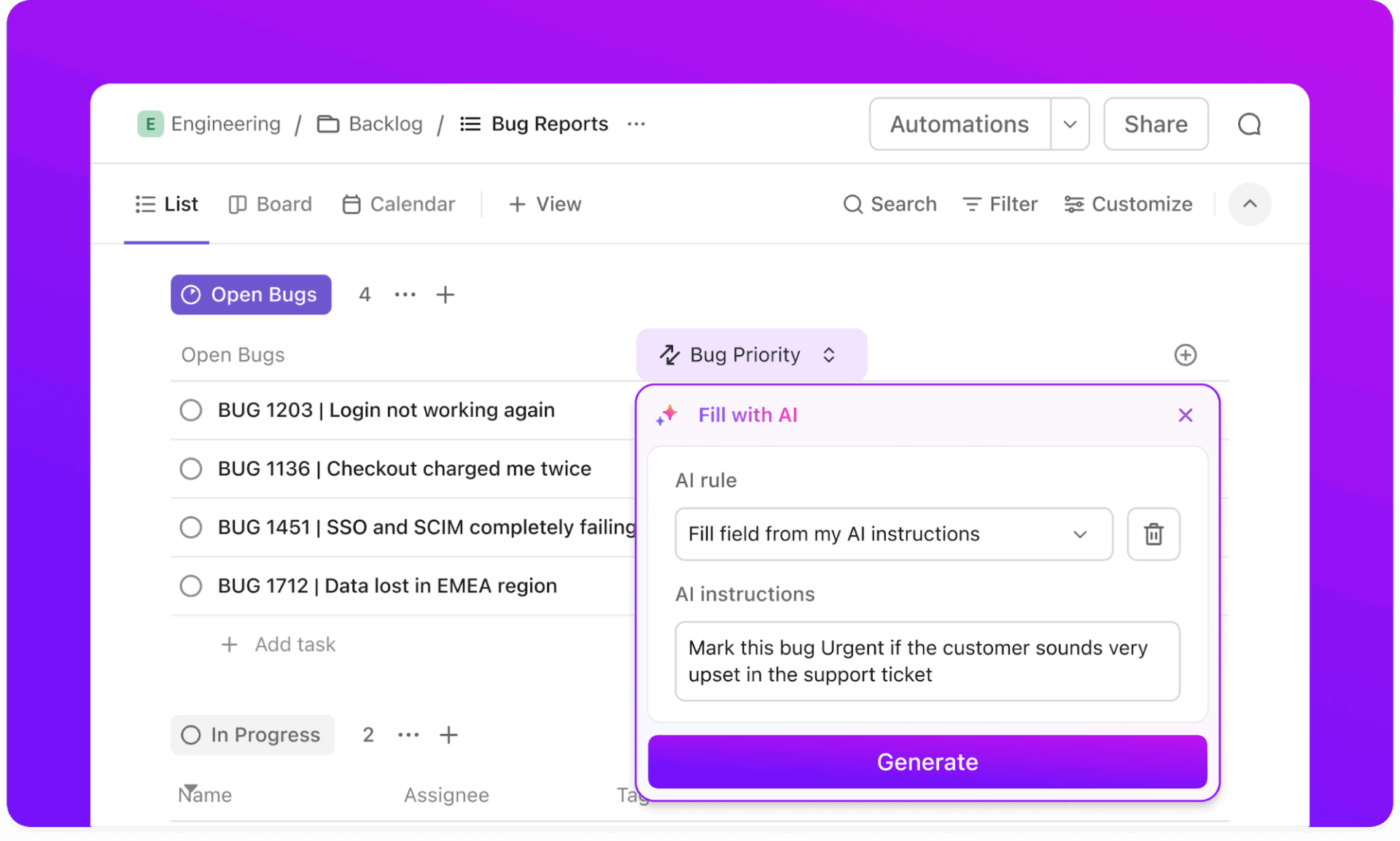

Łatwo śledź każdy przypadek stronniczości jako element wymagający działania, korzystając z zadań ClickUp i pól niestandardowych ClickUp, aby ustrukturyzować cykle pracy związane z oceną stronniczości i uchwycić wszystkie ważne szczegóły.

W ten sposób można śledzić rodzaj stronniczości, poziom jej nasilenia, status działań naprawczych, odpowiedzialnego członka zespołu oraz termin następnej kontroli, zapewniając jasny podział własności i terminy realizacji każdego problemu.

Dołącz zestawy danych, podsumowania ocen i notatki dotyczące pochodzenia, aby wszystko znajdowało się w jednym miejscu. Automatyzacja może następnie powiadamiać recenzentów, gdy model przechodzi do fazy testowej lub produkcyjnej.

Krok 4: Przeprowadzaj zaplanowane i oparte na wydarzeniach audyty stronniczości

Audyty stronniczości powinny odbywać się zarówno zgodnie z harmonogramem, jak i w odpowiedzi na konkretne wyzwalacze.

Skonfiguruj proste reguły za pomocą ClickUp automatyzacji, która automatycznie wyzwala zadania przeglądu, gdy model osiąga nowy kamień milowy wdrożenia lub zbliża się termin zaplanowanego audytu. Nigdy więcej nie przegapisz kwartalnej oceny stronniczości, ponieważ automatyzacja może przydzielić odpowiednich recenzentów, ustawić właściwe terminy, a nawet wysyłać przypomnienia w miarę zbliżania się terminów.

W przypadku audytów opartych na zdarzeniach formularze ClickUp ułatwiają gromadzenie zgłoszeń dotyczących przypadków stronniczości lub opinii pracowników, a recenzenci mogą korzystać z pól niestandardowych do rejestrowania luk w zakresie sprawiedliwości, wyników testów i zaleceń. Każdy przesłany formularz jest przekazywany do Twojego zespołu jako zadanie ClickUp, co tworzy powtarzalny proces audytu.

Krok 5: Badanie i rozwiązywanie przypadków stronniczości

W przypadku wykrycia problemu związanego z tendencyjnością należy utworzyć zadanie dotyczące incydentu, które uwzględnia jego powagę, grupy, na które ma wpływ, wersję modelu oraz wymagane działania łagodzące. Agenci AI mogą eskalować wyniki o wysokim ryzyku do kierowników ds. zgodności i przydzielać odpowiednich recenzentów i inżynierów.

Każde działanie ograniczające, wynik testu i krok walidacji pozostaje połączony z zapisem zdarzenia. ClickUp Brain może generować podsumowania dla kierownictwa lub pomagać w przygotowywaniu notatek dotyczących działań naprawczych do dokumentacji dotyczącej zarządzania, zapewniając przejrzystość i możliwość śledzenia wszystkich działań.

Krok 6: Monitoruj stan swojego programu zarządzania AI

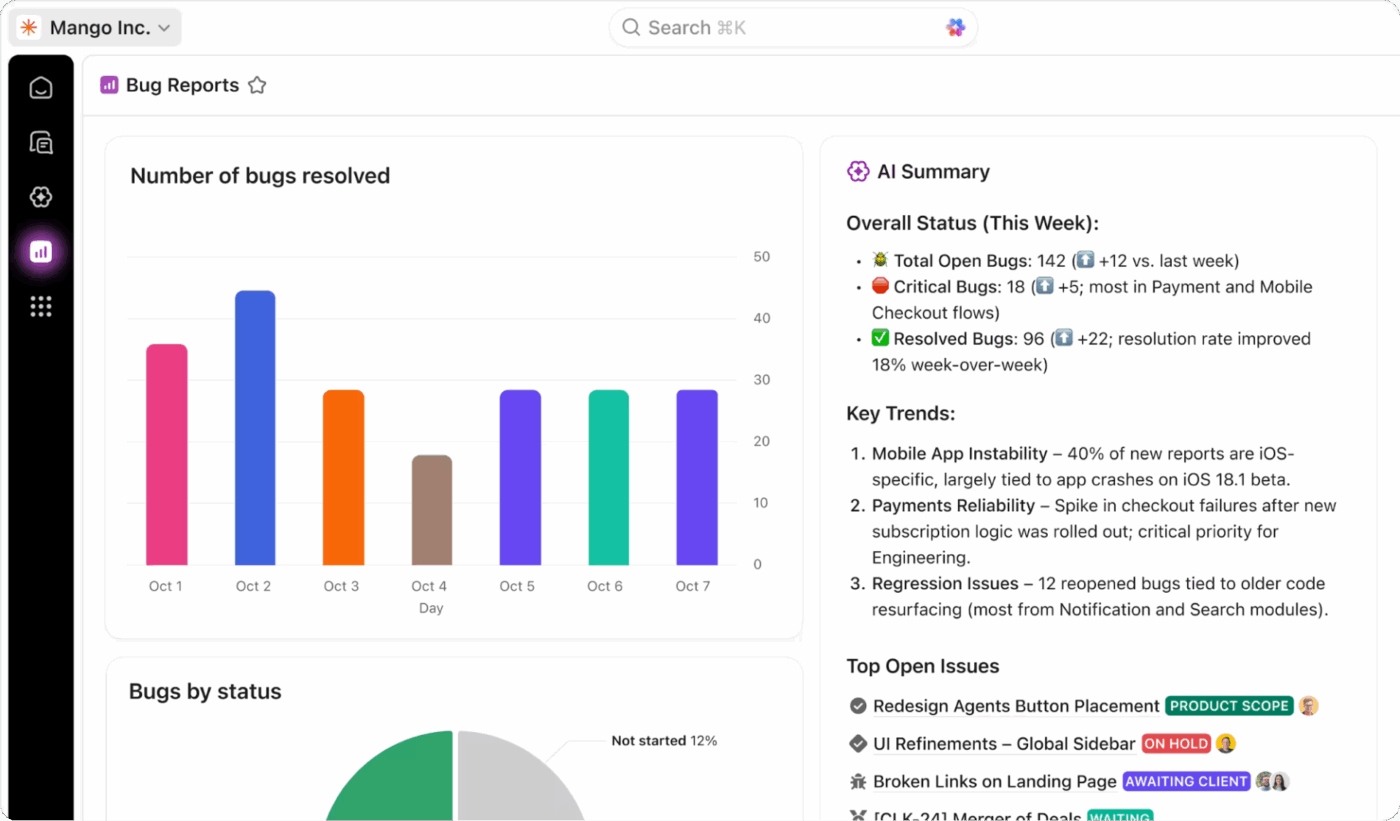

Na koniec stwórz pulpity nawigacyjne, które zapewnią liderom widok w czasie rzeczywistym na program ograniczania stronniczości.

Dodaj panele pokazujące otwarte incydenty, czas rozwiązania, wskaźniki ukończenia audytu, wskaźniki sprawiedliwości i status zgodności we wszystkich aktywnych modelach. Pulpity nawigacyjne bez kodowania w ClickUp mogą automatycznie pobierać dane i aktualizować zadania w miarę postępu prac, a podsumowania AI są wbudowane w widok pulpitu nawigacyjnego.

📖 Więcej informacji: Jak pokonać typowe wyzwania związane z AI

Kontrole stronniczości po wdrożeniu

Twoja praca nie jest gotowa wraz z uruchomieniem modelu AI.

W rzeczywistości to właśnie wtedy zaczyna się prawdziwy test. Modele mogą z czasem „dryfować” i rozwijać nowe tendencje, ponieważ dane z rzeczywistego świata, które widzą, zaczynają się zmieniać. Ciągłe monitorowanie jest jedynym sposobem, aby wychwycić te pojawiające się tendencje, zanim spowodują one powszechne szkody.

Oto, co powinno obejmować bieżące monitorowanie:

| Praktyka | Co to zapewnia |

|---|---|

| Śledzenie wyników według grup | Ciągłe mierzenie dokładności i sprawiedliwości modelu w różnych segmentach demograficznych, aby wcześnie wykrywać rozbieżności. |

| Wykrywanie dryfu danych | Monitoruje zmiany w danych wejściowych, które mogą wprowadzać nowe tendencyjności lub osłabiać wydajność modelu w miarę upływu czasu. |

| Pętle informacji zwrotnych od użytkowników | Zapewnia użytkownikom przejrzyste kanały raportowania stronniczych lub nieprawidłowych wyników, poprawiając nadzór w rzeczywistym świecie. |

| Zaplanowane audyty | Zapewnia kwartalne lub półroczne dogłębne analizy zachowania modelu, wskaźników sprawiedliwości i wymagań dotyczących zgodności. |

| Reagowanie na incydenty | Określa ustrukturyzowany proces badania, korygowania i dokumentowania wszelkich zgłoszonych zdarzeń stronniczości. |

💟 Bonus: Systemy generatywne AI wymagają szczególnej czujności, ponieważ ich wyniki są znacznie mniej przewidywalne niż w przypadku tradycyjnych modeli uczenia maszynowego. Doskonałą techniką w tym zakresie jest red-teaming, w ramach którego dedykowany zespół aktywnie próbuje wywołać stronnicze lub szkodliwe reakcje modelu, aby zidentyfikować jego słabe punkty.

Na przykład projekt Lighthouse firmy Airbnb stanowi doskonałe studium przypadku z branży, przedstawiające firmę wdrażającą systematyczne monitorowanie stronniczości po wdrożeniu.

Jest to inicjatywa badawcza, która analizuje, w jaki sposób postrzegana rasa może wpływać na wyniki rezerwacji, pomagając firmie zidentyfikować i ograniczyć dyskryminację na platformie. Wykorzystuje ona metody zapewniające prywatność, współpracuje z grupami zajmującymi się prawami obywatelskimi i przekłada wyniki badań na zmiany w produktach i polityce, umożliwiając większej liczbie gości korzystanie z platformy bez napotykania niewidocznych przeszkód.

📖 Więcej informacji: Sztuczna inteligencja generatywna a sztuczna inteligencja predykcyjna: zrozumienie różnic i zastosowań

Ograniczaj stronniczość AI dzięki ClickUp

Budowanie sprawiedliwej i odpowiedzialnej AI jest zobowiązaniem organizacyjnym.

Kiedy Twoje zasady, ludzie, procesy i narzędzia działają w harmonii, tworzysz system zarządzania, który może dostosować się do nowych zagrożeń, szybko reagować na incydenty i zdobywać zaufanie osób, które polegają na Twoich produktach.

Dzięki ustrukturyzowanym przeglądom, przejrzystej dokumentacji i powtarzalnym cyklom pracy w przypadku stronniczości Teams pozostają zgrane i odpowiedzialne, zamiast reagować w trybie kryzysowym.

Centralizując wszystko w ClickUp, od rekordów modeli po wyniki audytów i raporty incydentów, tworzysz jedną warstwę operacyjną, w której decyzje są przejrzyste, obowiązki jasne, a ulepszenia nigdy nie giną w natłoku innych zadań.

Silne zarządzanie nie spowalnia innowacji, a je stabilizuje. Chcesz włączyć ograniczanie stronniczości do swoich cykli pracy AI? Zacznij bezpłatnie korzystać z ClickUp i już dziś rozpocznij tworzenie programu zarządzania AI.

Często zadawane pytania

Doskonałym pierwszym krokiem jest przeprowadzenie audytu stronniczości istniejących systemów AI. Ta podstawowa ocena pokaże, gdzie obecnie występują nieuczciwości, i pomoże ustalić priorytety wysiłków mających na celu ich ograniczenie.

Zespoły wykorzystują konkretne wskaźniki sprawiedliwości, takie jak parytet demograficzny, wyrównane szanse i wskaźnik zróżnicowanego oddziaływania, aby określić ilościowo stronniczość. Wybór odpowiedniego wskaźnika zależy od konkretnego przypadku użycia i rodzaju sprawiedliwości, która jest najważniejsza w danym kontekście.

W przypadku decyzji o dużym znaczeniu, które mają istotny wpływ na życie lub możliwości danej osoby, takich jak zatrudnienie, udzielenie kredytu lub opieka zdrowotna, zawsze należy dodać krok weryfikacji przez człowieka. Rozsądnie jest również stosować tę strategię podczas wczesnego wdrażania każdego nowego modelu, gdy jego zachowanie jest nadal nieprzewidywalne.

Ponieważ generatywna AI może generować niemal nieskończony zakres nieprzewidywalnych odpowiedzi, nie wystarczy po prostu sprawdzić jej dokładność. Należy stosować aktywne techniki testowania, takie jak red teaming i pobieranie próbek wyników na dużą skalę, aby sprawdzić, czy model generuje stronniczą zawartość w różnych warunkach.