El sesgo de la IA puede parecer un problema tecnológico. Sin embargo, sus efectos se manifiestan en el mundo real y, a menudo, pueden ser devastadores.

Cuando un sistema de IA se inclina por el camino equivocado, aunque sea solo un poco, puede dar lugar a resultados injustos.

Con el tiempo, esos pequeños problemas pueden convertirse en clientes frustrados, problemas de reputación o incluso cuestiones de cumplimiento normativo que no habías previsto.

La mayoría de los equipos no se proponen crear una IA sesgada. Esto ocurre porque los datos son desordenados, el mundo real es desigual y las herramientas que utilizamos no siempre piensan como esperamos. La buena noticia es que no es necesario ser un científico de datos para comprender lo que está sucediendo.

En este blog, le explicaremos qué es realmente el sesgo de la IA, por qué se produce y cómo se manifiesta en las herramientas empresariales cotidianas.

¿Qué es el sesgo de la IA?

El sesgo de la IA se produce cuando un sistema de IA genera resultados sistemáticos e injustos que favorecen o perjudican de forma sistemática a determinados grupos de personas. No se trata de errores aleatorios, sino de patrones predecibles que se incorporan a la forma en que la IA toma decisiones. ¿La causa? La IA aprende a partir de datos que reflejan los sesgos humanos existentes, otros sesgos inconscientes y las desigualdades sociales.

Piénselo de esta manera: si entrena un algoritmo de contratación con datos de la empresa de los últimos diez años, en los que el 90 % de los directivos eran hombres, la IA podría aprender erróneamente que ser hombre es un requisito clave para un rol directivo. La IA no está actuando de forma maliciosa, simplemente identifica y repite los patrones que se le han mostrado.

Esto es lo que hace que el sesgo de la IA sea tan complicado:

- Es sistemático, no aleatorio: la injusticia no es un fallo puntual, sino un patrón repetible en los resultados de la IA.

- A menudo es invisible: los resultados sesgados pueden ocultarse tras las complejas matemáticas de un algoritmo aparentemente neutral, lo que dificulta su detección.

- Se basa en los datos y el diseño: el sesgo se introduce en el sistema a través de las decisiones que tomamos los seres humanos cuando creamos y entrenamos la IA.

⭐ Plantilla destacada

La plantilla de informe de respuesta a incidencias de ClickUp proporciona una estructura lista para usar que permite documentar, realizar el seguimiento y resolver incidencias de principio a fin. Registre todos los detalles relevantes de la incidencia, mantenga estados claramente categorizados y capture atributos importantes como la gravedad, los grupos afectados y las medidas correctivas. Admite campos personalizados para elementos como Aprobado por, Notas de la incidencia y Documentos de apoyo, que ayudan a poner de manifiesto la responsabilidad y las pruebas a lo largo del proceso de revisión.

📖 Más información: Cómo realizar una evaluación de riesgos: herramientas y técnicas

Por qué es importante mitigar el sesgo de la IA

Cuando sus sistemas de IA son injustos, corre el riesgo de perjudicar la vida de personas reales.

Esto, a su vez, expone a su organización a graves retos empresariales e incluso puede destruir la confianza que ha trabajado duro para construir con sus clientes.

Una IA sesgada que deniega un préstamo a alguien, rechaza su solicitud de empleo o hace una recomendación incorrecta tiene graves consecuencias en el mundo real.

Las normas y marcos emergentes del sector animan ahora a las organizaciones a identificar y abordar activamente los sesgos en sus sistemas de IA. Los riesgos afectan a su organización desde todos los ángulos:

- Riesgo normativo: el incumplimiento de las nuevas normas sobre IA puede dar lugar a importantes retos para la empresa.

- Daño a la reputación: una vez que el público se entera de que su IA es sesgada, es increíblemente difícil recuperar su confianza.

- Ineficiencia operativa: los modelos sesgados producen resultados poco fiables o alucinaciones de la IA que conducen a decisiones erróneas y requieren costosas soluciones.

- Responsabilidad ética: su organización debe garantizar que la tecnología que implementa trata a todos los usuarios de forma justa.

Cuando se logra mitigar correctamente los sesgos, se crean sistemas de IA en los que las personas pueden confiar realmente. La IA justa abre las puertas a nuevos mercados, mejora la calidad de sus decisiones y demuestra a todo el mundo que usted se compromete a dirigir una empresa ética.

📮 ClickUp Insight: El 22 % de nuestros encuestados sigue mostrándose cauteloso a la hora de utilizar la IA en el trabajo. De ese 22 %, la mitad se preocupa por la privacidad de sus datos, mientras que la otra mitad simplemente no está segura de poder confiar en lo que les dice la IA.

ClickUp aborda ambas preocupaciones de forma directa con medidas de seguridad robustas y generando enlaces detallados a tareas y fuentes con cada respuesta.

Esto significa que incluso los equipos más cautelosos pueden empezar a disfrutar del aumento de la productividad sin perder el sueño por si su información está protegida o si están obteniendo resultados fiables.

📖 Más información: Asistente de cumplimiento normativo de IA: cómo la IA está transformando el cumplimiento normativo y las auditorías

Tipos y fuentes de sesgos en la IA

El sesgo puede colarse en sus sistemas de IA desde múltiples direcciones.

Desde el momento en que comienza a recopilar datos hasta mucho después de que se implemente el sistema, este elemento se mantiene relativamente estable. Pero si sabe dónde buscar, puede establecer objetivos y dejar de jugar al juego interminable del «whack-a-mole» con resultados injustos.

Sesgo de muestra

El sesgo de muestreo se produce cuando los datos que utiliza para entrenar su IA no representan con precisión el mundo real en el que se utilizará la IA.

Por ejemplo, si crea un sistema de reconocimiento de voz entrenado principalmente con datos de hablantes de inglés americano, naturalmente le costará entender a personas con acento escocés o indio, de forma similar a cómo los LLM favorecen los nombres asociados a personas blancas en el 85,1 % de los casos en la selección de currículos. Esta infrarrepresentación crea enormes puntos ciegos, lo que hace que su modelo no esté preparado para atender a grupos enteros de personas.

Sesgos algorítmicos

El sesgo algorítmico se produce cuando el diseño del modelo o el proceso matemático amplifican patrones injustos, incluso si los datos parecen neutrales.

El código postal de una persona no debería determinar si obtiene un préstamo, pero si los códigos postales de sus datos de entrenamiento están fuertemente correlacionados con la raza, el algoritmo podría aprender a utilizar la ubicación como un indicador de discriminación.

Este problema se agrava aún más con los bucles de retroalimentación: cuando una predicción sesgada (como la denegación de un préstamo) se introduce en el sistema como nuevo dato, el sesgo no hace más que intensificarse con el tiempo.

Sesgos en las decisiones humanas

Cada decisión que toma una persona al crear un sistema de IA puede introducir sesgos.

Esto incluye decidir qué datos recopilar, cómo etiquetarlos y cómo definir el «éxito» del modelo. Por ejemplo, un equipo podría favorecer inconscientemente los datos que respaldan lo que ya cree (sesgo de confirmación) o dar demasiada importancia a la primera información que ve (sesgo de anclaje).

Incluso los equipos con las mejores intenciones pueden codificar accidentalmente sus propios supuestos y su visión del mundo en un sistema de IA.

📖 Más información: 10 plantillas de gobernanza de proyectos para gestionar tareas

Ejemplos de sesgos de la IA en el mundo real

Empresas reales se han enfrentado a graves consecuencias cuando sus sistemas de IA mostraron sesgos, lo que les costó millones en daños y la pérdida de la confianza de los clientes. A continuación se presentan algunos ejemplos documentados:

1. Herramientas de reclutamiento sesgadas

Uno de los casos más citados fue el de una importante empresa tecnológica que descartó un sistema interno de reclutamiento basado en IA después de que este aprendiera a favorecer a los candidatos masculinos frente a las mujeres. El sistema se entrenó con una década de currículos en los que la mayoría de los candidatos seleccionados eran hombres. Así que empezó a penalizar los currículos que contenían palabras como «mujeres», llegando incluso a rebajar la calificación de las graduadas de universidades femeninas.

Esto muestra cómo el sesgo de los datos históricos, cuando los patrones del pasado reflejan la desigualdad existente, puede colarse en la automatización a menos que se audite cuidadosamente. Sin embargo, a medida que la contratación automatizada con IA se vuelve más frecuente, la magnitud del problema se hace aún mayor.

🌼 ¿Sabías que... Datos recientes muestran que el 37 % de las organizaciones ahora «integran activamente» o «experimentan» con herramientas de IA genérica en la contratación, frente al 27 % de hace un año.

2. Reconocimiento facial que deja fuera a la mitad de la población

Una investigación dirigida por Joy Buolamwini y documentada en el estudio Gender Shades reveló que los sistemas comerciales de reconocimiento facial tenían tasas de error de hasta el 34,7 % en el caso de las mujeres de piel oscura, en comparación con menos del 1 % en el caso de los hombres de piel clara.

Esto vuelve a ser un reflejo de los conjuntos de datos de entrenamiento desequilibrados. El sesgo en las herramientas biométricas tiene efectos aún más trascendentales.

La policía y las agencias gubernamentales también se han encontrado con problemas relacionados con el sesgo en el reconocimiento facial. Las investigaciones de The Washington Post revelaron que algunos de estos sistemas eran mucho más propensos a identificar erróneamente a personas pertenecientes a grupos marginados. En varios casos reales, esto provocó detenciones injustificadas, reacciones negativas por parte del público y una gran preocupación sobre cómo estas herramientas afectan a los derechos de las personas.

3. Algoritmos sanitarios que restan prioridad a la atención médica

Los sistemas de IA sanitarios diseñados para predecir qué pacientes necesitan cuidados adicionales también han mostrado sesgos.

En un caso bien documentado, un algoritmo de predicción sanitaria muy utilizado cometió un error significativo. Se suponía que debía ayudar a decidir qué pacientes debían recibir atención adicional, pero acabó dando sistemáticamente menor prioridad a los pacientes negros, incluso cuando estaban igual o más enfermos que los pacientes blancos.

Esto sucedió porque el modelo utilizaba el gasto sanitario como indicador de las necesidades médicas. Dado que los pacientes negros tenían históricamente un menor gasto sanitario debido al acceso desigual a la atención médica, el algoritmo los trataba como menos necesitados. Como resultado, desviaba los recursos sanitarios de quienes realmente más los necesitaban. Los investigadores descubrieron que con solo corregir este indicador se podía aumentar significativamente el acceso a programas de atención sanitaria equitativos.

La preocupación por estos problemas ha llevado a los grupos de derechos civiles a presionar para que se adopten normas de «equidad primero» en la IA aplicada a la asistencia sanitaria. En diciembre de 2025, la NAACP publicó un plan detallado en el que se instaba a los hospitales, las empresas tecnológicas y los responsables políticos a adoptar auditorías de sesgos, prácticas de diseño transparentes, marcos inclusivos y herramientas de gobernanza de la IA para evitar que se agraven las desigualdades raciales en materia de salud.

4. Algoritmos de crédito con resultados desiguales

La IA y la toma de decisiones automatizada no solo dan forma a lo que ves en las redes sociales, sino que también influyen en quién tiene acceso al dinero y en qué condiciones.

Uno de los ejemplos del mundo real más comentados proviene de la Apple Card, una tarjeta de crédito digital emitida por Goldman Sachs.

En 2019, los clientes compartieron en las redes sociales que el algoritmo de límite de crédito de la tarjeta otorgaba límites mucho más altos a algunos hombres que a sus esposas o parejas femeninas. Esto ocurría incluso cuando las parejas presentaban perfiles financieros similares. Un ingeniero de software afirmó haber recibido un límite de crédito 20 veces superior al de su esposa, e incluso el cofundador de Apple, Steve Wozniak, confirmó una experiencia similar con su cónyuge.

Estos patrones provocaron una protesta pública y dieron lugar a una investigación regulatoria por parte del Departamento de Servicios Financieros del Estado de Nueva York para determinar si el algoritmo discriminaba a las mujeres, lo que puso de relieve cómo las herramientas financieras automatizadas pueden producir resultados desiguales.

5. Subtítulos automáticos y reconocimiento de voz que excluyen voces

Los sistemas de reconocimiento de voz y subtitulado automático a menudo no escuchan a todo el mundo por igual. Múltiples estudios han demostrado que estas herramientas tienden a funcionar mejor con algunos hablantes que con otros, dependiendo de factores como el acento, el dialecto, la raza y si el inglés es la lengua materna del hablante.

Esto ocurre porque los sistemas comerciales suelen entrenarse con conjuntos de datos dominados por determinados patrones lingüísticos, a menudo el inglés occidental estándar, lo que deja otras voces infrarrepresentadas.

Por ejemplo, investigadores de Stanford probaron cinco sistemas líderes de conversión de voz a texto (de Amazon, Google, Microsoft, IBM y Apple) y descubrieron que cometían casi el doble de errores al transcribir el habla de hablantes negros en comparación con los blancos . El problema se producía incluso cuando los sujetos decían las mismas palabras en las mismas condiciones.

Cuando los subtítulos son inexactos para determinados hablantes, pueden provocar una mala experiencia de usuario y la inaccesibilidad para las personas que dependen de los subtítulos. Peor aún, pueden contribuir a resultados sesgados en sistemas que utilizan el reconocimiento de voz en entornos de contratación, educación o atención sanitaria.

Cada uno de estos ejemplos ilustra una forma distinta en la que el sesgo puede incorporarse a los sistemas automatizados, a través de datos de entrenamiento sesgados, proxies mal elegidos o pruebas poco representativas. En todos los casos, los resultados no son solo técnicos, sino que dan forma a las oportunidades, socavan la confianza y conllevan riesgos empresariales y éticos reales.

📖 Más información: Riesgos frente a problemas: ¿cuál es la diferencia?

Resumen: Cómo se manifiesta el sesgo de la IA y a quién perjudica

| Dónde apareció el sesgo | Quiénes se vieron afectados | Impacto en el mundo real |

|---|---|---|

| Algoritmos de reclutamiento (herramienta de contratación de IA descartada) | Mujeres | Los currículos se degradaban en función de palabras clave relacionadas con el género, lo que reducía el acceso a entrevistas y oportunidades laborales. |

| Sistemas de reconocimiento facial (Gender Shades + casos de detenciones injustificadas) | Mujeres de piel oscura; grupos raciales marginados. | Las tasas de identificación errónea, mucho más elevadas, dieron lugar a detenciones injustificadas, daños a la reputación y problemas relacionados con los derechos civiles. |

| Algoritmos de predicción de riesgos sanitarios (estudio de la Universidad de Chicago) | Pacientes negros | Se restó prioridad a los pacientes para recibir atención adicional porque el gasto sanitario se utilizó como un indicador erróneo de las necesidades médicas, lo que agravó las desigualdades en materia de salud. |

| Algoritmos de límite de crédito (investigación de Apple Card) | Mujeres | Los hombres recibieron límites de crédito considerablemente más altos que sus compañeras con la misma cualificación, lo que afectó a su acceso financiero y a su capacidad de endeudamiento. |

| Reconocimiento de voz y subtítulos automáticos (estudio ASR de Stanford) | Ponentes con acentos no estándar; ponentes negros. | Las tasas de error, que casi se duplicaron, crearon barreras de accesibilidad, malentendidos y resultados sesgados en las herramientas utilizadas en la contratación, la educación y el acceso digital diario. |

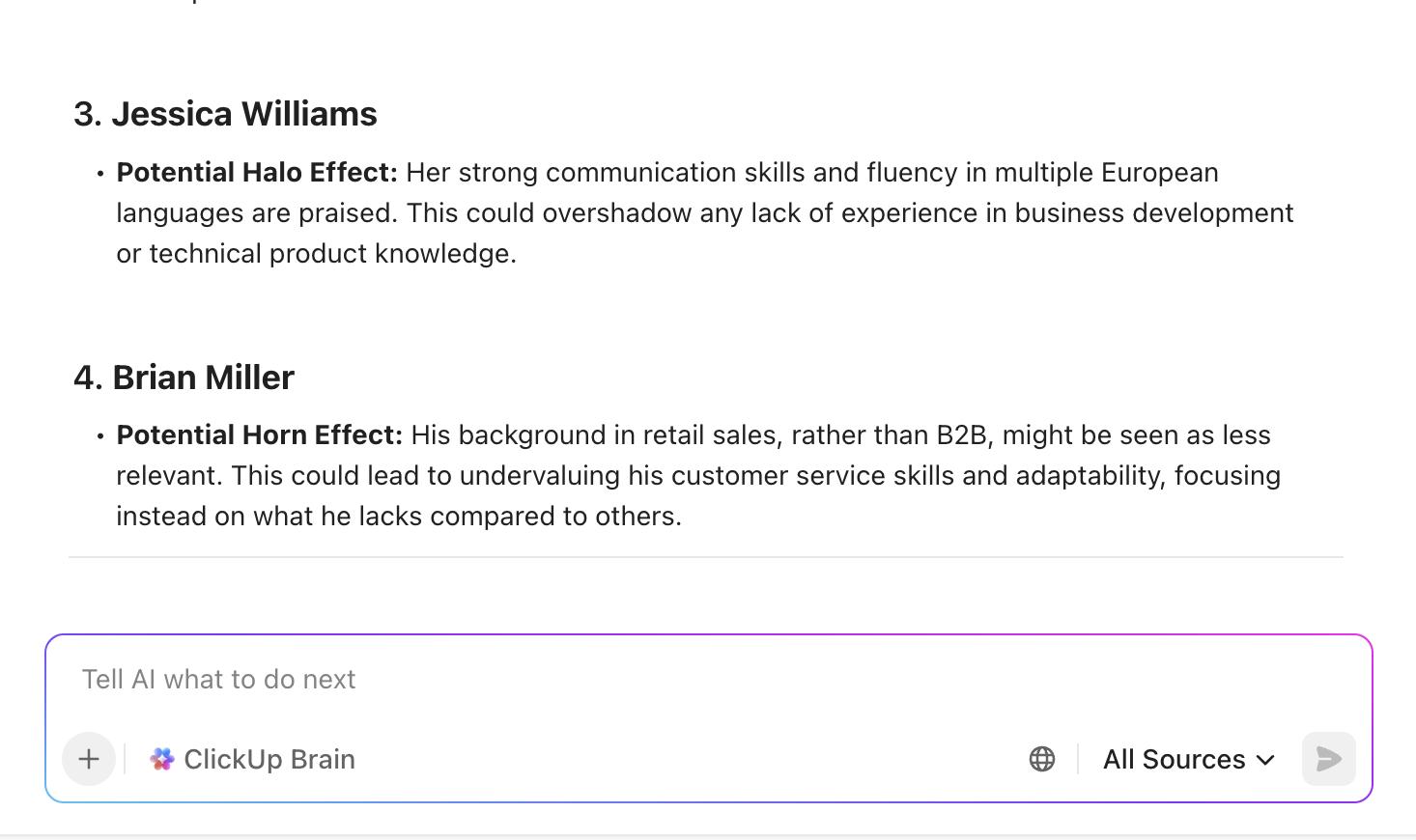

📖 Más información: Cómo evitar el efecto halo y el efecto cuerno para mitigar el sesgo

Estrategias eficaces para mitigar los sesgos

No existe una solución milagrosa para eliminar el sesgo de la IA.

Para mitigar eficazmente los sesgos es necesario aplicar una defensa multicapa a lo largo de todo el ciclo de vida de la IA. Combinando estas estrategias probadas, puede reducir drásticamente el riesgo de obtener resultados injustos.

Recopile datos de entrenamiento diversos.

Los datos representativos son la base absoluta de una IA justa.

Su modelo no puede aprender a atender a grupos de personas que nunca ha visto en su entrenamiento. Empiece por auditar sus conjuntos de datos existentes para encontrar cualquier brecha demográfica. A continuación, haga un esfuerzo consciente por obtener nuevos datos de esas poblaciones infrarrepresentadas.

Cuando es difícil encontrar datos del mundo real, puede utilizar técnicas como el aumento de datos (creación de copias modificadas de datos existentes) o la generación de datos sintéticos para ayudar a llenar los vacíos.

🚧 Kit de herramientas: utilice la plantilla de lista de control de auditoría interna de ClickUp para correlacionar su proceso de auditoría.

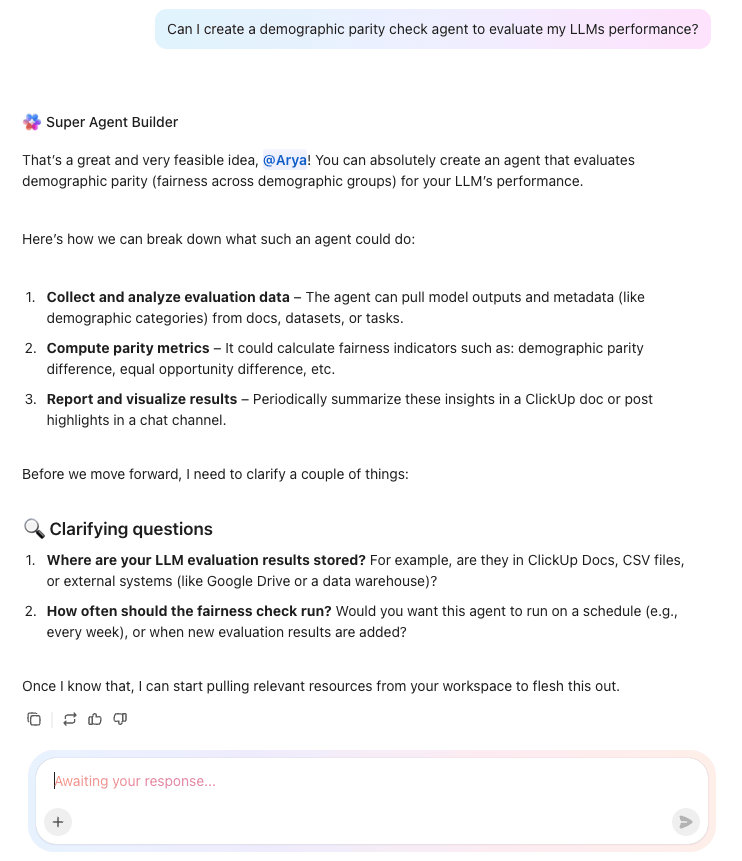

Pruebe modelos para detectar sesgos.

Debe realizar pruebas sistemáticas para detectar los sesgos antes de que causen daños reales. Utilice métricas de equidad para medir el rendimiento de su modelo en diferentes grupos.

Por ejemplo, la paridad demográfica comprueba si el modelo produce un resultado positivo (como la aprobación de un préstamo) en proporciones iguales entre los distintos grupos, mientras que la igualdad de probabilidades comprueba si las tasas de error son iguales.

Divida el rendimiento de su modelo por todos los datos demográficos que pueda (raza, género, edad, geografía) para detectar dónde disminuye la precisión o dónde se cuela la injusticia.

Mantenga al ser humano en el circuito

Los sistemas automatizados pueden pasar por alto sutiles injusticias específicas del contexto que una persona detectaría de inmediato. Un enfoque humano en el ciclo es crucial para las decisiones de alto riesgo, en las que una IA puede hacer una recomendación, pero una persona toma la decisión final.

Esto es especialmente importante en áreas como la contratación, los préstamos y el diagnóstico médico. Para que esto funcione, sus revisores humanos deben estar capacitados para reconocer los sesgos y tener la autoridad para anular las sugerencias de la IA.

📖 Más información: Cómo utilizar la IA centrada en las personas en el lugar de trabajo: la guía definitiva

Aplique técnicas de equidad algorítmica.

También puede utilizar métodos técnicos para intervenir directamente y reducir el sesgo. Estas técnicas se dividen en tres categorías principales:

- Preprocesamiento: consiste en ajustar los datos de entrenamiento antes de que el modelo los vea, a menudo repondiendo o remuestreando los datos para crear una representación más equilibrada de los diferentes grupos.

- En proceso: aquí, se añaden restricciones de equidad directamente en el proceso de entrenamiento del modelo, enseñándole a optimizar tanto la precisión como la equidad al mismo tiempo.

- Postprocesamiento: esto significa ajustar las predicciones finales del modelo después de que se hayan realizado para garantizar que los resultados sean equitativos entre los distintos grupos.

Estas técnicas suelen implicar una compensación, en la que puede ser necesario un ligero descenso de la precisión general para lograr una mejora significativa en la equidad.

💟 Bonificación: BrainGPT es su compañero de escritorio impulsado por IA que lleva las pruebas de sesgo de la IA al siguiente nivel al darle acceso a múltiples modelos líderes, incluidos GPT-5, Claude, Gemini y más, todo en un solo lugar.

Esto significa que puede ejecutar fácilmente las mismas indicaciones o escenarios en diferentes modelos, comparar sus capacidades de razonamiento y detectar dónde divergen las respuestas o muestran sesgos. Esta superaplicación de IA también le permite utilizar la función de conversión de voz a texto para configurar casos de prueba, documentar sus hallazgos y organizar los resultados para realizar análisis comparativos.

Sus herramientas avanzadas de razonamiento y sensibles al contexto le ayudan a resolver problemas, destacar patrones y comprender cómo aborda cada modelo los temas delicados. Al centralizar su flujo de trabajo y permitir pruebas transparentes y multimodelo, Brain MAX le permite auditar, comparar y abordar el sesgo de la IA con confianza y precisión.

Aumente la transparencia y la explicabilidad.

Si no sabe cómo toma decisiones su modelo, no podrá corregirlo cuando se equivoque. Las técnicas de IA explicable (XAI) le ayudan a echar un vistazo dentro de la «caja negra» y ver qué funciones de los datos están impulsando las predicciones.

También puede crear tarjetas de modelo, que son como rótulos nutricionales para su IA, en los que se documenta su uso previsto, los datos de rendimiento y las limitaciones conocidas.

📮ClickUp Insight: El 13 % de los participantes en nuestra encuesta desea utilizar la IA para tomar decisiones difíciles y resolver problemas complejos. Sin embargo, solo el 28 % afirma utilizar la IA de forma habitual en el trabajo. Una posible razón: ¡las preocupaciones por la seguridad!

Es posible que los usuarios no deseen permitir el uso compartido de datos confidenciales relacionados con la toma de decisiones con una IA externa.

ClickUp resuelve este problema llevando la resolución de problemas basada en IA directamente a su entorno de trabajo seguro. Desde SOC 2 hasta las normas ISO, ClickUp cumple con los más altos estándares de seguridad de datos y le ayuda a utilizar de forma segura la tecnología de IA generativa en todo su entorno de trabajo.

Políticas de gobernanza y responsabilidad de la IA

Un programa sólido de gobernanza de la IA crea una propiedad clara y normas coherentes que todos los miembros del equipo pueden seguir.

Su organización necesita estructuras de gobernanza claras para garantizar que siempre haya alguien responsable de crear e implementar la IA de forma ética.

Estos son los elementos esenciales de un programa eficaz de gobernanza de la IA:

| Elemento de gobernanza | Qué significa | Pasos que puede tomar su organización |

|---|---|---|

| Propiedad clara | Hay personas o equipos dedicados que se encargan de la ética, la supervisión y el cumplimiento normativo de la IA. | • Nombrar a un responsable de ética de la IA o crear un comité multifuncional. • Definir las responsabilidades en materia de datos, calidad de los modelos, cumplimiento normativo y riesgos. • Incluir las opiniones de los departamentos jurídico, de ingeniería, de producto y de diversidad, equidad e inclusión en la supervisión. |

| Políticas documentadas | Directrices escritas que definen cómo se recopilan, utilizan y supervisan los datos a lo largo del ciclo de vida de la IA. | • Cree políticas internas para la fuente de datos, el etiquetado, la privacidad y la retención de datos. • Documente las normas para el desarrollo, la validación y la implementación de modelos. • Exija a los equipos que sigan listas de control antes de enviar cualquier sistema de IA. |

| Pistas de auditoría | Un registro transparente de decisiones, versiones de modelos, conjuntos de datos y cambios. | • Implemente el control de versiones para conjuntos de datos y modelos. • Registre las decisiones clave, los parámetros de los modelos y revise los resultados. • Almacene los registros de auditoría en un repositorio central y accesible. |

| Revisiones periódicas | Evaluaciones continuas de los sistemas de IA para comprobar si hay sesgos, desviaciones y deficiencias de cumplimiento. | • Programe evaluaciones de sesgos trimestrales o semestrales mediante una sólida evaluación LLM. • Vuelva a entrenar o recalibre los modelos cuando el rendimiento disminuya o el comportamiento cambie. • Revise los modelos después de actualizaciones importantes de datos o cambios en los productos. |

| Plan de respuesta ante incidencias | Un protocolo claro para identificar, elaborar informes y corregir el sesgo o el daño de la IA. | • Cree un flujo de trabajo interno para la escalada de sesgos. • Defina cómo se investigan los problemas y quién aprueba las soluciones. • Esboce los pasos de comunicación para los usuarios, clientes o reguladores cuando sea necesario. |

💡Consejo profesional: Marcos como el Marco de gestión de riesgos de IA del NIST y la Ley de IA de la UE, con multas de hasta el 7 % de la facturación anual, pueden proporcionar excelentes modelos para crear su propio programa de gobernanza.

Cómo implementar la mitigación del sesgo con ClickUp

El entorno de trabajo de IA convergente de ClickUp reúne todos los elementos móviles de su programa de gobernanza de IA en un único entorno de trabajo organizado.

Sus equipos pueden gestionar tareas, almacenar políticas, revisar los resultados de las auditorías, debatir los riesgos y realizar el seguimiento de las incidencias sin tener que cambiar de herramienta ni perder el contexto. Todos los registros de modelos, los registros de decisiones y los planes de corrección permanecen enlazados, por lo que siempre sabrá quién hizo qué y por qué.

Y como la IA de ClickUp comprende el trabajo dentro de su entorno de trabajo, puede mostrar evaluaciones anteriores, resumir informes largos y ayudar a su equipo a mantenerse alineado a medida que evolucionan los estándares. El resultado es un sistema de gobernanza más fácil de seguir, más fácil de auditar y mucho más fiable a medida que crece su huella de IA.

¡Analicémoslo como un flujo de trabajo!

Paso 1: Configure su entorno de trabajo de gobernanza de la IA

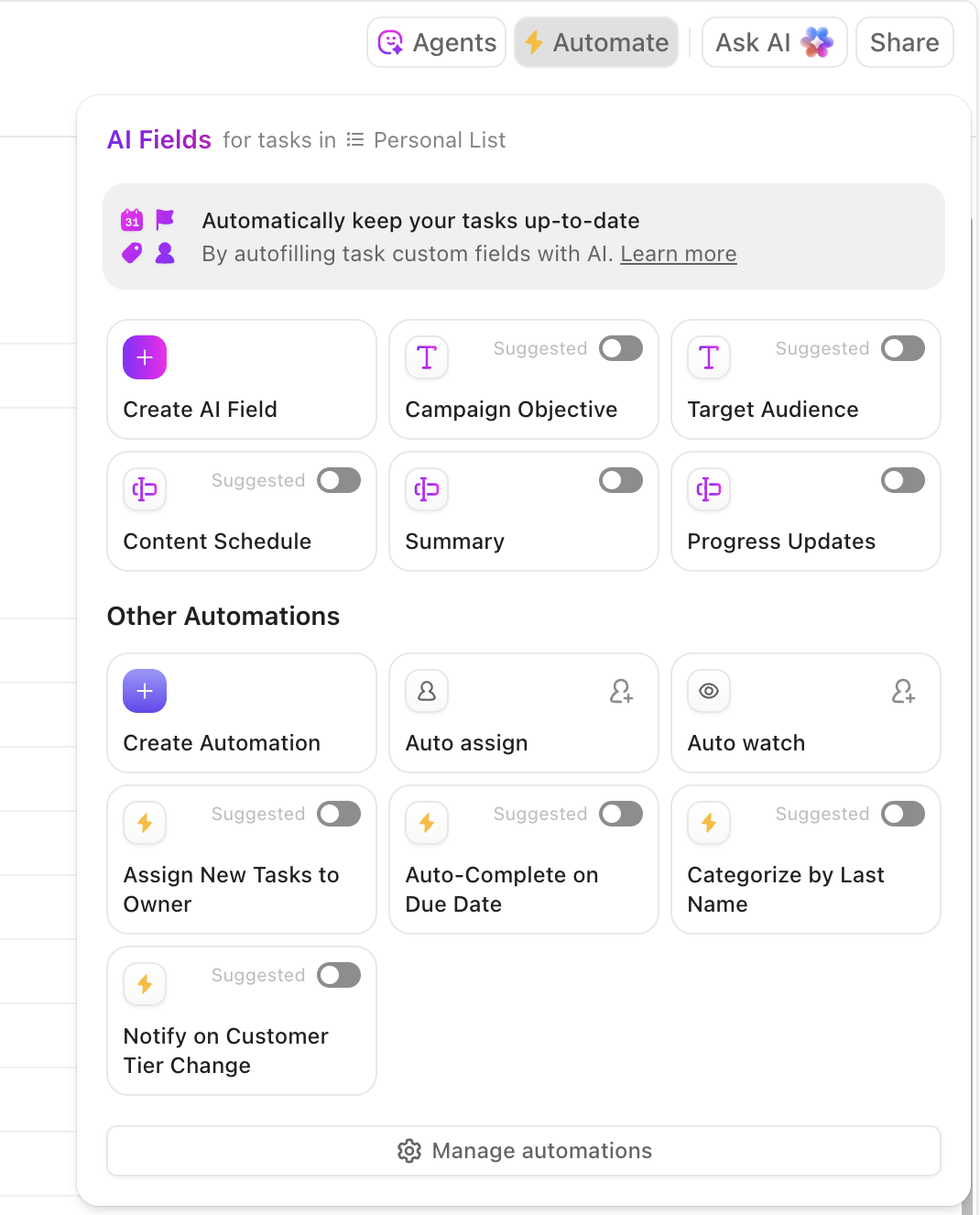

Comience por crear un espacio dedicado en ClickUp para todo el trabajo relacionado con la gobernanza. Añada listas para su inventario de modelos, evaluaciones de sesgos, informes de incidencias, documentos de políticas y revisiones programadas, de modo que todos los elementos del programa se encuentren en un entorno controlado.

Configure campos personalizados o campos de IA para realizar un seguimiento de las métricas de equidad, las puntuaciones de sesgo, las versiones de los modelos, el estado de las revisiones y los niveles de riesgo. Utilice permisos basados en roles para garantizar que solo los revisores, ingenieros y responsables de cumplimiento autorizados puedan acceder al trabajo confidencial de IA. Esto crea una base estructural que las herramientas puntuales y las plataformas de proyectos genéricas de la competencia no pueden ofrecer.

Paso 2: Cree su marco de gobernanza

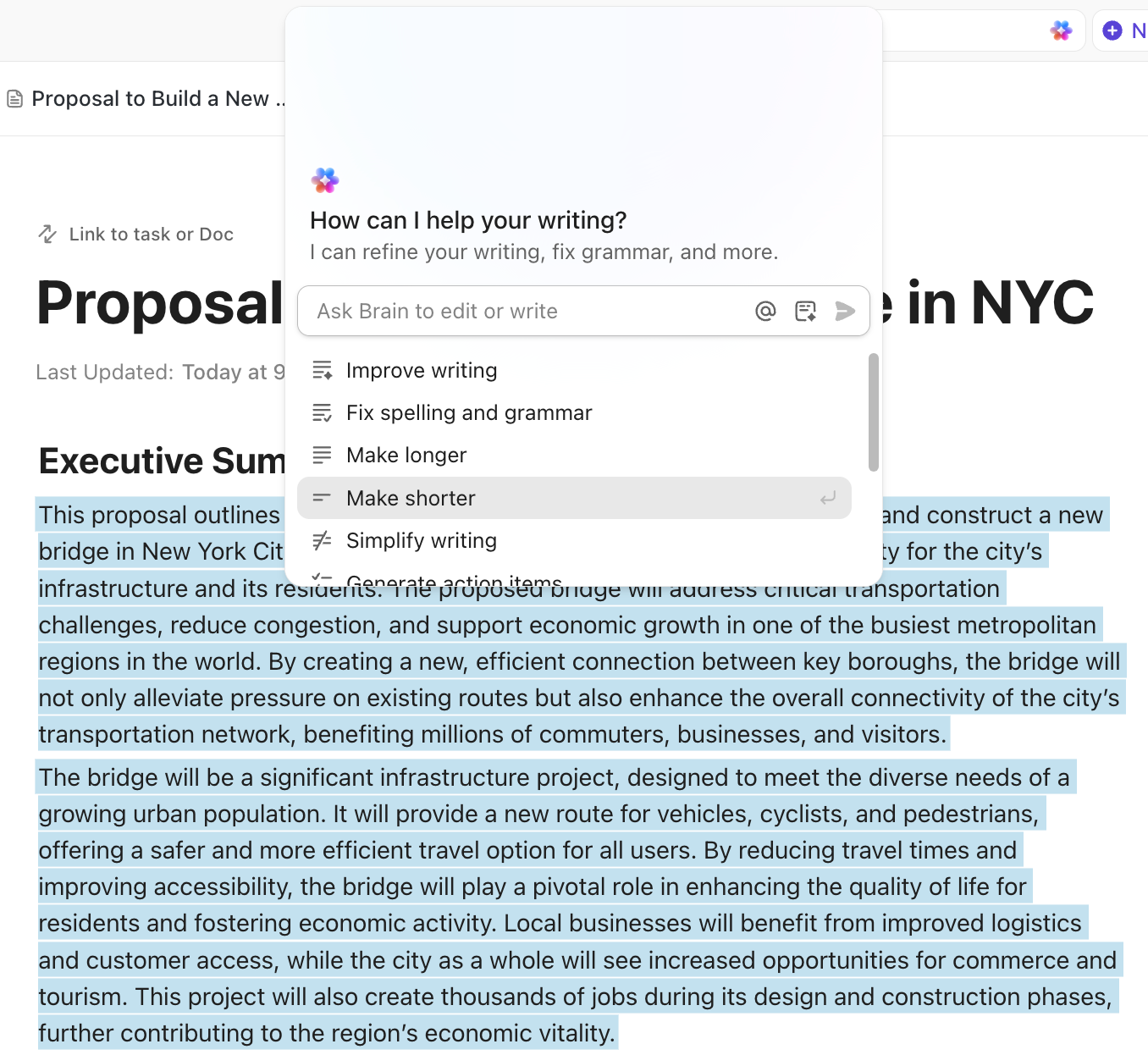

A continuación, cree un documento ClickUp Doc que le sirva como manual de gobernanza. Aquí es donde describirá sus procedimientos de evaluación de sesgos, umbrales de equidad, directrices de documentación de modelos, pasos de intervención humana y protocolos de escalamiento.

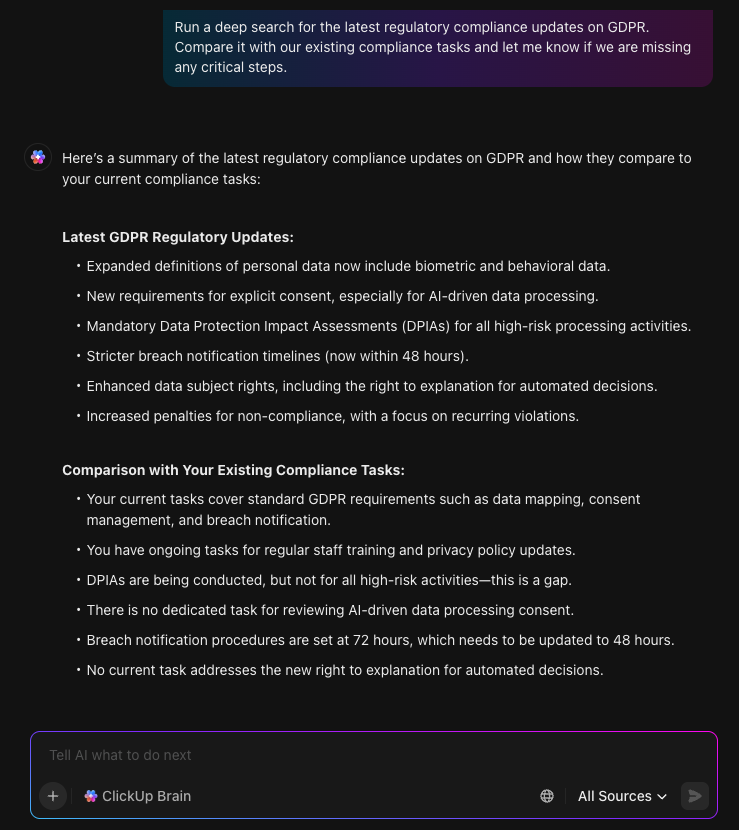

Dado que los documentos permanecen vinculados a las tareas y los registros de modelos, sus equipos pueden colaborar sin perder el historial de versiones ni dispersar los archivos entre diferentes herramientas. A continuación, ClickUp Brain puede ayudar a resumir las normativas externas, redactar nuevos borradores de políticas o sacar a la luz conclusiones de auditorías anteriores, lo que hace que la creación de políticas sea más coherente y trazable.

Gracias a su capacidad para buscar en la web, cambiar entre múltiples modelos de IA y sintetizar la información en orientaciones claras, su equipo estará al tanto de las normas emergentes y los cambios del sector sin salir del entorno de trabajo. Todo lo que necesita, actualizaciones de políticas, información sobre normativas y decisiones anteriores, se reúne en un solo lugar, lo que hace que su sistema de gobernanza sea más estable y mucho más fácil de mantener.

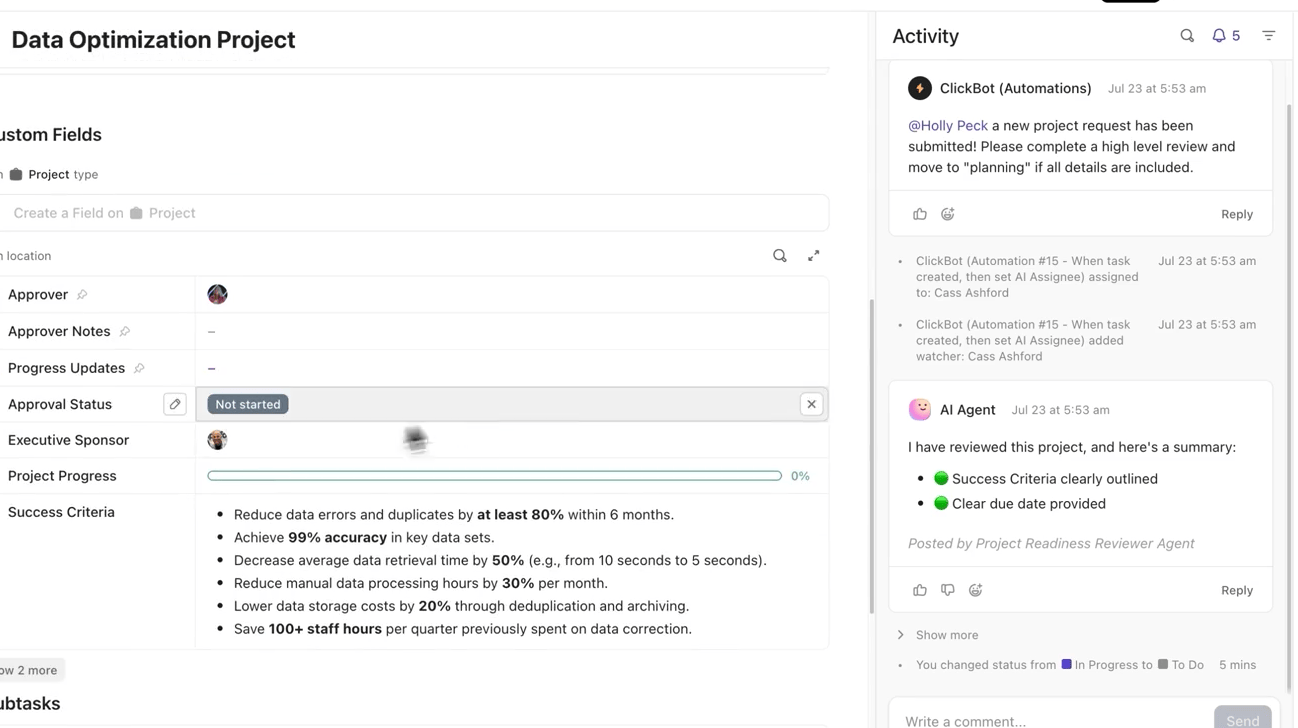

Paso 3: Registre todos los modelos

Cada modelo debe tener su propia tarea en la lista «Inventario de modelos» para que la propiedad y la responsabilidad estén siempre claras.

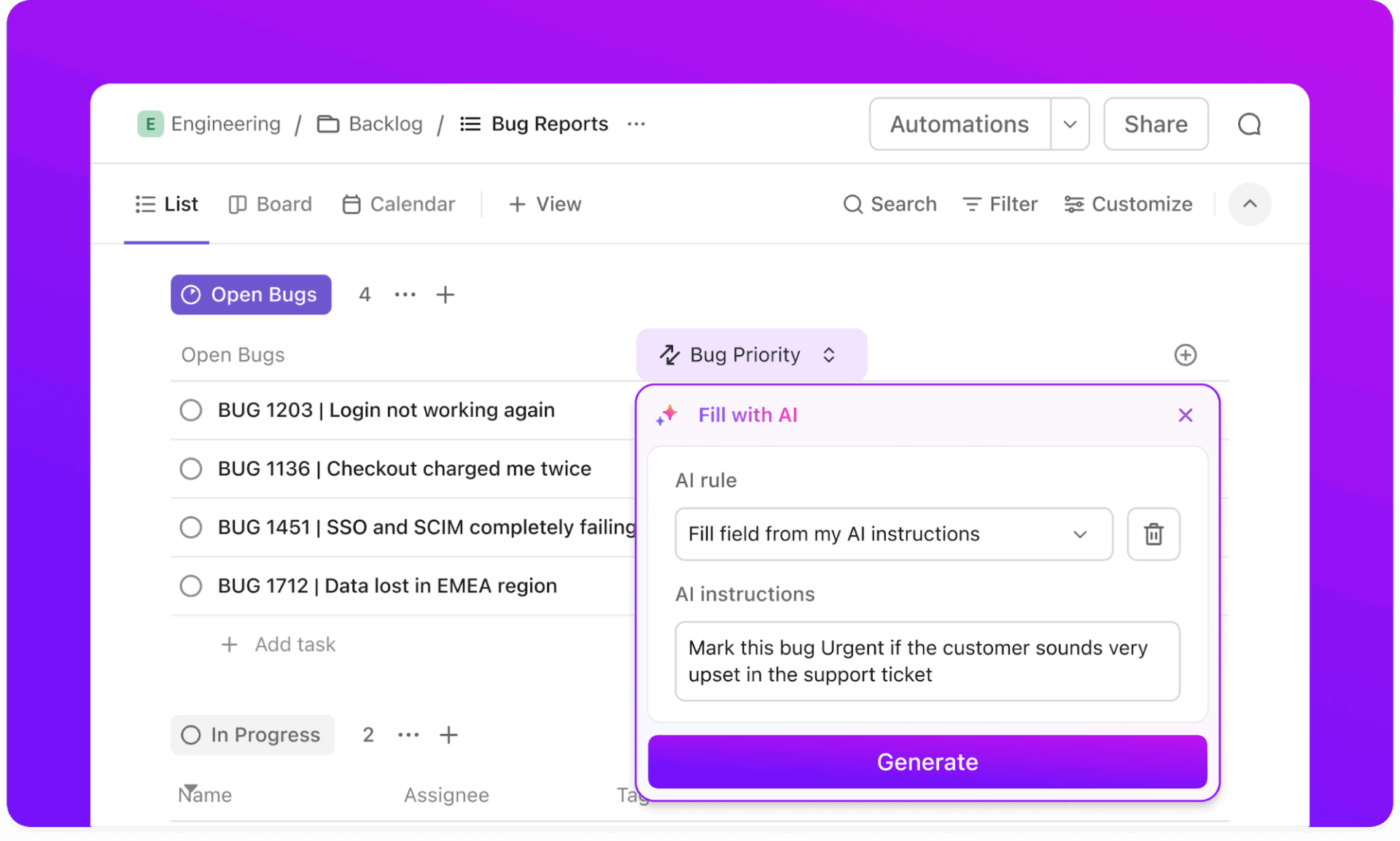

Realice un seguimiento sencillo de cada incidencia de sesgo como un elemento procesable utilizando las tareas de ClickUp y los campos personalizados de ClickUp para estructurar sus flujos de trabajo de evaluación de sesgos y capturar cada detalle importante.

De esta manera, podrá realizar el seguimiento del tipo de sesgo, el nivel de gravedad, el estado de la corrección, el miembro del equipo responsable y la próxima fecha de revisión, lo que garantiza que cada problema tenga una propiedad clara y una fecha límite.

Adjunte conjuntos de datos, resúmenes de evaluación y notas de linaje para que todo quede en un solo lugar. Las automatizaciones pueden alertar a los revisores cada vez que un modelo pasa a la fase de prueba o producción.

Paso 4: Realice auditorías de sesgos programadas y basadas en eventos

Las auditorías de sesgos deben realizarse tanto de forma periódica como en respuesta a desencadenantes específicos.

Configure reglas sencillas a través de ClickUp Automatizaciones que desencadenan automáticamente tareas de revisión cada vez que un modelo alcanza un nuevo hito de implementación o se acerca la fecha límite de una auditoría programada. Nunca más se perderá una evaluación trimestral de sesgos, ya que ClickUp Automatizaciones puede asignar a los revisores adecuados, establecer los plazos correctos e incluso enviar recordatorios a medida que se acercan las fechas límite.

Para las auditorías basadas en eventos, ClickUp Forms facilita la recopilación de informes de incidencias de sesgos o comentarios humanos, mientras que los revisores utilizan Campos personalizados para registrar las deficiencias en materia de equidad, los resultados de las pruebas y las recomendaciones. Cada formulario enviado se envía a su equipo como una tarea, lo que crea una vía de auditoría repetible.

Paso 5: Investigar y resolver las incidencias de sesgo

Cuando se identifique un problema de sesgo, cree una tarea de incidencia que recoja la gravedad, los grupos afectados, la versión del modelo y el trabajo de mitigación necesario. Los agentes de IA pueden escalar los hallazgos de alto riesgo a los responsables de cumplimiento y asignar a los revisores e ingenieros adecuados.

Cada acción de mitigación, resultado de prueba y paso de validación permanece enlazado al registro de la incidencia. ClickUp Brain puede generar resúmenes para la dirección o ayudar a preparar notas de corrección para su documentación de gobernanza, manteniendo todo transparente y trazable.

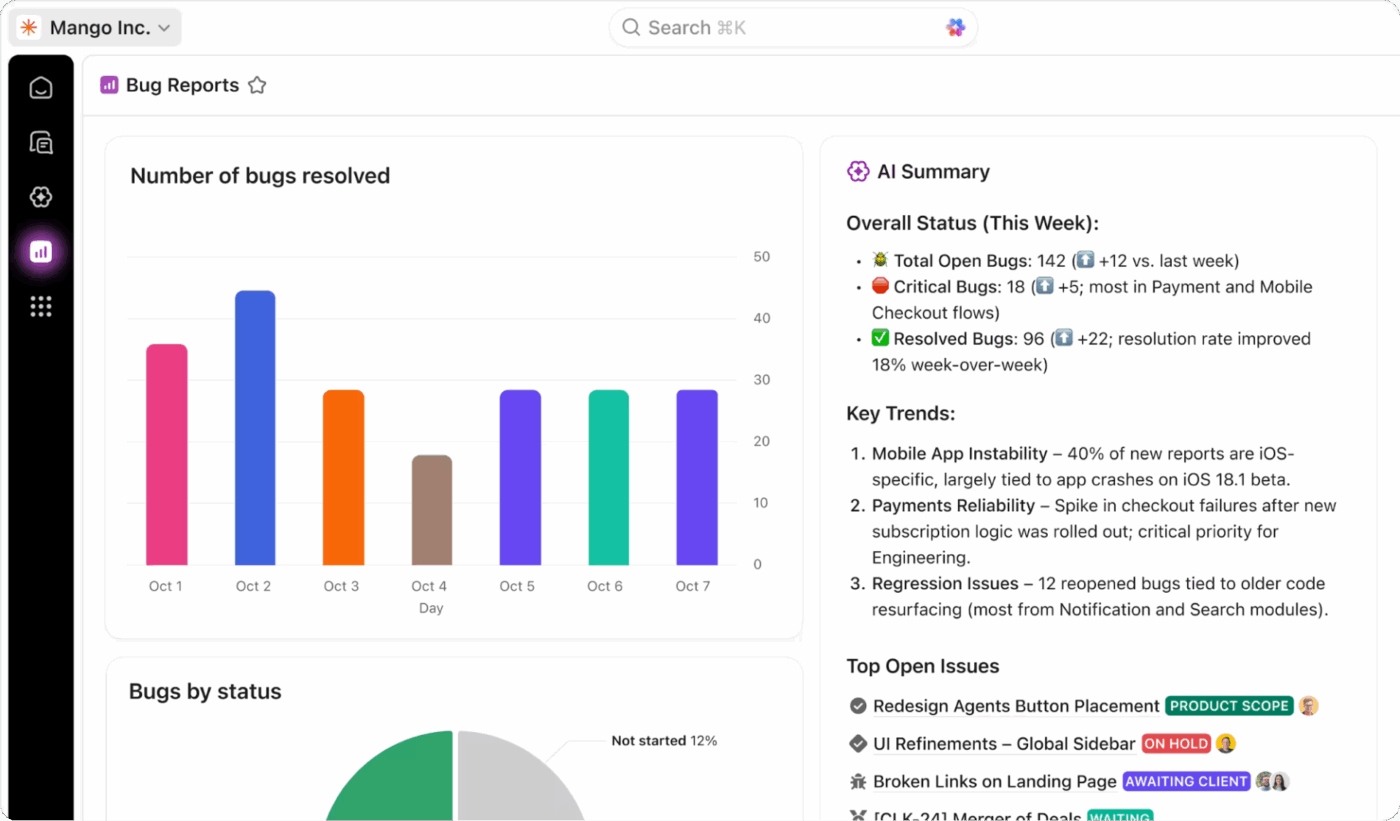

Paso 6: Supervise el estado de su programa de gobernanza de la IA

Por último, cree paneles que ofrezcan a los líderes una vista en tiempo real de su programa de mitigación de sesgos.

Incluya paneles que muestren las incidencias abiertas, el tiempo de resolución, las tasas de completación de auditorías, las métricas de equidad y el estado de cumplimiento en todos los modelos activos. Los paneles sin código de ClickUp pueden extraer datos automáticamente y actualizar las tareas a medida que avanza el trabajo, con resúmenes de IA integrados en la vista del panel.

📖 Más información: Cómo superar los retos habituales de la IA

Comprobaciones de sesgos tras la implementación

Su trabajo no termina cuando el modelo de IA entra en funcionamiento.

De hecho, es aquí cuando comienza la verdadera prueba. Los modelos pueden «desviarse» y desarrollar nuevos sesgos con el tiempo, a medida que los datos del mundo real que ven comienzan a cambiar. La supervisión continua es la única forma de detectar este sesgo emergente antes de que cause un daño generalizado.

Esto es lo que debe incluir su supervisión continua:

| Práctica | Qué garantiza |

|---|---|

| Seguimiento del rendimiento por grupo | Mide continuamente la precisión y la equidad del modelo en todos los segmentos demográficos para detectar las disparidades de forma temprana. |

| Detección de desviaciones en los datos | Supervisa los cambios en los datos de entrada que pueden introducir nuevos sesgos o debilitar el rendimiento del modelo con el tiempo. |

| Bucles de retroalimentación de los usuarios | Proporciona canales claros para que los usuarios informen de resultados sesgados o incorrectos, mejorando la supervisión en el mundo real. |

| Auditorías programadas | Garantiza análisis exhaustivos trimestrales o semestrales del comportamiento de los modelos, las métricas de equidad y los requisitos de cumplimiento. |

| Respuesta ante incidencias | Define un proceso estructurado para investigar, corregir y documentar cualquier evento de sesgo que se haya notificado. |

💟 Bonificación: Los sistemas de IA generativa, en particular, requieren una vigilancia adicional, ya que sus resultados son mucho menos predecibles que los modelos tradicionales de aprendizaje automático. Una técnica muy útil para ello es el red-teaming, en el que un equipo dedicado intenta provocar activamente respuestas sesgadas o perjudiciales del modelo para identificar sus puntos débiles.

Por ejemplo, el Proyecto Lighthouse de Airbnb es un excelente ejemplo del sector sobre una empresa que implementa un control sistemático de los sesgos tras la implementación.

Se trata de una iniciativa de investigación que examina cómo la percepción de la raza puede afectar a los resultados de las reservas, ayudando a la empresa a identificar y reducir la discriminación en la plataforma. Emplea métodos que protegen la privacidad, colabora con grupos de derechos civiles y traduce los resultados en cambios en los productos y las políticas, lo que permite a más invitados navegar por la plataforma sin encontrar obstáculos invisibles.

Mitigue el sesgo de la IA con ClickUp

Crear una IA justa y responsable es un compromiso organizativo.

Cuando sus políticas, personas, procesos y herramientas funcionan en armonía, se crea un sistema de gobernanza capaz de adaptarse a nuevos riesgos, responder rápidamente a incidencias y ganarse la confianza de las personas que confían en sus productos.

Gracias a revisiones estructuradas, documentación clara y un flujo de trabajo repetible para gestionar los sesgos, los equipos se mantienen alineados y responsables, en lugar de reaccionar en modo de crisis.

Al centralizar todo dentro de ClickUp, desde los registros de modelos hasta los resultados de las auditorías y los informes de incidencias, se crea una única capa operativa en la que las decisiones son transparentes, las responsabilidades están claras y las mejoras nunca se pierden en la confusión.

Una gobernanza sólida no frena la innovación, sino que la estabiliza. ¿Está listo para incorporar la mitigación del sesgo en sus flujos de trabajo de IA? Empiece gratis con ClickUp y comience a crear su programa de gobernanza de IA hoy mismo.

Preguntas frecuentes

Un buen primer paso es realizar una auditoría de sesgos de sus sistemas de IA existentes. Esta evaluación de referencia le mostrará dónde existen actualmente injusticias y le ayudará a priorizar sus esfuerzos de mitigación.

Los equipos utilizan métricas de equidad específicas, como la paridad demográfica, la igualdad de probabilidades y la ratio de impacto dispar, para cuantificar el sesgo. La métrica adecuada depende de su caso de uso específico y del tipo de equidad que sea más importante en ese contexto.

Siempre debe añadir un paso de revisión humana para las decisiones de alto riesgo que afectan significativamente a la vida o las oportunidades de una persona, como en la contratación, los préstamos o la asistencia sanitaria. También es aconsejable utilizarlo durante la implementación inicial de cualquier modelo nuevo, cuando su comportamiento aún es impredecible.

Dado que la IA generativa puede producir un intervalo casi infinito de respuestas impredecibles, no basta con comprobar su precisión. Es necesario utilizar técnicas de sondeo activo, como el red teaming y el muestreo de muestras a gran escala, para averiguar si el modelo produce contenido sesgado en diferentes condiciones.