La maggior parte delle persone pensa di dover scegliere tra l'utilizzo di potenti strumenti di IA e la riservatezza dei propri dati. In realtà, è possibile avere entrambe le cose. Eseguire l'IA localmente significa che i dati non lasciano mai il tuo hardware. Mantieni il pieno controllo sulle tue informazioni, pur automatizzando le attività più ripetitive.

Questa guida ti mostra come utilizzare l'IA locale per flussi di lavoro sicuri utilizzando strumenti come Ollama. Imparerai a effettuare la selezione di modelli open source adatti alle specifiche del tuo hardware e a creare flussi di lavoro automatizzati che elaborano i documenti privati in locale.

Esploreremo anche la possibilità di centralizzare i flussi di lavoro in uno spazio unificato come ClickUp. 😎

Che cos'è l'IA locale?

L'IA locale significa eseguire modelli linguistici di grandi dimensioni (LLM) interamente sul proprio hardware, come un laptop o un server in loco, invece di inviare i dati a servizi cloud esterni. Questa soluzione è adatta a qualsiasi team che gestisca informazioni sensibili, dai reparti di ingegneria e progettazione dei prodotti a quelli legali e finanziari.

Con la maggior parte degli strumenti di IA basati sul cloud, i tuoi prompt, i tuoi documenti e i tuoi dati vengono trasferiti su server di terze parti. Perdi il controllo su come tali informazioni vengono elaborate, archiviate o utilizzate.

Al contrario, l'IA locale mantiene i tuoi dati all'interno del tuo ambiente. Mantieni il controllo completo sulla sicurezza e sulla protezione dei dati per i tuoi flussi di lavoro.

Naturalmente, c'è un compromesso. L'implementazione dell'IA locale richiede un maggiore lavoro richiesto e un investimento iniziale in hardware. Tuttavia, elimina completamente la tua dipendenza da provider esterni. Con l'inferenza sul dispositivo, le tue informazioni rimangono esattamente dove vuoi tu.

Perché l'IA locale è importante per flussi di lavoro sicuri all'interno del team

🔎 Lo sapevi? Solo 1 consumatore su 10 è disposto a effettuare la condivisione di informazioni sensibili, come dati finanziari, di comunicazione o biometrici, con sistemi basati sull'IA.

Questa esitazione riflette una realtà sempre più diffusa per i team B2B. Con l'IA basata sul cloud, in sostanza stai affidando la proprietà intellettuale della tua azienda a una terza parte. Per i team legali, finanziari o delle risorse umane, ciò comporta una responsabilità enorme.

L'IA locale cambia questa dinamica trasferendo l'IA sul tuo hardware. Ecco perché è importante per le tue operazioni quotidiane:

- Elimina la fuga di dati: impedisci che il codice proprietario o i contratti privati con i clienti vengano utilizzati per addestrare un modello pubblico che i tuoi concorrenti potrebbero utilizzare

- Mantenere la conformità normativa: Rimanete nei limiti previsti dal GDPR o dall'HIPAA, poiché i dati sensibili non attraversano mai i confini internazionali né vengono trasferiti su server di terze parti

- Elimina la dipendenza da Internet: esegui analisi complesse dei dati o attività di progettazione durante un'interruzione di servizio o in ambienti ad alta sicurezza in cui l'accesso al cloud è limitato

- Gestisci i costi in modo prevedibile: evita l'aumento delle tariffe API man mano che il tuo team cresce, poiché l'unico costo è l'hardware che già possiedi

Integrando l'IA locale con i tuoi strumenti esistenti, puoi automatizzare il tuo lavoro senza compromettere la sicurezza.

⚠️ Tuttavia, è importante ricordare che questo problema può aggravarsi. Il tuo team potrebbe voler adottare più strumenti di IA, portando a una proliferazione incontrollata di tali strumenti, senza supervisione o strategia. Ciò può comportare sprechi di denaro, duplicazione del lavoro richiesto e rischi per la sicurezza.

In definitiva, questo amplia il tuo modello di minaccia alla sicurezza e rende più difficile il monitoraggio del lavoro.

📮ClickUp Insight: I team con prestazioni scarse sono 4 volte più propensi a destreggiarsi tra più di 15 strumenti, mentre i team ad alte prestazioni mantengono l'efficienza limitando il loro kit di strumenti a 9 o meno piattaforme. Ma che ne dici di utilizzare un'unica piattaforma? In quanto app completa per il lavoro, ClickUp riunisce le tue attività, i progetti, i documenti, i wiki, la chat e le chiamate in un'unica piattaforma, completa di flussi di lavoro basati sull'IA. Pronto a lavorare in modo più intelligente? ClickUp funziona per ogni team, garantisce la visibilità del lavoro e ti permette di concentrarti su ciò che conta mentre l'IA si occupa del resto.

Cosa serve per eseguire l'IA locale?

Non serve un supercomputer specializzato per eseguire l'IA localmente. I recenti cambiamenti nel modo in cui vengono costruiti i modelli ti consentono di iniziare con l'hardware che già possiedi. Deve solo soddisfare alcuni criteri specifici.

Requisiti hardware

È l'hardware a determinare le dimensioni e la velocità dei modelli di IA che puoi utilizzare. Mentre una macchina potente ti consente di eseguire modelli di ragionamento più complessi, i modelli più piccoli sono diventati sorprendentemente efficienti.

- GPU con VRAM: una scheda NVIDIA dedicata con almeno 12 GB di VRAM rappresenta attualmente la soluzione ideale per la maggior parte dei team. Consente di eseguire modelli di medie dimensioni come Llama 3.3 (8B) o Mistral Small ad alta velocità

- RAM di sistema: se non disponi di una GPU di fascia alta, la RAM del tuo computer gestirà il carico. 32 GB ti offrono spazio sufficiente per eseguire un modello mantenendo aperti il browser e gli strumenti di project management

- Memoria unificata (per utenti Mac): Se utilizzi un Mac con un chip della serie M (M2, M3 o M4), la RAM e la memoria della GPU sono in condivisione. Ciò rende i Mac particolarmente efficienti per l'IA locale, poiché il modello può accedere all'intero pool di memoria

- Spazio di archiviazione veloce: i modelli sono file di grandi dimensioni, che spesso hanno un intervallo di dimensioni che va dai 5 GB ai 50 GB. L'uso di un SSD NVMe è essenziale per evitare lunghi tempi di attesa durante il caricamento di un nuovo modello

🔎 Lo sapevi? Costruire un PC è molto più costoso rispetto a pochi mesi fa. In precedenza, un kit di memoria DDR5 da 32 GB costava meno di 130 dollari, ma ora lo stesso kit ha superato i 400 dollari. Questo cambiamento ha reso i 32 GB il nuovo minimo indispensabile per qualsiasi lavoro serio di IA locale, poiché è necessario un margine sufficiente per eseguire i modelli senza che le prestazioni del sistema crollino.

Requisiti software

Il software funge da ponte tra il tuo hardware e l'IA. Non è più necessario essere uno sviluppatore per farlo funzionare.

- Sistema operativo: Sebbene Linux sia l'ambiente nativo per l'IA, Windows e macOS sono ormai altrettanto efficienti. Gli utenti Windows possono utilizzare WSL2 per un ambiente simile a Linux, anche se molti strumenti ora funzionano direttamente su Windows

- Gestori di modelli: Strumenti come Ollama o LM Studio sono il punto di partenza più semplice. Si occupano della quantizzazione, comprimendo il modello in modo che si adatti automaticamente al tuo hardware

- Driver: Avrai bisogno dei driver più recenti per il tuo hardware, come l'ultimo driver CUDA per le schede NVIDIA. La maggior parte dei programmi di installazione moderni lo verificherà automaticamente durante la configurazione

Opzioni LLM open source

Stiamo assistendo a un'esplosione di modelli open-weight che puoi scaricare gratis. Questi sono sviluppati da aziende come Meta (Llama), Mistral e Alibaba (Qwen). A differenza dei sistemi chiusi, questi modelli ti consentono di vedere esattamente come funzionano e dove finiscono i tuoi dati.

Quando scegli un modello linguistico di grandi dimensioni, controlla la licenza del software. La maggior parte utilizza Apache 2.0 o MIT, che ti consentono di utilizzarli per le operazioni aziendali senza una sottoscrizione mensile. Poiché questi modelli risiedono sul tuo hardware, si integrano direttamente nei tuoi flussi di lavoro privati.

Ad esempio, puoi utilizzare un modello locale per redigere bozze di email interne, riepilogare i verbali delle riunioni o analizzare set di dati proprietari. In questo modo, i dettagli più sensibili dei tuoi progetti e le note strategiche rimangono sul tuo computer.

🧠 Curiosità: I chip della serie M di Apple offrono un vantaggio architettonico unico per i team che puntano sulla privacy. La memoria unificata del Mac consente all'IA di utilizzare l'intero pool di RAM di sistema come se fosse memoria grafica dedicata.

Ciò significa che un MacBook dotato di 128 GB di RAM può eseguire modelli enormi e altamente sofisticati che normalmente richiederebbero hardware specializzato dell'azienda dal costo superiore ai 10.000 dollari.

I migliori modelli di IA locale per i flussi di lavoro di squadra

Per trovare il modello giusto, valuta se i punti di forza del modello corrispondono alle attività del tuo team e alle capacità dell'hardware.

Modelli generici

Questi sono i cavalli di battaglia della tua configurazione locale. Usali per redigere email, riepilogare gli aggiornamenti sui progetti o fare brainstorming di idee creative.

- Llama 4 Scout (17B): Ha una funzionalità di finestra di contesto da 10 milioni di token, che consente di elaborare migliaia di pagine di testo contemporaneamente

- Mistral Small 4: utilizza un'architettura "mixture-of-experts", il che significa che attiva solo una parte dei suoi parametri per ogni attività

- Qwen 3.5 (7B): Offre prestazioni costantemente superiori se il tuo team gestisce documentazione tecnica in più lingue

Modelli per il ragionamento e l'uso degli strumenti

Utilizzali quando hai bisogno che gli agenti LLM risolvano problemi con più passaggi, seguano logiche complesse o agiscano come agenti autonomi all'interno dei tuoi flussi di lavoro.

- Llama 4 Maverick: È nativamente multimodale. Questo lo rende ideale per i team che devono analizzare grafici complessi o fogli di calcolo finanziari, dove il contesto visivo è importante tanto quanto il testo

- Phi-4 (14B): Ottimizzato per le discipline STEM e il ragionamento logico. Utilizzalo per la convalida dei dati o per attività matematiche complesse che solitamente richiedono modelli molto più grandi e costosi

- DeepSeek-R1: Visualizza la propria catena di ragionamento interna, aiutandoti a verificarne la logica per analisi di grande importanza. Ideale per ricerche approfondite e piano strategico

Modelli specifici per attività

A volte, uno strumento specializzato è più efficiente di un assistente generico. Questi modelli sono ottimizzati per una parte specifica del tuo flusso di lavoro.

- Qwen 3-Coder-Next: Comprende la logica a livello di repository, consentendogli di suggerire correzioni di bug o rifattorizzare il codice su più file. Il tutto seguendo le specifiche linee guida di stile del tuo team

- Voxtral Mini: identifica i diversi interlocutori in una registrazione e trasforma le registrazioni di riunioni private in testo ricercabile. Funziona interamente offline, ideale per evitare fughe di dati

- Nomic Embed v1.5: Trasforma i tuoi documenti privati in dati matematici per la ricerca semantica. Questo ti consente di effettuare ricerche nella knowledge base interna del tuo team in base al significato anziché solo alle parole chiave

Strumenti popolari per l'esecuzione dell'IA locale

Non è più necessario essere un ingegnere del software per eseguire modelli sul proprio computer. Diverse applicazioni intuitive gestiscono ora la configurazione tecnica al posto tuo in pochi minuti.

Ollama e OpenWebUI

Ollama è la soluzione ideale se cerchi velocità e flessibilità. Funziona in background e gestisce la tua libreria di modelli tramite un'interfaccia semplice.

Sebbene sia inizialmente uno strumento di base, la maggior parte delle persone lo abbina a OpenWebUI. Ciò aggiunge al tuo browser un'esperienza di chat raffinata, simile nell'aspetto e nell'utilizzo agli strumenti basati sul cloud che già conosci. Crea inoltre un ponte locale che consente alle altre app sul tuo computer di comunicare in modo sicuro con i tuoi modelli di IA.

LM Studio

Se preferisci un'app desktop tradizionale, LM Studio è un'ottima alternativa. Funziona come un app store per l'IA. Puoi utilizzarlo per cercare, scaricare e chattare con un nuovo modello in pochi clic.

L'app include il rilevamento hardware integrato, quindi configura automaticamente le impostazioni in base alla tua specifica GPU o RAM. Questo la rende un ottimo punto di partenza se vuoi sperimentare con diversi modelli senza mai toccare una riga di codice.

GPT4All

Per i team che si occupano esclusivamente di privacy e analisi dei documenti, GPT4All è una soluzione affidabile e semplice. Funziona su quasi tutti i computer, compresi i laptop meno recenti che potrebbero non disporre di una scheda grafica dedicata.

La sua funzionalità più utile è la possibilità di chattare direttamente con i tuoi file locali. Puoi indicare all'app una cartella sul tuo disco rigido e l'IA risponderà alle domande su quei documenti specifici. Il tutto senza mai caricarli su un server di terze parti.

Come configurare l'IA locale per flussi di lavoro sicuri

Questa guida utilizza Ollama perché è uno strumento ampiamente supportato per la creazione di flussi di lavoro di IA locali e sicuri.

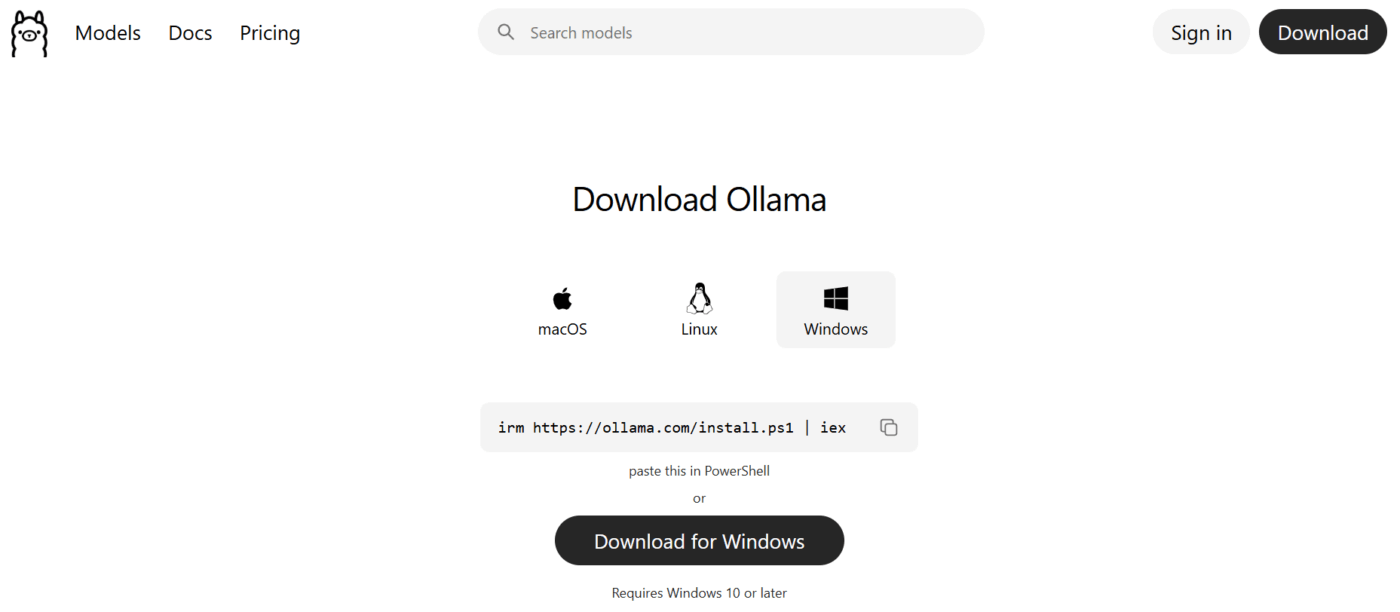

Passaggio 1: Installa Ollama

Scarica il programma di installazione dal sito web ufficiale per il tuo specifico sistema operativo. Mentre le versioni precedenti di Windows richiedevano la configurazione manuale del sottosistema Linux, la versione attuale si installa come applicazione nativa.

L'installazione richiede solo pochi minuti. Una volta completata l'installazione, apri il terminale o il prompt dei comandi e digita ollama --version per verificare che sia pronto all'uso.

Passaggio 2: Scarica ed esegui un modello

Per iniziare a utilizzare un'IA, devi scaricare i suoi pesi sul tuo computer. Per il tuo primo test, prova un modello compatto ma potente come Llama 3.2 (3B) o l'ultima versione di Mistral.

Usa il comando ollama run llama3.2 per scaricare.

A seconda della velocità della tua connessione Internet, l'operazione richiede solitamente pochi minuti. Una volta scaricato il file, puoi digitare un prompt direttamente nel terminale per ottenere una risposta immediata dal modello presente sul tuo disco rigido.

Passaggio 3: Connettiti al tuo strumento di flusso di lavoro

Il vero valore dell'IA locale deriva dalla sua integrazione nelle attività quotidiane. Quando Ollama è in esecuzione, avvia automaticamente un server locale all'indirizzo http://localhost:11434. Questo crea un ponte sicuro che consente ad altre applicazioni di comunicare con il tuo modello.

Poiché questo server è compatibile con i protocolli standard di OpenAI, puoi collegarlo a piattaforme di automazione o script interni semplicemente sostituendo l'indirizzo API. Ad esempio, puoi indirizzare uno strumento di ricerca di documenti locale a questo indirizzo. Ciò gli consente di riepilogare i file privati senza mai inviare quel testo al cloud.

Best practice di sicurezza per i flussi di lavoro di IA locale

L'esecuzione dell'IA in locale rappresenta un importante passaggio avanti per la privacy. Tuttavia, archiviare i dati in locale significa che ora sei responsabile della loro protezione. Sebbene tu abbia eliminato il rischio di una violazione del cloud da parte di terzi, devi comunque proteggere il tuo hardware e il modo in cui il tuo team interagisce con i modelli.

Segui queste best practice:

- Isolamento di rete: Limita l'accesso alle API alle reti interne affidabili, in modo che il tuo server di IA rimanga inaccessibile dalla rete Internet pubblica

- Convalida degli input: Sanifica tutti i dati prima di inviarli al modello. Questo blocca le istruzioni dannose nascoste nei documenti o nelle email

- Controlli di accesso: implementa l'autenticazione sul tuo endpoint IA per verificare che solo gli utenti autorizzati possano trigger le azioni del modello

- Registrazione degli audit: conserva una traccia di tutte le interazioni dei modelli per facilitare le indagini relative alla conformità e alla sicurezza

- Isolamento dei container: esegui i tuoi modelli in ambienti sandbox come Docker. In questo modo si impedisce che una potenziale violazione raggiunga i file di sistema principali

- Aggiornamenti regolari: installa le patch più recenti per strumenti come Ollama per proteggerti dalle vulnerabilità appena scoperte

- Limitazione della frequenza: per impedire che un singolo utente o script sovraccarichi il tuo server con richieste, implementa il limite di frequenza per controllare il numero di query che possono essere effettuate in un determinato periodo

🔎 Lo sapevi? Le manipolazioni basate sui prompt non sono più una minaccia teorica. Un recente sondaggio di Gartner ha rilevato che il 32% delle organizzazioni ha subito un attacco dannoso tramite prompt alle applicazioni di IA nell'ultimo anno. Questi attacchi possono manipolare il tuo modello locale in modo da generare output distorti o non autorizzati.

Come creare flussi di lavoro IA sicuri per il tuo team

Una volta che il tuo server locale è in funzione, puoi integrarlo nel tuo lavoro quotidiano. Questo trasforma un semplice strumento in un motore di produttività privato. Il modo più efficace per farlo è attraverso la Generazione potenziata dal recupero (RAG).

Questo processo crea una connessione tra la tua IA locale e un database privato dei tuoi file. Puoi rispondere alle domande utilizzando il contesto specifico della tua azienda senza mai caricare un solo byte sul cloud.

Puoi anche progettare flussi di lavoro "human-in-the-loop", in cui il lavoro dell'IA viene revisionato da membri umani del team. Ciò garantisce l'accuratezza, accelerando al contempo in modo significativo la produzione.

Ecco alcuni esempi pratici:

- Analisi dei documenti: riepiloga i report interni o i feedback dei clienti per estrarre immediatamente informazioni chiave

- Generazione di bozze: crea le prime versioni di email o aggiornamenti sui progetti che i membri del team potranno perfezionare

- Classificazione dei dati: categorizza automaticamente le attività in arrivo in base al contenuto specifico della richiesta

- Preparazione alla riunione: genera argomenti di discussione analizzando i file dei progetti correlati archiviati sul tuo disco locale

- Revisione del codice: ricevi feedback sul codice sorgente proprietario senza esporre la tua proprietà intellettuale a terzi

📮ClickUp Insight: Il nostro sondaggio sulla maturità dell'IA mostra che l'accesso all'IA sul posto di lavoro è ancora limitato: il 36% delle persone non ha alcun accesso e solo il 14% afferma che la maggior parte dei dipendenti possa effettivamente sperimentarla. Quando l'IA è vincolata da autorizzazioni, strumenti aggiuntivi o configurazioni complicate, i team non hanno nemmeno la possibilità di provarla nel lavoro quotidiano reale.

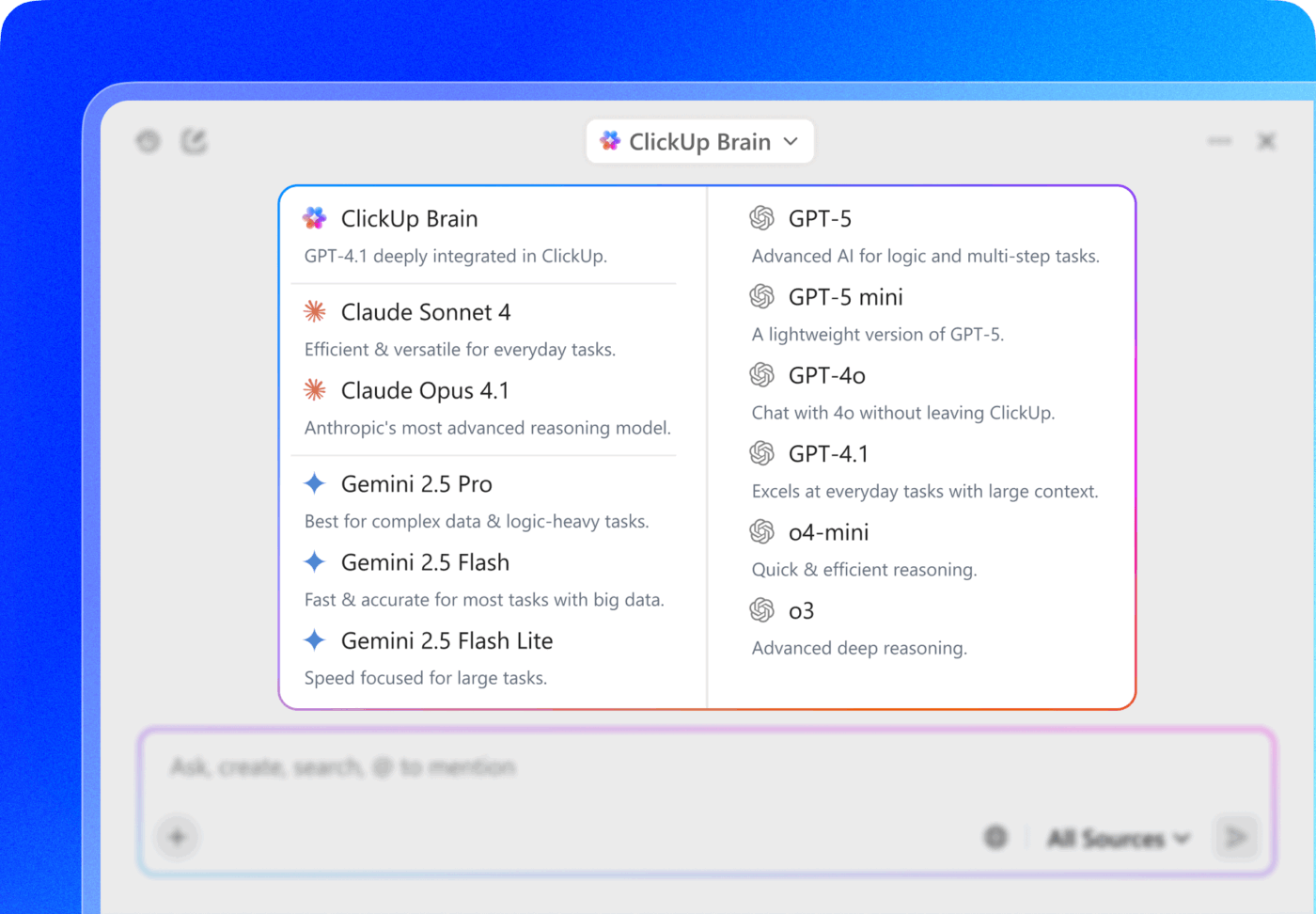

ClickUp Brain elimina tutte queste difficoltà integrando l'IA direttamente all'interno dell'area di lavoro che già utilizzi. Puoi attingere a diversi modelli di IA, generare immagini, scrivere o eseguire il debug di codice, effettuare ricerche sul web, riepilogare documenti e molto altro ancora, senza dover cambiare strumento o perdere la concentrazione.

È il tuo partner di IA ambientale, facile da usare e accessibile a tutti i membri del team.

Limiti dell'utilizzo dell'IA locale per i flussi di lavoro basati sull'IA

L'IA locale è uno strumento potente, ma non è una soluzione magica per ogni problema. Comprendere i suoi limiti ti aiuta a decidere quando mantenere un'attività sul tuo hardware e quando utilizzare il cloud. Per alcuni team, i compromessi tecnici e finanziari potrebbero superare i vantaggi in termini di privacy.

- Limiti delle capacità: i modelli proprietari di fascia alta mantengono ancora un leggero vantaggio in termini di ragionamento complesso e sfumature creative rispetto alle versioni open source

- Investimento in hardware: per ottenere prestazioni elevate su modelli di grandi dimensioni sono necessarie GPU costose dotate di una notevole quantità di VRAM. Ciò può comportare un costo iniziale elevato per i team di piccole dimensioni

- Costi di manutenzione: sei responsabile di tutti gli aggiornamenti software, della risoluzione dei problemi hardware e dell'applicazione delle patch di sicurezza senza il team del supporto del provider

- Competenze tecniche: l'ottimizzazione di un ambiente locale richiede conoscenze pratiche sulla quantizzazione dei modelli e sulla configurazione dei server

- Gestione della sicurezza: a differenza dei servizi cloud, i modelli locali non dispongono di moderazione integrata. È necessario implementare filtri per i contenuti e misure di protezione personalizzati

- Consumo energetico: l'esecuzione di modelli di IA su larga scala sui propri server o workstation può aumentare significativamente il consumo di elettricità e le esigenze di raffreddamento

Molti team adottano un approccio ibrido: IA locale per i dati sensibili, IA nel cloud per le attività meno sensibili che richiedono la massima potenza. Ecco una rapida panoramica del confronto tra le due:

| Fattore | IA locale | IA nel cloud |

|---|---|---|

| Privacy dei dati | Pieno controllo | Dati inviati al provider |

| Complessità di configurazione | Superiore | Riduci |

| Costi ricorrenti | Hardware + elettricità | Commissioni per token |

| Funzionalità dei modelli | Buono, in miglioramento | All'avanguardia |

| Manutenzione | Autogestito | Gestito dal provider |

In che modo ClickUp fornisce supporto per flussi di lavoro sicuri basati sull'intelligenza artificiale

Oggi la maggior parte dei team si trova di fronte a un dilemma: utilizzare una potente IA nel cloud e preoccuparsi di dove finiscano i propri dati, oppure configurare modelli locali e gestire i costi aggiuntivi che ne derivano. ClickUp aggira questo dilemma fungendo da area di lavoro IA convergente, dove l'IA è già integrata nel sistema in cui si svolge il tuo lavoro.

ClickUp Brain è il livello di IA integrato direttamente nell'area di lavoro di ClickUp, progettato per comprendere le tue attività, i tuoi documenti e le comunicazioni del team in un unico posto. Offre assistenza IA con il contesto completo: nessun tool separato, nessuna integrazione instabile.

Per i team che mirano a creare flussi di lavoro di IA sicuri, quella combinazione di contesto e controllo fa la differenza tra la sperimentazione e l'adozione effettiva.

🌟 ClickUp è inoltre conforme allo standard SOC 2 e rispetta gli standard ISO 42001 per una gestione responsabile dell'IA. Ciò garantisce che i tuoi dati non vengano mai utilizzati per addestrare modelli di terze parti, consentendoti di automatizzare il tuo lavoro con la stessa sicurezza di una configurazione on-premise.

Accedi alla ricerca e ai flussi di lavoro autonomi con ClickUp Brain

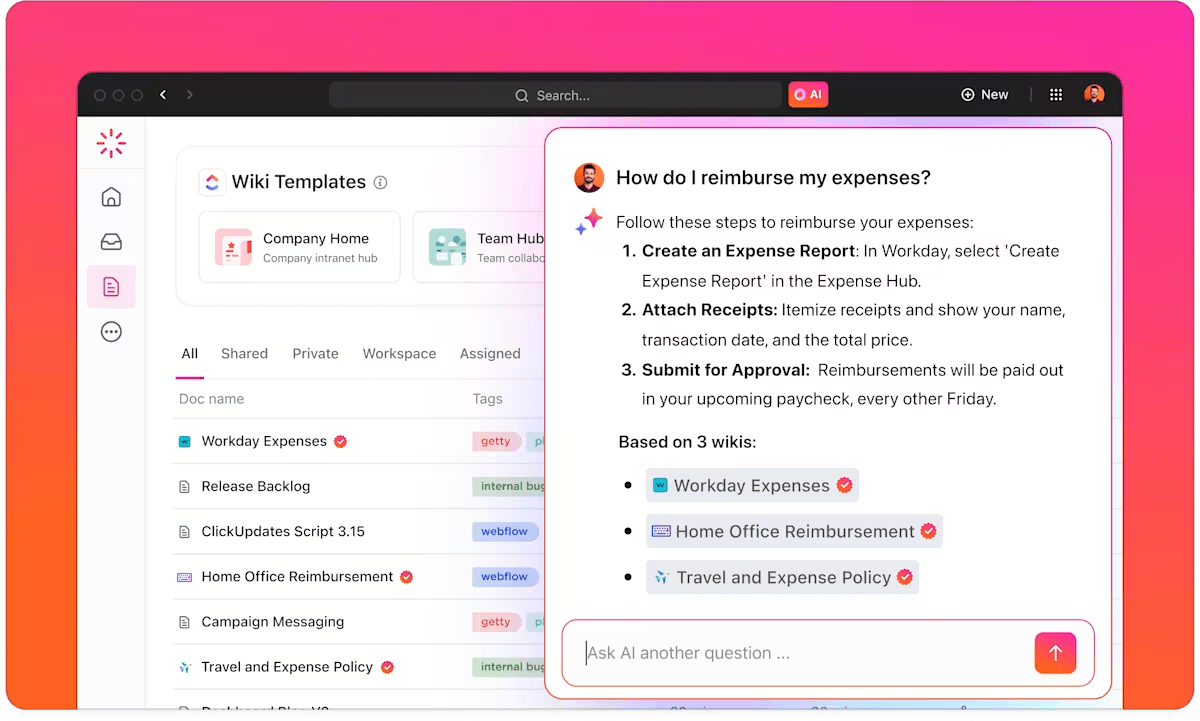

Una volta che i tuoi dati sono al sicuro all'interno dell'area di lavoro di ClickUp, ClickUp Brain estrae valore dalle tue attività e dai tuoi documenti in tempo reale.

Poiché l'IA è integrata, si evita il divario contestuale che rallenta le configurazioni locali. Puoi porle domande che richiedono di visualizzare la cronologia completa del tuo progetto per rispondere in modo accurato:

- Identifica le decisioni finali da un lungo documento tecnico senza dover scorrere le diverse versioni

- Bozza degli aggiornamenti per gli stakeholder dai commenti alle attività e dai cambiamenti di stato

ClickUp Brain genera risposte basate sui dati della tua area di lavoro analizzando i contenuti specifici presenti nei tuoi documenti, nelle attività e nelle chat. In questo modo, man mano che il tuo progetto evolve, l'IA dispone sempre del contesto più aggiornato.

Ciò consente al tuo team di basarsi sulle informazioni acquisite senza dover spiegare manualmente la cronologia del progetto o spostare i dati tra strumenti non collegati.

💡Suggerimento da esperto: puoi ampliare ulteriormente il contesto della tua area di lavoro utilizzando Enterprise AI Search per estrarre informazioni da tutti i tuoi strumenti esterni.

Ad esempio, ponete una domanda complessa come "Mostrami tutte le trattative aperte in corso" e ClickUp Brain effettuerà una ricerca tra le vostre app collegate, tra cui Slack, Google Drive e Gmail, per fornire una risposta affidabile in tempo reale con riferimenti.

Questo trasforma i dati frammentati su più piattaforme in un unico livello di intelligence ricercabile, dove puoi trovare qualsiasi file, messaggio o attività senza mai uscire dalla tua area di lavoro.

Gestisci le attività in modo intelligente con l'automazione e l'IA

ClickUp Brain non si limita a fornire un supporto passivo, ma opera attivamente all'interno del tuo sistema di gestione delle attività. È in grado di:

- Genera attività da note di riunione o documenti

- Suddividi i progetti di grandi dimensioni in attività secondarie

- Suggerisci i titolari delle attività in base alle attività passate

- Consiglia delle scadenze in base al contesto del progetto

Può anche aggiornare lo stato delle attività, riepilogare lunghi thread di commenti in chiari passaggi successivi e segnalare gli ostacoli prima che rallentino l'esecuzione.

Se abbinato a ClickUp Automazioni, questo diventa un sistema a ciclo chiuso: l'IA può trigger flussi di lavoro (come l'assegnazione di attività, la notifica agli stakeholder o l'aggiornamento delle priorità) in base ai cambiamenti all'interno della tua area di lavoro.

Ad esempio, quando un documento viene finalizzato, è possibile creare e assegnare automaticamente delle attività senza che nessuno debba spostare manualmente i dati tra i vari strumenti.

💟 Bonus: Trasforma ClickUp Brain MAX nella tua “memoria decisionale”.

Utilizzalo per:

- Riassumi lunghi thread di commenti in decisioni chiare e passaggi successivi

- Aggiorna i documenti indicando "cosa è cambiato e perché" dopo le attività cardine

- Genera registri decisionali settimanali da attività, riunioni e aggiornamenti

Nel tempo, questo crea un livello dinamico di conoscenza istituzionale a cui Brain MAX può fare riferimento. Quindi, invece di rispondere ai prompt in modo isolato, inizia a rispondere tenendo conto delle decisioni, delle priorità e dei modelli passati.

È in quel momento che l'IA passa dall'essere utile all'essere affidabile, specialmente nei flussi di lavoro IA sicuri in cui il contesto e la tracciabilità sono fondamentali.

Ottieni una sicurezza e un'esecuzione contestualizzata su larga scala con i Super Agent

I Super Agent di ClickUp portano ClickUp Brain un passo avanti: dall'assistenza al lavoro alla sua gestione attiva. Questi agenti possono essere configurati per monitorare i flussi di lavoro, intraprendere azioni e coordinare le attività nel tuo spazio di lavoro in base a regole predefinite e al contesto in tempo reale.

Ad esempio, un Super Agent può:

- Monitora le richieste in arrivo o i documenti e convertili automaticamente in attività strutturate con titolari e scadenze

- Tieni traccia dello stato del progetto e segnala rischi o ritardi prima che si aggravino

- Trigger automazioni in più passaggi quando vengono soddisfatte determinate condizioni, come notificare le parti interessate, aggiornare le priorità o creare attività di follow-up

Questi agenti operano interamente all'interno dell'area di lavoro unificata di ClickUp, con piena consapevolezza delle tue attività, dei tuoi documenti e della struttura delle autorizzazioni. Ciò significa che:

- Non è necessario esportare i dati verso sistemi di IA esterni o strumenti di orchestrazione

- Hanno accesso solo ai dati che sono autorizzati a vedere

- Agiscono entro gli stessi limiti di autorizzazione del tuo team

Ulteriori informazioni su come lavorare con i Super Agents:

Approfitta dell'assistenza dell'IA all'interno dei tuoi documenti

Con ClickUp Docs, l'assistenza IA è integrata direttamente nei tuoi flussi di lavoro di documentazione. I team possono redigere brief di progetto, riepilogare lunghi report, estrarre azioni da intraprendere o riscrivere contenuti per diversi tipi di pubblico, il tutto senza uscire dalla piattaforma.

Questo è importante per flussi di lavoro IA sicuri perché uno dei rischi maggiori deriva dal copiare e incollare informazioni sensibili in strumenti esterni. In ClickUp, riduci al minimo il trasferimento dei dati e mantieni il pieno controllo sugli accessi tramite le autorizzazioni.

Verdetto finale: Costruire il tuo stack di IA privato

L'IA locale sfrutta l'intelligenza artificiale mantenendo il controllo completo sulla privacy dei dati e sulla conformità. Tuttavia, questo percorso richiede un investimento significativo in hardware, configurazione tecnica e manutenzione continua.

Le pratiche di sicurezza rimangono fondamentali sia che si utilizzi l'IA locale sia quella nel cloud. La strategia più efficace spesso prevede un approccio ibrido: l'utilizzo dell'IA locale per le operazioni più sensibili, sfruttando al contempo soluzioni gestite e sicure per la produttività quotidiana.

È fondamentale valutare i compromessi: per molti team, l'onere di una soluzione fai-da-te potrebbe non essere la scelta giusta.

Per chi desidera una produttività AI potente senza l'onere dell'infrastruttura, soluzioni gestite come ClickUp Brain offrono una valida via di mezzo. Garantiscono una sicurezza di livello aziendale senza alcuna complessità di configurazione.

Inizia a utilizzare ClickUp gratis ed esplora flussi di lavoro sicuri e contestualizzati basati sull'IA per il tuo team.

Domande frequenti

Qual è la differenza tra l'IA locale e quella basata sul cloud per i flussi di lavoro di team?

L'IA locale funziona interamente sul tuo hardware, garantendo che i dati non escano mai dalla tua rete interna, mentre l'IA basata sul cloud invia i dati a server di terze parti per l'elaborazione. Le configurazioni locali offrono sovranità totale sui dati e accesso offline, mentre i servizi cloud offrono maggiore potenza di calcolo e facilità d'uso a scapito del controllo diretto sui dati.

In che modo i team possono utilizzare modelli di IA locale con dati di progetto riservati?

I team possono utilizzare l'IA locale per elaborare documenti sensibili, codice proprietario e registrazioni finanziarie indirizzando il modello verso directory private in locale. Poiché l'inferenza avviene sul dispositivo, è possibile eseguire attività come la riassunzione automatica, l'estrazione dei dati e le ricerche interne di conoscenze senza rischiare l'esposizione a set di addestramento LLM pubblici.

I modelli di IA locale sono efficaci quanto ChatGPT per le attività di lavoro?

Molti modelli locali open source, come Llama 3 e Mistral, sono ormai perfettamente in grado di gestire attività di routine quali la stesura di bozze, la codifica e la riassunzione. Mentre i modelli cloud di fascia alta come GPT-4o continuano a primeggiare nel ragionamento ultra-complesso, i modelli locali offrono prestazioni comparabili per il 90% delle operazioni aziendali quotidiane, garantendo una privacy significativamente migliore.

Quali sono i pro e i contro dell'esecuzione dell'IA in locale rispetto all'utilizzo dei servizi di IA nel cloud?

Il principale compromesso consiste nella scelta tra la completa privacy dei dati offerta dall'IA locale e la scalabilità senza manutenzione dell'IA cloud. L'esecuzione dell'IA a livello locale richiede un investimento iniziale in hardware e competenze tecniche, ma elimina i costi ricorrenti delle API e i rischi di fuga di dati. L'IA cloud è più veloce da implementare, ma comporta costi di sottoscrizione continui e dipendenze dai dati di terze parti.