Większość osób zakłada, że musi wybierać między korzystaniem z zaawansowanych narzędzi AI a zachowaniem prywatności danych. Jednak w rzeczywistości można mieć jedno i drugie. Lokalne uruchamianie AI oznacza, że dane nigdy nie opuszczają Twojego sprzętu. Zachowujesz pełną kontrolę nad informacjami, jednocześnie automatyzując najbardziej powtarzalne zadania.

W tym przewodniku dowiesz się, jak wykorzystać lokalną AI do zapewnienia bezpieczeństwa cykli pracy przy użyciu narzędzi takich jak Ollama. Dowiesz się, jak wybierać modele open source dostosowane do konkretnych specyfikacji sprzętowych. Będziesz też tworzyć zautomatyzowane cykle pracy, które przetwarzają prywatne dokumenty lokalnie.

Przyjrzymy się również centralizacji cykli pracy w ujednoliconej przestrzeni, takiej jak ClickUp. 😎

Czym jest lokalna AI?

Lokalna AI oznacza, że duże modele językowe (LLM) uruchamiasz całkowicie na własnym sprzęcie — takim jak laptop lub serwer lokalny — zamiast wysyłać dane do zewnętrznych usług w chmurze. Jest to odpowiednie rozwiązanie dla każdego zespołu zajmującego się poufnymi informacjami, od działów inżynierii i projektowania produktów po działy prawne i finansowe.

W przypadku większości narzędzi AI opartych na chmurze Twoje podpowiedzi, dokumenty i dane trafiają na serwery stron trzecich. Tracisz kontrolę nad tym, jak te informacje są przetwarzane, przechowywane lub wykorzystywane.

Z drugiej strony lokalna AI pozwala zachować dane w Twoim środowisku. Zachowujesz pełną kontrolę nad bezpieczeństwem i ochroną danych w swoich cyklach pracy.

Oczywiście wiąże się to z pewnym kompromisem. Konfiguracja lokalnej AI wymaga większego wysiłku technicznego i początkowej inwestycji w sprzęt. Jednak całkowicie eliminuje to zależność od zewnętrznych dostawców. Dzięki wnioskowaniu na urządzeniu Twoje informacje pozostają dokładnie tam, gdzie chcesz.

Dlaczego lokalna AI ma znaczenie dla bezpiecznych cykli pracy zespołów

🔎 Czy wiesz, że... Tylko 1 na 10 konsumentów jest skłonny udostępniać systemom opartym na AI poufne informacje, takie jak dane finansowe, komunikacyjne lub biometryczne.

Ta niepewność odzwierciedla coraz powszechniejszą rzeczywistość zespołów B2B. Korzystając ze sztucznej inteligencji w chmurze, w zasadzie przekazujesz własność intelektualną swojej firmy podmiotowi zewnętrznemu. Dla zespołów prawnych, finansowych lub HR wiąże się to z ogromną odpowiedzialnością.

Lokalna sztuczna inteligencja zmienia tę dynamikę, przenosząc AI na Twój własny sprzęt. Oto dlaczego ma to znaczenie dla Twojej codziennej działalności:

- Wyeliminuj wyciek danych: Zapobiegaj wykorzystywaniu zastrzeżonego kodu lub prywatnych umów z klientami do szkolenia modeli publicznych, z których mogliby skorzystać Twoi konkurenci

- Zachowaj zgodność z przepisami: Działaj w ramach wytycznych RODO lub HIPAA, ponieważ dane wrażliwe nigdy nie przekraczają granic międzynarodowych ani nie trafiają na serwery stron trzecich

- Uniezależnij się od zależności od Internetu: przeprowadzaj złożone analizy danych lub wykonuj zadania związane z tworzeniem projektów podczas awarii lub w środowiskach o wysokim poziomie bezpieczeństwa, gdzie dostęp do chmury jest ograniczony

- Przewidywalne zarządzanie kosztami: unikaj rosnących opłat za API w miarę rozwoju zespołu, ponieważ jedynym kosztem jest sprzęt, który już posiadasz

Dzięki integracji lokalnej AI z istniejącymi narzędziami możesz zautomatyzować swoją pracę bez narażania bezpieczeństwa.

⚠️ Należy jednak pamiętać, że problem ten może się pogłębić. Twój zespół może chcieć wdrożyć wiele narzędzi AI, co doprowadzi do ich niekontrolowanego rozrostu — czyli mnożenia się narzędzi AI bez nadzoru i strategii. Może to skutkować marnowaniem pieniędzy, powielaniem wysiłków i zagrożeniami dla bezpieczeństwa.

Ostatecznie poszerza to model zagrożeń bezpieczeństwa i utrudnia śledzenie działań.

📮ClickUp Insight: Zespoły o niskiej wydajności są 4 razy bardziej skłonne do korzystania z ponad 15 narzędzi, podczas gdy zespoły o wysokiej wydajności utrzymują efektywność, ograniczając swój zestaw narzędzi do 9 lub mniej platform. A co powiesz na korzystanie z jednej platformy? Jako aplikacja do wszystkiego w pracy, ClickUp łączy Twoje zadania, projekty, dokumenty, wiki, czat i rozmowy w ramach jednej platformy, uzupełnionej o cykle pracy oparte na sztucznej inteligencji. Gotowy na mądrzejszą pracę? ClickUp sprawdza się w każdym zespole, sprawia, że praca staje się widoczna, i pozwala skupić się na tym, co najważniejsze, podczas gdy AI zajmuje się resztą.

Czego potrzebujesz, aby uruchomić lokalną AI?

Nie potrzebujesz specjalistycznego superkomputera, aby uruchamiać AI lokalnie. Najnowsze zmiany w sposobie tworzenia modeli pozwalają rozpocząć pracę przy użyciu sprzętu, który już posiadasz. Musi on jedynie spełniać kilka konkretnych kryteriów.

Wymagania sprzętowe

To sprzęt decyduje o rozmiarze i szybkości modeli AI, z których możesz korzystać. Chociaż wydajna maszyna pozwala na uruchamianie bardziej złożonych modeli wnioskowania, mniejsze modele stały się zaskakująco wydajne.

- Karta graficzna z pamięcią VRAM: Dedykowana karta NVIDIA z co najmniej 12 GB pamięci VRAM to obecnie optymalne rozwiązanie dla większości zespołów. Pozwala ona na uruchamianie średniej wielkości modeli, takich jak Llama 3.3 (8B) lub Mistral Small, z dużą prędkością

- Pamięć RAM systemu: Jeśli nie masz wysokiej klasy karty graficznej, obciążenie przejmie pamięć RAM komputera. 32 GB zapewnia wystarczającą rezerwę mocy, aby uruchomić model, jednocześnie pozostawiając otwarte przeglądarkę i narzędzia do zarządzania projektami

- Pamięć zunifikowana (dla użytkowników komputerów Mac): Jeśli korzystasz z komputera Mac z procesorem z serii M (M2, M3 lub M4), pamięć RAM i pamięć GPU są udostępniane. Dzięki temu komputery Mac są szczególnie wydajne w przypadku lokalnej AI, ponieważ model ma dostęp do całej puli pamięci

- Szybka pamięć masowa: Modele to duże pliki, często o zakresie rozmiarów od 5 GB do 50 GB. Korzystanie z dysku SSD NVMe jest niezbędne, aby uniknąć długiego czasu oczekiwania podczas ładowania nowego modelu

🔎 Czy wiesz, że? Złożenie komputera jest znacznie droższe niż jeszcze kilka miesięcy temu. Wcześniej zestaw pamięci DDR5 o pojemności 32 GB kosztował poniżej 130 dolarów, ale obecnie ceny tych samych zestawów przekroczyły 400 dolarów. Ta zmiana sprawiła, że 32 GB stało się nowym absolutnym minimum dla każdej poważnej pracy z lokalną AI, ponieważ potrzebujesz wystarczającej rezerwy mocy, aby uruchamiać modele bez spadku wydajności systemu.

Wymagania sprzętowe

Oprogramowanie pełni rolę pomostu między sprzętem a AI. Nie musisz już być programistą, aby to uruchomić.

- System operacyjny: Chociaż Linux jest naturalnym środowiskiem dla AI, systemy Windows i macOS są obecnie równie wydajne. Użytkownicy systemu Windows mogą korzystać z WSL2, aby uzyskać środowisko podobne do Linuksa, choć wiele narzędzi działa obecnie bezpośrednio w systemie Windows

- Menedżerowie modeli: Narzędzia takie jak Ollama czy LM Studio to najłatwiejszy punkt wyjścia. Zajmują się one kwantyzacją — automatycznie kompresują model, aby zmieścił się na Twoim sprzęcie

- Sterowniki: Będziesz potrzebować najnowszych sterowników dla swojego sprzętu, takich jak najnowszy sterownik CUDA dla kart NVIDIA. Większość nowoczesnych instalatorów sprawdzi to za Ciebie podczas ustawień

Opcje LLM typu open source

Obserwujemy gwałtowny wzrost liczby modeli o otwartej wadze, które można pobrać za darmo. Są one tworzone przez takie firmy jak Meta (Llama), Mistral i Alibaba (Qwen). W przeciwieństwie do systemów zamkniętych, modele te pozwalają dokładnie zobaczyć, jak działają i dokąd trafiają Twoje dane.

Wybierając duży model językowy, zwróć uwagę na licencję oprogramowania. Większość z nich korzysta z licencji Apache 2.0 lub MIT, co pozwala na wykorzystanie ich w działalności biznesowej bez konieczności płacenia miesięcznej subskrypcji. Ponieważ modele te działają na Twoim sprzęcie, integrują się bezpośrednio z Twoimi prywatnymi cyklami pracy.

Możesz na przykład używać lokalnego modelu do tworzenia szkiców wewnętrznych wiadomości e-mail, podsumowywania protokołów ze spotkań lub analizowania zastrzeżonych zbiorów danych. Dzięki temu najbardziej wrażliwe szczegóły projektów i notatki strategiczne pozostają na Twoim komputerze.

🧠 Ciekawostka: Chipy Apple z serii M oferują wyjątkową zaletę architektoniczną dla zespołów skupiających się na prywatności. Zunifikowana pamięć komputerów Mac pozwala AI wykorzystywać całą pulę pamięci RAM systemu tak, jakby była to dedykowana pamięć graficzna.

Oznacza to, że MacBook wyposażony w 128 GB pamięci RAM może obsługiwać ogromne, bardzo zaawansowane modele, które normalnie wymagałyby specjalistycznego sprzętu klasy Enterprise kosztującego ponad 10 000 dolarów.

Najlepsze lokalne modele AI do cykli pracy zespołów

Aby znaleźć odpowiedni model, dopasuj jego mocne strony do zadań Twojego zespołu i możliwości sprzętowych.

Modele ogólnego przeznaczenia

To podstawowe narzędzia Twoich lokalnych ustawień. Wykorzystaj je do tworzenia szkiców wiadomości e-mail, podsumowywania aktualizacji projektów lub burzy mózgów nad kreatywnymi pomysłami.

- Llama 4 Scout (17B): Posiada funkcję okna kontekstowego o pojemności 10 milionów tokenów, co pozwala na jednoczesne przetwarzanie tysięcy stron tekstu

- Mistral Small 4: Wykorzystuje architekturę typu „mixture-of-experts”, co oznacza, że dla każdego zadania aktywuje jedynie ułamek swoich parametrów

- Qwen 3.5 (7B): Zapewnia stałą przewagę wydajnościową, jeśli Twój zespół zajmuje się dokumentacją techniczną w wielu językach

Modele służące do wnioskowania i korzystania z narzędzi

Wykorzystaj je, gdy potrzebujesz, aby agenci LLM rozwiązywali wieloetapowe problemy, podążali za złożoną logiką lub działali jako autonomiczni agenci w ramach Twoich cykli pracy.

- Llama 4 Maverick: Jest to rozwiązanie natywnie multimodalne. Dzięki temu idealnie nadaje się dla zespołów, które muszą analizować złożone wykresy lub arkusze kalkulacyjne, gdzie kontekst wizualny jest równie ważny jak tekst.

- Phi-4 (14B): Dostosowany do potrzeb STEM i rozumowania logicznego. Wykorzystaj go do walidacji danych lub złożonych zadań matematycznych, które zazwyczaj wymagają znacznie większych i droższych modeli

- DeepSeek-R1: Wyświetla swój wewnętrzny tok rozumowania, co pomaga zweryfikować jego logikę w przypadku analiz o wysokiej stawce. Idealny do dogłębnych badań i planowania strategicznego

Modele przeznaczone do konkretnych zadań

Czasami wyspecjalizowane narzędzie jest bardziej wydajne niż ogólny asystent. Modele te są zoptymalizowane pod kątem jednej konkretnej części Twojego cyklu pracy.

- Qwen 3-Coder-Next: Rozumie logikę na poziomie repozytorium, co pozwala mu sugerować poprawki błędów lub refaktoryzację kodu w wielu plikach. Wszystko to przy zachowaniu zgodności z konkretnymi wytycznymi stylistycznymi Twojego zespołu.

- Voxtral Mini: Rozpoznaje różnych mówców w nagraniu i przekształca nagrania z prywatnych spotkań w tekst z możliwością wyszukiwania. Działa całkowicie w trybie offline, co pozwala uniknąć wycieku danych

- Nomic Embed v1.5: Przekształca Twoje prywatne dokumenty w dane matematyczne do wyszukiwania semantycznego. Dzięki temu możesz przeszukiwać wewnętrzną bazę wiedzy swojego zespołu na podstawie znaczenia, a nie tylko słów kluczowych

📚 Przeczytaj również: Wyszukiwarki LLM: wyszukiwanie informacji oparte na AI

Popularne narzędzia do uruchamiania lokalnej AI

Nie musisz już być inżynierem oprogramowania, aby uruchamiać modele na własnym komputerze. Kilka przyjaznych dla użytkownika aplikacji zajmie się teraz ustawieniami technicznymi za Ciebie w ciągu kilku minut.

Ollama i OpenWebUI

Ollama jest odpowiednim rozwiązaniem, jeśli zależy Ci na szybkości i elastyczności. Działa w tle i zarządza biblioteką modeli za pomocą prostego interfejsu.

Chociaż na początku jest to podstawowe narzędzie, większość użytkowników łączy je z OpenWebUI. Zapewnia to dopracowaną obsługę czatu w przeglądarce, która wygląda i działa podobnie do znanych już narzędzi z chmury. Tworzy również lokalny most, dzięki któremu inne aplikacje na komputerze mogą bezpiecznie komunikować się z modelami AI.

LM Studio

Jeśli wolisz tradycyjną aplikację komputerową, LM Studio jest doskonałą alternatywą. Działa jak sklep z aplikacjami dla AI. Możesz go używać do wyszukiwania, pobierania i komunikowania się z nowym modelem za pomocą zaledwie kilku kliknięć.

Aplikacja zawiera wbudowaną funkcję wykrywania sprzętu, dzięki czemu automatycznie konfiguruje ustawienia dostosowane do konkretnego procesora graficznego (GPU) lub pamięci RAM. To świetny punkt wyjścia, jeśli chcesz eksperymentować z różnymi modelami bez konieczności pisania ani jednej linii kodu.

GPT4All

Dla zespołów skupiających się wyłącznie na prywatności i analizie dokumentów GPT4All stanowi niezawodne i proste rozwiązanie. Działa na niemal każdym komputerze, w tym na starszych laptopach, które mogą nie posiadać dedykowanej karty graficznej.

Najbardziej przydatną funkcją jest możliwość bezpośredniej komunikacji z lokalnymi plikami. Możesz wskazać aplikacji folder na dysku twardym, a AI odpowie na pytania dotyczące tych konkretnych dokumentów. Wszystko to bez konieczności przesyłania ich na serwer zewnętrzny.

📚 Przeczytaj również: Najlepsze agenty AI dla użytkowników bez umiejętności programowania

Jak skonfigurować lokalną AI w celu zapewnienia bezpiecznych cykli pracy

W tym przewodniku wykorzystano Ollamę, ponieważ jest to narzędzie z szerokim wsparciem do tworzenia bezpiecznych, lokalnych cykli pracy opartych na AI.

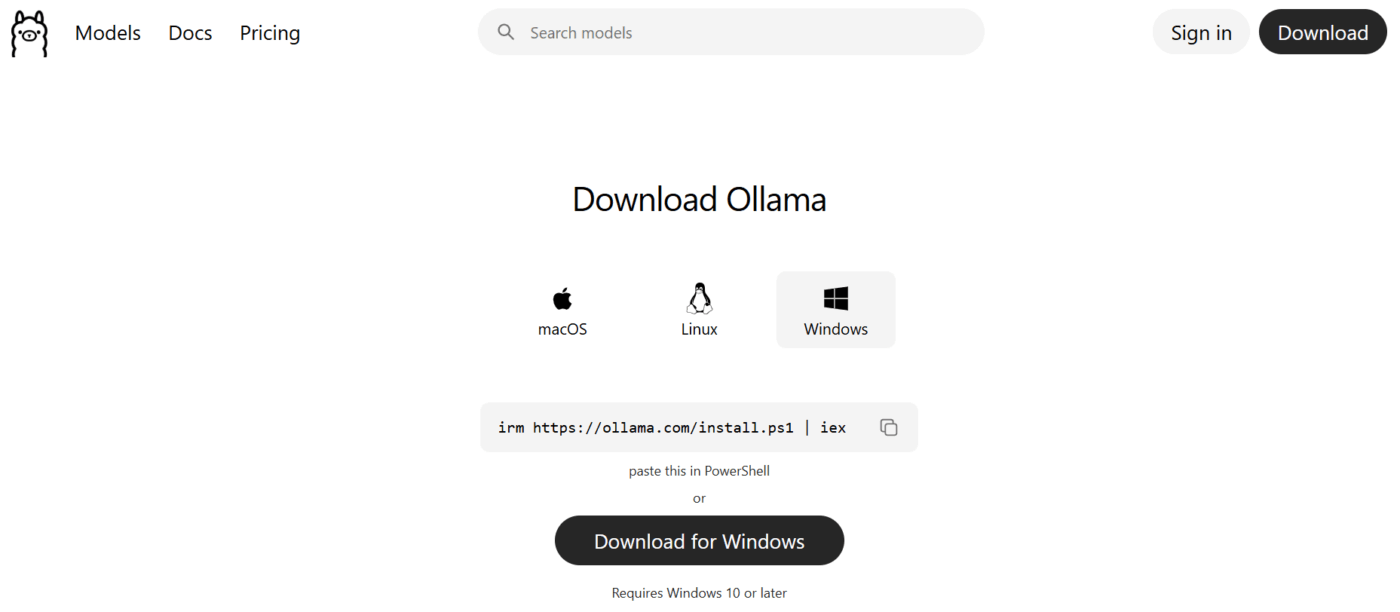

Krok 1: Zainstaluj Ollama

Pobierz instalator z oficjalnej strony internetowej dla swojego systemu operacyjnego. Podczas gdy wcześniejsze wersje systemu Windows wymagały ręcznych ustawień podsystemu Linux, obecna wersja instaluje się jako aplikacja natywna.

Instalacja powinna zająć tylko kilka minut. Po zakończeniu instalacji otwórz terminal lub komendę i wpisz ollama --version, aby sprawdzić, czy wszystko działa poprawnie.

Krok 2: Pobierz i uruchom model

Aby rozpocząć korzystanie ze sztucznej inteligencji, musisz pobrać jej wagi na swój komputer. Do pierwszego testu wypróbuj kompaktowy, ale wydajny model, taki jak Llama 3.2 (3B) lub najnowszy Mistral.

Użyj komendy ollama run llama3.2, aby rozpocząć pobieranie.

W zależności od szybkości połączenia internetowego trwa to zazwyczaj kilka minut. Po zakończeniu pobierania możesz wpisać podpowiedź bezpośrednio w terminalu, aby uzyskać natychmiastową odpowiedź od modelu znajdującego się na dysku twardym.

Krok 3: Wykonaj połączenie z narzędziem do zarządzania cyklem pracy

Prawdziwa wartość lokalnej AI wynika z jej integracji z codziennymi zadaniami. Gdy Ollama jest uruchomiona, automatycznie uruchamia lokalny serwer pod adresem http://localhost:11434. Tworzy to bezpieczny pomost umożliwiający innym aplikacjom komunikację z Twoim modelem.

Ponieważ serwer ten jest zgodny ze standardowymi protokołami OpenAI, możesz podłączyć go do platform automatyzacji lub wewnętrznych skryptów, po prostu zmieniając adres API. Możesz na przykład skierować lokalne narzędzie do wyszukiwania dokumentów na ten adres. Dzięki temu narzędzie to będzie mogło tworzyć podsumowania prywatnych plików bez konieczności wysyłania tekstu do chmury.

📖 Przeczytaj również: Jak usprawnić koordynację cykli pracy w celu zwiększenia wydajności

Najlepsze praktyki w zakresie bezpieczeństwa dla lokalnych cykli pracy opartych na AI

Lokalne uruchamianie AI to duży krok naprzód w zakresie prywatności. Jednak przechowywanie danych lokalnie oznacza, że to Ty jesteś teraz odpowiedzialny za ich ochronę. Chociaż wyeliminowałeś ryzyko naruszenia bezpieczeństwa w chmurze przez stronę trzecią, nadal musisz zabezpieczyć swój sprzęt oraz sposób, w jaki Twój zespół korzysta z modeli.

Postępuj zgodnie z poniższymi najlepszymi praktykami:

- Izolacja sieciowa: Ogranicz dostęp do API do zaufanych sieci wewnętrznych, aby serwer AI pozostawał niedostępny z publicznej sieci internetowej

- Walidacja danych wejściowych: Oczyść wszystkie dane przed wysłaniem ich do modelu. Blokuje to ukryte złośliwe instrukcje w dokumentach lub e-mailach.

- Kontrola dostępu: Wprowadź uwierzytelnianie w punkcie końcowym AI, aby zweryfikować, czy tylko uprawnieni użytkownicy mogą być wyzwalaczami działań modeli

- Rejestrowanie audytowe: Prowadź rejestr wszystkich interakcji modeli, aby ułatwić działania związane z zapewnieniem zgodności z przepisami i dochodzeniami dotyczącymi bezpieczeństwa

- Izolacja kontenerów: Uruchamiaj modele w środowiskach typu sandbox, takich jak Docker. Zapobiega to przedostaniu się potencjalnego naruszenia do plików systemu podstawowego.

- Regularne aktualizacje: Zainstaluj najnowsze poprawki do narzędzi takich jak Ollama, aby zapewnić sobie ochronę przed nowo wykrytymi lukami w zabezpieczeniach

- Ograniczanie przepustowości: Aby zapobiec przeciążeniu serwera żądaniami wysyłanymi przez pojedynczego użytkownika lub skrypt, wdroż ograniczanie przepustowości, aby kontrolować liczbę zapytań, które mogą być wysyłane w danym okresie.

🔎 Czy wiesz, że? Manipulacje oparte na poleceniach nie są już tylko teoretycznym zagrożeniem. Niedawna ankieta firmy Gartner wykazała, że w ciągu ostatniego roku 32% organizacji doświadczyło złośliwego ataku typu prompt na aplikacje AI. Ataki te mogą manipulować lokalnym modelem w taki sposób, aby generował stronnicze lub nieautoryzowane wyniki.

Jak stworzyć bezpieczne cykle pracy oparte na AI dla swojego zespołu

Gdy lokalny serwer już działa, możesz zintegrować go ze swoją codzienną pracą. Dzięki temu proste narzędzie zamienia się w prywatny silnik wydajności. Najskuteczniejszym sposobem na to jest wykorzystanie technologii RAG ( Retrieval-Augmented Generation ).

Proces tworzy połączenie między lokalną AI a prywatną bazą danych zawierającą Twoje własne pliki. Możesz odpowiadać na pytania, korzystając z konkretnego kontekstu firmowego, bez konieczności przesyłania ani jednego bajtu do chmury.

Możesz również projektować cykle pracy z udziałem człowieka (human-in-the-loop), w których praca AI jest weryfikowana przez członków zespołu. Zapewnia to dokładność, jednocześnie znacznie przyspieszając uzyskiwanie wyników.

Oto kilka praktycznych przykładów:

- Analiza dokumentów: Podsumowuj raporty wewnętrzne lub opinie klientów, aby natychmiast uzyskać kluczowe wnioski

- Tworzenie szkiców: Twórz wstępne wersje wiadomości e-mail lub aktualizacji dotyczących projektów, które członkowie zespołu będą mogli dopracować

- Klasyfikacja danych: Automatycznie kategoryzuj przychodzące zadania na podstawie konkretnej zawartości żądania

- Przygotowanie do spotkania: Stwórz listę tematów do omówienia, analizując powiązane pliki projektowe przechowywane na dysku lokalnym

- Przegląd kodu: Uzyskaj opinie na temat własnego kodu źródłowego bez ujawniania swojej własności intelektualnej osobom trzecim

📮ClickUp Insight: Nasze badanie dojrzałości AI pokazuje, że dostęp do sztucznej inteligencji w pracy jest nadal ograniczony — 36% osób nie ma do niej żadnego dostępu, a tylko 14% twierdzi, że większość pracowników może faktycznie z nią eksperymentować. Gdy AI jest ograniczona uprawnieniami, wymaga dodatkowych narzędzi lub skomplikowanych ustawień, zespoły nie mają szansy nawet wypróbować jej w rzeczywistej, codziennej pracy.

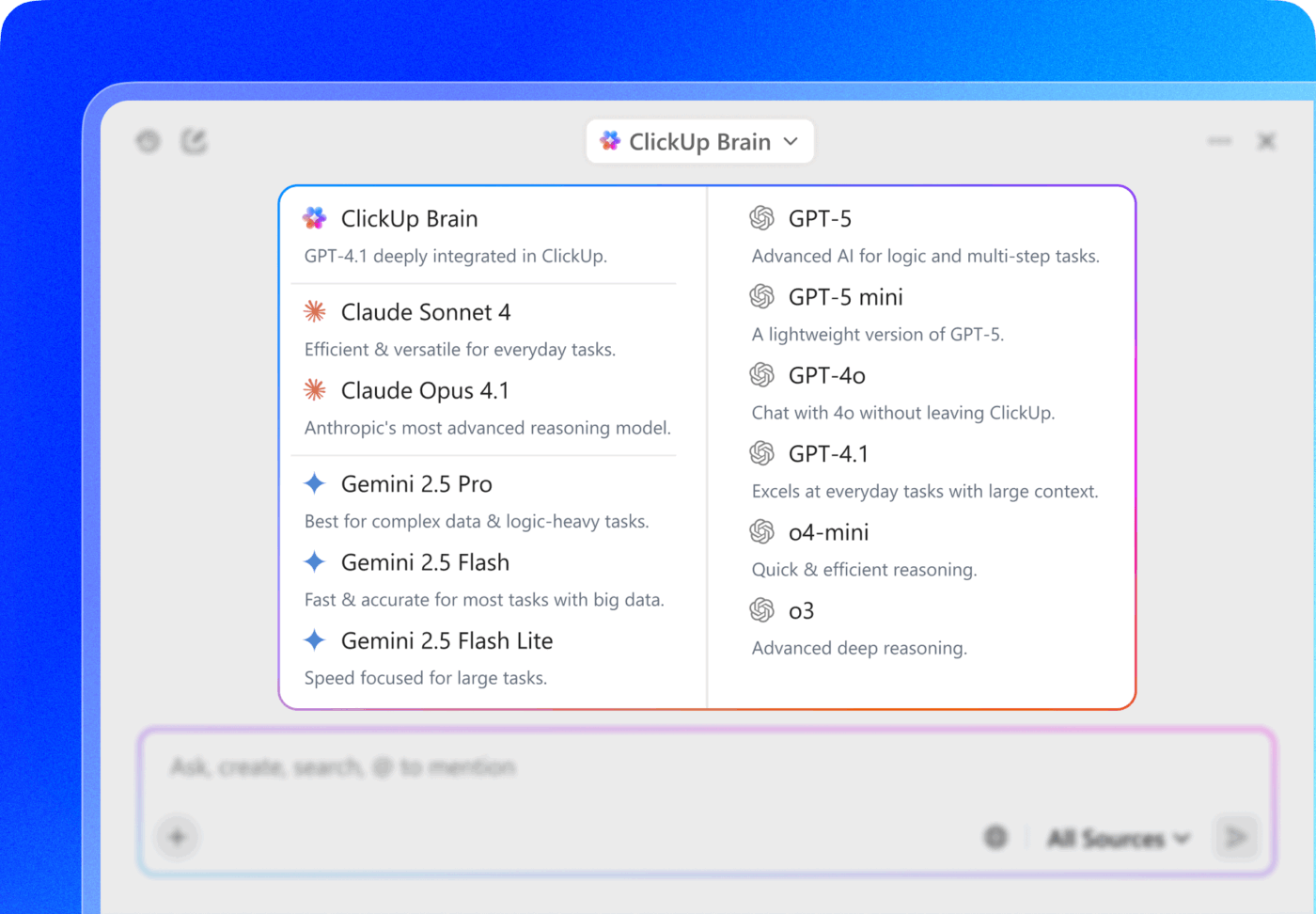

ClickUp Brain eliminuje wszystkie te utrudnienia, umieszczając sztuczną inteligencję bezpośrednio w obszarze roboczym, z którego już korzystasz. Możesz korzystać z wielu modeli AI, generować obrazy, pisać lub debugować kod, przeszukiwać internet, tworzyć podsumowania dokumentów i nie tylko — bez konieczności przełączania się między narzędziami lub utraty koncentracji.

To Twój partner w zakresie AI otoczenia — łatwy w użyciu i dostępny dla wszystkich członków zespołu.

Ograniczenia związane z wykorzystaniem lokalnej sztucznej inteligencji w cyklach pracy opartych na AI

Lokalna sztuczna inteligencja to potężne narzędzie, ale nie jest to magiczne rozwiązanie wszystkich problemów. Zrozumienie jej ograniczeń pomoże Ci zdecydować, kiedy zadanie należy wykonać na własnym sprzęcie, a kiedy skorzystać z chmury. Dla niektórych zespołów kompromisy techniczne i finansowe mogą przeważać nad korzyściami związanymi z prywatnością.

- Ograniczenia możliwości: Najwyższej klasy modele własnościowe nadal mają niewielką przewagę w zakresie złożonego rozumowania i kreatywnych niuansów w porównaniu z wersjami open source

- Inwestycja w sprzęt: Szybkie działanie dużych modeli wymaga drogich procesorów graficznych (GPU) z dużą pamięcią VRAM. Dla małych zespołów może to oznaczać wysokie koszty początkowe

- Koszty utrzymania: Użytkownik ponosi odpowiedzialność za wszystkie aktualizacje oprogramowania, rozwiązywanie problemów sprzętowych oraz instalowanie poprawek bezpieczeństwa bez wsparcia zespołu wsparcia technicznego dostawcy

- Wiedza techniczna: Optymalizacja środowiska lokalnego wymaga praktycznej wiedzy na temat kwantyzacji modeli i konfiguracji serwerów

- Zarządzanie bezpieczeństwem: W przeciwieństwie do usług w chmurze, lokalne modele nie mają wbudowanych mechanizmów moderacji. Musisz wdrożyć własne filtry zawartości i zabezpieczenia

- Zużycie energii: Uruchamianie modeli AI na dużą skalę na własnych serwerach lub stacjach roboczych może znacznie zwiększyć zużycie energii elektrycznej i zapotrzebowanie na chłodzenie

Wiele zespołów stosuje podejście hybrydowe: lokalną AI do przetwarzania danych wrażliwych, a chmurową AI do mniej wrażliwych zadań wymagających maksymalnej wydajności. Oto krótki przegląd tych dwóch rozwiązań:

| Czynnik | Lokalna AI | AI w chmurze |

|---|---|---|

| Prywatność danych | Pełna kontrola | Dane wysyłane do dostawcy |

| Złożoność ustawień | Wyżej | Niższe |

| Bieżące koszty | Sprzęt + energia elektryczna | Opłaty za token |

| Możliwości modeli | Dobrze, poprawa | Najnowocześniejsze rozwiązania |

| Konserwacja | Zarządzane samodzielnie | Zarządzane przez dostawcę |

W jaki sposób ClickUp zapewnia wsparcie dla bezpiecznych cykli pracy opartych na sztucznej inteligencji

Większość zespołów stoi dziś przed dylematem: korzystać z potężnej sztucznej inteligencji w chmurze i martwić się o to, gdzie trafiają dane, czy też skonfigurować lokalne modele i radzić sobie z bieżącymi kosztami. ClickUp pozwala ominąć ten dylemat, działając jako zintegrowany obszar roboczy AI — gdzie sztuczna inteligencja jest już wbudowana w system, w którym odbywa się Twoja praca.

ClickUp Brain to warstwa AI wbudowana bezpośrednio w obszar roboczy ClickUp, zaprojektowana tak, aby w jednym miejscu analizować Twoje zadania, dokumenty i komunikację zespołową. Zapewnia pomoc AI z pełnym kontekstem — bez oddzielnych narzędzi i bez niestabilnych integracji.

Dla zespołów dążących do stworzenia bezpiecznych cykli pracy opartych na AI połączenie kontekstu i kontroli stanowi różnicę między eksperymentowaniem a rzeczywistym wdrożeniem.

🌟 ClickUp jest również zgodny z SOC 2 i przestrzega norm ISO 42001 dotyczących odpowiedzialnego zarządzania sztuczną inteligencją. Gwarantuje to, że Twoje dane nigdy nie zostaną wykorzystane do szkolenia modeli stron trzecich, co pozwala na automatyzację pracy z takim samym poczuciem bezpieczeństwa, jak w przypadku ustawień lokalnych.

Uzyskaj dostęp do funkcji wyszukiwania i autonomicznych cykli pracy dzięki ClickUp Brain

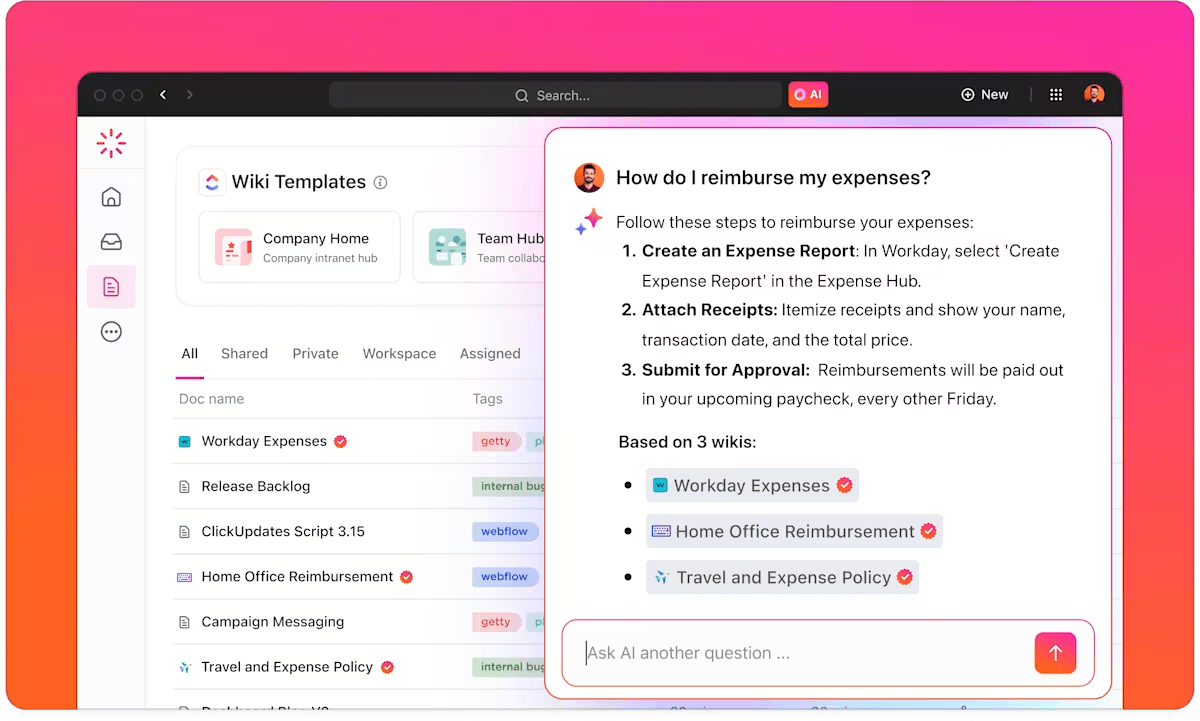

Gdy dane są już zabezpieczone w obszarze roboczym, ClickUp Brain w czasie rzeczywistym wydobywa wartość z Twoich zadań i dokumentów.

Ponieważ AI jest wbudowana, pozwala uniknąć luki kontekstowej, która spowalnia lokalne ustawienia. Możesz zadawać jej pytania, których dokładne rozstrzygnięcie wymaga pełnego widoku na historię projektu:

- Zidentyfikuj ostateczne decyzje na podstawie obszernego briefu technicznego bez konieczności przewijania kolejnych wersji

- Tworzenie wersji roboczych aktualizacji dla interesariuszy na podstawie komentarzy do zadań i zmian statusu

ClickUp Brain generuje odpowiedzi oparte na danych z Twojego obszaru roboczego, analizując konkretną zawartość w dokumentach, zadaniach i czatach. Dzięki temu, w miarę rozwoju projektu, sztuczna inteligencja zawsze dysponuje najnowszym kontekstem.

Dzięki temu Twój zespół może wykorzystywać wnioski bez konieczności ręcznego wyjaśniania historii projektu lub przenoszenia danych między oddzielnymi narzędziami.

💡Wskazówka dla profesjonalistów: Możesz jeszcze bardziej rozszerzyć kontekst swojego obszaru roboczego, korzystając z funkcji Enterprise AI Search, aby pobierać informacje ze wszystkich swoich narzędzi zewnętrznych.

Na przykład zadaj szczegółowe pytanie, takie jak „Pokaż mi wszystkie otwarte transakcje w procesie sprzedaży”, a ClickUp Brain przeszuka połączone aplikacje, w tym Slack, Google Drive i Gmail, aby dostarczyć wiarygodną odpowiedź w czasie rzeczywistym wraz z odniesieniami.

Dzięki temu rozproszone dane na wielu platformach zamieniają się w jedną warstwę informacji z funkcją wyszukiwania, w której możesz znaleźć dowolny plik, wiadomość lub zadanie bez opuszczania swojego obszaru roboczego.

Inteligentne zarządzanie zadaniami dzięki automatyzacji i AI

ClickUp Brain nie tylko biernie pomaga — aktywnie działa w ramach Twojego systemu zadań. Może:

- Generuj zadania na podstawie notatek ze spotkań lub dokumentów

- Podziel duże zadania na podzadania

- Sugeruj właścicieli zadań na podstawie wcześniejszej aktywności

- Rekomenduj terminy w oparciu o kontekst projektu

Może również aktualizować statusy zadań, podsumowywać długie wątki komentarzy w postaci jasnych kolejnych kroków oraz sygnalizować przeszkody, zanim spowolnią one realizację.

W połączeniu z ClickUp Automatyzacją tworzy to system zamkniętej pętli: AI może uruchamiać cykle pracy (takie jak przydzielanie zadań, powiadamianie interesariuszy lub aktualizowanie priorytetów) w oparciu o zmiany zachodzące w Twoim obszarze roboczym.

Na przykład po sfinalizowaniu dokumentu zadania mogą być automatycznie tworzone i przypisywane bez konieczności ręcznego przenoszenia danych między narzędziami.

💟 Bonus: Zmień ClickUp Brain MAX w swoją „pamięć decyzyjną”.

Wykorzystaj to do:

- Podsumuj długie wątki komentarzy, formułując jasne decyzje i kolejne kroki

- Po osiągnięciu kluczowych kamieni milowych aktualizuj dokumentację, podając informacje o tym, „co się zmieniło i dlaczego”.

- Generuj cotygodniowe dzienniki decyzji na podstawie zadań, spotkań i aktualizacji

Z czasem tworzy to żywą warstwę wiedzy instytucjonalnej, do której Brain MAX może się odwoływać. Zamiast więc odpowiadać na podpowiedzi w oderwaniu od kontekstu, zaczyna reagować z uwzględnieniem wcześniejszych decyzji, priorytetów i wzorców.

Właśnie wtedy AI przestaje być tylko pomocna, a staje się niezawodna — zwłaszcza w bezpiecznych cyklach pracy opartych na AI, gdzie kontekst i identyfikowalność mają znaczenie.

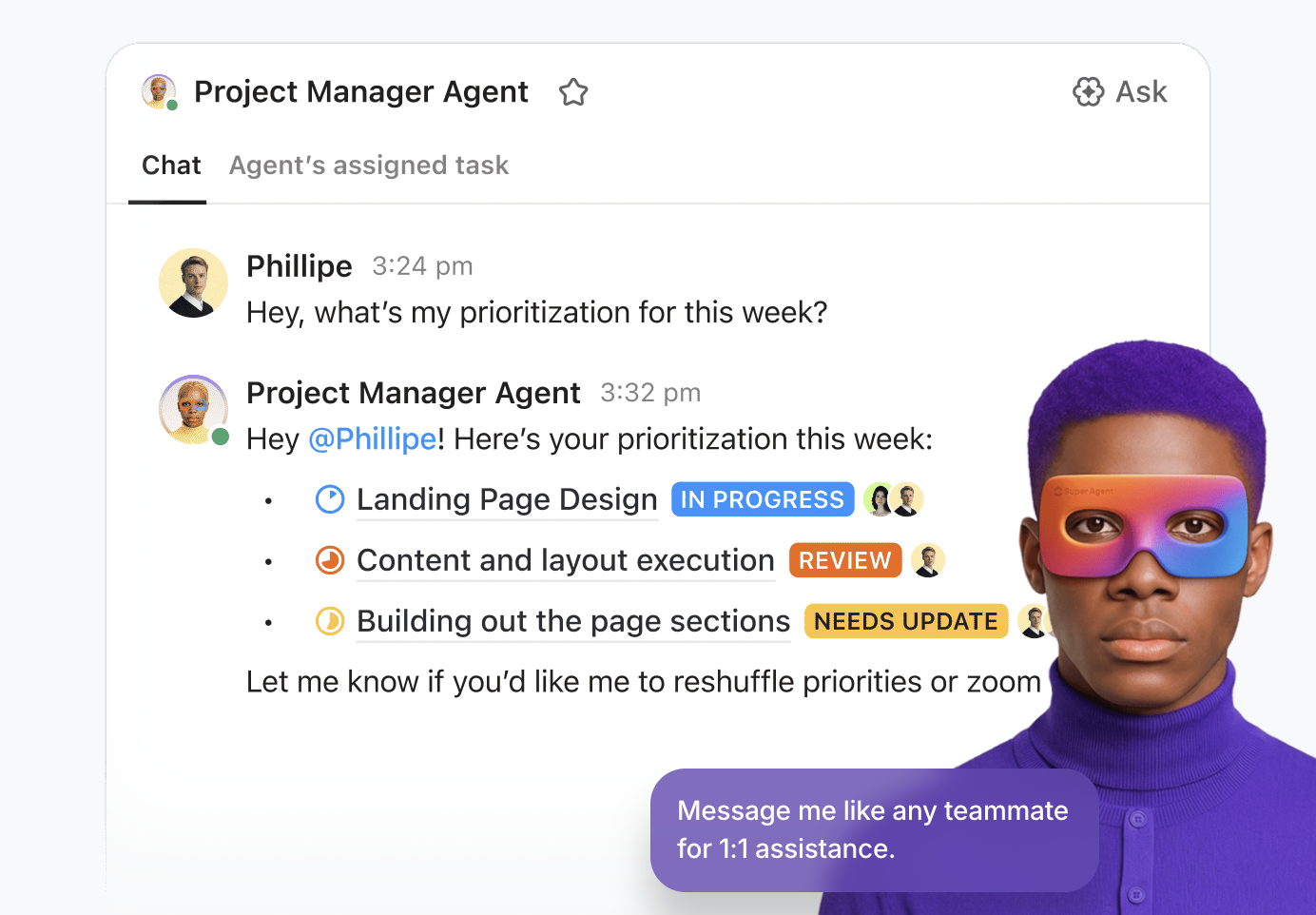

Zapewnij bezpieczne, kontekstowe wykonywanie zadań na dużą skalę dzięki Super Agents

Superagenci ClickUp przenoszą ClickUp Brain na wyższy poziom — od pomocy w pracy do jej aktywnego kierowania. Agentów tych można skonfigurować tak, aby monitorowali cykle pracy, podejmowali działania i koordynowali zadania w całym obszarze roboczym w oparciu o z góry określone reguły i kontekst w czasie rzeczywistym.

Na przykład Super Agent może:

- Monitoruj przychodzące zgłoszenia lub dokumenty i automatycznie przekształcaj je w uporządkowane zadania z wyznaczonymi właścicielami i terminami

- Śledź postępy projektu i sygnalizuj zagrożenia lub opóźnienia, zanim się nasilą

- Uruchamiaj wieloetapowe automatyzacje po spełnieniu określonych warunków — np. powiadamiaj interesariuszy, aktualizuj priorytety lub twórz zadania następcze

Agenci ci działają całkowicie w ramach ujednoliconego obszaru roboczego ClickUp, mając pełną świadomość Twoich zadań, dokumentów i struktury uprawnień. Oznacza to, że:

- Nie musisz eksportować danych do zewnętrznych systemów AI ani narzędzi do koordynacji

- Mają dostęp tylko do tych danych, do których mają uprawnienia

- Działają w ramach tych samych ograniczeń uprawnień, co Twój zespół

Dowiedz się więcej o pracy z Super Agentami:

Skorzystaj z pomocy AI w swoich dokumentach

Dzięki ClickUp Docs wsparcie AI jest wbudowane bezpośrednio w cykle pracy związane z tworzeniem dokumentów. Zespoły mogą tworzyć szkice briefów projektowych, streszczać długie raporty, wyodrębniać elementy do wykonania lub przerabiać zawartość dla różnych odbiorców — wszystko to bez opuszczania platformy.

Ma znaczenie dla bezpiecznych cykli pracy AI, ponieważ jedno z największych zagrożeń wynika z kopiowania i wklejania poufnych informacji do narzędzi zewnętrznych. W ClickUp minimalizujesz przepływ danych i zachowujesz pełną kontrolę nad dostępem dzięki uprawnieniom.

Ostateczny werdykt: Budowa prywatnego stosu AI

Lokalna AI wykorzystuje możliwości sztucznej inteligencji, zapewniając jednocześnie pełną kontrolę nad prywatnością danych i zgodnością z przepisami. Jednak ta droga wymaga znacznych inwestycji w sprzęt, ustawienia techniczne i bieżącą konserwację.

Praktyki bezpieczeństwa pozostają kluczowe niezależnie od tego, czy korzystasz z lokalnej, czy chmurowej AI. Najskuteczniejsza strategia często polega na podejściu hybrydowym: wykorzystaniu lokalnej AI do najbardziej wrażliwych operacji przy jednoczesnym korzystaniu z zarządzanych, bezpiecznych rozwiązań zapewniających codzienną wydajność.

Należy koniecznie rozważyć kompromisy — dla wielu zespołów obciążenie związane z rozwiązaniem typu „zrób to sam” może nie być właściwym wyborem.

Dla tych, którzy pragną wysokiej wydajności AI bez obciążenia związanego z infrastrukturą, rozwiązania zarządzane, takie jak ClickUp Brain, stanowią atrakcyjny kompromis. Zapewniają one bezpieczeństwo na poziomie korporacyjnym bez żadnej złożoności ustawień.

Zacznij korzystać z ClickUp za darmo i odkryj bezpieczne, kontekstowe cykle pracy oparte na AI dla swojego zespołu.

Często zadawane pytania

Jaka jest różnica między lokalną AI a AI w chmurze w kontekście cykli pracy zespołów?

Lokalna AI działa całkowicie na Twoim własnym sprzęcie, gwarantując, że dane nigdy nie opuszczają Twojej sieci wewnętrznej, podczas gdy AI oparta na chmurze wysyła podpowiedzi do serwerów stron trzecich w celu przetworzenia. Ustawienia lokalne zapewniają całkowitą suwerenność danych i dostęp offline, podczas gdy usługi w chmurze oferują większą moc obliczeniową i łatwość użytkowania kosztem bezpośredniej kontroli nad danymi.

W jaki sposób zespoły mogą wykorzystywać lokalne modele AI w połączeniu z poufnymi danymi z projektów?

Zespoły mogą wykorzystywać lokalną AI do przetwarzania poufnych dokumentów, zastrzeżonego kodu i dokumentacji finansowej, kierując model do prywatnych katalogów w siedzibie firmy. Ponieważ wnioskowanie odbywa się na urządzeniu, można wykonywać zadania, takie jak automatyczne tworzenie podsumowań, ekstrakcja danych i wewnętrzne wyszukiwanie wiedzy, bez narażania się na kontakt z publicznymi zestawami szkoleniowymi LLM.

Czy lokalne modele AI są równie wydajne jak ChatGPT w zadaniach służbowych?

Wiele lokalnych modeli open source, takich jak Llama 3 i Mistral, jest obecnie w stanie z powodzeniem wykonywać rutynowe zadania, takie jak tworzenie szkiców, kodowanie i streszczanie. Podczas gdy najlepsze modele chmurowe, takie jak GPT-4o, nadal przodują w zakresie niezwykle złożonego rozumowania, modele lokalne oferują porównywalną wydajność w 90% codziennych operacji biznesowych, zapewniając jednocześnie znacznie lepszą prywatność.

Jakie są zalety i wady lokalnego uruchamiania AI w porównaniu z korzystaniem z usług AI w chmurze?

Głównym kompromisem jest wybór między całkowitą prywatnością danych w przypadku lokalnej AI a skalowalnością AI w chmurze, która nie wymaga konserwacji. Lokalne uruchamianie AI wymaga początkowej inwestycji w sprzęt i wiedzy technicznej, ale eliminuje powtarzające się opłaty za API oraz ryzyko wycieku danych. AI w chmurze jest szybsza we wdrożeniu, ale wiąże się z bieżącymi kosztami subskrypcji i zależnością od danych stron trzecich.