Il monitoraggio degli esperimenti di IA esiste per un semplice motivo: il lavoro di ML è intrinsecamente disordinato e, senza un sistema per registrare le decisioni, è quasi impossibile costruire su ciò che hai già terminato.

Ogni esperimento coinvolge decine di elementi in movimento: set di dati, parametri, versioni dei modelli e metriche di valutazione. Ma altrettanto importante è il perché alla base di ogni cambiamento. Perché hai modificato quella funzionalità/funzione? Perché questa versione ha funzionato meglio? Senza una documentazione chiara, quel contesto va perso.

E per il ~55% dei team che opera ancora senza un sistema dedicato al monitoraggio degli esperimenti, questa mancanza di contesto si manifesta ovunque.

Nota in Jupyter, metriche nei fogli di calcolo, decisioni sepolte in Slack. Con questa caotica mancanza di un sistema, non è possibile riprodurre i risultati. Si finisce per ripetere idee fallite e diventa più difficile scalare i successi.

Questa guida presenta 10 modelli gratuiti per il monitoraggio degli esperimenti di IA progettati proprio per risolvere questo problema. Ciascuno di essi affronta aspetti specifici del tuo flusso di lavoro, dalla strutturazione delle ipotesi al monitoraggio degli esperimenti di crescita, in modo che il tuo sistema rimanga utile anche man mano che il tuo lavoro diventa più complesso.

Che cos'è un modello per il monitoraggio degli esperimenti di IA?

Un modello per il monitoraggio degli esperimenti di IA è un framework predefinito che aiuta i team a documentare, organizzare e analizzare gli esperimenti di machine learning. Raccoglie tutto, dai parametri dei modelli alle metriche di performance, in un unico luogo strutturato.

Per i team di data science, gli ingegneri ML e i product manager che conducono esperimenti di crescita, offre un modo sistematico per il monitoraggio di ciò che è stato testato e ciò che ha effettivamente funzionato.

Senza un sistema centralizzato, i team perdono il contesto alla base delle decisioni. Il lavoro si frammenta, con le informazioni sparse tra diversi strumenti, portando a errori ripetuti, perdita di informazioni e passaggi di consegne disorganizzati che rendono gli esperimenti difficili da monitorare o replicare.

Un modello per il monitoraggio degli esperimenti di IA risolve questo problema creando un'unica fonte di verità in cui ogni ipotesi, modifica dei parametri e risultato convivono insieme. Elimina definitivamente la confusione del "quale era quella versione?".

Panoramica dei modelli per il monitoraggio degli esperimenti di IA

| Nome del modello | Link per scaricare | Ideale per | Funzionalità principali | Formato visivo |

| Modello per piano e risultati degli esperimenti di ClickUp | Scarica il modello gratis | ML, prodotto e crescita che conducono esperimenti strutturati con ipotesi e risultati chiari | Campi strutturati per gli esperimenti; pianificazione e monitoraggio centralizzati; visibilità delle tendenze; documentazione collaborativa | Strumento di monitoraggio degli esperimenti basato su elenchi con campi strutturati e flusso di lavoro degli stati |

| Modello di lavagna online per esperimenti di crescita di ClickUp | Scarica il modello gratis | I team di prodotto e crescita fanno brainstorming e stabiliscono le priorità degli esperimenti prima dell'esecuzione | Spazio di ideazione visiva; framework di prioritizzazione ICE; pianificazione drag-and-drop; conversione delle idee in attività | Lavagna online con mappatura visiva e corsie di prioritizzazione |

| Modello di foglio di calcolo di ClickUp | Scarica il modello gratis | Teams che si affidano a flussi di lavoro basati su fogli di calcolo ma necessitano di collaborazione e connessione al contesto | Monitoraggio basato su griglia; collaborazione in tempo reale; filtri e ordinamenti flessibili; righe collegate ad attività/documenti | Vista Tabella (griglia in stile foglio di calcolo) con collaborazione in tempo reale |

| Modello di report analitico di ClickUp | Scarica il modello gratis | I team dedicati ai dati, ai prodotti e al marketing presentano i risultati degli esperimenti agli stakeholder | Reportistica incentrata sui KPI; visualizzazioni integrate; analisi delle tendenze; sezioni di reportistica strutturate | Report in stile dashboard con grafici e sezioni di riepilogo/riassunto |

| Modello per i risultati dell'analisi dei dati di ClickUp | Scarica il modello gratis | Data scientist e analisti che raccolgono approfondimenti esplorativi da diversi set di dati | Hub centralizzato dei risultati; monitoraggio di anomalie e modelli; acquisizione strutturata di informazioni; raccomandazioni di follow-up | Repository di conoscenze basato su elenchi con approfondimenti taggati |

| Modello di rapporto tecnico di ClickUp | Scarica il modello gratis | Ingegneri ML che documentano modifiche all'infrastruttura, implementazioni e benchmark delle prestazioni | Documentazione a livello di sistema; monitoraggio della riproducibilità; contesto ingegneristico collegato; formato di reportistica strutturato | Report in formato documento collegato alle attività e ai flussi di lavoro tecnici |

| Modello di rapporto di ricerca di ClickUp | Scarica il modello gratis | Research teams and ML practitioners publishing structured, reproducible findings | Struttura in stile accademico; dati di ricerca centralizzati; metodologia e conclusioni chiare; supporto per documenti di lunga durata | Documento multipagina con documenti nidificati per resoconti dettagliati |

| Modello di rapporto di valutazione di ClickUp | Scarica il modello gratis | Teams che eseguono test A/B o valutazioni che richiedono criteri chiari di confronto e decisione | Struttura di valutazione strutturata; confronti affiancati; punteggio e monitoraggio personalizzabili | Report strutturato con sezioni di valutazione e campi di punteggio |

| Modello di caso di test di ClickUp | Scarica il modello gratis | I team di ML e QA che testano i modelli in casi limite e variazioni di input | Standardizzazione dei casi di test; monitoraggio della copertura; flusso di lavoro basato sullo stato; monitoraggio dall'individuazione del problema alla risoluzione | Tabella in stile QA con casi di test, stati e campi dei risultati |

| Modello di registro delle conversazioni di ClickUp | Scarica il modello gratis | Teams che lavorano su modelli di linguaggio di grandi dimensioni (LLM), chatbot o flussi di lavoro di prompt engineering | Monitoraggio delle risposte ai prompt; cronologia delle iterazioni; valutazione della qualità delle risposte; registri ricercabili | Tabella in stile registro che raccoglie prompt, output e valutazioni |

Cosa cercare nei modelli per il monitoraggio degli esperimenti di IA

Un buon strumento di monitoraggio degli esperimenti si integra naturalmente nel tuo flusso di lavoro. Dovrebbe aiutarti a lavorare più velocemente, non rallentarti con un carico di lavoro amministrativo aggiuntivo. Hai bisogno di qualcosa di più di un semplice foglio di calcolo con una nuova veste grafica.

Ecco a cosa vale la pena prestare attenzione:

- Campi di metadati strutturati: il tuo modello dovrebbe includere campi dedicati per registrare elementi essenziali quali il tipo di modello, gli iperparametri, la versione del set di dati e l'ambiente di addestramento. Ciò evita il problema dell'inserimento incoerente delle voci, in cui una persona scrive "learning_rate" e un'altra scrive "LR"

- Viste comparative: la possibilità di visualizzare gli esperimenti affiancati è imprescindibile. È così che si individua quella variazione di una variabile che ha effettivamente influito sulle metriche chiave

- Monitoraggio dello stato: È fondamentale che lo stato degli esperimenti sia chiaro e con visibilità, ad esempio pianificato, in corso, completato o archiviato. Ciò impedisce che due membri del team eseguano accidentalmente lo stesso test, sprecando così risorse preziose

- Flessibilità di integrazione: il tuo strumento di monitoraggio degli esperimenti non dovrebbe costringerti ad abbandonare i tuoi strumenti di ML preferiti. Deve funzionare insieme a essi, fungendo da hub centrale che collega tutto

- Funzionalità di collaborazione per il progetto: La sperimentazione è un lavoro di squadra. Il tuo modello ha bisogno di funzionalità come Commenti e Menzioni per mantenere i team interfunzionali, dall'ingegneria al prodotto, allineati su priorità e risultati

- Potenziali di automazione: i modelli migliori riducono il carico di lavoro manuale. Cerca la possibilità di registrare automaticamente i risultati o di triggerare i passaggi successivi in base agli esiti, risparmiando al tuo team il noioso lavoro di copia e incolla

Con ClickUp al tuo fianco per la gestione e il monitoraggio degli esperimenti, puoi finalmente smettere di costringere il tuo flusso di lavoro in una struttura rigida.

Puoi personalizzare i tuoi metadati in base al tuo flusso di lavoro ML specifico con i campi personalizzati di ClickUp, aggiungendo campi per qualsiasi cosa, dalle posizioni alle analisi basate sull'IA. Inoltre, puoi creare una pipeline visiva che rispecchi il ciclo di vita del tuo esperimento utilizzando gli stati personalizzati di ClickUp, in modo che tutti sappiano cosa sta succedendo a colpo d'occhio.

Le automazioni di ClickUp eliminano la necessità di aggiornamenti manuali, facendo avanzare automaticamente gli esperimenti attraverso le fasi man mano che i risultati vengono registrati.

🎥 Dato che stai già sperimentando l'IA, ecco un breve video tutorial su come utilizzare l'IA per lavorare in modo più efficiente:

10 modelli per il monitoraggio degli esperimenti di IA

Abbiamo selezionato un elenco di modelli che vanno oltre la semplice registrazione dei dati. Questi modelli forniscono la struttura necessaria per condurre esperimenti più rapidi e meglio organizzati.

1. Modello per il piano e i risultati degli esperimenti di ClickUp

Stanco di esperimenti che partono da un'idea vaga e finiscono con risultati inconcludenti? Questo modello per piani e risultati degli esperimenti di ClickUp impone disciplina fornendo un framework end-to-end per documentare ipotesi, metodologie e risultati in un'unica vista strutturata. È perfetto per i team di ML che conducono esperimenti controllati e hanno bisogno di una chiara documentazione "prima e dopo" per dimostrare l'impatto del loro lavoro.

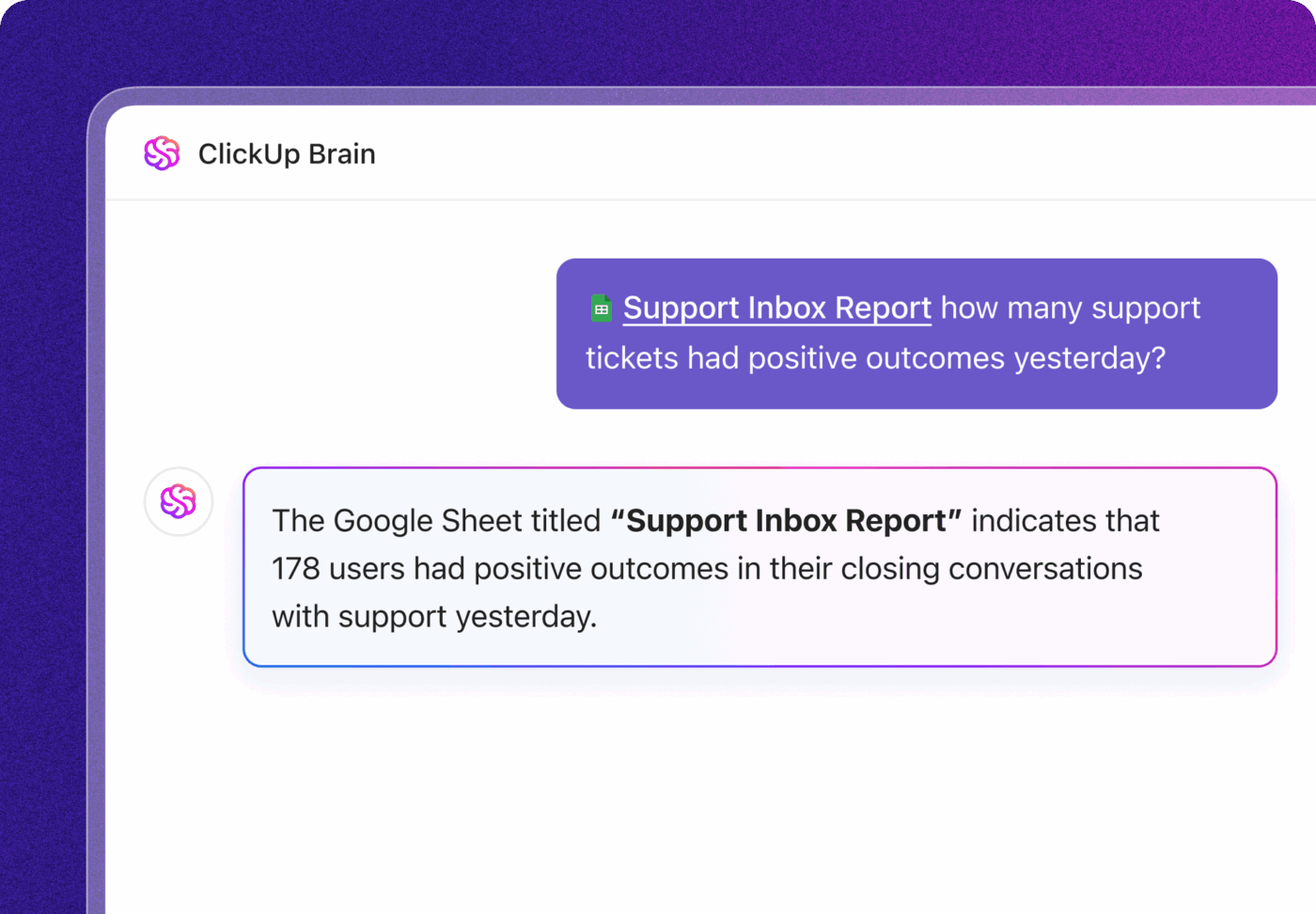

La funzionalità distintiva è rappresentata dalle sezioni predefinite per ipotesi, variabili, criteri di successo e analisi dei risultati. Una volta completato l'esperimento, puoi anche utilizzare ClickUp Brain (l'IA nativa e sensibile al contesto di ClickUp) per riassumere i risultati e generare automaticamente raccomandazioni per i passaggi successivi.

- Campi strutturati per gli esperimenti: sezioni integrate per ipotesi, variabili, metodi e risultati

- Area di lavoro centralizzata: Pianifica, esegui e analizza gli esperimenti in un unico posto senza dover cambiare strumento

- Visibilità delle tendenze: individua i modelli ricorrenti negli esperimenti per prendere decisioni più informate

- Collaborazione in team: condividi i progressi e i risultati con piena visibilità all'interno del tuo team

🔎 Ideale per: team di ML, prodotto e crescita che conducono esperimenti strutturati e necessitano di una documentazione chiara e completa, dall'ipotesi ai risultati.

📮 ClickUp Insight: Sebbene il 35% degli intervistati utilizzi l'IA per attività di base, funzionalità avanzate come l'automazione (12%) e l'ottimizzazione (10%) sembrano ancora fuori dalla portata di molti. La maggior parte dei team si sente bloccata al "livello base dell'IA" perché le loro app gestiscono solo attività superficiali. Uno strumento genera testi, un altro suggerisce l'assegnazione dei compiti, un terzo riepiloga/riassume le note, ma nessuno di essi condivide il contesto o collabora con gli altri. Quando l'IA opera in compartimenti stagni come questo, produce output, ma non risultati. Ecco perché i flussi di lavoro unificati sono importanti. ClickUp Brain cambia questa situazione attingendo alle tue attività, ai tuoi contenuti e al contesto dei tuoi processi, aiutandoti a eseguire automazioni avanzate e flussi di lavoro autonomi senza sforzo, tramite un'intelligenza integrata e intelligente. È un'IA che comprende il tuo lavoro, non solo i tuoi prompt.

2. Modello di lavagna online per esperimenti di crescita di ClickUp

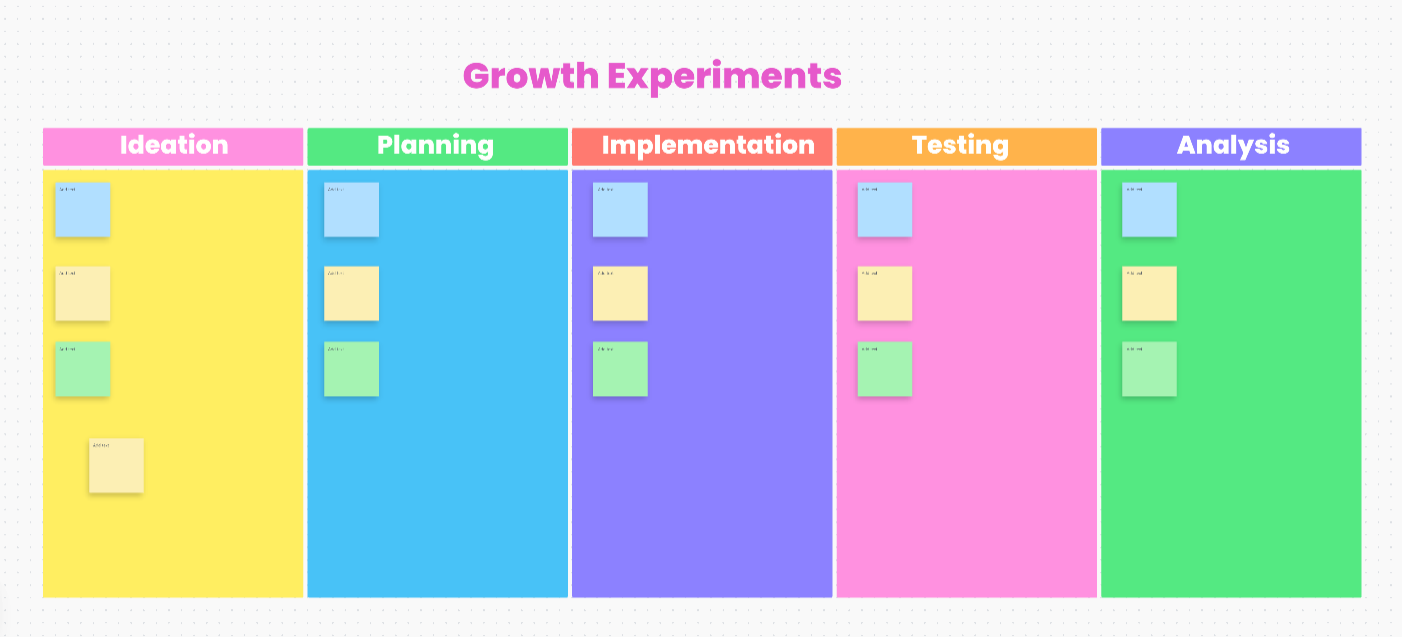

Le idee brillanti per gli esperimenti di crescita spesso finiscono nel dimenticatoio tra le note delle riunioni o nei thread di conversazione casuali. Il modello "Growth Experiments Whiteboard" di ClickUp è stato progettato proprio per evitare che ciò accada.

È uno spazio dedicato al brainstorming, alla definizione delle priorità e alla mappatura delle idee per gli esperimenti di crescita prima ancora di scrivere una sola riga di codice. È l'ideale per i team di prodotto e di crescita che gestiscono cicli di sperimentazione rapidi su più canali.

La funzionalità principale del modello è il framework di prioritizzazione drag-and-drop con punteggio ICE integrato (Impatto, Fiducia, Facilità). Questo aiuta il tuo team a concordare rapidamente quali idee perseguire in seguito sulla base dei dati, non solo delle opinioni.

Inoltre, puoi trasformare le idee emerse dal brainstorming direttamente in attività di ClickUp tracciabili senza perdere il contesto iniziale, grazie alle lavagne online di ClickUp, che costituiscono la base del modello.

- Pianificazione visiva degli esperimenti: mappa le idee di crescita e gli esperimenti su una lavagna online condivisa, in modo che il tuo team possa avere una visione completa del processo, dall'ideazione all'esecuzione

- Priorità integrate: organizza e classifica gli esperimenti in base a impatto, lavoro richiesto e obiettivi per concentrarti su ciò che genera la maggiore crescita

- Visibilità end-to-end: monitora lo stato, documenta gli esperimenti e analizza i risultati in un unico posto senza perdere il contesto

- Flusso di lavoro collaborativo: fai brainstorming, assegna attività e coordina i team in tempo reale grazie a viste condivise e campi personalizzabili

🔎 Ideale per: Team di prodotto e di crescita che necessitano di uno spazio visivo e collaborativo per il brainstorming, la definizione delle priorità e il monitoraggio degli esperimenti di crescita.

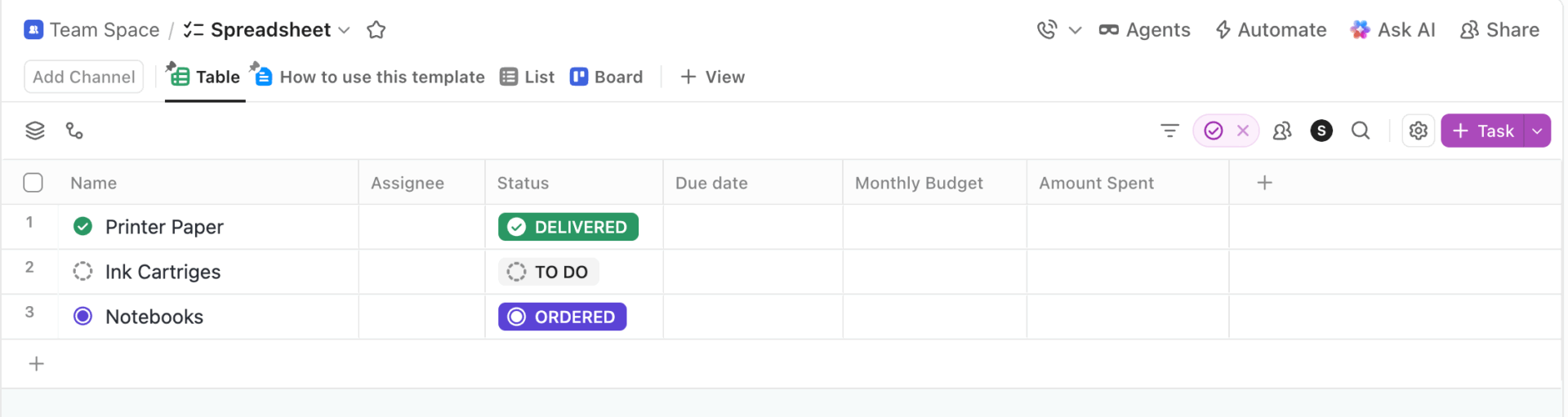

3. Modello di foglio di calcolo di ClickUp

Forse adori i tuoi fogli di calcolo. Soprattutto quelli che sfruttano la potenza analitica di Excel. Il problema, però, è che i tradizionali file Excel sono pessimi per la collaborazione e diventano rapidamente fonte di problemi di controllo delle versioni.

Questo modello di foglio di calcolo di ClickUp ti offre il familiare formato a griglia che ami, ma lo potenzia con moderne funzionalità di collaborazione.

È pensato per gli analisti di dati e i team che preferiscono un flusso di lavoro basato su fogli di calcolo, ma sono stanchi dei limiti dei file offline. Avrai a disposizione il supporto completo per le formule e la formattazione condizionale, ma con la potenza aggiuntiva della modifica in tempo reale e multiutente.

💡 Suggerimento da esperto: ottieni il contesto completo di ogni esperimento collegando le righe del foglio di calcolo direttamente alle attività di ClickUp o ai documenti correlati. Puoi anche individuare automaticamente modelli e approfondimenti inserendo i dati in ClickUp Brain quando sei pronto per l'analisi.

- Flusso di lavoro in stile foglio di calcolo: Lavora in un layout a griglia familiare trasformando ogni riga in un elemento tracciabile e con connessione

- Collaborazione in tempo reale: aggiorna i dati con il tuo team in tempo reale senza dover gestire versioni duplicate

- Visualizzazioni dei dati flessibili: filtra, ordina e personalizza la visualizzazione delle informazioni senza alterare la struttura sottostante

🔎 Ideale per: Teams che utilizzano fogli di calcolo per il monitoraggio di esperimenti o dati, ma necessitano di una migliore collaborazione, visibilità e connessione con i flussi di lavoro effettivi.

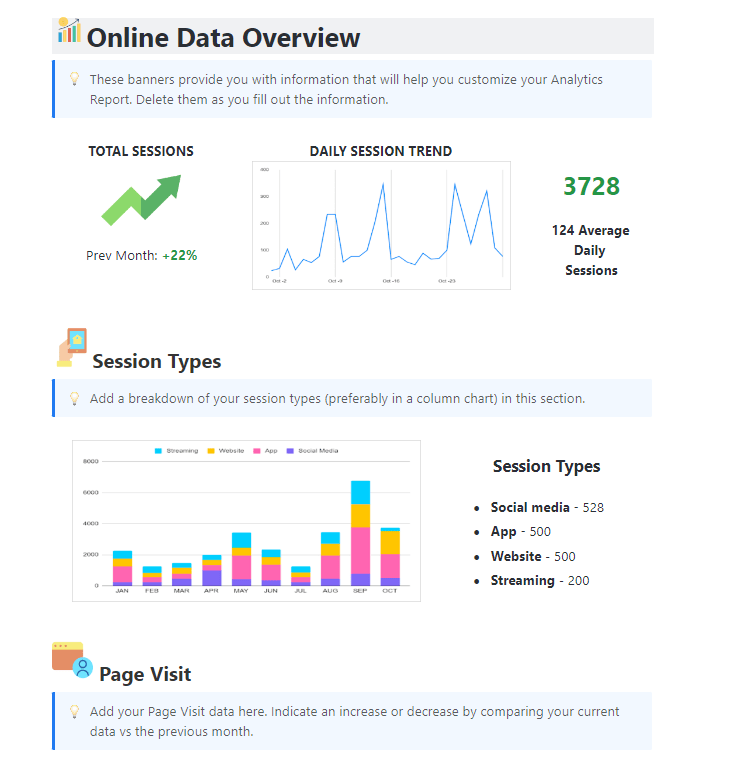

4. Modello di report analitico di ClickUp

Hai condotto un esperimento con esito positivo, ma ora devi spiegarlo alla dirigenza. La condivisione di un notebook Jupyter o di un file di dati grezzi è un modo sicuro per ottenere sguardi perplessi. Questo modello di reportistica analitica di ClickUp offre un formato di reportistica strutturato per presentare le analisi degli esperimenti a stakeholder non tecnici.

Sono dotati di sezioni preformattate per le metriche chiave, segnaposto per le visualizzazioni e un riepilogo esecutivo, così potrai costruire una storia avvincente attorno ai tuoi dati.

Inoltre, il modello è collegato alle dashboard di ClickUp, che possono estrarre dati in tempo reale dai tuoi esperimenti e trasformarli in grafici strutturati come grafici a barre, grafici a torta e grafici lineari, e persino in schede di riepilogo basate sull'IA!

Di conseguenza, i tuoi report rimangono automaticamente aggiornati e gli stakeholder possono visualizzare in tempo reale lo stato dei tuoi progressi.

- Reportistica incentrata sui KPI: monitora e presenta in modo chiaro le metriche chiave di performance, in modo che la dirigenza possa capire cosa funziona e cosa no

- Visualizzazione dei dati integrata: trasforma dati complessi in tabelle e grafici più semplici che rendono le informazioni più facili da comprendere

- Analisi di tendenze e modelli: Identifica le correlazioni e le tendenze delle prestazioni per fornire supporto a un processo decisionale più efficace

- Flusso di lavoro strutturato per la creazione di reportistica: utilizza sezioni predefinite e campi personalizzabili per standardizzare il modo in cui i report vengono creati e condivisi tra i team

🔎 Ideale per: Team che si occupano di dati, prodotti e marketing che hanno bisogno di presentare i risultati degli esperimenti e le informazioni sulle prestazioni in un formato chiaro e di facile comprensione per gli stakeholder.

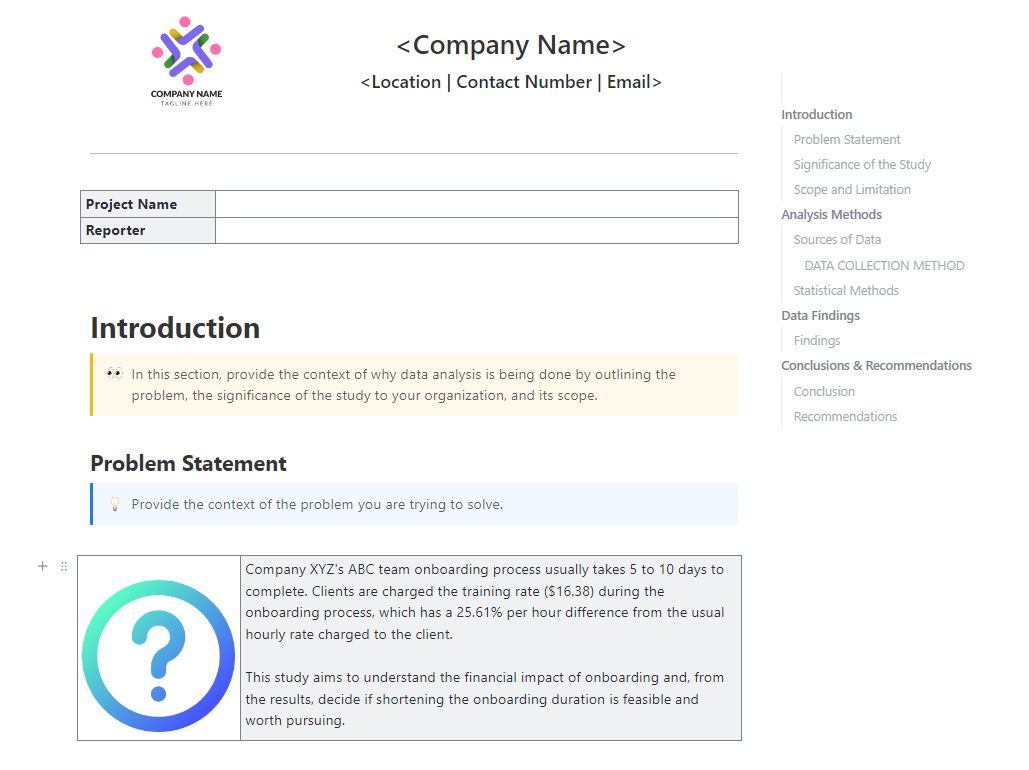

5. Modello per i risultati dell'analisi dei dati di ClickUp

Durante l'analisi esplorativa dei dati che utilizza l'IA, i data scientist spesso individuano intuizioni, anomalie o problemi di qualità dei dati che non appartengono a un esperimento specifico ma sono fondamentali per il lavoro futuro. Il più delle volte, questi risultati vanno persi nei taccuini personali. Il modello "Risultati dell'analisi dei dati " di ClickUp offre un framework di documentazione dedicato per catturare e organizzare quei momenti di illuminazione.

Include sezioni dedicate alle note sulla qualità dei dati, ai segnalatori di anomalie e agli esperimenti di follow-up consigliati, creando una libreria consultabile di conoscenze istituzionali.

E non è tutto: puoi rendere questi dati facilmente reperibili taggandoli con i campi personalizzati di ClickUp.

Ora, quando un membro del tuo team avvia un nuovo progetto, potrà cercare rapidamente i risultati passati relativi al set di dati e non dovrà affrontare gli stessi problemi che hai già risolto.

- Hub centralizzato dei risultati: Raccogli approfondimenti, anomalie e note sui dati provenienti da più origini dati in un unico posto, in modo che nulla vada perso

- Rilevamento di modelli e anomalie: Individua più rapidamente tendenze, correlazioni e valori anomali senza dover setacciare note sparse

- Raccolta strutturata delle informazioni: Utilizza un formato coerente per documentare i risultati, migliorando l'accuratezza e rendendo più facile rivedere le informazioni

- Flusso dall'intuizione all'azione: Trasforma le osservazioni in raccomandazioni e attività di follow-up, in modo che le scoperte portino effettivamente ai passaggi successivi

🔎 Ideale per: Data scientist e analisti che desiderano un metodo strutturato e ricercabile per acquisire intuizioni esplorative e riutilizzarle in progetti futuri.

6. Modello di rapporto tecnico di ClickUp

Quando si sperimentano modifiche all'infrastruttura, implementazioni di modelli o ottimizzazioni delle pipeline, i dettagli tecnici contano, e molto.

Dimenticare di documentare una versione specifica della libreria o una configurazione di sistema può rendere impossibile riprodurre un miglioramento delle prestazioni. Il modello di report tecnico di ClickUp è pensato per gli ingegneri ML che hanno bisogno di catturare quel contesto tecnico approfondito.

Include sezioni dedicate alle specifiche di sistema, ai benchmark delle prestazioni e alle note sul debito tecnico. Con questo modello, puoi smettere di seppellire queste informazioni critiche nei messaggi di commit o in file README sparsi. Conserva tutto il tuo contesto tecnico in un unico posto utilizzando le attività di ClickUp con relazioni per collegare i tuoi report di ingegneria direttamente ai repository di codice o alle attività di distribuzione pertinenti.

- Acquisisci dettagli a livello di sistema: documenta configurazioni, ambienti e benchmark delle prestazioni in un report strutturato

- Supporto per la riproducibilità: tieni traccia in modo chiaro delle dipendenze e delle modifiche, in modo che i risultati possano essere convalidati in un secondo momento

- Mantieni il contesto collegato: collega i report alle attività, alle implementazioni o al codice correlati, in modo che nulla vada perso

- Rendi i report più facili da esaminare: presenta i risultati tecnici in un formato che gli stakeholder possano seguire senza dover scavare nei log

🔎 Ideale per: ingegneri ML e team tecnici che documentano modifiche all'infrastruttura, implementazioni di modelli o miglioramenti delle prestazioni, dove un contesto dettagliato è fondamentale per riferimento futuro.

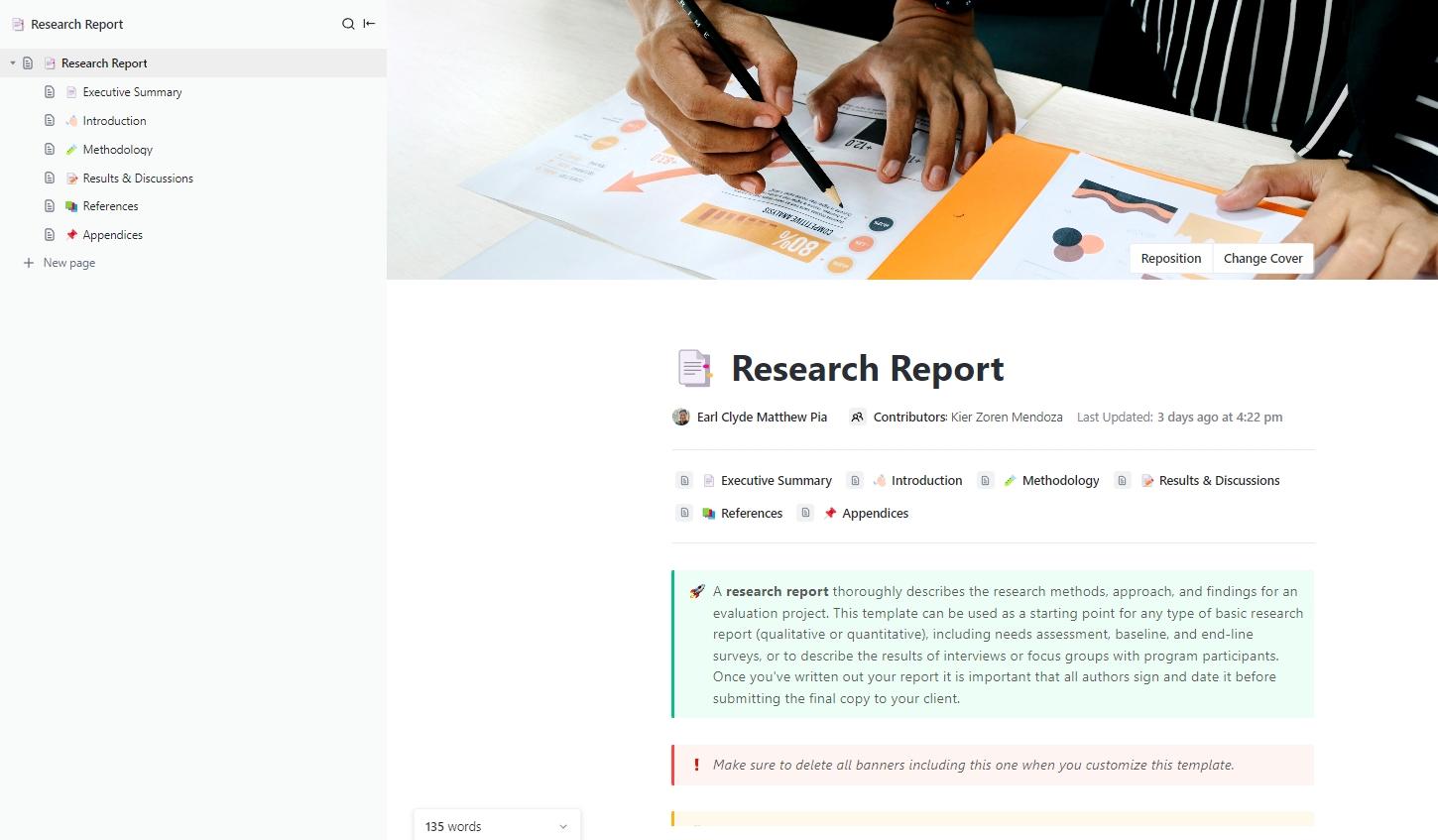

7. Modello di rapporto di ricerca di ClickUp

Per i team di ricerca o i professionisti del ML che devono pubblicare i propri risultati, la riproducibilità è fondamentale. Questo modello di rapporto di ricerca di ClickUp offre una struttura in stile accademico per documentare gli esperimenti di ricerca con il necessario rigore metodologico. Assicura che il tuo lavoro possa essere compreso, convalidato e sviluppato da altri.

Il modello include funzionalità dedicate alla revisione della letteratura, a una descrizione dettagliata della metodologia e a una discussione dei limiti.

💡 Suggerimento da esperto: crea resoconti completi per metodologie approfondite e complesse utilizzando ClickUp Documenti e inserendoli all'interno del modello. In questo modo, potrai creare resoconti di più pagine mantenendo il report principale chiaro e leggibile.

- Struttura di ricerca strutturata: Organizza il tuo rapporto con sezioni chiare dedicate alla metodologia, ai risultati e alle conclusioni, in modo che il tuo lavoro risulti coerente e di facile comprensione

- Dati e approfondimenti centralizzati: raccogli dati di ricerca, note e analisi in un unico posto invece di disperderli tra diversi strumenti

- Progettato per garantire chiarezza e comunicazione: presenta i risultati della ricerca e le raccomandazioni in un formato che gli stakeholder possano comprendere rapidamente

🔎 Ideale per: Teams di ricerca, analisti e professionisti del machine learning che necessitano di un metodo strutturato e collaborativo per documentare e presentare in modo chiaro i risultati di ricerche complesse.

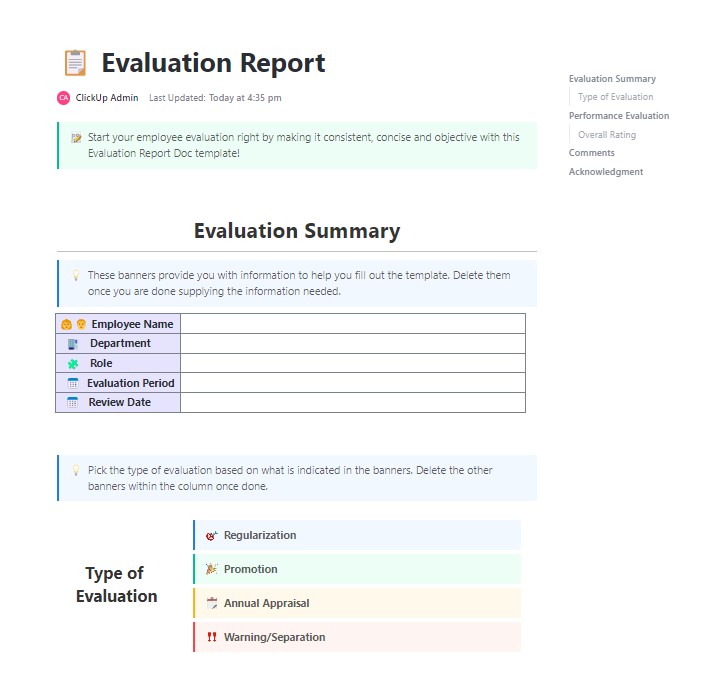

8. Modello di rapporto di valutazione di ClickUp

Eseguire test A/B o valutazioni di modelli senza criteri chiari e oggettivi porta spesso a discussioni sul fatto che un esperimento sia stato davvero un "esito positivo". Questo modello di rapporto di valutazione di ClickUp elimina ogni ambiguità. Avrai a disposizione un formato strutturato per valutare i risultati rispetto a criteri di successo predefiniti. È perfetto per i team che necessitano di una documentazione chiara sui risultati positivi o negativi.

Le sezioni di valutazione integrate ti consentono di valutare gli esperimenti in base a più criteri anziché a un unico parametro. Puoi quindi calcolare automaticamente i punteggi di valutazione in base alle metriche inserite utilizzando i campi formula in ClickUp.

- Struttura di valutazione chiara: suddividi gli esperimenti in sezioni ben definite, in modo che i risultati siano più facili da interpretare e comunicare

- Valutazione comparativa: confronta i risultati di diversi test utilizzando un formato uniforme che riduce la confusione

- Monitoraggio personalizzabile: utilizza i campi personalizzati e le oltre 15 visualizzazioni di ClickUp per adattare il modo in cui misuri e presenti i risultati della valutazione in base ai tuoi criteri

🔎 Ideale per: Teams che conducono esperimenti o valutazioni e hanno bisogno di un metodo chiaro e coerente per documentare i risultati e confrontarli.

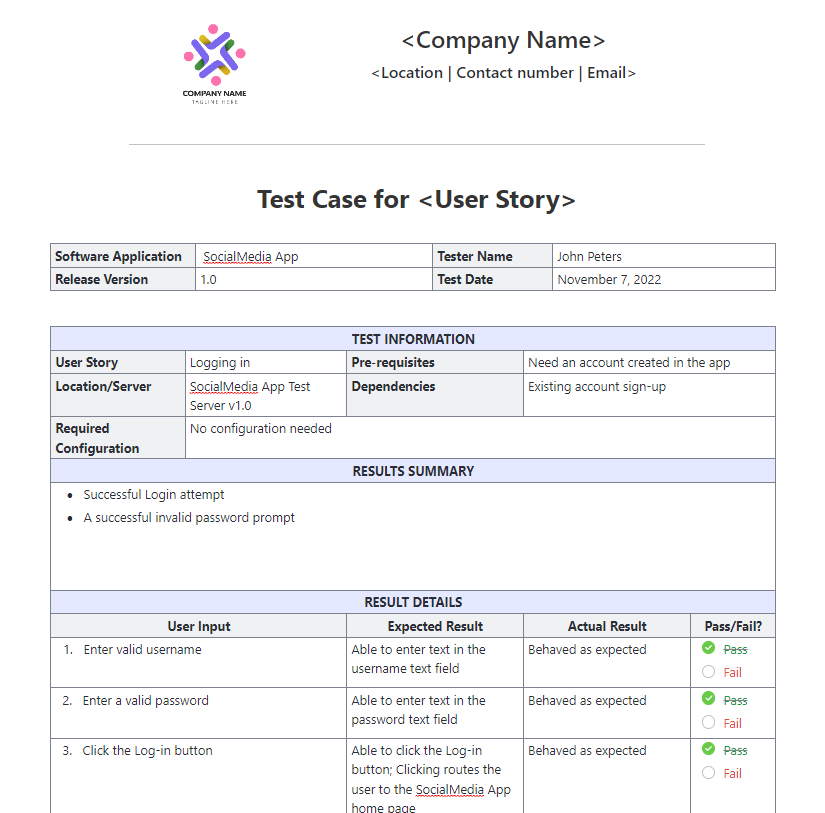

9. Modello di caso di test di ClickUp

I modelli di ML possono fallire in modi strani e inaspettati, specialmente nei casi limite.

Non basta il monitoraggio dell'accuratezza complessiva; è necessario convalidare il comportamento del modello su un ampio intervallo di input specifici. È proprio a questo che serve il modello di caso di test in stile QA di ClickUp.

Offre un formato strutturato con un sistema di identificazione dei casi di test, colonne per i risultati attesi e quelli effettivi e il monitoraggio dello stato. Usalo per ampliare sistematicamente la copertura dei test e identificare specifiche modalità di errore.

💡 Suggerimento da esperto: Chiudi il ciclo tra test e risoluzione utilizzando le Automazioni di ClickUp per segnalare automaticamente i test falliti, creare attività di correzione dei bug e assegnarle al tecnico giusto. Utilizzando trigger e azioni "se-allora", le Automazioni ti consentono di far procedere i passaggi di consegne senza intervento manuale.

🎥 Scopri come i team di ingegneri utilizzano le automazioni di ClickUp:

- Standardizzazione dei casi di test: Utilizza un formato coerente con ID, passaggi e risultati attesi rispetto a quelli effettivi per convalidare il comportamento del modello

- Monitoraggio della copertura: crea e gestisci una libreria di casi di test per non tralasciare gli scenari limite

- Flusso di lavoro basato sullo stato: monitora ogni test come superato, fallito o in corso per mantenere i test organizzati

- Monitoraggio integrato dei problemi: converti i test falliti in attività, in modo che le correzioni vengano assegnate e risolte senza ritardi

🔎 Ideale per: team di ML e QA che testano modelli su diversi input e casi limite e che hanno bisogno di un modo chiaro per effettuare il monitoraggio dei risultati e intervenire rapidamente in caso di errori.

📚 Leggi anche: Capire i test black box, white box e gray box

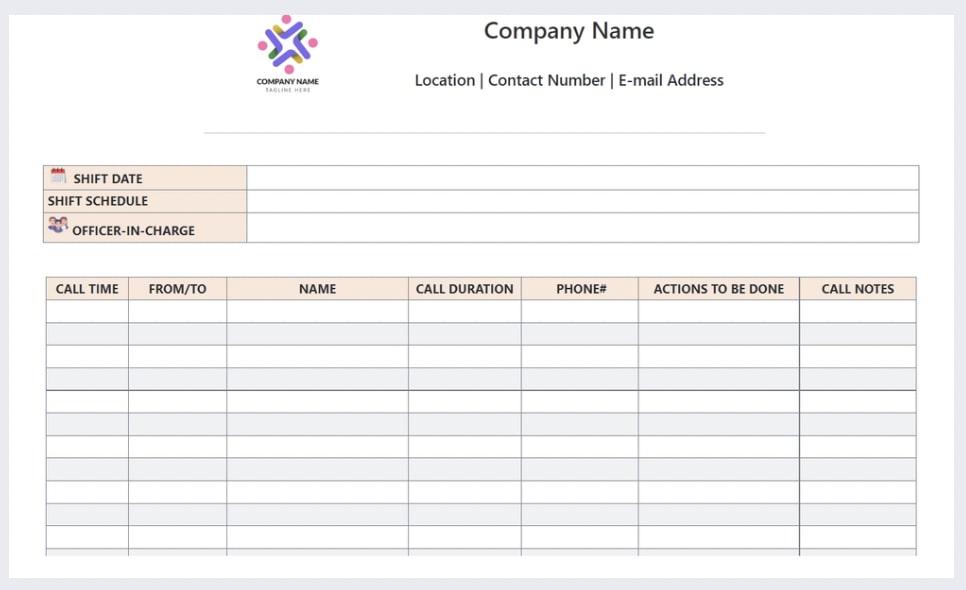

10. Modello di registro delle conversazioni di ClickUp

Messa a punto dell'IA conversazionale o perfezionamento di un prompt per un LLM possono sembrare una forma d'arte. Questo modello di registro delle conversazioni di ClickUp rende il processo scientifico, fornendo un modo strutturato per monitorare le interazioni e i risultati. È progettato per i team che lavorano su chatbot, assistenti virtuali o qualsiasi attività di ingegneria dei prompt.

Include campi per il prompt di input, la risposta del modello, una valutazione della qualità e note sull'iterazione. Questo registro crea una cronologia dettagliata di ciò che funziona e ciò che non funziona.

Perché ti piacerà questo modello:

- Monitoraggio a livello di prompt: registra ogni input e ogni risposta del modello in modo da poter vedere chiaramente cosa determina risultati migliori

- Visibilità delle iterazioni: monitora le modifiche apportate ai prompt e alle risposte per capire cosa migliora le prestazioni nel tempo

- Valutazione della qualità delle risposte: Valuta i risultati in modo coerente per confrontare diverse varianti di prompt e perfezionare i risultati

- Cronologia organizzata degli esperimenti: crea un registro ricercabile delle interazioni in modo che le conoscenze acquisite in passato non vadano perse

🔎 Ideale per: Teams che lavorano su modelli di linguaggio di grandi dimensioni (LLM), chatbot o progetti di prompt engineering e che necessitano di un metodo strutturato per il monitoraggio delle iterazioni dei prompt e per migliorare la qualità delle risposte nel tempo.

Migliori pratiche per il monitoraggio degli esperimenti di IA

Avere ottimi modelli non basta. Se le abitudini del tuo team sono incoerenti, la tua "unica fonte di verità" può trasformarsi rapidamente in un'unica fonte di confusione. 😅

Adotta queste best practice per assicurarti che il tuo sistema di monitoraggio degli esperimenti offra davvero un valore aggiunto:

- Documenta prima di iniziare: l'errore più comune è cercare di ricordare l'ipotesi dopo aver visto i risultati. Registra la tua ipotesi e i criteri per un esito positivo prima di iniziare. Questo impedisce la razionalizzazione a posteriori, che compromette l'integrità dell'esperimento

- Standardizza i tuoi metadati: il tuo team deve concordare una serie di campi obbligatori (come la versione del modello, il set di dati e i parametri chiave) per ogni esperimento. Questo è l'unico modo per garantire che i tuoi esperimenti siano comparabili

- Versioni di tutto: non limitarti a collegarti al "più recente" set di dati o codice. Collegati a versioni specifiche dei set di dati e ai commit del codice. Questo è fondamentale per la riproducibilità degli esperimenti

- Stabilisci criteri chiari per l'interruzione: definisci quando un esperimento è da considerarsi terminato. Ciò impedisce iterazioni infinite su una singola idea senza mai prendere una decisione

- Rivedi regolarmente gli esperimenti: programma una riunione ricorrente settimanale o bisettimanale per esaminare gli esperimenti completati. In questa sede potrai archiviare i test obsoleti, individuare modelli ricorrenti nei risultati e effettuare la condivisione delle conoscenze acquisite con l'intero team

- Collega gli esperimenti alle decisioni: un esperimento senza un risultato è una perdita di tempo. Ogni esperimento completato dovrebbe essere collegato a un'azione concreta successiva, che si tratti di "lanciarlo", "annullarlo" o "eseguire un test di follow-up"

👀 Lo sapevi? Gli studi dimostrano che la condivisione del codice e dei dati aumenta la riproducibilità all'86%, mentre la condivisione solo dei dati la riduce al 33%.

Puoi integrare queste abitudini direttamente nel tuo flusso di lavoro utilizzando ClickUp. Rendi automatiche le abitudini di documentazione utilizzando ClickUp Automazioni per richiedere che i campi personalizzati di ClickUp chiave, come "Ipotesi", vengano compilati prima che lo stato di un esperimento possa essere modificato in "In corso".

Una semplice regola per assicurarti di non avere mai una registrazione di un esperimento priva dell'elemento contestuale più importante.

Monitoraggio degli esperimenti senza il caos del contesto

Un monitoraggio efficace degli esperimenti è la migliore difesa del tuo team contro il lavoro ripetitivo e la perdita di contesto.

Quando standardizzi la tua documentazione, rendi i tuoi esperimenti comparabili, riproducibili e, soprattutto, preziosi. Il modello giusto dovrebbe sempre adattarsi al flusso di lavoro del tuo team, non il contrario.

La dispersione del contesto tra decine di strumenti è ciò che rallenta la velocità degli esperimenti. Raggruppando tutto in un sistema di monitoraggio centralizzato, crei una memoria istituzionale che sopravvive ai cambiamenti del team e aiuta i nuovi membri a mettersi al passo più rapidamente.

I teams che sistematizzano il monitoraggio dei propri esperimenti consolidano le proprie conoscenze, poiché ogni nuovo esperimento si basa su una cronologia documentata di ciò che ha funzionato e di ciò che non ha funzionato.

Trasferisci il monitoraggio dei tuoi esperimenti nell'area di lavoro AI integrata di ClickUp e inizia a costruire su una cronologia documentata di apprendimento. Inizia oggi stesso gratis con ClickUp. ✨

Domande frequenti sui modelli per il monitoraggio degli esperimenti di IA

Qual è la differenza tra un modello per il monitoraggio degli esperimenti di IA e uno strumento di monitoraggio del ML?

Un modello per il monitoraggio degli esperimenti serve a documentare il processo di sviluppo e test di un modello: la parte relativa a "cosa abbiamo provato". Uno strumento di monitoraggio ML serve a effettuare il monitoraggio delle prestazioni di un modello dopo che è stato implementato in un ambiente di produzione live: la parte relativa a "come sta funzionando ora".

Come posso personalizzare un modello ClickUp per il monitoraggio degli esperimenti di machine learning?

Puoi aggiungere i campi personalizzati di ClickUp per acquisire i metadati specifici del tuo team, come iperparametri o versioni dei set di dati. Quindi, crea stati personalizzati che corrispondano al ciclo di vita unico dei tuoi esperimenti e utilizza le automazioni di ClickUp per applicare le regole di documentazione man mano che gli esperimenti avanzano nella tua pipeline.

Posso utilizzare i modelli per il monitoraggio degli esperimenti insieme a strumenti dedicati al machine learning come MLflow o Weights & Biases?

Sì, funzionano alla grande insieme. Usa strumenti di ML dedicati per la registrazione tecnica e poi usa il tuo modello ClickUp come livello centrale di collaborazione e documentazione. Puoi semplicemente collegarti alle tue esecuzioni MLflow o alle dashboard W&B dalla tua attività di esperimento in ClickUp per tenere tutto il contesto tecnico e strategico in un unico posto.

I modelli gratuiti per il monitoraggio degli esperimenti sono adatti ai team di IA delle aziende?

I modelli gratuiti sono un ottimo punto di partenza, ma i team delle aziende spesso necessitano di una governance più avanzata. Ciò include funzionalità quali autorizzazioni granulari per controllare chi può visualizzare o modificare esperimenti specifici e audit trail per effettuare il monitoraggio di tutte le modifiche a fini di conformità, entrambe disponibili in ClickUp.