KI-Voreingenommenheit mag wie ein technisches Problem erscheinen. Ihre Auswirkungen zeigen sich jedoch in der realen Welt und können oft verheerend sein.

Wenn ein KI-System auch nur geringfügig in die falsche Richtung tendiert, kann dies zu unfairen Ergebnissen führen.

Und mit der Zeit können diese kleinen Probleme zu frustrierten Kunden, Reputationsproblemen oder sogar Compliance-Fragen führen, die Sie nicht vorhergesehen haben.

Die meisten Teams haben nicht die Absicht, voreingenommene KI zu entwickeln. Dies geschieht, weil die Daten unübersichtlich sind, die reale Welt ungleichmäßig ist und die von uns verwendeten Tools nicht immer so denken, wie wir es erwarten. Die gute Nachricht ist, dass Sie kein Datenwissenschaftler sein müssen, um zu verstehen, was vor sich geht.

In diesem Blog erklären wir Ihnen, was KI-Voreingenommenheit eigentlich ist, warum sie auftritt und wie sie sich in alltäglichen Business-Tools manifestieren kann.

Was sind KI-Verzerrungen?

KI-Voreingenommenheit liegt vor, wenn ein System künstlicher Intelligenz systematische, unfaire Ergebnisse liefert, die bestimmte Personengruppen konsequent begünstigen oder benachteiligen. Dabei handelt es sich nicht nur um zufällige Fehler, sondern um vorhersehbare Muster, die sich in die Entscheidungsfindung der KI einprägen. Die Ursache? KI lernt aus Daten, die bestehende menschliche Voreingenommenheit, andere unbewusste Vorurteile und gesellschaftliche Ungleichheiten widerspiegeln.

Stellen Sie sich Folgendes vor: Wenn Sie einen Einstellungsalgorithmus mit Unternehmensdaten aus zehn Jahren trainieren, in denen 90 % der Führungskräfte Männer waren, könnte die KI fälschlicherweise lernen, dass das männliche Geschlecht eine wichtige Qualifikation für die Rolle der Führungskraft ist. Die KI handelt dabei nicht böswillig, sondern identifiziert und wiederholt lediglich die Muster, die ihr gezeigt wurden.

Das macht KI-Voreingenommenheit so schwierig:

- Es ist systematisch, nicht zufällig: Die Ungerechtigkeit ist kein einmaliger Fehler, sondern ein wiederkehrendes Muster in den Ergebnissen der KI.

- Oft ist es nicht sichtbar: Verzerrte Ergebnisse können sich hinter der komplexen Mathematik eines scheinbar neutralen Algorithmus verbergen, wodurch sie schwer zu erkennen sind.

- Es basiert auf Daten und Design: Verzerrungen gelangen durch die Entscheidungen, die wir Menschen beim Aufbau und Training von KI treffen, in das System.

⭐ Vorgestellte Vorlage

Die Vorlage für Vorfallberichte von ClickUp bietet eine vorgefertigte Struktur für die Dokumentation, Nachverfolgung und Lösung von Vorfällen von Anfang bis Ende. Erfassen Sie alle relevanten Details zum Vorfall, verwalten Sie klar kategorisierte Status und erfassen Sie wichtige Attribute wie Schweregrad, betroffene Gruppen und Abhilfemaßnahmen. Die Vorlage unterstützt Benutzerdefinierte Felder für Angaben wie „Genehmigt von“, „Vorfallnotizen“ und „Begleitdokumente“, die dabei helfen, während des gesamten Überprüfungsprozesses Verantwortlichkeiten und Nachweise offenzulegen.

📖 Weiterlesen: Wie man eine Risikobewertung durchführt: Tools und Techniken

Warum es wichtig ist, KI-Voreingenommenheit zu mindern

Wenn Ihre KI-Systeme unfair sind, riskieren Sie, das Leben realer Menschen zu schädigen.

Dies wiederum setzt Ihr Unternehmen ernsthaften geschäftlichen Herausforderungen aus und kann sogar das Vertrauen zerstören, das Sie sich mühsam bei Ihren Kunden aufgebaut haben.

Eine voreingenommene KI, die jemandem einen Kredit verweigert, seine Bewerbung ablehnt oder eine falsche Empfehlung ausspricht, hat schwerwiegende Konsequenzen in der realen Welt.

Neue Branchenstandards und Rahmenwerke ermutigen Unternehmen nun dazu, Verzerrungen in ihren KI-Systemen aktiv zu identifizieren und zu beheben. Die Risiken betreffen Ihr Unternehmen aus jeder Perspektive:

- Regulatorisches Risiko: Die Nichteinhaltung neuer KI-Standards kann das Ergebnis erheblicher geschäftlicher Herausforderungen sein.

- Reputationsschaden: Sobald die Öffentlichkeit erfährt, dass Ihre KI voreingenommen ist, ist es unglaublich schwierig, ihr Vertrauen zurückzugewinnen.

- Operative Ineffizienz: Voreingenommene Modelle liefern unzuverlässige Ergebnisse oder KI-Halluzinationen, die zu schlechten Entscheidungen führen und kostspielige Korrekturen erfordern.

- Ethische Verantwortung: Ihr Unternehmen sollte sicherstellen, dass die von Ihnen eingesetzte Technologie alle Benutzer fair behandelt.

Wenn Sie Vorurteile richtig mindern, bauen Sie KI-Systeme auf, auf die sich Menschen tatsächlich verlassen können. Faire KI öffnet Türen zu neuen Märkten, verbessert die Qualität Ihrer Entscheidungen und zeigt allen, dass Sie sich für eine ethische Geschäftstätigkeit engagieren.

📮 ClickUp Insight: 22 % unserer Befragten sind nach wie vor skeptisch, wenn es um den Einsatz von KI am Arbeitsplatz geht. Von diesen 22 % sorgt sich die Hälfte um den Datenschutz, während die andere Hälfte einfach nicht sicher ist, ob sie den Aussagen der KI vertrauen kann.

ClickUp geht beide Probleme direkt an, indem es robuste Maßnahmen zur Sicherheit einsetzt und zu jeder Antwort detaillierte Links zu Aufgaben und Quellen generiert.

Das bedeutet, dass selbst die vorsichtigsten Teams von Steigerungen in der Produktivität profitieren können, ohne sich Gedanken darüber machen zu müssen, ob ihre Informationen geschützt sind oder ob sie zuverlässige Ergebnisse erhalten.

Arten und Ursachen von KI-Voreingenommenheit

Voreingenommenheit kann aus verschiedenen Richtungen in Ihre KI-Systeme eindringen.

Vom Beginn der Datenerfassung bis lange nach der Einführung des Systems bleibt dieses Element relativ stabil. Wenn Sie jedoch wissen, wo Sie suchen müssen, können Sie Ihren Aufwand gezielt einsetzen und müssen nicht mehr endlos gegen unfaire Ergebnisse ankämpfen.

Verzerrung durch Stichproben

Eine Stichprobenverzerrung tritt auf, wenn die Daten, die Sie zum Trainieren Ihrer KI verwenden, die reale Welt, in der die KI eingesetzt wird, nicht genau widerspiegeln.

Als Beispiel können wir angeben, dass wenn Sie ein Spracherkennungssystem entwickeln, das hauptsächlich mit Daten von amerikanischen Englischsprechern trainiert wurde, es natürlich Schwierigkeiten haben wird, Menschen mit schottischem oder indischem Akzent zu verstehen, ähnlich wie LLMs bei der Überprüfung von Lebensläufen in 85,1 % der Fälle Namen bevorzugen, die mit Weißen assoziiert werden. Diese Unterrepräsentation führt zu massiven blinden Flecken, sodass Ihr Modell nicht in der Lage ist, ganze Personengruppen zu bedienen.

Algorithmische Verzerrung

Algorithmische Verzerrungen treten auf, wenn das Design oder der mathematische Prozess des Modells unfaire Muster verstärkt, selbst wenn die Daten neutral erscheinen.

Die Postleitzahl einer Person sollte nicht darüber entscheiden, ob sie einen Kredit erhält. Wenn jedoch die Postleitzahlen in Ihren Trainingsdaten stark mit der ethnischen Zugehörigkeit korrelieren, könnte der Algorithmus lernen, den Standort als Indikator für Diskriminierung zu verwenden.

Dieses Problem verschärft sich noch durch Rückkopplungsschleifen: Wenn eine voreingenommene Vorhersage (z. B. die Ablehnung eines Kreditantrags) als neue Daten in das System zurückgespeist wird, verstärkt sich die Voreingenommenheit mit der Zeit nur noch weiter.

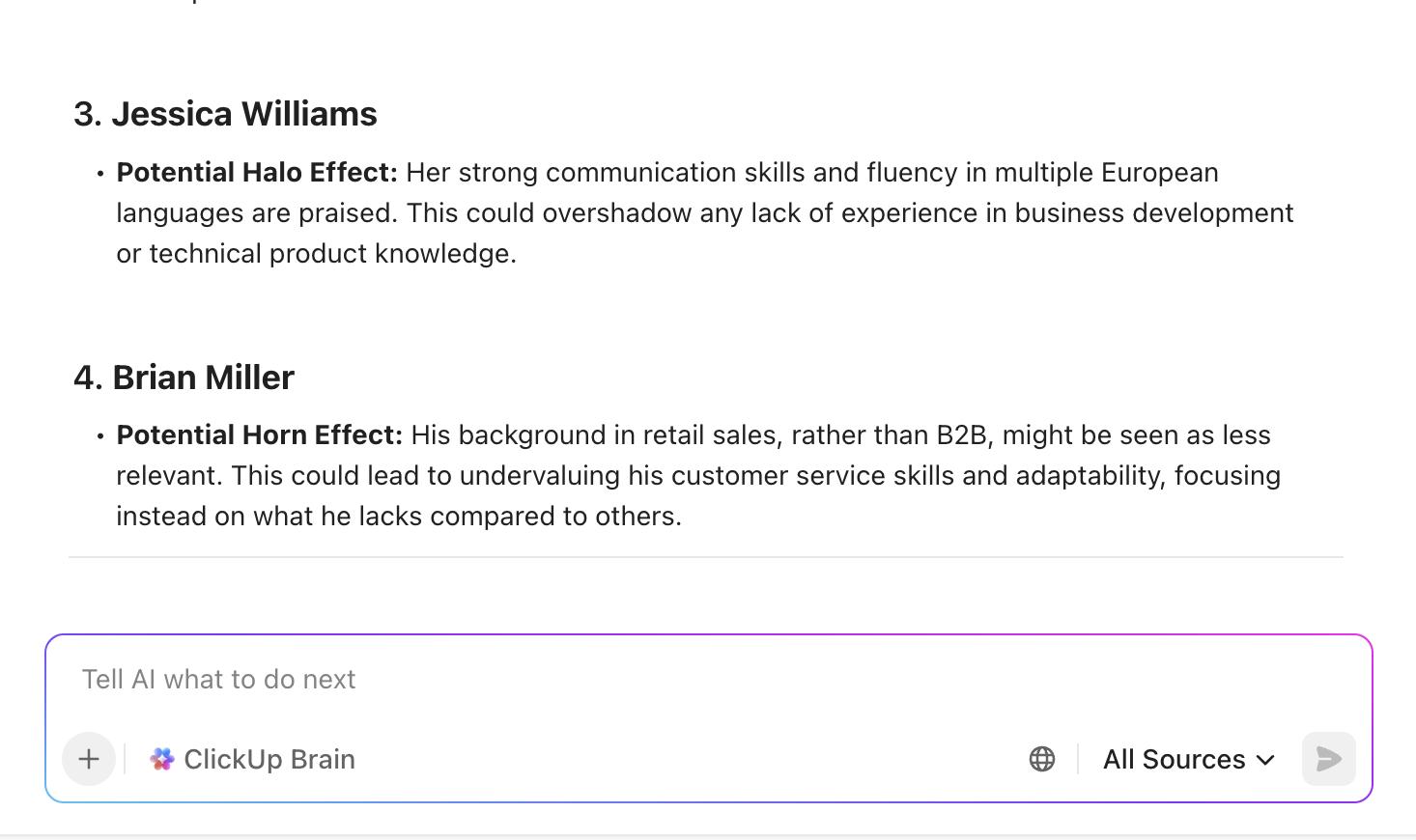

Voreingenommenheit menschlicher Entscheidungen

Jede Entscheidung, die eine Person beim Aufbau eines KI-Systems trifft, kann zu Verzerrungen führen.

Dazu gehört die Entscheidung, welche Daten erfasst werden sollen, wie sie beschrieben werden sollen und wie „Erfolg“ für das Modell definiert wird. Beispielsweise könnte ein Team unbewusst Daten bevorzugen, die seine bereits bestehende Meinung unterstützen (Bestätigungsfehler), oder der ersten Information, die es sieht, zu viel Gewicht beimessen (Verankerungsfehler).

Selbst die wohlmeinendsten Teams können versehentlich ihre eigenen Annahmen und Weltanschauungen in ein KI-System einfließen lassen.

Beispiele für KI-Voreingenommenheit in der realen Welt

Reale Unternehmen mussten erhebliche Konsequenzen hinnehmen, als ihre KI-Systeme Verzerrungen aufwiesen, was sie Millionen an Schäden und den Verlust des Kundenvertrauens kostete. Hier sind einige dokumentierte Beispiele:

1. Voreingenommene Rekrutierungstools

Einer der meistzitierten Fälle betraf ein großes Technologieunternehmen, das ein internes KI-Rekrutierungssystem abschaffte, nachdem es gelernt hatte, männliche Bewerber gegenüber Frauen zu bevorzugen. Das System wurde anhand von Lebensläufen aus einem Jahrzehnt trainiert, in dem die meisten erfolgreichen Bewerber Männer waren. So begann es, Lebensläufe mit Wörtern wie „Frauen” zu benachteiligen und sogar Absolventinnen von Frauenhochschulen herabzustufen.

Dies zeigt, wie Verlaufsdaten, wenn vergangene Muster bestehende Ungleichheiten widerspiegeln, sich in die Automatisierung einschleichen können, wenn sie nicht sorgfältig geprüft werden. Da jedoch die automatisierte Personalbeschaffung mit KI immer mehr Verbreitung findet, wird das Ausmaß des Problems noch größer.

🌼 Wussten Sie schon: Aktuelle Daten zeigen, dass 37 % der Unternehmen mittlerweile Gen-KI-Tools „aktiv integrieren” oder „testen”, um neue Mitarbeiter zu rekrutieren – vor einem Jahr waren es noch 27 %.

2. Gesichtserkennung, die die Hälfte der Population übersieht

Eine von Joy Buolamwini geleitete und in der Studie „Gender Shades” dokumentierte Untersuchung ergab, dass kommerzielle Gesichtserkennungssysteme Fehlerquoten von bis zu 34,7 % bei dunkelhäutigen Frauen aufwiesen, verglichen mit weniger als 1 % bei hellhäutigen Männern.

Auch dies ist ein Spiegelbild unausgewogener Trainingsdatensätze. Verzerrungen in biometrischen tools haben noch weitreichendere Auswirkungen.

Auch Polizei und Behörden hatten Probleme mit voreingenommener Gesichtserkennung. Untersuchungen der Washington Post ergaben , dass einige dieser Systeme Personen aus marginalisierten Gruppen mit viel höherer Wahrscheinlichkeit falsch identifizierten. In mehreren realen Fällen führte dies zu unrechtmäßigen Verhaftungen, öffentlichen Protesten und großen Bedenken hinsichtlich der Auswirkungen dieser tools auf die Rechte der Menschen.

3. Gesundheitsalgorithmen, die die Versorgung zu wenig priorisieren

Auch KI-Systeme im Gesundheitswesen, die vorhersagen sollen, welche Patienten zusätzliche Pflege benötigen, weisen Vorurteile auf.

In einem gut dokumentierten Fall kam es bei einem weit verbreiteten Algorithmus zur Vorhersage im Gesundheitswesen zu einem erheblichen Fehler. Er sollte dabei helfen, zu entscheiden, welche Patienten zusätzliche Pflege erhalten sollten, führte jedoch dazu, dass schwarze Patienten systematisch eine niedrigere Priorität erhielten, selbst wenn sie genauso krank oder kränker waren als weiße Patienten.

Dies geschah, weil das Modell die Gesundheitsausgaben als Indikator für den medizinischen Bedarf heranzog. Da schwarze Patienten aufgrund des ungleichen Zugangs zur Gesundheitsversorgung in der Vergangenheit geringere Gesundheitsausgaben hatten, behandelte der Algorithmus sie als weniger bedürftig. Als Ergebnis wurden die Ressourcen für die Gesundheitsversorgung von denjenigen abgezogen, die sie tatsächlich am dringendsten benötigten. Die Forscher fanden heraus, dass eine einfache Korrektur dieses Indikators den Zugang zu fairen Versorgungsprogrammen erheblich verbessern könnte.

Die Besorgnis über genau diese Probleme hat Bürgerrechtsgruppen dazu veranlasst, auf „Equity-First”-Standards in der KI im Gesundheitswesen zu drängen. Im Dezember 2025 veröffentlichte die NAACP einen detaillierten Entwurf, in dem sie Krankenhäuser, Technologieunternehmen und politische Entscheidungsträger aufforderte, Bias-Audits, transparente Designpraktiken, inklusive Rahmenbedingungen und KI-Governance-Tools einzuführen, um eine Verschärfung der gesundheitlichen Ungleichheiten zwischen den Rassen zu verhindern.

4. Kreditalgorithmen mit ungleichen Ergebnissen

KI und Automatisierung der Entscheidungsfindung prägen nicht nur das, was Sie in den sozialen Medien sehen, sondern beeinflussen auch, wer Zugang zu Geld erhält und zu welchen Bedingungen.

Eines der meistdiskutierten Beispiele aus der Praxis stammt von der Apple Card , einer von Goldman Sachs herausgegebenen digitalen Kreditkarte.

Im Jahr 2019 berichteten Kunden in den sozialen Medien, dass der Kreditlimit-Algorithmus der Karte einigen Männern viel höhere Limits einräumte als ihren Ehefrauen oder Partnerinnen. Dies geschah sogar dann, wenn die Paare ähnliche Finanzprofile angaben. Ein Software-Ingenieur gab an, dass er ein 20-mal höheres Kreditlimit als seine Frau erhalten habe, und sogar Apple-Mitbegründer Steve Wozniak bestätigte eine ähnliche Erfahrung mit seiner Ehefrau.

Diese Muster lösten einen öffentlichen Aufschrei aus und führten zu einer behördlichen Untersuchung durch das New York State Department of Financial Services, ob der Algorithmus Frauen diskriminierte, was deutlich machte, wie automatisierte Finanztools zu ungleichen Ergebnissen führen können.

5. Automatische Untertitel und Spracherkennung, die Stimmen ausschließen

Spracherkennung und automatische Untertitelungssysteme hören oft nicht alle gleichermaßen. Mehrere Studien haben gezeigt, dass diese tools für manche Sprecher besser funktionieren als für andere, abhängig von Faktoren wie Akzent, Dialekt, ethnischer Zugehörigkeit und der Frage, ob Englisch die Muttersprache des Sprechers ist.

Das liegt daran, dass kommerzielle Systeme in der Regel mit Datensätzen trainiert werden, die von bestimmten Sprachmustern dominiert werden – oft westliches Standard-Englisch –, wodurch andere Stimmen unterrepräsentiert sind.

Beispielsweise testeten Forscher in Stanford fünf führende Sprach-zu-Text-Systeme (von Amazon, Google, Microsoft, IBM und Apple) und stellten fest, dass diese bei der Transkription von Sprache fast doppelt so viele Fehler machten, wenn sie von schwarzen Sprechern stammte, im Vergleich zu weißen Sprechern. Das Problem trat sogar auf, wenn die Probanden unter denselben Bedingungen dieselben Wörter sagten.

Wenn Untertitel für bestimmte Sprecher ungenau sind, kann dies zu einer schlechten Benutzererfahrung und Unzugänglichkeit für Menschen führen, die auf Untertitel angewiesen sind. Schlimmer noch, es kann zu voreingenommenen Ergebnissen in Systemen beitragen, die Spracherkennung in den Bereichen Personalbeschaffung, Bildung oder Gesundheitswesen einsetzen.

Jedes dieser Beispiele veranschaulicht eine bestimmte Art und Weise, wie Verzerrungen in automatisierte Systeme eingebettet werden können, sei es durch verzerrte Trainingsdaten, schlecht gewählte Proxys oder nicht repräsentative Tests. In jedem Fall sind die Ergebnisse nicht nur technischer Natur – sie formen Chancen, untergraben Vertrauen und bergen echte geschäftliche und ethische Risiken.

📖 Weiterlesen: Risiken vs. Probleme – Was ist der Unterschied?

Zusammenfassung: Wie KI-Voreingenommenheit auftritt und wem sie schadet

| Wo Vorurteile auftraten | Wer war betroffen? | Auswirkungen in der Praxis |

|---|---|---|

| Rekrutierungsalgorithmen (verworfenes KI-Rekrutierungstool) | Frauen | Lebensläufe wurden aufgrund geschlechtsspezifischer Schlüsselwörter herabgestuft, wodurch der Zugang zu Vorstellungsgesprächen und Stellenangeboten eingeschränkt wurde. |

| Gesichtserkennungssysteme (Gender Shades + Fälle von unrechtmäßigen Verhaftungen) | Dunkelhäutige Frauen; marginalisierte ethnische Gruppen | Weitaus höhere Fehlidentifizierungsraten führten zu ungerechtfertigten Verhaftungen, Rufschädigung und Bedenken hinsichtlich der Bürgerrechte. |

| Algorithmen zur Risikovorhersage im Gesundheitswesen (Studie der University of Chicago) | Schwarze Patienten | Patienten wurden bei der zusätzlichen Versorgung benachteiligt, da die Gesundheitsausgaben als fehlerhafter Indikator für den medizinischen Bedarf herangezogen wurden, was die Ungleichheiten im Gesundheitswesen verschärfte. |

| Limit-Algorithmen (Untersuchung zur Apple Card) | Frauen | Männer erhielten deutlich höhere Limite als gleich qualifizierte weibliche Partner, was sich auf den Zugang zu Finanzmitteln und die Kreditwürdigkeit auswirkte. |

| Spracherkennung und automatische Untertitel (Stanford ASR-Studie) | Sprecher mit nicht standardmäßigen Akzenten; schwarze Sprecher | Fast doppelt so hohe Fehlerquoten führten zu Barrieren bei der Barrierefreiheit, Missverständnissen und voreingenommenen Ergebnissen bei tools, die in den Bereichen Personalbeschaffung, Bildung und täglicher digitaler Zugang eingesetzt werden. |

Strategien zur Verringerung von Verzerrungen, die funktionieren

Es gibt kein Patentrezept, um KI-Voreingenommenheit zu beseitigen.

Eine wirksame Verringerung von Verzerrungen erfordert eine mehrschichtige Verteidigung, die Sie während des gesamten KI-Lebenszyklus anwenden. Durch die Kombination dieser bewährten Strategien können Sie das Risiko unfairer Ergebnisse drastisch reduzieren.

Sammeln Sie vielfältige Trainingsdaten

Repräsentative Daten sind die absolute Grundlage für faire KI.

Ihr Modell kann nicht lernen, Gruppen von Menschen zu bedienen, die es während seiner Ausbildung nie gesehen hat. Beginnen Sie damit, Ihre vorhandenen Datensätze zu überprüfen, um demografische Lücken zu finden. Investieren Sie dann bewusst einen gewissen Aufwand in die Beschaffung neuer Daten aus diesen unterrepräsentierten Populationen.

Wenn Daten aus der realen Welt schwer zu finden sind, können Sie Techniken wie Datenvergrößerung (Erstellung modifizierter Kopien vorhandener Daten) oder die Generierung synthetischer Daten einsetzen, um die Lücken zu füllen.

🚧 Toolkit: Verwenden Sie die Vorlage für die interne Audit-Checkliste von ClickUp, um Ihren Audit-Prozess zu planen.

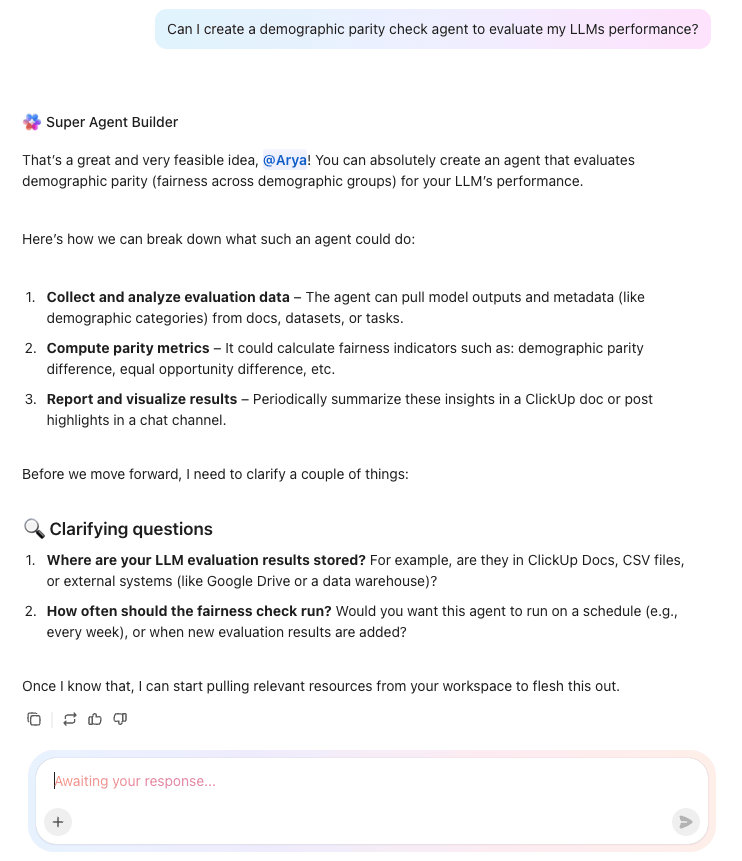

Modelle auf Verzerrungen testen

Sie müssen systematisch auf Verzerrungen testen, um diese zu erkennen, bevor sie tatsächlichen Schaden anrichten. Verwenden Sie Fairness-Metriken, um die Leistung Ihres Modells in verschiedenen Gruppen zu messen.

Beispielsweise überprüft die demografische Parität, ob das Modell für alle Gruppen zu gleichen Quoten ein positives Ergebnis (z. B. eine Kreditgenehmigung) liefert, während die Gleichstellungsprüfung überprüft, ob die Fehlerquoten gleich sind.

Unterteilen Sie die Leistung Ihres Modells nach allen möglichen demografischen Merkmalen – ethnische Zugehörigkeit, Geschlecht, Alter, geografische Lage –, um festzustellen, wo die Genauigkeit nachlässt oder Ungerechtigkeiten auftreten.

Behalten Sie den Menschen im Loop

Automatisierte Systeme können subtile, kontextspezifische Ungerechtigkeiten übersehen, die ein Mensch sofort erkennen würde. Ein Human-in-the-Loop-Ansatz ist entscheidend für Entscheidungen mit hohem Risiko, bei denen eine KI eine Empfehlung aussprechen kann, aber ein Mensch die endgültige Entscheidung trifft.

Dies ist besonders wichtig in Bereichen wie Personalbeschaffung, Kreditvergabe und medizinischer Diagnose. Damit dies funktioniert, müssen Ihre menschlichen Prüfer darin geschult sein, Verzerrungen zu erkennen, und die Befugnis haben, die Vorschläge der KI zu übersteuern.

Wenden Sie Techniken zur algorithmischen Fairness an.

Sie können auch technische Methoden einsetzen, um direkt einzugreifen und Verzerrungen zu reduzieren. Diese Techniken lassen sich in drei Hauptkategorien einteilen:

- Vorverarbeitung: Dabei werden die Trainingsdaten angepasst, bevor das Modell sie sieht, häufig durch Neugewichtung oder erneutes Sampling der Daten, um eine ausgewogenere Darstellung verschiedener Gruppen zu erzielen.

- In-Processing: Hier fügen Sie Fairness-Beschränkungen direkt in den Trainingsprozess des Modells ein und bringen ihm bei, gleichzeitig sowohl die Genauigkeit als auch die Fairness zu optimieren.

- Nachbearbeitung: Dies bedeutet, dass die endgültigen Vorhersagen des Modells nach ihrer Erstellung angepasst werden, um sicherzustellen, dass die Ergebnisse für alle Gruppen gleich sind.

Diese Techniken sind oft mit Kompromissen verbunden, wobei eine leichte Verringerung der Gesamtgenauigkeit erforderlich sein kann, um eine deutliche Verbesserung der Fairness zu erreichen.

💟 Bonus: BrainGPT ist Ihr KI-gestützter Desktop-Begleiter, der KI-Voreingenommenheitstests auf die nächste Stufe hebt, indem er Ihnen Zugriff auf mehrere führende Modelle – darunter GPT-5, Claude, Gemini und mehr – an einem Ort bietet.

Das bedeutet, dass Sie dieselben Eingabeaufforderungen oder Szenarien problemlos für verschiedene Modelle ausführen, deren Schlussfolgerungsfähigkeiten vergleichen und feststellen können, wo die Antworten voneinander abweichen oder Verzerrungen aufweisen. Mit dieser KI-Super-App können Sie außerdem die Sprach-zu-Text-Funktion nutzen, um Testfälle einzurichten, Ihre Ergebnisse zu dokumentieren und die Ergebnisse für eine Gegenüberstellung zu organisieren.

Die fortschrittlichen Tools für logisches Denken und kontextbezogene Analyse helfen Ihnen dabei, Probleme zu beheben, Muster zu erkennen und zu verstehen, wie jedes Modell mit sensiblen Themen umgeht. Durch die Zentralisierung Ihres Workflows und die Ermöglichung transparenter Tests mit mehreren Modellen versetzt Brain MAX Sie in die Lage, KI-Verzerrungen mit Zuversicht und Präzision zu prüfen, zu vergleichen und zu beheben.

Erhöhen Sie die Transparenz und Erklärbarkeit.

Wenn Sie nicht wissen, wie Ihr Modell Entscheidungen trifft, können Sie es nicht korrigieren, wenn es falsch liegt. Mit erklärbaren KI-Techniken (XAI) können Sie einen Blick in die „Black Box“ werfen und sehen, welche Daten-Features die Vorhersagen beeinflussen.

Sie können auch Modellkarten erstellen, die wie Beschreibungen der Nährwerte für Ihre KI sind und deren Verwendungszweck, Leistungsdaten und bekannte Limite dokumentieren.

📮ClickUp Insight: 13 % der Befragten unserer Umfrage möchten KI nutzen, um schwierige Entscheidungen zu treffen und komplexe Probleme zu lösen. Allerdings geben nur 28 % an, KI regelmäßig bei der Arbeit einzusetzen. Ein möglicher Grund: Bedenken hinsichtlich der Sicherheit!

Benutzer möchten möglicherweise keine sensiblen Entscheidungsdaten mit einer externen KI freigeben.

ClickUp löst dieses Problem, indem es KI-gestützte Problemlösungen direkt in Ihren sicheren ClickUp-Workspace bringt. Von SOC 2 bis zu ISO-Standards – ClickUp erfüllt die höchsten Standards der Datensicherheit und hilft Ihnen, generative KI-Technologie sicher in Ihrem gesamten Workspace einzusetzen.

Richtlinien für KI-Governance und Rechenschaftspflicht

Ein starkes KI-Governance-Programm schafft klare Eigentümerschaften und einheitliche Standards, an die sich alle Teammitglieder halten können.

Ihr Unternehmen benötigt klare Governance-Strukturen, um sicherzustellen, dass immer jemand für die ethische Entwicklung und den Einsatz von KI verantwortlich ist.

Hier sind die wesentlichen Elemente eines effektiven KI-Governance-Programms:

| Governance-Element | Was das bedeutet | Schritte für Ihr Unternehmen |

|---|---|---|

| Klare Eigentümerschaft | Spezielle Mitarbeiter oder Teams sind für KI-Ethik, Überwachung und Compliance verantwortlich. | • Ernennen Sie einen KI-Ethikbeauftragten oder einen funktionsübergreifenden Ausschuss. • Definieren Sie Verantwortlichkeiten für Daten, Modellqualität, Compliance und Risiken. • Beziehen Sie Stimmen aus den Bereichen Recht, Technik, Produktentwicklung und DEI in die Aufsicht ein. |

| Dokumentierte Richtlinien | Schriftliche Richtlinien, die festlegen, wie Daten während des gesamten KI-Lebenszyklus erfasst, verwendet und überwacht werden. | • Erstellen Sie interne Richtlinien für die Datenquellen, die Beschreibung, den Datenschutz und die Speicherung. • Dokumentieren Sie Standards für die Modellentwicklung, -validierung und -bereitstellung. • Verlangen Sie von den Teams, dass sie vor der Auslieferung eines KI-Systems Checklisten befolgen. |

| Prüfpfade | Eine transparente Aufzeichnung von Entscheidungen, Versionen von Modellen, Datensätzen und Änderungen | • Implementieren Sie eine Version für Datensätze und Modelle. • Protokollieren Sie wichtige Entscheidungen, Modellparameter und überprüfen Sie die Ergebnisse. • Speichern Sie Prüfpfade in einem zentralen, zugänglichen Repository. |

| Regelmäßige Überprüfungen | Laufende Bewertungen von KI-Systemen zur Überprüfung auf Verzerrungen, Abweichungen und Compliance-Lücken | • Planen Sie vierteljährliche oder halbjährliche Bias-Bewertungen mithilfe einer robusten LLM-Evaluierung. • Trainieren Sie Modelle neu oder kalibrieren Sie sie neu, wenn die Leistung nachlässt oder sich das Verhalten ändert. • Überprüfen Sie Modelle nach größeren Datenaktualisierungen oder Produktänderungen. |

| Plan für die Reaktion auf Incidents | Ein klares Protokoll zur Identifizierung, Berichterstellung und Korrektur von KI-Voreingenommenheit oder -Schäden | • Erstellen Sie einen internen Workflow für die Eskalation von Verzerrungen. • Legen Sie fest, wie Probleme untersucht werden und wer Korrekturen genehmigt. • Skizzieren Sie Kommunikationsschritte für Benutzer, Kunden oder Aufsichtsbehörden, falls erforderlich. |

💡Profi-Tipp: Rahmenwerke wie das NIST AI Risk Management Framework und das EU-KI-Gesetz mit Geldstrafen von bis zu 7 % des Jahresumsatzes können Ihnen als hervorragende Blaupausen für die Entwicklung Ihres eigenen Governance-Programms dienen.

Wie Sie mit ClickUp Vorurteile abbauen können

Der konvergierte KI-Workspace von ClickUp vereint alle beweglichen Teile Ihres KI-Governance-Programms in einem organisierten Workspace.

Ihre Teams können Aufgaben verwalten, Richtlinien speichern, Auditergebnisse überprüfen, Risiken diskutieren und Incidents verfolgen, ohne zwischen verschiedenen tools hin- und herwechseln zu müssen oder den Kontext zu verlieren. Alle Modellaufzeichnungen, Entscheidungsprotokolle und Abhilfemaßnahmenpläne bleiben miteinander verknüpft, sodass Sie immer wissen, wer was warum getan hat.

Und da die KI von ClickUp die Arbeit in Ihrem Workspace versteht, kann sie frühere Bewertungen aufzeigen, lange Berichte zusammenfassen und Ihrem Team helfen, bei sich ändernden Standards auf dem Laufenden zu bleiben. Das Ergebnis ist ein Governance-System, das einfacher zu befolgen, leichter zu prüfen und weitaus zuverlässiger ist, wenn Ihr KI-Fußabdruck wächst.

Lassen Sie uns das als Workflow aufschlüsseln!

Schritt 1: Richten Sie Ihren KI-Governance-Workspace ein

Beginnen Sie damit, in ClickUp einen eigenen Bereich für alle Governance-bezogenen Arbeiten zu erstellen. Fügen Sie Listen für Ihr Modellinventar, Vorurteilsbewertungen, Vorfallberichte, Richtliniendokumente und geplante Überprüfungen hinzu, damit alle Elemente des Programms in einer kontrollierten Umgebung gespeichert sind.

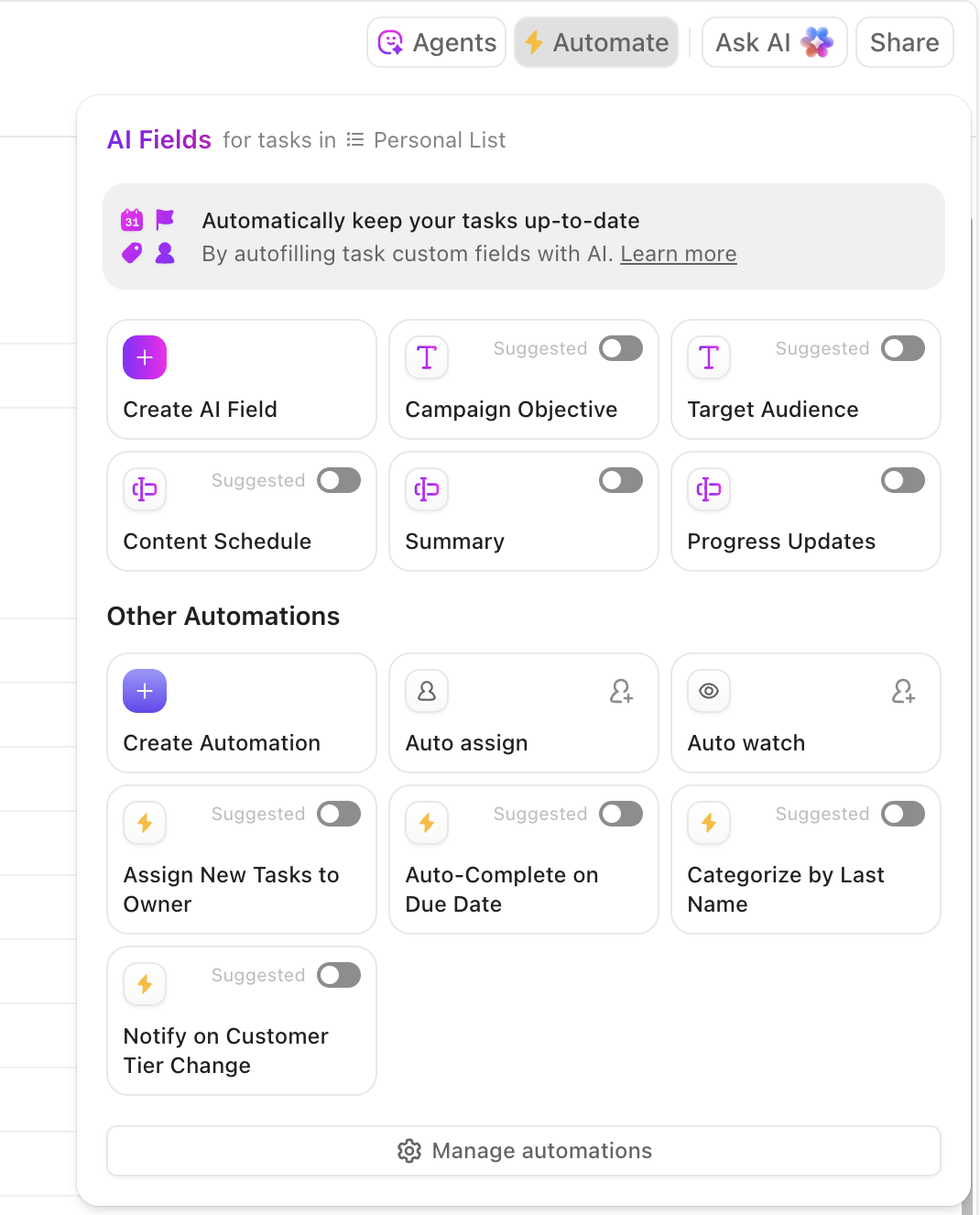

Konfigurieren Sie benutzerdefinierte Felder oder KI-Felder, um Fairness-Metriken, Verzerrungswerte, Modellversionen, Überprüfungsstatus und Risikostufen zu verfolgen. Verwenden Sie rollenbasierte Berechtigungen, um sicherzustellen, dass nur autorisierte Prüfer, Ingenieure und Compliance-Verantwortliche auf sensible KI-Arbeiten zugreifen können. Dies schafft eine strukturelle Grundlage, die Punktwerkzeuge und generische Projektplattformen von Mitbewerbern nicht bieten können.

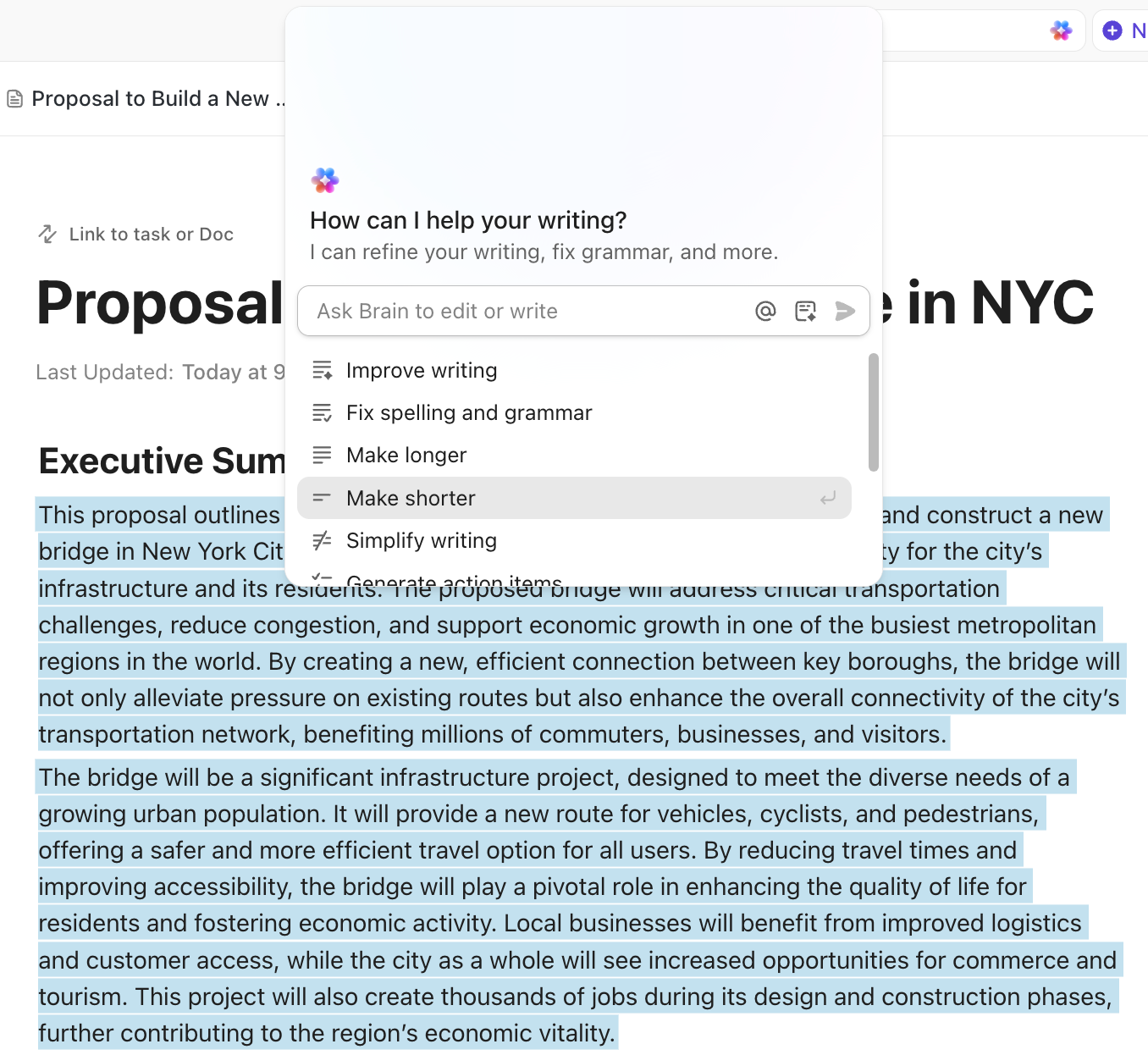

Schritt 2: Erstellen Sie Ihr Governance-Framework

Erstellen Sie anschließend ein ClickUp-Dokument, das als Ihr lebendiges Governance-Handbuch dient. Hier legen Sie Ihre Verfahren zur Bewertung von Verzerrungen, Fairness-Schwellenwerte, Richtlinien für die Modelldokumentation, Schritte zur Einbeziehung menschlicher Kontrolle und Eskalationsprotokolle fest.

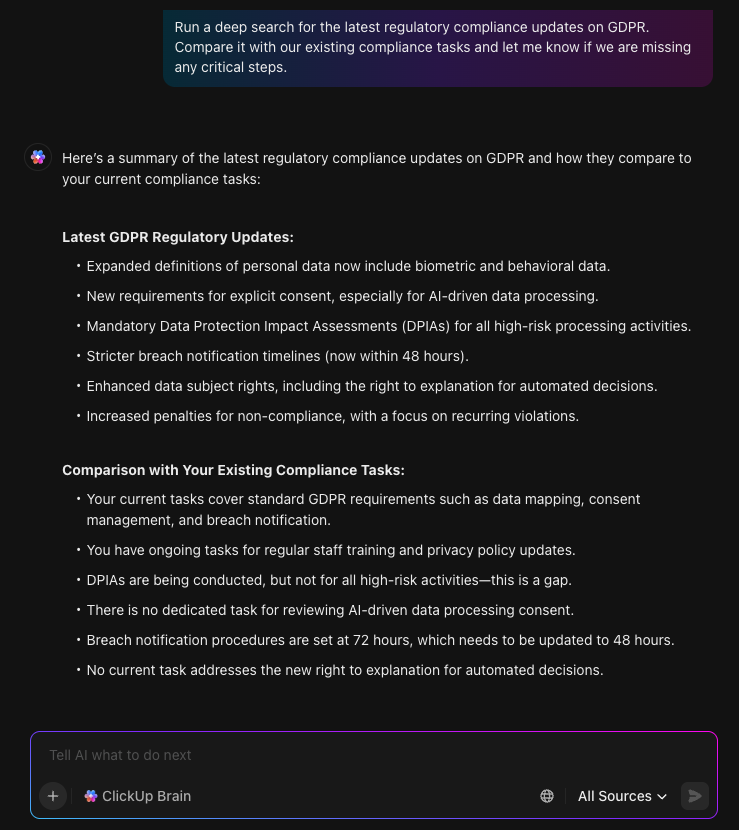

Da Docs mit Aufgaben und Modelldatensätzen verbunden bleiben, können Ihre Teams zusammenarbeiten, ohne den Versionsverlauf zu verlieren oder Dateien über verschiedene Tools zu verstreuen. Als Nächstes kann ClickUp Brain dabei helfen, externe Vorschriften zusammenzufassen, neue Richtlinienformulierungen zu entwerfen oder frühere Prüfungsergebnisse aufzuzeigen, wodurch die Erstellung von Richtlinien konsistenter und nachvollziehbarer wird.

Da das System das Internet durchsuchen, zwischen mehreren KI-Modellen wechseln und Informationen zu klaren Leitlinien zusammenfassen kann, bleibt Ihr Team über neue Standards und Veränderungen in der Branche auf dem Laufenden, ohne den Workspace verlassen zu müssen. Alles, was Sie benötigen – Aktualisierungen von Richtlinien, Einblicke in regulatorische Aspekte und frühere Entscheidungen – finden Sie an einem Ort, wodurch Ihr Governance-System stabiler und wesentlich einfacher zu verwalten ist.

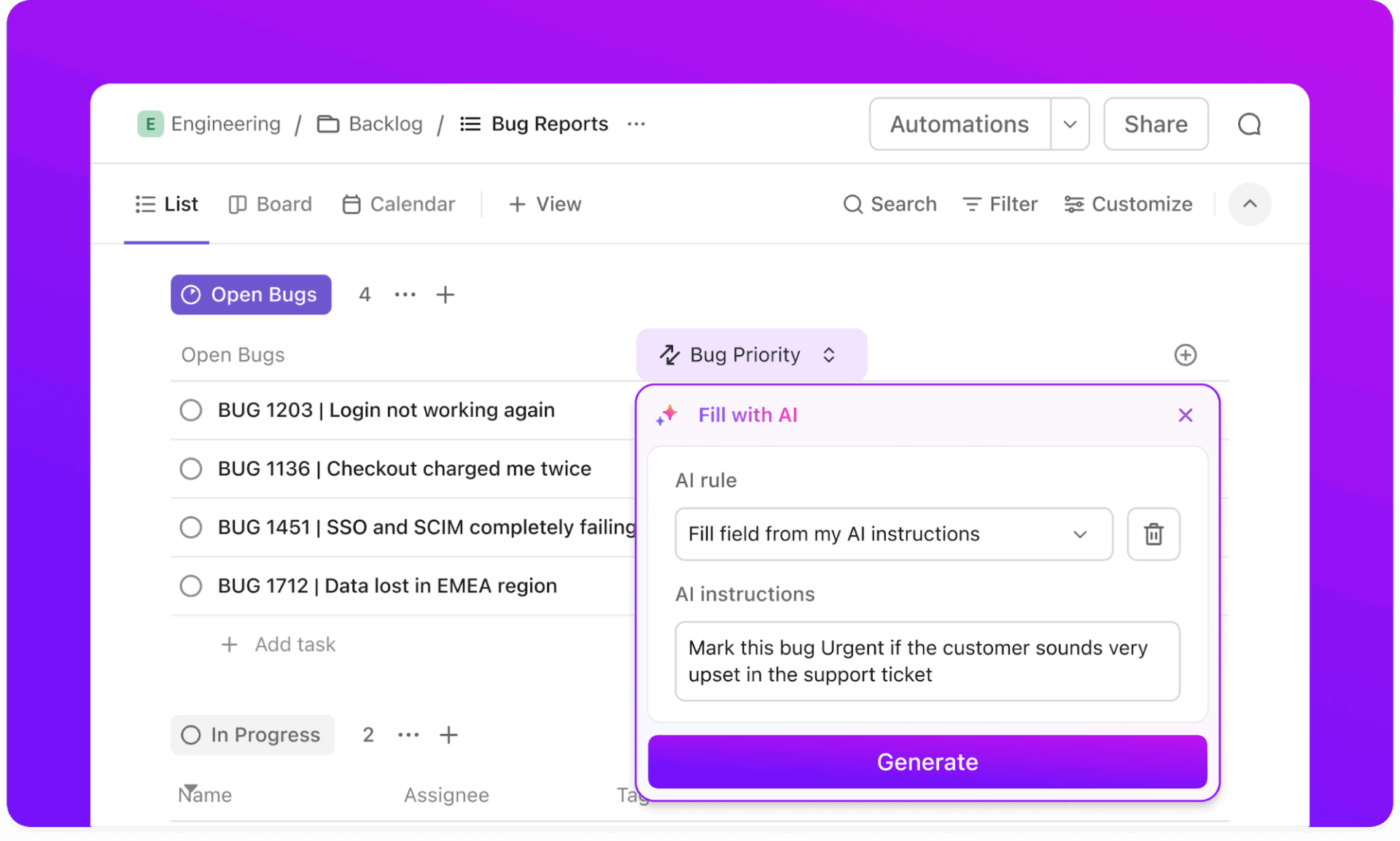

Schritt 3: Registrieren Sie jedes Modell

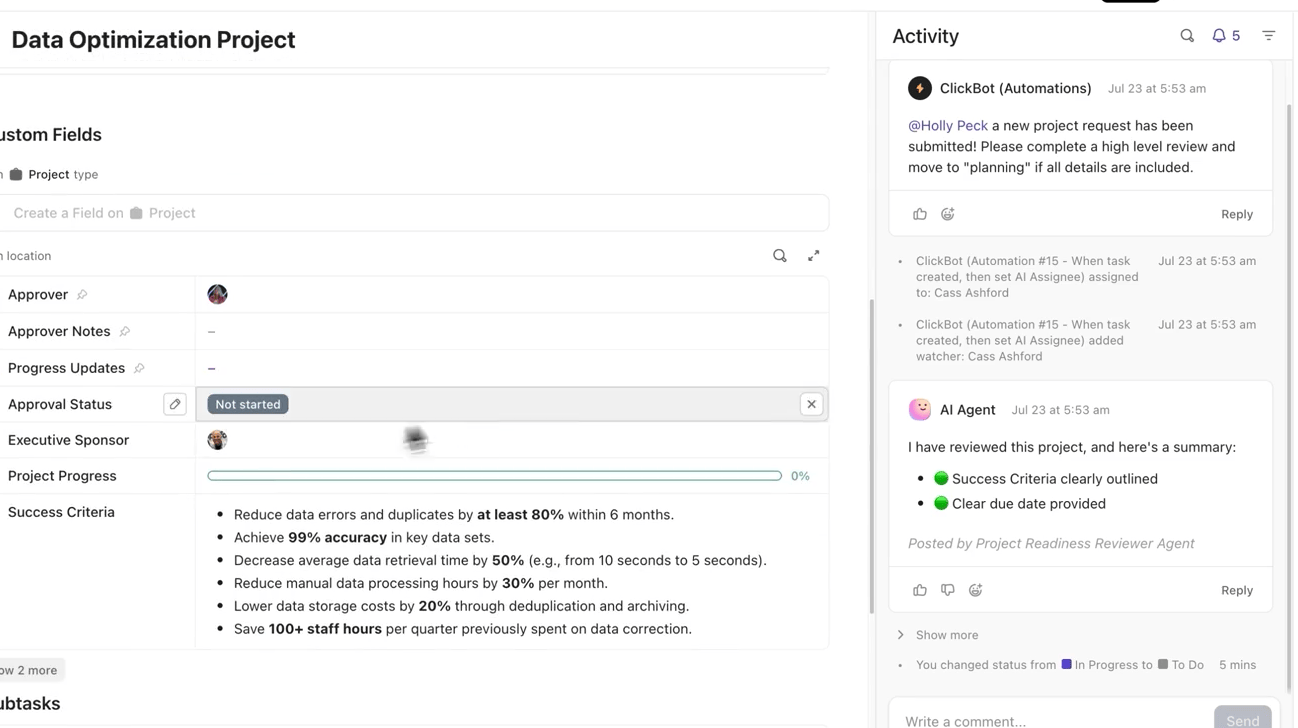

Jedes Modell sollte eine eigene Aufgabe in der Liste „Modellinventar” haben, damit die Eigentümerschaft und Verantwortlichkeiten immer klar sind.

Verfolgen Sie jeden Incident von Voreingenommenheit ganz einfach als umsetzbare Maßnahme, indem Sie ClickUp Aufgaben und ClickUp Benutzerdefinierte Felder verwenden, um Ihre Workflows zur Bewertung von Voreingenommenheit zu strukturieren und jedes wichtige Detail zu erfassen.

Auf diese Weise können Sie die Art der Verzerrung, den Schweregrad, den Status der Behebung, das zuständige Teammitglied und das nächste Überprüfungsdatum verfolgen und so sicherstellen, dass jedes Problem eine klare Eigentümerschaft und eine Frist hat.

Fügen Sie Datensätze, Bewertungszusammenfassungen und Herkunftsnotizen hinzu, damit Alles an einem Ort gespeichert ist. Automatisierungen können dann die Prüfer benachrichtigen, wenn ein Modell in die Phase der Staging- oder Produktionsbereitstellung übergeht.

Schritt 4: Führen Sie geplante und ereignisbasierte Bias-Audits durch

Voreingenommenheitsprüfungen sollten sowohl regelmäßig als auch als Reaktion auf bestimmte Auslöser durchgeführt werden.

Richten Sie über ClickUp Automatisierungen einfache Regeln ein, die automatisch Überprüfungsaufgaben auslösen, sobald ein Modell einen neuen Meilenstein der Bereitstellung erreicht oder eine geplante Prüfung fällig ist. Sie werden nie wieder eine vierteljährliche Bias-Bewertung verpassen, da Automatisierungen die richtigen Prüfer zuweisen, die richtigen Fristen festlegen und sogar Erinnerungen versenden können, wenn das Fälligkeitsdatum näher kommt.

Bei ereignisbasierten Audits erleichtern ClickUp-Formulare das Sammeln von Berichten über Voreingenommenheitsvorfälle oder menschlichem Feedback, während Prüfer mithilfe von benutzerdefinierten Feldern Fairnesslücken, Testergebnisse und Empfehlungen protokollieren können. Jede Formularübermittlung wird als Aufgabe an Ihr Team weitergeleitet, wodurch ein wiederholbarer Audit-Prozess entsteht.

Schritt 5: Vorurteils-Incidents untersuchen und lösen

Wenn ein Vorurteilsproblem identifiziert wird, erstellen Sie eine Incident-Aufgabe, die den Schweregrad, die betroffenen Gruppen, die Version des Modells und die erforderlichen Abhilfearbeiten erfasst. KI-Agenten können risikoreiche Ergebnisse an Compliance-Verantwortliche eskalieren und die richtigen Prüfer und Ingenieure zuweisen.

Jede Maßnahme zur Minderung, jedes Ergebnis des Tests und jeder Validierungsschritt bleibt mit dem Incident-Protokoll verknüpft. ClickUp Brain kann Zusammenfassungen für die Führungskräfte erstellen oder Ihnen bei der Vorbereitung von Notizen für Ihre Governance-Dokumentation helfen, sodass alles transparent und nachvollziehbar bleibt.

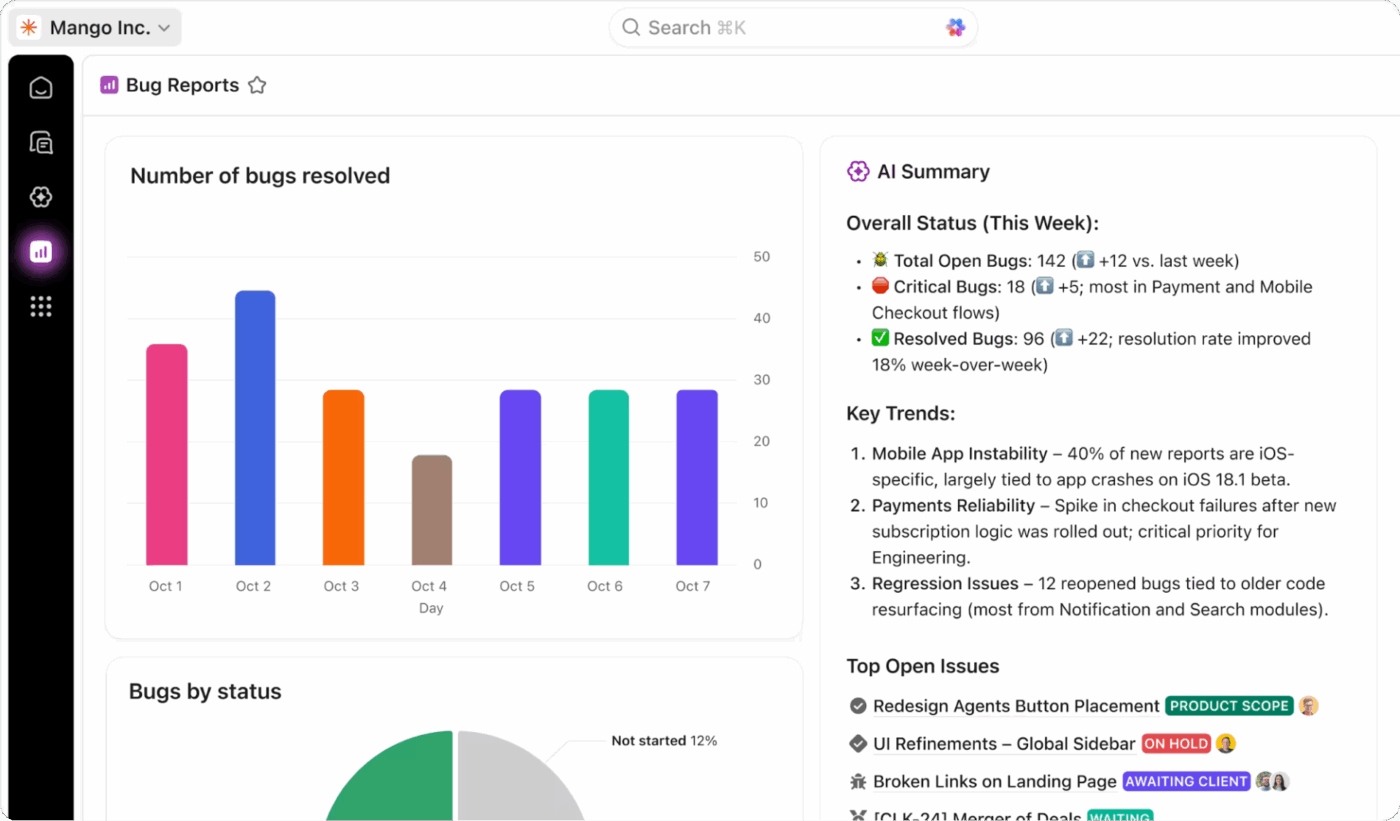

Schritt 6: Überwachen Sie den Zustand Ihres KI-Governance-Programms

Erstellen Sie schließlich Dashboards, die Führungskräften eine Echtzeit-Ansicht über Ihr Programm zur Verringerung von Verzerrungen bieten.

Fügen Sie Panels hinzu, die offene Incidents, die Zeit bis zur Lösung, die Abschlussrate von Audits, Fairness-Metriken und den Compliance-Status aller aktiven Modelle anzeigen. Die no-code Dashboards in ClickUp können automatisch Daten abrufen und Aufgaben im Laufe der Arbeit aktualisieren, wobei KI-Zusammenfassungen in Ihre Dashboard-Ansicht integriert sind.

Voreingenommenheitsprüfungen nach der Bereitstellung

Ihre Arbeit ist nicht erledigt, wenn das KI-Modell live geht.

Tatsächlich beginnt hier der eigentliche Test. Modelle können im Laufe der Zeit „driften” und neue Verzerrungen entwickeln, wenn sich die realen Daten, die sie sehen, zu verändern beginnen. Kontinuierliche Überwachung ist die einzige Möglichkeit, diese aufkommenden Verzerrungen zu erkennen, bevor sie weitreichenden Schaden anrichten.

Ihre fortlaufende Überwachung sollte Folgendes umfassen:

| Praxis | Was es gewährleistet |

|---|---|

| Nachverfolgung der Leistung nach Gruppen | Misst kontinuierlich die Genauigkeit und Fairness des Modells über verschiedene demografische Segmente hinweg, sodass Ungleichheiten frühzeitig erkannt werden. |

| Erkennung von Datenabweichungen | Überwacht Änderungen in den Eingabedaten, die im Laufe der Zeit neue Verzerrungen verursachen oder die Modellleistung beeinträchtigen könnten. |

| Benutzer-Feedback-Schleifen | Bietet klare Kanäle für Benutzer, um voreingenommene oder falsche Ergebnisse zu melden, wodurch die Überwachung in der Praxis verbessert wird. |

| Geplante Audits | Gewährleistet vierteljährliche oder halbjährliche eingehende Analysen des Modellverhaltens, der Fairness-Metriken und der Compliance-Anforderungen. |

| Reaktion auf Incidents | Definiert einen strukturierten Prozess zur Untersuchung, Korrektur und Dokumentation aller gemeldeten Voreingenommenheits-Ereignisse. |

💟 Bonus: Insbesondere generative KI-Systeme erfordern besondere Wachsamkeit, da ihre Ergebnisse weitaus weniger vorhersehbar sind als bei herkömmlichen Modellen des maschinellen Lernens. Eine hervorragende Technik hierfür ist das Red-Teaming, bei dem ein spezielles Team aktiv versucht, voreingenommene oder schädliche Reaktionen des Modells zu provozieren, um dessen Schwachstellen zu identifizieren.

Das Projekt „Lighthouse“ von Airbnb ist beispielsweise ein hervorragendes Beispiel aus der Branche, in der ein Unternehmen eine systematische Überwachung von Verzerrungen nach der Bereitstellung implementiert.

Es handelt sich um eine Forschungsinitiative, die untersucht, wie sich die wahrgenommene ethnische Zugehörigkeit auf Buchungsergebnisse auswirken kann, und dem Unternehmen dabei hilft, Diskriminierung auf der Plattform zu erkennen und zu reduzieren. Sie verwendet datenschutzsichere Methoden, arbeitet mit Bürgerrechtsgruppen zusammen und setzt die Ergebnisse in Produkt- und Richtlinienänderungen um, sodass mehr Gäste die Plattform ohne unsichtbare Hindernisse nutzen können.

KI-Voreingenommenheit mit ClickUp mindern

Der Aufbau einer fairen, verantwortungsvollen KI ist eine Verpflichtung für das gesamte Unternehmen.

Wenn Ihre Richtlinien, Mitarbeiter, Prozesse und Tools harmonisch zusammenwirken, schaffen Sie ein Governance-System, das sich an neue Risiken anpassen, schnell auf Incidents reagieren und das Vertrauen der Menschen gewinnen kann, die sich auf Ihre Produkte verlassen.

Mit strukturierten Überprüfungen, klarer Dokumentation und einem wiederholbaren Workflow für den Umgang mit Verzerrungen bleiben Teams aufeinander abgestimmt und verantwortungsbewusst, anstatt in Krisensituationen zu reagieren.

Indem Sie alles in ClickUp zentralisieren, von Modellaufzeichnungen über Auditergebnisse bis hin zu Incident-Berichten, schaffen Sie eine einzige operative Ebene, auf der Entscheidungen transparent sind, Verantwortlichkeiten klar sind und Verbesserungen nie untergehen.

Eine starke Governance bremst Innovationen nicht, sondern stabilisiert sie. Sind Sie bereit, Vorurteilsminderung in Ihre KI-Workflows zu integrieren? Starten Sie kostenlos mit ClickUp und beginnen Sie noch heute mit dem Aufbau Ihres KI-Governance-Programms.

Häufig gestellte Fragen

Ein guter erster Schritt ist die Durchführung einer Bias-Prüfung Ihrer bestehenden KI-Systeme. Diese Basisbewertung zeigt Ihnen, wo derzeit Ungerechtigkeiten bestehen, und hilft Ihnen, den Aufwand für die Minderung dieser Ungerechtigkeiten zu priorisieren.

Teams verwenden spezifische Fairness-Metriken wie demografische Parität, ausgeglichene Chancen und unterschiedliche Auswirkungsquoten, um Verzerrungen zu quantifizieren. Die richtige Metrik hängt von Ihrem spezifischen Anwendungsfall und der Art von Fairness ab, die in diesem Zusammenhang am wichtigsten ist.

Bei Entscheidungen mit hohen Risiken, die das Leben oder die Chancen einer Person erheblich beeinflussen, wie beispielsweise bei Einstellungen, Kreditvergaben oder im Gesundheitswesen, sollten Sie immer einen menschlichen Überprüfung-Schritt einbauen. Es ist auch ratsam, dies während der frühen Einführung eines neuen Modells zu tun, wenn dessen Verhalten noch unvorhersehbar ist.

Da generative KI einen nahezu unendlichen Bereich an unvorhersehbaren Antworten produzieren kann, reicht es nicht aus, nur die Genauigkeit zu überprüfen. Sie müssen aktive Testverfahren wie Red-Teaming und groß angelegte Output-Sampling-Verfahren einsetzen, um herauszufinden, ob das Modell unter verschiedenen Bedingungen voreingenommene Inhalte produziert.