AI-bias lijkt misschien een technisch probleem. Maar de effecten ervan zijn wel degelijk merkbaar in de echte wereld en kunnen vaak verwoestend zijn.

Wanneer een AI-systeem zelfs maar een klein beetje de verkeerde kant op neigt, kan dit leiden tot oneerlijke resultaten.

En na verloop van tijd kunnen die kleine problemen leiden tot gefrustreerde klanten, reputatieproblemen of zelfs compliancekwesties die u niet had zien aankomen.

De meeste teams zijn niet van plan om bevooroordeelde AI te bouwen. Het gebeurt omdat de gegevens rommelig zijn, de echte wereld ongelijk is en de tools die we gebruiken niet altijd denken zoals we verwachten. Het goede nieuws is dat u geen datawetenschapper hoeft te zijn om te begrijpen wat er aan de hand is.

In deze blog leggen we uit wat AI-bias precies is, waarom het voorkomt en hoe het zich kan manifesteren in alledaagse zakelijke tools.

Wat is AI-bias?

AI-vooringenomenheid doet zich voor wanneer een kunstmatig intelligentiesysteem systematische, oneerlijke resultaten produceert die bepaalde groepen mensen consequent bevoordelen of benadelen. Dit zijn geen willekeurige fouten, maar voorspelbare patronen die verankerd zijn in de manier waarop de AI beslissingen neemt. De oorzaak? AI leert van gegevens die bestaande menselijke vooringenomenheid, andere onbewuste vooroordelen en maatschappelijke ongelijkheden weerspiegelen.

Bekijk het als volgt: als u een wervingsalgoritme traint op basis van tien jaar bedrijfsgegevens waarin 90% van de managers mannen waren, kan de AI ten onrechte leren dat mannelijkheid een belangrijke kwalificatie is voor de rol van manager. De AI is niet kwaadwillig; hij identificeert en herhaalt gewoon de patronen die hem zijn getoond.

Dit is wat AI-vooringenomenheid zo lastig maakt:

- Het is systematisch, niet willekeurig: de oneerlijkheid is geen eenmalige storing, maar een herhaalbaar patroon in de output van de AI.

- Het is vaak onzichtbaar: vooringenomen resultaten kunnen schuilgaan achter de complexe wiskunde van een ogenschijnlijk neutraal algoritme, waardoor ze moeilijk te herkennen zijn.

- Het is geworteld in data en ontwerp: vooringenomenheid komt in het systeem terecht door de keuzes die wij mensen maken wanneer we AI bouwen en trainen.

⭐ Aanbevolen sjabloon

Het Incident Response Sjabloon van ClickUp biedt een kant-en-klare structuur voor het documenteren, bijhouden en oplossen van incidenten van begin tot eind. Leg alle relevante incidentdetails vast, houd duidelijk gecategoriseerde statussen bij en leg belangrijke kenmerken vast, zoals ernst, getroffen groepen en herstelstappen. Het ondersteunt aangepaste velden voor zaken als Goedgekeurd door, Incidentaantekeningen en Ondersteunende documenten, die helpen om verantwoordelijkheid en bewijs tijdens het beoordelingsproces aan het licht te brengen.

Waarom het verminderen van AI-vooringenomenheid belangrijk is

Wanneer uw AI-systemen oneerlijk zijn, loopt u het risico het leven van echte mensen te schaden.

Dit stelt uw organisatie op zijn beurt bloot aan ernstige zakelijke uitdagingen en kan zelfs het vertrouwen dat u met veel moeite bij uw klanten hebt opgebouwd, tenietdoen.

Een bevooroordeelde AI die iemand een lening weigert, zijn sollicitatie afwijst of een onjuiste aanbeveling doet, heeft ernstige gevolgen in de praktijk.

Opkomende industrienormen en kaders moedigen organisaties nu aan om vooringenomenheid in hun AI-systemen actief te identificeren en aan te pakken. De risico's raken uw organisatie vanuit alle hoeken:

- Regelgevingsrisico: Het niet voldoen aan nieuwe AI-normen kan het resultaat zijn van aanzienlijke zakelijke uitdagingen.

- Reputatieschade: zodra het publiek ontdekt dat uw AI vooringenomen is, is het ontzettend moeilijk om hun vertrouwen terug te winnen.

- Operationele inefficiëntie: Bevooroordeelde modellen leveren onbetrouwbare resultaten of AI-hallucinaties op die leiden tot slechte beslissingen en dure oplossingen vereisen.

- Ethische verantwoordelijkheid: uw organisatie moet ervoor zorgen dat de technologie die u implementeert alle gebruikers eerlijk behandelt.

Als je vooringenomenheid op de juiste manier vermindert, bouw je AI-systemen waarop mensen echt kunnen vertrouwen. Eerlijke AI opent deuren naar nieuwe markten, verbetert de kwaliteit van je beslissingen en laat iedereen zien dat je je inzet voor ethisch ondernemen.

📮 ClickUp Insight: 22% van onze respondenten is nog steeds op hun hoede als het gaat om het gebruik van AI op het werk. Van die 22% maakt de helft zich zorgen over de privacy van hun gegevens, terwijl de andere helft gewoon niet zeker weet of ze kunnen vertrouwen op wat AI hen vertelt.

ClickUp pakt beide problemen frontaal aan met robuuste maatregelen voor veiligheid en door bij elk antwoord gedetailleerde links naar taken en bronnen te genereren.

Dit betekent dat zelfs de meest voorzichtige teams kunnen profiteren van de verhoging van de productiviteit zonder zich zorgen te hoeven maken over de bescherming van hun informatie of de betrouwbaarheid van de resultaten.

Soorten en bronnen van AI-vooringenomenheid

Vooringenomenheid kan vanuit meerdere richtingen in uw AI-systemen binnensluipen.

Vanaf het moment dat u begint met het verzamelen van gegevens tot lang nadat het systeem is geïmplementeerd, blijft dit element enigszins stabiel. Maar als u weet waar u moet zoeken, kunt u uw inspanningen gericht targeten en een einde maken aan een eindeloos spel van whack-a-mole met oneerlijke resultaten.

Bias in steekproeven

Steekproefvertekening treedt op wanneer de gegevens die u gebruikt om uw AI te trainen, niet nauwkeurig de echte wereld weergeven waarin de AI zal worden gebruikt.

Als u bijvoorbeeld een spraakherkenningssysteem bouwt dat voornamelijk is getraind op gegevens van Amerikaanse Engelstaligen, zal het natuurlijk moeite hebben om mensen met een Schots of Indiaas accent te begrijpen, net zoals LLM's in 85,1% van de gevallen de voorkeur geven aan namen die met blanken worden geassocieerd bij het screenen van cv's. Deze ondervertegenwoordiging zorgt voor enorme blinde vlekken, waardoor uw model niet geschikt is voor hele groepen mensen.

Algoritmische vooringenomenheid

Algoritmische vooringenomenheid treedt op wanneer het ontwerp of het wiskundige proces van het model oneerlijke patronen versterkt, zelfs als de gegevens neutraal lijken.

De postcode van een persoon zou niet bepalend moeten zijn voor het al dan niet toekennen van een lening, maar als postcodes in uw trainingsgegevens sterk gecorreleerd zijn met ras, kan het algoritme leren om locatie te gebruiken als een proxy voor discriminatie.

Dit probleem wordt nog erger door feedbackloops: wanneer een bevooroordeelde voorspelling (zoals het weigeren van een lening) als nieuwe gegevens terugkoppelen naar het systeem, wordt de vooringenomenheid in de loop van de tijd alleen maar groter.

Vooringenomenheid bij menselijke beslissingen

Elke keuze die iemand maakt bij het bouwen van een AI-systeem kan vooringenomenheid introduceren.

Dit omvat onder meer beslissen welke gegevens moeten worden verzameld, hoe deze moeten worden gelabeld en hoe 'succes' voor het model moet worden gedefinieerd. Een team kan bijvoorbeeld onbewust de voorkeur geven aan gegevens die hun bestaande overtuigingen ondersteunen (bevestigingsbias) of te veel gewicht toekennen aan de eerste informatie die ze zien (verankeringsbias).

Zelfs de meest goedbedoelende teams kunnen per ongeluk hun eigen aannames en wereldbeeld in een AI-systeem coderen.

Voorbeelden van AI-vooringenomenheid in de praktijk

Echte bedrijven hebben te maken gehad met grote gevolgen toen hun AI-systemen vooringenomenheid vertoonden, wat hen miljoenen aan schade en verloren klantvertrouwen heeft gekost. Hier zijn een paar gedocumenteerde voorbeelden:

1. Bevooroordeelde wervingsinstrumenten

Een van de meest geciteerde gevallen betrof een groot technologiebedrijf dat een intern AI-wervingssysteem schrapte nadat het had geleerd mannelijke kandidaten te verkiezen boven vrouwen. Het systeem was getraind op basis van tien jaar aan cv's, waarbij de meeste succesvolle sollicitanten mannen waren. Daardoor begon het cv's met woorden als "vrouwen" te benadelen en zelfs afgestudeerden van vrouwencolleges lager te beoordelen.

Dit laat zien hoe historische gegevensbias, wanneer patronen uit het verleden bestaande ongelijkheid weerspiegelen, in automatisering kan sluipen, tenzij deze zorgvuldig wordt gecontroleerd. Maar naarmate geautomatiseerde werving met AI steeds gangbaarder wordt, wordt de omvang van het probleem nog groter.

🌼 Wist u dat: Uit recente gegevens blijkt dat 37% van de organisaties nu "actief integreert" of "experimenteert" met Gen AI-tools bij het werven van personeel, tegenover 27% een jaar geleden.

2. Gezichtsherkenning die de helft van de populatie mist

Onderzoek onder leiding van Joy Buolamwini en gedocumenteerd in de studie Gender Shades onthulde dat commerciële gezichtsherkenningssystemen een foutpercentage tot 34,7% hadden voor vrouwen met een donkere huidskleur, vergeleken met minder dan 1% voor mannen met een lichte huidskleur.

Ook dit is een weerspiegeling van onevenwichtige trainingsdatasets. Vooringenomenheid in biometrische tools heeft nog verdergaande gevolgen.

Ook politie en overheidsinstanties hebben te maken gehad met problemen met bevooroordeelde gezichtsherkenning. Uit onderzoek van The Washington Post bleek dat sommige van deze systemen veel vaker mensen uit gemarginaliseerde groepen verkeerd identificeerden. In verschillende praktijkgevallen leidde dit tot onterechte arrestaties, publieke verontwaardiging en grote bezorgdheid over de gevolgen van deze tools voor de rechten van mensen.

3. Gezondheidsalgoritmen die zorg onderprioriteren

AI-systemen in de gezondheidszorg die zijn ontworpen om te voorspellen welke patiënten extra zorg nodig hebben, vertonen ook vooringenomenheid.

In een goed gedocumenteerd geval liep een veelgebruikt voorspellingsalgoritme voor de gezondheidszorg tegen een aanzienlijke fout aan. Het algoritme moest helpen beslissen welke patiënten extra zorg moesten krijgen, maar gaf uiteindelijk systematisch minder prioriteit aan zwarte patiënten, zelfs als zij even ziek of zieker waren dan blanke patiënten.

Dat gebeurde omdat het model uitgaven voor gezondheidszorg als maatstaf voor medische behoefte gebruikte. Omdat zwarte patiënten historisch gezien lagere uitgaven voor gezondheidszorg hadden vanwege ongelijke toegang tot zorg, behandelde het algoritme hen als minder behoeftig. Als gevolg daarvan werden zorgmiddelen weggehaald bij degenen die ze eigenlijk het hardst nodig hadden. Onderzoekers ontdekten dat het simpelweg corrigeren van deze maatstaf het resultaat had dat de toegang tot eerlijke zorgprogramma's aanzienlijk werd verbeterd.

Bezorgdheid over deze problemen heeft ertoe geleid dat burgerrechtenorganisaties aandringen op "equity-first"-normen in AI voor de gezondheidszorg. In december 2025 publiceerde de NAACP een gedetailleerd plan waarin ziekenhuizen, technologiebedrijven en beleidsmakers worden opgeroepen om vooringenomenheidsaudits, transparante ontwerppraktijken, inclusieve kaders en AI-governance-tools in te voeren om verdere vergroting van raciale ongelijkheden op gezondheidsgebied te voorkomen.

4. Kredietalgoritmen met ongelijke resultaten

AI en automatisering van besluitvorming vormen niet alleen de vorm van wat u op sociale media te zien krijgt, maar beïnvloeden ook wie toegang krijgt tot geld en onder welke voorwaarden.

Een van de meest besproken praktijkvoorbeelden kwam van de Apple Card , een digitale creditkaart uitgegeven door Goldman Sachs.

In 2019 deelden klanten op sociale media dat het kredietlimietalgoritme van de kaart sommige mannen veel hogere limieten gaf dan hun vrouwen of vrouwelijke partners. Dit gebeurde zelfs wanneer de koppels vergelijkbare financiële profielen rapporteerden. Een software-ingenieur zei dat hij een kredietlimiet kreeg dat 20 keer hoger was dan dat van zijn vrouw, en zelfs Apple-medeoprichter Steve Wozniak bevestigde een soortgelijke ervaring met zijn echtgenote.

Deze patronen leidden tot publieke verontwaardiging en een onderzoek door het New York State Department of Financial Services naar de vraag of het algoritme vrouwen discrimineerde, waarmee werd benadrukt hoe automatisering financiële tools tot ongelijke resultaten kan leiden.

5. Geautomatiseerde ondertiteling en spraakherkenning die stemmen uitsluiten

Spraakherkenning en automatische ondertitelingssystemen horen vaak niet iedereen even goed. Meerdere onderzoeken hebben aangetoond dat deze tools voor sommige sprekers beter werken dan voor andere, afhankelijk van factoren zoals accent, dialect, ras en of Engels de moedertaal van de spreker is.

Dat komt omdat commerciële systemen meestal worden getraind op datasets die worden gedomineerd door bepaalde spraakpatronen – vaak westers, standaard Engels – waardoor andere stemmen ondervertegenwoordigd zijn.

Onderzoekers van Stanford hebben bijvoorbeeld vijf toonaangevende spraak-naar-tekstsystemen (van Amazon, Google, Microsoft, IBM en Apple) getest en ontdekten dat ze bijna twee keer zoveel fouten maakten bij het transcriberen van spraak van zwarte sprekers in vergelijking met blanke sprekers . Dit probleem deed zich zelfs voor wanneer proefpersonen onder dezelfde voorwaarden dezelfde woorden uitspraken.

Wanneer ondertitels voor bepaalde sprekers onnauwkeurig zijn, kan dit leiden tot een slechte gebruikerservaring en ontoegankelijkheid voor mensen die afhankelijk zijn van ondertitels. Erger nog, het kan bijdragen aan vooringenomen resultaten in instellingen die spraakherkenning gebruiken bij werving, onderwijs of gezondheidszorg.

Elk van deze voorbeelden illustreert een specifieke manier waarop vooringenomenheid in geautomatiseerde systemen kan worden ingebed, door middel van vertekende trainingsgegevens, slecht gekozen proxies of niet-representatieve tests. In alle gevallen zijn de resultaten niet alleen technisch van aard: ze vormen kansen, ondermijnen vertrouwen en brengen reële zakelijke en ethische risico's met zich mee.

📖 Lees meer: Risico's versus problemen – wat is het verschil?

Samenvatting: Hoe AI-vooringenomenheid zich manifesteert en wie erdoor wordt benadeeld

| Waar vooringenomenheid optrad | Wie werd hierdoor getroffen? | Impact in de praktijk |

|---|---|---|

| Wervingsalgoritmen (afgeschafte AI-wervingstool) | Vrouwen | Cv's werden op basis van gendergerelateerde trefwoorden lager beoordeeld, waardoor de toegang tot sollicitatiegesprekken en vacatures werd beperkt. |

| Gezichtsherkenningssystemen (Gender Shades + gevallen van onterechte arrestaties) | Donkere vrouwen; gemarginaliseerde raciale groepen | Veel hogere percentages verkeerde identificaties leidden tot onterechte arrestaties, reputatieschade en bezorgdheid over burgerrechten. |

| Algoritmen voor risicovoorspelling in de gezondheidszorg (onderzoek van de Universiteit van Chicago) | Zwarte patiënten | Patiënten kregen minder prioriteit voor extra zorg omdat de uitgaven voor gezondheidszorg werden gebruikt als een gebrekkige maatstaf voor medische behoeften, waardoor de ongelijkheid op gezondheidsgebied toenam. |

| Kredietlimietalgoritmen (onderzoek naar Apple Card) | Vrouwen | Mannen kregen aanzienlijk hogere limieten voor krediet dan vrouwelijke partners met dezelfde kwalificaties, wat van invloed was op hun financiële toegang en leencapaciteit. |

| Spraakherkenning en automatische ondertiteling (Stanford ASR-onderzoek) | Sprekers met een niet-standaard accent; zwarte sprekers | Bijna dubbele foutpercentages zorgden voor toegankelijkheidsbarrières, miscommunicatie en bevooroordeelde resultaten in tools die worden gebruikt bij werving, onderwijs en dagelijkse digitale toegang. |

Strategieën voor het verminderen van vooringenomenheid die werken

Er is geen wondermiddel om AI-vooringenomenheid te elimineren.

Effectieve beperking van vooringenomenheid vereist een meerlaagse verdediging die u gedurende de gehele levenscyclus van AI toepast. Door deze beproefde strategieën te combineren, kunt u het risico op oneerlijke resultaten drastisch verminderen.

Verzamel diverse trainingsgegevens

Representatieve gegevens vormen de absolute basis voor eerlijke AI.

Uw model kan niet leren om groepen mensen te bedienen die het tijdens de training nooit heeft gezien. Begin met het controleren van uw bestaande datasets om eventuele demografische hiaten op te sporen. Probeer vervolgens bewust nieuwe gegevens te verzamelen van die ondervertegenwoordigde populaties.

Wanneer het moeilijk is om gegevens uit de echte wereld te vinden, kunt u technieken zoals data-augmentatie (het maken van gewijzigde kopieën van bestaande gegevens) of het genereren van synthetische gegevens gebruiken om de hiaten op te vullen.

🚧 Toolkit: Gebruik de sjabloon voor interne auditchecklists van ClickUp om uw auditproces in kaart te brengen.

Test modellen op vooringenomenheid

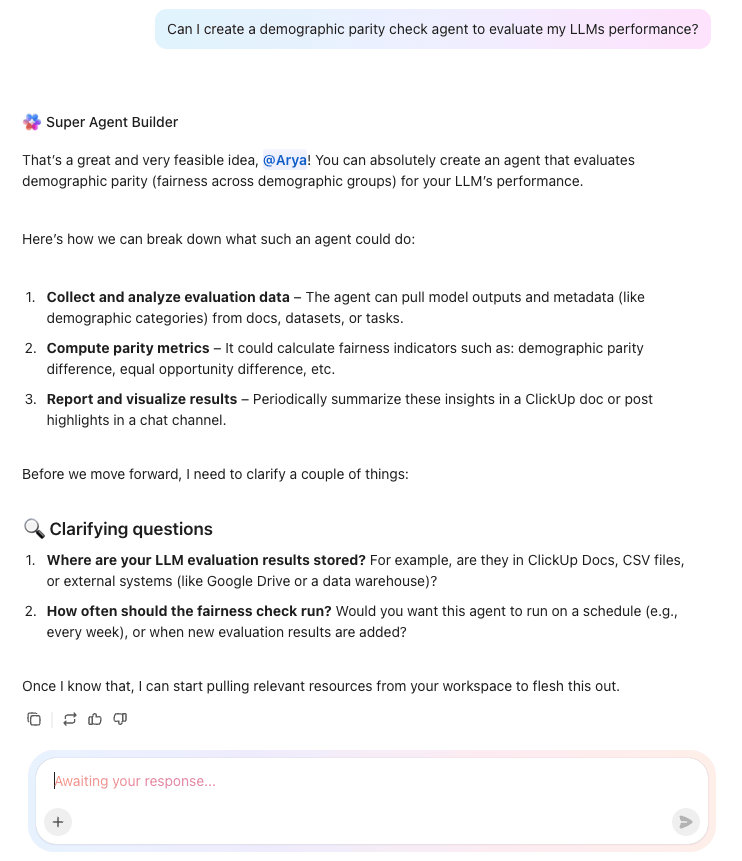

U moet systematisch testen op vooringenomenheid om deze op te sporen voordat deze echte schade aanricht. Gebruik eerlijkheidsmetriek om te meten hoe uw model presteert bij verschillende groepen.

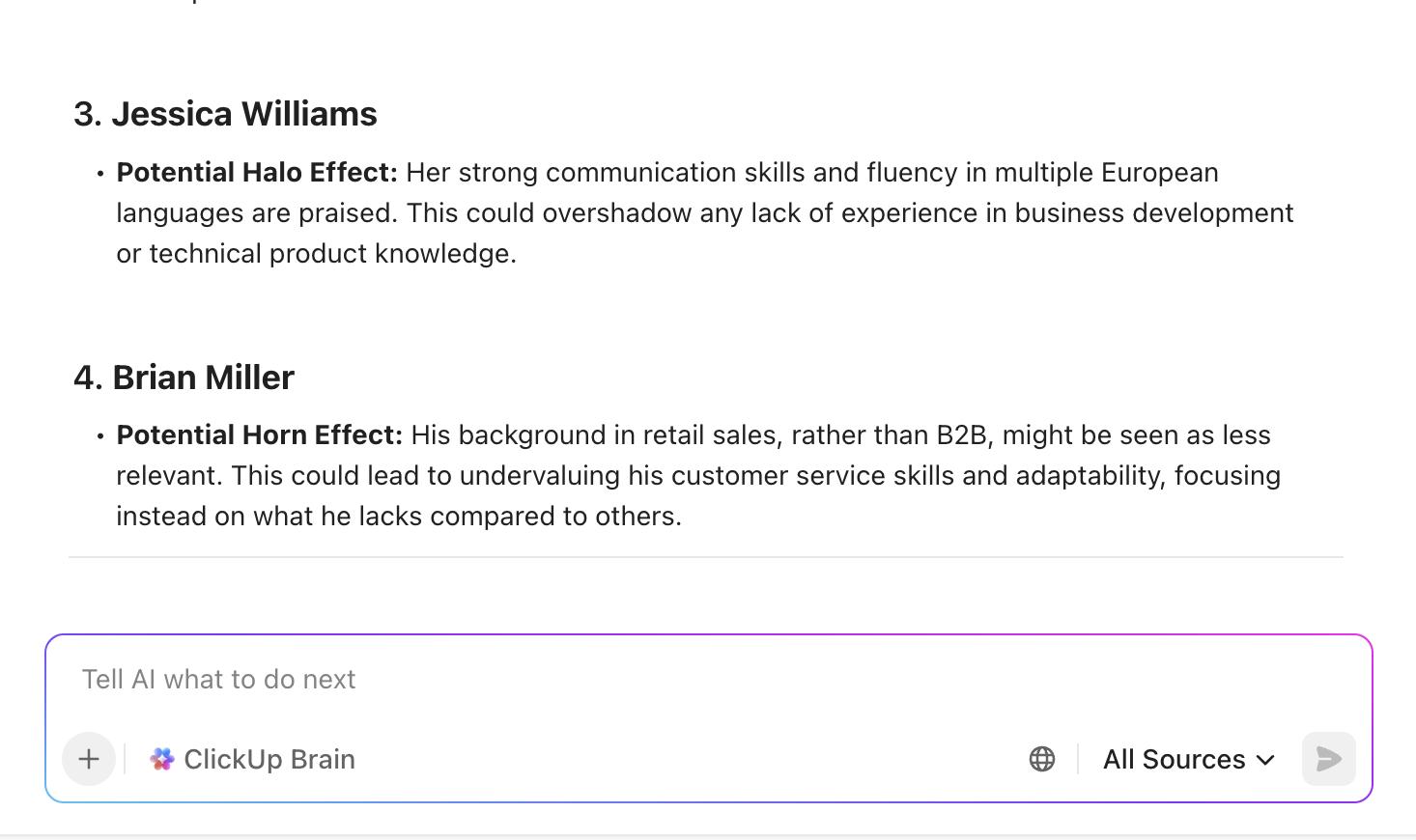

Als voorbeeld controleert demografische pariteit bijvoorbeeld of het model voor alle groepen een gelijk positief resultaat oplevert (zoals een goedgekeurde lening), terwijl geëgaliseerde kansen controleren of de foutpercentages gelijk zijn.

Verdeel de prestaties van uw model over alle mogelijke demografische gegevens – ras, geslacht, leeftijd, geografie – om te zien waar de nauwkeurigheid afneemt of oneerlijkheid insluipt.

Houd de mens in de loop

Geautomatiseerde systemen kunnen subtiele, contextspecifieke oneerlijkheden over het hoofd zien die een mens meteen zou opmerken. Een 'human-in-the-loop'-benadering is cruciaal voor beslissingen met hoge inzet, waarbij een AI een aanbeveling kan doen, maar een mens de uiteindelijke beslissing neemt.

Dit is vooral belangrijk op gebieden als werving, kredietverlening en medische diagnoses. Om dit te laten werken, moeten uw menselijke beoordelaars worden getraind om vooringenomenheid te herkennen en moeten ze de bevoegdheid hebben om de suggesties van de AI te negeren.

Pas algoritmische eerlijkheidstechnieken toe

U kunt ook technische methoden gebruiken om direct in te grijpen en vooringenomenheid te verminderen. Deze technieken vallen uiteen in drie hoofdcategorieën:

- Voorbewerking: Dit houdt in dat de trainingsgegevens worden aangepast voordat het model ze te zien krijgt, vaak door de gegevens opnieuw te wegen of te resamplen om een evenwichtiger weergave van verschillende groepen te creëren.

- In-processing: Hier voegt u rechtvaardigheidsbeperkingen rechtstreeks toe aan het trainingsproces van het model, waardoor het leert om tegelijkertijd zowel nauwkeurigheid als rechtvaardigheid te optimaliseren.

- Nabewerking: Dit betekent dat de uiteindelijke voorspellingen van het model nadat ze zijn gedaan, worden aangepast om ervoor te zorgen dat de resultaten voor alle groepen gelijk zijn.

Deze technieken brengen vaak een afweging met zich mee, waarbij een lichte afname van de algehele nauwkeurigheid nodig kan zijn om een aanzienlijke verbetering in eerlijkheid te bereiken.

💟 Bonus: BrainGPT is uw AI-aangedreven desktopmetgezel die AI-bias-testen naar een hoger niveau tilt door u toegang te geven tot meerdere toonaangevende modellen, waaronder GPT-5, Claude, Gemini en meer, allemaal op één plek.

Dit betekent dat u eenvoudig dezelfde prompts of scenario's op verschillende modellen kunt uitvoeren, hun redeneervermogen kunt vergelijken en kunt zien waar de reacties uiteenlopen of vooringenomenheid vertonen. Met deze AI-superapp kunt u ook spraak-naar-tekst gebruiken om testcases op te zetten, uw bevindingen te documenteren en resultaten te ordenen voor een vergelijkende analyse.

De geavanceerde redenering en contextbewuste tools helpen u bij het oplossen van problemen, het signaleren van patronen en het begrijpen hoe elk model omgaat met gevoelige onderwerpen. Door uw werkstroom te centraliseren en transparante, multimodale tests mogelijk te maken, stelt Brain MAX u in staat om AI-bias met vertrouwen en precisie te controleren, te vergelijken en aan te pakken.

Verhoog de transparantie en verklaarbaarheid

Als u niet weet hoe uw model beslissingen neemt, kunt u het niet corrigeren wanneer het fout is. Verklarbare AI-technieken (XAI) helpen u een kijkje te nemen in de 'black box' en te zien welke data-functies de voorspellingen sturen.

U kunt ook modelkaarten maken, die vergelijkbaar zijn met voedingslabels voor uw AI, waarop het beoogde gebruik, prestatiegegevens en bekende beperkingen worden gedocumenteerd.

📮ClickUp Insight: 13% van de respondenten van onze enquête wil AI gebruiken om moeilijke beslissingen te nemen en complexe problemen op te lossen. Slechts 28% zegt echter regelmatig AI te gebruiken op het werk. Een mogelijke reden: bezorgdheid over de veiligheid!

Gebruikers willen mogelijk geen gevoelige besluitvormingsgegevens delen met een externe AI.

ClickUp lost dit op door AI-aangedreven probleemoplossing rechtstreeks naar uw beveiligde werkruimte te brengen. Van SOC 2 tot ISO-normen, ClickUp voldoet aan de hoogste normen voor gegevensveiligheid en helpt u generatieve AI-technologie veilig te gebruiken in uw hele werkruimte.

Beleid inzake AI-governance en verantwoordingsplicht

Een sterk AI-governanceprogramma zorgt voor duidelijke eigendommen en consistente normen die iedereen in het team kan volgen.

Uw organisatie heeft duidelijke bestuursstructuren nodig om ervoor te zorgen dat er altijd iemand verantwoordelijk is voor het op ethische wijze bouwen en implementeren van AI.

Dit zijn de essentiële elementen van een effectief AI-governanceprogramma:

| Governance-element | Wat dit betekent | Actiestappen voor uw organisatie |

|---|---|---|

| Duidelijke eigendom | Speciale mensen of teams zijn verantwoordelijk voor AI-ethiek, toezicht en naleving. | • Stel een AI-ethiekverantwoordelijke of een multifunctionele commissie aan • Definieer verantwoordelijkheden voor gegevens, modelkwaliteit, naleving en risico's • Betrek juridische, technische, product- en DEI-vertegenwoordigers bij het toezicht |

| Gedocumenteerd beleid | Schriftelijke richtlijnen die beschrijven hoe gegevens worden verzameld, gebruikt en gecontroleerd gedurende de hele levenscyclus van AI. | • Stel intern beleid op voor de databronnen, labeling, privacy en beveiliging van gegevens • Documenteer normen voor modelontwikkeling, validatie en implementatie • Verplicht teams om checklists te volgen voordat ze een AI-systeem in gebruik nemen |

| Audittrajecten | Een transparant overzicht van beslissingen, versieën van modellen, datasets en wijzigingen | • Implementeer versiebeheer voor datasets en modellen • Leg belangrijke beslissingen en modelparameters vast en evalueer de resultaten • Sla audittrails op in een centrale, toegankelijke opslagplaats |

| Regelmatige beoordelingen | Voortdurende beoordelingen van AI-systemen om te controleren op vooringenomenheid, afwijkingen en nalevingslacunes. | • Plan driemaandelijkse of halfjaarlijkse beoordelingen van vooringenomenheid via robuuste LLM-evaluatie • Herleid of herkalibreer modellen wanneer de prestaties dalen of het gedrag verandert • Controleer modellen na grote gegevensupdates of productwijzigingen |

| Incidentresponsplan | Een duidelijk protocol voor het identificeren, uitvoeren van rapportage en corrigeren van AI-bias of schade. | • Creëer een interne werkstroom voor het escaleren van vooringenomenheid • Bepaal hoe problemen worden onderzocht en wie oplossingen goedkeurt • Schets communicatiestappen voor gebruikers, klanten of regelgevende instanties wanneer dat nodig is |

💡Pro-tip: Kaders zoals het NIST AI Risk Management Framework en de EU AI Act, met boetes tot 7% van de jaarlijkse omzet, kunnen uitstekende blauwdrukken bieden voor het opzetten van uw eigen governanceprogramma.

Hoe vooringenomenheid te verminderen met ClickUp

De geconvergeerde AI-werkruimte van ClickUp brengt alle bewegende delen van uw AI-governanceprogramma samen in één georganiseerde werkruimte.

Uw teams kunnen taken beheren, beleid opslaan, auditbevindingen beoordelen, risico's bespreken en incidenten bijhouden zonder tussen verschillende tools te hoeven schakelen of de context te verliezen. Elk modelrecord, beslissingslogboek en herstelplan blijft gekoppeld, zodat u altijd weet wie wat heeft gedaan en waarom.

En omdat de ClickUp AI het werk binnen uw werkruimte begrijpt, kan het eerdere beoordelingen weergeven, lange rapporten samenvatten en uw team helpen om op één lijn te blijven terwijl de normen evolueren. Het resultaat is een governancesysteem dat gemakkelijker te volgen en te controleren is en veel betrouwbaarder wordt naarmate uw AI-voetafdruk groeit.

Laten we het eens als een werkstroom bekijken!

Stap 1: Richt uw AI-governancewerkruimte in

Begin met het creëren van een speciale ruimte in ClickUp voor al het werk dat met governance te maken heeft. Voeg lijsten toe voor uw modelinventaris, vooringenomenheidbeoordelingen, incidentrapporten, beleidsdocumenten en geplande beoordelingen, zodat elk onderdeel van het programma in één gecontroleerde omgeving wordt beheerd.

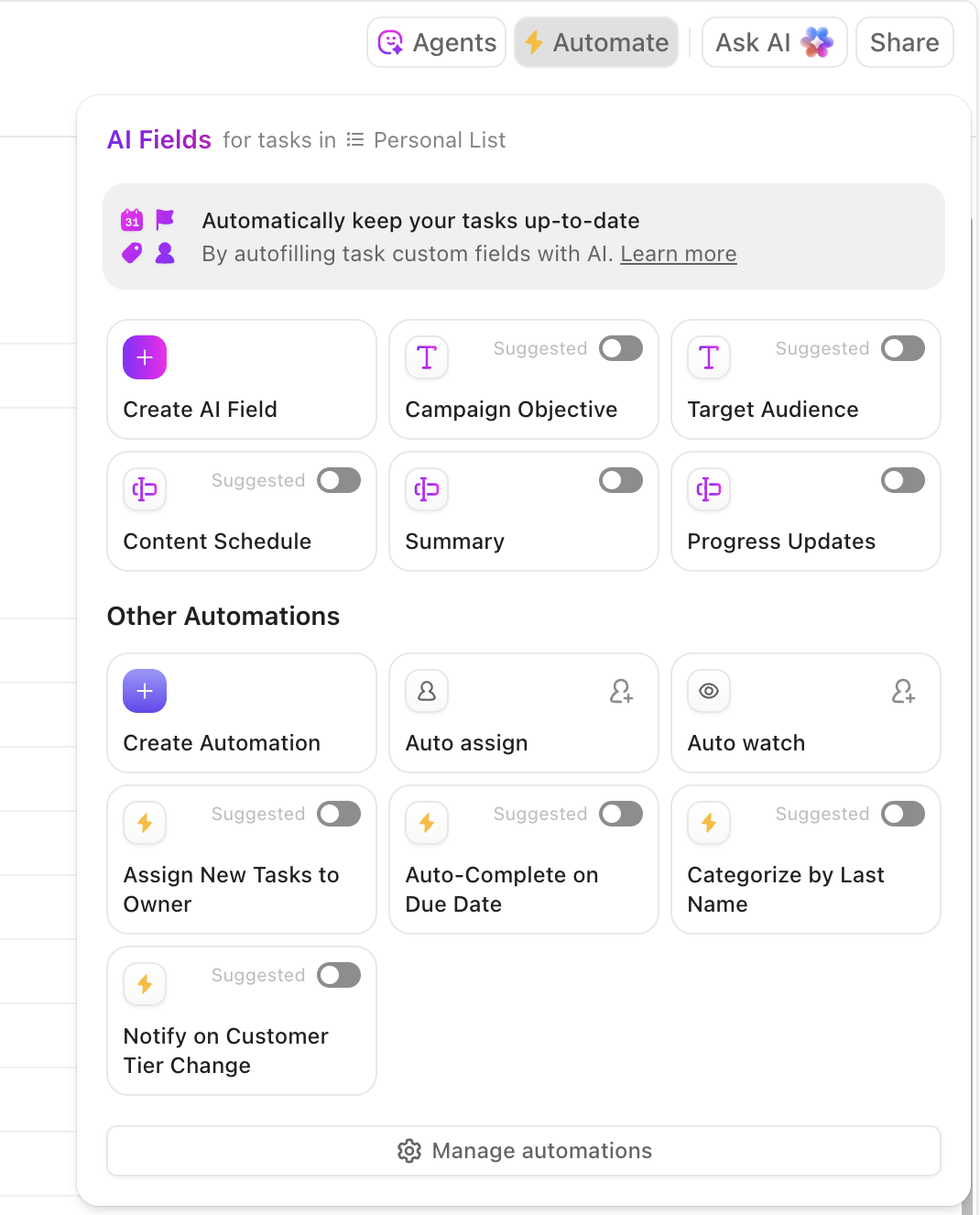

Configureer aangepaste velden of AI-velden om eerlijkheidsstatistieken, vooroordelenscores, modelversies, beoordelingsstatus en risiconiveaus bij te houden. Gebruik op rollen gebaseerde toestemmingen om ervoor te zorgen dat alleen geautoriseerde beoordelaars, ingenieurs en compliance-leiders toegang hebben tot gevoelige AI-werkzaamheden. Dit creëert de structurele basis die de punttools en generieke projectplatforms van concurrenten niet kunnen bieden.

Stap 2: Bouw uw governancekader op

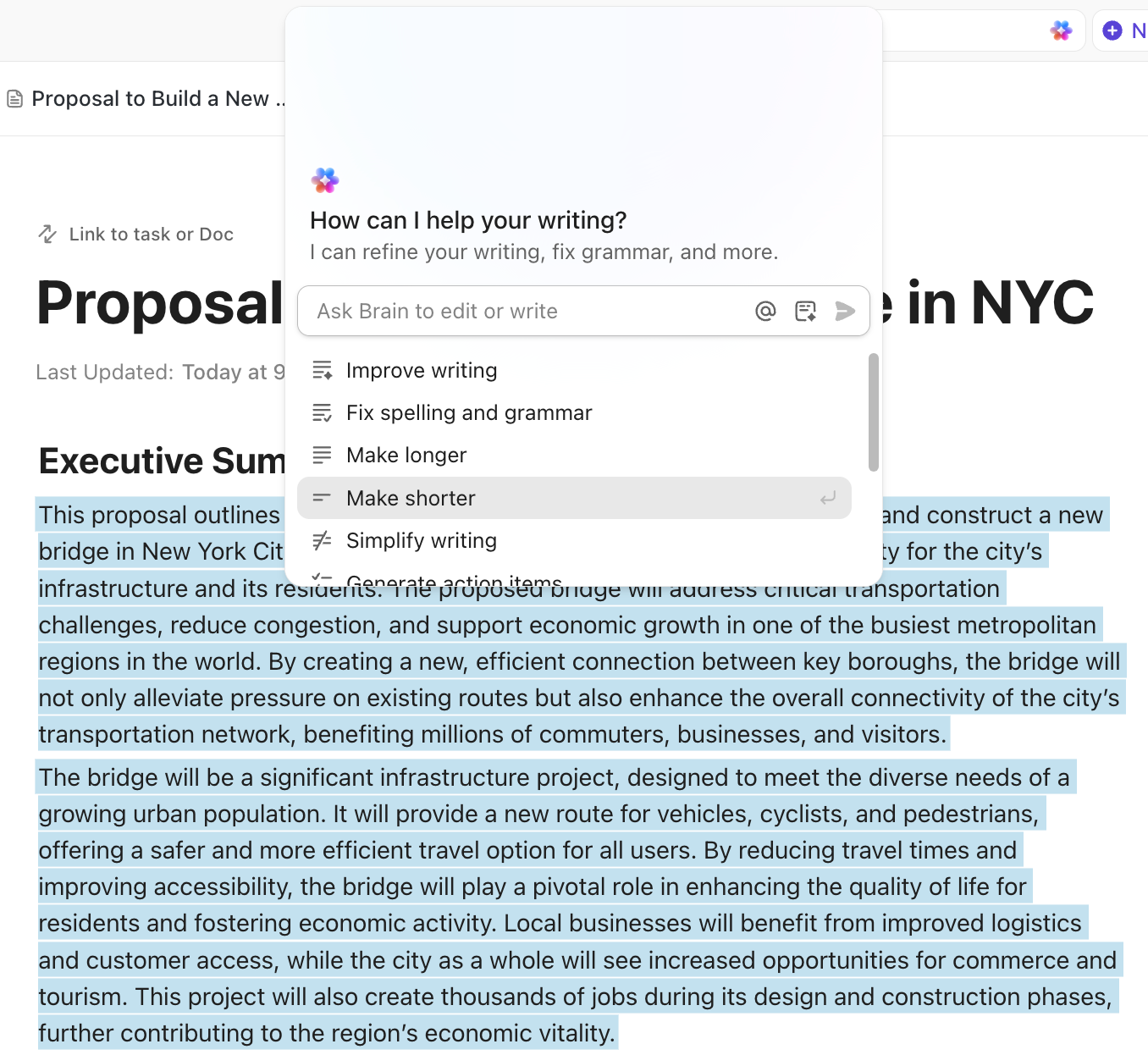

Maak vervolgens een ClickUp-document aan dat als uw levend governance-handboek kan dienen. Hierin beschrijft u uw procedures voor het evalueren van vooringenomenheid, drempels voor eerlijkheid, richtlijnen voor model documentatie, stappen voor menselijke tussenkomst en escalatieprotocollen.

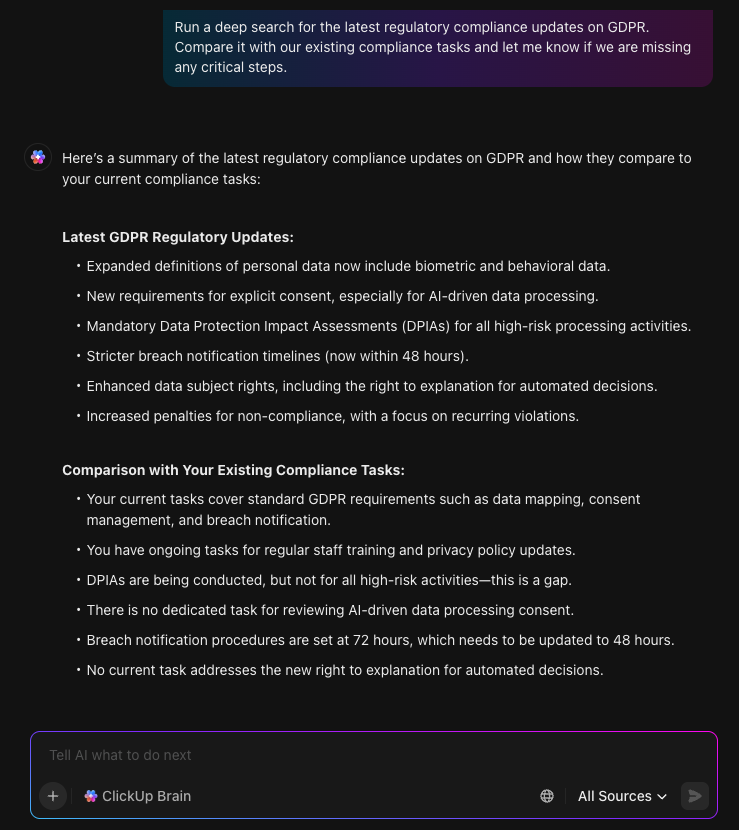

Omdat documenten verbonden blijven aan taken en modelrecords, kunnen uw teams samenwerken zonder versiegeschiedenis te verliezen of bestanden over verschillende tools te verspreiden. Vervolgens kan ClickUp Brain helpen bij het samenvatten van externe regelgeving, het opstellen van nieuwe beleidsformuleringen of het boven water halen van eerdere auditbevindingen, waardoor het aanmaken van beleid consistenter en beter traceerbaar wordt.

Omdat het systeem het internet kan doorzoeken, tussen meerdere AI-modellen kan schakelen en informatie kan samenvatten tot duidelijke richtlijnen, blijft uw team op de hoogte van nieuwe normen en veranderingen in de sector zonder de werkruimte te verlaten. Alles wat u nodig hebt, beleidsupdates, inzichten in regelgeving en eerdere beslissingen, komt samen op één plek, waardoor uw governancesysteem stabieler en veel gemakkelijker te onderhouden is.

Stap 3: Registreer elk model

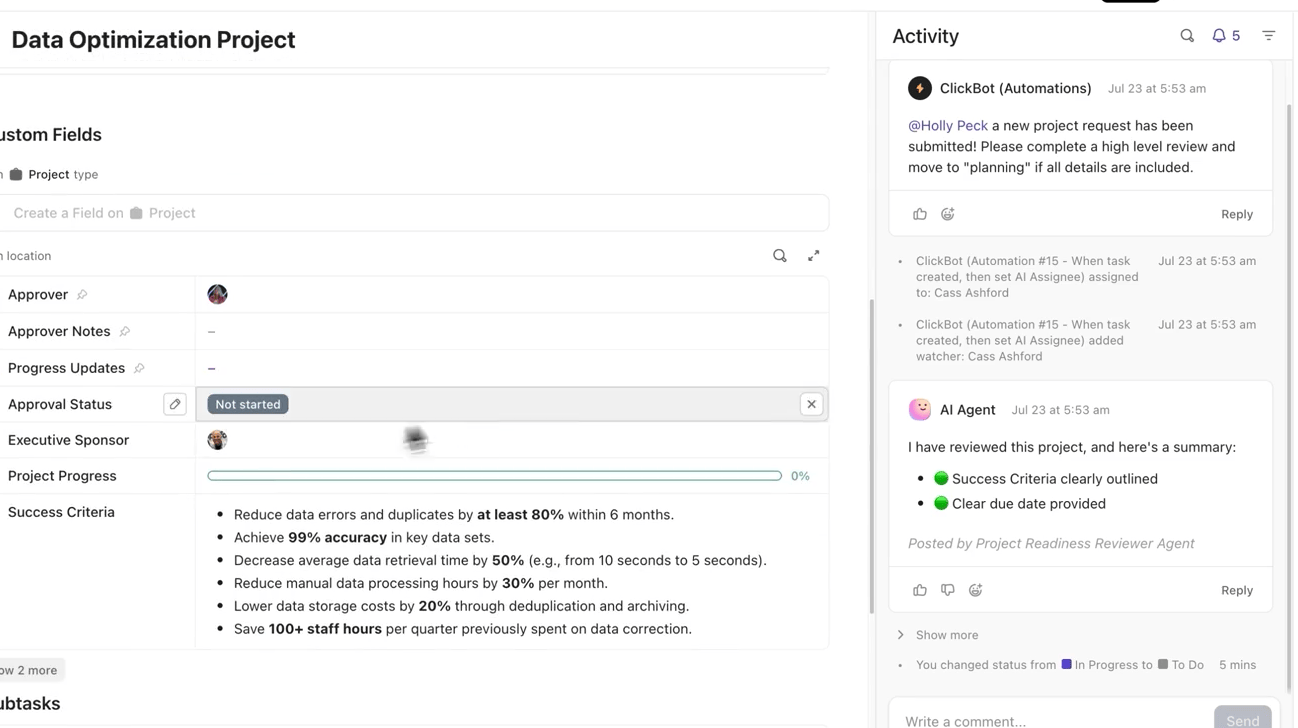

Elk model moet een eigen taak hebben in de lijst 'Modelinventaris', zodat de eigendom en aansprakelijkheid altijd duidelijk zijn.

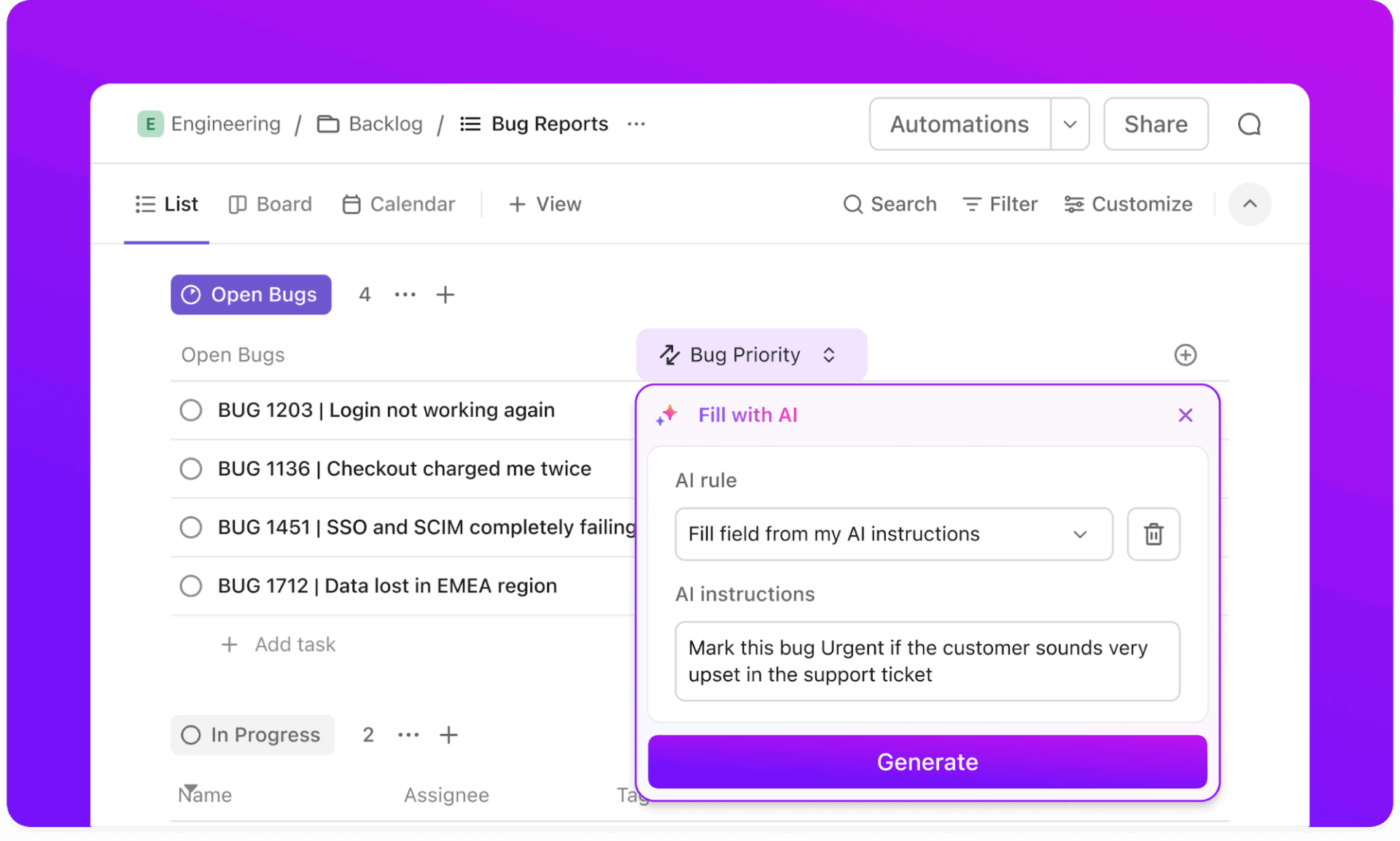

Houd elk vooringenomenheidsincident eenvoudig bij als een actiepunt door ClickUp-taaken en aangepaste velden te gebruiken om uw werkstroom voor vooringenomenheidsbeoordeling te structureren en elk belangrijk detail vast te leggen.

Op deze manier kunt u het type vooringenomenheid, de ernst, de status van de herstelmaatregelen, het verantwoordelijke teamlid en de volgende beoordelingsdatum bijhouden, zodat elk probleem een duidelijke eigenaar en een deadline heeft.

Voeg datasets, evaluatiesamenvattingen en afkomstantekeningen toe als bijlagen, zodat alles op één plek staat. Automatiseringen kunnen beoordelaars vervolgens waarschuwen wanneer een model naar de staging- of productieomgeving wordt verplaatst.

Stap 4: Voer geplande en gebeurtenisgebaseerde vooringenomenheidscontroles uit

Bevooroordelingsaudits moeten zowel op basis van een terugkerend schema als in reactie op specifieke triggers plaatsvinden.

Stel eenvoudige regels in via ClickUp-automatiseringen die automatisch beoordelingstaken triggeren wanneer een model een nieuwe implementatiemijlpaal bereikt of een geplande audit moet plaatsvinden. U mist nooit meer een driemaandelijkse beoordeling van vooringenomenheid, omdat automatiseringen de juiste beoordelaars kan toewijzen, de juiste deadlines kan instellen en zelfs herinneringen kan versturen wanneer de deadlines naderen.

Voor evenementgebaseerde audits maakt ClickUp Forms het eenvoudig om rapporten over vooringenomenheidsincidenten of menselijke feedback te verzamelen, terwijl beoordelaars aangepaste velden gebruiken om hiaten in de eerlijkheid, testresultaten en aanbevelingen te registreren. Elk ingediend formulier wordt als Taak naar uw team gestuurd, waardoor een herhaalbare auditroute ontstaat.

Stap 5: Onderzoek en los vooringenomenheidsincidenten op

Wanneer een vooringenomenheid wordt vastgesteld, maak dan een incident-taak aan waarin de ernst, de getroffen groepen, de versie van het model en het vereiste werk voor de mitigatie worden vastgelegd. AI-agenten kunnen problemen met een hoog risico escaleren naar compliance-leiders en de juiste beoordelaars en ingenieurs toewijzen.

Elke mitigatiemaatregel, testresultaat en validatiestap blijft gekoppeld aan het incidentrapport. ClickUp Brain kan samenvattingen genereren voor het management of helpen bij het opstellen van herstelantekeningen voor uw governance-documentatie, zodat alles transparant en traceerbaar blijft.

Stap 6: Controleer de gezondheid van uw AI-governanceprogramma

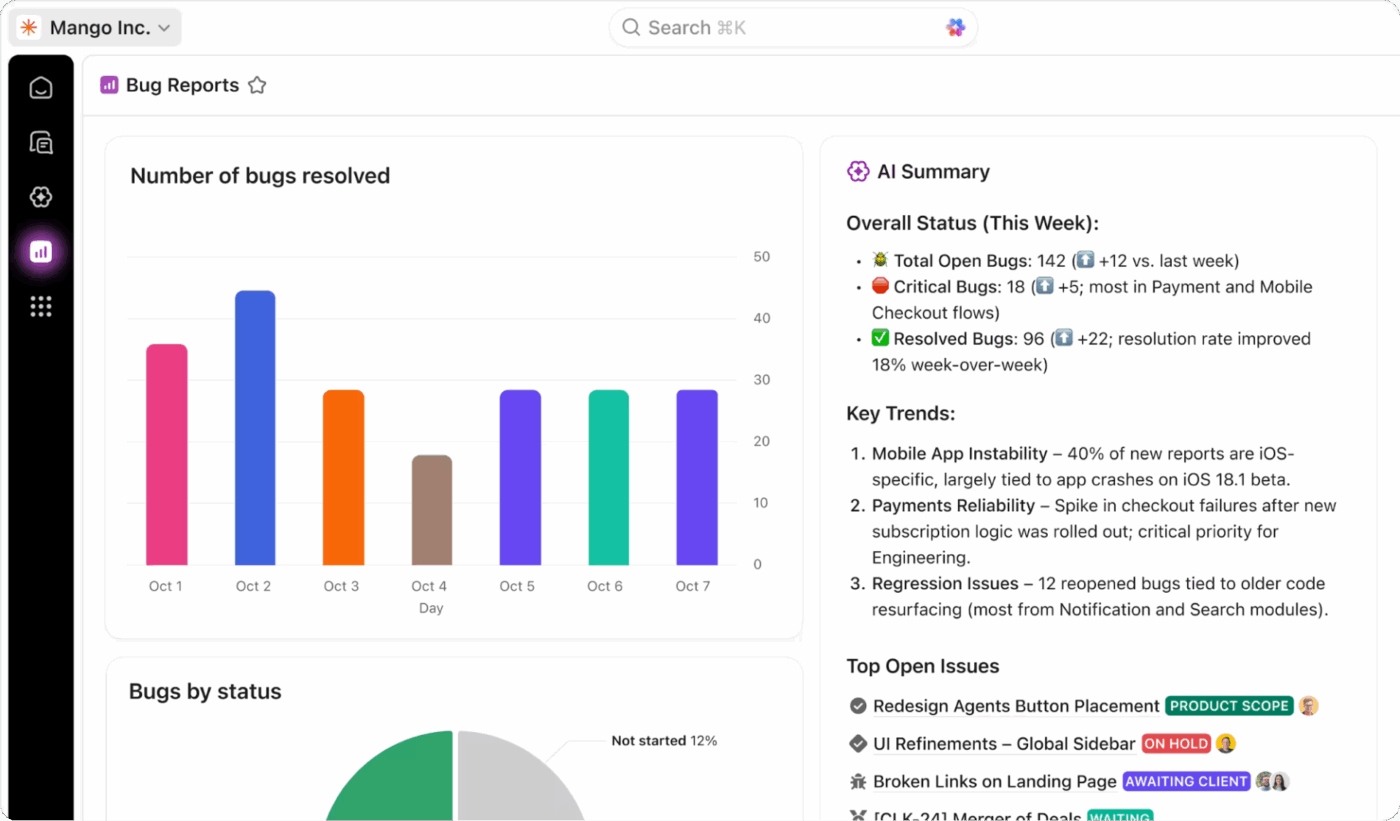

Bouw ten slotte dashboards die leidinggevenden een realtime weergave geven van uw programma voor het verminderen van vooringenomenheid.

Voeg panelen toe met openstaande incidenten, de tijd tot oplossing, voltooiingspercentages van audits, eerlijkheidsstatistieken en de nalevingsstatus voor alle actieve modellen. De no-code dashboards in ClickUp kunnen automatisch gegevens ophalen en taken bijwerken naarmate de voortgang vordert, met AI-samenvattingen die in uw dashboardweergave zijn ingebouwd.

📖 Lees meer: Hoe veelvoorkomende AI-uitdagingen te overwinnen

Bevooroordelingscontroles na implementatie

Uw werk is niet klaar wanneer het AI-model live gaat.

In feite begint dan de echte test. Modellen kunnen in de loop van de tijd 'afdrijven' en nieuwe vooroordelen ontwikkelen naarmate de gegevens uit de echte wereld die ze zien, beginnen te veranderen. Continue monitoring is de enige manier om deze opkomende vooroordelen op te sporen voordat ze grote schade aanrichten.

Dit is wat uw voortdurende monitoring zou moeten omvatten:

| Oefening | Wat het garandeert |

|---|---|

| Prestaties bijhouden per groep | Meet continu de nauwkeurigheid en eerlijkheid van modellen in verschillende demografische segmenten, zodat ongelijkheden vroegtijdig worden opgespoord. |

| Detectie van datadrift | Controleert veranderingen in invoergegevens die nieuwe vooringenomenheid kunnen introduceren of de prestaties van het model in de loop van de tijd kunnen verzwakken. |

| Feedbackloops van gebruikers | Biedt gebruikers duidelijke kanalen voor rapportage van vooringenomen of onjuiste resultaten, waardoor het toezicht in de praktijk wordt verbeterd. |

| Geplande audits | Zorgt voor driemaandelijkse of halfjaarlijkse diepgaande analyses van modelgedrag, eerlijkheidsstatistieken en nalevingsvereisten. |

| Incidentrespons | Definieert een gestructureerd proces voor het onderzoeken, corrigeren en documenteren van gemelde vooringenomenheid-gebeurtenissen. |

💟 Bonus: Met name generatieve AI-systemen vereisen extra waakzaamheid, omdat hun output veel minder voorspelbaar is dan die van traditionele machine learning-modellen. Een uitstekende techniek hiervoor is red-teaming, waarbij een speciaal team actief probeert om bevooroordeelde of schadelijke reacties uit het model te lokken om zo de zwakke plekken ervan te identificeren.

Het Project Lighthouse van Airbnb is bijvoorbeeld een uitstekend voorbeeld uit de sector van een bedrijf dat systematische biasmonitoring na implementatie toepast.

Het is een onderzoeksinitiatief dat onderzoekt hoe waargenomen ras van invloed kan zijn op boekingsresultaten, waardoor het bedrijf discriminatie op het platform kan identificeren en verminderen. Het maakt gebruik van privacyveilige methoden, werkt samen met burgerrechtenorganisaties en vertaalt de bevindingen naar product- en beleidswijzigingen, waardoor meer gasten zonder onzichtbare hindernissen door het platform kunnen navigeren.

Beperk AI-vooringenomenheid met ClickUp

Het bouwen van eerlijke, verantwoordelijke AI is een organisatorische verplichting.

Wanneer uw beleid, mensen, processen en tools in harmonie samenwerken, creëert u een governancesysteem dat zich kan aanpassen aan nieuwe risico's, snel kan reageren op incidenten en het vertrouwen kan winnen van de mensen die op uw producten vertrouwen.

Met gestructureerde beoordelingen, duidelijke documentatie en een herhaalbare werkstroom voor het omgaan met vooringenomenheid blijven teams op één lijn en verantwoordelijk, in plaats van te reageren in crisismodus.

Door alles in ClickUp te centraliseren, van modelrecords tot auditresultaten en incidentrapporten, creëert u één operationele laag waar beslissingen transparant zijn, verantwoordelijkheden duidelijk zijn en verbeteringen nooit verloren gaan in de wirwar.

Sterk beheer remt innovatie niet, maar zorgt juist voor stabiliteit. Klaar om vooringenomenheid in uw AI-werkstroom te verminderen? Ga gratis aan de slag met ClickUp en begin vandaag nog met het opzetten van uw AI-beheerprogramma.

Veelgestelde vragen

Een goede eerste stap is het uitvoeren van een vooringenomenheidsaudit van uw bestaande AI-systemen. Deze basisbeoordeling laat zien waar er momenteel oneerlijkheid bestaat en helpt u prioriteiten te stellen voor uw inspanningen om dit te verminderen.

Teams gebruiken specifieke eerlijkheidsmaatstaven, zoals demografische pariteit, gelijke kansen en ongelijke impactratio, om vooringenomenheid te kwantificeren. De juiste maatstaf hangt af van uw specifieke gebruikssituatie en het soort eerlijkheid dat in die context het belangrijkst is.

Voeg altijd een menselijke beoordelingsstap toe voor belangrijke beslissingen die een aanzienlijke invloed hebben op iemands leven of kansen, zoals bij aanwerving, kredietverlening of gezondheidszorg. Het is ook verstandig om dit te doen tijdens de vroege implementatie van een nieuw model, wanneer het gedrag ervan nog onvoorspelbaar is.

Omdat generatieve AI een bijna oneindig bereik aan onvoorspelbare reacties kan produceren, kunt u niet alleen controleren op nauwkeurigheid. U moet actieve onderzoekstechnieken gebruiken, zoals red-teaming en grootschalige steekproeven van outputs, om erachter te komen of het model onder verschillende voorwaarden bevooroordeelde content produceert.