Les biais de l'IA peuvent sembler être un problème technique. Mais leurs effets se manifestent dans le monde réel et peuvent souvent être dévastateurs.

Lorsqu'un système /IA penche dans la mauvaise direction, même légèrement, cela peut conduire à des résultats injustes.

Au fil du temps, ces petits problèmes peuvent se transformer en frustration chez les clients, en problèmes de réputation, voire en questions de conformité auxquelles vous ne vous attendiez pas.

La plupart des équipes ne cherchent pas à créer une IA biaisée. Cela se produit parce que les données sont désordonnées, que le monde réel est inégal et que les outils que nous utilisons ne fonctionnent pas toujours comme nous le souhaitons. La bonne nouvelle, c'est qu'il n'est pas nécessaire d'être un spécialiste des données pour comprendre ce qui se passe.

Dans cet article, nous vous expliquerons ce qu'est réellement le biais de l'IA, pourquoi il se produit et comment il peut se manifester dans les outils d'entreprise quotidiens.

Qu'est-ce que le biais de l'IA ?

Le biais de l'IA se produit lorsqu'un système d'IA produit des résultats systématiques et injustes qui favorisent ou désavantagent systématiquement certains groupes de personnes. Il ne s'agit pas simplement d'erreurs aléatoires, mais de schémas prévisibles qui s'intègrent dans la manière dont l'IA prend ses décisions. La cause ? L'IA apprend à partir de données qui reflètent les biais humains existants, d'autres biais inconscients et les inégalités sociales.

Pensez-y de cette façon : si vous entraînez un algorithme de recrutement sur dix ans de données d'entreprise où 90 % des cadres étaient des hommes, l'IA pourrait apprendre à tort que le fait d'être un homme est une qualification essentielle pour un rôle de direction. L'IA n'est pas malveillante ; elle identifie et répète simplement les modèles qui lui ont été présentés.

Voici ce qui rend les biais de l'IA si délicats :

- C'est systématique, pas aléatoire : l'injustice n'est pas un incident isolé, mais un schéma récurrent dans les résultats de l'IA.

- C'est souvent invisible : les résultats biaisés peuvent se cacher derrière les calculs mathématiques complexes d'un algorithme apparemment neutre, ce qui les rend difficiles à repérer.

- Tout repose sur les données et la conception : les biais s'introduisent dans le système à travers les choix que nous, les humains, faisons lorsque nous construisons et entraînons l'IA.

⭐ Modèle présenté

Le modèle de rapport d'incident de ClickUp fournit une structure prête à l'emploi pour documenter, suivre et résoudre les incidents du début à la fin. Enregistrez tous les détails pertinents de l'incident, maintenez des statuts clairement classés et capturez les attributs importants tels que la gravité, les groupes touchés et les mesures correctives. Il prend en charge les champs personnalisés pour des éléments tels que Approuvé par, Notes sur l'incident et Documents justificatifs, qui aident à mettre en évidence la responsabilité et les preuves tout au long du processus d'examen.

📖 Pour en savoir plus : Comment réaliser une évaluation des risques : outils et techniques

Pourquoi est-il important d'atténuer les biais de l'IA ?

Lorsque vos systèmes IA sont injustes, vous risquez de nuire à la vie de personnes réelles.

Cela expose votre organisation à de sérieux défis commerciaux et peut même détruire la confiance que vous avez mis tant d'efforts à établir avec vos clients.

Une IA biaisée qui refuse un prêt à quelqu'un, rejette sa candidature à un emploi ou fait une recommandation erronée entraîne de graves conséquences dans le monde réel.

Les normes et cadres émergents du secteur encouragent désormais les organisations à identifier et à traiter activement les biais dans leurs systèmes d'IA. Les risques touchent votre organisation sous tous les angles :

- Risque réglementaire : le non-respect des nouvelles normes en matière d'IA peut entraîner des difficultés pour l'entreprise.

- Atteinte à la réputation : une fois que le public apprend que votre IA est biaisée, il est extrêmement difficile de regagner sa confiance.

- Inefficacité opérationnelle : les modèles biaisés produisent des résultats peu fiables ou des hallucinations de l'IA qui conduisent à de mauvaises décisions et nécessitent des corrections coûteuses.

- Responsabilité éthique : votre organisation doit s'assurer que la technologie que vous déployez traite tous les utilisateurs de manière équitable.

Lorsque vous parvenez à atténuer les biais, vous créez des systèmes d'IA sur lesquels les gens peuvent réellement compter. Une IA équitable ouvre les portes de nouveaux marchés, améliore la qualité de vos décisions et démontre à tous que vous vous engagez à mener une entreprise éthique.

📮 ClickUp Insight : 22 % de nos répondants restent méfiants quant à l'utilisation de l'IA au travail. Parmi ces 22 %, la moitié s'inquiète pour la confidentialité de leurs données, tandis que l'autre moitié n'est tout simplement pas sûre de pouvoir se fier aux informations fournies par l'IA.

ClickUp répond à ces deux préoccupations de front grâce à des mesures de sécurité robustes et en générant des liens détaillés vers les tâches et les sources pour chaque réponse.

Ainsi, même les équipes les plus prudentes peuvent commencer à profiter d'un gain de productivité sans se demander si leurs informations sont protégées ou si les résultats obtenus sont fiables.

📖 Pour en savoir plus : Assistant de conformité IA : comment l'IA transforme la conformité et les audits

Types et sources de biais liés à l'IA

Les biais peuvent s'immiscer dans vos systèmes IA de multiples façons.

Dès le moment où vous commencez à collecter des données et longtemps après le déploiement du système, cet élément reste relativement stable. Mais si vous savez où chercher, vous pouvez cibler vos efforts et mettre fin à un jeu sans fin de « tape-taupe » aux résultats injustes.

Biais d'échantillonnage

Le biais d'échantillonnage se produit lorsque les données que vous utilisez pour entraîner votre IA ne représentent pas fidèlement le monde réel dans lequel l'IA sera utilisée.

Par exemple, si vous créez un système de reconnaissance vocale principalement entraîné sur des données provenant de locuteurs anglophones américains, il aura naturellement du mal à comprendre les personnes ayant un accent écossais ou indien, tout comme les LLM favorisent les noms associés aux Blancs dans 85,1 % des cas lors de la sélection des CV. Cette sous-représentation crée d'énormes angles morts, laissant votre modèle incapable de servir des groupes entiers de personnes.

Biais algorithmique

Les biais algorithmiques surviennent lorsque la conception du modèle ou le processus mathématique amplifie des schémas injustes, même si les données semblent neutres.

Le code postal d'une personne ne devrait pas déterminer si elle obtient un prêt, mais si les codes postaux dans vos données d'entraînement sont fortement corrélés à l'origine ethnique, l'algorithme pourrait apprendre à utiliser l'emplacement comme indicateur de discrimination.

Ce problème s'aggrave encore avec les boucles de rétroaction : lorsqu'une prédiction biaisée (comme le refus d'un prêt) est réinjectée dans le système en tant que nouvelle donnée, le biais ne fait que s'intensifier avec le temps.

Biais décisionnel humain

Chaque choix effectué lors de la création d'un système IA peut introduire un biais.

Cela implique notamment de décider quelles données collecter, comment les étiqueter et comment définir la « réussite » du modèle. Par exemple, une équipe peut inconsciemment privilégier les données qui corroborent ses convictions (biais de confirmation) ou accorder trop d'importance à la première information qu'elle voit (biais d'ancrage).

Même les équipes les mieux intentionnées peuvent accidentellement intégrer leurs propres hypothèses et leur vision du monde dans un système d'IA.

📖 Pour en savoir plus : 10 modèles de gouvernance de projet pour gérer les tâches

Exemples de biais de l'IA dans le monde réel

Des entreprises réelles ont subi des conséquences majeures lorsque leurs systèmes d'IA ont fait preuve de biais, ce qui leur a coûté des millions en dommages et en perte de confiance de la part de leurs clients. Voici quelques exemples documentés :

1. Outils de recrutement biaisés

L'un des cas les plus cités concerne une grande entreprise technologique qui a abandonné son système interne de recrutement basé sur l'IA après avoir constaté qu'il favorisait les candidats masculins par rapport aux femmes. Le système avait été entraîné à partir d'une décennie de CV, dont la plupart des candidats ayant connu la réussite étaient des hommes. Il a donc commencé à pénaliser les CV contenant des mots tels que « femmes », allant même jusqu'à dévaloriser les diplômées des universités féminines.

Cela montre comment les biais des données historiques, lorsque les modèles passés reflètent les inégalités existantes, peuvent s'immiscer dans l'automatisation s'ils ne sont pas soigneusement contrôlés. Mais à mesure que le recrutement automatisé avec l'IA se généralise, l'ampleur du problème devient encore plus importante.

🌼 Le saviez-vous ? Des données récentes montrent que 37 % des organisations « intègrent activement » ou « expérimentent » désormais les outils d'IA générique dans le domaine du recrutement, contre 27 % il y a un an.

2. La reconnaissance faciale qui ignore la moitié de la population

Les recherches menées par Joy Buolamwini et documentées dans l'étude Gender Shades ont révélé que les systèmes commerciaux de reconnaissance faciale présentaient des taux d'erreur pouvant atteindre 34,7 % pour les femmes à la peau foncée, contre moins de 1 % pour les hommes à la peau claire.

Cela reflète une fois de plus le déséquilibre des ensembles de données d'entraînement. Les biais dans les outils biométriques ont des effets encore plus importants.

La police et les agences gouvernementales ont également rencontré des problèmes liés aux biais dans la reconnaissance faciale. Des enquêtes menées par The Washington Post ont révélé que certains de ces systèmes étaient beaucoup plus susceptibles d'identifier de manière erronée les personnes issues de groupes marginalisés. Dans plusieurs cas réels, cela a conduit à des arrestations injustifiées, à des réactions négatives de la part du public et à des inquiétudes majeures quant à l'impact de ces outils sur les droits des personnes.

📖 Pour en savoir plus : L'IA sur le lieu de travail : comment améliorer la productivité et l'efficacité

3. Algorithmes de santé qui sous-estiment la priorité des soins

Les systèmes d'IA dans le domaine de la santé conçus pour prédire quels patients ont besoin de soins supplémentaires ont également montré des biais.

Dans un cas bien documenté, un algorithme de prédiction médicale largement utilisé a commis une erreur importante. Il était censé aider à déterminer quels patients devaient recevoir des soins supplémentaires, mais il a fini par accorder systématiquement une priorité moindre aux patients noirs, même lorsqu'ils étaient aussi malades, voire plus malades, que les patients blancs.

Cela s'est produit parce que le modèle utilisait les dépenses de santé comme indicateur des besoins médicaux. Les patients noirs ayant historiquement moins dépensé en soins de santé en raison d'un accès inégal aux soins, l'algorithme les a considérés comme moins nécessiteux. En conséquence, il a détourné les ressources de soins de ceux qui en avaient le plus besoin. Les chercheurs ont découvert que le simple fait de corriger cet indicateur pouvait considérablement améliorer l'accès à des programmes de soins équitables.

Les préoccupations liées à ces problèmes ont conduit les groupes de défense des droits civiques à faire pression pour que des normes « d'équité avant tout » soient appliquées à l'IA dans le domaine de la santé. En décembre 2025, la NAACP a publié un plan détaillé appelant les hôpitaux, les entreprises technologiques et les décideurs politiques à adopter des audits de biais, des pratiques de conception transparentes, des cadres inclusifs et des outils de gouvernance de l'IA afin d'éviter l'aggravation des inégalités raciales en matière de santé.

4. Algorithmes de crédit avec des résultats inégaux

L'IA et l'automatisation de la prise de décision ne donnent pas seulement la forme à ce que vous voyez sur les réseaux sociaux, elles influencent également qui a accès à l'argent et à quelles conditions.

L'un des exemples concrets les plus commentés est celui de l'Apple Card , une carte de crédit numérique émise par Goldman Sachs.

En 2019, des clients ont partagé sur les réseaux sociaux que l'algorithme de limite de crédit de la carte de crédit accordait des limites beaucoup plus élevées à certains hommes qu'à leurs épouses ou partenaires féminines. Cela s'est produit même lorsque les couples ont déclaré des profils financiers similaires. Un ingénieur logiciel a déclaré avoir reçu une limite de crédit 20 fois supérieure à celle de sa femme, et même le cofondateur d'Apple, Steve Wozniak, a confirmé avoir vécu une expérience similaire avec son épouse.

Ces schémas ont suscité un tollé général et ont conduit le Département des services financiers de l'État de New York à mener une enquête réglementaire afin de déterminer si l'algorithme était discriminatoire à l'égard des femmes, soulignant ainsi comment les outils financiers automatisés peuvent produire des résultats inégaux.

📖 Pour en savoir plus : Comment utiliser l'IA pour la gouvernance des données (cas d'utilisation et outils)

5. Sous-titres automatisés et reconnaissance vocale qui excluent certaines voix

Les systèmes de reconnaissance vocale et de sous-titrage par automatisation n'entendent souvent pas tout le monde de la même manière. De nombreuses études ont montré que ces outils ont tendance à mieux fonctionner pour certains locuteurs que pour d'autres, en fonction de facteurs tels que l'accent, le dialecte, l'origine ethnique et le fait que l'anglais soit ou non la langue maternelle du locuteur.

Cela s'explique par le fait que les systèmes commerciaux sont généralement entraînés à partir d'ensembles de données dominés par certains modèles linguistiques, souvent l'anglais standard occidental, laissant les autres voix sous-représentées.

Par exemple, des chercheurs de Stanford ont testé cinq systèmes de reconnaissance vocale de pointe (d'Amazon, Google, Microsoft, IBM et Apple) et ont constaté qu'ils commettaient npresque deux fois plus d'erreurs lors de la transcription des paroles de locuteurs noirs que de locuteurs blancs . Le problème se posait même lorsque les sujets prononçaient les mêmes mots dans les mêmes conditions.

Lorsque les sous-titres sont inexacts pour certains locuteurs, cela peut nuire à l'expérience de l'utilisateur et rendre le contenu inaccessible aux personnes qui dépendent des sous-titres. Pire encore, cela peut contribuer à des résultats biaisés dans les systèmes qui utilisent la reconnaissance vocale dans les domaines du recrutement, de l'éducation ou de la santé.

Chacun de ces exemples illustre une manière distincte dont les biais peuvent être intégrés dans les systèmes automatisés, par le biais de données d'entraînement biaisées, de proxys mal choisis ou de tests non représentatifs. Dans tous les cas, les résultats ne sont pas seulement techniques : ils façonnent les opportunités, sapent la confiance et comportent des risques commerciaux et éthiques réels.

📖 Pour en savoir plus : Risques et problèmes : quelle est la différence ?

Résumé : Comment se manifestent les biais de l'IA et qui sont les personnes concernées ?

| Où les biais sont-ils apparus ? | Qui a été touché ? | Impact dans le monde réel |

|---|---|---|

| Algorithmes de recrutement (outil d'embauche basé sur l'IA abandonné) | Femmes | Les CV ont été déclassés en fonction de mots-clés liés au genre, ce qui a réduit l'accès aux entretiens et aux opportunités d'emploi. |

| Systèmes de reconnaissance faciale (Gender Shades + cas d'arrestations injustifiées) | Femmes à la peau foncée ; groupes raciaux marginalisés | Des taux d'erreurs d'identification beaucoup plus élevés ont conduit à des arrestations injustifiées, à une atteinte à la réputation et à des problèmes liés aux droits civils. |

| Algorithmes de prédiction des risques dans le domaine de la santé (étude de l'université de Chicago) | Patients noirs | Les patients ont été privés de soins supplémentaires parce que les dépenses de santé ont été utilisées comme un indicateur erroné des besoins médicaux, ce qui a aggravé les inégalités en matière de santé. |

| Algorithmes de limite de crédit (enquête sur l'Apple Card) | Femmes | Les hommes ont bénéficié de limites de crédit nettement plus élevées que leurs partenaires féminines ayant les mêmes qualifications, ce qui a eu une incidence sur leur accès aux services financiers et leur capacité d'emprunt. |

| Reconnaissance vocale et sous-titrage automatique (étude ASR de Stanford) | Intervenants ayant un accent non standard ; intervenants noirs | Des taux d'erreur presque deux fois plus élevés ont créé des obstacles à l'accessibilité, des malentendus et des résultats biaisés dans les outils utilisés pour le recrutement, l'éducation et l'accès quotidien au numérique. |

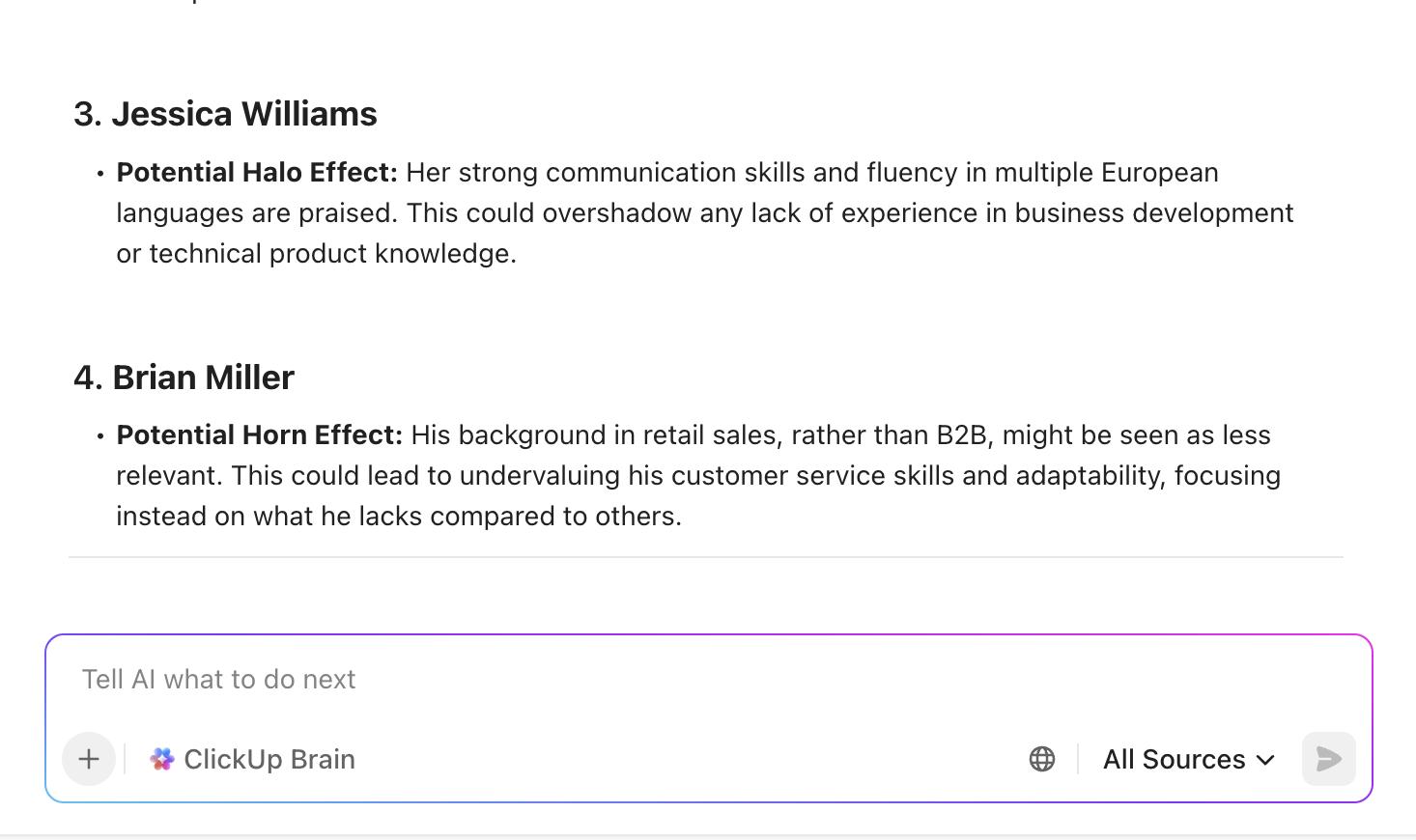

📖 Pour en savoir plus : Comment éviter les effets de halo et de corne pour atténuer les biais

Stratégies efficaces pour atténuer les biais

Il n'existe pas de solution miracle pour éliminer les biais de l'IA.

Pour atténuer efficacement les biais, il faut mettre en place une défense à plusieurs niveaux que vous appliquerez tout au long du cycle de vie de l'IA. En combinant ces stratégies éprouvées, vous pouvez réduire considérablement le risque de résultats injustes.

Collectez des données d'entraînement diversifiées

Des données représentatives constituent le fondement absolu d'une IA équitable.

Votre modèle ne peut pas apprendre à servir des groupes de personnes qu'il n'a jamais vus lors de sa formation. Commencez par auditer vos ensembles de données existants afin d'identifier les lacunes démographiques. Ensuite, faites un effort conscient pour obtenir de nouvelles données auprès des populations sous-représentées.

Lorsque les données réelles sont difficiles à trouver, vous pouvez utiliser des techniques telles que l'augmentation des données (création de copies modifiées des données existantes) ou la génération de données synthétiques pour aider à combler les lacunes.

🚧 Boîte à outils : utilisez le modèle de checklist d'audit interne de ClickUp pour planifier votre processus d'audit.

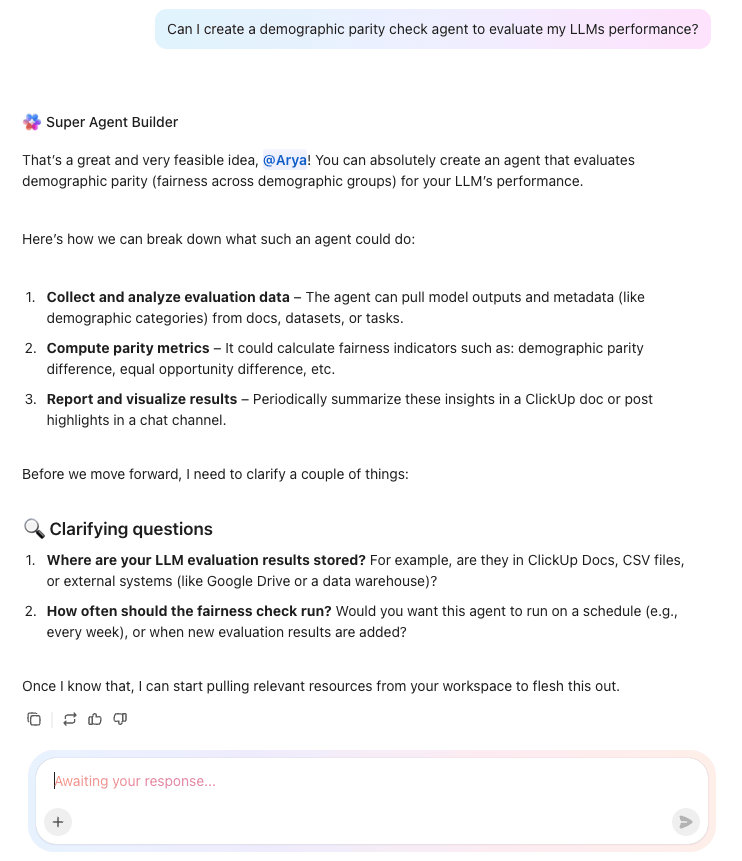

Testez les modèles pour détecter les biais

Vous devez tester systématiquement les biais afin de les détecter avant qu'ils ne causent de réels dommages. Utilisez des indicateurs d'équité pour mesurer les performances de votre modèle auprès de différents groupes.

Par exemple, la parité démographique vérifie si le modèle produit un résultat positif (tel que l'approbation d'un prêt) à des taux égaux entre les groupes, tandis que l'égalisation des chances vérifie si les taux d'erreur sont égaux.

Analysez les performances de votre modèle en fonction de tous les critères démographiques possibles (origine ethnique, sexe, âge, situation géographique) afin d'identifier les domaines dans lesquels la précision diminue ou l'injustice s'installe.

Gardez l'humain dans la boucle

Les systèmes automatisés peuvent passer à côté d'injustices subtiles et spécifiques au contexte qu'une personne repérerait immédiatement. Une approche impliquant l'intervention humaine est cruciale pour les décisions à haut risque, où l'IA peut faire une recommandation, mais où c'est une personne qui prend la décision finale.

Cela est particulièrement important dans des domaines tels que le recrutement, les prêts et les diagnostics médicaux. Pour que cela fonctionne, vos évaluateurs humains doivent être formés à reconnaître les biais et avoir le pouvoir de passer outre les suggestions de l'IA.

📖 Pour en savoir plus : Comment utiliser l'IA centrée sur l'humain sur le lieu de travail : le guide ultime

Appliquez des techniques d'équité algorithmique.

Vous pouvez également utiliser des méthodes techniques pour intervenir directement et réduire les biais. Ces techniques se répartissent en trois grandes catégories :

- Prétraitement : cela consiste à ajuster les données d'entraînement avant que le modèle ne les voie, souvent en les pondérant ou en les rééchantillonnant afin de créer une représentation plus équilibrée des différents groupes.

- En cours de traitement : ici, vous ajoutez des contraintes d'équité directement dans le processus d'entraînement du modèle, en lui apprenant à optimiser à la fois la précision et l'équité.

- Post-traitement : cela signifie ajuster les prédictions finales du modèle après qu'elles ont été faites afin de garantir que les résultats sont équitables pour tous les groupes.

Ces techniques impliquent souvent un compromis, où une légère diminution de la précision globale peut être nécessaire pour obtenir un gain significatif en matière d'équité.

💟 Bonus : BrainGPT est votre compagnon de bureau alimenté par l'IA qui fait passer les tests de biais de l'IA à un niveau supérieur en vous donnant accès à plusieurs modèles de pointe, notamment GPT-5, Claude, Gemini et bien d'autres, le tout en un seul endroit.

Cela signifie que vous pouvez facilement exécuter les mêmes invites ou scénarios sur différents modèles, comparer leurs capacités de raisonnement et repérer les divergences ou les biais dans les réponses. Cette super application d'IA vous permet également d'utiliser la fonction de reconnaissance vocale pour configurer des cas de test, documenter vos conclusions et organiser les résultats pour une analyse comparative.

Ses outils avancés de raisonnement et de reconnaissance du contexte vous aident à résoudre les problèmes, à mettre en évidence des tendances et à comprendre comment chaque modèle aborde les sujets sensibles. En centralisant votre flux de travail et en permettant des tests transparents et multimodèles, Brain MAX vous permet d'auditer, de comparer et de traiter les biais de l'IA avec confiance et précision.

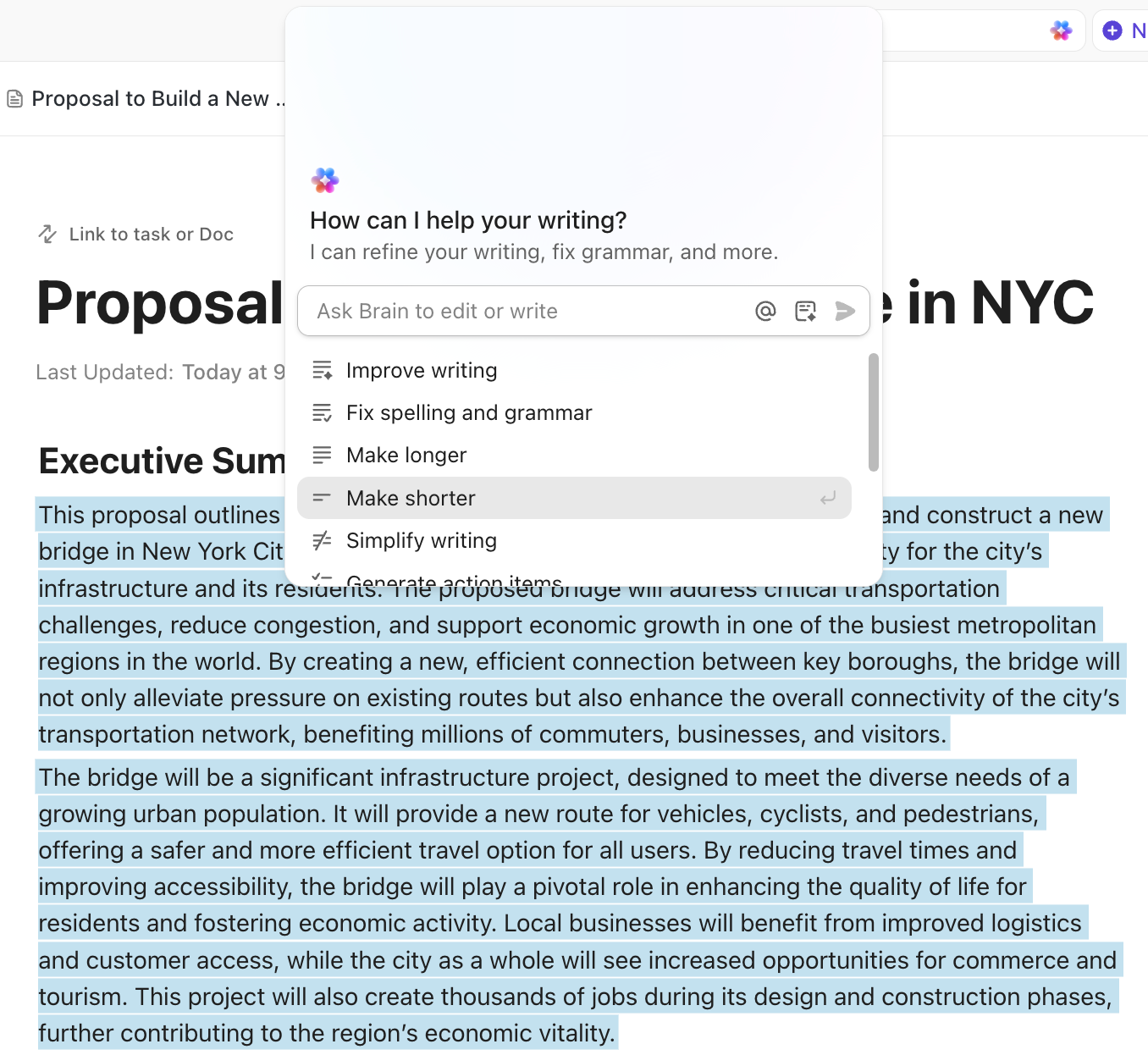

Améliorez la transparence et l'explicabilité.

Si vous ne savez pas comment votre modèle prend ses décisions, vous ne pouvez pas le corriger lorsqu'il se trompe. Les techniques d'IA explicable (XAI) vous aident à jeter un œil dans la « boîte noire » et à voir quelles fonctionnalités des données influencent les prédictions.

Vous pouvez également créer des cartes techniques, qui sont en quelque sorte des libellés nutritionnels pour votre IA, documentant son utilisation prévue, ses performances et ses limites connues.

📮ClickUp Insight : 13 % des personnes interrogées dans le cadre de notre sondage souhaitent utiliser l'IA pour prendre des décisions difficiles et résoudre des problèmes complexes. Cependant, seules 28 % d'entre elles déclarent utiliser régulièrement l'IA dans leur travail. Une raison possible : les préoccupations en matière de sécurité !

Les utilisateurs peuvent ne pas souhaiter partager des données sensibles relatives à la prise de décision avec une IA externe.

ClickUp résout ce problème en intégrant une solution de résolution de problèmes basée sur l'IA directement dans votre environnement de travail sécurisé. De la norme SOC 2 aux normes ISO, ClickUp est conforme aux normes de sécurité des données les plus strictes et vous aide à utiliser en toute sécurité la technologie d'IA générative dans votre environnement de travail.

Politiques de gouvernance et de responsabilité en matière d'IA

Un programme de gouvernance solide en matière d'IA établit des responsabilités claires et des normes cohérentes que tous les membres de l'équipe peuvent suivre.

Votre organisation a besoin de structures de gouvernance claires afin de garantir que quelqu'un soit toujours responsable de la création et du déploiement éthiques de l'IA.

Voici les éléments essentiels d'un programme efficace de gouvernance de l'IA :

| Élément de gouvernance | Ce que cela signifie | Étapes à suivre pour votre organisation |

|---|---|---|

| Propriété claire | Des personnes ou des équipes dédiées sont responsables de l'éthique, de la supervision et de la conformité de l'IA. | • Nommez un responsable de l'éthique de l'IA ou créez un comité interfonctionnel. • Définissez les responsabilités en matière de données, de qualité des modèles, de conformité et de risques. • Intégrez les points de vue des services juridiques, techniques, produits et DEI dans la supervision. |

| Politiques documentées | Directives écrites qui définissent comment les données sont collectées, utilisées et contrôlées tout au long du cycle de vie de l'IA. | • Créez des politiques internes pour l'approvisionnement en données, l'étiquetage, la confidentialité et la conservation des données • Documentez les normes pour le développement, la validation et le déploiement des modèles • Exigez des équipes qu'elles suivent des checklists avant de livrer tout système IA |

| Pistes d'audit | Un enregistrement transparent des décisions, des versions des modèles, des ensembles de données et des modifications | • Mettre en œuvre un contrôle de version pour les ensembles de données et les modèles • Consigner les décisions clés, les paramètres des modèles et examiner les résultats • Stocker les pistes d'audit dans un référentiel central et accessible |

| Révisions régulières | Évaluations continues des systèmes IA afin de vérifier l'absence de biais, de dérive et de lacunes en matière de conformité. | • Planifiez des évaluations trimestrielles ou semestrielles des biais grâce à une évaluation LLM robuste • Réentraînez ou recalibrez les modèles lorsque les performances diminuent ou que le comportement change • Revoyez les modèles après des mises à jour importantes des données ou des changements de produits |

| Plan d'intervention en cas d'incident | Un protocole clair pour identifier, signaler et corriger les biais ou les dommages causés par l'IA. | • Créez un flux de travail interne de signalement des biais • Définissez la manière dont les problèmes sont examinés et qui approuve les corrections • Décrivez les étapes de communication pour les utilisateurs, les clients ou les régulateurs, le cas échéant |

💡Conseil de pro : des cadres tels que le NIST IA Risk Management Framework et l'UE IA Act, qui prévoit des amendes pouvant atteindre 7 % du chiffre d'affaires annuel, peuvent fournir d'excellents modèles pour élaborer votre propre programme de gouvernance.

Comment mettre en œuvre l'atténuation des biais avec ClickUp

L'environnement de travail IA convergent de ClickUp rassemble tous les éléments mobiles de votre programme de gouvernance IA dans un environnement de travail organisé.

Vos équipes peuvent gérer les tâches, stocker les politiques, examiner les résultats d'audit, discuter des risques et suivre les incidents sans passer d'un outil à l'autre ni perdre le contexte. Chaque enregistrement de modèle, journal de décision et plan de correction reste lié, de sorte que vous savez toujours qui a fait quoi et pourquoi.

Et comme l'IA de ClickUp comprend le travail effectué dans votre environnement de travail, elle peut faire ressortir les évaluations passées, résumer les longs rapports et aider votre équipe à rester alignée à mesure que les normes évoluent. Le résultat est un système de gouvernance plus facile à suivre, plus facile à auditer et beaucoup plus fiable à mesure que votre empreinte IA s'étend.

Décomposons cela en un flux de travail !

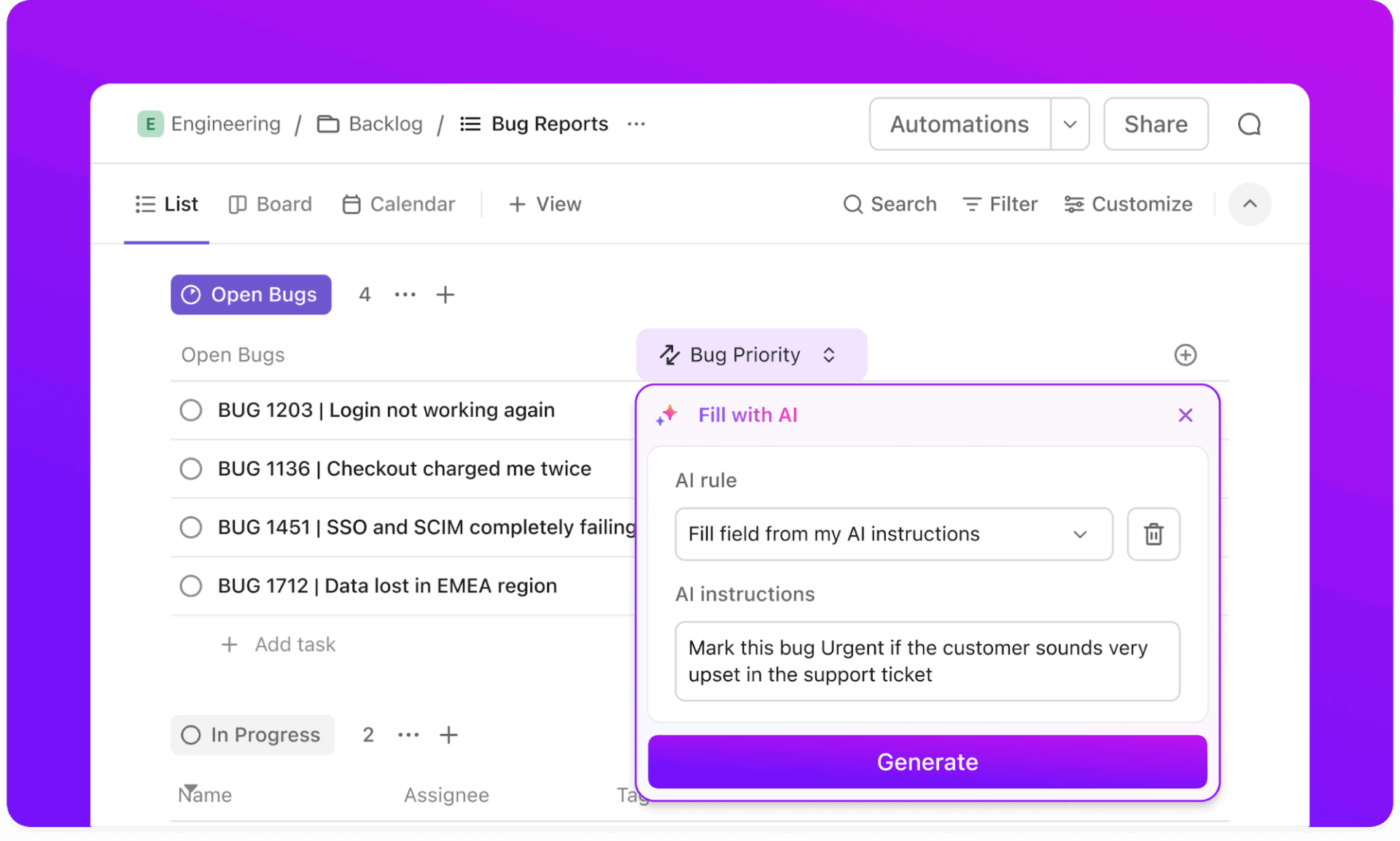

Étape 1 : Configurez votre environnement de travail dédié à la gouvernance de l'IA

Commencez par créer un espace dédié dans ClickUp pour tous les travaux liés à la gouvernance. Ajoutez des listes pour votre inventaire de modèles, vos évaluations de biais, vos rapports d'incidents, vos documents de politique et vos révisions programmées afin que chaque élément du programme se trouve dans un environnement contrôlé.

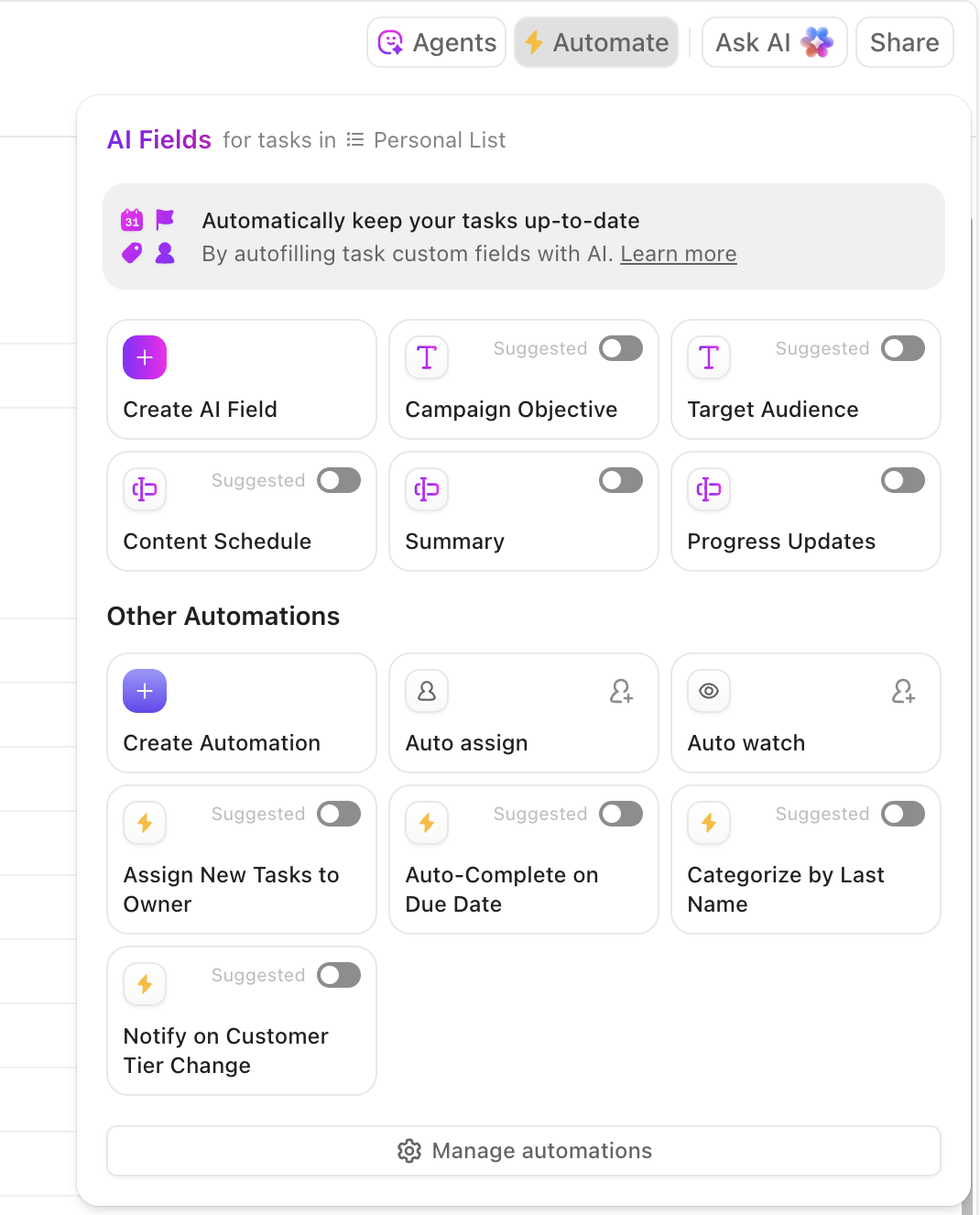

Configurez des champs personnalisés ou des champs IA pour suivre les indicateurs d'équité, les scores de biais, les versions des modèles, le statut des révisions et les niveaux de risque. Utilisez des autorisations basées sur les rôles pour vous assurer que seuls les réviseurs, ingénieurs et responsables de la conformité autorisés peuvent accéder aux travaux sensibles liés à l'IA. Cela crée une base structurelle que les outils ponctuels et les plateformes de projet génériques de vos concurrents ne peuvent pas offrir.

Étape 2 : Élaborez votre cadre de gouvernance

Ensuite, créez un document ClickUp qui servira de guide de gouvernance évolutif. C'est là que vous définirez vos procédures d'évaluation des biais, vos seuils d'équité, vos directives en matière de documentation des modèles, vos étapes d'intervention humaine et vos protocoles d'escalade.

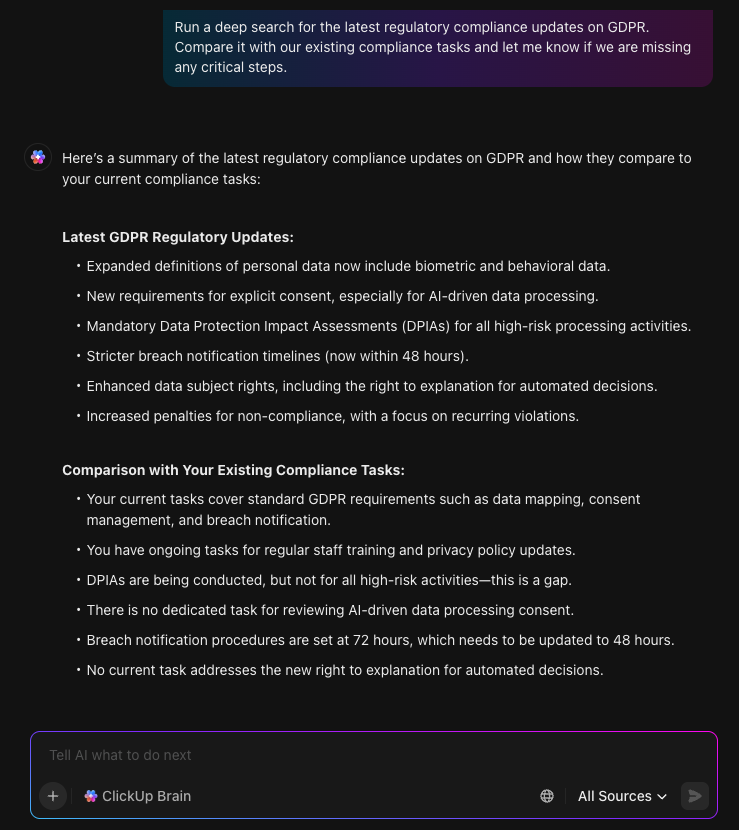

Comme les documents restent liés aux tâches et aux enregistrements de modèles, vos équipes peuvent collaborer sans perdre l'historique des versions ni disperser les fichiers entre différents outils. Ensuite, ClickUp Brain peut aider à résumer les réglementations externes, à rédiger de nouveaux textes de politique ou à faire ressortir les conclusions d'audits antérieurs, rendant ainsi la création de politiques plus cohérente et plus traçable.

Grâce à sa capacité à effectuer des recherches sur le Web, à passer d'un modèle d'IA à un autre et à synthétiser les informations pour fournir des conseils clairs, votre équipe reste au fait des nouvelles normes et des changements dans le secteur sans quitter son environnement de travail. Tout ce dont vous avez besoin, qu'il s'agisse de mises à jour des politiques, d'informations réglementaires ou de décisions antérieures, est regroupé en un seul endroit, ce qui rend votre système de gouvernance plus stable et beaucoup plus facile à maintenir.

Étape 3 : Enregistrer chaque modèle

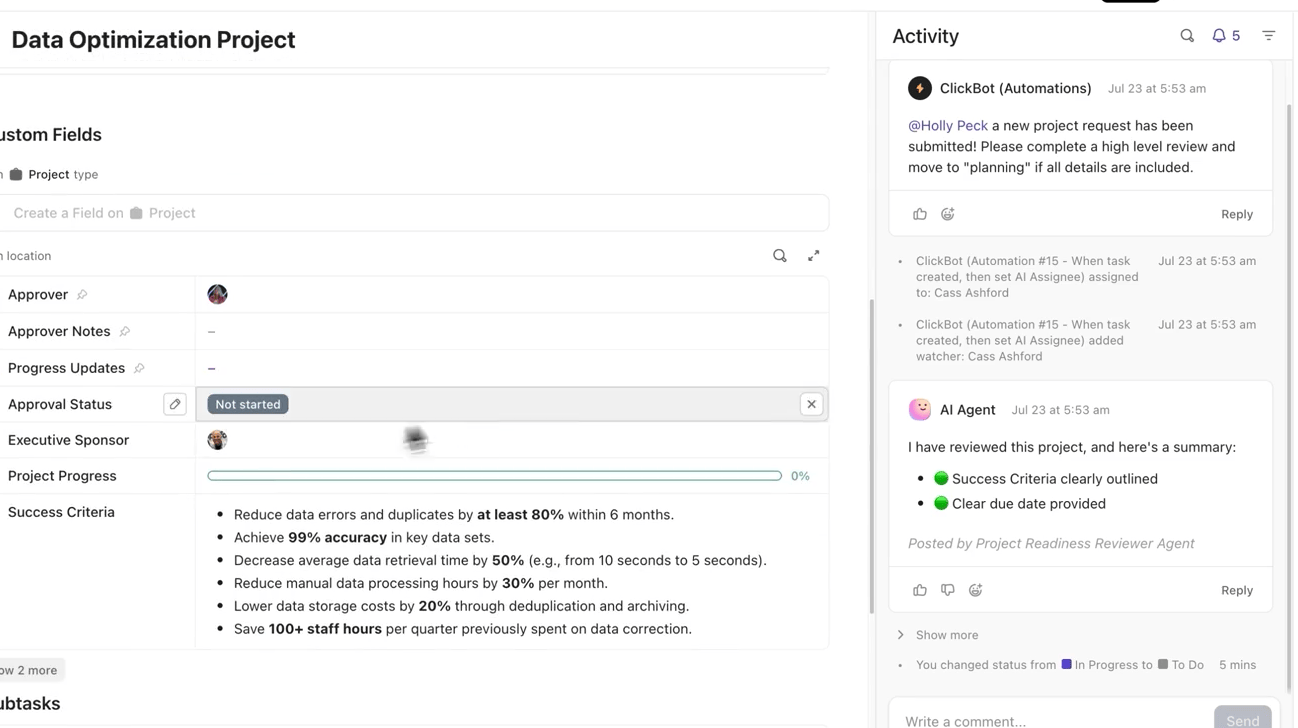

Chaque modèle doit avoir sa propre tâche dans la liste « Inventaire des modèles » afin que la propriété et la responsabilité soient toujours claires.

Suivez facilement chaque incident de biais en tant qu'élément exploitable à l'aide de tâches ClickUp et de champs personnalisés pour structurer vos flux de travail d'évaluation des biais et saisir chaque détail important.

Vous pourrez ainsi suivre le type de biais, son niveau de gravité, le statut des mesures correctives, le membre de l'équipe responsable et la date de la prochaine révision, en vous assurant que chaque problème est clairement attribué à un responsable et assorti d'une échéance.

Joignez les ensembles de données, les résumés d'évaluation et les notes de lignage afin que tout soit regroupé au même endroit. Les automatisations peuvent alors alerter les réviseurs chaque fois qu'un modèle passe à l'étape de test ou de production.

Étape 4 : Effectuez des audits de biais programmés et basés sur les évènements

Les audits de biais doivent être effectués à intervalles réguliers et en réponse à des déclencheurs spécifiques.

Configurez des règles simples via ClickUp Automatisations qui déclenchent automatiquement des tâches de révision chaque fois qu'un modèle atteint un nouveau jalon de déploiement ou qu'un audit prévu doit être effectué. Vous ne manquerez plus jamais une évaluation trimestrielle des biais, car ClickUp Automatisations peut assigner les bons réviseurs, fixer les délais appropriés et même envoyer des rappels à l'approche des dates d'échéance.

Pour les audits basés sur les évènements, ClickUp Forms facilite la collecte des rapports d'incidents liés aux biais ou des commentaires humains, tandis que les évaluateurs utilisent des champs personnalisés pour consigner les écarts en matière d'équité, les résultats des tests et les recommandations. Chaque formulaire soumis est transmis à votre équipe sous forme de tâche, ce qui crée une voie d'audit reproductible.

Étape 5 : Enquêter sur les incidents liés aux biais et les résoudre

Lorsqu'un problème de biais est identifié, créez une tâche d'incident qui capture la gravité, les groupes touchés, la version du modèle et le travail d'atténuation requis. Les agents IA peuvent escalader les résultats à haut risque aux responsables de la conformité et assigner les bons réviseurs et ingénieurs.

Chaque mesure d'atténuation, résultat de test et étape de validation reste lié au dossier de l'incident. ClickUp Brain peut générer des résumés à l'intention de la direction ou aider à préparer des notes de correction pour votre documentation de gouvernance, garantissant ainsi la transparence et la traçabilité de tout ce qui concerne l'incident.

Étape 6 : Surveillez la santé de votre programme de gouvernance de l'IA

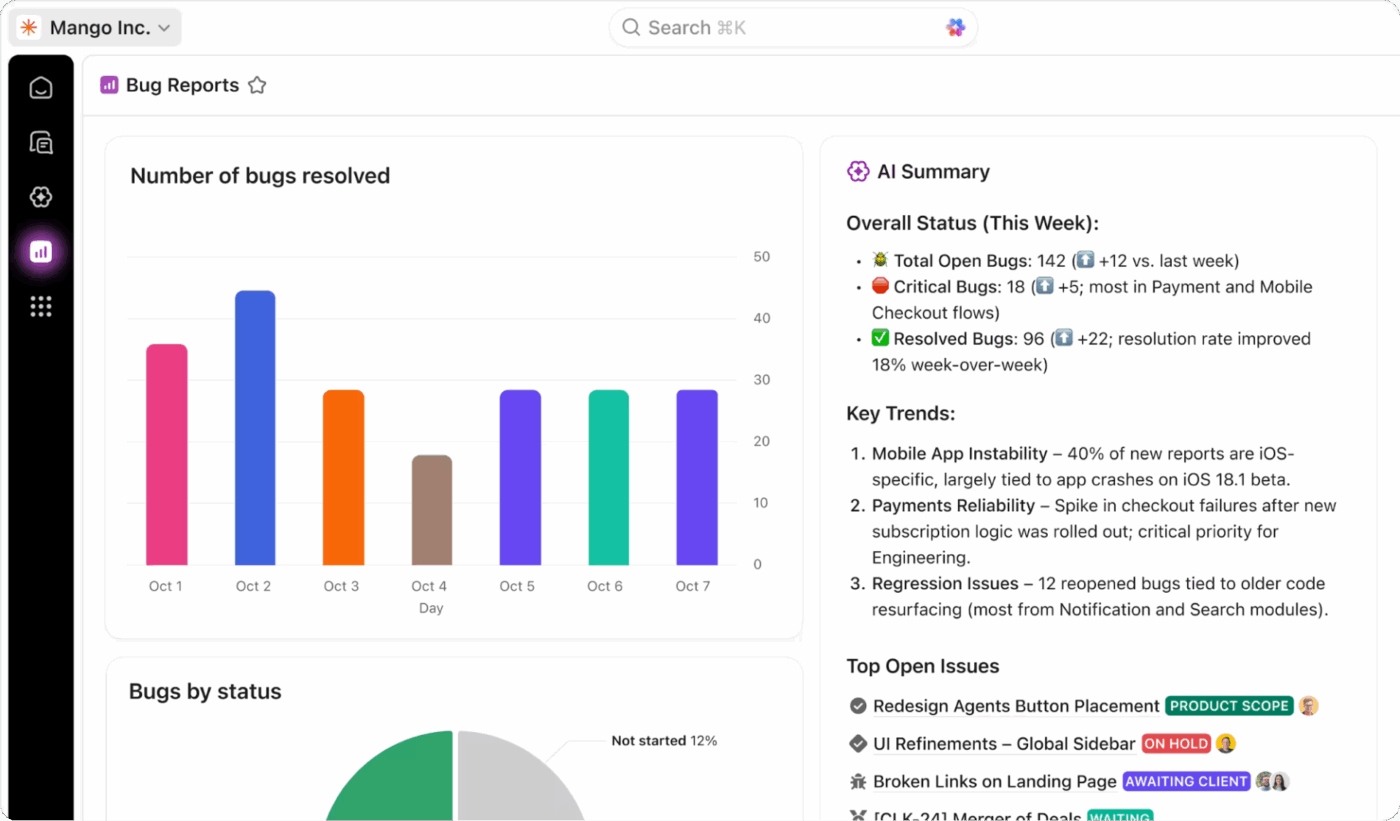

Enfin, créez des tableaux de bord qui affichent aux dirigeants une vue en temps réel de votre programme d'atténuation des biais.

Incluez des tableaux présentant les incidents ouverts, le délai de résolution, les taux d'achèvement des audits, les mesures d'équité et l'état de conformité pour tous les modèles actifs. Les tableaux de bord sans code de ClickUp peuvent automatiquement extraire des données et mettre à jour les tâches au fur et à mesure de l'avancement du travail, avec des résumés IA intégrés à votre vue du tableau de bord.

📖 Pour en savoir plus : Comment surmonter les défis courants liés à l'IA

Contrôles des biais après le déploiement

Votre travail n'est pas terminé lorsque le modèle IA est mis en service.

En réalité, c'est à ce moment-là que le véritable test commence. Les modèles peuvent « dériver » et développer de nouveaux biais au fil du temps, à mesure que les données réelles qu'ils traitent commencent à changer. Une surveillance continue est le seul moyen de détecter ces biais émergents avant qu'ils ne causent des dommages à grande échelle.

Voici ce que votre surveillance continue devrait inclure :

| Pratique | Ce que cela garantit |

|---|---|

| Suivi des performances par groupe | Mesurez en permanence la précision et l'équité des modèles dans tous les segments démographiques afin de détecter rapidement les disparités. |

| Détection des dérives de données | Surveille les changements dans les données d'entrée qui pourraient introduire de nouveaux biais ou affaiblir les performances du modèle au fil du temps. |

| Boucles de rétroaction des utilisateurs | Fournit des canaux clairs permettant aux utilisateurs de signaler les résultats biaisés ou incorrects, améliorant ainsi la supervision dans le monde réel. |

| Audits programmés | Assure une analyse approfondie trimestrielle ou semestrielle du comportement des modèles, des indicateurs d'équité et des exigences de conformité. |

| Réponse aux incidents | Définit un processus structuré pour enquêter, corriger et documenter tout évènement de biais signalé. |

💟 Bonus : les systèmes d'IA générative, en particulier, nécessitent une vigilance accrue, car leurs résultats sont beaucoup moins prévisibles que ceux des modèles d'apprentissage automatique traditionnels. Une excellente technique pour cela est le red-teaming, qui consiste à charger une équipe dédiée de provoquer activement des réponses biaisées ou nuisibles de la part du modèle afin d'identifier ses points faibles.

Par exemple, le projet Lighthouse d'Airbnb est un excellent exemple dans le secteur, qui montre comment une entreprise met en œuvre un suivi systématique des biais après le déploiement.

Il s'agit d'une initiative de recherche qui examine comment la perception de l'origine ethnique peut influencer les résultats des réservations, aidant ainsi l'entreprise à identifier et à réduire la discrimination sur la plateforme. Elle utilise des méthodes respectueuses de la confidentialité, s'associe à des groupes de défense des droits civiques et traduit les résultats en changements de produits et de politiques, permettant ainsi à davantage d'invités de naviguer sur la plateforme sans rencontrer d'obstacles invisibles.

📖 Pour en savoir plus : IA générative vs IA prédictive : comprendre leurs différences et leurs applications

Atténuez les biais de l'IA avec ClickUp

La mise en place d'une IA équitable et responsable est un engagement organisationnel.

Lorsque vos politiques, vos collaborateurs, vos processus et vos outils fonctionnent en harmonie, vous créez un système de gouvernance capable de s'adapter aux nouveaux risques, de réagir rapidement aux incidents et de gagner la confiance des personnes qui utilisent vos produits.

Grâce à des examens structurés, une documentation claire et un flux de travail reproductible pour gérer les biais, les équipes restent alignées et responsables, plutôt que de réagir en mode crise.

En centralisant tout dans ClickUp, des enregistrements de modèles aux résultats d'audit en passant par les rapports d'incident, vous créez une couche opérationnelle unique où les décisions sont transparentes, les responsabilités claires et les améliorations jamais perdues dans la confusion.

Une gouvernance solide ne ralentit pas l'innovation, elle la stabilise. Prêt à intégrer l'atténuation des biais dans vos flux de travail d'IA ? Commencez gratuitement avec ClickUp et lancez-vous dès aujourd'hui dans la création de votre programme de gouvernance de l'IA.

Foire aux questions

Une excellente première étape consiste à réaliser un audit des biais de vos systèmes IA existants. Cette évaluation de référence vous montrera où se situent actuellement les injustices et vous aidera à hiérarchiser vos efforts d'atténuation.

Les équipes utilisent des indicateurs d'équité spécifiques, tels que la parité démographique, l'égalité des chances et le ratio d'impact disparate, pour quantifier les biais. Le choix de l'indicateur approprié dépend de votre cas d'utilisation spécifique et du type d'équité qui est le plus important dans ce contexte.

Vous devez toujours ajouter une étape de révision humaine pour les décisions à haut risque qui ont un impact significatif sur la vie ou les opportunités d'une personne, comme dans le domaine du recrutement, du crédit ou des soins de santé. Il est également judicieux de l'utiliser lors du déploiement initial de tout nouveau modèle, lorsque son comportement est encore imprévisible.

Comme l'IA générative peut produire un intervalle presque infini de réponses imprévisibles, vous ne pouvez pas vous contenter de vérifier son exactitude. Vous devez utiliser des techniques de sondage actives, telles que le red teaming et l'échantillonnage à grande échelle des résultats, afin de déterminer si le modèle produit des contenus biaisés dans différentes conditions.