AI önyargısı bir teknoloji sorunu gibi görünebilir. Ancak etkileri gerçek dünyada da görülür ve çoğu zaman yıkıcı olabilir.

Bir AI sistemi yanlış yönde eğilimli olduğunda, bu eğilim ne kadar küçük olursa olsun, adil olmayan sonuçlara yol açabilir.

Ve zamanla, bu küçük sorunlar müşterilerin memnuniyetsizliğine, itibar sorunlarına ve hatta öngöremediğiniz uyum sorunlarına dönüşebilir.

Çoğu takım, önyargılı bir AI oluşturmak için yola çıkmaz. Bu durum, verilerin dağınık olması, gerçek dünyanın dengesiz olması ve kullandığımız araçların her zaman beklediğimiz şekilde çalışmaması nedeniyle ortaya çıkar. İyi haber ise, neler olup bittiğini anlamak için veri bilimcisi olmanıza gerek olmamasıdır.

Bu blogda, AI önyargısının gerçekte ne olduğunu, neden ortaya çıktığını ve günlük iş araçlarında nasıl ortaya çıkabileceğini anlatacağız.

AI Önyargısı Nedir?

AI önyargısı, yapay zeka sisteminin belirli grupları sürekli olarak kayırarak veya dezavantajlı duruma düşürerek sistematik ve adaletsiz sonuçlar üretmesidir. Bunlar rastgele hatalar değildir; AI'nın karar verme sürecine yerleşmiş, öngörülebilir kalıplardır. Nedeni nedir? AI, mevcut insan önyargılarını, diğer bilinçsiz önyargıları ve toplumsal eşitsizlikleri yansıtan verilerden öğrenir.

Şöyle düşünün: 90%'ı erkek olan yöneticilerin bulunduğu on yıllık şirket verileriyle bir işe alım algoritması eğitirseniz, AI erkek olmanın yönetim rolü için anahtar bir nitelik olduğunu yanlış bir şekilde öğrenebilir. AI kötü niyetli değildir; sadece kendisine gösterilen kalıpları tanımlayıp tekrarlar.

AI önyargısını bu kadar zorlu kılan şey şudur:

- Bu sistematik bir durumdur, rastgele değildir: Adaletsizlik tek seferlik bir hata değil, AI çıktılarının tekrarlanabilir bir modelidir.

- Genellikle görünmez: Önyargılı sonuçlar, görünüşte tarafsız bir algoritmanın karmaşık matematiğinin arkasına gizlenebilir ve bu da onları tespit etmeyi zorlaştırır.

- Veriler ve tasarımda kök salmıştır: Önyargı, biz insanlar yapay zekayı oluştururken ve eğittiğimizde yaptığımız seçimler yoluyla sisteme girer.

⭐ Öne Çıkan Şablon

ClickUp'ın Olay Müdahale Raporu Şablonu , olayları baştan sona belgelemek, izlemek ve çözmek için hazır bir yapı sunar . İlgili tüm olay ayrıntılarını kaydedin, açıkça kategorize edilmiş durumları koruyun ve ciddiyet, etkilenen gruplar ve düzeltme adımları gibi önemli özellikleri yakalayın. Onaylayan, Olay notları ve Destekleyici belgeler gibi öğeler için Özel Alanları destekler ve bu da inceleme süreci boyunca hesap verebilirliği ve kanıtları ortaya çıkarmaya yardımcı olur.

📖 Daha fazla bilgi: Risk Değerlendirmesi Nasıl Yapılır: Araçlar ve Teknikler

AI Önyargısını Azaltmak Neden Önemlidir?

AI sistemleriniz adil değilse, gerçek insanların hayatlarına zarar verme riskiyle karşı karşıya kalırsınız.

Bu da kuruluşunuzu ciddi iş zorluklarına maruz bırakır ve müşterilerinizle kurmak için çok uğraştığınız güveni bile yok edebilir.

Birine kredi vermeyi reddeden, iş başvurusunu geri çeviren veya yanlış bir öneride bulunan önyargılı bir AI, gerçek dünyada ciddi sonuçlar doğurur.

Gelişmekte olan endüstri standartları ve çerçeveleri, kuruluşları AI sistemlerindeki önyargıları aktif olarak belirlemeye ve ele almaya teşvik ediyor. Riskler, kuruluşunuzu her açıdan etkiliyor:

- Düzenleme riski: Yeni AI standartlarını karşılamamak, önemli iş zorluklarının sonucunu doğurabilir.

- İtibar kaybı: Kamuoyu, AI'nızın önyargılı olduğunu öğrendiğinde, güvenini geri kazanmak son derece zor hale gelir.

- Operasyonel verimsizlik: Önyargılı modeller, güvenilmez sonuçlar veya AI halüsinasyonları üretir, bu da kötü kararlar alınmasına ve pahalı düzeltmeler yapılmasına neden olur.

- Etik sorumluluk: Kuruluşunuz, kullandığınız teknolojinin tüm kullanıcıları adil bir şekilde ele aldığından emin olmalıdır.

Önyargıyı doğru bir şekilde azaltırsanız, insanların gerçekten güvenebileceği AI sistemleri oluşturursunuz. Adil AI, yeni pazarlara kapı açar, kararlarınızın kalitesini artırır ve etik bir iş yürütmeye komiteli olduğunuzu herkese gösterir.

📮 ClickUp Insight: Ankete katılanların %22'si iş yerinde AI kullanımı konusunda hala temkinli davranıyor. Bu %22'nin yarısı veri gizliliği konusunda endişeli, diğer yarısı ise AI'nın verdiği bilgilere güvenip güvenemeyeceğinden emin değil.

ClickUp, sağlam güvenlik önlemleri ve her cevapla birlikte görevlere ve kaynaklara ayrıntılı bağlantılar oluşturarak her iki sorunu da doğrudan ele alır.

Bu, tedbirli takımlar bile, bilgilerinin korunup korunmadığını veya güvenilir sonuçlar alıp almadıklarını düşünerek uykularını kaçırmadan verimlilik artışının keyfini çıkarmaya başlayabilecekleri anlamına gelir.

📖 Daha fazla bilgi: AI Uyumluluk Asistanı: AI, Uyumluluk ve Denetimleri Nasıl Dönüştürüyor?

AI Önyargısının Türleri ve Kaynakları

Önyargılar, AI sistemlerinize birçok yönden sızabilir.

Veri toplamaya başladığınız andan sistemin devreye alınmasından çok sonraya kadar, bu unsur bir şekilde sabit kalır. Ancak nereye bakmanız gerektiğini bilirseniz, çabalarınızı hedefleyebilir ve haksız sonuçlarla sonsuz bir "köstebek avı" oyununu oynamaktan vazgeçebilirsiniz.

Örnekleme önyargısı

Örnekleme önyargısı, AI'nızı eğitmek için kullandığınız verilerin, AI'nın kullanılacağı gerçek dünyayı doğru bir şekilde temsil etmemesi durumunda ortaya çıkar.

Örneğin, çoğunlukla Amerikan İngilizcesi konuşanların verileriyle eğitilmiş bir ses tanıma sistemi kurarsanız, bu sistem doğal olarak İskoç veya Hint aksanlı kişileri anlamakta zorlanacaktır. Bu durum, LLM'lerin özgeçmiş taramalarında %85,1 oranında beyazlarla ilişkili isimleri tercih etmesine benzer. Bu yetersiz temsil, büyük kör noktalar yaratarak modelinizin tüm insan gruplarına hizmet vermeye hazır olmamasını sağlar.

Algoritmik önyargı

Algoritmik önyargı, veriler tarafsız görünse bile, modelin tasarımı veya matematiksel süreci adaletsiz kalıpları güçlendirdiğinde ortaya çıkar.

Bir kişinin posta kodu, kredi alıp almayacağına karar vermemelidir, ancak eğitim verilerinizdeki posta kodları ırkla güçlü bir şekilde ilişkiliyse, algoritma konumu ayrımcılık için bir gösterge olarak kullanmayı öğrenebilir.

Bu sorun, geri bildirim döngüleriyle daha da kötüleşir; önyargılı bir tahmin (örneğin, bir kredinin reddedilmesi) yeni veri olarak sisteme geri beslendiğinde, önyargı zamanla daha da yoğunlaşır.

İnsan karar önyargısı

Bir kişi AI sistemi oluştururken yaptığı her seçim önyargıya yol açabilir.

Bu, hangi verilerin toplanacağına, nasıl etiketleneceğine ve model için "başarı"nın nasıl tanımlanacağına karar vermeyi içerir. Örneğin, bir takım bilinçsizce, zaten inandıkları şeyi destekleyen verileri tercih edebilir (onay önyargısı) veya gördükleri ilk bilgiye çok fazla ağırlık verebilir (bağlama önyargısı).

En iyi niyetli takımlar bile, kendi varsayımlarını ve dünya görüşlerini yanlışlıkla bir AI sistemine kodlayabilir.

📖 Daha fazla bilgi: Görevleri Yönetmek için 10 Proje Yönetişim Şablonu

Gerçek Dünyadan AI Önyargı Örnekleri

Gerçek şirketler, AI sistemlerinin önyargılı davranması sonucunda milyonlarca dolarlık zarara uğramış ve müşteri güvenini kaybetmişlerdir. İşte birkaç belgelenmiş örnek:

1. Önyargılı işe alım araçları

En çok alıntılanan vakalardan biri, büyük bir teknoloji şirketinin, erkek adayları kadınlara göre tercih ettiğini öğrendikten sonra dahili AI işe alım sistemini kaldırmasıydı. Sistem, en başarılı başvuru sahiplerinin çoğunun erkek olduğu on yıllık özgeçmişler üzerinde eğitilmişti. Böylece, "kadınlar" gibi kelimeler içeren özgeçmişleri cezalandırmaya başladı ve hatta kadın üniversitelerinden mezun olanları daha düşük derecelendirdi.

Bu, geçmişteki kalıpların mevcut eşitsizliği yansıttığı durumlarda tarihsel veri önyargısının, dikkatli bir şekilde denetlenmediği takdirde otomasyona nasıl sızabileceğini göstermektedir. Ancak, AI ile otomatikleştirilmiş işe alımların yaygınlaşmasıyla birlikte, sorunun boyutu daha da büyüyor.

🌼 Biliyor muydunuz: Son veriler, kuruluşların %37'sinin artık işe alım sürecinde Gen AI araçlarını "aktif olarak entegre ettiğini" veya "denediğini" gösteriyor. Bu oran bir yıl önce %27 idi.

2. Nüfusun yarısını kaçıran yüz tanıma

Joy Buolamwini tarafından yürütülen ve Gender Shades çalışmasında belgelenen araştırma , ticari yüz tanıma sistemlerinin koyu tenli kadınlar için %34,7'ye varan hata oranlarına sahip olduğunu ortaya koydu. Bu oran, açık tenli erkekler için %1'in altındaydı.

Bu da yine dengesiz eğitim veri kümelerinin bir yansımasıdır. Biyometrik araçlardaki önyargıların etkileri daha da geniş kapsamlıdır.

Polis ve devlet kurumları da önyargılı yüz tanıma ile ilgili sorunlarla karşılaşmıştır. The Washington Post 'un araştırmaları, bu sistemlerin bazılarının marjinal gruplara mensup kişileri yanlış tanımlama olasılığının çok daha yüksek olduğunu ortaya koymuştur . Birkaç gerçek vakada, bu durum haksız tutuklamalara, kamuoyunun tepkisine ve bu araçların insanların haklarını nasıl etkilediği konusunda büyük endişelere yol açmıştır.

📖 Daha fazla bilgi: İşyerinde AI: Verimlilik ve Etkinliği Artırmanın Yolları

3. Bakımı önceliklendirmeyen sağlık algoritmaları

Ekstra bakıma ihtiyaç duyan hastaları tahmin etmek için tasarlanmış sağlık AI sistemleri de önyargı göstermiştir.

İyi belgelenmiş bir vakada, yaygın olarak kullanılan bir sağlık tahmin algoritması önemli bir hata yaptı. Bu algoritma, hangi hastaların ekstra bakım alması gerektiğine karar vermeye yardımcı olması gerekiyordu, ancak sonuçta, beyaz hastalara eşit veya daha fazla hasta olsalar bile, sistematik olarak siyahi hastalara daha düşük öncelik verdi.

Bu durum, modelin sağlık harcamalarını tıbbi ihtiyaçların bir göstergesi olarak kullanması nedeniyle meydana geldi. Siyah hastalar, sağlık hizmetlerine eşit erişim imkânına sahip olmadıkları için tarihsel olarak daha düşük sağlık harcamalarına sahip olduklarından, algoritma onları daha az ihtiyaç sahibi olarak değerlendirdi. Sonuç olarak, algoritma sağlık kaynaklarını en çok ihtiyaç duyanlardan uzaklaştırdı. Araştırmacılar, bu göstergenin düzeltilmesinin adil sağlık programlarına erişimi önemli ölçüde artırabileceğini keşfettiler.

Bu sorunlarla ilgili endişeler, sivil hak gruplarını sağlık hizmetlerinde yapay zeka için "eşitlik öncelikli" standartlar talep etmeye yöneltmiştir. Aralık 2025'te NAACP, ırksal sağlık eşitsizliklerinin derinleşmesini önlemek için hastaneler, teknoloji şirketleri ve politika yapıcıları önyargı denetimleri, şeffaf tasarım uygulamaları, kapsayıcı çerçeveler ve yapay zeka yönetişim araçlarını benimsemeye çağıran ayrıntılı bir plan yayınladı.

4. Eşit olmayan sonuçlar veren kredi algoritmaları

AI ve otomasyon, yalnızca sosyal medyada gördüklerinizi şekillendirmekle kalmaz, aynı zamanda kimin ne şartlarda paraya erişebileceğini de etkiler.

En çok konuşulan gerçek dünya örneklerinden biri, Goldman Sachs tarafından çıkarılan dijital kredi kartı Apple Card 'tan geldi.

2019 yılında, sosyal medyadaki müşteriler, kartın kredi limiti algoritmasının bazı erkeklere eşlerine veya kadın partnerlerine göre çok daha yüksek sınırlar verdiğini paylaştılar. Bu durum, çiftlerin benzer finansal profiller bildirmelerine rağmen meydana geldi. Bir yazılım mühendisi, eşinden 20 kat daha yüksek bir sınır aldığını söyledi ve Apple'ın kurucu ortağı Steve Wozniak bile eşiyle ilgili benzer bir deneyim yaşadığını doğruladı.

Bu örüntüler kamuoyunda büyük tepki yarattı ve New York Eyaleti Finansal Hizmetler Departmanı'nın algoritmanın kadınlara karşı ayrımcılık yapıp yapmadığını araştırmasına yol açtı. Bu olay, otomasyonun finansal araçlarda nasıl eşitsiz sonuçlar üretebileceğini ortaya koydu.

📖 Daha fazla bilgi: Veri Yönetişimi için AI'yı Kullanma (Kullanım Örnekleri ve Araçlar)

5. Sesleri hariç tutan otomasyonlu altyazılar ve ses tanıma

Konuşma tanıma ve otomasyonlu altyazı sistemleri genellikle herkesi eşit şekilde duymaz. Birçok çalışma, bu araçların aksan, lehçe, ırk ve konuşmacının ana dilinin İngilizce olup olmadığı gibi faktörlere bağlı olarak bazı konuşmacılar için diğerlerine göre daha iyi çalıştığını göstermiştir.

Bunun nedeni, ticari sistemlerin genellikle belirli konuşma kalıplarının (genellikle Batı İngilizcesi ve standart İngilizce) hakim olduğu veri kümeleriyle eğitilmesi ve diğer seslerin yeterince temsil edilmemesidir.

Örneğin, Stanford'daki araştırmacılar beş önde gelen konuşma-metin dönüştürme sistemini (Amazon, Google, Microsoft, IBM ve Apple'dan) test ettiler ve siyah konuşmacıların konuşmalarını beyaz konuşmacıların konuşmalarına kıyasla neredeyse iki kat daha fazla hata yaptıklarını tespit ettiler. Bu sorun, denekler aynı koşullarda aynı kelimeleri söyleseler bile ortaya çıkıyordu.

Bazı konuşmacılar için altyazılar yanlış olduğunda, altyazılara güvenen kişiler için kötü bir kullanıcı deneyimi ve erişilemezlik sorunları ortaya çıkabilir. Daha da kötüsü, işe alım, eğitim veya sağlık hizmetleri alanlarında konuşma tanıma kullanan sistemlerde önyargılı sonuçlara yol açabilir.

Bu örneklerin her biri, çarpık eğitim verileri, kötü seçilmiş vekiller veya temsil edici olmayan testler yoluyla önyargının otomasyon sistemlerine nasıl yerleştirilebileceğini gösteren farklı bir yolu göstermektedir. Her durumda, sonuçlar sadece teknik değildir; fırsatları şekillendirir, güveni zedeler ve gerçek iş ve etik riskler taşır.

📖 Daha fazla bilgi: Riskler ve Sorunlar – Aralarındaki Fark Nedir?

Özet: AI önyargısı nasıl ortaya çıkar ve kimleri etkiler?

| Önyargının ortaya çıktığı yerler | Kimler etkilendi | Gerçek dünyadaki etkisi |

|---|---|---|

| İşe alım algoritmaları (hurdaya ayrılmış AI işe alım aracı) | Kadınlar | Özgeçmişler, cinsiyete dayalı anahtar kelimelere göre derecelendirilerek, mülakatlara ve iş fırsatlarına erişim azaltıldı. |

| Yüz tanıma sistemleri (Cinsiyet Tonları + haksız tutuklama vakaları) | Koyu tenli kadınlar; marjinalleştirilmiş ırk grupları | Çok daha yüksek yanlış tanımlama oranları, haksız tutuklamalara, itibar kaybına ve sivil haklar endişelerine yol açtı. |

| Sağlık hizmetleri risk tahmin algoritmaları (Chicago Üniversitesi araştırması) | Siyah hastalar | Sağlık harcamaları tıbbi ihtiyaçların yerine geçmek üzere hatalı bir şekilde kullanıldığından, hastalar ekstra bakım konusunda öncelik sıralamasında geriye düştüler ve bu da sağlık eşitsizliklerini daha da kötüleştirdi. |

| Kredi sınır algoritmaları (Apple Card araştırması) | Kadınlar | Erkekler, eşit niteliklere sahip kadın ortaklara göre önemli ölçüde daha yüksek kredi sınırları aldılar ve bu durum finansal erişim ve borçlanma gücünü etkiledi. |

| Konuşma tanıma ve otomatik altyazılar (Stanford ASR çalışması) | Standart olmayan aksanları olan konuşmacılar; Siyah konuşmacılar | Hata oranlarının neredeyse iki katına çıkması, işe alım, eğitim ve günlük dijital erişimde kullanılan araçlarda erişilebilirlik engelleri, yanlış iletişim ve önyargılı sonuçlara yol açtı. |

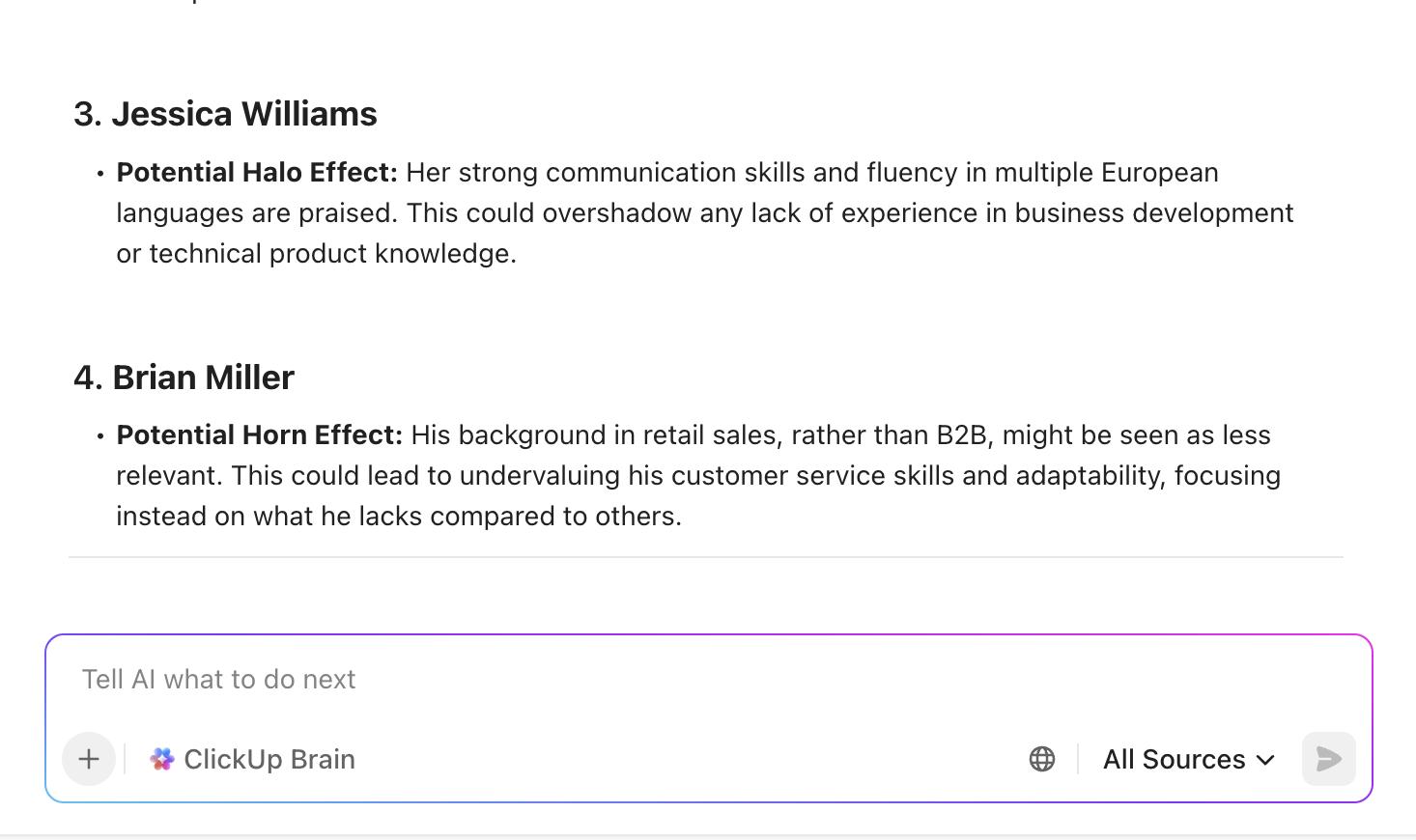

📖 Daha fazla bilgi: Önyargıyı Azaltmak için Halo ve Horn Etkisini Nasıl Önleyebilirsiniz?

Etkili Önyargı Azaltma Stratejileri

AI önyargısını ortadan kaldırmak için tek bir sihirli formül yoktur.

Etkili önyargı azaltma, yapay zeka yaşam döngüsünün tamamında uygulayacağınız çok katmanlı bir savunma gerektirir. Bu kanıtlanmış stratejileri birleştirerek, haksız sonuçların ortaya çıkma riskini önemli ölçüde azaltabilirsiniz.

Çeşitli eğitim verileri toplayın

Temsili veriler, adil yapay zekanın mutlak temelidir.

Modeliniz, eğitiminde hiç görmediği insan gruplarına hizmet etmeyi öğrenemez. Öncelikle, mevcut veri kümelerinizi denetleyerek demografik boşlukları bulun. Ardından, yeterince temsil edilmeyen nüfus gruplarından yeni veriler elde etmek için bilinçli bir çaba gösterin.

Gerçek dünya verilerini bulmak zor olduğunda, veri artırma (mevcut verilerin değiştirilmiş kopyalarını oluşturma) veya sentetik veri üretimi gibi teknikleri kullanarak boşlukları doldurabilirsiniz.

🚧 Araç seti: ClickUp'ın İç Denetim Kontrol Listesi şablonunu kullanarak denetim sürecinizi haritaleyin.

Önyargı için modelleri test edin

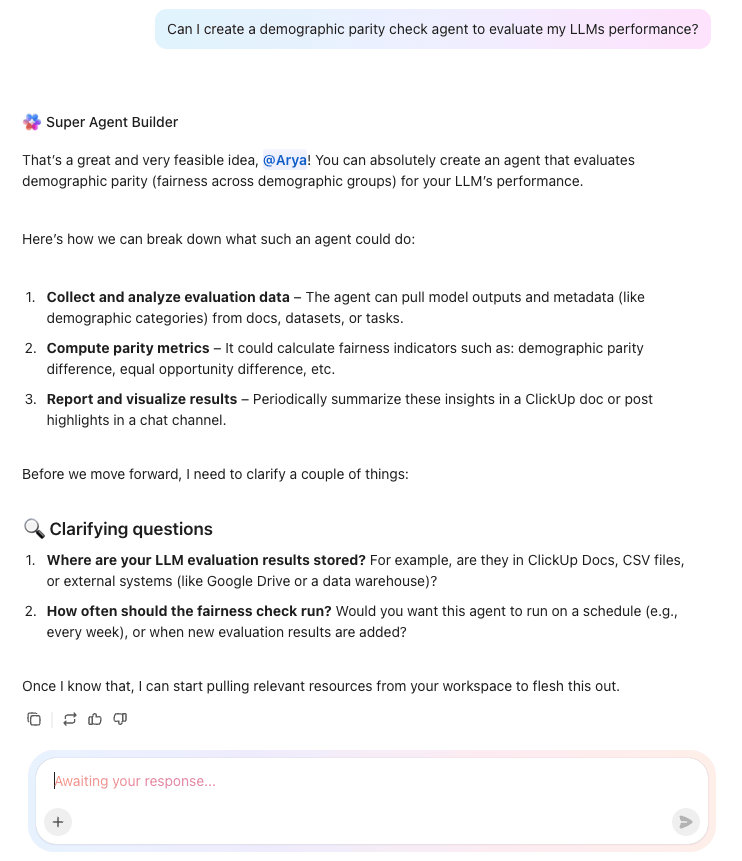

Gerçek bir zarar vermeden önce önyargıyı tespit etmek için sistematik olarak test etmelisiniz. Adalet ölçütlerini kullanarak modelinizin farklı gruplarda nasıl performans gösterdiğini ölçün.

Örneğin, demografik eşitlik, modelin tüm gruplarda eşit oranlarda olumlu sonuçlar (kredi onayı gibi) verip vermediğini kontrol ederken, eşitleştirilmiş olasılıklar hata oranlarının eşit olup olmadığını kontrol eder.

Modelin performansını ırk, cinsiyet, yaş, coğrafya gibi tüm demografik özelliklere göre bölümlere ayırarak doğruluğun düştüğü veya adaletsizliğin ortaya çıktığı noktaları tespit edin.

İnsan faktörünü devre dışı bırakmayın

Otomasyon sistemler, bir insanın hemen fark edeceği ince, bağlama özgü adaletsizlikleri gözden kaçırabilir. AI'nın öneride bulunabileceği, ancak nihai kararı bir insanın vereceği yüksek riskli kararlar için insan faktörünün dahil olduğu bir yaklaşım çok önemlidir.

Bu, özellikle işe alım, kredi verme ve tıbbi teşhis gibi alanlarda önemlidir. Bunun iş yapması için, insan denetçileriniz önyargıları tanımak üzere eğitilmeli ve AI'nın önerilerini geçersiz kılma yetkisine sahip olmalıdır.

📖 Daha fazla bilgi: İş Yerinde İnsan Odaklı Yapay Zeka Nasıl Kullanılır: Kapsamlı Kılavuz

Algoritmik adalet tekniklerini uygulayın

Ayrıca, teknik yöntemler kullanarak doğrudan müdahale edip önyargıyı azaltabilirsiniz. Bu teknikler üç ana kategoriye ayrılır:

- Ön işleme: Bu, model verileri görmeden önce eğitim verilerinin ayarlanmasını içerir. Genellikle, farklı grupların daha dengeli bir temsilini oluşturmak için verilerin yeniden ağırlıklandırılması veya yeniden örneklenmesi yoluyla yapılır.

- İşlem sırasında: Burada, adalet kısıtlamalarını doğrudan modelin eğitim sürecine ekleyerek, hem doğruluk hem de adalet açısından aynı anda optimizasyon yapmasını öğretirsiniz.

- Son işlem: Bu, sonuçların tüm gruplar arasında eşit olmasını sağlamak için modelin nihai tahminlerinin yapılmasından sonra bu tahminlerin ayarlanması anlamına gelir.

Bu teknikler genellikle bir ödün vermeyi gerektirir; adalette önemli bir kazanç elde etmek için genel doğrulukta hafif bir azalma gerekebilir.

💟 Bonus: BrainGPT, GPT-5, Claude, Gemini ve daha fazlasını içeren birden fazla önde gelen modele tek bir yerden erişim sağlayarak AI önyargı testlerini bir üst seviyeye taşıyan, AI destekli masaüstü yardımcınızdır.

Bu, farklı modellerde aynı komutları veya senaryoları kolayca çalıştırabileceğiniz, bunların muhakeme yeteneklerini karşılaştırabileceğiniz ve yanıtların farklılaştığı veya önyargı gösterdiği noktaları tespit edebileceğiniz anlamına gelir. Bu AI süper uygulaması ayrıca, test senaryoları oluşturmak, bulgularınızı belgelemek ve yan yana analiz için sonuçları düzenlemek için konuşma-metin özelliğini kullanmanıza da olanak tanır.

Gelişmiş akıl yürütme ve bağlam farkındalıklı araçları, sorunları gidermenize, kalıpları vurgulamaya ve her modelin hassas konulara nasıl yaklaştığını anlamanıza yardımcı olur. Ş Akışınızı merkezileştirerek ve şeffaf, çoklu model testleri sağlayarak Brain MAX, AI önyargısını güvenle ve hassasiyetle denetlemenizi, karşılaştırmanızı ve ele almanızı sağlar.

Şeffaflığı ve açıklanabilirliği artırın

Modelinizin kararları nasıl verdiğini bilmiyorsanız, yanlış olduğunda düzeltemezsiniz. Açıklanabilir AI (XAI) teknikleri, "kara kutunun" içine bakmanıza ve tahminleri hangi veri özelliklerinin yönlendirdiğini görmenize yardımcı olur.

Ayrıca, AI'nız için besin değerleri etiketi gibi, kullanım amacı, performans verileri ve bilinen sınırları belgeleyen model kartları da oluşturabilirsiniz.

📮ClickUp Insight: Anket katılımcılarının %13'ü zor kararlar almak ve karmaşık sorunları çözmek için AI kullanmak istiyor. Ancak, sadece %28'i iş yerinde düzenli olarak AI kullandığını söylüyor. Olası bir neden: Güvenlik endişeleri!

Kullanıcılar, hassas karar verme verilerini harici bir AI ile paylaşım yapmak istemeyebilir.

ClickUp, yapay zeka destekli problem çözme özelliğini güvenli Çalışma Alanınıza getirerek bu sorunu çözüyor. SOC 2'den ISO standartlarına kadar, ClickUp en yüksek veri güvenliği standartlarına uygundur ve çalışma alanınızda üretken yapay zeka teknolojisini güvenli bir şekilde kullanmanıza yardımcı olur.

AI Yönetişim ve Hesap Verebilirlik Politikaları

Güçlü bir AI yönetişim programı, takımdaki herkesin uyabileceği net bir sahiplik dağılımı ve tutarlı standartlar oluşturur.

Kuruluşunuzun, yapay zekanın etik bir şekilde geliştirilmesi ve uygulanmasından her zaman birisinin sorumlu olmasını sağlamak için net yönetişim yapılarına ihtiyacı vardır.

Etkili bir AI yönetişim programının temel unsurları şunlardır:

| Yönetişim unsuru | Anlamı | Kuruluşunuz için eylem adımları |

|---|---|---|

| Net sahiplik | AI etiği, denetimi ve uyumluluğundan özel olarak görevlendirilmiş kişiler veya takımlar sorumludur. | • Bir AI etik sorumlusu veya fonksiyonlar arası bir komite atayın • Veri, model kalitesi, uyumluluk ve riskle ilgili sorumlulukları tanımlayın • Denetime hukuk, mühendislik, ürün ve DEI temsilcilerini dahil edin |

| Belgelenmiş politikalar | AI yaşam döngüsü boyunca verilerin nasıl toplandığı, kullanıldığı ve izlendiğini tanımlayan yazılı kılavuzlar | • Veri kaynağı, etiketleme, gizlilik ve saklama için iç politikalar oluşturun • Model geliştirme, doğrulama ve dağıtım için standartları belgelendirin • Takımların herhangi bir AI sistemini piyasaya sürmeden önce kontrol listelerini takip etmelerini zorunlu kılın |

| Denetim izleri | Kararlar, model sürümleri, veri kümeleri ve değişikliklerin şeffaf bir kaydı | • Veri kümeleri ve modeller için sürüm kontrolü uygulayın • Anahtar kararları, model parametrelerini kaydedin ve sonuçları inceleyin • Denetim izlerini merkezi, erişilebilir bir depoda saklayın |

| Düzenli incelemeler | Önyargı, sapma ve uyum eksikliklerini kontrol etmek için AI sistemlerinin sürekli değerlendirilmesi | • Güçlü LLM değerlendirmesi yoluyla üç aylık veya altı aylık önyargı değerlendirmeleri planlayın • Performans düştüğünde veya davranış değiştiğinde modelleri yeniden eğitin veya yeniden kalibre edin • Büyük veri güncellemeleri veya ürün değişikliklerinden sonra modelleri gözden geçirin |

| Olay müdahale planı | AI önyargılarını veya zararlarını belirlemek, raporlamak ve düzeltmek için net bir protokol | • Dahili önyargı eskalasyon ş Akışı oluşturun • Sorunların nasıl araştırılacağını ve düzeltmelerin kim tarafından onaylanacağını tanımlayın • Gerektiğinde kullanıcılar, müşteriler veya düzenleyiciler için iletişim adımlarını özetleyin |

💡Profesyonel İpucu: NIST AI Risk Yönetimi Çerçevesi ve yıllık cirosunun %7'sine kadar para cezası öngören AB AI Yasası gibi çerçeveler, kendi yönetişim programınızı oluşturmak için mükemmel birer model olabilir.

ClickUp ile Önyargıyı Azaltma Yöntemleri

ClickUp'ın birleştirilmiş AI çalışma alanı, AI yönetişim programınızın tüm hareketli parçalarını tek bir düzenli Çalışma Alanı'nda bir araya getirir.

Takımlarınız, araçlar arasında geçiş yapmadan veya bağlamı kaybetmeden görevleri yönetebilir, politikaları depolayabilir, denetim bulgularını inceleyebilir, riskleri tartışabilir ve olayları izleyebilir. Her model kaydı, karar günlüğü ve düzeltme planı birbirine bağlı kalır, böylece kimin neyi neden yaptığını her zaman bilirsiniz.

ClickUp'ın AI'sı çalışma alanınızdaki işleri anladığı için, geçmiş değerlendirmeleri ortaya çıkarabilir, uzun raporları özetleyebilir ve standartlar geliştikçe takımınızın uyumlu kalmasına yardımcı olabilir. Sonuç, AI ayak iziniz büyüdükçe takip etmesi ve denetlemesi daha kolay ve çok daha güvenilir bir yönetişim sistemidir.

Bunu bir ş akışı olarak inceleyelim!

1. Adım: AI yönetişim Çalışma Alanınızı kurun

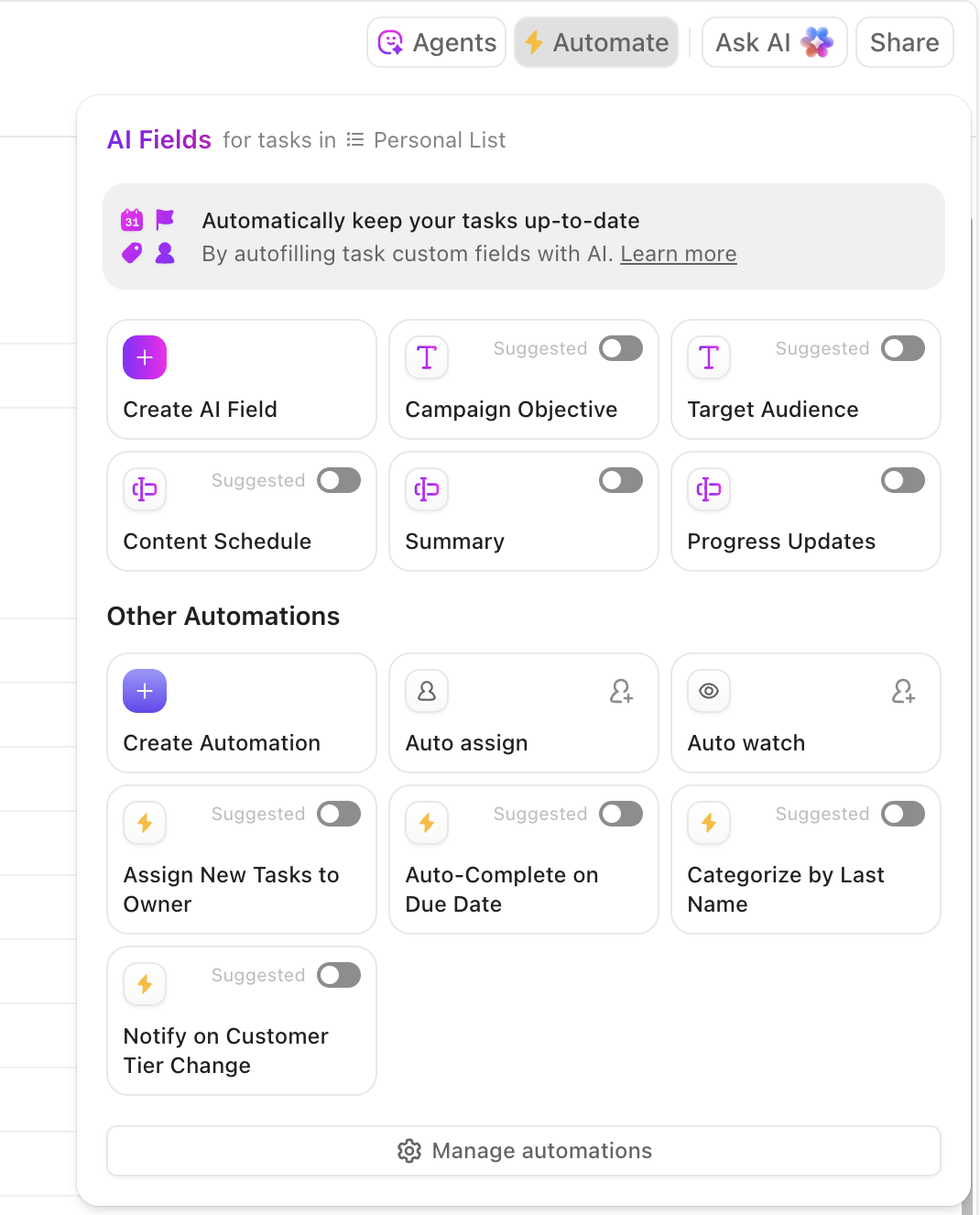

ClickUp'ta tüm yönetişimle ilgili işler için özel bir alan oluşturarak başlayın. Model envanteriniz, önyargı değerlendirmeleriniz, olay raporlarınız, politika belgeleriniz ve planlanmış incelemeleriniz için listeler ekleyin, böylece programın her unsuru tek bir kontrollü ortamda bulunur.

Adalet metriklerini, önyargı puanlarını, model sürümlerini, inceleme durumunu ve risk seviyelerini izlemek için Özel Alanlar veya AI Alanları yapılandırın. Yalnızca yetkili inceleme görevlileri, mühendisler ve uyum sorumlularının hassas AI işlerine erişebilmesini sağlamak için rol tabanlı izinler kullanın. Bu, rakiplerin nokta araçlarının ve genel proje platformlarının sunamadığı yapısal temeli oluşturur.

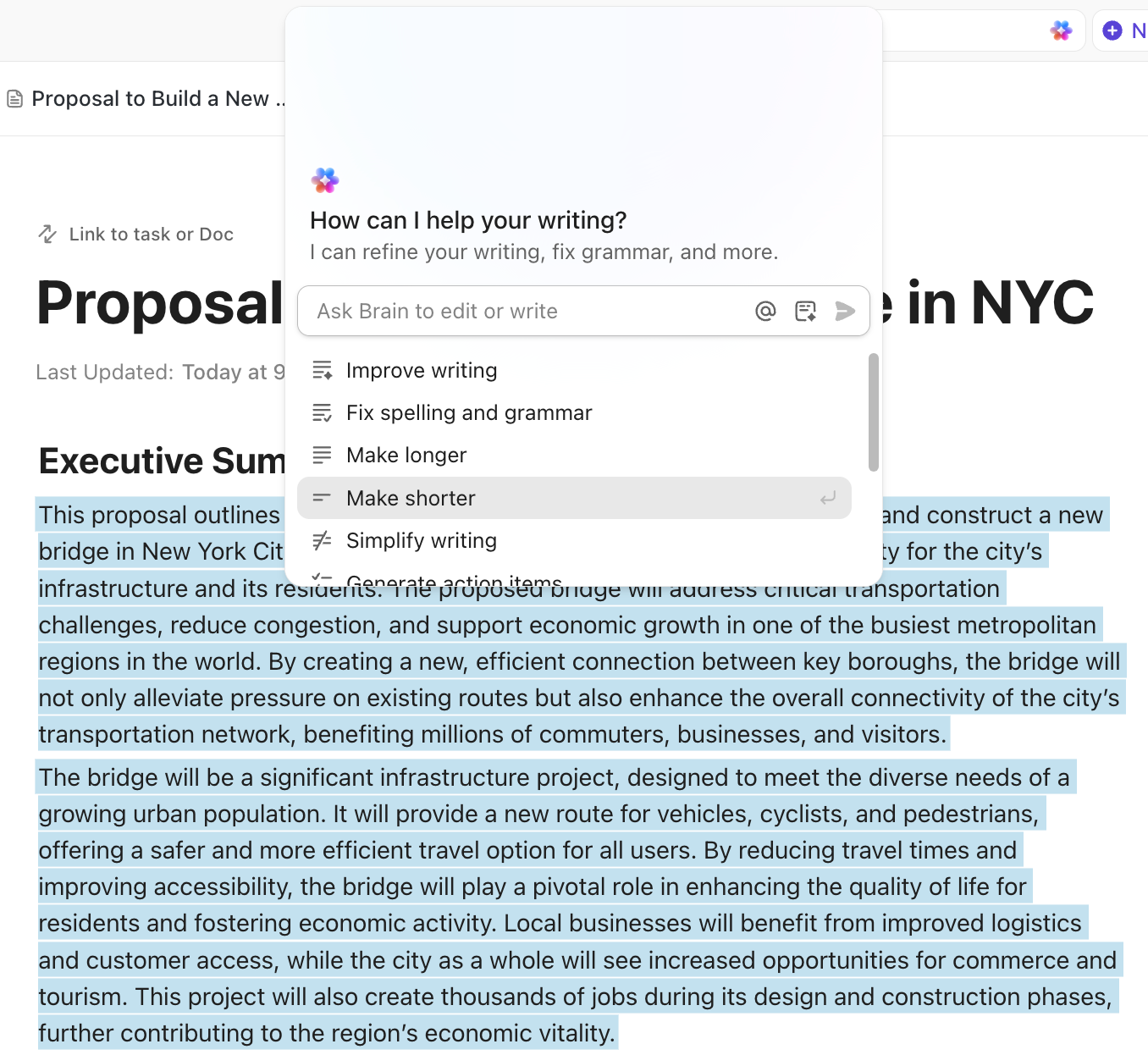

2. Adım: Yönetişim çerçevenizi oluşturun

Ardından, canlı yönetişim kılavuzunuz olarak kullanmak üzere bir ClickUp belge oluşturun. Burada önyargı değerlendirme prosedürlerinizi, adalet eşiklerini, model belgeleme yönergelerini, insan müdahalesi adımlarını ve eskalasyon protokollerini özetleyin.

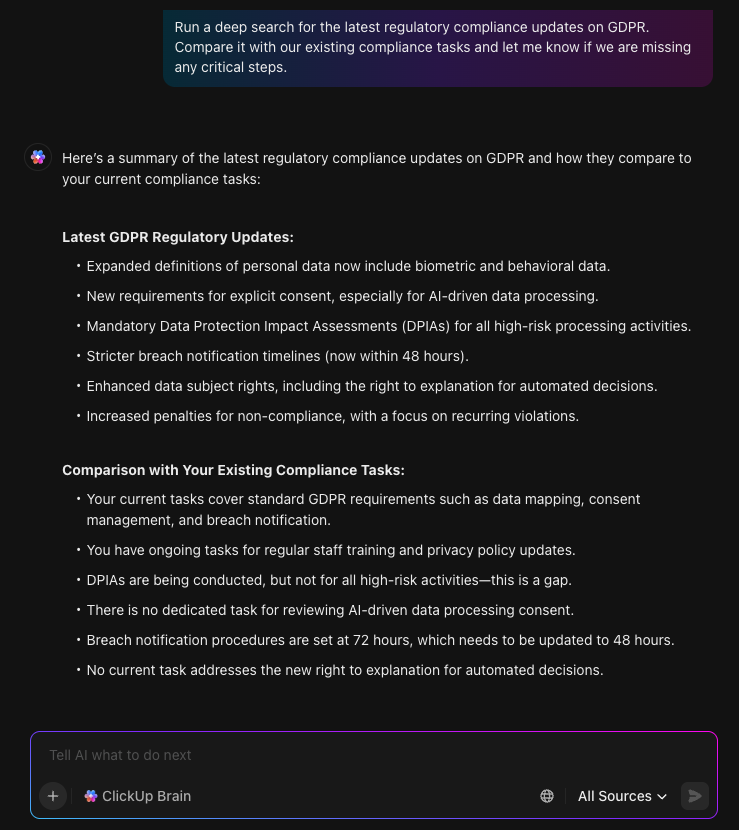

Belgeler, görevlere ve model kayıtlarına bağlı kaldığı için takımlarınız, sürüm geçmişini kaybetmeden veya dosyaları farklı araçlara dağıtmadan işbirliği yapabilir. Ayrıca ClickUp Brain, harici düzenlemeleri özetlemeye, yeni politika metinleri hazırlamaya veya önceki denetim bulgularını ortaya çıkarmaya yardımcı olarak politika oluşturma sürecini daha tutarlı ve izlenebilir hale getirir.

Web'de arama yapabilmesi, birden fazla AI modeli arasında geçiş yapabilmesi ve bilgileri net bir rehber haline getirebilmesi sayesinde, takımınız Çalışma Alanından ayrılmadan yeni standartları ve sektördeki değişiklikleri takip edebilir. İhtiyacınız olan her şey, politika güncellemeleri, düzenleyici bilgiler ve geçmiş kararlar tek bir yerde toplanır, böylece yönetişim sisteminiz daha istikrarlı ve bakımı çok daha kolay hale gelir.

3. Adım: Her modeli kaydedin

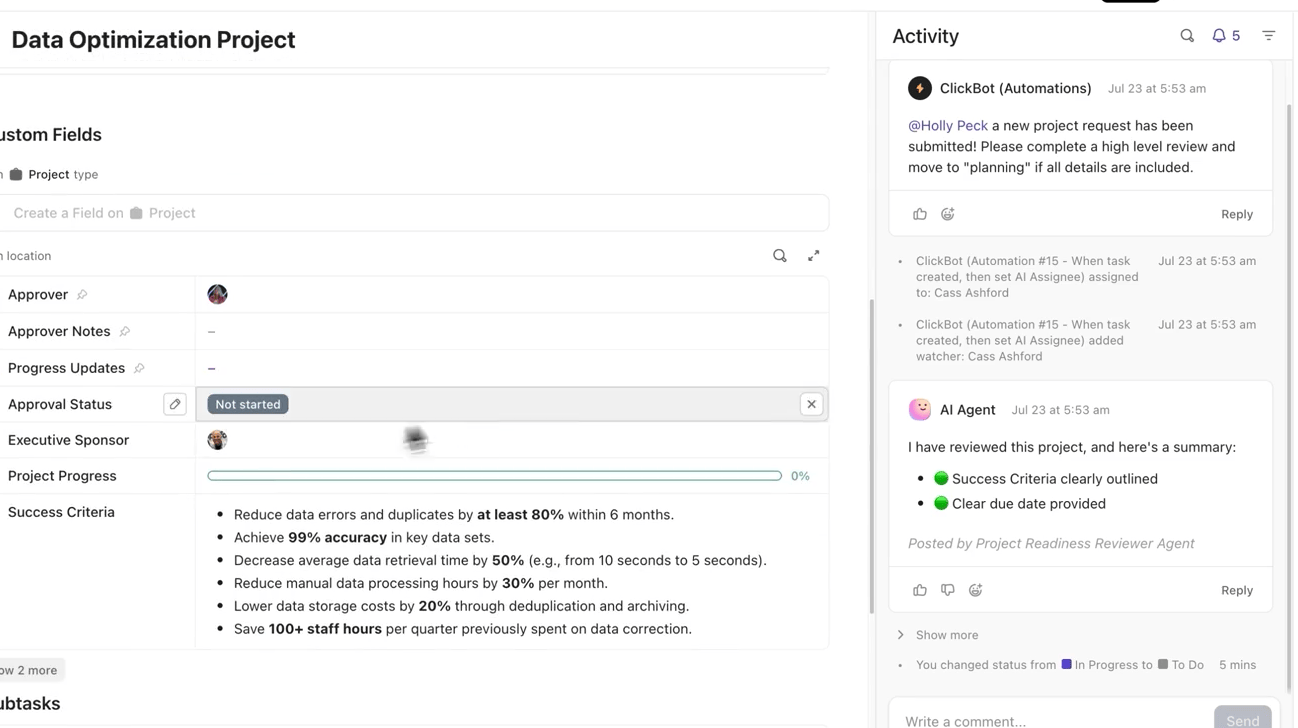

Her modelin "Model envanteri" listesinde kendi görevi olmalıdır, böylece sahiplik ve sorumluluk her zaman net olur.

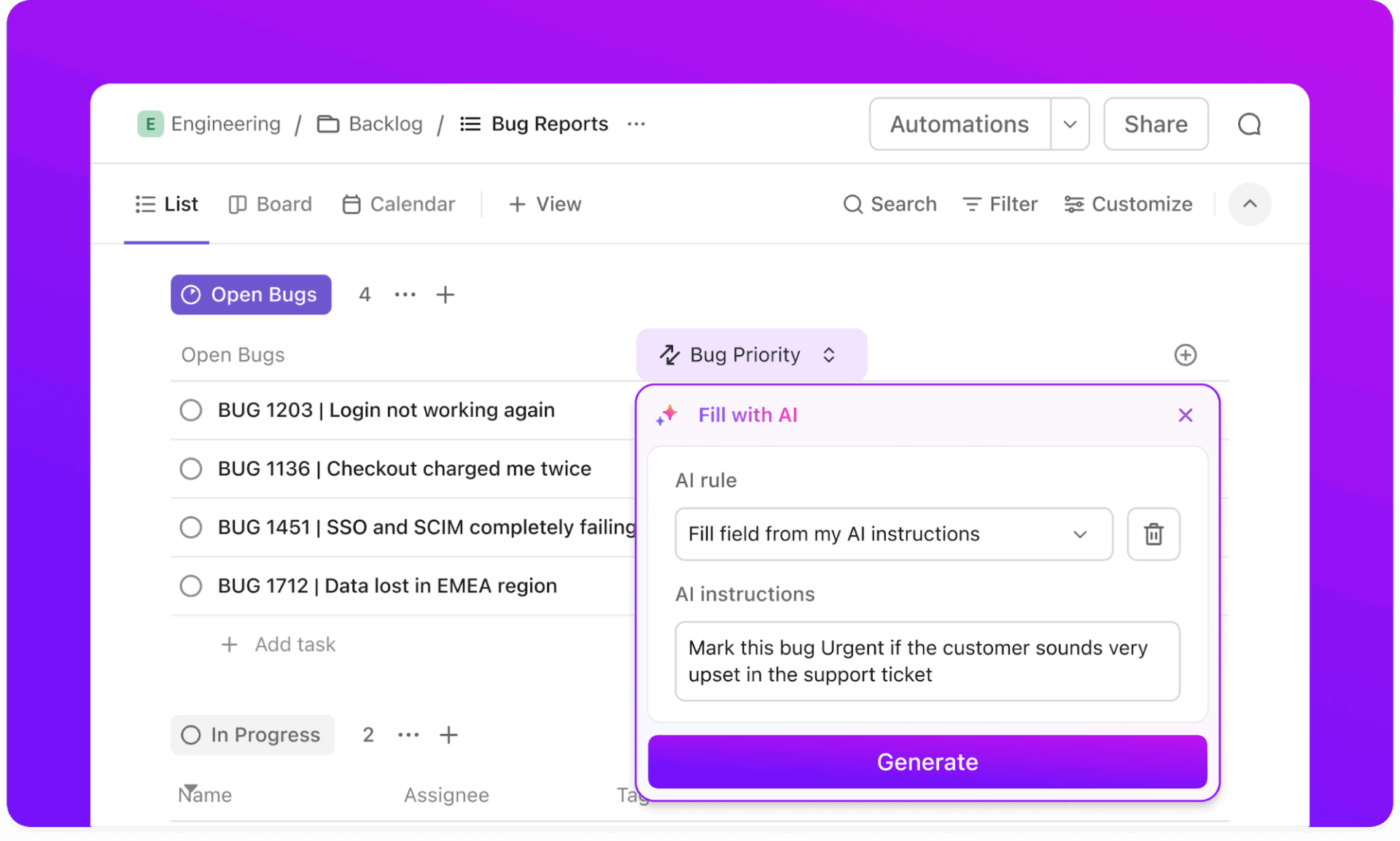

ClickUp görevleri ve ClickUp Özel Alanları kullanarak önyargı değerlendirme ş akışlarınızı yapılandırın ve her önemli ayrıntıyı yakalayın, böylece her önyargı olayını kolayca izleyebilirsiniz.

Bu şekilde, önyargı türünü, ciddiyet düzeyini, düzeltme durumunu, sorumlu takım üyesini ve bir sonraki inceleme tarihini izleyebilir, her sorunun net bir sahipliği ve son tarihi olmasını sağlayabilirsiniz.

Veri kümelerini, değerlendirme özetlerini ve soy notlarını ek dosya olarak ekleyin, böylece her şey tek bir yerde toplansın. Otomasyonlar, bir model hazırlık aşamasına veya üretime geçtiğinde gözden geçirenleri uyarabilir.

4. Adım: Planlanmış ve etkinlik tabanlı önyargı denetimleri gerçekleştirin

Önyargı denetimleri, hem düzenli aralıklarla hem de belirli tetikleyicilere yanıt olarak gerçekleştirilmelidir.

ClickUp otomasyonları aracılığıyla, bir model yeni bir dağıtım dönüm noktasına ulaştığında veya planlanmış bir denetim tarihi geldiğinde otomatik olarak inceleme görevlerini tetikleyen basit kurallar oluşturun. Otomasyonlar, doğru inceleme görevlilerini atayabilir, doğru son tarihleri belirleyebilir ve hatta son teslim tarihleri yaklaştığında hatırlatıcılar gönderebilir, böylece bir daha üç aylık önyargı değerlendirmelerini asla kaçırmayacaksınız.

Etkinlik tabanlı denetimler için ClickUp Formları, önyargı olay raporlarını veya insan geri bildirimlerini toplamayı kolaylaştırırken, denetçiler Özel Alanlar kullanarak adalet eksikliklerini, test sonuçlarını ve önerileri kaydeder. Her form gönderimi, tekrarlanabilir bir denetim yolu oluşturan bir görev olarak takımınıza yönlendirilir.

Adım 5: Önyargı olaylarını araştırın ve çözün

Önyargı sorunu tespit edildiğinde, ciddiyetini, etkilenen grupları, model sürümünü ve gerekli azaltma işlerini içeren bir olay görevi oluşturun. AI Ajanları, yüksek riskli bulguları uyum sorumlularına iletebilir ve doğru gözden geçirenleri ve mühendisleri atayabilir.

Her bir azaltma eylemi, test sonuçu ve doğrulama adımı olay kaydına bağlı kalır. ClickUp Brain, liderlik için özetler oluşturabilir veya yönetişim belgeleriniz için düzeltme notları hazırlamanıza yardımcı olabilir, böylece her şey şeffaf ve izlenebilir kalır.

6. Adım: AI yönetişim programınızın durumunu izleyin

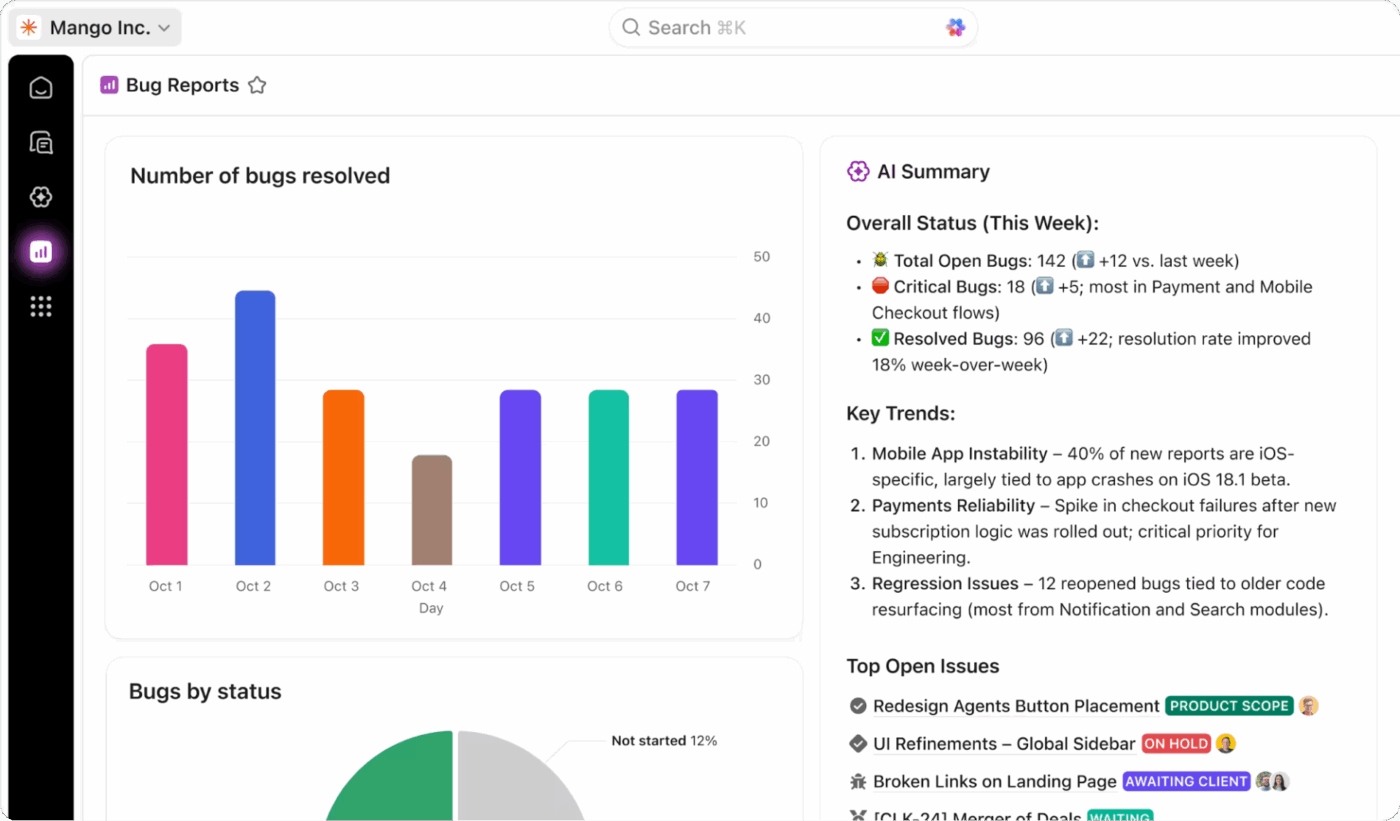

Son olarak, liderlere önyargı azaltma programınızı gerçek zamanlı olarak gösteren gösterge panelleri oluşturun.

Tüm aktif modellerde açık olayları, çözüm süresini, denetim tamamlanma oranlarını, adalet ölçütlerini ve uyumluluk durumunu gösteren paneller ekleyin. ClickUp'taki kod gerektirmeyen gösterge panelleri , iş ilerledikçe verileri otomatik olarak çekebilir ve görevleri güncelleyebilir ; ayrıca dashboard görünümüne AI özetleri de eklenebilir.

📖 Daha fazla bilgi: Yaygın AI Zorluklarının Üstesinden Gelme Yöntemleri

Dağıtım Sonrası Önyargı Kontrolleri

AI modeli devreye girdiğinde işiniz tamamlanmış sayılmaz.

Aslında, gerçek test bu noktada başlar. Modeller, gördükleri gerçek dünya verileri değişmeye başladıkça zamanla "sapabilir" ve yeni önyargılar geliştirebilir. Sürekli izleme, bu ortaya çıkan önyargıyı yaygın bir zarara yol açmadan yakalamanın tek yoludur.

Sürekli izlemenizin şunları içermesi gerekir:

| Uygulama | Neler sağlar |

|---|---|

| Gruplara göre performans izleme | Demografik segmentler genelinde model doğruluğunu ve adaleti sürekli olarak ölçerek eşitsizliklerin erken tespit edilmesini sağlar. |

| Veri sapması tespiti | Zaman içinde yeni önyargılar getirebilecek veya model performansını zayıflatabilecek girdi verilerindeki değişiklikleri izler. |

| Kullanıcı geri bildirim döngüleri | Kullanıcıların önyargılı veya yanlış çıktıları bildirmeleri için net kanallar sağlayarak gerçek dünyadaki denetimi iyileştirir. |

| Planlanmış denetimler | Model davranışı, adalet ölçütleri ve uyumluluk gereklilikleri konusunda üç aylık veya altı aylık derinlemesine incelemeler yapılmasını sağlar. |

| Olaylara müdahale | Bildirilen önyargı etkinliklerini araştırmak, düzeltmek ve belgelemek için yapılandırılmış bir süreç tanımlar. |

💟 Bonus: Özellikle üretken AI sistemleri, çıktıları geleneksel makine öğrenimi modellerine göre çok daha az öngörülebilir olduğu için ekstra dikkat gerektirir. Bunun için harika bir teknik, özel bir takımın modelin zayıf noktalarını belirlemek için aktif olarak önyargılı veya zararlı yanıtlar vermeye çalıştığı kırmızı takım tekniğidir.

Örneğin, Airbnb'nin Project Lighthouse projesi, sistematik, dağıtım sonrası önyargı izleme uygulayan bir şirketin harika bir sektör vaka çalışmasıdır.

Bu, algılanan ırkın rezervasyon sonuçlarını nasıl etkileyebileceğini inceleyen ve şirketin platformdaki ayrımcılığı belirleyip azaltmasına yardımcı olan bir araştırma girişimidir. Gizlilik güvenliği sağlayan yöntemler kullanır, sivil hak gruplarıyla işbirliği yapar ve bulguları ürün ve politika değişikliklerine dönüştürerek daha fazla misafirin görünmez engellerle karşılaşmadan platformda gezinmesini sağlar.

📖 Daha fazla bilgi: Üretken AI ve Tahmine Dayalı AI: Aralarındaki Farklar ve Uygulamaları

ClickUp ile AI Önyargısını Azaltın

Adil ve hesap verebilir bir yapay zeka oluşturmak, kurumsal bir taahhüttür.

Politikalarınız, çalışanlarınız, süreçleriniz ve araçlarınız uyum içinde çalıştığında, yeni risklere uyum sağlayabilen, olaylara hızlı bir şekilde yanıt verebilen ve ürünlerinize güvenen kişilerin güvenini kazanabilen bir yönetişim sistemi oluşturursunuz.

Yapılandırılmış incelemeler, net belgeler ve önyargıları ele almak için tekrarlanabilir bir ş Akışı sayesinde takımlar, kriz modunda tepki vermek yerine uyumlu ve sorumlu bir şekilde çalışmaya devam eder.

Model kayıtlarından denetim sonuçlarına ve olay raporlarına kadar her şeyi ClickUp içinde merkezileştirerek, kararların şeffaf, sorumlulukların net ve iyileştirmelerin asla karışıklık içinde kaybolmadığı tek bir operasyonel katman oluşturursunuz.

Güçlü yönetişim, inovasyonu yavaşlatmaz; onu istikrarlı hale getirir. AI ş akışlarınıza önyargı azaltma özelliğini eklemeye hazır mısınız? ClickUp ile ücretsiz olarak başlayın ve AI yönetişim programınızı bugün oluşturmaya başlayın.

Sık Sorulan Sorular

İlk adım olarak, mevcut AI sistemlerinizde önyargı denetimi yapabilirsiniz. Bu temel değerlendirme, mevcut adaletsizliklerin nerede olduğunu gösterir ve azaltma çabalarınızı önceliklendirmenize yardımcı olur.

Takımlar, önyargıyı ölçmek için demografik eşitlik, eşitleştirilmiş olasılıklar ve farklı etki oranı gibi belirli adalet ölçütlerini kullanır. Doğru ölçüt, özel kullanım durumunuza ve bu bağlamda en önemli olan adalet türüne bağlıdır.

İşe alım, kredi verme veya sağlık hizmetleri gibi bir kişinin hayatını veya fırsatlarını önemli ölçüde etkileyen yüksek riskli kararlar için her zaman bir insan gözden geçirme adımı eklemelisiniz. Davranışı hala öngörülemez olan yeni bir modelin erken aşamalarında da bunu kullanmak akıllıca olacaktır.

Üretken yapay zeka neredeyse sonsuz bir alaka aralığıyla öngörülemeyen yanıtlar üretebileceğinden, sadece doğruluğunu kontrol etmek yeterli değildir. Modelin farklı koşullar altında önyargılı içerik üretip üretmediğini öğrenmek için kırmızı takım ve büyük ölçekli çıktı örnekleme gibi aktif sondaj tekniklerini kullanmanız gerekir.