Hugging Face ha creato un ecosistema straordinario per gli sviluppatori ML, dal suo enorme hub di modelli agli strumenti di implementazione senza soluzione di continuità.

Ma a volte il tuo progetto richiede qualcosa di diverso. Forse hai bisogno di un'infrastruttura specializzata, di una sicurezza di livello aziendale o di flussi di lavoro personalizzati che altre alternative a Hugging Face gestiscono meglio.

Che tu stia creando chatbot, ottimizzando LLM o eseguendo pipeline NLP che farebbero piangere di gioia i tuoi data scientist, esistono numerose piattaforme pronte a soddisfare le tue esigenze di IA.

In questo blog abbiamo raccolto le migliori alternative a Hugging Face, dalle potenti API cloud ai toolkit open source e alle piattaforme di flusso di lavoro IA end-to-end.

Le migliori alternative a Hugging Face in sintesi

Ecco un confronto tra le migliori alternative a Hugging Face. 📄

| Strumento | Ideale per | Funzionalità migliori | Prezzi* |

| ClickUp | Integra l'IA direttamente nella gestione quotidiana del tuo lavoro, dalle attività ai documenti e all'automazione Dimensione del team: ideale per singoli individui, startup e grandi aziende | IA Notetaker, Autopilot Agents, Brain MAX, Enterprise AI Search, generazione di immagini su lavagne online, accesso a Claude/ChatGPT/Gemini, automazione tramite linguaggio naturale. | Gratis per sempre, personalizzazioni disponibili per le aziende. |

| OpenAI | Sviluppo con modelli linguistici avanzati e API per testo, immagini e incorporamenti Dimensione del team: ideale per sviluppatori di IA e startup che sviluppano con LLM | Messa a punto, elaborazione di PDF/immagini, analisi semantica dei file, dashboard dei costi, prompt di temperatura/sistema | Basato sull'utilizzo |

| Anthropic Claude | Creazione di conversazioni ricche di contesto, più sicure e risposte LLM ponderate Dimensione del team: ideale per team che necessitano di sicurezza, contesto lungo e ragionamento etico | Ricerca web in tempo reale, generazione di output strutturati (JSON/XML), memoria ad alto contesto, supporto matematico/statistico. | Basato sull'utilizzo |

| Cohere | Progettazione di soluzioni NLP multilingue e sicure su scala aziendale Dimensione del team: ideale per team orientati alla conformità con esigenze NLP multilingue | Messa a punto su dati privati, supporto per oltre 100 lingue, dashboard di analisi, inferenza scalabile, integrazione SSO/SAML/RBAC. | A partire da 0,0375 $/1 milione di token (Comando R7B); prezzi personalizzati |

| Replica | Esplora ed esegui modelli open source senza preoccuparti della configurazione o dei server Dimensione del team: ideale per sviluppatori che testano modelli di IA o creano MVP | Modelli forkabili, controllo delle versioni con test A/B, previsione batch e supporto webhook. | Pagamento in base all'utilizzo; i prezzi variano a seconda del modello. |

| TensorFlow | Creazione di sistemi di machine learning completamente personalizzati con il massimo controllo Dimensione del team: ideale per gli ingegneri ML che necessitano di un controllo completo del modello | Monitoraggio TensorBoard, conversione ONNX/SavedModel, funzioni di perdita personalizzate, addestramento a precisione mista | Gratis (open source); l'utilizzo della potenza di calcolo viene fatturato separatamente. |

| Azure Machine Learning | Connessione dei modelli ML all'ecosistema Microsoft con automazione e scalabilità Dimensione del team: ideale per i team aziendali sull'ecosistema Azure | AutoML, trigger di riqualificazione, spiegabilità dei modelli con SHAP/LIME, rilevamento delle derive, cluster di calcolo scalabili | Prezzi personalizzati |

| Google Gemini | Interagisci con più tipi di dati (testo, codice, immagini e video) attraverso un unico modello di IA Dimensione del team: ideale per team di ricerca e analisi multimodali | Comprensione di immagini/grafici, esecuzione Python in tempo reale, riassunto video, ragionamento su input misti | Gratis; piani a pagamento disponibili a seconda dell'accesso al modello |

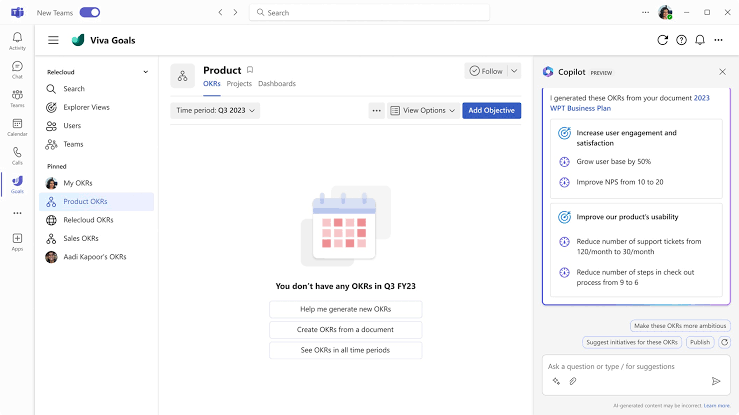

| Microsoft Copilot | Aumenta la produttività all'interno delle app Microsoft 365 come Word, Excel e OutlookDimensione del team: ideale per gli utenti aziendali nell'ecosistema Microsoft 365 | Automazioni delle funzioni Excel, generazione di diapositive PPT, redazione di programmi/email, collegamento delle attività di Outlook | Gratis; piani a pagamento a partire da 20 $ al mese. |

| IBM WatsonX | Gestione dell'IA in settori altamente regolamentati con piena verificabilità e controllo Dimensione del team: ideale per banche, sanità e organizzazioni del settore pubblico | Rilevamento dei pregiudizi, modelli di sicurezza immediati, test di robustezza avversaria, flussi di lavoro human-in-loop. | Gratis; piani a pagamento a partire da 1.050 $ al mese. |

| BigML. com | Creazione e spiegazione di modelli predittivi senza codice o conoscenze di ML Dimensione del team: ideale per analisti e utenti senza competenze di programmazione | Modellazione visiva drag-and-drop, apprendimento ensemble, clustering, previsione di serie temporali | Versione di prova gratuita di 14 giorni; piani a pagamento a partire da 30 $ al mese. |

| LangChain | Creazione di agenti IA e flussi di lavoro che combinano più modelli, strumenti e API Dimensione del team: ideale per sviluppatori IA che creano strumenti basati su agenti | Tracciamento e registrazione, cache delle chiamate API, logica di fallback, risposte in streaming, framework di valutazione personalizzati | Gratis; piani a pagamento a partire da 39 $ al mese. |

| Weights & Biases | Mantieni gli esperimenti di machine learning organizzati, riproducibili e orientati alle prestazioni Dimensione del team: ideale per team di ricerca ML e laboratori di IA | Scansioni di iperparametri, dashboard live, condivisione pubblica di esperimenti, profilazione GPU e versioning degli esperimenti. | Gratis; piani a pagamento a partire da 50 $ al mese. |

| ClearML | Gestione dell'intero ciclo di vita MLOps, dal monitoraggio all'orchestrazione e all'implementazione Dimensione del team: ideale per team ML con molte operazioni e uso interno dell'infrastruttura | Registrazione degli audit, implementazione blue-green, integrazione CI/CD, pianificazione fuori picco, registro dei modelli, strumenti di riproducibilità | Gratis; piani a pagamento a partire da 15 $ al mese per utente |

| Amazon SageMaker | Esecuzione, ottimizzazione e scalabilità dei modelli ML in modo nativo sull'infrastruttura AWS Dimensione del team: ideale per team basati su AWS che sviluppano su larga scala | Etichettatura dei dati Ground Truth, notebook gestiti, ottimizzazione automatica degli iperparametri, endpoint scalabili, monitoraggio CloudWatch. | Unified Studio: gratis; altri prezzi dipendono dalla potenza di calcolo e dall'utilizzo |

Come valutiamo i software su ClickUp

Il nostro team editoriale segue un processo trasparente, supportato da ricerche e indipendente dai fornitori, quindi puoi fidarti che i nostri consigli si basano sul valore reale dei prodotti.

Ecco una panoramica dettagliata di come valutiamo i software su ClickUp.

Perché scegliere le alternative a Hugging Face

Ecco perché ha senso esplorare le alternative a Hugging Face:

- Funzionalità IA su misura: trova piattaforme con modelli linguistici specializzati per attività di nicchia come la visione artificiale o l'NLP avanzato.

- Flussi di lavoro semplificati: scegli soluzioni con configurazione più semplice o interfacce senza codice per una prototipazione più rapida e una maggiore efficienza operativa.

- Piani convenienti: scopri le opzioni con livelli gratis o prezzi più bassi per una gestione dei dati attenta al budget.

- Capacità di integrazione potenziate: cerca strumenti che garantiscano una perfetta sincronia con il tuo stack tecnologico esistente, come CRM o piattaforme cloud.

- Prestazioni scalabili: scegli piattaforme IA in grado di gestire set di dati più grandi o che offrono un'elaborazione più veloce per progetti di grandi dimensioni.

- Supporto aziendale più solido: selezione delle alternative a Hugging Face con supporto dedicato per i team che necessitano di soluzioni robuste e sicure.

- Formazione di modelli personalizzati: esplora le opzioni con una messa a punto avanzata per modelli unici e ad alte prestazioni.

- Opzioni di implementazione innovative: scegli strumenti con metodi di hosting o implementazione unici per una scalabilità più semplice.

🔍 Lo sapevate? Grazie ai trasformatori, strumenti come GPT e BERT sono in grado di leggere intere frasi. Rilevano il tono, l'intenzione e il contesto in un modo che i modelli precedenti non erano in grado di fare. Ecco perché oggi l'IA sembra più naturale quando risponde.

Le migliori alternative a Hugging Face

Queste sono le nostre scelte per le migliori alternative a Hugging Face. 👇

1. ClickUp (ideale per integrare l'IA direttamente nella project management, nei documenti e nei flussi di lavoro)

Tutti usano l'IA, ma la maggior parte di essa vive in silos. Hai uno strumento per scrivere, un altro per riepilogare/riassumere e un terzo per pianificare, ma nessuno di essi comunica con il tuo lavoro. Questo crea una maggiore dispersione dell'IA e un caos inutile.

ClickUp risolve questo problema integrando l'IA dove è utile: all'interno delle tue attività, dei tuoi documenti e degli aggiornamenti del team.

Scrivi, riepiloga/riassumi e effettua automazioni nel contesto

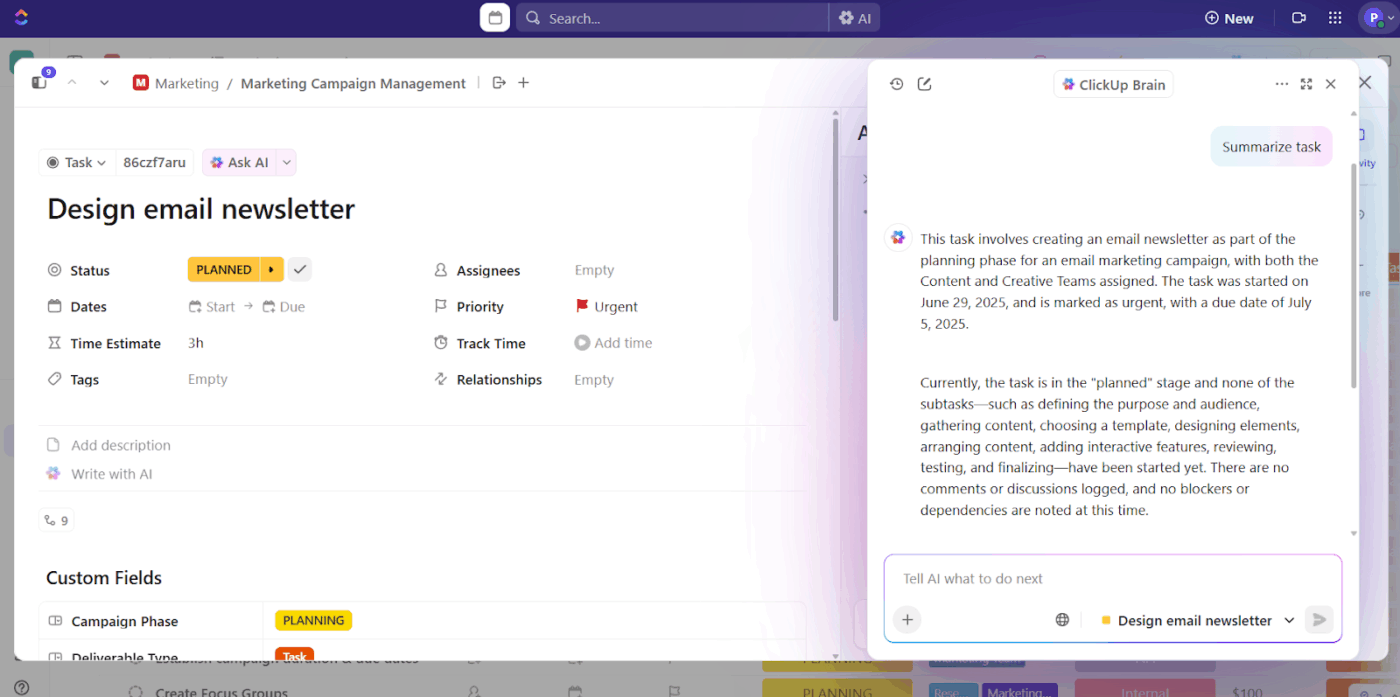

ClickUp Brain è integrato in ogni parte della piattaforma. Scrive contenuti, riepiloga gli aggiornamenti, genera report e riscrive descrizioni di attività disordinate, proprio dove si svolge il lavoro.

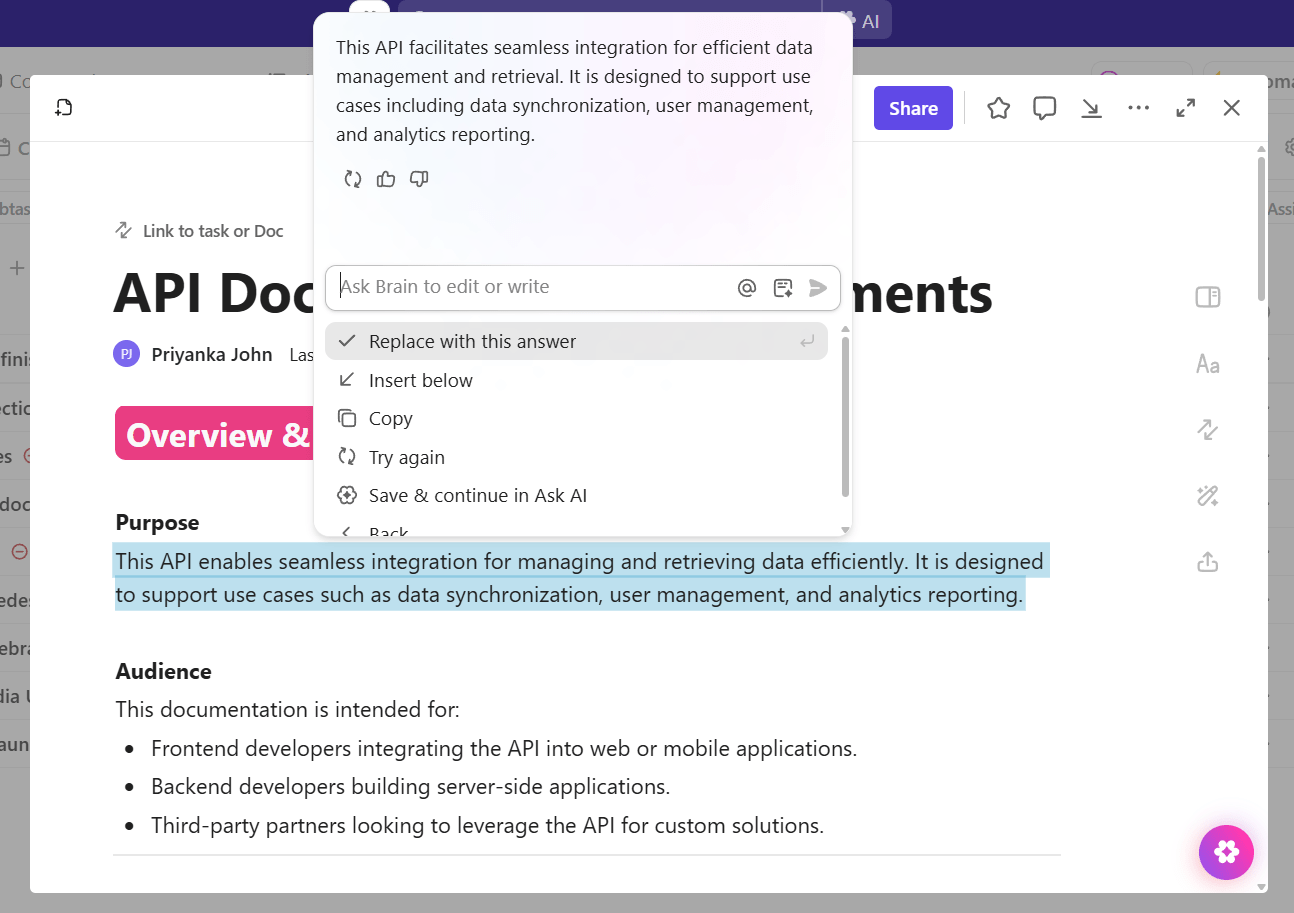

Supponiamo che tu stia documentando i requisiti API per gli sviluppatori.

Incolla le specifiche tecniche in un documento ClickUp, aggiungi punti elenco relativi all'autenticazione e ai limiti di frequenza, quindi richiedi a ClickUp Brain di creare una documentazione di facile consultazione per gli sviluppatori con esempi di codice.

L'assistente IA connesso struttura i tuoi appunti grezzi in sezioni chiare rimanendo all'interno del documento, dove il tuo team potrà consultarli.

Altri esempi:

- Trasforma un lungo documento di riunione in una sintesi di progetto per il tuo team leader.

- Riscrivi le descrizioni vaghe delle attività per rendere più chiari i passaggi successivi.

- Redigi aggiornamenti ricorrenti per i clienti utilizzando le attività della settimana precedente.

- Riassumi un thread di pianificazione e assegna i follow-up ai titolari

Trova risposte, ostacoli e reportistica in pochi secondi

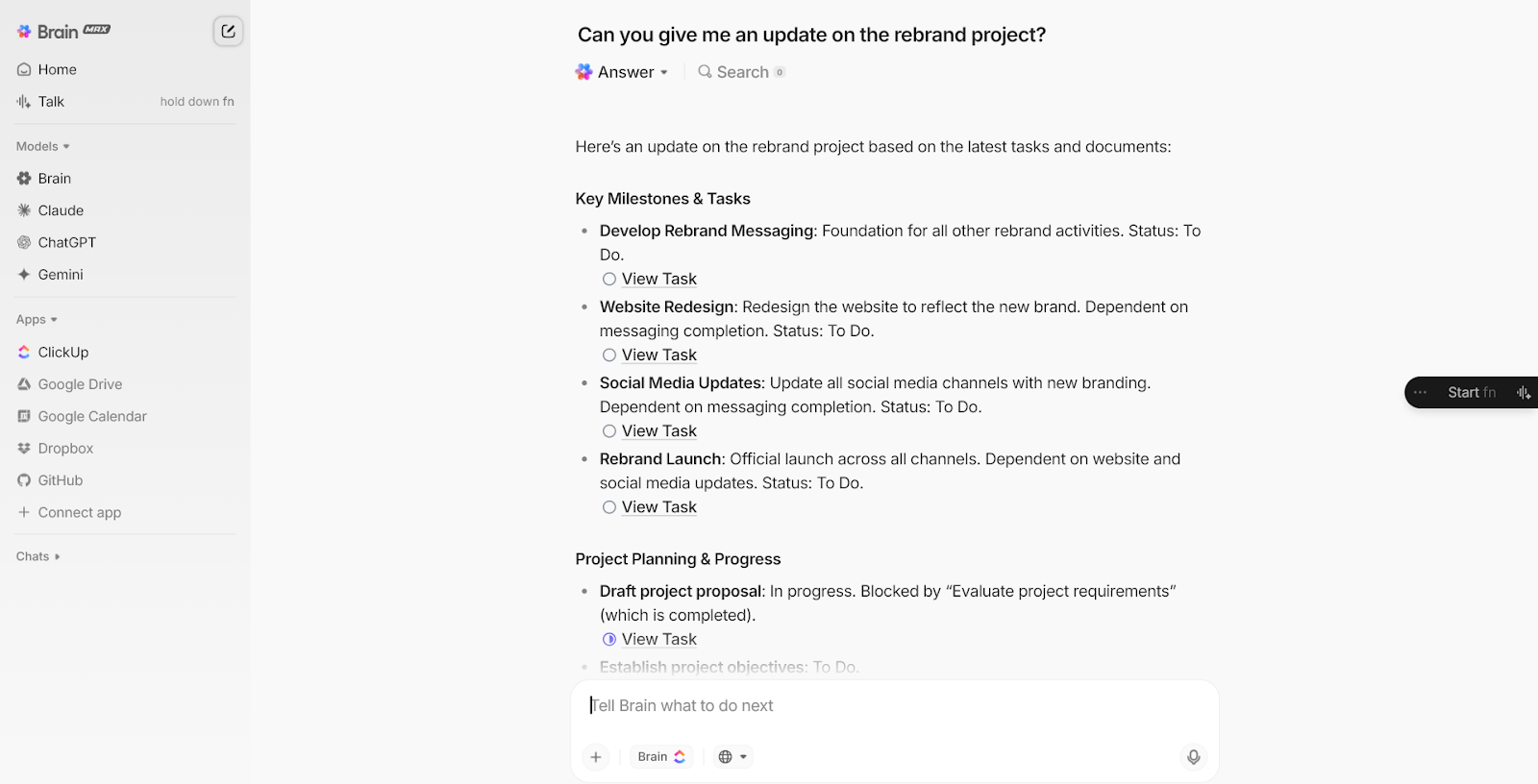

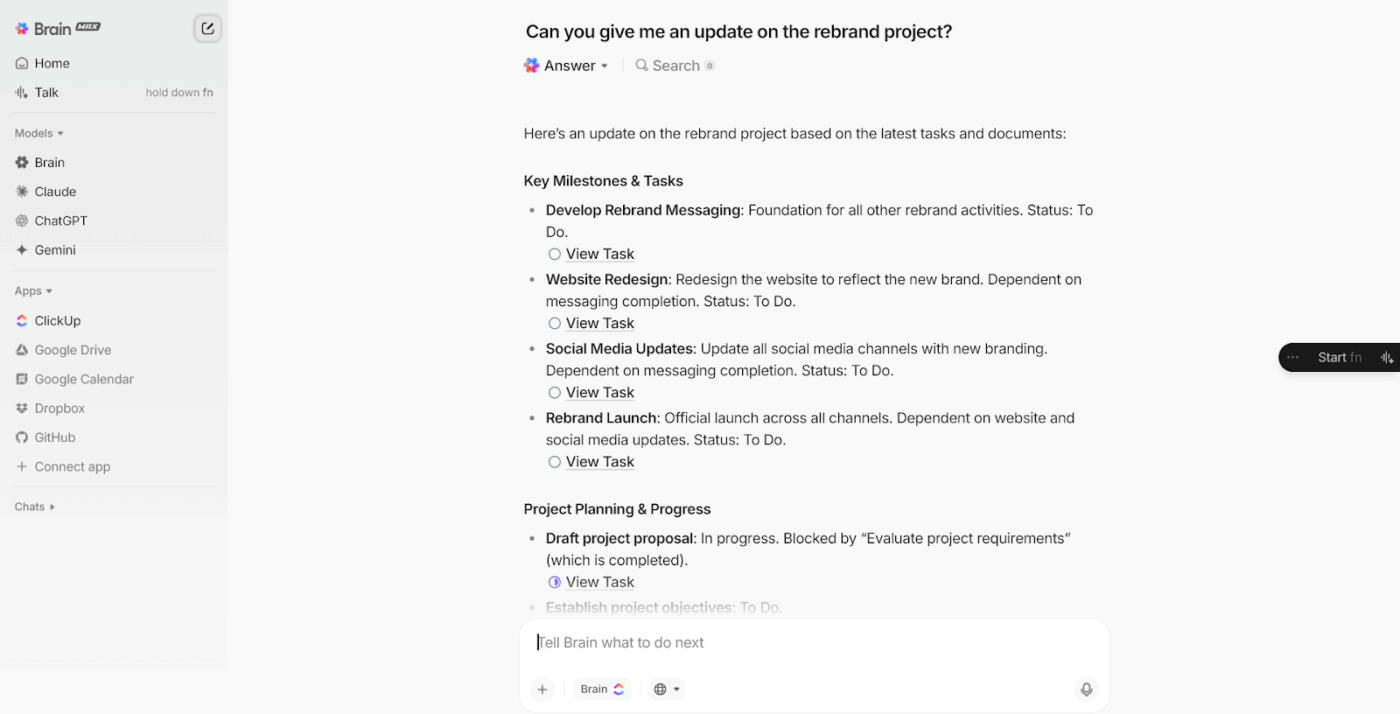

Sì, ClickUp Brain ti aiuta a lavorare all'interno delle attività e dei documenti. Ma a volte è necessario fare un passo indietro: uno spazio dedicato per porre domande, ottenere chiarezza e muoversi rapidamente.

Questo è esattamente lo scopo per cui è stato creato ClickUp Brain MAX.

Ti offre uno spazio dedicato per lavorare con l'IA, separato dalle tue attività e dai tuoi documenti, ma completamente connesso ad essi. Come tuo compagno di lavoro desktop basato sull'IA, ti aiuta a riflettere sul lavoro, a trovare risposte e a muoverti più velocemente senza dover cambiare strumento o spiegare nuovamente il contesto.

Digita una domanda e il sistema attingerà dai dati dell'area di lavoro in tempo reale, non da output IA isolati. Comprende il contesto del progetto, i livelli di priorità e gli incarichi dei titolari. Puoi anche pronunciare la tua query ad alta voce.

ClickUp Brain MAX è voice-first, sempre a portata di mano e progettato per ridurre il carico mentale della gestione del lavoro.

Supponiamo che tu stia guidando un lancio interfunzionale. Ti chiedi: "Cosa sta bloccando il lancio della campagna?" Brain MAX mostra le attività in ritardo, i titolari assegnati, i documenti collegati e i commenti contrassegnati pronti per essere gestiti.

Altri casi d'uso reali:

- Richiedi un elenco delle attività scadute raggruppate per assegnatario.

- Estrai un riepilogo/riassunto delle attività cardine completate in questo trimestre

- Ottieni la visualizzazione in tempo reale degli ostacoli in tutti i progetti attivi

- Individua i rischi prima che si aggravino, sulla base dell'attività delle attività.

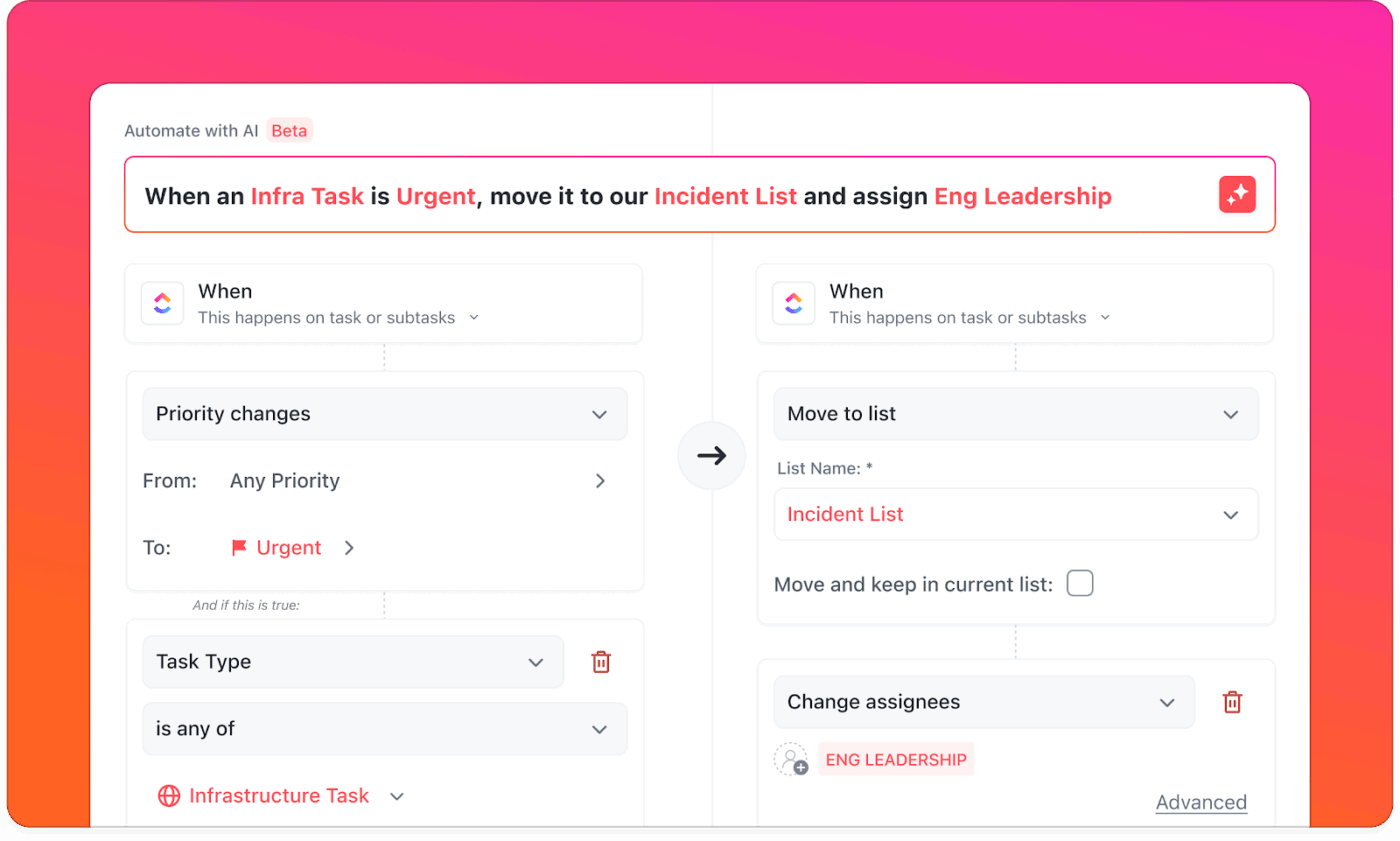

Automatizza le attività senza regole

Non dovrai più cercare tra trigger e azioni. Basta descrivere ciò che desideri in linguaggio naturale e l'IA creerà l'automazione in ClickUp.

Ad esempio, il tuo team di assistenza clienti gestisce lavori ripetitivi ogni volta che un cliente aziendale si registra. Tu dici a ClickUp Brain: Quando un'attività viene contrassegnata come "Onboarding aziendale", crea attività secondarie per la chiamata iniziale, il pacchetto di benvenuto, l'assegnazione tecnica e i promemoria di follow-up.

L'IA crea questa automazione del flusso di lavoro in più passaggi e ti consente di testarla prima di metterla in funzione.

Le migliori funzionalità di ClickUp

- Agenti IA che funzionano: implementa agenti ClickUp AI Autopilot specializzati che gestiscono attività ricorrenti come aggiornamenti di progetto e rapporti sullo stato, senza necessità di complessi addestramenti dei modelli.

- Evita il vendor lock-in: accedi a Claude, GPT, Gemini e altri modelli di IA leader attraverso un'unica interfaccia intuitiva senza dover ricostruire i flussi di lavoro.

- Non perdere mai il contesto: usa AI Notetaker di ClickUp per acquisire e riassumere automaticamente le riunioni con elementi da intraprendere che si effettuano direttamente con le tue attività.

- Trova qualsiasi cosa: cerca in tutto il tuo lavoro con Enterprise AI Search in ClickUp, che comprende il contesto del tuo team.

- Scalabilità senza complessità: ottieni funzionalità di IA di livello aziendale senza dover gestire infrastrutture o chiavi API: tutto funziona immediatamente.

- Brainstorming visivo: genera immagini direttamente nelle lavagne online di ClickUp utilizzando ClickUp Brain, quindi trasforma quelle idee in piani di progetto realizzabili.

- Chattare senza cambiare piattaforma: mantieni le conversazioni collegate al tuo lavoro effettivo utilizzando ClickUp Chat.

- Pianifica in modo più intelligente: lascia che ClickUp Calendario blocchi automaticamente il tempo di concentrazione e suggerisca riunioni ottimali in base alle scadenze dei progetti.

Limiti di ClickUp

- Non è possibile modificare, biforcare o contribuire all'infrastruttura IA sottostante come è possibile fare con Hugging Face.

Prezzi di ClickUp

Valutazioni e recensioni di ClickUp

- G2: 4,7/5 (oltre 10.385 recensioni)

- Capterra: 4,6/5 (oltre 4.000 recensioni)

Cosa dicono gli utenti reali di ClickUp?

Questa recensione su G2 dice davvero tutto su questa piattaforma di collaborazione IA:

Il nuovo Brain MAX ha notevolmente migliorato la mia produttività. La possibilità di utilizzare più modelli di IA, compresi modelli di ragionamento avanzati, a un prezzo accessibile rende facile centralizzare tutto in un'unica piattaforma. Funzionalità/funzioni come la conversione da voce a testo, l'automazione delle attività e l'integrazione con altre app rendono il flusso di lavoro molto più fluido e intelligente.

Il nuovo Brain MAX ha notevolmente migliorato la mia produttività. La possibilità di utilizzare più modelli di IA, compresi modelli di ragionamento avanzati, a un prezzo accessibile rende facile centralizzare tutto in un'unica piattaforma. Funzionalità/funzioni come la conversione da voce a testo, l'automazione delle attività e l'integrazione con altre app rendono il flusso di lavoro molto più fluido e intelligente.

📮 Approfondimento ClickUp: il 30% dei nostri intervistati si affida a strumenti di IA per la ricerca e la raccolta di informazioni. Ma esiste un'IA che ti aiuta a trovare quel file smarrito al lavoro o quell'importante thread di Slack che hai dimenticato di salvare?

Sì! La ricerca connessa basata sull'intelligenza artificiale di ClickUp è in grado di cercare istantaneamente in tutti i contenuti del tuo spazio di lavoro, comprese le app di terze parti integrate, fornendo approfondimenti, risorse e risposte. Risparmia fino a 5 ore alla settimana con la ricerca avanzata di ClickUp!

2. OpenAI (ideale per accedere a modelli avanzati di generazione di linguaggio e immagini)

tramite OpenAI

OpenAI ha fatto notizia quando è stato lanciato ChatGPT e, improvvisamente, tutti hanno ricominciato a parlare di IA. I loro modelli GPT gestiscono tutto, dalla scrittura di email al debug del codice, mentre DALL-E trasforma i tuoi prompt di testo più fantasiosi in immagini reali.

Ciò che distingue OpenAI è il modo in cui ha confezionato l'IA. Si ha accesso a modelli che prima erano confinati nei laboratori di ricerca. Certo, si paga per la comodità, ma quando le scadenze sono strette e i clienti ti stanno col fiato sul collo, quella comodità diventa inestimabile.

Le migliori funzionalità di OpenAI

- Ottimizza i modelli sui tuoi set di dati specifici per adattarli alla voce del tuo marchio, allo stile di scrittura o alle competenze nel tuo settore.

- Controlla il comportamento del modello utilizzando i prompt di sistema e le impostazioni di temperatura per regolare i livelli di creatività e la formattazione delle risposte.

- Elabora più formati di file, inclusi PDF, immagini e documenti, per un'analisi e un'estrazione completa dei contenuti.

- Tieni traccia dei costi di utilizzo e imposta limiti di spesa tramite dashboard di fatturazione dettagliate che suddividono le spese per modello e progetto.

- Crea incorporamenti per applicazioni di ricerca semantica che comprendono il significato anziché limitarsi a trovare corrispondenze tra parole chiave.

Limiti di OpenAI

- Opzioni di personalizzazione limitate per l'architettura dei modelli

- La dipendenza dalle chiamate API esterne influisce sulla funzionalità offline

- I limiti di frequenza possono influire sulle applicazioni ad alto volume in diversi settori industriali.

- OpenAI ha affrontato diverse cause legali e controlli sui dati di addestramento raccolti dal web senza consenso.

Prezzi OpenAI

- GPT-4. 1 Input: 2 $ per 1 milione di token Input memorizzato nella cache: 0,50 $ per 1 milione di token Output: 8 $ per 1 milione di token

- Input: 2 $ per 1 milione di token

- Input memorizzato nella cache: 0,50 $ per 1 milione di token

- Output: 8 $ per 1 milione di token

- GPT-4. 1 mini Input: 0,40 $ per 1 milione di token Input memorizzato nella cache: 0,10 $ per 1 milione di token Output: 1,60 $ per 1 milione di token

- Input: 0,40 $ per 1 milione di token

- Input memorizzato nella cache: 0,10 $ per 1 milione di token

- Output: 1,60 $ per 1 milione di token

- GPT-4. 1 nano Input: 0,100 $ per 1 milione di token Input memorizzato nella cache: 0,025 $ per 1 milione di token Output: 0,400 $ per 1 milione di token

- Input: 0,100 $ per 1 milione di token

- Input memorizzato nella cache: 0,025 $ per 1 milione di token

- Output: 0,400 $ per 1 milione di token

- OpenAI o3 Input: 2 $ per 1 milione di token Input memorizzato nella cache: 0,50 $ per 1 milione di token Output: 8 $ per 1 milione di token

- Input: 2 $ per 1 milione di token

- Input memorizzato nella cache: 0,50 $ per 1 milione di token

- Output: 8 $ per 1 milione di token

- OpenAI o4-mini Input: 1,100 $ per 1 milione di token Input memorizzato nella cache: 0,275 $ per 1 milione di token Output: 4,400 $ per 1 milione di token

- Input: 1,100 $ per 1 milione di token

- Input memorizzato nella cache: 0,275 $ per 1 milione di token

- Output: 4.400 $ per 1 milione di token

- Modelli di ottimizzazione GPT-4. 1 Input: 3 $ per 1 milione di token Input memorizzato nella cache: 0,75 $ per 1 milione di token Output: 12 $ per 1 milione di token Formazione: 25 $ per 1 milione di token GPT-4. 1 mini Input: 0,80 $ per 1 milione di token Input memorizzato nella cache: 0,20 $ per 1 milione di token Output: 3,20 $ per 1 milione di token Formazione: 5 $ per 1 milione di token GPT-4. 1 nano Input: 0,20 $ per 1 milione di token Input memorizzato nella cache: 0,05 $ per 1 milione di token Output: 0,80 $ per 1 milione di token Formazione: 1,50 $ per 1 milione di token o4-mini Input: 4 $ per 1 milione di token Input memorizzato nella cache: 1 $ per 1 milione di token Output: 16 $ per 1 milione di token Formazione: 100 $ per ora di formazione

- GPT-4. 1 Input: 3 $ per 1 milione di token Input memorizzato nella cache: 0,75 $ per 1 milione di token Output: 12 $ per 1 milione di token Formazione: 25 $ per 1 milione di token

- Input: 3 $ per 1 milione di token

- Input memorizzato nella cache: 0,75 $ per 1 milione di token

- Output: 12 $ per 1 milione di token

- Formazione: 25 $ per 1 milione di token

- GPT-4. 1 mini Input: 0,80 $ per 1 milione di token Input memorizzato nella cache: 0,20 $ per 1 milione di token Output: 3,20 $ per 1 milione di token Formazione: 5 $ per 1 milione di token

- Input: 0,80 $ per 1 milione di token

- Input memorizzato nella cache: 0,20 $ per 1 milione di token

- Output: 3,20 $ per 1 milione di token

- Formazione: 5 $ per 1 milione di token

- GPT-4. 1 nano Input: 0,20 $ per 1 milione di token Input memorizzato nella cache: 0,05 $ per 1 milione di token Output: 0,80 $ per 1 milione di token Formazione: 1,50 $ per 1 milione di token

- Input: 0,20 $ per 1 milione di token

- Input memorizzato nella cache: 0,05 $ per 1 milione di token

- Output: 0,80 $ per 1 milione di token

- Formazione: 1,50 $ per 1 milione di token

- o4-mini Input: 4 $ per 1 milione di token Input memorizzato nella cache: 1 $ per 1 milione di token Output: 16 $ per 1 milione di token Formazione: 100 $ per ora di formazione

- Input: 4 $ per 1 milione di token

- Input memorizzato nella cache: 1 $ per 1 milione di token

- Output: 16 $ per 1 milione di token

- Formazione: 100 $ per ogni ora di formazione

- Input: 2 $ per 1 milione di token

- Input memorizzato nella cache: 0,50 $ per 1 milione di token

- Output: 8 $ per 1 milione di token

- Input: 0,40 $ per 1 milione di token

- Input memorizzato nella cache: 0,10 $ per 1 milione di token

- Output: 1,60 $ per 1 milione di token

- Input: 0,100 $ per 1 milione di token

- Input memorizzato nella cache: 0,025 $ per 1 milione di token

- Output: 0,400 $ per 1 milione di token

- Input: 2 $ per 1 milione di token

- Input memorizzato nella cache: 0,50 $ per 1 milione di token

- Output: 8 $ per 1 milione di token

- Input: 1,100 $ per 1 milione di token

- Input memorizzato nella cache: 0,275 $ per 1 milione di token

- Output: 4.400 $ per 1 milione di token

- GPT-4. 1 Input: 3 $ per 1 milione di token Input memorizzato nella cache: 0,75 $ per 1 milione di token Output: 12 $ per 1 milione di token Formazione: 25 $ per 1 milione di token

- Input: 3 $ per 1 milione di token

- Input memorizzato nella cache: 0,75 $ per 1 milione di token

- Output: 12 $ per 1 milione di token

- Formazione: 25 $ per 1 milione di token

- GPT-4. 1 mini Input: 0,80 $ per 1 milione di token Input memorizzato nella cache: 0,20 $ per 1 milione di token Output: 3,20 $ per 1 milione di token Formazione: 5 $ per 1 milione di token

- Input: 0,80 $ per 1 milione di token

- Input memorizzato nella cache: 0,20 $ per 1 milione di token

- Output: 3,20 $ per 1 milione di token

- Formazione: 5 $ per 1 milione di token

- GPT-4. 1 nano Input: 0,20 $ per 1 milione di token Input memorizzato nella cache: 0,05 $ per 1 milione di token Output: 0,80 $ per 1 milione di token Formazione: 1,50 $ per 1 milione di token

- Input: 0,20 $ per 1 milione di token

- Input memorizzato nella cache: 0,05 $ per 1 milione di token

- Output: 0,80 $ per 1 milione di token

- Formazione: 1,50 $ per 1 milione di token

- o4-mini Input: 4 $ per 1 milione di token Input memorizzato nella cache: 1 $ per 1 milione di token Output: 16 $ per 1 milione di token Formazione: 100 $ per ora di formazione

- Input: 4 $ per 1 milione di token

- Input memorizzato nella cache: 1 $ per 1 milione di token

- Output: 16 $ per 1 milione di token

- Formazione: 100 $ per ogni ora di formazione

- Input: 3 $ per 1 milione di token

- Input memorizzato nella cache: 0,75 $ per 1 milione di token

- Output: 12 $ per 1 milione di token

- Formazione: 25 $ per 1 milione di token

- Input: 0,80 $ per 1 milione di token

- Input memorizzato nella cache: 0,20 $ per 1 milione di token

- Output: 3,20 $ per 1 milione di token

- Formazione: 5 $ per 1 milione di token

- Input: 0,20 $ per 1 milione di token

- Input memorizzato nella cache: 0,05 $ per 1 milione di token

- Output: 0,80 $ per 1 milione di token

- Formazione: 1,50 $ per 1 milione di token

- Input: 4 $ per 1 milione di token

- Input memorizzato nella cache: 1 $ per 1 milione di token

- Output: 16 $ per 1 milione di token

- Formazione: 100 $ per ogni ora di formazione

Valutazioni e recensioni di OpenAI

- G2: 4,7/5 (oltre 830 recensioni)

- Capterra: 4,5/5 (oltre 220 recensioni)

Cosa dicono gli utenti reali di OpenAI?

Da una recensione su G2:

La sua API è fantastica, con un'interfaccia utente eccellente e non ho riscontrato alcun problema durante l'utilizzo di chatgpt. Mi è piaciuto molto e consiglio vivamente di provarlo, scaricarlo e prendere rapidamente una decisione.

La sua API è fantastica, con un'interfaccia utente eccellente e non ho riscontrato alcun problema durante l'utilizzo di chatgpt. Mi è piaciuto molto e consiglio vivamente di provarlo, scaricarlo e prendere rapidamente una decisione.

🎥 Guarda: Come utilizzare ClickUp Brain come assistente personale, sempre e ovunque.

💡 Suggerimento professionale: non affidarti a un unico parametro. Suddividi la valutazione LLM in base alla sua capacità di gestire input strutturati (ad es. tabelle, elenchi) rispetto a prompt non strutturati (attività aperte). Riuscirai a individuare più rapidamente i modelli di errore.

3. Anthropic Claude (ideale per conversazioni IA sicure e contestualizzate)

tramite Anthropic

Claude adotta un approccio diverso alla sicurezza dell'IA. Invece di applicare filtri ai contenuti, Anthropic lo ha addestrato a riflettere attentamente sui problemi. Noterai che Claude considera più punti di vista prima di rispondere, il che lo rende adatto a discussioni sfumate su argomenti complessi.

La finestra di contesto è enorme, quindi puoi inserirvi interi documenti e avere conversazioni reali sul contenuto.

Pensa a quelle volte in cui hai voluto discutere un articolo di ricerca o analizzare un lungo rapporto. Claude gestisce questi scenari in modo naturale. Ricorda anche tutto ciò che è stato detto in precedenza nella conversazione, così non devi ripeterti continuamente.

Le migliori funzionalità di Anthropic Claude

- Scrivi e debugghi il codice in decine di linguaggi di programmazione, spiegando la logica e suggerendo miglioramenti lungo il percorso.

- Effettua ricerche sul web in tempo reale per accedere alle informazioni più aggiornate e verificare i fatti durante le conversazioni.

- Ragiona su complessi dilemmi etici e argomenti sfumati, presentando prospettive equilibrate anziché risposte eccessivamente semplificate.

- Esegui calcoli matematici avanzati e analisi statistiche con spiegazioni dettagliate e verifiche di ogni passaggio.

- Genera output strutturati come JSON, XML e YAML che seguono schemi specifici per le integrazioni API.

Limiti di Anthropic Claude

- Ha una selezione di modelli più ridotta rispetto alle alternative a Claude.

- Meno flessibilità per l'addestramento di modelli personalizzati

- Latenza più elevata per alcune attività specializzate

Prezzi di Anthropic Claude

- Claude Opus 4 Input: 15 $ per 1 milione di token Output: 75 $ per 1 milione di token Caching dei prompt: Scrittura: 18,75 $ per 1 milione di token Lettura: 1,50 $ per 1 milione di token

- Input: 15 $ per 1 milione di token

- Output: 75 $ per 1 milione di token

- Caching dei prompt: Scrittura: 18,75 $ per 1 milione di token Lettura: 1,50 $ per 1 milione di token

- Scrivi: 18,75 $ per 1 milione di token

- Leggi: 1,50 $ per 1 milione di token

- Claude Sonnet 4 Input: 3 $ per 1 milione di token Output: 15 $ per 1 milione di token Caching dei prompt: Scrittura: 3,75 $ per 1 milione di token Lettura: 0,30 $ per 1 milione di token

- Input: 3 $ per 1 milione di token

- Output: 15 $ per 1 milione di token

- Caching dei prompt: Scrittura: 3,75 $ per 1 milione di token Lettura: 0,30 $ per 1 milione di token

- Scrivi: 3,75 $ per 1 milione di token

- Leggi: 0,30 $ per 1 milione di token

- Claude Haiku 3. 5 Input: 0,80 $ per 1 milione di token Output: 4 $ per 1 milione di token Caching dei prompt: Scrittura: 1 $ per 1 milione di token Lettura: 0,08 $ per 1 milione di token

- Input: 0,80 $ per 1 milione di token

- Output: 4 $ per 1 milione di token

- Caching dei prompt: Scrittura: 1 $ per 1 milione di token Lettura: 0,08 $ per 1 milione di token

- Scrivi: 1 $ per 1 milione di token

- Leggi: 0,08 $ per 1 milione di token

- Input: 15 $ per 1 milione di token

- Output: 75 $ per 1 milione di token

- Caching dei prompt: Scrittura: 18,75 $ per 1 milione di token Lettura: 1,50 $ per 1 milione di token

- Scrivi: 18,75 $ per 1 milione di token

- Leggi: 1,50 $ per 1 milione di token

- Scrivi: 18,75 $ per 1 milione di token

- Leggi: 1,50 $ per 1 milione di token

- Input: 3 $ per 1 milione di token

- Output: 15 $ per 1 milione di token

- Caching dei prompt: Scrittura: 3,75 $ per 1 milione di token Lettura: 0,30 $ per 1 milione di token

- Scrivi: 3,75 $ per 1 milione di token

- Leggi: 0,30 $ per 1 milione di token

- Scrivi: 3,75 $ per 1 milione di token

- Leggi: 0,30 $ per 1 milione di token

- Input: 0,80 $ per 1 milione di token

- Output: 4 $ per 1 milione di token

- Caching dei prompt: Scrittura: 1 $ per 1 milione di token Lettura: 0,08 $ per 1 milione di token

- Scrivi: 1 $ per 1 milione di token

- Leggi: 0,08 $ per 1 milione di token

- Scrivi: 1 $ per 1 milione di token

- Leggi: 0,08 $ per 1 milione di token

Valutazioni e recensioni di Anthropic Claude

- G2: 4,4/5 (oltre 55 recensioni)

- Capterra: 4,5/5 (oltre 20 recensioni)

Cosa dicono gli utenti reali di Anthropic Claude?

Basato su un commento su Reddit:

Onestamente? Claude sembra proprio una brava "persona". Nelle sue decisioni tiene conto del benessere umano con una profondità che non si riscontra in altri modelli. Se fossi costretto a scegliere un LLM come leader mondiale, Claude sarebbe la mia prima scelta. Non mi fiderei necessariamente degli altri allo stesso modo senza una formazione etica o sulla costituzione della personalità.

Onestamente? Claude sembra proprio una brava "persona". Nelle sue decisioni tiene conto del benessere umano con una profondità che non si riscontra in altri modelli. Se fossi costretto a scegliere un LLM come leader mondiale, Claude sarebbe la mia prima scelta. Non mi fiderei necessariamente degli altri allo stesso modo senza una formazione etica o sulla costituzione della personalità.

🧠 Curiosità: nel 2012, un modello chiamato AlexNet ha battuto gli esseri umani nel riconoscimento delle immagini. Era più veloce, più preciso e non si stancava mai. Quel momento ha cambiato il modo in cui le persone vedevano il potenziale dell'IA in campi come la sanità, la sicurezza e la robotica.

📖 Leggi anche: Le migliori alternative e concorrenti di Anthropic IA

4. Cohere (ideale per la creazione di soluzioni di elaborazione del linguaggio naturale di livello aziendale)

tramite Cohere

Cohere ha creato la sua piattaforma appositamente per le aziende che necessitano di intelligenza artificiale ma non possono permettersi di scendere a compromessi sulla privacy dei dati. Le sue funzionalità multilingue coprono oltre 100 lingue, il che è fondamentale se hai a che fare con clienti globali o mercati internazionali.

Gli embedding funzionano particolarmente bene per le applicazioni di ricerca in cui è necessario comprendere il significato piuttosto che limitarsi a trovare corrispondenze tra parole chiave. È anche possibile addestrare i propri classificatori IA personalizzati, il che lo rende pratico per i team che necessitano di soluzioni IA ma non dispongono di data scientist dedicati.

Le migliori funzionalità di Cohere

- Ottimizza i modelli utilizzando i tuoi dati proprietari, mantenendo il controllo completo sui set di dati di addestramento e sui pesi dei modelli.

- Scala automaticamente la capacità di inferenza in base ai modelli di domanda senza gestire l'infrastruttura GPU sottostante.

- Implementa sistemi di generazione potenziati dal recupero che possono citare le fonti e fornire l'attribuzione per i contenuti generati.

- Monitora le prestazioni dei modelli e i modelli di utilizzo attraverso dashboard analitiche complete e sistemi di allerta.

- Integrazione con i sistemi di autenticazione esistenti utilizzando SSO, SAML e controlli di accesso basati sui ruoli per il monitoraggio degli esperimenti.

Limiti di Cohere

- Comunità più piccola e meno integrazioni di terze parti

- Capacità di visione artificiale limitate rispetto alle piattaforme multimodali

- Sono disponibili meno modelli pre-addestrati per domini specializzati.

- Documentazione meno estesa per casi d'uso avanzati e configurazioni ibride

Prezzi di Cohere

- Comando A Input: 2,50 $ per 1 milione di token Output: 10 $ per 1 milione di token

- Input: 2,50 $ per 1 milione di token

- Output: 10 $ per 1 milione di token

- Comando R Input: 0,15 $ per 1 milione di token Output: 0,60 $ per 1 milione di token

- Input: 0,15 $ per 1 milione di token

- Output: 0,60 $ per 1 milione di token

- Comando R7B Input: 0,0375 $ per 1 milione di token Output: 0,15 $ per 1 milione di token

- Input: 0,0375 $ per 1 milione di token

- Output: 0,15 $ per 1 milione di token

- Input: 2,50 $ per 1 milione di token

- Output: 10 $ per 1 milione di token

- Input: 0,15 $ per 1 milione di token

- Output: 0,60 $ per 1 milione di token

- Input: 0,0375 $ per 1 milione di token

- Output: 0,15 $ per 1 milione di token

Valutazioni e recensioni di Cohere

- G2: recensioni insufficienti

- Capterra: Recensioni insufficienti

Cosa dicono gli utenti reali di Cohere?

Secondo una recensione di Capterra:

Configurare Cohere è stato piuttosto facile e la documentazione era abbastanza semplice da seguire. Poter vedere come i nostri utenti utilizzano l'app è stato davvero utile e interessante fin dall'inizio. […] La versione gratis del software ha un numero di sessioni estremamente limitato e, con la crescita della nostra base di utenti, stiamo trovando l'applicazione meno utile poiché un numero maggiore di sessioni è nascosto dietro un paywall.

Configurare Cohere è stato piuttosto facile e la documentazione era abbastanza semplice da seguire. Poter vedere come i nostri utenti utilizzano l'app è stato davvero utile e interessante fin dall'inizio. […] La versione gratuita del software ha un numero di sessioni estremamente limitato e, con la crescita della nostra base di utenti, stiamo trovando l'applicazione meno utile poiché sempre più sessioni sono nascoste dietro un paywall.

🔍 Lo sapevate? Modelli come GPT‑4 e Grok 4 hanno modificato le loro risposte quando hanno ricevuto un feedback negativo (anche se la loro prima risposta era corretta). Hanno iniziato a dubitare di sé stessi dopo aver ricevuto un feedback contraddittorio. È stranamente simile al modo in cui le persone si comportano sotto stress e solleva interrogativi sull'affidabilità delle loro risposte.

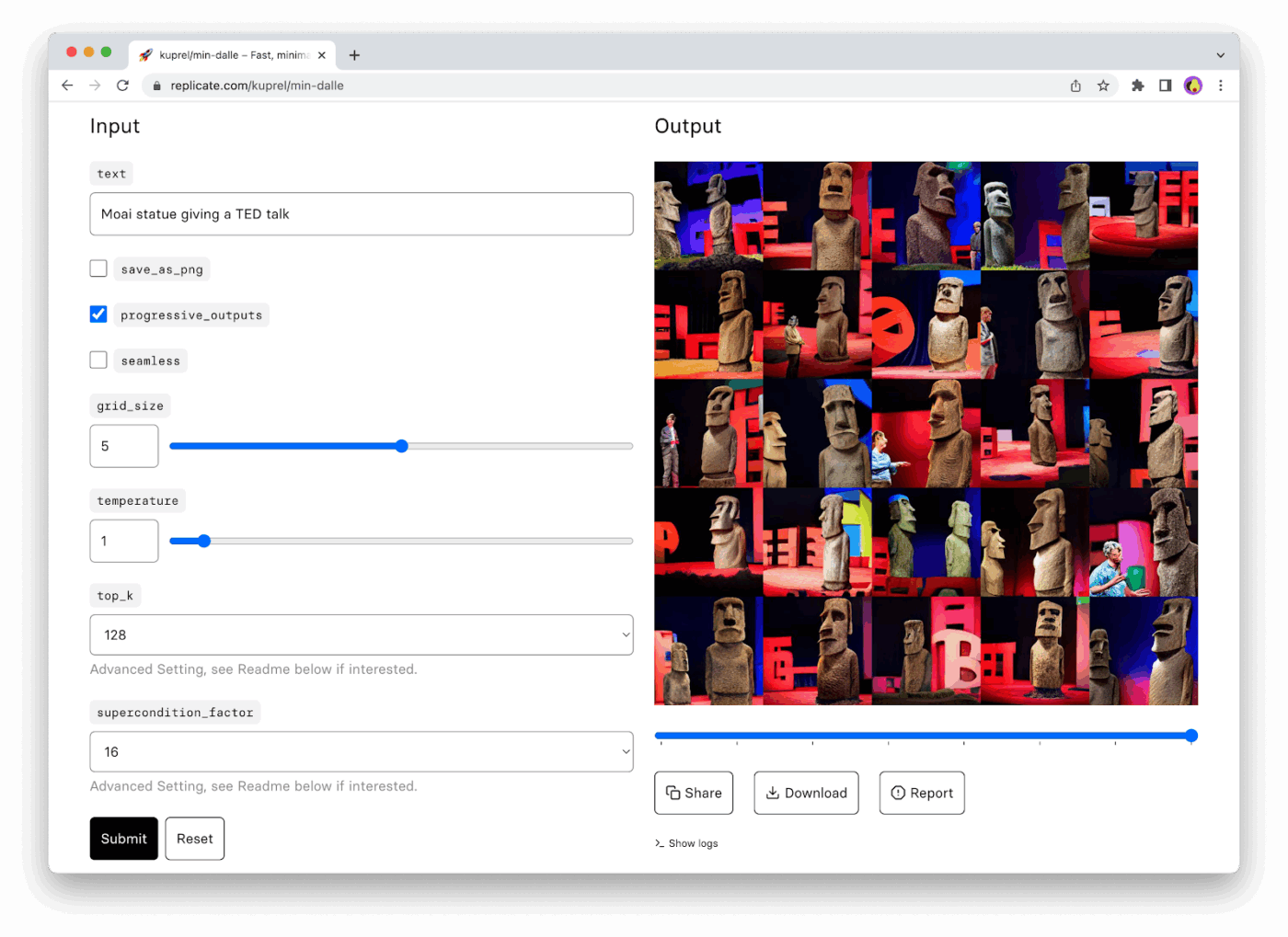

5. Replicate (ideale per l'esecuzione di modelli di IA open source senza gestione dell'infrastruttura)

tramite Replicate

Replicate è come avere una vasta libreria di modelli di IA senza il grattacapo della gestione dei server. Qualcuno ha creato un fantastico generatore di immagini? Probabilmente è su Replicate. Vuoi provare quel nuovo modello di sintesi vocale di cui tutti parlano? Basta effettuare una chiamata API.

L'app di IA gestisce tutta la complessità dell'infrastruttura, così puoi sperimentare decine di modelli diversi senza doverti impegnare con uno solo. Paghi solo quando usi qualcosa, il che la rende perfetta per la prototipazione.

Inoltre, quando trovi un modello che funziona, puoi persino implementare le tue versioni personalizzate utilizzando il loro semplice sistema di container.

Replica le migliori funzionalità/funzioni

- Controlla la versione delle implementazioni dei tuoi modelli con funzionalità di rollback e test A/B tra diverse versioni dei modelli.

- Configura i webhook per ricevere notifiche quando le previsioni di lunga durata vengono completate o incontrano errori.

- Elabora in batch più input contemporaneamente per ridurre i costi per previsione e migliorare l'efficienza della produttività.

- Biforca i modelli esistenti per creare versioni personalizzate con parametri o dati di addestramento diversi.

Replica dei limiti

- Hai meno controllo sull'ambiente di hosting del modello e sulle configurazioni

- Esistono potenziali problemi di latenza per le applicazioni in tempo reale e le esigenze dell'azienda.

- Opzioni limitate per la personalizzazione e la messa a punto dei modelli

- Dipendenza dalla disponibilità e dalla manutenzione di modelli di terze parti

Replica dei prezzi

- I prezzi variano a seconda del modello.

Replica valutazioni e recensioni

- G2: recensioni insufficienti

- Capterra: Recensioni insufficienti

Cosa dicono gli utenti reali di Replicate?

Una nota su Reddit osserva:

Ad ogni modo, secondo me Replicate è l'opzione più facile da usare per provare nuovi modelli di immagini o video. Dubito che sia la soluzione più conveniente se hai molti utenti, ma per un MVP potrebbe farti risparmiare un sacco di seccature e soldi (rispetto al noleggio di una GPU a ore).

Ad ogni modo, secondo me Replicate è l'opzione più facile da usare per provare nuovi modelli di immagini o video. Dubito che sia la soluzione più conveniente se hai molti utenti, ma per un MVP potrebbe farti risparmiare un sacco di seccature e soldi (rispetto al noleggio di una GPU a ore).

💡 Suggerimento professionale: ottimizza con moderazione. Non è sempre necessario ottimizzare un modello per ottenere risultati specifici per un determinato dominio. Prova prima l'ingegneria dei prompt intelligenti + la generazione aumentata dal recupero (RAG). Investi nell'ottimizzazione solo se raggiungi costantemente i limiti massimi di accuratezza o pertinenza.

6. TensorFlow (ideale per creare modelli di machine learning personalizzati da zero)

tramite TensorFlow

TensorFlow ti offre il controllo completo sul tuo destino nel campo dell'apprendimento automatico (il che può essere sia una benedizione che una maledizione). Google ha reso open source il proprio framework ML di produzione, il che significa che puoi ottenere gli stessi strumenti che utilizzano internamente.

La flessibilità è incredibile: puoi costruire qualsiasi cosa, dalla semplice regressione lineare alle complesse architetture dei trasformatori.

TensorFlow Hub fornisce modelli pre-addestrati che puoi perfezionare, mentre TensorBoard ti offre analisi in tempo reale sulle prestazioni di addestramento. Tuttavia, questa potenza comporta una certa complessità. Dovrai dedicare del tempo all'apprendimento di concetti che le piattaforme di livello superiore rendono astratti.

Le migliori funzionalità di TensorFlow

- Analizza il profilo delle prestazioni dei modelli e identifica i colli di bottiglia utilizzando strumenti di debug avanzati che mostrano l'utilizzo della memoria e i grafici di calcolo.

- Converti i modelli tra diversi formati come SavedModel, TensorFlow Lite e ONNX, per garantire la compatibilità multipiattaforma.

- Implementa funzioni di perdita personalizzate e algoritmi di ottimizzazione che non sono disponibili nelle librerie standard di machine learning.

- Utilizza l'addestramento a precisione mista per ridurre l'utilizzo della memoria e accelerare l'addestramento sulle moderne architetture GPU.

- Crea pipeline di dati personalizzate con tf. data che gestiscono in modo efficiente grandi set di dati con pre-elaborazione e aumento.

Limiti di TensorFlow

- Richiede risorse computazionali significative per l'addestramento di modelli di grandi dimensioni.

- Processo di debug complesso rispetto alle alternative Hugging Face di livello superiore

- Configurazione e impostazione che richiedono molto tempo per casi d'uso avanzati

Prezzi di TensorFlow

- Prezzi personalizzati

Valutazioni e recensioni di TensorFlow

- G2: 4,5/5 (oltre 125 recensioni)

- Capterra: 4,6/5 (oltre 100 recensioni)

Cosa dicono gli utenti reali di TensorFlow?

Un utente su G2 sottolinea:

Adoro la potenza e la flessibilità di TensorFlow per la creazione e l'addestramento di modelli di deep learning. Keras rende tutto un po' più semplice e i modelli pre-addestrati consentono di risparmiare molto tempo. Inoltre, la community è fantastica quando mi trovo in difficoltà. […] La curva di apprendimento è ripida, soprattutto per i principianti. A volte i messaggi di errore sono troppo complicati da capire e il debug è frustrante. Inoltre, richiede una grande potenza di calcolo, il che può essere un problema se non si dispone di hardware di fascia alta.

Adoro la potenza e la flessibilità di TensorFlow per la creazione e l'addestramento di modelli di deep learning. Keras rende tutto un po' più semplice e i modelli pre-addestrati consentono di risparmiare molto tempo. Inoltre, la community è fantastica quando mi trovo in difficoltà. […] La curva di apprendimento è ripida, soprattutto per i principianti. A volte i messaggi di errore sono troppo complicati da capire e il debug è frustrante. Inoltre, richiede una grande potenza di calcolo, il che può essere un problema se non si dispone di hardware di fascia alta.

🧠 Curiosità: i ricercatori hanno scoperto che i modelli linguistici spesso suggeriscono pacchetti software che non esistono. Circa il 19,7% dei campioni di codice includeva nomi inventati, che possono portare ad attacchi di squatting.

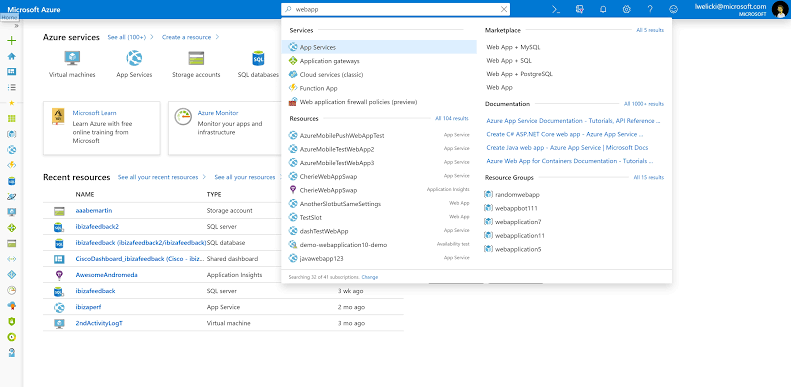

7. Azure Machine Learning (ideale per integrare i flussi di lavoro ML con i servizi cloud Microsoft)

tramite Microsoft Azure

Azure ML è la scelta naturale se la tua organizzazione utilizza già Microsoft. Lo strumento offre sia interfacce point-and-click per gli utenti aziendali che ambienti di programmazione completi per i data scientist.

AutoML si occupa del lavoro pesante quando hai bisogno di risultati rapidi, provando automaticamente diversi algoritmi e iperparametri. Nel frattempo, l'integrazione con Power BI significa che i tuoi modelli possono essere inseriti direttamente nei dashboard esecutivi.

Ottieni un solido controllo delle versioni per i modelli, pipeline di implementazione automatizzate e monitoraggio che ti avvisa quando le prestazioni del modello iniziano a peggiorare.

Le migliori funzionalità di Azure Machine Learning

- Pianifica pipeline di riqualificazione automatizzate che si attivano quando sono disponibili nuovi dati o quando le prestazioni del modello diminuiscono.

- Crea ambienti Docker personalizzati per l'addestramento e l'implementazione riproducibili dei modelli su diversi target di calcolo.

- Implementa funzionalità di interpretabilità dei modelli che spiegano le previsioni utilizzando LIME, SHAP e altre tecniche di spiegabilità.

- Imposta il monitoraggio della deriva dei dati che ti avvisa quando i dati in entrata differiscono in modo significativo dai set di dati di addestramento.

- Gestisci cluster di elaborazione che si adattano automaticamente in base alle esigenze di carico di lavoro, ottimizzando al contempo l'efficienza dei costi.

Limitazioni di Azure Machine Learning

- Esistono preoccupazioni relative al vendor lock-in per le organizzazioni che utilizzano strategie multi-cloud.

- Flessibilità limitata rispetto alle alternative open source di Hugging Face

Prezzi di Azure Machine Learning

- Prezzi personalizzati

Valutazioni e recensioni di Azure Machine Learning

- G2: 4,3/5 (oltre 85 recensioni)

- Capterra: 4,5/5 (30 recensioni)

Cosa dicono gli utenti reali di Azure Machine Learning?

Come condiviso durante la condivisione su G2:

Il servizio è facile da usare e offre molte funzionalità interessanti per caricare dati e individuarne i modelli; l'interfaccia potrebbe essere migliorata, ma soddisfa le mie esigenze. Se hai dubbi sull'implementazione, puoi trovare molte informazioni sul web o richiedere supporto direttamente al supporto Microsoft.

Il servizio è facile da usare e offre molte funzionalità interessanti per caricare dati e individuarne i modelli; l'interfaccia potrebbe essere migliorata, ma soddisfa le mie esigenze. Se hai dubbi sull'implementazione, puoi trovare molte informazioni sul web o richiedere assistenza direttamente al supporto Microsoft.

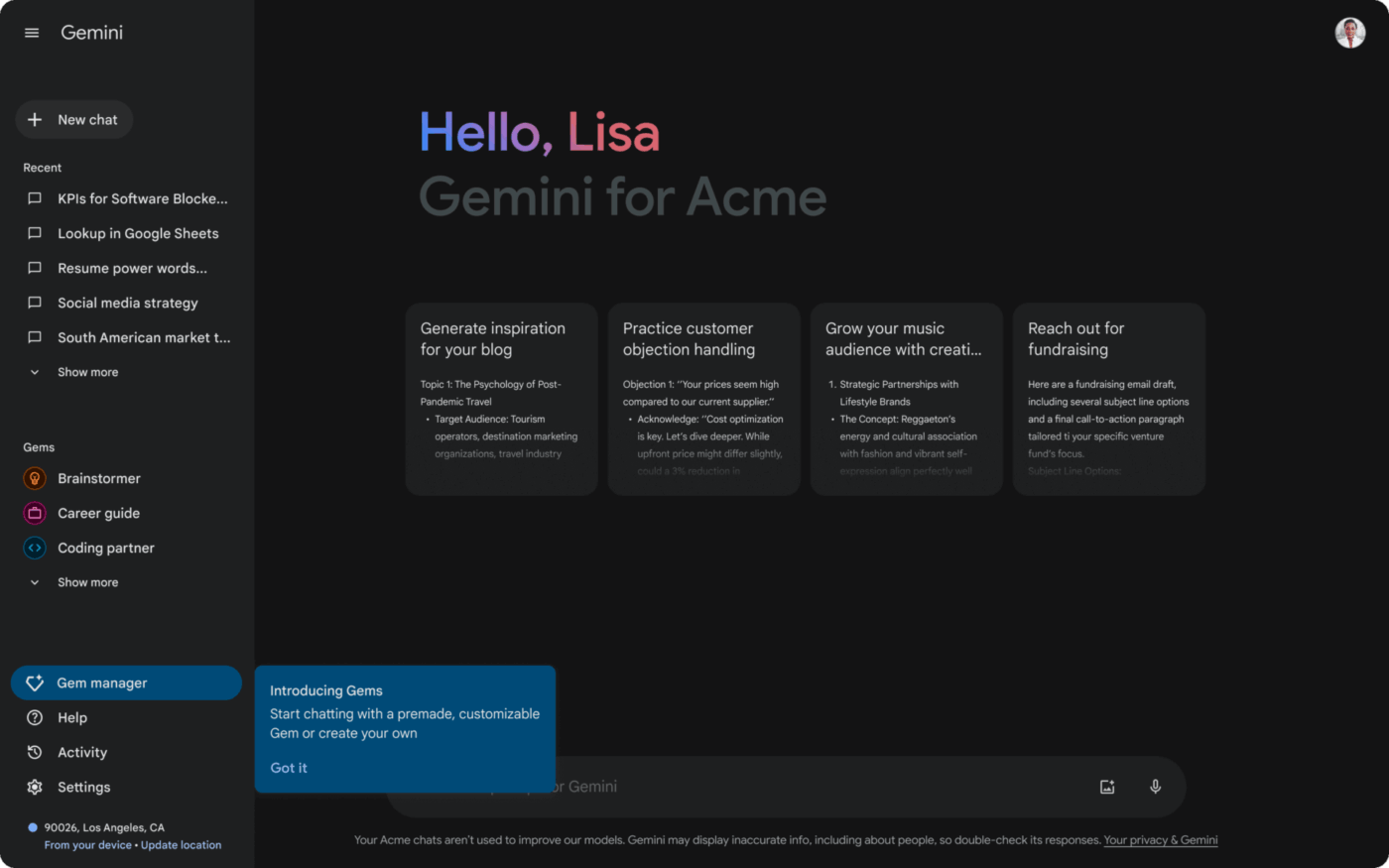

8. Google Gemini (ideale per elaborare più tipi di contenuti in un'unica interazione)

tramite Google Gemini

Gemini di Google è in grado di comprendere contemporaneamente più tipi di contenuti. Puoi mostrare un grafico e porre domande sui dati, oppure caricare immagini e avviare conversazioni su ciò che vi è raffigurato. Le capacità matematiche e di codifica sono particolarmente avanzate. Elabora equazioni complesse passo dopo passo e spiega il proprio ragionamento.

La finestra contestuale gestisce enormi quantità di testo, rendendola utile per analizzare interi articoli di ricerca o documenti lunghi. La cosa interessante è come mantiene il flusso della conversazione tra diversi tipi di contenuti senza perdere di vista l'argomento di discussione.

Le migliori funzionalità di Google Gemini

- Traduci tra decine di lingue preservando il contesto e le sfumature culturali del testo originale.

- Genera ed esegui codice Python direttamente all'interno delle conversazioni, mostrando i risultati e il debug degli errori in tempo reale.

- Estrai dati strutturati da origini dati non strutturate come ricevute, moduli e documenti scritti a mano.

- Analizza contemporaneamente sia i componenti visivi che quelli audio per ottenere riepiloghi dettagliati dei contenuti video.

- Esegui attività di ragionamento complessi che richiedono la combinazione di informazioni provenienti da più fonti e tipi di contenuti.

Limiti di Google Gemini

- Disponibilità limitata in alcune regioni e per casi d'uso specifici.

- Opzioni di personalizzazione dei modelli meno estese rispetto alle alternative consolidate

- Gli utenti hanno espresso preoccupazioni riguardo alla privacy dei dati all'interno dell'ecosistema di Google.

Prezzi di Google Gemini

- Free

- Livello a pagamento: i prezzi variano a seconda del modello

Valutazioni e recensioni di Google Gemini

- G2: 4,4/5 (oltre 245 recensioni)

- Capterra: recensioni insufficienti

🧠 Curiosità: si potrebbe pensare che modelli migliori commettano meno errori, ma può verificarsi il contrario. Man mano che gli LLM diventano più grandi e avanzati, a volte hanno più allucinazioni, soprattutto quando vengono richiesti fatti. Anche le versioni più recenti mostrano errori più sicuri, il che li rende più difficili da individuare.

9. Microsoft Copilot (ideale per migliorare la produttività all'interno delle applicazioni Microsoft Office)

tramite Microsoft Copilot

Copilot è integrato nelle app Microsoft che usi quotidianamente, cambiando il modo in cui l'IA viene percepita nella pratica. Comprende il tuo contesto di lavoro: il tuo stile di scrittura, i dati che stai analizzando e persino la cronologia delle tue riunioni.

Chiedigli di creare una presentazione e lui estrarrà le informazioni rilevanti dai tuoi documenti e dalle tue email recenti.

L'integrazione con Excel è particolarmente intelligente e ti aiuta ad analizzare i dati utilizzando il linguaggio naturale anziché formule complesse. La parte migliore? La curva di apprendimento è minima perché l'interfaccia dello strumento di collaborazione IA si basa sulle convenzioni Microsoft familiari.

Le migliori funzionalità/funzioni di Microsoft Copilot

- Trasforma i dati grezzi in presentazioni PowerPoint accattivanti utilizzando i tuoi modelli esistenti e le linee guida del marchio.

- Automatizza le attività ripetitive di Excel come tabelle pivot, formattazione condizionale e creazione di formule tramite comandi conversazionali.

- Redigi programmi delle riunioni e email di follow-up sulla base degli inviti del calendario e delle note delle riunioni precedenti.

- Progetta documenti dall'aspetto professionale utilizzando stili integrati e suggerimenti di formattazione che corrispondono agli standard della tua organizzazione.

Limiti di Microsoft Copilot

- Lo strumento richiede una sottoscrizione a Microsoft 365 e l'impegno dell'ecosistema e ha funzioni limitate al di fuori delle applicazioni Microsoft.

- Prestazioni incoerenti tra le diverse applicazioni di Office

Prezzi di Microsoft Copilot

- Free

- Copilot Pro: 20 $ al mese

- Copilot per Microsoft 365: 30 $ al mese per utente (fatturazione annuale)

Valutazioni e recensioni di Microsoft Copilot

- G2: 4,4/5 (oltre 85 recensioni)

- Capterra: Recensioni insufficienti

Cosa dicono gli utenti reali di Microsoft Copilot?

Un utente di Reddit afferma:

Lo uso ogni giorno per aiutarmi con le funzioni Excel più complesse. Se ho un'idea concettuale di come voglio manipolare i dati, espongo la situazione e Copilot mi fornisce quasi sempre una soluzione pratica e utilizzabile. Mi ha aiutato a familiarizzare e a sentirmi più a mio agio con le funzioni di matrice.

Lo uso ogni giorno per aiutarmi con le funzioni Excel più complesse. Se ho un'idea concettuale di come voglio manipolare i dati, espongo la situazione e Copilot mi fornisce quasi sempre una soluzione pratica e utilizzabile. Mi ha aiutato a familiarizzare e a sentirmi più a mio agio con le funzioni di matrice.

📖 Leggi anche: Le migliori alternative a Microsoft Copilot per semplificare la tua vita e i tuoi flussi di lavoro

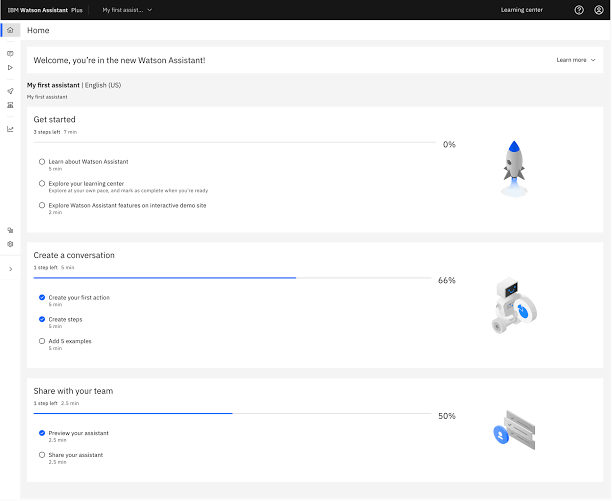

10. IBM WatsonX (ideale per l'implementazione dell'IA in ambienti aziendali altamente regolamentati)

tramite IBM WatsonX

IBM ha progettato WatsonX appositamente per le organizzazioni che non possono correre rischi con l'IA, come banche, ospedali e agenzie governative. Ogni decisione del modello viene registrata, creando tracce di audit apprezzate dai team di conformità.

La piattaforma offre soluzioni specifiche per il settore, consentendo alle organizzazioni sanitarie di utilizzare modelli addestrati sulla letteratura medica e alle organizzazioni di servizi finanziari di acquisire capacità di valutazione del rischio.

A seconda dei requisiti di sensibilità dei dati, è possibile implementare modelli in loco, nel cloud IBM o in configurazioni ibride. Le funzionalità di governance consentono di impostare barriere di protezione e monitorare i risultati dell'IA per individuare eventuali distorsioni o comportamenti imprevisti.

Le migliori funzionalità/funzioni di IBM WatsonX

- Implementa un monitoraggio dell'equità che rileva e corregge automaticamente i pregiudizi nelle previsioni dei modelli tra diversi gruppi demografici.

- Crea modelli di prompt IA personalizzati con protezioni di sicurezza integrate che impediscono risposte IA dannose o inappropriate.

- Genera report di conformità dettagliati che mostrano le decisioni dei modelli e l'utilizzo dei dati per gli audit normativi e la documentazione.

- Verifica la robustezza del modello utilizzando esempi contraddittori e casi limite per identificare potenziali vulnerabilità prima dell'implementazione.

- Crea flussi di lavoro human-in-the-loop in cui le decisioni critiche richiedono l'approvazione manuale prima dell'esecuzione.

Limiti di IBM WatsonX

- Costi più elevati rispetto alle alternative cloud-native a Hugging Face

- I requisiti di configurazione e installazione sono complessi.

- Ha un ciclo di innovazione più lento rispetto alle piattaforme di IA più recenti.

- Supporto della community limitato ed estensioni di terze parti

Prezzi di IBM WatsonX

- Free

- Essenziali: A partire da 0 $ al mese (modello pay-as-you-go)

- Standard: a partire da 1.050 $/mese (modello pay-as-you-go)

Valutazioni e recensioni di IBM WatsonX

- G2: 4,5/5 (oltre 84 recensioni)

- Capterra: recensioni insufficienti

Cosa dicono gli utenti reali di IBM WatsonX?

Basato su una recensione di G2:

Come sviluppatore, apprezzo il modo in cui combina flessibilità e struttura, offrendo un ampio intervallo di tipi di modelli, dal ML classico ai modelli linguistici di grandi dimensioni. L'interfaccia utente è pulita e l'integrazione con i framework cloud e di sicurezza esistenti è semplice, il che aiuta ad accelerare i cicli di sperimentazione senza compromettere la governance. [...] Sebbene la piattaforma sia potente, all'inizio può sembrare opprimente, soprattutto quando si effettuano le impostazioni per flussi di lavoro più personalizzati. Inoltre, i prezzi potrebbero essere più trasparenti per gli utenti che stanno ancora valutando le opzioni prima di impegnarsi a livello di azienda. Sarebbe gradita l'aggiunta di tutorial di onboarding migliorati per gli sviluppatori che non conoscono l'ecosistema IBM.

Come sviluppatore, apprezzo il modo in cui combina flessibilità e struttura, offrendo un ampio intervallo di tipi di modelli, dal ML classico ai modelli linguistici di grandi dimensioni. L'interfaccia utente è pulita e l'integrazione con i framework cloud e di sicurezza esistenti è semplice, il che aiuta ad accelerare i cicli di sperimentazione senza compromettere la governance. [...] Sebbene la piattaforma sia potente, all'inizio può sembrare opprimente, soprattutto durante l'impostazione di flussi di lavoro più personalizzati. Inoltre, i prezzi potrebbero essere più trasparenti per gli utenti che stanno ancora valutando le opzioni prima di impegnarsi a livello di azienda. Sarebbe gradita l'aggiunta di tutorial di onboarding migliorati per gli sviluppatori che non conoscono l'ecosistema IBM.

🎥 Guarda: Prova il tuo primo agente IA che risponde in modo contestuale al tuo lavoro. Ascoltalo direttamente da Zeb Evans, fondatore e CEO di ClickUp:

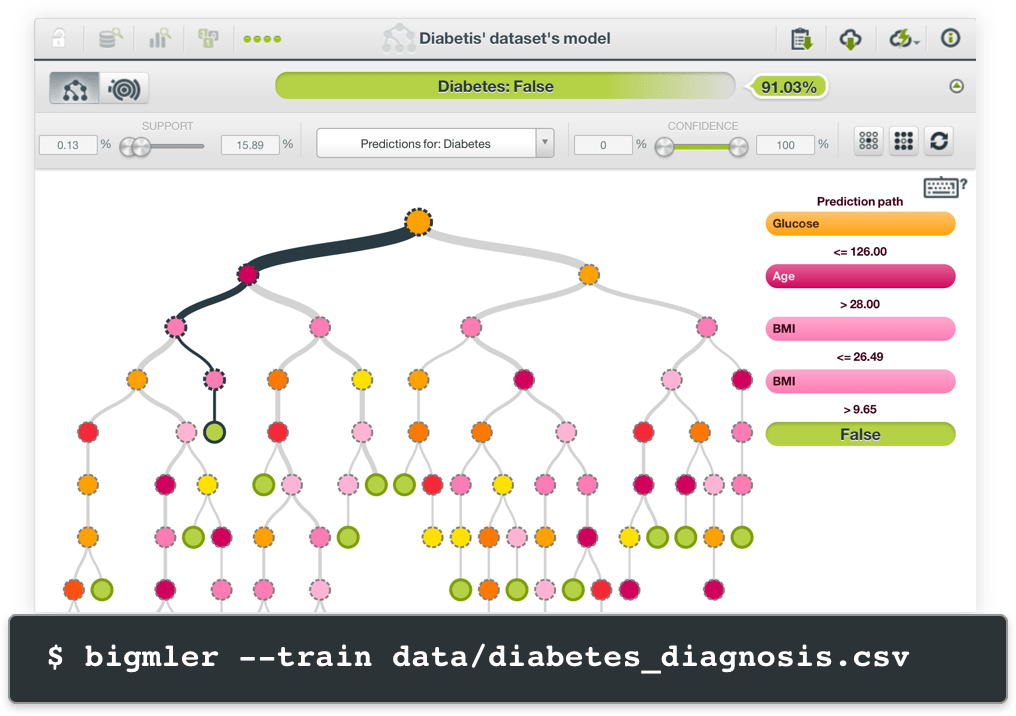

11. BigML. com (Ideale per la creazione di modelli predittivi senza codice o competenze tecniche)

tramite BigML

L'interfaccia visiva di BigML ti consente di creare modelli predittivi trascinando e rilasciando set di dati anziché scrivere codice complesso. Carica un file CSV con i dati dei clienti e BigML ti aiuterà a prevedere quali clienti potrebbero abbandonarti.

La piattaforma gestisce automaticamente la pre-elaborazione dei dati, la selezione delle caratteristiche e la convalida dei modelli. Ciò che rende BigML affidabile è il modo in cui spiega le sue previsioni. Ottieni visualizzazioni chiare che mostrano quali fattori influenzano le decisioni del modello, rendendo facile presentare i risultati agli stakeholder che hanno bisogno di comprendere il "perché" dietro i consigli dell'IA.

BigML. com funzionalità/funzioni migliori

- Genera approfondimenti e raccomandazioni automatizzati dai tuoi dati utilizzando spiegazioni in linguaggio naturale comprensibili anche ai team non tecnici.

- Combina più algoritmi per migliorare l'accuratezza delle previsioni e ridurre i rischi di overfitting con i modelli ensemble.

- Esegui analisi di clustering per identificare modelli nascosti e segmenti di clientela nei tuoi dati aziendali.

- Crea modelli di previsione di serie temporali per la pianificazione dell'inventario, la previsione della domanda e le proiezioni finanziarie.

- Esporta la logica di previsione come applicazioni autonome o incorporala direttamente nei sistemi aziendali esistenti.

Limiti di BigML.com

- Ha un supporto limitato per il deep learning e le architetture di reti neurali.

- Meno opzioni di personalizzazione rispetto alle piattaforme basate sulla programmazione

- Comunità più piccola ed ecosistema di strumenti di terze parti

- Meno adatto alla ricerca all'avanguardia e agli approcci sperimentali

Prezzi di BigML.com

- Versione di prova gratis di 14 giorni

- Standard Prime: 30 $ al mese

Valutazioni e recensioni su BigML.com

- G2: 4,7/5 (oltre 20 recensioni)

- Capterra: recensioni insufficienti

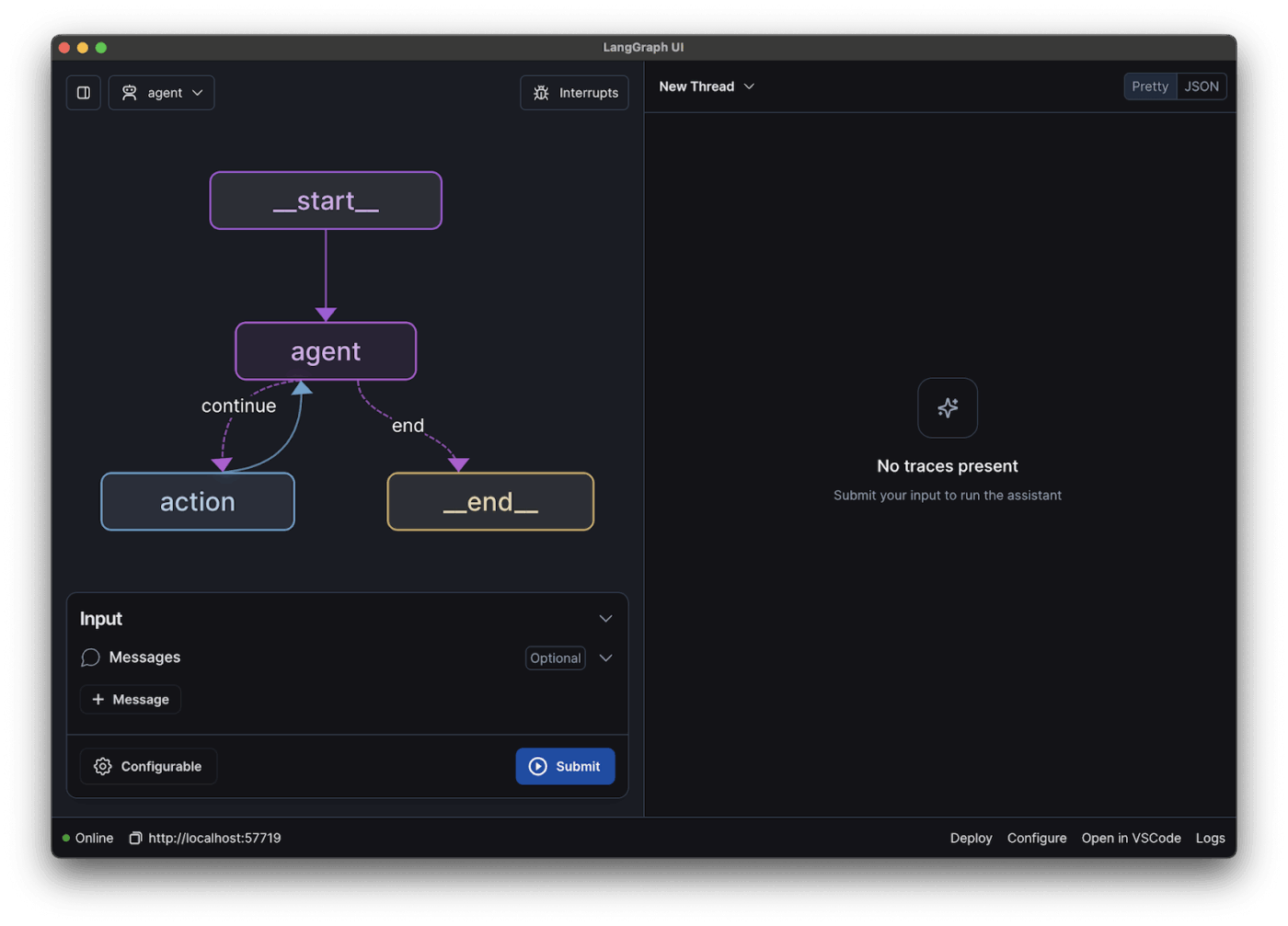

12. LangChain (ideale per lo sviluppo di applicazioni IA complesse con più componenti)

tramite LangChain

LangChain risolve il problema di collegare i modelli di IA alle applicazioni del mondo reale. È possibile creare sistemi che cercano informazioni nei database, chiamano API esterne e mantengono la cronologia delle conversazioni attraverso più interazioni.

Il framework fornisce componenti predefiniti per modelli comuni come RAG, in cui i modelli di IA possono accedere e citare documenti specifici. È possibile concatenare diversi servizi di IA, magari utilizzando un modello per comprendere l'intento dell'utente e un altro per generare risposte.

Inoltre, le funzionalità dell'agente LLM di LangChain sono open source e indipendenti dal modello, quindi non sei vincolato a nessun provider di IA in particolare.

Le migliori funzionalità di LangChain

- Esegui il debug di flussi di lavoro AI complessi utilizzando strumenti di tracciamento e registrazione integrati che mostrano esattamente come i dati fluiscono tra i componenti.

- Memorizza nella cache le chiamate API costose e le risposte dei modelli per ridurre i costi e migliorare le prestazioni delle applicazioni.

- Gestisci gli errori con eleganza grazie alla logica di riprova e ai meccanismi di fallback quando i servizi di IA non sono disponibili.

- Crea framework di valutazione personalizzati per testare le prestazioni delle applicazioni IA in diversi scenari e set di dati.

- Implementa risposte in streaming per applicazioni in tempo reale in cui gli utenti necessitano di un feedback immediato durante processi di lunga durata.

Limiti di LangChain

- Richiede conoscenze di programmazione e comprensione dei concetti di IA.

- Il rapido ritmo di sviluppo può portare a cambiamenti radicali e instabilità.

- Overhead prestazionale dei livelli di astrazione nelle applicazioni complesse

- Strumenti di monitoraggio e debug integrati limitati per gli ambienti di produzione

Prezzi di LangChain

- Sviluppatore: A partire da 0 $ al mese (poi pagamento in base al consumo)

- In più: A partire da 39 $ al mese (poi si paga in base al consumo)

- Enterprise: Prezzi personalizzati

Valutazioni e recensioni di LangChain

- G2: Recensioni insufficienti

- Capterra: recensioni insufficienti

💡 Suggerimento professionale: prima di investire risorse in un LLM di grandi dimensioni, crea una solida pipeline di recupero delle informazioni che filtri il contesto con precisione. La maggior parte delle allucinazioni inizia con input rumorosi, non con limiti del modello.

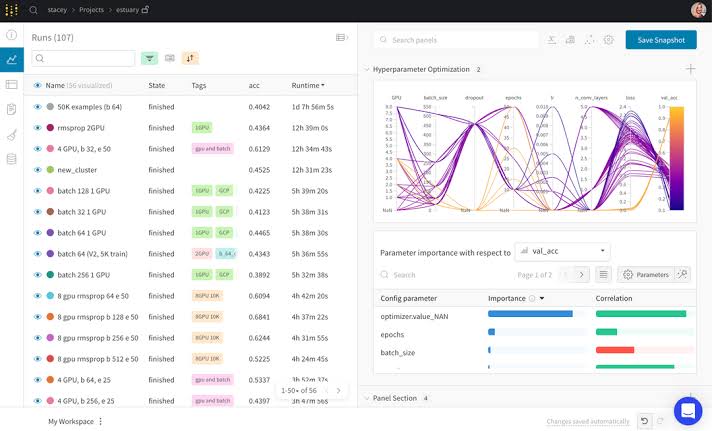

13. Weights & Biases (ideale per il monitoraggio e il confronto dei risultati degli esperimenti di machine learning)

tramite Weights & Biases

Weights & Biases impedisce che il ML diventi un caos di esperimenti dimenticati e risultati persi. La piattaforma acquisisce automaticamente tutte le informazioni relative all'addestramento del modello: iperparametri, metriche, versioni del codice e persino le prestazioni del sistema.

Quando qualcosa funziona bene, è facile riprodurlo. Quando gli esperimenti falliscono, è possibile capire esattamente cosa è andato storto.

Gli strumenti di visualizzazione ti aiutano a individuare le tendenze in centinaia di cicli di formazione, identificando quali approcci producono le migliori prestazioni. I team apprezzano le funzionalità di collaborazione perché tutti possono vedere cosa stanno provando gli altri senza interferire con il lavoro reciproco.

Le migliori funzionalità/funzioni di Weights & Biases

- Configura scansioni automatizzate degli iperparametri che esplorano diverse combinazioni di parametri e identificano le configurazioni ottimali.

- Crea dashboard personalizzate con grafici interattivi che si aggiornano in tempo reale man mano che gli esperimenti procedono.

- Tag e organizza gli esperimenti utilizzando metadati personalizzati per trovare risultati rilevanti in grandi progetti di ricerca.

- Condividi i risultati degli esperimenti esternamente utilizzando report pubblici che non espongono codici o dati sensibili.

- Analizza il profilo delle prestazioni di addestramento per identificare i problemi di utilizzo della GPU e ottimizzare l'allocazione delle risorse.

Limiti di Weights & Biases

- Lo strumento introduce ulteriore complessità per progetti semplici che non richiedono un monitoraggio approfondito.

- I costi possono aumentare rapidamente per i team di grandi dimensioni e il monitoraggio di esperimenti estesi.

- Sono state segnalate recensioni relative a una documentazione tecnica inadeguata.

Prezzi di Weights & Biases

Ospitato su cloud

- Free

- Pro: A partire da 50 $ al mese

- Enterprise: Prezzi personalizzati

Ospitato privatamente

- Gratis per uso personale

- Advanced Enterprise: Prezzi personalizzati

Valutazioni e recensioni di Weights & Biases

- G2: 4,7/5 (oltre 40 recensioni)

- Capterra: Recensioni insufficienti

Cosa dicono gli utenti reali di Weights & Biases?

Su Reddit, un utente ha detto:

Uso WandB nel mio lavoro diverse ore al giorno. È lo strumento con il maggior numero di funzionalità per questa applicazione, ma le sue prestazioni sono davvero pessime.

Uso WandB nel mio lavoro diverse ore al giorno. È lo strumento con il maggior numero di funzionalità per questa applicazione, ma le sue prestazioni sono davvero pessime.

📮 Approfondimento ClickUp: Solo il 12% dei partecipanti al nostro sondaggio utilizza le funzionalità/funzioni di IA integrate nelle suite di produttività. Questo basso tasso di adozione suggerisce che le attuali implementazioni potrebbero non offrire l'integrazione contestuale e senza soluzione di continuità che spingerebbe gli utenti a passare dalle loro piattaforme conversazionali autonome preferite.

Ad esempio, l'IA è in grado di eseguire un flusso di lavoro automatizzato basato su un prompt di testo normale fornito dall'utente? ClickUp Brain è in grado di farlo ! L'IA è profondamente integrata in ogni aspetto di ClickUp, inclusi, a titolo esemplificativo ma non esaustivo, la sintesi delle conversazioni in chat, la stesura o la revisione di testi, il recupero di informazioni dall'area di lavoro, la generazione di immagini e molto altro ancora!

Unisciti al 40% dei clienti ClickUp che hanno sostituito più di 3 app con la nostra app completa per il lavoro!

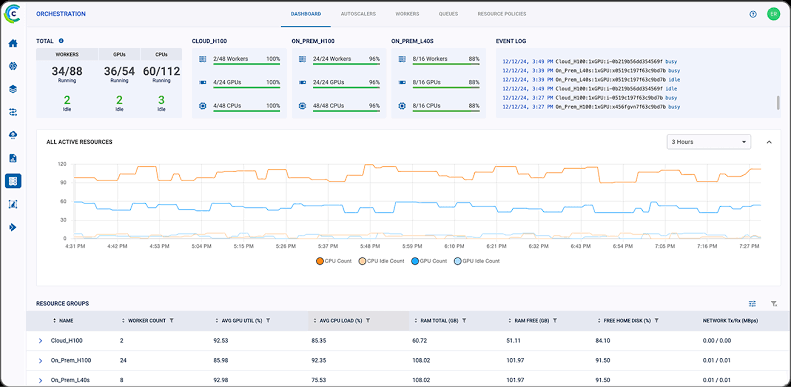

14. ClearML (ideale per l'automazione dei flussi di lavoro delle operazioni di machine learning end-to-end)

tramite ClearML

ClearML gestisce l'incubo operativo della gestione dei modelli di machine learning in produzione. La piattaforma effettua automaticamente il monitoraggio di ogni aspetto del tuo flusso di lavoro ML, dalla pre-elaborazione dei dati alla distribuzione dei modelli, creando una traccia di audit completa senza alcun lavoro richiesto.

Quando i modelli si interrompono durante la produzione, è possibile risalire ai problemi causati da specifiche modifiche ai dati o al codice. Le funzionalità di formazione distribuita consentono di scalare gli esperimenti su più macchine e provider cloud senza soluzione di continuità.

Inoltre, l'orchestrazione della pipeline automatizza attività ripetitive come la convalida dei dati, il riaddestramento dei modelli e le approvazioni di implementazione.

Le migliori funzionalità/funzioni di ClearML

- Pianifica gli esperimenti in modo che vengano eseguiti automaticamente durante le ore non di punta per ottimizzare i costi di calcolo e l'utilizzo delle risorse.

- Confronta le prestazioni dei modelli su diversi set di dati e periodi di tempo utilizzando metriche di valutazione standardizzate.

- Integrazione con pipeline CI/CD esistenti e strumenti di implementazione utilizzando artefatti personalizzati e registri di modelli.

- Implementa distribuzioni blue-green per modelli ML con funzionalità di rollback automatizzate in caso di calo delle prestazioni.

- Genera automaticamente la documentazione di conformità per i settori regolamentati che richiedono una governance dettagliata dei modelli.

Limiti di ClearML

- Configurazione iniziale complessa e configurazione per funzionalità avanzate

- Curva di apprendimento per i team che passano da una gestione dei flussi di lavoro più semplice

- Il monitoraggio ad alta intensità di risorse di ClearML può influire sulle prestazioni del sistema.

- Integrazioni limitate rispetto alle alternative più consolidate a Hugging Face

Prezzi ClearML

- Free

- Pro: 15 $/mese per utente + utilizzo (per team con un massimo di 10 membri)

- Scala: Prezzi personalizzati

- Enterprise: Prezzi personalizzati

Valutazioni e recensioni di ClearML

- G2: Recensioni insufficienti

- Capterra: Recensioni insufficienti

Cosa dicono gli utenti reali di ClearML?

Come condiviso durante la condivisione su Reddit:

Utilizziamo ClearML esclusivamente per il monitoraggio degli esperimenti e abbiamo ospitato autonomamente sia ClearML Server che ClearML Agent sulla nostra infrastruttura interna. Finora, la nostra esperienza con ClearML è stata eccellente, in particolare per quanto riguarda la gestione degli esperimenti, la riproducibilità e il flusso di lavoro di implementazione.

Utilizziamo ClearML esclusivamente per il monitoraggio degli esperimenti e abbiamo ospitato autonomamente sia ClearML Server che ClearML Agent sulla nostra infrastruttura interna. Finora, la nostra esperienza con ClearML è stata eccellente, in particolare per quanto riguarda la gestione degli esperimenti, la riproducibilità e il flusso di lavoro di implementazione.

🔍 Lo sapevi? I sistemi ibridi offrono prestazioni costantemente superiori rispetto al recupero con metodo singolo. Integra entrambi gli approcci nel tuo motore di ricerca IA per bilanciare la comprensione semantica con la precisione della corrispondenza esatta.

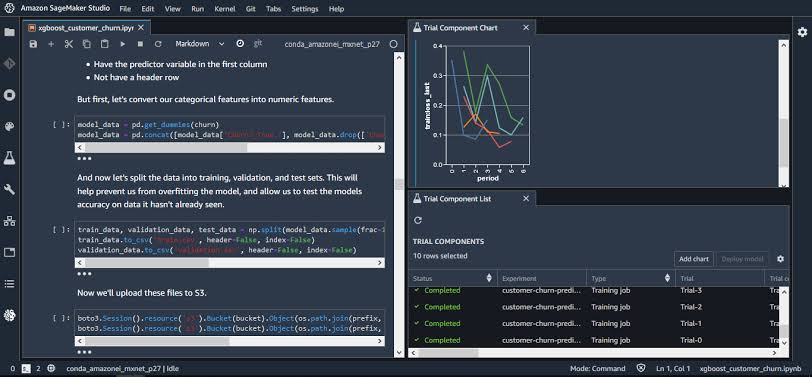

15. Amazon SageMaker (ideale per la gestione completa dei cicli di vita ML sull'infrastruttura AWS)

tramite Amazon SageMaker

SageMaker è la scelta giusta se già utilizzi AWS e hai bisogno di funzionalità ML che funzionino perfettamente con la tua infrastruttura esistente. I notebook gestiti eliminano i problemi di configurazione del server, mentre gli algoritmi integrati gestiscono i casi d'uso più comuni senza necessità di codice personalizzato.

Ground Truth aiuta a creare set di dati di addestramento di alta qualità attraverso flussi di lavoro di annotazione gestiti, particolarmente utili quando sono necessari etichettatori umani per dati immagine o di testo.

Quando i modelli sono pronti per la produzione, SageMaker gestisce le complessità di implementazione come il bilanciamento del carico e il ridimensionamento automatico. Tutto viene fatturato tramite il tuo account AWS esistente, semplificando la gestione dei costi.

Le migliori funzionalità di Amazon SageMaker

- Addestra i modelli utilizzando un'infrastruttura gestita che fornisce automaticamente le risorse in base alla dimensione del set di dati e ai requisiti di calcolo.

- Distribuisci i modelli attraverso endpoint scalabili che gestiscono i picchi di traffico e regolano automaticamente la capacità di calcolo in base alla domanda.

- Ottimizza le prestazioni dei modelli utilizzando la regolazione automatica degli iperparametri che testa migliaia di combinazioni per trovare le impostazioni ottimali.

- Monitora i modelli di produzione utilizzando l'integrazione CloudWatch che effettua il monitoraggio dell'accuratezza delle previsioni, della latenza e delle metriche sulla qualità dei dati.

Limitazioni di Amazon SageMaker

- La sua complessa struttura dei prezzi può comportare costi imprevisti per un utilizzo su larga scala, poiché non è chiara.

- È prevista una curva di apprendimento per i team che non hanno familiarità con l'ecosistema e i servizi AWS.

- L'interfaccia dello strumento può essere lenta o difficile da navigare a causa di alcuni problemi tecnici.

- L'utilizzo di Amazon SageMaker rende difficile la migrazione ad altri provider di servizi cloud.

Prezzi di Amazon SageMaker

- SageMaker Unified Studio: gratis

- Prezzi personalizzati

Valutazioni e recensioni di Amazon SageMaker

- G2: 4,3/5 (45 recensioni)

- Capterra: recensioni insufficienti

Cosa dicono gli utenti reali di Amazon SageMaker?

Secondo una recensione di G2:

Ciò che mi piace di più di Amazon SageMaker è la sua capacità di gestire l'intero ciclo di vita dell'apprendimento automatico in un'unica piattaforma integrata. Semplifica la creazione, l'addestramento e l'implementazione dei modelli, offrendo al contempo scalabilità e strumenti potenti come SageMaker Studio e la messa a punto automatizzata dei modelli.

Ciò che mi piace di più di Amazon SageMaker è la sua capacità di gestire l'intero ciclo di vita dell'apprendimento automatico in un'unica piattaforma integrata. Semplifica la creazione, l'addestramento e l'implementazione dei modelli, offrendo al contempo scalabilità e strumenti potenti come SageMaker Studio e la messa a punto automatizzata dei modelli.

💡 Suggerimento professionale: non addestrare ciò che non puoi strutturare. Prima di passare alla messa a punto, chiediti: È possibile risolvere il problema con una logica strutturata e un modello di base? Ad esempio, invece di addestrare un modello per rilevare i tipi di fattura, aggiungi prima un semplice classificatore che filtra in base ai metadati.

Ottimizza il tuo flusso di lavoro con ClickUp

Esistono tantissime alternative a Hugging Face, ma perché limitarsi ai modelli e alle API?

ClickUp fa un salto di qualità.

Con ClickUp Brain e Brain MAX, puoi scrivere più velocemente, riassumere le cose in pochi secondi ed eseguire automazioni che ti capiscono. È integrato direttamente nelle tue attività, nei tuoi documenti e nelle tue chat, così non dovrai mai passare da uno strumento all'altro o da una scheda all'altra.

Iscriviti a ClickUp e scopri perché è l'alternativa più intelligente a Hugging Face! ✅