Sie atmen erleichtert auf. Endlich ist es erledigt: Sie haben das Video bearbeitet, für scharfe Bilder gesorgt und das Skript fertiggestellt. Sie gehen das Skript noch einmal durch und stellen fest, dass die Sprachaufnahmen noch fehlen. Da kehrt die Frustration zurück.

Es bleibt keine Zeit mehr für die übliche Routine „über ein Wort stolpern, neu anfangen, den Rhythmus verlieren“.

Die meisten Projekte kommen an dieser Stelle zum Stillstand und verzetteln sich in der zeitaufwändigen und unvorhersehbaren Aufgabe, Voiceovers hinzuzufügen. Die gute Nachricht ist, dass Sie das nicht mehr so zu erledigen haben.

In diesem Leitfaden erfahren Sie, wie Sie die Sprachgenerierung mit KI automatisieren können. Als Bonus erfahren Sie außerdem, wie ClickUp Ihnen dabei hilft, Skripte, Aufgaben und Veröffentlichungs-Workflows an einem Ort zu verwalten. 🤩

Was ist KI-Sprachgenerierung?

Die KI-Sprachgenerierung wandelt geschriebenen Text in Sprache um, die natürliche menschliche Sprachmuster widerspiegelt. Sie stützt sich auf maschinelle Lernmodelle, die anhand umfangreicher Sprachproben trainiert wurden, um Tonfall, Rhythmus, Pausen und Emotionen zu erfassen.

Das Ergebnis sind ausdrucksstarke, realistische und anpassungsfähige Stimmen, die sich für verschiedene Kontexte eignen. Mit KI-Tools können Sie sofort lebensechte Erzählungen oder Dialoge erstellen.

🧠 Wissenswertes: Ein KI-Tool war in der Lage, die Stimme des legendären britischen Rundfunkmoderators Sir Michael Parkinson für eine achtteilige Podcast-Serie wieder zum Leben zu erwecken. Dies zeigt, wie weit die Sprachklonung bereits fortgeschritten ist (ganz zu schweigen von der Debatte, die sie ausgelöst hat).

Wichtige Unterschiede: KI-Sprachgenerator vs. herkömmliche TTS

KI-Text-to-Speech (TTS) ist nichts Neues, aber der Unterschied zwischen älteren Systemen und den heutigen KI-gesteuerten Sprachgeneratoren ist frappierend. Herkömmliche TTS-Tools wurden entwickelt, um „Text vorzulesen“, und erzeugten roboterhafte Stimmen, die zwar ihre Aufgabe erfüllten, aber keinen natürlichen Flow hatten.

Auf der anderen Seite nutzen KI-Sprachgeneratoren Deep Learning, um Tonfall, Tempo und Emotionen (so weit wie möglich) authentisch nachzubilden.

Hier sind die Unterschiede:

| Aspekt | Herkömmliche TTS | KI-Sprachgenerator |

| Sprachqualität | Flach, roboterhaft und leicht als synthetisch erkennbar | Natürlich, ausdrucksstark und oft nicht von menschlichen Stimmen zu unterscheiden |

| Flexibilität | Beschränkt auf feste Aussprachen und monotone Wiedergabe | Dynamische Intonation, emotionale Tonfälle und anpassungsfähiges Sprechtempo |

| Benutzerdefinierte Anpassung | Grundlegende Steuerelemente wie Geschwindigkeits- und Tonhöhenanpassungen | Fein abgestimmte Kontrolle über Tonfall, Stil, Akzent und Sprachrhythmus |

| Lernfähigkeit | Regelbasiert, keine Anpassung an den Kontext | Lernt aus großen Sprachdatensätzen und ahmt menschliche Muster nach. |

| Nutzungspotenzial | Geeignet für einfache Leseaufgaben | Vielseitig einsetzbar für Erzählungen, Branding, Apps und interaktive Inhalte |

Vorteile der Automatisierung der Sprachgenerierung

Die Automatisierung der Spracharbeit verändert die Art und Weise, wie Audioinhalte erstellt, bereitgestellt und skaliert werden. Sehen wir uns einige Vorteile an:

- Reduzieren Sie die Produktionskosten: Eliminieren Sie Ausgaben für Studiozeit, Sprecher und Neuaufnahmen.

- Beschleunigen Sie die Bearbeitungszeit: Produzieren Sie innerhalb von Sekunden Kommentare, führen Sie die Bearbeitung durch oder wechseln Sie den Stil, ohne mehrere Takes und Nachbearbeitung.

- Erweitern Sie die Sprach- und Akzentoptionen: Generieren Sie Stimmen in verschiedenen Sprachen oder regionalen Akzenten, um zusätzliche Castings oder Aufnahmesitzungen zu vermeiden.

- Markenkonsistenz wahren: Verwenden Sie in Schulungsmaterialien, Produkterfahrungen oder Kampagnen denselben Ton, dasselbe Tempo und denselben Stil, um eine konsistente Sprachidentität zu gewährleisten.

- Skalieren Sie Inhalte: Erstellen Sie Sprachressourcen in großen Mengen für Videos, Apps oder Kommunikation, ohne Ihre Ressourcen zu überlasten.

- Verbessern Sie die Barrierefreiheit und Inklusivität: Fügen Sie Erzählungen, Übersetzungen oder Audio-Support hinzu, um Inhalte für ein globales Publikum nutzbar zu machen.

🔍 Wussten Sie schon? Jonathan Harrington, Professor für Phonetik und digitale Sprache an der Universität München, beschäftigt sich seit Jahrzehnten damit, wie Menschen Laute und Akzente erzeugen.

Hier ist, was er über KI-Stimmen zu sagen hat:

In den letzten 50 Jahren und insbesondere in jüngster Zeit sind Sprachgenerierungs-/Synthesesysteme so gut geworden, dass es oft sehr schwierig ist, eine KI-generierte Stimme von einer echten Stimme zu unterscheiden.

In den letzten 50 Jahren und insbesondere in jüngster Zeit sind Sprachgenerierungs-/Synthesesysteme so gut geworden, dass es oft sehr schwierig ist, eine KI-generierte Stimme von einer echten Stimme zu unterscheiden.

So realisieren Sie die Automatisierung der Sprachgenerierung mit KI

Wie funktioniert das? Die Idee, ein Skript in eine realistische Audioaufnahme umzuwandeln, klingt großartig, aber der wichtigste Schritt ist die Einrichtung eines Workflows, der Zeit spart.

Und so haben wir ClickUp, die Allround-App für die Arbeit, die das Setup vereinfacht. Sie kombiniert Projektmanagement, Wissensmanagement und Chat – alles unterstützt durch KI, die Ihnen hilft, schneller und intelligenter zu arbeiten.

Hier finden Sie eine Schritt-für-Schritt-Anleitung, wie Sie die Sprachgenerierung mit KI automatisieren können (mit etwas Hilfe von ClickUp). 👀

Schritt 1: Wählen Sie ein tool zur Sprachgenerierung aus.

Entscheiden Sie zunächst, woher Ihre KI-Voiceovers stammen sollen. Es gibt viele großartige Plattformen für KI-Sprachgeneratoren.

Die richtige Lösung hängt davon ab, was Sie am meisten benötigen:

- Ist Ihnen die Vielfalt an Akzenten und Tonfällen wichtig?

- Benötigen Sie API-Zugriff, um Ihre Workflows anzubinden?

- Wie viel Budget möchten Sie für Lizenzen und Nutzung bereitstellen?

🔍 Wussten Sie schon? Der erste Computer, der „singen“ konnte, war ein IBM 7094 aus dem Jahr 1961. Er spielte „Daisy Bell“ in einer frühen Sprachsynthese-Demo, die die HAL 9000-Szene in 2001: Odyssee im Weltraum inspirierte.

Schritt 2: Bereiten Sie Ihr Skript oder Ihren Text vor.

Bevor Sie ein großartiges Voiceover erstellen können, benötigen Sie ein ausgefeiltes Skript, das einsatzbereit ist.

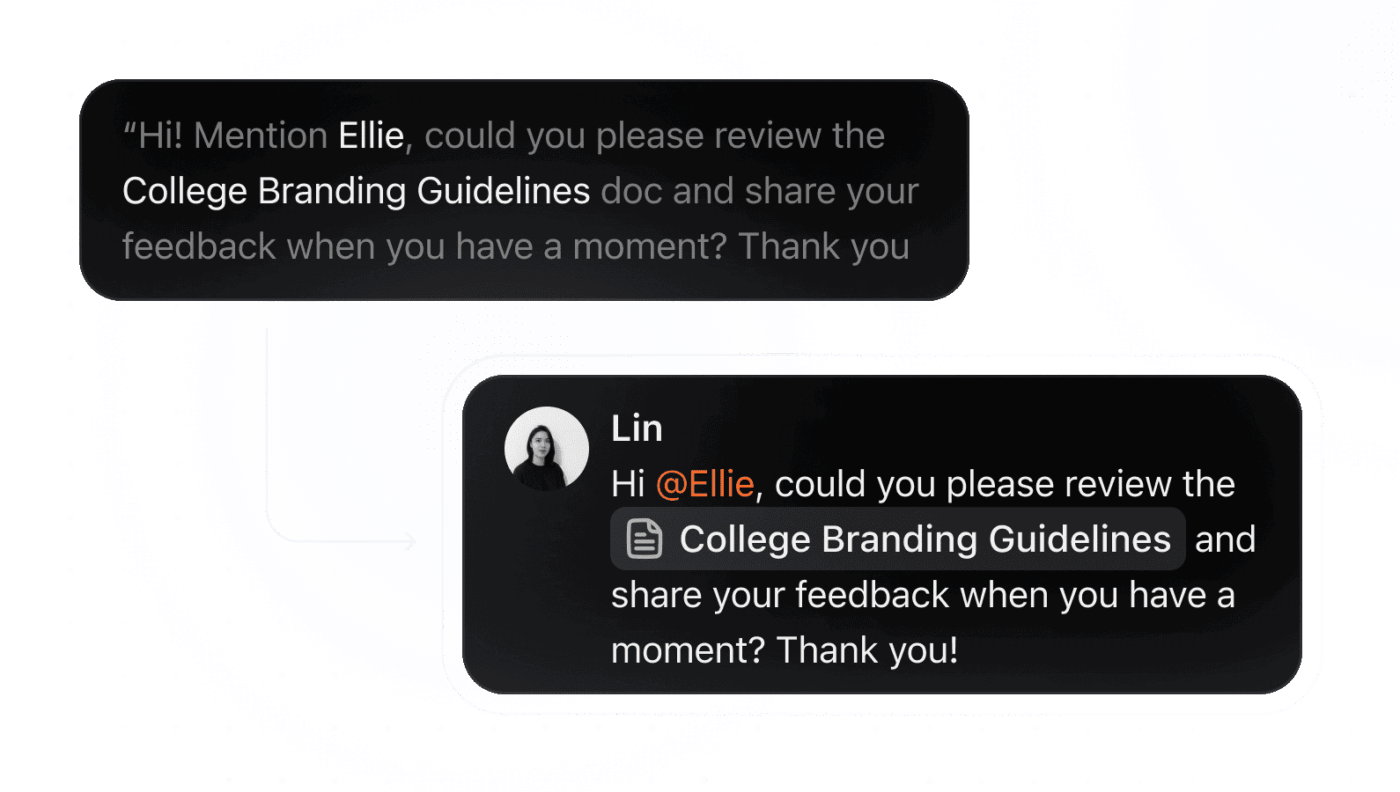

Nutzen Sie ClickUp Docs als zentralen hub für das Verfassen, Überprüfen und Verfeinern von Texten. Arbeiten Sie in Echtzeit Seite an Seite mit Ihrem Team, damit Autoren, Editors und Stakeholder stets auf dem gleichen Stand sind.

Sie können ClickUp-Aufgaben auch mit Rich-Text-Formatierungen, Tabellen und Links versehen, um alles strukturiert und übersichtlich zu halten. Auf diese Weise ist Ihr Skript gut organisiert, leicht zugänglich und für eine spätere nahtlose Automatisierung vorbereitet.

📌 Beispiel: Wenn Sie eine Video-Tutorial-Reihe erstellen, erstellen Sie ein Dokument mit Abschnitten für die Einleitung, den Hauptinhalt und den Abschluss und geben Sie Notizen frei. Editors können Kommentare zu bestimmten Zeilen hinterlassen, während Autoren den Text live anpassen, wobei jede Änderung sofort für das gesamte Team synchronisiert wird. Sie können auch Tabellen hinzufügen, um Notizen zum Tempo oder zum Sprachstil zu verfolgen, sowie Lesezeichen, um zwischen verschiedenen Teilen zu springen.

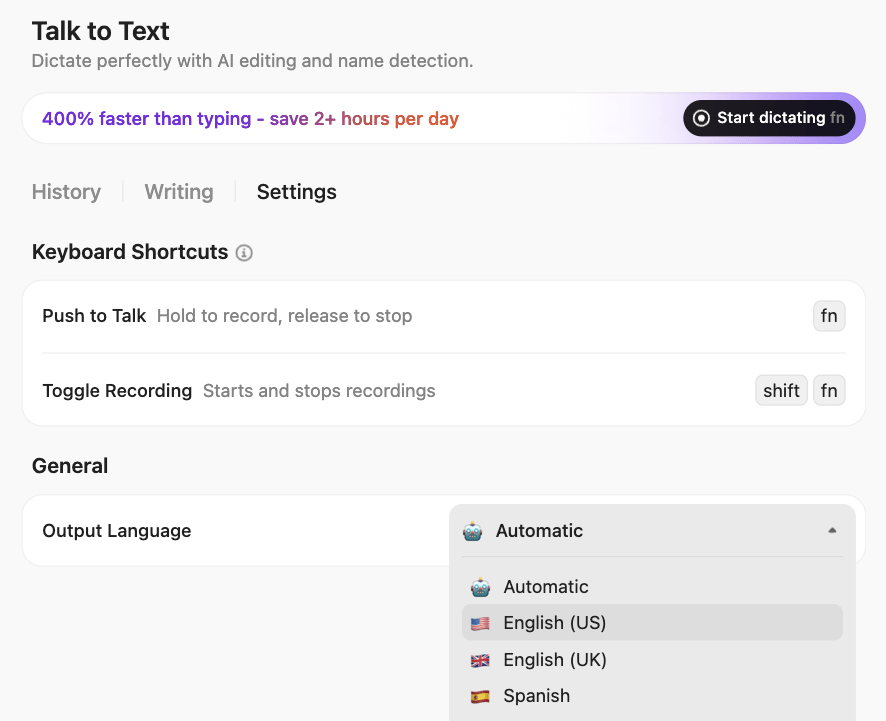

Voice-First-Workflow mit ClickUp Brain Max

ClickUp Brain MAX verwandelt Ihren Workspace in ein Talk to Text -Studio, sodass Sie Skripte entwerfen, Überarbeitungen hinterlassen oder Aufgabenaktualisierungen protokollieren können, indem Sie einfach sprechen. Kein Tippen, kein Wechseln zwischen Tools, kein „Ich formatiere das später“.

Das Ergebnis? Schnellere Skript-Zyklen, weniger Überarbeitungen und weniger Reibungsverluste zwischen Idee → Stimme → Umsetzung.

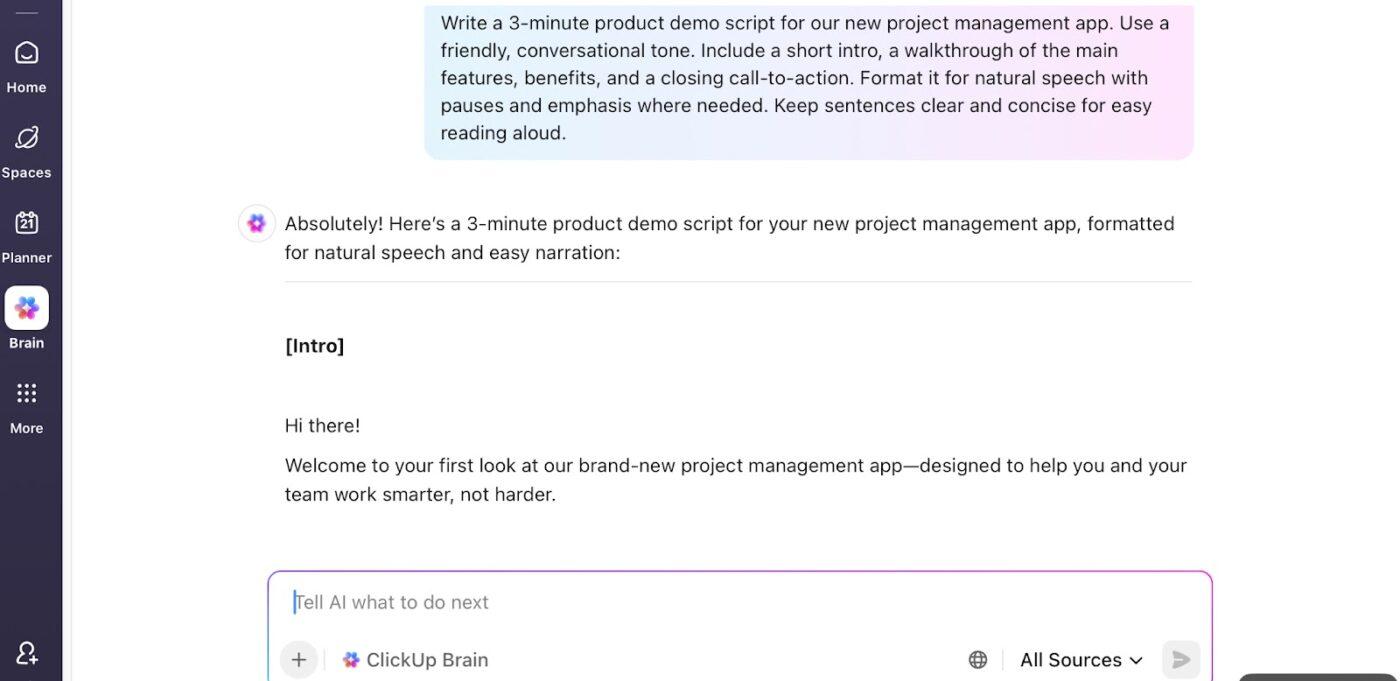

Sind Sie unsicher, was den Tonfall angeht? ClickUp Brain optimiert die Erzählung, kürzt überflüssige Passagen und erstellt ein Format für Ihren Text, damit dieser in einem natürlichen Ton gesprochen wird, direkt in Ihrem ClickUp-Dokument.

Betrachten Sie es als Editor. Sie können:

- Verwenden Sie den KI-Schreiber für die Arbeit, um Entwürfe zu glätten oder sogar für Sie zu schreiben.

- Ändern Sie den Tonfall (professionell, locker, optimistisch) mit Change Tone.

- Führen Sie Format for Speech aus, damit Ihr Skript wie das Sprechen einer realen Person klingt, mit natürlichen Pausen und einem flüssigen Flow.

- Fassen Sie lange Abschnitte zusammen oder erweitern Sie kurze Abschnitte, je nach dem Grad der Detailgenauigkeit, den Sie benötigen.

- Überprüfen Sie sofort Grammatik, Rechtschreibung und Verständlichkeit.

- Übersetzen Sie Ihr Skript in andere Sprachen, wenn Sie in verschiedene Regionen expandieren möchten.

✅ Probieren Sie diesen Vorschlag aus: Fügen Sie zur Betonung Pausen ein, damit der Text beim Vorlesen leichter zu verstehen ist, und fassen Sie die Fachbegriffe in 2–3 kurzen Sätzen zusammen.

Erfahren Sie mehr über ClickUp Brain:

Schritt 3: Automatisieren Sie Ihren Workflow

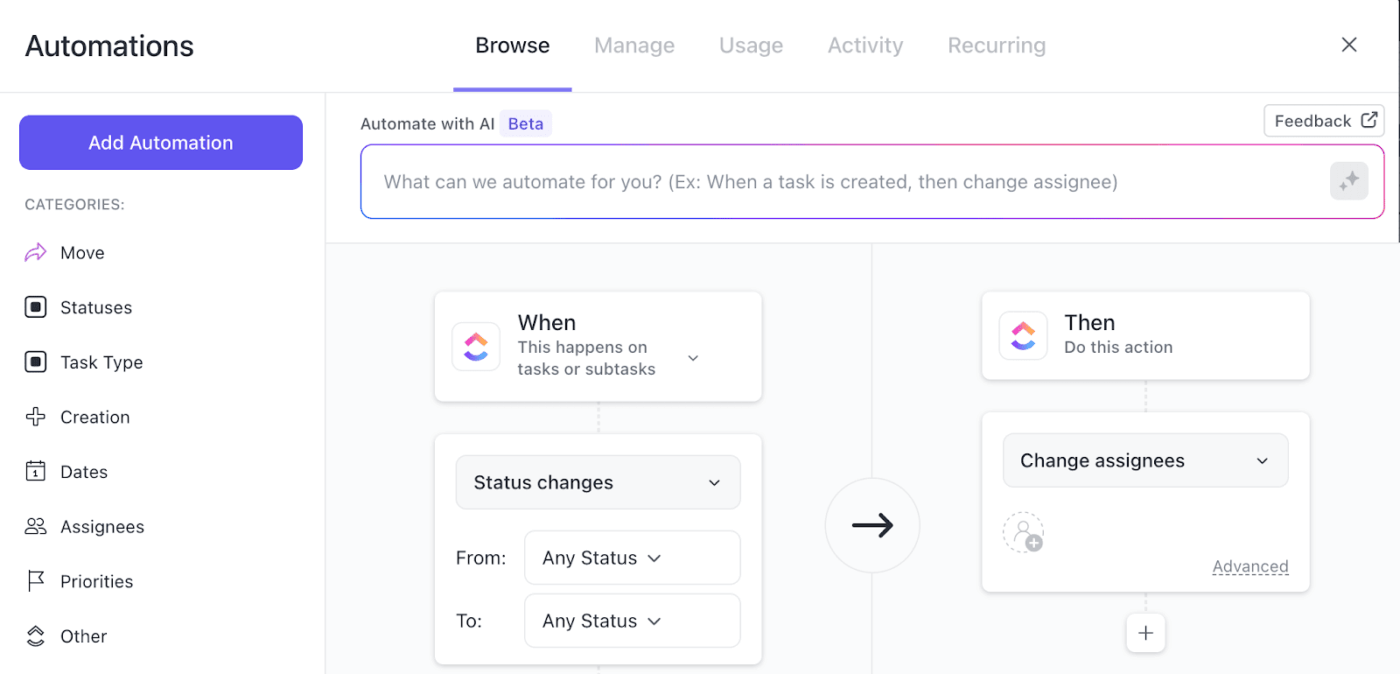

Sobald Ihr Skript fertig ist und die Audiodatei generiert wurde, wechseln Sie zu ClickUp Automatisierungen.

Sie können Workflows nach einem einfachen Prinzip erstellen: „Wenn dies, dann das. “

Sie können beispielsweise eine Automatisierung einrichten, wenn sich der Status einer Aufgabe in „Audio generiert“ ändert. ClickUp weist die Aufgabe automatisch dem Editor zu, benachrichtigt ihn im ClickUp-Chat und verschiebt die Aufgabe in die Liste „Bearbeitung“.

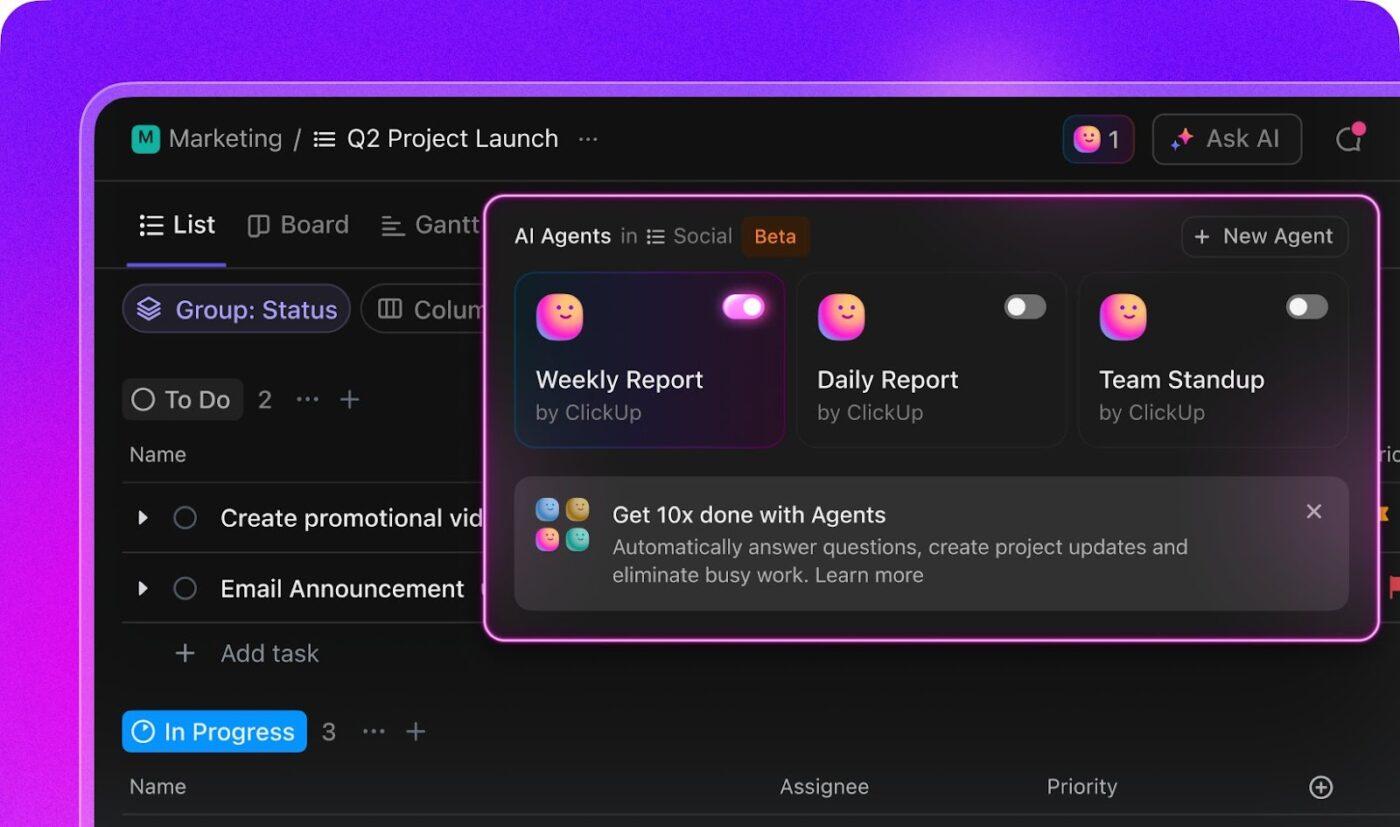

🚀 Vorteil von ClickUp: ClickUp AI Autopilot Agents halten Projekte ohne menschliches Eingreifen am Laufen.

Sie achten auf Auslöser, wie z. B. eine als fertiggestellt markierte Aufgabe, und führen dann automatisch die nächsten Aktionen aus. Das bedeutet, dass Dateien generiert, als Anhänge angehängt und an die richtigen Personen weitergeleitet werden, Aktualisierungen sofort mit den Teams geteilt werden und Aufgaben ohne Verzögerungen in die nächste Phase übergehen.

KI ist nicht nur etwas für Technikprofis – sie ist für jeden von uns da. Von der Planung von Mahlzeiten bis zur Verwaltung von Finanzen kann KI Ihren gesamten Alltag vereinfachen. Erfahren Sie in dem folgenden Video, wie das geht!

Die besten KI-Tools für die Text-to-Speech-Automatisierung

Die meisten kommerziellen Text-to-Speech-Softwareprogramme sind mit Limiten verbunden: begrenzte Stimmenauswahl, Nutzungsbeschränkungen, Lizenzgebühren und wenig Spielraum für benutzerdefinierte Anpassungen.

Open-Source-Text-to-Speech hilft Ihnen dabei.

Mit diesen Tools haben Sie die vollständige Kontrolle über das Sprachtraining, die Bereitstellung und die Skalierung und durchbrechen so den Zyklus der Herstellerabhängigkeit.

Hier sind unsere Top-Auswahl der besten KI-Sprachgeneratoren. 💁

1. ClickUp

ClickUp ist bereits als flexible All-in-One-Workspace-Plattform bekannt, die Aufgaben, Dokumente, Chat, Whiteboards und Automatisierung in einer einzigen Umgebung vereint.

Was es derzeit besonders attraktiv macht, ist ClickUp Brain MAX, die kontextbezogene KI-Super-App von ClickUp, die sich tief in Ihren gesamten Workflow integrieren lässt. Sie fügt nicht einfach nur „KI hinzu“, sondern baut eine Verbindung zu Ihrer tatsächlichen Arbeit (Aufgaben, Dokumente, Chats, Integrationen) auf, sodass Sie einen intelligenten Assistenten anstelle vieler unverbundener Tools erhalten.

Beste Features:

- Einheitlicher Workspace, der Aufgaben, Dokumente, Dashboards, Whiteboards, Automatisierungen und Ansichten vereint

- Leistungsstarke Nachverfolgung von Bugs und Workflow-Management: Bugs protokollieren, mit Features/Testplänen verknüpfen, Vorlagen erstellen

- KI-Assistent („ClickUp Brain“) und integrierte Automatisierungen zur Generierung von Aufgaben und Zusammenfassungen aus der Arbeit.

- Hochgradig anpassbar: unterstützt Listen-, Board-, Kalender- und Gantt-Ansichten sowie tiefgehende Integrationen.

Limitierungen:

- Steile Lernkurve aufgrund der Vielzahl an Features; neue Benutzer könnten sich überfordert fühlen.

- Bei der Bearbeitung großer Workspaces oder vieler Aufgaben werden Leistungsrückstände und Probleme mit der mobilen Benutzererfahrung gemeldet.

Preise:

Bewertungen und Rezensionen:

- G2: 4,7/5 (über 10.000 Bewertungen)

- Capterra: 4,6/5 (über 4.000 Bewertungen)

2. Coqui TTS

Coqui TTS ist ein gemeinschaftsbasiertes Projekt, das hochwertige, auf neuronalen Netzen basierende TTS-Modelle anbietet. Es unterstützt mehrere Sprachen und bietet vorab trainierte Modelle für eine einfache Nutzung.

Beste Features

- Neuronale Vocoder-basierte TTS-Engine mit natürlich klingenden Stimmen

- Unterstützt mehrsprachiges Sprachtraining und Klonen aus kurzen Beispielen.

- Echtzeit-Sprachgenerierung und Bereitstellung benutzerdefinierter Modelle

- Ideal für Entwickler, die Assistenten, E-Learning- oder Barrierefreiheits-Apps erstellen.

Einschränkungen

- Erfordert technisches Setup für die Feinabstimmung der Sprachausgabe und das Hosting des Modells.

- Die Lizenzierung für die kommerzielle Nutzung kann je nach Modell variieren.

Preise

- Free Version verfügbar

- Starter: 9,90 $/Monat

- Ersteller: 19,90 $/Monat

- Pro: 69,90 $/Monat

Bewertungen und Rezensionen

- G2: Nicht genügend Bewertungen

- Capterra: Nicht genügend Bewertungen

📌 Ideal für: Entwickler, die anpassbare TTS-Lösungen in Anwendungen wie virtuellen Assistenten, E-Learning-Plattformen und Barrierefreiheits-Tools implementieren möchten.

⚡ Vorlagenarchiv: Mit der Vorlage für Meeting-Protokolle von ClickUp können Sie Tagesordnungen, wichtige Punkte und Aktionselemente an einem Ort erfassen. Die Vorlage für Meeting-Notizen sorgt für eine strukturierte Dokumentation Ihrer Diskussionen und Entscheidungen, sodass nichts übersehen wird.

3. Piper TTS

Piper TTS ist ein leichtgewichtiges, schnelles und effizientes TTS-System, das für Echtzeitanwendungen entwickelt wurde. Es ist auf Leistung optimiert und kann auf verschiedenen Geräten, einschließlich mobiler Plattformen, ausgeführt werden.

Die besten Features

- Leichte Echtzeit-TTS, optimiert für geringe Latenzzeiten

- Funktioniert auf Desktops, Servern und eingebetteten Systemen.

- Unterstützt mehrere Sprachen und anpassbare Stimmen.

- Vollständig quelloffen und datenschutzfreundlich (läuft lokal)

Einschränkungen

- Erfordert Entwickler-Setup für Integration und Modellverwaltung.

- Die Sprachqualität ist solide, entspricht jedoch nicht dem Premium-Niveau kommerzieller Produkte.

Preise

- Kostenlos und Open Source

Bewertungen und Rezensionen

- G2: Nicht genügend Bewertungen

- Capterra: Nicht genügend Bewertungen

📌 Ideal für: Manager, die Echtzeit-Sprachfeedback benötigen, z. B. für Navigationssysteme, interaktive Kiosksysteme und assistive Technologien.

4. Festival-Sprachsynthesesystem

Das Festival Speech Synthesis System ist ein umfassendes, universell einsetzbares TTS-System, das von der Universität Edinburgh entwickelt wurde. Es bietet ein vollständiges Text-to-Speech-System mit verschiedenen APIs und unterstützt mehrere Sprachen.

Die besten Features

- Modulare, forschungsfreundliche Architektur für TTS-Experimente

- Unterstützt mehrere Sprachen und verschiedene APIs.

- Ideal für akademische, pädagogische und experimentelle Sprachprojekte.

Einschränkungen

- Im Vergleich zu neuronalen TTS-Tools weniger natürlich und ausdrucksstark

- Erfordert manuelle Konfiguration und verfügt über keine einfache Benutzeroberfläche.

Preise

- Kostenlos und Open Source

Bewertungen und Rezensionen

- G2: Nicht genügend Bewertungen

- Capterra: Nicht genügend Bewertungen

📌 Ideal für: Forscher, Entwickler und Pädagogen, die ein KI-Transkriptionstool für Experimente, akademische Projekte oder die Entwicklung maßgeschneiderter Sprachlösungen suchen.

5. eSpeak NG

eSpeak NG (Next Generation) ist ein kompakter Open-Source-Sprachsynthesizer, der einen breiten Bereich an Sprachen unterstützt. Er ist vor allem für seinen geringen Platzbedarf und seine Effizienz bekannt.

Die besten Features

- Extrem kompakter, effizienter Sprachsynthesizer für Geräte mit begrenzten Ressourcen

- Unterstützt über 100 Sprachen und Dialekte.

- Funktioniert sowohl als Befehlszeilentool als auch als Bibliothek für die Integration.

Einschränkungen

- Roboterstimme im Vergleich zu neuronalen Systemen

- Begrenzte Ausdruckskraft und Emotionalität in generierten Sprachausgaben

Preise

- Kostenlos und Open Source

Bewertungen und Rezensionen

- Capterra: Nicht genügend Bewertungen

- G2: Nicht genügend Bewertungen

📌 Ideal für: Entwickler, Hobbyisten und Embedded-System-Projekte, bei denen Effizienz und mehrsprachiger Support wichtiger sind als ultrarealistische Sprachqualität.

📖 Lesen Sie auch: Wie man KI für Meeting-Notizen nutzt (Anwendungsfälle und Tools)

Herausforderungen bei der Automatisierung der KI-Sprachgenerierung

Die Automatisierung der KI-Sprachgenerierung bringt sowohl technische als auch ethische Herausforderungen mit sich, insbesondere wenn Realismus und Sicherheit angestrebt werden.

Hier sind einige anhaltende Herausforderungen:

Ethischer Missbrauch und Probleme mit Inhalten

KI-Stimmen können aus nur wenigen Sekunden aufgezeichnetem Audio geklont werden, manchmal ohne Wissen des Urhebers. Das wirft ernsthafte ethische und sogar rechtliche Fragen auf.

Darüber hinaus haben Synchronsprecher Bedenken geäußert, dass ihre Arbeit ohne vollständige Offenlegung oder Vergütung zum Trainieren synthetischer Stimmen verwendet wird.

🔍 Wussten Sie schon? Eine schottische Schauspielerin protestierte, als ihre Stimme ohne ihre Berechtigung für öffentliche Durchsagen verwendet wurde, was zur Abschaffung der KI-Stimme führte.

Emotionale Tiefe und Nuancen

Selbst hochauflösende KI-Stimmen können flach wirken.

Forscher haben herausgefunden, dass KI Schwierigkeiten hat, subtile emotionale Signale wie Empathie oder Sarkasmus zu vermitteln. Dies sind Elemente, die menschliche Sprecher je nach Kontext ganz natürlich anpassen.

Ohne diese Nuance kann selbst eine perfekt ausgesprochene Zeile hohl wirken, insbesondere beim Geschichtenerzählen oder in der Kommunikation mit Patienten.

Akzentvorurteile und digitale Ausgrenzung

Eine aktuelle Studie hat ergeben, dass synthetische Sprachsysteme bei regionalen Akzenten schlechter abschneiden, was sprachliche Privilegien verstärkt und unbeabsichtigt verschiedene Sprecher ausschließt.

In multikulturellen Umgebungen, wie dem globalen Kundensupport oder mehrsprachigem E-Learning, kann dies die Inklusivität und Genauigkeit beeinträchtigen.

🧠 Wissenswertes: Der Schauspieler Val Kilmer, der aufgrund von Kehlkopfkrebs seine Stimme verloren hatte, ließ sie anhand seiner früheren Aufnahmen synthetisch nachbilden. So konnte er seine ikonische Rolle in Top Gun: Maverick erneut spielen.

Vertrauens- und Erkennungsschwierigkeiten

Benutzer können oft nicht unterscheiden, ob eine Stimme von einem Menschen oder von KI erzeugt wurde. Tatsächlich ordneten etwa 80 % der Zuhörer eine KI-Stimme ihrem menschlichen Gegenstück zu, während nur etwa 60 % eine Stimme korrekt als synthetisch identifizierten.

Diese Verwischung des Vertrauens kann problematisch sein, insbesondere wenn böswillige Akteure synthetische Stimmen für Betrug oder Fehlinformationen missbrauchen.

📖 Lesen Sie auch: So transkribieren Sie Sprachmemos in Text

Sicherheit und Deepfake-Bedrohungen

Audio-Deepfakes sind keine Science-Fiction mehr. In zahlreichen hochkarätigen Betrugsfällen, wie z. B. der Nachahmung von CEOs zur Autorisierung betrügerischer Überweisungen, wurden realistische KI-Stimmen als Waffe eingesetzt.

Tatsächlich zeigt sich dieses Risiko auch deutlich in der politischen Desinformation. KI-geklonte Stimmen von Persönlichkeiten des öffentlichen Lebens wurden in schädlichen Desinformationskampagnen im Wahlkampf eingesetzt.

🔍 Wussten Sie schon? Das Wort „Deepfake “ ist eine Mischung aus „Deep Learning“ und „Fake“. Diese KI-gestützten Erstellungen können Gesichter austauschen, Lippenbewegungen optimieren und sogar neue Stimmen generieren, sodass sie fast nicht mehr zu unterscheiden sind. Während sie oft für Unterhaltungszwecke verwendet werden, stellt dieselbe Technologie große Herausforderungen für die Authentizität der KI-generierten Sprachautomatisierung dar.

Wie ClickUp Ihnen bei der Verwaltung von Sprachgenerierungsprojekten hilft

Teams verwalten oft mehrere Tools für die Nachverfolgung von Entwürfen, Aufzeichnungen und endgültigen Dateien, was den gesamten Prozess verlangsamt.

Wie wir bereits gesehen haben, vereint ClickUp all das in einem einzigen Workspace. Schauen wir uns nun an, wie Sie einige der anderen Tools nutzen können, um Ihren Workflow zur Sprachgenerierung zu verwalten. 🔁

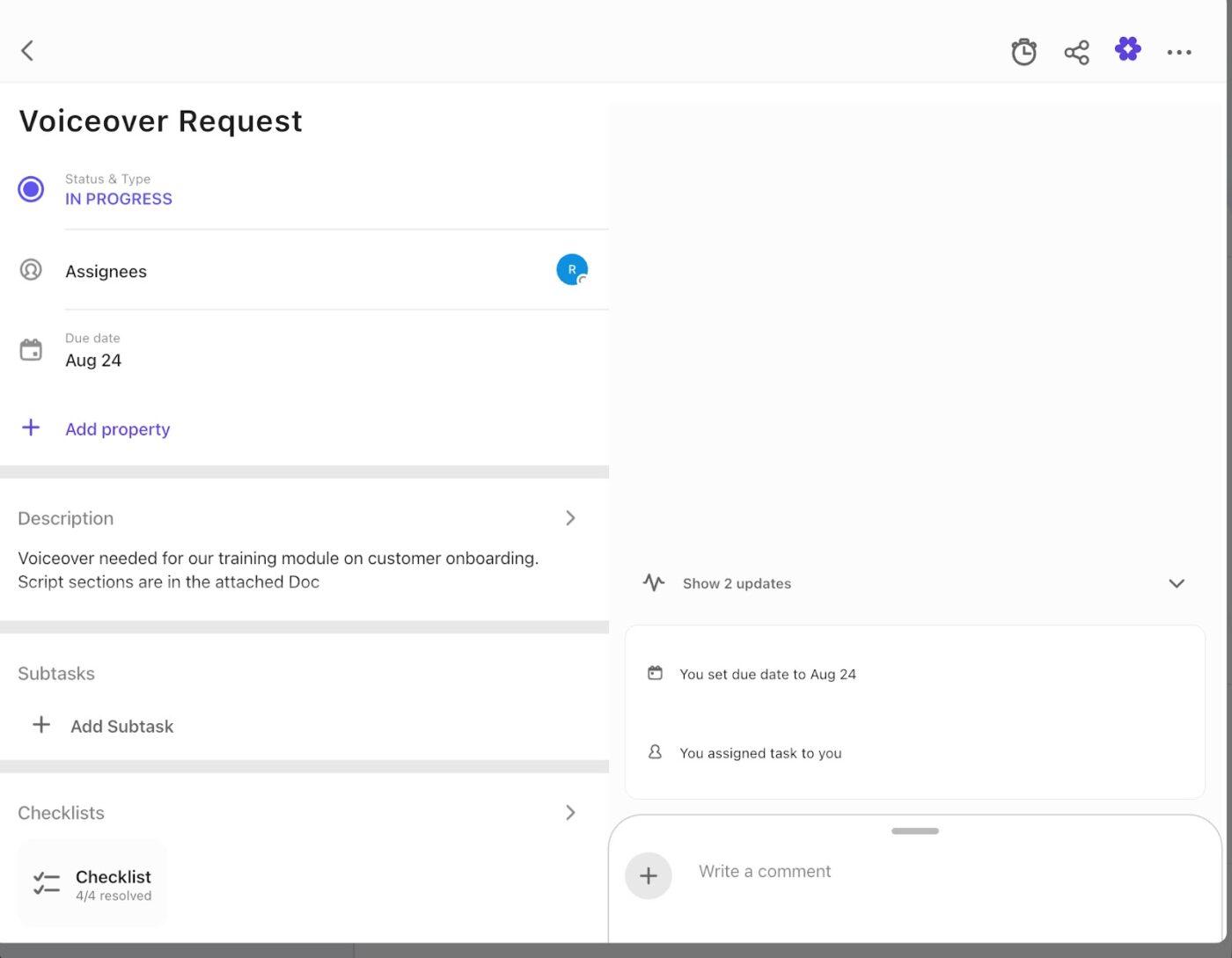

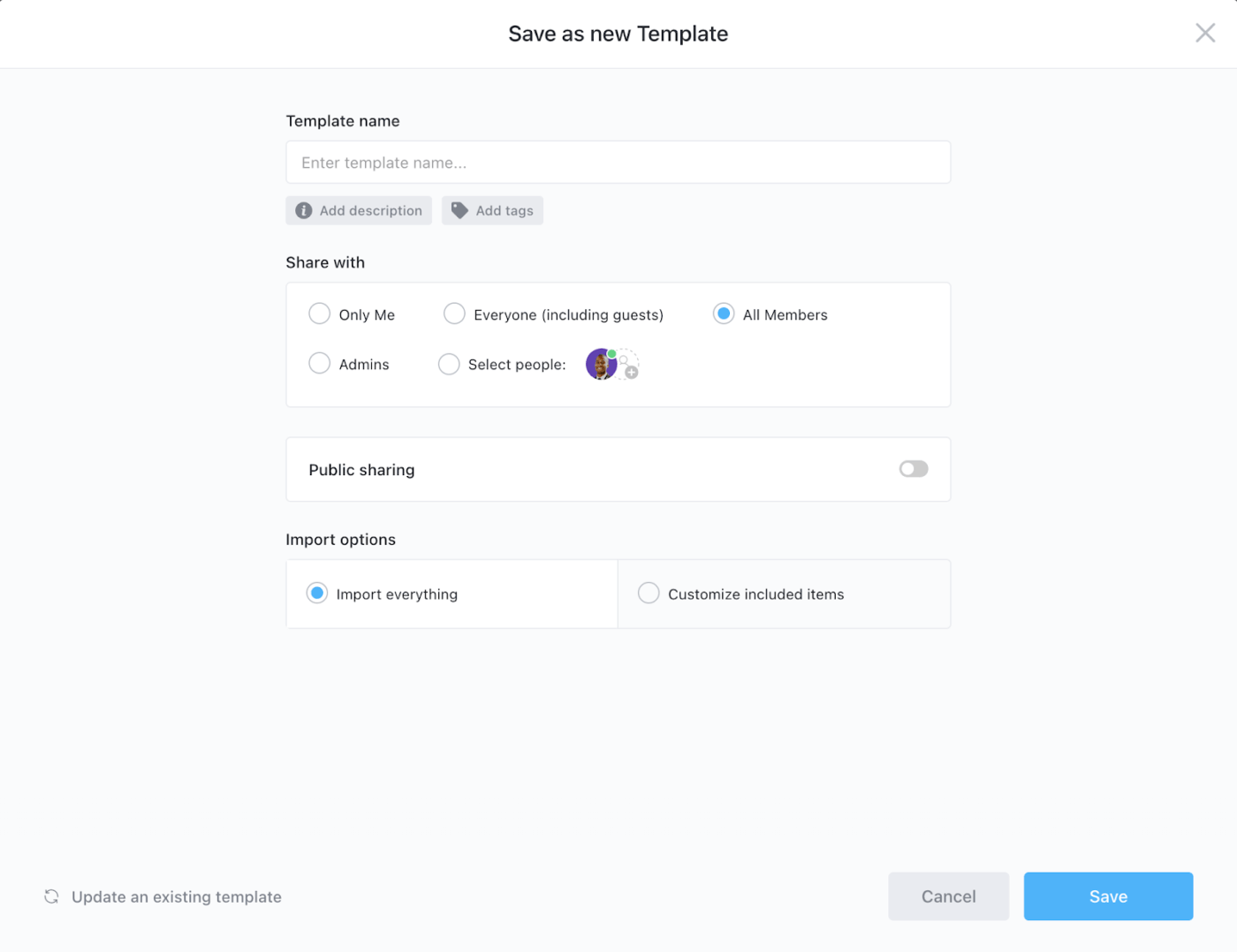

Anfragen standardisieren

Um zu vermeiden, dass Sie Aufgaben von Grund auf neu erstellen müssen, richten Sie eine Vorlage mit allen wichtigen Details ein. Dazu können ClickUp-Benutzerdefinierte Felder, eine Frist und ein Mitarbeiter (ein Sprecher, Editor oder Projektmanager) gehören.

Sie können auch Felder wie „Sprache“, „Tonfall“ oder „Styleguide“ hinzufügen, um sicherzustellen, dass jede Anfrage von Anfang an klar ist.

Um Projekte reibungslos abzuwickeln, fügen Sie innerhalb der Aufgabe eine Checkliste hinzu, die den gesamten Prozess umreißt. Beispiel: Skriptüberprüfung → Sprachaufzeichnung → Bearbeitung → Veröffentlichung.

Sobald Sie eine Aufgabe erstellt haben, die alles enthält, was Sie benötigen, speichern Sie sie als wiederverwendbare Vorlage (z. B. „Voiceover-Anfrage“).

📮 ClickUp Insight: 57 % der Menschen werden während geplanter Sitzungen zur Konzentration unterbrochen, und 25 % dieser Unterbrechungen gehen von anderen Menschen aus. 🤦🏾♂️

Aber wissen Sie was? Viele dieser dringenden Fragen und kurzen Rückfragen können mit KI-Agenten automatisiert werden, die Antworten, Status-Updates und mehr liefern können.

Die Autopilot-Agenten von ClickUp können all das und sogar benutzerdefinierte Workflows übernehmen. Richten Sie einfach die Auslöser ein, und schon kann es losgehen!

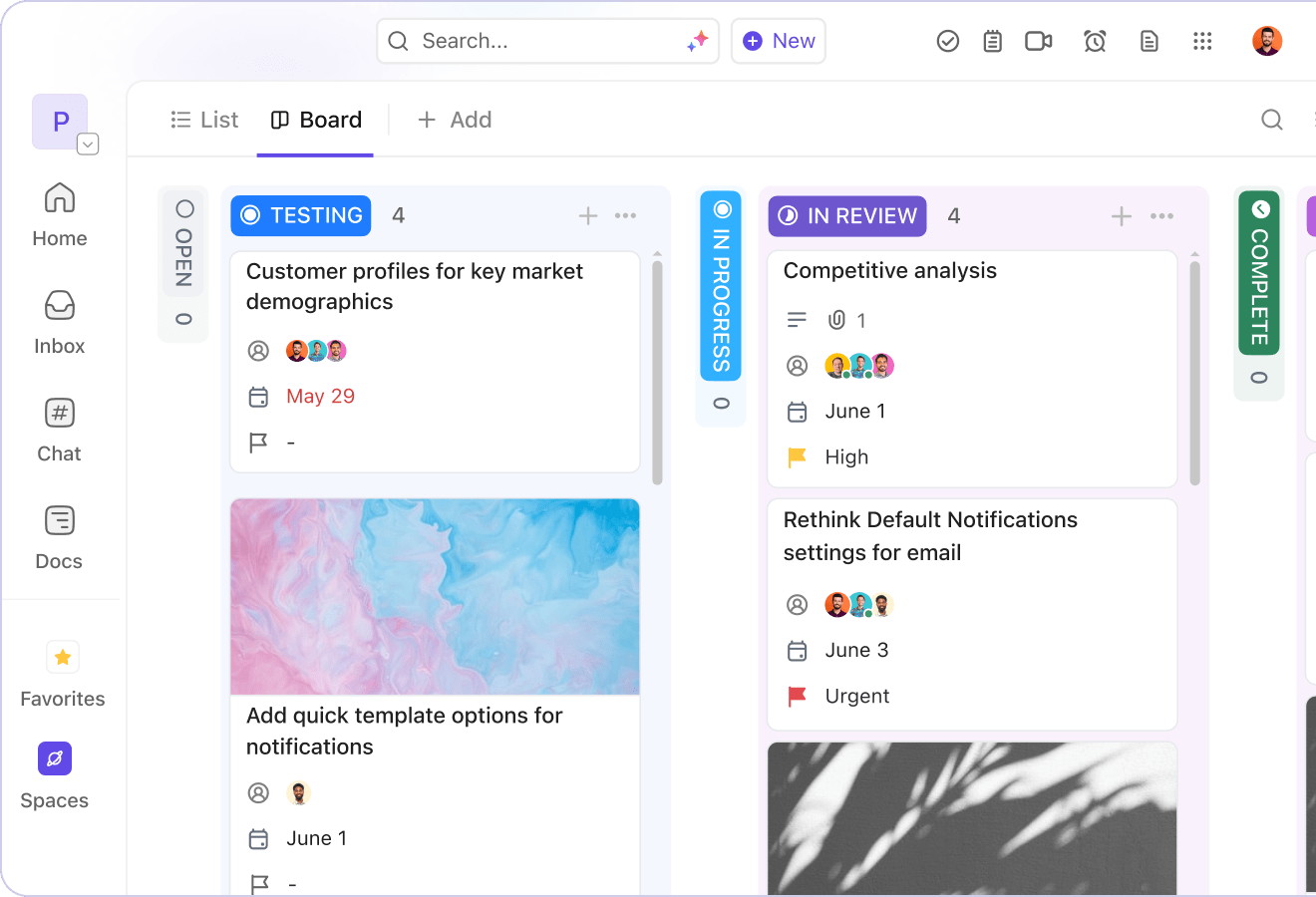

Visualisieren Sie jede Phase

Um Ihre Sprachgenerierungsprojekte auf Kurs zu halten, müssen Sie sowohl den Stand jeder einzelnen Aufgabe als auch den gesamten Zeitplan auf einen Blick im Blick behalten. ClickUp Ansichten machen dies möglich und bieten Ihnen flexible Möglichkeiten, den Fortschritt zu visualisieren, Engpässe zu erkennen und Termine einzuhalten.

Nehmen Sie zum Beispiel die ClickUp-Board-Ansicht.

Wenn Sie mehrere Videos gleichzeitig produzieren, können Sie Spalten für Phasen wie Skript → Überprüfung → Stimme → Veröffentlichung einrichten. Wenn eine Aufgabe abgeschlossen ist, ziehen Sie sie einfach von einer Spalte in die nächste.

So lässt sich leicht erkennen, wenn sich Skripte in der „Überprüfung” stapeln oder wenn Aufnahmen nicht in die „Bearbeitung” gelangen.

Teams können direkt im Board zusammenarbeiten, Kommentare hinzufügen, Dateien freigeben oder Details zu Aufgaben in Echtzeit aktualisieren. Sie können sogar Limits für Arbeiten in Bearbeitung (WIP) festlegen, um zu verhindern, dass zu viele Projekte ins Stocken geraten.

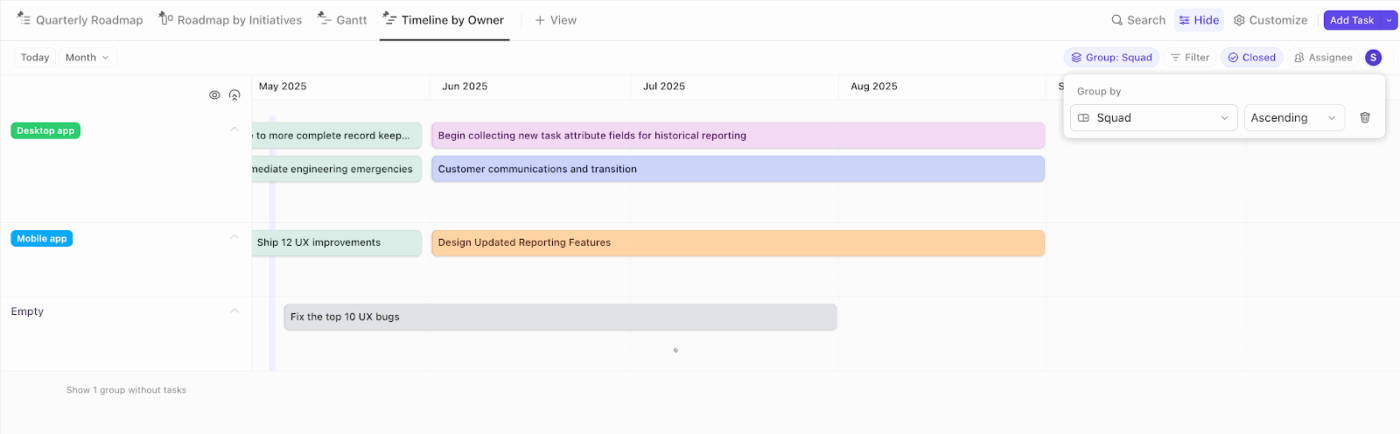

Wenn Sie eine umfassendere Perspektive benötigen, wechseln Sie zur ClickUp-Zeitleiste.

Ihr Produktionskalender zeigt beispielsweise jede Aufgabe mit einem Start- und Enddatum an, die anhand von Abhängigkeiten zugeordnet sind. Eine Aufnahmesitzung kann erst beginnen, wenn das Skript geprüft wurde, und die Veröffentlichung erfolgt erst, wenn die Bearbeitung abgeschlossen ist.

Mit hinzugefügten Meilensteinen können Sie Schlüsselpunkte wie „Abschließende Überprüfung” oder „Starttag” hervorheben, wodurch es einfacher wird, die Nachverfolgung des Fortschritts in Richtung wichtiger Termine durchzuführen.

Ein Benutzer gibt an:

ClickUp eignet sich hervorragend, wenn es mehrere Aufgaben/Unteraufgaben für ein bestimmtes Projekt gibt und alle Mitglieder des Teams auf dem Laufenden gehalten werden müssen. Ein gut gestalteter Ordner oder eine gut gestaltete Liste kann die Kommunikation per E-Mail und Slack/MS Teams leicht ersetzen. Die verschiedenen Ansichten helfen auch dabei, Prioritäten zu identifizieren und Zeitleisten effektiv zu erstellen.

ClickUp eignet sich hervorragend, wenn es mehrere Aufgaben/Unteraufgaben für ein bestimmtes Projekt gibt und alle Mitglieder des Teams auf dem Laufenden gehalten werden müssen. Ein gut gestalteter Ordner oder eine gut gestaltete Liste kann die Kommunikation per E-Mail und Slack/MS Teams leicht ersetzen. Die verschiedenen Ansichten helfen auch dabei, Prioritäten zu identifizieren und Zeitleisten effektiv zu erstellen.

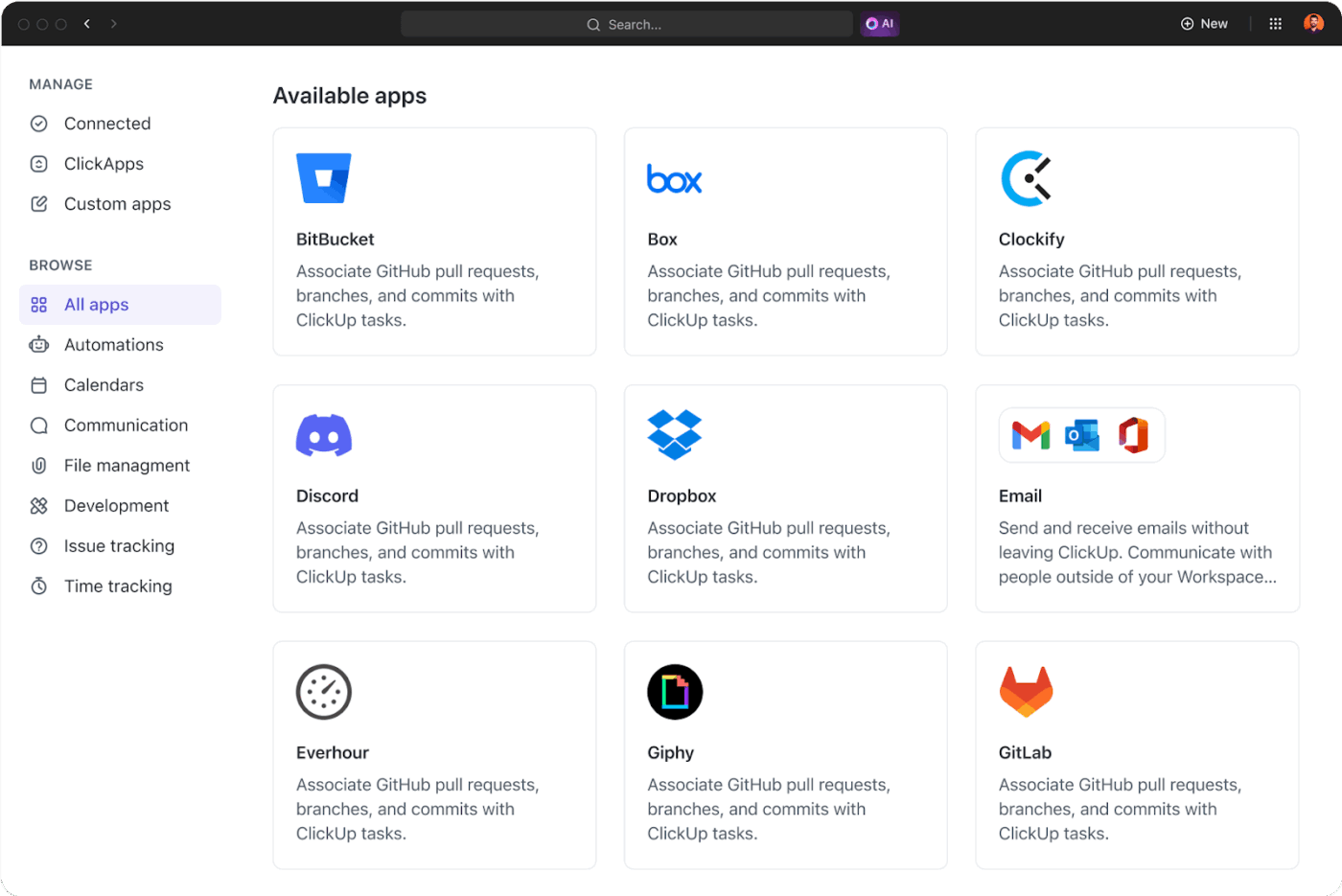

Verbinden Sie sich mit Tools von Drittanbietern

Wenn Sie mit mehreren Tools wie Gmail für die Kommunikation mit Stakeholdern und Dropbox für die Verwaltung von Audiodateien arbeiten, kann das sehr anstrengend sein.

ClickUp-Integrationen schaffen eine direkte Verbindung zwischen Ihrer Technologie und Ihrem Workspace.

Fügen Sie beispielsweise ein Google Doc-Skript in eine ClickUp-Aufgabe ein, führen Sie eine Synchronisierung der Termine mit Ihrem Google Kalender durch oder verknüpfen Sie aufgezeichnete Audiodateien aus dem Cloud-Speicher, damit alles an einem Ort gespeichert ist. Wenn Ihr Team Bearbeitungen in Figma verwaltet, lassen sich diese Workflows ebenfalls direkt in ClickUp integrieren.

📖 Lesen Sie auch: Die besten kostenlosen Bildschirmrekorder ohne Wasserzeichen

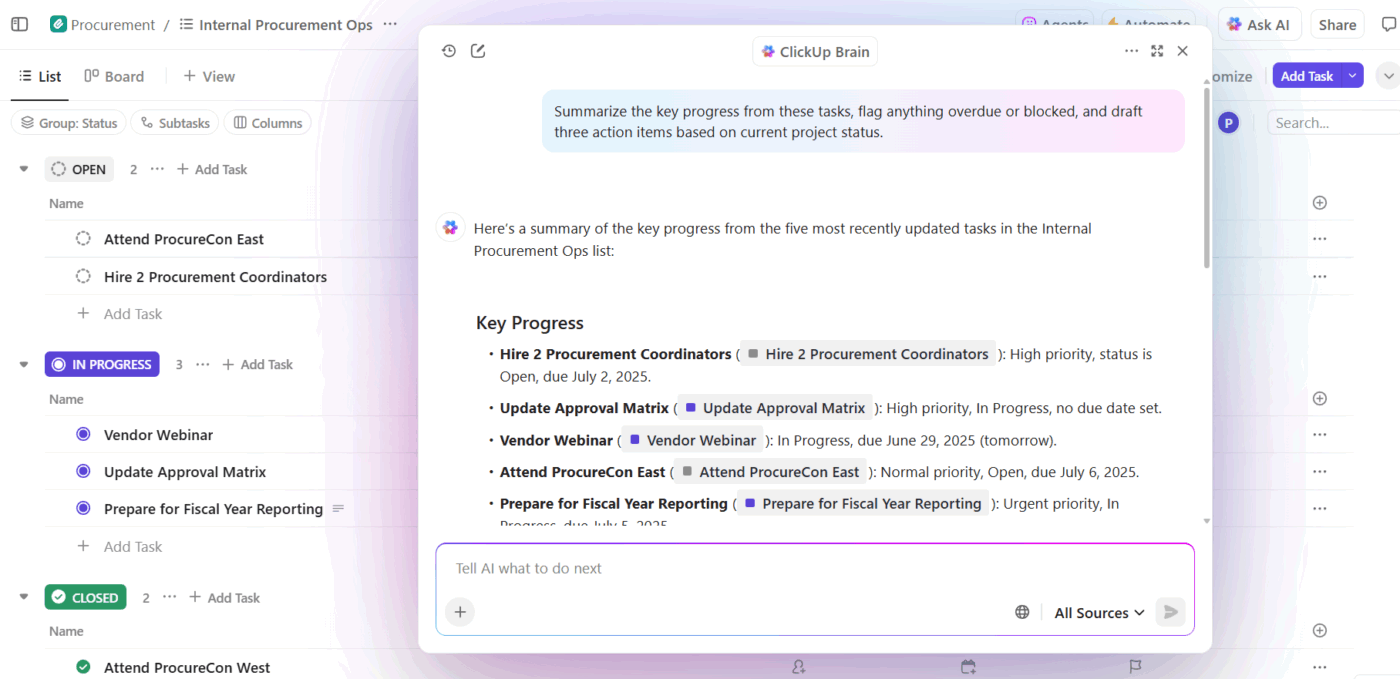

Optimieren Sie die Produktion mit KI

ClickUp Brain fungiert als Ihr integrierter Assistent für Projekte und hilft Ihnen dabei, den Überblick über Aufgaben zur Sprachgenerierung zu behalten.

Mit dem KI-Projektmanager müssen Sie nur noch fragen: „Welche Videos warten noch auf eine Sprachaufnahme?“ oder „Welche Aufgaben sind in der Phase der Bearbeitung blockiert?“ Sie erhalten sofort Antworten aus Ihrem Workspace.

Außerdem können Sie mit ClickUp Enterprise Search Ergebnisse aus Ihrem gesamten Arbeitsbereich und verbundenen Tools abrufen.

Wenn Sie also das aktualisierte französische Skript aus dem Thread der E-Mails der letzten Woche oder den neuesten Audio-Entwurf aus einem verknüpften Laufwerk benötigen, findet ClickUp Brain es in Sekundenschnelle.

🚀 Vorteil von ClickUp: ClickUp Brain MAX transformiert Ihren Workflow mit arbeitsplatzweiter, sprachgesteuerter Intelligenz.

Nutzen Sie die Talk-to-Text-Funktion, um Nachrichten, Aufgaben oder Dokumente zu diktieren. Das ist viermal schneller als Tippen! Mit der Speech-to-Text-Software können Sie auch auf Premium-KI-Modelle wie GPT-4.1, Claude und Gemini zugreifen, die automatisch für Ihre Aufgabe optimiert werden.

Zukünftige Trends in der automatisierten KI-Sprachgenerierung

Da Modelle immer intelligenter und anpassungsfähiger werden, entwickelt sich die KI-Sprachgenerierung in Richtung menschenähnlicher Eigenschaften. Es gibt Entwicklungen für Stimmen, die realistisch klingen und mit Kontext, Emotionen und Absichten reagieren.

Hier sind einige Schlüssel-Trends, die die Zukunft formen werden:

- Hyper-Personalisierung und Kontextbewusstsein: Bietet maßgeschneiderte Interaktionen unter Berücksichtigung des Verhaltens der Benutzer, der Präferenzen und der Kontextdaten.

- Multimodale und mehrsprachige Funktionen: Versteht und generiert Sprache in verschiedenen Sprachen, verarbeitet komplexe sprachliche Nuancen und lässt sich nahtlos in Text-, Bild- und Video-Schnittstellen integrieren.

- Integration in Unternehmen und im Gesundheitswesen: Ermöglicht den breiten Einsatz von KI-Sprachlösungen im Kundenservice, im Gesundheitswesen (Diagnosetools, Gesundheitsassistenten) und im Unternehmensbetrieb.

- Emotionale Intelligenz und ethische Fortschritte: Verfügt über emotionale Sensibilität, wie z. B. das Erkennen von Tonfall, Stimmung und Kontext, um einfühlsame Antworten zu geben. Gleichzeitig wird ein verstärkter Fokus auf Datenschutz, Sicherheit und ethische Rahmenbedingungen gelegt.

📖 Lesen Sie auch: Die besten KI-Meeting-Zusammenfassungen

Lassen Sie sich nicht von Voiceovers ausbremsen, wechseln Sie zu ClickUp

Die Sprachgenerierung ist längst kein Nischentool mehr. Sie entwickelt sich schnell zu einem zentralen Bestandteil der Arbeit von Teams, die Inhalte produzieren, Apps entwickeln und in großem Umfang kommunizieren.

Projektmanager vergessen jedoch oft, dass die Herausforderung auch in der Optimierung des Workflows liegt. Sie müssen Skripte, Überprüfungen und Veröffentlichungsschritte verwalten, damit das Endergebnis nutzbar ist.

ClickUp passt hier perfekt. Sie verfügen über Aufgabenvorlagen für wiederkehrende Anfragen und Board- und Zeitleistenansichten zur Nachverfolgung des Fortschritts. Dokumente sind der perfekte Ort, um Skripte zu speichern, während ClickUp Brain sich hervorragend für sofortige Aktualisierungen eignet.

Mit diesen Tools an Ihrer Seite verfügen Sie über ein optimiertes Produktionsstudio.

Melden Sie sich noch heute kostenlos bei ClickUp an! 📋

Häufig gestellte Fragen

1. Kann eine KI-generierte Stimme menschliche Sprachaufnahmen ersetzen?

Nicht ganz. KI-Stimmen eignen sich hervorragend für Aufgaben wie Schulungsvideos, Produktdemos oder schnelle Aktualisierungen des Inhalts, bei denen es auf Geschwindigkeit und Skalierbarkeit ankommt. Bei Projekten, die tiefe emotionale Nuancen oder künstlerischen Ausdruck erfordern, ist die menschliche Sprachausgabe jedoch nach wie vor im Vorteil. Viele Teams verwenden je nach Projekt eine Mischung aus beidem.

2. Wie verbessert KI die Genauigkeit der automatisierten Sprachgenerierung?

Moderne Systeme lernen aus riesigen Datensätzen und passen sich an Akzente, Tonfall und Sprechgeschwindigkeit an. Mit Features wie Rauschfilterung, Kontexterkennung und emotionaler Intonation werden natürlich klingende KI-Stimmen immer wichtiger. Die Genauigkeit verbessert sich durch kontinuierliches Training und Echtzeit-Feedbackschleifen ständig.

3. Ist die KI-Sprachgenerierung für die kommerzielle Nutzung legal?

Ja, aber unter bestimmten Bedingungen. Sie können KI-generierte Stimmen in den meisten kommerziellen Projekten legal verwenden, sofern Sie die Lizenzbedingungen der von Ihnen verwendeten Tools einhalten. Das Klonen der Stimme einer realen Person ohne deren Zustimmung kann jedoch ethische und rechtliche Probleme aufwerfen. Überprüfen Sie vor der Veröffentlichung immer die Nutzungsbedingungen.

4. Kann ich Stimmen in mehreren Sprachen generieren?

Auf jeden Fall. Viele KI-Sprachgenerator-Tools unterstützen Dutzende von Sprachen und Akzenten und sind daher nützlich für globale Teams, lokalisierte Marketingkampagnen und barrierefreie Inhalte.