O viés da IA pode parecer um problema técnico. Mas seus efeitos aparecem no mundo real e muitas vezes podem ser devastadores.

Quando um sistema de IA se inclina para o lado errado, mesmo que seja um pouco, isso pode levar a resultados injustos.

Com o tempo, essas pequenas questões podem se transformar em clientes frustrados, problemas de reputação ou até mesmo questões de conformidade que você não previa.

A maioria das equipes não tem a intenção de criar uma IA tendenciosa. Isso acontece porque os dados são confusos, o mundo real é desigual e as ferramentas que usamos nem sempre funcionam da maneira que esperamos. A boa notícia é que você não precisa ser um cientista de dados para entender o que está acontecendo.

Neste blog, vamos explicar o que é realmente o viés da IA, por que ele ocorre e como ele pode se manifestar nas ferramentas comerciais do dia a dia.

O que é o viés da IA?

O viés da IA ocorre quando um sistema de inteligência artificial produz resultados sistemáticos e injustos que favorecem ou prejudicam consistentemente determinados grupos de pessoas. Não se trata apenas de erros aleatórios, mas de padrões previsíveis que se incorporam à forma como a IA toma decisões. A causa? A IA aprende com dados que refletem o viés humano existente, outros viés inconscientes e desigualdades sociais.

Pense nisso desta forma: se você treinar um algoritmo de contratação com dez anos de dados da empresa, nos quais 90% dos gerentes eram homens, a IA pode aprender incorretamente que ser homem é uma qualificação essencial para uma função de gestão. A IA não está sendo maliciosa; ela está simplesmente identificando e repetindo os padrões que lhe foram mostrados.

Veja o que torna o viés da IA tão complicado:

- É sistemático, não aleatório: a injustiça não é uma falha pontual, mas um padrão repetitivo nos resultados da IA.

- Muitas vezes é invisível: resultados tendenciosos podem se esconder por trás da matemática complexa de um algoritmo aparentemente neutro, tornando-os difíceis de detectar.

- Isso está enraizado nos dados e no design: o viés entra no sistema por meio das escolhas que nós, seres humanos, fazemos quando criamos e treinamos a IA.

⭐ Modelo em destaque

O modelo de relatório de resposta a incidentes da ClickUp fornece uma estrutura pronta para documentar, rastrear e resolver incidentes do início ao fim. Registre todos os detalhes relevantes do incidente, mantenha status claramente categorizados e capture atributos importantes, como gravidade, grupos afetados e etapas de correção. Ele oferece suporte a campos personalizados para itens como Aprovado por, Notas do incidente e Documentos de apoio, que ajudam a revelar a responsabilidade e as evidências ao longo do processo de revisão.

Por que mitigar o viés da IA é importante

Quando seus sistemas de IA são injustos, você corre o risco de prejudicar a vida de pessoas reais.

Isso, por sua vez, expõe sua organização a sérios desafios comerciais e pode até mesmo destruir a confiança que você trabalhou duro para construir com seus clientes.

Uma IA tendenciosa que nega um empréstimo a alguém, rejeita sua candidatura a um emprego ou faz uma recomendação incorreta traz consigo sérias consequências no mundo real.

Os padrões e estruturas emergentes do setor agora incentivam as organizações a identificar e abordar ativamente o viés em seus sistemas de IA. Os riscos afetam sua organização de todos os ângulos:

- Risco regulatório: o não cumprimento das novas normas de IA pode resultar em desafios comerciais significativos.

- Prejuízo à reputação: uma vez que o público descobre que sua IA é tendenciosa, é extremamente difícil reconquistar sua confiança.

- Ineficiência operacional: modelos tendenciosos produzem resultados não confiáveis ou alucinações de IA que levam a decisões ruins e exigem correções caras.

- Responsabilidade ética: sua organização deve garantir que a tecnologia implantada trate todos os usuários de maneira justa.

Quando você consegue mitigar o viés da maneira correta, cria sistemas de IA nos quais as pessoas podem realmente confiar. A IA justa abre portas para novos mercados, melhora a qualidade de suas decisões e demonstra a todos que você está comprometido em conduzir um negócio ético.

📮 ClickUp Insight: 22% dos nossos entrevistados ainda mantêm a cautela quando se trata de usar IA no trabalho. Desses 22%, metade se preocupa com a privacidade dos seus dados, enquanto a outra metade simplesmente não tem certeza se pode confiar no que a IA lhes diz.

O ClickUp aborda ambas as preocupações de frente com medidas de segurança robustas e gerando links detalhados para tarefas e fontes com cada resposta.

Isso significa que mesmo as equipes mais cautelosas podem começar a aproveitar o aumento de produtividade sem se preocupar se suas informações estão protegidas ou se estão obtendo resultados confiáveis.

📖 Leia mais: Assistente de conformidade de IA: como a IA está transformando a conformidade e as auditorias

Tipos e fontes de viés da IA

O viés pode se infiltrar em seus sistemas de IA de várias maneiras.

Desde o momento em que você começa a coletar dados até muito tempo depois da implantação do sistema, esse elemento permanece relativamente estável. Mas se você souber onde procurar, poderá direcionar seus esforços e parar de jogar um jogo interminável de “bate-bola” com resultados injustos.

Viés de amostragem

O viés de amostragem ocorre quando os dados usados para treinar sua IA não representam com precisão o mundo real onde a IA será usada.

Por exemplo, se você criar um sistema de reconhecimento de voz treinado principalmente com dados de falantes de inglês americano, ele naturalmente terá dificuldade para entender pessoas com sotaque escocês ou indiano, da mesma forma que os LLMs favorecem nomes associados a pessoas brancas em 85,1% das vezes na triagem de currículos. Essa sub-representação cria enormes pontos cegos, deixando seu modelo despreparado para atender grupos inteiros de pessoas.

Viés algorítmico

O viés algorítmico ocorre quando o design do modelo ou o processo matemático amplifica padrões injustos, mesmo que os dados pareçam neutros.

O código postal de uma pessoa não deve determinar se ela obtém um empréstimo, mas se os códigos postais em seus dados de treinamento estiverem fortemente correlacionados com a raça, o algoritmo pode aprender a usar a localização como um indicador de discriminação.

Esse problema se agrava ainda mais com os ciclos de feedback — quando uma previsão tendenciosa (como a recusa de um empréstimo) é inserida no sistema como um novo dado, o viés só se intensifica com o tempo.

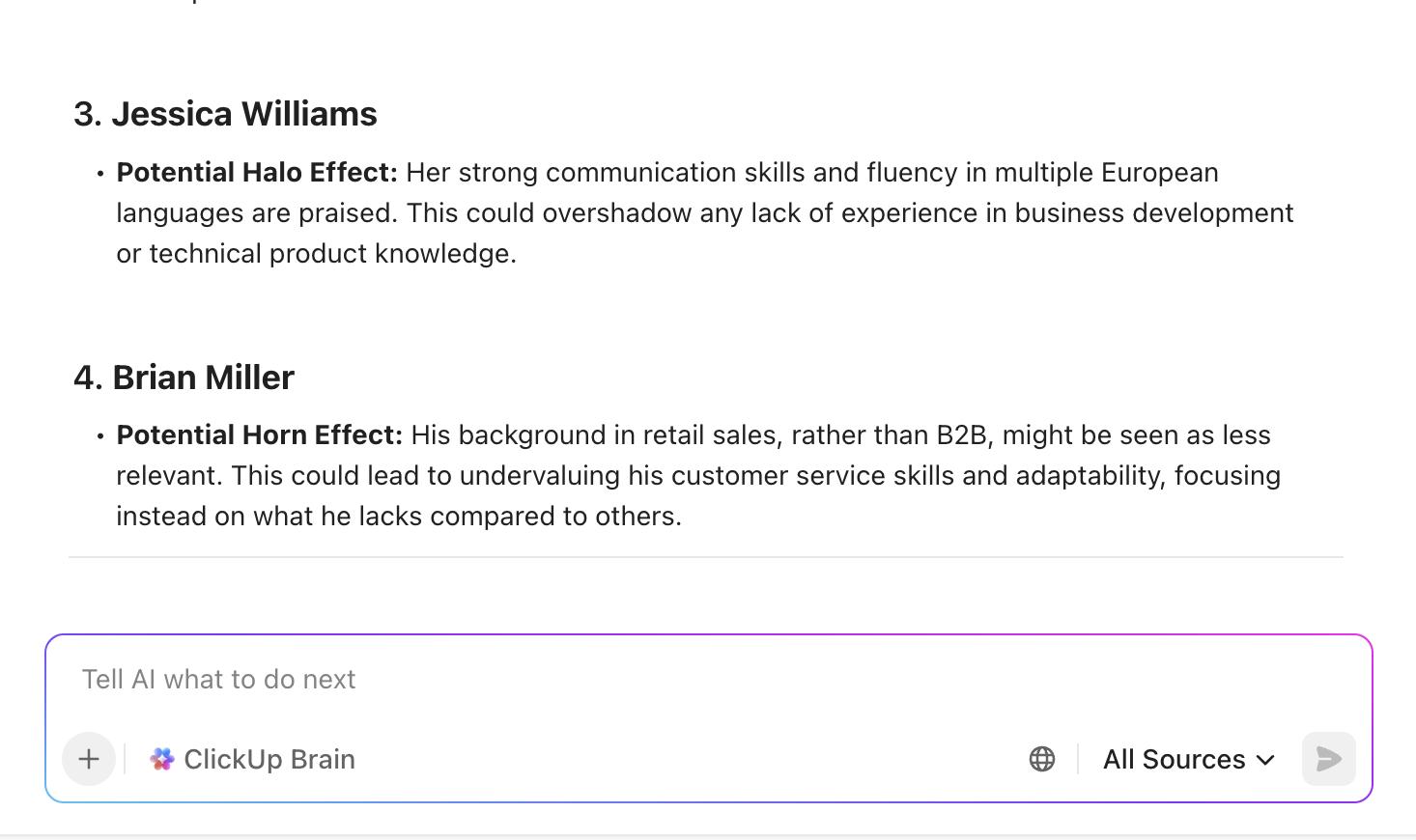

Viés de decisão humana

Cada escolha que uma pessoa faz ao construir um sistema de IA pode introduzir viés.

Isso inclui decidir quais dados coletar, como rotulá-los e como definir o “sucesso” do modelo. Por exemplo, uma equipe pode inconscientemente favorecer dados que corroboram suas crenças (viés de confirmação) ou dar muito peso à primeira informação que vê (viés de ancoragem).

Mesmo as equipes mais bem-intencionadas podem acidentalmente codificar suas próprias suposições e visão de mundo em um sistema de IA.

Exemplos de viés de IA no mundo real

Empresas reais enfrentaram consequências graves quando seus sistemas de IA apresentaram viés, custando-lhes milhões em danos e perda da confiança dos clientes. Aqui estão alguns exemplos documentados:

1. Ferramentas de recrutamento tendenciosas

Um dos casos mais citados envolveu uma grande empresa de tecnologia que descartou um sistema interno de recrutamento de IA depois que ele aprendeu a favorecer candidatos do sexo masculino em detrimento das mulheres. O sistema foi treinado com uma década de currículos em que a maioria dos candidatos aprovados eram homens. Assim, ele começou a penalizar currículos com palavras como “mulheres”, chegando até mesmo a rebaixar graduadas de faculdades femininas.

Isso mostra como o viés dos dados históricos, quando os padrões passados refletem a desigualdade existente, pode se infiltrar na automação, a menos que seja cuidadosamente auditado. Mas, à medida que o recrutamento automatizado com IA se torna mais prevalente, a escala do problema se torna ainda maior.

🌼 Você sabia? Dados recentes mostram que 37% das organizações agora estão “integrando ativamente” ou “experimentando” ferramentas de IA de última geração no recrutamento, um aumento em relação aos 27% registrados há um ano.

2. Reconhecimento facial que ignora metade da população

Uma pesquisa liderada por Joy Buolamwini e documentada no estudo Gender Shades revelou que os sistemas comerciais de reconhecimento facial apresentavam taxas de erro de até 34,7% para mulheres de pele escura, em comparação com menos de 1% para homens de pele clara.

Isso é mais uma vez um reflexo de conjuntos de dados de treinamento desequilibrados. O viés em ferramentas biométricas tem efeitos ainda mais abrangentes.

A polícia e as agências governamentais também enfrentaram problemas com o viés do reconhecimento facial. Investigações do The Washington Post descobriram que alguns desses sistemas eram muito mais propensos a identificar erroneamente pessoas de grupos marginalizados. Em vários casos reais, isso levou a prisões indevidas, reações públicas negativas e grandes preocupações sobre como essas ferramentas afetam os direitos das pessoas.

3. Algoritmos de saúde que subestimam a prioridade dos cuidados

Os sistemas de IA na área da saúde projetados para prever quais pacientes precisam de cuidados extras também demonstraram viés.

Em um caso bem documentado, um algoritmo de previsão de saúde amplamente utilizado cometeu um erro significativo. Ele deveria ajudar a decidir quais pacientes deveriam receber cuidados extras, mas acabou sistematicamente dando menor prioridade aos pacientes negros, mesmo quando eles estavam igualmente ou mais doentes do que os pacientes brancos.

Isso aconteceu porque o modelo usou os gastos com saúde como um indicador das necessidades médicas. Como os pacientes negros historicamente tinham gastos menores com saúde devido ao acesso desigual aos cuidados médicos, o algoritmo os tratou como menos necessitados. Como resultado, ele desviou os recursos de saúde daqueles que realmente mais precisavam deles. Os pesquisadores descobriram que simplesmente corrigir esse indicador poderia aumentar significativamente o acesso a programas de saúde justos.

Preocupações com essas questões levaram grupos de direitos civis a pressionar por padrões de “equidade em primeiro lugar” na IA na área da saúde. Em dezembro de 2025, a NAACP divulgou um plano detalhado convocando hospitais, empresas de tecnologia e formuladores de políticas a adotar auditorias de viés, práticas de design transparentes, estruturas inclusivas e ferramentas de governança de IA para evitar o aprofundamento das desigualdades raciais na saúde.

4. Algoritmos de crédito com resultados desiguais

A IA e a tomada de decisões automatizada não apenas moldam o que você vê nas redes sociais, mas também influenciam quem tem acesso ao dinheiro e em que condições.

Um dos exemplos reais mais comentados veio do Apple Card , um cartão de crédito digital emitido pela Goldman Sachs.

Em 2019, clientes nas redes sociais compartilharam que o algoritmo de limite de crédito do cartão concedia limites muito mais altos a alguns homens do que a suas esposas ou parceiras. Isso acontecia mesmo quando os casais apresentavam perfis financeiros semelhantes. Um engenheiro de software disse que recebeu um limite de crédito 20 vezes maior do que o de sua esposa, e até mesmo o cofundador da Apple, Steve Wozniak, confirmou uma experiência semelhante envolvendo sua esposa.

Esses padrões provocaram protestos públicos e levaram a uma investigação regulatória pelo Departamento de Serviços Financeiros do Estado de Nova York para apurar se o algoritmo discriminava as mulheres, destacando como as ferramentas financeiras automatizadas podem produzir resultados desiguais.

5. Legendas automatizadas e reconhecimento de voz que excluem vozes

Os sistemas de reconhecimento de voz e legenda automática muitas vezes não ouvem todos da mesma forma. Vários estudos demonstraram que essas ferramentas tendem a funcionar melhor para alguns falantes do que para outros, dependendo de fatores como sotaque, dialeto, raça e se o inglês é a primeira língua do falante.

Isso acontece porque os sistemas comerciais geralmente são treinados com conjuntos de dados dominados por determinados padrões de fala — muitas vezes o inglês padrão ocidental —, deixando outras vozes sub-representadas.

Por exemplo, pesquisadores da Stanford testaram cinco sistemas líderes de conversão de voz em texto (da Amazon, Google, Microsoft, IBM e Apple) e descobriram que eles cometiam quase o dobro de erros ao transcrever a fala de locutores negros em comparação com locutores brancos. O problema ocorria mesmo quando os participantes diziam as mesmas palavras nas mesmas condições.

Quando as legendas são imprecisas para determinados locutores, isso pode levar a experiências ruins para os usuários e à inacessibilidade para pessoas que dependem das legendas. Pior ainda, isso pode contribuir para resultados tendenciosos em sistemas que usam reconhecimento de voz em ambientes de contratação, educação ou saúde.

Cada um desses exemplos ilustra uma maneira distinta pela qual o viés pode ser incorporado em sistemas automatizados, por meio de dados de treinamento distorcidos, proxies mal escolhidos ou testes não representativos. Em todos os casos, os resultados não são apenas técnicos — eles moldam oportunidades, minam a confiança e acarretam riscos comerciais e éticos reais.

📖 Leia mais: Riscos x Problemas – Qual é a diferença?

Resumo: Como o viés da IA se manifesta e quem ele prejudica

| Onde o viés apareceu | Quem foi afetado | Impacto no mundo real |

|---|---|---|

| Algoritmos de recrutamento (ferramenta de contratação de IA descartada) | Mulheres | Os currículos foram rebaixados com base em palavras-chave relacionadas ao gênero, reduzindo o acesso a entrevistas e oportunidades de emprego. |

| Sistemas de reconhecimento facial (Gender Shades + casos de prisões indevidas) | Mulheres de pele escura; grupos raciais marginalizados | Taxas de identificação incorreta muito mais altas levaram a prisões indevidas, danos à reputação e preocupações com os direitos civis. |

| Algoritmos de previsão de riscos na área da saúde (estudo da Universidade de Chicago) | Pacientes negros | Os pacientes foram despriorizados para cuidados extras porque os gastos com saúde foram usados como um indicador falho da necessidade médica, agravando as desigualdades na saúde. |

| Algoritmos de limite de crédito (investigação do Apple Card) | Mulheres | Os homens receberam limites de crédito significativamente mais altos do que suas parceiras igualmente qualificadas, afetando o acesso financeiro e o poder de empréstimo. |

| Reconhecimento de voz e legendas automáticas (estudo ASR da Stanford) | Oradores com sotaques não padronizados; Oradores negros | Taxas de erro quase duas vezes maiores criaram barreiras de acessibilidade, falhas de comunicação e resultados tendenciosos em ferramentas utilizadas em contratações, educação e acesso digital diário. |

Estratégias eficazes de mitigação de viés

Não existe uma solução mágica para eliminar o viés da IA.

A mitigação eficaz do viés requer uma defesa em várias camadas que você aplica ao longo de todo o ciclo de vida da IA. Ao combinar essas estratégias comprovadas, você pode reduzir drasticamente o risco de resultados injustos.

Colete dados de treinamento diversificados

Dados representativos são a base absoluta de uma IA justa.

Seu modelo não pode aprender a atender grupos de pessoas que nunca viu em seu treinamento. Comece auditando seus conjuntos de dados existentes para encontrar lacunas demográficas. Em seguida, faça um esforço consciente para obter novos dados dessas populações sub-representadas.

Quando os dados do mundo real são difíceis de encontrar, você pode usar técnicas como aumento de dados (criação de cópias modificadas de dados existentes) ou geração de dados sintéticos para ajudar a preencher as lacunas.

🚧 Kit de ferramentas: use o modelo de lista de verificação de auditoria interna do ClickUp para mapear seu processo de auditoria.

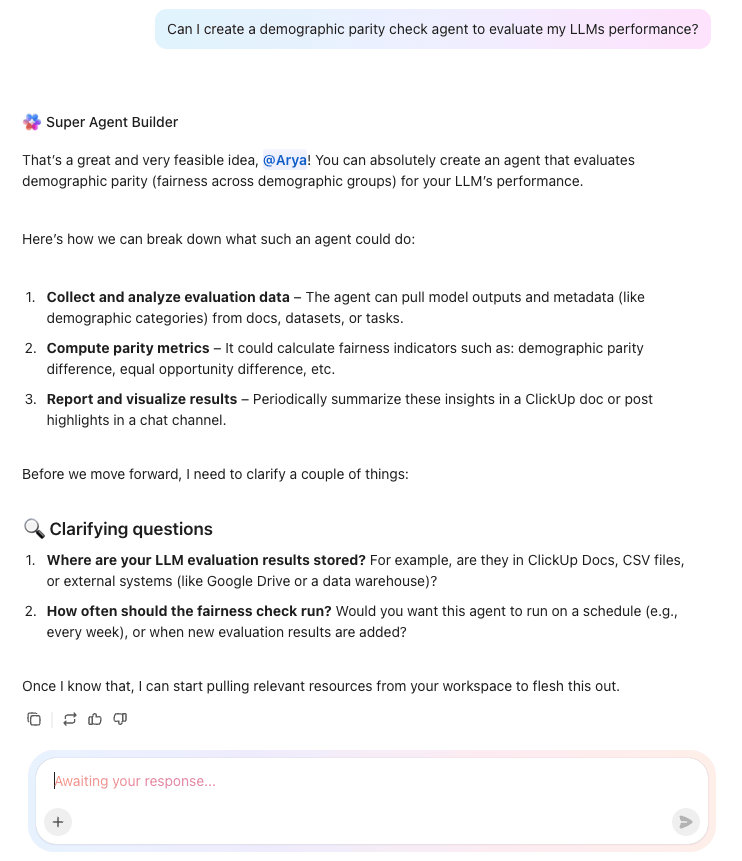

Teste modelos para viés

Você precisa testar sistematicamente o viés para detectá-lo antes que ele cause danos reais. Use métricas de equidade para medir o desempenho do seu modelo em diferentes grupos.

Por exemplo, a paridade demográfica verifica se o modelo produz um resultado positivo (como a aprovação de um empréstimo) em taxas iguais entre os grupos, enquanto a igualdade de chances verifica se as taxas de erro são iguais.

Divida o desempenho do seu modelo por todos os dados demográficos possíveis — raça, gênero, idade, localização geográfica — para identificar onde a precisão diminui ou onde surgem injustiças.

Mantenha o ser humano no circuito

Os sistemas automatizados podem deixar passar injustiças sutis e específicas do contexto que uma pessoa perceberia imediatamente. Uma abordagem com intervenção humana é crucial para decisões de alto risco, nas quais uma IA pode fazer uma recomendação, mas uma pessoa toma a decisão final.

Isso é especialmente importante em áreas como contratação, empréstimos e diagnóstico médico. Para que isso funcione, seus revisores humanos devem ser treinados para reconhecer o viés e ter autoridade para substituir as sugestões da IA.

Aplique técnicas de equidade algorítmica

Você também pode usar métodos técnicos para intervir diretamente e reduzir o viés. Essas técnicas se enquadram em três categorias principais:

- Pré-processamento: envolve ajustar os dados de treinamento antes que o modelo os veja, geralmente reponderando ou reamostrando os dados para criar uma representação mais equilibrada dos diferentes grupos.

- Em processamento: aqui, você adiciona restrições de imparcialidade diretamente ao processo de treinamento do modelo, ensinando-o a otimizar a precisão e a imparcialidade ao mesmo tempo.

- Pós-processamento: isso significa ajustar as previsões finais do modelo depois que elas forem feitas para garantir que os resultados sejam equitativos entre os grupos.

Essas técnicas geralmente envolvem uma compensação, em que uma ligeira redução na precisão geral pode ser necessária para obter um ganho significativo em termos de imparcialidade.

💟 Bônus: O BrainGPT é o seu companheiro de desktop com tecnologia de IA que leva os testes de viés de IA a um novo patamar, oferecendo acesso a vários modelos líderes — incluindo GPT-5, Claude, Gemini e muito mais — tudo em um só lugar.

Isso significa que você pode facilmente executar os mesmos prompts ou cenários em diferentes modelos, comparar suas habilidades de raciocínio e identificar onde as respostas divergem ou mostram viés. Este superaplicativo de IA também permite que você use a conversão de voz em texto para configurar casos de teste, documentar suas descobertas e organizar os resultados para análise comparativa.

Seu raciocínio avançado e ferramentas sensíveis ao contexto ajudam você a solucionar problemas, destacar padrões e entender como cada modelo aborda temas delicados. Ao centralizar seu fluxo de trabalho e permitir testes transparentes e multimodais, o Brain MAX permite que você audite, compare e lide com o viés da IA com confiança e precisão.

Aumente a transparência e a explicabilidade

Se você não sabe como seu modelo está tomando decisões, não pode corrigi-lo quando ele estiver errado. As técnicas de IA explicável (XAI) ajudam você a dar uma olhada dentro da “caixa preta” e ver quais características dos dados estão impulsionando as previsões.

Você também pode criar cartões de modelo, que são como rótulos nutricionais para sua IA, documentando seu uso pretendido, dados de desempenho e limitações conhecidas.

📮ClickUp Insight: 13% dos participantes da nossa pesquisa querem usar a IA para tomar decisões difíceis e resolver problemas complexos. No entanto, apenas 28% afirmam usar a IA regularmente no trabalho. Um possível motivo: preocupações com a segurança!

Os usuários podem não querer compartilhar dados confidenciais de tomada de decisão com uma IA externa.

O ClickUp resolve isso trazendo a resolução de problemas com IA diretamente para o seu espaço de trabalho seguro. De SOC 2 a normas ISO, o ClickUp está em conformidade com os mais altos padrões de segurança de dados e ajuda você a usar com segurança a tecnologia de IA generativa em todo o seu espaço de trabalho.

Políticas de governança e responsabilidade da IA

Um programa robusto de governança de IA cria responsabilidades claras e padrões consistentes que todos na equipe podem seguir.

Sua organização precisa de estruturas de governança claras para garantir que alguém seja sempre responsável pela criação e implantação ética da IA.

Aqui estão os elementos essenciais de um programa eficaz de governança de IA:

| Elemento de governança | O que isso significa | Medidas práticas para sua organização |

|---|---|---|

| Propriedade clara | Pessoas ou equipes dedicadas são responsáveis pela ética, supervisão e conformidade da IA. | • Nomeie um líder de ética em IA ou um comitê multifuncional • Defina responsabilidades por dados, qualidade de modelos, conformidade e risco • Inclua opiniões jurídicas, de engenharia, de produto e de DEI na supervisão |

| Políticas documentadas | Diretrizes escritas que definem como os dados são coletados, usados e monitorados ao longo do ciclo de vida da IA. | • Crie políticas internas para obtenção, rotulagem, privacidade e retenção de dados • Documente padrões para desenvolvimento, validação e implantação de modelos • Exija que as equipes sigam listas de verificação antes de enviar qualquer sistema de IA |

| Trilhas de auditoria | Um registro transparente de decisões, versões de modelos, conjuntos de dados e alterações. | • Implemente controle de versão para conjuntos de dados e modelos • Registre decisões importantes, parâmetros de modelos e analise resultados • Armazene trilhas de auditoria em um repositório central e acessível |

| Revisões regulares | Avaliações contínuas dos sistemas de IA para verificar preconceitos, desvios e lacunas de conformidade. | • Programe avaliações de viés trimestrais ou semestrais por meio de uma avaliação robusta de LLM • Retreine ou recalibre modelos quando o desempenho cair ou o comportamento mudar • Revise os modelos após grandes atualizações de dados ou alterações no produto |

| Plano de resposta a incidentes | Um protocolo claro para identificar, relatar e corrigir o viés ou os danos da IA. | • Crie um fluxo de trabalho interno para escalonamento de vieses • Defina como as questões são investigadas e quem aprova as correções • Descreva as etapas de comunicação para usuários, clientes ou reguladores, quando necessário |

💡Dica profissional: estruturas como a Estrutura de Gerenciamento de Risco de IA do NIST e a Lei de IA da UE, com multas de até 7% do faturamento anual, podem fornecer excelentes modelos para a criação de seu próprio programa de governança.

Como implementar a mitigação do viés com o ClickUp

O espaço de trabalho de IA convergente da ClickUp reúne todas as partes móveis do seu programa de governança de IA em um único espaço de trabalho organizado.

Suas equipes podem gerenciar tarefas, armazenar políticas, revisar resultados de auditorias, discutir riscos e rastrear incidentes sem precisar alternar entre ferramentas ou perder o contexto. Todos os registros de modelos, logs de decisões e planos de correção permanecem vinculados, para que você sempre saiba quem fez o quê e por quê.

E como a IA do ClickUp entende o trabalho dentro do seu espaço de trabalho, ela pode trazer à tona avaliações anteriores, resumir relatórios longos e ajudar sua equipe a se manter alinhada à medida que os padrões evoluem. O resultado é um sistema de governança mais fácil de seguir, mais fácil de auditar e muito mais confiável à medida que sua pegada de IA cresce.

Vamos analisar isso como um fluxo de trabalho!

Etapa 1: Configure seu espaço de trabalho de governança de IA

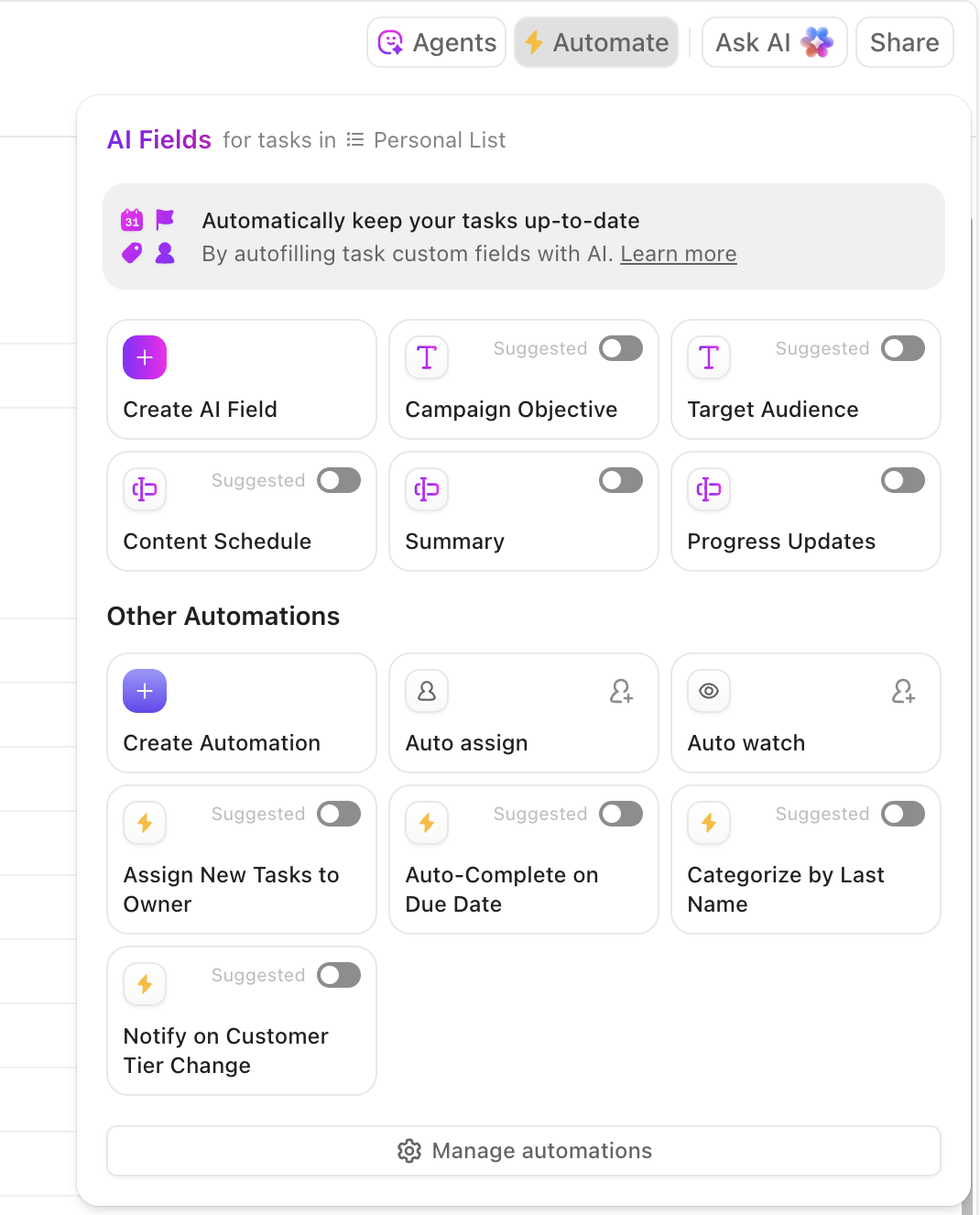

Comece criando um espaço dedicado no ClickUp para todo o trabalho relacionado à governança. Adicione listas para seu inventário de modelos, avaliações de viés, relatórios de incidentes, documentos de política e revisões programadas para que todos os elementos do programa fiquem em um ambiente controlado.

Configure campos personalizados ou campos de IA para acompanhar métricas de equidade, pontuações de viés, versões de modelos, status de revisão e níveis de risco. Use permissões baseadas em funções para garantir que apenas revisores, engenheiros e líderes de conformidade autorizados possam acessar trabalhos confidenciais de IA. Isso cria uma base estrutural que as ferramentas pontuais e as plataformas de projetos genéricas dos concorrentes não podem oferecer.

Etapa 2: Crie sua estrutura de governança

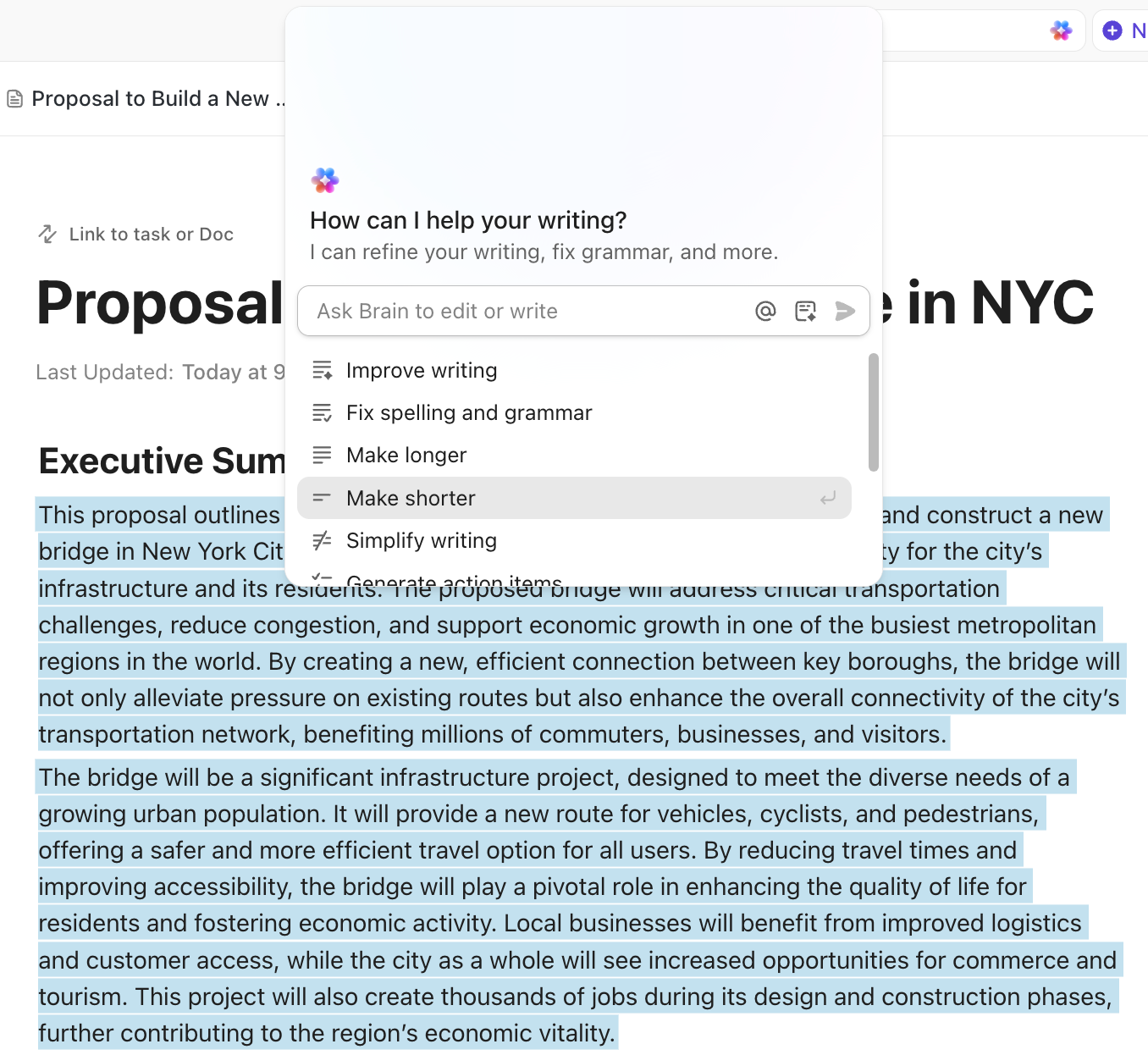

Em seguida, crie um documento ClickUp para servir como seu manual de governança. É nele que você descreve seus procedimentos de avaliação de viés, limites de imparcialidade, diretrizes de documentação de modelos, etapas de intervenção humana e protocolos de escalonamento.

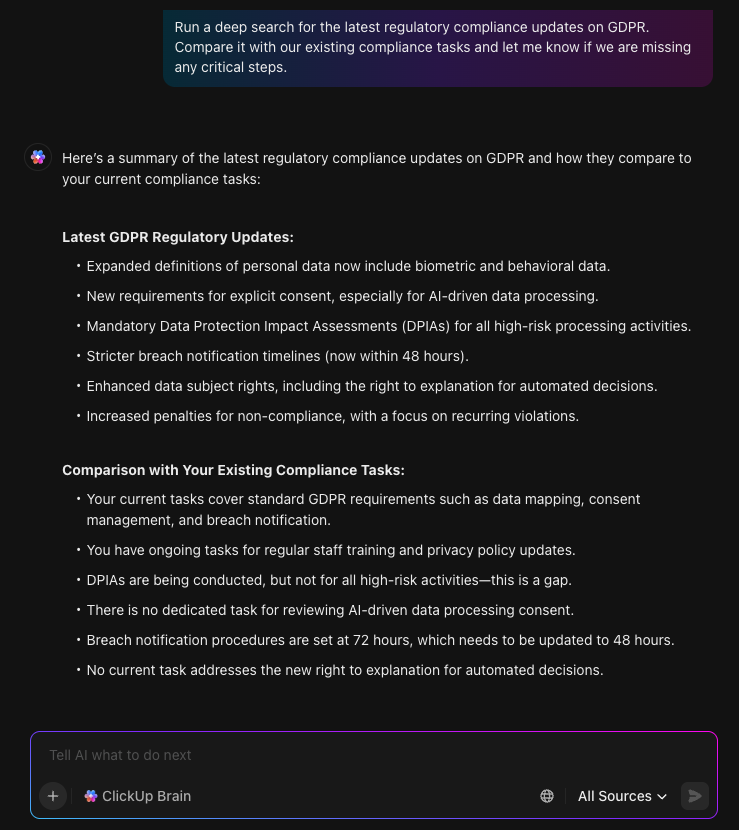

Como os documentos permanecem conectados às tarefas e aos registros do modelo, suas equipes podem colaborar sem perder o histórico de versões ou espalhar arquivos por várias ferramentas. Em seguida, o ClickUp Brain pode ajudar a resumir regulamentos externos, redigir novas políticas ou revelar resultados de auditorias anteriores, tornando a criação de políticas mais consistente e rastreável.

Como ele pode pesquisar na web, alternar entre vários modelos de IA e sintetizar informações em orientações claras, sua equipe fica por dentro dos padrões emergentes e das mudanças do setor sem sair do espaço de trabalho. Tudo o que você precisa, atualizações de políticas, insights regulatórios e decisões anteriores, está reunido em um só lugar, tornando seu sistema de governança mais estável e muito mais fácil de manter.

Etapa 3: Registre todos os modelos

Cada modelo deve ter sua própria tarefa na lista “Inventário de modelos” para que a propriedade e a responsabilidade sejam sempre claras.

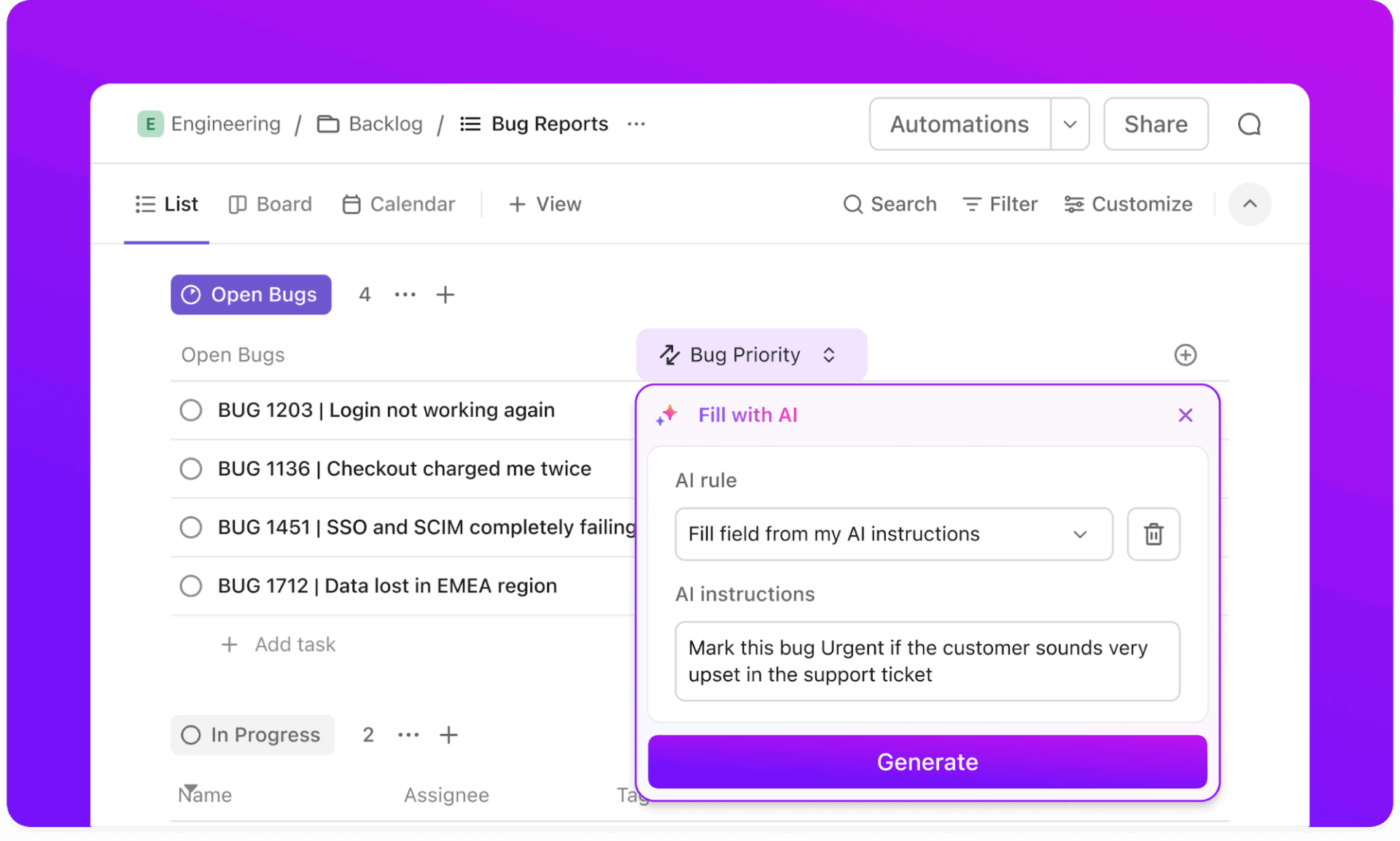

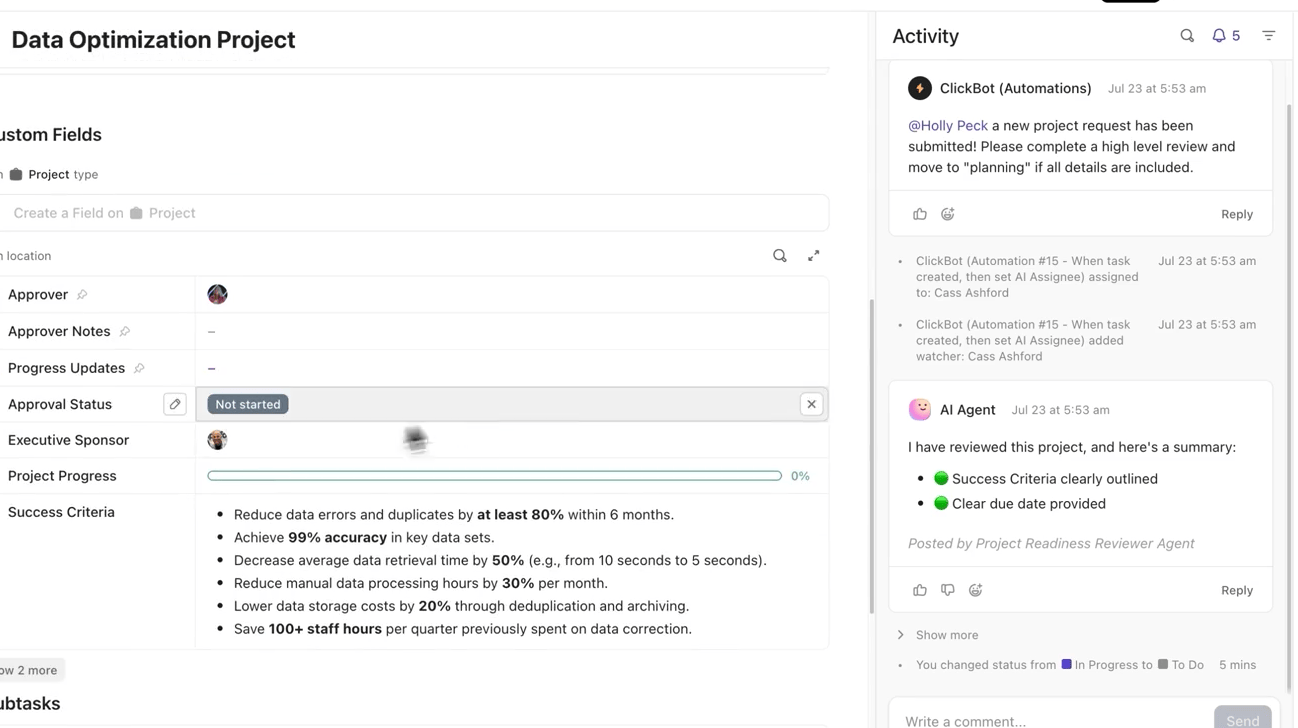

Acompanhe facilmente cada incidente de viés como um item acionável usando o ClickUp Tasks e o ClickUp Custom Fields para estruturar seus fluxos de trabalho de avaliação de viés e capturar todos os detalhes importantes.

Dessa forma, você pode rastrear o tipo de viés, o nível de gravidade, o status da correção, o membro da equipe responsável e a próxima data de revisão, garantindo que cada problema tenha um responsável claro e um prazo para resolução.

Anexe conjuntos de dados, resumos de avaliação e notas de linhagem para que tudo fique em um só lugar. As automações podem então alertar os revisores sempre que um modelo passar para a fase de teste ou produção.

Etapa 4: execute auditorias de viés programadas e baseadas em eventos

As auditorias de viés devem ocorrer tanto em uma programação recorrente quanto em resposta a gatilhos específicos.

Configure regras simples por meio do ClickUp Automations, que aciona automaticamente tarefas de revisão sempre que um modelo atinge um novo marco de implantação ou uma auditoria programada está prestes a ocorrer. Você nunca mais perderá uma avaliação trimestral de viés, pois o Automations pode designar os revisores certos, definir os prazos corretos e até mesmo enviar lembretes à medida que as datas de vencimento se aproximam.

Para auditorias baseadas em eventos, os formulários ClickUp simplificam a coleta de relatórios de incidentes de viés ou feedback humano, enquanto os revisores usam campos personalizados para registrar lacunas de imparcialidade, resultados de testes e recomendações. Cada envio de formulário é encaminhado para sua equipe como uma tarefa, o que cria uma linha de auditoria repetível.

Etapa 5: Investigue e resolva incidentes de viés

Quando uma questão de viés for identificada, crie uma tarefa de incidente que capture a gravidade, os grupos afetados, a versão do modelo e o trabalho de mitigação necessário. Os agentes de IA podem escalar descobertas de alto risco para os líderes de conformidade e designar os revisores e engenheiros certos.

Cada ação de mitigação, resultado de teste e etapa de validação permanece vinculada ao registro do incidente. O ClickUp Brain pode gerar resumos para a liderança ou ajudar a preparar notas de correção para sua documentação de governança, mantendo tudo transparente e rastreável.

Etapa 6: Monitore a integridade do seu programa de governança de IA

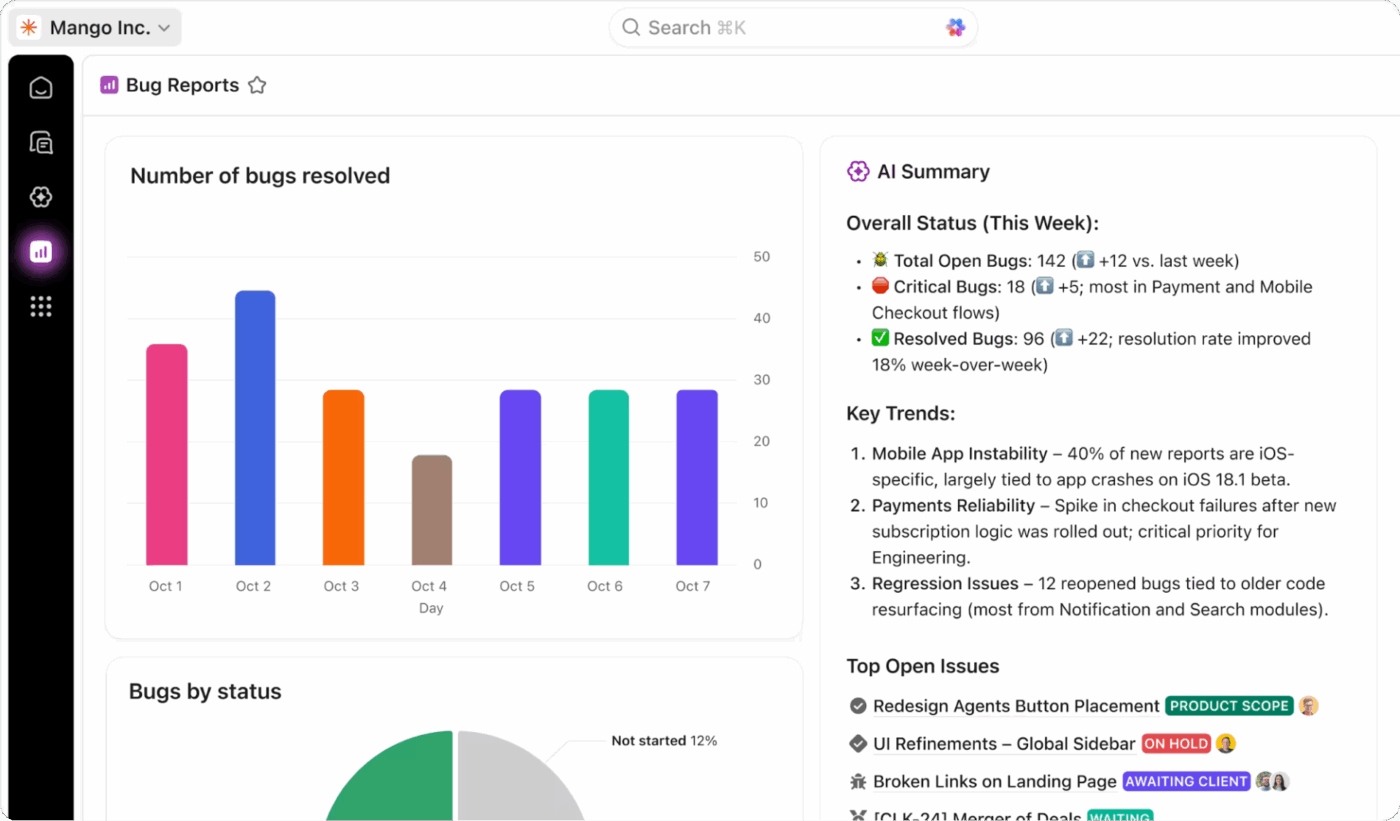

Por fim, crie painéis que ofereçam aos líderes uma visão em tempo real do seu programa de mitigação de viés.

Inclua painéis que mostram incidentes em aberto, tempo para resolução, taxas de conclusão de auditoria, métricas de equidade e status de conformidade em todos os modelos ativos. Os painéis sem código no ClickUp podem extrair dados automaticamente e atualizar tarefas à medida que o trabalho avança, com resumos de IA integrados à visualização do painel.

📖 Leia mais: Como superar desafios comuns da IA

Verificações de viés pós-implantação

Seu trabalho não termina quando o modelo de IA entra em operação.

Na verdade, é aí que o verdadeiro teste começa. Os modelos podem “desviar-se” e desenvolver novos vieses ao longo do tempo, à medida que os dados do mundo real que eles veem começam a mudar. O monitoramento contínuo é a única maneira de detectar esse viés emergente antes que ele cause danos generalizados.

Veja o que seu monitoramento contínuo deve incluir:

| Prática | O que isso garante |

|---|---|

| Acompanhamento do desempenho por grupo | Mede continuamente a precisão e a imparcialidade do modelo em todos os segmentos demográficos para que as disparidades sejam detectadas antecipadamente. |

| Detecção de desvio de dados | Monitora alterações nos dados de entrada que podem introduzir novos vieses ou enfraquecer o desempenho do modelo ao longo do tempo. |

| Feedback dos usuários | Oferece canais claros para os usuários relatarem resultados tendenciosos ou incorretos, melhorando a supervisão no mundo real. |

| Auditorias programadas | Garante análises aprofundadas trimestrais ou semestrais do comportamento do modelo, métricas de equidade e requisitos de conformidade. |

| Resposta a incidentes | Define um processo estruturado para investigar, corrigir e documentar quaisquer eventos de viés relatados. |

💟 Bônus: Os sistemas de IA generativa, em particular, precisam de vigilância extra porque seus resultados são muito menos previsíveis do que os modelos tradicionais de aprendizado de máquina. Uma ótima técnica para isso é o red-teaming, em que uma equipe dedicada tenta ativamente provocar respostas tendenciosas ou prejudiciais do modelo para identificar seus pontos fracos.

Por exemplo, o Projeto Lighthouse da Airbnb é um excelente estudo de caso do setor sobre uma empresa que implementa monitoramento sistemático de viés pós-implantação.

Trata-se de uma iniciativa de pesquisa que examina como a percepção de raça pode afetar os resultados das reservas, ajudando a empresa a identificar e reduzir a discriminação na plataforma. Ela emprega métodos que garantem a privacidade, tem parceria com grupos de direitos civis e traduz as descobertas em mudanças de produtos e políticas, permitindo que mais hóspedes naveguem pela plataforma sem encontrar obstáculos invisíveis.

Mitigue o viés da IA com o ClickUp

Construir uma IA justa e responsável é um compromisso organizacional.

Quando suas políticas, pessoas, processos e ferramentas funcionam em harmonia, você cria um sistema de governança capaz de se adaptar a novos riscos, responder rapidamente a incidentes e conquistar a confiança das pessoas que dependem de seus produtos.

Com revisões estruturadas, documentação clara e um fluxo de trabalho repetível para lidar com o viés, as equipes permanecem alinhadas e responsáveis, em vez de reagir em modo de crise.

Ao centralizar tudo dentro do ClickUp, desde registros de modelos até resultados de auditorias e relatórios de incidentes, você cria uma única camada operacional onde as decisões são transparentes, as responsabilidades são claras e as melhorias nunca se perdem na confusão.

Uma governança forte não retarda a inovação, mas a estabiliza. Pronto para incorporar a mitigação do viés em seus fluxos de trabalho de IA? Comece gratuitamente com o ClickUp e comece a construir seu programa de governança de IA hoje mesmo.

Perguntas frequentes

Um ótimo primeiro passo é realizar uma auditoria de viés em seus sistemas de IA existentes. Essa avaliação de base mostrará onde existem injustiças atualmente e ajudará você a priorizar seus esforços de mitigação.

As equipes usam métricas de equidade específicas, como paridade demográfica, chances equalizadas e índice de impacto desigual, para quantificar o viés. A métrica certa depende do seu caso de uso específico e do tipo de equidade que é mais importante nesse contexto.

Você deve sempre adicionar uma etapa de revisão humana para decisões de alto risco que afetam significativamente a vida ou as oportunidades de uma pessoa, como contratação, empréstimos ou cuidados de saúde. Também é aconselhável usá-la durante a implantação inicial de qualquer novo modelo, quando seu comportamento ainda é imprevisível.

Como a IA generativa pode produzir uma gama quase infinita de respostas imprevisíveis, não basta verificar a precisão. É necessário usar técnicas de sondagem ativa, como red teaming e amostragem de saída em grande escala, para descobrir se o modelo produz conteúdo tendencioso em diferentes condições.