A maioria de nós já teve alguma experiência “conversando” com as ferramentas de IA mais recentes do mercado. Se você já passou tempo suficiente com a IA, sabe que ela é como aquele amigo brilhante, mas esquecido, que tem ótimas ideias, mas às vezes esquece o que vocês dois conversaram. Ou aquele colega que está sempre ao telefone compartilhando notícias duvidosas de conversas aleatórias, espalhando desinformação.

Isso é apenas a ponta do iceberg quando falamos sobre os desafios da inteligência artificial.

Pesquisadores da Oregon State University e da Adobe estão desenvolvendo uma nova técnica de treinamento para reduzir o viés social nos sistemas de IA. Se essa técnica se mostrar confiável, ela poderá tornar a IA mais justa para todos.

Mas não vamos nos precipitar. Esta é apenas uma das muitas soluções necessárias para enfrentar os inúmeros desafios da IA que enfrentamos hoje. De problemas técnicos a dilemas éticos, o caminho para uma IA confiável é pavimentado com questões complexas.

Vamos analisar juntos esses desafios da IA e ver o que é necessário para superá-los.

10 desafios e soluções de IA

À medida que a tecnologia de IA avança, ela enfrenta uma série de questões. Esta lista explora dez desafios urgentes da IA e descreve soluções práticas para uma implantação responsável e eficiente da IA.

1. Viés algorítmico

O viés algorítmico refere-se à tendência dos sistemas de IA de apresentar resultados tendenciosos, muitas vezes devido à natureza de seus dados de treinamento ou design. Esses viéses podem se manifestar de várias formas, muitas vezes perpetuando e amplificando os viéses sociais existentes.

Soluções

- Dados diversificados e representativos: use conjuntos de dados de treinamento que reflitam verdadeiramente a diversidade de todos os grupos para evitar preconceitos relacionados a gênero, etnia ou idade

- Detecção e monitoramento de vieses: verifique regularmente se há vieses em seus sistemas de IA. Isso deve ser feito por meio de uma combinação de monitoramento automatizado e suas próprias revisões manuais para garantir que nada passe despercebido.

- Ajustes algorítmicos: Assuma um papel ativo no ajuste dos algoritmos de IA para combater o viés. Isso pode significar reequilibrar os pesos dos dados ou adicionar restrições de equidade aos seus modelos

- Diretrizes éticas de IA: ajude a moldar práticas éticas de IA adotando e implementando diretrizes que abordem a equidade e o preconceito, garantindo que esses princípios sejam incorporados em todas as etapas do seu projeto de IA

2. A falta de transparência da IA causa desconfiança

Transparência em IA significa ser aberto sobre como os sistemas de IA operam, incluindo seu design, os dados que usam e seus processos de tomada de decisão. A explicabilidade vai um passo além, garantindo que qualquer pessoa, independentemente de suas habilidades técnicas, possa entender quais decisões a IA está tomando e por quê. Esses conceitos ajudam a enfrentar os receios sobre a IA, como preconceitos, questões de privacidade ou mesmo riscos como usos militares autônomos.

Soluções

- Desenvolva uma documentação clara: forneça detalhes abrangentes sobre os modelos de IA, seu processo de desenvolvimento, entradas de dados e processos de tomada de decisão. Isso promove uma melhor compreensão e estabelece uma base para a confiança.

- Implementação de modelos de IA explicáveis: utilize modelos que ofereçam mais transparência, como árvores de decisão ou sistemas baseados em regras, para que os usuários vejam exatamente como as entradas são transformadas em saídas

- Use ferramentas de interpretabilidade: aplique ferramentas como LIME (Local Interpretable Model-agnostic Explanations) ou SHAP (SHapley Additive exPlanations) para detalhar as contribuições de vários recursos no processo de tomada de decisão do modelo

3. Dimensionar a IA é mais difícil do que parece

A expansão da tecnologia de IA é fundamental para organizações que desejam capitalizar seu potencial em várias unidades de negócios. No entanto, alcançar essa escalabilidade da infraestrutura de IA é uma tarefa complexa.

Apesar do potencial de alto retorno sobre o investimento, muitas empresas têm dificuldade em ir além dos projetos-piloto e avançar para a implantação em grande escala.

O fiasco da Zillow com a revenda de imóveis é um forte lembrete dos desafios de escalabilidade da IA. Sua IA, destinada a prever os preços das casas para obter lucro, apresentou taxas de erro de até 6,9%, levando a graves perdas financeiras e uma baixa contábil de US$ 304 milhões no estoque.

O desafio da escalabilidade é mais evidente fora das gigantes da tecnologia, como Google e Amazon, que possuem os recursos para aproveitar a IA de forma eficaz. Para a maioria das outras empresas, especialmente as não tecnológicas que estão apenas começando a explorar a IA, as barreiras incluem a falta de infraestrutura, poder de computação, expertise e implementação estratégica.

Soluções

- Infraestrutura aprimorada: desenvolva uma infraestrutura digital robusta, capaz de lidar com implantações de IA em grande escala. Por exemplo, serviços em nuvem e data centers localizados reduzem a latência e melhoram o desempenho

- Equipes interdisciplinares: promova um ambiente colaborativo onde as unidades de tecnologia e negócios trabalhem juntas para integrar soluções de IA de maneira perfeita aos modelos de negócios existentes

- Ferramentas automatizadas de desenvolvimento de IA: utilize plataformas como o evoML da TurinTech para automatizar o desenvolvimento de códigos de aprendizado de máquina, permitindo a criação e implantação mais rápidas de modelos

- Aprendizado e adaptação contínuos: implemente mecanismos para o aprendizado e a atualização contínuos de modelos de IA para se adaptar aos dados do mundo real e às condições de mercado em constante mudança, garantindo relevância e eficiência a longo prazo

- Invista no desenvolvimento de talentos: desenvolva conhecimentos internos sobre IA por meio de treinamentos e práticas de contratação com foco em tecnologias emergentes de IA, reduzindo a dependência excessiva de talentos externos nessa área.

Leia também: Estatísticas essenciais sobre IA que você precisa saber hoje

4. Deepfake e fraude com IA generativa

As tecnologias de IA generativa e deepfake estão transformando o cenário das fraudes, especialmente no setor de serviços financeiros. Elas tornam mais fácil e barato criar falsificações convincentes.

Por exemplo, em janeiro de 2024, um deepfake se passando por um diretor financeiro instruiu um funcionário a transferir US$ 25 milhões, demonstrando as graves implicações dessas tecnologias.

Essa tendência crescente destaca os desafios que os bancos enfrentam ao se esforçarem para adaptar seus sistemas de gerenciamento de dados e detecção de fraudes para combater golpes cada vez mais sofisticados que enganam não apenas indivíduos, mas também sistemas de segurança baseados em máquinas.

Soluções

- Tecnologias avançadas de detecção: os bancos devem investir em tecnologias mais recentes que possam detectar deepfakes e anomalias de IA generativa de forma mais eficaz

- Supervisão humana: integrar análises humanas qualificadas com respostas de IA aumenta as taxas de detecção e ajuda a verificar e compreender a identificação de fraudes impulsionada pela IA

- Esforços colaborativos de prevenção de fraudes: estabelecer parcerias dentro e entre setores pode ajudar a desenvolver mecanismos mais robustos para identificar e prevenir fraudes

5. Desafios de interoperabilidade e interação entre humanos e IA

Quando diferentes organizações ou países utilizam a IA em conjunto, devem garantir que ela se comporta de forma ética, de acordo com as regras de todos. Isso é chamado de interoperabilidade ética e é especialmente importante em áreas como defesa e segurança.

Atualmente, governos e organizações têm seus próprios conjuntos de regras e valores. Por exemplo, confira as Diretrizes para Interação Humano-IA da Microsoft:

No entanto, há uma falta de padronização nessa filosofia e nas regras em todo o mundo.

Atualmente, os sistemas de IA vêm com seu próprio conjunto de regras éticas, que podem ser adequadas em um lugar, mas problemáticas em outro. Quando esses sistemas interagem com humanos, se não se comportarem como esperado, isso pode levar a mal-entendidos ou desconfiança.

Soluções

- Defina padrões éticos universais: Chegue a um acordo sobre regras éticas básicas que todos os sistemas de IA devem seguir, independentemente de sua origem. Concentre-se na justiça, responsabilidade e transparência

- Use um sistema de certificação robusto: antes de qualquer sistema de IA ser usado, ele deve passar por um teste rigoroso para confirmar que atende a esses padrões éticos. Isso pode incluir verificações feitas pelos criadores e também por grupos independentes.

- Garanta que todos estejam informados: seja sempre claro sobre como a IA toma decisões e usa dados. Essa transparência ajuda a construir confiança e facilita a integração de diferentes sistemas de IA

- Fique atento: verifique regularmente os sistemas de IA para garantir que eles continuem atendendo aos padrões éticos. Atualize-os conforme necessário para acompanhar as novas regras ou tecnologias.

6. A ética da IA vai além das boas intenções

A Inteligência Artificial (IA) está entrando em quase todas as partes de nossas vidas — de carros autônomos a assistentes virtuais, e isso é brilhante! Mas aqui está o problema: a forma como usamos a IA às vezes pode causar sérios dilemas éticos. Existem questões éticas espinhosas em torno de privacidade, preconceito, deslocamento de empregos e muito mais.

Com a IA capaz de realizar tarefas que antes eram feitas por humanos, há todo um debate sobre se ela deveria mesmo realizar algumas delas.

Por exemplo, a IA deveria escrever roteiros de filmes? Parece legal, mas isso causou um grande alvoroço no mundo do entretenimento, com greves nos EUA e na Europa. E não se trata apenas de quais trabalhos a IA pode assumir, mas também de como ela usa nossos dados, toma decisões e, às vezes, até comete erros. Isso faz com que todos, desde desenvolvedores de tecnologia até especialistas em direito, se esforcem para descobrir como lidar com a IA de forma responsável.

Soluções

- Esclareça as regras: desenvolva diretrizes claras sobre como a IA deve ser usada. Isso significa estabelecer limites para evitar o uso indevido e compreender as implicações legais das ações da IA

- Respeite a privacidade: grandes quantidades de dados, incluindo informações pessoais, são usadas para treinar a IA. Precisamos ter muito cuidado com a forma como esses dados são coletados, usados e protegidos. Trata-se de garantir que a IA respeite nossa privacidade.

- Combata o preconceito: a IA é tão boa quanto os dados dos quais aprende e, às vezes, esses dados têm preconceitos. Devemos eliminar esses preconceitos dos sistemas de IA para garantir que sejam justos e não discriminem.

- Proteja a propriedade intelectual: a IA pode produzir trabalhos com base no que aprendeu com as obras criativas de outras pessoas. Isso pode infringir direitos autorais e privar os criadores do que lhes é devido, a menos que tomemos cuidado.

- Ética x velocidade: na corrida desenfreada para levar as tecnologias mais recentes de IA ao mercado, a ética pode ficar em segundo plano. Precisamos equilibrar a necessidade de velocidade com a necessidade de fazer as coisas da maneira certa.

7. Misturar conjuntos de dados de IA pode ser desastroso

Ao desenvolver modelos de aprendizado de máquina de IA, pode ser difícil distinguir corretamente entre conjuntos de dados de treinamento, validação e teste. O conjunto de dados de treinamento do modelo de IA ensina o modelo, o conjunto de dados de validação o ajusta e o conjunto de dados de teste avalia seu desempenho.

Esse erro pode prejudicar gravemente a capacidade do modelo de funcionar de forma eficaz em aplicações de IA do mundo real, onde a adaptabilidade e a precisão em dados padronizados são fundamentais.

Soluções

- Divisão estruturada de dados: adote uma abordagem sistemática para dividir os dados em conjuntos de treinamento, validação e teste

- Técnicas de validação cruzada: utilize métodos de validação cruzada, especialmente em cenários com dados limitados. Técnicas como a validação cruzada K-fold ajudam a maximizar o uso do treinamento e fornecem uma estimativa mais robusta do desempenho do modelo em dados não vistos

- Randomização de dados: garanta que a divisão dos dados seja aleatória para evitar que qualquer viés de IA seja introduzido pela ordem dos dados. Isso ajuda a criar conjuntos de treinamento e validação que sejam representativos do conjunto de dados geral

8. Riscos e preocupações com a tomada de decisões automatizada

Quando a IA toma decisões, as coisas podem ficar complicadas, especialmente em áreas críticas como saúde e bancos. Um grande problema é que nem sempre podemos ver como os sistemas de IA chegam às suas decisões.

Isso pode levar a decisões injustas que ninguém consegue explicar. Além disso, esses sistemas são alvos de hackers que, se conseguirem invadi-los, podem roubar muitos dados importantes.

Soluções

- Desenvolva protocolos de segurança robustos: garanta que os sistemas de IA estejam bem protegidos contra hackers. Continue atualizando a segurança para fechar quaisquer novas brechas que surgirem

- Aumente a transparência: use tecnologia que ajude a IA a explicar suas escolhas em termos simples. Se todos entenderem como as decisões são tomadas, confiarão mais na IA.

- Proteja informações privadas: proteja todos os dados pessoais que a IA lida. Siga leis como o GDPR para garantir que a privacidade de ninguém seja comprometida

- Promova a colaboração multidisciplinar: reúna especialistas de todas as áreas — tecnologia, direito, ética — para trabalharem juntos. Eles podem ajudar a garantir que as decisões da IA sejam justas e seguras

Leia também: As ferramentas de IA mais populares para estudantes

9. Falta de regras e regulamentações claras sobre IA

No momento, não existe um órgão regulador global para a IA; a regulamentação varia de acordo com o país e até mesmo com o setor. Por exemplo, não há nenhum órgão central específico para IA nos Estados Unidos.

Essa abordagem descentralizada pode levar a inconsistências e confusão; diferentes padrões podem ser aplicados dependendo de onde e como a IA é implantada. Isso torna difícil para os desenvolvedores e usuários de IA garantirem que estejam em total conformidade em todas as jurisdições.

Soluções

- Estabeleça um órgão regulador dedicado à IA: os países poderiam se beneficiar com a criação de uma agência específica focada em IA. Esse órgão poderia supervisionar todas as questões relacionadas à IA, acompanhando o rápido ritmo de desenvolvimento da IA e garantindo a conformidade com os padrões de segurança e ética

- Cooperação internacional: a IA não para nas fronteiras. Os países precisam trabalhar juntos para criar padrões e acordos internacionais sobre o uso da IA, semelhante ao funcionamento dos tratados globais para a proteção ambiental.

- Legislação clara e adaptável: as leis precisam ser claras (para que as empresas saibam como cumpri-las), mas também flexíveis o suficiente para se adaptarem aos novos avanços da IA. Atualizações e revisões regulares das leis de IA podem ajudar a mantê-las relevantes

- Envolvimento do público e das partes interessadas: as regulamentações devem ser desenvolvidas com a contribuição de uma ampla gama de partes interessadas, incluindo empresas de tecnologia, especialistas em ética e o público em geral. Isso pode ajudar a garantir que diversos pontos de vista sejam considerados e que o público confie mais nos sistemas de IA.

Leia também: Ferramentas de IA para advogados

10. Desinformação proveniente da IA

Imagine ter uma tecnologia capaz de pensar como um ser humano. Essa é a promessa da Inteligência Artificial Geral (AGI), mas ela traz grandes riscos. A desinformação é uma das principais questões aqui.

Com a AGI, é possível criar facilmente notícias falsas ou informações falsas convincentes, tornando mais difícil para todos descobrirem o que é verdade e o que não é.

Além disso, se a IGA tomar decisões com base nessas informações falsas, isso pode levar a resultados desastrosos, afetando tudo, desde a política até a vida pessoal.

Soluções

- Estabeleça verificações rigorosas: sempre verifique os fatos antes de permitir que a IGA divulgue informações. Use fontes confiáveis e confirme os detalhes antes de qualquer coisa ser divulgada publicamente

- Ensine ética à IGA: assim como ensinamos às crianças o que é certo e errado, precisamos ensinar à IGA o que é um comportamento ético. Isso inclui compreender o impacto da disseminação de informações falsas e tomar decisões justas e imparciais.

- Mantenha os humanos informados: não importa o quão inteligente a IGA se torne, mantenha os humanos envolvidos no processo de tomada de decisão. Isso ajuda a detectar erros e garante que as ações da IGA reflitam nossos valores e ética

- Crie regras claras: estabeleça diretrizes rígidas sobre o que a IGA pode e não pode fazer, especialmente quando se trata de criar e divulgar informações. Certifique-se de que essas regras sejam seguidas à risca

Leia também: O glossário completo de IA

Ferramentas para lidar com os desafios da IA

Quando você está mergulhado na IA, escolher as ferramentas certas não é apenas algo bom de se ter; é essencial para garantir que sua jornada na IA não se torne desastrosa. Trata-se de simplificar o complexo, proteger seus dados e obter o suporte necessário para resolver os desafios da IA sem gastar muito.

O segredo é escolher um software de IA personalizado que aumente a produtividade e, ao mesmo tempo, proteja sua privacidade e a segurança dos seus dados.

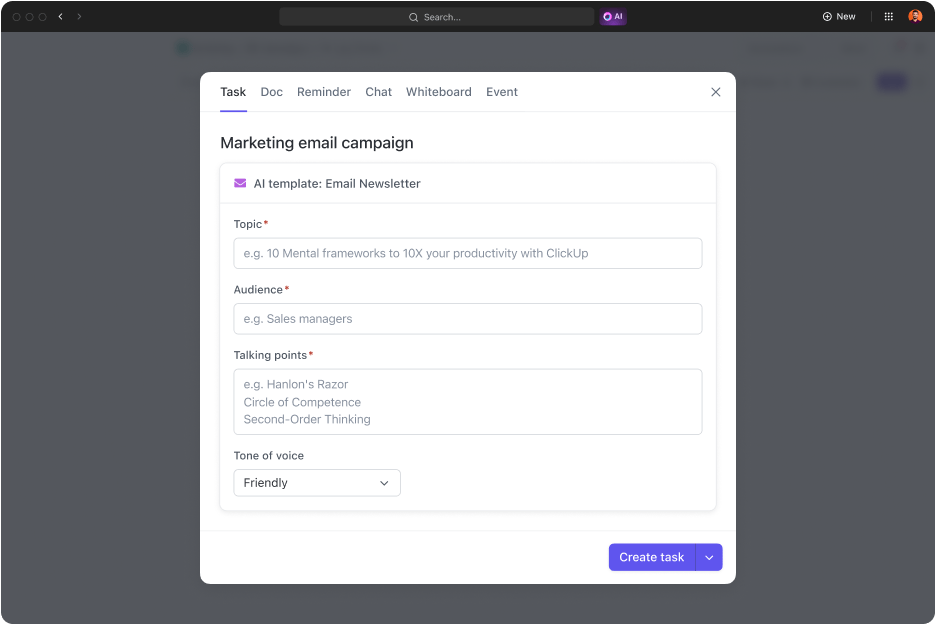

Conheça o ClickUp Brain, o canivete suíço para IA no seu local de trabalho.

ClickUp Brain: eficiência, segurança e inovação — tudo em um só lugar

O ClickUp Brain foi projetado para lidar com tudo relacionado à IA — desde o gerenciamento de seus projetos e documentos até o aprimoramento da comunicação da equipe. Com os recursos de IA do ClickUp Brain, você pode enfrentar desafios relacionados a dados, melhorar o gerenciamento de projetos e aumentar a produtividade, tudo isso mantendo as coisas simples e seguras. O ClickUp Brain é uma solução abrangente que:

- Integra-se perfeitamente ao seu trabalho diário

- Garanta que seus dados continuem sendo seus

- Economize seu dinheiro e recursos

O ClickUp Brain se integra de forma inteligente ao seu fluxo de trabalho para economizar tempo e esforço, ao mesmo tempo em que protege seus dados. Ele é (assim como o restante da plataforma ClickUp) compatível com o GDPR e não usa seus dados para treinamento.

Veja como funciona:

- Gerenciador de conhecimento de IA: já desejou obter respostas instantâneas e precisas a partir de seus documentos de trabalho ou bate-papos? O ClickUp Brain torna isso possível. Chega de vasculhar arquivos por horas. Basta perguntar e você receberá — sejam detalhes de um documento de projeto ou insights de atualizações anteriores da equipe.

- Gerente de projetos de IA: imagine ter um assistente de IA que mantém seus projetos em dia. Desde automatizar atualizações de tarefas até resumir o andamento do projeto, o ClickUp Brain cuida das partes tediosas para que você possa se concentrar no panorama geral

- AI Writer for Work: esta ferramenta é uma revolução para quem tem medo de escrever. Seja para redigir um e-mail rápido ou elaborar um relatório abrangente, o ClickUp Brain ajuda a refinar sua prosa, verificar a ortografia e ajustar o tom à perfeição

Enfrentando os desafios da IA com as ferramentas certas

Apesar dos desafios da IA que discutimos, podemos concordar que a inteligência artificial já percorreu um longo caminho. Ela evoluiu da automação básica para sistemas sofisticados que podem aprender, se adaptar e prever resultados. Muitos de nós já integramos a IA em vários aspectos de nossas vidas, desde assistentes virtuais até ferramentas avançadas de coleta e análise de dados.

À medida que a IA avança, podemos esperar ainda mais inovações, hacks e ferramentas de IA para aumentar a produtividade, melhorar a tomada de decisões e revolucionar os setores. Esse progresso abre novas possibilidades, levando-nos a um futuro em que a IA desempenha um papel crucial nas esferas pessoal e profissional.

Com ferramentas de IA como o ClickUp Brain, você pode aproveitar ao máximo as tecnologias de IA e, ao mesmo tempo, proteger-se contra os desafios da IA em relação à privacidade e à segurança dos dados. O ClickUp é sua ferramenta de gerenciamento de tarefas com tecnologia de IA para tudo, desde projetos de software até marketing. Escolha o ClickUp para transformar com segurança sua organização em uma entidade alimentada por dados e IA, enquanto aumenta a produtividade da equipe.

Pronto para transformar seus fluxos de trabalho com IA? Inscreva-se agora no ClickUp!