AI rozwija się szybciej niż zabezpieczenia, które ją otaczają.

Badanie IBM „AI at the Core” wykazało, że prawie 74% ankietowanych organizacji zgłasza jedynie umiarkowany lub ograniczony zakres swoich ram zarządzania ryzykiem i AI w odniesieniu do ryzyka technologicznego, ryzyka związanego z podmiotami zewnętrznymi oraz ryzyka modelowego.

Innymi słowy, wiele zespołów dostarcza modele, ale znacznie mniej jest w stanie z całą pewnością odpowiedzieć na pytania, które pojawiają się zaraz potem:

🤔 Kto to zatwierdził, na jakiej podstawie, na podstawie jakich dowodów i co się stanie, gdy model ulegnie zmianie podczas produkcji?

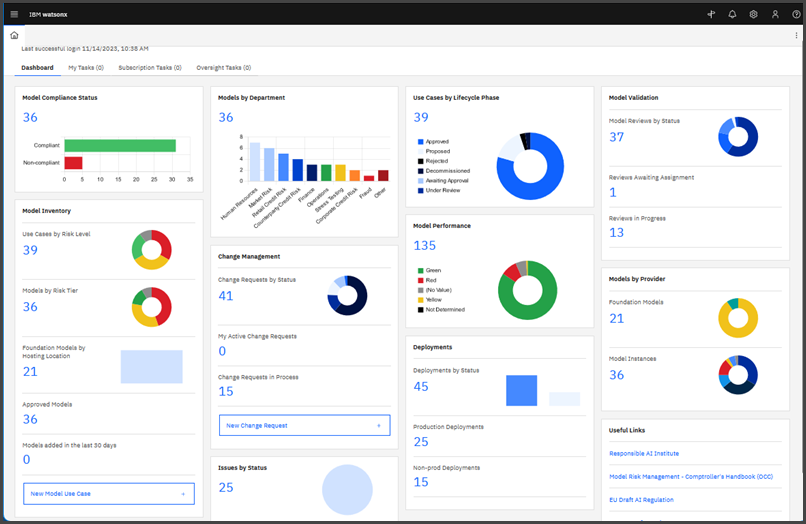

Właśnie na to odpowiada IBM Watsonx Governance. Pomaga zarządzać, zabezpieczać i monitorować AI w całym cyklu życia, dzięki cyklom pracy, monitorowaniu i zarządzaniu ryzykiem zaprojektowanym w celu zapewnienia wsparcia dla odpowiedzialnej skalowalności.

W tym przewodniku omówimy, jak korzystać z watsonx. governance do dokumentowania przypadków użycia, standaryzacji przeglądów i zatwierdzeń, rejestrowania właściwych faktów dotyczących modeli oraz monitorowania modeli w produkcji w miarę skalowania.

Czym jest IBM watsonx. governance?

IBM Watsonx Governance to platforma do zarządzania sztuczną inteligencją klasy korporacyjnej opracowana przez IBM w ramach platformy Watsonx AI and Data Platform. Pomaga ona organizacjom w odpowiedzialnym kierowaniu, zarządzaniu, monitorowaniu i skalowaniu działań związanych ze sztuczną inteligencją w całym cyklu życia AI.

Służy jako ujednolicone rozwiązanie do zarządzania zarówno tradycyjnymi modelami uczenia maszynowego (ML), jak i nowoczesnymi modelami generatywnej AI (gen AI), w tym dużymi modelami językowymi i aplikacjami, niezależnie od tego, czy są one zbudowane na IBM watsonx. ai, czy wdrożone na platformach z wsparciem innych firm.

📚 Więcej informacji: Najlepsze narzędzia AI do zarządzania zapewniające zgodność z przepisami i przejrzystość

Jak działa IBM Watsonx Governance

Watsonx Governance to zintegrowany zestaw funkcji, który według IBM łączy w sobie:

OpenPages do zarządzania ryzykiem i zgodnością

OpenPages to komponent w ramach watsonx. governance, który pełni rolę centralnego silnika ryzyka i zgodności. Został zaprojektowany w celu przekształcenia polityk firmy w konkretne, możliwe do śledzenia wskaźniki dla każdego modelu AI.

Daje Ci to narzędzia do przeprowadzania formalnych ocen ryzyka, mapowania modeli do konkretnych przepisów i tworzenia niezmiennych ścieżek audytu dla organów regulacyjnych.

- Ocena ryzyka: Możesz przypisywać i śledzić poziom ryzyka dla każdego przypadku użycia AI w oparciu o czynniki takie jak wrażliwość wykorzystywanych danych lub wpływ podejmowanych decyzji.

- Mapowanie zgodności: umożliwia mapowanie modeli do ram regulacyjnych, takich jak unijna ustawa o AI lub ramy zarządzania ryzykiem AI NIST, oraz śledzenie dowodów zgodności i statusu w ramach przeglądów.

- Ścieżki audytu: OpenPages przechowuje stały rejestr tego, kto i kiedy zatwierdził dane elementy, co ma zasadnicze znaczenie dla udowodnienia zgodności podczas audytu.

OpenScale do monitorowania modeli

OpenScale to silnik monitorowania w czasie rzeczywistym, który czuwa nad modelami po ich uruchomieniu. Jest to system wczesnego ostrzeżenia o problemach, które pojawiają się, gdy model wchodzi w interakcję z nieuporządkowanymi, nieprzewidywalnymi danymi ze świata rzeczywistego.

- Wykrywanie odchyleń: identyfikuje moment, w którym dane wejściowe lub wyjściowe modelu zaczynają różnić się od danych, na których został on wytrenowany, co może oznaczać spadek jego wydajności.

- Monitorowanie sprawiedliwości: przeprowadza śledzenie prognoz w grupach wrażliwych (takich jak wiek lub płeć), aby wychwycić pojawiające się tendencje w AI, zanim staną się one problemami systemowymi.

- Wyjaśnialność: może generować zrozumiałe dla człowieka wyjaśnienia dotyczące zachowania modelu i prognoz, w zależności od typu i konfiguracji modelu, co ma kluczowe znaczenie dla audytów i zapytań klientów.

- Wskaźniki wydajności: monitoruje podstawowe wskaźniki wydajności, takie jak dokładność i czas reakcji, zapewniając, że model nadal spełnia wymagania biznesowe.

Arkusze informacyjne dotyczące AI do śledzenia cyklu życia

Arkusze informacyjne dotyczące AI są częścią zarządzania cyklem życia dokumentów dla każdego modelu. Arkusze informacyjne automatycznie śledzą kluczowe szczegóły na każdym etapie cyklu życia AI, w tym:

- Metadane dotyczące rozwoju, takie jak źródła danych szkoleniowych i wybory algorytmów

- Wyniki oceny, takie jak wskaźniki testowe i oceny stronniczości

- Szczegóły wdrożenia, w tym miejsce działania modelu i osoby mające do niego dostęp.

- Historia operacyjna, taka jak trendy wydajności i przeszłe incydenty

🔍 ClickUp Brain MAX: Szybsze testowanie wielu modeli przed wprowadzeniem bramek zarządzania

Zanim model, podpowiedź lub agent trafi do IBM Watsonx Governance, zespoły zazwyczaj potrzebują miejsca, w którym mogą bez przeszkód myśleć, testować i porównywać.

Właśnie w tym zakresie ClickUp Brain MAX wyróżnia się na tle innych rozwiązań.

Brain MAX to samodzielna aplikacja AI na komputery stacjonarne, która umożliwia zespołom przełączanie się między wieloma wiodącymi modelami (np. GPT, Claude, Gemini) w tym samym kontekście obszaru roboczego. Możesz uruchamiać ten sam monit, logikę decyzyjną lub projekt wyniku w różnych modelach jednocześnie, natychmiast porównywać odpowiedzi i zachowywać pełną ścieżkę rozumowania wraz z samą pracą.

Dzięki temu Brain MAX jest szczególnie skuteczny w następujących obszarach:

- Wczesna faza modelu i szybkie porównanie przed formalną oceną

- Testy warunków skrajnych pod kątem tonu, jakości rozumowania lub przypadków skrajnych w różnych modelach

- Rejestrowanie i zapisywanie „dlaczego wybraliśmy to podejście” bezpośrednio obok zadań i dokumentów

Gdy zespoły uzgodnią właściwe zachowanie, podpowiedź lub wybór modelu, watsonx. governance staje się systemem rejestrującym. Arkusze informacyjne, zatwierdzenia i monitorowanie odzwierciedlają wówczas decyzje, które zostały już przetestowane pod kątem odporności, udokumentowane i uzgodnione.

👉 W praktyce Brain MAX przyspiesza uczenie się i iterację, a watsonx. governance zapewnia kontrolę i odpowiedzialność. Razem zapobiegają one spowolnieniu innowacji przez zarządzanie lub ominięciu zarządzania przez innowacje.

Jak skonfigurować watsonx. governance dla swojego zespołu Teams

Teraz skonfigurujmy krok po kroku rozwiązanie Watsonx Governance dla Twojego zespołu 👇.

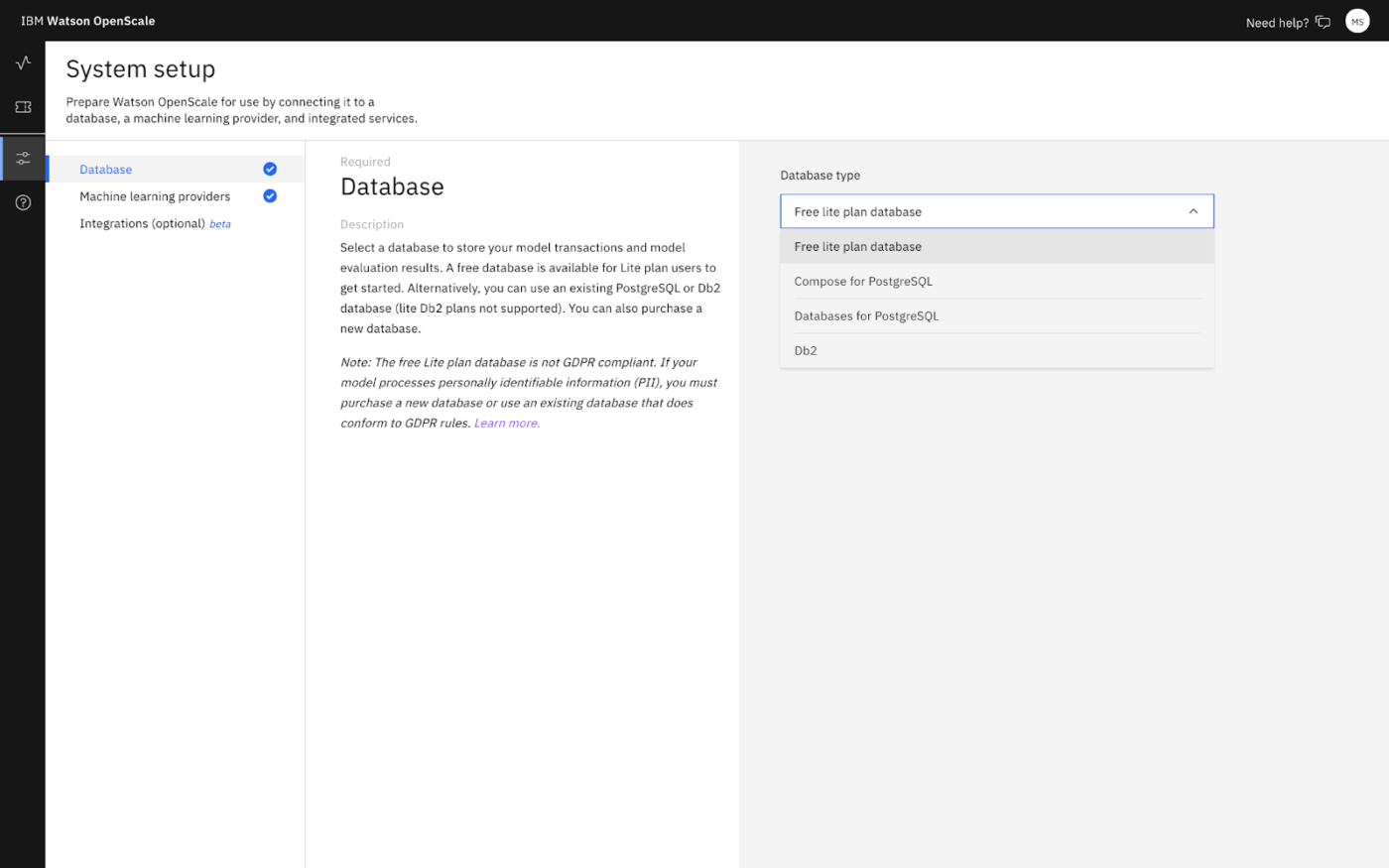

1. Stwórz połączenie z bazą danych (magazyn danych)

Otwórz URL watsonx. governance dla swojego regionu, a następnie przejdź do Configure → Database i wybierz typ bazy danych (Lite lub własną bazę DB2/PostgreSQL).

2. Skonfiguruj przypadki użycia AI

- Przejdź do Przykłady zastosowań AI → Zakończ ustawienia

- Spowoduje to utworzenie ID usługi: watsonx. governance_DO_NOT_DELETE

- Jeśli nie masz domyślnego wykazu, zostaniesz poproszony o utworzenie takiego wykazu, który jest wymagany do zarządzania modelami zewnętrznymi, załącznikami i raportami dotyczącymi raportowania.

3. Utwórz zasady dostępu (zaproś swój zespół)

W IBM Cloud, Zarządzaj → Dostęp (IAM) → Użytkownicy → Zaproś użytkownika → przypisz zasady dostępu dla usługi watsonx. zarządzanie i określ jego zakres (konto/grupa zasobów/określona instancja)

📌 Użytkownicy potrzebują Reader/Writer+ aby uzyskać dostęp do usługi. Writer+ umożliwia przeglądanie informacji dotyczących wszystkich projektów i przestrzeni wdrożeniowych.

4. Zarządzaj użytkownikami i rolami w watsonx. governance

Przypisuj role współpracy dla działań związanych z oceną (administrator/redaktor/widz/operator) w oparciu o zadania, które każda osoba powinna wykonywać.

👀 Czy wiesz, że... Jedno nowoczesne naruszenie bezpieczeństwa może mieć rozmiar stadionu! Naruszenie bezpieczeństwa firmy Under Armour dodane w styczniu 2026 r. zawiera listę 72,7 mln kont.

Jak zarządzać cyklem życia AI za pomocą ClickUp

IBM Watsonx Governance służy jako system zarządzania AI, w którym modele, podpowiedzi, oceny i zatwierdzenia są formalnie śledzone w sposób uporządkowany i identyfikowalny.

Jednak zarządzanie nadal musi obejmować wszystkie działy. Ktoś musi uchwycić początkowy kontekst, prowadzić śledzenie decyzji, dbać o spójność dowodów i kontynuować pracę, nie zamieniając tego procesu w labirynt przekazywania zadań. Ogromna ilość pracy w akcji!

Wprowadź ClickUp. Jako pierwsze na świecie zintegrowany obszar roboczy AI, łączy ono warstwę operacyjną — dokumenty, zadania, czat, cykle pracy, wiedzę, AI i widoczność kierownictwa — dzięki czemu Twoje zespoły mogą płynnie realizować cykl zarządzania.

Zobaczmy, jak to zrobić. 👇

Twórz i dokumentuj przypadki użycia AI.

Przykłady zastosowań można łatwo udokumentować. Trudniejsze jest utrzymanie spójności tej dokumentacji, gdy pomysł jest poddawany testom przez zespoły ds. ryzyka, prawne, bezpieczeństwa i dostaw.

Napraw to za pomocą ClickUp Docs. Na przykład użyj szablonu ClickUp Doc dla każdego nowego przypadku użycia AI, aby każdy projekt rozpoczynał się od znormalizowanych danych wejściowych:

- Cel

- Interesariusze

- Kontekst danych

- Oczekiwane wyniki

- Ograniczenia

- Kryteria powodzenia

Ponadto zachowaj dyskusje dotyczące przypadków użycia i decyzje w dokumencie, korzystając z funkcji @wzmianek i przypisanych komentarzy ClickUp. W miarę postępów przeglądu zamień kolejne kroki na zadania ClickUp bezpośrednio z dokumentu.

Jeśli pasuje do Twojego cyklu pracy, dodaj ClickUp Brain, aby przyspieszyć te części, które zazwyczaj powodują opóźnienia. Wykorzystaj to narzędzie, aby dopracować streszczenie, zidentyfikować założenia wymagające weryfikacji lub sporządzić wstępną wersję wytycznych dotyczących zarządzania (np. punkty kontrolne dotyczące sprawiedliwości lub prywatności) w oparciu o to, co już napisał Twój zespół.

Po zrobieniu przypadku użycia sformalizuj go w IBM Watsonx Governance, aby stał się on podstawą do śledzenia cyklu życia i dokumentacji faktów.

W watsonx. governance utwórz przypadek użycia AI w wykazie:

- Przejdź do Katalogi → Przypadki użycia AI

- Kliknij Nowy przypadek użycia AI

- Wprowadź nazwę i wybierz zasoby.

- Wypełnij potrzebne pola, takie jak: Opis (problem biznesowy + kontekst) Poziom ryzyka Dane pomocnicze Właściciel Status Etykiety

- Opis (problem biznesowy + kontekst)

- Poziom ryzyka

- Dane w wsparciu

- Właściciel

- Status

- Etykiety

- Opis (problem biznesowy + kontekst)

- Poziom ryzyka

- Dane w wsparciu

- Właściciel

- Status

- Etykiety

W tym momencie przypadek użycia staje się miejscem, w którym można mieć widok na śledzenie cyklu życia (Przegląd/Cykl życia/Dostęp) i przeprowadzać połączenia między zarządzanymi zasobami a ich arkuszami informacyjnymi.

Arkusze informacyjne pomagają następnie rejestrować metadane dotyczące zarządzania i zgodności w całym cyklu życia, w tym cel/krytyczność i pochodzenie działań podjętych podczas opracowywania i wdrażania.

📮 ClickUp Insight: 53% organizacji nie ma żadnych zasad zarządzania sztuczną inteligencją lub posiada jedynie nieformalne wytyczne. A kiedy ludzie nie wiedzą, gdzie trafiają ich dane — lub czy dane narzędzie AI może stwarzać ryzyko niezgodności z przepisami — wahają się. Jeśli narzędzie AI znajduje się poza zaufanymi systemami lub ma niejasne praktyki dotyczące danych, obawa „A co, jeśli nie jest to bezpieczne?” wystarczy, aby powstrzymać jego wdrożenie.

Nie dotyczy to w pełni zarządzanego, bezpiecznego środowiska ClickUp. ClickUp AI jest zgodny z przepisami RODO, HIPAA i SOC 2 oraz posiada certyfikat ISO 42001, co gwarantuje prywatność, ochronę i odpowiedzialne zarządzanie danymi.

Zewnętrzni dostawcy sztucznej inteligencji nie mogą szkolić się ani przechowywać żadnych danych klientów ClickUp, a obsługa wielu modeli działa w oparciu o ujednolicone uprawnienia, kontrolę prywatności i surowe standardy bezpieczeństwa. W tym przypadku zarządzanie sztuczną inteligencją staje się częścią samego obszaru roboczego, dzięki czemu zespoły mogą korzystać ze sztucznej inteligencji bez obaw i dodatkowego ryzyka.

Oceniaj modele AI i podpowiedzi

Ocena modelu jest krytycznym, ale złożonym etapem, obejmującym wiele zmiennych elementów. Należy przeprowadzić testy wydajności, sprawdzić tendencyjność i przetestować tryby awarii, jednocześnie informując o tym wszystkich zainteresowanych.

Aby tworzyć powtarzalne cykle pracy, użyj szablonu ClickUp DMAIC.

Twórz procesy oceny z wykorzystaniem statusów niestandardowych opartych na etapach, korzystając z szablonu ClickUp DMAIC.

W tym szablonie możesz tworzyć potoki oceny za pomocą niestandardowych statusów ClickUp. Oznacza to, że statusy mogą odzwierciedlać etapy oceny, takie jak Oczekująca ocena, Testowanie stronniczości, Ocena wydajności i Gotowe do zatwierdzenia.

Możesz również wyeliminować ręczne przekazywanie zadań dzięki automatyzacji ClickUp. Na przykład, gdy zadanie przechodzi do etapu Testowania stronniczości, ustawiona automatyzacja może przypisać pracę do osoby odpowiedzialnej za zgodność i dodać komentarz z listą kontrolną testów oraz linkami.

Po ustaleniu cyklu pracy możesz przeprowadzić ocenę techniczną w watsonx:

- W przypadku szablonów podpowiedzi i genAI: przeprowadzaj oceny podpowiedzi z zasobów szablonów podpowiedzi, przeglądaj wyniki metryczne i korzystaj z podsumowania oceny, aby wykrywać przekroczenia progów.

- W przypadku modeli zewnętrznych lub niehostowanych przez IBM: Możesz oceniać „odłączone” szablony podpowiedzi w ramach wsparcia dla obsługiwanych typów zadań, takich jak streszczanie, klasyfikacja, odpowiadanie na pytania, ekstrakcja encji, generowanie zawartości i RAG, przy czym wskaźniki różnią się w zależności od modelu i zadania.

Zatwierdzaj i wdrażaj modele AI

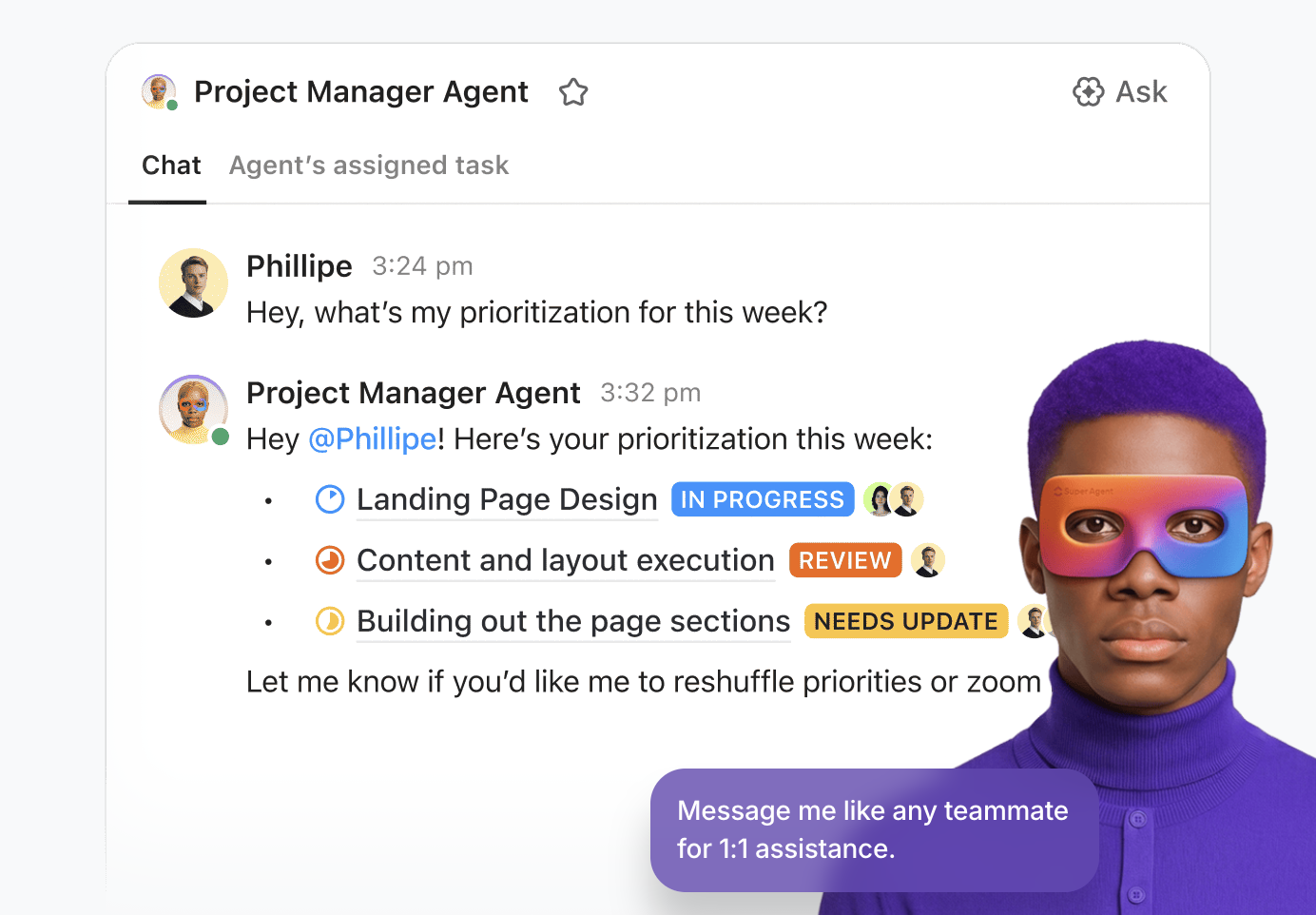

Skorzystaj z ClickUp Super Agents, aby przeprowadzić proces zatwierdzania od początku do końca.

Są to współpracownicy oparci na sztucznej inteligencji, którzy działają w pełnym kontekście obszaru roboczego i mogą bezpiecznie wykonywać wieloetapowe cykle pracy. Co więcej, można skonfigurować ich zachowanie za pomocą instrukcji, wyzwalaczy, narzędzi i wiedzy, aby zapewnić ich działanie w ramach określonych ograniczeń.

Na przykład, po zakończeniu oceny Super Agent może skompilować w jednym miejscu wszystko, czego potrzebują recenzenci (np. aktualny kontekst przypadku użycia, notatki dotyczące decyzji i linki do połączonych dowodów).

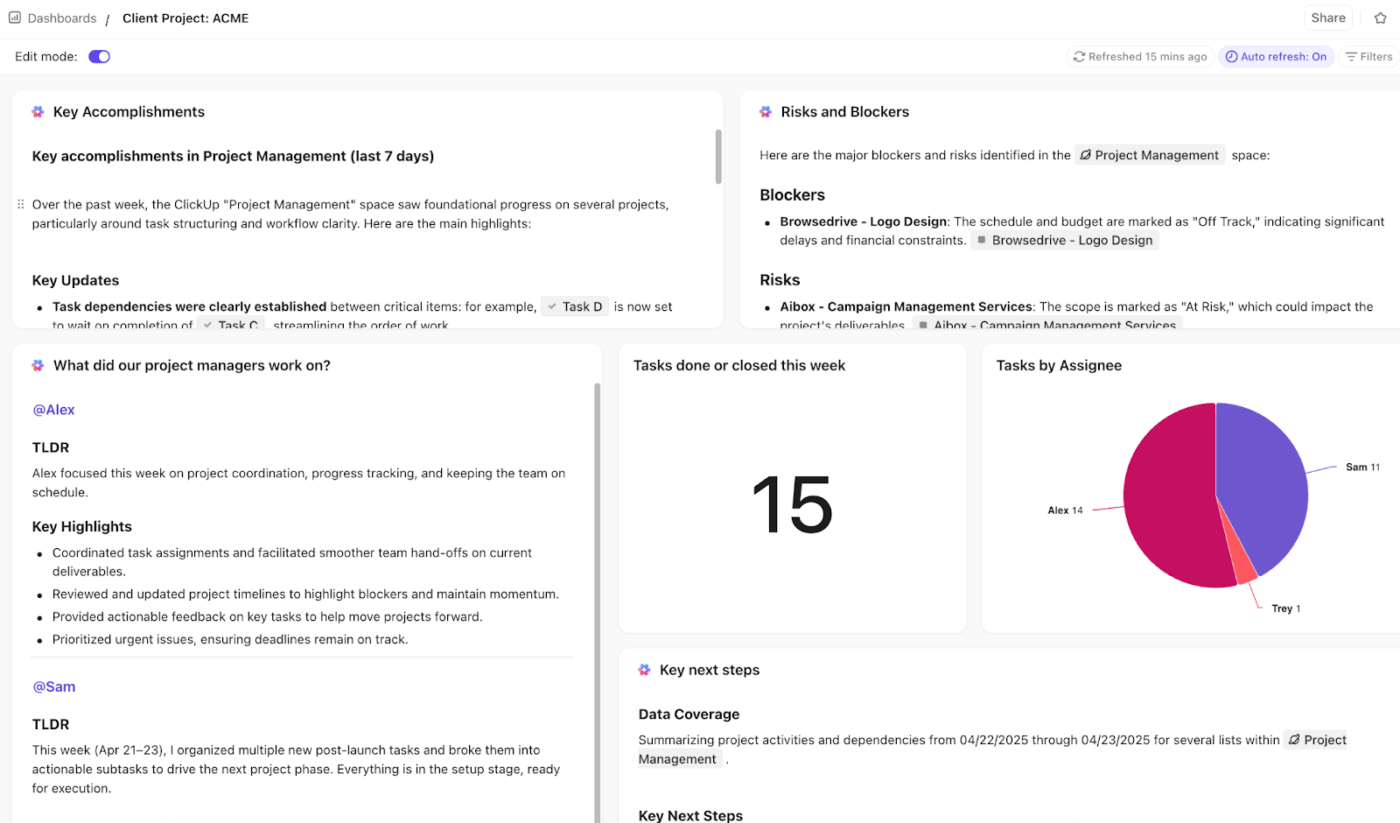

Idąc dalej, pulpity nawigacyjne ClickUp mogą przekształcić dane dotyczące zadań w obszarze roboczym w widok ogólny postępów, dzięki czemu kierownictwo może zobaczyć, ile modeli oczekuje na przegląd, który etap jest opóźniony i co się starzeje.

Stwórz własny pulpit zarządzania projektami w ClickUp ⬇️

Następnie możesz powiązać cykl pracy operacyjnej z watsonx:

- W ramach watsonx. governance firma IBM zapewnia cykl pracy Model Lifecycle, który przeprowadza model sztucznej inteligencji przez wiele etapów i interesariuszy aż do zatwierdzenia do wdrożenia. Ma to na celu zapewnienie, że zarządzany system rejestracji odzwierciedla te same bramki, które Twój zespół stosuje operacyjnie w ClickUp.

- Po zatwierdzeniu następuje monitorowanie. Watson OpenScale można skonfigurować z monitorami, które oceniają wdrożone zasoby pod kątem określonych przez Ciebie progów (na przykład progów sprawiedliwości lub dokładności/odchylenia).

🚀 Zaleta ClickUp: Utwórz pulpit kierowniczy i dodaj karty ClickUp AI, które podsumowują, co blokuje zatwierdzenia (np. „Co czeka na zatwierdzenie przez dział prawny?” lub „Które modele są najdłużej w trakcie przeglądu?”).

Ograniczenia korzystania z Watsonx do zarządzania AI i skalowania

Żadne narzędzie nie jest panaceum, dlatego przed podjęciem decyzji o komitecie należy zapoznać się z limitami platformy.

Oto kilka kwestii, które należy wziąć pod uwagę w przypadku watsonx. governance 👀

| Limity | Wpływ |

| Ekosystem IBM | Chociaż oferuje wsparcie dla modeli innych firm, najgłębsza integracja dotyczy narzędzi własnych IBM. Zespoły, które zainwestowały znaczne środki w inne platformy chmurowe, mogą napotkać trudności. |

| Złożoność dla mniejszych zespołów | Platforma została stworzona z myślą o operacjach na skalę Enterprise. Mniejsze zespoły mogą uznać, że koszty i złożoność są większe niż potrzebują. |

| Krzywa uczenia się OpenPages | Moduł zarządzania ryzykiem został pierwotnie zaprojektowany dla sektora finansowego, więc jego koncepcje i interfejs mogą nie być intuicyjne dla zespołów zajmujących się AI. |

| Ograniczenia dotyczące dostosowywania niestandardowego | Gotowe szablony zgodności są doskonałym punktem wyjścia, ale mogą nie odpowiadać w pełni specyficznym lub niszowym wymaganiom regulacyjnym Twojej firmy. |

| Zarządzanie generatywną AI wciąż się rozwija | Narzędzia do zarządzania dużymi modelami językowymi (LLM) szybko ewoluują w całej branży, a możliwości zarządzania nadal dojrzewają wraz z pojawiającymi się najlepszymi praktykami. |

Inne alternatywne narzędzia do wykorzystania

Jeśli IBM Watsonx Governance nie wydaje się odpowiednim rozwiązaniem, masz kilka alternatyw, w zależności od tego, czy potrzebujesz natywnego dla chmury stosu zarządzania, czy niezależnej od chmury warstwy monitorowania.

- Amazon SageMaker Model Monitor + Amazon SageMaker Model Cards: Doskonała opcja, jeśli już zainwestowałeś w AWS. Model Monitor koncentruje się na monitorowaniu produkcji (np. wykrywaniu problemów jakościowych, takich jak odchylenia/anomalia i powiadamianiu o nich), natomiast Model Cards pomaga dokumentować szczegóły modelu do celów audytów i raportowania zarządzania w standardowy sposób.

- Azure Machine Learning Responsible AI: Najlepsze rozwiązanie, gdy cykle pracy są już w Azure i potrzebujesz wbudowanego sposobu oceny modeli pod kątem sprawiedliwości, analizy błędów i wyjaśnialności (oraz analizy „co jeśli”/kontrfaktycznej) w jednym interfejsie.

- Monitorowanie modeli Google Vertex AI: odpowiednik Google Cloud dla zespołów wdrażających rozwiązania na platformie GCP. Koncentruje się na wykonywaniu zadań monitorowania zgodnie z harmonogramem lub na żądanie, śledzeniu sygnałów dotyczących jakości modeli/danych (takich jak dryf/skrzywienie cech) oraz ostrzeganiu w przypadku przekroczenia progów.

- Fiddler AI + Arthur AI: Dobry wybór, gdy potrzebujesz niezależnej od dostawcy warstwy obserwowalności dla wszystkich modeli — często wybierany ze względu na większą wyjaśnialność, szybszą analizę przyczyn źródłowych i spójność monitorowania w różnych Teams i środowiskach.

- MLflow: Najlepsze rozwiązanie dla zespołów, które chcą elastyczności open source. MLflow zapewnia solidną podstawę (śledzenie + rejestr modeli z metadanymi/etykietami i etapami cyklu życia), ale zazwyczaj potrzebny jest wysiłek inżynieryjny, aby dodać egzekwowanie zasad, przeglądy/zatwierdzanie i cykle pracy związane z zarządzaniem w sposób odpowiadający Twojej organizacji.

Wprowadź konkretne zasady zarządzania AI dzięki ClickUp

Platforma taka jak IBM Watsonx Governance może zapewnić podstawy techniczne do kontroli ryzyka i zgodności z przepisami, ale zarządzanie działa tylko wtedy, gdy Teams za nią stojące są zgrane i odpowiedzialne.

ClickUp łączy tę warstwę wykonawczą. Dokumenty standaryzują zasady i rekordy modeli. Pulpity nawigacyjne zapewniają widoczność przeglądów i wąskich gardła. Agenci AI dbają o ciągłość zatwierdzania i przekazywania zadań, dzięki czemu zarządzanie pozostaje operacyjne, a nie teoretyczne.

Co najważniejsze, dzięki temu zarządzanie sztuczną inteligencją przestaje być okresowym przeglądem, a staje się żywym systemem. Systemem, w którym decyzje są dokumentowane, działania są śledzone, a odpowiedzialność jasno określona na każdym etapie cyklu życia.

Rozpocznij bezpłatnie z ClickUp i zarządzaj procesem od początku do końca w przejrzysty sposób. ✅

Często zadawane pytania

Ogólne zarządzanie AI odnosi się do szeroko pojętych zasad i polityk przyjętych przez organizację, natomiast watsonx. governance to konkretna platforma oprogramowania, która pomaga wdrażać i przeprowadzać automatyzację tych praktyk.

Tak, platforma może monitorować i zarządzać modelami wdrożonymi w innych chmurach, takich jak AWS SageMaker i Azure ML, chociaż integracja może wymagać więcej ręcznej konfiguracji niż w przypadku modeli natywnych IBM.

Skuteczne zarządzanie to praca zespołowa, w którą zazwyczaj zaangażowani są naukowcy zajmujący się danymi, inżynierowie ML, specjaliści ds. zgodności, menedżerowie ds. ryzyka, interesariusze biznesowi i specjaliści ds. bezpieczeństwa IT, aby objąć cały cykl życia.