Sowohl Claude als auch ChatGPT sind leistungsstarke KI-Assistenten für die Arbeit, aber sie sind nicht identisch.

Claude, entwickelt von Anthropic, ist ein großes Sprachmodell (LLM), das oft für seine nuancierten, sicherheitsbewussten Antworten gelobt wird. ChatGPT von OpenAI ist ein weiteres LLM, das für seine breite Funktionalität und sein umfangreiches Ökosystem an Integrationen bekannt ist.

Der schnellste Weg, um herauszufinden, welche KI für Ihr Team tatsächlich geeignet ist: Schauen Sie sich an, was unter realer Workload zuerst zusammenbricht.

Dieser Leitfaden führt Sie durch die spezifischen Einschränkungen, die Claude und ChatGPT im täglichen Gebrauch behindern – Kontext-Limite, Nutzungs-Limite, Genauigkeitslücken und Integrationsprobleme – Herausforderungen, die heute wichtiger denn je sind.

Was sind Claude und ChatGPT?

Claude und ChatGPT scheinen in ihrer Absicht ähnlich zu sein. Beide KI-Tools wurden entwickelt, um Menschen dabei zu helfen, Informationen mithilfe natürlicher Sprache zu generieren, zu analysieren und zu bearbeiten.

Anstatt durch Menüs zu navigieren oder Code zu schreiben, interagieren Sie mit diesen generativen KI-Tools, indem Sie Eingabeaufforderungen oder Fragen eingeben, und die KI erzeugt Antworten auf der Grundlage von Mustern, die sie während des Trainings gelernt hat.

Obwohl sich ihre Fähigkeiten oft überschneiden, wurden die beiden tools mit leicht unterschiedlichen Prioritäten entwickelt.

Claude wurde von Anthropic entwickelt und legt den Schwerpunkt auf sorgfältige Argumentation und sicherere Ergebnisse. Es wird häufig für Aufgaben wie Dokumentenanalyse, Langformtexte und differenzierte Erklärungen bevorzugt, bei denen Tonfall und Klarheit eine wichtige Rolle spielen.

ChatGPT, entwickelt von OpenAI, konzentriert sich auf umfassende Funktionalität und ein schnell wachsendes Ökosystem. Über die Unterstützung beim Schreiben und beim Codeenvelopen hinaus bietet es Integrationen, Plugins und anpassbare GPTs, mit denen Teams das Tool an ihre Workflows anpassen können.

Für viele Teams können beide Tools ähnliche alltägliche Aufgaben bewältigen, wie zum Beispiel:

- Entwerfen und Bearbeitung von schriftlichen Inhalten

- Zusammenfassung langer Dokumente

- Ideenfindung

- Code schreiben oder überprüfen

- Beantwortung von Forschungsfragen

Die tatsächlichen Unterschiede zeigen sich oft erst, wenn Sie diese Tools über einfache Eingabeaufforderungen hinaus nutzen. Dinge wie die Analyse langer Dokumente, schnelle Iterationen, Workflow-Integrationen und Zuverlässigkeit bei intensiver Nutzung zeigen, wo jeder KI-Assistent gute Leistungen erbringt und wo Limite auftreten.

Das Verständnis dieser praktischen Einschränkungen hilft Teams dabei, zu entscheiden, welches tool tatsächlich zu ihrem Workflow passt.

📦 Wo KI echten Wert schafft: ClickUp Super Agents

Wann wird KI wirklich nützlich? Nur dann, wenn sie über das Generieren von Antworten hinausgeht und beginnt, in Ihrem Namen Maßnahmen zu ergreifen.

Das ist die Idee hinter Super Agents in ClickUp.

Anstatt sich auf Vorschläge zu beschränken, können Super Agents abgewogene, überwachte Aktionen in Ihrem Workspace ausführen. Sie arbeiten innerhalb Ihrer Projekte, verstehen den Kontext Ihrer Aufgaben und Dokumente und helfen dabei, die Arbeit automatisch voranzubringen, während die Menschen weiterhin auf dem Laufenden bleiben.

Ein Super Agent kann beispielsweise:

- Verwandeln Sie Notizen von Meetings in Aufgaben und weisen Sie nächste Schritte zu.

- Überwachen Sie Projekte und fassen Sie den Status für Stakeholder zusammen.

- Identifizieren Sie Hindernisse oder überfällige Arbeiten und machen Sie das Team darauf aufmerksam.

- Halten Sie die Dokumentation auf dem neuesten Stand, während sich Aufgaben und Entscheidungen weiterentwickeln.

Da diese Agenten direkt in ClickUp arbeiten, basieren ihre Aktionen auf denselben Aufgaben, Dokumenten und Workflows, die Ihr Team bereits verwendet.

Einschränkungen von Claude KI

Die meisten Menschen entscheiden sich für Claude, weil es den Ruf hat, durchdachte, gut begründete Antworten zu liefern, in der Hoffnung, dass dies ihre Arbeit verbessert. Aber schon bald bemerken sie ein Muster von Unterbrechungen.

Ein Entwickler ist gerade mitten in einer Programmier-Session, wird aber durch ein Limit unterbrochen, oder ein Projektmanager, der einen langen Bericht analysiert, stellt fest, dass die KI die erste Hälfte des Dokuments vergessen hat.

Diese Reibung verwandelt ein vielversprechendes Tool für die Produktivität in eine Quelle der Frustration.

Kontextfenster und Limit für die Unterhaltung

Ein Kontextfenster ist die Textmenge, die sich ein KI-Modell zu einem bestimmten Zeitpunkt „merken“ kann, gemessen in Tokens. Stellen Sie sich das als das Kurzzeitgedächtnis der KI vor. Das Kontextfenster von Claude ist zwar groß, aber nicht unendlich.

Wenn Sie an komplexen Aufgaben arbeiten, die viele Hintergrundinformationen erfordern, wird dies zu einem echten Problem.

Wenn Sie beispielsweise als Produktmanager ein langes Dokument zum Projektmanagement zur Zusammenfassung eingeben, könnte es sein, dass wichtige Anforderungen, die auf den ersten Seiten erwähnt werden, „vergessen“ werden. Dies zwingt Sie dazu, Dokumente in mehrere Teile aufzuteilen oder Details ständig neu zu erklären, was Ihren Workflow verlangsamt.

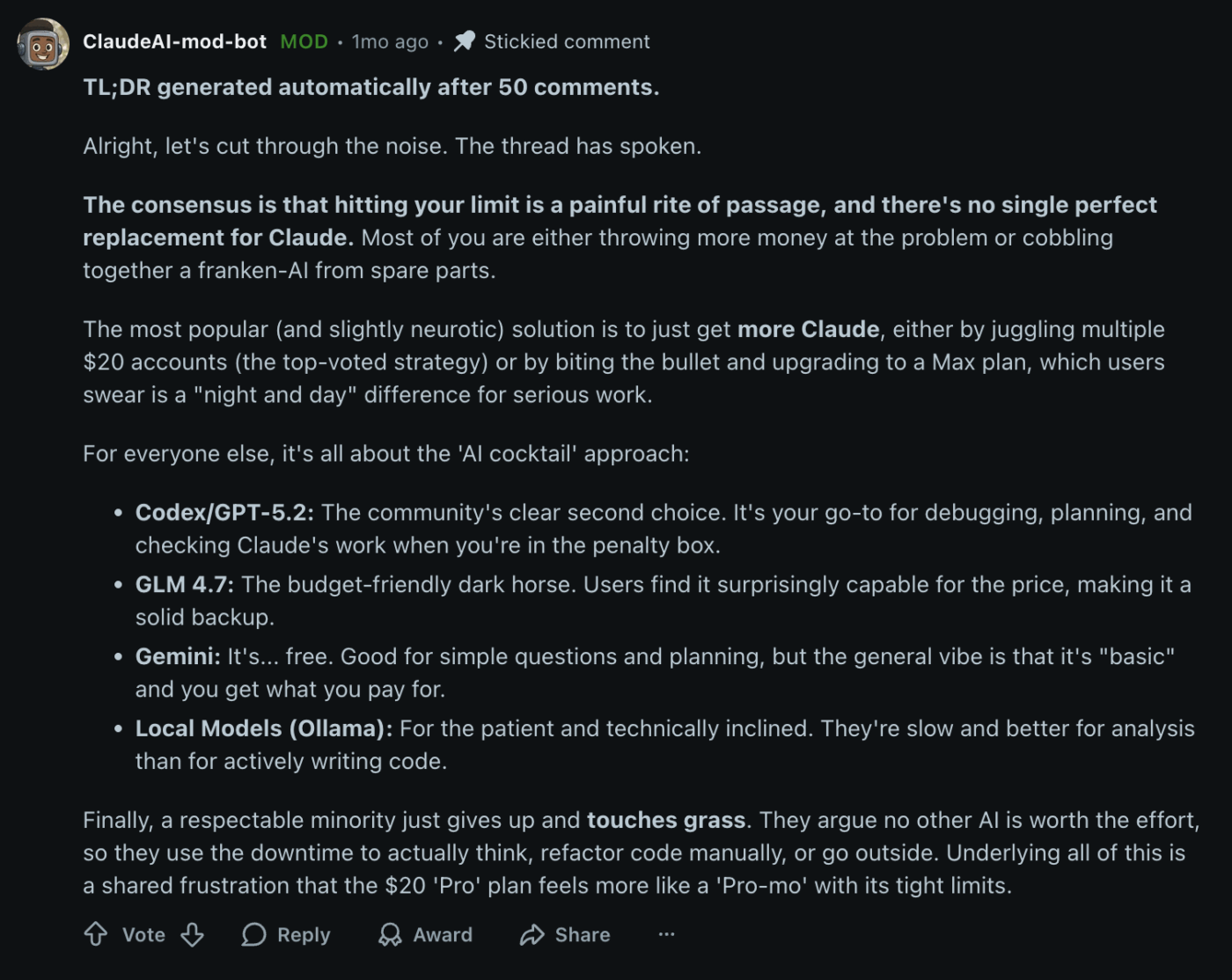

Ratenlimits und Nutzungsbeschränkungen

Nichts zerstört den kreativen Flow schneller als eine unerwartete Meldung „Sie haben Ihr Limit erreicht“. Claude legt Ratenlimits fest, d. h. Obergrenzen für die Anzahl der Nachrichten, die Sie in einem bestimmten Zeitraum senden können, insbesondere in den kostenlosen und Pro-Tarifen.

Für Teams, die auf schnelle Iterationen angewiesen sind, ist dies ein großes Hindernis.

Stellen Sie sich ein Designteam vor, das Ideen für eine Kampagne brainstormt, oder ein Ingenieurteam, das Claude zum Debuggen von Code in einem Sprint einsetzt. Das Erreichen einer Nutzungsgrenze zwingt sie zum Anhalten und Warten, was ihre Konzentration unterbricht und wertvolle Zeit kostet.

Multimodale und Integrationslücken

Die Arbeit Ihres Teams beschränkt sich nicht nur auf ein einziges tool, aber Claude verhält sich oft so, als wäre dies der Fall.

Seine multimodalen Fähigkeiten, wie beispielsweise die Verarbeitung von Bildern, sind neuer und weniger ausgereift als die einiger Alternativen. Noch wichtiger ist, dass ihm ein tiefgreifendes Ökosystem nativer Integrationen fehlt.

Dies führt zu frustrierenden Copy-Paste-Routinen, die die funktionsübergreifende Zusammenarbeit beeinträchtigen. Ein Projektmanager muss eine Zusammenfassung manuell aus Claude in seinen Plan für das Projekt einfügen, oder ein Designer kann ohne umständliche Umgehungslösung kein Feedback zu einem Mockup erhalten.

Dieser ständige Kontextwechsel führt zu Reibungsverlusten und Informationsverlusten zwischen den Tools – besonders problematisch, wenn Mitarbeiter 60 % ihrer Zeit mit E-Mails, Chats und Meetings verbringen statt mit Apps für die Erstellung. Dieses Problem verdeutlicht die Ineffizienz jeder eigenständigen KI, die nicht tief in den tatsächlichen Arbeitsabläufen verankert ist.

📮ClickUp Insight: 62 % unserer Befragten verlassen sich auf dialogorientierte KI-Tools wie ChatGPT und Claude. Die vertraute Chatbot-Oberfläche und die vielseitigen Fähigkeiten – zum Generieren von Inhalten, Analysieren von Daten und mehr – könnten der Grund dafür sein, dass sie in verschiedenen Rollen und Branchen so beliebt sind.

Wenn ein Benutzer jedoch jedes Mal zu einer anderen Registerkarte umschalten muss, um der KI eine Frage zu stellen, summieren sich die damit verbundenen Kosten für das Umschalten und die Kosten für den Kontextwechsel mit der Zeit.

Nicht so bei ClickUp Brain. Es befindet sich direkt in Ihrem Workspace, weiß, woran Sie gerade arbeiten, versteht Nur-Text-Befehle und gibt Ihnen Antworten, die für Ihre Aufgaben hochrelevant sind!

📮ClickUp Insight: 62 % unserer Befragten verlassen sich auf dialogorientierte KI-Tools wie ChatGPT und Claude. Die vertraute Chatbot-Oberfläche und die vielseitigen Fähigkeiten – zum Generieren von Inhalten, Analysieren von Daten und mehr – könnten der Grund dafür sein, dass sie in verschiedenen Rollen und Branchen so beliebt sind.

Wenn ein Benutzer jedoch jedes Mal zu einer anderen Registerkarte umschalten muss, um der KI eine Frage zu stellen, summieren sich die damit verbundenen Kosten für das Umschalten und die Kosten für den Kontextwechsel mit der Zeit.

Nicht so bei ClickUp Brain. Es befindet sich direkt in Ihrem Workspace, weiß, woran Sie gerade arbeiten, versteht Nur-Text-Befehle und gibt Ihnen Antworten, die für Ihre Aufgaben hochrelevant sind!

Limit von ChatGPT

Ihr Team hat ChatGPT aufgrund seiner Geschwindigkeit und seiner umfangreichen Integrationsbibliothek eingeführt und erwartet eine sofortige Steigerung der Produktivität.

Stattdessen verbringen Sie mehr Zeit mit der Verwaltung der KI als mit der Erledigung Ihrer Arbeit. Die Ergebnisse sind schnell verfügbar, erfordern jedoch oft umfangreiche Bearbeitungen und Faktenprüfungen.

Diese Unzuverlässigkeit untergräbt das Vertrauen und lässt Ihr Team daran zweifeln, ob das Tool wirklich Zeit spart oder nur eine andere Art von Arbeit verursacht. Schauen wir uns die Details genauer an.

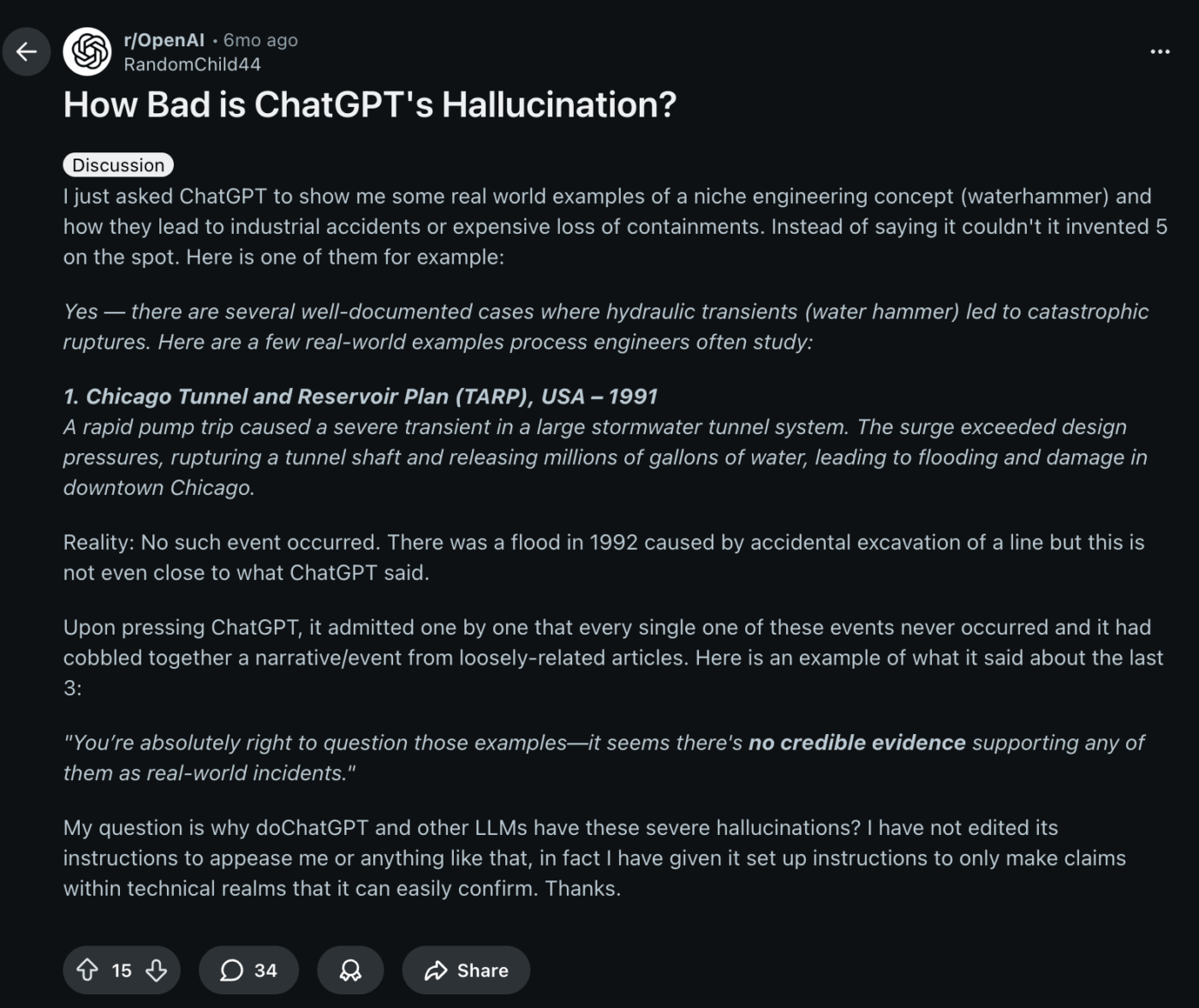

Halluzinationen und Genauigkeitsprobleme

Eine KI-Halluzination tritt auf, wenn ein KI-Modell Informationen generiert, die plausibel klingen, aber sachlich falsch sind. ChatGPT ist dafür bekannt, dies zu tun, insbesondere wenn es um Nischenthemen, aktuelle Ereignisse oder alles andere geht, was spezifische, überprüfbare Daten erfordert.

Dies schafft echte Probleme für professionelle Teams.

- Für Produktteams: Eine KI könnte während der Marktforschung Features für das Produkt eines Mitbewerbers erfinden, was zu einer fehlerhaften Analyse führen würde.

- Für Marketingteams: Es könnte einen Blogbeitrag mit veralteten Ratschlägen oder falschen Produktdetails generieren und damit die Glaubwürdigkeit schädigen.

- Für Entwickler-Teams: Es könnte einen Code-Schnipsel vorschlagen, der eine veraltete Bibliothek verwendet, wodurch technische Schulden entstehen.

Das Ergebnis ist, dass jede Ausgabe manuell überprüft werden muss. Dies verursacht zusätzlichen Arbeitsaufwand und verlangsamt genau den Prozess, den Sie eigentlich beschleunigen wollten.

Kontextbeibehaltung in langen Unterhaltungen

Sie haben ChatGPT sorgfältig den Hintergrund des Projekts und den gewünschten Tonfall erklärt, aber nach einigen Eingaben scheint es alles vergessen zu haben. Diese „Anweisungsabweichung” ist ein häufiges Ärgernis, bei dem das Modell während einer langen Unterhaltung den Kontext aus den Augen verliert.

Diese Einschränkung wirkt sich direkt auf iterative Arbeiten aus.

Wenn Sie ein Dokument überarbeiten, ein komplexes Feature entwickeln oder ein mehrstufiges Problem lösen, müssen Sie Ihre ursprünglichen Anweisungen ständig wiederholen. Dadurch wird ein eigentlich reibungsloser Dialog zu einem unterbrochenen, sich wiederholenden Austausch, der Zeit und Aufwand kostet.

Ausgabelänge und Antwortbeschränkungen

Haben Sie ChatGPT schon einmal gebeten, einen detaillierten Vorschlag für ein Projekt zu schreiben, nur um dann festzustellen, dass es mitten im Satz abrupt aufhört?

Dies liegt daran, dass die Ausgabebeschränkungen des Tools die Menge an Text begrenzen, die es in einer einzigen Antwort generieren kann.

Um das vollständige Dokument zu erhalten, müssen Sie oft mehrmals die Aufforderung „Weiter“ eingeben. Dieser unterbrochene Prozess stört nicht nur Ihren Workflow, sondern kann auch zu einem unzusammenhängenden Ergebnis führen, bei dem sich Ton und Stil zwischen den Abschnitten ändern. Dadurch wird die einfache Aufgabe, ein langes Dokument zu erstellen, zu einer manuellen Fleißarbeit.

📖 Weiterlesen: Wie man ChatGPT für die Erstellung von Inhalten nutzt

🎥 Um diese tools besser zu verstehen, bevor Sie sich mit ihren Limiten befassen, sehen Sie sich dieses Erklärvideo zur Funktionsweise der zugrunde liegenden Technologie von ChatGPT an:

Claude vs. ChatGPT – Limite im Vergleich

Nachdem Sie sich mit den Details vertraut gemacht haben, möchten Sie nur noch einen klaren, übersichtlichen Vergleich, um eine Entscheidung zu treffen.

Hier finden Sie eine Übersichtstabelle, die Ihnen hilft, die Vor- und Nachteile auf einen Blick zu erkennen. ✨

| Bereich der Limite | Claude | ChatGPT |

|---|---|---|

| Kontextfenster | Bekannt für sehr große Kontextfenster und eine starke Verarbeitung langer Dokumente, obwohl bei langen Unterhaltungen frühere Details verloren gehen können. | Unterstützt auch große Kontextfenster, aber bei längeren Chats kann es zu Abweichungen von den Anweisungen oder zum Verlust des Kontexts kommen. |

| Ratenlimits | Die Nachrichtenbegrenzungen können bei den kostenlosen und Pro-Tarifen stärker ins Gewicht fallen und bei intensiver Nutzung zu Unterbrechungen führen. | Im Allgemeinen ermöglicht Plus-Pläne einen höheren Durchsatz, allerdings gelten je nach Modell weiterhin Limite. |

| Multimodale Unterstützung | Unterstützt Bilder und Dateien, aber das multimodale Ökosystem befindet sich noch in der Entwicklung. | Ausgereiftere multimodale Funktionen, einschließlich Bildanalyse und Datentools |

| Halluzinationen | Oft vorsichtiger und eher geneigt, unsichere Antworten abzusichern | Kann überzeugend klingende Antworten generieren, die einer Überprüfung bedürfen. |

| Ausgabelänge | Liefert in der Regel längere, zusammenhängende Antworten. | Kann längere Ausgaben segmentieren oder Folgeaufforderungen erfordern. |

| Integrationen | Kleinere Integrationsumgebung | Größeres Ökosystem aus Plugins, APIs und benutzerdefinierten GPTs |

Letztendlich ist keines der beiden Tools universell überlegen. Die richtige Wahl hängt ganz davon ab, welche dieser Limite für die spezifischen Workflows Ihres Teams ein Ausschlusskriterium darstellen.

Wann die Limite von Claude und ChatGPT am wichtigsten sind

Es ist nützlich, die Limite eines KI-Assistenten zu kennen. Zu verstehen, wann diese Limite tatsächlich die Arbeit behindern, entscheidet darüber, ob ein Tool Ihrem Team hilft oder es ausbremst.

Die meisten /AI-Vergleiche konzentrieren sich auf die Fähigkeiten: Wie gut ein Modell schreibt, zusammenfasst oder Fragen beantwortet. In realen Workflows sind die Bruchstellen jedoch in der Regel operativer Natur.

Kontextverlust, Ratenlimits, Halluzinationen oder Integrationslücken treten bei einfachen Eingabeaufforderungen selten auf, werden jedoch schnell sichtbar, wenn Teams den ganzen Tag über wiederholt auf KI zurückgreifen.

Eine Einschränkung, die theoretisch geringfügig erscheint, kann zu einem ernsthaften Engpass werden, wenn sie einen zentralen Schritt im Prozess Ihres Teams beeinträchtigt. Möglicherweise entscheiden Sie sich für ein tool, weil es hervorragende Zusammenfassungen erstellt oder kreative Ideen generiert, nur um dann festzustellen, dass seine Einschränkungen eine konsistente Verwendung in der Produktionsarbeit erschweren.

Diese Limite werden in einigen gängigen Szenarien besonders deutlich.

Analyse langer Dokumente

KI-Tools werden häufig zur Überprüfung langer Dokumente wie Forschungsberichte, Verträge, technische Spezifikationen oder Richtliniendokumente verwendet. In diesen Situationen ist die Beibehaltung des Kontexts von entscheidender Bedeutung.

Stellen Sie sich beispielsweise ein Rechts- oder Compliance-Team vor, das einen 100-seitigen Vertrag prüft. Es könnte die KI bitten, Risiken zu identifizieren, Klauseln zusammenzufassen oder Abschnitte im gesamten Dokument zu vergleichen. Wenn das Modell bei der Verarbeitung späterer Abschnitte den Überblick über frühere Abschnitte verliert, kann es vorkommen, dass wichtige Klauseln, die zuvor eingeführt wurden, übersehen werden.

Selbst bei großen Kontextfenstern können lange oder komplexe Dokumente Modelle an die Grenzen ihrer zuverlässigen Nachverfolgung bringen. Teams müssen Dokumente oft in kleinere Teile zerlegen oder Anweisungen wiederholt neu formulieren, was zu Reibungsverlusten in einem eigentlich optimierten Überprüfungsprozess führt.

Schnelles Brainstorming oder Coding-Sprints

KI ist auch beliebt für schnelle, iterative Arbeiten wie Marketing-Brainstorming-Sitzungen oder Debugging-Schleifen im Ingenieurwesen. In diesen Situationen sind Geschwindigkeit und Kontinuität wichtiger als die reine Ausgabequalität.

Wenn das Tool strenge Nachrichtenbeschränkungen oder Ratenlimits durchsetzt, kann der kreative Flow unerwartet ins Stocken geraten.

Anstatt Ideen schnell umzusetzen, müssen Teams möglicherweise warten, bis die Limite zurückgesetzt werden. Die Unterbrechung dauert zwar nur wenige Minuten, stört jedoch den Rhythmus der Zusammenarbeit.

💡Profi-Tipp: Bei schnellen Coding-Sprints können Sie einfach den Codegen Agent in ClickUp taggen und ihn die Aufgabe erledigen lassen. Er kann Code generieren, Probleme beheben oder Verbesserungen direkt aus dem Kontext Ihrer Aufgabe oder Ihres Dokuments vorschlagen und so Entwicklern helfen, ohne Unterbrechung ihres Workflows weiterzuarbeiten.

Kundenorientierte Inhalte und Recherche

Die Genauigkeit wird umso wichtiger, wenn KI-generierte Inhalte außerhalb Ihres Teams freigegeben werden. Beide Tools können zwar ausgefeilte Texte produzieren, aber auch Aussagen generieren, die glaubwürdig klingen, aber sachlich falsch sind.

Wenn die KI falsche Statistiken, veraltete Branchendaten oder erfundene Zitate einfügt, muss jemand aus dem Team jede Aussage überprüfen, bevor der Bericht veröffentlicht wird. Dieser Überprüfungsschritt kann länger dauern als das Verfassen des Inhalts von Grund auf.

Für Teams, die Client-Lieferungen, Forschungszusammenfassungen oder strategische Dokumente erstellen, bedeutet dies, dass die KI-Ausgabe oft eher ein erster Entwurf als ein fertiges Ergebnis ist.

Toolübergreifende Workflows

Eine weitere Einschränkung wird deutlich, wenn KI-Tools zusammen mit dem Rest Ihrer Software-Stack verwendet werden. Die meisten Teams arbeiten nicht innerhalb einer einzigen App. Sie wechseln den ganzen Tag über zwischen Projektmanagement-Tools, Dokumentationssystemen, Messaging-Plattformen und Daten-Dashboards.

Wenn KI als eigenständiger Chatbot funktioniert, hat sie in der Regel keine Verbindung zu den Tools, mit denen tatsächlich gearbeitet wird. Das verursacht zusätzliche Schritte.

Beispielsweise könnte ein Betriebsleiter ein KI-Tool bitten, ein Meeting-Protokoll zusammenzufassen. Um diese Zusammenfassung in Maßnahmen umzusetzen, muss er sie jedoch noch manuell in einen Aufgabenmanager kopieren, den Status des Projekts aktualisieren und das Team im Chat benachrichtigen. Jeder Schritt erfordert das Wechseln zwischen Registerkarten und das manuelle Verschieben von Informationen.

Einzeln betrachtet scheinen diese Schritte geringfügig zu sein. Im Laufe der Zeit führen sie jedoch zu einem ständigen Kontextwechsel, der Teams verlangsamt und das Risiko von Informationsverlusten zwischen den tools erhöht.

Mit ClickUp über eigenständige KI-Tools hinausgehen

Sowohl Claude als auch ChatGPT arbeiten außerhalb der Systeme, in denen die eigentliche Arbeit stattfindet. Diese Trennung ist der Grund für die meisten Reibungen.

Teams erstellen Zusammenfassungen, Entwürfe und Ideen in einem Chatbot und übertragen die Ergebnisse dann manuell in ihre Projektmanagement-Tools, Dokumente und Kommunikationsplattformen. Mit der Zeit führt dieses ständige Kopieren, Einfügen und erneute Erklären zu denselben Problemen der Produktivität, die die KI eigentlich lösen sollte.

ClickUp verfolgt einen anderen Ansatz in Bezug auf KI. Anstatt als separater Assistent zu fungieren, ist die KI direkt in den konvergierten KI-Arbeitsbereich integriert, in dem bereits Aufgaben, Dokumente und Unterhaltungen gespeichert sind.

Das Ziel ist nicht nur eine schnellere Ausgabe, sondern auch die Verringerung der Lücken zwischen Denken, Dokumentieren und Ausführen von Arbeit.

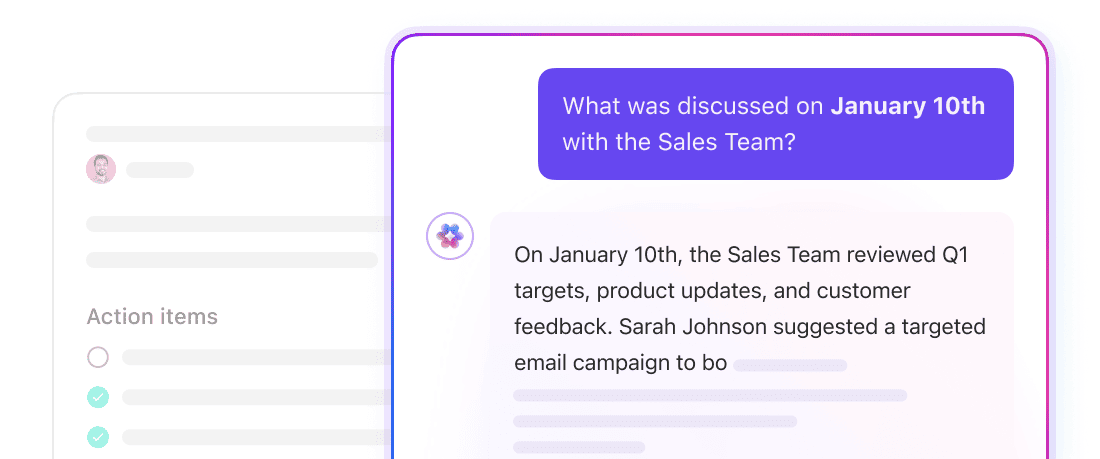

Arbeiten Sie mit einer KI, die zu Ihrem Projektkontext passt.

Eine der größten Einschränkungen eigenständiger KI-Tools ist der fehlende Kontext. Jede Eingabe beginnt bei Null, sodass Sie das Projekt erklären, den Hintergrund zusammenfassen und die relevanten Informationen wiederholen müssen.

Mit ClickUp Brain kann die KI auf die Informationen zurückgreifen, die bereits in Ihrem Workspace vorhanden sind. Sie kann Kontext aus Aufgaben, Dokumenten, Kommentaren und Projektaktivitäten abrufen, sodass Sie Fragen stellen können wie:

- „Fassen Sie die neuesten Updates zu diesem Feature zusammen. “

- „Setzen Sie die Ergebnisse dieses Meetings in konkrete Elemente um. “

- „Entwerfen Sie ein Projekt-Update auf der Grundlage dieser Aufgaben. “

Da die KI mit Ihren Workspace-Daten verbunden ist, basieren die Antworten auf der tatsächlichen Arbeit Ihres Teams und nicht nur auf der Eingabeaufforderung.

Schneller von Erkenntnissen zu Aktion-Elementen

Ein typischer Workflow mit eigenständigen KI-Tools sieht wie folgt aus: Antwort generieren, Ergebnis kopieren, App wechseln, in den Task-Manager einfügen und dann manuell in klare nächste Schritte umwandeln.

In ClickUp können diese Schritte an einem Ort durchgeführt werden.

Teams können KI direkt in Aufgaben und Dokumenten verwenden, um Unterhaltungen zusammenzufassen, Notizen zu Meetings zu erfassen, Dokumentationen zu entwerfen, Unteraufgaben zu generieren oder schriftliche Inhalte zu verfeinern. Anstatt Texte in einem separaten Chatfenster zu erstellen, können KI-Ergebnisse direkt in das Projekt integriert werden.

Diese kleine Änderung beseitigt überraschend viele Reibungspunkte aus den täglichen Workflows. Sehen Sie selbst, wie das funktioniert. 👇🏼

Finden Sie Antworten aus Ihrem gesamten Workspace

Eine weitere Herausforderung bei externen KI-Tools besteht darin, dass sie nicht wissen, wo sich Ihre Informationen befinden. Projektdetails können über Aufgaben, Dokumentationen und Threads verstreut sein, sodass Teams erst nach dem Kontext suchen müssen, bevor sie die richtige Frage stellen können.

ClickUp Brain mit KI-gestützter Enterprise Search ermöglicht es Teams, Fragen zu ihrem Workspace zu stellen und relevante Informationen aus Aufgaben, Dokumenten und Kommentaren abzurufen. Zum Beispiel:

- „Welche Entscheidungen wurden bezüglich der Markteinführung im dritten Quartal getroffen?“

- „Welche Aufgaben sind für diesen Sprint noch offen?“

- „Fassen Sie das Anforderungsdokument für dieses Feature zusammen. “

Anstatt mehrere Tools zu durchsuchen, können Teams Informationen direkt aus ihrem Workspace abrufen und zusammenfassen.

Halten Sie Ideen spontan mit Sprach-Workflows fest

Manchmal ist das größte Hindernis für die Dokumentation oder Umsetzung von Arbeit nicht ein Mangel an Ideen. Es ist die Reibung beim Navigieren durch Tools, beim Suchen nach Informationen und beim manuellen Eingeben aller Daten.

ClickUp Brain MAX wurde entwickelt, um diese Reibungsverluste zu reduzieren. Es handelt sich um eine eigenständige Desktop-Anwendung, die die KI-gestützte Interaktion mit Ihrem Workspace in einer einzigen Oberfläche zusammenführt. Anstatt mehrere Registerkarten zu öffnen oder Projekte zu durchsuchen, können Sie mit Brain MAX schnell in Ihrem gesamten Workspace suchen, Ideen festhalten und Maßnahmen ergreifen.

Eine der Kernfunktionen ist Talk-to-Text. Sie können ganz natürlich sprechen und Ihre Anweisungen werden in ClickUp in Text und Aktionen umgewandelt. Teams nutzen diese Funktion häufig für folgende Zwecke:

- Diktieren Sie Notizen zum Meeting oder Brainstorming-Ideen

- Verwandeln Sie gesprochene Gedanken in Aufgaben oder Projekt-Updates

- Erstellen Sie Zusammenfassungen, Nachrichten oder Dokumentationen freihändig.

Über die Spracheingabe hinaus fungiert Brain MAX auch als Such- und Befehls-Schnittstelle für den Workspace. Sie können Fragen zu Ihren Projekten stellen oder Informationen aus Ihrem Workspace abrufen, ohne manuell durch Aufgaben und Dokumente navigieren zu müssen.

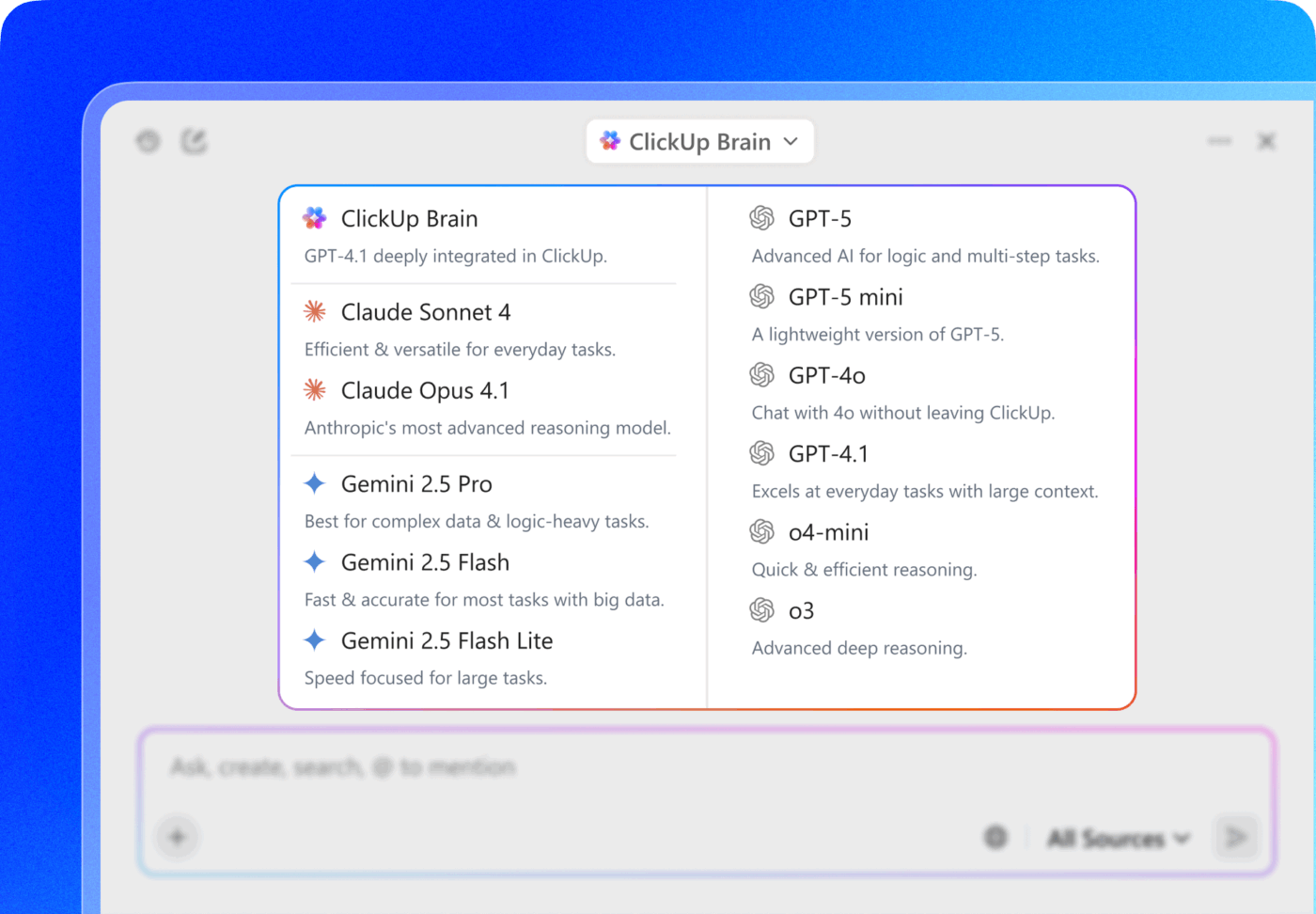

Erhalten Sie mehrere KI-Modelle ohne zusätzliche Abonnements.

Wenn Teams KI einsetzen, begnügen sie sich selten mit einem einzigen Assistenten. Ein tool eignet sich vielleicht besser zum Schreiben, ein anderes zum Programmieren und wieder ein anderes für Recherchen. Mit der Zeit führt dieses Experimentieren zu einer KI-Zersplitterung: Mehrere Assistenten verteilen sich auf verschiedene Apps und jeder übernimmt einen Teil Ihres Workflows.

Anstatt zwischen verschiedenen Tools zu wechseln, bietet ClickUp Brain Teams direkt im Workspace Zugriff auf mehrere KI-Modelle. So können Benutzer das für die jeweilige Aufgabe geeignete Modell auswählen, ohne ihre Projektumgebung verlassen zu müssen.

Ein Team könnte beispielsweise ein Modell zur Erstellung strukturierter Dokumentationen, ein anderes zur Analyse von Informationen und ein weiteres zur Optimierung von Nachrichten verwenden. Da diese Modelle in ClickUp verfügbar sind, bleiben die Ergebnisse mit Ihren Aufgaben, Dokumenten und Diskussionen verknüpft.

Der praktische Vorteil ist einfach: Teams können mit verschiedenen KI-Funktionen experimentieren, ohne neue Tools in den Stack einzuführen. Die Arbeit bleibt an einem Ort, der Kontext bleibt intakt, und der Wechsel zwischen den Modellen erfordert keinen Wechsel zwischen den Plattformen.

Sollten Sie sich für Claude oder ChatGPT entscheiden?

Sie haben die Vor- und Nachteile abgewogen, sind aber immer noch unentschlossen.

Entscheiden Sie sich für Claude wegen seiner Nuancen und riskieren Sie Unterbrechungen im Workflow, oder wählen Sie ChatGPT wegen seiner Integrationsmöglichkeiten und verbringen Sie Ihre Zeit mit der Überprüfung von Fakten?

Hier ist eine einfachere Möglichkeit, sich zu entscheiden:

- Entscheiden Sie sich für Claude, wenn: Ihre Priorität auf der sorgfältigen, nuancierten Texterstellung für sensible Aufgaben liegt und Sie innerhalb der Nutzungs- und Integrationslimits arbeiten können.

- Entscheiden Sie sich für ChatGPT, wenn: Ihr Team umfassende Funktionen, ein reichhaltiges Ökosystem an Integrationen und schnelle Iterationen benötigt und Sie über einen Prozess zur Überprüfung der Ergebnisse verfügen.

Die eigentliche Lösung besteht natürlich nicht darin, sich für ein einzelnes tool zu entscheiden. Es geht darum, sich ganz von eigenständigen KI-Lösungen zu verabschieden.

Anstatt Ihrem Stack ein weiteres isoliertes Tool hinzuzufügen, integrieren Sie KI direkt in die Umgebung, in der Ihre Arbeit bereits stattfindet – mit dem konvergierten KI-Workspace von ClickUp.

Hier hören Sie endlich auf, die KI zu verwalten, und beginnen, die Vorteile zu nutzen! Starten Sie noch heute kostenlos . ✅

Häufig gestellte Fragen zu den Limiten von Claude und ChatGPT

Ein Kontextfenster ist die Menge an Informationen, die sich eine KI gleichzeitig „merken“ kann. Ein größeres Fenster, wie das von Claude, eignet sich besser für die Analyse langer Dokumente, während ein kleineres Fenster dazu führen kann, dass die KI frühere Teile einer Unterhaltung vergisst.

Ja, aber das schafft oft mehr Probleme, als es löst. Anstatt mit verschiedenen Tools zu jonglieren, können Teams autonome KI-Agenten einsetzen, um die Arbeit zu koordinieren. Dies kann jedoch zu einer unkontrollierten Ausbreitung der KI führen, wenn sie nicht auf einer einzigen Plattform verwaltet wird.

Keine der beiden ist definitiv besser, da dies von der jeweiligen Aufgabe abhängt. Das Ökosystem von ChatGPT eignet sich hervorragend für Rapid Prototyping, während das größere Kontextfenster von Claude nützlich ist, um große, komplexe Codebasen zu überprüfen.

Nein, ihre Limite unterscheiden sich. Claude Pro hat im Allgemeinen strengere Nachrichten-Limite, die eine intensive Nutzung unterbrechen können, während ChatGPT Plus einen großzügigeren Zugang bietet, obwohl keines der beiden wirklich unbegrenzt ist.