Die meisten Menschen gehen davon aus, dass sie sich zwischen der Nutzung leistungsstarker KI-Tools und dem Schutz ihrer Daten entscheiden müssen. Tatsächlich können Sie jedoch beides haben. Wenn Sie KI lokal ausführen, verlassen die Daten Ihre Hardware nie. Sie behalten die volle Kontrolle über Ihre Informationen und können dennoch Ihre repetitivsten Aufgaben automatisieren.

Dieser Leitfaden zeigt Ihnen, wie Sie lokale KI mithilfe von Tools wie Ollama für sichere Workflows nutzen können. Sie lernen, wie Sie Open-Source-Modelle auswählen, die zu Ihren spezifischen Hardware-Spezifikationen passen. Und wie Sie automatisierte Workflows erstellen, die vertrauliche Dokumente lokal verarbeiten.

Außerdem werden wir uns damit befassen, wie man Workflows in einer einheitlichen Umgebung wie ClickUp zentralisieren kann. 😎

Was ist lokale KI?

Lokale KI bedeutet, dass Sie große Sprachmodelle (LLMs) vollständig auf Ihrer eigenen Hardware – wie Ihrem Laptop oder einem lokalen Server – ausführen, anstatt Ihre Daten an externe Cloud-Dienste zu senden. Dies eignet sich für jedes Team, das mit sensiblen Informationen umgeht, von der Technik und Produktentwicklung bis hin zu Rechts- und Finanzabteilungen.

Bei den meisten cloudbasierten KI-Tools werden Ihre Eingaben, Dokumente und Daten an Server von Drittanbietern übertragen. Sie verlieren die Kontrolle darüber, wie diese Informationen verarbeitet, gespeichert oder genutzt werden.

Im Gegensatz dazu bleiben Ihre Daten bei lokaler KI in Ihrer Umgebung. Sie behalten die vollständige Kontrolle über die Sicherheit und den Datenschutz Ihrer Workflows.

Natürlich gibt es einen Kompromiss. Die Einrichtung lokaler KI erfordert mehr technischen Aufwand und eine Vorabinvestition in Hardware. Allerdings macht sie Sie völlig unabhängig von externen Anbietern. Mit On-Device-Inferenz bleiben Ihre Informationen genau dort, wo Sie sie haben wollen.

Warum lokale KI für sichere Team-Workflows wichtig ist

🔎 Wussten Sie schon? Nur jeder zehnte Verbraucher ist bereit, sensible Informationen wie Finanz-, Kommunikations- oder biometrische Daten an KI-gesteuerte Systeme freizugeben.

Diese Zurückhaltung spiegelt eine zunehmende Realität für B2B-Teams wider. Bei cloudbasierter KI übergeben Sie im Grunde genommen das geistige Eigentum Ihres Unternehmens an einen Dritten. Für Rechts-, Finanz- oder HR-Teams bedeutet dies eine enorme Haftung.

Lokale KI verändert diese Dynamik, indem sie die KI auf Ihre eigene Hardware verlagert. Hier erfahren Sie, warum dies für Ihren täglichen Betrieb wichtig ist:

- Verhindern Sie Datenlecks: Verhindern Sie, dass proprietärer Code oder private Verträge mit Clients zum Trainieren eines öffentlichen Modells verwendet werden, das Ihre Konkurrenten nutzen könnten.

- Einhaltung gesetzlicher Vorschriften: Halten Sie sich an die Vorgaben der DSGVO oder HIPAA, da sensible Daten niemals internationale Grenzen überschreiten oder auf Server von Drittanbietern gelangen.

- Unabhängigkeit von der Cloud: Führen Sie komplexe Datenanalysen oder Entwurfsaufgaben während eines Ausfalls oder in Umgebungen mit hoher Sicherheit durch, in denen der Zugriff auf die Cloud eingeschränkt ist

- Planbare Kosten: Vermeiden Sie steigende API-Gebühren bei der Skalierung Ihres Teams, da Ihre einzigen Kosten die Hardware sind, die Sie bereits besitzen

Durch die Integration lokaler KI in Ihre bestehenden Tools können Sie die Automatisierung Ihrer Arbeit durchführen, ohne Ihre Sicherheit zu gefährden.

⚠️ Es ist jedoch wichtig zu bedenken, dass sich dieses Problem verschlimmern kann. Ihr Team möchte möglicherweise mehrere KI-Tools einsetzen, was zu einer KI-Wildwuchs führen kann – der unkontrollierten Verbreitung von KI-Tools ohne Aufsicht oder Strategie. Dies kann zu Geldverschwendung, Doppelarbeit und Sicherheitsrisiken führen.

Letztendlich erweitert dies Ihr Modell der Bedrohung für die Sicherheit und erschwert die Nachverfolgung der Arbeit.

📮ClickUp Insight: Leistungsschwache Teams jonglieren mit viermal höherer Wahrscheinlichkeit mit mehr als 15 Tools, während leistungsstarke Teams ihre Effizienz aufrechterhalten, indem sie ihr Toolkit auf neun oder weniger Plattformen beschränken. Aber wie wäre es mit einer einzigen Plattform? Als All-in-One-App für die Arbeit vereint ClickUp Ihre Aufgaben, Projekte, Dokumente, Wikis, Chats und Anrufe auf einer einzigen Plattform – komplett mit KI-gestützten Workflows. Sind Sie bereit, smarter zu arbeiten? ClickUp eignet sich für jedes Team, macht Arbeit sichtbar und ermöglicht es Ihnen, sich auf das Wesentliche zu konzentrieren, während die KI den Rest erledigt.

Was benötigen Sie, um lokale KI auszuführen?

Sie benötigen keinen speziellen Supercomputer, um KI lokal auszuführen. Dank der jüngsten Veränderungen bei der Erstellung von Modellen können Sie mit der Hardware beginnen, die Sie bereits besitzen. Diese muss lediglich einige spezifische Kriterien erfüllen.

Hardwareanforderungen

Ihre Hardware bestimmt die Größe und Geschwindigkeit der KI-Modelle, die Sie nutzen können. Während Sie mit einem leistungsstarken Rechner komplexere Schlussfolgerungsmodelle ausführen können, sind auch kleinere Modelle mittlerweile überraschend leistungsfähig geworden.

- GPU mit VRAM: Eine dedizierte NVIDIA-Karte mit mindestens 12 GB VRAM ist derzeit für die meisten Teams die ideale Lösung. Damit können Sie mittelgroße Modelle wie Llama 3.3 (8B) oder Mistral Small mit hoher Geschwindigkeit ausführen.

- System-RAM: Wenn Sie keine High-End-GPU haben, übernimmt der Arbeitsspeicher Ihres Computers die Last. 32 GB bieten Ihnen genügend Spielraum, um ein Modell auszuführen und gleichzeitig Ihren Browser und Ihre Tools für das Projektmanagement geöffnet zu lassen.

- Unified Memory (für Mac-Benutzer): Wenn Sie einen Mac mit einem Chip der M-Serie (M2, M3 oder M4) verwenden, werden RAM und GPU-Speicher freigegeben. Dadurch eignen sich Macs besonders gut für lokale KI, da das Modell auf den gesamten Speicherpool zugreifen kann

- Schneller Speicher: Modelle sind große Dateien, die oft in einem Bereich von 5 GB bis 50 GB groß sind. Die Verwendung einer NVMe-SSD ist unerlässlich, um lange Wartezeiten beim Laden eines neuen Modells zu vermeiden.

🔎 Wussten Sie schon? Der Bau eines PCs ist heute deutlich teurer als noch vor wenigen Monaten. Früher kostete ein 32-GB-DDR5-Speicherkit weniger als 130 US-Dollar, doch mittlerweile sind die Preise für solche Kits auf über 400 US-Dollar gestiegen. Diese Entwicklung hat 32 GB zum neuen absoluten Minimum für jede ernsthafte lokale KI-Arbeit gemacht, da Sie genügend Spielraum benötigen, um Modelle auszuführen, ohne dass die Systemleistung einbricht.

Softwareanforderungen

Software fungiert als Brücke zwischen Ihrer Hardware und der KI. Sie müssen kein Entwickler mehr sein, um dies zum Laufen zu bringen.

- Betriebssystem: Während Linux die ursprüngliche Heimat der KI ist, sind Windows und macOS mittlerweile ebenso leistungsfähig. Windows-Benutzer können WSL2 für eine Linux-ähnliche Umgebung nutzen, obwohl viele Tools mittlerweile direkt unter Windows laufen

- Modellmanager: Tools wie Ollama oder LM Studio sind der einfachste Einstieg. Sie übernehmen die Quantisierung – also die Komprimierung des Modells, damit es automatisch auf Ihre Hardware passt.

- Treiber: Sie benötigen die neuesten Treiber für Ihre Hardware, beispielsweise den neuesten CUDA-Treiber für NVIDIA-Karten. Die meisten modernen Setups überprüfen dies während des Setups für Sie.

Open-Source-LLM-Optionen

Wir erleben derzeit eine explosionsartige Zunahme von Open-Weight-Modellen, die Sie kostenlos herunterladen können. Diese werden von Unternehmen wie Meta (Llama), Mistral und Alibaba (Qwen) entwickelt. Im Gegensatz zu geschlossenen Systemen ermöglichen Ihnen diese Modelle, genau zu sehen, wie sie funktionieren und wohin Ihre Daten gelangen.

Achten Sie bei der Auswahl eines großen Sprachmodells auf die Softwarelizenz. Die meisten verwenden die Apache 2.0- oder MIT-Lizenz, die es Ihnen ermöglicht, sie für geschäftliche Zwecke ohne monatliche Abonnementgebühr zu nutzen. Da diese Modelle auf Ihrer Hardware laufen, lassen sie sich direkt in Ihre privaten Workflows integrieren.

Sie können beispielsweise ein lokales Modell nutzen, um interne E-Mails zu entwerfen, Meeting-Protokolle zusammenzufassen oder firmeneigene Datensätze zu analysieren. So bleiben Ihre sensibelsten Projektdetails und strategischen Notizen auf Ihrem Rechner.

🧠 Wissenswertes: Die Chips der M-Serie von Apple bieten einen einzigartigen architektonischen Vorteil für Teams, denen Datenschutz besonders wichtig ist. Dank des Unified Memory des Mac kann die KI den gesamten System-RAM-Pool so nutzen, als wäre es dedizierter Grafikspeicher.

Das bedeutet, dass ein MacBook mit 128 GB RAM umfangreiche, hochkomplexe Modelle ausführen kann, für die normalerweise spezielle Hardware für Unternehmen im Wert von über 10.000 US-Dollar erforderlich wäre.

Die besten lokalen KI-Modelle für Team-Workflows

Um das richtige Modell zu finden, sollten Sie die Stärken des Modells mit den Aufgaben des Teams und den Hardware-Kapazitäten abgleichen.

Allgemeine Modelle

Dies sind die Arbeitspferde Ihres lokalen Setups. Nutzen Sie sie zum Verfassen von E-Mails, zum Zusammenfassen von Projekt-Updates oder zum Brainstorming kreativer Ideen.

- Llama 4 Scout (17B): Verfügt über ein Kontextfenster mit 10 Millionen Token, wodurch Sie Tausende von Seiten mit Text auf einmal verarbeiten können

- Mistral Small 4: Verwendet eine „Mixture-of-Experts“-Architektur, was bedeutet, dass für jede Aufgabe nur ein Bruchteil der Parameter aktiviert wird

- Qwen 3.5 (7B): Bietet durchweg überlegene Leistung, wenn Ihr Team technische Dokumentationen in mehreren Sprachen bearbeitet

Modelle für Schlussfolgerungen und den Einsatz von Tools

Nutzen Sie diese Funktionen, wenn Sie die LLM-Agenten benötigen, um mehrstufige Probleme zu lösen, komplexe Logik zu befolgen oder als autonomer Agent innerhalb Ihrer Workflows zu agieren.

- Llama 4 Maverick: Es ist von Haus aus multimodal. Damit eignet es sich ideal für Teams, die komplexe Diagramme oder Finanztabellen analysieren müssen, bei denen der visuelle Kontext genauso wichtig ist wie der Text.

- Phi-4 (14B): Optimiert für MINT-Fächer und logisches Denken. Nutzen Sie es für die Datenvalidierung oder komplexe mathematische Aufgaben, die normalerweise viel größere und teurere Modelle erfordern.

- DeepSeek-R1: Zeigt seine interne Gedankengangkette an, was Ihnen hilft, seine Logik bei Analysen mit hohem Risiko zu überprüfen. Ideal für eingehende Forschung und strategische Planung

Aufgabenspezifische Modelle

Manchmal ist ein spezialisiertes tool effizienter als ein allgemeiner Assistent. Diese Modelle sind für einen bestimmten Teil Ihres Workflows optimiert.

- Qwen 3-Coder-Next: Versteht die Logik auf Repository-Ebene und kann so Fehlerbehebungen vorschlagen oder Code über mehrere Dateien hinweg umgestalten. Dabei hält es sich stets an die spezifischen Stilrichtlinien Ihres Teams.

- Voxtral Mini: Erkennt verschiedene Sprecher in einer Aufzeichnung und wandelt Aufzeichnungen privater Meetings in durchsuchbaren Text um. Funktioniert vollständig offline und eignet sich daher gut zur Vermeidung von Datenlecks.

- Nomic Embed v1.5: Wandelt Ihre privaten Dokumente in mathematische Daten für die semantische Suche um. So können Sie die interne Wissensdatenbank Ihres Teams nach Bedeutung statt nur nach Stichwörtern durchsuchen.

📚 Lesen Sie auch: LLM-Suchmaschinen: KI-gestützte Informationsgewinnung

Beliebte Tools für die Ausführung lokaler KI

Sie müssen kein Softwareentwickler mehr sein, um Modelle auf Ihrem eigenen Rechner auszuführen. Mehrere benutzerfreundliche Anwendungen übernehmen das Setup mittlerweile in wenigen Minuten für Sie.

Ollama und OpenWebUI

Ollama ist die richtige Wahl, wenn Sie Geschwindigkeit und Flexibilität wünschen. Es läuft im Hintergrund und verwaltet Ihre Modellbibliothek über eine einfache Benutzeroberfläche.

Obwohl es als einfaches Basis-Tool beginnt, kombinieren die meisten Nutzer es mit OpenWebUI. Dies sorgt für ein ausgefeiltes Chat-Erlebnis in Ihrem Browser, das in Aussehen und Handhabung den Ihnen bereits bekannten cloudbasierten Tools ähnelt. Außerdem wird so eine lokale Brücke geschaffen, über die andere Apps auf Ihrem Computer sicher mit Ihren KI-Modellen kommunizieren können.

LM Studio

Wenn Sie eine herkömmliche Desktop-App bevorzugen, ist LM Studio eine hervorragende Alternative. Es funktioniert wie ein App-Store für KI. Mit nur wenigen Klicks können Sie damit nach einem neuen Modell suchen, es herunterladen und mit ihm chatten.

Die App verfügt über eine integrierte Hardwareerkennung, sodass sie Ihre Einstellungen automatisch an Ihre spezifische GPU oder Ihren Arbeitsspeicher anpasst. Dies macht sie zu einem hervorragenden Ausgangspunkt, wenn Sie mit verschiedenen Modellen experimentieren möchten, ohne auch nur eine Zeile Code zu schreiben.

GPT4All

Für Teams, die sich ausschließlich auf Datenschutz und Dokumentenanalyse konzentrieren, ist GPT4All eine zuverlässige, einfache Lösung. Es funktioniert auf fast jedem Computer, einschließlich älterer Laptops, die möglicherweise keine dedizierte Grafikkarte haben.

Die nützlichste Funktion ist die Möglichkeit, direkt mit Ihren lokalen Dateien zu chatten. Sie können der App einen Ordner auf Ihrer Festplatte zuweisen, und die KI beantwortet Fragen zu genau diesen Dokumenten. Und das alles, ohne sie jemals auf einen Server eines Drittanbieters hochladen zu müssen.

📚 Lesen Sie auch: Die besten KI-Agenten für Benutzer ohne Programmierkenntnisse

So richten Sie lokale KI für sichere Workflows ein

In dieser Anleitung wird Ollama verwendet, da es ein weit verbreitetes tool zum Aufbau sicherer, lokaler KI-Workflows unterstützt.

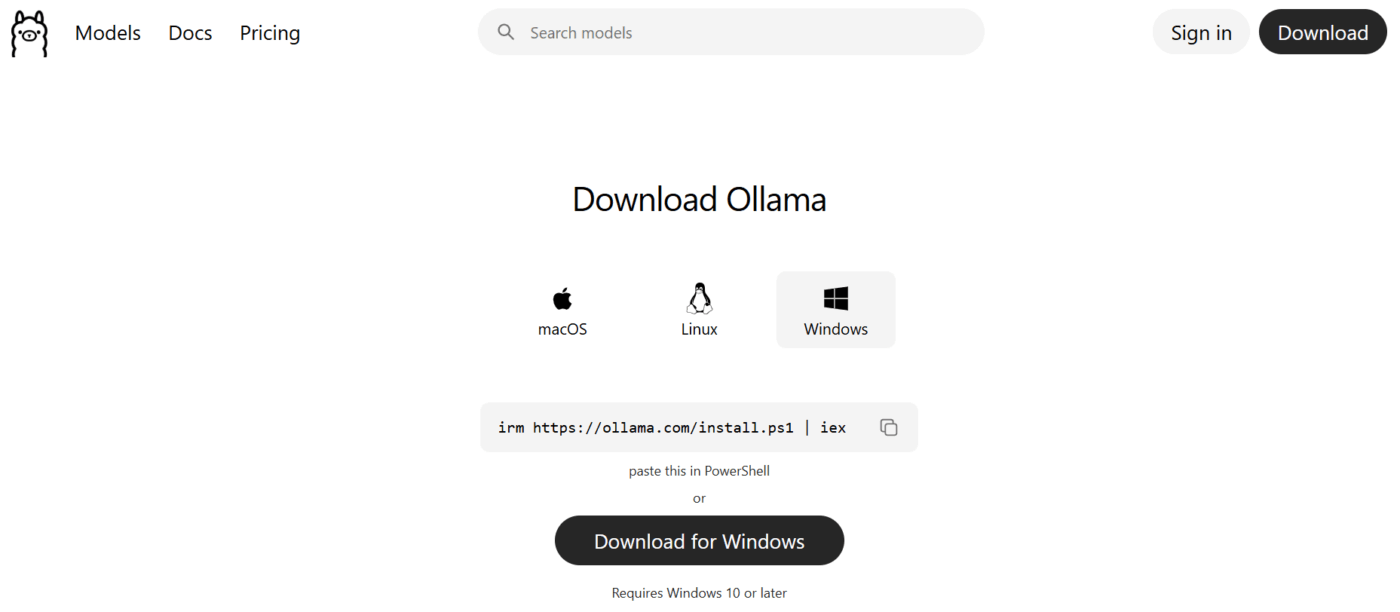

Schritt 1: Installieren Sie Ollama

Laden Sie das Installationsprogramm für Ihr Betriebssystem von der offiziellen Website herunter. Während frühere Windows-Versionen ein manuelles Setup des Linux-Subsystems erforderten, lässt sich die aktuelle Version als native Anwendung installieren.

Die Installation sollte nur wenige Minuten dauern. Sobald die Installation abgeschlossen ist, öffnen Sie Ihr Terminal oder den Befehlszeiger und geben Sie ollama --version ein, um zu überprüfen, ob die Version bereit ist.

Schritt 2: Herunterladen und Ausführen eines Modells

Um eine KI zu nutzen, müssen Sie deren Gewichte auf Ihren Rechner laden. Probieren Sie für Ihren ersten Test ein kompaktes, aber leistungsstarkes Modell wie Llama 3.2 (3B) oder das neueste Mistral aus.

Verwenden Sie den Befehl ollama run llama3.2, um das Herunterladen zu starten.

Je nach Internetgeschwindigkeit dauert dies in der Regel einige Minuten. Sobald alles heruntergeladen wurde, können Sie eine Eingabe direkt in das Terminal eingeben, um eine sofortige Antwort vom Modell auf Ihrer Festplatte zu erhalten.

Schritt 3: Verbinden Sie sich mit Ihrem Workflow-Tool

Der wahre Wert lokaler KI liegt in ihrer Integration in Ihre täglichen Aufgaben. Wenn Ollama läuft, startet es automatisch einen lokalen Server unter http://localhost:11434. Dadurch entsteht eine sichere Brücke, über die andere Anwendungen mit Ihrem Modell kommunizieren können.

Da dieser Server mit den Standardprotokollen von OpenAI kompatibel ist, können Sie mit einfachem Austauschen der API-Adresse Verbindungen zu Automatisierungsplattformen oder internen Skripten herstellen. Sie können beispielsweise ein lokales Dokumentensuchtool auf diese Adresse verweisen. So kann es private Dateien zusammenfassen, ohne dass der Text jemals in die Cloud gesendet wird.

📖 Lesen Sie auch: So optimieren Sie den Workflow-Workflow für mehr Effizienz

Bewährte Best Practices für lokale KI-Workflows

Die lokale Ausführung von KI ist ein großer Schritt für den Datenschutz. Die lokale Speicherung von Daten bedeutet jedoch, dass Sie nun für deren Schutz verantwortlich sind. Sie haben zwar das Risiko einer Cloud-Sicherheitsverletzung durch Dritte beseitigt, müssen aber dennoch Ihre Hardware und die Art und Weise, wie Ihr Team mit den Modellen interagiert, absichern.

Befolgen Sie diese Best Practices:

- Netzwerkisolierung: Beschränken Sie den API-Zugriff auf vertrauenswürdige interne Netzwerke, damit Ihr KI-Server vom öffentlichen Internet aus nicht erreichbar bleibt

- Eingabevalidierung: Bereinigen Sie alle Daten, bevor Sie sie an das Modell senden. Dadurch werden versteckte bösartige Anweisungen in Dokumenten oder E-Mails blockiert.

- Zugriffskontrollen: Implementieren Sie eine Authentifizierung auf Ihrem KI-Endpunkt, um sicherzustellen, dass nur autorisierte Benutzer Modellaktionen auslösen können

- Audit-Protokollierung: Führen Sie Aufzeichnungen über alle Modellinteraktionen, um Compliance- und Untersuchungen zur Sicherheit zu unterstützen

- Container-Isolation: Führen Sie Ihre Modelle in Sandbox-Umgebungen wie Docker aus. So verhindern Sie, dass eine potenzielle Sicherheitsverletzung Ihre Kernsystemdateien erreicht.

- Regelmäßige Updates: Installieren Sie die neuesten Patches für Tools wie Ollama, um vor neu entdeckten Sicherheitslücken geschützt zu bleiben.

- Ratenlimit: Um zu verhindern, dass ein einzelner Benutzer oder ein Skript Ihren Server mit Anfragen überlastet, implementieren Sie ein Ratenlimit, um zu steuern, wie viele Abfragen in einem bestimmten Zeitraum gestellt werden können.

🔎 Wussten Sie schon? Prompt-basierte Manipulationen sind keine theoretische Bedrohung mehr. Eine aktuelle Gartner-Umfrage ergab, dass 32 % der Unternehmen im letzten Jahr einen böswilligen Prompt-Angriff auf /AI-Anwendungen erlebt haben. Diese Angriffe können Ihr lokales Modell so manipulieren, dass es verzerrte oder unbefugte Ergebnisse generiert.

So erstellen Sie sichere KI-Workflows für Ihr Team

Sobald Ihr lokaler Server läuft, können Sie ihn in Ihre tägliche Arbeit integrieren. So wird aus einem einfachen tool eine private Maschine für die Produktivität. Der effektivste Weg, dies zu erreichen, ist die Retrieval-Augmented Generation (RAG).

Dieser Prozess erstellt eine Verbindung zwischen Ihrer lokalen KI und einer privaten Datenbank Ihrer eigenen Dateien. Sie können Fragen unter Berücksichtigung Ihres spezifischen Unternehmenskontexts beantworten, ohne auch nur ein einziges Byte in die Cloud hochladen zu müssen.

Sie können auch „Human-in-the-Loop“-Workflows entwerfen, bei denen die Arbeit der KI von menschlichen Team-Mitgliedern überprüft wird. Dies gewährleistet Genauigkeit und beschleunigt gleichzeitig Ihre Arbeitsergebnisse erheblich.

Hier sind einige praktische Beispiele:

- Dokumentenanalyse: Fassen Sie interne Berichte oder Kundenfeedback zusammen, um sofort Schlüssel-Erkenntnisse zu gewinnen

- Entwurfserstellung: Erstellen Sie erste Versionen von E-Mails oder Projekt-Updates, die von den Mitgliedern des Teams überarbeitet werden können

- Datenklassifizierung: Kategorisieren Sie eingehende Aufgaben automatisch anhand des spezifischen Inhalts der Anfrage

- Vorbereitung auf das Meeting: Erstellen Sie Gesprächspunkte, indem Sie relevante Projektdateien analysieren, die auf Ihrem lokalen Laufwerk gespeichert sind

- Code-Review: Erhalten Sie Feedback zu proprietärem Code, ohne Ihr geistiges Eigentum Dritten preiszugeben

📮ClickUp Insight: Unsere Umfrage zur KI-Reife zeigt, dass der Zugang zu KI am Arbeitsplatz nach wie vor begrenzt ist – 36 % der Befragten haben überhaupt keinen Zugang, und nur 14 % geben an, dass die meisten Mitarbeiter tatsächlich damit experimentieren können. Wenn KI hinter Berechtigungen, zusätzlichen Tools oder komplizierten Setups verborgen ist, haben Teams nicht einmal die Möglichkeit, sie in der realen, täglichen Arbeit auszuprobieren.

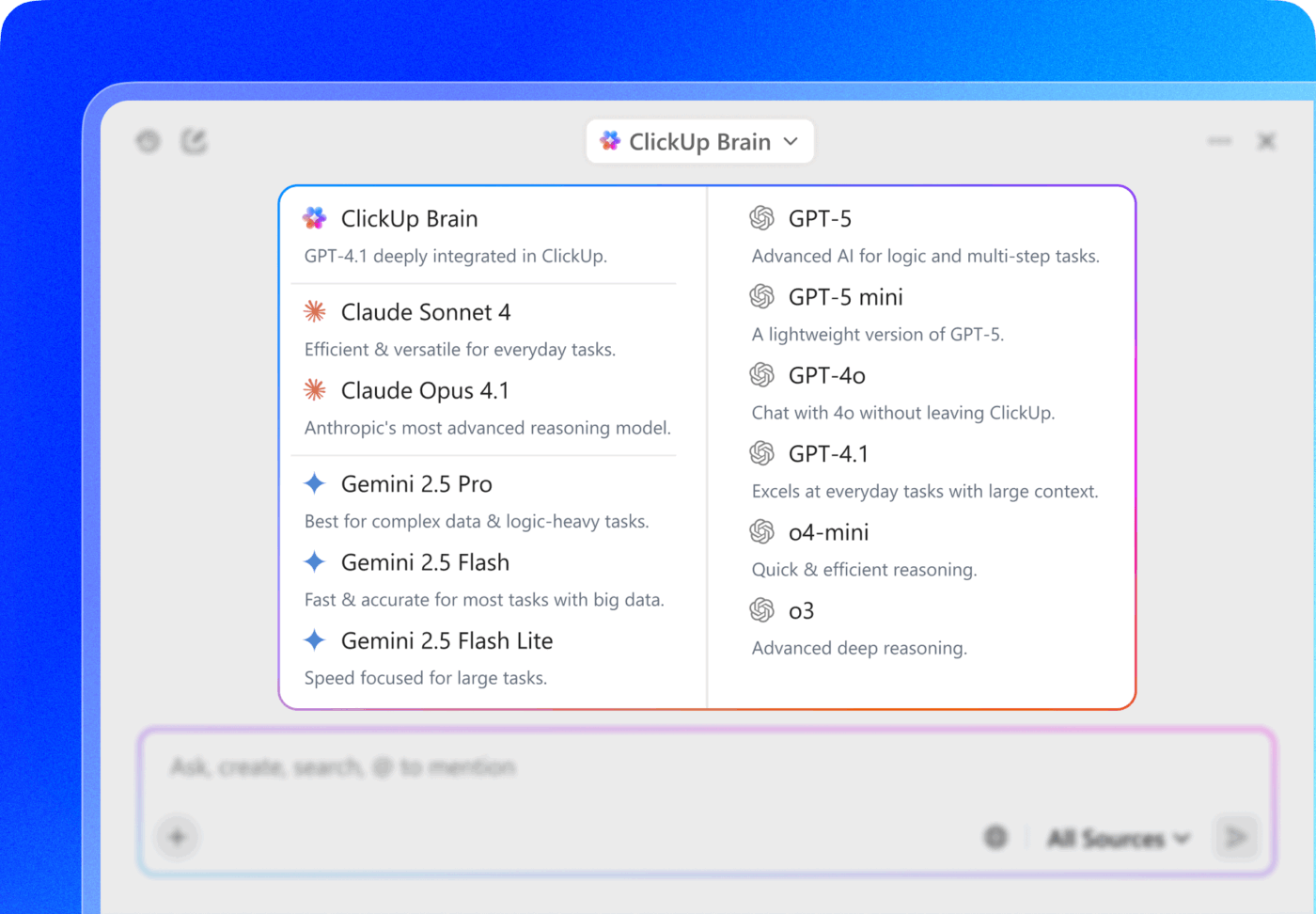

ClickUp Brain beseitigt all diese Reibungsverluste, indem es KI direkt in den Arbeitsbereich integriert, den Sie bereits nutzen. Sie können auf mehrere KI-Modelle zugreifen, Bilder generieren, Code schreiben oder debuggen, im Internet suchen, Dokumente zusammenfassen und vieles mehr – ohne zwischen Tools zu wechseln oder den Fokus zu verlieren.

Es ist Ihr Partner für Ambient-KI – einfach zu bedienen und für alle im Team zugänglich.

Limitationen bei der Nutzung lokaler KI für KI-Workflows

Lokale KI ist ein leistungsstarkes Tool, aber kein Allheilmittel für jedes Problem. Wenn Sie ihre Grenzen kennen, können Sie besser entscheiden, wann Sie eine Aufgabe auf Ihrer eigenen Hardware ausführen und wann Sie die Cloud nutzen sollten. Für manche Teams könnten die technischen und finanziellen Kompromisse die Vorteile für den Datenschutz überwiegen.

- Leistungsgrenze: Hochwertige proprietäre Modelle haben im Vergleich zu Open-Source-Versionen nach wie vor einen leichten Vorsprung bei komplexen Schlussfolgerungen und kreativen Nuancen.

- Hardware-Investition: Eine schnelle Verarbeitung großer Modelle erfordert teure GPUs mit großem VRAM. Dies kann für kleine Teams hohe Vorlaufkosten bedeuten.

- Wartungsaufwand: Sie sind für alle Software-Updates, die Fehlerbehebung bei der Hardware und die Installation von Patches zur Sicherheit verantwortlich, ohne dass Ihnen das Support-Team eines Anbieters zur Seite steht.

- Technisches Fachwissen: Die Optimierung einer lokalen Umgebung erfordert praktische Kenntnisse in den Bereichen Modellquantisierung und Konfiguration der Server

- Sicherheitsmanagement: Im Gegensatz zu Cloud-Diensten verfügen lokale Modelle nicht über integrierte Moderationsfunktionen. Sie müssen eigene Inhaltsfilter und Sicherheitsvorkehrungen implementieren.

- Stromverbrauch: Die Ausführung groß angelegter KI-Modelle auf Ihren eigenen Servern oder Workstations kann Ihren Stromverbrauch und Ihren Kühlbedarf erheblich erhöhen.

Viele Teams verfolgen einen hybriden Ansatz: lokale KI für sensible Daten, Cloud-KI für weniger sensible Aufgaben, die maximale Leistungsfähigkeit erfordern. Hier eine kurze Übersicht über den Vergleich zwischen den beiden:

| Faktor | Lokale KI | Cloud KI |

|---|---|---|

| Datenschutz | Volle Kontrolle | An den Anbieter gesendete Daten |

| Komplexität des Setups | Weiter | Niedriger |

| Laufende Kosten | Hardware + Strom | Gebühren pro Token |

| Modellfunktionen | Gut, verbessert sich | Auf dem neuesten Stand der Technik |

| Wartung | Selbstverwaltet | Vom Anbieter verwaltet |

Wie ClickUp sichere KI-gestützte Workflows unterstützt

Die meisten Teams stehen heute vor einem Dilemma: Entweder nutzen sie leistungsstarke Cloud-KI und machen sich Gedanken darüber, wohin ihre Daten gelangen, oder sie richten lokale Modelle ein und müssen sich mit den damit verbundenen laufenden Kosten auseinandersetzen. ClickUp umgeht dieses Dilemma, indem es als konvergierter KI-Workspace fungiert – in dem die KI bereits in dem System integriert ist, in dem Ihre Arbeit stattfindet.

ClickUp Brain ist die direkt in den ClickUp-Arbeitsbereich integrierte KI-Ebene, die darauf ausgelegt ist, Ihre Aufgaben, Dokumente und Teamkommunikation an einem Ort zu erfassen. Sie bietet KI-Unterstützung mit vollständigem Kontext – ohne separate Tools und ohne instabile Integrationen.

Für Teams, die sichere KI-Workflows aufbauen möchten, ist diese Kombination aus Kontext und Kontrolle der entscheidende Unterschied zwischen Experimentieren und tatsächlicher Einführung.

🌟 ClickUp ist zudem SOC 2-konform und hält sich an die ISO 42001-Standards für verantwortungsbewusstes KI-Management. Dadurch wird sichergestellt, dass Ihre Daten niemals zum Trainieren von Modellen Dritter verwendet werden, sodass Sie Ihre Arbeit mit dem gleichen Vertrauen automatisieren können wie bei einem lokalen Setup.

Nutzen Sie Such- und autonome Workflows mit ClickUp Brain

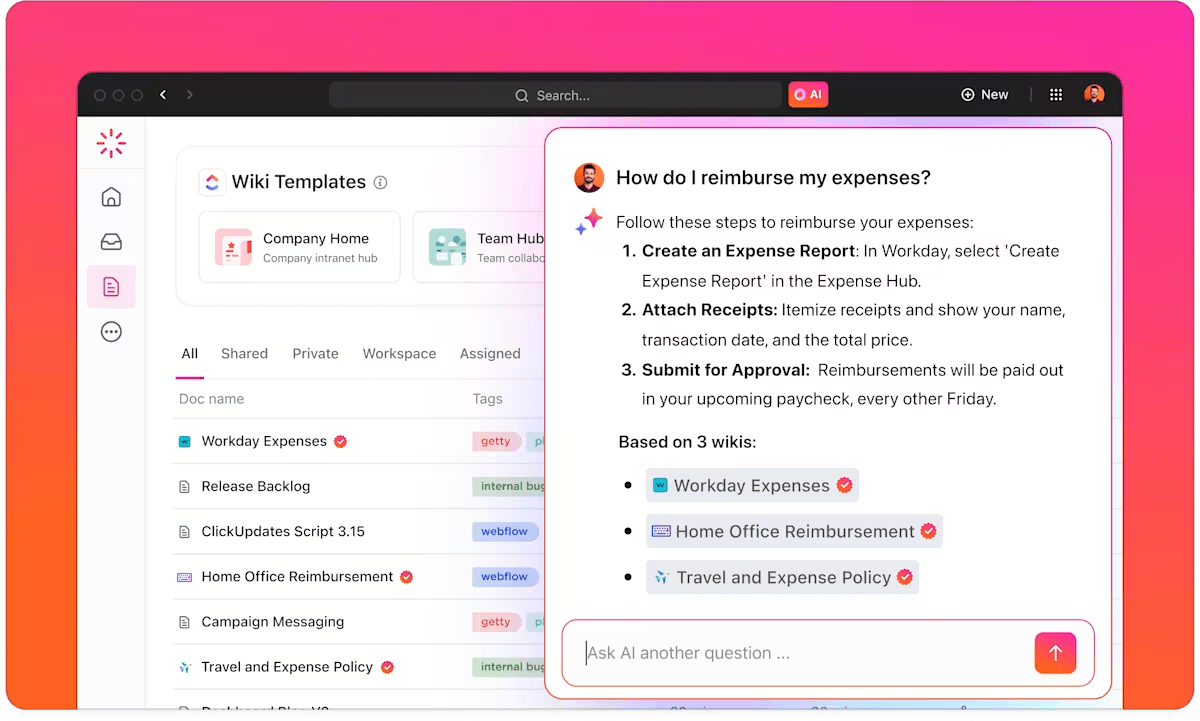

Sobald Ihre Daten im Workspace gesichert sind, extrahiert ClickUp Brain in Echtzeit Wert aus Ihren Aufgaben und Dokumenten.

Da die KI eingebettet ist, vermeidet sie die Kontextlücke, die lokale Setups verlangsamt. Sie können ihr Fragen stellen, deren genaue Beantwortung eine vollständige Ansicht Ihrer Projektgeschichte erfordert:

- Ermitteln Sie die endgültigen Entscheidungen aus einem langen technischen Bericht, ohne durch verschiedene Versionen scrollen zu müssen

- Entwürfe für Stakeholder-Updates aus Kommentaren zu Aufgaben und Status-Änderungen

ClickUp Brain generiert Antworten auf der Grundlage Ihrer Workspace-Daten, indem es die spezifischen Inhalte Ihrer Dokumente, Aufgaben und Chats analysiert. So wird sichergestellt, dass die KI im Laufe Ihres Projekts stets über den aktuellsten Kontext verfügt.

So kann Ihr Team auf Erkenntnissen aufbauen, ohne die Geschichte des Projekts manuell erneut erklären oder Daten zwischen nicht miteinander verbundenen Tools verschieben zu müssen.

💡Profi-Tipp: Sie können den Kontext Ihres Workspaces noch weiter ausbauen, indem Sie mit der Enterprise AI Search Informationen aus all Ihren externen tools abrufen.

Stellen Sie beispielsweise eine komplexe Frage wie „Zeige mir alle offenen Deals in der Pipeline“, und ClickUp Brain durchsucht Ihre verbundenen Apps, darunter Slack, Google Drive und Gmail, um Ihnen eine zuverlässige Antwort in Echtzeit mit Quellenangaben zu liefern.

Dadurch werden fragmentierte Daten auf mehreren Plattformen zu einer einzigen, durchsuchbaren Informationsschicht zusammengefasst, in der Sie jede Datei, Nachricht oder Aufgabe finden können, ohne Ihren Workspace verlassen zu müssen.

Verwalten Sie Aufgaben intelligent mit Automatisierung und KI

ClickUp Brain unterstützt Sie nicht nur passiv – es arbeitet aktiv in Ihrem Aufgabensystem mit. Es kann:

- Erstellen Sie Aufgaben aus Meeting-Notizen oder Dokumenten

- Teilen Sie große Projekte in Unteraufgaben auf

- Schlagen Sie Eigentümer von Aufgaben basierend auf früheren Aktivitäten vor

- Empfehlen Sie Fristen basierend auf dem Kontext des Projekts

Es kann außerdem den Status von Aufgaben aktualisieren, lange Kommentarthreads zu klaren nächsten Schritten zusammenfassen und Hindernisse kennzeichnen, bevor sie die Ausführung verlangsamen.

In Kombination mit ClickUp Automatisierung entsteht so ein geschlossenes System: KI kann Workflows (wie das Zuweisen von Aufgaben, das Benachrichtigen von Beteiligten oder das Aktualisieren von Prioritäten) basierend auf Änderungen in Ihrem Workspace auslösen.

Als Beispiel kann man sagen, dass ein Dokument, wenn es fertiggestellt ist, automatisch Aufgaben erstellt und zugewiesen bekommt, ohne dass jemand Daten manuell zwischen Tools verschiebt.

💟 Bonus: Machen Sie ClickUp Brain MAX zu Ihrem „Entscheidungsgedächtnis“.

Nutzen Sie dies für:

- Fassen Sie lange Kommentarthreads zu klaren Entscheidungen und nächsten Schritten zusammen

- Aktualisieren Sie die Dokumente nach wichtigen Meilensteinen mit den Angaben „Was hat sich geändert und warum?“

- Erstellen Sie wöchentliche Entscheidungsprotokolle aus Aufgaben, Meetings und Updates

Im Laufe der Zeit entsteht so eine lebendige Ebene institutionellen Wissens, auf die Brain MAX zurückgreifen kann. Anstatt also isoliert auf Eingaben zu reagieren, beginnt es, unter Berücksichtigung früherer Entscheidungen, Prioritäten und Muster zu antworten.

Dann wird KI nicht mehr nur hilfreich, sondern zuverlässig – insbesondere in sicheren KI-Workflows, bei denen Kontext und Nachverfolgbarkeit eine wichtige Rolle spielen.

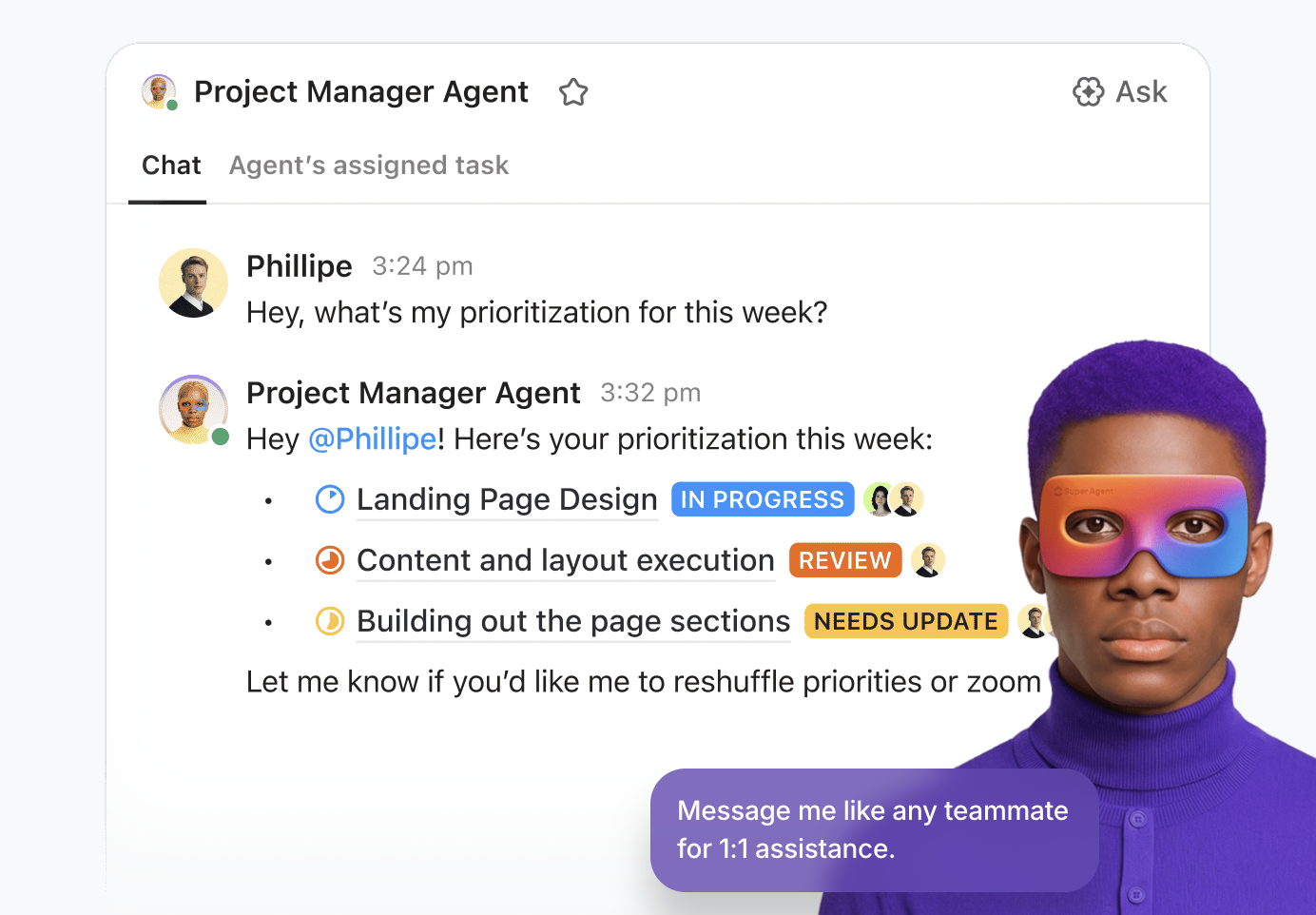

Sicherheit und kontextbezogene Ausführung in großem Maßstab mit Super Agents

Die Super-Agenten von ClickUp bringen ClickUp Brain einen Schritt weiter – von der Unterstützung bei der Arbeit hin zur aktiven Steuerung. Diese Agenten können so konfiguriert werden, dass sie Workflows überwachen, Maßnahmen ergreifen und Aufgaben in Ihrem gesamten Workspace auf der Grundlage vordefinierter Regeln und des Echtzeitkontexts koordinieren.

Ein Super Agent kann beispielsweise:

- Überwachen Sie eingehende Anfragen oder Dokumente und wandeln Sie diese automatisch in strukturierte Aufgaben mit Eigentümern und Fristen um

- Verfolgen Sie den Fortschritt des Projekts und kennzeichnen Sie Risiken oder Verzögerungen, bevor sie eskalieren

- Lösen Sie mehrstufige Automatisierungen aus, wenn bestimmte Bedingungen erfüllt sind – beispielsweise die Benachrichtigung von Beteiligten, die Aktualisierung von Prioritäten oder die Erstellung von Folgeaufgaben

Diese Agenten laufen vollständig innerhalb des einheitlichen ClickUp-Workspaces und haben vollständigen Überblick über Ihre Aufgaben, Dokumente und Berechtigungen. Das bedeutet:

- Sie müssen keine Daten in externe KI-Systeme oder Orchestrierungstools exportieren

- Sie greifen nur auf Daten zu, für die sie eine Berechtigung haben

- Sie agieren innerhalb derselben Berechtigungskreise wie Ihr Team

Erhalten Sie weitere Informationen über die Arbeit mit Super Agents:

Profitieren Sie von KI-Unterstützung in Ihren Dokumenten

Mit ClickUp Docs wird KI-Unterstützung direkt in Ihre Dokumentations-Workflows integriert. Teams können Projektbeschreibungen entwerfen, lange Berichte zusammenfassen, Aktionspunkte extrahieren oder Inhalte für verschiedene Zielgruppen umschreiben – und das alles, ohne die Plattform zu verlassen.

Dies ist für sichere KI-Workflows von Bedeutung, da eines der größten Risiken darin besteht, sensible Informationen in externe Tools zu kopieren und einzufügen. In ClickUp minimieren Sie den Datentransfer und behalten durch Berechtigungen die volle Kontrolle über den Zugriff.

Fazit: Aufbau Ihres privaten KI-Stacks

Lokale KI nutzt künstliche Intelligenz und gewährleistet gleichzeitig die vollständige Kontrolle über Datenschutz und Compliance. Dieser Weg erfordert jedoch erhebliche Investitionen in Hardware, technisches Setup und laufende Wartung.

Sicherheit ist nach wie vor von entscheidender Bedeutung, unabhängig davon, ob Sie lokale oder Cloud-KI nutzen. Die effektivste Strategie besteht oft in einem hybriden Ansatz: der Einsatz lokaler KI für die sensibelsten Vorgänge bei gleichzeitiger Nutzung verwalteter, sicherer Lösungen für die tägliche Produktivität.

Es ist entscheidend, Kompromisse abzuwägen – für viele Teams ist der Aufwand einer DIY-Lösung möglicherweise nicht die richtige Wahl.

Für alle, die leistungsstarke KI-Produktivität ohne den Aufwand für die Infrastruktur wünschen, bieten Managed Solutions wie ClickUp Brain einen überzeugenden Mittelweg. Sie bieten Sicherheit auf Enterprise-Niveau ohne jeglichen Setup-Aufwand.

Starten Sie kostenlos mit ClickUp und entdecken Sie sichere, kontextbezogene, KI-gestützte Workflows für Ihr Team.

Häufig gestellte Fragen

Was ist der Unterschied zwischen lokaler KI und cloudbasierter KI für Team-Workflows?

Lokale KI läuft vollständig auf Ihrer eigenen Hardware, wodurch sichergestellt wird, dass Daten Ihr internes Netzwerk niemals verlassen, während Cloud-KI zur Verarbeitung Anfragen an Server von Drittanbietern sendet. Lokale Setups bieten vollständige Datenhoheit und Offline-Zugriff, während Cloud-Dienste höhere Rechenleistung und Benutzerfreundlichkeit bieten, allerdings auf Kosten der direkten Datenkontrolle.

Wie können Teams lokale KI-Modelle mit vertraulichen Daten eines Projekts nutzen?

Teams können lokale KI nutzen, um sensible Dokumente, proprietären Code und Finanzunterlagen zu verarbeiten, indem sie das Modell auf private Verzeichnisse vor Ort verweisen. Da die Inferenz auf dem Gerät selbst erfolgt, können Sie Aufgaben wie automatisierte Zusammenfassungen, Datenextraktion und interne Wissenssuchen durchführen, ohne das Risiko einzugehen, dass Daten in öffentlichen LLM-Trainingsdatensätzen offengelegt werden.

Sind lokale KI-Modelle für Aufgaben in der Arbeit genauso leistungsfähig wie ChatGPT?

Viele lokale Open-Source-Modelle wie Llama 3 und Mistral sind mittlerweile in der Lage, Routineaufgaben wie das Verfassen von Entwürfen, das Programmieren und das Erstellen von Zusammenfassungen zu bewältigen. Während erstklassige Cloud-Modelle wie GPT-4o bei hochkomplexen Denkprozessen nach wie vor führend sind, bieten lokale Modelle bei 90 % der täglichen Aufgaben im Geschäft eine vergleichbare Leistung bei deutlich besserem Datenschutz.

Was sind die Vor- und Nachteile der lokalen KI-Nutzung im Vergleich zur Nutzung von Cloud-KI-Diensten?

Der wichtigste Kompromiss besteht in der Wahl zwischen vollständigem Datenschutz durch lokale KI und der wartungsfreien Skalierbarkeit von Cloud-KI. Die lokale Nutzung von KI erfordert zwar eine anfängliche Investition in Hardware und technisches Fachwissen, eliminiert jedoch wiederkehrende API-Gebühren und das Risiko von Datenlecks. Cloud-KI lässt sich schneller bereitstellen, ist jedoch mit laufenden Abonnementkosten und der Abhängigkeit von Daten Dritter verbunden.