Volgens een onderzoek van Gallup voelt slechts 21% van de werknemers wereldwijd zich betrokken bij het werk, maar de meeste leidinggevenden ontdekken problemen met het moreel pas wanneer uit exitgesprekken patronen naar voren komen die ze maandenlang over het hoofd hebben gezien.

In deze gids wordt uitgelegd hoe AI-team moreel monitoring gebruikmaakt van natuurlijke taalverwerking en gedragsanalyse om vroege waarschuwingssignalen van verminderde betrokkenheid te detecteren.

U leert welke ethische kaders nodig zijn om dit te implementeren zonder het vertrouwen te schaden. En u ontdekt hoe geconvergeerde werkruimten zoals ClickUp de uniforme context bieden die AI nodig heeft om nauwkeurige inzichten te leveren waarmee u uw team proactief kunt ondersteunen.

Wat is AI-team moreel monitoring?

Jaarlijkse pulse-enquêtes en individuele vergaderingen geven u een momentopname, maar het moreel van uw team verandert dagelijks, niet per kwartaal. Dit betekent dat u voortdurend achter de feiten aanloopt en probeert problemen op te lossen die al maandenlang sluimeren. Tegen de tijd dat een probleem aan het licht komt tijdens een beoordeling, zijn uw beste mensen misschien al op zoek naar een andere baan.

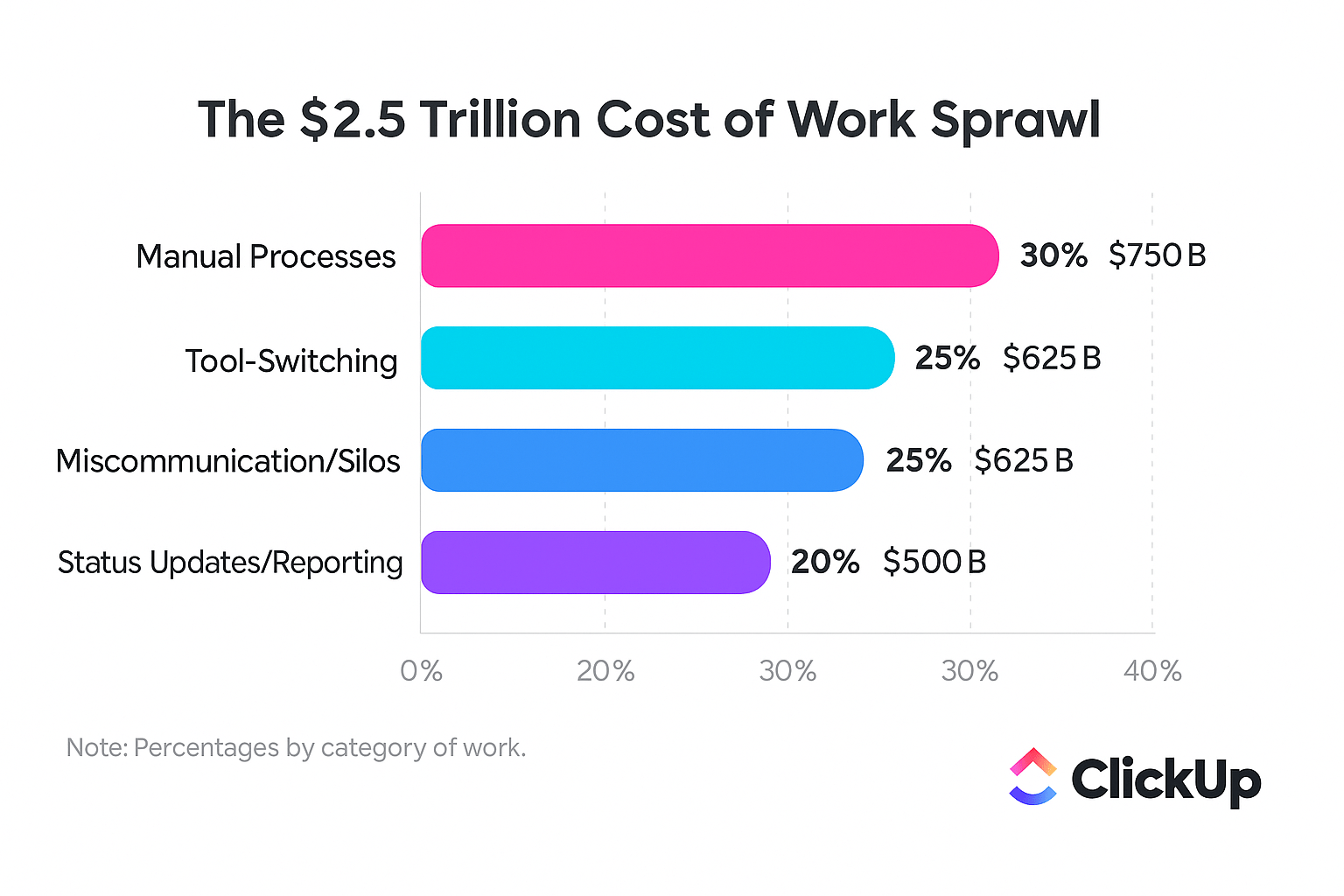

Je komt er pas achter dat iemand niet meer betrokken is als diegene zijn ontslag indient, en dan is het al te laat. Dit gebeurt door versnippering van de context: de feedback van je team, projectupdates en informele gesprekken zijn verspreid over Slack, e-mail en een tiental andere tools.

De gemiddelde kenniswerker ontvangt tegenwoordig dagelijks 117 e-mails en 153 berichten. Contextversnippering ontstaat wanneer teams urenlang zoeken naar informatie op losstaande platforms die niet met elkaar communiceren. Het is onmogelijk om de verbanden te leggen en een volledig beeld te krijgen van de gezondheid van uw team.

Hier komt AI-team moreel monitoring om de hoek kijken. Dit is de praktijk waarbij kunstmatige intelligentie wordt gebruikt om continu gegevens over de werkplek te analyseren, zoals berichten, taakvoltooiingspercentages en vergaderingspatronen, om veranderingen in het sentiment van werknemers in realtime te identificeren. Dit gaat niet om surveillance, maar om het bieden van bruikbare context aan u als leidinggevende, die u anders zou missen.

In plaats van verrast te worden door personeelsverloop, krijgt u een vroege waarschuwing dat de betrokkenheid van een lid van het team afneemt. Dit geeft u de kans om in te grijpen en het lid te ondersteunen voordat een klein probleem een groot probleem wordt.

Om dit effectief te kunnen doen, heeft de AI een volledige weergave nodig, wat alleen mogelijk is in een geconvergeerde werkruimte waarin communicatie, taken en documentatie zijn gecentraliseerd.

📮ClickUp Insight: 83% van de kenniswerkers vertrouwt voornamelijk op e-mail en chat voor teamcommunicatie. Bijna 60% van hun werkdag gaat echter verloren met het schakelen tussen deze tools en het zoeken naar informatie. Met een alles-in-één app voor werk zoals ClickUp komen uw projectmanagement, berichten, e-mails en chats allemaal samen op één plek! Het is tijd om te centraliseren en energie te steken in uw werk!

📮ClickUp Insight: 83% van de kenniswerkers vertrouwt voornamelijk op e-mail en chat voor teamcommunicatie. Bijna 60% van hun werkdag gaat echter verloren met het schakelen tussen deze tools en het zoeken naar informatie. Met een alles-in-één app voor werk zoals ClickUp komen uw projectmanagement, berichten, e-mails en chats allemaal samen op één plek! Het is tijd om te centraliseren en energie te steken in uw werk!

Bekijk dit overzicht van AI-tools die speciaal zijn ontworpen voor HR-professionals om meer inzicht te krijgen in het bredere landschap van AI-toepassingen in HR en hoe deze tools het personeelsbeheer transformeren.

Hoe AI vroege tekenen van een daling van het moreel van het team detecteert

Subtiele signalen, zoals een andere energie tijdens vergaderingen of kortere berichten tijdens het chatten, zijn moeilijk om op te reageren. Je aarzelt om in te grijpen omdat je niet overdreven wilt reageren op een slechte dag, maar je wilt ook geen echt probleem negeren.

Door deze vertraging kunnen kleine problemen escaleren en uitgroeien tot een aanzienlijke afname van de betrokkenheid. Onderzoek toont aan dat veranderingen in de communicatie vijf maanden voordat managers daadwerkelijk ontslag nemen, zichtbaar worden.

Het kernprobleem is dat al deze subtiele signalen verspreid zijn over te veel plaatsen – hier een negatieve opmerking, daar een gemiste deadline – en dat je de verbindingen niet handmatig kunt leggen. AI-morale monitoring fungeert als je patroonherkenningsengine en analyseert meerdere datastromen tegelijk om je een duidelijker signaal te geven. ✨

Dit proces zorgt ervoor dat u niet langer op uw intuïtie hoeft te vertrouwen, maar kunt werken met op gegevens gebaseerde hypothesen. De AI geeft u geen oordeel, maar biedt u een startpunt voor een nieuwsgierig, ondersteunend gesprek.

Sentimentanalyse in communicatietools

Een van de belangrijkste manieren waarop AI veranderingen in het moreel detecteert, is door middel van sentimentanalyse. Hierbij wordt gebruikgemaakt van een technologie die natural language processing (NLP) wordt genoemd, wat in feite AI is die de emotionele toon van geschreven tekst kan lezen en begrijpen. Het scant berichten in de chatplatforms, e-mails en taakcommentaren van uw team om veranderingen in communicatiepatronen te identificeren.

De AI zoekt naar taalkundige aanwijzingen die op een probleem kunnen duiden, zoals:

- Een toename van negatieve of passieve taal

- Een afname van enthousiaste of positieve woorden

- Antwoorden die consequent korter zijn dan normaal

Een geavanceerd model kan onderscheid maken tussen iemand die gewoon een slechte dag heeft en een aanhoudend patroon dat wijst op een dieper liggend probleem.

Om dit te laten werken, moet de AI echter beschikken over volledige organisatorische contextuele nauwkeurigheid. Zonder kennis van de deadline van het project of de moeilijkheidsgraad van de Taak die wordt besproken, kan de AI normale projectstress verkeerd interpreteren als een moreelprobleem, of erger nog, echte waarschuwingssignalen missen die verborgen zijn in informele gesprekken.

Betrokkenheidspatronen en signalen over productiviteit

Naast wat uw teamleden schrijven, houdt AI ook hoe ze werken bij door hun digitale lichaamstaal te analyseren, een belangrijk onderdeel van gedragsanalyse. Het gaat hier niet om het meten van output voor prestatiebeoordelingen, maar om het signaleren van afwijkingen van iemands persoonlijke basisniveau van activiteit. Een plotselinge verandering in gedrag is vaak een betrouwbaardere indicator van een probleem dan een enkele negatieve opmerking.

Belangrijke gedragsanalyses zijn onder meer:

- Inlogfrequentie: Loggen ze later of minder vaak in dan normaal?

- Snelheid waarmee taken worden voltooid: Duurt het aanzienlijk langer om hun taken te voltooien in vergelijking met hun eigen gemiddelde?

- Samenwerkingsfrequentie: Zijn ze gestopt met het plaatsen van opmerkingen, het delen van bestanden of het samenwerken met teamgenoten zoals ze dat vroeger deden?

- Reactietijden: Duurt het plotseling veel langer voordat ze reageren op berichten en vermeldingen?

Een goed presterende engineer die plotseling deadlines niet meer haalt of een doorgaans actieve ontwerper die stil wordt in teamkanalen zijn beide signalen die het onderzoeken waard zijn. Deze patronen worden pas betekenisvol wanneer de AI de volledige werkstroom kan zien, en niet alleen geïsoleerde fragmenten verspreid over losstaande apps.

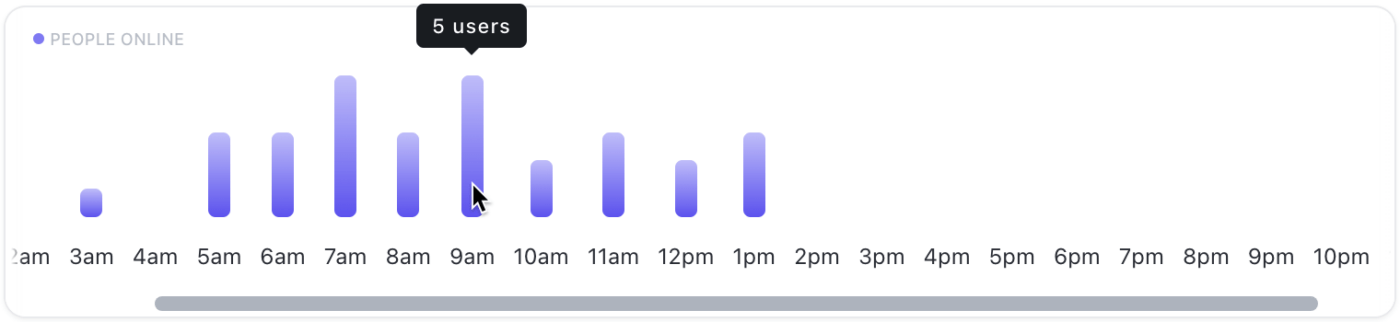

💡 Pro-tip: Bekijk de online status en activiteit van het hele team met ClickUp Analytics.

Voorspellende analyses voor retentierisico's

Voorspellende analyses gaan nog een stap verder door sentiment- en betrokkenheidsgegevens te combineren om potentieel verloop te voorspellen. Het AI-model leert van de historische patronen van uw organisatie door de signalen te analyseren die voorafgingen aan het vertrek van eerdere werknemers. Vervolgens past het die lessen toe op de gegevens van uw huidige team om te identificeren wie een verhoogd risico loopt op desinteresse.

Het is belangrijk om te onthouden dat deze voorspellingen geen zekerheden zijn; het zijn aanwijzingen voor managers om proactieve gesprekken te voeren.

Dit proces genereert een retentierisicoscore, een belangrijke indicator voor potentieel verloop. Moderne AI-modellen kunnen een voorspellingsnauwkeurigheid van 92% bereiken.

De nauwkeurigheid van deze voorspellingen verbetert aanzienlijk wanneer de AI toegang heeft tot de volledige context. Dit omvat niet alleen communicatie- en taakgegevens, maar ook projectgeschiedenis, werklastverdeling, interacties met collega's en zelfs informatie over loopbaanvoortgang, allemaal op één plek.

📚 Lees ook: De beste softwaretools voor personeelsmanagement

Voordelen en risico's van AI-morele monitoring

AI-monitoring roept terechte zorgen op over het surveilleren van werknemers of het handelen op basis van verkeerde informatie. Deze angst kan leiden tot analyseverlamming, waardoor u vasthoudt aan oude, ineffectieve methoden terwijl uw team kwetsbaar blijft voor de burn-out die u juist probeert te voorkomen.

Benader het met een evenwichtig perspectief. Door zowel de potentiële voordelen als de valkuilen te begrijpen, kunt u een strategie ontwikkelen die de voordelen maximaliseert en de risico's beperkt.

| Voordeel | Risico |

|---|---|

| Proactieve interventie. U kunt problemen signaleren en aanpakken voordat ze escaleren tot personeelsverloop, waardoor u de kosten en verstoring van het verlies van een waardevol teamlid bespaart. | Verkeerde interpretatie zonder context. Als de AI geen volledige weergave heeft van het werk, kan het normale stress als een crisis signaleren, wat tot onnodige interventies leidt. |

| Datagestuurde inzichten. AI levert objectieve gegevens die een aanvulling vormen op de intuïtie van managers, waardoor zij met meer vertrouwen en beter geïnformeerd beslissingen kunnen nemen. | Ongemak bij werknemers. Als de monitoring als opdringerig wordt ervaren of het doel ervan niet duidelijk wordt gecommuniceerd, kan dit het vertrouwen dat u probeert op te bouwen juist ondermijnen. |

| Trends binnen het hele team signaleren. AI kan systemische problemen identificeren, zoals een burn-outrisico binnen een hele afdeling, die bij individuele gesprekken mogelijk over het hoofd worden gezien. | Overmatige afhankelijkheid van automatisering. Als je alleen op AI vertrouwt zonder menselijk oordeel, kan dat leiden tot een steriele, onpersoonlijke cultuur waarin managers geen echte gesprekken meer voeren. |

Uiteindelijk worden de voordelen pas werkelijkheid wanneer de AI over voldoende context beschikt en wanneer uw organisatie de inzichten combineert met doordachte, menselijke follow-up.

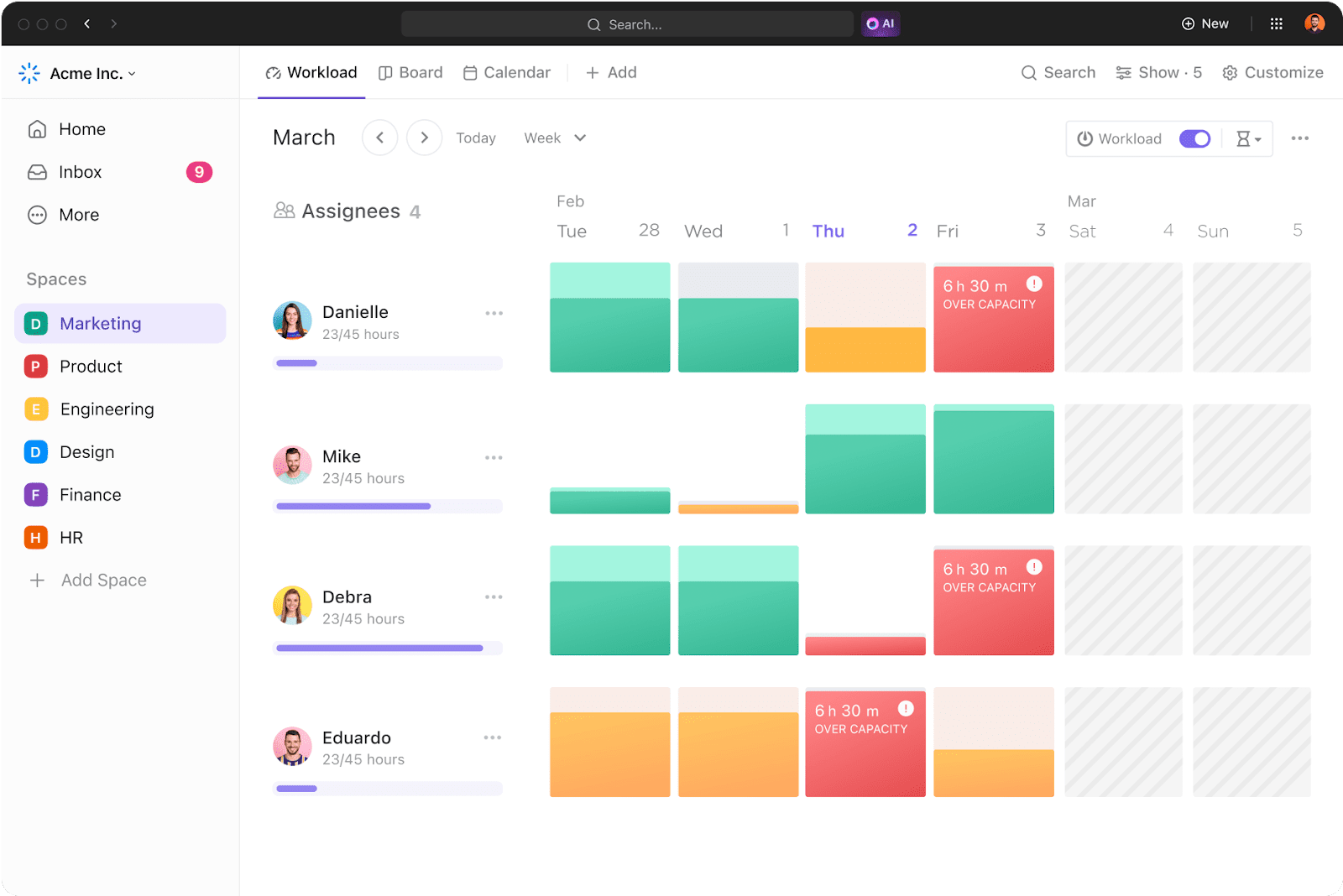

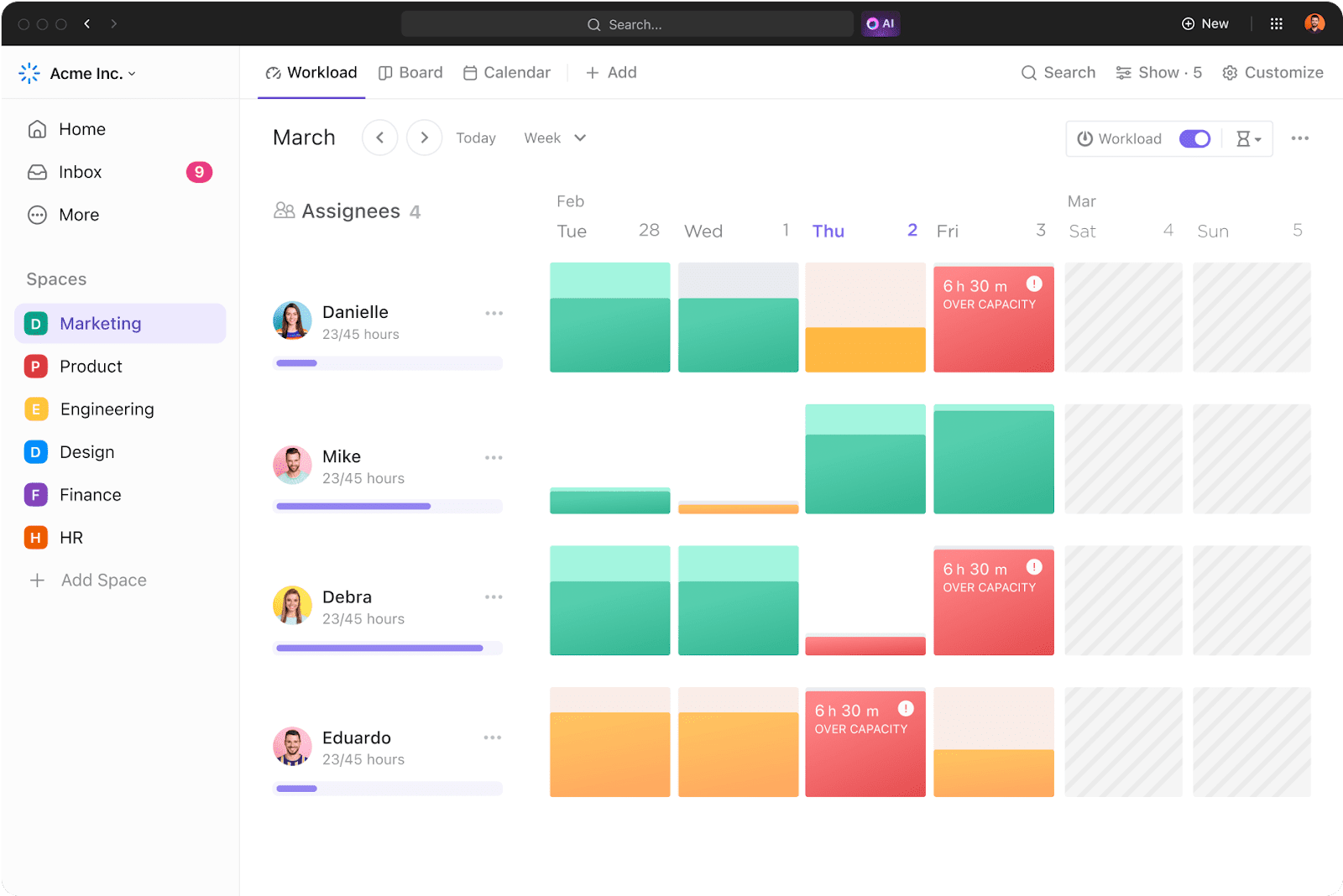

📮ClickUp Insight: Uit onze enquête over de balans tussen werk en privé bleek dat 46% van de werknemers 40-60 uur per week werkt, terwijl maar liefst 17% meer dan 80 uur werkt! Maar daar houdt het niet op: 31% heeft moeite om consequent tijd voor zichzelf vrij te maken. Dat is een perfect recept voor een burn-out. 😰Maar weet je wat? Balans op het werk begint met zichtbaarheid! De ingebouwde functies van ClickUp, zoals werklastweergave & tijdsregistratie, maken het gemakkelijk om de werklast te visualiseren, taken eerlijk te verdelen en de daadwerkelijk bestede uren bij te houden, zodat je altijd weet hoe en wanneer je het werk kunt optimaliseren. 💫 Echte resultaten: Lulu Press bespaart 1 uur per dag per werknemer door gebruik te maken van ClickUp-automatiseringen, wat leidt tot een toename van 12% in werkefficiëntie.

Ethische overwegingen voor AI-gestuurde teammonitoring

Het ethisch implementeren van AI-monitoring vereist het navigeren door een complex moreel en juridisch landschap. Een misstap kan de reputatie van uw bedrijf en de psychologische veiligheid van uw team schaden.

Ethiek vormt geen belemmering voor AI-monitoring, maar juist de blauwdruk voor een succesvolle implementatie ervan. Een ethisch kader dat is gebaseerd op transparantie en een oprechte toewijding aan het welzijn van werknemers is onontbeerlijk. Als u dit goed aanpakt, bouwt u een programma op dat door werknemers wordt gezien als ondersteunend en niet als opdringerig, waardoor het vertrouwen wordt versterkt in plaats van aangetast.

Vereisten op het gebied van privacy en transparantie

Uw medewerkers moeten weten welke gegevens worden verzameld, hoe deze worden geanalyseerd en welke resultaten uit de inzichten kunnen voortvloeien. Dit betekent dat u duidelijke, toegankelijke documentatie van uw monitoringbeleid moet opstellen en deze openlijk moet communiceren. Hoewel privacyregelgeving zoals de AVG specifieke wettelijke vereisten kan opleggen, moet transparantie verder gaan dan louter naleving – het is de basis van vertrouwen.

Als uw team het gevoel heeft dat het wordt gecontroleerd in plaats van ondersteund, zal het zich nog meer terugtrekken, waardoor het hele doel van het initiatief teniet wordt gedaan. Betrek waar mogelijk medewerkers bij de ontwikkeling van dit beleid om draagvlak te creëren en te laten zien dat u hun autonomie respecteert.

Voorkomen van vooringenomenheid bij AI-interpretatie

AI-modellen zijn niet inherent objectief; ze kunnen menselijke vooroordelen overnemen en zelfs versterken als ze zijn getraind op basis van scheve gegevens of onvoldoende context hebben. Een AI-model kan bijvoorbeeld ten onrechte een introverte communicatiestijl aanmerken als een teken van desinteresse of culturele verschillen in uitdrukkingen verkeerd interpreteren als negativiteit. Dit kan leiden tot oneerlijke beoordelingen en de geloofwaardigheid van het hele systeem ondermijnen.

Om dit te voorkomen, moet u de output van de AI regelmatig controleren op eventuele ongelijke effecten op verschillende demografische groepen. Het belangrijkste is dat een sterke leiderschapsfilosofie, gericht op menselijk toezicht, centraal blijft staan in het proces. De rol van de AI is om potentiële signalen aan het licht te brengen, maar het is de taak van de mens om deze te interpreteren, verder te onderzoeken en de uiteindelijke beslissing te nemen.

Best practices voor het monitoren van het moreel van AI-teams

Zonder een duidelijke implementatiestrategie kan zelfs de beste tool ongebruikt blijven of het moreel ondermijnen. Technologie is slechts een stukje van de puzzel. De processen en trainingen die u eromheen bouwt, zijn bepalend voor het succes. Bij de beste implementaties wordt AI gezien als een gespreksstarter, niet als een oordeel, waardoor uw managers betere coaches worden en uw team zich meer ondersteund voelt.

Communiceer monitoringbeleid op transparante wijze

Voordat u AI-monitoring implementeert, moet u duidelijk communiceren wat er wordt bijgehouden, waarom u dit bijhoudt en hoe de inzichten zullen worden gebruikt. De manier waarop u dit gesprek voert, is van groot belang.

- Goede formulering: "We gebruiken AI om onze managers te helpen jullie beter te ondersteunen door potentiële burn-outs vroegtijdig op te sporen. "

- Slechte formulering: "We implementeren een nieuw systeem om uw berichten te monitoren met het oog op productiviteit. "

De eerste aanpak stimuleert samenwerking en bouwt vertrouwen op, terwijl de tweede aanpak defensief gedrag en angst triggert. Leg uw beleid vast op een gemakkelijk toegankelijke plek, zoals een bedrijfsbrede wiki, en plan om dit regelmatig te herzien naarmate uw tools en processen evolueren.

Gebruik AI voor coaching in plaats van controle

Dit is de belangrijkste best practice. AI-gestuurde inzichten in het moreel moeten altijd aanleiding geven tot ondersteunende gesprekken, niet tot disciplinaire maatregelen. Er is een enorm verschil tussen het gebruik van een retentierisico-indicator om een oprecht gesprek in te plannen en het gebruik ervan om iemand onder druk te zetten over zijn of haar betrokkenheid.

Uw team zal snel doorhebben of de AI wordt gebruikt om hen te helpen of om hen in de gaten te houden, en zal daarop reageren. Investeer in training voor uw managers over hoe ze met empathie en nieuwsgierigheid in plaats van wantrouwen kunnen omgaan met AI-inzichten. Het doel is om een dialoog op gang te brengen, niet om een ondervraging te starten.

Balans tussen automatisering en menselijk oordeel

AI blinkt uit in het detecteren van patronen in enorme hoeveelheden gegevens, maar mist het genuanceerde begrip dat mensen intuïtief hebben. De plotselinge afname van de betrokkenheid van een lid van het team kan te wijten zijn aan een persoonlijke crisis, een conflict met een collega of een simpele mismatch in een project. AI kan zonder menselijk onderzoek geen onderscheid maken tussen deze scenario's.

U moet AI-output altijd beschouwen als hypothesen die moeten worden onderzocht, niet als conclusies waarop moet worden gereageerd. De meest effectieve implementaties maken gebruik van een human-in-the-loop-model, waarbij AI ervoor zorgt dat niets door de mazen van het net glipt, maar het menselijk oordeel behouden blijft voor alle daadwerkelijke interventies.

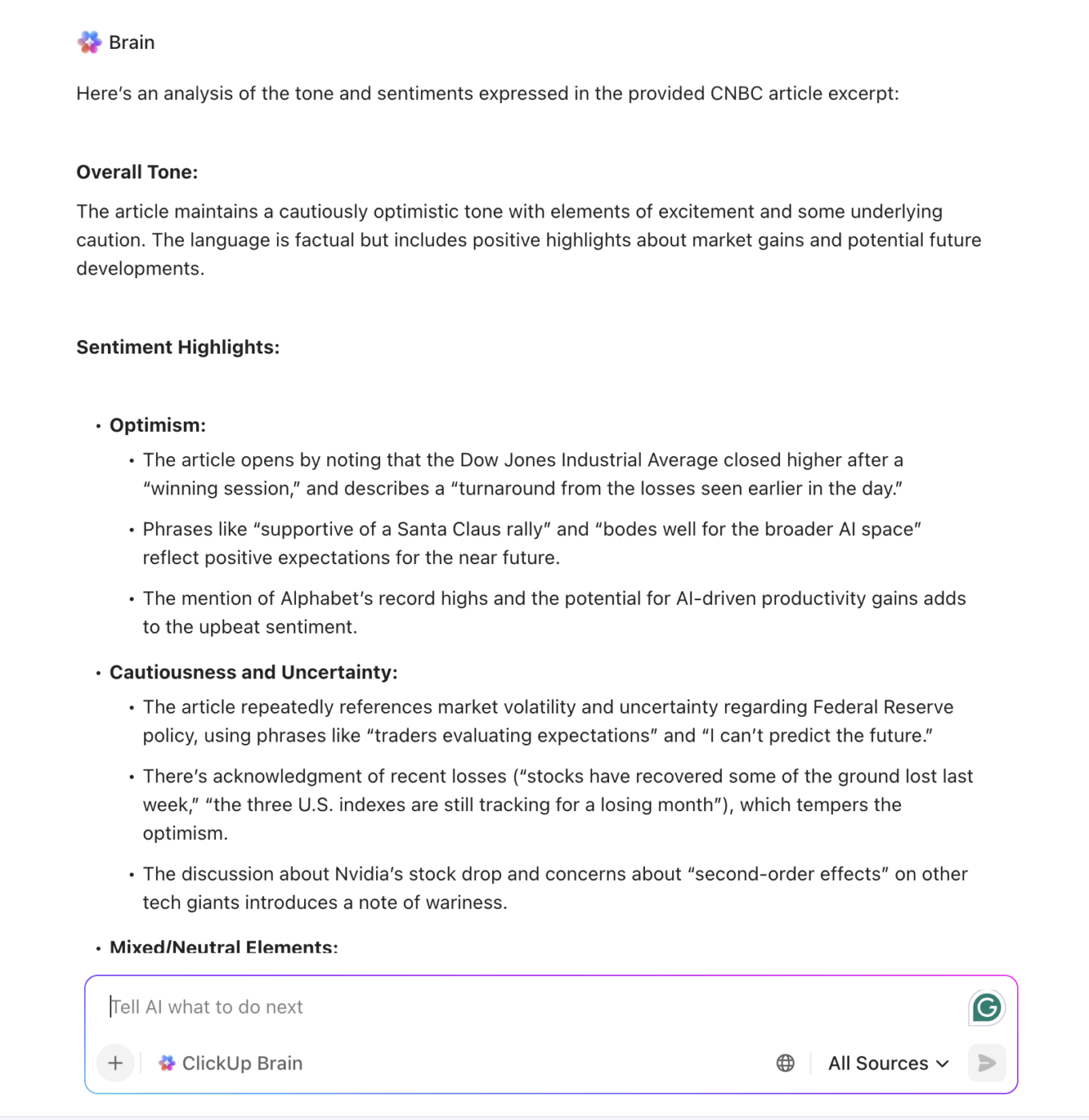

Hoe ClickUp Brain het monitoren van het moreel van teams ondersteunt

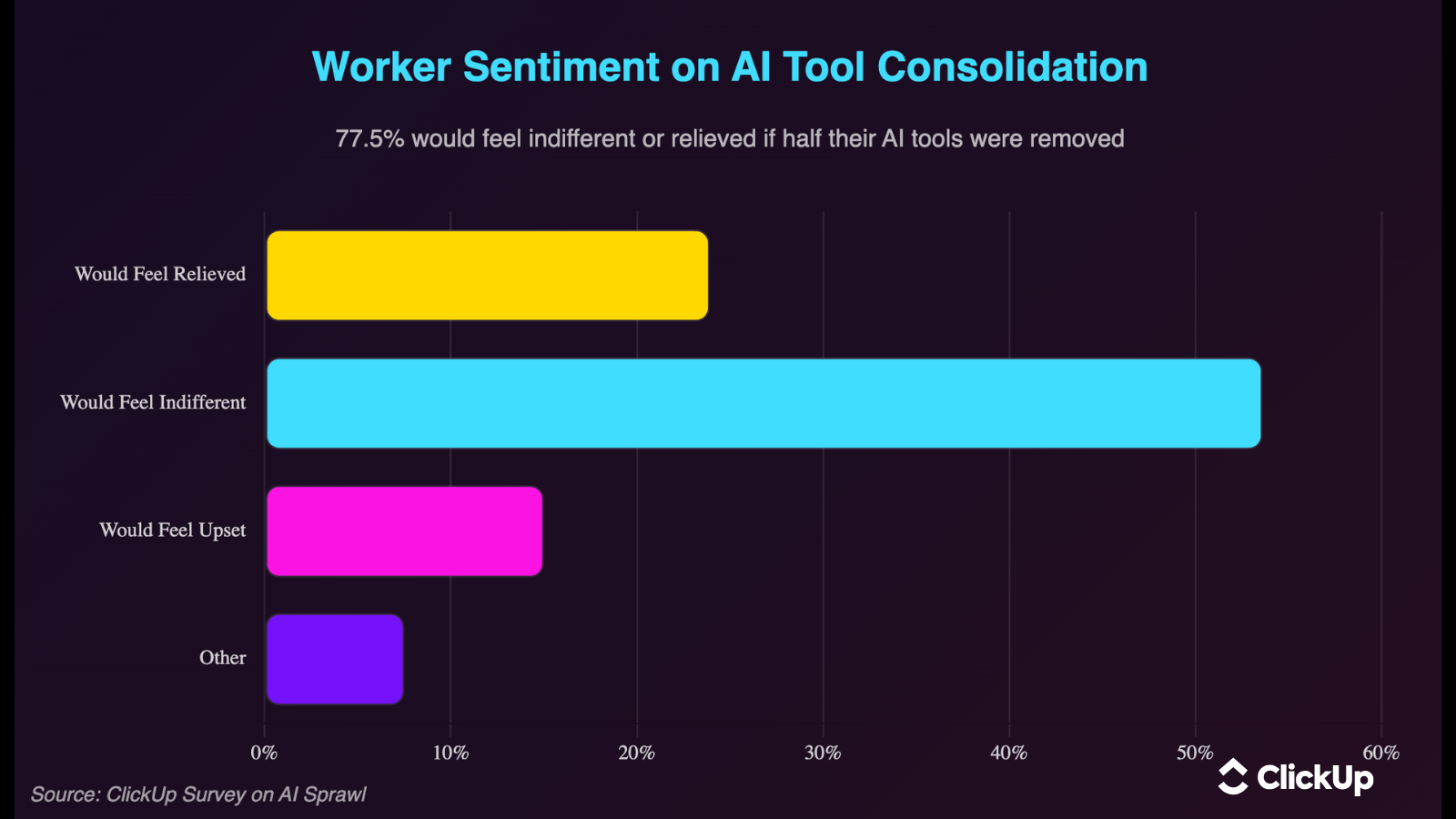

De meeste AI-monitoringtools zijn ofwel invasieve bewakingssoftware of analyseren slechts één enkele databron, zoals chatberichten. Hierdoor bent u genoodzaakt om inzichten uit meerdere dashboards samen te voegen, wat meer werk oplevert en juist de contextversnippering in stand houdt die u probeert op te lossen. Deze versnippering betekent dat de inzichten van uw AI onvolledig en vaak onnauwkeurig zijn.

Maak een einde aan deze AI-wildgroei – de ongeplande proliferatie van losstaande AI-tools en -platforms zonder toezicht of strategie – met ClickUp Brain, de AI-functie die rechtstreeks in de geconvergeerde werkruimte van ClickUp is ingebouwd.

Omdat uw taken, documenten en teamcommunicatie al op één plek staan, heeft ClickUp Brain de native, uniforme context die andere AI-tools missen. Het analyseert het volledige plaatje van hoe uw team werkt, niet alleen geïsoleerde fragmenten. Dit geeft u nauwkeurigere, contextbewuste inzichten zonder dat er nieuwe, ingrijpende monitoringlagen nodig zijn. 🛠️

Hieronder leest u hoe de functies van ClickUp het moreel ondersteunen:

- Inzichten naar boven halen: Breng potentiële sentimentverschuivingen aan het licht zonder urenlang door threads te spitten. Vermeld ClickUp Brain gewoon in een Taak of chat en vraag het om recente activiteiten samen te vatten of terugkerende thema's te identificeren uit opmerkingen, updates en documenten die kunnen wijzen op sentimentverschuivingen binnen het team.

- Zorg voor een gelijkmatige verdeling van de werklast: signaleer ongelijke verdeling van de werklast of overbelasting voordat dit tot een crisis leidt met de werklastweergave.

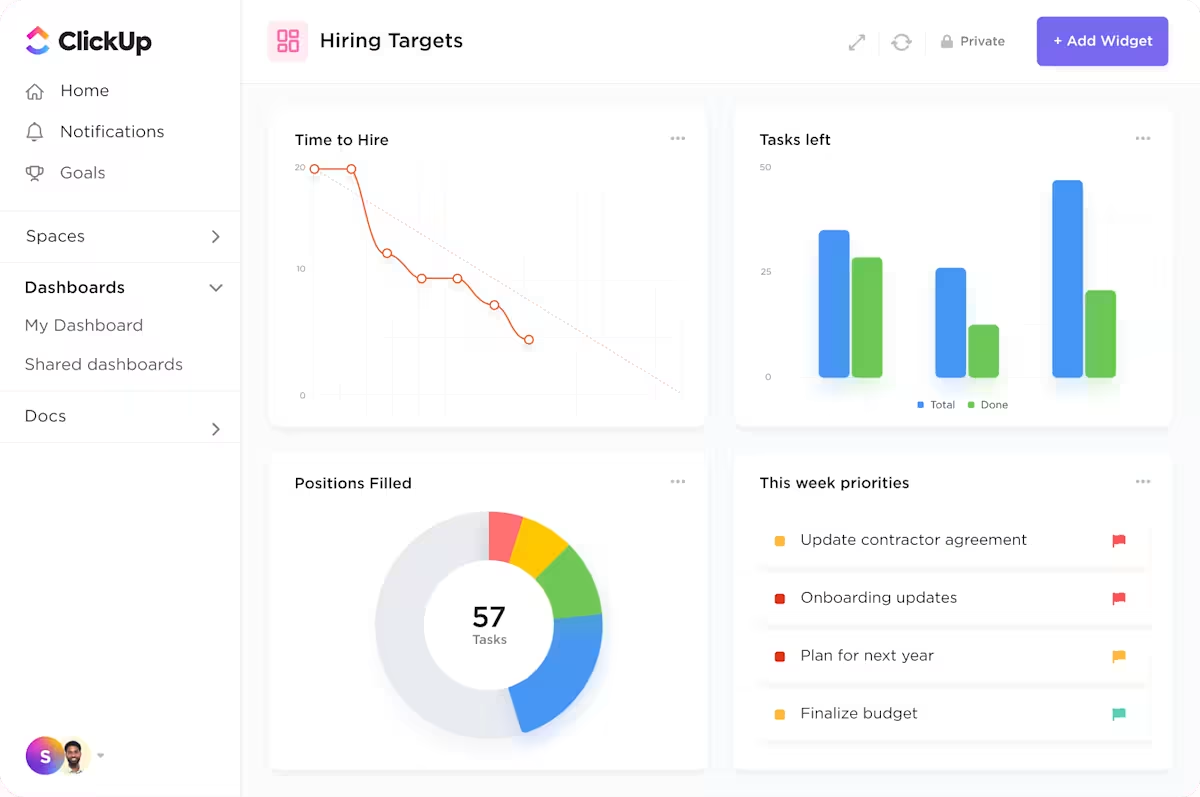

- Teamactiviteiten bijhouden: krijg een overzicht van de productiviteit van je team zonder dat je regelmatig updates hoeft te doen met ClickUp Dashboards. Maak kaarten om taken per persoon, tijdsinschattingen en voltooiingspercentages bij te houden, zodat je een goed beeld krijgt van het werk van je team.

- Automatiseer check-ins: Zorg ervoor dat ondersteunende gesprekken consistent plaatsvinden zonder handmatige tracking door werkstroomen te bouwen met ClickUp automatiseringen. Trigger bijvoorbeeld regelmatig pulse-vragen of herinneringen voor managers om verbinding te leggen met teamleden die veranderde patronen vertonen.

Met ClickUp krijgt u de inzichten die u nodig hebt om een proactieve leider te zijn, allemaal binnen hetzelfde platform waar uw team al zijn werk doet.

Van reactief naar proactief leiderschap

Reageren op personeelsverloop is kostbaar, verstorend en demotiverend voor iedereen die achterblijft. Als u vasthoudt aan verouderde methoden zoals jaarlijkse enquêtes, blijft u goede mensen verliezen aan vermijdbare problemen.

De verschuiving naar proactief leiderschap vereist dat je op het juiste moment over de juiste informatie beschikt. AI-team moreel monitoring, mits ethisch uitgevoerd en met de volledige context van een geconvergeerde werkruimte, biedt die zichtbaarheid. Het stelt je in staat om niet langer te gissen naar hoe je team zich voelt en geeft je de context die je nodig hebt om de leider te zijn die ze verdienen.

Breng het werk van uw team samen op één plek waar AI u daadwerkelijk kan helpen om op de hoogte te blijven van hoe het met hen gaat. Ga vandaag nog gratis aan de slag met ClickUp.

Veelgestelde vragen

AI-morale monitoring analyseert geaggregeerde patronen met als doel managers te helpen hun teams te ondersteunen, terwijl surveillance zich richt op het bijhouden van individueel gedrag om naleving te controleren. Het belangrijkste verschil is het doel: het ene is bedoeld voor coaching en ondersteuning, het andere voor controle.

AI kan patronen identificeren die verband houden met burn-out, zoals aanhoudende overbelasting of afnemende betrokkenheid – wat veelzeggend is, aangezien 77% burn-out heeft ervaren in hun huidige baan – maar dit zijn waarschijnlijkheden, geen zekerheden. Het werkt het beste als een vroegtijdig waarschuwingssysteem dat aanleiding geeft tot een menselijk gesprek.

Beschouw de melding als een aanleiding voor een oprecht gesprek, niet als een oordeel. Stel open vragen, luister zonder vooroordelen en concentreer u op het begrijpen van het perspectief van het teamlid om samen tot een oplossing te komen.