De meeste mensen gaan ervan uit dat ze moeten kiezen tussen het gebruik van krachtige AI-tools of het privé houden van hun gegevens. Maar u kunt eigenlijk beide hebben. Door AI lokaal uit te voeren, blijven de gegevens altijd op uw eigen hardware. U behoudt de volledige controle over uw informatie en kunt toch uw meest repetitieve taken automatiseren.

Deze gids laat zien hoe u lokale AI kunt gebruiken voor veilige werkstroomen met behulp van tools zoals Ollama. U leert hoe u open-source modellen uitvoert bij de selectie die passen bij uw specifieke hardware-specificaties. En hoe u geautomatiseerde werkstroomen bouwt die privé-documenten lokaal verwerken.

We gaan ook kijken naar het centraliseren van werkstroomen in een uniforme ruimte zoals ClickUp. 😎

Wat is lokale AI?

Lokale AI houdt in dat u grote taalmodellen (LLM's) volledig op uw eigen hardware uitvoert – zoals uw laptop of een server op locatie – in plaats van uw gegevens naar externe clouddiensten te sturen. Dit is geschikt voor elk team dat met gevoelige informatie werkt, van engineering en productontwerp tot juridische en financiële afdelingen.

Bij de meeste cloudgebaseerde AI-tools worden uw prompts, documenten en gegevens naar servers van derden verzonden. U verliest de controle over hoe die informatie wordt verwerkt, opgeslagen of gebruikt.

Omgekeerd houdt lokale AI uw gegevens binnen uw eigen omgeving. U behoudt de volledige controle over de veiligheid en gegevensbescherming van uw werkstroom.

Natuurlijk zijn er ook nadelen. Het opzetten van lokale AI vereist meer technische inspanning en een initiële investering in hardware. Het maakt u echter volledig vrij van afhankelijkheid van externe providers. Met on-device inferentie blijft uw informatie precies waar u dat wilt.

Waarom lokale AI belangrijk is voor veilige werkstroomen

🔎 Wist u dat? Slechts 1 op de 10 consumenten is bereid om gevoelige informatie, zoals financiële, communicatie- of biometrische gegevens, te delen met AI-gestuurde systemen.

Deze terughoudendheid weerspiegelt een groeiende realiteit voor B2B-teams. Met cloudgebaseerde AI draagt u in feite het intellectuele eigendom van uw bedrijf over aan een derde partij. Voor juridische, financiële of HR-teams leidt dit tot een enorme aansprakelijkheid.

Lokale AI verandert deze dynamiek door de AI naar uw eigen hardware te verplaatsen. Dit is waarom dat belangrijk is voor uw dagelijkse activiteiten:

- Voorkom datalekken: Voorkom dat eigen code of privé-klantcontracten worden gebruikt om een openbaar model te trainen dat uw concurrenten zouden kunnen gebruiken

- Zorg voor naleving van de regelgeving: Blijf binnen de grenzen van de AVG of HIPAA, omdat gevoelige gegevens nooit internationale grenzen overschrijden of op een server van een derde partij terechtkomen

- Maak uzelf onafhankelijk van internet: Voer complexe data-analyses of ontwerp-taaken uit tijdens een stroomstoring of in omgevingen met hoge mate van veiligheid waar de toegang tot de cloud beperkt is

- Beheer kosten op voorspelbare wijze: Vermijd stijgende API-kosten naarmate uw team groeit, aangezien uw enige kosten de hardware zijn die u al in bezit heeft

Door lokale AI te integreren met uw bestaande tools kunt u de automatisering van uw werk uitvoeren zonder dat dit ten koste gaat van uw veiligheid.

⚠️ Het is echter belangrijk om te onthouden dat dit probleem kan verergeren. Uw team wil misschien meerdere AI-tools gaan gebruiken, wat kan leiden tot AI-wildgroei: de ongebreidelde toename van AI-tools zonder toezicht of strategie. Dit kan leiden tot verspilling van geld, dubbel werk en risico's op gebied van veiligheid.

Uiteindelijk verbreedt dit uw model voor de veiligheid en maakt het werk moeilijker om bij te houden.

📮ClickUp Insight: Slecht presterende teams gebruiken 4 keer vaker meer dan 15 tools, terwijl goed presterende teams efficiënt blijven door hun toolkit te beperken tot 9 of minder platforms. Maar wat dacht je ervan om één platform te gebruiken? Als de alles-in-één-app voor werk brengt ClickUp je taken, projecten, documenten, wiki's, chat en gesprekken samen op één platform, compleet met AI-aangedreven werkstroom. Klaar om slimmer te werken? ClickUp werkt voor elk team, maakt werk zichtbaar en stelt je in staat je te concentreren op wat belangrijk is, terwijl AI de rest afhandelt.

Wat heeft u nodig om lokale AI te gebruiken?

U hebt geen gespecialiseerde supercomputer nodig om AI lokaal uit te voeren. Dankzij recente veranderingen in de manier waarop modellen worden gebouwd, kunt u aan de slag met de hardware die u al hebt. Deze hoeft alleen maar aan een paar specifieke criteria te voldoen.

Hardwarevereisten

Uw hardware bepaalt de grootte en snelheid van de AI-modellen die u kunt gebruiken. Hoewel u met een krachtige machine complexere redeneermodellen kunt uitvoeren, zijn kleinere modellen verrassend capabel geworden.

- GPU met VRAM: Een speciale NVIDIA-kaart met minimaal 12 GB VRAM is momenteel de ideale keuze voor de meeste teams. Hiermee kunt u middelgrote modellen zoals Llama 3.3 (8B) of Mistral Small op hoge snelheid draaien

- Systeem-RAM: Als u geen high-end GPU hebt, neemt het RAM-geheugen van uw computer de belasting voor zijn rekening. Met 32 GB hebt u voldoende ruimte om een model uit te voeren terwijl uw browser en projectmanagementtools open blijven staan

- Unified memory (voor Mac-gebruikers): Als u een Mac met een chip uit de M-serie (M2, M3 of M4) gebruikt, worden uw RAM-geheugen en GPU-geheugen gedeeld. Dit maakt Macs bijzonder efficiënt voor lokale AI, omdat het model toegang heeft tot de volledige geheugenpool

- Snelle opslagruimte: Modellen zijn grote bestanden, met een bereik van 5 GB tot 50 GB. Het gebruik van een NVMe SSD is essentieel om lange wachttijden bij het laden van een nieuw model te voorkomen

🔎 Wist u dat? Het bouwen van een pc is aanzienlijk duurder dan een paar maanden geleden. Eerder kostte een 32 GB DDR5-geheugenkit minder dan $ 130, maar nu zijn diezelfde kits gestegen tot meer dan $ 400. Door deze verschuiving is 32 GB het nieuwe absolute minimum geworden voor elk serieus lokaal AI-werk, aangezien u voldoende ruimte nodig hebt om modellen uit te voeren zonder dat de prestaties van uw systeem instorten.

Softwarevereisten

Software fungeert als brug tussen uw hardware en de AI. U hoeft geen ontwikkelaar meer te zijn om dit aan de praat te krijgen.

- Besturingssysteem: Hoewel Linux de natuurlijke thuisbasis is voor AI, zijn Windows en macOS inmiddels net zo geschikt. Windows-gebruikers kunnen WSL2 gebruiken voor een Linux-achtige omgeving, hoewel veel tools nu rechtstreeks op Windows draaien

- Modelbeheerders: Tools zoals Ollama of LM Studio zijn het gemakkelijkste startpunt. Zij zorgen voor de kwantisering: het comprimeren van het model zodat het automatisch op uw hardware past

- Stuurprogramma's: U hebt de nieuwste stuurprogramma's voor uw hardware nodig, zoals het nieuwste CUDA-stuurprogramma voor NVIDIA-kaarten. De meeste moderne installatieprogramma's controleren dit automatisch tijdens de installatie.

Open-source LLM-opties

We zien een explosieve groei van open-source modellen die u gratis kunt downloaden. Deze zijn ontwikkeld door bedrijven als Meta (Llama), Mistral en Alibaba (Qwen). In tegenstelling tot gesloten systemen kunt u bij deze modellen precies zien hoe ze werken en waar uw gegevens naartoe gaan.

Let bij het kiezen van een groot taalmodel op de softwarelicentie. De meeste maken gebruik van de Apache 2.0- of MIT-licentie, waardoor u ze voor zakelijke doeleinden kunt gebruiken zonder maandelijkse abonnementskosten. Omdat deze modellen op uw eigen hardware draaien, kunnen ze direct in uw privé-werkstroom worden geïntegreerd.

U kunt bijvoorbeeld een lokaal model gebruiken om interne e-mails op te stellen, notulen van vergaderingen samen te vatten of eigen datasets te analyseren. Zo blijven uw meest gevoelige projectdetails en strategische aantekeningen op uw eigen computer.

🧠 Leuk weetje: De chips uit de M-serie van Apple bieden een uniek architectonisch voordeel voor teams die zich richten op privacy. Dankzij het Unified Memory van de Mac kan de AI de volledige hoeveelheid systeem-RAM gebruiken alsof het speciaal grafisch geheugen is.

Dit betekent dat een MacBook met 128 GB RAM enorme, zeer geavanceerde modellen kan draaien waarvoor normaal gesproken gespecialiseerde hardware van een onderneming nodig is die meer dan $ 10.000 kost.

De beste lokale AI-modellen voor werkstroomen

Om het juiste model te vinden, moet u de sterke punten van het model afstemmen op de taken van uw team en de mogelijkheden van uw hardware.

Modellen voor algemeen gebruik

Dit zijn de werkpaarden van je lokale installatie. Gebruik ze voor het opstellen van e-mails, het samenvatten van projectupdates of het bedenken van creatieve ideeën.

- Llama 4 Scout (17B): Beschikt over een contextvenster van 10 miljoen tokens, waarmee u duizenden pagina's tekst tegelijk kunt verwerken

- Mistral Small 4: Maakt gebruik van een 'mixture-of-experts'-architectuur, wat betekent dat het voor elke taak slechts een fractie van zijn parameters activeert

- Qwen 3.5 (7B): Presteert consistent beter als uw team technische documentatie in meerdere talen verwerkt

Modellen voor redeneren en het gebruik van tools

Gebruik deze wanneer u de LLM-agenten nodig hebt om meerstapsproblemen op te lossen, complexe logica te volgen of als autonome agent binnen uw werkstroom te fungeren.

- Llama 4 Maverick: Het is van nature multimodaal. Dit maakt het ideaal voor teams die complexe grafieken of financiële spreadsheets moeten analyseren, waarbij de visuele context net zo belangrijk is als de tekst

- Phi-4 (14B): Afgestemd op STEM en logisch redeneren. Gebruik het voor datavalidatie of complexe wiskundige taken waarvoor doorgaans veel grotere, duurdere modellen nodig zijn

- DeepSeek-R1: Geeft zijn interne redenering weer, wat u helpt de logica te verifiëren bij analyses met hoge inzet. Ideaal voor diepgaand onderzoek en strategische planning

Taakspecifieke modellen

Soms is een gespecialiseerde tool efficiënter dan een algemene assistent. Deze modellen zijn geoptimaliseerd voor één specifiek onderdeel van uw werkstroom.

- Qwen 3-Coder-Next: Begrijpt logica op niveau van de opslagplaats, waardoor het bugfixes kan voorstellen of code in meerdere bestanden kan herstructureren. Dit alles met inachtneming van de specifieke stijlgidsen van uw team

- Voxtral Mini: Identificeert verschillende sprekers in een opname en zet opnames van privé-vergaderingen om in doorzoekbare tekst. Werkt volledig offline, ideaal om datalekken te voorkomen

- Nomic Embed v1.5: Zet uw privé-documenten om in wiskundige gegevens voor semantisch zoeken. Hiermee kunt u de interne kennisbank van uw team doorzoeken op basis van betekenis in plaats van alleen op trefwoorden

Populaire tools voor het uitvoeren van lokale AI

U hoeft geen software-engineer meer te zijn om modellen op uw eigen computer te draaien. Er zijn nu verschillende gebruiksvriendelijke applicaties die de technische installatie binnen enkele minuten voor u regelen.

Ollama en OpenWebUI

Ollama is geschikt als u snelheid en flexibiliteit wilt. Het draait op de achtergrond en beheert uw modelbibliotheek via een eenvoudige interface.

Hoewel het begint als een basistool, combineren de meeste mensen het met OpenWebUI. Dit voegt een verfijnde chatervaring toe aan je browser die eruitziet en aanvoelt als de cloudgebaseerde tools die je al kent. Het creëert ook een lokale brug zodat andere apps op je computer veilig kunnen communiceren met je AI-modellen.

LM Studio

Als u de voorkeur geeft aan een traditionele desktop-app, is LM Studio een uitstekend alternatief. Het werkt als een app store voor AI. U kunt het gebruiken om met slechts een paar klikken naar een nieuw model te zoeken, het te downloaden en ermee te chatten.

De app bevat ingebouwde hardware-detectie, zodat deze automatisch uw instellingen configureert op basis van uw specifieke GPU of RAM. Dit maakt het een uitstekend startpunt als u met verschillende modellen wilt experimenteren zonder ook maar één regel code aan te raken.

GPT4All

Voor teams die zich uitsluitend richten op privacy en documentanalyse is GPT4All een betrouwbare, eenvoudige oplossing. Het werkt op vrijwel elke computer, inclusief oudere laptops die mogelijk geen aparte grafische kaart hebben.

De handigste functie is de mogelijkheid om rechtstreeks met uw lokale bestanden te chatten. U kunt de app naar een map op uw harde schijf leiden, en de AI beantwoordt vragen over die specifieke documenten. Dit alles zonder ze ooit naar een server van een derde partij te uploaden.

Lokale AI instellen voor veilige werkstroom

In deze handleiding wordt Ollama gebruikt, omdat dit een breed ondersteunde tool is voor het bouwen van veilige, lokale AI-werkstroomen.

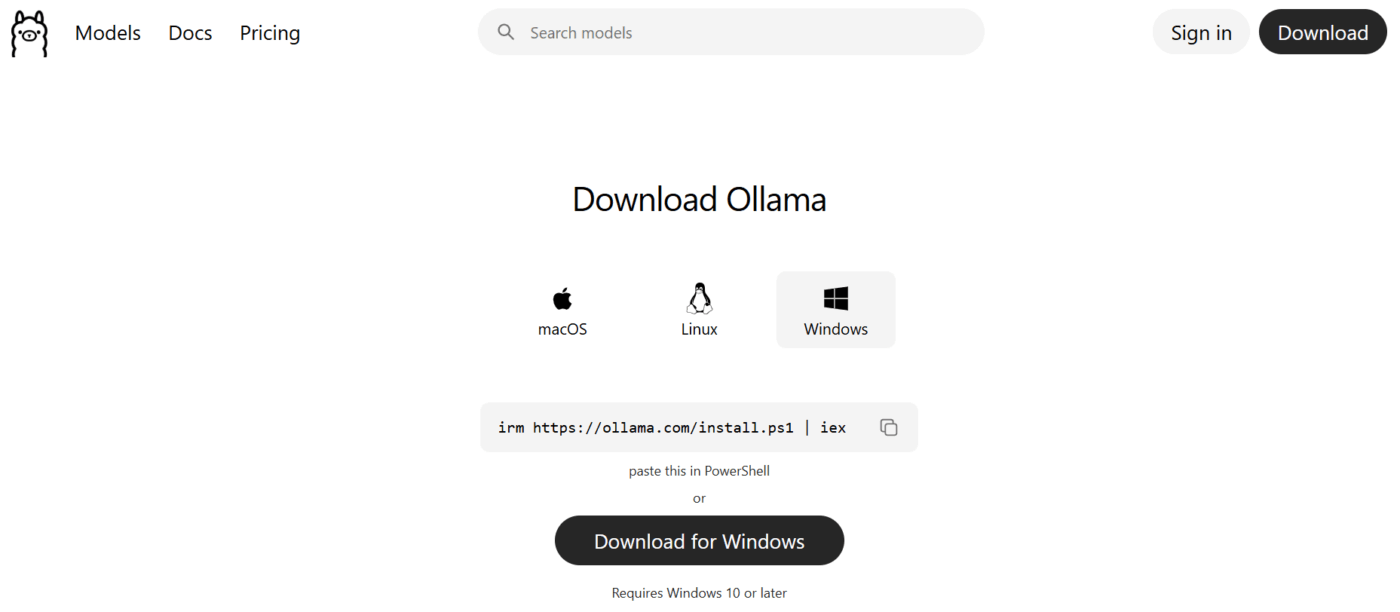

Stap 1: Installeer Ollama

Download het installatieprogramma van de officiële website voor uw specifieke besturingssysteem. Terwijl eerdere Windows-versies een handmatige installatie van het Linux-subsysteem vereisten, wordt de huidige versie geïnstalleerd als een native applicatie.

De installatie duurt slechts enkele minuten. Zodra de installatie is voltooid, opent u uw terminal of opdrachtprompt en typt u ollama --versie om te controleren of het programma klaar is voor gebruik.

Stap 2: Downloaden en uitvoeren van een model

Om een AI te gaan gebruiken, moet u de gewichten ervan naar uw machine halen. Probeer voor uw eerste test een compact maar krachtig model zoals Llama 3.2 (3B) of de nieuwste Mistral.

Gebruik het commando ollama run llama3.2 om te beginnen met downloaden.

Afhankelijk van uw internetsnelheid duurt dit meestal een paar minuten. Zodra het downloaden is voltooid, kunt u een opdracht rechtstreeks in de terminal typen om direct een reactie te krijgen van het model op uw harde schijf.

Stap 3: Maak verbinding met uw werkstroomtool

De echte waarde van lokale AI komt voort uit de integratie ervan in uw dagelijkse taken. Wanneer Ollama draait, start het automatisch een lokale server op http://localhost:11434. Dit creëert een veilige verbinding waarmee andere applicaties met uw model kunnen communiceren.

Aangezien deze server compatibel is met standaard OpenAI-protocollen, kunt u hem koppelen aan platforms voor automatisering of interne scripts door simpelweg het API-adres te wijzigen. U kunt bijvoorbeeld een lokale tool voor het zoeken naar documenten naar dit adres laten verwijzen. Hierdoor kan deze tool privébestanden samenvatten zonder die tekst ooit naar de cloud te sturen.

Best practices voor veiligheid van lokale AI-werkstroomen

Het lokaal uitvoeren van AI is een grote stap voorwaarts voor de privacy. Het lokaal opslaan van gegevens betekent echter dat u nu zelf verantwoordelijk bent voor de veiligheid ervan. Hoewel u het risico op een inbreuk op de cloud door derden hebt geëlimineerd, moet u nog steeds uw hardware beveiligen en de manier waarop uw team met de modellen omgaat.

Volg deze best practices:

- Netwerkafscherming: Beperk API-toegang tot vertrouwde interne netwerken, zodat uw AI-server niet bereikbaar is vanaf het openbare internet

- Invoervalidatie: Zuiver alle gegevens voordat u ze naar het model stuurt. Dit blokkeert verborgen kwaadaardige instructies in documenten of e-mails

- Toegangscontrole: Implementeer verificatie op uw AI-eindpunt om te controleren of alleen geautoriseerde gebruikers modelacties kunnen triggeren

- Auditlogging: Houd een overzicht bij van alle modelinteracties om te helpen bij compliance- en veiligheidsonderzoeken

- Containerisolatie: Voer uw modellen uit in sandbox-omgevingen zoals Docker. Dit voorkomt dat een mogelijke inbreuk uw kernsysteembestanden bereikt

- Regelmatige updates: Installeer de nieuwste patches voor tools zoals Ollama om beschermd te blijven tegen nieuw ontdekte kwetsbaarheden

- Rate limiting: Om te voorkomen dat één gebruiker of script uw server overspoelt met verzoeken, implementeert u rate limiting om te bepalen hoeveel queries er in een bepaalde periode mogen worden uitgevoerd

🔎 Wist u dat? Manipulaties via prompts zijn niet langer een theoretische dreiging. Uit een recent onderzoek van Gartner blijkt dat 32% van de organisaties het afgelopen jaar te maken heeft gehad met een kwaadaardige prompt-aanval op AI-toepassingen. Deze aanvallen kunnen uw lokale model manipuleren, waardoor het bevooroordeelde of ongeautoriseerde output genereert.

Hoe u veilige AI-werkstroomen voor uw team kunt opzetten

Zodra uw lokale server draait, kunt u deze integreren in uw dagelijkse werk. Zo verandert een eenvoudige tool in een privé-motor voor productiviteit. De meest effectieve manier om dit te doen is via Retrieval-Augmented Generation (RAG).

Dit proces stelt een verbinding tussen uw lokale AI en een privé-database met uw eigen bestanden op. U kunt vragen beantwoorden op basis van de specifieke context van uw bedrijf, zonder ook maar één byte naar de cloud te uploaden.

U kunt ook 'human-in-the-loop '-werkstroomen ontwerpen, waarbij het werk van de AI wordt gecontroleerd door menselijke teamleden. Dit garandeert nauwkeurigheid en versnelt uw output aanzienlijk.

Hier volgen enkele praktische voorbeelden:

- Documentanalyse: Vat interne rapporten of feedback van klanten samen om direct sleutelinzichten te verkrijgen

- Conceptgeneratie: Maak eerste versies van e-mails of projectupdates die leden van het team kunnen bijwerken

- Gegevensclassificatie: categoriseer binnenkomende taken automatisch op basis van de specifieke content van het verzoek

- Voorbereiding van de vergadering: Stel gespreksonderwerpen op door gerelateerde projectbestanden te analyseren die op uw lokale schijf zijn opgeslagen

- Codebeoordeling: Ontvang feedback op eigen code zonder uw intellectuele eigendom aan derden bloot te geven

📮ClickUp Insight: Uit onze enquête over AI-volwassenheid blijkt dat de toegang tot AI op het werk nog steeds beperkt is: 36% van de mensen heeft helemaal geen toegang, en slechts 14% zegt dat de meeste werknemers er daadwerkelijk mee kunnen experimenteren. Wanneer AI verborgen zit achter toestemming, extra tools of ingewikkelde installaties, krijgen teams niet eens de kans om het in de praktijk, tijdens hun dagelijkse werk, uit te proberen.

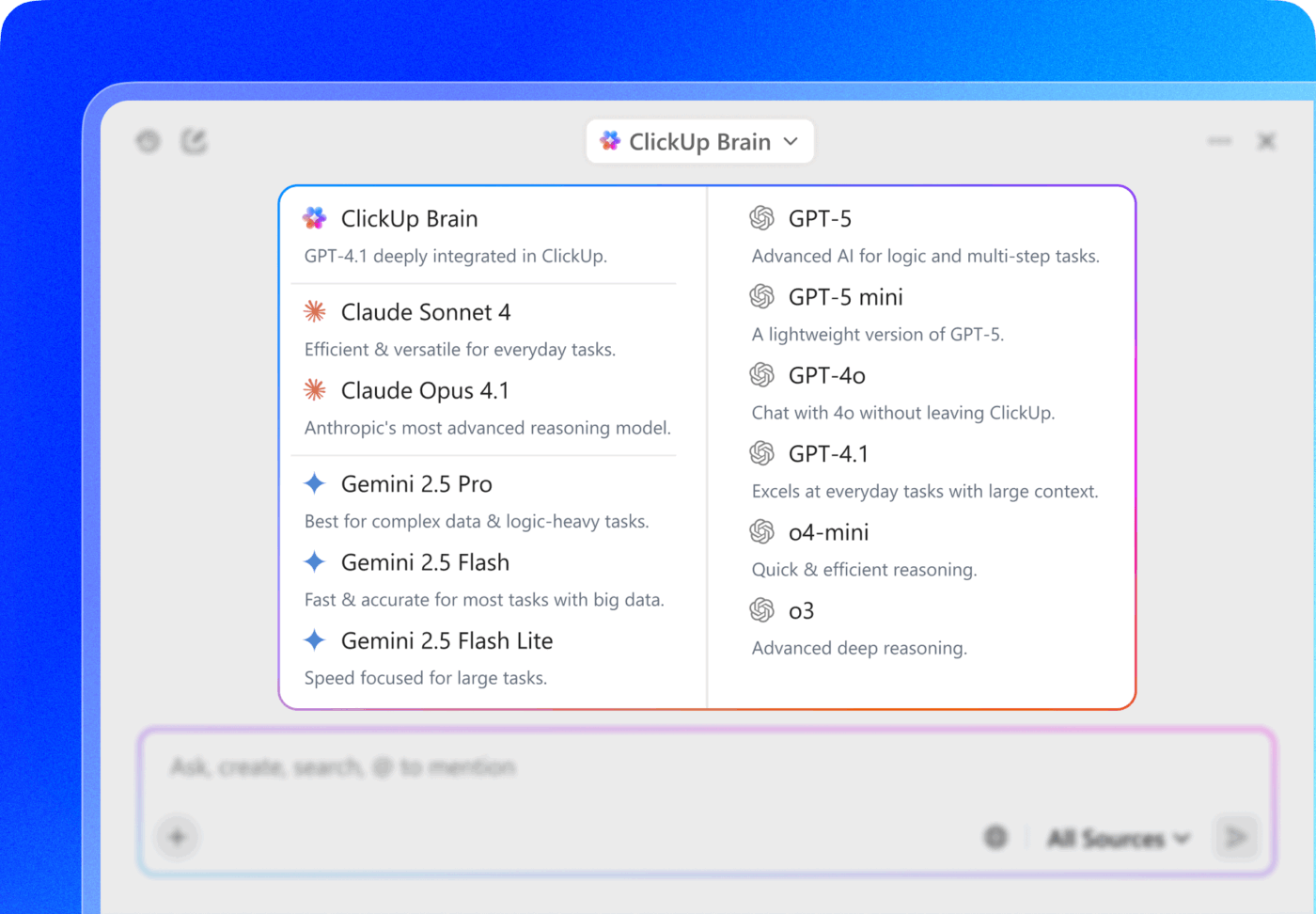

ClickUp Brain neemt al die wrijving weg door AI rechtstreeks in de werkruimte te integreren die je al gebruikt. Je kunt gebruikmaken van meerdere AI-modellen, afbeeldingen genereren, code schrijven of debuggen, op het web zoeken, documenten samenvatten en nog veel meer – zonder van tool te wisselen of je focus te verliezen.

Het is uw ambient AI-partner, gebruiksvriendelijk en toegankelijk voor iedereen in het team.

Beperkingen van het gebruik van lokale AI voor AI-werkstroomen

Lokale AI is een krachtig hulpmiddel, maar het is geen wondermiddel voor elk probleem. Als u de beperkingen ervan begrijpt, kunt u beter beslissen wanneer u een taak op uw eigen hardware moet uitvoeren en wanneer u de cloud moet gebruiken. Voor sommige teams wegen de technische en financiële afwegingen mogelijk zwaarder dan de voordelen op het gebied van privacy.

- Beperkingen: Eigen modellen van topkwaliteit hebben nog steeds een klein voordeel op het gebied van complexe redeneringen en creatieve nuances in vergelijking met open-sourceversies

- Investering in hardware: Voor snelle prestaties bij grote modellen zijn dure GPU's met veel VRAM nodig. Dit kan voor kleine teams hoge initiële kosten met zich meebrengen

- Onderhoudskosten: U bent zelf verantwoordelijk voor alle software-updates, het oplossen van hardwareproblemen en het installeren van patches voor de veiligheid, zonder ondersteuningsteam van een provider.

- Technische expertise: Het optimaliseren van een lokale omgeving vereist praktische kennis van modelkwantisering en serverconfiguratie

- Veiligheidsbeheer: In tegenstelling tot clouddiensten beschikken lokale modellen niet over ingebouwde moderatie. U moet uw eigen content-filters en veiligheidsmaatregelen implementeren

- Stroomverbruik: Het draaien van grootschalige AI-modellen op uw eigen servers of werkstations kan uw stroomverbruik en koelbehoeften aanzienlijk verhogen

Veel teams hanteren een hybride aanpak: lokale AI voor gevoelige gegevens, cloud-AI voor minder gevoelige taken die maximale capaciteit vereisen. Hier volgt een kort overzicht van de vergelijking tussen beide:

| Factor | Lokale AI | Cloud-AI |

|---|---|---|

| Gegevensprivacy | Volledige controle | Gegevens verzonden naar provider |

| Complexiteit van de installatie | Hoger | Lager |

| Lopende kosten | Hardware + elektriciteit | Kosten per token |

| Modelmogelijkheden | Goed, in verbetering | State-of-the-art |

| Onderhoud | Zelfbeheerd | Beheerd door de provider |

Hoe ClickUp veilige, door AI aangestuurde werkstroom-werkstroom-werkstroom-werkstroom-werkstroom-werkstroom-werkstroom-werkstroom-werkstroom-werkstroom-werkstroom-werkstroom-werkstroom

De meeste teams zitten tegenwoordig in een spagaat: gebruik krachtige cloud-AI en maak je zorgen over waar je gegevens naartoe gaan, of zet lokale modellen op en houd rekening met doorlopende overheadkosten. ClickUp omzeilt dat dilemma door te fungeren als een geconvergeerde AI-werkruimte — waar de AI al aanwezig is in het systeem waarin je werkt.

ClickUp Brain is de AI-laag die rechtstreeks in de ClickUp-werkruimte is ingebouwd, ontworpen om je taken, documenten en teamcommunicatie op één plek te begrijpen. Het biedt AI-ondersteuning met volledige context – geen aparte tools, geen kwetsbare integraties.

Voor teams die veilige AI-werkstroomen willen opzetten, maakt die combinatie van context en controle het verschil tussen experimenteren en daadwerkelijke implementatie.

🌟 ClickUp voldoet ook aan SOC 2 en houdt zich aan de ISO 42001-normen voor verantwoord AI-beheer. Dit zorgt ervoor dat uw gegevens nooit worden gebruikt om modellen van derden te trainen, waardoor u uw werk met hetzelfde vertrouwen kunt automatiseren als bij een on-premise installatie.

Krijg toegang tot zoek- en autonome werkstroomen met ClickUp Brain

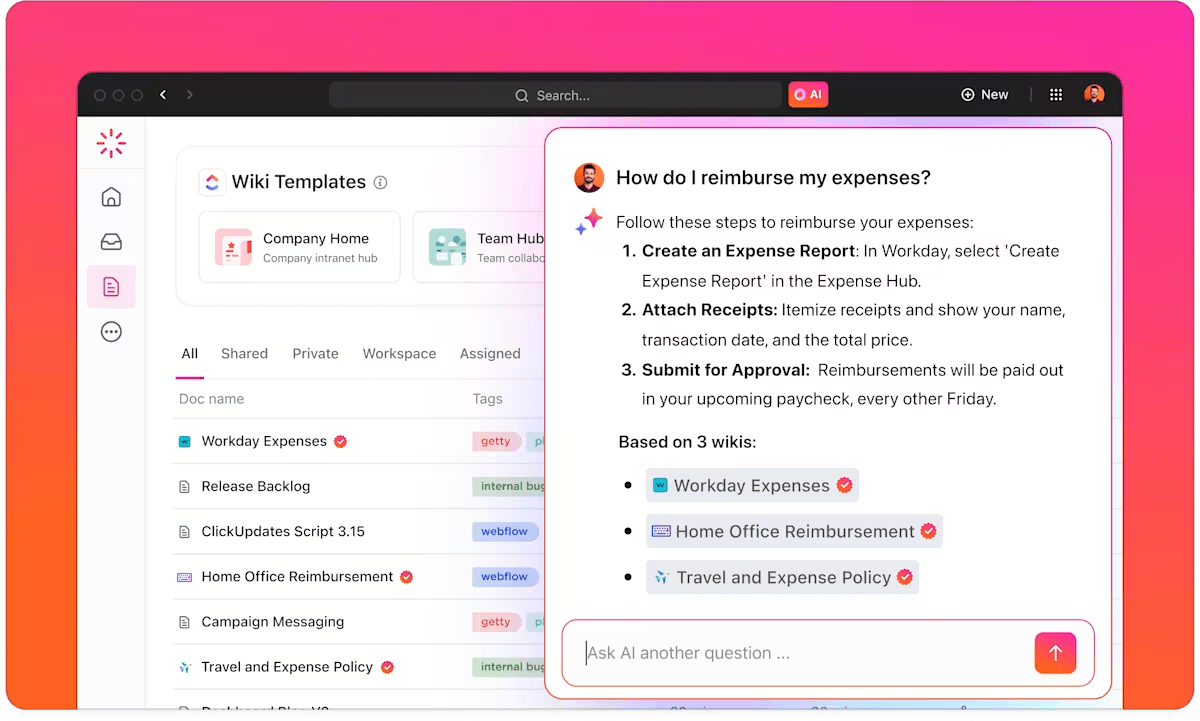

Zodra uw gegevens binnen de ClickUp-werkruimte zijn beveiligd, haalt ClickUp Brain in realtime waarde uit uw taken en documenten.

Omdat de AI is ingebed, wordt de contextkloof vermeden die lokale installaties vertraagt. U kunt er vragen aan stellen die een volledige weergave van uw projectgeschiedenis vereisen om nauwkeurig te kunnen beantwoorden:

- Bepaal de definitieve beslissingen op basis van een uitgebreide technische briefing zonder door verschillende versies te hoeven scrollen

- Opstellen van updates voor belanghebbenden op basis van opmerkingen bij Taaken en wijzigingen in de status

ClickUp Brain genereert antwoorden op basis van de gegevens in je werkruimte door de specifieke content van je documenten, taken en chats te analyseren. Dit zorgt ervoor dat de AI altijd over de meest recente context beschikt naarmate je project zich ontwikkelt.

Hierdoor kan uw team voortbouwen op inzichten zonder de geschiedenis van het project handmatig opnieuw te moeten uitleggen of gegevens te verplaatsen tussen losstaande tools.

🟒Pro-tip: U kunt de context van uw werkruimte nog verder uitbreiden door Enterprise AI Search te gebruiken om informatie uit al uw externe tools op te halen.

Stel bijvoorbeeld een diepgaande vraag zoals 'Toon me alle openstaande deals in de pijplijn', en ClickUp Brain doorzoekt al je gekoppelde apps, waaronder Slack, Google Drive en Gmail, om een betrouwbaar antwoord in realtime te geven, inclusief bronvermeldingen.

Dit zet gefragmenteerde gegevens verspreid over meerdere platforms om in één doorzoekbare informatielaag, waar u elk bestand, bericht of elke Taak kunt vinden zonder uw werkruimte te verlaten.

Beheer taken op een slimme manier met automatisering en AI

ClickUp Brain biedt niet alleen passieve ondersteuning, maar werkt actief binnen uw takenbeheersysteem. Het kan:

- Taak genereren op basis van aantekeningen van vergaderingen of documenten

- Verdeel grote opdrachten in subtaaken

- Stel taakeigenaars voor op basis van eerdere activiteiten

- Stel deadlines voor op basis van de context van het project

Het kan ook de status van taken bijwerken, lange commentaren samenvatten in duidelijke vervolgstappen en knelpunten signaleren voordat ze de uitvoering vertragen.

In combinatie met ClickUp automatisering wordt dit een gesloten systeem: AI kan werkstroomtriggers activeren (zoals het toewijzen van taken, het informeren van belanghebbenden of het bijwerken van prioriteiten) op basis van wijzigingen binnen je werkruimte.

Wanneer een document bijvoorbeeld is afgerond, kunnen er automatisch taken worden aangemaakt en toegewezen zonder dat iemand handmatig gegevens tussen tools hoeft te verplaatsen.

💟 Bonus: Maak van ClickUp Brain MAX uw 'beslissingsgeheugen'.

Gebruik het om:

- Vat lange commentarethreads samen tot duidelijke beslissingen en vervolgstappen

- Werk documenten bij met "wat er is veranderd en waarom" na belangrijke mijlpalen

- Genereer wekelijkse beslissingslogboeken op basis van taken, vergaderingen en updates

Na verloop van tijd ontstaat zo een levende laag van institutionele kennis waar Brain MAX naar kan verwijzen. In plaats van afzonderlijke vragen te beantwoorden, begint het dus te reageren met kennis van eerdere beslissingen, prioriteiten en patronen.

Op dat moment verandert AI van 'handig' in 'betrouwbaar' – vooral in veilige AI-werkstroomen waar context en traceerbaarheid van belang zijn.

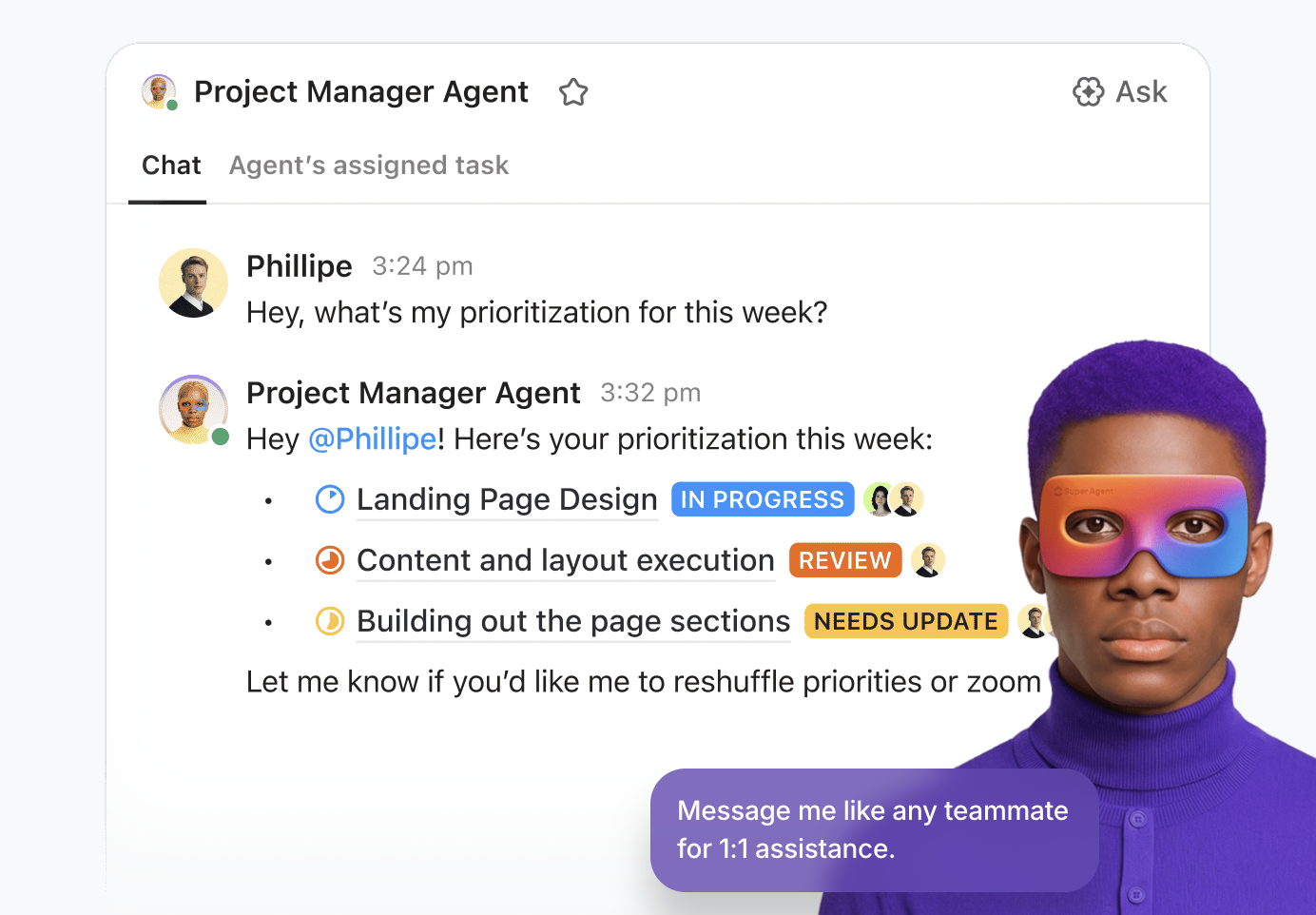

Zorg voor veiligheid en contextbewuste uitvoering op schaal met Super Agents

De Super Agents van ClickUp tillen ClickUp Brain naar een hoger niveau: van ondersteuning bij het werk naar het actief aansturen ervan. Deze agents kunnen worden geconfigureerd om werkstroom-activiteiten te monitoren, acties uit te voeren en taken in uw hele werkruimte te coördineren op basis van vooraf gedefinieerde regels en realtime context.

Een Super Agent kan bijvoorbeeld:

- Monitor binnenkomende verzoeken of documenten en zet deze automatisch om in gestructureerde taken met eigenaars en deadlines

- Houd de voortgang van projecten bij en signaleer risico's of vertragingen voordat ze escaleren

- Trigger meerstapsautomatiseringen wanneer aan bepaalde voorwaarden wordt voldaan, zoals het informeren van belanghebbenden, het bijwerken van prioriteiten of het aanmaken van vervolgtaken

Deze agents draaien volledig binnen de geïntegreerde werkruimte van ClickUp, met volledig inzicht in je taken, documenten en toestemmingsstructuur. Dat betekent:

- U hoeft geen gegevens te exporteren naar externe AI-systemen of orchestration-tools

- Ze hebben alleen toegang tot gegevens die ze mogen inzien

- Ze handelen binnen dezelfde toestemminggrenzen als uw team

Meer informatie over het werk met Super Agents:

Profiteer van AI-ondersteuning in uw documenten

Met ClickUp Docs wordt AI-ondersteuning rechtstreeks in uw documentatiewerkstroom geïntegreerd. Teams kunnen projectbriefings opstellen, lange rapporten samenvatten, actiepunten eruit halen of content herschrijven voor verschillende doelgroepen – en dat allemaal zonder het platform te verlaten.

Dit is belangrijk voor veilige AI-werkstroomen, omdat een van de grootste risico's voortkomt uit het kopiëren en plakken van gevoelige informatie in externe tools. In ClickUp minimaliseert u gegevensverplaatsing en behoudt u volledige controle over de toegang via toestemming.

Eindoordeel: uw privé AI-stack bouwen

Lokale AI maakt gebruik van kunstmatige intelligentie terwijl u volledige controle behoudt over gegevensprivacy en compliance. Deze aanpak vereist echter een aanzienlijke investering in hardware, technische installatie en doorlopend onderhoud.

Beveiligingsmaatregelen blijven cruciaal, of u nu lokale of cloud-AI gebruikt. De meest effectieve strategie is vaak een hybride aanpak: lokale AI gebruiken voor de meest gevoelige bewerkingen en tegelijkertijd gebruikmaken van beheerde, veilige oplossingen voor de dagelijkse productiviteit.

Het is cruciaal om afwegingen te maken: voor veel teams is de overhead van een doe-het-zelfoplossing misschien niet de juiste keuze.

Voor wie krachtige AI-productiviteit wil zonder de last van de infrastructuur, bieden beheerde oplossingen zoals ClickUp Brain een aantrekkelijk alternatief. Het biedt veiligheid op niveau van een onderneming zonder enige installatie-complexiteit.

Ga gratis aan de slag met ClickUp en ontdek veilige, contextuele, door AI aangestuurde werkstroomen voor je team.

Veelgestelde vragen

Wat is het verschil tussen lokale AI en cloudgebaseerde AI voor werkstroomen voor teams?

Lokale AI draait volledig op uw eigen hardware, waardoor gegevens uw interne netwerk nooit verlaten, terwijl cloudgebaseerde AI verzoeken naar servers van derden stuurt voor verwerking. Lokale installaties bieden volledige gegevenssoevereiniteit en offline toegang, terwijl clouddiensten meer rekenkracht en gebruiksgemak bieden ten koste van directe controle over de gegevens.

Hoe kunnen teams lokale AI-modellen gebruiken met vertrouwelijke projectgegevens?

Teams kunnen lokale AI gebruiken om gevoelige documenten, bedrijfseigen code en financiële gegevens te verwerken door het model te koppelen aan privé-mappen op locatie. Omdat de inferentie op het apparaat zelf plaatsvindt, kunt u taken uitvoeren zoals geautomatiseerde samenvattingen, gegevensextractie en interne kenniszoekopdrachten zonder het risico te lopen dat deze worden blootgesteld aan openbare LLM-trainingssets.

Zijn lokale AI-modellen even geschikt als ChatGPT voor werk-taken?

Veel open-source lokale modellen, zoals Llama 3 en Mistral, zijn inmiddels zeer geschikt voor routinematige taken zoals het opstellen van concepten, code schrijven en samenvatten. Hoewel topklasse cloudmodellen zoals GPT-4o nog steeds toonaangevend zijn op het gebied van uiterst complexe redeneringen, bieden lokale modellen vergelijkbare prestaties voor 90% van de dagelijkse bedrijfsactiviteiten, met aanzienlijk betere privacy.

Wat zijn de voor- en nadelen van het lokaal uitvoeren van AI ten opzichte van het gebruik van AI-clouddiensten?

De belangrijkste afweging is de keuze tussen volledige gegevensprivacy met lokale AI versus de onderhoudsvrije schaalbaarheid van cloud-AI. Het lokaal uitvoeren van AI vereist een initiële investering in hardware en technische expertise, maar elimineert terugkerende API-kosten en risico's op gegevenslekken. Cloud-AI is sneller te implementeren, maar brengt doorlopende abonnementskosten en afhankelijkheid van gegevens van derden met zich mee.