Hugging Face heeft een indrukwekkend ecosysteem voor ML-ontwikkelaars opgebouwd, van zijn enorme modelhub tot naadloze implementatietools.

Maar soms vraagt uw project om iets anders. Misschien hebt u gespecialiseerde infrastructuur, veiligheid op bedrijfsniveau of aangepaste werkstroom nodig die andere alternatieven voor Hugging Face beter aankunnen.

Of je nu chatbots bouwt, LLM's verfijnt of NLP-pijplijnen uitvoert waar je datawetenschapper tranen van vreugde van zou krijgen, er zijn tal van platforms die klaar staan om aan je AI-behoeften te voldoen.

In deze blog hebben we de beste alternatieven voor Hugging Face op een rijtje gezet, van krachtige cloud-API's tot open-source toolkits en end-to-end AI-werkstroomplatforms.

De beste alternatieven voor Hugging Face in één oogopslag

Hier vindt u een vergelijking van de beste alternatieven voor Hugging Face. 📄

| Tool | Het beste voor | Beste functies | Prijzen* |

| ClickUp | Breng AI rechtstreeks in uw dagelijks werkbeheer, van taken tot documenten en automatisering Teamgrootte: Ideaal voor individuen, startups en ondernemingen | AI Notetaker, Autopilot Agents, Brain MAX, Enterprise AI Search, beeldgeneratie op Whiteboards, toegang tot Claude/ChatGPT/Gemini, automatisering via natuurlijke taal | Voor altijd gratis, aangepaste opties beschikbaar voor ondernemingen |

| OpenAI | Bouwen met geavanceerde taalmodellen en API's voor tekst, afbeeldingen en embeddings Teamgrootte: Ideaal voor AI-ontwikkelaars en startups die bouwen met LLM's | Fijnafstemming, PDF-/beeldverwerking, semantische bestandsanalyse, kostendashboards, temperatuur-/systeemmeldingen | Op basis van gebruik |

| Anthropic Claude | Creëer contextrijke, veiligere gesprekken en doordachte LLM-reacties Teamgrootte: Ideaal voor teams die behoefte hebben aan veiligheid, lange context en ethische redeneringen | Realtime zoeken op internet, gestructureerde uitvoergeneratie (JSON/XML), geheugen met hoge context, wiskunde/statistiek ondersteunen | Op basis van gebruik |

| Cohere | Ontwerp meertalige en veilige NLP-oplossingen op ondernemingsniveau Teamgrootte: Ideaal voor compliance-gedreven teams met meertalige NLP-behoeften | Fijnafstemming op privégegevens, die meer dan 100 talen ondersteunt, analytische dashboard, schaalbare inferentie, SSO/SAML/RBAC-integratie | Vanaf $ 0,0375/1 miljoen tokens (commando R7B); aangepaste prijzen |

| Repliceren | Open-source modellen verkennen en uitvoeren zonder je zorgen te maken over installatie of servers Teamgrootte: Ideaal voor ontwikkelaars die AI-modellen testen of MVP's bouwen | Forkable-modellen, versie-beheer met A/B-testen, batchvoorspelling en webhook-ondersteunen | Betalen per gebruik; prijzen verschillen per model |

| TensorFlow | Volledig aangepaste machine learning-systemen bouwen met maximale controle. Teamgrootte: Ideaal voor ML-engineers die volledige controle over het model nodig hebben | TensorBoard-monitoring, ONNX/SavedModel-conversie, aangepaste verliesfuncties, training met gemengde precisie | Free (open source); computergebruik wordt apart in rekening gebracht. |

| Azure Machine Learning | ML-modellen verbinden met het Microsoft-ecosysteem met automatisering en schaalbaarheid Teamgrootte: Ideaal voor ondernemingsteams in het Azure-ecosysteem | AutoML, triggers voor hertraining, verklaarbaarheid van modellen met SHAP/LIME, driftdetectie, schaalbare rekenclusters | Aangepaste prijzen |

| Google Gemini | Interactie met meerdere gegevenstypen – tekst, code, afbeeldingen en video – via één AI-model Teamgrootte: Ideaal voor multimodale onderzoeks- en analyseteams | Begrip van afbeeldingen/grafieken, realtime Python-uitvoering, video-samenvatting, redeneren op basis van gemengde inputs | Gratis; betaalde abonnementen beschikbaar, afhankelijk van modeltoegang |

| Microsoft Copilot | Verhoog de productiviteit binnen Microsoft 365-apps zoals Word, Excel en OutlookTeam: Ideaal voor zakelijke gebruikers in het Microsoft 365-ecosysteem | Automatisering van Excel-functies, genereren van PPT-dia's, opstellen van agenda's/e-mails, koppelen van Outlook-taken | Gratis; betaalde abonnementen beginnen bij $ 20 per maand. |

| IBM WatsonX | AI gebruiken in sterk gereguleerde sectoren met volledige controleerbaarheid en controle Teamgrootte: Ideaal voor banken, gezondheidszorg en organisaties in de publieke sector | Biasdetectie, prompt safety-sjablonen, adversarial robustness-tests, human-in-loop-werkstroom | Gratis; betaalde abonnementen beginnen bij $ 1.050/maand |

| BigML. com | Voorspellende modellen bouwen en uitleggen zonder enige kennis van code of ML Teamgrootte: Ideaal voor analisten en gebruikers zonder programmeerkennis | Visuele drag-and-drop-modellering, ensemble learning, clustering, tijdreeksvoorspellingen | 14 dagen gratis proefversie; betaalde abonnementen vanaf $ 30 per maand. |

| LangChain | Het bouwen van AI-agents en werkstroom die meerdere modellen, tools en API's combineren Teamgrootte: Ideaal voor AI-ontwikkelaars die agentgebaseerde tools bouwen | Traceren en loggen, API-call caching, fallback-logica, streaming-responses, aangepaste eval-frameworks | Free; betaalde abonnementen beginnen bij $ 39/maand |

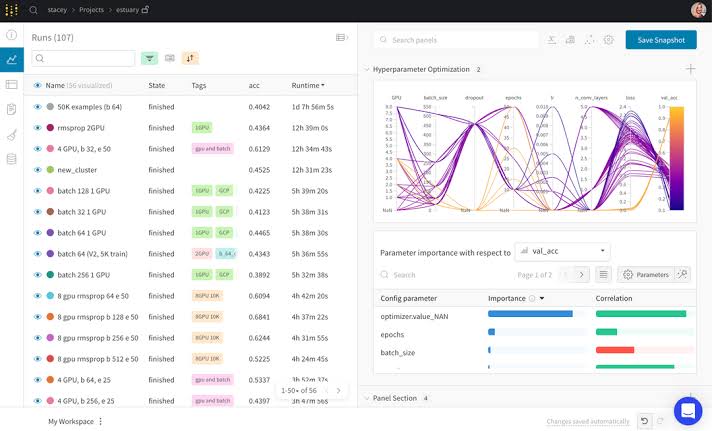

| Weights & Biases | Houd machine learning-experimenten georganiseerd, reproduceerbaar en prestatiegericht Teamgrootte: Ideaal voor ML-onderzoeksteams en AI-laboratoria | Hyperparametersweeps, live dashboard, het delen van openbare experimenten, GPU-profilering en experimentversie. | Gratis; betaalde abonnementen beginnen bij $ 50 per maand. |

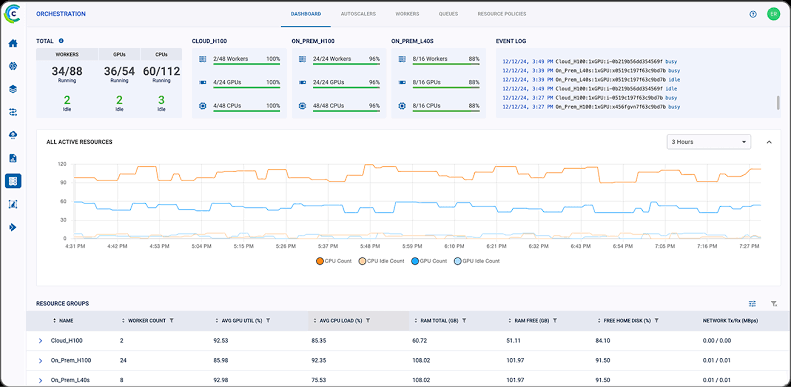

| ClearML | Beheer de volledige MLOps-levenscyclus, van bijhouden tot orkestratie en implementatie Teamgrootte: Ideaal voor ML-teams met veel operationele taken en intern infrastructuurgebruik | Auditlogging, blauw-groene implementatie, CI/CD-integratie, off-peak planning, modelregistratie, reproduceerbaarheidstools | Gratis; betaalde abonnementen beginnen bij $ 15 per maand per gebruiker. |

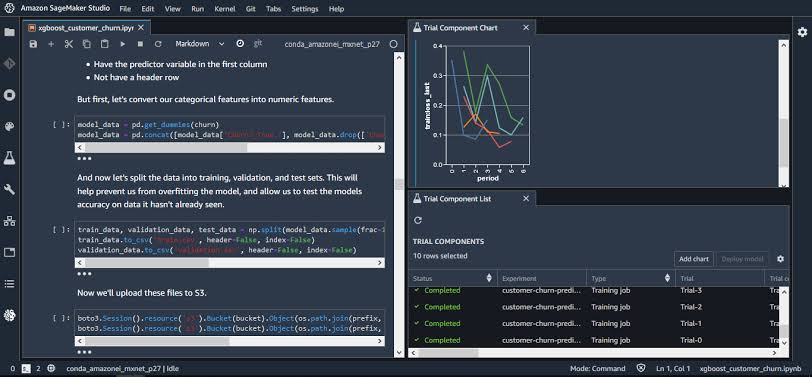

| Amazon SageMaker | ML-modellen native uitvoeren, afstemmen en schalen op AWS-infrastructuur Teamgrootte: Ideaal voor AWS-gebaseerde teams die op grote schaal bouwen | Ground Truth-gegevenslabel, beheerde notebooks, automatische hyperparameterafstemming, schaalbare eindpunten, CloudWatch-monitoring | Unified Studio: gratis; andere prijzen zijn afhankelijk van rekenkracht en gebruik |

Hoe we software beoordelen bij ClickUp

Ons redactieteam volgt een transparant, op onderzoek gebaseerd en leveranciersonafhankelijk proces, zodat u erop kunt vertrouwen dat onze aanbevelingen zijn gebaseerd op de werkelijke waarde van het product.

Hier volgt een gedetailleerd overzicht van hoe we software beoordelen bij ClickUp.

Waarom kiezen voor alternatieven voor Hugging Face?

Dit is waarom het verstandig is om alternatieven voor Hugging Face te verkennen:

- Op maat gemaakte AI-functies: vind platforms met gespecialiseerde grote taalmodellen voor niche-taken zoals computervisie of geavanceerde NLP.

- Vereenvoudigde werkstroom: Kies oplossingen met een eenvoudigere installatie of interfaces zonder code voor snellere prototyping en verbeterde operationele efficiëntie.

- Kosteneffectieve abonnementen: Ontdek opties met gratis niveaus of lagere prijzen voor budgetbewust gegevensbeheer.

- verbeterde integratiemogelijkheden: *Zoek naar tools die naadloos synchroniseren met uw bestaande tech stack, zoals CRM's of cloudplatforms

- Schaalbare prestaties: Kies voor AI-platforms die grotere datasets kunnen verwerken of snellere verwerking bieden voor grote projecten

- sterkere ondersteuning voor ondernemingen: *Kies Hugging Face-alternatieven met speciale ondersteuning voor teams die robuuste, veilige oplossingen nodig hebben

- Aangepaste modeltraining: Ontdek opties met geavanceerde fijnafstemming voor unieke, hoogwaardige modellen

- Innovatieve implementatieopties: Kies tools met unieke hosting- of implementatiemethoden voor eenvoudigere schaalbaarheid

🔍 Wist je dat? Dankzij transformers kunnen tools zoals GPT en BERT hele zinnen samen lezen. Ze pikken de toon, intentie en context op op een manier die oudere modellen nooit konden. Daarom klinkt de AI van vandaag natuurlijker wanneer hij antwoord geeft.

De beste alternatieven voor Hugging Face

Dit zijn onze keuzes voor de beste alternatieven voor Hugging Face. 👇

1. ClickUp (het beste voor het rechtstreeks integreren van AI in projectmanagement, documenten en werkstroom)

Iedereen gebruikt AI, maar het meeste daarvan zit in silo's. Je hebt één tool voor schrijven, een andere voor samenvatten en een derde voor plannen, maar geen van deze tools communiceert met je werk. Dat zorgt voor meer AI-wildgroei en onnodige chaos.

ClickUp lost dat op door AI in te bedden waar het helpt: in uw taken, documenten en teamupdates.

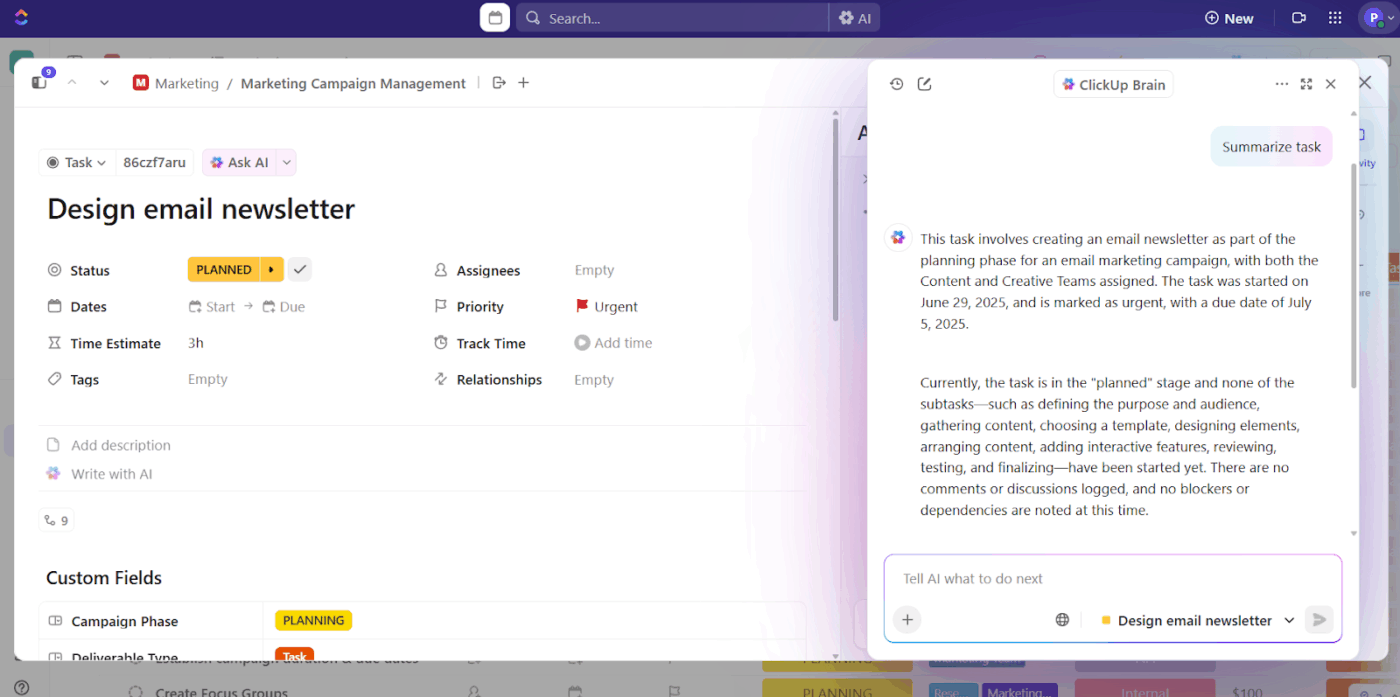

Schrijf, vat samen en automatiseer in context

ClickUp Brain is ingebouwd in elk onderdeel van het platform. Het schrijft content, vat updates samen, genereert rapporten en herschrijft rommelige taakbeschrijvingen – precies daar waar het werk plaatsvindt.

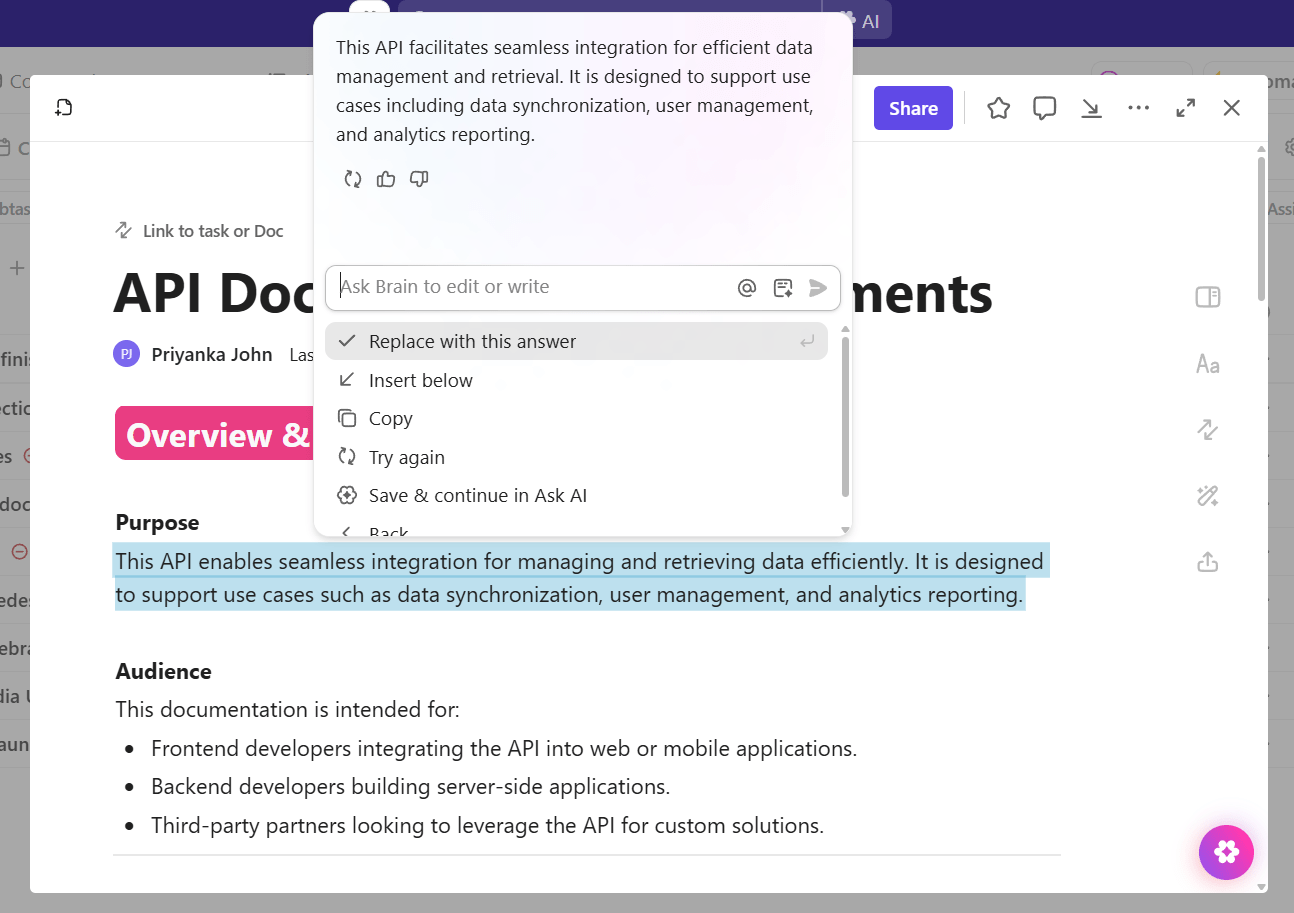

Stel dat u API-vereisten voor ontwikkelaars documenteert.

Je plakt technische specificaties in een ClickUp Doc, voegt opsommingstekens toe over verificatie en limiet, en vraagt ClickUp Brain vervolgens om ontwikkelaarsvriendelijke documentatie met code-voorbeelden te maken.

De verbonden AI-assistent structureert uw ruwe aantekeningen in duidelijke secties, terwijl deze binnen het document blijven, waar uw team ze kan raadplegen.

Andere voorbeelden:

- Verander een lang vergadering-document in een projectbriefing voor uw teamleider

- Herschrijf vage beschrijvingen van de taak om de volgende stappen duidelijker te maken

- Stel terugkerende client-updates op aan de hand van de takenactiviteit van de afgelopen week

- Vat een planningsthread samen en wijs follow-ups toe aan eigenaren

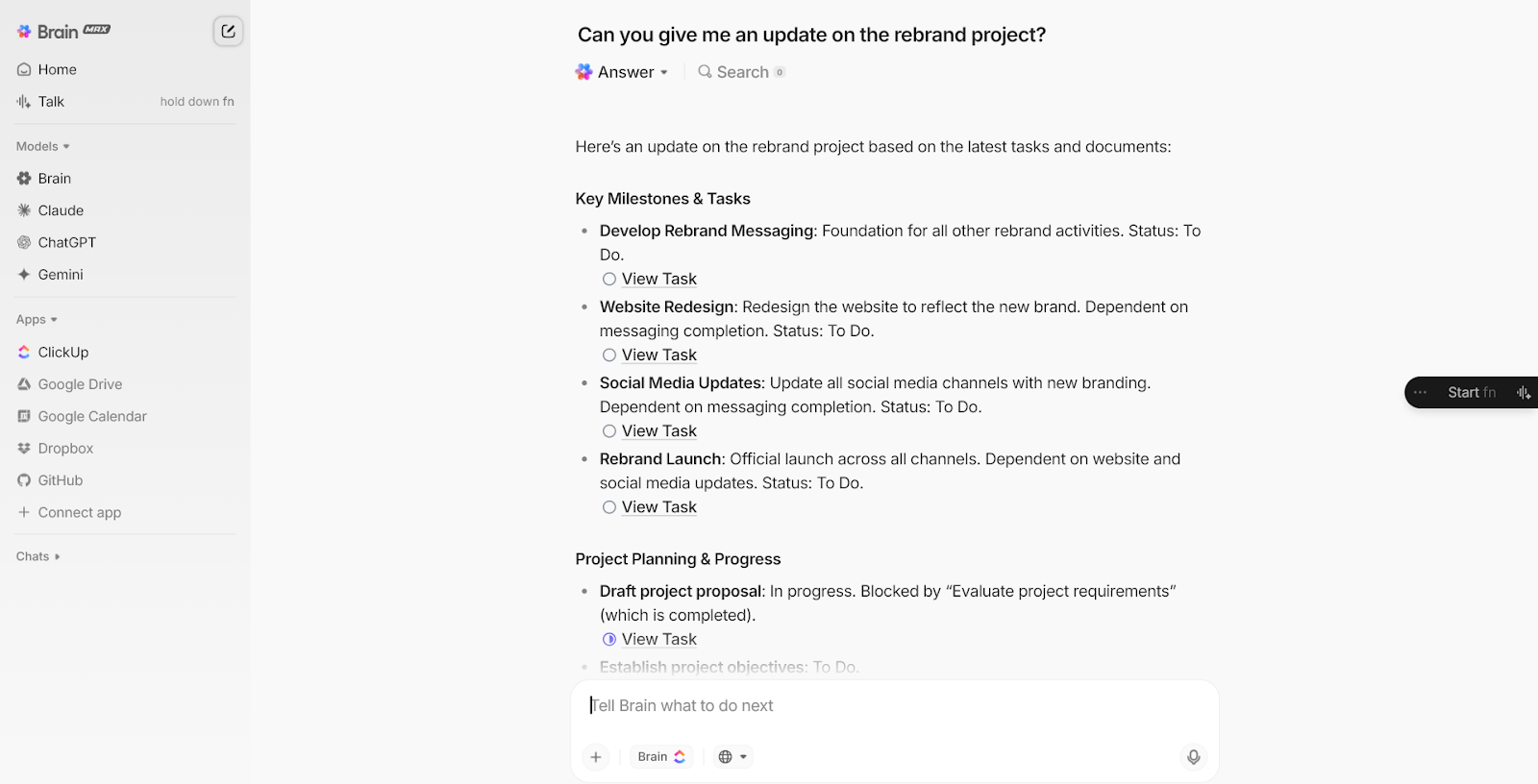

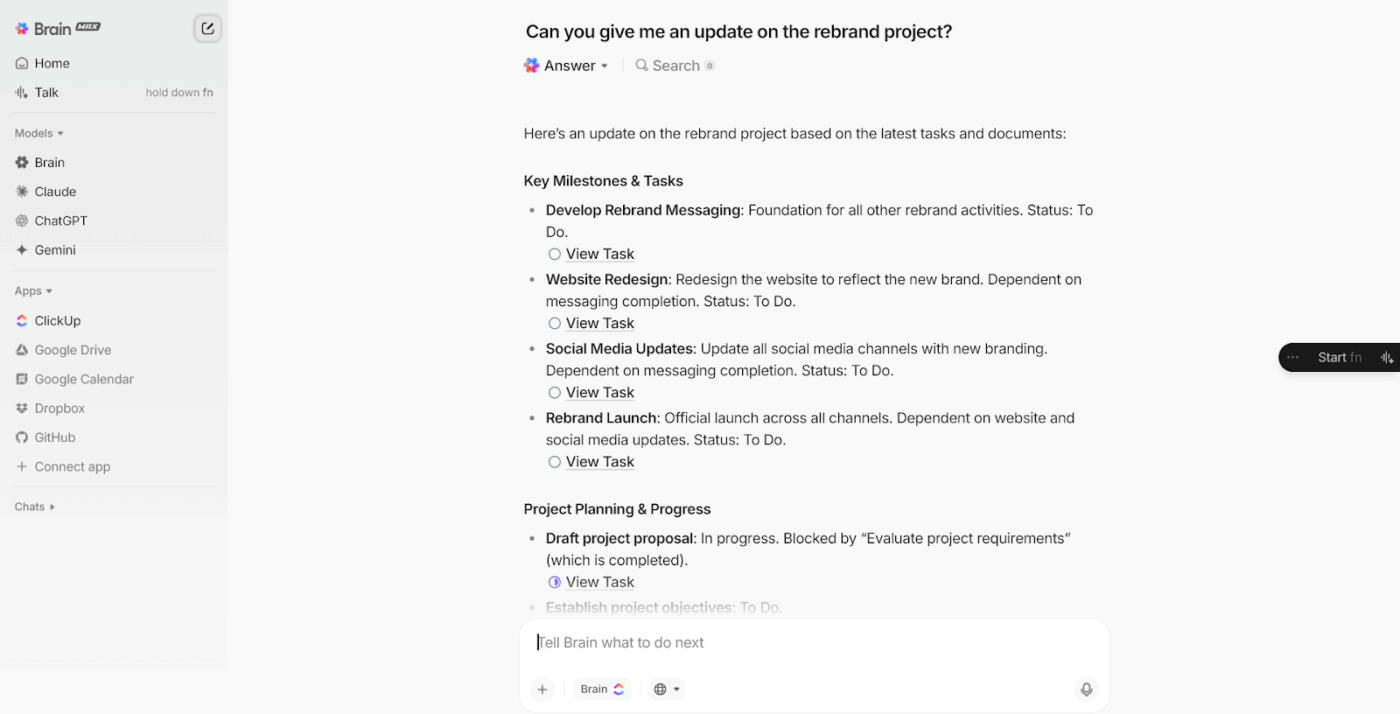

Vind antwoorden, blokkades en rapportage in enkele seconden

Ja, ClickUp Brain helpt je bij het werk binnen taken en documenten. Maar soms heb je behoefte aan een stap terug: een gerichte ruimte om vragen te stellen, duidelijkheid te krijgen en snel te handelen.

Dat is precies waar ClickUp Brain MAX voor is gemaakt.

Het biedt u een speciale ruimte om met AI te werken, los van uw taken en documenten, maar volledig daarmee verbonden. Als uw desktop-AI-assistent helpt het u om na te denken over uw werk, antwoorden te vinden en sneller te werken zonder van tool te wisselen of de context opnieuw uit te leggen.

Typ een vraag en het haalt informatie uit live werkruimtegegevens, niet uit geïsoleerde AI-uitvoer. Het begrijpt de projectcontext, prioriteitniveaus en toewijzingen aan eigenaren. U kunt uw query zelfs hardop uitspreken.

clickUp Brain MAX is voice-first, *altijd binnen handbereik en ontworpen om de mentale belasting van het beheren van werk te verminderen.

Stel dat u leiding geeft aan een cross-functie lancering. U vraagt: "Wat blokkeert de uitrol van de campagne?" Brain MAX toont achterstallige taken, toegewezen eigenaren, gekoppelde documenten en gemarkeerde opmerkingen die klaar zijn om te worden afgehandeld.

Andere praktijkvoorbeelden:

- Vraag om een lijst met achterstallige taken, gegroepeerd per toegewezen persoon

- Bekijk een overzicht van de voltooide mijlpalen van dit kwartaal

- Krijg een realtime weergave van blokkades in alle actieve projecten

- Ontdek risico's voordat ze escaleren, op basis van Taak-activiteit

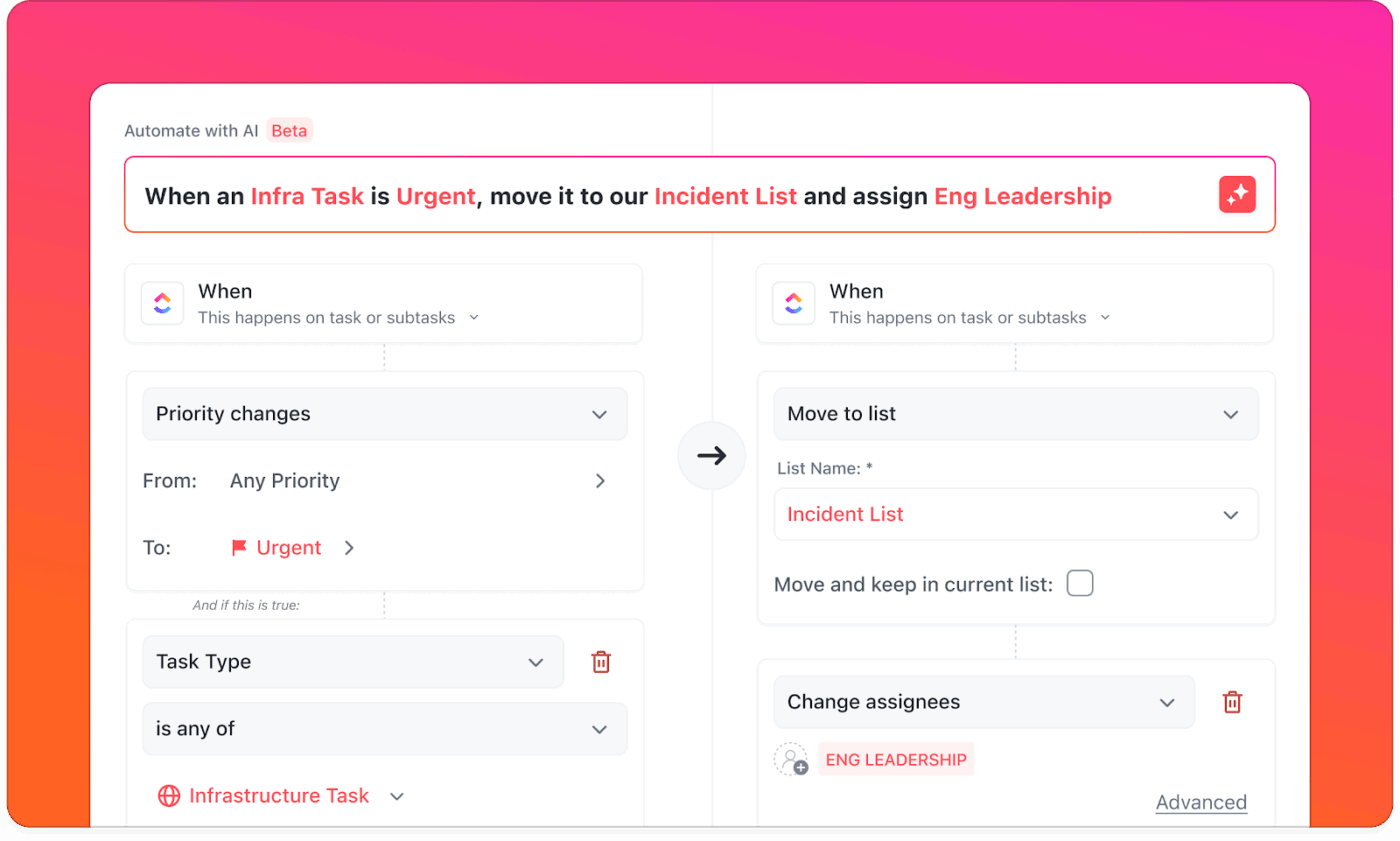

Automatiseer taken zonder regels

U hoeft niet langer door triggers en acties te spitten. Beschrijf gewoon wat u wilt in natuurlijke taal, en AI bouwt de automatisering in ClickUp.

Uw customer success-team voert bijvoorbeeld repetitief werk uit telkens wanneer een zakelijke client zich aanmeldt. U geeft ClickUp Brain de volgende opdracht: Wanneer een taak wordt getagd met 'Enterprise Onboarding', maak dan subtaken aan voor het kickoff-gesprek, het welkomstpakket, de technische opdracht en follow-up herinneringen.

AI bouwt deze meerstap werkstroom automatisering en laat je deze testen voordat je live gaat.

De beste functies van ClickUp

- *aI-agenten die werken: Implementeer gespecialiseerde ClickUp AI Autopilot Agents die terugkerende taken zoals projectupdates en statusrapporten afhandelen – geen complexe modeltraining vereist

- Vermijd vendor lock-in: krijg toegang tot Claude, GPT, Gemini en andere toonaangevende AI-modellen via één intuïtieve interface zonder werkstroom opnieuw te hoeven opbouwen

- Mis nooit meer de context: Gebruik ClickUp's AI Notetaker om vergaderingen automatisch vast te leggen en samen te vatten met actiepunten die direct worden synchroniseerd met uw taken

- Vind alles: Zoek in al uw werk met Enterprise AI Search in ClickUp, dat de context van uw team begrijpt

- schaalbaar zonder complexiteit: *Profiteer van AI-functies van onderneming-kwaliteit zonder dat u infrastructuur of API-sleutels hoeft te beheren – alles werkt direct uit de doos

- Brainstorm visueel: Genereer afbeeldingen rechtstreeks in ClickUp Whiteboards door ClickUp Brain te activeren en zet die ideeën vervolgens om in uitvoerbare projectplannen

- *chatten zonder te schakelen: Houd gesprekken in verbinding met je daadwerkelijk werk met behulp van ClickUp Chat

- plan slimmer: *Laat ClickUp Kalender automatisch focusuren blokkeren en optimale vergaderingen voorstellen op basis van projectdeadlines

Limieten van ClickUp

- Je kunt de onderliggende AI-infrastructuur niet wijzigen, forken of eraan bijdragen, zoals je dat wel kunt met Hugging Face

Prijzen van ClickUp

Beoordelingen en recensies van ClickUp

- G2: 4,7/5 (meer dan 10.385 beoordelingen)

- Capterra: 4,6/5 (meer dan 4.000 beoordelingen)

Wat zeggen echte gebruikers over ClickUp?

Deze G2-recensie zegt eigenlijk alles over dit AI-samenwerkingsplatform:

De nieuwe Brain MAX heeft mijn productiviteit aanzienlijk verbeterd. De mogelijkheid om meerdere AI-modellen, waaronder geavanceerde redeneringsmodellen, te gebruiken voor een betaalbare prijs maakt het gemakkelijk om alles op één platform te centraliseren. Functies zoals spraak-naar-tekst, automatisering van taken en integratie met andere apps maken de werkstroom veel soepeler en slimmer.

De nieuwe Brain MAX heeft mijn productiviteit aanzienlijk verbeterd. De mogelijkheid om meerdere AI-modellen, waaronder geavanceerde redeneermodellen, te gebruiken voor een betaalbare prijs maakt het gemakkelijk om alles op één platform te centraliseren. Functies zoals spraak-naar-tekst, automatisering van taken en integratie met andere apps maken de werkstroom veel soepeler en slimmer.

📮 ClickUp Insight: 30% van onze respondenten vertrouwt op AI-tools voor onderzoek en het verzamelen van informatie. Maar is er een AI die je helpt dat ene verloren bestand op het werk te vinden of die belangrijke Slack-thread die je bent vergeten op te slaan?

Ja! De AI-aangedreven Connected Search van ClickUp kan direct zoeken in al uw werkruimte-content, inclusief geïntegreerde apps van derden, en inzichten, bronnen en antwoorden ophalen. Bespaar tot 5 uur per week met de geavanceerde zoekfunctie van ClickUp!

2. OpenAI (het beste voor toegang tot geavanceerde taal- en beeldgeneratiemodellen)

via OpenAI

OpenAI haalde de krantenkoppen toen ChatGPT werd gelanceerd en plotseling had iedereen het weer over AI. Hun GPT-modellen kunnen alles aan, van het schrijven van e-mails tot het debuggen van code, terwijl DALL-E je wildste tekstprompts omzet in echte afbeeldingen.

Wat OpenAI onderscheidt, is de manier waarop ze AI hebben verpakt. Je krijgt toegang tot modellen die voorheen alleen in onderzoekslaboratoria beschikbaar waren. Natuurlijk betaal je voor het gemak, maar wanneer deadlines krap zijn en clients je op de hielen zitten, is dat gemak van onschatbare waarde.

De beste functies van OpenAI

- Verfijn modellen op basis van uw specifieke datasets, zodat ze aansluiten bij uw merkstem, schrijfstijl of domeinexpertise

- Beheer het gedrag van modellen met behulp van systeemmeldingen en temperatuurinstellingen om creativiteitsniveaus en responsformat aan te passen

- Verwerk meerdere bestandsformaten, waaronder pdf's, afbeeldingen en documenten, voor uitgebreide content-analyse en -extractie

- Houd de gebruikskosten bij en stel uitgavenlimieten in via gedetailleerde factureringsdashboards die de uitgaven uitsplitsen per model en project

- Maak embeddings voor semantische zoektoepassingen die betekenis begrijpen in plaats van alleen maar trefwoorden te matchen

Limieten van OpenAI

- Limiet aanpassingsmogelijkheden voor modelarchitectuur

- Afhankelijkheid van externe API-aanroepen beïnvloedt offline functionaliteit

- Rate limieten kunnen van invloed zijn op applicaties met grote volumes in diverse sectoren

- OpenAI heeft te maken gehad met meerdere rechtszaken en kritische vragen over trainingsgegevens die zonder toestemming van het internet zijn gehaald

Prijzen van OpenAI

- GPT-4. 1 Invoer: $2 per 1 miljoen tokens Gecachete invoer: $0,50 per 1 miljoen tokens Uitvoer: $8 per 1 miljoen tokens

- Input: $2 per 1 miljoen tokens

- Cache-invoer: $0,50 per 1 miljoen tokens

- Output: $ 8 per 1 miljoen tokens

- GPT-4. 1 mini Invoer: $0,40 per 1 miljoen token Gecachete invoer: $0,10 per 1 miljoen token Uitvoer: $1,60 per 1 miljoen token

- Input: $0,40 per 1 miljoen token

- Cache-invoer: $0,10 per 1 miljoen tokens

- Output: $1,60 per 1 miljoen tokens

- GPT-4. 1 nano Invoer: $0,100 per 1 miljoen token Invoer in cache: $0,025 per 1 miljoen token Uitvoer: $0,400 per 1 miljoen token

- Input: $0,100 per 1 miljoen token

- Cache-invoer: $0,025 per 1 miljoen tokens

- Output: $0,400 per 1 miljoen token

- OpenAI o3 Invoer: $2 per 1 miljoen tokens Gecachete invoer: $0,50 per 1 miljoen tokens Uitvoer: $8 per 1 miljoen tokens

- Input: $2 per 1 miljoen tokens

- Cache-invoer: $0,50 per 1 miljoen tokens

- Output: $8 per 1 miljoen tokens

- OpenAI o4-mini Invoer: $1,100 per 1 miljoen token Gecachete invoer: $0,275 per 1 miljoen token Uitvoer: $4,400 per 1 miljoen token

- Input: $1,100 per 1 miljoen tokens

- Cache-invoer: $0,275 per 1 miljoen tokens

- Output: $4. 400 per 1 miljoen token

- Modellen finetunen GPT-4. 1 Invoer: $3 per 1 miljoen tokens Gecachete invoer: $0,75 per 1 miljoen tokens Uitvoer: $12 per 1 miljoen tokens Training: $25 per 1 miljoen tokens GPT-4. 1 mini Input: $0,80 per 1 miljoen token Cache-input: $0,20 per 1 miljoen token Output: $3,20 per 1 miljoen token Training: $5 per 1 miljoen token GPT-4. 1 nano Input: $0,20 per 1 miljoen token Cached input: $0,05 per 1 miljoen token Output: $0,80 per 1 miljoen token Training: $1,50 per 1 miljoen token o4-mini Input: $4 per 1 miljoen token Cache-input: $1 per 1 miljoen token Output: $16 per 1 miljoen token Training: $100 per trainingsuur

- GPT-4. 1 Invoer: $3 per 1 miljoen tokens Gecachete invoer: $0,75 per 1 miljoen tokens Uitvoer: $12 per 1 miljoen tokens Training: $25 per 1 miljoen tokens

- Input: $3 per 1 miljoen tokens

- Cache-invoer: $0,75 per 1 miljoen tokens

- Output: $12 per 1 miljoen tokens

- Training: $25 per 1 miljoen tokens

- GPT-4. 1 mini Invoer: $0,80 per 1 miljoen token Gecachete invoer: $0,20 per 1 miljoen token Uitvoer: $3,20 per 1 miljoen token Training: $5 per 1 miljoen token

- Input: $0,80 per 1 miljoen token

- Cache-invoer: $0,20 per 1 miljoen tokens

- Output: $3,20 per 1 miljoen tokens

- Training: $ 5 per 1 miljoen tokens

- GPT-4. 1 nano Invoer: $0,20 per 1 miljoen token Gecachete invoer: $0,05 per 1 miljoen token Uitvoer: $0,80 per 1 miljoen token Training: $1,50 per 1 miljoen token

- Input: $0,20 per 1 miljoen token

- Cache-invoer: $0,05 per 1 miljoen tokens

- Output: $0,80 per 1 miljoen tokens

- Training: $ 1,50 per 1 miljoen tokens

- o4-mini Input: $4 per 1 miljoen token Cached input: $1 per 1 miljoen token Output: $16 per 1 miljoen token Training: $100 per trainingsuur

- Input: $4 per 1 miljoen tokens

- Cache-invoer: $1 per 1 miljoen tokens

- Output: $16 per 1 miljoen tokens

- Training: $ 100 per trainingsuur

- Input: $2 per 1 miljoen tokens

- Cache-invoer: $0,50 per 1 miljoen tokens

- Output: $ 8 per 1 miljoen tokens

- Input: $0,40 per 1 miljoen token

- Cache-invoer: $0,10 per 1 miljoen tokens

- Output: $1,60 per 1 miljoen tokens

- Input: $0,100 per 1 miljoen token

- Cache-invoer: $0,025 per 1 miljoen tokens

- Output: $0,400 per 1 miljoen token

- Input: $2 per 1 miljoen tokens

- Cache-invoer: $0,50 per 1 miljoen tokens

- Output: $8 per 1 miljoen tokens

- Input: $1,100 per 1 miljoen tokens

- Cache-invoer: $0,275 per 1 miljoen tokens

- Output: $4. 400 per 1 miljoen token

- GPT-4. 1 Invoer: $3 per 1 miljoen tokens Gecachete invoer: $0,75 per 1 miljoen tokens Uitvoer: $12 per 1 miljoen tokens Training: $25 per 1 miljoen tokens

- Input: $3 per 1 miljoen tokens

- Cache-invoer: $0,75 per 1 miljoen tokens

- Output: $12 per 1 miljoen tokens

- Training: $25 per 1 miljoen tokens

- GPT-4. 1 mini Invoer: $0,80 per 1 miljoen token Gecachete invoer: $0,20 per 1 miljoen token Uitvoer: $3,20 per 1 miljoen token Training: $5 per 1 miljoen token

- Input: $0,80 per 1 miljoen token

- Cache-invoer: $0,20 per 1 miljoen tokens

- Output: $3,20 per 1 miljoen tokens

- Training: $ 5 per 1 miljoen tokens

- GPT-4. 1 nano Invoer: $0,20 per 1 miljoen token Gecachete invoer: $0,05 per 1 miljoen token Uitvoer: $0,80 per 1 miljoen token Training: $1,50 per 1 miljoen token

- Input: $0,20 per 1 miljoen token

- Cache-invoer: $0,05 per 1 miljoen tokens

- Output: $0,80 per 1 miljoen tokens

- Training: $1,50 per 1 miljoen tokens

- o4-mini Input: $4 per 1 miljoen token Cached input: $1 per 1 miljoen token Output: $16 per 1 miljoen token Training: $100 per trainingsuur

- Input: $4 per 1 miljoen tokens

- Cache-invoer: $1 per 1 miljoen tokens

- Output: $16 per 1 miljoen tokens

- Training: $ 100 per trainingsuur

- Input: $3 per 1 miljoen tokens

- Cache-invoer: $0,75 per 1 miljoen tokens

- Output: $12 per 1 miljoen tokens

- Training: $25 per 1 miljoen tokens

- Input: $0,80 per 1 miljoen token

- Cache-invoer: $0,20 per 1 miljoen tokens

- Output: $3,20 per 1 miljoen tokens

- Training: $ 5 per 1 miljoen tokens

- Input: $0,20 per 1 miljoen token

- Cache-invoer: $0,05 per 1 miljoen tokens

- Output: $0,80 per 1 miljoen tokens

- Training: $ 1,50 per 1 miljoen tokens

- Input: $4 per 1 miljoen tokens

- Cache-invoer: $1 per 1 miljoen tokens

- Output: $16 per 1 miljoen tokens

- Training: $ 100 per trainingsuur

OpenAI-beoordelingen en recensies

- G2: 4,7/5 (830+ beoordelingen)

- Capterra: 4,5/5 (meer dan 220 beoordelingen)

Wat zeggen echte gebruikers over OpenAI?

Uit een G2-recensie:

De API is geweldig, met een uitstekende interface voor de gebruiker, en ik heb geen problemen ondervonden tijdens het gebruik van chatgpt. Ik vond het geweldig en raad iedereen aan om het te proberen, te downloaden en snel een beslissing te nemen.

Het API is geweldig, met een uitstekende interface voor de gebruiker, en ik heb geen problemen ondervonden tijdens het gebruik van chatgpt. Ik vond het geweldig en raad het ten zeerste aan om het te proberen, te downloaden en snel een beslissing te nemen.

🎥 Bekijk: Hoe u ClickUp Brain kunt gebruiken als uw persoonlijke assistent, altijd en overal.

💡 Pro-tip: Vertrouw niet op één enkele maatstaf. Splits de LLM-evaluatie op in hoe goed het omgaat met gestructureerde invoer (bijv. tabellen, lijsten) versus ongestructureerde prompts (open taken). Zo ontdek je sneller foutpatronen.

3. Anthropic Claude (het beste voor veilige en contextuele AI-gesprekken)

via Anthropic

Claude hanteert een andere benadering van AI-veiligheid. In plaats van content-filters toe te passen, heeft Anthropic het getraind om problemen zorgvuldig te overdenken. U zult merken dat Claude meerdere perspectieven in overweging neemt voordat hij reageert, waardoor hij goed is in genuanceerde discussies over complexe onderwerpen.

Het contextvenster is enorm, dus je kunt er hele documenten in invoeren en echte gesprekken voeren over de content.

Denk eens aan die momenten waarop u een onderzoeksrapport wilde bespreken of een lang rapport wilde analyseren. Claude gaat op natuurlijke wijze met deze scenario's om. Het onthoudt ook alles uit eerdere gesprekken, zodat u zich niet steeds hoeft te herhalen.

De beste functies van Anthropic Claude

- Schrijf en debug code in tientallen programmeertalen, waarbij logica wordt uitgelegd en verbeteringen worden voorgesteld

- Zoek in realtime op internet om actuele informatie te vinden en feiten te verifiëren tijdens gesprekken

- Denk na over complexe ethische dilemma's en genuanceerde onderwerpen en presenteer evenwichtige perspectieven in plaats van al te simplistische antwoorden

- Voer geavanceerde wiskundige berekeningen en statistische analyses uit met stapsgewijze uitleg en verificatie

- Genereer gestructureerde outputs zoals JSON, XML en YAML die specifieke schema's volgen voor API-integraties

Beperkingen van Anthropic Claude

- Het heeft een kleinere selectie in vergelijking met de Claude-alternatieven

- Minder flexibiliteit voor het trainen van aangepaste modellen

- Hogere latentie voor sommige gespecialiseerde taken

Prijzen van Anthropic Claude

- Claude Opus 4 Input: $15 per 1 miljoen tokens Output: $75 per 1 miljoen tokens Prompt caching: Schrijven: $18,75 per 1 miljoen tokens Lezen: $1,50 per 1 miljoen tokens

- Input: $15 per 1 miljoen tokens

- Output: $75 per 1 miljoen token

- Prompt caching: Schrijven: $18,75 per 1 miljoen tokens Lezen: $1,50 per 1 miljoen tokens

- Schrijf: $18,75 per 1 miljoen tokens

- Lees: $1,50 per 1 miljoen tokens

- Claude Sonnet 4 Input: $3 per 1 miljoen tokens Output: $15 per 1 miljoen tokens Prompt caching: Schrijven: $3,75 per 1 miljoen tokens Lezen: $0,30 per 1 miljoen tokens

- Input: $3 per 1 miljoen tokens

- Output: $15 per 1 miljoen tokens

- Prompt caching: Schrijven: $3,75 per 1 miljoen tokens Lezen: $0,30 per 1 miljoen tokens

- Schrijf: $3,75 per 1 miljoen tokens

- Lees: $0,30 per 1 miljoen token

- Claude Haiku 3. 5 Input: $0,80 per 1 miljoen tokens Output: $4 per 1 miljoen tokens Prompt caching: Schrijven: $1 per 1 miljoen tokens Lezen: $0,08 per 1 miljoen tokens

- Input: $0,80 per 1 miljoen token

- Output: $4 per 1 miljoen tokens

- Prompt caching: Schrijven: $1 per 1 miljoen tokens Lezen: $0,08 per 1 miljoen tokens

- Schrijf: $1 per 1 miljoen tokens

- Lees: $0,08 per 1 miljoen token

- Input: $15 per 1 miljoen tokens

- Output: $75 per 1 miljoen token

- Prompt caching: Schrijven: $18,75 per 1 miljoen tokens Lezen: $1,50 per 1 miljoen tokens

- Schrijf: $18,75 per 1 miljoen tokens

- Lees: $1,50 per 1 miljoen tokens

- Schrijf: $18,75 per 1 miljoen tokens

- Lees: $1,50 per 1 miljoen tokens

- Input: $3 per 1 miljoen tokens

- Output: $15 per 1 miljoen tokens

- Prompt caching: Schrijven: $3,75 per 1 miljoen tokens Lezen: $0,30 per 1 miljoen tokens

- Schrijf: $3,75 per 1 miljoen tokens

- Lees: $0,30 per 1 miljoen token

- Schrijf: $3,75 per 1 miljoen tokens

- Lees: $0,30 per 1 miljoen token

- Input: $0,80 per 1 miljoen token

- Output: $4 per 1 miljoen tokens

- Prompt caching: Schrijven: $1 per 1 miljoen tokens Lezen: $0,08 per 1 miljoen tokens

- Schrijf: $1 per 1 miljoen tokens

- Lees: $0,08 per 1 miljoen tokens

- Schrijf: $1 per 1 miljoen tokens

- Lees: $0,08 per 1 miljoen token

Anthropic Claude beoordelingen en recensies

- G2: 4,4/5 (55+ beoordelingen)

- Capterra: 4,5/5 (meer dan 20 beoordelingen)

Wat zeggen echte gebruikers over Anthropic Claude?

Gebaseerd op een opmerking op Reddit:

Eerlijk gezegd? Claude lijkt gewoon een goed 'mens'. Het houdt bij zijn beslissingen rekening met het welzijn van de mens op een manier die je bij andere modellen niet ziet. Als ik gedwongen zou worden om een LLM te kiezen als wereldleider, zou Claude mijn eerste keuze zijn. Ik zou de anderen niet noodzakelijkerwijs in dezelfde mate vertrouwen zonder training op het gebied van ethiek of persoonlijkheidsvorming.

Eerlijk gezegd? Claude lijkt gewoon een goed 'mens'. Het houdt bij zijn beslissingen rekening met het welzijn van de mens op een manier die je bij andere modellen niet ziet. Als ik gedwongen zou worden om een LLM te kiezen als wereldleider, zou Claude mijn eerste keuze zijn. Ik zou de anderen niet noodzakelijkerwijs in dezelfde mate vertrouwen zonder training op het gebied van ethiek of persoonlijkheidsvorming.

🧠 Leuk weetje: In 2012 versloeg een model genaamd AlexNet mensen op het gebied van beeldherkenning. Het was sneller, nauwkeuriger en raakte niet vermoeid. Dat moment veranderde hoe mensen het potentieel van AI zagen in velden als gezondheidszorg, veiligheid en robotica.

4. Cohere (het beste voor het bouwen van natuurlijke taalverwerkingsoplossingen op bedrijfsniveau)

via Cohere

Cohere heeft zijn platform speciaal ontwikkeld voor bedrijven die kunstmatige intelligentie nodig hebben, maar geen concessies kunnen doen op het gebied van gegevensprivacy. Hun meertalige mogelijkheden omvatten meer dan 100 talen, wat enorm is als u te maken heeft met wereldwijde klanten of internationale markten.

De embeddings werken bijzonder goed voor zoektoepassingen waarbij u de betekenis moet begrijpen in plaats van alleen maar trefwoorden te matchen. U kunt ook uw eigen AI- aangepaste classificaties trainen, wat praktisch is voor teams die AI-oplossingen nodig hebben maar geen speciale datawetenschappers in dienst hebben.

De beste functies van Cohere

- Verfijn modellen met behulp van uw eigen gegevens, terwijl u volledige controle behoudt over trainingsdatasets en modelgewichten

- Schaal de inferentiecapaciteit automatisch op basis van vraagpatronen zonder de onderliggende GPU-infrastructuur te beheren

- Implementeer retrieval-augmented generation-systemen die bronnen kunnen citeren en attributie kunnen geven voor gegenereerde content

- Monitor de prestaties en gebruikspatronen van modellen via uitgebreide analytische dashboard en waarschuwingssystemen

- Integreer met bestaande verificatie-systemen met behulp van SSO, SAML en op rollen gebaseerde toegangscontroles om experimenten bij te houden

Limieten van Cohere

- Kleinere community en minder integraties van derden

- Limiet computervisiecapaciteiten in vergelijking met multimodale platforms

- Er zijn minder vooraf getrainde modellen beschikbaar voor gespecialiseerde domeinen

- Minder uitgebreide documentatie voor geavanceerde gebruiksscenario's en hybride installaties

Prijzen van Cohere

- Commando A Invoer: $2,50 per 1 miljoen tokens Uitvoer: $10 per 1 miljoen tokens

- Input: $ 2,50 per 1 miljoen tokens

- Output: $10 per 1 miljoen tokens

- Commando R Invoer: $0,15 per 1 miljoen tokens Uitvoer: $0,60 per 1 miljoen tokens

- Input: $0,15 per 1 miljoen token

- Output: $0,60 per 1 miljoen tokens

- Commando R7B Input: $0,0375 per 1 miljoen token Output: $0,15 per 1 miljoen token

- Input: $0,0375 per 1 miljoen token

- Output: $0,15 per 1 miljoen token

- Input: $ 2,50 per 1 miljoen tokens

- Output: $10 per 1 miljoen tokens

- Input: $0,15 per 1 miljoen token

- Output: $0,60 per 1 miljoen token

- Input: $0,0375 per 1 miljoen token

- Output: $0,15 per 1 miljoen tokens

Cohere-beoordelingen en recensies

- G2: Onvoldoende beoordelingen

- Capterra: Onvoldoende beoordelingen

Wat zeggen echte gebruikers over Cohere?

Volgens een recensie van Capterra:

De instelling van Cohere was vrij eenvoudig en de documentatie was vrij eenvoudig te volgen. Het was erg nuttig en cool om te kunnen zien hoe onze gebruikers de app gebruiken. […] De gratis versie van de software heeft een zeer beperkte limiet aan sessies en naarmate ons gebruikersbestand is gegroeid, vinden we de applicatie minder nuttig omdat meer sessies achter een betaalmuur zijn verborgen.

De instelling van Cohere was vrij eenvoudig en de documentatie was vrij eenvoudig te volgen. Het was erg handig en cool om te kunnen zien hoe onze gebruikers de app gebruiken. […] De gratis versie van de software heeft een zeer beperkte limiet aan sessies en naarmate ons gebruikersbestand is gegroeid, vinden we de applicatie minder nuttig omdat meer sessies achter een betaalmuur zijn verborgen.

🔍 Wist u dat? Modellen zoals GPT‑4 en Grok 4 veranderden hun antwoorden wanneer ze tegenwind kregen (zelfs als hun eerste antwoord correct was). Ze begonnen aan zichzelf te twijfelen nadat ze tegenstrijdige feedback hadden gekregen. Dit lijkt griezelig veel op hoe mensen zich gedragen onder stress, en het roept vragen op over de betrouwbaarheid van hun antwoorden.

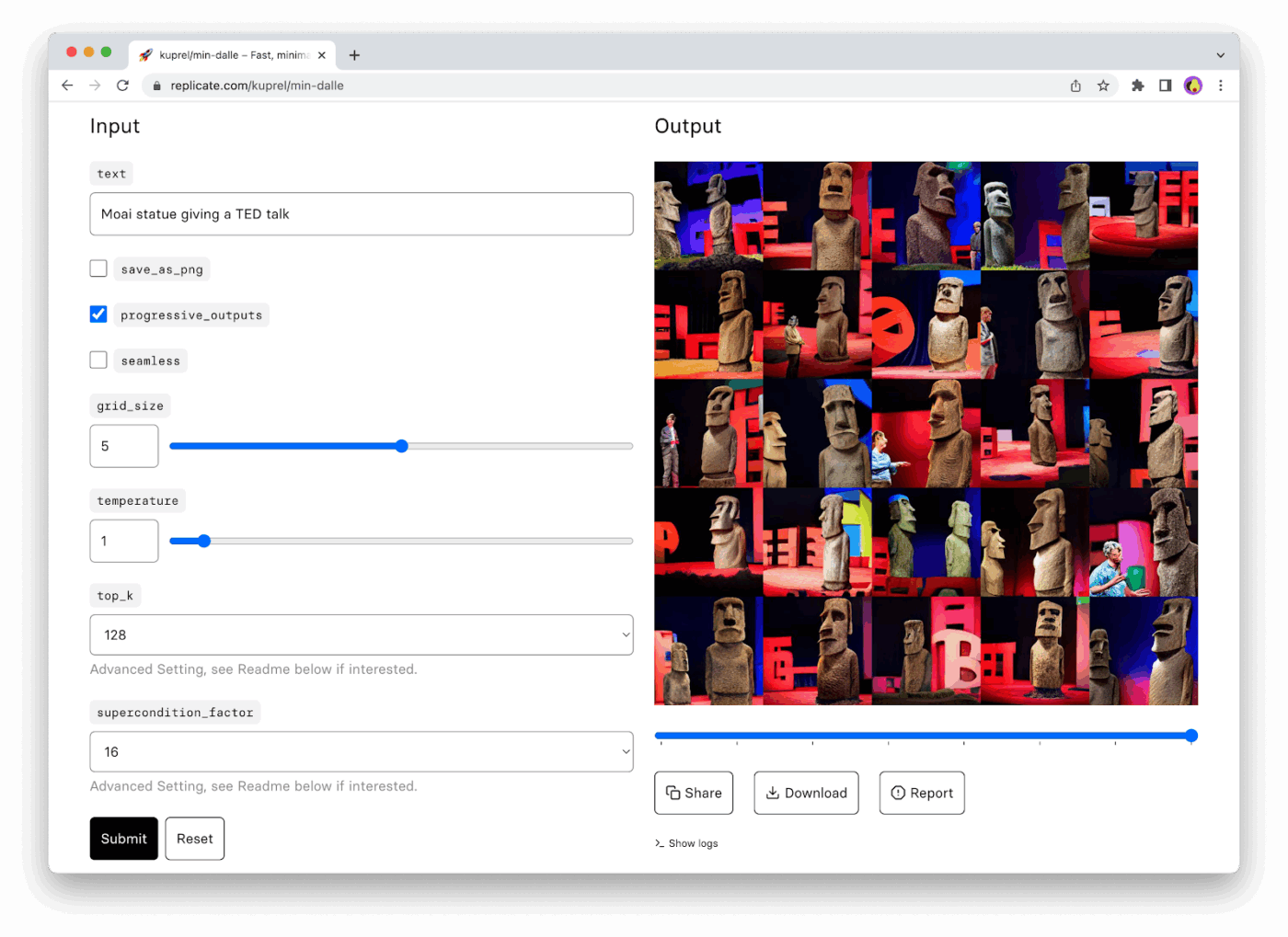

5. Replicate (het beste voor het uitvoeren van open-source AI-modellen zonder infrastructuurbeheer)

via Replicate

Replicate is als het hebben van een enorme bibliotheek met AI-modellen zonder het gedoe van het beheren van servers. Heeft iemand een geweldige beeldgenerator gebouwd? Die staat waarschijnlijk op Replicate. Wil je dat nieuwe spraaksynthesemodel uitproberen waar iedereen het over heeft? Doe gewoon een API-oproep.

De AI-app handelt alle complexiteit van de infrastructuur af, zodat u met tientallen verschillende modellen kunt experimenteren zonder u aan één model toe te wijzen. U betaalt alleen wanneer u iets gebruikt, waardoor het perfect is voor prototyping.

Bovendien kunt u, wanneer u een model vindt dat werkt, zelfs uw eigen aangepaste versies implementeren met behulp van hun eenvoudige containersysteem.

Repliceer de beste functies

- Beheer de versiecontrole van uw modelimplementaties met rollback-mogelijkheden en A/B-tests tussen verschillende versie

- Stel webhooks in om notificaties te ontvangen wanneer langdurige voorspellingen zijn voltooid of fouten zijn opgetreden

- Verwerk meerdere invoeren tegelijkertijd in batches om de kosten per voorspelling te verlagen en de doorvoerefficiëntie te verbeteren

- Fork bestaande modellen om aangepaste versies te maken met verschillende parameters of trainingsgegevens

Limieten repliceren

- Je hebt minder controle over de modelhostingomgeving en configuraties

- Er zijn mogelijke latentieproblemen voor realtime-toepassingen en onderneming

- Limiet mogelijkheden voor aangepaste modelaanpassing en fijnafstemming

- Afhankelijkheid van de beschikbaarheid en het onderhoud van modellen van derden

Replicate-prijzen

- De prijzen verschillen per model

Beoordelingen en recensies repliceren

- G2: Onvoldoende beoordelingen

- Capterra: Onvoldoende beoordelingen

Wat zeggen echte gebruikers over Replicate?

Een recensie op Reddit maakt aantekening:

Hoe dan ook, repliceren is naar mijn mening de gemakkelijkste optie om nieuwe beeld- of video-modellen uit te proberen. Ik betwijfel of het de meest kosteneffectieve optie is als je veel gebruikers hebt, maar voor een MVP kan het je veel gedoe en geld besparen (in tegenstelling tot het per uur huren van een GPU).

Hoe dan ook, repliceren is naar mijn mening de gemakkelijkste optie om nieuwe beeld- of video-modellen uit te proberen. Ik betwijfel of het de meest kosteneffectieve optie is als je veel gebruikers hebt, maar voor een MVP kan het je veel gedoe en geld besparen (in tegenstelling tot het per uur huren van een GPU).

💡 Pro-tip: Fine-tune met mate. U hoeft niet altijd een model te fine-tunen om domeinspecifieke outputs te krijgen. Probeer eerst slimme prompt engineering + retrieval-augmented generation (RAG). Investeer alleen in fine-tuning als u consequent de nauwkeurigheids- of relevantieplafonds bereikt.

6. TensorFlow (het beste voor het vanaf nul creëren van aangepaste machine learning-modellen)

via TensorFlow

TensorFlow geeft u volledige controle over uw machine learning-toekomst (wat zowel een zegen als een vloek kan zijn). Google heeft zijn productie-ML-framework open source gemaakt, wat betekent dat u dezelfde tools krijgt die zij intern gebruiken.

De flexibiliteit is ongelooflijk; je kunt alles bouwen, van eenvoudige lineaire regressie tot complexe transformatorarchitecturen.

TensorFlow Hub biedt vooraf getrainde modellen die u kunt verfijnen, terwijl TensorBoard u realtime analyses van de trainingsprestaties geeft. Deze kracht gaat echter gepaard met complexiteit. U zult tijd besteden aan het leren van concepten die op platforms van een hoger niveau worden geabstraheerd.

De beste functies van TensorFlow

- Breng de prestaties van profielmodellen in kaart en identificeer knelpunten met behulp van geavanceerde debuggingtools die het geheugengebruik en reken grafieken weergeven

- Converteer modellen tussen verschillende formaten, zoals SavedModel, TensorFlow Lite en ONNX, voor compatibiliteit tussen verschillende platforms

- Implementeer aangepaste verliesfuncties en optimalisatiealgoritmen die niet beschikbaar zijn in standaard machine learning-bibliotheken

- Gebruik training met gemengde precisie om het geheugengebruik te verminderen en de training op moderne GPU-architecturen te versnellen

- Creëer aangepaste datapijplijnen met tf. data die grote datasets efficiënt verwerken met voorbewerking en uitbreiding

Limieten van TensorFlow

- Het vereist aanzienlijke rekenkracht voor het trainen van grote modellen

- Complex debuggingproces in vergelijking met alternatieven voor Hugging Face op hoger niveau

- Tijdrovende installatie en configuratie voor geavanceerde gebruiksscenario's

Prijzen van TensorFlow

- Aangepaste prijzen

TensorFlow-beoordelingen en recensies

- G2: 4,5/5 (meer dan 125 beoordelingen)

- Capterra: 4,6/5 (meer dan 100 beoordelingen)

Wat zeggen echte gebruikers over TensorFlow?

Een gebruiker op G2 benadrukt:

Ik vind het geweldig hoe krachtig en flexibel TensorFlow is voor het bouwen en trainen van deep learning-modellen. Keras maakt het een beetje makkelijker en vooraf getrainde modellen besparen veel tijd. Bovendien is de community geweldig als ik ergens niet uitkom. […] De leercurve is steil. Vooral voor beginners. Soms zijn de foutmeldingen te ingewikkeld om te begrijpen en is debuggen frustrerend. Ook vereist het veel rekenkracht, wat een probleem kan zijn als je geen high-end hardware hebt.

Ik vind het geweldig hoe krachtig en flexibel TensorFlow is voor het bouwen en trainen van deep learning-modellen. Keras maakt het een beetje makkelijker en vooraf getrainde modellen besparen veel tijd. Bovendien is de community geweldig als ik ergens niet uitkom. […] De leercurve is steil. Vooral voor beginners. Soms zijn de foutmeldingen te ingewikkeld om te begrijpen en is debuggen frustrerend. Ook vereist het veel rekenkracht, wat een probleem kan zijn als je geen high-end hardware hebt.

🧠 Leuk weetje: Onderzoekers hebben ontdekt dat taalmodellen vaak softwarepakketten suggereren die niet bestaan. Ongeveer 19,7% van de code-steekproeven bevatte verzonnen namen, wat kan leiden tot squatting-aanvallen.

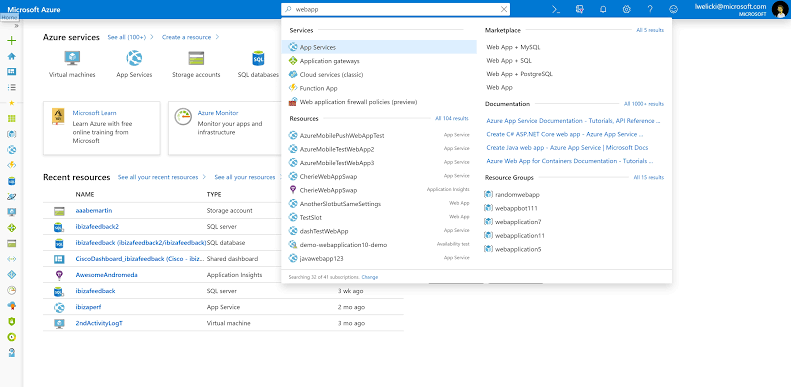

7. Azure Machine Learning (het beste voor het integreren van ML-werkstroom met Microsoft-cloudservices)

via Microsoft Azure

Azure ML is een logische keuze als uw organisatie al met Microsoft werkt. De tool biedt zowel point-and-click-interfaces voor zakelijke gebruikers als volledige programmeeromgevingen voor datawetenschappers.

AutoML neemt het zware werk uit handen wanneer u snel resultaat nodig hebt, door automatisch verschillende algoritmen en hyperparameters uit te proberen. Dankzij de integratie met Power BI kunnen uw modellen bovendien rechtstreeks worden ingevoerd in executive dashboards.

U krijgt robuuste versie-beheer voor modellen, geautomatiseerde implementatiepijplijnen en monitoring die u waarschuwt wanneer de prestaties van het model achteruitgaan.

De beste functies van Azure Machine Learning

- Plan geautomatiseerde hertrainingspijplijnen die worden getriggerd wanneer nieuwe gegevens beschikbaar komen of de modelprestaties achteruitgaan

- Creëer aangepaste Docker-omgevingen voor reproduceerbare modeltraining en -implementatie op verschillende compute targets

- Implementeer functies voor modelinterpretatie die voorspellingen uitleggen met behulp van LIME, SHAP en andere verklaarbaarheidstechnieken

- Stel datadriftmonitoring in de u waarschuwt wanneer binnenkomende gegevens aanzienlijk verschillen van trainingsdatasets

- Beheer rekenclusters die automatisch worden geschaald op basis van de werklast, terwijl ze worden geoptimaliseerd voor kostenefficiëntie

Limieten van Azure Machine Learning

- Er zijn zorgen over vendor lock-in voor organisaties die multi-cloudstrategieën gebruiken

- Limiet flexibiliteit in vergelijking met open-source alternatieven voor Hugging Face

Prijzen voor Azure Machine Learning

- Aangepaste prijzen

Beoordelingen en recensies van Azure Machine Learning

- G2: 4,3/5 (85+ beoordelingen)

- Capterra: 4,5/5 (30 beoordelingen)

Wat zeggen echte gebruikers over Azure Machine Learning?

Zoals gedeeld op G2:

De service is gebruiksvriendelijk en heeft veel interessante functies om gegevens te uploaden en patronen te herkennen. De interface kan beter, maar voldoet aan mijn behoeften. Als u twijfels hebt over de implementatie, vindt u veel informatie op het internet of kunt u rechtstreeks hulp vragen aan de Microsoft-ondersteuning.

De service is gebruiksvriendelijk en heeft veel interessante functies om gegevens te uploaden en patronen te herkennen. De interface kan beter, maar voldoet aan mijn behoeften. Als u twijfels hebt over de implementatie, vindt u veel informatie op het internet of kunt u rechtstreeks hulp vragen aan de Microsoft-ondersteuning.

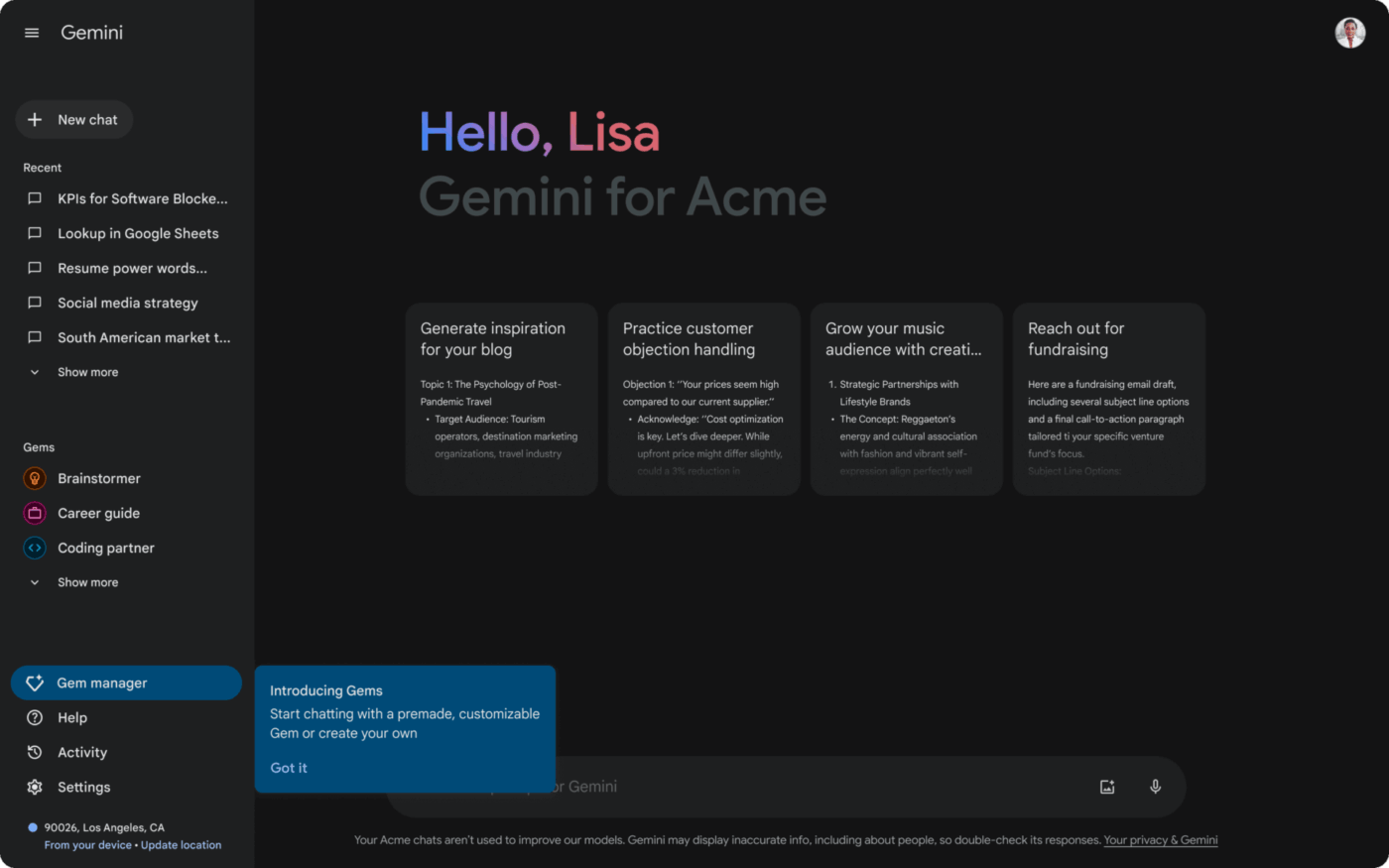

8. Google Gemini (het beste voor het verwerken van meerdere content-typen in één interactie)

via Google Gemini

Gemini van Google begrijpt meerdere soorten content tegelijkertijd. Je kunt een grafiek laten zien en vragen stellen over de gegevens, of afbeeldingen uploaden en gesprekken voeren over wat er op die afbeeldingen te zien is. De wiskundige en code-functies zijn bijzonder sterk. Het werkt stap voor stap door complexe vergelijkingen heen en legt zijn redenering uit.

Het contextvenster kan enorme hoeveelheden tekst verwerken, waardoor het handig is voor het analyseren van volledige onderzoeksrapporten of lange documenten. Het interessante is dat het de gespreksstroom tussen verschillende soorten content in stand houdt zonder dat je bijhoudt waar je het over hebt.

De beste functies van Google Gemini

- Vertaal tussen tientallen talen met behoud van de context en culturele nuances in de originele tekst

- Genereer en voer Python-code rechtstreeks binnen gesprekken uit, waarbij resultaten worden weergegeven en fouten in realtime worden opgespoord

- Haal gestructureerde gegevens uit ongestructureerde bronnen zoals bonnen, formulieren en handgeschreven documenten

- Analyseer zowel visuele als audiocomponenten tegelijkertijd voor gedetailleerde video-samenvattingen van video-content

- Voer complexe redeneringstaken uit waarvoor informatie uit meerdere bronnen en content moet worden gecombineerd

Limieten van Google Gemini

- Limiet beschikbaarheid in bepaalde regio's en voor specifieke gebruikssituaties

- Minder uitgebreide opties voor aangepaste modellen in vergelijking met gevestigde alternatieven

- Gebruikers hebben hun bezorgdheid geuit over gegevensprivacy binnen het ecosysteem van Google

Prijzen van Google Gemini

- Free

- Betaald niveau: Prijzen verschillen per model

Beoordelingen en recensies van Google Gemini

- G2: 4,4/5 (245+ beoordelingen)

- Capterra: Onvoldoende beoordelingen

🧠 Leuk weetje: Je zou denken dat betere modellen minder fouten maken, maar het tegenovergestelde kan gebeuren. Naarmate LLM's groter en geavanceerder worden, hallucineren ze soms meer, vooral wanneer ze om feiten worden gevraagd. Zelfs nieuwere versies vertonen meer zelfverzekerde fouten, waardoor ze moeilijker te herkennen zijn.

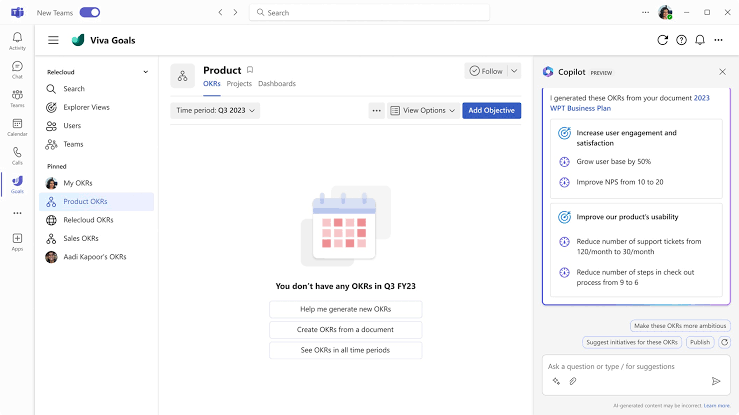

9. Microsoft Copilot (het beste voor het verbeteren van de productiviteit binnen Microsoft Office-toepassingen)

Copilot is geïntegreerd in de Microsoft-apps die u dagelijks gebruikt, wat de manier waarop AI in de praktijk werkt verandert. Het begrijpt uw werkcontext: uw schrijfstijl, de gegevens die u analyseert en zelfs uw vergader- en vergaderinggeschiedenis.

Vraag het om een presentatie te maken en het haalt relevante informatie uit uw recente documenten en e-mails.

De Excel-integratie is bijzonder slim en helpt u bij het analyseren van gegevens met behulp van natuurlijke taal in plaats van complexe formules. Het beste deel? Uw leercurve is minimaal omdat de interface van de AI-samenwerkingstool voortbouwt op vertrouwde Microsoft-conventies.

De beste functies van Microsoft Copilot

- Zet ruwe gegevens om in boeiende PowerPoint-presentaties met behulp van uw bestaande sjablonen en merkrichtlijnen

- Automatiseer repetitieve Excel-taken zoals draaitabellen, voorwaardelijke opmaak en het aanmaken van formules via conversatiecommando's

- Stel vergaderagenda's en follow-up-e-mails op basis van kalender-uitnodigingen en aantekeningen van eerdere vergaderingen

- Ontwerp professioneel ogende documenten met behulp van ingebouwde stijlen en format-suggesties die aansluiten bij de normen van uw organisatie

Limieten van Microsoft Copilot

- De tool vereist een Microsoft 365-abonnement en een ecosysteemtoewijzing en heeft een limiet aan functie buiten Microsoft-applicaties

- Inconsistente prestaties in verschillende Office-toepassingen

Prijzen van Microsoft Copilot

- Free

- Copilot Pro: $ 20/maand

- Copilot voor Microsoft 365: $ 30/maand per gebruiker (jaarlijks gefactureerd)

Beoordelingen en recensies van Microsoft Copilot

- G2: 4,4/5 (85+ beoordelingen)

- Capterra: Onvoldoende beoordelingen

Wat zeggen echte gebruikers over Microsoft Copilot?

Een Redditor zegt:

Ik gebruik het elke dag om me te helpen met moeilijkere Excel-functies. Als ik een conceptueel idee heb van hoe ik gegevens wil manipuleren, leg ik de situatie uit en Copilot komt bijna altijd met een praktische en bruikbare oplossing. Het heeft me geholpen om veel meer vertrouwd en comfortabel te raken met array-functies.

Ik gebruik het elke dag om me te helpen met moeilijkere Excel-functies. Als ik een conceptueel idee heb van hoe ik gegevens wil manipuleren, leg ik de situatie uit en Copilot komt bijna altijd met een praktische en bruikbare oplossing. Het heeft me geholpen om veel meer vertrouwd en comfortabel te raken met array-functies.

📖 Lees ook: De beste alternatieven voor Microsoft Copilot om uw leven en werkstroom gemakkelijker te maken

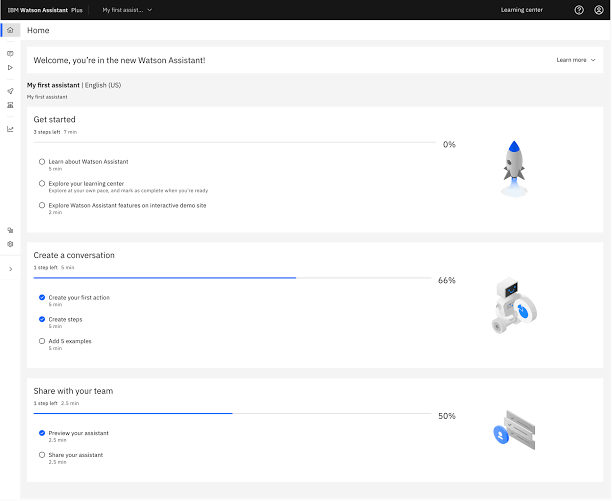

10. IBM WatsonX (het meest geschikt voor het implementeren van AI in sterk gereguleerde bedrijfsomgevingen)

via IBM WatsonX

IBM heeft WatsonX speciaal ontworpen voor organisaties die geen risico's kunnen nemen met AI, zoals banken, ziekenhuizen en overheidsinstanties. Elke modelbeslissing wordt geregistreerd, waardoor audit trails worden gecreëerd die compliance-teams waarderen.

Het platform biedt branchespecifieke oplossingen, waardoor zorginstellingen gebruik kunnen maken van modellen die zijn getraind op medische literatuur en financiële dienstverleners risicobeoordelingsmogelijkheden kunnen verkrijgen.

Afhankelijk van uw vereisten op het gebied van gegevensgevoeligheid kunt u modellen on-premises, in de cloud van IBM of in hybride configuraties implementeren. Met de governancefuncties kunt u waarborgen instellen en AI-outputs controleren op vooringenomenheid of onverwacht gedrag.

De beste functies van IBM WatsonX

- Implementeer eerlijkheidsmonitoring die automatisch vooringenomenheid in modelvoorspellingen voor verschillende demografische groepen detecteert en corrigeert

- Maak aangepaste AI-promptsjablonen met ingebouwde veiligheidsmaatregelen die schadelijke of ongepaste AI-reacties voorkomen

- Genereer gedetailleerde nalevingsrapportage met modelbeslissingen en gegevensgebruik voor regelgevende audits en documentatie

- Test de robuustheid van modellen met behulp van adversarial voorbeelden en edge cases om potentiële kwetsbaarheden te identificeren voordat u ze implementeert

- Zorg voor werkstroom waarbij mensen betrokken zijn en kritieke beslissingen handmatig moeten worden goedgekeurd voordat ze worden uitgevoerd

Limieten van IBM WatsonX

- Hogere kosten in vergelijking met cloud-native alternatieven voor Hugging Face

- De installatie- en configuratievereisten zijn complex.

- Het heeft een tragere innovatiecyclus in vergelijking met nieuwere AI-platforms.

- Community die beperkt ondersteunt en extensies van derden

Prijzen van IBM WatsonX

- Free

- Essentials: Vanaf $ 0/maand (pay-as-you-go-model)

- Standaard: vanaf $ 1.050/maand (pay-as-you-go-model)

IBM WatsonX-beoordelingen en recensies

- G2: 4,5/5 (84+ beoordelingen)

- Capterra: Onvoldoende beoordelingen

Wat zeggen echte gebruikers over IBM WatsonX?

Gebaseerd op een G2-recensie:

Als ontwikkelaar waardeer ik hoe het flexibiliteit combineert met structuur en een breed bereik aan modeltypes biedt, van klassieke ML tot grote taalmodellen. De gebruikersinterface is overzichtelijk en de integratie met bestaande cloud- en veiligheidframeworks is eenvoudig, wat helpt bij het versnellen van experimentele cycli zonder afbreuk te doen aan het beheer. […] Hoewel het platform krachtig is, kan het in het begin overweldigend aanvoelen, vooral bij de instelling van meer aangepaste werkstroom. Bovendien zou de prijsstelling transparanter kunnen zijn voor gebruikers die nog bezig zijn met het verkennen van opties voordat ze zich op ondernemingsniveau toewijzen. Verbeterde onboarding-tutorials voor ontwikkelaars die nieuw zijn in het ecosysteem van IBM zouden een welkome aanvulling zijn. *

Als ontwikkelaar waardeer ik hoe het flexibiliteit combineert met structuur en een breed bereik aan modeltypes biedt, van klassieke ML tot grote taalmodellen. De gebruikersinterface is overzichtelijk en de integratie met bestaande cloud- en veiligheidframeworks is eenvoudig, wat helpt bij het versnellen van experimentele cycli zonder afbreuk te doen aan het beheer. […] Hoewel het platform krachtig is, kan het in het begin overweldigend aanvoelen, vooral bij het instellen van meer aangepaste werkstroom. Bovendien zou de prijsstelling transparanter kunnen zijn voor gebruikers die nog steeds opties aan het verkennen zijn voordat ze zich op onderneming niveau toewijzen. Verbeterde onboarding-tutorials voor ontwikkelaars die nieuw zijn in het ecosysteem van IBM zouden een welkome aanvulling zijn. *

🎥 Bekijk: Probeer uw eerste AI-agent die contextueel reageert op uw werk. Hoor het rechtstreeks van Zeb Evans, oprichter en CEO van ClickUp:

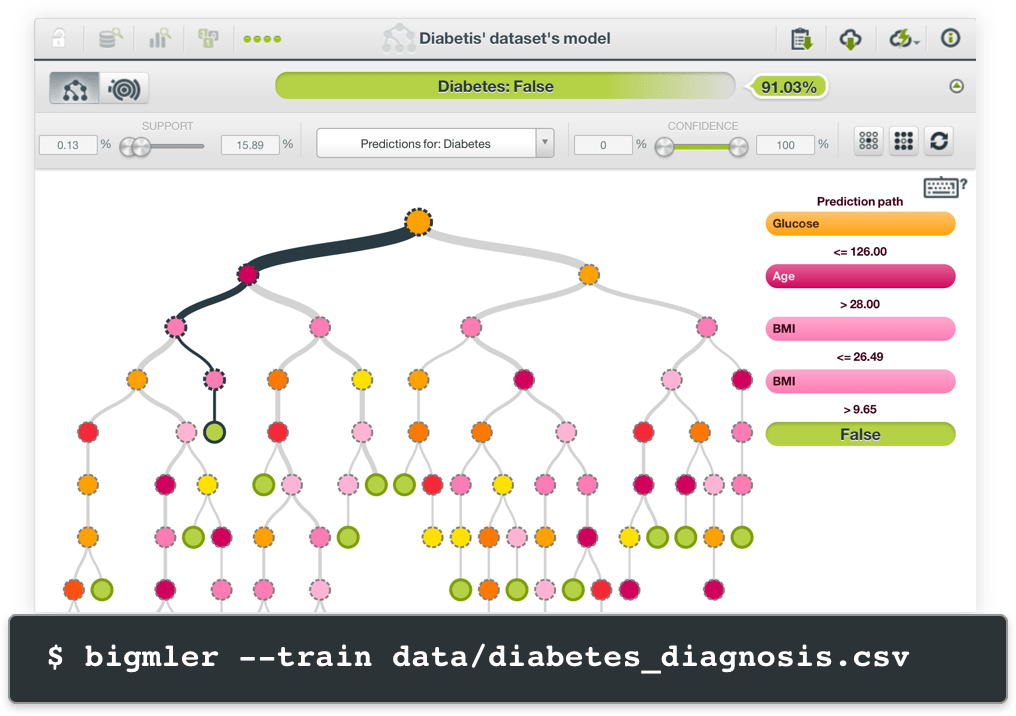

11. BigML. com (het beste voor het bouwen van voorspellende modellen zonder code of technische expertise)

via BigML

Met de visuele interface van BigML kunt u voorspellende modellen bouwen door datasets te slepen en neer te zetten in plaats van complexe code te schrijven. Upload een CSV-bestand met aangepaste klantgegevens en BigML helpt u te voorspellen welke klanten waarschijnlijk zullen weglopen.

Het platform zorgt automatisch voor de voorbewerking van gegevens, de selectie van functies en de validatie van modellen. Wat BigML zo betrouwbaar maakt, is de manier waarop het zijn voorspellingen uitlegt. U krijgt duidelijke visualisaties te zien die laten zien welke factoren van invloed zijn op modelbeslissingen, waardoor u het resultaat gemakkelijk kunt presenteren aan belanghebbenden die het 'waarom' achter AI-aanbevelingen moeten begrijpen.

BigML. com beste functies

- Genereer geautomatiseerde inzichten en aanbevelingen op basis van uw gegevens met behulp van natuurlijke taalverklaringen die ook voor niet-technische teams begrijpelijk zijn.

- Combineer meerdere algoritmen om de voorspellingsnauwkeurigheid te verbeteren en het risico op overfitting te verminderen met ensemblemodellen.

- Voer clusteranalyses uit om verborgen patronen en klantsegmenten in uw bedrijfsgegevens te identificeren.

- Bouw tijdreeksvoorspellingsmodellen voor voorraadplanning, vraagvoorspelling en financiële prognoses.

- Exporteer voorspellingslogica als zelfstandige applicaties of integreer deze rechtstreeks in bestaande bedrijfssystemen.

Limieten van BigML.com

- Het ondersteunt diepe leer en neurale netwerkarchitecturen met een limiet.

- Minder aangepaste mogelijkheden in vergelijking met op programmering gebaseerde platforms

- Kleinere community en ecosysteem van tools van derden

- Minder geschikt voor baanbrekend onderzoek en experimentele benaderingen

Prijzen van BigML.com

- 14 dagen gratis proefversie

- Standard Prime: $30/maand

Beoordelingen en recensies van BigML.com

- G2: 4,7/5 (meer dan 20 beoordelingen)

- Capterra: Onvoldoende beoordelingen

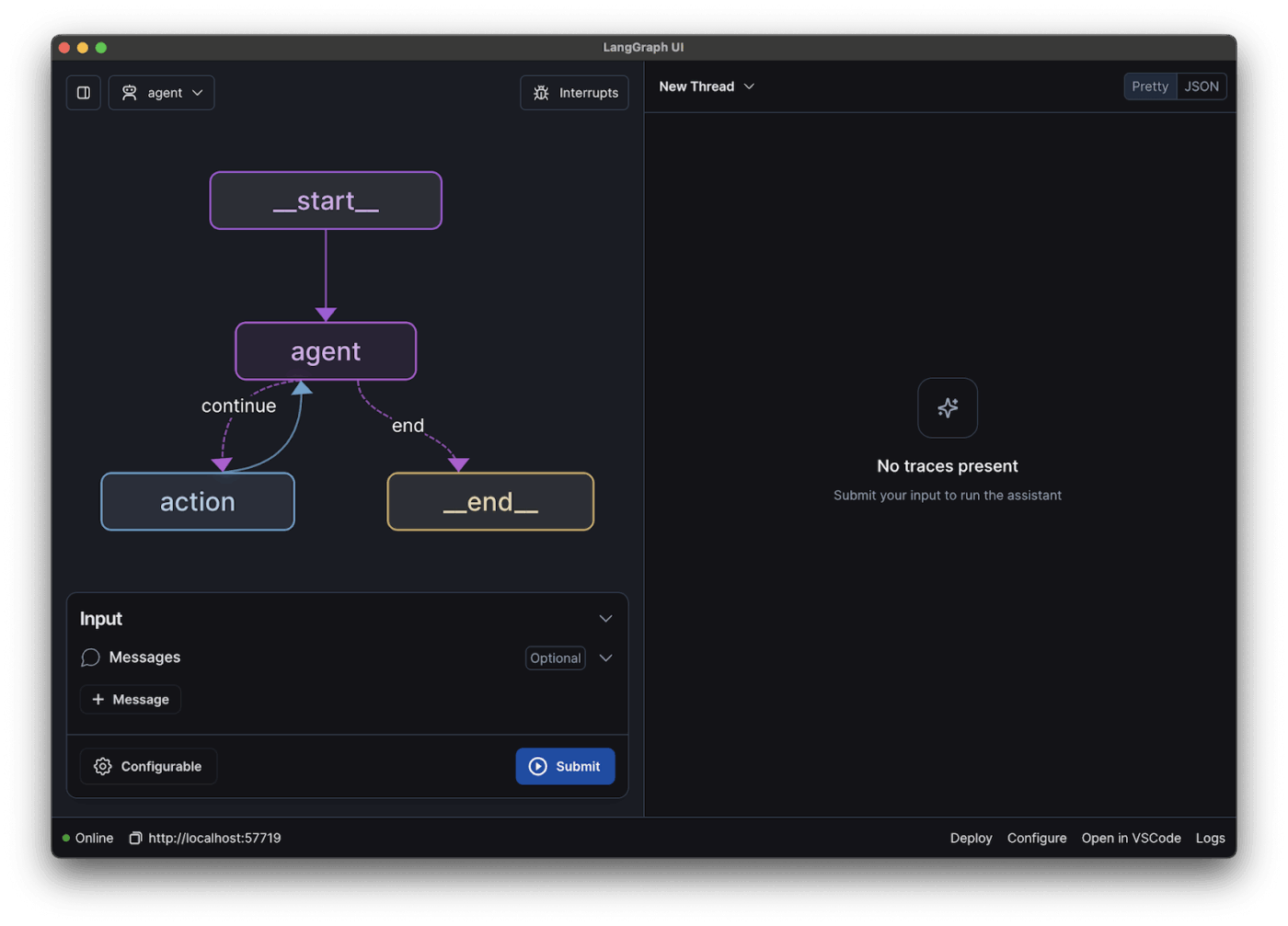

12. LangChain (het meest geschikt voor het ontwikkelen van complexe AI-toepassingen met meerdere componenten)

via LangChain

LangChain lost het probleem op van het leggen van de verbinding tussen AI-modellen en praktijktoepassingen. U kunt systemen bouwen die informatie opzoeken in databases, externe API's aanroepen en gesprekgeschiedenis bijhouden over meerdere interacties heen.

Het framework biedt vooraf gebouwde componenten voor veelvoorkomende patronen zoals RAG, waarbij AI-modellen toegang hebben tot specifieke documenten en deze kunnen citeren. U kunt verschillende AI-services aan elkaar koppelen, bijvoorbeeld door het ene model te gebruiken om de intentie van de gebruiker te begrijpen en het andere om reacties te genereren.

Bovendien zijn de LLM-agentmogelijkheden van LangChain open source en modelonafhankelijk, zodat u niet gebonden bent aan een bepaalde AI-provider.

De beste functies van LangChain

- Debug complexe AI-werkstroom met behulp van ingebouwde tracing- en loggingtools die precies laten zien hoe de werkstroom tussen componenten verloopt.

- Sla dure API-aanroepen en modelreacties op in de cache om kosten te verlagen en de prestaties van applicaties te verbeteren

- Behandel fouten op een elegante manier met herhalingslogica en fallback-mechanismen wanneer AI-services niet beschikbaar zijn

- Creëer aangepaste evaluatiekaders om de prestaties van AI-toepassingen in verschillende scenario's en datasets te testen

- Implementeer streamingresponsen voor realtime-toepassingen waarbij gebruikers onmiddellijke feedback nodig hebben tijdens langdurige processen

Limieten van LangChain

- Vereist programmeerkennis en begrip van AI-concepten

- Het hoge tempo van de ontwikkeling kan leiden tot ingrijpende veranderingen en instabiliteit

- Prestatieoverhead van abstractielagen in complexe applicaties

- Limiet ingebouwde monitoring- en debuggingtools voor productieomgevingen

Prijzen van LangChain

- Ontwikkelaar: Vanaf $ 0/maand (daarna betalen naar gebruik)

- Plus: Vanaf $ 39 per maand (daarna betalen naar gebruik)

- onderneming: *Aangepaste prijzen

LangChain-beoordelingen en recensies

- G2: Onvoldoende beoordelingen

- Capterra: Onvoldoende beoordelingen

💡 Pro-tip: Voordat u middelen in een enorme LLM steekt, bouwt u eerst een sterke pijplijn voor het ophalen van informatie die de context nauwkeurig filtert. De meeste hallucinaties beginnen met ruis in de invoer, niet met limieten van het model.

13. Weights & Biases (het beste voor het bijhouden en vergelijken van resultaten van machine learning-experimenten)

via Weights & Biases

Weights & Biases voorkomt dat ML een chaotische puinhoop wordt van vergeten experimenten en verloren resultaten. Het platform legt automatisch alles vast wat met uw modeltraining te maken heeft: hyperparameters, statistieken, code-versies en zelfs systeemprestaties.

Als iets goed werkt, kun je het gemakkelijk reproduceren. Als experimenten mislukken, kun je precies zien wat er mis is gegaan.

Met de visualisatietools kun je trends ontdekken in honderden trainingsruns en bepalen welke aanpak het beste presteert. Teams zijn dol op de samenwerkingsfuncties, omdat iedereen kan zien wat anderen doen zonder elkaars werk te stapelen.

De beste functies van Weights & Biases

- Stel geautomatiseerde hyperparametersweeps in die verschillende parametercombinaties verkennen en optimale configuraties identificeren

- Maak aangepaste dashboards met interactieve grafieken die in realtime worden bijgewerkt naarmate de experimenten voortgang boeken

- Tag en organiseer experimenten met behulp van aangepaste metadata om relevante resultaten te vinden in grote onderzoeksprojecten

- Deel experimentresultaten extern met behulp van openbare rapporten die geen gevoelige code of gegevens blootgeven

- Profiel trainingprestaties om GPU-gebruik problemen te identificeren en resource toewijzing te optimaliseren

Limieten van Weights & Biases

- De tool maakt eenvoudige projecten die geen uitgebreid bijhouden vereisen, extra complex

- De kosten kunnen snel oplopen voor grote teams en uitgebreide experimenten bijhouden

- Er zijn beoordelingen geweest over ontoereikende technische documentatie

Prijzen van Weights & Biases

Gehost in de cloud

- Free

- Pro: Vanaf $ 50 per maand

- onderneming: *Aangepaste prijzen

Privé gehost

- Gratis voor persoonlijk gebruik

- Advanced Onderneming: Aangepaste prijzen

Beoordelingen en recensies van Weights & Biases

- G2: 4,7/5 (meer dan 40 beoordelingen)

- Capterra: Onvoldoende beoordelingen

Wat zeggen echte gebruikers over Weights & Biases?

Op Reddit zei een gebruiker:

Ik gebruik WandB meerdere uren per dag in mijn werk. Het is het meest uitgeruste functie voor deze toepassing dat er te vinden is, maar de prestaties zijn zo ontzettend slecht.

Ik gebruik WandB meerdere uren per dag in mijn werk. Het is het meest functie-voltooide programma voor deze toepassing dat er te vinden is, maar de prestaties zijn zo ontzettend slecht.

📮 ClickUp Insight: Slechts 12% van de respondenten van onze enquête maakt gebruik van AI-functies die zijn ingebouwd in productiviteit suites. Deze lage acceptatiegraad suggereert dat de huidige implementaties mogelijk niet de naadloze, contextuele integratie bieden die gebruikers zou kunnen overhalen om over te stappen van hun favoriete standalone gesprek platform.

Kan de AI bijvoorbeeld een automatiseringwerkstroom uitvoeren op basis van een platte tekst-prompt van de gebruiker? ClickUp Brain kan dat ! De AI is diep geïntegreerd in elk aspect van ClickUp, inclusief maar niet beperkt tot het samenvatten van chatthreads, het opstellen of bijschaven van tekst, het ophalen van informatie uit de werkruimte, het genereren van afbeeldingen en nog veel meer!

Sluit u aan bij de 40% van de ClickUp-klanten die meer dan 3 apps hebben vervangen door onze alles-in-één app voor werk!

14. ClearML (het beste voor automatisering van end-to-end machine learning-werkstroom)

via ClearML

ClearML lost de operationele nachtmerrie van het beheer van machine learning-modellen in productie op. Het platform houdt automatisch elk aspect van uw ML-werkstroom bij, van gegevensvoorbewerking tot modelimplementatie, en creëert zo een voltooid controlespoor zonder handmatige inspanningen.

Wanneer modellen tijdens de productie defect raken, kunt u problemen herleiden tot specifieke gegevenswijzigingen of code-wijzigingen. Dankzij de gedistribueerde trainingsmogelijkheden kunt u experimenten naadloos schalen over meerdere machines en cloudproviders.

Bovendien realiseert pijplijnorkestratie automatisering van repetitieve taken zoals gegevensvalidatie, hertraining van modellen en goedkeuringen voor implementatie.

De beste functies van ClearML

- Plan experimenten zo dat ze automatisch worden uitgevoerd tijdens daluren om de rekenkosten en het gebruik van resources te optimaliseren

- Vergelijk de prestaties van modellen voor verschillende datasets en perioden met behulp van gestandaardiseerde evaluatiemetrics

- Integreer met bestaande CI/CD-pijplijnen en implementatietools met behulp van aangepaste artefacten en modelregisters

- Implementeer blauw-groene implementaties voor ML-modellen met geautomatiseerde rollback-mogelijkheden wanneer de prestaties achteruitgaan

- Genereer automatisch compliance-documentatie voor gereguleerde sectoren die gedetailleerd modelbeheer vereisen

Limieten van ClearML

- Complexe initiële installatie en configuratie voor geavanceerde functies

- Leercurve voor teams die overstappen van eenvoudiger werkstroombeheer

- De resource-intensieve monitoring van ClearML kan de systeemprestaties beïnvloeden

- Integraties met een limiet in vergelijking met meer gevestigde alternatieven voor Hugging Face

Prijzen van ClearML

- Free

- Pro: $15/maand per gebruiker + gebruik (voor teams met maximaal 10 leden)

- Schaal: Aangepaste prijzen

- onderneming: *Aangepaste prijzen

ClearML-beoordelingen en recensies

- G2: Onvoldoende beoordelingen

- Capterra: Onvoldoende beoordelingen

Wat zeggen echte gebruikers over ClearML?

Zoals gedeeld op Reddit:

We gebruiken ClearML uitsluitend voor het bijhouden van experimenten en we hebben zowel de ClearML Server als ClearML Agent zelf gehost op onze interne infrastructuur. Tot nu toe zijn onze ervaringen met ClearML uitstekend, met name wat betreft het beheer van experimenten, de reproduceerbaarheid en de implementatiewerkstroom.

We gebruiken ClearML uitsluitend voor het bijhouden van experimenten en we hebben zowel de ClearML Server als ClearML Agent zelf gehost op onze interne infrastructuur. Tot nu toe zijn onze ervaringen met ClearML uitstekend, met name wat betreft het beheer van experimenten, de reproduceerbaarheid en de implementatiewerkstroom.

🔍 Wist u dat? Hybride systemen presteren consequent beter dan systemen die slechts één methode gebruiken. Integreer beide benaderingen in uw AI-zoekmachine om een evenwicht te vinden tussen semantisch begrip en exacte zoekresultaten.

15. Amazon SageMaker (het beste voor het beheer van voltooide ML-levenscycli op AWS-infrastructuur)

via Amazon SageMaker

SageMaker is een goede keuze als je al in AWS-land leeft en ML-mogelijkheden nodig hebt die naadloos werken met je bestaande infrastructuur. De beheerde notebooks elimineren het gedoe van server-installatie, terwijl ingebouwde algoritmen veelvoorkomende use cases afhandelen zonder aangepaste code.

Ground Truth helpt bij het creëren van hoogwaardige trainingsdatasets door middel van beheerde annotatiewerkstroom, wat vooral waardevol is wanneer menselijke label nodig zijn voor beeld- of tekstgegevens.

Wanneer modellen klaar zijn voor productie, handelt SageMaker de complexiteit van de implementatie af, zoals load balancing en auto-scaling. Alles wordt gefactureerd via uw bestaande AWS-account, wat het kostenbeheer vereenvoudigt.

De beste functies van Amazon SageMaker

- Train modellen met behulp van beheerde infrastructuur die automatisch resources toewijst op basis van de grootte van de dataset en de rekenvereisten

- Implementeer modellen via schaalbare eindpunten die pieken in het verkeer verwerken en de capaciteit automatisch aanpassen op basis van de vraag

- Optimaliseer de prestaties van modellen met behulp van automatische hyperparameter-afstemming, waarbij duizenden combinaties worden getest om de optimale instellingen te vinden

- Monitor productiemodellen met behulp van CloudWatch-integratie, die de nauwkeurigheid van voorspellingen, latentie en gegevenskwaliteitsstatistieken bijhoudt

Limieten van Amazon SageMaker

- De complexe prijsstructuur kan leiden tot onverwachte kosten bij grootschalig gebruik, omdat het onduidelijk is

- Er is een leercurve voor teams die niet bekend zijn met het AWS-ecosysteem en de AWS-services

- De interface van de tool kan traag zijn of moeilijk te navigeren vanwege storingen

- Het gebruik van Amazon SageMaker maakt migratie naar andere cloudproviders moeilijk

Prijzen van Amazon SageMaker

- SageMaker Unified Studio: Gratis

- Aangepaste prijzen

Amazon SageMaker-beoordelingen en recensies

- G2: 4,3/5 (45 beoordelingen)

- Capterra: Onvoldoende beoordelingen

Wat zeggen echte gebruikers over Amazon SageMaker?

Volgens een G2-recensie:

Wat ik het leukste vind aan Amazon SageMaker is de mogelijkheid om de volledige levenscyclus van machine learning te beheren in één geïntegreerd platform. Het vereenvoudigt het bouwen, trainen en implementeren van modellen en biedt tegelijkertijd schaalbaarheid en krachtige tools zoals SageMaker Studio en geautomatiseerde modelafstemming.

Wat ik het leukste vind aan Amazon SageMaker is de mogelijkheid om de volledige levenscyclus van machine learning te beheren in één geïntegreerd platform. Het vereenvoudigt het bouwen, trainen en implementeren van modellen en biedt tegelijkertijd schaalbaarheid en krachtige tools zoals SageMaker Studio en geautomatiseerde modelafstemming.

💡 Pro-tip: Train niet wat je niet kunt structureren. Voordat je begint met fine-tuning, vraag je jezelf af: Kan dit worden opgelost met gestructureerde logica plus een basismodel? In plaats van, bijvoorbeeld, een model te trainen om factuurtypes te detecteren, kun je beter een eenvoudige classificator toevoegen die eerst filtert op basis van metadata.

Haal het maximale uit uw werkstroom met ClickUp

Er zijn talloze alternatieven voor Hugging Face, maar waarom zou je je beperken tot modellen en API's?

ClickUp gaat nog een stapje verder.

Met ClickUp Brain en Brain MAX kunt u sneller schrijven, zaken in enkele seconden samenvatten en automatisering uitvoeren die u begrijpt. Het is rechtstreeks in uw taken, documenten en chats ingebouwd, zodat u nooit tussen tools of tabbladen hoeft te schakelen.

Meld u aan bij ClickUp en ontdek waarom dit het slimste alternatief voor Hugging Face is! ✅