Nie brakuje Ci alertów. Brakuje Ci czasu, aby je segregować.

Aby podjąć działania, alerty wymagają kontekstu. Oznacza to pobieranie danych z logów, wzorców ruchu i wcześniejszych incydentów z różnych narzędzi. Podczas wykonywania tych czynności reakcja ulega spowolnieniu, a kolejka nadal rośnie.

Część tego przepływu można zautomatyzować. Trudniejsze jest jednak wiedzieć, jak je zastosować. Według PwC braki w wiedzy i umiejętnościach były w ubiegłym roku największą przeszkodą we wdrażaniu AI w działaniach związanych z bezpieczeństwem.

W tym artykule omówiono, jak wykorzystać AI do zapewnienia bezpieczeństwa sieci w codziennych cyklach pracy, począwszy od przeglądu alertów, poprzez dochodzenie, aż po działania następcze. Dowiesz się również, jak dzięki ClickUp Twój zespół zyska jedno miejsce do obsługi incydentów bez konieczności posiadania głębokiej wiedzy specjalistycznej w zakresie automatyzacji. ⬇️

Czym jest AI w zakresie bezpieczeństwa sieci?

AI w zakresie bezpieczeństwa sieci odnosi się do systemów, które analizują aktywność sieciową i pomagają wykrywać, badać i reagować przy użyciu uczenia maszynowego i automatyzacji.

Stosuje się ją, gdy ręczna kontrola nie jest w stanie nadążyć za ilością logów, ruchem sieciowym i zachowaniami użytkowników generowanymi przez sieć. Zamiast polegać wyłącznie na stałych regułach lub znanych sygnaturach zagrożeń, AI ocenia wzorce i odchylenia w oparciu o normalne działanie środowiska.

Gdy aktywność obejmuje wiele systemów, AI koreluje te sygnały w jednym widoku, dzięki czemu dochodzenie rozpoczyna się od kontekstu, a nie od niepowiązanych alertów.

Dlaczego AI jest niezbędna dla bezpieczeństwa sieci?

Potrzeba zastosowania AI pojawia się, gdy przeglądanie i reagowanie nie nadążają za aktywnością sieci.

Twoje środowisko generuje nieustanne logi, ruch i działania użytkowników, a osoby atakujące wykorzystują automatyzację, aby działać szybciej niż pozwala na to ręczne badanie. Wraz ze wzrostem ilości danych przegląd domyślnie ulega opóźnieniu. Potwierdzasz alerty później i tracisz szansę na szybką reakcję.

Różnica ta pogłębia się wraz z rozwojem środowisk. Dodajesz usługi w chmurze, zdalny dostęp i podłączone urządzenia, ale proces badania pozostaje ten sam. Każdy nowy punkt wejścia oznacza więcej pracy, a Twój zespół nadal pracuje w tym samym tempie.

Korzyści płynące z AI w cyberbezpieczeństwie ujawniają się w tym momencie, ponieważ zmienia ona sposób przeprowadzania przeglądów i ustalania priorytetów w sytuacjach stresowych:

- AI przejmuje wczesną fazę przeglądu, analizując aktywność, grupując powiązane sygnały i ustalając wstępne priorytety, zanim analitycy przystąpią do działania.

- Uczy się podstawowych zachowań użytkowników, urządzeń i systemów, a także sygnalizuje pojawiające się odchylenia, identyfikując pojawiające się zagrożenia w odpowiednim czasie.

- Ocenia aktywność w kontekście i zapobiega przesuwaniu prawdziwych incydentów w dół kolejki przez fałszywe alarmy, aby zmniejszyć liczbę niepotrzebnych alertów.

🔍 Czy wiesz, że... Według raportu firmy Gartner 62% organizacji doświadczyło w ciągu ostatnich 12 miesięcy co najmniej jednego ataku typu deepfake, obejmującego socjotechnikę lub automatyzację procesów.

Jak działa AI w zakresie bezpieczeństwa sieci

Sztuczna inteligencja w cyberbezpieczeństwie nie jest pojedynczym systemem podejmującym decyzje w izolacji. Jest to zestaw technik, które pojawiają się na różnych etapach wykrywania, badania i reagowania.

Wykrywanie anomalii i analiza zachowań

AI wykorzystuje dwa popularne podejścia, aby dowiedzieć się, jak wygląda normalna aktywność w Twoim środowisku:

- Analiza zachowań użytkowników i podmiotów (UEBA) śledzi zachowania użytkowników i systemów w czasie. Podkreśla takie działania, jak logowanie się o nietypowych porach, dostęp do nieznanych zasobów lub transfer danych wykraczający poza normalny wzorzec.

- Systemy wykrywania i reagowania w sieci (NDR) monitorują ruch sieciowy. Szukają one oznak ruchu bocznego, komunikacji typu „komenda-i-kontrola” lub danych opuszczających sieć w nieoczekiwany sposób.

Podejście to nie opiera się na predefiniowanych sygnaturach. Wykrywanie opiera się na zachowaniu, co pozwala na wykrycie wcześniej niewidocznych zagrożeń bez konieczności oczekiwania na aktualizację reguł.

Zautomatyzowana reakcja na zagrożenia

Gdy aktywność przekroczy próg pewności, reakcja nie musi czekać na ręczne działanie. Systemy oparte na AI mogą być wyzwalaczami działań z góry określonych, żeby ograniczyć wpływ, podczas gdy dochodzenie trwa.

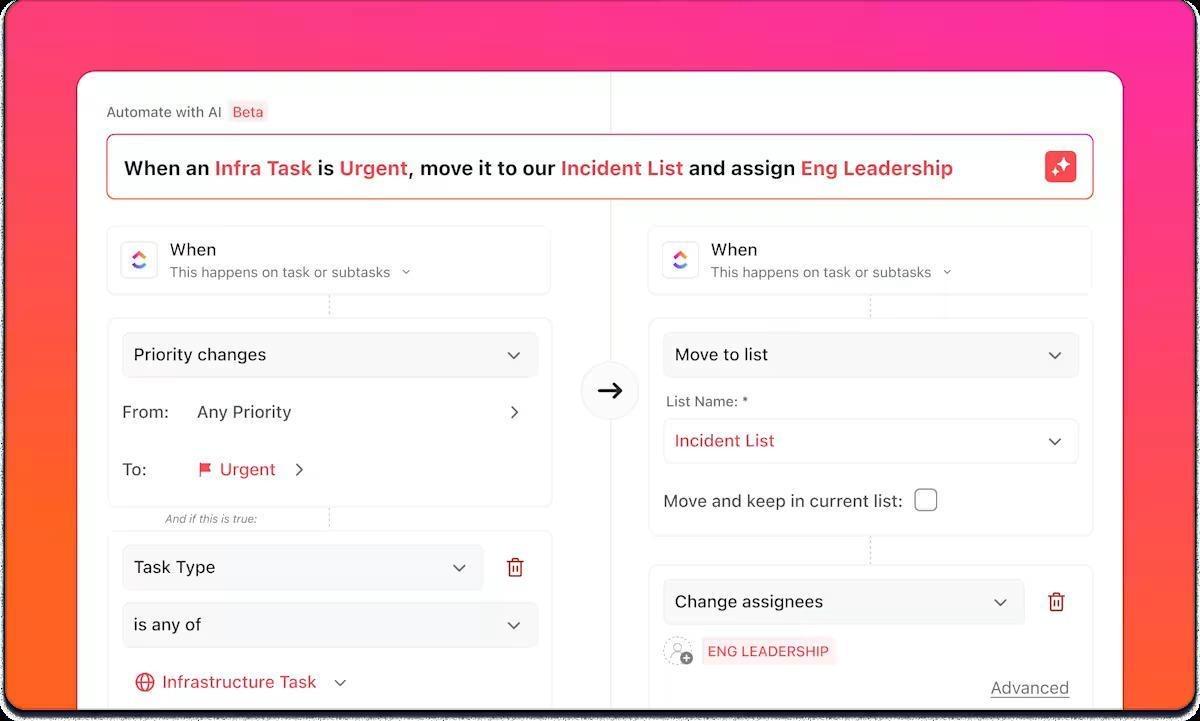

ClickUp Automations zapewnia wsparcie dla tworzenia cykli pracy związanych z reagowaniem za pomocą prostego w obsłudze kreatora AI. Opisujesz, co powinno się stać, gdy spełnione zostaną określone warunki, a automatyzacja jest konfigurowana bezpośrednio w odpowiedniej przestrzeni, folderze lub liście. Ułatwia to przekładanie zasad reagowania na działania bez konieczności tworzenia skryptów lub niestandardowych narzędzi.

Typowe działania obejmują izolację zainfekowanego punktu końcowego, blokowanie podejrzanego adresu IP lub wyłączenie konta wykazującego oznaki przejęcia. W przypadku działań o wyższym ryzyku reakcja może zostać wstrzymana do czasu zatwierdzenia przez analityka, dzięki czemu automatyzacja zapewnia wsparcie dla podejmowania decyzji bez utraty kontroli.

Skraca to czas między wykryciem a powstrzymaniem ataku, co ma największe znaczenie w przypadku szybko zmieniających się ataków.

Analiza predykcyjna i priorytetyzacja zagrożeń

AI jest również wykorzystywana przed wystąpieniem incydentów. Modele analizują dane historyczne dotyczące ataków i zewnętrzne informacje o zagrożeniach, aby zidentyfikować ryzyka najbardziej istotne dla danego środowiska.

Zamiast traktować wszystkie luki w zabezpieczeniach jednakowo, AI pomaga ustalić priorytety problemów na podstawie prawdopodobieństwa ich wykorzystania i skutków, jakie mogłyby one wywołać. Dzięki temu można skupić się na usuwaniu najistotniejszych luk, zamiast poświęcać cały wysiłek wyłącznie na ocenę stopnia zagrożenia.

Analiza językowa do wykrywania phishingu

Wiele ataków rozpoczyna się od komunikacji, a nie od złośliwego oprogramowania. Przetwarzanie języka naturalnego służy do analizowania zawartości wiadomości e-mail i komunikatów pod kątem oznak socjotechniki.

Systemy te wykraczają poza analizę słów kluczowych. Oceniają ton, strukturę i intencje, w tym sygnały wskazujące na pilność sprawy, wzorce podszywania się pod inne osoby oraz prośby, które nie są zgodne z normalnymi zachowaniami komunikacyjnymi. Dzięki temu wykrywanie jest bardziej skuteczne w przypadku prób phishingu i przejęcia e-maila firmy, które unikają oczywistych wskaźników.

🧠 Ciekawostka: Mandiant przeprowadza raportowanie i podaje, że średni czas przebywania w sieci wynosi 11 dni. W wersji dla kadry kierowniczej średni czas przebywania wynosi 26 dni, gdy podmioty zewnętrzne powiadamiają ofiarę.

Tradycyjne zabezpieczenia sieciowe a zabezpieczenia oparte na AI

Tradycyjne środki kontroli, takie jak zapory sieciowe, sygnatury i predefiniowane reguły, nadal odgrywają ważną rolę, zwłaszcza w przypadku znanych zagrożeń i egzekwowania zasad. Problem pojawia się, gdy aktywność nie odpowiada oczekiwaniom tych reguł lub gdy ilość danych przekracza możliwości przetworzenia przez ludzi w określonym czasie.

AI nie zastępuje tradycyjnych zabezpieczeń. Zmienia sposób wykrywania i reagowania, gdy wzorce są niejasne, sygnały są fragmentaryczne lub szybkość ma większe znaczenie niż całkowita pewność.

| Aspect | Tradycyjne zabezpieczenia | Bezpieczeństwo oparte na AI |

|---|---|---|

| Wykrywanie | Oparte na regułach, sterowane sygnaturami | Oparte na zachowaniu i wzorcach |

| Zakres zagrożeń | Najbardziej znane zagrożenia | Znane i nowe wzorce aktywności |

| Adaptacja | Ręczne aktualizacje | Ciągłe uczenie się i dostosowywanie |

| Skalowanie | Ograniczone obciążenie przeglądu | Obsługuje duże ilości danych |

| Reagowanie | Ręczne lub opóźnione | Zautomatyzowane lub niemal w czasie rzeczywistym |

| Fałszywe alarmy | Wyższe przy stałych progach | Zmniejszone dzięki punktacji uwzględniającej kontekst |

W praktyce korzystasz z obu tych rozwiązań jednocześnie. Tradycyjne mechanizmy kontroli chronią przed znanymi zagrożeniami. AI ogranicza konieczność ręcznej weryfikacji, grupuje powiązane działania i przyspiesza reakcję, gdy zachowanie wykracza poza znane schematy.

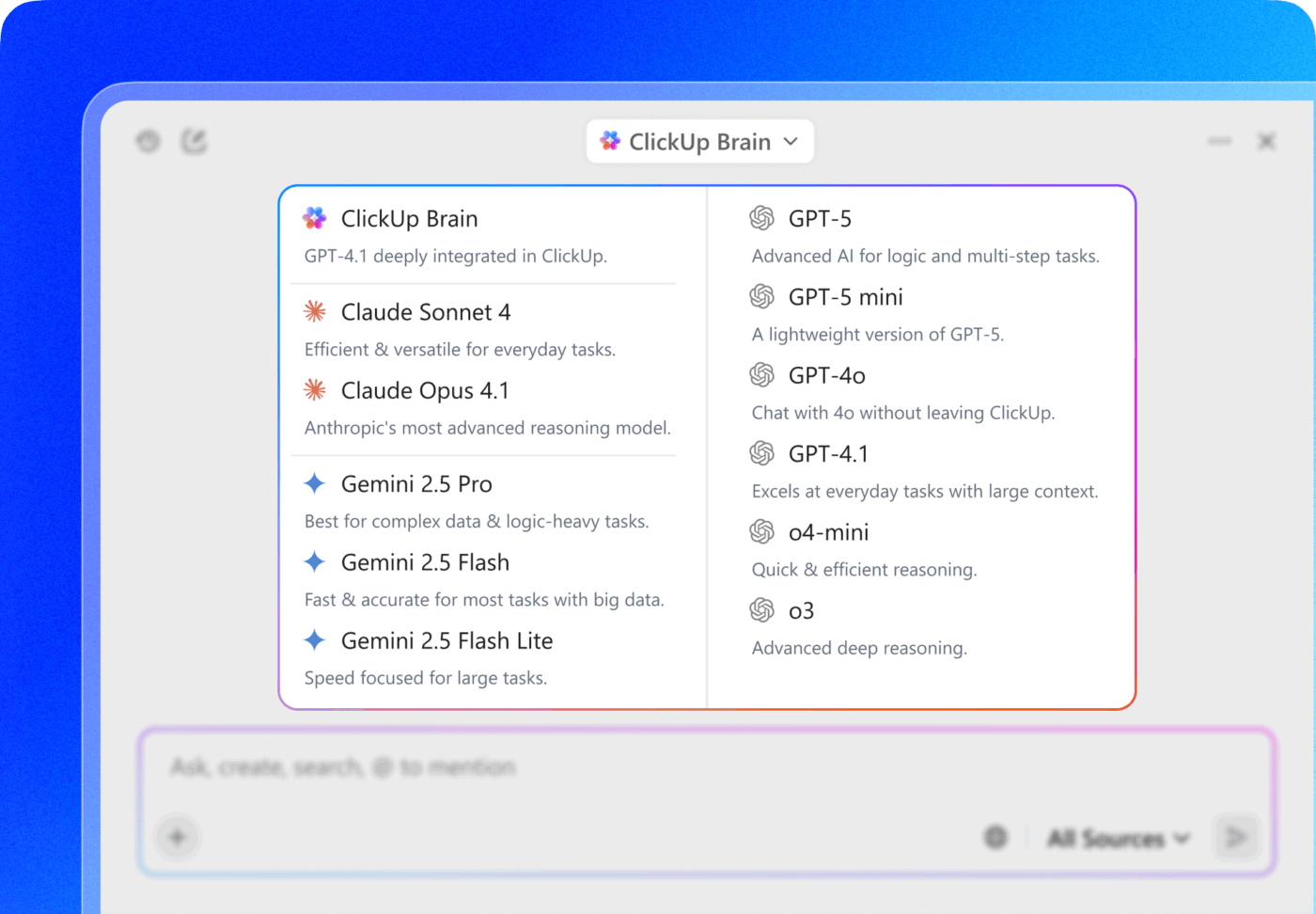

📮 ClickUp Insight: Przeciętny profesjonalista spędza ponad 30 minut dziennie na wyszukiwaniu informacji związanych z pracą — to ponad 120 godzin rocznie straconych na przeglądanie wiadomości e-mail, wątków na Slacku i rozproszonych plików. Inteligentny asystent AI wbudowany w Twój obszar roboczy może to zmienić. Przedstawiamy ClickUp Brain. Dostarcza on natychmiastowych informacji i odpowiedzi, wyświetlając odpowiednie dokumenty, rozmowy i szczegóły zadań w ciągu kilku sekund — dzięki czemu możesz przestać szukać i zacząć pracować. 💫 Rzeczywiste wyniki: Zespoły takie jak QubicaAMF odzyskały ponad 5 godzin tygodniowo dzięki ClickUp — to ponad 250 godzin rocznie na osobę — eliminując przestarzałe procesy zarządzania wiedzą. Wyobraź sobie, co Twój zespół mógłby osiągnąć, mając dodatkowy tydzień wydajności w każdym kwartale!

Przykłady zastosowań AI w bezpieczeństwie sieci

Poniższe przykłady zastosowania AI w cyberbezpieczeństwie odnoszą się do punktów w cyklu pracy, w których weryfikacja przez człowieka spowalnia proces, ponieważ ilość danych jest duża lub kontekst jest rozproszony między różnymi systemami.

Każdy z nich pokazuje, gdzie AI zmniejsza tarcia decyzyjne bez zastępowania istniejących mechanizmów kontroli lub konieczności kompleksowej automatyzacji.

- Zarządzanie tożsamością i dostępem (IAM): sygnalizuje nadużycia poświadczeń poprzez identyfikację niemożliwych podróży, nietypowych czasów logowania lub prób wypełnienia poświadczeń na dużą skalę, zanim dostęp rozprzestrzeni się dalej.

- Wykrywanie i reagowanie na poziomie punktów końcowych (EDR): monitoruje zachowanie procesów i aktywność plików w celu wykrycia działania złośliwego oprogramowania, wzorców szyfrowania ransomware lub nieautoryzowanych procesów działających w tle na urządzeniach użytkowników.

- Bezpieczeństwo w chmurze: śledzi zmiany konfiguracji, wykorzystanie API i przepływ danych między usługami, aby wykrywać działania wykraczające poza oczekiwane zachowania w środowiskach chmurowych.

- Analiza ruchu sieciowego: analizuje wzorce ruchu w celu identyfikacji komunikacji dowodzenia i kontroli, ruchów bocznych oraz eksfiltracji danych, w tym aktywności ukrytej w ruchu szyfrowanym.

- Dochodzenie w sprawie incydentów: koreluje powiązane wydarzenia, rekonstruuje osie czasu i ujawnia prawdopodobne przyczyny źródłowe, dzięki czemu dochodzenie nie rozpoczyna się od surowych logów po wystąpieniu incydentu.

- Zarządzanie podatnością na zagrożenia: Priorytetyzacja podatności na zagrożenia w oparciu o prawdopodobieństwo wykorzystania i narażenie w konkretnym środowisku.

- Wykrywanie zagrożeń wewnętrznych: wykrywa zmiany w zachowaniu, które mogą wskazywać na przejęcie konta lub złośliwą aktywność osób wewnętrznych, takie jak nietypowe wzorce dostępu lub zmiany w wykorzystaniu danych.

💡 Wskazówka dla profesjonalistów: Tylko 29% przedsiębiorstw szkoli pracowników spoza działu bezpieczeństwa do pełnienia ról związanych z bezpieczeństwem. Nawet jeśli narzędzia są dostępne, ich stosowanie ma limit.

Część tej luki można wypełnić operacyjnie dzięki ClickUp University. Analitycy, zespoły IT i osoby pełniące pokrewne role mogą dowiedzieć się, jak przebiegają cykle pracy związane z incydentami, dokumentacją i koordynacją reakcji w ClickUp. Ta wspólna podstawa ułatwia większej liczbie osób wspieranie działań związanych z bezpieczeństwem bez konieczności posiadania dogłębnej wiedzy na temat wykrywania lub automatyzacji.

Wyzwania związane z wykorzystaniem AI w zakresie bezpieczeństwa sieci

AI zmienia sposób wykonywania zadań związanych z bezpieczeństwem, ale nie zastępuje potrzeby posiadania struktury, zarządzania danymi ani jasnych procedur operacyjnych. W miarę jak w coraz większym stopniu polegasz na AI w zakresie bezpieczeństwa sieci i monitorowania, pierwsze ograniczenia, z jakimi się spotkasz, to luki w zakresie zgodności, własności i cyklu pracy.

Jakość i zakres danych

/AI zależność od spójnych, wiarygodnych danych. Jeśli logi są niekompletne, opóźnione lub źle znormalizowane, jakość wykrywania spada, a alerty tracą kontekst.

✅ Jak to naprawić: Wcześnie ujednolicaj źródła logów, zdefiniuj wymagane pola danych i sprawdź zasięg przed rozszerzeniem automatyzacji.

Odchylenie modelu

Zachowanie sieci zmienia się z upływem czasu. W miarę dodawania nowych aplikacji, zmiany wzorców dostępu lub cykli pracy modele, które kiedyś działały dobrze, tracą dokładność, chyba że są regularnie monitorowane i ponownie szkolone.

✅ Jak to naprawić: Monitoruj wydajność wykrywania w sposób ciągły i ponownie trenuj modele w ramach regularnych operacji bezpieczeństwa, a nie jako jednorazowe zadanie.

Luki integracyjne

Narzędzia AI potrzebują dostępu do istniejących systemów bezpieczeństwa, aby skutecznie korelować działania. Gdy integracje są częściowe lub niestabilne, sygnały pozostają odizolowane, a dochodzenie przebiega wolniej.

✅ Jak to naprawić: Zacznij od integracji, które zapewniają wsparcie dla cykli pracy związanych z badaniem i reagowaniem od początku do końca, a nie odizolowane wyniki wykrywania.

Ograniczona wyjaśnialność

Niektóre modele sygnalizują aktywność bez wyjaśnienia przyczyny. Gdy nie widać powodu, dla którego system wygenerował alert, poświęca się więcej czasu na jego weryfikację i waha się przed zaufaniem automatycznym działaniom.

✅ Jak to naprawić: Wykorzystaj cykle pracy i modele, które ujawniają sygnały i ścieżki decyzyjne, aby analitycy mogli szybko zweryfikować sytuację i podjąć działania.

Techniki przeciwdziałania

Atakujący aktywnie testują systemy wykrywania i dostosowują się do nich. Stopniowe zatruwanie danych i zachowania mające na celu uniknięcie wykrycia mogą zmniejszyć skuteczność modelu, jeśli nie zostaną wprowadzone odpowiednie zabezpieczenia.

✅ Jak to naprawić: Połącz wykrywanie behawioralne z zabezpieczeniami, takimi jak kontrole walidacyjne, weryfikacja przez człowieka w przypadku działań o dużym znaczeniu oraz ciągłe testowanie modeli.

Umiejętności i gotowość operacyjna

Wykorzystanie AI w działaniach związanych z bezpieczeństwem wymaga koordynacji między zespołami ds. bezpieczeństwa, operacyjnymi i ds. danych. Luki w zakresie własności lub wiedzy specjalistycznej limitują wartość, jaką zapewnia automatyzacja.

✅ Jak to naprawić: Określ jasny zakres odpowiedzialności za nadzór nad modelami, obsługę incydentów i działania następcze oraz włącz decyzje podejmowane przez AI do istniejących cykli pracy bezpieczeństwa zamiast tworzyć oddzielną warstwę.

Najlepsze praktyki dotyczące wdrażania AI w zakresie bezpieczeństwa sieci

Najlepsze wyniki z narzędzi AI do cyberbezpieczeństwa osiąga się, wprowadzając je z jasno określonym celem i stosując je w ramach codziennych działań związanych z bezpieczeństwem.

Zacznij od określonego przypadku użycia.

Wybierz konkretny problem do rozwiązania, taki jak ograniczenie liczby incydentów phishingowych lub wykrywanie ruchów bocznych. Wdrażaj AI tam, gdzie wynik jest mierzalny, zamiast włączać ją szeroko i sortować wyniki później.

Stwórz podstawy danych

AI opiera się na spójnych danych wejściowych. Przed wdrożeniem należy sprawdzić źródła logów, aby potwierdzić pełny zakres, dokładność znaczników czasu i prawidłowe przetwarzanie danych, zwłaszcza w przypadku informacji wrażliwych.

Zaplanuj integracje przed wdrożeniem

Zmapuj, w jaki sposób wyniki działania sztucznej inteligencji będą przepływać do istniejących narzędzi SIEM, SOAR i narzędzi końcowych. Wykrywanie bez jasnej ścieżki dochodzenia i reagowania powoduje dodatkowe utrudnienia zamiast je zmniejszać.

Trzymaj ludzi w pętli informacyjnej

Z góry określ ścieżki eskalacji. Zdecyduj, które działania mogą być wykonywane automatycznie, a które wymagają zatwierdzenia przez analityka, aby automatyzacja zapewniła wsparcie dla reagowania bez utraty kontroli.

Stałe monitorowanie wydajności

Monitoruj dokładność wykrywania, fałszywe alarmy i wyniki reakcji w czasie. Traktuj dostosowywanie modelu jako ciągłe zadanie operacyjne, a nie krok ustawień.

Dokumentuj i udoskonalaj cykle pracy

Twórz podręczniki postępowania dotyczące obsługi alertów generowanych przez AI. Wykorzystaj wyniki dochodzeń do dostosowania progów, poprawy logiki korelacji i zaostrzenia kroków reagowania w miarę zmiany warunków.

W jaki sposób ClickUp zapewnia wsparcie dla cykli pracy związanych z bezpieczeństwem wzbogaconych o AI

Dzięki AI można zidentyfikować alerty, które wymagają uwagi, ale należy pamiętać o poważnym zastrzeżeniu dotyczącym dalszych działań.

Gdy alert wymaga podjęcia działań, często dzielisz dochodzenie i reagowanie między różne narzędzia. Sprawdzasz dowody w jednym systemie, omawiasz wyniki na czacie, śledzisz działania naprawcze w innym systemie, a później sporządzasz raporty. W miarę jak dołącza coraz więcej osób, kontekst się rozprasza, a szybkość reakcji spada, mimo że wykrywanie spełniło swoje zadanie.

ClickUp pozwala utrzymać tę pracę w jednym przepływie operacyjnym, zamiast rozdzielać ją na wiele części.

Przekształcanie alertów w możliwe do śledzenia incydenty

Kiedy sygnał AI wymaga podjęcia działania, potrzebuje własności i miejsca, w którym może ewoluować. W ClickUp każde zdarzenie staje się zadaniem, które obejmuje cały cykl dochodzenia i reagowania.

Zadanie ClickUp pełni funkcję rejestru zdarzenia. Dokumentujesz ustalenia bezpośrednio podczas przeglądania aktywności, dołączasz logi i zrzuty ekranu jako dowody oraz aktualizujesz status w miarę zmian wagi zdarzenia. Zadanie pokazuje jasną własność na każdym etapie, więc nigdy nie musisz zgadywać, kto jest odpowiedzialny, na podstawie wątków czatu lub dodatkowych zgłoszeń.

Oto, w jaki sposób ułatwiają one zarządzanie incydentami:

- Zadania związane z incydentami gromadzą logi, zrzuty ekranu i linki zewnętrzne w jednym miejscu, dzięki czemu śledczy nie muszą przełączać się między narzędziami, aby odtworzyć kontekst.

- Status zadania i priorytet odzwierciedlają aktualny stan incydentu, co eliminuje niejasności podczas przekazywania zadań lub zmian zmianowych.

- Powiązania między zadaniami łączą działania naprawcze lub monitorujące z pierwotnym incydentem, dzięki czemu reakcja nie kończy się na ograniczeniu skutków.

Mówiąc prościej, zadania ClickUp znajdują się w centrum obszaru roboczego i służą jako punkt odniesienia dla Wszystkiego, co następuje, a nie tylko jako kolejny bilet do zarządzania.

Zachowanie procedur i historii blisko rzeczywistej reakcji

Każda zmiana narzędzia podczas incydentu wiąże się z kosztami. Jeśli Twoje instrukcje i wcześniejsze dochodzenia są poza cyklem pracy reagowania, ponosisz te koszty wielokrotnie, a czas nieubłaganie mija.

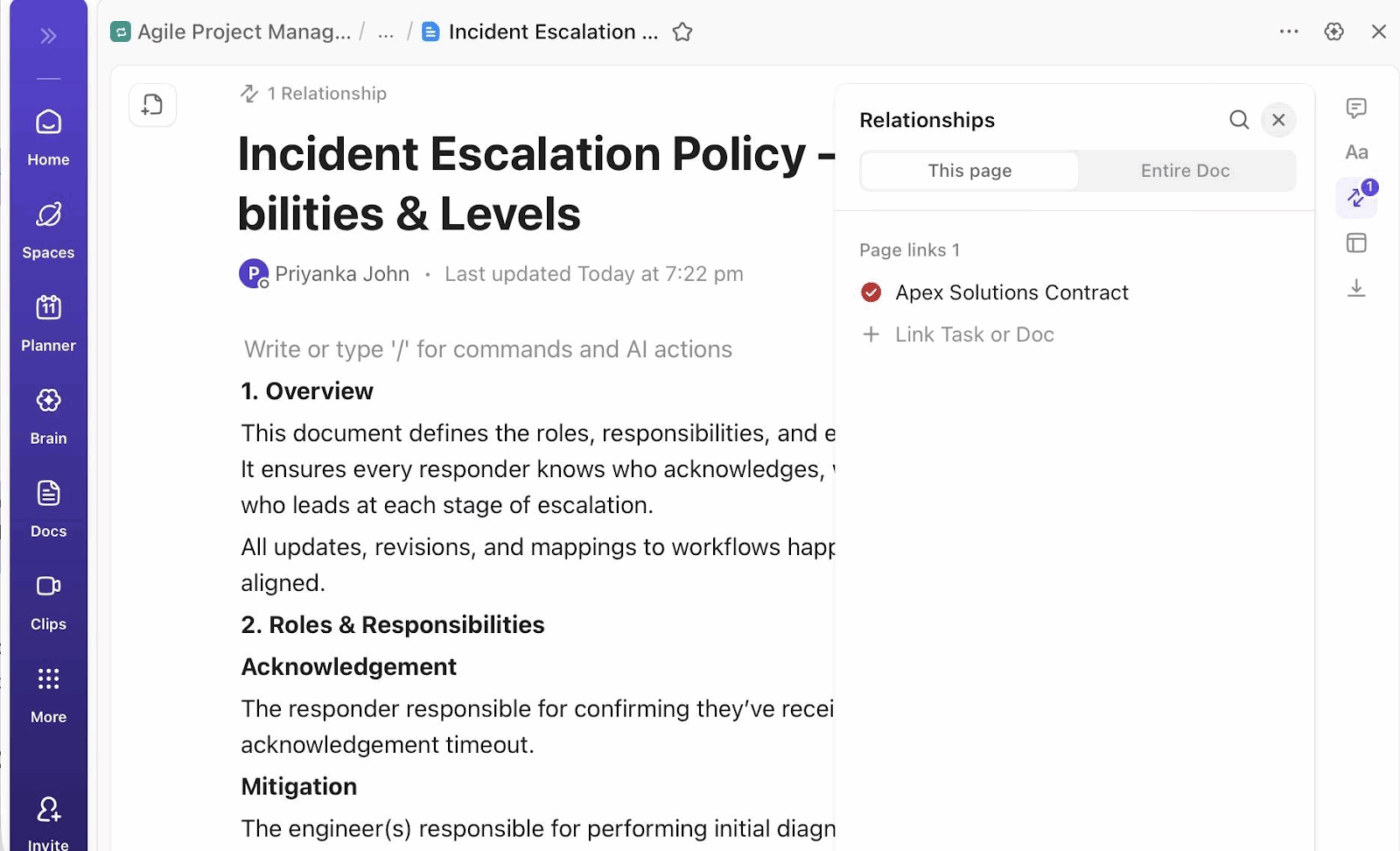

ClickUp Docs przechowuje scenariusze reagowania, listy kontrolne dochodzeń i przeglądy po incydentach bezpośrednio połączone z zadaniem dotyczącym incydentu. Analitycy mogą otworzyć odpowiednią procedurę podczas reagowania na żywo, postępować zgodnie z nią krok po kroku i tworzyć notatki w miejscach, w których rzeczywistość odbiega od udokumentowanego przepływu.

Aktualizacje te są załącznikami do incydentu, co oznacza, że przegląd po incydencie rozpoczyna się od dokładnego kontekstu, a nie od pamięci.

ClickUp Brain działa bezpośrednio w ramach zadań i dokumentów w miarę postępu dochodzenia. Podsumowuje postępy, wyciąga kluczowe decyzje z komentarzy i tworzy projekty aktualizacji dotyczących incydentów na podstawie aktywności zadań na żywo. Twój zespół na bieżąco aktualizuje dokumentację podczas reagowania, zamiast rekonstruować wydarzenia po ustabilizowaniu się sytuacji.

Ograniczanie przekazywania spraw w miarę eskalacji incydentów

W miarę rozwoju incydentów koordynacja zazwyczaj załamuje się w punktach przejściowych. Często jednocześnie zmienia się stopień ważności, następuje zmiana własności i pojawiają się potrzeby związane z widocznością dla interesariuszy.

Automatyzacje ClickUp obsługują te przejścia w oparciu o stan zadania, a nie ręczne działania następcze:

- Oznaczenie incydentu jako krytycznego automatycznie aktualizuje priorytet i własność, dzięki czemu eskalacja rozpoczyna się natychmiast.

- Zakończenie izolacji automatycznie tworzy i połączone zadania naprawcze i następcze z pierwotnym incydentem.

- Zmiana statusu zadania lub własności automatycznie powiadamia odpowiednie osoby, bez konieczności wysyłania dodatkowych wiadomości.

Pola niestandardowe służą do porządkowania danych dotyczących incydentów podczas reagowania. Analitycy aktualizują poziom ważności, systemy, na które ma wpływ incydent, wpływ na zgodność i status rozwiązania bezpośrednio w zadaniu podczas pracy. Raporty i audyty odzwierciedlają następnie działania zespołu podczas incydentu, a nie to, co ktoś odtworzył później.

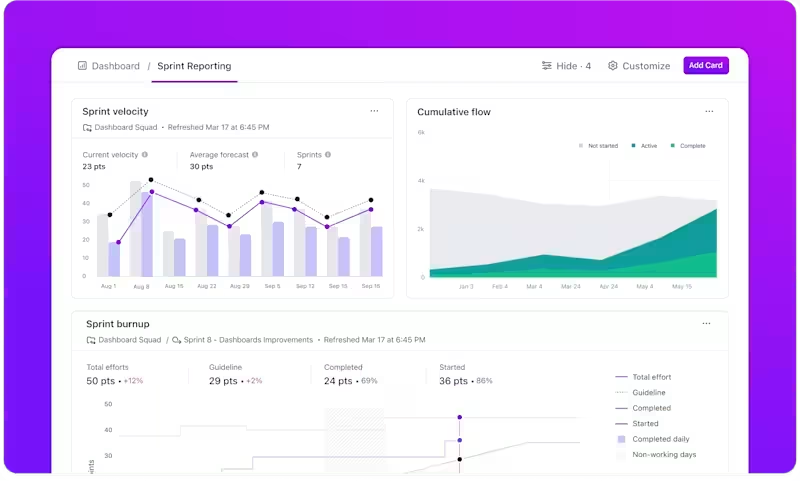

Zachowanie widoczności podczas pracy

W przypadku wielu równoległych incydentów widoczność staje się problemem wykonawczym. Kierownictwo jest coraz bardziej zainteresowane tym, co dzieje się w danej chwili, aby móc dostosować swoje działania, zanim pojawią się opóźnienia.

Panele ClickUp czerpią informacje z tych samych zadań, które Twój zespół wykorzystuje do badania i reagowania na incydenty. Gdy analitycy aktualizują status zadania, własność lub poziom ważności, panele są aktualizowane wraz z nimi. Twój zespół unika ręcznego śledzenia, a kierownictwo widzi rzeczywiste działania zamiast opóźnionych podsumowań.

Panele kontrolne zapewniają wsparcie dla aktywnego reagowania, zapewniając widoczność krytycznych sygnałów:

- Pokaż wszystkie aktywne incydenty pogrupowane według ważności i statusu, aby osoby odpowiedzialne za reagowanie mogły zobaczyć, które problemy wymagają najpilniejszej uwagi, bez otwierania poszczególnych zadań.

- Wykrywaj zablokowane incydenty, pobierając informacje bezpośrednio ze stanów zadań i zależności, co pomaga zespołom interweniować, zanim działania reagujące ulegną cichemu spowolnieniu.

- Odzwierciedlaj własność i obciążenie pracą za pomocą przypisywania zadań na żywo, co ułatwia przywrócenie równowagi wysiłków, gdy jednocześnie eskaluje wiele incydentów.

- Połącz dane dotyczące incydentów z zadaniami naprawczymi i następczymi, aby zespoły mogły sprawdzić, czy prace związane z ograniczaniem skutków faktycznie postępują, czy też czekają na dalsze działania.

Panele ClickUp pobierają dane bezpośrednio z danych zadań i pól niestandardowych, dzięki czemu widok aktualizuje się wraz ze zmianami w zdarzeniach. Twój zespół pomija oddzielny cykl pracy związany z raportowaniem, a kierownictwo widzi dokładnie, co się dzieje, podczas gdy działania reagujące są nadal w toku.

ClickUp Brain zwiększa tę widoczność, gdy pojawiają się pytania w trakcie reagowania. Kierownicy mogą zadawać bezpośrednie pytania dotyczące statusu incydentu lub obciążenia pracą i uzyskać odpowiedzi na podstawie tych samych danych z pulpitu nawigacyjnego, które są już w użyciu.

Innymi słowy, dostosowujesz reakcję w trakcie pracy, zamiast odkrywać luki po tym, jak incydenty już się wydarzyły.

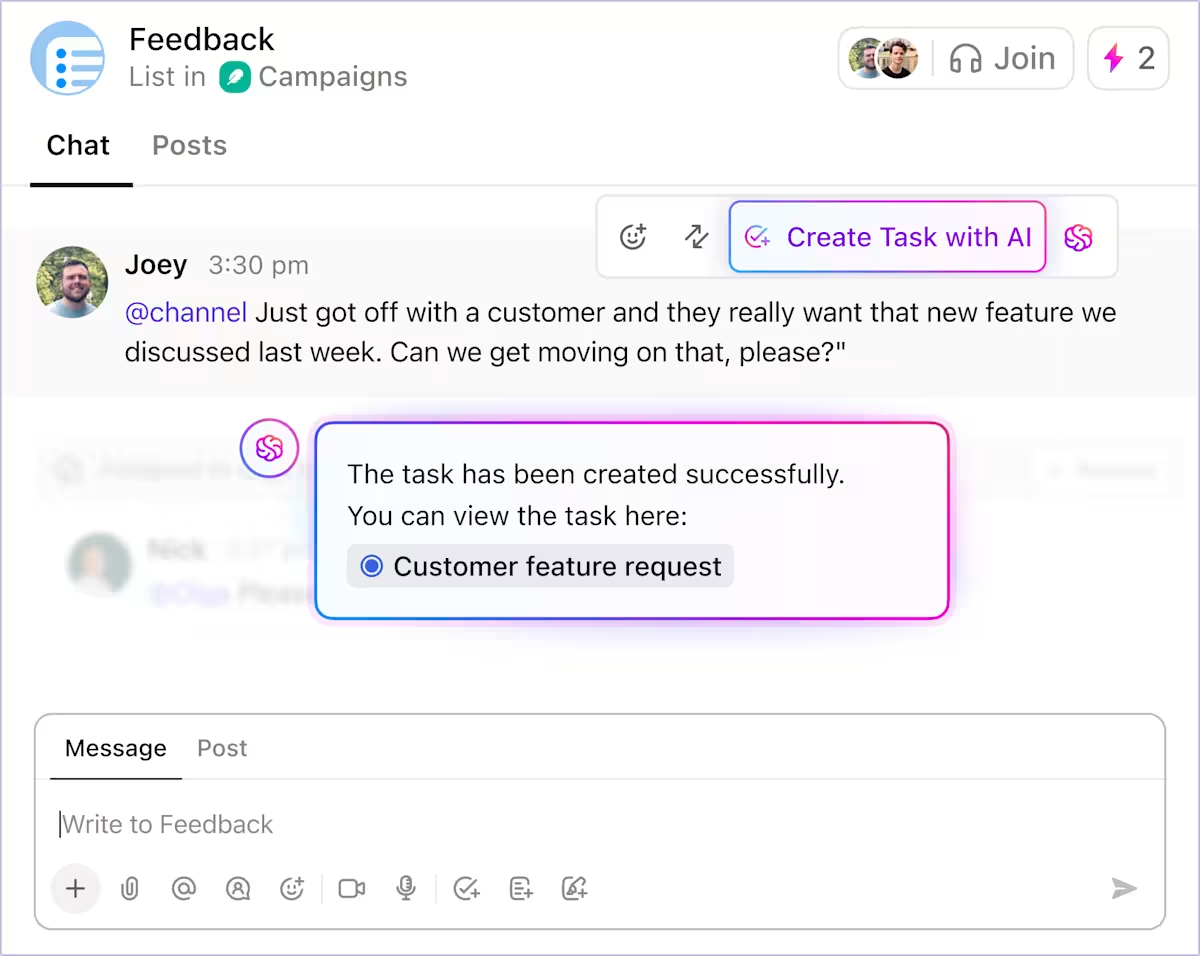

💡 Porada dla profesjonalistów: Podczas reagowania na incydenty Twój zespół szybko podejmuje decyzje, ale śledzenie zadań pozostaje w tyle. Gdy pozostawisz te decyzje na czacie, Twój zespół przegapi dalsze działania. ClickUp Chat pozwala natychmiast przekształcić wiadomości w zadania, przypisać ich właścicieli i zapewnić widoczność każdego kolejnego kroku.

Zmień reagowanie na zagrożenia bezpieczeństwa w powtarzalny cykl pracy

Po wystąpieniu incydentu nadal musisz dokończyć pracę. Musisz przydzielić działania następcze, udokumentować zmiany i przenieść te decyzje do kolejnej reakcji. W takim przypadku fragmentaryczne cykle pracy spowalniają kolejne dochodzenie, zanim jeszcze się rozpocznie.

ClickUp zapewnia połączony ekosystem, który pozwala zamknąć ten cykl. Zarządzasz incydentami, decyzjami, dokumentacją i dalszymi działaniami w ramach jednego cyklu pracy, dzięki czemu nic nie zależy od pamięci ani nie wymaga późniejszego porządkowania.

Zacznij korzystać z ClickUp za darmo i stwórz cykl pracy związany z reagowaniem na incydenty, na którym Twój zespół będzie mógł polegać długo po wyczyszczeniu alertu.

Często zadawane pytania

Sztuczna inteligencja w cyberbezpieczeństwie wykorzystuje narzędzia AI do ochrony sieci, podczas gdy bezpieczeństwo AI koncentruje się na ochronie modeli AI przed atakami, takimi jak zatrucie danych lub manipulacja.

Zespoły nietechniczne korzystają z bezpieczniejszego środowiska pracy, zmniejszonego ryzyka phishingu i jaśniejszej komunikacji podczas incydentów związanych z bezpieczeństwem, ponieważ narzędzia cyklu pracy zapewniają im dostęp do informacji bez technicznego żargonu.

AI ma na celu wspieranie specjalistów ds. bezpieczeństwa, a nie zastępowanie ich, poprzez przejęcie powtarzalnych zadań, dzięki czemu mogą oni skupić się na pracy strategicznej, wymagającej ludzkiej oceny i wiedzy specjalistycznej.

Przyszłość sztucznej inteligencji w cyberbezpieczeństwie obejmuje ściślejszą integrację narzędzi bezpieczeństwa z cyklami pracy biznesowej, bardziej przyjazne dla użytkownika interfejsy oraz ulepszoną automatyzację rutynowych decyzji dotyczących bezpieczeństwa.