Sei sicuro che il documento esista. L'hai visto la settimana scorsa.

Ma dopo aver provato tutte le combinazioni di parole chiave possibili e immaginabili ("risultati di marketing del terzo trimestre", "performance del terzo trimestre", "rapporto di marketing ottobre"), la barra di ricerca della tua azienda non restituisce alcun risultato. Questa frustrante ricerca di informazioni è un classico segno di una ricerca per parole chiave ormai superata.

Questi sistemi trovano solo corrispondenze esatte delle parole e non colgono il vero significato. Cohere risolve efficacemente questo problema fornendo un livello di ricerca intelligente che crea connessioni tra i tuoi sistemi.

Quindi, se stai cercando di capire "Come utilizzare Cohere per la ricerca nell'azienda", abbiamo quello che fa per te. Questa guida spiega tutto.

Cos'è Cohere IA e perché è importante per la ricerca dell'azienda?

Cohere è una piattaforma di IA che crea modelli linguistici di grandi dimensioni (LLM) specifici per l'uso nell'azienda. Per la ricerca interna, ciò significa andare oltre la ricerca basata su parole chiave per passare a una ricerca semantica e intelligente che comprenda l'intento, il contesto e il significato.

La maggior parte degli strumenti di ricerca per l'azienda si basa ancora sulla corrispondenza letterale delle parole chiave. Se le parole esatte non compaiono nel titolo o nel corpo di un documento, spesso il risultato non viene trovato. Cohere cambia questa situazione consentendo ai sistemi di ricerca di comprendere ciò che l'utente sta effettivamente cercando, non solo ciò che ha digitato.

Teams che tentano di creare autonomamente una ricerca basata sull'IA di solito impiegano mesi per assemblare database vettoriali, pipeline di embedding e modelli di riclassificazione. Anche dopo tutto questo lavoro, la ricerca spesso non funziona come dovrebbe perché risiede in un sistema separato da quello in cui si svolge effettivamente il lavoro, scollegato da attività, documenti e flussi di lavoro.

Un potente strumento di ricerca per l'azienda come Cohere utilizza la generazione aumentata dal recupero (RAG) per combinare la ricerca intelligente con l'IA. Questo approccio trasforma le tue conoscenze interne in una risorsa immediatamente accessibile.

Nel caso di Cohere, lo strumento converte i documenti in embedding, rappresentazioni numeriche del significato. Quando qualcuno cerca "rapporto trimestrale sulle entrate", il sistema recupera documenti concettualmente rilevanti come "Risultati finanziari del quarto trimestre" o "Riassunto degli utili", anche se quelle parole chiave esatte non sono presenti.

Ecco perché Cohere è importante per la ricerca dell'azienda. Riduce la complessità di implementazione, migliora l'accuratezza dei risultati e consente una ricerca che funziona nel modo in cui i dipendenti pensano e pongono domande all'interno dei moderni sistemi di lavoro.

📮ClickUp Insight: più della metà dei dipendenti (57%) perde tempo a cercare documenti interni o nella knowledge base aziendale per trovare informazioni relative al lavoro.

E quando non ci riescono? 1 su 6 ricorre a soluzioni personali, cercando tra vecchie email, note o screenshot solo per mettere insieme i pezzi.

ClickUp Brain elimina la ricerca fornendo risposte immediate basate sull'IA estratte dall'intero spazio di lavoro e dalle app di terze parti integrate, in modo da ottenere ciò che ti serve senza alcuna difficoltà.

Funzionalità chiave di Cohere per la ricerca aziendale

Quando si valutano soluzioni di ricerca basate sull'IA, il clamore del marketing può rendere difficile capire quali funzionalità risolvano effettivamente i tuoi problemi. Le promesse generiche di una "ricerca più intelligente" non aiutano i tuoi team di ingegneri e di prodotto a prendere decisioni informate.

La realtà è che un sistema di ricerca affidabile si basa su una pipeline di modelli di IA distinti che lavorano insieme.

Cohere offre diversi modelli che puoi utilizzare in modo indipendente o combinare per creare un'architettura di ricerca sofisticata. Comprendere queste funzionalità/funzioni fondamentali è il primo passaggio per progettare un sistema che soddisfi le esigenze specifiche del tuo team.

Embedding per la ricerca vettoriale semantica

La più grande frustrazione dei vecchi sistemi di ricerca è la loro incapacità di trovare informazioni concettualmente correlate. Si cerca "guida all'inserimento dei dipendenti" e si perde il documento con il titolo "Lista di controllo per il primo giorno dei nuovi assunti". Questo accade perché il sistema abbina le parole, non il significato.

Il modello Embed, con ricerca neurale, risolve questo problema convertendo il testo in vettori, lunghi elenchi di numeri che catturano il significato semantico. Questo processo, chiamato embedding, consente al sistema di identificare documenti concettualmente simili, anche se non condividono alcuna parola chiave comune. In sostanza, il tuo strumento di ricerca comprende automaticamente i sinonimi e le idee correlate.

Ecco gli aspetti chiave del modello Embed di Cohere:

- Supporto multimodale: l'ultima versione, Embed 4, è in grado di elaborare sia testo che immagini, consentendoti di effettuare ricerche su diversi tipi di contenuti contemporaneamente.

- Funzionalità multilingue: puoi cercare informazioni in documenti in lingue diverse senza doverli prima tradurre.

- Opzioni di dimensionalità: puoi scegliere la dimensione dei tuoi vettori. Dimensioni più elevate catturano più sfumature, ma richiedono maggiore spazio di archiviazione e potenza di elaborazione.

📖 Per saperne di più: Casi d'uso della ricerca aziendale basata sull'IA

Riorganizza per migliorare la pertinenza dei risultati

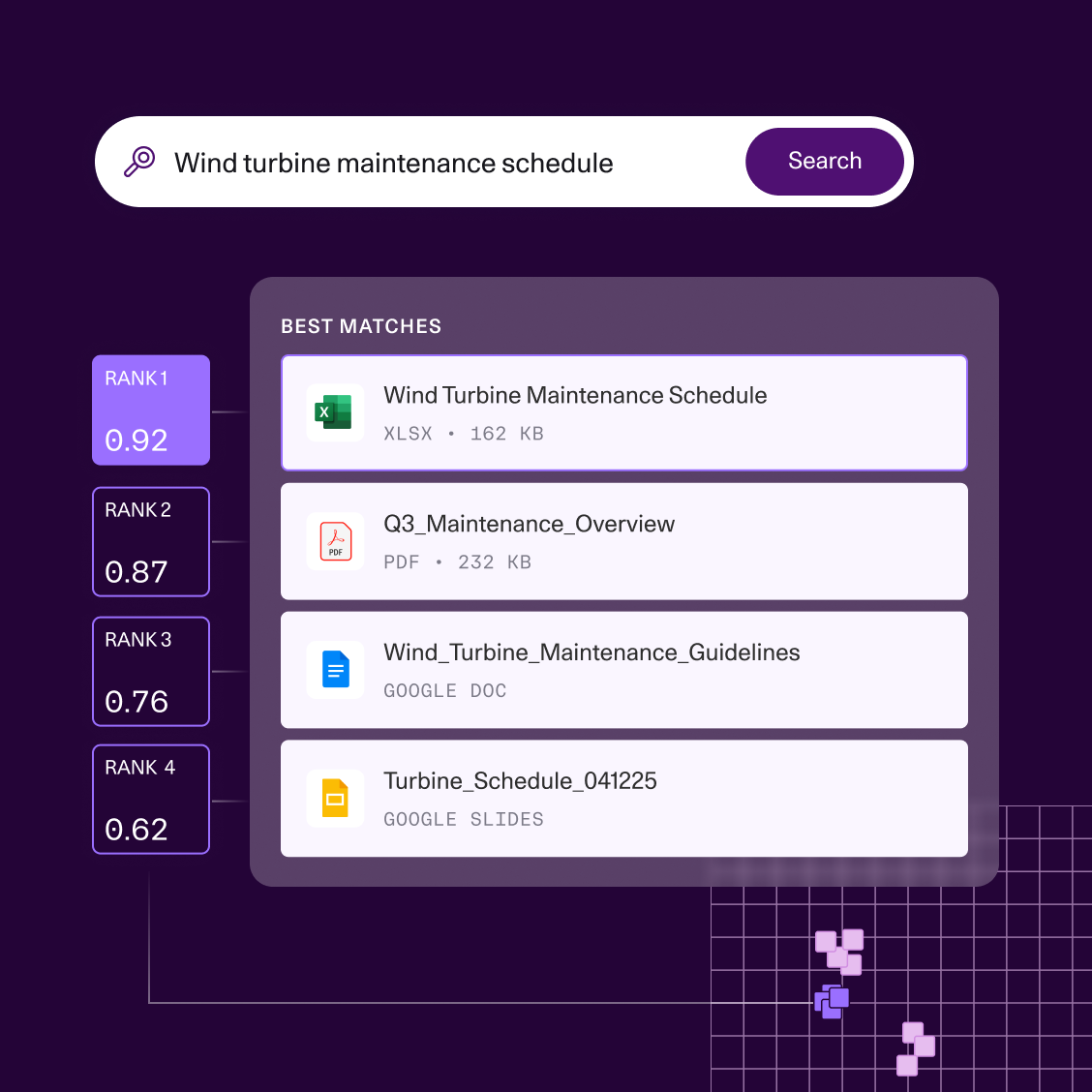

A volte, una ricerca restituisce un elenco di documenti pertinenti, ma quello più importante è nascosto nella seconda pagina. Ciò costringe gli utenti a setacciare i risultati, facendo loro perdere tempo e fiducia nel sistema di ricerca.

Si tratta di un problema di classificazione. Il sistema ha trovato le informazioni giuste, ma non è riuscito a classificarle correttamente.

Il modello Rerank di Cohere risolve questo problema con un processo in due fasi. Innanzitutto, utilizzi un metodo di recupero veloce (come la ricerca semantica) per raccogliere un ampio insieme di documenti potenzialmente rilevanti. Quindi, passi quell'elenco al modello Rerank, che utilizza un'architettura cross-encoder più intensiva dal punto di vista computazionale per analizzare ogni documento in base alla tua query specifica e riordinarli per ottenere la massima rilevanza.

Ciò è particolarmente utile in situazioni ad alto rischio in cui la precisione è fondamentale, ad esempio quando un agente dell'assistenza trova la risposta giusta per un cliente o un membro del team cerca una sezione specifica in un documento. Sebbene ciò comporti un leggero aumento dei tempi di elaborazione, il miglioramento della qualità dei risultati spesso vale il compromesso.

📖 Per saperne di più: Esempi e casi d'uso dell'automazione del flusso di lavoro

Casi d'uso di Enterprise Search per i team

Le funzionalità dell'IA astratta sono interessanti, ma diventano utili solo quando vengono applicate per risolvere problemi aziendali reali. Un'implementazione di ricerca per l'azienda di successo inizia con l'identificazione di questi specifici punti critici. 👀

Ecco alcuni scenari pratici in cui le squadre possono applicare la ricerca basata su Cohere:

- Ricerca nella knowledge base: aiuta i dipendenti a trovare risposte nella documentazione interna, nei wiki, nella knowledge base del servizio clienti e nelle procedure operative standard (SOP) .

- Supporto clienti: consenti agli agenti di individuare rapidamente articoli di assistenza pertinenti e risoluzioni di ticket precedenti durante una chiamata con un cliente: l'analisi di McKinsey mostra un aumento della produttività del 30-45% quando l'IA generativa viene applicata ai flussi di lavoro dell'assistenza clienti.

- Aspetti legali e di conformità: cerca tra milioni di contratti, politiche e documenti normativi con comprensione semantica per trovare clausole o precedenti specifici.

- Ricerca e sviluppo: consenti agli ingegneri di trovare lavori precedenti, brevetti e documentazione tecnica pertinenti per evitare la duplicazione dei lavori richiesti.

- Risorse umane e inserimento dei nuovi assunti: metti in evidenza le politiche, i materiali di formazione, gli esempi di flussi di lavoro e le procedure rilevanti per i nuovi assunti, in modo che possano trovare autonomamente le risposte alle loro domande.

- Supporto alle vendite: aiuta i rappresentanti commerciali a trovare i casi di studio, le informazioni sulla concorrenza e le informazioni sui prodotti giusti per concludere le trattative più rapidamente.

Il filo conduttore è che una ricerca aziendale efficace deve essere integrata nella gestione del flusso di lavoro esistente. Una barra di ricerca autonoma non è sufficiente. Il tuo team deve essere in grado di trovare le informazioni e agire immediatamente senza dover cambiare strumento.

🛠️ Toolkit: crea un hub interno che il tuo team utilizzerà davvero. Il modello di knowledge base di ClickUp mantiene tutto, dalle guide pratiche alle procedure operative standard, ben organizzato e facile da cercare, così nessuno dovrà più chiedersi dove si trovano le informazioni.

Come configurare Cohere per la ricerca aziendale

Passare dalla valutazione della ricerca IA alla sua effettiva implementazione può sembrare scoraggiante. Soprattutto se il tuo team non ha familiarità con i modelli linguistici di grandi dimensioni.

Sebbene la complessità della configurazione dipenda dalle dimensioni e dallo stack tecnologico esistente, i passaggi fondamentali per la creazione di un sistema di ricerca basato su Cohere sono gli stessi. Questa sezione fornisce una guida pratica per assistere il tuo team tecnico.

Prerequisiti e accesso API

Prima di scrivere qualsiasi codice, devi procurarti gli strumenti e l'accesso necessari in ordine. Questa configurazione iniziale aiuta a prevenire problemi di sicurezza e ostacoli in seguito.

Ecco cosa ti serve per iniziare:

- Account API Cohere: registrati sul sito web di Cohere per ottenere le tue chiavi API.

- Ambiente di sviluppo: la maggior parte dei team utilizza Python, ma sono disponibili SDK per altri linguaggi.

- Database vettoriale: avrai bisogno di uno spazio in cui archiviare gli embedding dei tuoi documenti, come Pinecone, Weaviate, Qdrant o un servizio gestito come Amazon OpenSearch.

- Corpus di documenti: raccogli i contenuti che desideri rendere ricercabili (ad esempio PDF, file di testo, record di database).

Puoi anche accedere ai modelli di Cohere tramite Amazon Bedrock, che può semplificare la fatturazione e la sicurezza se la tua azienda opera già all'interno dell'ecosistema AWS.

Genera embedding con Cohere Embed

Il passaggio successivo consiste nel convertire i tuoi documenti in vettori ricercabili. Questo processo prevede la preparazione del contenuto e la sua elaborazione tramite il modello Cohere Embed.

Il modo in cui prepari i tuoi documenti, in particolare il modo in cui li suddividi in parti più piccole, ha un impatto enorme sulla qualità della ricerca. Questa strategia è chiamata "chunking".

Le strategie di chunking più comuni includono:

- Blocchi di dimensioni fisse: il metodo più semplice, ma può dividere in modo innaturale frasi o concetti nel mezzo.

- Chunking semantico: un metodo più avanzato che rispetta la struttura del documento, come la suddivisione alla fine dei paragrafi o delle sezioni.

- Blocchi sovrapposti: questo approccio include una piccola quantità di testo ripetuto tra i blocchi per aiutare a preservare il contesto oltre i confini.

Una volta suddivisi i documenti, inviali all'API Embed in batch per generare le rappresentazioni vettoriali. Di solito si tratta di un processo una tantum per i documenti esistenti, mentre i documenti nuovi o aggiornati vengono incorporati man mano che vengono creati.

📖 Per saperne di più: Che cos'è un motore di ricerca interno? I migliori strumenti e come funzionano

Memorizza e query i vettori

I tuoi vettori appena creati hanno bisogno di una sede. Un database vettoriale è un database specializzato progettato per archiviare e queryare gli embedding in base alla loro somiglianza.

Il processo di query funziona in questo modo:

- Un utente digita una query di ricerca

- La tua applicazione invia la query allo stesso modello Cohere Embed per convertirla in un vettore.

- Il vettore di query viene inviato al database, che individua i vettori di documenti più simili.

- Il database restituisce i documenti corrispondenti, che puoi quindi mostrare all'utente.

Quando scegli un database vettoriale, dovrai anche considerare quale metrica di similarità utilizzare. La similarità coseno è la più comune per la ricerca basata sul testo, ma esistono altre opzioni per diversi casi d'uso.

| Metrica di similarità | Ideale per |

|---|---|

| Similarità coseno | Ricerca di testo generica |

| Prodotto scalare | Quando l'ampiezza dei vettori è importante |

| Distanza euclidea | Dati spaziali o geografici |

Implementa il riclassificamento per ottenere risultati migliori.

Per molte applicazioni, i risultati del tuo database vettoriale sono sufficienti. Ma quando hai bisogno del risultato migliore in assoluto, è consigliabile aggiungere un passaggio di riclassificazione.

Ciò è particolarmente importante quando la tua ricerca alimenta un sistema RAG, poiché la qualità della risposta generata dipende in larga misura dalla qualità del contesto recuperato.

Il processo di riclassificazione è molto semplice:

- Recupera un insieme più ampio di candidati iniziali dal tuo database vettoriale (ad esempio, i primi 50 risultati).

- Passa la query originale dell'utente e questo elenco di candidati all'API Cohere Rerank.

- L'API restituisce lo stesso elenco di documenti, ma riordinato in base a un punteggio di pertinenza più preciso.

- Mostra all'utente i risultati migliori dall'elenco riclassificato.

Per misurare l'impatto del riclassamento, puoi effettuare il monitoraggio di metriche di valutazione offline, come nDCG (Normalized Discounted Cumulative Gain) e MRR (Mean Reciprocal Rank).

💫 Per una panoramica visiva dell'implementazione delle funzionalità di ricerca per l'azienda, guarda questa guida che illustra i concetti chiave e le considerazioni pratiche:

Best practice per la ricerca aziendale basata su Cohere

La creazione di un sistema di ricerca è solo il primo passaggio. Mantenere e migliorare la sua qualità nel tempo è ciò che distingue un progetto di esito positivo da uno fallito. Se gli utenti hanno alcune esperienze negative, perderanno fiducia e smetteranno di utilizzare lo strumento. 🛠️

Ecco alcune lezioni apprese da implementazioni di ricerca aziendale con esito positivo:

- Inizia con la ricerca ibrida: non affidarti solo alla ricerca semantica. Combinala con un algoritmo di ricerca tradizionale basato su parole chiave, come BM25. In questo modo otterrai il meglio da entrambi i mondi: la ricerca semantica trova elementi concettualmente correlati, mentre la ricerca per parole chiave ti garantisce di trovare comunque corrispondenze esatte per codici prodotto o nomi specifici.

- Investi nella pulizia e nella qualità dei dati: i risultati della ricerca possono essere validi solo quanto i tuoi dati. Documenti puliti e ben strutturati, con titoli e paragrafi chiari, producono embedding di qualità molto superiore.

- Suddividi in modo ponderato: il modo in cui suddividi i tuoi documenti in blocchi è fondamentale. Invece di utilizzare limiti di caratteri arbitrari, cerca di allineare i blocchi alla struttura logica dei tuoi documenti, come paragrafi o sezioni.

- Aggiungi il filtro dei metadati: la ricerca semantica è potente, ma a volte gli utenti sanno già cosa stanno cercando. Consenti loro di filtrare i risultati in base a metadati come data, reparto o tipo di documento prima che la ricerca semantica entri in azione.

- Monitorate e ripetete: prestate molta attenzione a ciò che i vostri utenti stanno cercando, a quali risultati cliccano e quali query non restituiscono risultati. Questi dati sono preziosi per identificare le lacune nei contenuti e migliorare il vostro sistema.

- Gestisci gli errori con eleganza: nessun sistema di ricerca è perfetto. Quando una ricerca restituisce risultati insoddisfacenti, fornisci soluzioni alternative utili, come suggerire query alternative o offrire di avvisare un esperto umano.

📖 Per saperne di più: Ricerca personalizzata: migliora la produttività e l'esperienza sul posto di lavoro

Limiti di Cohere per la ricerca aziendale

Sebbene Cohere fornisca potenti modelli di IA, non è una soluzione plug-and-play (non esattamente).

La creazione di una soluzione di ricerca aziendale pronta per la produzione comporta sfide significative che i team spesso sottovalutano. Comprendere questi limiti è fondamentale per prendere decisioni informate ed evitare costose sorprese in futuro.

Il problema principale è che si ottiene una serie di strumenti, non un prodotto finito. Ciò significa che il tuo team è responsabile della creazione e della manutenzione dell'intera infrastruttura relativa alla ricerca come servizio.

Ecco alcune delle limitazioni principali da tenere in considerazione:

| Sfida | Perché diventa un problema |

|---|---|

| Richiede competenze specialistiche | Per costruire, gestire e mantenere il sistema sono necessari ingegneri esperti in IA e dati. Non è qualcosa che la maggior parte dei team può configurare o possedere con facilità. |

| Sono necessarie integrazioni personalizzate | I modelli non effettuano automaticamente la connessione ai tuoi strumenti esistenti. Ogni origine dati deve essere collegata e gestita manualmente. |

| Elevata manutenzione continua | Gli indici di ricerca devono essere costantemente aggiornati man mano che i contenuti cambiano o i modelli vengono aggiornati, aggiungendo un carico di lavoro operativo continuo. |

| Non connesso alla tua area di lavoro | L'IA comprende il linguaggio, ma non vive dove lavora effettivamente il tuo team, creando una disconnessione tra ricerca ed esecuzione. |

| Il cambio di contesto è inevitabile | Le persone trovano le informazioni in un unico posto, poi cambiano strumento per agire su di esse, il che riduce la produttività e l'adozione. |

📖 Per saperne di più: Modelli gratis per knowledge base in Word e ClickUp

Come utilizzare ClickUp come alternativa alla ricerca dell'azienda

A questo punto, il compromesso dovrebbe essere ovvio.

La ricerca aziendale è potente, ma realizzarla autonomamente significa gestire pipeline di acquisizione, strategie di suddivisione in blocchi, aggiornamenti degli embedding, logica di riclassificazione e manutenzione continua. Si tratta di un impegno infrastrutturale a lungo termine, non del lancio di una nuova funzionalità/funzione.

Essendo la prima area di lavoro AI convergente al mondo, ClickUp elimina l'intero livello rendendo la ricerca basata sull'intelligenza artificiale nativa dell'area di lavoro stessa.

Questo è importante perché la maggior parte dei problemi di ricerca non sono realmente problemi di ricerca. Sono problemi di dispersione del lavoro . Quando il lavoro è disperso tra strumenti non collegati tra loro, i team sono costretti a cercare costantemente il contesto. Il risultato è una perdita di tempo, uno sforzo duplicato e decisioni prese senza una visibilità completa.

ClickUp affronta il problema alla radice riunendo lavoro, contesto e intelligenza in un unico spazio di lavoro. Analizziamo come funziona nella pratica.

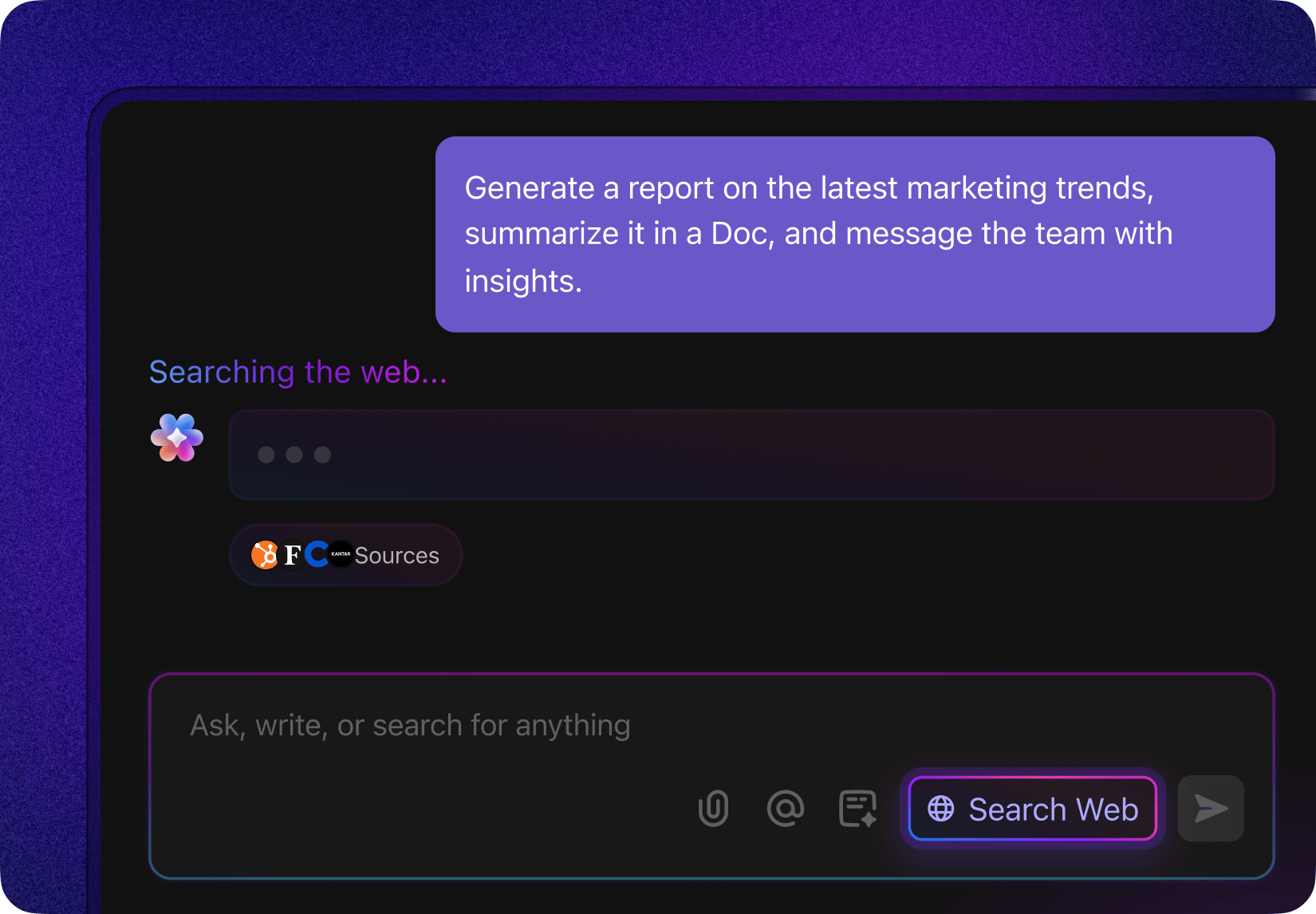

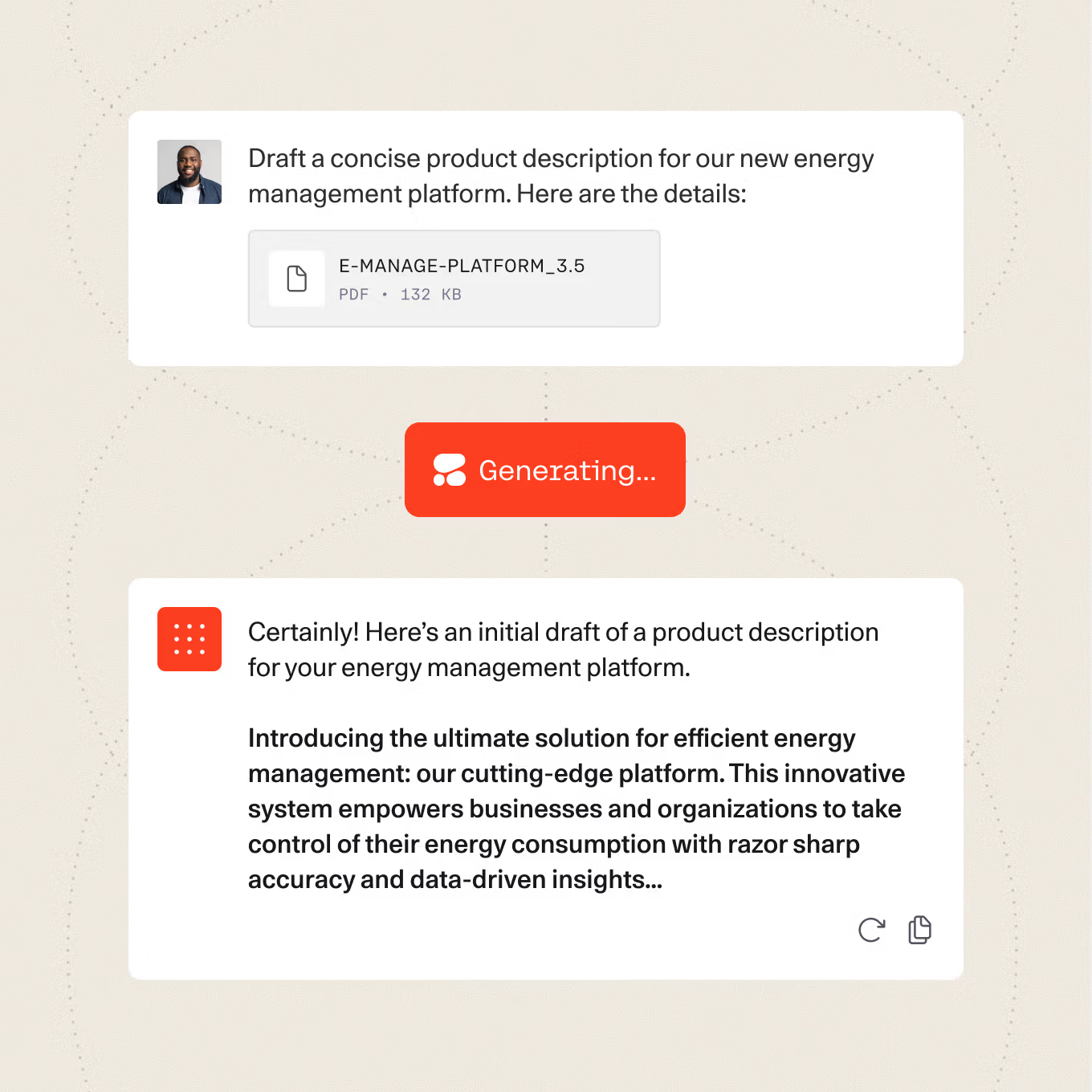

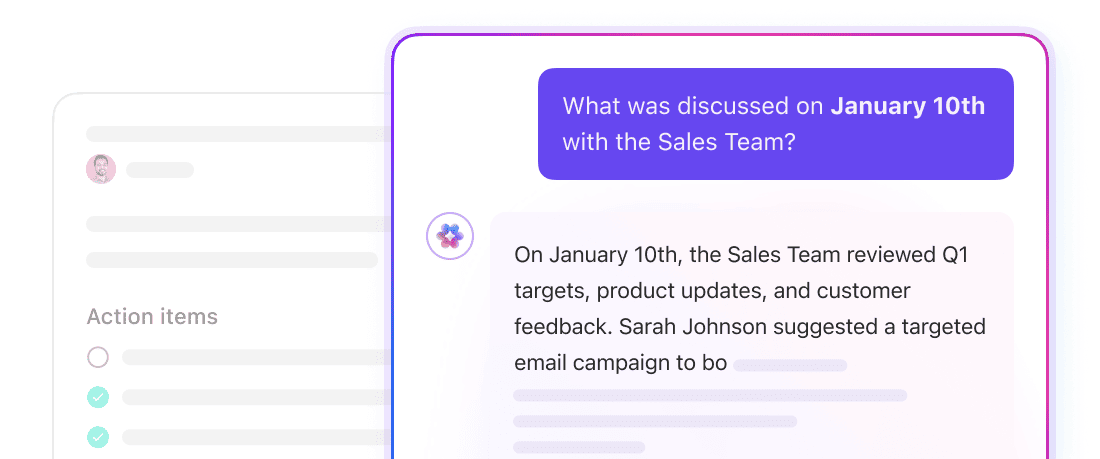

Ottieni risposte contestualizzate da tutto lo spazio di lavoro con ClickUp Brain.

ClickUp Brain è un livello di IA contestuale che opera nell'intero spazio di lavoro. È in grado di rispondere a domande, riecheggiare/riassumere informazioni e mettere in evidenza lavori rilevanti perché ha già accesso alla struttura sottostante dello spazio di lavoro: ClickUp Tasks, ClickUp Documenti, ClickUp Comments e altro ancora.

Non è necessario definire le dimensioni dei blocchi o gestire gli embedding. Brain utilizza il modello di dati nativo di ClickUp per comprendere come sono collegate le informazioni. Ponete una domanda come "Cosa sta bloccando il lancio del quarto trimestre?" e Brain sarà in grado di estrarre il contesto dalle attività, dai commenti e dai documenti collegati a tale iniziativa.

ClickUp Brain offre anche supporto per più modelli di IA, consentendoti di sfruttare diverse richieste al modello più appropriato per il ragionamento, la sintesi o la generazione. Ciò evita di vincolare i tuoi flussi di lavoro ai punti di forza o ai limiti di un singolo modello.

Quando hai bisogno di un contesto esterno, Brain può eseguire ricerche sul web direttamente dall'area di lavoro, restituendo risultati riassunti senza richiederti di uscire da ClickUp o aprire una scheda separata del browser.

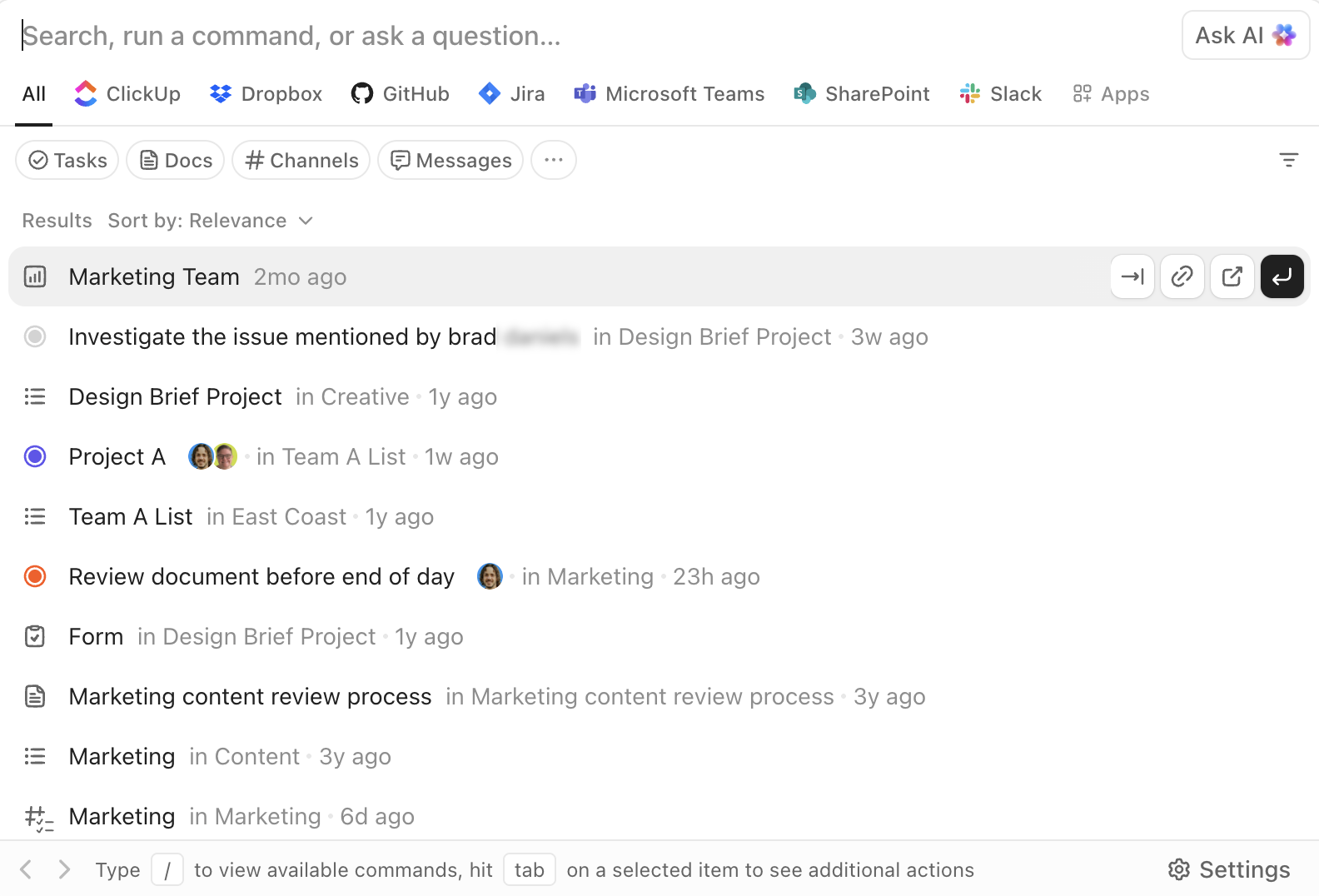

Cerca, naviga ed esegui con ClickUp Enterprise Search

La ricerca aziendale di ClickUp è accessibile da qualsiasi punto dell'area di lavoro. Consente di effettuare ricerche tra attività, documenti, commenti e allegati, nonché app di terze parti collegate come Google Drive, Slack, GitHub e altre, a seconda delle integrazioni.

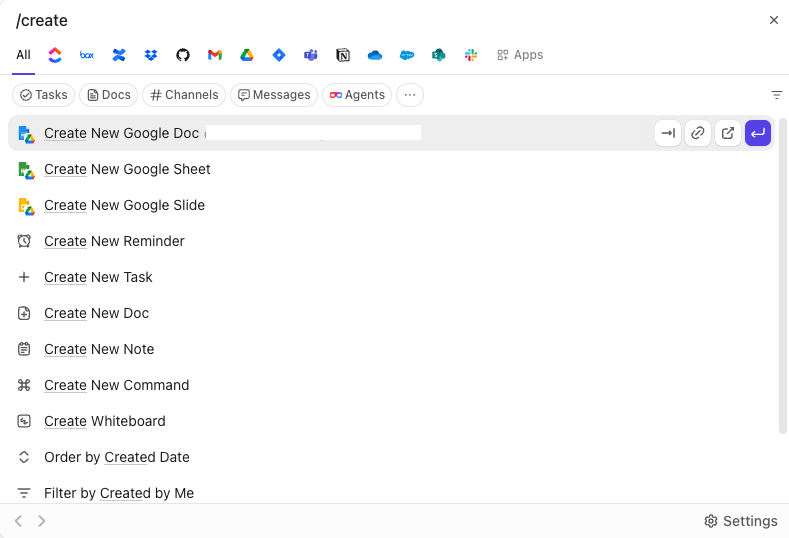

La barra di comando IA trasforma la ricerca in un livello di esecuzione. È possibile passare agli elementi, creare attività, modificare gli stati, assegnare titolari o aprire viste specifiche direttamente dalla stessa interfaccia. Non si tratta solo di "trovare e leggere", ma di "trovare e agire".

Poiché la ricerca è integrata nell'interfaccia utente dell'area di lavoro, i risultati sono sempre utilizzabili. Non è necessario recuperare le informazioni separatamente e poi passare a un altro strumento per utilizzarle. Il flusso di lavoro continua senza interruzioni.

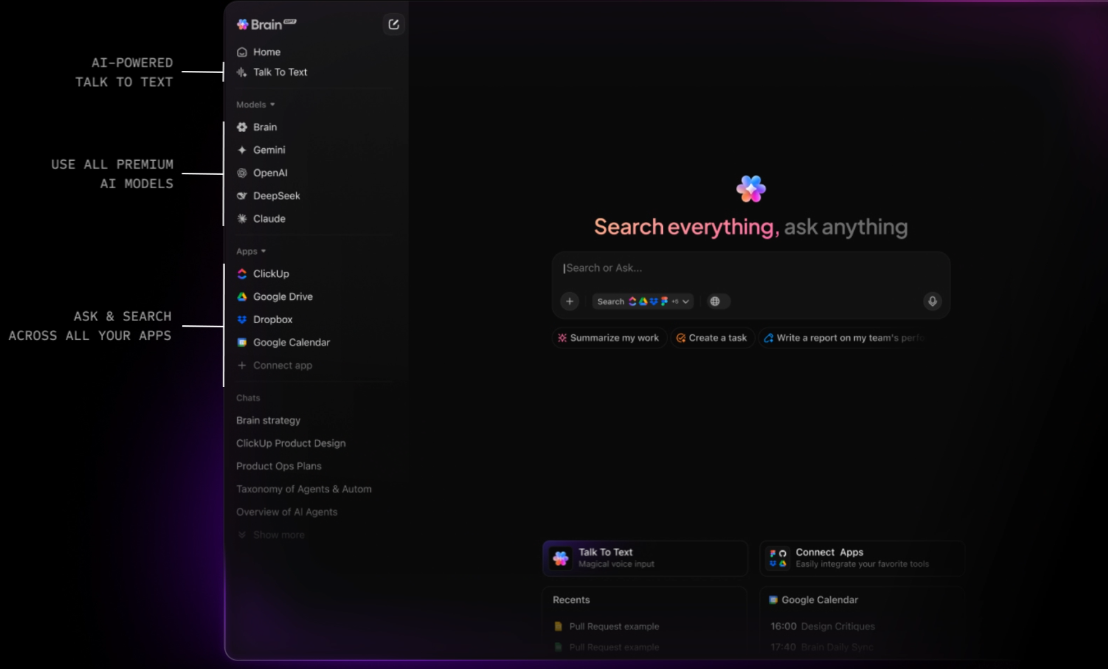

Riduci la proliferazione di strumenti con ClickUp BrainGPT

ClickUp BrainGPT estende le funzionalità di ricerca oltre il browser, offrendo un'app desktop autonoma e un'estensione Chrome. Si collega direttamente alla tua area di lavoro e mostra la stessa intelligenza contestuale senza richiederti di aprire prima ClickUp o qualsiasi altra app collegata.

Da un'unica interfaccia, puoi cercare attività, documenti, commenti e strumenti collegati, tra cui Gmail e altre integrazioni. La funzione vocale Talk-to-Text ti consente di effettuare ricerche o acquisire domande all'istante, il che è particolarmente utile per ricerche rapide o per lavorare in movimento.

Invece di aggiungere un altro prodotto di ricerca IA da gestire, Brain GPT consolida la ricerca in un'unica interfaccia che comprende già il tuo lavoro.

Questo è il vero cambiamento. ClickUp non ti chiede di creare una ricerca per l'azienda. L'area di lavoro convergente lo integra direttamente nel sistema in cui si svolge il lavoro, eliminando i costi di infrastruttura e preservando potenza, precisione e velocità.

📖 Per saperne di più: Esempi dei migliori sistemi di gestione della conoscenza

Bonus: confronto strategico tra IA personalizzata e IA nativa dell'area di lavoro

| Valore fondamentale | Massima flessibilità; controllo proprietario | Pronto all'uso; sensibile al contesto per impostazione predefinita |

| Implementazione | Mesi: richiede team di ingegneri per creare pipeline | Minuti: attivazione/disattivazione con un solo clic per l'intera area di lavoro |

| Acquisizione dei dati | Manuale: è necessario creare e mantenere ETL e database vettoriali. | Automatico: accesso in tempo reale ad attività, documenti e chat |

| Logica di autorizzazione | Deve essere codificato manualmente (alto rischio di fuga di dati) | Ereditato in modo nativo dalla gerarchia ClickUp |

| Profondità contestuale | Semantico (basato sul significato) | Operativo (sa chi è assegnato a cosa) |

| Interfaccia utente | È necessario progettare e creare la barra di ricerca/chat. | Integrato (barra di ricerca, documenti e visualizzazioni delle attività) |

| Azione del flusso di lavoro | Nessuno: l'utente trova le informazioni, quindi cambia strumento per lavorare | Elevato: trova informazioni e convertile istantaneamente in un'attività |

| Ideale per | Aziende ad alta tecnologia che sviluppano software proprietario | Teams che desiderano eliminare la "proliferazione di strumenti" e agire rapidamente |

La ricerca non deve essere un ostacolo!

La ricerca semantica non è più un elemento di differenziazione. È ormai uno standard.

Il costo reale della ricerca aziendale si manifesta in molti altri aspetti: il tempo necessario per svilupparla e mantenerla, l'infrastruttura richiesta per garantirne l'accuratezza e l'attrito creato quando la ricerca avviene al di fuori degli strumenti in cui si svolge effettivamente il lavoro. Trovare il documento giusto non ha molta importanza se per agire su di esso è comunque necessario passare da un sistema all'altro.

Ecco perché il problema non è solo "una ricerca migliore". Si tratta di eliminare il divario tra informazione ed esecuzione.

Quando la ricerca è integrata direttamente nell'area di lavoro, il contesto viene preservato per impostazione predefinita. Le risposte non vengono solo recuperate, ma sono immediatamente utilizzabili. Le attività possono essere aggiornate, le decisioni possono essere documentate e il lavoro può procedere senza creare un ulteriore passaggio di consegne.

Per i team che non vogliono dedicare mesi alla creazione e alla manutenzione di un'infrastruttura di ricerca personalizzata, lavorare in uno spazio di lavoro AI convergente cambia completamente le carte in tavola. ClickUp offre una ricerca di livello aziendale basata sull'intelligenza artificiale come parte del sistema che il tuo team già utilizza per pianificare, collaborare ed eseguire.

✅ Inizia a utilizzare ClickUp gratis.

Domande frequenti

Cohere si concentra specificamente su casi d'uso aziendali, come la ricerca, offrendo modelli come Embed e Rerank appositamente progettati per attività di recupero. OpenAI fornisce modelli più ampi e generici che possono essere adattati alla ricerca, ma che potrebbero richiedere una maggiore messa a punto.

Sì, Cohere fornisce API che consentono l'integrazione con altri strumenti; tuttavia, ciò richiede risorse di sviluppo e ingegneria personalizzate. Un'alternativa come ClickUp offre una ricerca AI nativa che funziona immediatamente, eliminando la necessità di qualsiasi lavoro di integrazione.

I settori con repository di documenti voluminosi e non strutturati, come quelli legale, sanitario, finanziario e tecnologico, traggono il massimo vantaggio dalla ricerca semantica. Qualsiasi organizzazione che abbia difficoltà nella gestione delle conoscenze può ottenere miglioramenti significativi.