La mayoría de la gente da por sentado que tiene que elegir entre utilizar potentes herramientas de IA o mantener la privacidad de sus datos. Pero, en realidad, puedes tener ambas cosas. Ejecutar la IA localmente significa que los datos nunca salen de tu hardware. Mantienes el control total sobre tu información sin dejar de automatizar tus tareas más repetitivas.

Esta guía le muestra cómo utilizar la IA local para crear flujos de trabajo seguros con herramientas como Ollama. Aprenderá a seleccionar modelos de código abierto que se adapten a las especificaciones concretas de su hardware. Y a crear flujos de trabajo automatizados que procesen documentos privados de forma local.

También veremos cómo centralizar los flujos de trabajo en un espacio unificado como ClickUp. 😎

¿Qué es la IA local?

La IA local significa que ejecutas modelos de lenguaje a gran escala (LLM) íntegramente en tu propio hardware —como tu ordenador portátil o un servidor local— en lugar de enviar tus datos a servicios externos en la nube. Esto es adecuado para cualquier equipo que maneje información confidencial, desde ingeniería y diseño de productos hasta departamentos jurídicos y financieros.

Con la mayoría de las herramientas de IA basadas en la nube, tus indicaciones, documentos y datos se envían a servidores de terceros. Pierdes el control sobre cómo se procesa, almacena o utiliza esa información.

Por el contrario, la IA local mantiene tus datos dentro de tu entorno. Mantienes el control total sobre la seguridad y la protección de los datos de tus flujos de trabajo.

Por supuesto, hay una contrapartida. Configurar la IA local requiere un mayor esfuerzo técnico y una inversión inicial en hardware. Sin embargo, elimina por completo tu dependencia de proveedores externos. Con la inferencia en el dispositivo, tu información permanece exactamente donde tú quieres.

Por qué la IA local es importante para los flujos de trabajo seguros en equipo

🔎 ¿Sabías que...? Solo 1 de cada 10 consumidores está dispuesto al uso compartido de información confidencial, como datos financieros, de comunicación o biométricos, con sistemas basados en IA.

Esta reticencia refleja una realidad cada vez más presente para los equipos B2B. Con la IA basada en la nube, básicamente estás entregando la propiedad intelectual de tu empresa a un tercero. Para los equipos jurídicos, financieros o de RR. HH., esto supone una enorme responsabilidad.

La IA local cambia esta dinámica al trasladar la IA a su propio hardware. He aquí por qué es importante para sus operaciones diarias:

- Elimine la fuga de datos: Evite que el código propietario o los contratos privados de los clientes se utilicen para entrenar un modelo público que podrían usar sus competidores.

- Mantenga el cumplimiento normativo: Cumpla con los requisitos del RGPD o la HIPAA, ya que los datos confidenciales nunca cruzan fronteras internacionales ni pasan por servidores de terceros.

- Elimine la dependencia de Internet: Realice análisis de datos complejos o tareas de redacción durante un corte de suministro o en entornos de alta seguridad donde el acceso a la nube esté restringido

- Gestiona los costes de forma predecible: Evita el aumento de las tarifas de las API a medida que tu equipo crece, ya que tu único coste es el hardware que ya posees

Al integrar la IA local con tus herramientas actuales, puedes automatizar tu trabajo sin comprometer tu seguridad.

⚠️ Sin embargo, es importante recordar que este problema puede agravarse. Es posible que su equipo quiera adoptar múltiples herramientas de IA, lo que daría lugar a una proliferación descontrolada de la IA: la proliferación de herramientas de IA sin supervisión ni estrategia. Esto puede provocar un desperdicio de dinero, una duplicación de esfuerzos y riesgos de seguridad.

En última instancia, amplía su modelo de amenazas de seguridad y dificulta el seguimiento del trabajo.

📮ClickUp Insight: Los equipos de bajo rendimiento son cuatro veces más propensos a utilizar más de 15 herramientas, mientras que los equipos de alto rendimiento mantienen la eficiencia limitando su conjunto de herramientas a nueve plataformas o menos. Pero, ¿qué tal si utilizas una sola plataforma? Como la aplicación todo en uno para el trabajo, ClickUp reúne tus tareas, proyectos, documentos, wikis, chat y llamadas en una única plataforma, con flujos de trabajo impulsados por IA. ¿Listo para trabajar de forma más inteligente? ClickUp funciona para todos los equipos, hace que el trabajo sea visible y te permite centrarte en lo que importa mientras la IA se encarga del resto.

¿Qué necesitas para ejecutar IA local?

No necesitas un superordenador especializado para ejecutar IA de forma local. Los recientes cambios en la forma de construir los modelos te permiten empezar con el hardware que ya tienes. Lo único que tiene que hacer es cumplir unos pocos criterios específicos.

Requisitos de hardware

Tu hardware determina el tamaño y la velocidad de los modelos de IA que puedes utilizar. Si bien una máquina potente te permite ejecutar modelos de razonamiento más complejos, los modelos más pequeños se han vuelto sorprendentemente capaces.

- GPU con VRAM: Una tarjeta NVIDIA dedicada con al menos 12 GB de VRAM es la opción ideal actualmente para la mayoría de los equipos. Te permite ejecutar modelos de tamaño medio, como Llama 3.3 (8B) o Mistral Small, a altas velocidades.

- RAM del sistema: Si no dispone de una GPU de gama alta, la RAM de su ordenador se encargará de la carga. 32 GB le proporcionan suficiente margen para ejecutar un modelo mientras mantiene abiertos el navegador y las herramientas de gestión de proyectos.

- Memoria unificada (para usuarios de Mac): Si utilizas un Mac con un chip de la serie M (M2, M3 o M4), la RAM y la memoria de la GPU tienen un uso compartido. Esto hace que los Mac sean especialmente eficientes para la IA local, ya que el modelo puede acceder a todo el conjunto de memoria

- Almacenamiento rápido: Los modelos son archivos de gran tamaño, que suelen tener un intervalo entre 5 GB y 50 GB. El uso de un SSD NVMe es esencial para evitar largos tiempos de espera al cargar un nuevo modelo

🔎 ¿Sabías que...? Montar un PC es mucho más caro de lo que era hace solo unos meses. Antes, un kit de memoria DDR5 de 32 GB costaba menos de 130 dólares, pero ahora esos mismos kits han superado los 400 dólares. Este cambio ha convertido los 32 GB en el nuevo mínimo imprescindible para cualquier trabajo serio de IA local, ya que se necesita suficiente margen para ejecutar modelos sin que el rendimiento del sistema se colapse.

Requisitos de software

El software actúa como puente entre tu hardware y la IA. Ya no es necesario ser desarrollador para ponerlo en marcha.

- Sistema operativo: Aunque Linux es el entorno nativo de la IA, Windows y macOS ahora ofrecen las mismas capacidades. Los usuarios de Windows pueden utilizar WSL2 para disponer de un entorno similar a Linux, aunque muchas herramientas ahora se ejecutan directamente en Windows

- Gestores de modelos: Herramientas como Ollama o LM Studio son el punto de partida más sencillo. Se encargan de la cuantificación, es decir, de comprimir el modelo para que quepa en tu hardware automáticamente.

- Controladores: Necesitarás los controladores más recientes para tu hardware, como el último controlador CUDA para tarjetas NVIDIA. La mayoría de los instaladores modernos lo comprobarán por ti durante la configuración.

Opciones de LLM de código abierto

Estamos asistiendo a una explosión de modelos de código abierto que se pueden descargar de forma gratuita. Estos han sido desarrollados por empresas como Meta (Llama), Mistral y Alibaba (Qwen). A diferencia de los sistemas cerrados, estos modelos te permiten ver exactamente cómo funcionan y adónde van tus datos.

A la hora de elegir un modelo de lenguaje grande, fíjate en la licencia del software. La mayoría utiliza Apache 2.0 o MIT, lo que te permite utilizarlos para operaciones empresariales sin una cuota de suscripción mensual. Dado que estos modelos residen en tu propio hardware, se integran directamente en tus flujos de trabajo privados.

Por ejemplo, puede utilizar un modelo local para redactar correos electrónicos internos, resumir actas de reuniones o analizar conjuntos de datos propios. De este modo, los detalles más confidenciales de sus proyectos y sus notas estratégicas permanecen en su equipo.

🧠 Dato curioso: Los chips de la serie M de Apple ofrecen una ventaja arquitectónica única para los equipos centrados en la privacidad. La memoria unificada de Mac permite que la IA utilice todo el conjunto de RAM del sistema como si se tratara de memoria gráfica dedicada.

Esto significa que un MacBook equipado con 128 GB de RAM puede ejecutar modelos enormes y muy sofisticados que normalmente requerirían hardware especializado de la corporación con un coste superior a los 10 000 dólares.

Los mejores modelos de IA local para flujos de trabajo en equipos

Para encontrar el modelo adecuado, compara las ventajas del modelo con las tareas de tu equipo y las capacidades de tu hardware.

Modelos de uso general

Estos son los pilares de tu configuración local. Úsalos para redactar correos electrónicos, resumir las novedades de los proyectos o generar ideas creativas.

- Llama 4 Scout (17B): Cuenta con una ventana de contexto de 10 millones de tokens, lo que te permite procesar miles de páginas de texto a la vez

- Mistral Small 4: utiliza una arquitectura de mezcla de expertos, lo que significa que solo activa una parte de sus parámetros para cada tarea

- Qwen 3.5 (7B): Ofrece un rendimiento superior de forma constante si tu equipo gestiona documentación técnica en varios idiomas

Modelos para el razonamiento y el uso de herramientas

Utilícelos cuando necesite que los agentes LLM resuelvan problemas de varios pasos, sigan una lógica compleja o actúen como agentes autónomos dentro de sus flujos de trabajo.

- Llama 4 Maverick: Es multimodal de forma nativa. Esto lo hace ideal para equipos que necesitan analizar gráficos complejos u hojas de cálculo financieras, donde el contexto visual es tan importante como el texto.

- Phi-4 (14B): Optimizado para STEM y razonamiento lógico. Úsalo para la validación de datos o tareas matemáticas complejas que suelen requerir modelos mucho más grandes y costosos.

- DeepSeek-R1: Muestra su cadena de razonamiento interna, lo que le ayuda a verificar su lógica para análisis de alto riesgo. Ideal para investigación en profundidad y planificación estratégica

Modelos específicos para cada tarea

A veces, una herramienta especializada es más eficiente que un asistente general. Estos modelos están optimizados para una parte específica de su flujo de trabajo.

- Qwen 3-Coder-Next: Comprende la lógica a escala de repositorio, lo que le permite sugerir correcciones de errores o refactorizar código en múltiples archivos. Todo ello siguiendo las guías de estilo específicas de su equipo.

- Voxtral Mini: Identifica a los diferentes interlocutores en una grabación y convierte las grabaciones de reuniones privadas en texto que se puede buscar. Funciona totalmente sin conexión, lo que resulta ideal para evitar fugas de datos.

- Nomic Embed v1.5: Convierte tus documentos privados en datos matemáticos para la búsqueda semántica. Esto te permite buscar en la base de conocimientos interna de tu equipo por significado, en lugar de solo por palabras clave.

Herramientas populares para ejecutar IA local

Ya no es necesario ser ingeniero de software para ejecutar modelos en su propio equipo. Actualmente, existen varias aplicaciones fáciles de usar que se encargan de la configuración técnica por usted en tan solo unos minutos.

Ollama y OpenWebUI

Ollama es ideal si buscas velocidad y flexibilidad. Se ejecuta en segundo plano y gestiona tu biblioteca de modelos a través de una interfaz sencilla.

Aunque se trata de una herramienta básica, la mayoría de los usuarios la combinan con OpenWebUI. Esto añade una experiencia de chat optimizada en tu navegador que se parece a las herramientas basadas en la nube que ya conoces. Además, crea un puente local para que otras aplicaciones de tu ordenador se comuniquen de forma segura con tus modelos de IA.

LM Studio

Si prefieres una aplicación de escritorio tradicional, LM Studio es una excelente alternativa. Funciona como una tienda de aplicaciones para IA. Puedes utilizarla para buscar, descargar y chatear con un nuevo modelo con solo unos clics.

La aplicación incluye detección de hardware integrada, por lo que configura automáticamente los ajustes para adaptarse a tu GPU o RAM específicas. Esto la convierte en un excelente punto de partida si quieres experimentar con diferentes modelos sin tener que tocar ni una sola línea de código.

GPT4All

Para los equipos que se centran exclusivamente en la privacidad y el análisis de documentos, GPT4All es una solución fiable y sencilla. Funciona en casi cualquier ordenador, incluidos los portátiles más antiguos que quizá no dispongan de una tarjeta gráfica dedicada.

Su función más útil es la posibilidad de chatear directamente con tus archivos locales. Puedes indicar a la aplicación una carpeta de tu disco duro y la IA responderá a preguntas sobre esos documentos concretos. Todo ello sin necesidad de subirlos a un servidor externo.

Cómo configurar la IA local para flujos de trabajo seguros de seguridad

En este tutorial se utiliza Ollama, ya que es una herramienta ampliamente compatible para crear flujos de trabajo de IA locales y seguros.

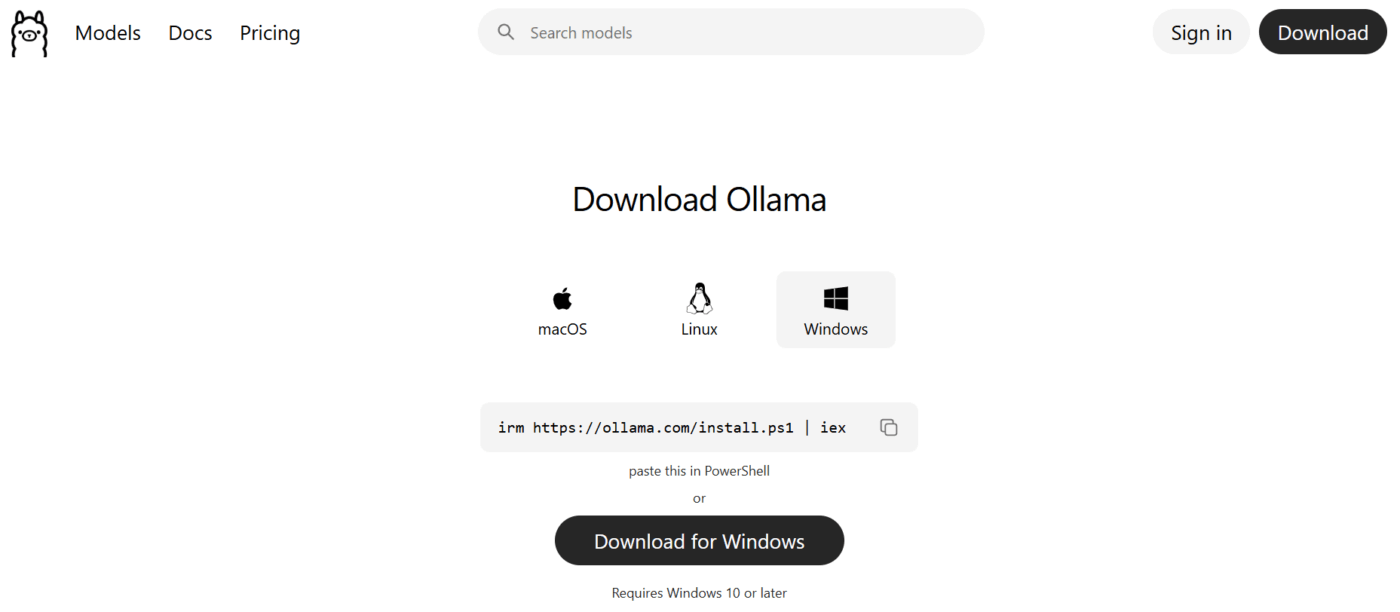

Paso 1: Instala Ollama

Descarga el instalador desde el sitio web oficial para tu sistema operativo específico. Mientras que las versiones anteriores de Windows requerían una configuración manual del subsistema Linux, la versión actual se instala como una aplicación nativa.

La instalación solo debería tardar unos minutos. Una vez finalizada la instalación, abre tu terminal o comando de símbolo del sistema y escribe ollama --versión para confirmar que está listo para funcionar.

Paso 2: Descarga y ejecuta un modelo

Para empezar a utilizar una IA, debes descargar sus pesos en tu máquina. Para tu primera prueba, prueba un modelo compacto pero potente como Llama 3.2 (3B) o la última versión de Mistral.

Utilice el comando ollama run llama3.2 para iniciar la descarga.

Dependiendo de la velocidad de tu conexión a Internet, esto suele tardar unos minutos. Una vez que hayas descargado el archivo, puedes escribir una indicación directamente en el terminal para obtener una respuesta inmediata del modelo en tu disco duro.

Paso 3: Conéctese a su herramienta de flujo de trabajo

El verdadero valor de la IA local reside en integrarla en tus tareas diarias. Cuando Ollama está en funcionamiento, inicia automáticamente un servidor local en http://localhost:11434. Esto crea un puente seguro para que otras aplicaciones se comuniquen con tu modelo.

Dado que este servidor es compatible con los protocolos estándar de OpenAI, puedes conectarlo a plataformas de automatización o scripts internos simplemente cambiando la dirección de la API. Por ejemplo, puedes dirigir una herramienta de búsqueda de documentos local a esta dirección. Esto le permite resumir archivos privados sin enviar nunca ese texto a la nube.

Buenas prácticas de seguridad para flujos de trabajo de IA local

Ejecutar la IA localmente supone un gran paso hacia la privacidad. Sin embargo, almacenar datos localmente implica que ahora eres responsable de protegerlos. Aunque has eliminado el riesgo de una violación de seguridad en la nube por parte de terceros, aún debes proteger tu hardware y la forma en que tu equipo interactúa con los modelos.

Sigue estas buenas prácticas:

- Aislamiento de red: Restringe el acceso a la API a redes internas de confianza para que tu servidor de IA siga siendo inaccesible desde la Internet pública

- Validación de entradas: Limpia todos los datos antes de enviarlos al modelo. Esto bloquea las instrucciones maliciosas ocultas en documentos o correos electrónicos.

- Controles de acceso: Implemente la autenticación en su punto final de IA para verificar que solo los usuarios autorizados puedan ser los desencadenantes de las acciones del modelo

- Registro de auditoría: Mantenga un registro de todas las interacciones de los modelos para facilitar las investigaciones de cumplimiento normativo y seguridad.

- Aislamiento de contenedores: Ejecute sus modelos en entornos aislados como Docker. Esto evita que una posible brecha de seguridad afecte a los archivos del sistema central.

- Actualizaciones periódicas: Instala los últimos parches para herramientas como Ollama y mantente protegido frente a las vulnerabilidades recién descubiertas.

- Limitación de velocidad: Para evitar que un solo usuario o script sature su servidor con solicitudes, implemente la limitación de velocidad para controlar cuántas consultas se pueden realizar en un periodo determinado.

🔎 ¿Sabías que...? Las manipulaciones basadas en indicaciones ya no son una amenaza teórica. Una encuesta reciente de Gartner reveló que el 32 % de las organizaciones sufrió un ataque malicioso mediante indicaciones en aplicaciones de IA durante el último año. Estos ataques pueden manipular tu modelo local para que genere resultados sesgados o no autorizados.

Cómo crear flujos de trabajo de IA seguros para tu equipo

Una vez que tu servidor local esté en funcionamiento, podrás integrarlo en tu trabajo diario. Esto convierte una simple herramienta en un motor de productividad privado. La forma más eficaz de hacerlo es mediante la generación aumentada por recuperación (RAG).

Este proceso conecta tu IA local a una base de datos privada de tus propios archivos. Puedes responder a preguntas utilizando el contexto específico de tu empresa sin necesidad de subir ni un solo byte a la nube.

También puede diseñar flujos de trabajo con intervención humana, en los que el trabajo de la IA es revisado por miembros del equipo humano. Esto garantiza la precisión al tiempo que acelera significativamente su rendimiento.

A continuación, te ofrecemos algunos ejemplos prácticos:

- Análisis de documentos: Resuma informes internos o comentarios de clientes para extraer información clave al instante

- Generación de borradores: Crea primeras versiones de correos electrónicos o actualizaciones de proyectos para que los miembros del equipo las perfeccionen

- Clasificación de datos: Categorice automáticamente las tareas entrantes en función del contenido específico de la solicitud

- Preparación de la reunión: Crea temas de conversación analizando los archivos de proyectos relacionados almacenados en tu unidad local

- Revisión de código: Obtenga comentarios sobre su código fuente propio sin exponer su propiedad intelectual a terceros

📮ClickUp Insight: Nuestra encuesta sobre la madurez de la IA muestra que el acceso a la IA en el trabajo sigue siendo limitado: el 36 % de las personas no tiene acceso alguno, y solo el 14 % afirma que la mayoría de los empleados puede realmente experimentar con ella. Cuando la IA está sujeta a permisos, herramientas adicionales o configuraciones complicadas, los equipos ni siquiera tienen la oportunidad de probarla en el trabajo real y cotidiano.

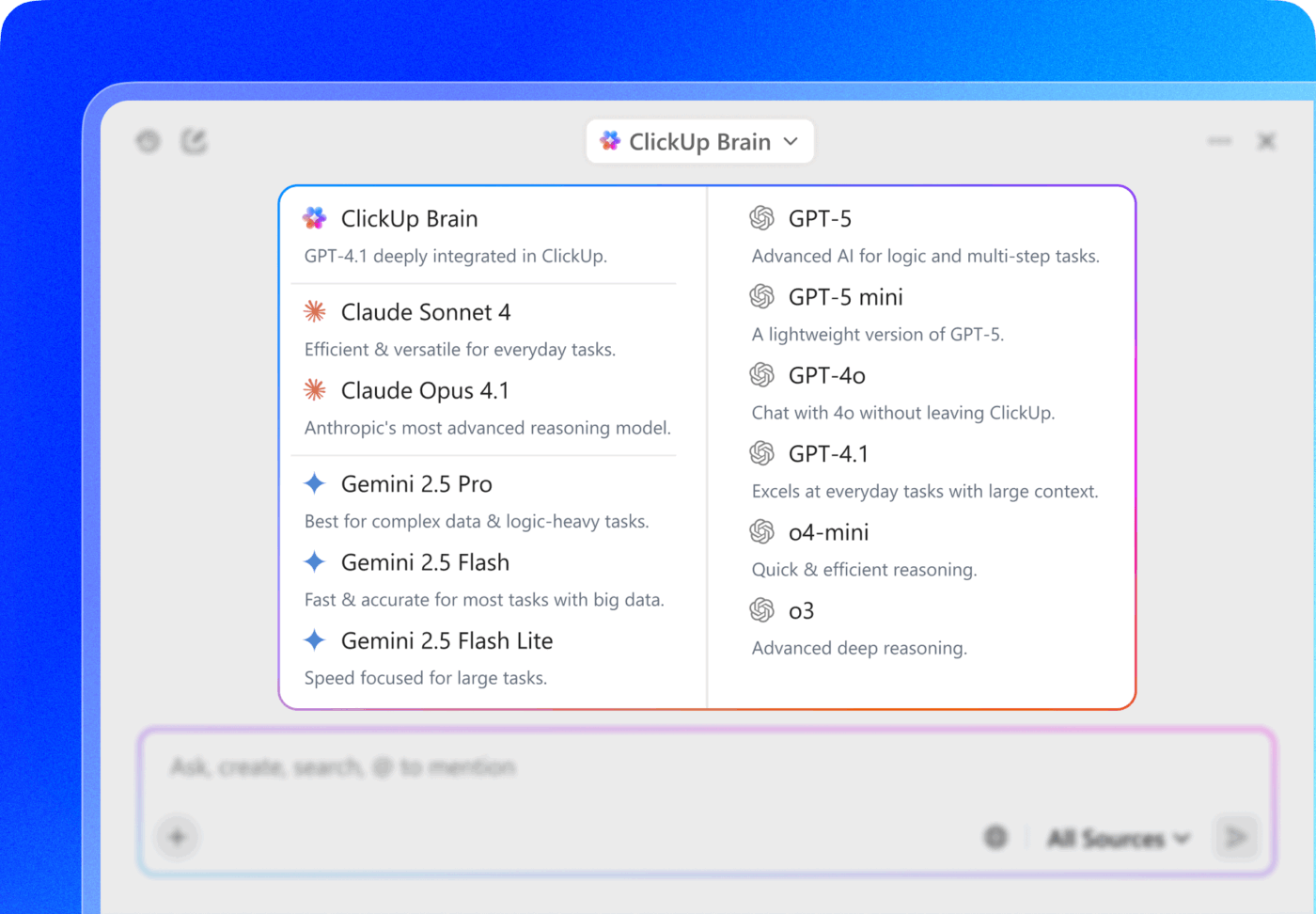

ClickUp Brain elimina todas esas dificultades al integrar la IA directamente en el entorno de trabajo que ya estás utilizando. Puedes acceder a múltiples modelos de IA, generar imágenes, escribir o depurar código, buscar en la web, resumir documentos y mucho más, sin cambiar de herramienta ni perder la concentración.

Es tu socio de IA ambiental, fácil de usar y accesible para todos los miembros del equipo.

Limitaciones del uso de la IA local para flujos de trabajo de IA

La IA local es una herramienta potente, pero no es una solución mágica para todos los problemas. Comprender sus limitaciones te ayuda a decidir cuándo mantener una tarea en tu propio hardware y cuándo utilizar la nube. Para algunos equipos, las compensaciones técnicas y financieras podrían superar las ventajas en materia de privacidad.

- Límite de capacidad: Los modelos propietarios de primer nivel siguen teniendo una ligera ventaja en cuanto a razonamiento complejo y matices creativos en comparación con las versiones de código abierto.

- Inversión en hardware: Para obtener un rendimiento rápido con modelos de gran tamaño se necesitan GPU costosas con una gran cantidad de VRAM. Esto puede suponer un elevado coste inicial para los equipos pequeños.

- Gastos de mantenimiento: Usted es responsable de todas las actualizaciones de software, la resolución de problemas de hardware y la aplicación de parches de seguridad sin el equipo de soporte del proveedor.

- Conocimientos técnicos: La optimización de un entorno local requiere conocimientos prácticos sobre la cuantificación de modelos y la configuración de servidores

- Gestión de la seguridad: A diferencia de los servicios en la nube, los modelos locales no incluyen moderación integrada. Debe implementar sus propios filtros de contenido y medidas de seguridad.

- Consumo energético: La ejecución de modelos de IA a gran escala en sus propios servidores o estaciones de trabajo puede aumentar significativamente su consumo de electricidad y sus necesidades de refrigeración.

Muchos equipos utilizan un enfoque híbrido: IA local para datos confidenciales e IA en la nube para tareas menos sensibles que requieren la máxima capacidad. A continuación, te ofrecemos una breve panorámica comparativa de ambas opciones:

| Factor | IA local | IA en la nube |

|---|---|---|

| Privacidad de los datos | Control total | Datos enviados al proveedor |

| Complejidad de la configuración | Más arriba | Reducir |

| Costes continuos | Hardware + electricidad | Tarifas por token |

| Capacidades de los modelos | Bueno, mejorando | Tecnología de vanguardia |

| Mantenimiento | Autogestionado | Gestionado por el proveedor |

Cómo ClickUp facilita flujos de trabajo seguros basados en IA

Hoy en día, la mayoría de los equipos se encuentran ante una disyuntiva: utilizar una potente IA en la nube y preocuparse por el destino de sus datos, o configurar modelos locales y lidiar con los gastos generales continuos. ClickUp elude ese dilema al actuar como un entorno de trabajo de IA convergente, donde la IA ya reside dentro del sistema en el que se desarrolla su trabajo.

ClickUp Brain es la capa de IA integrada directamente en el entorno de trabajo de ClickUp, diseñada para comprender tus tareas, documentos y la comunicación de tu equipo en un solo lugar. Ofrece asistencia de IA con todo el contexto: sin herramientas independientes ni integraciones inestables.

Para los equipos que desean crear flujos de trabajo de IA seguros, esa combinación de contexto y control marca la diferencia entre la experimentación y la adopción real.

🌟 ClickUp también cumple con la norma SOC 2 y se adhiere a los estándares ISO 42001 para una gestión responsable de la IA. Esto garantiza que tus datos nunca se utilicen para entrenar modelos de terceros, lo que te permite automatizar tu trabajo con la misma confianza que con una configuración local.

Accede a flujos de trabajo de búsqueda y autónomos con ClickUp Brain

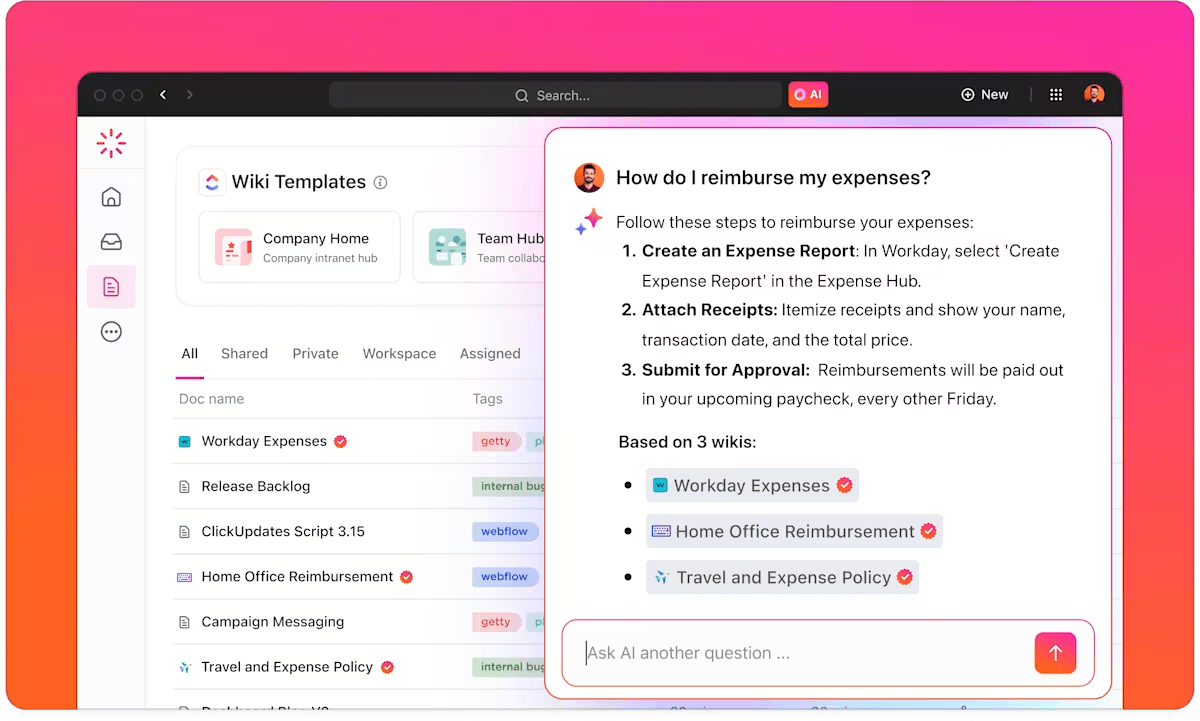

Una vez que tus datos estén seguros dentro del entorno de trabajo, ClickUp Brain extrae valor de tus tareas y documentos en tiempo real.

Al estar integrada, la IA evita la falta de contexto que ralentiza las configuraciones locales. Puedes hacerle preguntas que requieran una vista completa del historial de tu proyecto para responder con precisión:

- Identifica las decisiones finales de un extenso informe técnico sin tener que desplazarte por las distintas versiones

- Borrador de actualizaciones para las partes interesadas a partir de los comentarios de las tareas y los cambios de estado

ClickUp Brain genera respuestas basadas en los datos de tu entorno de trabajo mediante el análisis del contenido específico de tus documentos, tareas y chats. Esto garantiza que, a medida que tu proyecto evoluciona, la IA siempre disponga del contexto más reciente.

Esto permite a tu equipo aprovechar los conocimientos adquiridos sin tener que volver a explicar manualmente el historial del proyecto ni mover datos entre herramientas desconectadas.

💡Consejo profesional: Puedes ampliar aún más el contexto de tu entorno de trabajo utilizando Enterprise AI Search para extraer información de todas tus herramientas externas.

Por ejemplo, haz una pregunta compleja como «Muéstrame todas las operaciones abiertas en el proceso», y ClickUp Brain buscará en tus aplicaciones conectadas, como Slack, Google Drive y Gmail, para ofrecerte una respuesta fiable en tiempo real con referencias.

Esto convierte los datos fragmentados en múltiples plataformas en una única capa de inteligencia con capacidad de búsqueda, en la que puedes encontrar cualquier archivo, mensaje o tarea sin salir de tu entorno de trabajo.

Gestiona las tareas de forma inteligente con la automatización y la IA

ClickUp Brain no solo te ayuda de forma pasiva, sino que trabaja activamente dentro de tu sistema de tareas. Puede:

- Genera tareas a partir de notas de reuniones o de documentos

- Divide los proyectos de gran envergadura en subtareas

- Sugiere propietarios de tareas en función de la actividad anterior

- Recomienda plazos en función del contexto del proyecto

También puede actualizar el estado de las tareas, resumir largos hilos de comentarios en pasos claros a seguir y señalar los obstáculos antes de que ralenticen la ejecución.

Cuando se combina con ClickUp Automatización, esto se convierte en un sistema de bucle cerrado: la IA puede desencadenar flujos de trabajo (como asignar tareas, notificar a las partes interesadas o actualizar prioridades) en función de los cambios que se produzcan dentro de tu entorno de trabajo.

Por ejemplo, cuando se finaliza un documento, se pueden crear y asignar tareas automáticamente sin que nadie tenga que mover datos manualmente entre herramientas.

💟 Bonus: Convierte ClickUp Brain MAX en tu «memoria de decisiones».

Úsalo para:

- Resumir largas cadenas de comentarios en decisiones claras y pasos a seguir

- Actualice los documentos con «qué ha cambiado y por qué» tras alcanzar hitos clave

- Genera registros de decisiones semanales a partir de tareas, reuniones y actualizaciones

Con el tiempo, esto crea una capa dinámica de conocimiento institucional a la que Brain MAX puede recurrir. Así, en lugar de responder a las indicaciones de forma aislada, empieza a responder teniendo en cuenta decisiones, prioridades y patrones del pasado.

Es entonces cuando la IA pasa de ser útil a ser fiable, especialmente en flujos de trabajo de IA seguros en los que el contexto y la trazabilidad son fundamentales.

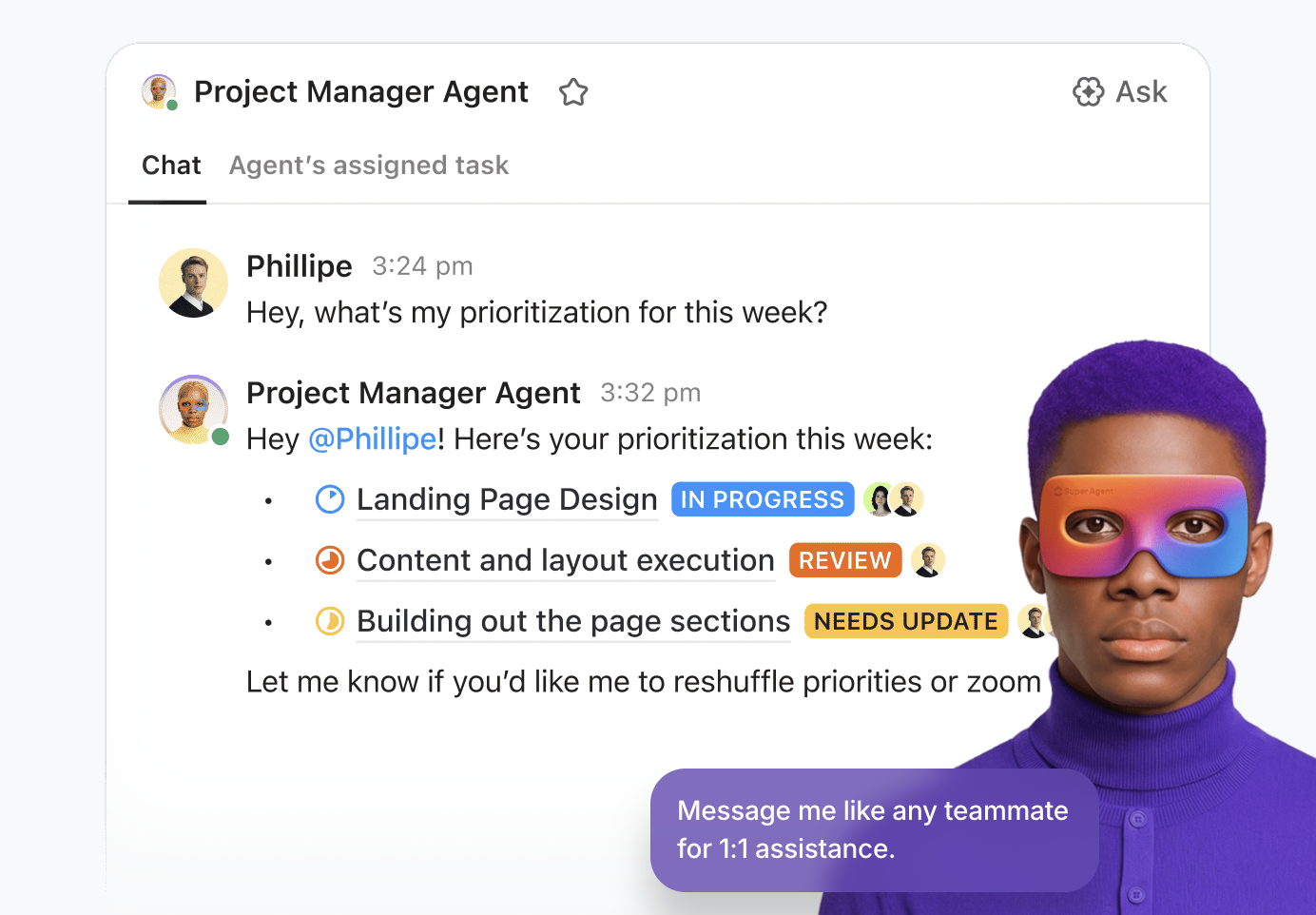

Consigue una seguridad y sensibilidad al contexto a gran escala con Super Agents

Los Superagentes de ClickUp llevan a ClickUp Brain un paso más allá: pasan de ayudar con el trabajo a impulsarlo activamente. Estos agentes se pueden configurar para supervisar flujos de trabajo, realizar acciones y coordinar tareas en todo tu entorno de trabajo basándose en reglas predefinidas y en el contexto en tiempo real.

Por ejemplo, un Super Agent puede:

- Supervisa las solicitudes entrantes o los documentos y conviértelos automáticamente en tareas estructuradas con propietarios y plazos.

- Realice un seguimiento del progreso del proyecto y señale los riesgos o retrasos antes de que se agraven

- Desencadena automatizaciones de varios pasos cuando se cumplan las condiciones, como notificar a las partes interesadas, actualizar prioridades o crear tareas de seguimiento

Estos agentes se ejecutan íntegramente dentro del entorno de trabajo unificado de ClickUp, con pleno conocimiento de tus tareas, documentos y estructura de permisos. Eso significa que:

- No es necesario exportar datos a sistemas de IA externos ni a herramientas de orquestación

- Solo acceden a los datos que están autorizados a ver

- Actúan dentro de los mismos límites de permisos que tu equipo

Más información sobre cómo trabajar con Super Agents:

Aprovecha la asistencia de la IA en tus documentos

Con ClickUp Docs, la asistencia de IA se integra directamente en tus flujos de trabajo de documentación. Los equipos pueden redactar resúmenes de proyectos, resumir informes extensos, extraer acciones a realizar o reescribir contenido para diferentes públicos, todo ello sin salir de la plataforma.

Esto es importante para los flujos de trabajo de IA seguros porque uno de los mayores riesgos proviene de copiar y pegar información confidencial en herramientas externas. En ClickUp, minimizas el movimiento de datos y mantienes un control total sobre el acceso a través de los permisos.

Veredicto final: cómo crear su propia pila de IA privada

La IA local aprovecha la inteligencia artificial al tiempo que mantiene un control total sobre la privacidad de los datos y el cumplimiento normativo. Sin embargo, esta vía requiere una inversión significativa en hardware, configuración técnica y mantenimiento continuo.

Las prácticas de seguridad siguen siendo fundamentales, tanto si utiliza IA local como en la nube. La estrategia más eficaz suele consistir en un enfoque híbrido: utilizar la IA local para las operaciones más sensibles y, al mismo tiempo, aprovechar soluciones gestionadas y seguras para la productividad diaria.

Es fundamental sopesar las ventajas y desventajas: para muchos equipos, la carga que supone una solución de bricolaje puede no ser la opción adecuada.

Para quienes buscan una productividad de IA potente sin la carga de la infraestructura, las soluciones gestionadas como ClickUp Brain ofrecen un término medio muy atractivo. Proporcionan seguridad de nivel empresarial sin ninguna complejidad de configuración.

Empieza a usar ClickUp gratis y explora flujos de trabajo seguros y contextuales impulsados por IA para tu equipo.

Preguntas frecuentes

¿Cuál es la diferencia entre la IA local y la IA basada en la nube para los flujos de trabajo del equipo?

La IA local se ejecuta íntegramente en su propio hardware, lo que garantiza que los datos nunca salgan de su red interna, mientras que la IA basada en la nube envía indicaciones a servidores de terceros para su procesamiento. Las configuraciones locales proporcionan soberanía total sobre los datos y acceso sin conexión, mientras que los servicios en la nube ofrecen mayor potencia computacional y facilidad de uso a costa del control directo de los datos.

¿Cómo pueden los equipos utilizar modelos de IA locales con datos confidenciales de proyectos?

Los equipos pueden utilizar la IA local para procesar documentos confidenciales, código propietario y registros financieros dirigiendo el modelo a directorios privados locales. Dado que la inferencia se realiza en el dispositivo, puede llevar a cabo tareas como el resumen automatizado, la extracción de datos y las búsquedas de conocimiento interno sin correr el riesgo de exposición a conjuntos de entrenamiento de LLM públicos.

¿Son los modelos de IA locales tan eficaces como ChatGPT para las tareas de trabajo?

Muchos modelos locales de código abierto, como Llama 3 y Mistral, son ahora muy capaces de gestionar tareas rutinarias como la redacción, la programación y la resumición. Aunque los modelos en la nube de primer nivel, como GPT-4o, siguen liderando el razonamiento ultracomplejo, los modelos locales ofrecen un rendimiento comparable para el 90 % de las operaciones empresariales diarias con una privacidad significativamente mayor.

¿Cuáles son las ventajas y desventajas de ejecutar la IA localmente frente al uso de servicios de IA en la nube?

La principal disyuntiva es elegir entre la privacidad total de los datos con la IA local frente a la escalabilidad sin mantenimiento de la IA en la nube. Ejecutar la IA localmente requiere una inversión inicial en hardware y conocimientos técnicos, pero elimina las cuotas recurrentes de las API y los riesgos de fuga de datos. La IA en la nube es más rápida de implementar, pero conlleva costes de suscripción continuos y dependencias de datos de terceros.