Los modelos de lenguaje grandes (LLM) han abierto nuevas y emocionantes posibilidades para las aplicaciones de software. Permiten crear sistemas más inteligentes y dinámicos que nunca.

Los expertos predicen que, para 2025, las aplicaciones basadas en estos modelos podrían automatizar casi la mitad de todo el trabajo digital.

Sin embargo, a medida que desbloqueamos estas capacidades, surge un reto: ¿cómo medimos de forma fiable la calidad de sus resultados a gran escala? Un pequeño ajuste en los ajustes y, de repente, se obtienen resultados notablemente diferentes. Esta variabilidad puede dificultar la evaluación de su rendimiento, lo cual es crucial a la hora de preparar un modelo para su uso en el mundo real.

En este artículo se comparten ideas sobre las mejores buenas prácticas de evaluación de sistemas LLM, desde las pruebas previas a la implementación hasta la producción. ¡Empecemos!

¿Qué es una evaluación LLM?

Las métricas de evaluación de LLM son una forma de comprobar si sus indicaciones, los ajustes del modelo o el flujo de trabajo están alcanzando las metas que ha establecido. Estas métricas le proporcionan información sobre el rendimiento de su modelo de lenguaje grande y si realmente está listo para su uso en el mundo real.

Hoy en día, algunas de las métricas más comunes miden la recuperación de contexto en tareas de generación aumentada por recuperación (RAG), las coincidencias exactas para clasificaciones, la validación JSON para salidas estructuradas y la similitud semántica para tareas más creativas.

Cada una de estas métricas garantiza de forma única que el LLM cumple con los estándares para su caso de uso específico.

¿Por qué es necesario evaluar un LLM?

Los modelos de lenguaje grandes (LLM) se utilizan actualmente en un amplio intervalo de aplicaciones. Es esencial evaluar el rendimiento de los modelos para garantizar que cumplen con los estándares esperados y sirven eficazmente a los fines previstos.

Piénselo de esta manera: los LLM están impulsando todo, desde los chatbots de soporte al cliente hasta las herramientas creativas, y a medida que se vuelven más avanzados, aparecen en más lugares.

Esto significa que necesitamos mejores formas de supervisarlos y evaluarlos, ya que los métodos tradicionales no pueden seguir el ritmo de todas las tareas que gestionan estos modelos.

Las buenas métricas de evaluación son como un control de calidad para los LLM. Muestran si el modelo es lo suficientemente fiable, preciso y eficiente para su uso en el mundo real. Sin estos controles, podrían pasar desapercibidos algunos errores, lo que daría lugar a experiencias de usuario frustrantes o incluso engañosas.

Cuando se dispone de métricas de evaluación sólidas, es más fácil detectar problemas, mejorar el modelo y garantizar que esté listo para satisfacer las necesidades específicas de sus usuarios. De esta manera, sabrá que la plataforma de IA con la que trabaja cumple con los estándares y puede ofrecer los resultados que necesita.

📖 Más información: LLM frente a IA generativa: una guía detallada

Tipos de evaluaciones LLM

Las evaluaciones proporcionan una perspectiva única para examinar las capacidades del modelo. Cada tipo aborda diversos aspectos de calidad, lo que ayuda a crear un modelo de implementación fiable, seguro y eficiente.

Estos son los diferentes tipos de métodos de evaluación LLM:

- La evaluación intrínseca se centra en el rendimiento interno del modelo en tareas lingüísticas o de comprensión específicas sin involucrar aplicaciones del mundo real. Normalmente se lleva a cabo durante la fase de desarrollo del modelo para comprender sus capacidades básicas.

- La evaluación extrínseca evalúa el rendimiento del modelo en aplicaciones del mundo real. Este tipo de evaluación examina en qué medida el modelo cumple metas específicas dentro de un contexto.

- La evaluación de solidez comprueba la estabilidad y fiabilidad del modelo en diversos escenarios, incluyendo entradas inesperadas y condiciones adversas. Identifica posibles debilidades, garantizando que el modelo se comporte de forma predecible.

- Las pruebas de eficiencia y latencia examinan el uso de recursos, la velocidad y la latencia del modelo. Garantizan que el modelo pueda realizar tareas rápidamente y con un coste computacional razonable, lo cual es esencial para la escalabilidad.

- La evaluación ética y de seguridad garantiza que el modelo se ajusta a las normas éticas y las directrices de seguridad, lo cual es fundamental en aplicaciones sensibles.

Evaluaciones de modelos LLM frente a evaluaciones de sistemas LLM

La evaluación de los modelos de lenguaje grandes (LLM) implica dos enfoques principales: evaluaciones de modelos y evaluaciones de sistemas. Cada uno se centra en diferentes aspectos del rendimiento del LLM, y conocer la diferencia es esencial para maximizar el potencial de estos modelos.

🧠 Las evaluaciones de modelos analizan las habilidades generales del LLM. Este tipo de evaluación comprueba la capacidad del modelo para comprender, generar y trabajar con el lenguaje de forma precisa en diversos contextos. Es como ver lo bien que el modelo puede manejar diferentes tareas, casi como una prueba de inteligencia general.

Por ejemplo, las evaluaciones de modelos podrían preguntar: «¿Qué grado de versatilidad tiene este modelo?».

🎯 Las evaluaciones del sistema LLM miden el rendimiento del LLM dentro de una configuración o finalidad específicas, como en un chatbot de atención al cliente. En este caso, no se trata tanto de las capacidades generales del modelo como de su rendimiento en tareas específicas para mejorar la experiencia del usuario.

Sin embargo, las evaluaciones del sistema se centran en preguntas como: «¿Qué tan bien maneja el modelo esta tarea específica para los usuarios?».

Las evaluaciones de modelos ayudan a los desarrolladores a comprender las capacidades y limitaciones generales del LLM, lo que sirve de guía para las mejoras. Las evaluaciones del sistema se centran en cómo el LLM satisface las necesidades de los usuarios en contextos específicos, lo que garantiza una experiencia de usuario más fluida.

En conjunto, estas evaluaciones proporcionan una visión completa de los puntos fuertes y las áreas de mejora del LLM, lo que lo hace más potente y fácil de usar en aplicaciones reales.

Ahora, exploremos las métricas específicas para la evaluación LLM.

Métricas para la evaluación de LLM

Algunas métricas de evaluación fiables y actuales son:

1. Perplejidad

La perplejidad mide la capacidad de un modelo lingüístico para predecir una secuencia de palabras. Básicamente, indica la incertidumbre del modelo sobre la siguiente palabra de una frase. Una puntuación de perplejidad más baja significa que el modelo tiene más confianza en sus predicciones, lo que se traduce en un mejor rendimiento.

📌 Ejemplo: Imagine que un modelo genera texto a partir de la indicación «El gato se sentó en el...». Si predice una alta probabilidad para palabras como «alfombra» y «suelo», significa que entiende bien el contexto, lo que da como resultado una puntuación de perplejidad baja.

Por otro lado, si sugiere una palabra no relacionada, como «nave espacial», la puntuación de perplejidad sería más alta, lo que indicaría que el modelo tiene dificultades para predecir un texto sensato.

2. Puntuación BLEU

La puntuación BLEU (Bilingual Evaluation Understudy) se utiliza principalmente para evaluar la traducción automática y valorar la generación de texto.

Mide cuántos n-gramas (secuencias contiguas de n elementos de una muestra de texto determinada) de la salida se superponen con los de uno o más textos de referencia. El intervalo de puntuación va de 0 a 1, y las puntuaciones más altas indican un mejor rendimiento.

📌 Ejemplo: si su modelo genera la frase «El rápido zorro marrón salta sobre el perro perezoso» y el texto de referencia es «Un rápido zorro marrón salta sobre un perro perezoso», BLEU comparará los n-gramas compartidos.

Una puntuación alta indica que la frase generada se ajusta mucho a la referencia, mientras que una puntuación más baja podría sugerir que el resultado generado no se ajusta bien.

3. Puntuación F1

La métrica de evaluación LLM de la puntuación F1 se utiliza principalmente para tareas de clasificación. Mide el equilibrio entre la precisión (la exactitud de las predicciones positivas) y la recuperación (la capacidad de identificar todas las instancias relevantes).

El intervalo de puntuación va de 0 a 1, donde 1 indica una precisión perfecta.

📌 Ejemplo: En una tarea de preguntas y respuestas, si se le pregunta al modelo «¿De qué color es el cielo?» y responde «El cielo es azul» (verdadero positivo), pero también incluye «El cielo es verde» (falso positivo), la puntuación F1 tendrá en cuenta tanto la relevancia de la respuesta correcta como la de la incorrecta.

Esta métrica ayuda a garantizar una evaluación equilibrada del rendimiento del modelo.

4. METEOR

METEOR (métrica para la evaluación de la traducción con orden explícito) va más allá de la coincidencia exacta de palabras. Tiene en cuenta sinónimos, derivaciones y paráfrasis para evaluar la similitud entre el texto generado y el texto de referencia. Esta métrica tiene como objetivo alinearse más estrechamente con el juicio humano.

📌 Ejemplo: si su modelo genera «El felino descansaba sobre la alfombra» y la referencia es «El gato yacía sobre la moqueta», METEOR le daría una puntuación más alta que BLEU, ya que reconoce que «felino» es sinónimo de «gato» y que «alfombra» y «moqueta» transmiten significados similares.

Esto hace que METEOR sea especialmente útil para captar los matices del lenguaje.

5. BERTScore

BERTScore evalúa la similitud del texto basándose en incrustaciones contextuales derivadas de modelos como BERT (Bidirectional Encoder Representations from Transformers). Se centra más en el significado que en la coincidencia exacta de palabras, lo que permite una mejor evaluación de la similitud semántica.

📌 Ejemplo: al comparar las frases «El coche corría por la carretera» y «El vehículo circulaba a toda velocidad por la calle», BERTScore analiza los significados subyacentes en lugar de limitarse a la elección de las palabras.

Aunque las palabras difieren, las ideas generales son similares, lo que da lugar a una puntuación BERTScore alta que refleja la eficacia del contenido generado.

6. Evaluación humana

La evaluación humana sigue siendo un aspecto crucial de la valoración del LLM. Implica que jueces humanos realicen la valoración de la calidad de los resultados del modelo basándose en diversos criterios, como la fluidez y la relevancia. Se pueden emplear técnicas como las escalas de Likert y las pruebas A/B para recabar opiniones.

📌 Ejemplo: después de generar respuestas desde un chatbot de atención al cliente, los evaluadores humanos pueden realizar una valoración de cada respuesta en una escala del 1 al 5. Por ejemplo, si el chatbot proporciona una respuesta clara y útil a la consulta de un cliente, podría recibir un 5, mientras que una respuesta vaga o confusa podría recibir un 2.

7. Métricas específicas para cada tarea

Las diferentes tareas de LLM requieren métricas de evaluación personalizadas.

En el caso de los sistemas de diálogo, las métricas pueden evaluar la participación de los usuarios o las tasas de finalización de tareas. En cuanto a la generación de código, el éxito podría medirse por la frecuencia con la que el código generado se compila o supera las pruebas.

📌 Ejemplo: en un chatbot de soporte al cliente, los niveles de interacción pueden medirse por el tiempo que los usuarios permanecen en una conversación o por el número de preguntas de seguimiento que formulan.

Si los usuarios solicitan información adicional con frecuencia, esto indica que el modelo está logrando captar su atención y respondiendo eficazmente a sus consultas.

8. Solidez y equidad

Evaluar la solidez de un modelo implica comprobar cómo responde ante entradas inesperadas o inusuales. Las métricas de equidad ayudan a identificar sesgos en los resultados del modelo, lo que garantiza que funcione de manera equitativa en diferentes grupos demográficos y escenarios.

📌 Ejemplo: al probar un modelo con una pregunta caprichosa como «¿Qué opinas de los unicornios?», este debería manejar la pregunta con elegancia y proporcionar una respuesta relevante. Si, por el contrario, da una respuesta sin sentido o inapropiada, esto indica una falta de solidez.

Las pruebas de imparcialidad garantizan que el modelo no genere resultados sesgados o perjudiciales, lo que promueve un sistema de IA más inclusivo.

📖 Más información: La diferencia entre el aprendizaje automático y la inteligencia artificial

9. Métricas de eficiencia

A medida que los modelos lingüísticos se vuelven más complejos, cada vez es más importante medir su eficiencia en cuanto a velocidad, uso de memoria y consumo de energía. Las métricas de eficiencia ayudan a evaluar cuántos recursos consume un modelo al generar respuestas.

📌 Ejemplo: en el caso de un modelo de lenguaje grande, medir la eficiencia puede implicar realizar un seguimiento de la rapidez con la que genera respuestas a las consultas de los usuarios y la cantidad de memoria que utiliza durante este proceso.

Si la respuesta tarda demasiado o consume recursos excesivos, podría ser un problema para aplicaciones que requieren un rendimiento en tiempo real, como los chatbots o los servicios de traducción.

Ahora ya sabe cómo evaluar un modelo LLM. Pero, ¿qué herramientas puede utilizar para medirlo? Vamos a explorarlo.

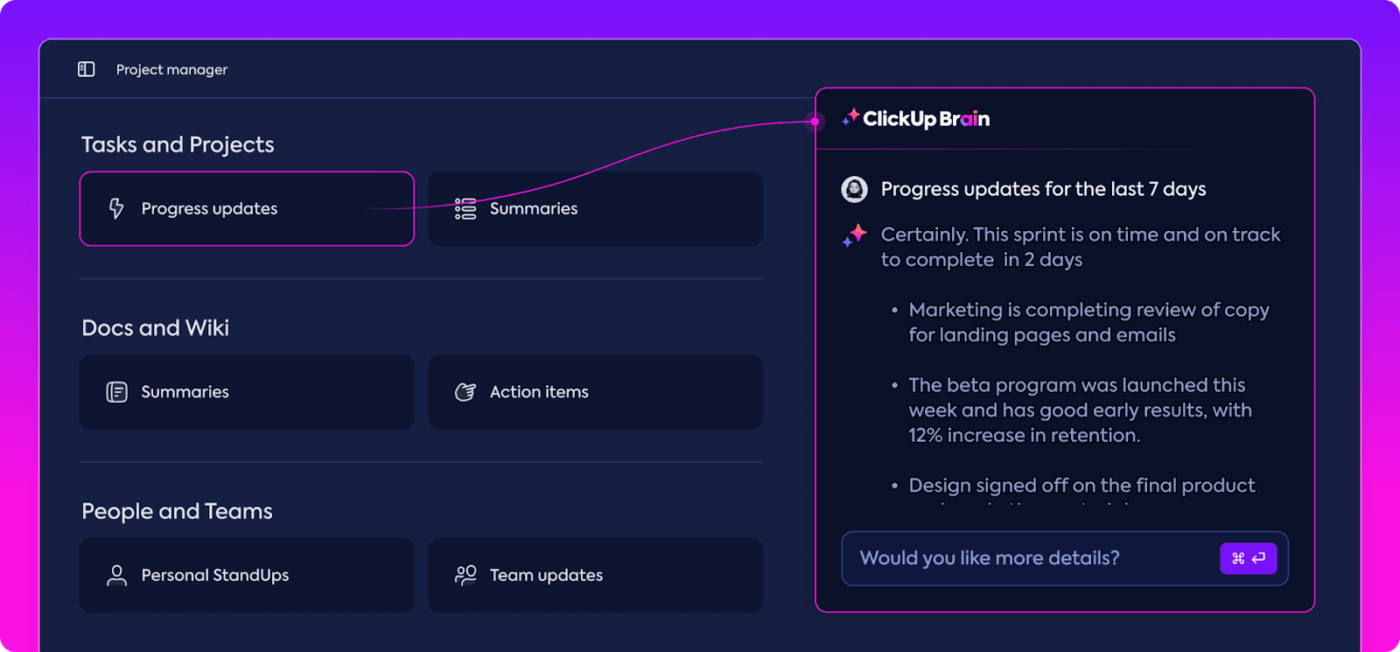

Cómo ClickUp Brain puede mejorar la evaluación LLM

ClickUp es una aplicación para todo lo relacionado con el trabajo que incluye un asistente personal integrado llamado ClickUp Brain.

ClickUp Brain es una herramienta revolucionaria para la evaluación del rendimiento de LLM. ¿Qué hace exactamente?

Organiza y destaca los datos más relevantes, manteniendo a su equipo bien encaminado. Con sus funciones basadas en IA, ClickUp Brain es uno de los mejores programas de redes neuronales que existen. Hace que todo el proceso sea más fluido, más eficiente y más colaborativo que nunca. Exploremos juntos sus capacidades.

Gestión inteligente del conocimiento

A la hora de evaluar modelos lingüísticos grandes (LLM), la gestión de grandes cantidades de datos puede resultar abrumadora.

ClickUp Brain puede organizar y destacar métricas y recursos esenciales diseñados específicamente para la evaluación de LLM. En lugar de rebuscar en hojas de cálculo dispersas e informes densos, ClickUp Brain lo reúne todo en un solo lugar. Las métricas de rendimiento, los datos de referencia y los resultados de las pruebas son accesibles desde una interfaz clara y fácil de usar.

Esta organización ayuda a su equipo a eliminar el ruido y centrarse en la información que realmente importa, lo que facilita la interpretación de las tendencias y los patrones de rendimiento.

Con todo lo que necesita en un solo lugar, puede pasar de la mera recopilación de datos a la toma de decisiones impactantes basadas en datos, transformando la sobrecarga de información en inteligencia útil.

Gestión de proyectos y gestión del flujo de trabajo

Las evaluaciones LLM requieren un plan minucioso y colaboración, y ClickUp facilita la gestión de este proceso.

Puede delegar fácilmente responsabilidades como la recopilación de datos, el entrenamiento de modelos y las pruebas de rendimiento, al tiempo que establece prioridades para asegurarse de que las tareas más críticas reciban atención primero. Además, los Campos personalizados le permiten adaptar los flujos de trabajo a las necesidades específicas de su proyecto.

Con ClickUp, todos pueden ver quién está haciendo qué y cuándo, lo que ayuda a evitar retrasos y garantiza que las tareas se desarrollen sin problemas en todo el equipo. Es una forma estupenda de mantener todo organizado y bajo control de principio a fin.

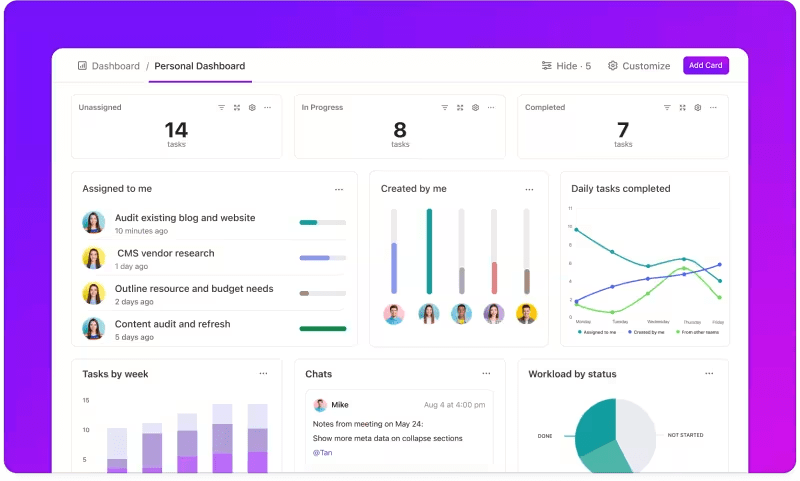

Seguimiento de métricas a través de paneles personalizados.

¿Quiere estar al tanto del rendimiento de sus sistemas LLM?

Los paneles de ClickUp visualizan los indicadores de rendimiento en tiempo real. Le permiten supervisar el progreso de su modelo al instante. Estos paneles son altamente personalizables, lo que le permite crear gráficos y tablas que presentan exactamente lo que necesita cuando lo necesita.

Puede observar cómo evoluciona la precisión de su modelo a lo largo de las fases de evaluación o desglosar el consumo de recursos en cada fase. Esta información le permite detectar tendencias rápidamente, identificar áreas de mejora y realizar ajustes sobre la marcha.

En lugar de esperar al próximo informe detallado, los paneles de ClickUp le permiten mantenerse informado y receptivo, lo que permite a su equipo tomar decisiones basadas en datos sin demora.

Información automatizada

El análisis de datos puede llevar mucho tiempo, pero las funciones de ClickUp Brain aligeran la carga al proporcionar información valiosa. Destaca tendencias importantes e incluso sugiere recomendaciones basadas en los datos, lo que facilita la obtención de conclusiones significativas.

Con los conocimientos automatizados de ClickUp Brain, no es necesario examinar manualmente los datos sin procesar en busca de patrones, ya que ellos los detectan por usted. Esta automatización libera a su equipo para que se centre en perfeccionar el rendimiento del modelo en lugar de atascarse en análisis de datos repetitivos.

La información generada está lista para usar, lo que permite a su equipo ver inmediatamente qué funciona y dónde pueden ser necesarios cambios. Al reducir el tiempo dedicado al análisis, ClickUp ayuda a su equipo a acelerar el proceso de evaluación y centrarse en la implementación.

Documentación y colaboración

Ya no tendrá que buscar en correos electrónicos o múltiples plataformas para encontrar lo que necesita; todo está ahí, listo para cuando usted lo necesite.

ClickUp Docs es un hub neurálgico que reúne todo lo que su equipo necesita para una evaluación LLM fluida. Organiza la documentación clave del proyecto, como los criterios de referencia, los resultados de las pruebas y los registros de rendimiento, en un único lugar accesible para que todos puedan acceder rápidamente a la información más reciente.

Lo que realmente distingue a ClickUp Docs son sus funciones de colaboración en tiempo real. El chat y los comentarios integrados de ClickUp permiten a los miembros del equipo debatir ideas, dar su opinión y sugerir cambios directamente en los documentos.

Esto significa que su equipo puede debatir los resultados y realizar ajustes directamente en la plataforma, manteniendo todas las discusiones relevantes y centradas.

Todo, desde la documentación hasta el trabajo en equipo, se realiza dentro de ClickUp Docs, lo que crea un proceso de evaluación optimizado en el que todos pueden ver, realizar el uso compartido y actuar sobre las últimas novedades.

¿El resultado? Un flujo de trabajo fluido y unificado que permite a su equipo avanzar hacia sus metas con total claridad.

¿Está listo para probar ClickUp? Antes de eso, veamos algunos consejos y trucos para sacar el máximo partido a su evaluación LLM.

Buenas prácticas en la evaluación de LLM

Un enfoque bien estructurado de la evaluación de LLM garantiza que el modelo satisfaga sus necesidades, se ajuste a las expectativas de los usuarios y ofrezca resultados significativos.

Establecer objetivos claros, tener en cuenta a los usuarios finales y utilizar diversas métricas ayuda a configurar una evaluación exhaustiva que revela los puntos fuertes y las áreas de mejora. A continuación se indican algunas buenas prácticas para guiar su proceso.

🎯 Defina objetivos claros

Antes de iniciar el proceso de evaluación, es fundamental saber exactamente qué quiere conseguir con su modelo de lenguaje grande (LLM). Tómese su tiempo para definir las tareas o las metas específicas del modelo.

📌 Ejemplo: si desea mejorar el rendimiento de la traducción automática, aclare los niveles de calidad que desea alcanzar. Tener objetivos claros le ayuda a centrarse en las métricas más relevantes, lo que garantiza que su evaluación se mantenga alineada con estas metas y mida con precisión el éxito.

👥 Ten en cuenta a tu público

Piense en quién utilizará el LLM y cuáles son sus necesidades. Es fundamental adaptar la evaluación a los usuarios previstos.

📌 Ejemplo: Si su modelo está destinado a generar contenido atractivo, le interesará prestar mucha atención a métricas como la fluidez y la coherencia. Comprender a su público le ayudará a refinar sus criterios de evaluación, asegurándose de que el modelo ofrece un valor real en aplicaciones prácticas.

📊 Utilice diversas métricas

No se base en una sola métrica para evaluar su LLM; una combinación de métricas le proporcionará una visión más completa de su rendimiento. Cada métrica captura diferentes aspectos, por lo que utilizar varias puede ayudarle a identificar tanto los puntos fuertes como los débiles.

📌 Ejemplo: Aunque las puntuaciones BLEU son excelentes para medir la calidad de la traducción, es posible que no cubran todos los matices de la escritura creativa. La incorporación de métricas como la perplejidad para la precisión predictiva e incluso las evaluaciones humanas para el contexto puede conducir a una comprensión mucho más completa del rendimiento de su modelo.

Puntos de referencia y herramientas de LLM

La evaluación de los modelos de lenguaje grandes (LLM) suele basarse en puntos de referencia estándar del sector y herramientas especializadas que ayudan a medir el rendimiento del modelo en diversas tareas.

A continuación, se detallan algunos puntos de referencia y herramientas ampliamente utilizados que aportan estructura y claridad al proceso de evaluación.

Puntos de referencia clave

- GLUE (Evaluación de comprensión general del lenguaje): GLUE evalúa las capacidades del modelo en múltiples tareas lingüísticas, incluyendo la clasificación de oraciones, la similitud y la inferencia. Es un punto de referencia imprescindible para los modelos que necesitan manejar la comprensión del lenguaje de uso general.

- SQuAD (Stanford Question Answering Dataset): El marco de evaluación SQuAD es ideal para la comprensión lectora y mide la capacidad de un modelo para responder preguntas basadas en un fragmento de texto. Se utiliza habitualmente para tareas como el soporte al cliente y la recuperación basada en el conocimiento, en las que es fundamental dar respuestas precisas.

- SuperGLUE: como versión mejorada de GLUE, SuperGLUE evalúa los modelos en tareas más complejas de razonamiento y comprensión contextual. Proporciona información más detallada, especialmente para aplicaciones que requieren una comprensión avanzada del lenguaje.

Herramientas de evaluación esenciales

- Hugging Face : Es muy popular por su amplia biblioteca de modelos, conjuntos de datos y funciones de evaluación. Su interfaz altamente intuitiva permite a los usuarios realizar fácilmente selecciones de puntos de referencia, personalizar evaluaciones y realizar el seguimiento del rendimiento de los modelos, lo que la hace muy versátil para muchas aplicaciones LLM.

- SuperAnnotate: Se especializa en la gestión y anotación de datos, lo cual es crucial para las tareas de aprendizaje supervisado. Es especialmente útil para refinar la precisión de los modelos, ya que facilita datos de alta calidad anotados por humanos que mejoran el rendimiento de los modelos en tareas complejas.

- AllenNLP: Desarrollado por el Allen Institute for IA, AllenNLP está dirigido a investigadores y desarrolladores que trabajan en modelos NLP personalizados. Tiene compatibilidad con una amplia gama de puntos de referencia y proporciona herramientas para entrenar, probar y evaluar modelos de lenguaje, lo que ofrece flexibilidad para diversas aplicaciones NLP.

El uso combinado de estos puntos de referencia y herramientas ofrece un enfoque integral para la evaluación de LLM. Los puntos de referencia pueden establecer estándares para todas las tareas, mientras que las herramientas proporcionan la estructura y la flexibilidad necesarias para realizar el seguimiento, perfeccionar y mejorar el rendimiento del modelo de manera eficaz.

Juntos, garantizan que los LLM cumplan tanto con los estándares técnicos como con las necesidades prácticas de aplicación.

Retos de la evaluación del modelo LLM

La evaluación de los modelos de lenguaje grandes (LLM) requiere un enfoque matizado. Se centra en la calidad de las respuestas y en comprender la adaptabilidad y los límites del modelo en diversos escenarios.

Dado que estos modelos se entrenan con conjuntos de datos extensos, su comportamiento se ve influido por una serie de factores, por lo que es esencial evaluar más que solo la precisión.

Una evaluación verdadera implica examinar la fiabilidad del modelo, su resistencia a indicaciones inusuales y la coherencia general de sus respuestas. Este proceso ayuda a obtener una imagen más clara de los puntos fuertes y débiles del modelo, y revela las áreas que necesitan mejoras.

A continuación, analizamos más detenidamente algunos de los retos más comunes que surgen durante la evaluación de LLM.

1. Superposición de datos de entrenamiento

Es difícil saber si el modelo ya ha «visto» algunos de los datos de prueba. Dado que los LLM se entrenan con conjuntos de datos masivos, existe la posibilidad de que algunas preguntas de prueba se superpongan con ejemplos de entrenamiento. Esto puede hacer que el modelo parezca mejor de lo que realmente es, ya que podría estar repitiendo lo que ya sabe en lugar de demostrar una comprensión real.

2. Rendimiento inconsistente

Los LLM pueden tener respuestas impredecibles. En un momento dado, ofrecen ideas impresionantes y, al siguiente, cometen errores extraños o presentan información imaginaria como si fuera real (lo que se conoce como «alucinaciones»).

Esta inconsistencia significa que, aunque los resultados del LLM pueden destacar en algunas áreas, pueden quedarse cortos en otras, lo que dificulta juzgar con precisión su fiabilidad y calidad generales.

3. Vulnerabilidades adversas

Los LLM pueden ser susceptibles a ataques adversarios, en los que indicaciones ingeniosamente elaboradas los engañan para que produzcan respuestas erróneas o perjudiciales. Esta vulnerabilidad expone las debilidades del modelo y puede dar lugar a resultados inesperados o sesgados. Las pruebas de estas debilidades adversarias son cruciales para comprender dónde están los límites del modelo.

Casos prácticos de evaluación de LLM

Por último, aquí tienes algunas situaciones habituales en las que la evaluación LLM realmente marca la diferencia:

Chatbots de soporte al cliente

Los LLM se utilizan ampliamente en los chatbots para gestionar las consultas de los clientes. Evaluar la calidad de las respuestas del modelo garantiza que este ofrezca respuestas precisas, útiles y contextualmente relevantes.

Es fundamental medir su capacidad para comprender la intención del cliente, gestionar preguntas diversas y proporcionar respuestas similares a las de un humano. Esto permitirá a las empresas garantizar una experiencia fluida al cliente y minimizar la frustración.

Generación de contenido

Muchas empresas utilizan LLM para generar contenido para blogs, redes sociales y descripciones de productos. Evaluar la calidad del contenido generado ayuda a garantizar que sea gramaticalmente correcto, atractivo y relevante para el público objetivo. Métricas como la creatividad, la coherencia y la relevancia con respecto al tema son importantes para mantener unos altos estándares de contenido.

Análisis de opiniones

Los LLM pueden analizar el sentimiento de los comentarios de los clientes, las publicaciones en redes sociales o las reseñas de productos. Es esencial evaluar la precisión con la que el modelo identifica si un texto es positivo, negativo o neutro. Esto ayuda a las empresas a comprender las emociones de los clientes, perfeccionar los productos o servicios, mejorar la satisfacción de los usuarios y optimizar las estrategias de marketing.

Generación de código

Los desarrolladores suelen utilizar los LLM como ayuda para generar código. Es fundamental evaluar la capacidad del modelo para producir código funcional y eficiente.

Es importante comprobar si el código generado es lógico, no contiene errores y cumple con los requisitos de la tarea. Esto ayuda a reducir la cantidad de codificación manual necesaria y mejora la productividad.

Optimice su evaluación LLM con ClickUp.

Evaluar los LLM consiste en elegir las métricas adecuadas que se ajusten a sus metas. La clave es comprender sus metas específicas, ya sea mejorar la calidad de la traducción, mejorar la generación de contenido o ajustar tareas especializadas.

Seleccionar las métricas adecuadas para la evaluación del rendimiento, como RAG o métricas de ajuste fino, constituye la base de una evaluación precisa y significativa. Por su parte, los evaluadores avanzados como G-Eval, Prometheus, SelfCheckGPT y QAG proporcionan información precisa gracias a su gran capacidad de razonamiento.

Sin embargo, eso no significa que estas puntuaciones sean perfectas, sigue siendo importante asegurarse de que sean fiables.

A medida que avanza en la evaluación de su aplicación LLM, adapte el proceso a su caso de uso específico. No existe una métrica universal que funcione para todos los escenarios. Una combinación de métricas, junto con un enfoque en el contexto, le dará una imagen más precisa del rendimiento de su modelo.

Para optimizar su evaluación LLM y mejorar la colaboración en equipo, ClickUp es la solución ideal para gestionar flujos de trabajo y realizar el seguimiento de métricas importantes.

¿Quiere mejorar la productividad de su equipo? ¡Regístrese hoy mismo en ClickUp y descubra cómo puede transformar su flujo de trabajo!