OpenAI, der Vorreiter im Bereich der KI-Innovation, hat kontinuierlich Tools entwickelt, die die Interaktion zwischen Mensch und Computer revolutionieren.

ChatGPT Voice Mode und Whisper /AI stammen vom selben Unternehmen, gehen jedoch die Sprachverarbeitung aus unterschiedlichen Blickwinkeln an.

Während ersteres Echtzeit-Unterhaltungen ermöglicht, handelt es sich bei letzterem um ein automatisches Spracherkennungsmodell, das Audio in Text umwandelt.

In diesem Leitfaden ChatGPT Voice vs. Whisper KI werden wir die unterschiedlichen Fähigkeiten der beiden Technologien aufschlüsseln und untersuchen, wie sie sich in moderne sprachgesteuerte Workflows einfügen.

Als Bonus empfehlen wir ein weiteres tool, das bei uns sehr bevorzugt wird und Transkriptionen in Aktionen umwandelt.

Was ist der ChatGPT-Sprachmodus?

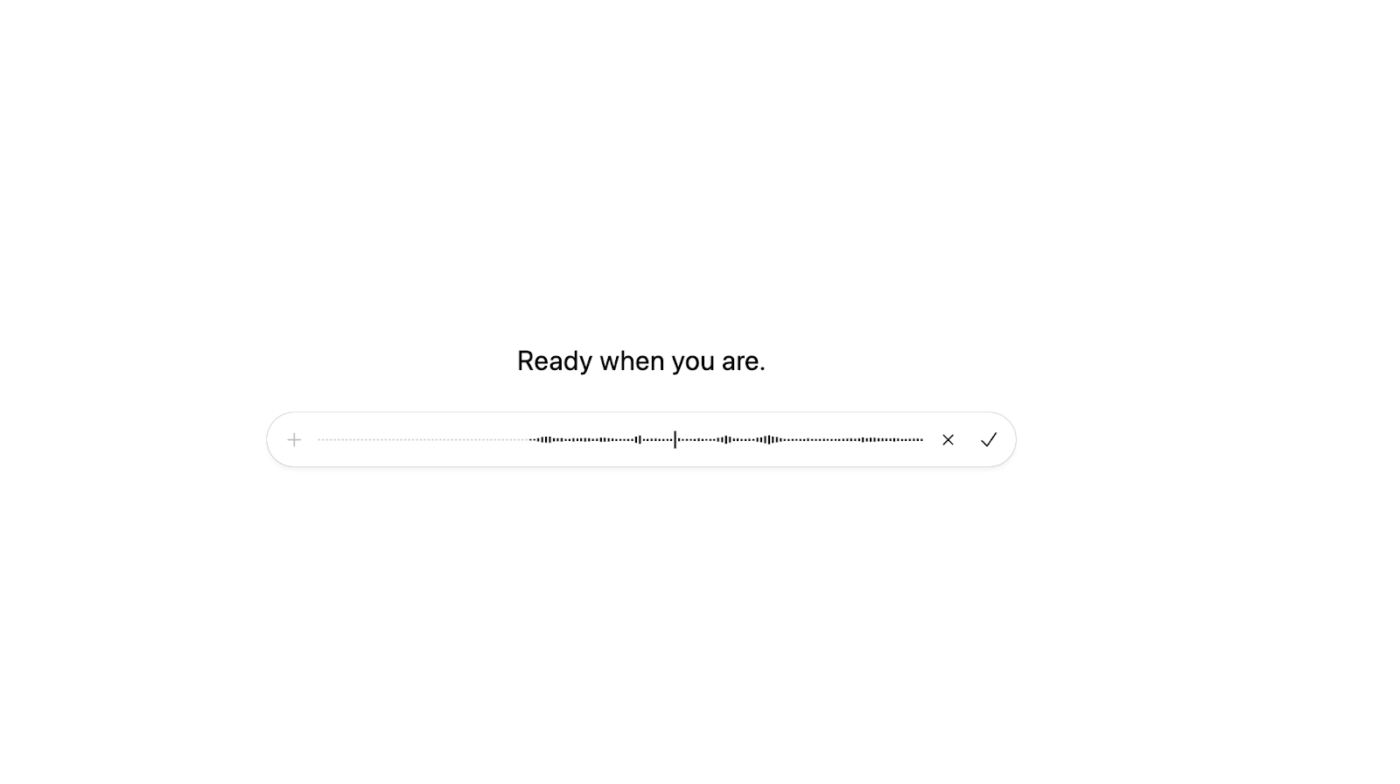

Der ChatGPT Voice Mode ist ein ChatGPT-Feature, mit dem Sie in Echtzeit gesprochene Unterhaltungen mit einem KI-Chatbot führen können. Dank der freihändigen Interaktion können Sie Voice-Unterhaltungen im Hintergrund fortsetzen, während Sie andere Apps verwenden oder sogar wenn Ihr Telefonbildschirm gesperrt ist.

Verwenden Sie es, um schnelle Antworten auf Ihre Fragen zu erhalten, Ideen zu sammeln oder einfach mehr über ein Thema zu erfahren – durch natürliche Unterhaltungen.

Voice unterstützt über zwei Dutzend Sprachen und bietet neun verschiedene Ausgabestimmen.

Features des ChatGPT Voice-Modus

Der Sprachmodus weicht von herkömmlichen Text-to-Speech-Chatbots ab und ermöglicht dialogorientierte Unterhaltungen und emotional sensible Interaktionen. Hier sind einige der Features, die ihn auszeichnen.

Feature Nr. 1: Umgang mit Unterbrechungen

Der erweiterte Sprachmodus in ChatGPT kann während einer Unterhaltung angepasst werden, wenn Sie die Antwort unterbrechen. Dadurch ist es viel einfacher, neue Details hinzuzufügen oder eine Folgefrage zu stellen, ohne warten zu müssen.

Anstatt voreilig zu antworten, können Sie dank der Sprachfunktion auch längere Pausen einlegen, um Ihre Gedanken zu ordnen.

💡 Profi-Tipp: Befolgen Sie bei der Verwendung von Sprachtechnologie immer die 3-Sekunden-Regel. Wenn Sie nach einer komplexen Frage 2–3 Sekunden pausieren, hat die AI Zeit, den Kontext zu verarbeiten und durchdachtere Antworten zu liefern.

Feature Nr. 2: Beibehaltung des Kontexts

Die Kontextbeibehaltung von ChatGPT funktioniert sowohl bei Sprach- als auch bei Textinteraktionen. Wenn Sie innerhalb desselben Threads zwischen Text und Sprache wechseln, müssen Sie keine Details erneut eingeben; das Programm erkennt Nuancen und weiß, worauf Sie sich beziehen.

Im Gegensatz zu Tools wie Siri und Alexa, die über kleinere Speicherfenster verfügen, behält der ChatGPT Voice Mode den Kontext während Ihrer gesamten Sitzung bei (selbst wenn diese mehrere Stunden dauert).

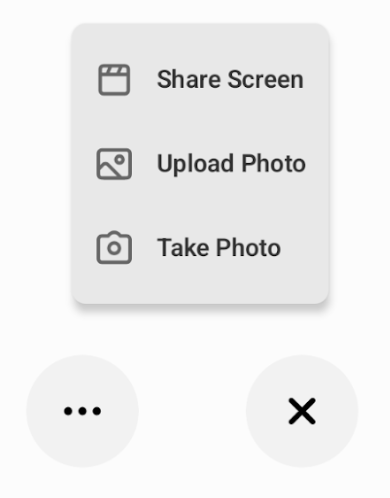

Feature Nr. 3: Visuelle Interaktionsmöglichkeiten

In den mobilen Apps von ChatGPT können Sie Sprachbefehle mit visuellen Inhalten kombinieren. Mit dieser erweiterten Einstellung können Sie Ihren Bildschirm freigeben, Videos hochladen oder Ihre Kamera direkt auf Objekte richten. Diese Kombination aus Bild und Sprache eröffnet praktische Szenarien zur Problemlösung.

Zum Beispiel:

- Teilen Sie eine Tabelle über die Bildschirmfreigabe und bitten Sie ChatGPT, Sie durch Fehler bei Formeln zu führen.

- Laden Sie einen PDF-Vertrag hoch und besprechen Sie bestimmte Klauseln per Sprachinteraktion.

- Richten Sie Ihre Kamera auf ein defektes Gerät und beschreiben Sie das Problem mündlich (in mehreren Sprachen), um eine Anleitung zur Fehlerbehebung zu erhalten.

👀 Wussten Sie schon? LLMs bieten zunehmend umfangreiche Kontextfenster. Claude bietet ~200.000 Tokens, GPT-4-Turbo bis zu 128.000 und Gemini ~2 Millionen Tokens.

Preise für den ChatGPT Voice Mode

- Free

- Plus: 20 $/Monat

- Pro: 200 $/Monat

- Geschäft: 30 $/Monat pro Benutzer

- Unternehmen: Benutzerdefinierte Preisgestaltung

(Es ist in den verschiedenen ChatGPT-Plänen enthalten und wird nicht separat berechnet)

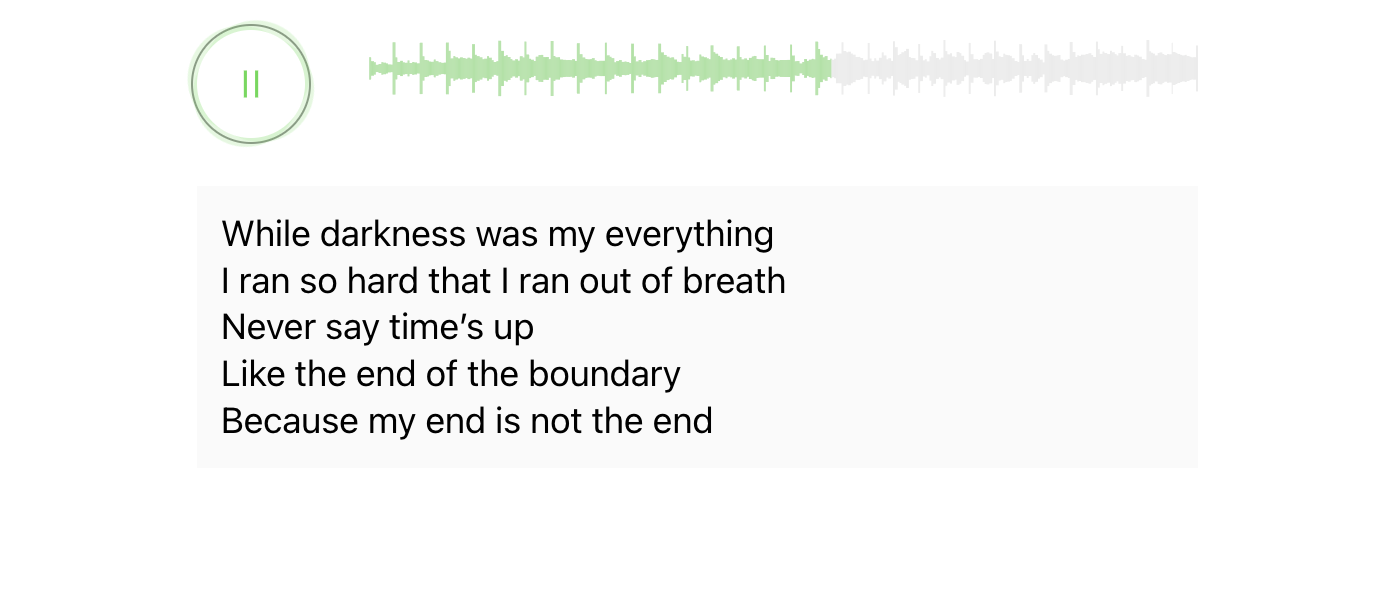

Was ist WhisperAI?

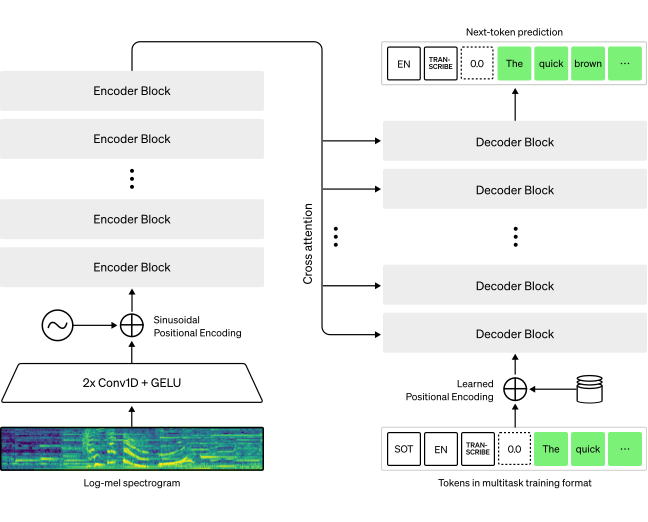

Whisper ist ein automatisches Spracherkennungssystem (ASR), das gesprochene Audio- oder aufgezeichnete Dateien in geschriebenen Text umwandelt. Dieses Open-Source-Modell wurde mit 680.000 Stunden mehrsprachiger und multitaskingfähiger überwachter Daten trainiert und konzentriert sich ausschließlich auf die Transkriptionsgenauigkeit.

Da ein Drittel der Vorab-Trainingsdaten mehrsprachig ist, kann Whisper über 99 Sprachen mit bemerkenswerter Präzision erkennen und transkribieren. Das System zeigt selbst bei schlechter Audioqualität mit mehreren Sprechern und Hintergrundgeräuschen eine robuste Leistung.

Whisper-Features

Hier sind die wichtigsten Features von Whisper, die es zu einer herausragenden Technologie für die Transkription von Sprache in Text machen.

Feature Nr. 1: Open Source

Whisper ist eine Open-Source-Software zur Transkription von Sprache in Text, für die keine Lizenzgebühren anfallen. Da es sich um Open Source handelt, können Sie auf den vollständigen Code zugreifen und ihn entsprechend Ihren spezifischen Anforderungen für den Einsatz anpassen.

Das Tool bietet außerdem eine umfassende Dokumentation. Entwickler können untersuchen, wie das Modell Audio verarbeitet, seine Entscheidungslogik verstehen und Probleme direkt im Code beheben.

❗Achtung: Es gibt Berichte, dass Whisper medizinische Bedingungen oder Behandlungen, falsche Nebenwirkungen, rassistische oder demografische Aussagen, manchmal gewalttätige Inhalte und sogar zufällige Phrasen wie „Danke fürs Zuschauen!“ erfindet, um Stille in der Eingabe zu füllen.

Feature Nr. 2: Lokales Hosting

Whisper kann lokal und in der Cloud eingesetzt werden, sodass Benutzer Audiodateien ohne Internetverbindung transkribieren können. Dies ist nützlich für Unternehmen, die vollständigen Datenschutz und die Einhaltung der DSGVO benötigen.

Die lokale Bereitstellung von Whisper erfordert jedoch erhebliche Rechenressourcen, insbesondere eine leistungsstarke GPU für optimale Verarbeitungsgeschwindigkeiten.

⚡ Vorlagenarchiv: Lassen Sie Ihre Transkriptionen nicht digital verstauben. Verwenden Sie vorgefertigte Vorlagen für Notizen zu Meetings, die Ihre transkribierten Unterhaltungen automatisch in strukturierte, umsetzbare Formate umwandeln, die Ihr Team sofort verwenden kann.

Feature Nr. 3: Feinabstimmung von Whisper

Mit Whisper können Sie das Sprach-zu-Text-Modell für bestimmte Anwendungsfälle und Datensätze trainieren. Dies ist jedoch ein ressourcenintensiver Prozess. Um das Modell benutzerdefiniert anzupassen, müssen Sie einen Datensatz mit Sounds zum Trainieren sowie eine Erklärung vorbereiten.

Das Feinabstimmungs-Feature ist hilfreich für Branchen, die produktspezifisches Vokabular erfordern, wie z. B. Transkriptionen für den medizinischen Bereich, juristische Dokumente oder Anrufe im Kundensupport.

🧠 Wissenswertes: Whisper wurde mit 680.000 Stunden Audiodaten trainiert, was 77 Jahren ununterbrochenem Hören entspricht. Von Podcasts über Vorträge und Unterhaltungen bis hin zu Interviews – Whisper wurde mit vielfältigen, mehrsprachigen Audiodaten aus dem Internet trainiert.

Preise für Whisper

Mit Whisper können Sie multimodale Erlebnisse mit geringer Latenz erstellen. Der Preis für 1 Million API-Token umfasst:

- GPT-4o: 40,00 $ für Token, 2,50 $ für zwischengespeicherte Token und 80,00 $ für Ausgabetoken

- GPT-4o mini: 10 $ für Token, 0,30 $ für zwischengespeicherte Token und 20 $ für Ausgabetoken

📮 ClickUp Insight: Nur 10 % unserer Umfrageteilnehmer verwenden Sprachassistenten (4 %) oder automatisierte Agenten (6 %) für KI-Anwendungen, während 62 % dialogorientierte KI-Tools wie ChatGPT und Claude bevorzugen.

Die geringere Akzeptanz von Assistenten und Agenten könnte daran liegen, dass diese Tools oft für bestimmte Aufgaben optimiert sind, wie z. B. die freihändige Bedienung oder bestimmte Workflows.

ClickUp bietet Ihnen das Beste aus beiden Welten. ClickUp Brain ist ein dialogorientierter KI-Assistent, der Ihnen in einem breiten Bereich von Anwendungsfällen helfen kann. Andererseits können KI-gestützte Agenten innerhalb der ClickUp-Chat-Kanäle Fragen beantworten, Probleme triagieren oder sogar bestimmte Aufgaben übernehmen!

📚 Weiterlesen: Die besten Alternativen zu Wispr Flow

ChatGPT Voice Mode vs. WhisperAI: Vergleich der Features

Der ChatGPT Voice-Modus ermöglicht natürliche Interaktionen durch gesprochene Unterhaltungen. Whisper hingegen ist ein reines Sprach-zu-Text-Transkriptionssystem, das Audio in geschriebenen Text umwandelt.

Während das eine für Unterhaltungen bekannt ist, führt das andere Transkriptionen in mehreren Sprachen durch.

Hier ein kurzer Überblick über die wichtigsten Unterschiede zwischen den beiden:

| Features | ChatGPT Voice Mode | Whisper KI |

| Interaktionsmodell | Zweiwege-Unterhaltung mit Sprachantworten | Einseitige Spracherkennung für die Textkonvertierung |

| Sprachunterstützung | Unterstützt über 30 Sprachen mit nativer Sprachsynthese | Erkennt und transkribiert über 99 Sprachen präzise. |

| Antworttyp | Erzeugt Sprachantworten und Protokolle der Unterhaltungen | Erzeugt nur schriftliche Texte |

| Ressourcenintensität | Cloud-basierte Verarbeitung mit minimalen lokalen Anforderungen | Erfordert eine leistungsstarke GPU für eine optimale lokale Verarbeitung. |

| Training | Vortrainiertes Modell für Unterhaltungen, nicht anpassbar | Feinabstimmbares Modell für domänenspezifische Terminologie |

| Umgang mit Hintergrundgeräuschen | Gute Leistung in Umgebungen der Unterhaltung | Selbst bei schlechter Audioqualität genau |

| Komplexität der Integration | Einfache API-Integration mit nutzungsabhängiger Preisgestaltung | Die Integration von Whisper KI erfordert ein komplexes Setup für die lokale Bereitstellung. |

| Support für mehrere Sprecher | Entwickelt für die Interaktion mit einem einzelnen Benutzer | Fortschrittliche Spracherkennungstechnologie, die mehrere Sprecher unterscheiden und transkribieren kann. |

| Setup | Plug-and-Play-Lösung; kann auch direkt in ChatGPT verwendet werden. | Erfordert manuelles Setup in der Cloud oder lokalen Anwendungen |

Feature Nr. 1: Spracherkennungsfunktion

Der ChatGPT Voice Mode verarbeitet Ihre Spracheingaben und antwortet mit einer Sprachausgabe. Er ist multimodal, versteht Ihre natürliche Sprache und kann Unterbrechungen verarbeiten und Hintergrundgeräusche ausblenden.

Sie erhalten auch die Aufzeichnung der Unterhaltung in Ihrem ChatGPT-Thread; die Genauigkeit dieser Aufzeichnung variiert jedoch.

Whisper hingegen hat die Funktion eines einseitigen Spracherkennungssystems. Es wandelt Audiodateien oder Live-Sprache in präzisen geschriebenen Text um.

🏆 Gewinner: ChatGPT Voice Mode zeichnet sich durch Echtzeit-Unterhaltungsfunktionen aus, während Whisper auf die reine Transkription beschränkt ist.

⚡ Vorlagenarchiv: Bei Unterhaltungen mit Sprache entstehen oft verstreute Aufgaben und Projektideen, die schnell in Vergessenheit geraten. Verwenden Sie Vorlagen für Aufgabenlisten, um diese mündlichen Vereinbarungen festzuhalten und sie in organisierte, nachverfolgbare Workflows mit klaren Prioritäten umzuwandeln.

Feature Nr. 2: Kontextuelles Verständnis

Der ChatGPT Voice Mode kann Unterhaltungen auf früheren Diskussionen innerhalb desselben Threads aufbauen. Er erkennt implizite Bedeutungen und versteht nuancierte Anfragen, indem er Informationen freigibt, die zuvor in der Unterhaltung geteilt wurden. Dieses Kontextbewusstsein sorgt für nahtlose Dialogerlebnisse.

Whisper hingegen fehlt das Verständnis für den Kontext von Unterhaltungen, da es nur als Transkriptionstool fungiert. Es verarbeitet jedes Audiosegment unabhängig, ohne sich an vorherige Interaktionen zu erinnern.

Es wandelt Sprache zwar präzise in Text um, interpretiert jedoch weder die Bedeutung noch die Beziehungen zwischen einzelnen Audiodateien oder Unterhaltungen.

🏆 Gewinner: ChatGPT Voice Mode überzeugt durch seine Fähigkeit, früheren Kontexten zu folgen und einen sinnvollen Dialog aufrechtzuerhalten.

Feature Nr. 3: Echtzeitverarbeitung

Der ChatGPT Voice-Modus zeichnet sich durch seine Echtzeit-Unterhaltung aus. Er verarbeitet Spracheingaben und generiert Sprachantworten mit minimaler Latenz.

Whisper kann jedoch vorab aufgezeichnete Dateien in der Stapelverarbeitung verarbeiten. Mit anderen Worten: Die Datei wird erst nach Abschluss der Aufnahme verarbeitet. Im Vergleich zu anderen Alternativen ist die Verarbeitungszeit von Whisper vergleichsweise langsamer. Dieser Kompromiss priorisiert die Transkriptionsgenauigkeit gegenüber der Geschwindigkeit.

🏆 Gewinner: Der ChatGPT Voice Mode eignet sich besser für Echtzeit-Interaktionen, während Whisper für die Dokumentation nach Meetings geeignet ist.

Feature Nr. 4: Spezifität der Anwendungsfälle

Der ChatGPT Voice-Modus eignet sich ideal für interaktive Aufgaben und Problemlösungsgespräche, bei denen Sie einen KI-Assistenten benötigen, der in Echtzeit denkt und reagiert. Er ist für diejenigen geeignet, die schnelle, aber zuverlässige Antworten auf Probleme suchen.

Whisper ist jedoch nützlich, wenn Sie schriftliche Aufzeichnungen aus Audioinhalten und diktierten Texten erstellen möchten. Es wird in erster Linie für die Transkription von Sprachmemos und die Bereitstellung von Barrierefreiheits-Features für Menschen mit Hörbeeinträchtigungen verwendet. Seine Stärke liegt in der Dokumentation und Archivierung.

🏆 Gewinner: Es gibt keinen eindeutigen Gewinner; es hängt von Ihrem Ziel ab. Wählen Sie den ChatGPT Voice-Modus für interaktive Dialoge und Whisper für Dokumentations- und Archivierungszwecke.

Feature Nr. 5: Preise

Der ChatGPT Voice-Modus ist in allen ChatGPT-Preisstufen verfügbar, allerdings haben Benutzer, die kostenlos nutzen, nur einen limitierten Zugriff. Er verfügt über eine offene API, die Entwickler in Anwendungen integrieren können, wobei die Preise über die OpenAI-Plattform nutzungsabhängig berechnet werden.

Whisper bietet über die API von OpenAI flexiblere Preise und ist mit 0,006 US-Dollar pro Audiominute eines der kostengünstigsten tools für Transkriptionsanforderungen. Für Unternehmen, die häufige Verarbeitungen benötigen, ist jedoch die Bereitstellung des lokalen Modells wirtschaftlicher.

🏆 Gewinner: Das hängt davon ab, wie Sie die Programme einsetzen möchten. Der ChatGPT Voice Mode eignet sich für die Unterhaltung auf Abruf, während Whisper kostengünstiger für groß angelegte Transkriptionspipelines ist.

🌟 Bonus: Während sich ChatGPT Voice Mode und Whisper auf Echtzeit-Unterhaltungen und Transkriptionen konzentrieren, bieten sie keine integrierte Workflow-Automatisierung.

Autopilot-Agenten (wie die in ClickUp) können vorgefertigt oder benutzerdefiniert angepasst werden, um basierend auf bestimmten Auslösern automatisch zu agieren, was weder ChatGPT Voice noch Whisper von Haus aus können.

Warum das wichtig ist:

- Von der Unterhaltung zur Aktion: Vorgefertigte Autopilot-Agenten scannen Chats, Aufgaben und Dokumente an ihrem Speicherort und erstellen oder weisen entsprechend Aufgaben zu. ChatGPT Voice kann Audioeingaben erfassen, generiert jedoch nicht automatisch Aufgaben und treibt die Arbeit nicht ohne spezifische Eingaben voran.

- Individuelle Logik für Ihr Geschäft: Sie können benutzerdefinierte Autopilot-Agenten erstellen, die genau Ihren Regeln folgen – beispielsweise das Taggen von Meeting-Zusammenfassungen, das Aktualisieren von CRM-Datensätzen oder das Auslösen von Folge-E-Mails. Whisper gibt lediglich Text aus, sodass Sie alle Folgearbeiten manuell zu erledigen haben.

ChatGPT Voice Mode vs. WhisperAI auf Reddit

Um die Debatte abzuschließen, haben wir sie auf Reddit gestellt. Hier sind einige Meinungen von Benutzern zu beiden tools.

Während der ChatGPT Voice Mode anfangs äußerst positive Resonanz fand, sind die Benutzer (im Großen und Ganzen) von den neuen Updates enttäuscht. Laut einem der Benutzer

Früher habe ich mich darauf gefreut, es (den ChatGPT Voice Mode) zu nutzen, um am Ende einer langen Arbeitswoche meine Woche Revue passieren zu lassen, mich intensiv mit einem technischen Thema zu beschäftigen oder einfach nur frei zu chatten. Die Unterhaltungen fühlten sich früher natürlich und angenehm an. Jetzt ist es nervtötend. Kurze Antworten, schroffe Antworten. Egal, worüber ich rede, es lenkt die Unterhaltung so, dass es nirgendwo hinführt. Die Unterhaltung verläuft einfach im Sande. Wie eine Person, die genervt von dir ist, etwas anderes zu erledigen hat und dich nur schnell beschwichtigen will, bevor sie gehen muss.

Früher habe ich mich darauf gefreut, es (den ChatGPT Voice Mode) zu nutzen, um am Ende einer langen Arbeitswoche meine Woche Revue passieren zu lassen, mich intensiv mit einem technischen Thema zu beschäftigen oder einfach nur frei zu chatten. Die Unterhaltungen fühlten sich früher natürlich und angenehm an. Jetzt ist es nervig wie sonst was. Kurze Antworten, schroff. Egal, worüber ich rede, es lenkt die Unterhaltung so, dass es nirgendwo hinführt. Die Unterhaltung verläuft einfach im Sande. Wie eine Person, die genervt von dir ist, etwas anderes zu erledigen hat und dich nur schnell beschwichtigen will, bevor sie gehen muss.

Ein anderer Benutzer gab eine ähnliche Meinung zum sich weiterentwickelnden Advanced Voice Mode frei. Laut dem Thread

Advanced Voice ist das einzige Sprachmodell, das mit der Zeit tatsächlich rückläufig ist. Wenn wir uns die ursprünglichen Demos ansehen, war es ein VOLLSTÄNDIG ausdrucksstarker Modus, extrem lebensecht. Nach dem letzten Update kann es insbesondere nicht mehr flüstern und keine Akzente mehr nachahmen. Es verfügt über einen einzigen, leicht gelangweilten Helpdesk-Modus für Unternehmen.

Advanced Voice ist das einzige Sprachmodell, das mit der Zeit tatsächlich Rückschritte macht. Wenn wir uns die ursprünglichen Demos ansehen, war es ein VOLLSTÄNDIG ausdrucksstarker Modus, extrem lebensecht. Nach dem letzten Update kann es insbesondere nicht mehr flüstern und keine Akzente mehr nachahmen. Es verfügt über einen einzigen, leicht gelangweilten Helpdesk-Modus für Unternehmen.

Whisper erfordert ein umfangreiches Setup, und selbst dann kommt es gelegentlich zu Störungen bei der Verarbeitung großer Dateien. Laut einem Benutzer

Ich benutze das große Modell von Whisper seit etwa anderthalb Jahren, und obwohl es fantastisch ist, wenn es funktioniert, kommt es immer noch zu Halluzinationen und es erholt sich erst wieder, wenn es neu geladen wird.

Ich verwende das große Modell von Whisper seit etwa anderthalb Jahren, und obwohl es fantastisch funktioniert, wenn es funktioniert, kommt es dennoch zu Halluzinationen, die erst nach einem Neustart behoben werden können.

Limitations of the individual tools

Weder ChatGPT Voice Mode noch Whisper sind ohne Kompromisse. Es ist besser zu verstehen, wo ihre Schwächen liegen, damit es bei der Verwendung in realen Szenarien keine Überraschungen gibt.

Limit des ChatGPT-Sprachmodus

- Eingeschränkte Offline-Funktionalität: Erfordert eine ständige Internetverbindung für die Verarbeitung, wodurch es in Gebieten mit schlechter Konnektivität oder bei datenschutzrelevanten Unterhaltungen unbrauchbar ist.

- Fokus auf einen einzelnen Sprecher: Entwickelt für Einzelunterhaltungen und hat Schwierigkeiten mit Gruppendiskussionen oder mehreren Teilnehmern, die gleichzeitig sprechen.

- Keine Verarbeitung von Audiodateien: Vorab aufgezeichnete Meetings oder vorhandene Audioinhalte können nicht transkribiert werden.

Limitierungen von Whisper

- Nur eine einfache Transkription: Whisper ist keine KI zur Erstellung von Meeting-Notizen. Es liefert Ihnen lediglich eine einfache Transkription der Audioaufnahme ohne jegliches Format.

- Keine Echtzeit-Interaktion: Kann keine wechselseitigen Unterhaltungen führen oder intelligente Antworten geben.

- Ressourcenintensive lokale Bereitstellung: Erfordert leistungsstarke Hardware mit hochleistungsfähigen GPUs für optimale Verarbeitungsgeschwindigkeiten bei lokaler Ausführung.

- Limitierte Sprecheridentifizierung: Das Programm kann zwar mehrere Sprecher verarbeiten, identifiziert jedoch nicht automatisch, wer gerade spricht, und unterscheidet die Sprecher auch nicht anhand ihres Namens.

💡 Profi-Tipp: Verwenden Sie ClickUp Brain MAX für die Umwandlung von Sprache in Text, die über die reine Transkription hinausgeht.

Während ChatGPT Voice Mode und Whisper Sprache isoliert verarbeiten, wandelt ClickUp Brain MAX Sprache in strukturiertes, kontextbezogenes Wissen innerhalb derselben Plattform um, in der Ihr Team bereits arbeitet. Hier sehen Sie, wie es beide übertrifft:

- Voice to Action: Brain MAX transkribiert Ihre Audio- und Video-Clips, um automatisch wichtige Schlüssel, Entscheidungen und Aufgaben zu extrahieren. Sie müssen nichts manuell umschreiben oder neu organisieren.

- Eine App für Ihren gesamten Kontext: Alle von Brain MAX erstellten Transkripte, Notizen und Aufgaben werden in ClickUp gespeichert – zusammen mit Ihren Projekten, Dokumenten, Whiteboards und Chats. Sie erhalten den Kontext, ohne zwischen Apps wechseln zu müssen.

- Funktioniert mit Live- oder aufgezeichneten Videos: Verarbeitet Echtzeit-Aufzeichnungen von Meetings (wie ChatGPT Voice) mit dem ClickUp AI Notetaker und transkribiert aufgezeichnete Audiodateien (wie Whisper), wodurch beide Anwendungsfälle in einem tool zusammengeführt werden.

- Datenschutzfreundlich: Die Daten bleiben in Ihrem ClickUp-Workspace und eignen sich daher für datenschutzrelevante Umgebungen.

Lernen Sie ClickUp kennen: Die beste Alternative zu ChatGPT Voice und WhisperAI

Weder ChatGPT Voice Mode noch Whisper /AI schließen den Kreis von gesprochenen Unterhaltungen zu umsetzbarem Wissen vollständig.

ClickUp, die Alles-App für die Arbeit, schließt diese Lücke. Mit ihr können Sie Unterhaltungen erfassen, verarbeiten und darauf reagieren. Sehen wir uns die wichtigsten Features von ClickUp an, die dies ermöglichen.

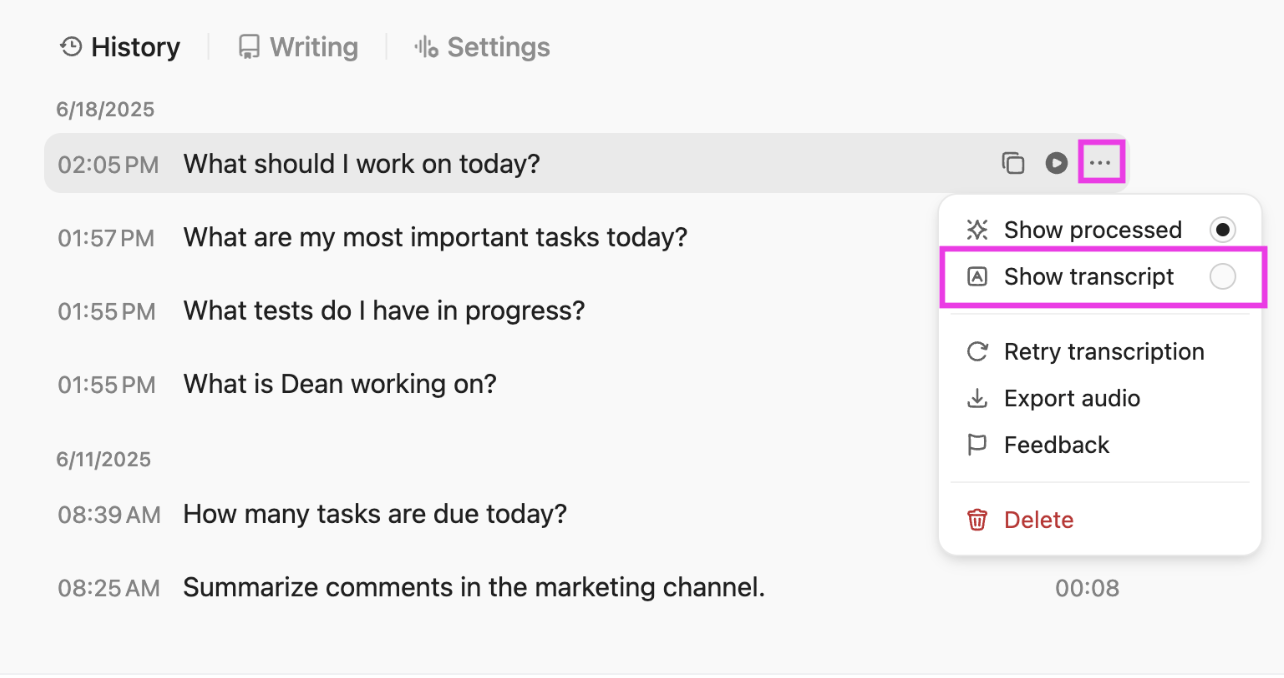

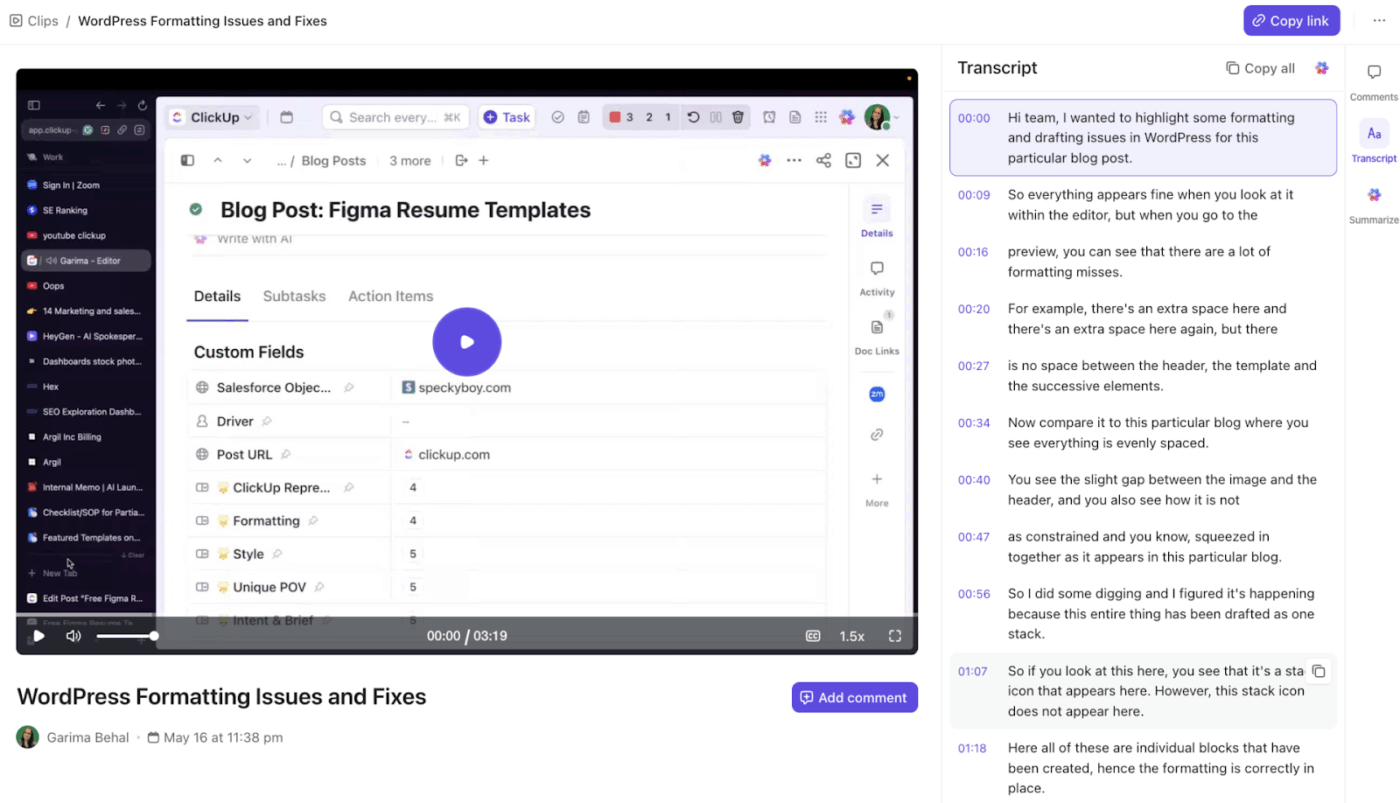

ClickUp's One Up #1: ClickUp AI Notetaker

Sie müssen keine externen APIs konfigurieren oder separate KI-Transkriptionstools einsetzen, um stundenlange Meetings zu transkribieren. Wenn Sie ClickUp verwenden, erhalten Sie diese Funktion mit ClickUp AI Notetaker integriert.

Lassen Sie es an Ihren Meetings teilnehmen, und es transkribiert die Meeting-Aufzeichnung in Text, identifiziert die Sprecher und fügt Zeitstempel hinzu, sodass Sie der Unterhaltung folgen können.

Mit ClickUp AI erhalten Sie Transkriptionssupport für Meetings, Sprachnotizen und Bildschirmaufzeichnungen. Es wandelt Audio aus jedem Workflow in durchsuchbaren und verwertbaren Text um.

Zu den zusätzlichen Features, die Ihnen einen Vorteil gegenüber ChatGPT Voice oder Whisper /AI verschaffen, gehören:

- Erstellt intelligente Zusammenfassungen: Dieser KI-Meeting-Zusammenfasser fasst automatisch die wichtigsten Punkte (Ihres Meetings) zusammen und veröffentlicht sie direkt in einem bestimmten ClickUp-Chat-Kanal, sodass sie für das Team sofort sichtbar sind.

- Identifiziert Aktionspunkte: Extrahiert Aktionspunkte aus Ihren Anrufen und wandelt sie in zugewiesene ClickUp-Aufgaben um, z. B. wird „Emma sollte die Vertragsbedingungen vor unserem nächsten Meeting finalisieren” zu einer Aufgabe, die Emma mit einem entsprechenden Fälligkeitsdatum zugewiesen wird.

- Strukturen-Transkripte: Formatiert Transkripte in ClickUp-Dokumenten und speichert sie als durchsuchbare Referenzpunkte für den zukünftigen Zugriff.

- Ermöglicht die Suche nach Meetings: Durchsucht alle Ihre Meeting-Protokolle, um bestimmte Diskussionen aus den letzten Wochen zu finden, und gibt Notizen an die relevanten Team-Mitglieder frei.

- Funktioniert überall: Lässt sich mit jeder Anrufplattform (Zoom, Teams, Meet) verbinden, um virtuelle Meetings ohne zusätzliches Setup zu transkribieren.

💡 Profi-Tipp: ClickUp AI Notetaker tagt Aktionspunkte, Fristen und Entscheidungen, die während des Meetings getroffen wurden, und organisiert sie unter ClickUp Docs.

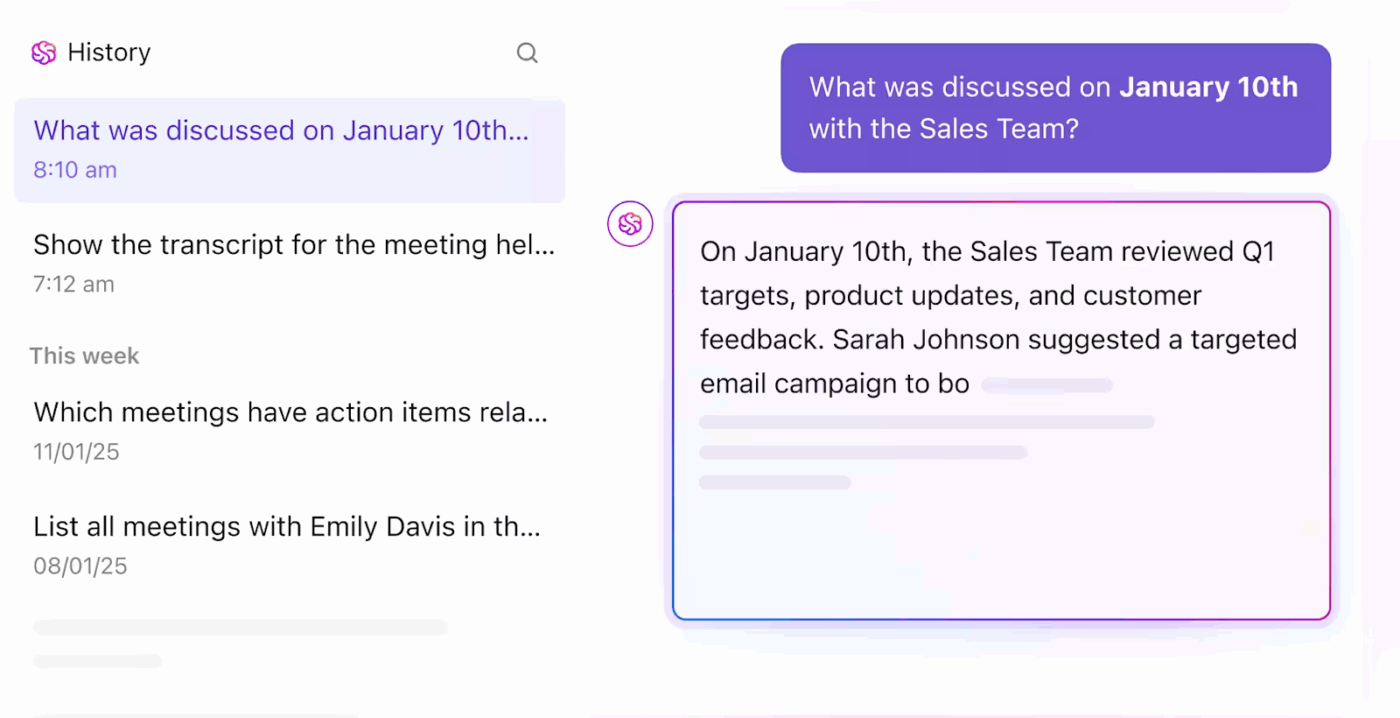

ClickUp's One Up #2: ClickUp Brain

Während ClickUp's AI Notetaker Ihre Meetings transkribiert, fügt ClickUp Brain, der integrierte KI-Assistent, Ihren Notizen eine leistungsstarke Intelligenzebene hinzu.

Wir haben bereits erwähnt, wie es Transkripte zusammenfassen oder bestimmte Momente herausgreifen kann, ohne den Inhalt manuell zu durchsuchen. Es kann sogar das Transkript durchlesen und Schlüssel-Erkenntnisse daraus extrahieren.

ClickUp Brain kann noch viel mehr:

- Dokumente freihändig entwerfen: Sprechen Sie Ihre Gedanken aus, und Brain wandelt sie in strukturierte Notizen um, die Sie in Aufgaben oder Dokumenten verwenden können.

- Sprache in umsetzbare Aufgaben umwandeln: Diktieren Sie Anforderungen für das Projekt und sehen Sie zu, wie Brain umfassende Listen mit entsprechenden Beschreibungen, Fälligkeitsdaten und Empfehlungen für Mitarbeiter erstellt.

- Automatisieren Sie die Erstellung von Aufgaben: Bitten Sie Brain, ClickUp-Automatisierungen zu erstellen, und erhalten Sie eine benutzerdefinierte Automatisierung mit Auslösern und Aktionen, die Sie nach Ihren Bedürfnissen bearbeiten können.

- Suche auf Unternehmensebene: Stellen Sie Fragen wie „Gib mir Projekt-Updates aus den Meetings mit Clients des letzten Monats“, und die Enterprise-Suche von ClickUp ruft relevante Daten aus all Ihren verbundenen Apps ab, um Ihnen kontextbezogene Antworten zu liefern.

In diesem YouTube-Video erhalten Sie eine detailliertere Übersicht darüber, wie ClickUp Brain Sprache und Videos transkribiert:

🌟 Bonus: ClickUp Brain-Benutzer können aus mehreren externen KI-Modellen wählen, darunter ChatGPT, Claude und Gemini, für verschiedene Schreib-, Denk- und Programmieraufgaben, direkt aus ihrer ClickUp-Plattform heraus!

Maximieren Sie die Effizienz der Projekte mit dem KI-Modell Ihrer Wahl mit ClickUp!

ClickUp One Up #3: ClickUp Dokumente

Wir haben bereits erläutert, wie ClickUp Notetaker Notizen aus einem Video erstellt und diese in ClickUp Dokumente speichert.

Docs bietet umfassende Funktionen zur Dokumentenverwaltung, mit denen eigenständige Diktat-Tools einfach nicht mithalten können. Ihre Arbeit bleibt in einem durchsuchbaren Docs Hub organisiert, sodass Sie alle benötigten Informationen schnell finden können.

Hier sind die wichtigsten Funktionen von ClickUp Docs für die Umwandlung von Sprache in Dokumente:

- Kollaborative Bearbeitung in Echtzeit: Mehrere Mitglieder des Teams können gleichzeitig sprachgenerierte Dokumente bearbeiten und dabei Kommentare und Vorschläge hinzufügen.

- Intelligente Formatierung von Sprache: ClickUp Brain strukturiert diktierte Inhalte automatisch mit Kopfzeilen, Listen und Abschnitten basierend auf dem gesprochenen Kontext.

- Aufgabenkonvertierung: Verwandeln Sie beliebige Dokumentabschnitte in zugewiesene Aufgaben mit Fristen und Projektverbindungen.

- Widget-Integration: Einbetten von Live-Projektdaten, Listen mit Aufgaben und Widgets für die Berichterstellung direkt in Dokumente

- Eingebettete Anhänge: Fügen Sie Screenshots, PDFs oder Referenzdateien direkt in Dokumente ein, um den vollständigen Kontext zu erhalten.

💡 Profi-Tipp: Verwenden Sie ClickUp Assign Comments , um bestimmte Teamkollegen direkt in Ihren Notizen oder Dokumenten zu taggen. Sie können Feedback in nachverfolgbare Aufgaben umwandeln, jedem Element einen Eigentümersitz zuweisen und Unklarheiten bei der Nachbereitung von Meetings beseitigen.

Die integrierten KI-Funktionen von ClickUp ermöglichen eine intelligente Automatisierung, die mit isolierten KI-Tools nicht erreicht werden kann. Deshalb glauben wir, dass es eine bessere Alternative zu Voice und Whisper ist.

Nutzen Sie Ihre Stimme, um Workflows in ClickUp zu automatisieren

Die Sprach-zu-Sprach-Funktionen des ChatGPT Voice Mode und die Transkriptionsgenauigkeit von Whisper haben neue Möglichkeiten für freihändige Produktivität und mehrsprachige Kommunikation eröffnet. Allerdings besteht nach wie vor eine erhebliche Lücke zwischen KI-Unterstützung und der tatsächlichen Ausführung von Arbeiten.

ClickUp verbindet mit seinem universellen Workspace-Konzept KI-gestützte Sprach-zu-Text-Funktionen direkt mit seinen Projekt-Workflows. Hier werden Ihre diktierten Ideen zu zugewiesenen Aufgaben, während Meeting-Protokolle in kollaborative Projektdokumente umgewandelt werden.

Kombinieren Sie dies mit all Ihren Aufgaben, Dokumenten und Chats an einem Ort, und Sie werden sehen, warum ClickUp die All-in-One-KI-Lösung ist, die Sie brauchen.

Melden Sie sich jetzt kostenlos an und verändern Sie die Art und Weise, wie Ihr Team Sprachtechnologie für die tatsächliche Durchführung des Projekts nutzt.