قد يبدو التحيز في الذكاء الاصطناعي مشكلة تقنية. لكن آثاره تظهر في العالم الحقيقي ويمكن أن تكون مدمرة في كثير من الأحيان.

عندما ينحرف نظام الذكاء الاصطناعي عن المسار الصحيح، ولو قليلاً، فقد يؤدي ذلك إلى نتائج غير عادلة.

ومع مرور الوقت، يمكن أن تتحول هذه المشكلات الصغيرة إلى عملاء محبطين أو مشكلات تتعلق بالسمعة أو حتى أسئلة حول الامتثال لم تكن تتوقعها.

لا تسعى معظم الفرق إلى بناء ذكاء اصطناعي متحيز. يحدث ذلك لأن البيانات غير منظمة، والعالم الحقيقي غير متساوٍ، والأدوات التي نستخدمها لا تعمل دائمًا بالطريقة التي نتوقعها. الخبر السار هو أنك لست بحاجة إلى أن تكون عالم بيانات لفهم ما يحدث.

في هذا المدونة، سنشرح لك ما هو التحيز في الذكاء الاصطناعي، ولماذا يحدث، وكيف يمكن أن يظهر في أدوات العمل اليومية.

ما هو التحيز في الذكاء الاصطناعي؟

يحدث تحيز الذكاء الاصطناعي عندما ينتج نظام الذكاء الاصطناعي نتائج منهجية وغير عادلة تفضل أو تضر بشكل مستمر بمجموعات معينة من الناس. هذه ليست مجرد أخطاء عشوائية؛ بل هي أنماط يمكن التنبؤ بها وتصبح جزءًا لا يتجزأ من كيفية اتخاذ الذكاء الاصطناعي للقرارات. السبب؟ يتعلم الذكاء الاصطناعي من البيانات التي تعكس التحيز البشري الحالي والتحيزات اللاواعية الأخرى والتفاوتات الاجتماعية.

فكر في الأمر على النحو التالي: إذا قمت بتدريب خوارزمية التوظيف على بيانات الشركة على مدى عشر سنوات حيث كان 90٪ من المديرين من الرجال، فقد يتعلم الذكاء الاصطناعي بشكل خاطئ أن كونك رجلاً هو مؤهل أساسي لشغل منصب إداري. الذكاء الاصطناعي ليس خبيثًا؛ إنه ببساطة يحدد ويكرر الأنماط التي تم عرضها عليه.

إليك ما يجعل تحيز الذكاء الاصطناعي صعبًا للغاية:

- إنه أمر منهجي وليس عشوائيًا: عدم العدالة ليس خطأً فرديًا، بل نمط متكرر في مخرجات الذكاء الاصطناعي.

- غالبًا ما يكون غير مرئي: يمكن أن تختبئ النتائج المتحيزة وراء الحسابات المعقدة لخوارزمية تبدو محايدة، مما يجعل من الصعب اكتشافها.

- إنه متجذر في البيانات والتصميم: يدخل التحيز إلى النظام من خلال الخيارات التي نتخذها نحن البشر عند بناء وتدريب الذكاء الاصطناعي.

⭐ نموذج مميز

يوفر نموذج تقرير الاستجابة للحوادث من ClickUp هيكلًا جاهزًا لتوثيق الحوادث وتتبعها وحلها من البداية إلى النهاية. سجل جميع تفاصيل الحادث ذات الصلة، وحافظ على حالات مصنفة بوضوح، وسجل السمات المهمة مثل الخطورة والمجموعات المتأثرة وخطوات الإصلاح. وهو يدعم الحقول المخصصة لأمور مثل الموافق عليه من قبل وملاحظات الحادث والمستندات الداعمة، مما يساعد على إظهار المساءلة والأدلة طوال عملية المراجعة.

📖 اقرأ المزيد: كيفية إجراء تقييم المخاطر: الأدوات والتقنيات

لماذا يعد التخفيف من تحيز الذكاء الاصطناعي أمرًا مهمًا

عندما تكون أنظمة الذكاء الاصطناعي الخاصة بك غير عادلة، فإنك تخاطر بإلحاق الضرر بحياة الأشخاص الحقيقيين.

وهذا بدوره يعرض مؤسستك لتحديات تجارية خطيرة ويمكن أن يدمر الثقة التي بذلت جهدًا كبيرًا لبنائها مع عملائك.

إن الذكاء الاصطناعي المتحيز الذي يرفض منح شخص ما قرضًا أو يرفض طلبه الوظيفي أو يقدم توصية غير صحيحة يؤدي إلى عواقب وخيمة في العالم الواقعي.

تشجع المعايير والأطر الصناعية الناشئة الآن المؤسسات على تحديد التحيز في أنظمة الذكاء الاصطناعي لديها ومعالجته بشكل فعال. تؤثر المخاطر على مؤسستك من جميع الجوانب:

- المخاطر التنظيمية: قد يؤدي عدم الامتثال للمعايير الجديدة للذكاء الاصطناعي إلى تحديات تجارية كبيرة.

- الضرر الذي يلحق بالسمعة: بمجرد أن يعلم الجمهور أن الذكاء الاصطناعي الخاص بك متحيز، يصبح من الصعب للغاية استعادة ثقتهم.

- عدم الكفاءة التشغيلية: تنتج النماذج المتحيزة نتائج غير موثوقة أو هلوسات الذكاء الاصطناعي التي تؤدي إلى قرارات سيئة وتتطلب إصلاحات باهظة الثمن.

- المسؤولية الأخلاقية: يجب أن تضمن مؤسستك أن التكنولوجيا التي تنشرها تعامل جميع المستخدمين بإنصاف.

عندما تنجح في التخفيف من التحيز، فإنك تبني أنظمة ذكاء اصطناعي يمكن للناس الاعتماد عليها بالفعل. يفتح الذكاء الاصطناعي العادل أبوابًا لأسواق جديدة، ويعزز جودة قراراتك، ويثبت للجميع أنك ملتزم بإدارة أعمالك بطريقة أخلاقية.

📮 ClickUp Insight: 22٪ من المشاركين في الاستطلاع لا يزالون متحفظين عندما يتعلق الأمر باستخدام الذكاء الاصطناعي في العمل. من بين الـ 22٪، نصفهم قلقون بشأن خصوصية بياناتهم، بينما النصف الآخر غير متأكد من أنه يمكنهم الوثوق بما يخبرهم به الذكاء الاصطناعي.

تتصدى ClickUp لهذين الشاغلين بشكل مباشر من خلال تدابير أمنية قوية ومن خلال إنشاء روابط مفصلة للمهام والمصادر مع كل إجابة.

وهذا يعني أنه حتى أكثر الفرق حذراً يمكنها البدء في الاستمتاع بزيادة الإنتاجية دون القلق بشأن حماية معلوماتها أو الحصول على نتائج موثوقة.

أنواع ومصادر التحيز في الذكاء الاصطناعي

يمكن أن يتسلل التحيز إلى أنظمة الذكاء الاصطناعي الخاصة بك من اتجاهات متعددة.

منذ اللحظة التي تبدأ فيها بجمع البيانات وحتى فترة طويلة بعد نشر النظام، يظل هذا العنصر ثابتًا إلى حد ما. ولكن إذا كنت تعرف أين تبحث، يمكنك توجيه جهودك والتوقف عن لعب لعبة لا نهاية لها من "ضرب الجرذ" مع نتائج غير عادلة.

تحيز العينات

يحدث التحيز في العينات عندما لا تمثل البيانات التي تستخدمها لتدريب الذكاء الاصطناعي الخاص بك العالم الحقيقي الذي سيتم استخدام الذكاء الاصطناعي فيه بشكل دقيق.

على سبيل المثال، إذا قمت ببناء نظام التعرف على الصوت مدرب في الغالب على بيانات من متحدثين باللغة الإنجليزية الأمريكية، فسيواجه صعوبة طبيعية في فهم الأشخاص الذين يتحدثون بلكنة اسكتلندية أو هندية، على غرار الطريقة التي تفضل بها نماذج اللغة الكبيرة (LLM) الأسماء المرتبطة بالبيض في 85.1٪ من حالات فحص السير الذاتية. يؤدي هذا التمثيل الناقص إلى ظهور نقاط عمياء ضخمة، مما يجعل نموذجك غير جاهز لخدمة مجموعات كاملة من الأشخاص.

التحيز الخوارزمي

يحدث التحيز الخوارزمي عندما يؤدي تصميم النموذج أو العملية الحسابية إلى تضخيم الأنماط غير العادلة، حتى لو بدت البيانات محايدة.

لا ينبغي أن يحدد الرمز البريدي لشخص ما ما إذا كان سيحصل على قرض أم لا، ولكن إذا كان الرموز البريدية في بيانات التدريب الخاصة بك مرتبطة ارتباطًا وثيقًا بالعرق، فقد يتعلم الخوارزمية استخدام الموقع كبديل للتمييز.

تزداد هذه المشكلة سوءًا مع حلقات التغذية الراجعة — فعندما يتم إدخال تنبؤ متحيز (مثل رفض قرض) في النظام كبيانات جديدة، يزداد التحيز حدة بمرور الوقت.

تحيز القرارات البشرية

كل خيار يتخذه الشخص أثناء بناء نظام الذكاء الاصطناعي يمكن أن يؤدي إلى التحيز.

ويشمل ذلك تحديد البيانات التي سيتم جمعها، وكيفية تصنيفها، وكيفية تعريف "نجاح" النموذج. على سبيل المثال، قد يفضل الفريق دون وعي البيانات التي تدعم ما يعتقده بالفعل (تحيز التأكيد) أو يعطي وزناً أكبر من اللازم لأول معلومة يراها (تحيز التثبيت).

حتى أكثر الفرق حسنة النية يمكن أن تقوم عن غير قصد بترميز افتراضاتها ورؤيتها للعالم في نظام الذكاء الاصطناعي.

📖 اقرأ المزيد: 10 نماذج لإدارة المشاريع لإدارة المهام

أمثلة على تحيز الذكاء الاصطناعي في العالم الواقعي

واجهت شركات حقيقية عواقب وخيمة عندما أظهرت أنظمة الذكاء الاصطناعي لديها تحيزًا، مما كلفها ملايين الدولارات في شكل أضرار وخسارة ثقة العملاء. فيما يلي بعض الأمثلة الموثقة:

1. أدوات التوظيف المتحيزة

إحدى الحالات الأكثر شيوعًا تتعلق بشركة تقنية كبرى ألغت نظامًا داخليًا لتوظيف الذكاء الاصطناعي بعد أن اكتشفت أنه يفضل المرشحين الذكور على الإناث. تم تدريب النظام على سير ذاتية تم جمعها على مدار عقد من الزمن، حيث كان معظم المتقدمين الناجحين من الرجال. لذلك بدأ النظام في معاقبة السير الذاتية التي تحتوي على كلمات مثل "نسائية"، بل وحتى خفض درجات خريجي الكليات النسائية.

يوضح هذا كيف يمكن أن يتسلل تحيز البيانات التاريخية، عندما تعكس الأنماط السابقة عدم المساواة القائمة، إلى الأتمتة ما لم يتم تدقيقها بعناية. ولكن مع انتشار التوظيف الآلي باستخدام الذكاء الاصطناعي، يزداد حجم المشكلة.

🌼 هل تعلم: تشير البيانات الحديثة إلى أن 37% من المؤسسات تقوم الآن "بالدمج النشط" أو "التجريب" لأدوات الذكاء الاصطناعي من الجيل الثاني في عمليات التوظيف، بزيادة عن 27% قبل عام.

2. التعرف على الوجه الذي يغفل نصف السكان

كشفت الأبحاث التي قادتها جوي بولامويني وو ثقت في دراسة Gender Shades أن أنظمة التعرف على الوجه التجارية سجلت معدلات خطأ تصل إلى 34. 7% بالنسبة للنساء ذوات البشرة الداكنة، مقارنة بأقل من 1% بالنسبة للرجال ذوي البشرة الفاتحة.

وهذا مرة أخرى انعكاس لعدم توازن مجموعات البيانات التدريبية. التحيز في الأدوات البيومترية له آثار أبعد مدى.

واجهت الشرطة والوكالات الحكومية أيضًا مشكلات تتعلق بالتحيز في التعرف على الوجوه. كشفت تحقيقات أجرتها صحيفة واشنطن بوست أن بعض هذه الأنظمة كانت أكثر عرضة لخطأ التعرف على الأشخاص المنتمين إلى الفئات المهمشة. في عدة حالات حقيقية، أدى ذلك إلى اعتقالات خاطئة وردود فعل عامة سلبية ومخاوف كبيرة بشأن تأثير هذه الأدوات على حقوق الأشخاص.

3. خوارزميات الصحة التي تقلل من أولوية الرعاية

كما أظهرت أنظمة الذكاء الاصطناعي الصحية المصممة للتنبؤ بالمرضى الذين يحتاجون إلى رعاية إضافية تحيزًا أيضًا.

في إحدى الحالات الموثقة جيدًا، واجهت خوارزمية التنبؤ بالرعاية الصحية المستخدمة على نطاق واسع خطأً كبيرًا. كان من المفترض أن تساعد في تحديد المرضى الذين يجب أن يتلقوا رعاية إضافية، ولكنها انتهت بإعطاء أولوية أقل للمرضى السود بشكل منهجي، حتى عندما كانوا مرضى بنفس درجة المرضى البيض أو أكثر.

حدث ذلك لأن النموذج استخدم الإنفاق على الرعاية الصحية كبديل عن الحاجة الطبية. نظرًا لأن المرضى السود كانوا ينفقون تاريخيًا على الرعاية الصحية أقل بسبب عدم المساواة في الوصول إلى الرعاية، فقد تعاملت معهم الخوارزمية على أنهم أقل حاجة. ونتيجة لذلك، حوّلت موارد الرعاية بعيدًا عن أولئك الذين كانوا في أمس الحاجة إليها. وجد الباحثون أن مجرد إصلاح هذا البديل يمكن أن يزيد بشكل كبير من الوصول إلى برامج الرعاية العادلة.

أدت المخاوف بشأن هذه القضايا إلى قيام جماعات الحقوق المدنية بالضغط من أجل معايير "الإنصاف أولاً" في الذكاء الاصطناعي في مجال الرعاية الصحية. في ديسمبر 2025، أصدرت NAACP خطة تفصيلية تدعو المستشفيات وشركات التكنولوجيا وصانعي السياسات إلى اعتماد عمليات تدقيق التحيز وممارسات التصميم الشفافة والأطر الشاملة وأدوات حوكمة الذكاء الاصطناعي لمنع تفاقم التفاوتات العرقية في مجال الصحة.

4. خوارزميات الائتمان ذات النتائج غير المتكافئة

لا يؤثر الذكاء الاصطناعي واتخاذ القرارات الآلي على ما تراه على وسائل التواصل الاجتماعي فحسب، بل يؤثران أيضًا على من يحصل على المال وبأي شروط.

أحد الأمثلة الواقعية الأكثر تداولًا جاء من Apple Card ، وهي بطاقة ائتمان رقمية صادرة عن Goldman Sachs.

في عام 2019، شارك العملاء على وسائل التواصل الاجتماعي أن خوارزمية حد الائتمان للبطاقة أعطت حدودًا أعلى بكثير لبعض الرجال مقارنة بزوجاتهم أو شريكاتهم. حدث هذا حتى عندما أبلغ الأزواج عن ملفات مالية متشابهة. قال أحد مهندسي البرمجيات إنه حصل على حد ائتمان أعلى بـ 20 مرة من حد زوجته، وحتى مؤسس شركة Apple المشارك ستيف وزنياك أكد تجربة مماثلة تتعلق بزوجته.

أثارت هذه الأنماط احتجاجًا عامًا وأدت إلى إجراء تحقيق تنظيمي من قبل وزارة الخدمات المالية بولاية نيويورك حول ما إذا كان الخوارزمية تميز ضد النساء، مما يسلط الضوء على كيفية تسبب الأدوات المالية الآلية في نتائج غير متكافئة.

5. التسميات التوضيحية الآلية والتعرف على الصوت الذي يستبعد الأصوات

غالبًا ما لا تسمع أنظمة التعرف على الكلام والترجمة الآلية الجميع على قدم المساواة. أظهرت دراسات متعددة أن هذه الأدوات تعمل بشكل أفضل مع بعض المتحدثين أكثر من غيرهم، اعتمادًا على عوامل مثل اللهجة واللهجة المحلية والعرق وما إذا كانت اللغة الإنجليزية هي اللغة الأم للمتحدث.

يحدث ذلك لأن الأنظمة التجارية عادةً ما يتم تدريبها على مجموعات بيانات تهيمن عليها أنماط كلامية معينة — غالبًا ما تكون الإنجليزية الغربية القياسية — مما يترك الأصوات الأخرى ممثلة تمثيلاً ناقصًا.

على سبيل المثال، اختبر باحثون في جامعة ستانفورد خمسة أنظمة رائدة لتحويل الكلام إلى نص (من Amazon وGoogle وMicrosoft وIBM وApple) ووجدوا أنها ارتكبت nأخطاء تقريبًا ضعف عدد الأخطاء عند نسخ كلام متحدثين سود مقارنة بمتحدثين بيض . وحدثت المشكلة حتى عندما كان المتحدثون يقولون نفس الكلمات في نفس الظروف.

عندما تكون الترجمة غير دقيقة لبعض المتحدثين، فقد يؤدي ذلك إلى تجربة مستخدم سيئة وصعوبة الوصول للأشخاص الذين يعتمدون على الترجمة. والأسوأ من ذلك، أنه قد يساهم في نتائج متحيزة في الأنظمة التي تستخدم التعرف على الكلام في التوظيف أو التعليم أو الرعاية الصحية.

يوضح كل من هذه الأمثلة طريقة مميزة يمكن أن يتجذر بها التحيز في الأنظمة الآلية، من خلال بيانات تدريب منحازة، أو وكلاء سيئين الاختيار، أو اختبارات غير تمثيلية. في كل حالة، لا تكون النتائج تقنية فحسب، بل تشكل الفرص، وتقوض الثقة، وتنطوي على مخاطر تجارية وأخلاقية حقيقية.

📖 اقرأ المزيد: المخاطر مقابل المشكلات – ما الفرق بينهما؟

ملخص: كيف يظهر التحيز في الذكاء الاصطناعي ومن يتضرر منه

| أين ظهر التحيز | من تأثر بذلك | التأثير في العالم الواقعي |

|---|---|---|

| خوارزميات التوظيف (أداة توظيف الذكاء الاصطناعي الملغاة) | النساء | تم تخفيض تقييم السير الذاتية بناءً على كلمات رئيسية مرتبطة بالجنس، مما قلل من فرص الحصول على مقابلات وفرص عمل. |

| أنظمة التعرف على الوجه (الظلال الجنسانية + حالات الاعتقال غير المشروع) | النساء ذوات البشرة الداكنة؛ المجموعات العرقية المهمشة | أدت معدلات الخطأ في التعرف إلى اعتقالات خاطئة وإلحاق الضرر بالسمعة ومخاوف تتعلق بالحقوق المدنية. |

| خوارزميات التنبؤ بالمخاطر الصحية (دراسة جامعة شيكاغو) | المرضى السود | تم إعطاء الأولوية للمرضى الذين يحتاجون إلى رعاية إضافية لأن الإنفاق على الرعاية الصحية استخدم كبديل خاطئ للاحتياجات الطبية، مما أدى إلى تفاقم التفاوتات الصحية. |

| خوارزميات حد الائتمان (تحقيق Apple Card) | النساء | حصل الرجال على حدود ائتمانية أعلى بكثير من شركائهم من النساء اللواتي يتمتعن بنفس المؤهلات، مما أثر على إمكانية الوصول إلى الخدمات المالية والقدرة على الاقتراض. |

| التعرف على الكلام والترجمة التلقائية (دراسة ستانفورد ASR) | المتحدثون ذوو اللهجات غير القياسية؛ المتحدثون السود | تسبب ما يقرب من ضعف معدلات الخطأ في إيجاد عوائق في الوصول، وسوء الفهم، ونتائج متحيزة في الأدوات المستخدمة في التوظيف والتعليم والوصول الرقمي اليومي. |

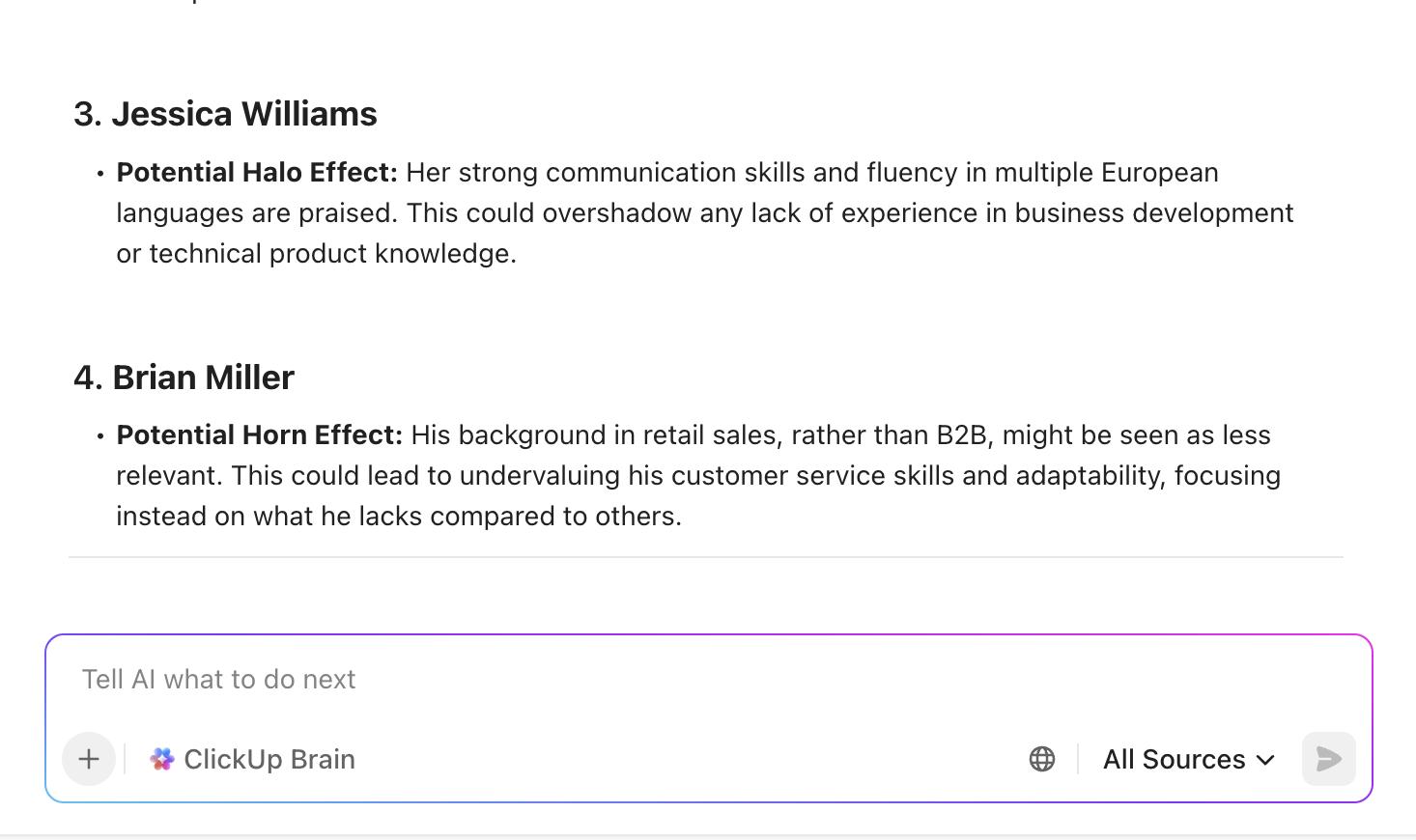

📖 اقرأ المزيد: كيفية تجنب تأثير الهالة والقرن لتقليل التحيز

استراتيجيات فعالة للتخفيف من التحيز

لا توجد حلول سحرية واحدة للقضاء على تحيز الذكاء الاصطناعي.

يتطلب التخفيف الفعال من التحيز دفاعًا متعدد الطبقات يتم تطبيقه طوال دورة حياة الذكاء الاصطناعي بأكملها. من خلال الجمع بين هذه الاستراتيجيات المجربة، يمكنك تقليل مخاطر النتائج غير العادلة بشكل كبير.

اجمع بيانات تدريب متنوعة

البيانات التمثيلية هي الأساس المطلق للذكاء الاصطناعي العادل.

لا يمكن لنموذجك أن يتعلم خدمة مجموعات من الأشخاص لم يسبق له أن رأهم خلال تدريبه. ابدأ بتدقيق مجموعات البيانات الموجودة لديك للعثور على أي فجوات ديموغرافية. ثم ابذل جهدًا واعيًا للحصول على بيانات جديدة من تلك الفئات السكانية غير الممثلة بشكل كافٍ.

عندما يصعب العثور على بيانات من العالم الحقيقي، يمكنك استخدام تقنيات مثل زيادة البيانات (إنشاء نسخ معدلة من البيانات الموجودة) أو إنشاء بيانات اصطناعية للمساعدة في سد الثغرات.

🚧 مجموعة الأدوات: استخدم نموذج قائمة مراجعة التدقيق الداخلي من ClickUp لرسم خريطة لعملية التدقيق الخاصة بك.

اختبار النماذج للتحيز

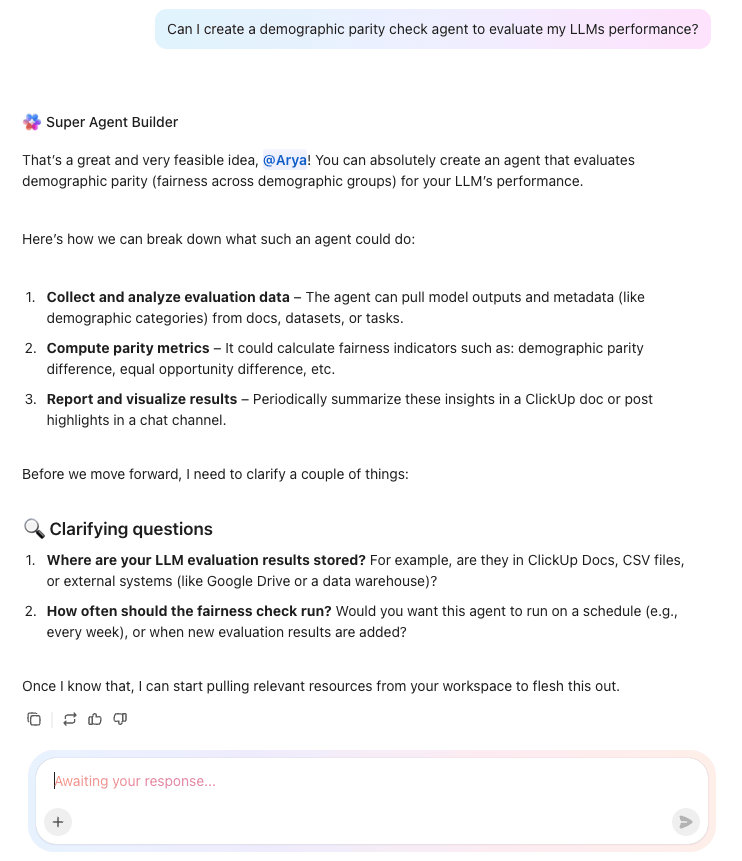

يجب عليك اختبار التحيز بشكل منهجي للكشف عنه قبل أن يتسبب في ضرر حقيقي. استخدم مقاييس الإنصاف لقياس أداء نموذجك عبر مجموعات مختلفة.

على سبيل المثال، يتحقق التكافؤ الديموغرافي مما إذا كان النموذج يحقق نتيجة إيجابية (مثل الموافقة على القرض) بمعدلات متساوية عبر المجموعات، بينما يتحقق التكافؤ في الاحتمالات مما إذا كانت معدلات الخطأ متساوية.

قسّم أداء نموذجك حسب كل فئة ديموغرافية ممكنة — العرق والجنس والعمر والجغرافيا — لتحديد الأماكن التي تنخفض فيها الدقة أو تظهر فيها عدم العدالة.

حافظ على مشاركة الإنسان في العملية

قد تفوت الأنظمة الآلية حالات الظلم الدقيقة والمحددة بالسياق التي قد يلاحظها الإنسان على الفور. يعد نهج "الإنسان في الحلقة" أمرًا بالغ الأهمية بالنسبة للقرارات عالية المخاطر، حيث يمكن للذكاء الاصطناعي تقديم توصية، ولكن الإنسان هو من يتخذ القرار النهائي.

وهذا مهم بشكل خاص في مجالات مثل التوظيف والإقراض والتشخيص الطبي. لكي ينجح ذلك، يجب تدريب المراجعين البشريين على التعرف على التحيز ومنحهم سلطة تجاوز اقتراحات الذكاء الاصطناعي.

تطبيق تقنيات العدالة الخوارزمية

يمكنك أيضًا استخدام أساليب تقنية للتدخل المباشر وتقليل التحيز. تنقسم هذه الأساليب إلى ثلاث فئات رئيسية:

- المعالجة المسبقة: تتضمن تعديل بيانات التدريب قبل أن يراها النموذج، غالبًا عن طريق إعادة تقييم أو إعادة أخذ عينات من البيانات لإنشاء تمثيل أكثر توازنًا للمجموعات المختلفة.

- أثناء المعالجة: هنا، يمكنك إضافة قيود الإنصاف مباشرة إلى عملية تدريب النموذج، وتعليمه كيفية تحسين الدقة والإنصاف في نفس الوقت.

- المعالجة اللاحقة: يعني تعديل التنبؤات النهائية للنموذج بعد إجرائها لضمان عدالة النتائج بين المجموعات.

غالبًا ما تنطوي هذه التقنيات على مقايضة، حيث قد يكون من الضروري إجراء انخفاض طفيف في الدقة الإجمالية لتحقيق مكاسب كبيرة في العدالة.

💟 مكافأة: BrainGPT هو رفيقك على سطح المكتب المدعوم بالذكاء الاصطناعي الذي يرتقي باختبار التحيز في الذكاء الاصطناعي إلى مستوى أعلى من خلال منحك إمكانية الوصول إلى العديد من النماذج الرائدة — بما في ذلك GPT-5 وClaude وGemini والمزيد — كل ذلك في مكان واحد.

وهذا يعني أنه يمكنك بسهولة تشغيل نفس المطالبات أو السيناريوهات عبر نماذج مختلفة، ومقارنة قدراتها على الاستدلال، وتحديد الأماكن التي تختلف فيها الاستجابات أو تظهر فيها التحيزات. تتيح لك هذه التطبيق الفائق للذكاء الاصطناعي أيضًا استخدام ميزة تحويل الكلام إلى نص لإعداد حالات الاختبار وتوثيق النتائج وتنظيمها لتحليلها جنبًا إلى جنب.

تساعدك أدواته المتقدمة في الاستدلال والوعي بالسياق على حل المشكلات وإبراز الأنماط وفهم كيفية تعامل كل نموذج مع الموضوعات الحساسة. من خلال مركزية سير العمل وتمكين الاختبار الشفاف متعدد النماذج، يتيح لك Brain MAX تدقيق التحيز في الذكاء الاصطناعي ومقارنته ومعالجته بثقة ودقة.

زيادة الشفافية والقابلية للتفسير

إذا كنت لا تعرف كيف يتخذ نموذجك القرارات، فلن تتمكن من إصلاحه عندما يكون خاطئًا. تساعدك تقنيات الذكاء الاصطناعي القابل للتفسير (XAI) على إلقاء نظرة داخل "الصندوق الأسود" ومعرفة ميزات البيانات التي تقود التنبؤات.

يمكنك أيضًا إنشاء بطاقات نماذج، وهي تشبه ملصقات التغذية الخاصة بالذكاء الاصطناعي، وتوثق الاستخدام المقصود والأداء والقيود المعروفة.

📮ClickUp Insight: 13٪ من المشاركين في استطلاعنا يرغبون في استخدام الذكاء الاصطناعي لاتخاذ قرارات صعبة وحل مشكلات معقدة. ومع ذلك، يقول 28٪ فقط إنهم يستخدمون الذكاء الاصطناعي بانتظام في العمل. أحد الأسباب المحتملة: مخاوف أمنية!

قد لا يرغب المستخدمون في مشاركة بيانات حساسة تتعلق باتخاذ القرارات مع ذكاء اصطناعي خارجي.

يحل ClickUp هذه المشكلة من خلال توفير حلول للمشكلات مدعومة بالذكاء الاصطناعي مباشرة في مساحة العمل الآمنة الخاصة بك. من SOC 2 إلى معايير ISO، يتوافق ClickUp مع أعلى معايير أمان البيانات ويساعدك على استخدام تقنية الذكاء الاصطناعي التوليدي بأمان في جميع أنحاء مساحة العمل الخاصة بك.

سياسات حوكمة الذكاء الاصطناعي والمساءلة

يخلق برنامج حوكمة قوي للذكاء الاصطناعي ملكية واضحة ومعايير متسقة يمكن لجميع أعضاء الفريق اتباعها.

تحتاج مؤسستك إلى هياكل حوكمة واضحة لضمان وجود شخص مسؤول دائمًا عن بناء ونشر الذكاء الاصطناعي بطريقة أخلاقية.

فيما يلي العناصر الأساسية لبرنامج فعال للحوكمة في مجال الذكاء الاصطناعي:

| عنصر الحوكمة | ماذا يعني ذلك | خطوات العمل لمنظمتك |

|---|---|---|

| ملكية واضحة | يتولى أشخاص أو فرق مخصصة مسؤولية أخلاقيات الذكاء الاصطناعي والإشراف والامتثال. | • تعيين مسؤول عن أخلاقيات الذكاء الاصطناعي أو لجنة متعددة الوظائف • تحديد المسؤوليات المتعلقة بالبيانات وجودة النماذج والامتثال والمخاطر • إشراك الأصوات القانونية والهندسية والمنتجات و DEI في الإشراف |

| سياسات موثقة | إرشادات مكتوبة تحدد كيفية جمع البيانات واستخدامها ومراقبتها عبر دورة حياة الذكاء الاصطناعي | • إنشاء سياسات داخلية لتوفير البيانات وتصنيفها وخصوصيتها والاحتفاظ بها • توثيق معايير تطوير النماذج والتحقق من صحتها ونشرها • مطالبة الفرق باتباع قوائم مراجعة قبل شحن أي نظام ذكاء اصطناعي |

| مسارات التدقيق | سجل شفاف للقرارات وإصدارات النماذج ومجموعات البيانات والتغييرات | • تنفيذ التحكم في إصدارات مجموعات البيانات والنماذج • تسجيل القرارات الرئيسية ومعلمات النماذج ومراجعة النتائج • تخزين سجلات التدقيق في مستودع مركزي يسهل الوصول إليه |

| مراجعات منتظمة | تقييمات مستمرة لأنظمة الذكاء الاصطناعي للتحقق من التحيز والانحراف وفجوات الامتثال | • جدولة تقييمات التحيز ربع سنوية أو نصف سنوية عبر تقييم LLM قوي • إعادة تدريب أو إعادة معايرة النماذج عند انخفاض الأداء أو تغير السلوك • مراجعة النماذج بعد تحديثات البيانات الرئيسية أو تغييرات المنتج |

| خطة الاستجابة للحوادث | بروتوكول واضح لتحديد التحيز أو الضرر في الذكاء الاصطناعي والإبلاغ عنه وتصحيحه | • إنشاء سير عمل داخلي لتصعيد التحيز • تحديد كيفية التحقيق في المشكلات ومن يوافق على الإصلاحات • تحديد خطوات الاتصال للمستخدمين أو العملاء أو الهيئات التنظيمية عند الحاجة |

💡نصيحة احترافية: يمكن أن توفر أطر عمل مثل إطار عمل إدارة مخاطر الذكاء الاصطناعي التابع للمعهد الوطني للمعايير والتكنولوجيا (NIST) وقانون الذكاء الاصطناعي التابع للاتحاد الأوروبي، الذي يفرض غرامات تصل إلى 7% من إجمالي المبيعات السنوية، مخططات ممتازة لإنشاء برنامج الحوكمة الخاص بك.

كيفية تنفيذ التخفيف من التحيز باستخدام ClickUp

تجمع مساحة عمل الذكاء الاصطناعي المتقاربة من ClickUp جميع الأجزاء المتحركة لبرنامج حوكمة الذكاء الاصطناعي الخاص بك في مساحة عمل واحدة منظمة.

يمكن لفرقك إدارة المهام وتخزين السياسات ومراجعة نتائج التدقيق ومناقشة المخاطر وتتبع الحوادث دون التنقل بين الأدوات أو فقدان السياق. تظل كل سجلات النماذج وسجلات القرارات وخطط الإصلاح مرتبطة ببعضها البعض، بحيث تعرف دائمًا من فعل ماذا ولماذا.

ونظرًا لأن الذكاء الاصطناعي في ClickUp يفهم العمل داخل مساحة العمل الخاصة بك، فإنه يمكنه عرض التقييمات السابقة وتلخيص التقارير الطويلة ومساعدة فريقك على البقاء متوافقًا مع تطور المعايير. والنتيجة هي نظام حوكمة أسهل في المتابعة والتدقيق وأكثر موثوقية مع نمو بصمة الذكاء الاصطناعي لديك.

دعونا نحلل ذلك كعملية سير عمل!

الخطوة 1: قم بإعداد مساحة عمل حوكمة الذكاء الاصطناعي

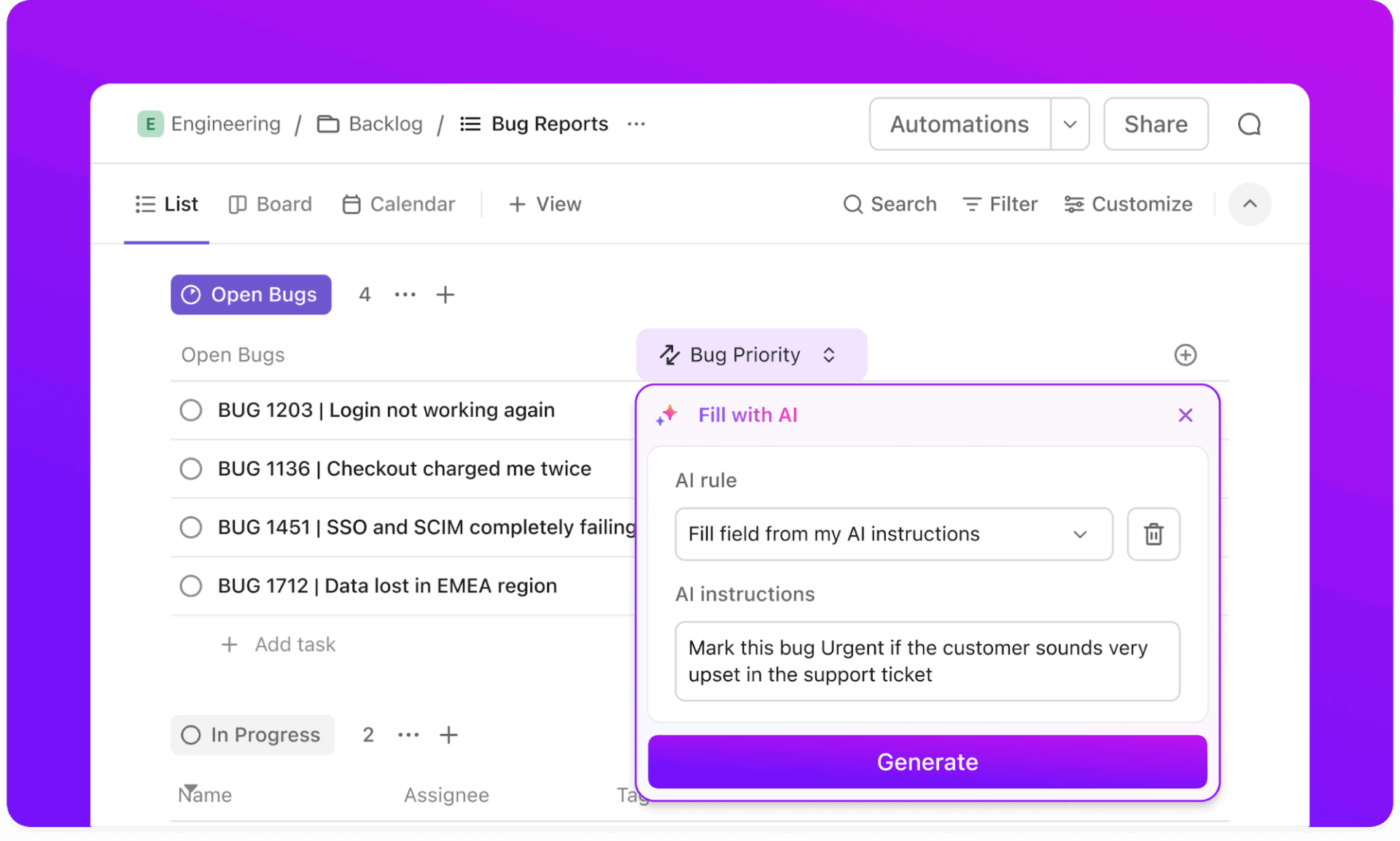

ابدأ بإنشاء مساحة مخصصة في ClickUp لجميع الأعمال المتعلقة بالحوكمة. أضف قوائم لمخزون النماذج وتقييمات التحيز وتقارير الحوادث ووثائق السياسات والمراجعات المجدولة بحيث يتم الاحتفاظ بجميع عناصر البرنامج في بيئة واحدة خاضعة للرقابة.

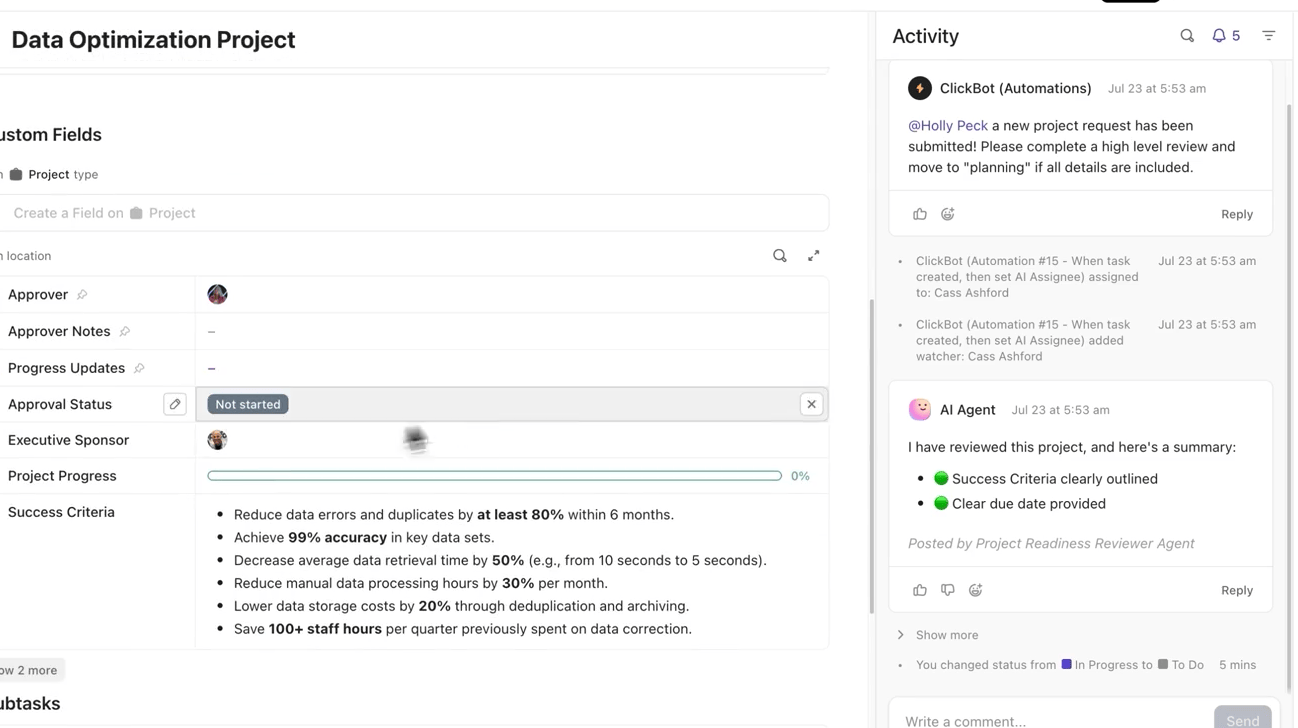

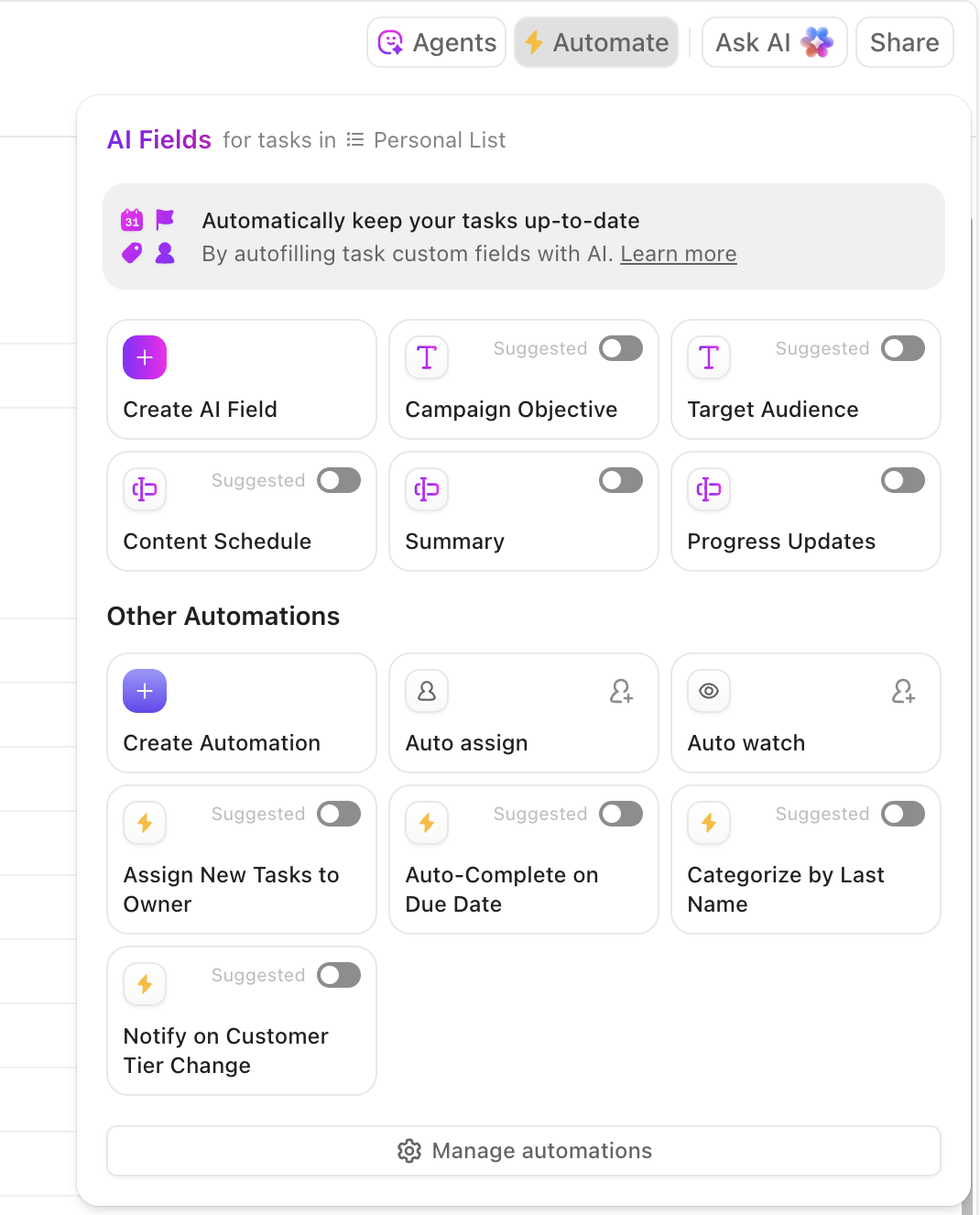

قم بتكوين حقول مخصصة أو حقول الذكاء الاصطناعي لتتبع مقاييس الإنصاف ودرجات التحيز وإصدارات النماذج وحالة المراجعة ومستويات المخاطر. استخدم الأذونات القائمة على الأدوار لضمان أن المراجعين والمهندسين وقادة الامتثال المصرح لهم فقط هم من يمكنهم الوصول إلى أعمال الذكاء الاصطناعي الحساسة. وهذا يخلق الأساس الهيكلي الذي لا تستطيع أدوات المنافسين ومنصات المشاريع العامة توفيره.

الخطوة 2: قم ببناء إطار عمل الحوكمة الخاص بك

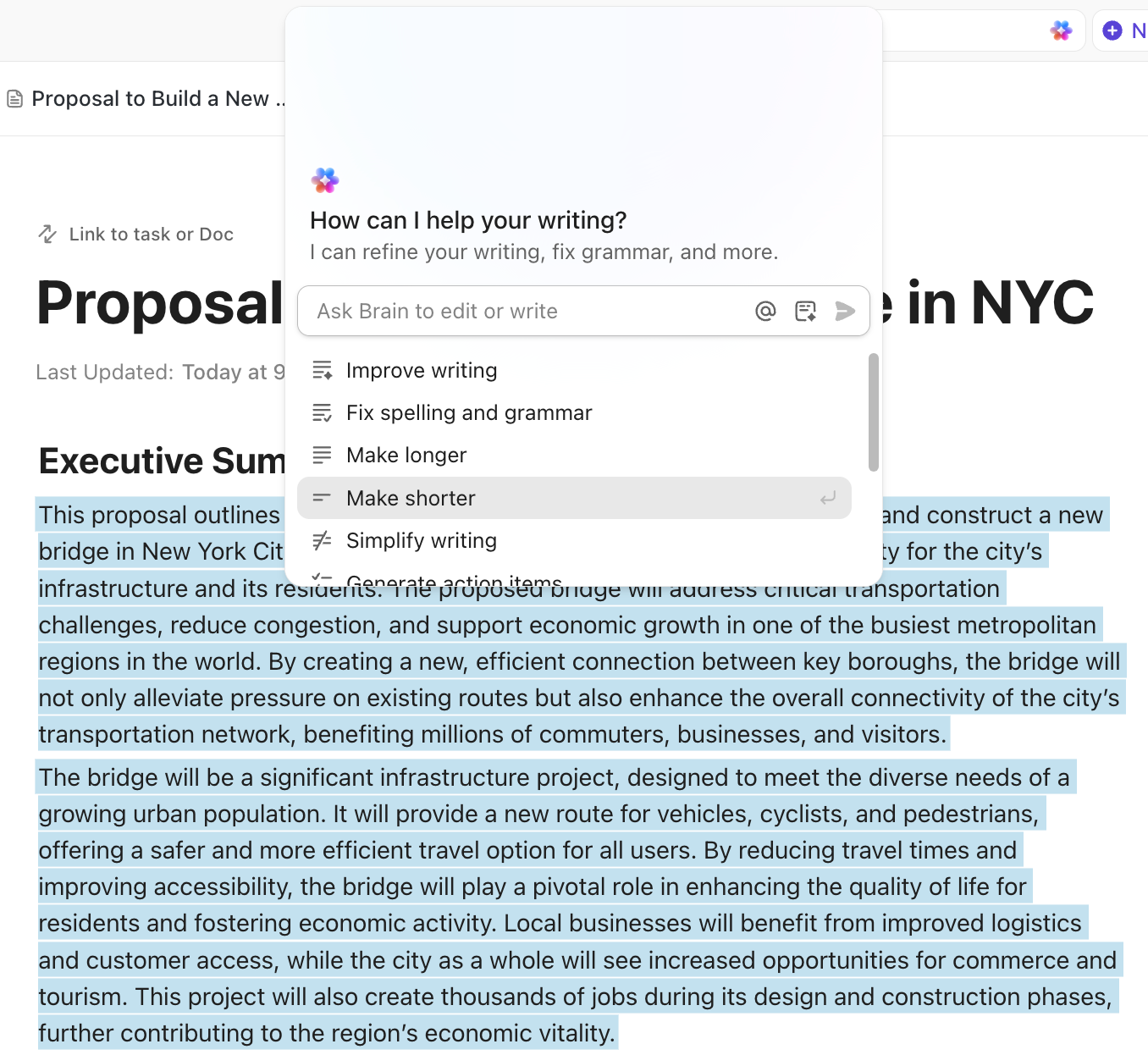

بعد ذلك، أنشئ مستند ClickUp ليكون بمثابة دليل الحوكمة الخاص بك. هنا تحدد إجراءات تقييم التحيز، وعتبات الإنصاف، وإرشادات توثيق النماذج، وخطوات تدخل الإنسان، وبروتوكولات التصعيد.

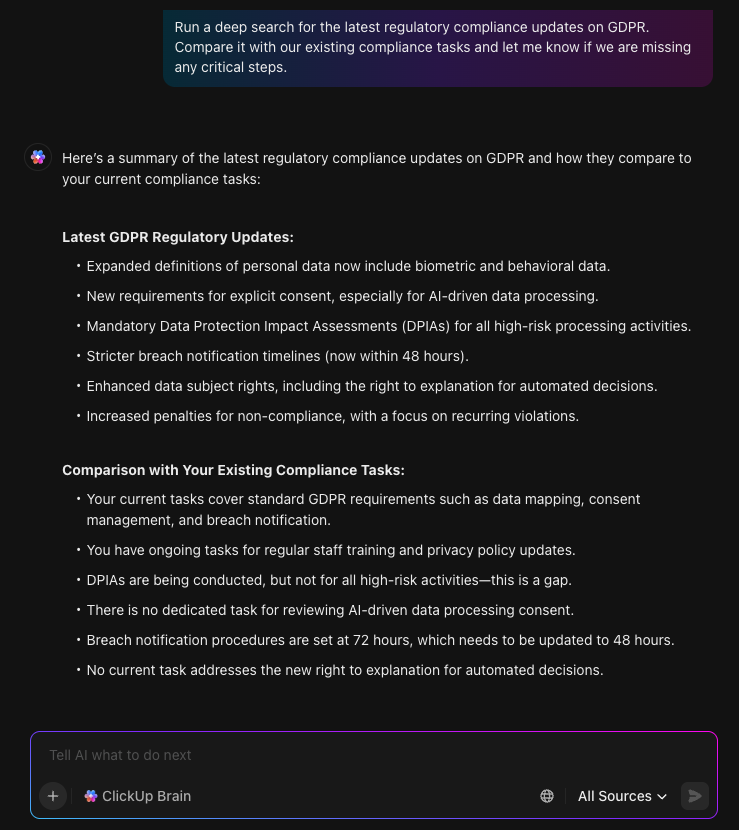

نظرًا لأن المستندات تظل مرتبطة بالمهام وسجلات النماذج، يمكن لفرقك التعاون دون فقدان سجل الإصدارات أو تشتيت الملفات عبر الأدوات. بعد ذلك، يمكن أن يساعد ClickUp Brain في تلخيص اللوائح الخارجية، وصياغة لغة السياسة الجديدة، أو عرض نتائج التدقيق السابقة، مما يجعل إنشاء السياسة أكثر اتساقًا وقابلية للتتبع.

نظرًا لقدرته على البحث في الويب والتبديل بين نماذج الذكاء الاصطناعي المتعددة وتوليف المعلومات في إرشادات واضحة، يظل فريقك على اطلاع بالمعايير الناشئة والتغيرات في الصناعة دون مغادرة مساحة العمل. كل ما تحتاجه، من تحديثات السياسات والرؤى التنظيمية والقرارات السابقة، يتجمع في مكان واحد، مما يجعل نظام الحوكمة الخاص بك أكثر ثباتًا وأسهل في الصيانة.

الخطوة 3: تسجيل كل نموذج

يجب أن يكون لكل نموذج مهمته الخاصة في قائمة "جرد النماذج" بحيث تكون الملكية والمسؤولية واضحة دائمًا.

تتبع بسهولة كل حادثة تحيز كعنصر قابل للتنفيذ باستخدام ClickUp Tasks و ClickUp Custom Fields لتنظيم سير عمل تقييم التحيز وتسجيل كل التفاصيل المهمة.

وبهذه الطريقة، يمكنك تتبع نوع التحيز ومستوى خطورته وحالة العلاج وعضو الفريق المسؤول وتاريخ المراجعة التالي، مما يضمن أن كل مشكلة لها مالك واضح وموعد نهائي.

أرفق مجموعات البيانات وملخصات التقييم وملاحظات النسب حتى يكون كل شيء في مكان واحد. يمكن للأتمتة بعد ذلك تنبيه المراجعين كلما انتقل النموذج إلى مرحلة الإعداد أو الإنتاج.

الخطوة 4: إجراء عمليات تدقيق التحيز المجدولة والقائمة على الأحداث

يجب إجراء عمليات تدقيق التحيز وفقًا لجدول زمني متكرر واستجابة لمحفزات محددة.

قم بإعداد قواعد بسيطة عبر ClickUp Automations التي تطلق مهام المراجعة تلقائيًا كلما وصل نموذج ما إلى مرحلة جديدة من النشر أو حان موعد التدقيق المجدول. لن تفوتك أبدًا تقييم التحيز الفصلي مرة أخرى، حيث يمكن لـ Automations تعيين المراجعين المناسبين، وتحديد المواعيد النهائية الصحيحة، وحتى إرسال تذكيرات مع اقتراب مواعيد الاستحقاق.

بالنسبة للتدقيقات القائمة على الأحداث، تسهل نماذج ClickUp جمع تقارير حوادث التحيز أو ملاحظات البشر، بينما يستخدم المراجعون الحقول المخصصة لتسجيل فجوات الإنصاف ونتائج الاختبارات والتوصيات. يتم توجيه كل نموذج يتم إرساله إلى فريقك كمهمة، مما يخلق مسار تدقيق قابل للتكرار.

الخطوة 5: التحقيق في حوادث التحيز وحلها

عند تحديد مشكلة تحيز، قم بإنشاء مهمة حادث تحدد مدى خطورتها والمجموعات المتأثرة وإصدار النموذج والعمل المطلوب للتخفيف من حدتها. يمكن لوكلاء الذكاء الاصطناعي تصعيد النتائج عالية المخاطر إلى مسؤولي الامتثال وتعيين المراجعين والمهندسين المناسبين.

تظل كل إجراء تخفيف ونتائج الاختبار وخطوات التحقق مرتبطة بسجل الحادث. يمكن لـ ClickUp Brain إنشاء ملخصات للقيادة أو المساعدة في إعداد ملاحظات التصحيح لوثائق الحوكمة الخاصة بك، مما يحافظ على شفافية كل شيء وإمكانية تتبعه.

الخطوة 6: مراقبة سلامة برنامج حوكمة الذكاء الاصطناعي لديك

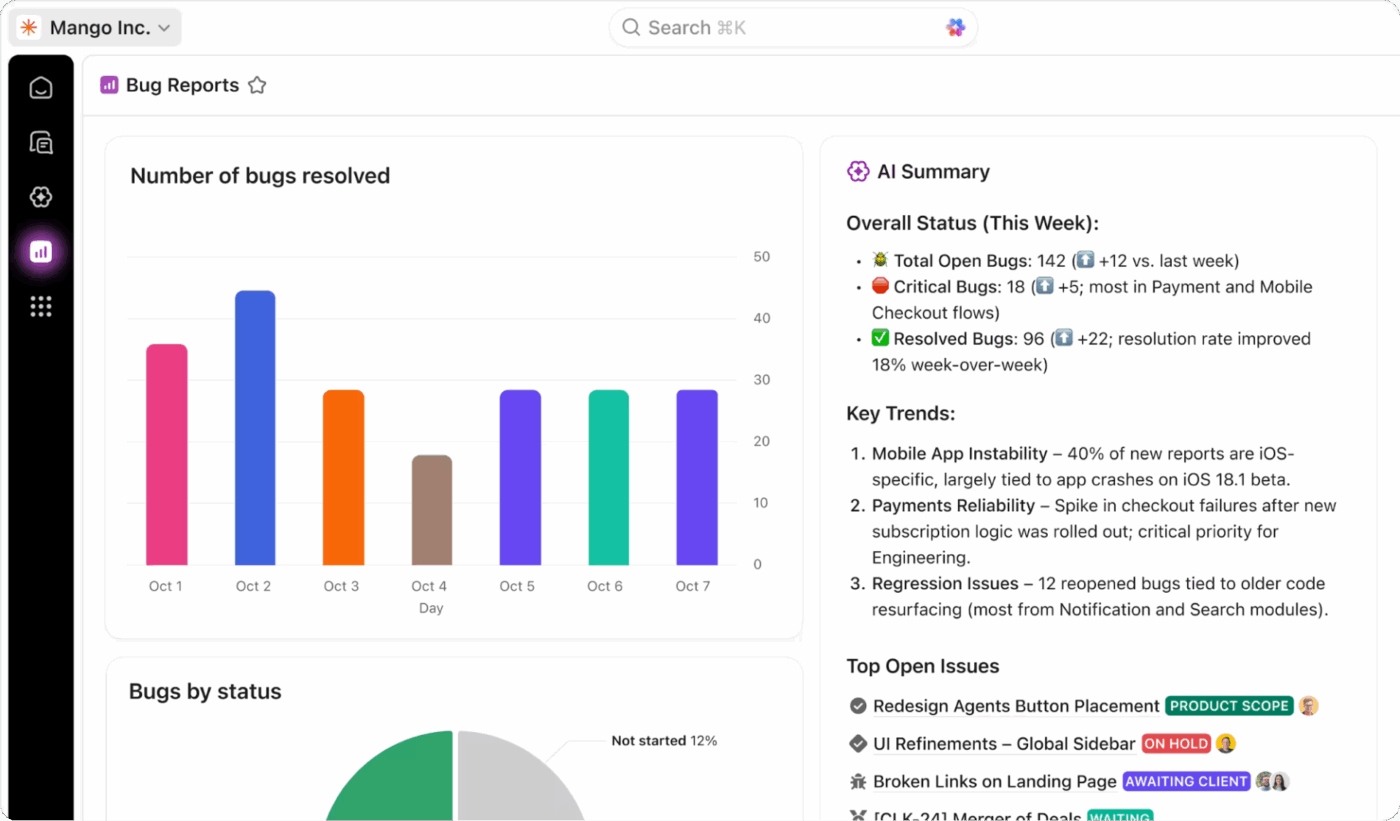

أخيرًا، قم بإنشاء لوحات معلومات تمنح القادة رؤية في الوقت الفعلي لبرنامجك لتقليل التحيز.

قم بتضمين لوحات تعرض الحوادث المفتوحة، ووقت الحل، ومعدلات إتمام التدقيق، ومقاييس العدالة، وحالة الامتثال عبر جميع النماذج النشطة. يمكن للوحات المعلومات التي لا تحتاج إلى كود في ClickUp سحب البيانات وتحديث المهام تلقائيًا مع تقدم العمل، مع ملخصات الذكاء الاصطناعي المدمجة في عرض لوحة المعلومات الخاصة بك.

📖 اقرأ المزيد: كيفية التغلب على التحديات الشائعة في مجال الذكاء الاصطناعي

فحوصات التحيز بعد النشر

لا تنتهي مهمتك عند بدء تشغيل نموذج الذكاء الاصطناعي.

في الواقع، هذا هو الوقت الذي يبدأ فيه الاختبار الحقيقي. يمكن أن "تنحرف" النماذج وتطور تحيزات جديدة بمرور الوقت مع تغير البيانات الواقعية التي تراها. المراقبة المستمرة هي الطريقة الوحيدة للكشف عن هذا التحيز الناشئ قبل أن يتسبب في ضرر واسع النطاق.

فيما يلي ما يجب أن تتضمنه عملية المراقبة المستمرة:

| الممارسة | ما يضمنه ذلك |

|---|---|

| تتبع الأداء حسب المجموعة | يقيس باستمرار دقة النموذج وعدالته عبر الشرائح السكانية بحيث يتم اكتشاف التباينات في وقت مبكر. |

| كشف انحراف البيانات | يراقب التغييرات في بيانات الإدخال التي قد تؤدي إلى ظهور تحيز جديد أو إضعاف أداء النموذج بمرور الوقت |

| حلقات تغذية مرتدة من المستخدمين | يوفر قنوات واضحة للمستخدمين للإبلاغ عن النتائج المتحيزة أو غير الصحيحة، مما يحسن الرقابة في العالم الواقعي. |

| عمليات التدقيق المجدولة | يضمن إجراء تحليلات متعمقة ربع سنوية أو نصف سنوية لسلوك النموذج ومقاييس الإنصاف ومتطلبات الامتثال. |

| الاستجابة للحوادث | يحدد عملية منظمة للتحقيق في أي حالات تحيز يتم الإبلاغ عنها وتصحيحها وتوثيقها. |

💟 مكافأة: تحتاج أنظمة الذكاء الاصطناعي التوليدي، على وجه الخصوص، إلى مزيد من اليقظة لأن مخرجاتها أقل قابلية للتنبؤ بها بكثير من نماذج التعلم الآلي التقليدية. ومن التقنيات الرائعة لتحقيق ذلك فريق الاختبار، حيث يحاول فريق متخصص بشكل نشط إثارة استجابات متحيزة أو ضارة من النموذج لتحديد نقاط ضعفه.

على سبيل المثال، يعد مشروع Lighthouse التابع لشركة Airbnb دراسة حالة رائعة في هذا المجال لشركة تطبق مراقبة منهجية للتحيز بعد النشر.

إنها مبادرة بحثية تدرس كيفية تأثير الانتماء العرقي المتصور على نتائج الحجز، مما يساعد الشركة على تحديد التمييز على المنصة والحد منه. وهي تستخدم أساليب آمنة للخصوصية، وتتعاون مع جماعات حقوقية، وتترجم النتائج إلى تغييرات في المنتجات والسياسات، مما يتيح لمزيد من الضيوف تصفح المنصة دون مواجهة عقبات غير مرئية.

📖 اقرأ المزيد: الذكاء الاصطناعي التوليدي مقابل الذكاء الاصطناعي التنبئي: فهم الاختلافات بينهما وتطبيقاتهما

تخفيف تحيز الذكاء الاصطناعي باستخدام ClickUp

إن بناء ذكاء اصطناعي عادل وخاضع للمساءلة هو التزام مؤسسي.

عندما تعمل سياساتك وموظفيك وعملياتك وأدواتك في انسجام تام، فإنك تنشئ نظام حوكمة قادرًا على التكيف مع المخاطر الجديدة والاستجابة السريعة للحوادث وكسب ثقة الأشخاص الذين يعتمدون على منتجاتك.

بفضل المراجعات المنظمة والوثائق الواضحة وسير العمل القابل للتكرار للتعامل مع التحيز، تظل الفرق متوافقة ومسؤولة، بدلاً من الرد في أوقات الأزمات.

من خلال تجميع كل شيء داخل ClickUp، من سجلات النماذج إلى نتائج التدقيق إلى تقارير الحوادث، يمكنك إنشاء طبقة تشغيلية واحدة حيث تكون القرارات شفافة والمسؤوليات واضحة ولا تضيع التحسينات في خضم التغييرات.

الحوكمة القوية لا تبطئ الابتكار، بل تثبته. هل أنت مستعد لدمج التخفيف من التحيز في سير عمل الذكاء الاصطناعي لديك؟ ابدأ مجانًا مع ClickUp وابدأ في بناء برنامج حوكمة الذكاء الاصطناعي الخاص بك اليوم.

الأسئلة المتداولة

تتمثل الخطوة الأولى الهامة في إجراء تدقيق للتحيز في أنظمة الذكاء الاصطناعي الحالية لديك. سيُظهر لك هذا التقييم الأساسي أين توجد حالات عدم الإنصاف حاليًا ويساعدك على تحديد أولويات جهودك للتخفيف من حدة هذه الحالات.

تستخدم الفرق مقاييس عدالة محددة، مثل التكافؤ الديموغرافي، وتساوي الاحتمالات، ونسبة التأثير المتباين، لتقييم التحيز. يعتمد المقياس الصحيح على حالة الاستخدام المحددة ونوع العدالة الأكثر أهمية في هذا السياق.

يجب عليك دائمًا إضافة خطوة المراجعة البشرية للقرارات عالية المخاطر التي تؤثر بشكل كبير على حياة الشخص أو فرصه، مثل التوظيف أو الإقراض أو الرعاية الصحية. من الحكمة أيضًا استخدامها أثناء النشر المبكر لأي نموذج جديد عندما لا يزال سلوكه غير متوقع.

نظرًا لأن الذكاء الاصطناعي التوليدي يمكن أن ينتج مجموعة لا حصر لها من الاستجابات غير المتوقعة، فلا يمكنك الاكتفاء بالتحقق من الدقة. تحتاج إلى استخدام تقنيات الفحص النشط مثل فريق الاختبار الأحمر وأخذ عينات النتائج على نطاق واسع لمعرفة ما إذا كان النموذج ينتج محتوى متحيزًا في ظل ظروف مختلفة.