AIバイアスは技術的な問題のように見えるかもしれません。しかしその影響は現実世界に現れ、しばしば壊滅的な結果をもたらすことがあります。

AIシステムが少しでも誤った方向に傾くと、不公平な結果を招く可能性があります。

そして時間の経過とともに、こうした小さな問題が顧客の不満、評判の悪化、さらには予期せぬコンプライアンス上の問題へと発展する可能性があります。

ほとんどのチームは意図的にバイアスのかかったAIを構築しようとしているわけではありません。データが不完全であること、現実世界が均一でないこと、そして使用するツールが常に期待通りに動作しないことが原因で発生します。良い知らせは、何が起きているかを理解するためにデータサイエンティストである必要はないということです。

本ブログでは、AIバイアスが実際に何であるか、なぜ発生するのか、そして日常的なビジネスツールにおいてどのように現れるのかを解説します。

AIバイアスとは何か?

AIバイアスとは、AIシステムが特定の集団を常に有利または不利にする体系的で不公平な結果を生み出す現象です。これはランダムなエラーではなく、AIの意思決定プロセスに組み込まれた予測可能なパターンです。その原因は?AIが学習するデータに、既存の人間の偏見、その他の無意識のバイアス、社会的不平等が反映されているためです。

次のように考えてみてください:採用アルゴリズムを、管理職の90%が男性だった10年間の企業データで訓練すると、AIは男性であることが管理職の重要な役割であると誤って学習する可能性があります。AIが悪意を持っているわけではありません。単に示されたパターンを識別し、繰り返しているだけです。

AIバイアスが厄介な理由は以下の通りです:

- それはランダムではなく体系的なもの: 不公平さは単発の不具合ではなく、AIの出力が示す再現可能なパターンである

- それは往々にして見えない: 偏った結果は、一見中立的なアルゴリズムの複雑な数学的処理の陰に隠れてしまうため、発見が困難です

- その根源はデータと設計にある: バイアスは、人間がAIを構築・訓練する際に下す選択を通じてシステムに侵入する

⭐ 機能テンプレート

ClickUpのインシデント対応レポートテンプレートは 、インシデントの記録・追跡・解決を最初から最後まで行うための既成の構造を提供します 。関連するインシデントの詳細をすべて記録し、明確に分類されたステータスを維持し、深刻度、影響を受けたグループ、修復手順などの重要な属性を捕捉します。承認者、インシデントメモ、関連文書などのカスタムフィールドをサポートしており、レビュープロセス全体を通じて説明責任と証拠を可視化するのに役立ちます。

📖 詳細はこちら:リスク評価の実施方法:ツールと手法

AIバイアス軽減が重要な理由

AIシステムが不公平な場合、実在する人々の生活に害を及ぼすリスクがあります。

これにより、組織は深刻なビジネス上の課題に直面し、顧客との信頼関係を築くために努力してきた成果さえも損なう可能性があります。

融資を拒否したり、就職申請を却下したり、誤った推奨を行うバイアスのかかったAIは、深刻な現実世界の結果をもたらします。

新興の業界標準とフレームワークは、組織がAIシステム内のバイアスを積極的に特定し対処することを推奨しています。リスクはあらゆる角度から組織に襲いかかります:

- 規制リスク:新たなAI基準を満たさない場合、重大なビジネス上の課題が生じる可能性があります

- 評判の毀損: あなたのAIに偏りがあると公に知られた場合、信頼を取り戻すことは極めて困難です

- 業務効率の低下:バイアスのかかったモデルは信頼性の低い結果やAIの幻覚を生成し、誤った意思決定を招き、高額な修正を必要とする

- 倫理の責任:組織は導入する技術が全てのユーザーを公平に扱うことを保証すべきです

バイアス軽減を適切に実施すれば、人々が実際に信頼できるAIシステムを構築できます。公正なAIは新たな市場への扉を開き、意思決定の質を高め、倫理的なビジネス運営へのコミットメントを広く示すことになります。

📮 ClickUpインサイト:回答者の22%は、仕事でのAI利用に依然として警戒心を抱いています。この22%のうち、半数はデータプライバシーを懸念し、残りの半数はAIの提示する情報を信頼できるか確信が持てないとしています。

ClickUpは、堅牢なセキュリティ対策と、回答ごとにタスクや情報源への詳細リンクを生成することで、両方の懸念に直接対処します。

これにより、最も慎重なチームでさえ、情報の保護や結果の信頼性について心配することなく、生産性向上の恩恵を享受できるようになります。

AIバイアスの種類と発生源

バイアスは複数の方向からAIシステムに潜り込む可能性があります。

データ収集を開始した瞬間からシステム導入後長期間にわたり、この要素は比較的安定しています。しかし、どこに注目すべきかを知っていれば、努力をターゲットにし、不公平な結果との終わりのない「モグラたたき」状態を終わらせることが可能です。

サンプリングバイアス

サンプリングバイアスとは、AIの訓練に使用するデータが、AIが実際に使用される現実世界を正確に反映していない場合に生じる現象です。

例えば、主にアメリカ英語話者のデータで訓練された音声認識システムを構築した場合、スコットランドやインドのアクセントを持つ人々の理解に当然ながら苦労します。これは、LLMが履歴書スクリーニングにおいて85.1%の確率で白人に関連付けられた名前を優先する現象と類似しています。この過小評価は巨大な盲点を生み出し、モデルが特定の集団全体に対応する準備ができていない状態に陥らせます。

アルゴリズムバイアス

アルゴリズムバイアスは、データが中立に見えても、モデルの設計や数学的処理が不公平なパターンを増幅させることで発生します。

個人の郵便番号が融資の可否を決めるべきではありません。しかし、トレーニングデータ内の郵便番号が人種と強い相関関係にある場合、アルゴリズムは場所を差別の代用指標として学習してしまう可能性があります。

この問題はフィードバックループによってさらに深刻化する——偏った予測(融資拒否など)が新たなデータとしてシステムに再投入されると、偏りは時間とともに増幅されるだけである。

人間の意思決定バイアス

AIシステム構築時に人間が行うあらゆる選択が、バイアスを組み込む可能性があります。

これには、収集するデータの選定、そのラベル付け方法、モデルの「成功」の定義が含まれます。例えば、チームは無意識のうちに、既に信じていることをサポートするデータに偏る(確認バイアス)、あるいは最初に目にした情報に過度に重きを置く(アンカリングバイアス)可能性があります。

善意に満ちたチームでさえ、自らの仮定や世界観を意図せずAIシステムに組み込んでしまう可能性があります。

📖 詳細はこちら:タスク管理のための10つのプロジェクトガバナンステンプレート

現実世界におけるAIバイアスの例

実在する企業は、AIシステムにバイアスが認められた際に重大な結果に直面し、数百万ドルの損害賠償と顧客信頼の喪失を招いています。以下に記録された例をいくつか挙げます:

1. バイアスのかかった採用ツール

最もよく引用される事例の一つは、大手テック企業が内部採用用AIシステムを廃棄したケースだ。このシステムは、採用成功者の大半が男性だった10年分の履歴書で訓練された結果、女性候補者を男性候補者より不利に扱うことを学習した。そのため「女性向け」といった単語を含む履歴書を不利に評価し始め、女子大学の卒業生さえも評価を下げるようになった。

これは、過去のパターンが既存の不平等を反映している場合、履歴データバイアスが注意深く監査されない限り、自動化に潜り込む可能性があることを示しています。しかし、AIを活用した自動化された採用がより一般的になるにつれ、この問題の規模はさらに大きくなっています。

🌼 ご存知ですか? 最近のデータによると、採用活動においてジェネレーティブAIツールを「積極的に統合」または「実験的に導入」している組織は37%に達し、1年前の27%から増加しています。

2. 人口の半数を認識できない顔認証技術

ジョイ・ブオラムウィニが主導し 『ジェンダー・シェイズ』研究で報告された調査によると、 商用顔認識システムは肌の色が濃い女性に対して最大34.7%のエラー率を示したのに対し 、肌の色が薄い男性では1%未満であった。

これもまた、不均衡なトレーニングデータセットを反映したものです。生体認証ツールにおけるバイアスは、さらに広範な影響を及ぼします。

警察や政府機関も偏った顔認識技術の問題に直面している。ワシントン・ポスト紙 の調査によれば、こうしたシステムの一部は社会的弱者層の人物を誤識別する可能性が著しく高いことが判明した 。実際の事例では、これが不当逮捕や世論の反発を招き、こうしたツールが個人の権利に与える影響に対する重大な懸念を引き起こしている。

📖 詳細はこちら:職場におけるAI:生産性と効率性を向上させる方法

3. 医療ケアを軽視するヘルスケアアルゴリズム

追加ケアを必要とする患者を予測するように設計されたAIシステムにもバイアスが認められています。

あるよく記録された事例では、広く利用されていた 医療予測アルゴリズムが重大なエラーを引き起こした。本来は追加ケアを必要とする患者の選定を支援するはずだったが、実際には黒人患者の優先度を低くするという体系的な偏りが生じ、白人患者と同等かそれ以上に病状が重い場合でも同様の結果となった。

この現象は、モデルが医療費支出を医療ニーズの代用指標として使用したために発生しました。黒人患者は医療へのアクセス格差により歴史的に医療費支出が低かったため、アルゴリズムは彼らをニーズが低いと判定。結果として、実際に最も必要とする人々から医療資源が遠ざけられました。研究者らは、この代用指標を修正するだけで公平な医療プログラムへのアクセスが大幅に改善されることを発見しました。

こうした問題に対する懸念から、市民権団体は医療AIにおける「公平性を最優先とする基準」の導入を強く求めている。2025年12月、NAACPは詳細な青写真を発表し、病院・技術企業・政策立案者に対し、人種的健康格差の拡大を防ぐため、バイアス監査、透明性のある設計手法、包括的枠組み、AIガバナンスツールの採用を要請した。

4. 不平等な結果をもたらすクレジットアルゴリズム

AIと自動化された意思決定は、ソーシャルメディア上で目にする情報を形作るだけでなく、誰がどのような条件で資金にアクセスできるかにも影響を与えています。

最も話題となった実例の一つは、ゴールドマン・サックスが発行するデジタルクレジットカード「Apple Card」から生まれた。

2019年、ソーシャルメディア上で顧客が「このカードの与信リミットアルゴリズムが、一部の男性に対して妻や女性パートナーよりもはるかに高いリミットを設定している」と共有した。これは、夫婦が類似した財務プロフィールを報告した場合でも発生していた。あるソフトウェアエンジニアは「妻の20倍ものリミットを付与された」と述べ、アップル共同創業者のスティーブ・ウォズニアック氏も配偶者に関する同様の体験を認めている。

これらのパターンは公の抗議を引き起こし、ニューヨーク州金融サービス局によるアルゴリズムが女性を差別しているかどうかの規制調査につながった。これは自動化された金融ツールが不平等な結果を生み出す可能性を浮き彫りにした。

📖 詳細はこちら:AIを活用したデータガバナンスの方法(ユースケースとツール)

5. 特定の声を排除する自動化された字幕と音声認識

音声認識や自動字幕生成システムは、しばしばすべての人の声を平等に聞き取れない。複数の研究が示すように、これらのツールは特定の話者に対してより高い精度を発揮する傾向がある。その要因には、アクセント、方言、人種、英語が母語かどうかなどが含まれる。

これは、商用システムが通常、特定の話し方(多くの場合西洋の標準英語)が支配的なデータセットで訓練されるため、他の声が過小評価される結果となる。

例えば、スタンフォード大学の研究者らは主要5社の音声認識システム(Amazon、Google、Microsoft、IBM、Apple)をテストしたところ、黒人話者のテキスト転写では白人話者と比べてほぼ2倍のエラーを発生 させることが判明しました。この問題は、被験者が同じ条件下で同じ言葉を話した場合でも発生しました。

特定の話者に対する字幕が不正確な場合、ユーザー体験の悪化や字幕に依存する人々へのアクセシビリティの阻害を招きます。さらに深刻なのは、採用・教育・医療現場で音声認識を利用するシステムにおいて、偏った結果を生み出す要因となり得る点です。

これらの例はそれぞれ、偏った訓練データ、不適切な代理変数の選択、代表性に欠けるテストを通じて、自動化システムにバイアスが組み込まれる異なる方法を示しています。いずれの場合も、結果は技術的な問題にとどまりません——それは機会を形作り、信頼を損ない、現実的なビジネスリスクと倫理的リスクを伴うのです。

📖 詳細はこちら:リスクと問題の違いとは?

要約:AIバイアスの現れ方とその被害を受ける人々

| バイアスが発生した箇所 | 影響を受けたのは誰か | 実社会への影響 |

|---|---|---|

| 採用アルゴリズム(廃止されたAI採用ツール) | 女性 | 履歴書は性別に基づくキーワードによって評価を下げられ、面接や就職機会へのアクセスが制限されました。 |

| 顔認識システム(ジェンダーシェイズ+不当逮捕事例) | 肌の色が濃い女性;社会的弱者となる人種グループ | はるかに高い誤識別率が誤った逮捕、評判の毀損、公民権上の懸念を引き起こした。 |

| 医療リスク予測アルゴリズム(シカゴ大学研究) | 黒人患者 | 医療費支出が医療ニーズの誤った代用指標として用いられたため、患者は追加ケアの優先順位を下げられ、健康格差が悪化した。 |

| 与信リミットアルゴリズム(Apple Card調査) | 女性 | 男性は同等の資格を持つ女性パートナーよりも大幅に高いクレジットリミットを受け取り、金融アクセスと借入能力に影響を与えた。 |

| 音声認識と自動字幕(スタンフォード大学ASR研究) | 非標準的なアクセントを持つ話者;黒人の話者 | エラー率がほぼ倍増したことで、採用・教育・日常的なデジタルアクセスに用いられるツールにおいて、アクセシビリティの障壁、意思疎通の誤り、偏った結果が生じました。 |

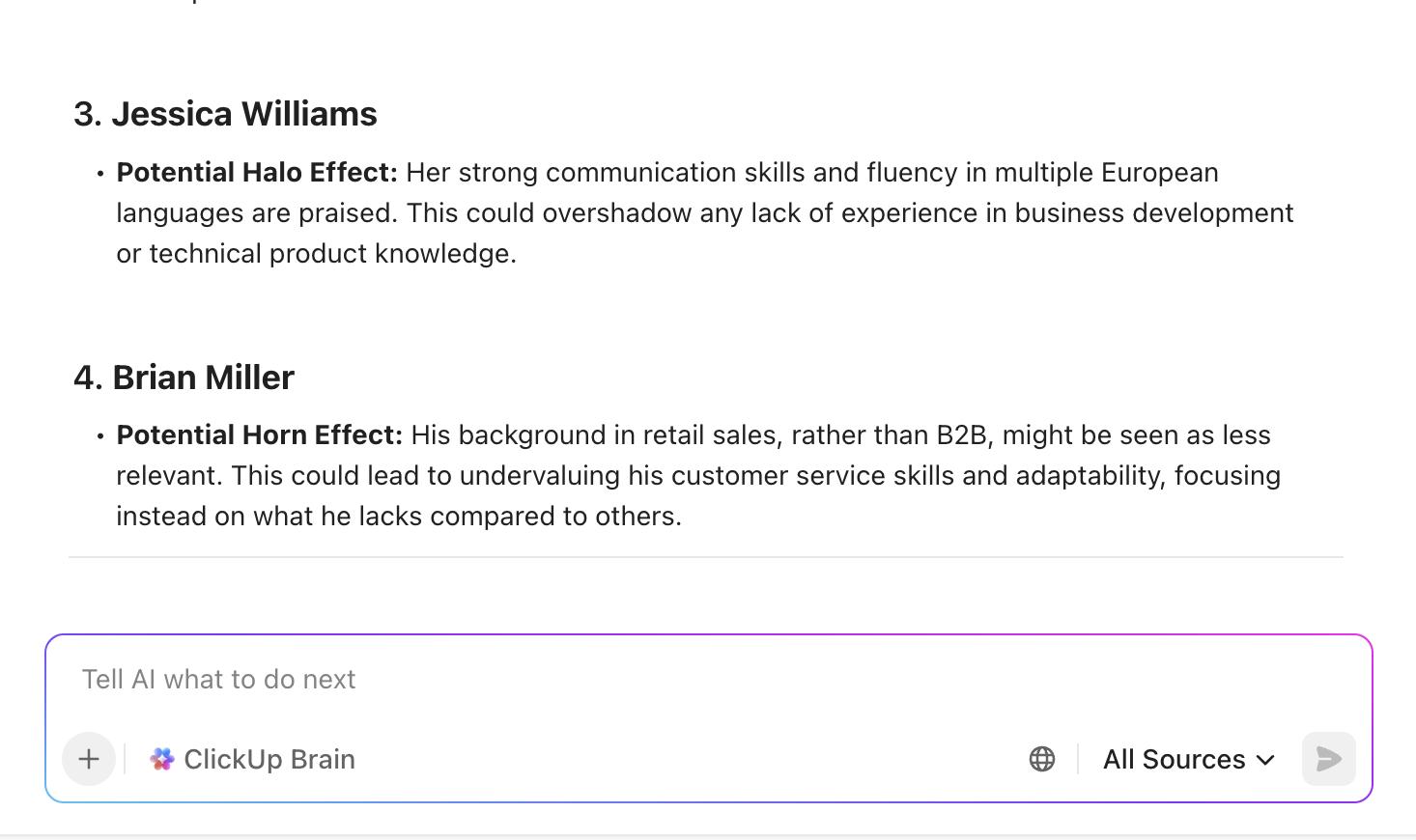

📖 詳細はこちら:ハロー効果とホーン効果を回避しバイアスを軽減する方法

効果的なバイアス軽減戦略

AIバイアスを根絶する魔法の特効薬は存在しません。

効果的なバイアス軽減には、AIライフサイクル全体に適用する多層的な防御策が必要です。これらの実証済み戦略を組み合わせることで、不公平な結果のリスクを大幅に低減できます。

多様なトレーニングデータを収集する

代表性のあるデータは、公平なAIの絶対的な基盤です。

モデルは、トレーニング中に一度も見たことのない人々のグループに対応する方法を学習できません。まず既存データセットを監査し、人口統計上のギャップを特定してください。その後、過小評価されている集団から新たなデータを意識的に収集する努力をしましょう。

実世界のデータが入手困難な場合、データ拡張(既存データの改変コピーを作成する手法)や合成データ生成といった技術を活用し、不足分を補うことが可能です。

🚧 ツールキット:ClickUpの内部監査チェックリストテンプレートを活用し、監査プロセスを体系化しましょう。

モデルをバイアスについてテストする

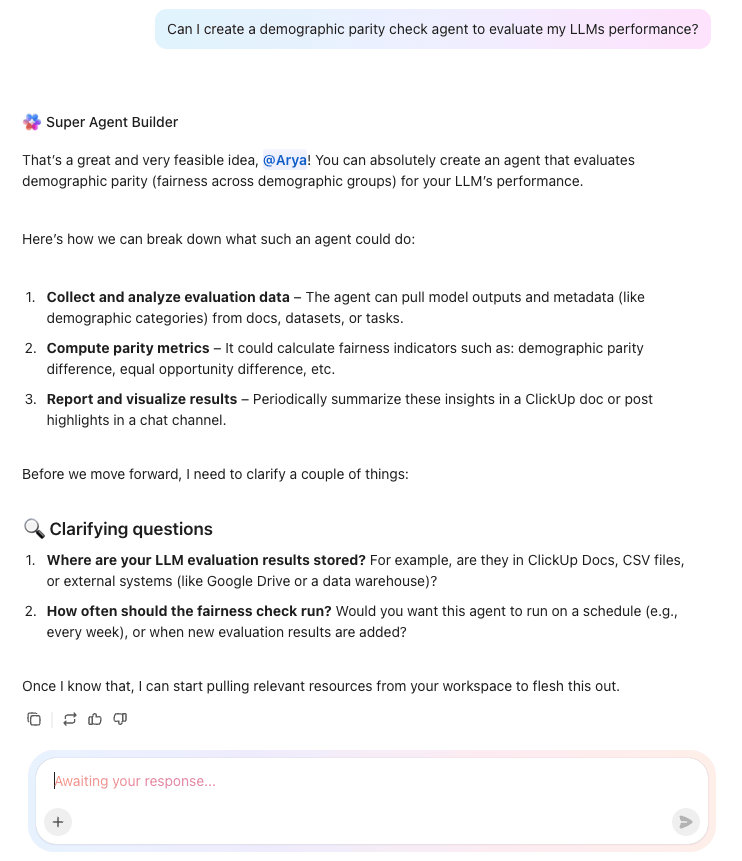

実際の被害が生じる前にバイアスを検出するには、体系的なテストが不可欠です。公平性メトリクスを用いて、モデルが異なるグループ間でどのように機能するかを測定しましょう。

例えば、人口統計学的均等性チェックは、モデルがグループ間で同等の割合で肯定的な結果(融資承認など)を生成するかを検証する一方、均等化されたオッズチェックはエラー率が等しいかを検証する。

人種、性別、年齢、地域などあらゆる属性ごとにモデルの性能を分析し、精度が低下する箇所や不公平性が潜む箇所を特定しましょう。

人間の関与を維持する

自動化されたシステムは、人間なら即座に気づくような、文脈に依存した微妙な不公平性を見逃す可能性があります。高リスクな意思決定においては、AIが提案を行い、最終判断を人間が下す「ヒューマン・イン・ザ・ループ」アプローチが不可欠です。

これは特に採用、融資、医療診断などの分野で重要です。これを機能させるには、人間のレビュー担当者がバイアスを認識できるよう訓練され、AIの提案を上書きする権限を持つ必要があります。

📖 詳細はこちら:職場における人間中心のAI活用法:究極のガイド

アルゴリズムの公平性技術を活用する

技術的手法を用いて直接介入しバイアスを低減することも可能です。これらの技術は主に以下の3つのカテゴリーに分類されます:

- 前処理: これは、モデルがトレーニングデータを見る前にデータを調整することを含み、多くの場合、データの再加重や再サンプリングによって、異なるグループをより均等に表現するようにします。

- インプロセッシング: ここでは、公平性の制約をモデルのトレーニングプロセスに直接組み込み、精度と公平性の両方を同時に最適化するよう学習させます。

- 後処理:これは、モデルによる最終予測が生成された後に調整を加え、グループ間で公平な結果が得られるようにすることを意味します。

これらの手法にはトレードオフが伴うことが多く、公平性を大幅に向上させるためには、全体的な精度をわずかに低下させる必要がある場合があります。

💟 特典:BrainGPTはAI搭載のデスクトップコンパニオンです。GPT-5、Claude、Geminiなど複数の主要モデルを1か所で利用可能にし、AIバイアステストを新たな次元へ引き上げます。

これにより、異なるモデル間で同じプロンプトやシナリオを簡単に実行し、推論能力を比較し、応答が分岐したりバイアスを示す箇所を特定できます。このAIスーパーアプリでは、音声入力でテストケースを設定し、発見事項を記録し、結果を整理して並列分析することも可能です。

高度な推論と文脈認識ツールにより、問題のトラブルシューティング、パターンの可視化、各モデルのセンシティブトピックへの対応方法の理解を支援します。ワークフローの集中管理と透明性の高いマルチモデルテストを実現するBrain MAXは、AIバイアスの監査・比較・是正を確信と精度をもって可能にします。

透明性と説明可能性を高める

モデルがどのように判断を下しているか理解していなければ、誤った判断を修正できません。説明可能なAI(XAI)技術は「ブラックボックス」の内部を覗き、予測を駆動しているデータ特徴量を可視化する手助けをします。

モデルカードを作成することも可能です。これはAIの栄養ラベルのようなもので、その意図された用途、性能データ、既知の制限事項を文書化します。

📮ClickUpインサイト: アンケート回答者の13%が、困難な意思決定や複雑な問題解決にAIを活用したいと考えています。しかし、仕事で定期的にAIを利用していると答えたのはわずか28%です。その理由の一つは、セキュリティ上の懸念でしょう!

ユーザーは、機密性の高い意思決定データを外部AIと共有することを望まない可能性があります。

ClickUpは、AIを活用した問題解決機能をセキュアなワークスペースに直接導入することでこの課題を解決します。SOC 2からISO規格まで、ClickUpは最高水準のデータセキュリティ基準に準拠し、ワークスペース全体で生成AI技術を安全に活用するお手伝いをします。

AIガバナンスと説明責任に関するポリシー

強力なAIガバナンスプログラムは、明確な所有権と一貫した基準を確立し、チーム全員が従うことができるようにします。

組織には、AIの構築と導入を倫理的に行う責任を常に誰かが負うことを保証する明確なガバナンス構造が必要です。

効果的なAIガバナンスプログラムの必須要素は以下の通りです:

| ガバナンス要素 | その意味 | 組織における具体的な行動ステップ |

|---|---|---|

| 明確な所有権 | AIの倫理、監視、コンプライアンスについては、専任の担当者またはチームが責任を負います。 | • AI倫理責任者または部門横断型委員会の設置• データ、モデル品質、コンプライアンス、リスク管理の責任範囲を定義• 監督体制に法務、エンジニアリング、プロダクト、DEI(多様性・公平性・包摂性)の視点を組み込む |

| 文書化されたポリシー | AIライフサイクル全体におけるデータの収集、使用、監視方法を定義する文書化されたガイドライン | • データソース、ラベル、プライバシー、保持に関する社内ポリシーの策定• モデル開発、検証、展開の基準を文書化• AIシステムのリリース前にチームがチェックリストを遵守することを義務付ける |

| 監査証跡 | 意思決定、モデルバージョン、データセット、変更内容の透明性のある記録 | • データセットとモデルに対するバージョン管理を実施する• 重要な意思決定、モデルパラメーター、レビュー結果を記録する• 監査証跡を中央のアクセス可能なリポジトリに保存する |

| 定期的なレビュー | AIシステムの継続的評価によるバイアス、ドリフト、コンプライアンスギャップのチェック | •堅牢なLLM評価による四半期または半期ごとのバイアス評価をスケジュール化• パフォーマンス低下や挙動変化時にモデルの再トレーニングまたは再調整を実施• 主要なデータ更新や製品変更後のモデルレビューを実施 |

| インシデント対応プラン | AIのバイアスや有害性を特定・レポート作成・修正するための明確な手順 | • 内部バイアスエスカレーションワークフローの構築• 問題調査の方法と修正承認者の定義• 必要に応じたユーザー、顧客、規制当局への連絡ステップの策定 |

💡プロの秘訣: NIST AIリスク管理フレームワークやEU AI法(年間売上高の最大7%の罰金規定あり)などの枠組みは、独自のガバナンスプログラム構築のための優れた青写真を提供します。

ClickUpでバイアス軽減を実装する方法

ClickUpの統合型AIワークスペースは、AIガバナンスプログラムのあらゆる要素を1つの整理されたワークスペースに集約します。

チームはツール間を行き来したり文脈を喪失したりすることなく、タスク管理、ポリシー保存、監査結果のレビュー、リスク議論、インシデント追跡が可能です。すべてのモデル記録、意思決定ログ、是正プランは相互にリンクされているため、誰が何をなぜ行ったのかを常に把握できます。

ClickUp AIはワークスペース内の仕事内容を理解しているため、過去の評価を抽出したり、長文レポートを要約したり、基準が変化する中でもチームの連携を維持する手助けができます。その結果、AIの活用範囲が拡大するにつれて、より追跡しやすく、監査しやすく、はるかに信頼性の高いガバナンス体制が実現します。

これをワークフローとして分解してみましょう!

ステップ1:AIガバナンスワークスペースを設定する

まず、ClickUp内にガバナンス関連仕事専用のスペースを作成します。モデルインベントリ、バイアス評価、インシデントレポート、ポリシー文書、定期レビューの各リストを追加し、プログラムの全要素を単一の管理環境下に集約します。

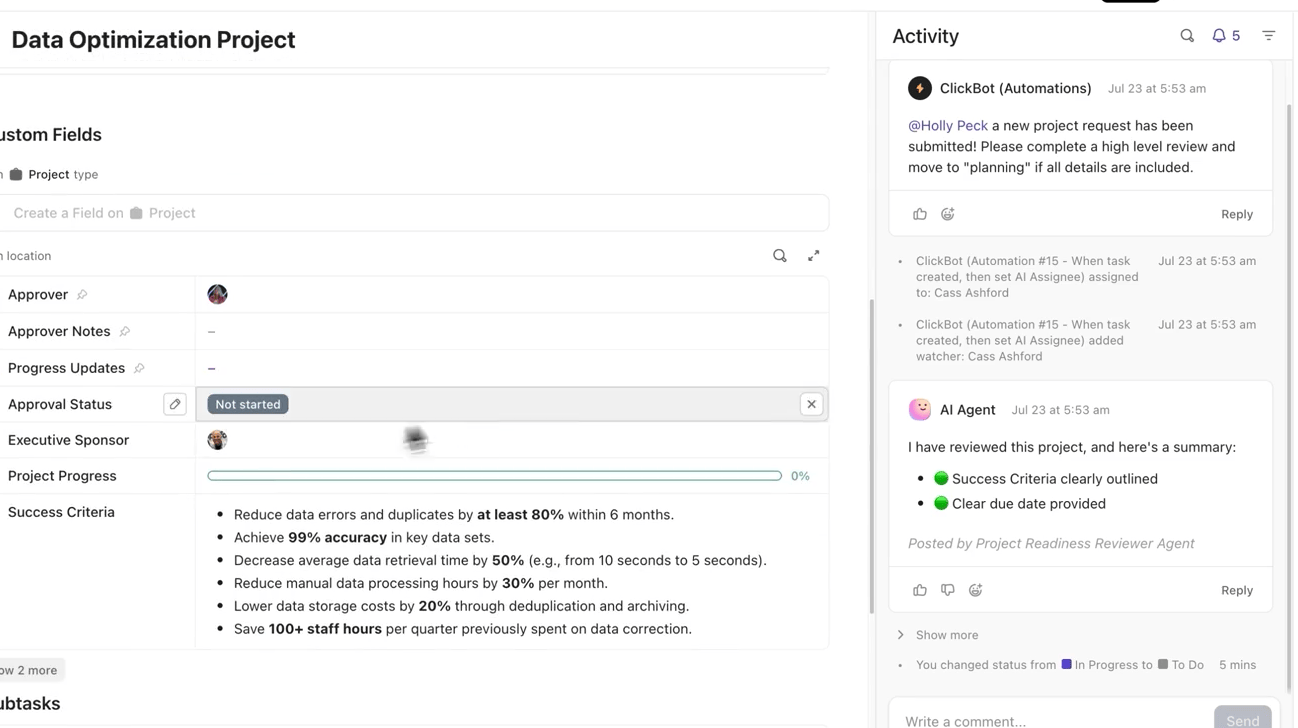

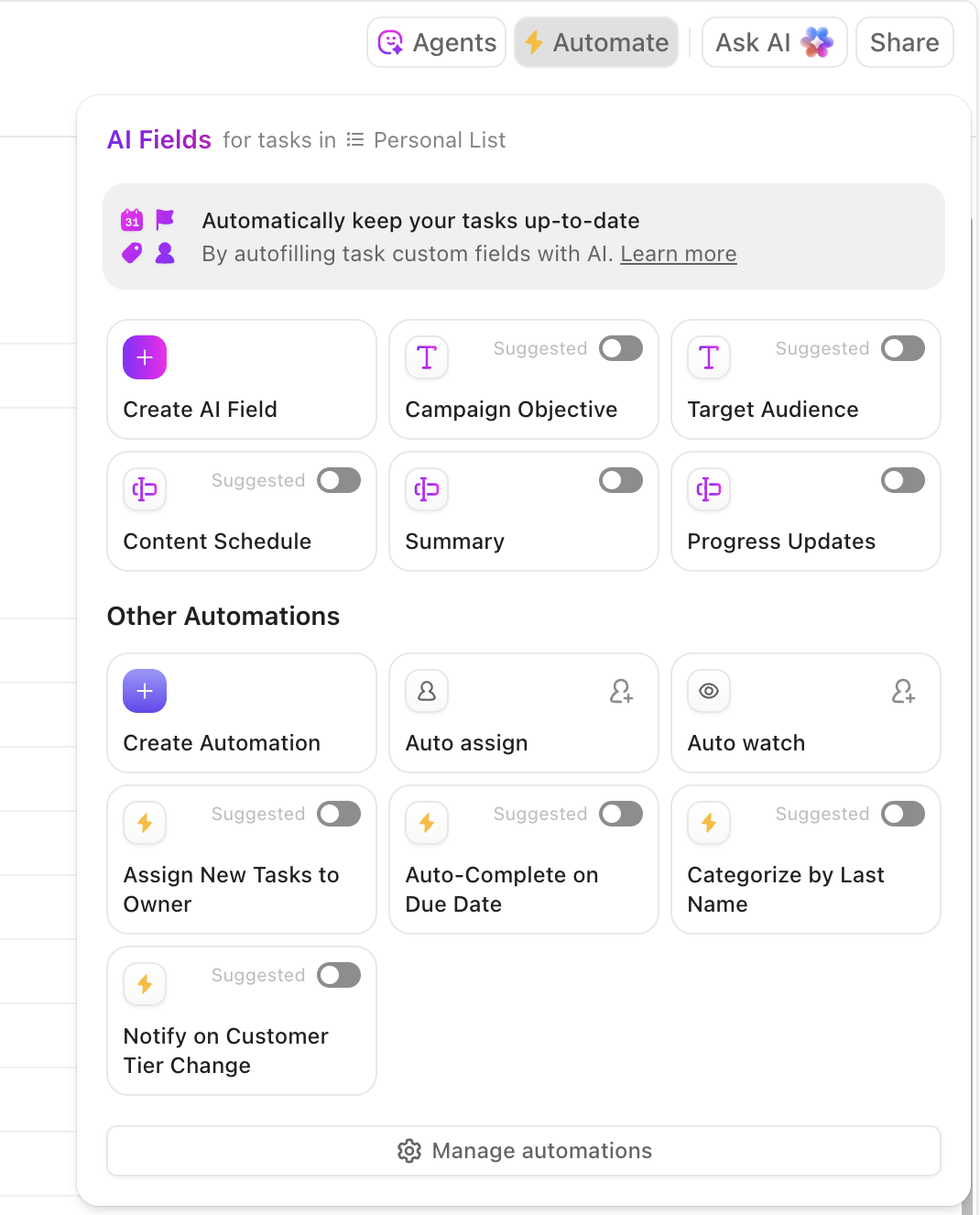

カスタムフィールドまたはAIフィールドを設定し、公平性メトリクス、バイアススコア、モデルバージョン、レビューステータス、リスクレベルを追跡します。ロールベースの許可管理により、承認されたレビュアー、エンジニア、コンプライアンス責任者のみが機密性の高いAI仕事にアクセスできるようにします。これにより、競合他社の単機能ツールや汎用プロジェクトプラットフォームでは提供できない構造的な基盤が構築されます。

ステップ2:ガバナンスフレームワークの構築

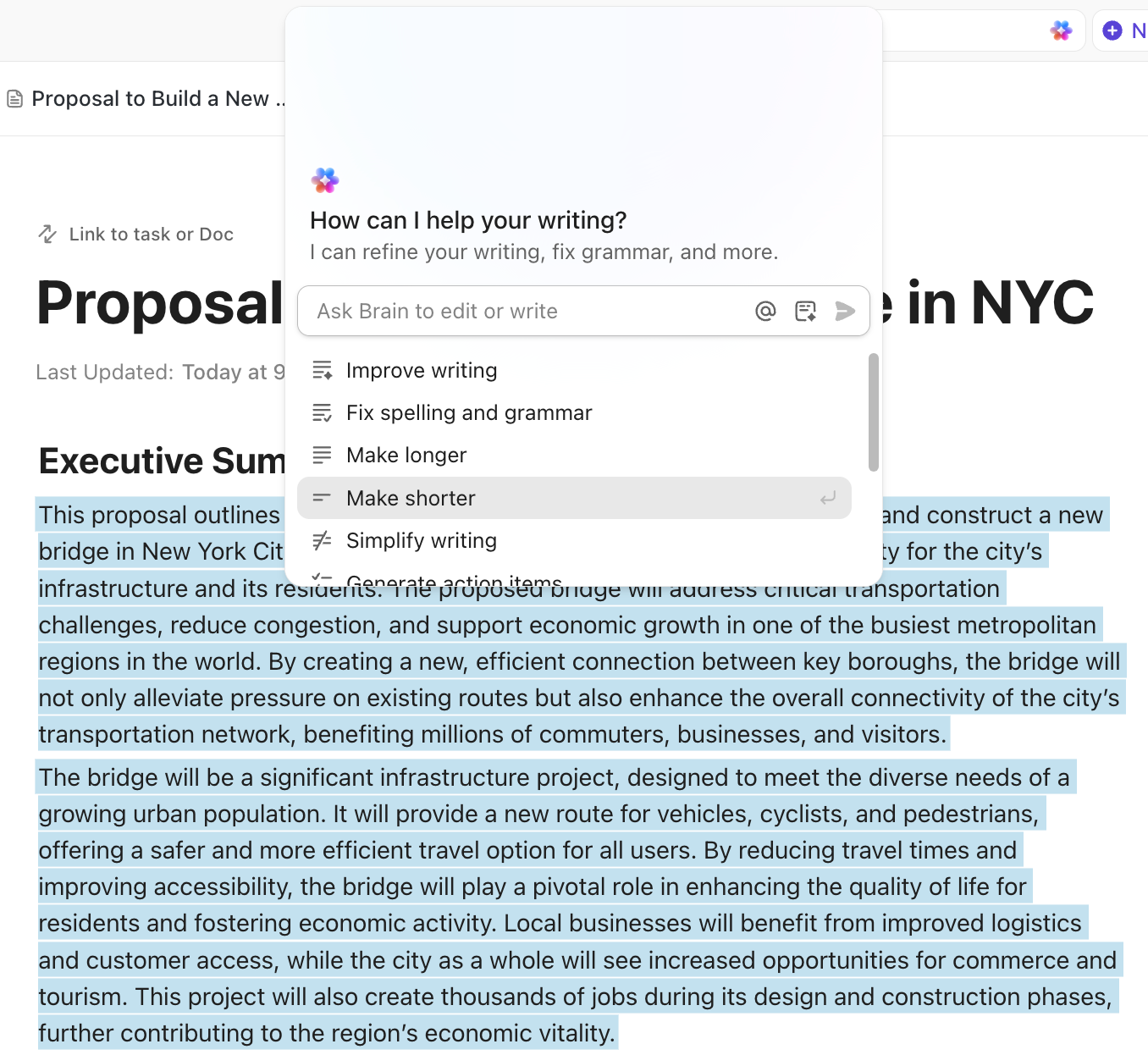

次に、ClickUpドキュメントを作成し、常に更新されるガバナンスプレイブックとして活用します。ここでは、バイアス評価手順、公平性の閾値、モデル文書化ガイドライン、人間が関与するステップ、エスカレーション手順を明記します。

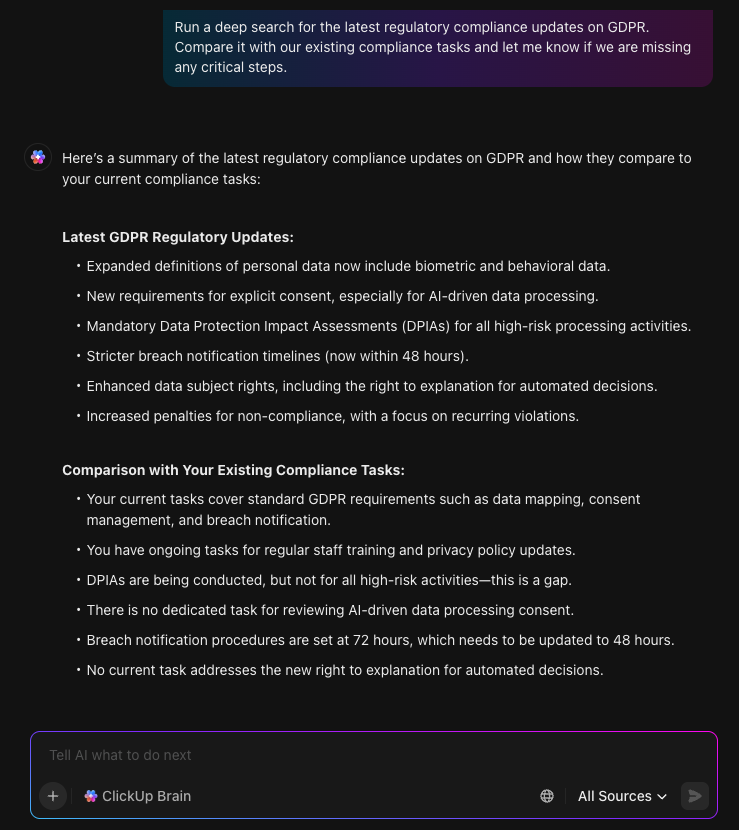

ドキュメントはタスクやモデル記録と常に接続しているため、チームはバージョン履歴を喪失したりツール間でファイルが散らばったりすることなく共同作業が可能です。さらにClickUp Brainは外部規制の要約、新規ポリシー文言の起草、過去の監査結果の抽出を支援し、ポリシー作成の一貫性と追跡可能性を高めます。

ウェブ検索が可能で、複数のAIモデルを切り替え、情報を明確なガイダンスに統合できるため、チームはワークスペースを離れることなく、新たな基準や業界の変化を常に把握できます。必要なものすべて——ポリシー更新、規制に関する洞察、過去の決定事項——が一箇所に集約されるため、ガバナンスシステムはより安定し、維持管理が格段に容易になります。

ステップ3:すべてのモデルを登録する

各モデルは「モデルインベントリ」リストに固有のタスクを持つべきであり、これにより所有権と責任が常に明確になります。

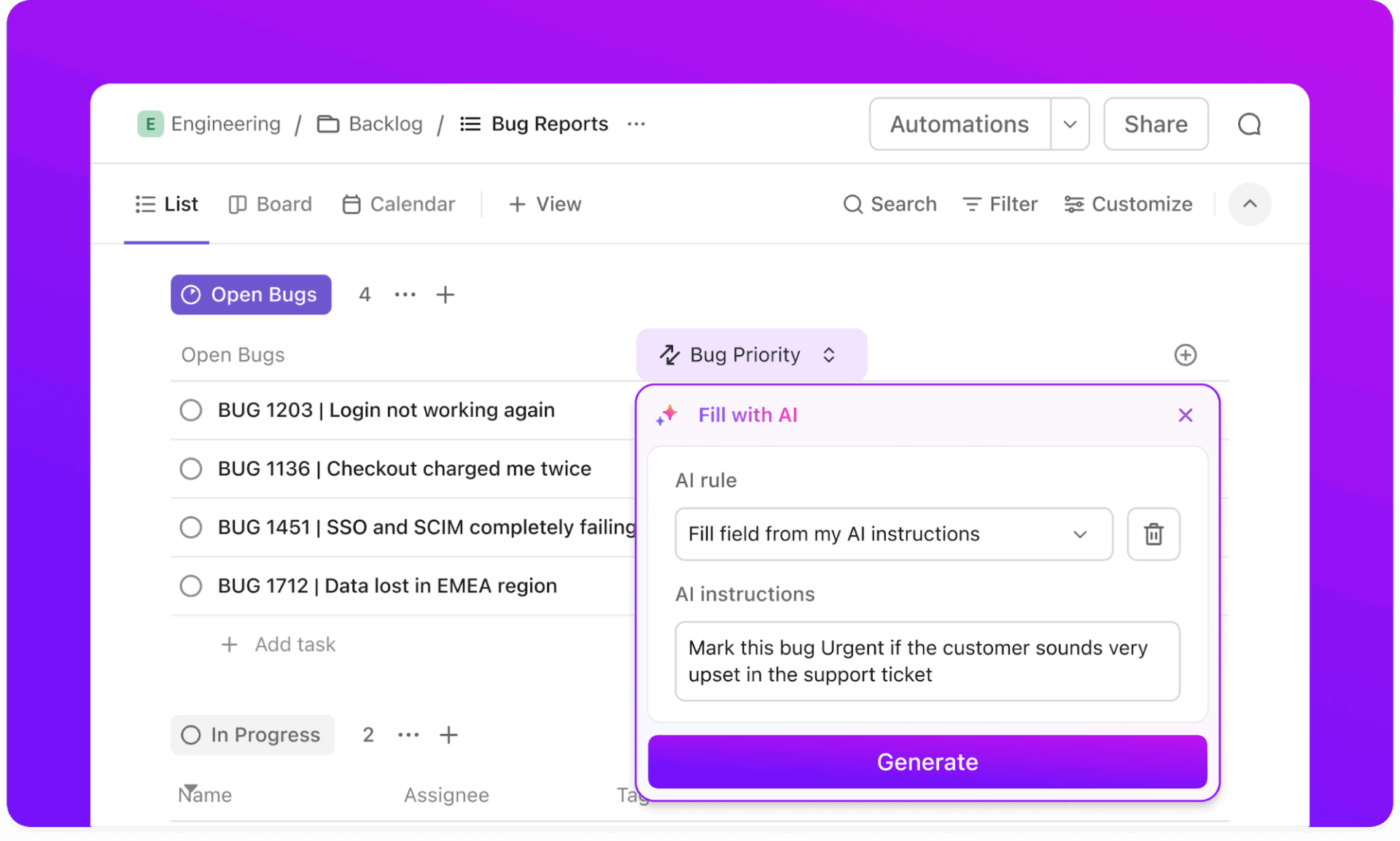

ClickUpタスクと ClickUpカスタムフィールドを活用し、バイアス評価ワークフローを体系化して重要な詳細をすべて捕捉することで、あらゆるバイアスインシデントをアクション可能なアイテムとして容易に追跡できます。

これにより、バイアスの種類、深刻度レベル、是正ステータス、担当チームメンバー、次回レビュー日を追跡でき、すべての問題に明確な所有権と期限が設定されます。

データセット、評価要約、データ系譜メモを添付し、すべてを一箇所に集約します。これにより、モデルがステージング環境や本番環境に移行するたびに、自動化機能によってレビュー担当者に通知が行われます。

ステップ4:定期的およびイベントベースのバイアス監査を実施する

バイアス監査は、定期的なスケジュールと特定のトリガー発生時、両方のタイミングで実施すべきです。

ClickUp自動化でシンプルなルールを設定し、モデルが新たなデプロイメントマイルストーンに到達した時や定期監査の期日が到来した時に、自動的にレビュータスクをトリガーしましょう。四半期ごとのバイアス評価を二度と見逃すことはありません。自動化が適切なレビュアーを割り当て、正しい期限を設定し、期日が近づくとリマインダーまで送信します。

イベントベースの監査では、ClickUp Formsがバイアスインシデント報告や人間のフィードバック収集を簡素化。審査担当者はカスタムフィールドで公平性のギャップ、テスト結果、改善提案を記録します。各フォーム提出はタスクとしてチームに自動割り当てされ、反復可能な監査プロセスを構築します。

ステップ5:バイアスインシデントの調査と解決

バイアス問題が特定されたら、深刻度、影響を受けたグループ、モデルバージョン、必要な緩和仕事を記録するインシデントタスクを作成します。AIエージェントは高リスクな発見事項をコンプライアンス責任者にエスカレーションし、適切なレビュー担当者とエンジニアを割り当てます。

各軽減措置、テスト結果、検証ステップはインシデント記録と常にリンクされています。ClickUp Brainは経営陣向け要約を生成したり、ガバナンス文書用の是正措置メモ作成を支援したりでき、すべての情報を透明かつ追跡可能に保ちます。

ステップ6:AIガバナンスプログラムの健全性を監視する

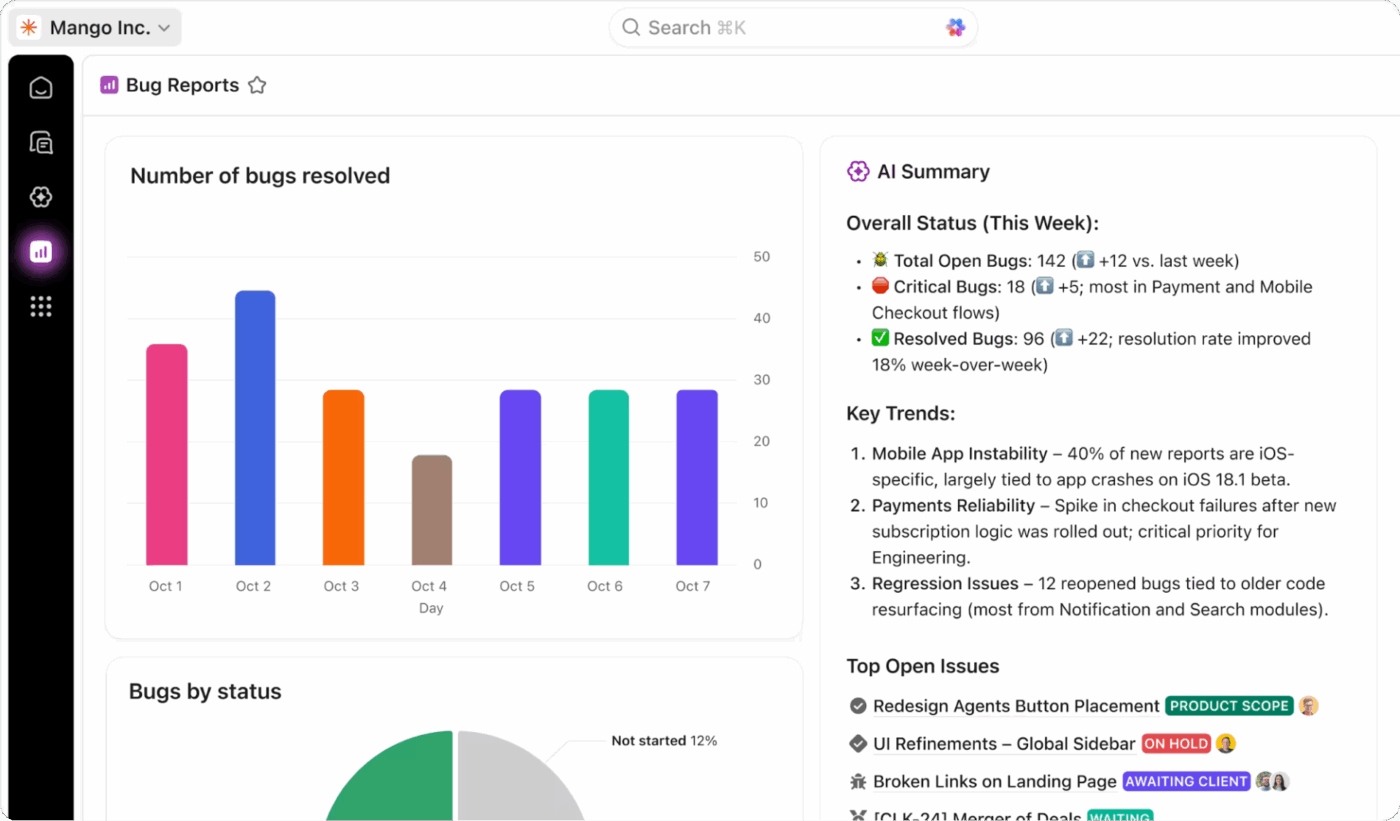

最後に、リーダーがバイアス軽減プログラムのビューをリアルタイムで把握できるダッシュボードを構築しましょう。

すべての稼働モデルにおいて、未解決インシデント、解決までの時間、監査完了率、公平性メトリクス、コンプライアンス状況を表示するパネルを含めます。ClickUpの ノーコードダッシュボード は、作業の進捗に合わせてデータを自動取得し タスクを更新。ダッシュボードビューに組み込まれたAIサマリー機能も活用できます 。

📖 詳細はこちら:よくあるAIの課題を克服する方法

導入後のバイアス検証

AIモデルが稼働した時点で、あなたの仕事は完了ではありません。

実際、真の試練はこの時点から始まる。モデルは、処理する実世界のデータが変化するにつれて「ドリフト」を起こし、新たなバイアスを発達させることがある。この新たなバイアスが広範な被害をもたらす前に捕捉する唯一の方法は、継続的な監視である。

継続的なモニタリングには以下を含めるべきです:

| 実践 | 保証される内容 |

|---|---|

| グループ別パフォーマンス追跡 | 人口統計セグメント全体でモデルの精度と公平性を継続的に測定し、不均衡を早期に検出します |

| データドリフト検出 | 入力データの変化を監視し、新たなバイアスを導入したり、時間の経過とともにモデルの性能を低下させたりする可能性を検知します。 |

| ユーザーフィードバックループ | ユーザーが偏った出力や誤った出力を報告するための明確なチャネルを提供し、実世界の監視体制を強化します。 |

| 定期監査 | 四半期または半期ごとに、モデル動作、公平性メトリクス、コンプライアンス要件に関する詳細な分析を確実に実施します。 |

| インシデント対応 | 報告されたバイアスイベントを調査、修正、文書化するための構造化されたプロセスを定義します。 |

💟 補足:特に生成AIシステムは、従来の機械学習モデルよりも出力が予測しにくいため、特別な警戒が必要です。このための優れた手法がレッドチームングです。これは、専用のチームがモデルから偏ったまたは有害な応答を引き出そうと積極的に試み、その弱点を特定する手法です。

例えば、Airbnbの「Project Lighthouse」は、導入後の体系的なバイアス監視を実施している企業の優れた業界事例です。

これは、認識される人種が予約結果に与える影響を検証する研究イニシアチブであり、プラットフォーム上の差別を特定・削減する取り組みを支援します。プライバシー保護手法を採用し、市民権団体と連携し、調査結果を製品・ポリシー変更に反映させることで、より多くのゲストが目に見えない障壁に遭遇することなくプラットフォームを利用できるようにします。

📖 詳細はこちら:生成AIと予測AIの違いと応用分野を理解する

ClickUpでAIバイアスを軽減する

公平で説明責任のあるAIの構築は、組織としての取り組みです。

ポリシー、人材、プロセス、ツールが調和して機能するとき、新たなリスクに適応し、インシデントに迅速に対応し、製品を信頼する人々からの信頼を獲得できるガバナンス体制が構築されます。

構造化されたレビュー、明確な文書化、バイアス対応のための再現可能なワークフローにより、チームは危機対応モードで反応するのではなく、連携と責任を保ち続けます。

モデル記録から監査結果、インシデント報告まで、すべてをClickUp内に一元化することで、意思決定が透明化され、責任範囲が明確化され、改善策が混乱の中で埋もれることのない単一の運用基盤を構築します。

強固なガバナンスはイノベーションを遅らせません。むしろ安定させます。AIワークフローにバイアス軽減機能を組み込む準備はできていますか?ClickUpで無料で始め、今日からAIガバナンスプログラムの構築を始めましょう。

よくある質問

既存のAIシステムに対するバイアス監査を実施することが、優れた第一歩です。この基礎評価により、現在どこに不公平性が存在するかが明らかになり、軽減策の優先順位付けに役立ちます。

Teamsは、人口統計的均等性、均等化されたオッズ、不均衡な影響比率などの特定の公平性メトリクスを用いてバイアスを定量化します。適切なメトリクスは、具体的なユースケースと、その文脈で最も重要な公平性の種類によって異なります。

採用、融資、医療など、個人の生活や機会に重大な影響を与えるハイリスクな意思決定には、常に人間のレビューステップを追加すべきです。また、新しいモデルの初期導入段階では、その挙動がまだ予測不可能なため、レビューを活用することが賢明です。

生成AIは予測不可能な応答をほぼ無限の範囲で生成するため、単純な正確性チェックでは不十分です。レッドチームングや大規模出力サンプリングといった能動的検証手法を用いて、モデルが様々な条件下でバイアスのあるコンテンツを生成しないかを確認する必要があります。