Hugging Face hat ein beeindruckendes Ökosystem für ML-Entwickler aufgebaut, das von einem riesigen Modell-Hub bis hin zu nahtlosen Bereitstellungstools reicht.

Manchmal erfordert Ihr Projekt jedoch etwas anderes. Vielleicht benötigen Sie eine spezielle Infrastruktur, Sicherheit auf Enterprise-Niveau oder benutzerdefinierte Workflows, die andere Hugging Face-Alternativen besser bewältigen können.

Ganz gleich, ob Sie Chatbots entwickeln, LLMs optimieren oder NLP-Pipelines betreiben, die Ihren Datenwissenschaftler vor Freude weinen lassen würden – es gibt eine Reihe von Plattformen, die bereit sind, Ihre KI-Anforderungen zu erfüllen.

In diesem Blog haben wir die besten Alternativen zu Hugging Face zusammengestellt, von leistungsstarken Cloud-APIs über Open-Source-Toolkits bis hin zu End-to-End-KI-Workflow-Plattformen.

Die besten Hugging Face-Alternativen auf einen Blick

Hier finden Sie einen Vergleich der besten Hugging Face-Alternativen. 📄

| Tool | Am besten geeignet für | Beste Features | Preise* |

| ClickUp | Integrieren Sie KI direkt in Ihr tägliches Arbeitsmanagement – von Aufgaben über Dokumente bis hin zur Automatisierung. Teamgröße: Ideal für Einzelpersonen, Start-ups und Unternehmen. | KI Notetaker, Autopilot Agents, Brain MAX, Enterprise AI Search, Bildgenerierung auf Whiteboards, Zugriff auf Claude/ChatGPT/Gemini, Automatisierung über natürliche Sprache | Für immer kostenlos, benutzerdefinierte Anpassungen für Unternehmen verfügbar |

| OpenAI | Entwickeln Sie mit fortschrittlichen Sprachmodellen und APIs für Text, Bilder und EinbettungenTeamgröße: Ideal für KI-Entwickler und Startups, die mit LLMs arbeiten | Feinabstimmung, PDF-/Bildverarbeitung, semantische Dateianalyse, Kosten-Dashboards, Temperatur-/Systemabfragen | Nutzungsbasiert |

| Anthropic Claude | Schaffen Sie kontextreiche, sicherere Unterhaltungen und durchdachte LLM-Antworten Teamgröße: Ideal für Teams, die Sicherheit, einen langen Kontext und ethisches Denken benötigen. | Echtzeit-Websuche, strukturierte Ausgabegenerierung (JSON/XML), kontextbezogene Speicherung, Unterstützung für Mathematik/Statistik | Nutzungsbasiert |

| Cohere | Entwerfen Sie mehrsprachige und sichere NLP-Lösungen im Maßstab des Unternehmens Teamgröße: Ideal für compliance-orientierte Teams mit mehrsprachigen NLP-Anforderungen | Feinabstimmung privater Daten, Unterstützung von über 100 Sprachen, Analyse-Dashboards, skalierbare Inferenz, SSO/SAML/RBAC-Integration | Ab 0,0375 $/1 Mio. Token (Befehl R7B); benutzerdefinierte Preisgestaltung |

| Replicate | Erkunden und Ausführen von Open-Source-Modellen, ohne sich um Setup oder Server kümmern zu müssen Teamgröße: Ideal für Entwickler, die KI-Modelle testen oder MVPs erstellen | Forkable-Modelle, Versionskontrolle mit A/B-Tests, Batch-Vorhersagen und Webhook-Unterstützung | Pay-per-Use; Preise variieren je nach Modell |

| TensorFlow | Aufbau benutzerdefinierter Machine-Learning-Systeme mit maximaler Kontrolle Teamgröße: Ideal für ML-Ingenieure, die vollständige Modellkontrolle benötigen | TensorBoard-Überwachung, ONNX/SavedModel-Konvertierung, benutzerdefinierte Verlustfunktionen, Training mit gemischter Genauigkeit | Kostenlos (Open Source); Rechenleistung wird separat abgerechnet. |

| Azure Machine Learning | Verbindung von ML-Modellen mit dem Microsoft-Ökosystem durch Automatisierung und Skalierbarkeit Teamgröße: Ideal für Teams von Unternehmen im Azure-Ökosystem | AutoML, Auslöser für Nachschulungen, Erklärbarkeit von Modellen mit SHAP/LIME, Drift-Erkennung, skalierbare Rechencluster | Benutzerdefinierte Preisgestaltung |

| Google Gemini | Interaktion mit mehreren Datentypen – Text, Code, Bilder und Videos – über ein einziges KI-Modell Teamgröße: Ideal für multimodale Forschungs- und Analyseteams | Bild-/Diagrammverständnis, Python-Ausführung in Echtzeit, Video-Zusammenfassung, Schlussfolgerungen aus gemischten Eingaben | Kostenlos; kostenpflichtige Pläne je nach Modellzugriff verfügbar |

| Microsoft Copilot | Steigern Sie die Produktivität in Microsoft 365-Apps wie Word, Excel und OutlookTeamgröße: Ideal für Business-Benutzer im Microsoft 365-Ökosystem | Automatisierung von Excel-Funktionen, Erstellung von PPT-Folien, Entwurf von Tagesordnungen/E-Mails, Verknüpfung von Outlook-Aufgaben | Kostenlos; kostenpflichtige Pläne ab 20 $/Monat |

| IBM WatsonX | Einsatz von KI in stark regulierten Branchen mit vollständiger Überprüfbarkeit und Kontrolle Teamgröße: Ideal für Banken, das Gesundheitswesen und Organisationen des öffentlichen Sektors | Bias-Erkennung, Prompt-Sicherheitsvorlagen, Adversarial Robustness Testing, Human-in-the-Loop-Workflows | Kostenlos; kostenpflichtige Pläne ab 1.050 $/Monat |

| BigML. com | Erstellen und Erläutern von Vorhersagemodellen ohne Code- oder ML-Kenntnisse Teamgröße: Ideal für Analysten und No-Code-Benutzer | Visuelle Drag-and-Drop-Modellierung, Ensemble-Lernen, Clustering, Zeitreihenprognosen | 14-tägige kostenlose Testversion; kostenpflichtige Pläne ab 30 $/Monat |

| LangChain | Entwicklung von KI-Agenten und Workflows, die mehrere Modelle, Tools und APIs kombinieren Teamgröße: Ideal für KI-Entwickler, die agentenbasierte Tools erstellen | Verfolgung und Protokollierung, API-Aufruf-Caching, Fallback-Logik, Streaming-Antworten, benutzerdefinierte Evaluierungs-Frameworks | Kostenlos; kostenpflichtige Pläne ab 39 $/Monat |

| Weights & Biases | Maschinelles Lernen experimentell organisiert, reproduzierbar und leistungsorientiert halten Teamgröße: Ideal für ML-Forschungsteams und KI-Labore | Hyperparameter-Sweeps, Live-Dashboards, öffentliche Freigabe von Experimenten, GPU-Profiling und Versionsverwaltung für Experimente | Kostenlos; kostenpflichtige Pläne ab 50 $/Monat |

| ClearML | Verwaltung des gesamten MLOps-Lebenszyklus von der Nachverfolgung über die Orchestrierung bis hin zur Bereitstellung Teamgröße: Ideal für ML-Teams mit hohem Betriebsaufwand und interne Infrastruktur | Audit-Protokollierung, Blue-Green-Bereitstellung, CI/CD-Integration, Off-Peak-Planung, Modellregistrierung, Reproduzierbarkeitstools | Kostenlos; kostenpflichtige Pläne beginnen bei 15 $/Monat pro Benutzer. |

| Amazon SageMaker | Ausführen, Optimieren und Skalieren von ML-Modellen nativ auf AWS-Infrastruktur Teamgröße: Ideal für AWS-basierte Teams, die in großem Maßstab entwickeln | Ground Truth-Datenbeschreibung, verwaltete Notizbücher, automatische Hyperparameter-Optimierung, skalierbare Endpunkte, CloudWatch-Überwachung | Unified Studio: Kostenlos; andere Preise hängen von Rechenleistung und Nutzung ab. |

Wie wir Software bei ClickUp bewerten

Unser Redaktionsteam folgt einem transparenten, forschungsgestützten und herstellerneutralen Prozess, sodass Sie darauf vertrauen können, dass unsere Empfehlungen auf dem tatsächlichen Wert des Produkts basieren.

Hier finden Sie eine detaillierte Übersicht darüber, wie wir Software bei ClickUp bewerten.

Warum Sie sich für Alternativen zu Hugging Face entscheiden sollten

Hier sind die Gründe, warum es sinnvoll ist, Alternativen zu Hugging Face zu erkunden:

- Maßgeschneiderte KI-Features: Finden Sie Plattformen mit spezialisierten großen Sprachmodellen für Nischenaufgaben wie Computer Vision oder fortgeschrittene NLP.

- Vereinfachte Workflows: Wählen Sie Lösungen mit einfacher Setup-Prozedur oder No-Code-Schnittstellen für schnelleres Prototyping und verbesserte betriebliche Effizienz.

- Kostengünstige Pläne: Entdecken Sie Optionen mit kostenlosen Stufen oder niedrigeren Preisen für budgetbewusstes Datenmanagement.

- Verbesserte Integrationsmöglichkeiten: Suchen Sie nach Tools, die eine nahtlose Synchronisierung mit Ihrer bestehenden Technologieumgebung ermöglichen, wie z. B. CRMs oder Cloud-Plattformen.

- Skalierbare Leistung: Entscheiden Sie sich für KI-Plattformen, die größere Datensätze verarbeiten oder eine schnellere Verarbeitung für große Projekte bieten.

- Stärkere Unterstützung für Unternehmen: Führen Sie eine Auswahl an Hugging Face-Alternativen durch, die Teams mit dediziertem Support unterstützen, die robuste und sichere Lösungen benötigen.

- Benutzerdefiniertes Modelltraining: Entdecken Sie Optionen mit erweiterter Feinabstimmung für einzigartige, leistungsstarke Modelle.

- Innovative Bereitstellungsoptionen: Wählen Sie Tools mit einzigartigen Hosting- oder Bereitstellungsmethoden für eine einfachere Skalierung.

🔍 Wussten Sie schon? Dank Transformatoren können Tools wie GPT und BERT ganze Sätze zusammen lesen. Sie erkennen Tonfall, Absicht und Kontext auf eine Weise, wie es ältere Modelle nie konnten. Deshalb klingt die KI von heute natürlicher, wenn sie antwortet.

Die besten Alternativen zu Hugging Face

Dies sind unsere Favoriten unter den besten Alternativen zu Hugging Face. 👇

1. ClickUp (am besten geeignet für die direkte Integration von KI in Projektmanagement, Dokumente und Workflows)

Jeder nutzt KI, aber das meiste davon findet in Silos statt. Sie haben ein tool zum Schreiben, ein anderes zum Zusammenfassen und ein drittes zum Planen, aber keines davon kommuniziert mit Ihrer Arbeit. Das führt zu mehr KI-Wildwuchs und unnötigem Chaos.

ClickUp löst dieses Problem, indem es KI dort einbindet, wo sie hilft: in Ihre Aufgaben, Dokumente und Team-Updates.

Schreiben, zusammenfassen und Automatisierung im Kontext

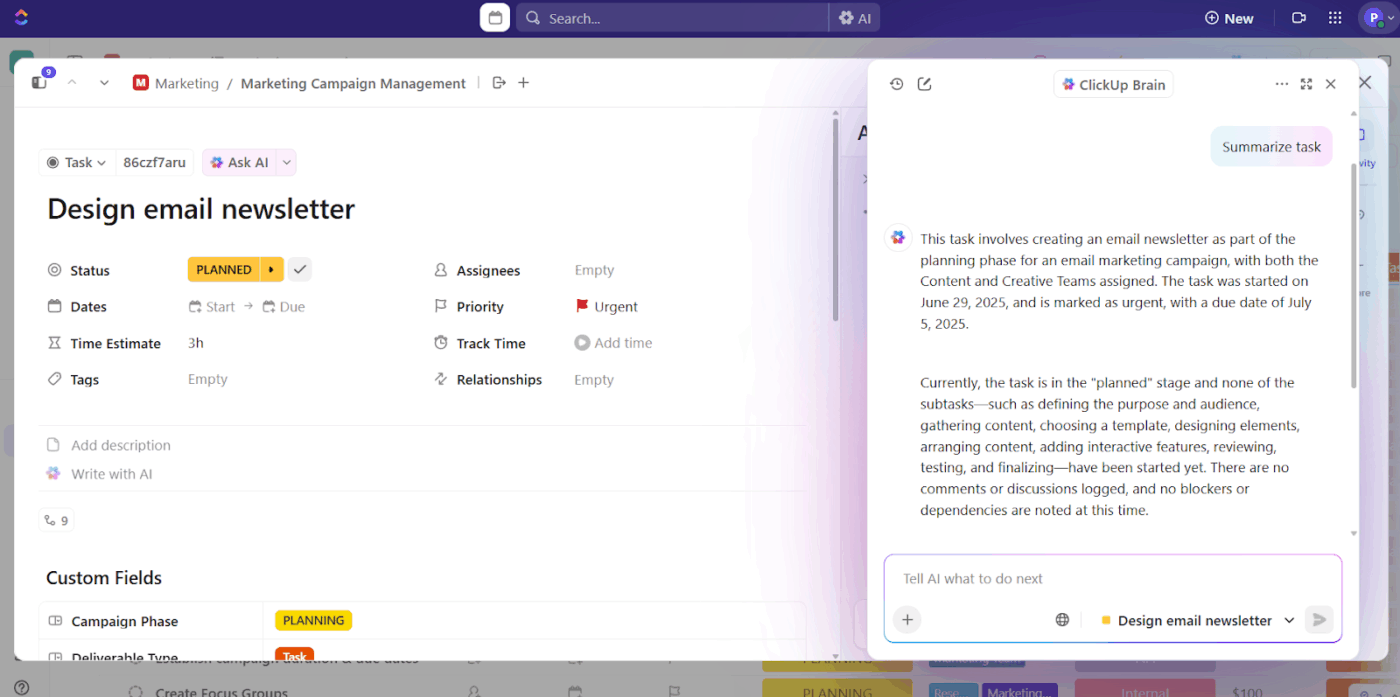

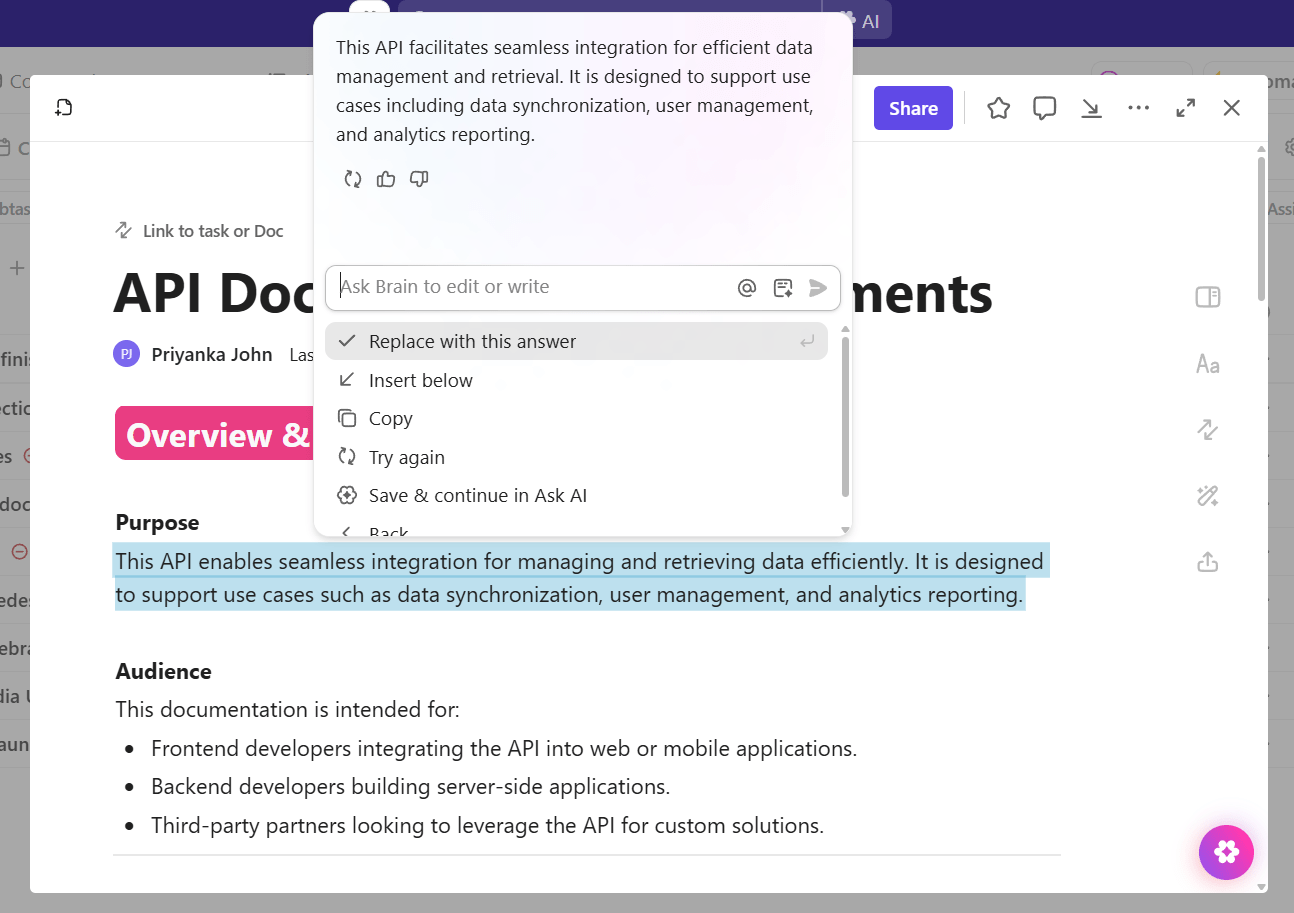

ClickUp Brain ist in jeden Teil der Plattform integriert. Es schreibt Inhalte, fasst Aktualisierungen zusammen, erstellt Berichte und überarbeitet unübersichtliche Aufgabenbeschreibungen – genau dort, wo die Arbeit stattfindet.

Angenommen, Sie dokumentieren API-Anforderungen für Entwickler.

Sie fügen technische Spezifikationen in ein ClickUp-Dokument ein, fügen Stichpunkte zu Authentifizierung und Ratenlimits hinzu und weisen dann ClickUp Brain an, eine entwicklerfreundliche Dokumentation mit Code-Beispielen zu erstellen.

Der vernetzte KI-Assistent strukturiert Ihre groben Notizen in übersichtliche Abschnitte, während er im Dokument verbleibt, wo Ihr Team darauf zugreifen kann.

Weitere Beispiele:

- Verwandeln Sie ein langes Meeting-Dokument in eine Projektbeschreibung für Ihren Teamleiter.

- Schreiben Sie vage Beschreibungen der Aufgaben um, um die nächsten Schritte klarer zu gestalten.

- Entwerfen Sie wiederkehrende Client-Updates anhand der Aktivitäten der Aufgaben der vergangenen Woche.

- Fassen Sie einen Planungs-Thread zusammen und weisen Sie den Eigentümern Folgeaufgaben zu.

Finden Sie Antworten, Blockaden und Berichte in Sekundenschnelle.

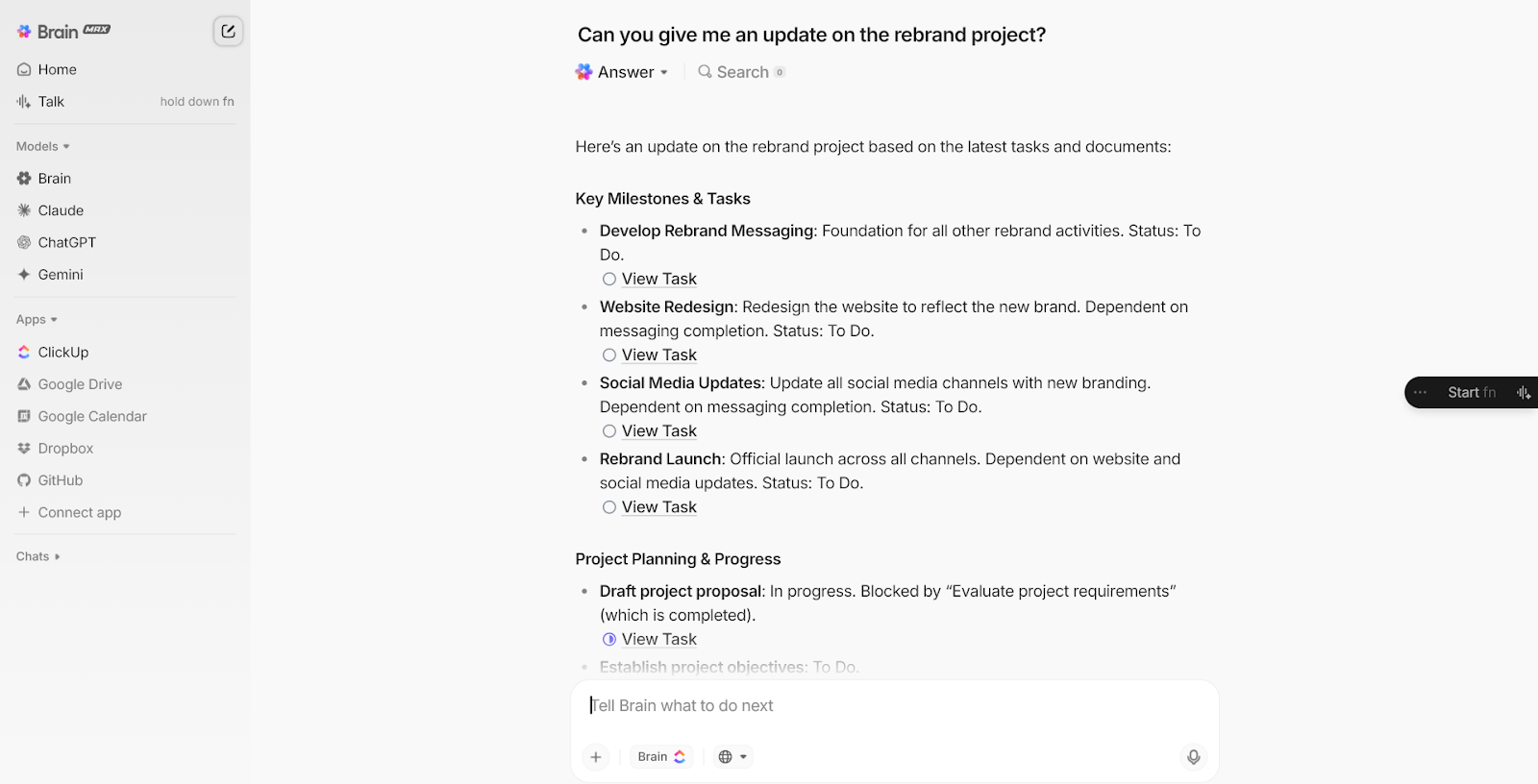

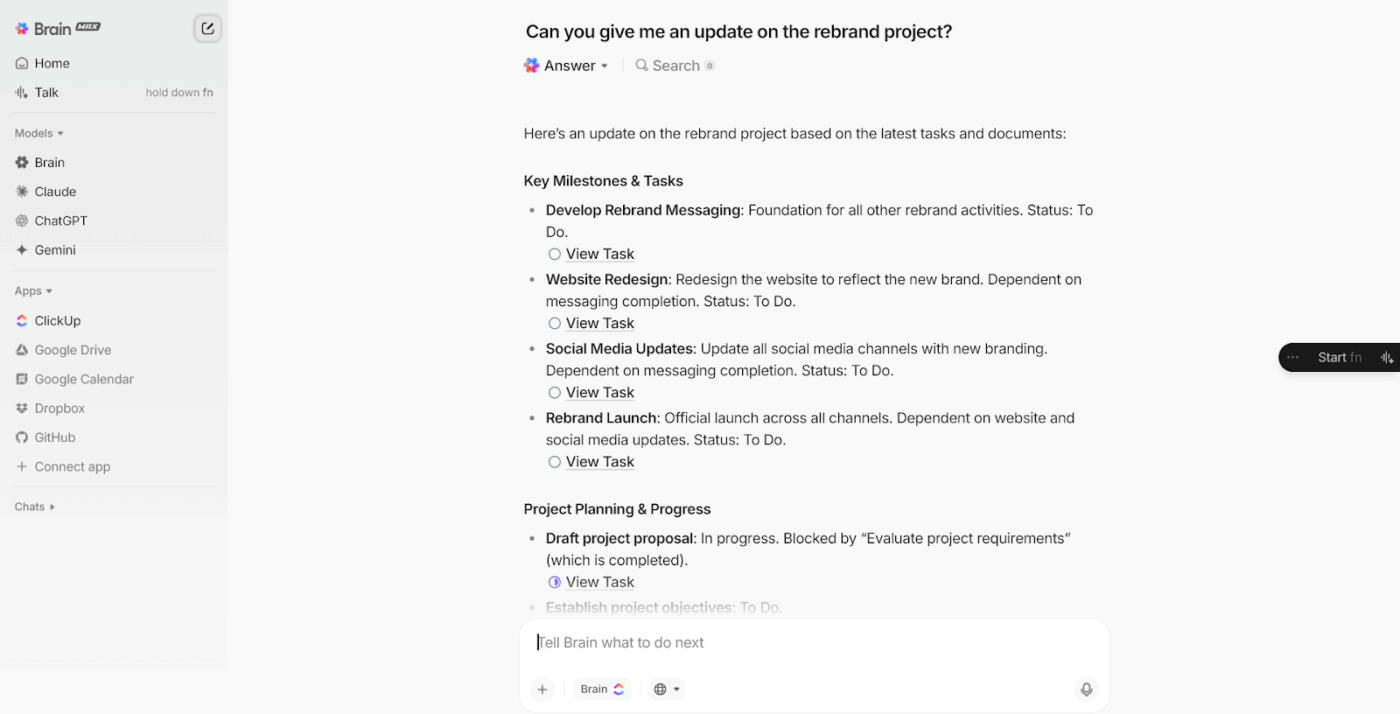

Ja, ClickUp Brain hilft Ihnen bei der Arbeit innerhalb von Aufgaben und Dokumenten. Aber manchmal muss man einen Schritt zurücktreten: einen konzentrierten Raum, um Fragen zu stellen, Klarheit zu gewinnen und schnell voranzukommen.

Genau dafür wurde ClickUp Brain MAX entwickelt.

Es bietet Ihnen einen dedizierten Bereich für die Arbeit mit KI, der von Ihren Aufgaben und Dokumenten getrennt, aber vollständig mit diesen verbunden ist. Als Ihr Desktop-KI-Begleiter hilft es Ihnen, Ihre Arbeit zu durchdenken, Antworten zu finden und schneller voranzukommen, ohne zwischen Tools wechseln oder den Kontext erneut erklären zu müssen.

Geben Sie eine Frage ein, und es werden Daten aus dem Live-Workspace abgerufen, nicht isolierte KI-Ausgaben. Es versteht den Projektkontext, die Prioritäten und Zuordnungen zu Eigentümern. Sie können Ihre Abfrage sogar laut aussprechen.

ClickUp Brain MAX ist sprachgesteuert, immer griffbereit und wurde entwickelt, um die mentale Belastung durch die Verwaltung der Arbeit zu reduzieren.

Nehmen wir an, Sie leiten eine funktionsübergreifende Produkteinführung. Sie fragen: „Was blockiert die Einführung der Kampagne?“ Brain MAX zeigt überfällige Aufgaben, zugewiesene Eigentümer, verknüpfte Dokumente und markierte Kommentare an, die zur Bearbeitung bereit sind.

Weitere Anwendungsfälle aus der Praxis:

- Fordern Sie eine Liste der überfälligen Aufgaben an, gruppiert nach Mitarbeitern.

- Rufen Sie eine Zusammenfassung der in diesem Quartal fertiggestellten Meilensteine ab.

- Erhalten Sie eine Echtzeit-Ansicht über Blockaden in allen aktiven Projekten.

- Finden Sie Risiken, bevor sie eskalieren, basierend auf der Aktivität der Aufgaben.

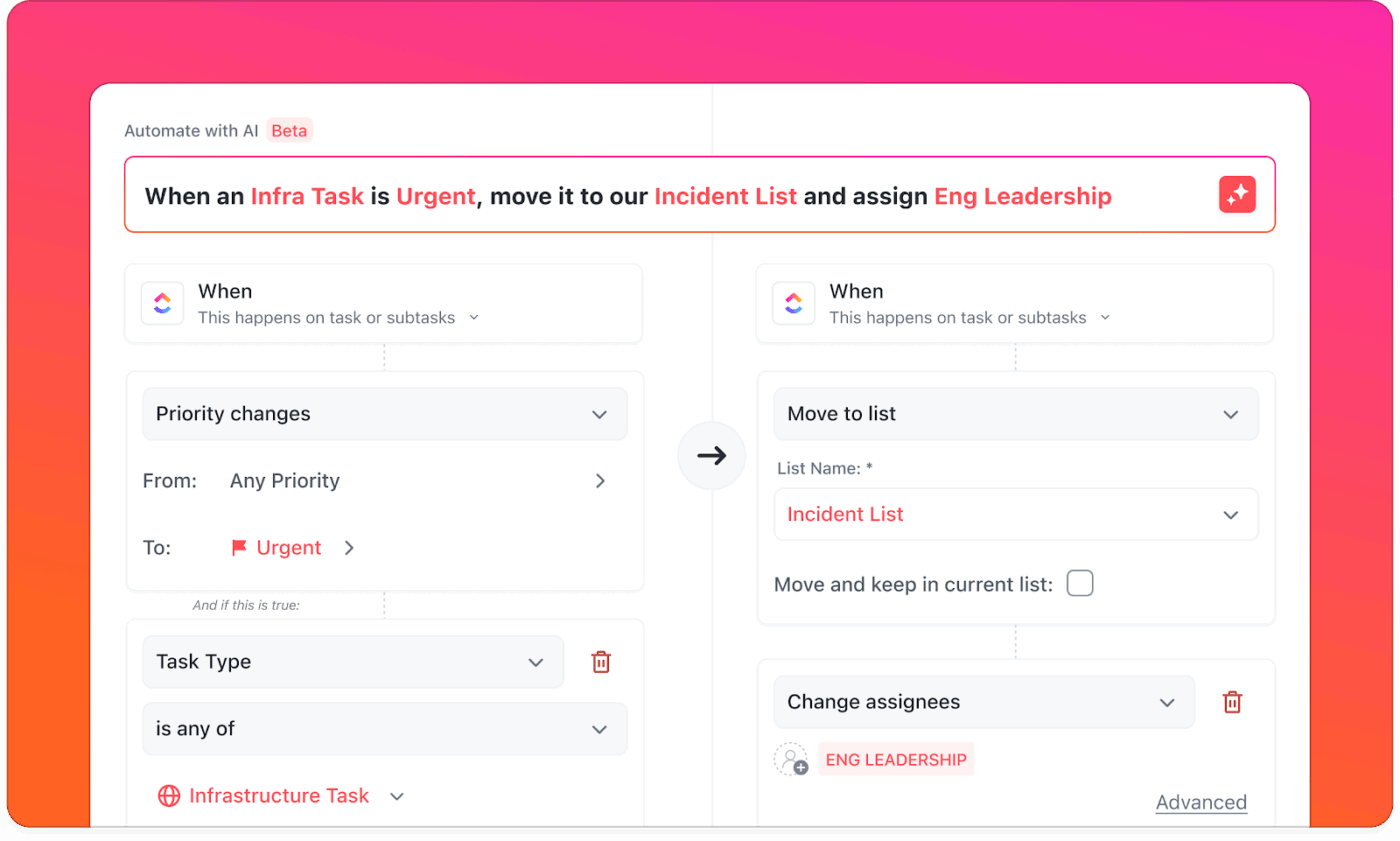

Automatisieren Sie Aufgaben ohne Regeln

Sie müssen sich nicht mehr durch Auslöser und Aktionen wühlen. Beschreiben Sie einfach in natürlicher Sprache, was Sie möchten, und die KI erstellt die Automatisierung in ClickUp.

Beispielsweise muss Ihr Kundenerfolgsteam jedes Mal, wenn sich ein Unternehmen anmeldet, wiederkehrende Aufgaben erledigen. Sie geben ClickUp Brain folgende Anweisung: Wenn eine Aufgabe mit „Enterprise Onboarding” getaggt ist, erstellen Sie Unteraufgaben für das Kickoff-Gespräch, das Willkommenspaket, die technische Zuweisung und die Follow-up-Erinnerungen.

KI erstellt diese mehrstufige Workflow-Automatisierung und ermöglicht es Ihnen, sie vor der Live-Schaltung zu testen.

Die besten Features von ClickUp

- KI-Agenten, die funktionieren: Setzen Sie spezialisierte ClickUp AI-Autopilot-Agenten ein, die wiederholende Aufgaben wie Projektaktualisierungen und Statusberichte übernehmen – ohne dass ein komplexes Modelltraining erforderlich ist.

- Vermeiden Sie Herstellerabhängigkeit: Greifen Sie über eine intuitive Benutzeroberfläche auf Claude, GPT, Gemini und andere führende KI-Modelle zu, ohne Workflows neu aufbauen zu müssen.

- Verpassen Sie nie den Kontext: Verwenden Sie den KI-Notizblock von ClickUp, um Meetings automatisch zu erfassen und zusammenzufassen, mit Aktionselementen, die direkt mit Ihren Aufgaben synchronisiert werden.

- Alles finden: Durchsuchen Sie Ihre gesamte Arbeit mit Enterprise AI Search in ClickUp, das den Kontext Ihres Teams versteht.

- Skalieren Sie ohne Komplexität: Erhalten Sie KI-Features der Enterprise-Klasse, ohne Infrastruktur oder API-Schlüssel verwalten zu müssen – alles funktioniert sofort.

- Visuelles Brainstorming: Generieren Sie Bilder direkt in ClickUp Whiteboards, indem Sie ClickUp Brain auffordern, und setzen Sie diese Ideen dann in umsetzbare Pläne für Projekte um.

- Chatten ohne Umschalten: Halten Sie Ihre Unterhaltungen mit ClickUp Chat mit Ihrer eigentlichen Arbeit verbunden.

- Planen Sie smarter: Lassen Sie ClickUp Kalender automatisch Fokuszeiten blockieren und optimale Meetings basierend auf Terminen für Projekte vorschlagen.

Limitierungen von ClickUp

- Sie können die zugrunde liegende KI-Infrastruktur nicht wie bei Hugging Face modifizieren, forken oder dazu beitragen.

Preise für ClickUp

Bewertungen und Rezensionen zu ClickUp

- G2: 4,7/5 (über 10.385 Bewertungen)

- Capterra: 4,6/5 (über 4.000 Bewertungen)

Was sagen echte Benutzer über ClickUp?

Diese G2-Bewertung sagt wirklich alles über diese KI-Kollaborationsplattform:

Das neue Brain MAX hat meine Produktivität erheblich gesteigert. Die Möglichkeit, mehrere KI-Modelle, darunter auch fortschrittliche Schlussfolgerungsmodelle, zu einem erschwinglichen Preis zu nutzen, macht es einfach, alles auf einer Plattform zu zentralisieren. Features wie Sprach-zu-Text, Automatisierung von Aufgaben und die Integration mit anderen Apps machen den Workflow viel reibungsloser und intelligenter.

Das neue Brain MAX hat meine Produktivität erheblich gesteigert. Die Möglichkeit, mehrere KI-Modelle, darunter auch fortschrittliche Schlussfolgerungsmodelle, zu einem erschwinglichen Preis zu nutzen, macht es einfach, alles auf einer Plattform zu zentralisieren. Features wie Sprach-zu-Text, Automatisierung von Aufgaben und die Integration mit anderen Apps machen den Workflow viel reibungsloser und intelligenter.

📮 ClickUp Insight: 30 % unserer Befragten verlassen sich bei der Recherche und Informationsbeschaffung auf KI-Tools. Aber gibt es eine KI, die Ihnen hilft, die eine verlorene Datei bei der Arbeit oder den wichtigen Slack-Thread zu finden, den Sie vergessen haben zu speichern?

Ja! Die KI-gestützte Connected Search von ClickUp kann sofort alle Inhalte Ihres Workspaces durchsuchen, einschließlich integrierter Drittanbieter-Apps, und liefert Ihnen Erkenntnisse, Ressourcen und Antworten. Sparen Sie mit der erweiterten Suche von ClickUp bis zu 5 Stunden pro Woche!

2. OpenAI (am besten geeignet für den Zugriff auf fortschrittliche Sprach- und Bildgenerierungsmodelle)

via OpenAI

OpenAI sorgte für Schlagzeilen, als ChatGPT auf den Markt kam, und plötzlich redeten alle wieder über KI. Ihre GPT-Modelle übernehmen Alles vom Verfassen von E-Mails bis zum Debuggen von Code, während DALL-E Ihre wildesten Textvorgaben in echte Bilder verwandelt.

Was OpenAI auszeichnet, ist die Art und Weise, wie sie KI verpackt haben. Sie erhalten Zugang zu Modellen, die zuvor in Forschungslabors unter Verschluss waren. Sicher, Sie zahlen für diesen Komfort, aber wenn die Fristen knapp sind und die Clients Ihnen im Nacken sitzen, ist dieser Komfort von unschätzbarem Wert.

Die besten Features von OpenAI

- Optimieren Sie Modelle anhand Ihrer spezifischen Datensätze, damit sie zu Ihrer Markenbotschaft, Ihrem Schreibstil oder Ihrer Fachkompetenz passen.

- Steuern Sie das Modellverhalten mithilfe von Systemaufforderungen und Temperatureinstellungen, um den Kreativitätsgrad und das Format der Antworten anzupassen.

- Verarbeiten Sie mehrere Formate, darunter PDFs, Bilder und Dokumente, für eine umfassende Analyse des Inhalts und seiner Extraktion.

- Verfolgen Sie die Nutzungskosten und legen Sie Limite fest – mithilfe detaillierter Abrechnungs-Dashboards, die die Ausgaben nach Modell und Projekt aufschlüsseln.

- Erstellen Sie Einbettungen für semantische Suchanwendungen, die Bedeutungen verstehen und nicht nur Schlüsselwörter abgleichen.

Limit von OpenAI

- Begrenzte benutzerdefinierte Anpassungsmöglichkeiten für die Modellarchitektur

- Die Abhängigkeit von externen API-Aufrufen beeinträchtigt die Offline-Funktionalität.

- Ratenlimits können sich auf Anwendungen mit hohem Datenaufkommen in verschiedenen Branchen auswirken.

- OpenAI sah sich mehreren Klagen und Untersuchungen wegen der ohne Zustimmung aus dem Internet gesammelten Trainingsdaten ausgesetzt.

Preise von OpenAI

- GPT-4. 1 Eingabe: 2 $ pro 1 Million Token Zwischengespeicherte Eingabe: 0,50 $ pro 1 Million Token Ausgabe: 8 $ pro 1 Million Token

- Eingabe: 2 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 0,50 $ pro 1 Million Token

- Ausgabe: 8 $ pro 1 Million Token

- GPT-4. 1 mini Eingabe: 0,40 $ pro 1 Million Token Zwischengespeicherte Eingabe: 0,10 $ pro 1 Million Token Ausgabe: 1,60 $ pro 1 Million Token

- Eingabe: 0,40 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 0,10 $ pro 1 Million Token

- Ausgabe: 1,60 $ pro 1 Million Token

- GPT-4. 1 Nano Eingabe: 0,100 $ pro 1 Million Token Zwischengespeicherte Eingabe: 0,025 $ pro 1 Million Token Ausgabe: 0,400 $ pro 1 Million Token

- Eingabe: 0,100 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 0,025 $ pro 1 Million Token

- Ausgabe: 0,400 $ pro 1 Million Token

- OpenAI o3 Eingabe: 2 $ pro 1 Million Token Zwischengespeicherte Eingabe: 0,50 $ pro 1 Million Token Ausgabe: 8 $ pro 1 Million Token

- Eingabe: 2 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 0,50 $ pro 1 Million Token

- Ausgabe: 8 $ pro 1 Million Token

- OpenAI o4-mini Eingabe: 1,100 $ pro 1 Million Token Zwischengespeicherte Eingabe: 0,275 $ pro 1 Million Token Ausgabe: 4,400 $ pro 1 Million Token

- Eingabe: 1,100 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 0,275 $ pro 1 Million Token

- Ausgabe: 4.400 $ pro 1 Million Token

- Modelle feinabstimmen GPT-4. 1 Eingabe: 3 $ pro 1 Million Token Zwischengespeicherte Eingabe: 0,75 $ pro 1 Million Token Ausgabe: 12 $ pro 1 Million Token Training: 25 $ pro 1 Million Token GPT-4. 1 mini Eingabe: 0,80 $ pro 1 Million Token Zwischengespeicherte Eingabe: 0,20 $ pro 1 Million Token Ausgabe: 3,20 $ pro 1 Million Token Training: 5 $ pro 1 Million Token GPT-4. 1 Nano Eingabe: 0,20 $ pro 1 Million Token Zwischengespeicherte Eingabe: 0,05 $ pro 1 Million Token Ausgabe: 0,80 $ pro 1 Million Token Training: 1,50 $ pro 1 Million Token o4-mini Eingabe: 4 $ pro 1 Million Token Zwischengespeicherte Eingabe: 1 $ pro 1 Million Token Ausgabe: 16 $ pro 1 Million Token Training: 100 $ pro Trainingsstunde

- GPT-4. 1 Eingabe: 3 $ pro 1 Million Token Zwischengespeicherte Eingabe: 0,75 $ pro 1 Million Token Ausgabe: 12 $ pro 1 Million Token Training: 25 $ pro 1 Million Token

- Eingabe: 3 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 0,75 $ pro 1 Million Token

- Ausgabe: 12 $ pro 1 Million Token

- Schulung: 25 $ pro 1 Million Token

- GPT-4. 1 mini Eingabe: 0,80 $ pro 1 Million Token Zwischengespeicherte Eingabe: 0,20 $ pro 1 Million Token Ausgabe: 3,20 $ pro 1 Million Token Training: 5 $ pro 1 Million Token

- Eingabe: 0,80 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 0,20 $ pro 1 Million Token

- Ausgabe: 3,20 $ pro 1 Million Token

- Schulung: 5 $ pro 1 Million Token

- GPT-4. 1 nano Eingabe: 0,20 $ pro 1 Million Token Zwischengespeicherte Eingabe: 0,05 $ pro 1 Million Token Ausgabe: 0,80 $ pro 1 Million Token Training: 1,50 $ pro 1 Million Token

- Eingabe: 0,20 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 0,05 $ pro 1 Million Token

- Ausgabe: 0,80 $ pro 1 Million Token

- Schulung: 1,50 $ pro 1 Million Token

- o4-mini Eingabe: 4 $ pro 1 Million Token Zwischengespeicherte Eingabe: 1 $ pro 1 Million Token Ausgabe: 16 $ pro 1 Million Token Training: 100 $ pro Trainingsstunde

- Eingabe: 4 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 1 $ pro 1 Million Token

- Ausgabe: 16 $ pro 1 Million Token

- Schulung: 100 $ pro Schulungsstunde

- Eingabe: 2 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 0,50 $ pro 1 Million Token

- Ausgabe: 8 $ pro 1 Million Token

- Eingabe: 0,40 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 0,10 $ pro 1 Million Token

- Ausgabe: 1,60 $ pro 1 Million Token

- Eingabe: 0,100 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 0,025 $ pro 1 Million Token

- Ausgabe: 0,400 $ pro 1 Million Token

- Eingabe: 2 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 0,50 $ pro 1 Million Token

- Ausgabe: 8 $ pro 1 Million Token

- Eingabe: 1,100 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 0,275 $ pro 1 Million Token

- Ausgabe: 4.400 $ pro 1 Million Token

- GPT-4. 1 Eingabe: 3 $ pro 1 Million Token Zwischengespeicherte Eingabe: 0,75 $ pro 1 Million Token Ausgabe: 12 $ pro 1 Million Token Training: 25 $ pro 1 Million Token

- Eingabe: 3 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 0,75 $ pro 1 Million Token

- Ausgabe: 12 $ pro 1 Million Token

- Schulung: 25 $ pro 1 Million Token

- GPT-4. 1 mini Eingabe: 0,80 $ pro 1 Million Token Zwischengespeicherte Eingabe: 0,20 $ pro 1 Million Token Ausgabe: 3,20 $ pro 1 Million Token Training: 5 $ pro 1 Million Token

- Eingabe: 0,80 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 0,20 $ pro 1 Million Token

- Ausgabe: 3,20 $ pro 1 Million Token

- Schulung: 5 $ pro 1 Million Token

- GPT-4. 1 nano Eingabe: 0,20 $ pro 1 Million Token Zwischengespeicherte Eingabe: 0,05 $ pro 1 Million Token Ausgabe: 0,80 $ pro 1 Million Token Training: 1,50 $ pro 1 Million Token

- Eingabe: 0,20 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 0,05 $ pro 1 Million Token

- Ausgabe: 0,80 $ pro 1 Million Token

- Schulung: 1,50 $ pro 1 Million Token

- o4-mini Eingabe: 4 $ pro 1 Million Token Zwischengespeicherte Eingabe: 1 $ pro 1 Million Token Ausgabe: 16 $ pro 1 Million Token Training: 100 $ pro Trainingsstunde

- Eingabe: 4 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 1 $ pro 1 Million Token

- Ausgabe: 16 $ pro 1 Million Token

- Schulung: 100 $ pro Schulungsstunde

- Eingabe: 3 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 0,75 $ pro 1 Million Token

- Ausgabe: 12 $ pro 1 Million Token

- Schulung: 25 $ pro 1 Million Token

- Eingabe: 0,80 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 0,20 $ pro 1 Million Token

- Ausgabe: 3,20 $ pro 1 Million Token

- Schulung: 5 $ pro 1 Million Token

- Eingabe: 0,20 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 0,05 $ pro 1 Million Token

- Ausgabe: 0,80 $ pro 1 Million Token

- Schulung: 1,50 $ pro 1 Million Token

- Eingabe: 4 $ pro 1 Million Token

- Zwischengespeicherte Eingabe: 1 $ pro 1 Million Token

- Ausgabe: 16 $ pro 1 Million Token

- Schulung: 100 $ pro Schulungsstunde

OpenAI-Bewertungen und Rezensionen

- G2: 4,7/5 (über 830 Bewertungen)

- Capterra: 4,5/5 (über 220 Bewertungen)

Was sagen echte Benutzer über OpenAI?

Aus einer G2-Bewertung:

Die API ist fantastisch, mit einer hervorragenden Benutzeroberfläche, und ich hatte bei der Verwendung von ChatGPT keinerlei Probleme. Ich finde es großartig und empfehle Ihnen wärmstens, es auszuprobieren, herunterzuladen und schnell eine Entscheidung zu treffen.

Die API ist fantastisch, mit einer hervorragenden Benutzeroberfläche, und ich hatte bei der Verwendung von ChatGPT keinerlei Probleme. Ich finde es großartig und empfehle Ihnen wärmstens, es auszuprobieren, herunterzuladen und schnell eine Entscheidung zu treffen.

🎥 Sehen Sie sich an: Wie Sie ClickUp Brain jederzeit und überall als Ihren persönlichen Assistenten nutzen können.

💡 Profi-Tipp: Verlassen Sie sich nicht auf eine einzige Metrik. Unterteilen Sie die LLM-Bewertung danach, wie gut es strukturierte Eingaben (z. B. Tabellen, Listen) im Vergleich zu unstrukturierten Eingaben (offene Aufgaben) verarbeitet. So werden Sie Fehlermuster schneller erkennen.

3. Anthropic Claude (am besten geeignet für sichere und kontextbezogene KI-Unterhaltungen)

via Anthropic

Claude verfolgt einen anderen Ansatz in Bezug auf KI-Sicherheit. Anstatt Inhaltsfilter einzusetzen, hat Anthropic das System darauf trainiert, Probleme sorgfältig zu durchdenken. Sie werden feststellen, dass Claude mehrere Perspektiven berücksichtigt, bevor es antwortet, wodurch es sich gut für nuancierte Diskussionen über komplexe Themen eignet.

Das Kontextfenster ist riesig, sodass Sie ganze Dokumente einspeisen und echte Unterhaltungen über den Inhalt führen können.

Denken Sie an die Momente, in denen Sie eine Forschungsarbeit diskutieren oder einen langen Bericht analysieren wollten. Claude geht mit solchen Situationen ganz natürlich um. Es merkt sich auch alles aus früheren Unterhaltungen, sodass Sie sich nicht ständig wiederholen müssen.

Die besten Features von Anthropic Claude

- Schreiben und debuggen Sie Code in Dutzenden von Programmiersprachen, erklären Sie die Logik und schlagen Sie dabei Verbesserungen vor.

- Durchsuchen Sie das Internet in Echtzeit, um auf aktuelle Informationen zuzugreifen und Fakten während Unterhaltungen zu überprüfen.

- Setzen Sie sich mit komplexen ethischen Dilemmata und nuancierten Themen auseinander und präsentieren Sie dabei ausgewogene Perspektiven anstelle von vereinfachten Antworten.

- Führen Sie komplexe mathematische Berechnungen und statistische Analysen mit Schritt-für-Schritt-Erklärungen und Überprüfungen durch.

- Generieren Sie strukturierte Ausgaben wie JSON, XML und YAML, die bestimmten Schemata für API-Integrationen entsprechen.

Einschränkungen von Anthropic Claude

- Im Vergleich zu den Claude-Alternativen bietet es eine kleinere Auswahl an Modellen.

- Weniger Flexibilität beim Training benutzerdefinierter Modelle

- Höhere Latenz für einige spezielle Aufgaben

Preise für Anthropic Claude

- Claude Opus 4 Eingabe: 15 $ pro 1 Million Token Ausgabe: 75 $ pro 1 Million Token Prompt-Caching: Schreiben: 18,75 $ pro 1 Million Token Lesen: 1,50 $ pro 1 Million Token

- Eingabe: 15 $ pro 1 Million Token

- Ausgabe: 75 $ pro 1 Million Token

- Prompt-Caching: Schreiben: 18,75 $ pro 1 Million Token Lesen: 1,50 $ pro 1 Million Token

- Schreiben: 18,75 $ pro 1 Million Token

- Lesen Sie: 1,50 $ pro 1 Million Token

- Claude Sonnet 4 Eingabe: 3 $ pro 1 Million Token Ausgabe: 15 $ pro 1 Million Token Prompt-Caching: Schreiben: 3,75 $ pro 1 Million Token Lesen: 0,30 $ pro 1 Million Token

- Eingabe: 3 $ pro 1 Million Token

- Ausgabe: 15 $ pro 1 Million Token

- Prompt-Caching: Schreiben: 3,75 $ pro 1 Million Token Lesen: 0,30 $ pro 1 Million Token

- Schreiben: 3,75 $ pro 1 Million Token

- Lesen Sie: 0,30 $ pro 1 Million Token

- Claude Haiku 3. 5 Eingabe: 0,80 $ pro 1 Million Token Ausgabe: 4 $ pro 1 Million Token Prompt-Caching: Schreiben: 1 $ pro 1 Million Token Lesen: 0,08 $ pro 1 Million Token

- Eingabe: 0,80 $ pro 1 Million Token

- Ausgabe: 4 $ pro 1 Million Token

- Prompt-Caching: Schreiben: 1 $ pro 1 Million Tokens Lesen: 0,08 $ pro 1 Million Tokens

- Schreiben: 1 $ pro 1 Million Token

- Lesen Sie: 0,08 $ pro 1 Million Token

- Eingabe: 15 $ pro 1 Million Token

- Ausgabe: 75 $ pro 1 Million Token

- Prompt-Caching: Schreiben: 18,75 $ pro 1 Million Token Lesen: 1,50 $ pro 1 Million Token

- Schreiben: 18,75 $ pro 1 Million Token

- Lesen Sie: 1,50 $ pro 1 Million Token

- Schreiben: 18,75 $ pro 1 Million Token

- Lesen Sie: 1,50 $ pro 1 Million Token

- Eingabe: 3 $ pro 1 Million Token

- Ausgabe: 15 $ pro 1 Million Token

- Prompt-Caching: Schreiben: 3,75 $ pro 1 Million Token Lesen: 0,30 $ pro 1 Million Token

- Schreiben: 3,75 $ pro 1 Million Token

- Lesen Sie: 0,30 $ pro 1 Million Token

- Schreiben: 3,75 $ pro 1 Million Token

- Lesen Sie: 0,30 $ pro 1 Million Token

- Eingabe: 0,80 $ pro 1 Million Token

- Ausgabe: 4 $ pro 1 Million Token

- Prompt-Caching: Schreiben: 1 $ pro 1 Million Token Lesen: 0,08 $ pro 1 Million Token

- Schreiben: 1 $ pro 1 Million Token

- Lesen Sie: 0,08 $ pro 1 Million Token

- Schreiben: 1 $ pro 1 Million Token

- Lesen Sie: 0,08 $ pro 1 Million Token

Bewertungen und Rezensionen zu Anthropic Claude

- G2: 4,4/5 (über 55 Bewertungen)

- Capterra: 4,5/5 (über 20 Bewertungen)

Was sagen echte Benutzer über Anthropic Claude?

Basierend auf einem Reddit-Kommentar:

Ganz ehrlich? Claude scheint einfach ein guter „Mensch“ zu sein. Bei seinen Entscheidungen berücksichtigt es das Wohlergehen der Menschen in einer Tiefe, die in anderen Modellen nicht zu finden ist. Wenn ich mich für ein LLM entscheiden müsste, das weltweit führend sein soll, wäre Claude meine erste Wahl. Den anderen würde ich ohne ethische oder persönlichkeitsbildende Schulungen nicht unbedingt das gleiche Maß an Vertrauen entgegenbringen.

Ganz ehrlich? Claude scheint einfach ein guter „Mensch“ zu sein. Bei seinen Entscheidungen berücksichtigt es das Wohlergehen der Menschen in einer Tiefe, die in anderen Modellen nicht zu finden ist. Wenn ich mich für ein LLM entscheiden müsste, das weltweit führend sein soll, wäre Claude meine erste Wahl. Den anderen würde ich ohne ethische oder persönlichkeitsbildende Schulungen nicht unbedingt das gleiche Maß an Vertrauen entgegenbringen.

🧠 Wissenswertes: Im Jahr 2012 schlug ein Modell namens AlexNet den Menschen bei der Bilderkennung. Es war schneller, genauer und wurde nicht müde. Dieser Moment veränderte die Sichtweise der Menschen auf das Potenzial von KI in Feldern wie Gesundheitswesen, Sicherheit und Robotik.

📖 Lesen Sie auch: Die besten Alternativen und Konkurrenten zu Anthropic KI

4. Cohere (am besten geeignet für die Entwicklung von Lösungen zur Verarbeitung natürlicher Sprache auf Unternehmensebene)

via Cohere

Cohere hat seine Plattform speziell für Unternehmen entwickelt, die künstliche Intelligenz benötigen, aber keine Kompromisse beim Datenschutz eingehen können. Die mehrsprachigen Funktionen umfassen über 100 Sprachen, was besonders für Unternehmen mit globalen Kunden oder internationalen Märkten von großem Vorteil ist.

Die Einbettungen eignen sich besonders gut für Suchanwendungen, bei denen es darum geht, Bedeutungen zu verstehen und nicht nur Schlüsselwörter abzugleichen. Sie können auch Ihre eigenen benutzerdefinierten KI- Klass ifikatoren trainieren, was für Teams praktisch ist, die KI-Lösungen benötigen, aber keine eigenen Datenwissenschaftler haben.

Die besten Features von Cohere

- Optimieren Sie Modelle mithilfe Ihrer proprietären Daten und behalten Sie dabei die vollständige Kontrolle über Trainingsdatensätze und Modellgewichte.

- Skalieren Sie die Inferenz-Kapazität automatisch basierend auf Nachfragemustern, ohne die zugrunde liegende GPU-Infrastruktur verwalten zu müssen.

- Implementieren Sie Retrieval-Augmented-Generation-Systeme, die Quellen zitieren und die Herkunft generierter Inhalte angeben können.

- Überwachen Sie die Modellleistung und Nutzungsmuster mithilfe umfassender Analyse-Dashboards und Warnsysteme.

- Integrieren Sie bestehende Systeme der Authentifizierung mithilfe von SSO, SAML und rollenbasierten Zugriffskontrollen zur Nachverfolgung von Experimenten.

Einschränkungen von Cohere

- Kleinere Community und weniger Integrationen von Drittanbietern

- Im Vergleich zu multimodalen Plattformen eingeschränkte Computer-Vision-Fähigkeiten

- Für spezialisierte Bereiche stehen weniger vortrainierte Modelle zur Verfügung.

- Weniger umfangreiche Dokumentation für fortgeschrittene Anwendungsfälle und hybride Setups

Preise von Cohere

- Befehl A Eingabe: 2,50 $ pro 1 Million Token Ausgabe: 10 $ pro 1 Million Token

- Eingabe: 2,50 $ pro 1 Million Token

- Ausgabe: 10 $ pro 1 Million Token

- Befehl R Eingabe: 0,15 $ pro 1 Million Token Ausgabe: 0,60 $ pro 1 Million Token

- Eingabe: 0,15 $ pro 1 Million Token

- Ausgabe: 0,60 $ pro 1 Million Token

- Befehl R7B Eingabe: 0,0375 $ pro 1 Million Token Ausgabe: 0,15 $ pro 1 Million Token

- Eingabe: 0,0375 $ pro 1 Million Token

- Ausgabe: 0,15 $ pro 1 Million Token

- Eingabe: 2,50 $ pro 1 Million Token

- Ausgabe: 10 $ pro 1 Million Token

- Eingabe: 0,15 $ pro 1 Million Token

- Ausgabe: 0,60 $ pro 1 Million Token

- Eingabe: 0,0375 $ pro 1 Million Token

- Ausgabe: 0,15 $ pro 1 Million Token

Bewertungen und Rezensionen zu Cohere

- G2: Nicht genügend Bewertungen

- Capterra: Nicht genügend Bewertungen

Was sagen echte Benutzer über Cohere?

Laut einer Bewertung von Capterra:

Die Einrichtung von Cohere war ziemlich einfach und die Dokumentation war leicht verständlich. Zu sehen, wie unsere Benutzer die App verwenden, war von Anfang an sehr nützlich und cool. […] Die kostenlose Version der Software hat ein extrem begrenztes Limit an Sitzungen, und da unsere Benutzerbasis gewachsen ist, finden wir die Anwendung weniger nützlich, da immer mehr Sitzungen hinter einer Paywall versteckt sind.

Die Einrichtung von Cohere war ziemlich einfach und die Dokumentation war leicht verständlich. Zu sehen, wie unsere Benutzer die App verwenden, war von Anfang an sehr nützlich und cool. […] Die kostenlose Version der Software hat ein extrem begrenztes Limit an Sitzungen, und da unsere Nutzerbasis gewachsen ist, finden wir die Anwendung weniger nützlich, da immer mehr Sitzungen hinter einer Paywall versteckt sind.

🔍 Wussten Sie schon? Modelle wie GPT‑4 und Grok 4 änderten ihre Antworten, wenn sie Widerspruch erhielten (auch wenn ihre erste Antwort korrekt war). Sie begannen, an sich selbst zu zweifeln, nachdem sie widersprüchliches Feedback erhalten hatten. Das ähnelt auf unheimliche Weise dem Verhalten von Menschen unter Stress und wirft Fragen zur Zuverlässigkeit ihrer Antworten auf.

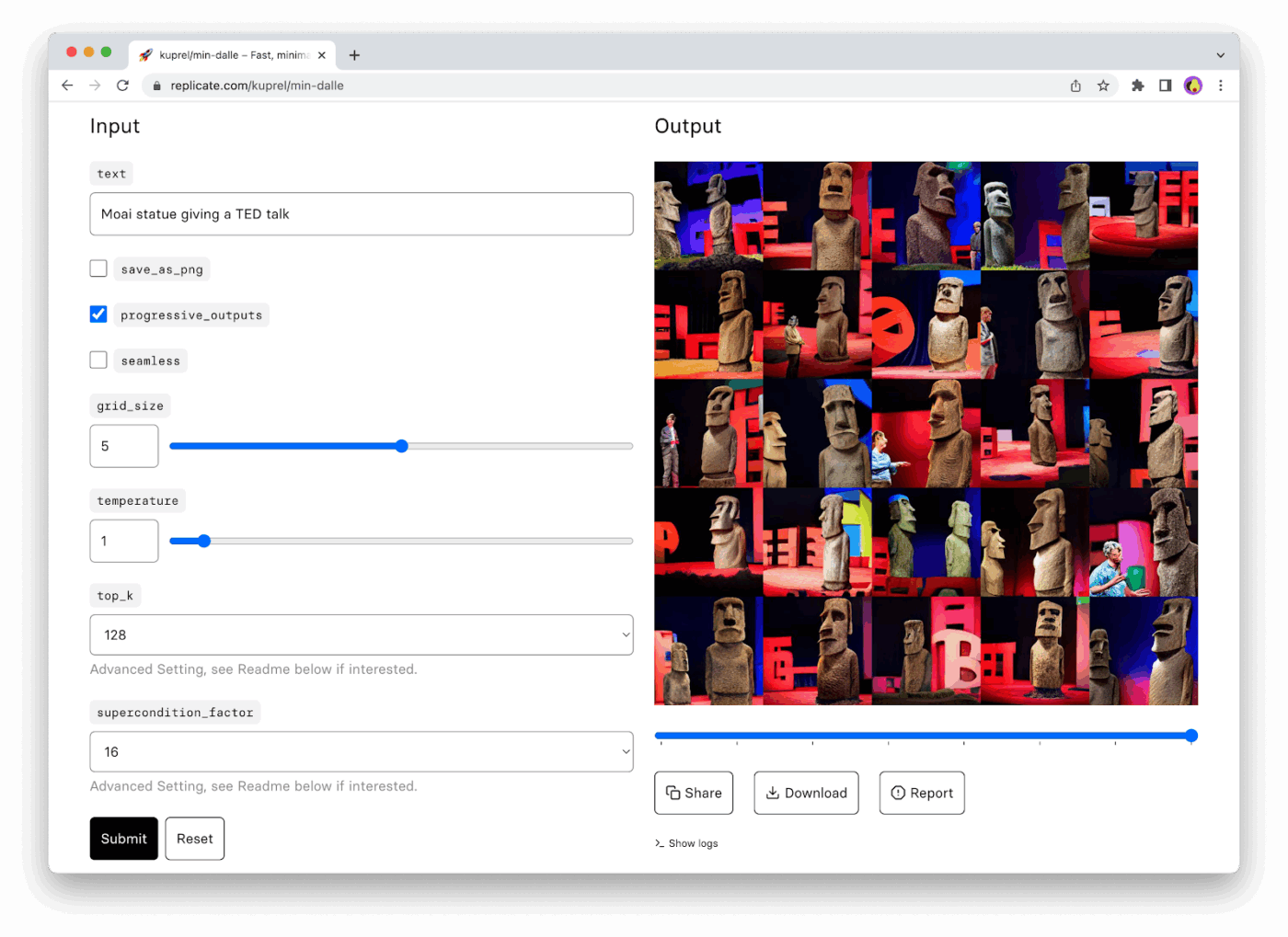

5. Replicate (am besten geeignet für die Ausführung von Open-Source-KI-Modellen ohne Infrastrukturmanagement)

via Replicate

Replicate ist wie eine riesige Bibliothek mit KI-Modellen, ohne dass Sie sich um die Verwaltung von Servern kümmern müssen. Jemand hat einen fantastischen Bildgenerator entwickelt? Der ist wahrscheinlich auf Replicate zu finden. Möchten Sie das neue Sprachsynthese-Modell ausprobieren, von dem alle sprechen? Rufen Sie einfach die API auf.

Die KI-App übernimmt die gesamte komplexe Infrastruktur, sodass Sie mit Dutzenden verschiedener Modelle experimentieren können, ohne sich auf eines festlegen zu müssen. Sie zahlen nur, wenn Sie etwas nutzen, was es perfekt für die Prototypenentwicklung macht.

Wenn Sie ein Modell gefunden haben, das funktioniert, können Sie sogar Ihre eigenen benutzerdefinierten Versionen mithilfe des unkomplizierten Containersystems bereitstellen.

Replizieren Sie die besten Features

- Versionskontrolle Ihrer Modellbereitstellungen mit Rollback-Funktionen und A/B-Tests zwischen verschiedenen Modellversionen.

- Richten Sie Webhooks ein, um Benachrichtigungen zu erhalten, wenn lang andauernde Vorhersagen abgeschlossen sind oder Fehler auftreten.

- Verarbeiten Sie mehrere Eingaben gleichzeitig im Batch-Verfahren, um die Kosten pro Vorhersage zu senken und die Durchsatzeffizienz zu verbessern.

- Forken Sie bestehende Modelle, um benutzerdefinierte Versionen mit unterschiedlichen Parametern oder Trainingsdaten zu erstellen.

Replizieren Sie Limite

- Sie haben weniger Kontrolle über die Modell-Hosting-Umgebung und die Konfigurationen.

- Es gibt potenzielle Latenzprobleme für Echtzeitanwendungen und Anforderungen des Unternehmens.

- Begrenzte Optionen für die benutzerdefinierte Modellanpassung und Feinabstimmung

- Abhängigkeit von der Verfügbarkeit und Wartung von Modellen von Drittanbietern

Replicate-Preise

- Die Preise variieren je nach Modell.

Bewertungen und Rezensionen replizieren

- G2: Nicht genügend Bewertungen

- Capterra: Nicht genügend Bewertungen

Was sagen echte Benutzer über Replicate?

Eine Reddit-Rezension macht eine Notiz:

Meiner Meinung nach ist Replicate die benutzerfreundlichste Option, um neue Bild- oder Video-Modelle auszuprobieren. Ich bezweifle, dass es die kostengünstigste Option ist, wenn Sie viele Benutzer haben, aber für ein MVP könnte es Ihnen viel Ärger und Geld sparen (im Gegensatz zur stundenweisen Anmietung einer GPU).

Meiner Meinung nach ist Replicate die benutzerfreundlichste Option, um neue Bild- oder Video-Modelle auszuprobieren. Ich bezweifle, dass es die kostengünstigste Option ist, wenn Sie viele Benutzer haben, aber für ein MVP könnte es Ihnen viel Ärger und Geld sparen (im Gegensatz zur stundenweisen Anmietung einer GPU).

💡 Profi-Tipp: Feinabstimmung mit Zurückhaltung. Sie müssen ein Modell nicht immer feinabstimmen, um domänenspezifische Ergebnisse zu erhalten. Probieren Sie zunächst Smart Prompt Engineering + Retrieval-Augmented Generation (RAG) aus. Investieren Sie nur dann in die Feinabstimmung, wenn Sie ständig an die Grenzen der Genauigkeit oder Relevanz stoßen.

6. TensorFlow (am besten geeignet für die Erstellung benutzerdefinierter Machine-Learning-Modelle von Grund auf)

via TensorFlow

Mit TensorFlow haben Sie die vollständige Kontrolle über Ihr maschinelles Lernen (was sowohl ein Segen als auch ein Fluch sein kann). Google hat sein Produktions-ML-Framework als Open Source veröffentlicht, sodass Sie dieselben Tools erhalten, die auch intern verwendet werden.

Die Flexibilität ist unglaublich: Sie können alles erstellen, von einfachen linearen Regressionen bis hin zu komplexen Transformer-Architekturen.

TensorFlow Hub bietet vortrainierte Modelle, die Sie feinabstimmen können, während TensorBoard Ihnen Echtzeit-Analysen zur Trainingsleistung liefert. Diese Leistungsfähigkeit geht jedoch mit Komplexität einher. Sie werden Zeit damit verbringen, Konzepte zu erlernen, die höherwertige Plattformen abstrahieren.

Die besten Features von TensorFlow

- Profilieren Sie die Modellleistung und identifizieren Sie Engpässe mit fortschrittlichen Debugging-tools, die die Speichernutzung und Berechnungsgraphen anzeigen.

- Konvertieren Sie Modelle zwischen verschiedenen Formaten wie SavedModel, TensorFlow Lite und ONNX, um plattformübergreifende Kompatibilität zu gewährleisten.

- Implementieren Sie benutzerdefinierte Verlustfunktionen und Optimierungsalgorithmen, die in Standard-Bibliotheken für maschinelles Lernen nicht verfügbar sind.

- Nutzen Sie Mixed-Precision-Training, um den Speicherverbrauch zu reduzieren und das Training auf modernen GPU-Architekturen zu beschleunigen.

- Erstellen Sie mit tf.data benutzerdefinierte Datenpipelines, die große Datensätze mit Vorverarbeitung und Augmentierung effizient verarbeiten.

Limitierungen von TensorFlow

- Für das Training großer Modelle sind erhebliche Rechenressourcen erforderlich.

- Komplexer Debugging-Prozess im Vergleich zu höherwertigen Alternativen zu Hugging Face

- Zeitaufwändiges Setup und Konfiguration für fortgeschrittene Anwendungsfälle

Preise für TensorFlow

- Benutzerdefinierte Preisgestaltung

TensorFlow-Bewertungen und Rezensionen

- G2: 4,5/5 (über 125 Bewertungen)

- Capterra: 4,6/5 (über 100 Bewertungen)

Was sagen echte Benutzer über TensorFlow?

Ein Benutzer auf G2 hebt hervor:

Ich finde es toll, wie leistungsstark und flexibel TensorFlow für die Erstellung und das Training von Deep-Learning-Modellen ist. Keras macht es etwas einfacher und vortrainierte Modelle sparen viel Zeit. Außerdem ist die Community großartig, wenn ich nicht weiterkomme. […] Die Lernkurve ist steil. Vor allem für Anfänger. Manchmal sind die Fehler zu kompliziert, um sie zu verstehen, und das Debugging ist frustrierend. Außerdem erfordert es viel Rechenleistung, was ein Problem sein kann, wenn man keine High-End-Hardware hat.

Ich finde es toll, wie leistungsstark und flexibel TensorFlow für die Erstellung und das Training von Deep-Learning-Modellen ist. Keras macht es etwas einfacher und vortrainierte Modelle sparen viel Zeit. Außerdem ist die Community großartig, wenn ich nicht weiterkomme. […] Die Lernkurve ist steil. Vor allem für Anfänger. Manchmal sind die Fehler zu kompliziert, um sie zu verstehen, und das Debugging ist frustrierend. Außerdem erfordert es viel Rechenleistung, was ein Problem sein kann, wenn man keine High-End-Hardware hat.

🧠 Wissenswertes: Forscher haben herausgefunden, dass Sprachmodelle häufig Softwarepakete vorschlagen, die gar nicht existieren. Rund 19,7 % der Code-Beispiele enthielten erfundene Namen, was zu Squatting-Angriffen führen kann.

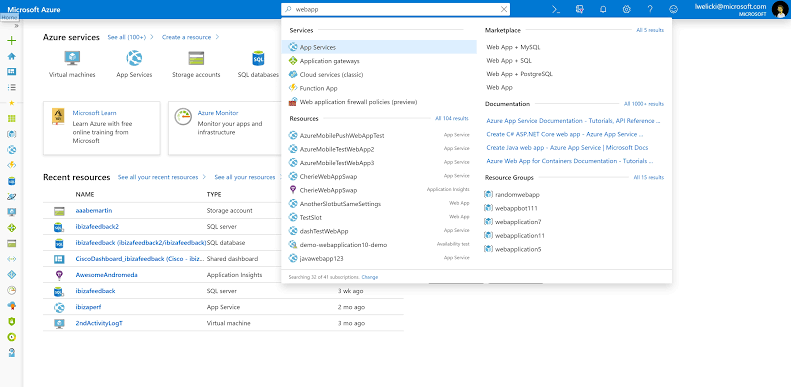

7. Azure Machine Learning (am besten geeignet für die Integration von ML-Workflows in Microsoft-Clouddienste)

über Microsoft Azure

Azure ML ist die natürliche Wahl, wenn Ihr Unternehmen bereits mit Microsoft arbeitet. Das tool bietet sowohl Point-and-Click-Oberflächen für Benutzer im Geschäftsbereich als auch vollständige Programmierumgebungen für Datenwissenschaftler.

AutoML übernimmt die Schwerarbeit, wenn Sie schnelle Ergebnisse benötigen, und probiert automatisch verschiedene Algorithmen und Hyperparameter aus. Durch die Integration mit Power BI können Ihre Modelle direkt in Executive-Dashboards eingespeist werden.

Sie erhalten eine robuste Version für Modelle, Automatisierung der Bereitstellungspipelines und eine Überwachung, die Sie benachrichtigt, wenn die Modellleistung nachlässt.

Die besten Features von Azure Machine Learning

- Planen Sie automatisierte Retraining-Pipelines, die als Auslöser dienen, wenn neue Daten verfügbar werden oder die Modellleistung nachlässt.

- Erstellen Sie benutzerdefinierte Docker-Umgebungen für reproduzierbares Modelltraining und -bereitstellung auf verschiedenen Rechenzielen.

- Implementieren Sie Features zur Interpretierbarkeit von Modellen, die Vorhersagen mithilfe von LIME, SHAP und anderen Erklärbarkeitstechniken erläutern.

- Richten Sie eine Datenabweichungsüberwachung ein, die Sie benachrichtigt, wenn eingehende Daten erheblich von den Trainingsdatensätzen abweichen.

- Verwalten Sie Rechencluster, die sich automatisch an die Workload anpassen und gleichzeitig die Kosteneffizienz optimieren.

Limit von Azure Machine Learning

- Für Unternehmen, die Multi-Cloud-Strategien einsetzen, bestehen Bedenken hinsichtlich der Anbieterabhängigkeit.

- Begrenzte Flexibilität im Vergleich zu Open-Source-Alternativen zu Hugging Face

Preise für Azure Machine Learning

- Benutzerdefinierte Preisgestaltung

Bewertungen und Rezensionen zu Azure Machine Learning

- G2: 4,3/5 (über 85 Bewertungen)

- Capterra: 4,5/5 (30 Bewertungen)

Was sagen echte Benutzer über Azure Machine Learning?

Wie auf G2 freigegeben:

Der Dienst ist einfach zu bedienen und verfügt über viele interessante Features zum Hochladen von Daten und Erkennen von Mustern. Die Benutzeroberfläche könnte besser sein, entspricht aber meinen Anforderungen. Wenn Sie Zweifel hinsichtlich der Implementierung haben, finden Sie viele Informationen im Internet oder können direkt Hilfe vom Microsoft-Support anfordern.

Der Dienst ist einfach zu bedienen und verfügt über viele interessante Features zum Hochladen von Daten und Erkennen von Mustern. Die Benutzeroberfläche könnte besser sein, entspricht aber meinen Anforderungen. Wenn Sie Zweifel hinsichtlich der Implementierung haben, finden Sie viele Informationen im Internet oder können direkt Hilfe vom Microsoft-Support anfordern.

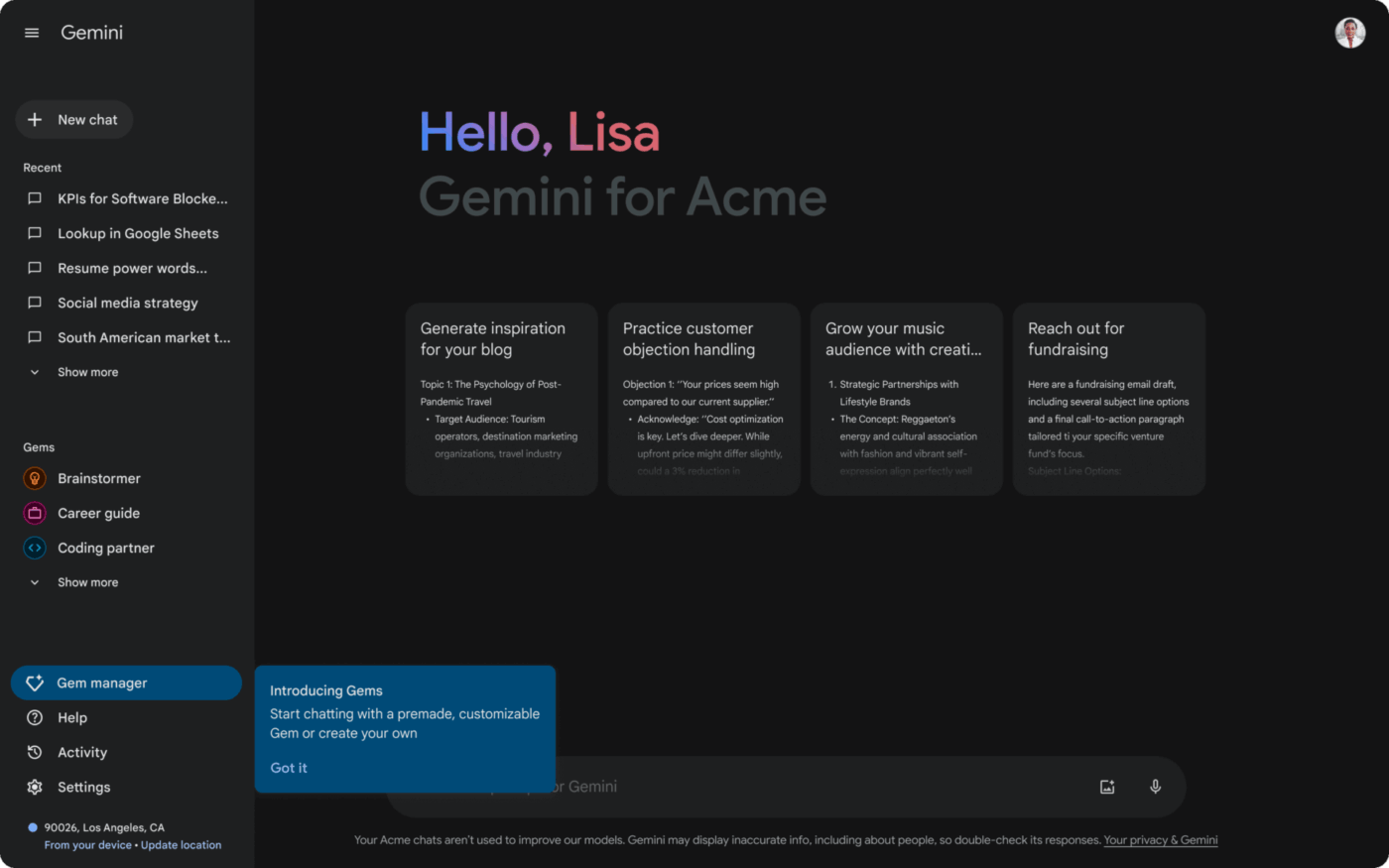

8. Google Gemini (am besten geeignet für die Verarbeitung mehrerer Inhaltstypen in einer einzigen Interaktion)

über Google Gemini

Gemini von Google versteht mehrere Arten von Inhalten gleichzeitig. Sie können ein Diagramm zeigen und Fragen zu den Daten stellen oder Bilder hochladen und Unterhaltungen darüber führen, was darauf zu sehen ist. Die Mathematik- und Codierungsfähigkeiten sind besonders stark. Es arbeitet sich Schritt für Schritt durch komplexe Gleichungen und erklärt seine Überlegungen.

Das Kontextfenster verarbeitet große Textmengen und eignet sich daher besonders für die Analyse ganzer Forschungsarbeiten oder umfangreicher Dokumente. Interessant ist, wie es den Flow der Unterhaltung über verschiedene Inhaltstypen hinweg aufrechterhält, ohne den Überblick über das zu verlieren, was Sie gerade besprechen.

Die besten Features von Google Gemini

- Übersetzen Sie zwischen Dutzenden von Sprachen und bewahren Sie dabei den Kontext und die kulturellen Nuancen des Originaltextes.

- Generieren und führen Sie Python-Code direkt in Unterhaltungen aus, zeigen Sie Ergebnisse an und beheben Sie Fehler in Echtzeit.

- Extrahieren Sie strukturierte Daten aus unstrukturierten Quellen wie Belegen, Formularen und handschriftlichen Dokumenten.

- Analysieren Sie gleichzeitig visuelle und akustische Komponenten, um detaillierte Videozusammenfassungen von Videoinhalten zu erhalten.

- Führen Sie komplexe Denkaufgaben durch, die die Kombination von Informationen aus mehreren Quellen und Inhaltstypen erfordern.

Einschränkungen von Google Gemini

- Begrenzte Verfügbarkeit in bestimmten Regionen und für bestimmte Anwendungsfälle

- Im Vergleich zu etablierten Alternativen weniger benutzerdefinierte Optionen zur Modellanpassung

- Benutzer haben Bedenken hinsichtlich des Datenschutzes innerhalb des Google-Ökosystems geäußert.

Preise für Google Gemini

- Free

- Kostenpflichtige Stufe: Die Preise variieren je nach Modell.

Bewertungen und Rezensionen zu Google Gemini

- G2: 4,4/5 (über 245 Bewertungen)

- Capterra: Nicht genügend Bewertungen

🧠 Wissenswertes: Man könnte meinen, dass bessere Modelle weniger Fehler machen, aber das Gegenteil kann der Fall sein. Je größer und fortschrittlicher LLMs werden, desto häufiger neigen sie zu Halluzinationen, insbesondere wenn sie nach Fakten gefragt werden. Selbst neuere Versionen zeigen selbstbewusstere Fehler, die schwerer zu erkennen sind.

📖 Lesen Sie auch: Google Gemini (Bard) vs. ChatGPT – Welches KI-Tool ist das beste?

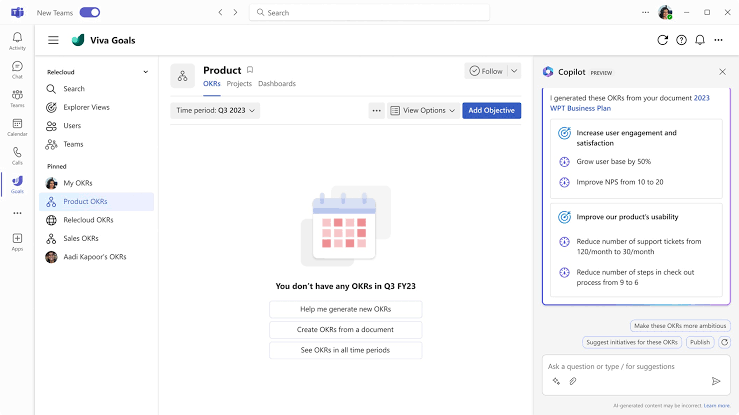

9. Microsoft Copilot (am besten geeignet zur Steigerung der Produktivität in Microsoft Office-Anwendungen)

über Microsoft Copilot

Copilot ist in den Microsoft-Apps integriert, die Sie täglich verwenden, und verändert damit die praktische Anwendung von KI. Es versteht Ihren Arbeitskontext – Ihren Schreibstil, die von Ihnen analysierten Daten und sogar Ihren Verlauf der Meetings.

Bitten Sie es, eine Präsentation zu erstellen, und es ruft relevante Informationen aus Ihren aktuellen Dokumenten und E-Mails ab.

Die Excel-Integration ist besonders clever und hilft Ihnen, Daten mit natürlicher Sprache statt komplexen Formeln zu analysieren. Das Beste daran? Die Lernkurve ist minimal, da die Benutzeroberfläche des KI-Kollaborationstools auf den bekannten Microsoft-Konventionen aufbaut.

Die besten Features von Microsoft Copilot

- Verwandeln Sie Rohdaten mithilfe Ihrer vorhandenen Vorlagen und Branding-Richtlinien in überzeugende PowerPoint-Präsentationen.

- Automatisieren Sie wiederholende Excel-Aufgaben wie Pivottabellen, bedingte Formatierungen und die Erstellung von Formeln durch Sprachbefehle.

- Entwerfen Sie Tagesordnungen für Meetings und Follow-up-E-Mails auf der Grundlage von Kalendereinladungen und früheren Notizen zu Meetings.

- Entwerfen Sie professionell aussehende Dokumente mit integrierten Stilen und Format-Vorschlägen, die den Standards Ihres Unternehmens entsprechen.

Limitierungen von Microsoft Copilot

- Das Tool erfordert ein Microsoft 365-Abonnement und die Einbindung in das Ökosystem und hat außerhalb von Microsoft-Anwendungen nur eingeschränkte Funktionen.

- Uneinheitliche Leistung in verschiedenen Office-Anwendungen

Preise für Microsoft Copilot

- Free

- Copilot Pro: 20 $/Monat

- Copilot für Microsoft 365: 30 $/Monat pro Benutzer (jährliche Abrechnung)

Bewertungen und Rezensionen zu Microsoft Copilot

- G2: 4,4/5 (über 85 Bewertungen)

- Capterra: Nicht genügend Bewertungen

Was sagen echte Benutzer über Microsoft Copilot?

Ein Redditor sagt:

Ich benutze es jeden Tag, um mir bei schwierigeren Excel-Funktionen zu helfen. Wenn ich eine konzeptionelle Vorstellung davon habe, wie ich Daten bearbeiten möchte, lege ich die Situation dar, und Copilot liefert fast immer eine praktische und brauchbare Lösung. Das hat mir geholfen, mich viel besser mit Array-Funktionen vertraut zu machen und mich damit wohlzufühlen.

Ich benutze es jeden Tag, um mir bei schwierigeren Excel-Funktionen zu helfen. Wenn ich eine konzeptionelle Vorstellung davon habe, wie ich Daten bearbeiten möchte, lege ich die Situation dar, und Copilot liefert fast immer eine praktische und brauchbare Lösung. Das hat mir geholfen, mich viel besser mit Array-Funktionen vertraut zu machen und mich damit wohlzufühlen.

📖 Lesen Sie auch: Die besten Microsoft Copilot-Alternativen, die Ihr Leben und Ihre Workflows vereinfachen

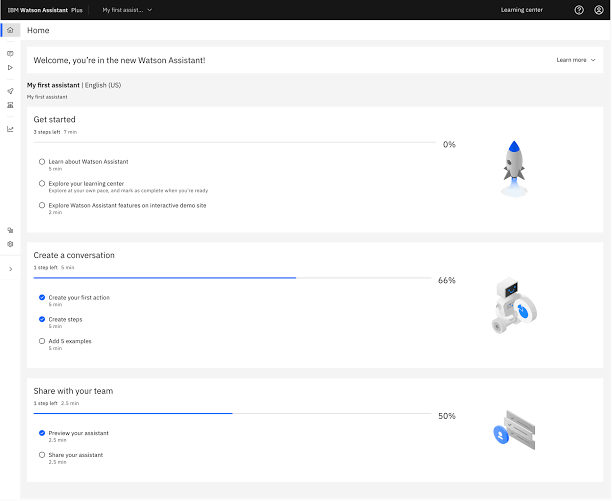

10. IBM WatsonX (Am besten geeignet für den Einsatz von KI in stark regulierten Geschäftsumgebungen)

via IBM WatsonX

IBM hat WatsonX speziell für Organisationen entwickelt, die keine Risiken mit KI eingehen können – beispielsweise Banken, Krankenhäuser und Behörden. Jede Modellentscheidung wird protokolliert, wodurch Prüfpfade entstehen, die Compliance-Teams zu schätzen wissen.

Die Plattform bietet branchenspezifische Lösungen, mit denen Gesundheitsorganisationen auf medizinischer Fachliteratur trainierte Modelle nutzen und Finanzdienstleister Risikobewertungsfunktionen erhalten können.

Je nach Ihren Anforderungen an die Datensensibilität können Sie Modelle vor Ort, in der IBM Cloud oder in hybriden Konfigurationen bereitstellen. Mit den Governance-Features können Sie Leitplanken festlegen und KI-Ausgaben auf Verzerrungen oder unerwartetes Verhalten überwachen.

Die besten Features von IBM WatsonX

- Implementieren Sie eine Fairness-Überwachung, die automatisch Verzerrungen in Modellvorhersagen für verschiedene demografische Gruppen erkennt und korrigiert.

- Erstellen Sie benutzerdefinierte KI-Prompt-Vorlagen mit integrierten Sicherheitsvorkehrungen, die schädliche oder unangemessene KI-Antworten verhindern.

- Erstellen Sie detaillierte Compliance-Berichte, die Modellentscheidungen und Datennutzung für behördliche Audits und Dokumentationen aufzeigen.

- Testen Sie die Robustheit des Modells anhand von gegensätzlichen Beispielen und Randfällen, um potenzielle Schwachstellen vor der Bereitstellung zu identifizieren.

- Richten Sie Human-in-the-Loop-Workflows ein, bei denen wichtige Entscheidungen vor der Ausführung manuell genehmigt werden müssen.

Limit von IBM WatsonX

- Höhere Kosten im Vergleich zu Cloud-nativen Alternativen zu Hugging Face

- Die Anforderungen an Setup und Konfiguration sind komplex.

- Im Vergleich zu neueren KI-Plattformen hat es einen langsameren Zyklus der Innovation.

- Begrenztes Community-Support-Angebot und Erweiterungen von Drittanbietern

Preise für IBM WatsonX

- Free

- Grundlagen: Ab 0 $/Monat (Pay-as-you-go-Modell)

- Standard: Ab 1.050 $/Monat (Pay-as-you-go-Modell)

IBM WatsonX Bewertungen und Rezensionen

- G2: 4,5/5 (über 84 Bewertungen)

- Capterra: Nicht genügend Bewertungen

Was sagen echte Benutzer über IBM WatsonX?

Basierend auf einer G2-Bewertung:

Als Entwickler schätze ich, wie es Flexibilität mit Struktur verbindet und einen breiten Bereich an Modelltypen bietet, von klassischem ML bis hin zu großen Sprachmodellen. Die Benutzeroberfläche ist übersichtlich und die Integration in bestehende Cloud- und Frameworks für Sicherheit ist unkompliziert, was dazu beiträgt, die Experimentierzyklen zu beschleunigen, ohne die Governance zu beeinträchtigen. […] Die Plattform ist zwar leistungsstark, kann aber zunächst überwältigend wirken, insbesondere wenn man benutzerdefinierte Workflows einrichtet. Außerdem könnte die Preisgestaltung für Benutzer, die noch verschiedene Optionen prüfen, bevor sie sich auf Unternehmensebene festlegen, transparenter sein. Verbesserte Onboarding-Tutorials für Entwickler, die neu im IBM-Ökosystem sind, wären eine willkommene Ergänzung.

Als Entwickler schätze ich, wie es Flexibilität mit Struktur verbindet und einen breiten Bereich an Modelltypen bietet, von klassischem ML bis hin zu großen Sprachmodellen. Die Benutzeroberfläche ist übersichtlich und die Integration in bestehende Cloud- und Frameworks für Sicherheit ist unkompliziert, was dazu beiträgt, die Experimentierzyklen zu beschleunigen, ohne die Governance zu beeinträchtigen. […] Die Plattform ist zwar leistungsstark, kann aber zunächst überwältigend wirken, insbesondere wenn man benutzerdefinierte Workflows einrichtet. Außerdem könnte die Preisgestaltung für Benutzer, die noch verschiedene Optionen prüfen, bevor sie sich auf Unternehmensebene festlegen, transparenter sein. Verbesserte Onboarding-Tutorials für Entwickler, die neu im IBM-Ökosystem sind, wären eine willkommene Ergänzung.

🎥 Sehen Sie sich das Video an: Probieren Sie Ihren ersten KI-Agenten aus, der kontextbezogen auf Ihre Arbeit reagiert. Hören Sie es direkt von Zeb Evans, Gründer und CEO von ClickUp:

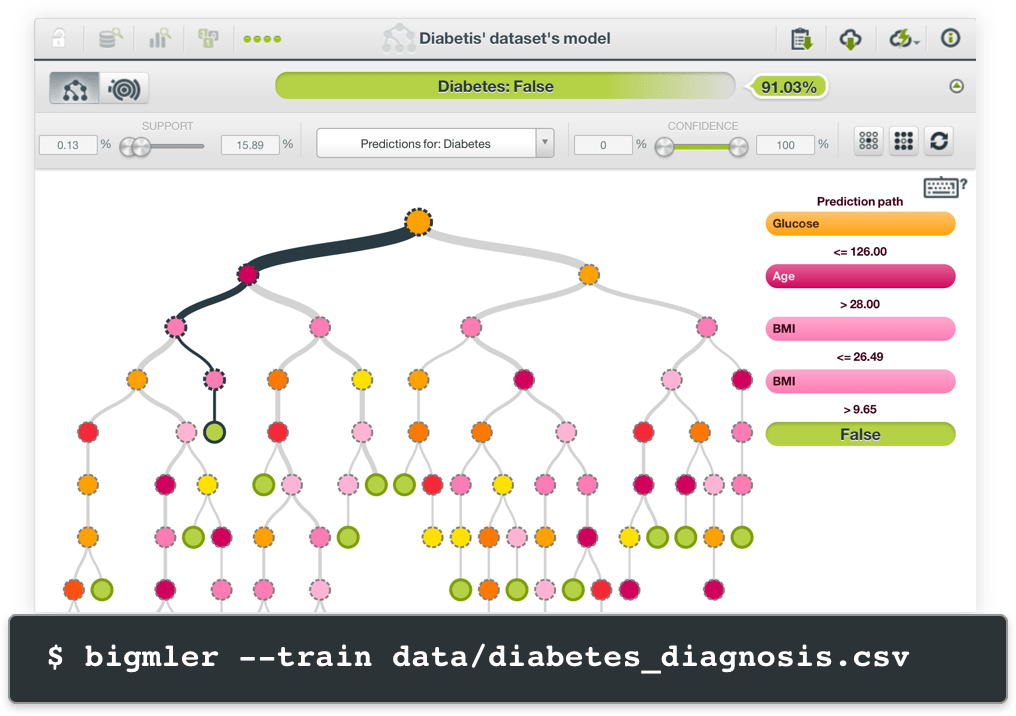

11. BigML. com (Am besten geeignet für die Erstellung von Vorhersagemodellen ohne Code oder technisches Fachwissen)

via BigML

Mit der visuellen Benutzeroberfläche von BigML können Sie Vorhersagemodelle erstellen, indem Sie Datensätze per Drag & Drop verschieben, anstatt komplexen Code zu schreiben. Laden Sie eine CSV-Datei mit Kundendaten hoch, und BigML hilft Ihnen dabei, vorherzusagen, welche Kunden wahrscheinlich abwandern werden.

Die Plattform übernimmt automatisch die Datenvorverarbeitung, die Auswahl der Features und die Modellvalidierung. Was BigML so zuverlässig macht, ist die Art und Weise, wie es seine Vorhersagen erklärt. Sie erhalten klare Visualisierungen, die zeigen, welche Faktoren die Modellentscheidungen beeinflussen, sodass Sie die Ergebnisse leicht den Stakeholdern präsentieren können, die das „Warum” hinter den KI-Empfehlungen verstehen müssen.

BigML. com – die besten Features

- Generieren Sie automatisierte Erkenntnisse und Empfehlungen aus Ihren Daten mithilfe von Erklärungen in natürlicher Sprache, die auch für nicht-technische Teams verständlich sind.

- Kombinieren Sie mehrere Algorithmen, um die Vorhersagegenauigkeit zu verbessern und das Risiko einer Überanpassung mit Ensemble-Modellen zu reduzieren.

- Führen Sie Clusteranalysen durch, um versteckte Muster und Kundensegmente in Ihren Geschäftsdaten zu identifizieren.

- Erstellen Sie Zeitreihen-Prognosemodelle für die Bestandsplanung, Nachfrageprognosen und Finanzprognosen.

- Exportieren Sie Vorhersagelogik als eigenständige Anwendungen oder binden Sie sie direkt in bestehende Geschäftssysteme ein.

Limitierungen von BigML.com

- Es unterstützt Deep Learning und neuronale Netzwerkarchitekturen nur begrenzt.

- Weniger benutzerdefinierte Anpassungsmöglichkeiten im Vergleich zu programmierbasierten Plattformen

- Kleinere Community und Ökosystem von Tools von Drittanbietern

- Weniger geeignet für Spitzenforschung und experimentelle Ansätze

Preise von BigML.com

- 14-tägige kostenlose Testversion

- Standard Prime: 30 $/Monat

Bewertungen und Rezensionen zu BigML.com

- G2: 4,7/5 (über 20 Bewertungen)

- Capterra: Nicht genügend Bewertungen

📖 Lesen Sie auch: Wie man KI für Produktivität nutzt (Anwendungsfälle und Tools)

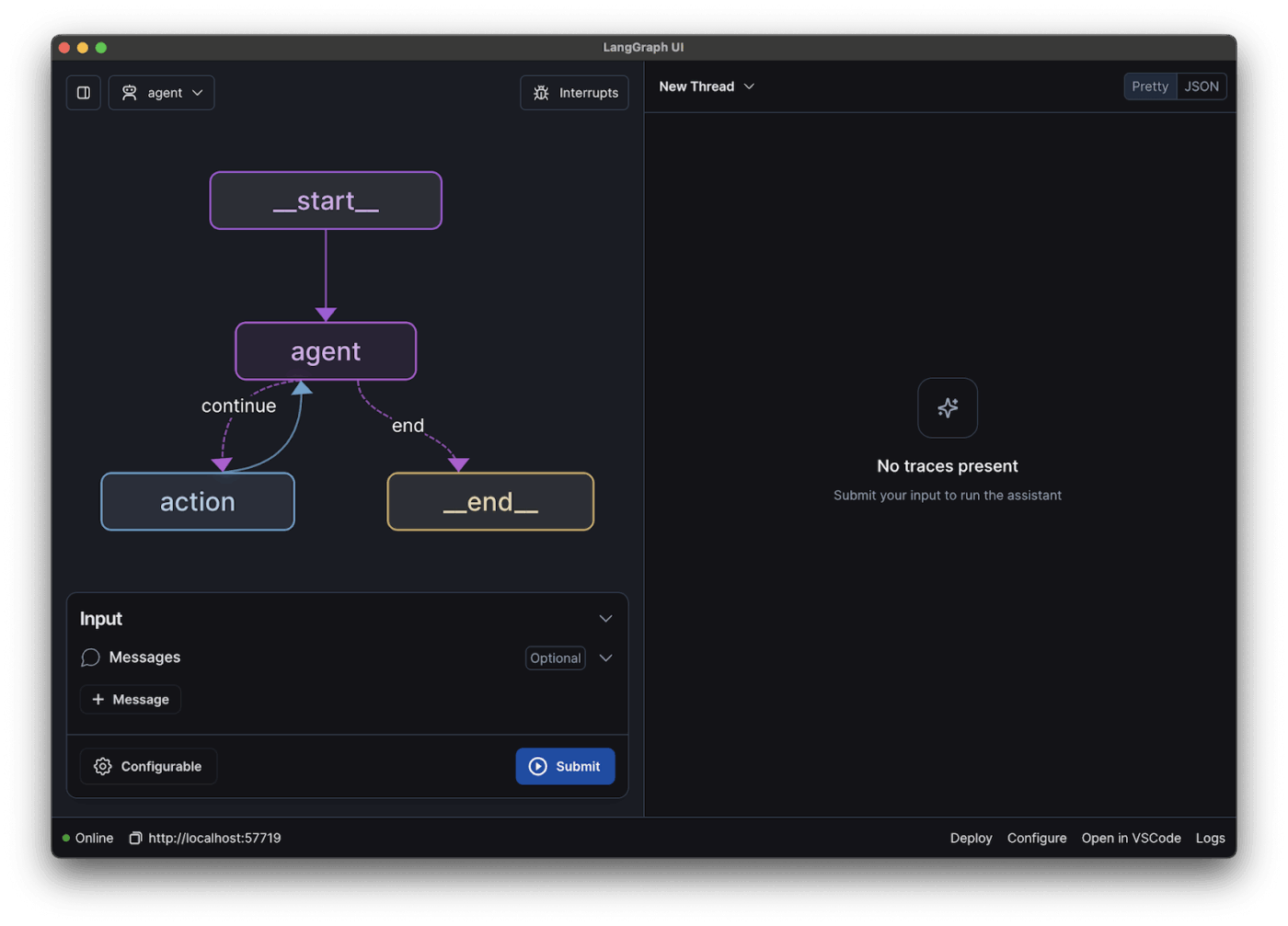

12. LangChain (Am besten geeignet für die Entwicklung komplexer KI-Anwendungen mit mehreren Komponenten)

via LangChain

LangChain löst das Problem der Verbindung von KI-Modellen mit realen Anwendungen. Sie können Systeme erstellen, die Informationen in Datenbanken abrufen, externe APIs aufrufen und die Unterhaltung über mehrere Interaktionen hinweg verwalten.

Das Framework bietet vorgefertigte Komponenten für gängige Muster wie RAG, bei denen KI-Modelle auf bestimmte Dokumente zugreifen und diese zitieren können. Sie können verschiedene KI-Dienste miteinander verknüpfen, beispielsweise indem Sie ein Modell zum Verstehen der Benutzerabsicht und ein anderes zum Generieren von Antworten verwenden.

Darüber hinaus sind die LLM-Agent- Funktionen von LangChain quelloffen und modellunabhängig, sodass Sie nicht an einen bestimmten KI-Anbieter gebunden sind.

Die besten Features von LangChain

- Debuggen Sie komplexe KI-Workflows mit integrierten Tracing- und Logging-Tools, die genau zeigen, wie Daten zwischen Komponenten fließen.

- Speichern Sie teure API-Aufrufe und Modellantworten im Cache, um Kosten zu senken und die Anwendungsleistung zu verbessern.

- Behandeln Sie Fehler elegant mit Wiederholungslogik und Fallback-Mechanismen, wenn KI-Dienste nicht verfügbar sind.

- Erstellen Sie benutzerdefinierte Bewertungsrahmen, um die Leistung von KI-Anwendungen in verschiedenen Szenarien und mit unterschiedlichen Datensätzen zu testen.

- Implementieren Sie Streaming-Antworten für Echtzeitanwendungen, bei denen Benutzer während lang andauernder Prozesse sofortiges Feedback benötigen.

Einschränkungen von LangChain

- Erfordert Programmierkenntnisse und Verständnis von KI-Konzepten.

- Das rasante Entwicklungstempo kann zu grundlegenden Änderungen und Instabilität führen.

- Leistungsaufwand durch Abstraktionsschichten in komplexen Anwendungen

- Eingeschränkte integrierte Überwachungs- und Debugging-Tools für Produktionsumgebungen

LangChain-Preise

- Entwickler: Ab 0 $/Monat (danach nach Verbrauch bezahlen)

- Plus: Ab 39 $/Monat (danach Zahlung nach Verbrauch)

- Unternehmen: Benutzerdefinierte Preisgestaltung

LangChain-Bewertungen und Rezensionen

- G2: Nicht genügend Bewertungen

- Capterra: Nicht genügend Bewertungen

💡 Profi-Tipp: Bevor Sie Ressourcen in ein umfangreiches LLM investieren, sollten Sie eine leistungsstarke Pipeline zur Informationsgewinnung aufbauen, die den Kontext präzise filtert. Die meisten Halluzinationen entstehen durch verrauschte Eingaben und nicht durch Limite des Modells.

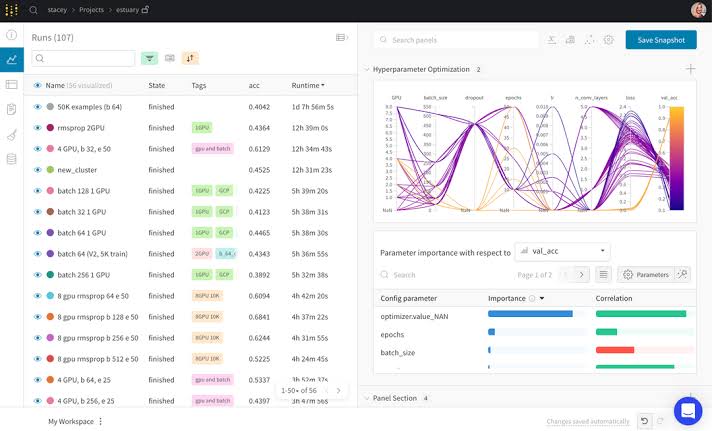

13. Weights & Biases (am besten geeignet für die Nachverfolgung und den Vergleich von Ergebnissen aus Machine-Learning-Experimenten)

via Weights & Biases

Weights & Biases verhindert, dass ML zu einem chaotischen Durcheinander aus vergessenen Experimenten und verlorenen Ergebnissen wird. Die Plattform erfasst automatisch Alles über Ihr Modelltraining: Hyperparameter, Metriken, Versionen des Codes und sogar die Systemleistung.

Wenn etwas gut funktioniert, lässt es sich leicht reproduzieren. Wenn Experimente fehlschlagen, können Sie genau sehen, was schiefgelaufen ist.

Die Visualisierungstools helfen Ihnen dabei, Trends über Hunderte von Trainingsläufen hinweg zu erkennen und zu identifizieren, welche Ansätze die beste Leistung erzielen. Teams schätzen die Features für die Zusammenarbeit, da jeder sehen kann, was andere ausprobieren, ohne sich gegenseitig in die Arbeit zu kommen.

Die besten Features von Weights & Biases

- Richten Sie automatisierte Hyperparameter-Sweeps ein, die verschiedene Parameterkombinationen untersuchen und optimale Konfigurationen identifizieren.

- Erstellen Sie benutzerdefinierte Dashboards mit interaktiven Diagrammen, die im Laufe der Experimente im Laufe des Fortschritts in Echtzeit aktualisiert werden.

- Versehen Sie Experimente mit Tags und organisieren Sie sie mithilfe benutzerdefinierter Metadaten, um relevante Ergebnisse in großen Forschungsprojekten zu finden.

- Freigeben Sie Versuchsergebnisse extern mithilfe öffentlicher Berichte, die keine sensiblen Codes oder Daten preisgeben.

- Profilieren Sie die Trainingsleistung, um Probleme bei der GPU-Auslastung zu identifizieren und die Ressourcenzuweisung zu optimieren.

Limitierungen von Weights & Biases

- Das Tool erhöht die Komplexität für einfache Projekte, die keine umfangreiche Nachverfolgung erfordern.

- Bei großen Teams und umfangreichen Nachverfolgungen von Experimenten können sich die Kosten schnell summieren.

- Es gab Bewertungen bezüglich unzureichender technischer Dokumentation.

Preise für Weights & Biases

Cloud-gehostet

- Free

- Pro: Ab 50 $/Monat

- Unternehmen: Benutzerdefinierte Preisgestaltung

Privat gehostet

- Kostenlos für den privaten Gebrauch

- Advanced Enterprise: Benutzerdefinierte Preisgestaltung

Bewertungen und Rezensionen zu Weights & Biases

- G2: 4,7/5 (über 40 Bewertungen)

- Capterra: Nicht genügend Bewertungen

Was sagen echte Benutzer über Weights & Biases?

Auf Reddit sagte ein Benutzer:

Ich benutze WandB in meinem Job mehrere Stunden pro Tag. Es ist das produktivste Produkt für diese Anwendung auf dem Markt, aber seine Leistung ist soooooo nervig schlecht.

Ich benutze WandB in meinem Job mehrere Stunden pro Tag. Es ist das produktivste Produkt für diese Anwendung auf dem Markt, aber seine Leistung ist soooooo nervig schlecht.

📮 ClickUp Insight: Nur 12 % der Befragten unserer Umfrage nutzen KI-Features, die in Suiten zur Steigerung der Produktivität integriert sind. Diese geringe Akzeptanz deutet darauf hin, dass den aktuellen Implementierungen möglicherweise die nahtlose, kontextbezogene Integration fehlt, die Benutzer dazu bewegen würde, von ihren bevorzugten eigenständigen Konversationsplattformen umzusteigen.

Kann die KI beispielsweise einen Automatisierungs-Workflow auf der Grundlage eines Nur-Textes des Benutzers ausführen? ClickUp Brain kann das ! Die KI ist tief in alle Aspekte von ClickUp integriert, darunter unter anderem das Zusammenfassen von Chat-Threads, das Verfassen oder Überarbeiten von Texten, das Abrufen von Informationen aus dem Workspace, das Erstellen von Bildern und vieles mehr!

Schließen Sie sich den 40 % der ClickUp-Kunden an, die mehr als drei Apps durch unsere All-in-One-App für die Arbeit ersetzt haben!

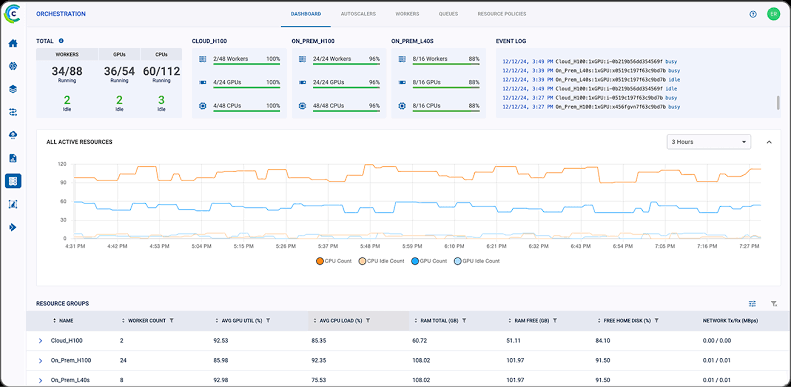

14. ClearML (am besten geeignet für die Automatisierung von End-to-End-Workflows für maschinelles Lernen)

via ClearML

ClearML bewältigt den operativen Albtraum der Verwaltung von Machine-Learning-Modellen in der Produktion. Die Plattform übernimmt die Nachverfolgung aller Aspekte Ihres ML-Workflows, von der Datenvorverarbeitung bis zur Modellbereitstellung, und erstellt so ohne manuellen Aufwand einen vollständigen Prüfpfad.

Wenn Modelle in der Produktion ausfallen, können Sie Probleme auf bestimmte Datenänderungen oder Code-Modifikationen zurückführen. Dank der verteilten Trainingsfunktionen können Sie Experimente nahtlos auf mehrere Maschinen und Cloud-Anbieter skalieren.

Darüber hinaus erfolgt durch die Pipeline-Orchestrierung die Automatisierung wiederholender Aufgaben wie Datenvalidierung, Modell-Retraining und Bereitstellungsgenehmigungen.

Die besten Features von ClearML

- Planen Sie Experimente so, dass sie automatisch außerhalb der Spitzenzeiten ausgeführt werden, um die Rechenkosten und die Ressourcennutzung zu optimieren.

- Vergleichen Sie die Modellleistung über verschiedene Datensätze und Zeiträume hinweg mithilfe standardisierter Metriken.

- Integrieren Sie vorhandene CI/CD-Pipelines und Bereitstellungstools mithilfe benutzerdefinierter Artefakte und Modellregistrierungen.

- Implementieren Sie Blue-Green-Bereitstellungen für ML-Modelle mit automatisierten Rollback-Funktionen für den Fall, dass die Leistung nachlässt.

- Generieren Sie automatisch Compliance-Dokumentationen für regulierte Branchen, die eine detaillierte Modell-Governance erfordern.

Limitierungen von ClearML

- Komplexes Setup und Konfiguration für erweiterte Features

- Lernkurve für Teams, die von einem einfacheren Workflow-Management umsteigen

- Die ressourcenintensive Überwachung von ClearML kann sich auf die Systemleistung auswirken.

- Im Vergleich zu etablierteren Alternativen zu Hugging Face nur begrenzte Integrationsmöglichkeiten

Preise für ClearML

- Free

- Pro: 15 $/Monat pro Benutzer + Nutzung (für Teams mit bis zu 10 Mitgliedern)

- Skalierbarkeit: Benutzerdefinierte Preisgestaltung

- Unternehmen: Benutzerdefinierte Preisgestaltung

ClearML-Bewertungen und Rezensionen

- G2: Nicht genügend Bewertungen

- Capterra: Nicht genügend Bewertungen

Was sagen echte Benutzer über ClearML?

Wir verwenden ClearML ausschließlich für die Nachverfolgung von Experimenten und haben sowohl den ClearML-Server als auch den ClearML-Agenten auf unserer internen Infrastruktur selbst gehostet. Bislang haben wir mit ClearML hervorragende Erfahrungen gemacht – insbesondere hinsichtlich der Verwaltung von Experimenten, der Reproduzierbarkeit und des Workflows für die Bereitstellung.

Wir verwenden ClearML ausschließlich für die Nachverfolgung von Experimenten und haben sowohl den ClearML-Server als auch den ClearML-Agenten auf unserer internen Infrastruktur selbst gehostet. Bislang haben wir mit ClearML hervorragende Erfahrungen gemacht – insbesondere hinsichtlich der Verwaltung von Experimenten, der Reproduzierbarkeit und des Workflows für die Bereitstellung.

🔍 Wussten Sie schon? Hybride Systeme schneiden durchweg besser ab als Suchmaschinen, die nur eine einzige Methode verwenden. Integrieren Sie beide Ansätze in Ihre KI-Suchmaschine, um semantisches Verständnis mit exakter Übereinstimmung zu verbinden.

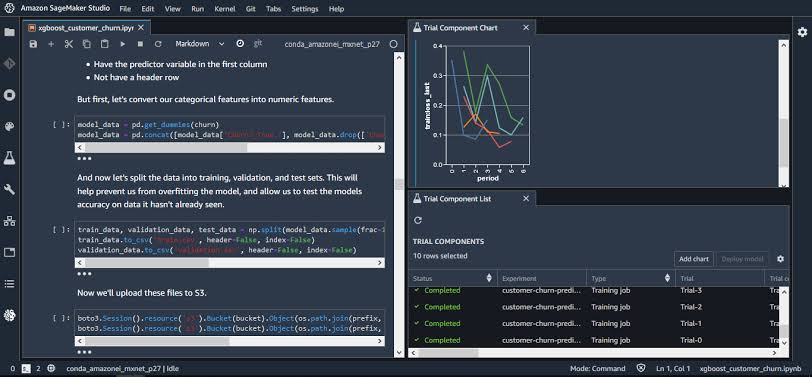

15. Amazon SageMaker (am besten geeignet für die Verwaltung kompletter ML-Lebenszyklen auf AWS-Infrastruktur)

über Amazon SageMaker

SageMaker ist sinnvoll, wenn Sie bereits in der AWS-Welt zu Hause sind und ML-Funktionen benötigen, die nahtlos mit Ihrer bestehenden Infrastruktur zusammenarbeiten. Die verwalteten Notebooks machen Schluss mit lästigen Server-Setups, während integrierte Algorithmen gängige Anwendungsfälle ohne benutzerdefinierten Code abdecken.

Ground Truth hilft bei der Erstellung hochwertiger Trainingsdatensätze durch verwaltete Annotations-Workflows, was besonders dann von Vorteil ist, wenn menschliche Labeler für Bild- oder Textdaten benötigt werden.

Wenn die Modelle produktionsbereit sind, übernimmt SageMaker komplexe Aufgaben wie Lastenausgleich und automatische Skalierung. Alles wird über Ihr bestehendes AWS-Konto abgerechnet, was die Kostenverwaltung vereinfacht.

Die besten Features von Amazon SageMaker

- Trainieren Sie Modelle mithilfe einer verwalteten Infrastruktur, die Ressourcen automatisch basierend auf der Größe des Datensatzes und den Rechenanforderungen bereitstellt.

- Stellen Sie Modelle über skalierbare Endpunkte bereit, die Traffic-Spitzen bewältigen und die Kapazität automatisch an den Bedarf anpassen.

- Optimieren Sie die Modellleistung mithilfe der automatischen Hyperparameter-Optimierung, die Tausende von Kombinationen testet, um die optimalen Einstellungen zu finden.

- Überwachen Sie Produktionsmodelle mit der CloudWatch-Integration, die die Nachverfolgung der Vorhersagegenauigkeit, Latenz und Datenqualitätsmetriken durchführt.

Einschränkungen von Amazon SageMaker

- Die komplexe Preisstruktur kann bei großflächiger Nutzung zu unerwarteten Kosten führen, da unklar ist,

- Für Teams, die mit dem AWS-Ökosystem und den AWS-Diensten nicht vertraut sind, ist eine gewisse Einarbeitungszeit erforderlich.

- Die Benutzeroberfläche des Tools kann aufgrund von Störungen langsam oder schwer zu navigieren sein.

- Die Verwendung von Amazon SageMaker erschwert die Migration zu anderen Cloud-Anbietern.

Preise für Amazon SageMaker

- SageMaker Unified Studio: Free

- Benutzerdefinierte Preisgestaltung

Bewertungen und Rezensionen zu Amazon SageMaker

- G2: 4,3/5 (45 Bewertungen)

- Capterra: Nicht genügend Bewertungen

Was sagen echte Benutzer über Amazon SageMaker?

Laut einer G2-Bewertung:

Was mir an Amazon SageMaker am besten gefällt, ist die Möglichkeit, den gesamten Lebenszyklus des maschinellen Lernens auf einer integrierten Plattform zu verwalten. Es vereinfacht die Modellerstellung, das Training und die Bereitstellung und bietet gleichzeitig Skalierbarkeit und leistungsstarke tools wie SageMaker Studio und Automatisierung der Modelloptimierung.

Was mir an Amazon SageMaker am besten gefällt, ist die Möglichkeit, den gesamten Lebenszyklus des maschinellen Lernens auf einer integrierten Plattform zu verwalten. Es vereinfacht die Modellerstellung, das Training und die Bereitstellung und bietet gleichzeitig Skalierbarkeit und leistungsstarke tools wie SageMaker Studio und automatisierte Modelloptimierung.

💡 Profi-Tipp: Trainieren Sie nicht, was Sie nicht strukturieren können. Bevor Sie mit der Feinabstimmung beginnen, fragen Sie sich: Kann dies mit strukturierter Logik und einem Basismodell gelöst werden? Beispielsweise sollten Sie nicht ein Modell zum Erkennen von Rechnungsarten trainieren, sondern zunächst einen einfachen Klassifikator hinzufügen, der anhand von Metadaten filtert.

Optimieren Sie Ihren Workflow mit ClickUp

Es gibt unzählige Alternativen zu Hugging Face, aber warum sollte man sich auf Modelle und APIs beschränken?

ClickUp legt noch eine Schippe drauf.

Mit ClickUp Brain und Brain MAX können Sie schneller schreiben, Dinge in Sekundenschnelle zusammenfassen und Automatisierungen ausführen, die Sie verstehen. Es ist direkt in Ihre Aufgaben, Dokumente und Chats integriert, sodass Sie nie zwischen Tools oder Registerkarten hin- und herspringen müssen.

Melden Sie sich bei ClickUp an und erfahren Sie, warum es die intelligenteste Hugging Face-Alternative auf dem Markt ist! ✅