LLaMA'yı keşfeden çoğu kurumsal takım aynı noktada takılır: model ağırlıklarını indirir, terminal penceresine bakar ve bundan sonra ne yapacaklarını bilmediklerini fark ederler.

Bu zorluk yaygın bir sorundur: Şirketlerin %88'i en az bir fonksiyonda yapay zeka kullanırken, yalnızca %7'si bunu kuruluş genelinde ölçeklendirmiştir.

Bu kılavuz, kullanım durumunuza uygun model boyutunu seçmekten şirketinizin verilerine göre ince ayar yapmaya kadar tüm süreci adım adım anlatır, böylece iş bağlamınızı gerçekten anlayan, çalışan bir yapay zeka çözümü kullanıma sunabilirsiniz.

LLaMA nedir ve kurumsal yapay zeka için neden önemlidir?

LLaMA (Large Language Model Meta AI'nın kısaltması), Meta tarafından oluşturulan açık ağırlıklı dil modelleri ailesidir. Genel olarak, GPT veya Gemini gibi modellerle aynı temel işlevleri yapar: dili anlar, metin üretir ve bilgiler arasında mantıksal bağlantılar kurabilir. En büyük fark, kurumsal kullanıcıların bunu nasıl kullanabileceğidir.

LLaMA açık ağırlıklı olduğu için, şirketler sadece kara kutu API aracılığıyla onunla etkileşim kurmak zorunda değildir. Kendi altyapılarında çalıştırabilir, iç verilerle ince ayar yapabilir ve nasıl ve nerede dağıtılacağını kontrol edebilirler.

Kurumsal şirketler için bu çok önemli bir konudur, özellikle de veri gizliliği, uyumluluk ve maliyet öngörülebilirliği yenilikten daha önemli olduğunda.

Bu esneklik, LLaMA'yı yalnızca bağımsız bir sohbet robotu olarak değil, iş akışlarına derinlemesine entegre edilmiş bir yapay zeka isteyen takımlar için özellikle cazip hale getirir. Hassas verileri kuruluş dışına göndermeden, iç bilgi asistanları, müşteri desteği otomasyonu, geliştirici araçları veya doğrudan ürünlere entegre edilmiş yapay zeka özelliklerini düşünün.

Kısacası, LLaMA kurumsal yapay zeka için önemlidir çünkü takımlara dağıtım, özelleştirme ve gerçek iş sistemlerine yapay zeka entegrasyonu konusunda seçim imkanı sunar. Yapay zeka deneysel aşamadan günlük operasyonlara geçerken, bu kontrol seviyesi "olması iyi olan" bir özellik olmaktan çıkıp bir gereklilik haline gelir.

Kurumsal Uygulamalar için LLaMA'ya Nasıl Başlanır?

1. Kurumsal kullanım durumunuzu tanımlayın

Herhangi bir şey indirmeden önce, AI'nın gerçek bir etki yaratabileceği ş akışlarını tam olarak belirleyin. AI kullanım senaryosunu model boyutuyla eşleştirmek anahtardır. Daha küçük 8B modeller basit görevler için verimlidir, daha büyük 70B+ modeller ise karmaşık muhakeme için daha uygundur.

İşletmeniz için doğru AI uygulamalarını belirlemenize yardımcı olması için, farklı kurumsal fonksiyonlar ve sektörlerdeki pratik AI kullanım örneklerinin genel bir özetini içeren bu videoyu izleyin:

Yaygın başlangıç noktaları şunlardır:

- Belge işleme: Uzun raporları özetleme veya sözleşmelerden anahtar bilgileri çıkarma

- Kod yardımı: Boilerplate kod oluşturma, eski sistemleri açıklama veya optimizasyon önerileri

- Bilgi erişimi: Retrieval-Augmented Generation (RAG) adlı bir teknik kullanarak iç belgeleri arayarak çalışanların sorularını yanıtlama.

- İçerik oluşturma: İlk aşama iletişim veya pazarlama metinleri taslağı hazırlama

2. Önkoşulları ve bağımlılıkları ayarlayın

Ardından, donanım ve yazılımınızı hazırlayın. Model boyutu ihtiyaçlarınızı belirler; bir LLaMA 8B modeli yaklaşık 15 GB VRAM'e sahip bir GPU gerektirirken, 70B modeli 131 GB veya daha fazlasına ihtiyaç duyar.

Yazılım yığınınızda Python 3. 8+, PyTorch, CUDA sürücüleri ve Hugging Face ekosistemi (transformatörler, hızlandırıcılar ve bitler ve baytlar) bulunmalıdır.

3. LLaMA model ağırlıklarına erişin ve indirin

Model ağırlıklarını Meta'nın resmi Llama indirme sayfasından veya Hugging Face model hub'ından edinebilirsiniz. Ticari kullanıma izin veren Llama 3 Topluluk Lisansını kabul etmeniz gerekecektir. Kurulumunuza bağlı olarak, ağırlıkları safetensors veya GGUF biçiminde indireceksiniz.

4. Geliştirme ortamınızı yapılandırın

Ağırlıklar indirildikten sonra, ortamınızı kurma zamanı gelmiştir. Modelin bellek ayak izini azaltan bir işlem olan niceleme için transformers, accelerate ve bitsandbytes dahil olmak üzere gerekli Python kütüphanelerini yükleyin.

Modeli doğru ayarlarla yükleyin ve özelleştirmeye geçmeden önce her şeyin doğru çalıştığından emin olmak için basit bir test komutu çalıştırın.

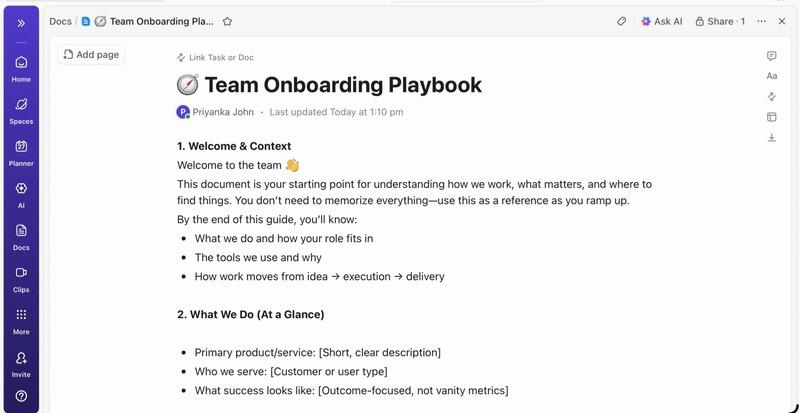

💡Özel bir ML altyapı takımınız yoksa, tüm bu süreç başlangıçta bile başarısız olabilir. ClickUp Brain ile dağıtımın karmaşıklığını tamamen ortadan kaldırın. Ekibinizin halihazırda çalıştığı ClickUp Çalışma Alanı’nda, model indirme veya GPU sağlama gerektirmeden, yazma yardımı ve görev otomasyonu gibi yapay zeka yetenekleri sunar.

Kurumsal Verileriniz için LLaMA'yı Özel Yapma

Temel bir LLaMA modeli kullanmak iyi bir başlangıçtır, ancak bu model şirketinizin kendine özgü kısaltmalarını, proje adlarını veya iç süreçlerini anlamayacaktır. Bu da gerçek iş sorunlarını çözemeyen, genel ve yararsız yanıtlara yol açar.

Kurumsal AI, özelleştirme yoluyla kullanışlı hale gelir — modeli belirli terminolojiniz ve bilgi tabanınız üzerinde eğiterek.

Alanınıza özgü eğitim verilerinizi hazırlayın

Özel yapay zekanızın başarısı, model boyutu veya hesaplama gücünden çok, eğitim verilerinizin kalitesine bağlıdır. İç bilgilerinizi toplayarak ve temizleyerek başlayın.

- Dahili belgeler: Ürün özelliklerini, süreç kılavuzlarını ve politika belgelerini toplayın.

- Geçmiş iletişim: E-posta şablonlarını, destek bileti yanıtlarını ve toplantı özetlerini toplayın.

- Alan terminolojisi: Sözlükler, kısaltma tanımları ve sektöre özgü dil derlemeleri

Toplanan bu bilgileri, denetimli ince ayar için talimat-yanıt çiftleri halinde biçimlendirin. Örneğin, bir talimat "Bu destek biletini özetleyin" olabilir ve yanıt, temiz ve özlü bir özet olabilir. Bu adım, modele verilerinizle belirli görevleri nasıl gerçekleştireceğini öğretmek için çok önemlidir.

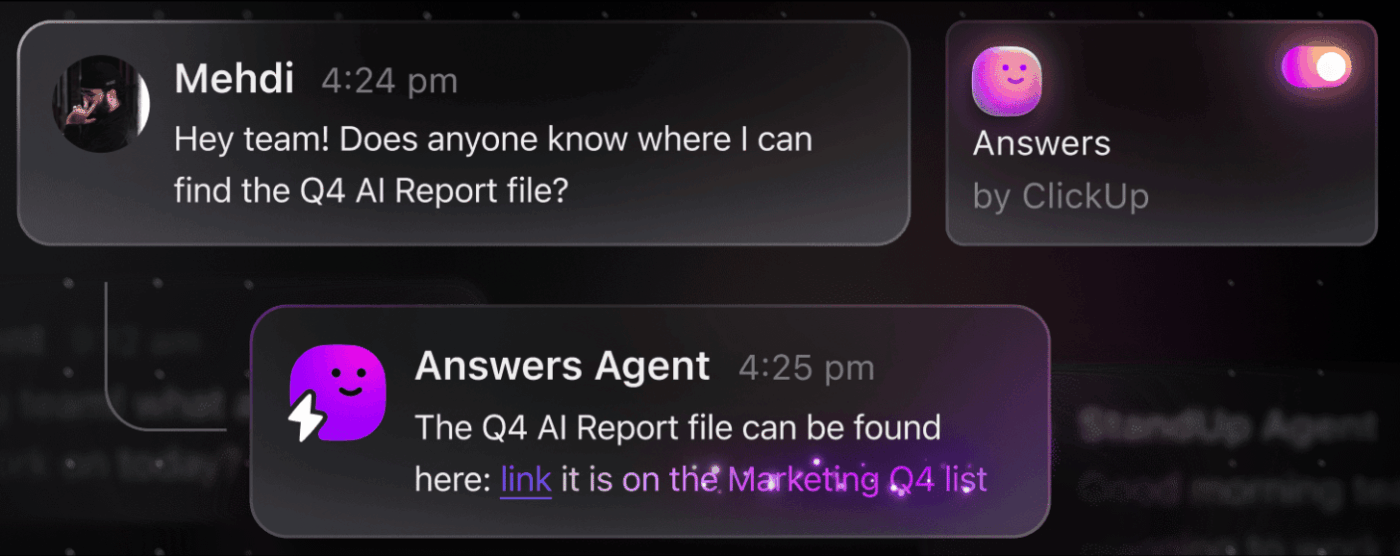

📮 ClickUp Insight: Ortalama bir profesyonel, iş ile ilgili bilgileri aramak için günde 30 dakikadan fazla zaman harcıyor. Bu, e-postaları, Slack konuları ve dağınık dosyaları aramak için yılda 120 saatten fazla zamanın kaybedilmesi anlamına geliyor. Çalışma Alanınıza entegre edilmiş akıllı bir AI asistanı bunu değiştirebilir.

ClickUp Brain'e girin. Doğru belgeleri, konuşmaları ve görev ayrıntılarını saniyeler içinde ortaya çıkararak anında içgörüler ve yanıtlar sunar, böylece aramayı bırakıp iş yapmaya başlayabilirsiniz.

💫 Gerçek Sonuçlar: QubicaAMF gibi takımlar, ClickUp'ı kullanarak eski bilgi yönetimi süreçlerini ortadan kaldırarak haftada 5 saatten fazla zaman kazandılar. Bu, kişi başına yıllık 250 saatten fazla bir zaman tasarrufu anlamına geliyor. Takımınızın her çeyrekte fazladan bir hafta daha verimlilikle neler başarabileceğini bir düşünün!

LLaMA'yı iş bağlamınıza göre ince ayarlayın

İnce ayar, LLaMA'nın mevcut bilgisini belirli kullanım durumunuza uyarlama sürecidir ve bu, alanına özgü görevlerde doğruluğunu önemli ölçüde artırır. Modeli sıfırdan eğitmek yerine, modelin parametrelerinin yalnızca küçük bir alt kümesini güncelleyen parametre verimli yöntemler kullanarak zaman ve hesaplama kaynaklarından tasarruf edebilirsiniz.

Popüler ince ayar yöntemleri şunlardır:

- LoRA (Düşük Sıralı Uyarlama): Bu yöntem, modelin tamamı yerine küçük "uyarlayıcı" matrisleri eğiterek yüksek verimlilik sağlar.

- QLoRA: LoRA ile nicelemeyi birleştirerek, tam ince ayar performansını korurken tek bir 48 GB GPU üzerinde ince ayar yapılmasına olanak tanır.

- Tam ince ayar: Modelin tüm parametrelerini günceller, en derin düzeyde özel ayar sunar, ancak önemli ölçüde hesaplama gücü gerektirir.

📚 Ayrıca okuyun: Kurumsal Yapay Zeka Araçları ile İşleri Dönüştürme

Model performansını değerlendirin ve yineleyin

Özelleştirilmiş modelinizin gerçekten çalıştığını nasıl anlarsınız? AI değerlendirmesi, basit doğruluk puanlarının ötesine geçmeli ve gerçek dünyadaki kullanışlılığını ölçmelidir. Üretim kullanım durumlarınızı yansıtan değerlendirme veri kümeleri oluşturun ve yanıt kalitesi, gerçek doğruluğu ve gecikme süresi gibi işiniz için önemli olan metrikleri izleyin.

- Niteliksel değerlendirme: İnsan gözden geçirenlerin çıktıları ton, yararlılık ve doğruluk açısından değerlendirmelerini sağlayın.

- Nicel metrikler: BLEU veya perplexity gibi otomasyonla hesaplanan puanları kullanarak performansı büyük ölçekte izlemeyi gerçekleştirin.

- Üretim izleme: Dağıtımdan sonra, kullanıcı geri bildirimlerini ve hata oranlarını izleyerek iyileştirilmesi gereken alanları belirleyin.

💡Bu yinelemeli eğitim ve değerlendirme süreci, başlı başına bir proje haline gelebilir. Yapay zeka geliştirme yaşam döngüsünü, elektronik tablolarda kaybolmak yerine doğrudan ClickUp'ta yönetin.

ClickUp Gösterge Panelleri ile performans metriklerini ve değerlendirme sonuçlarını tek bir görünümde merkezileştirin. ClickUp Özel Alanlar ile model sürümlerini, eğitim parametrelerini ve değerlendirme puanlarını diğer ürün işlerinizle birlikte izleyin, her şeyi düzenli ve görünür tutun. 🛠️

LLaMA için En Önemli Kurumsal Kullanım Örnekleri

Takımlar genellikle analiz felci yaşayarak, yapay zeka konusundaki soyut heyecandan somut uygulamalara geçemiyorlar. LLaMA'nın esnekliği, onu çok çeşitli kurumsal iş akışları için uygun hale getirerek, görevleri otomasyonla gerçekleştirmenize ve daha verimli çalışmanıza yardımcı olur.

Özel olarak ayarlanmış bir LLaMA modelinin en önemli kullanım örneklerinden bazıları şunlardır:

- Dahili bilgi asistanları: Bilgi aramakla zaman kaybetmeyi bırakın. RAG ile LLaMA'yı kullanarak, dahili wiki'lerinizi, politika belgelerinizi ve geçmiş proje iletişimlerinizi arayarak çalışanların sorularını anında yanıtlayabilen bir sohbet robotu oluşturun.

- Müşteri desteği otomasyonu: Bilet geçmişinizdeki modeli ince ayarlayarak yanıtları otomatik olarak taslak haline getirin, soruları kategorilere ayırın ve karmaşık sorunları doğru müşteri temsilcisine iletin.

- Kod oluşturma ve inceleme: Mühendislik takımınızın daha verimli çalışmasına yardımcı olun. LLaMA'yı kullanarak standart kodlar oluşturun, karmaşık eski sistemleri açıklayın ve hatta sorun haline gelmeden Çekme Taleblerindeki potansiyel hataları tespit edin.

- Belge işleme: Büyük hacimli metinleri yararlı bilgilere dönüştürün. Uzun raporları özetleyin, yasal sözleşmelerden anahtar terimleri çıkarın veya ham transkriptlerden saniyeler içinde özlü toplantı notları oluşturun.

- İçerik oluşturma ş akışları: Yazarın tıkanıklığını aşın. İnsan düzenleyicileriniz daha sonra iyileştirebileceği ve mükemmelleştirebileceği pazarlama metinleri, ürün açıklamaları ve iç duyurular taslakları hazırlayın.

💡ClickUp Brain ile bu kullanım örneklerinin çoğuna hazır olarak erişin.

- ClickUp'ın yapay zeka destekli yazma yardımı ile görev konularıını özetleyin, proje güncellemelerini taslak haline getirin ve içerik oluşturun.

- ClickUp'ın Kurumsal Arama özelliği ve önceden oluşturulmuş Ambient Answers ajanı ile tüm Çalışma Alanınızda anında cevapları bulun.

- ClickUp otomasyonları ile rutin işlerinizi sizin için halleden akıllı ş akışları oluşturun.

Kurumsal Yapay Zeka için LLaMA Kullanımının Sınırlamaları

LLaMA'yı kendi sunucunuzda barındırmak önemli bir kontrol sağlasa da, bazı zorlukları da beraberinde getirir. Takımlar genellikle operasyonel masrafları hafife alır ve inovasyon yerine bakım işleriyle uğraşmak zorunda kalır. "Oluşturma" yoluna girmeden önce, olası engelleri anlamak çok önemlidir.

Dikkate alınması gereken bazı anahtar sınırlamalar şunlardır:

- Altyapı gereksinimleri: Büyük modelleri çalıştırmak pahalıdır ve birçok kuruluşun elinde bulunmayan güçlü, kurumsal düzeyde GPU'lar gerektirir.

- Gerekli teknik uzmanlık: Büyük bir dil modelini dağıtmak, ince ayar yapmak ve bakımını yapmak, yüksek talep gören özel ML mühendislik becerileri gerektirir.

- Sürekli bakım yükü: Bu, "ayar ve unut" türünde bir çözüm değildir. Modeller, işiniz geliştikçe sürekli izleme, güvenlik güncellemeleri ve yeniden eğitim gerektirir.

- Halüsinasyon riski: Tüm LLM'ler gibi, LLaMA da bazen makul görünen ancak yanlış bilgiler üretebilir. Kurumsal uygulamalar, bu riski azaltmak için sağlam koruma önlemleri ve insan gözetimi gerektirir.

- Yerleşik kurumsal özellikler yoktur: Erişim kontrolü, denetim günlüğü ve uyumluluk araçları gibi kritik özellikler ayrı olarak oluşturulmalı ve yönetilmelidir, bu da karmaşıklığı bir kat daha artırır.

💡ClickUp Brain'i kullanarak bu sınırlamaları aşabilirsiniz. Mevcut çalışma alanınızda yönetilen yapay zeka sağlar ve operasyonel masraflar olmadan kurumsal yapay zeka yetenekleri sunar. ClickUp ile kurumsal düzeyde güvenlik elde edin ve altyapı bakımını ortadan kaldırın, böylece takımınızın temel işlerine odaklanmasını sağlayın.

📮ClickUp Insight: Anket katılımcılarımızın %88'i kişisel görevleri için yapay zeka kullanıyor, ancak %50'den fazlası iş yerinde kullanmaktan çekiniyor. Üç ana engel nedir? Sorunsuz entegrasyon eksikliği, bilgi eksikliği veya güvenlik endişeleri.

Peki ya AI çalışma alanınıza entegre edilmiş ve zaten güvenliyse? ClickUp Brain, ClickUp'ın yerleşik AI asistanı, bunu gerçeğe dönüştürüyor. Basit dildeki komutları anlar, AI'nın benimsenmesiyle ilgili üç endişeyi de ortadan kaldırırken, sohbetlerinizi, görevlerinizi, belgelerinizi ve bilgilerinizi Çalışma Alanı genelinde birbirine bağlar. Tek bir tıklama ile cevapları ve içgörüleri bulun!

Kurumsal Kullanım Örnekleri için Alternatif Yapay Zeka Araçları

Mevcut birçok seçenek arasından doğru AI aracını seçmek, her takım için zorlu bir görevdir. Farklı modeller arasındaki artıları ve eksileri değerlendirmeye çalışıyorsunuz, ancak yanlış modeli seçip kaynakları boşa harcamaktan endişe duyuyorsunuz.

Bu durum genellikle AI Sprawl'a yol açar —gözetim veya strateji olmaksızın AI araçlarının ve platformlarının plansız bir şekilde yayılması—takımlar birbiriyle bağlantısı olmayan birden fazla hizmete abone olur ve iş yükünü azaltmak yerine artırır.

İşte başlıca oyuncular ve bunların yerleri hakkında kısa bir özet:

| Araç | En Uygun | Önemli Hususlar |

|---|---|---|

| LLaMA (kendi sunucunuzda barındırılan) | Maksimum kontrol, veri egemenliği | ML altyapısı ve uzmanlık gerektirir. |

| OpenAI GPT-4 | En yüksek kapasite, minimum kurulum | Veriler ortamınızdan çıkar, kullanıma dayalı fiyatlandırma |

| Claude (Anthropic) | Uzun bağlamlı görevler, güvenlik odaklılık | GPT-4 ile benzer ödünleşimler |

| Mistral | Avrupa veri yerleşimi, verimlilik | LLaMA'dan daha küçük ekosistem |

| ClickUp Brain | Entegre Çalışma Alanı yapay zeka, dağıtım gerektirmez | Mevcut ş akışlarında yapay zeka isteyen takımlar için en uygun seçenek |

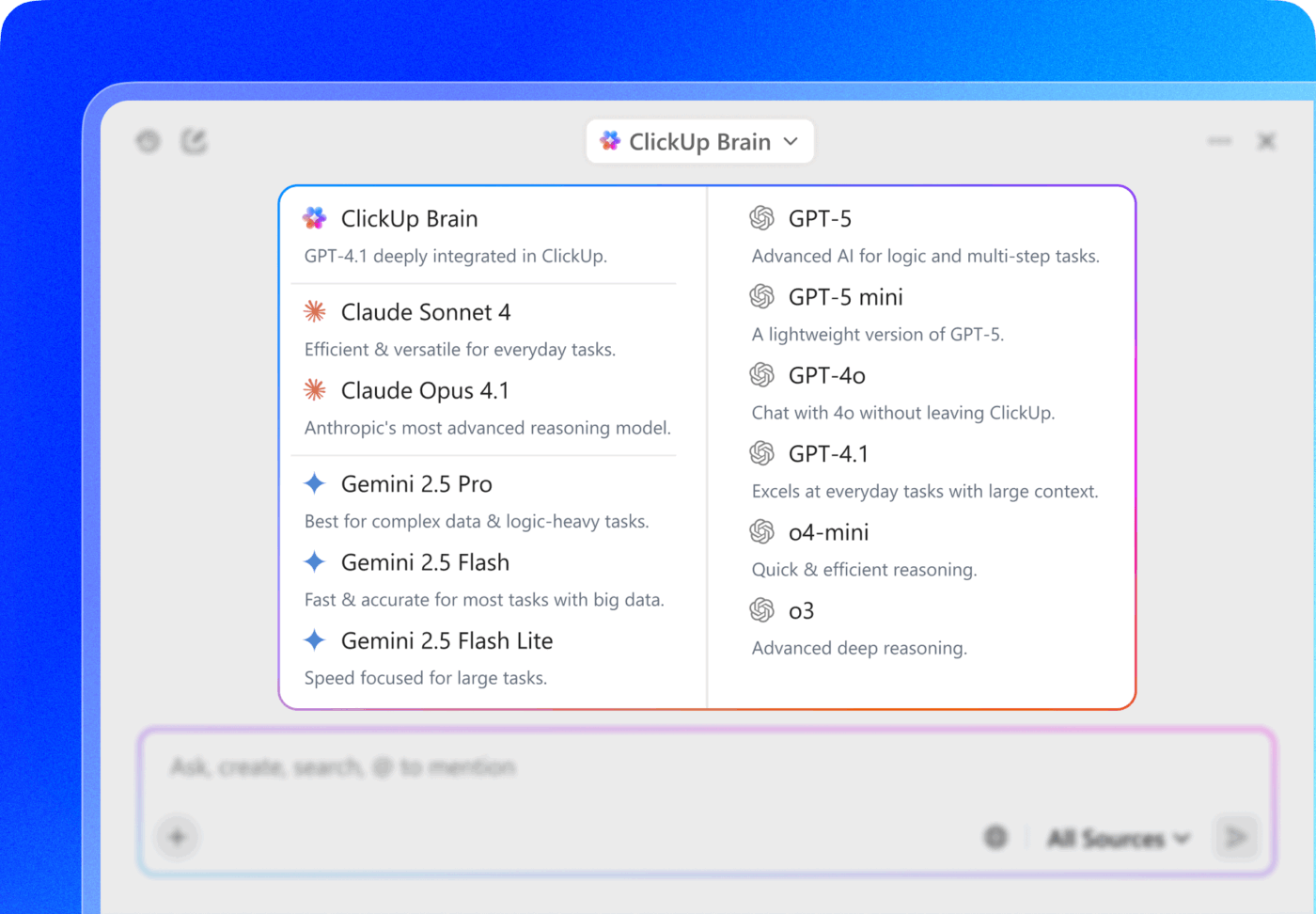

İhtiyaçlarınızı karşılamak için birden fazla aracı birbirine bağlamak yerine, işinizin yapıldığı yerde doğrudan gömülü AI'ya erişmeye ne dersiniz? Bu, ClickUp'ın dünyanın ilk Converged AI Çalışma Alanı (Birleştirilmiş AI Çalışma Alanı) olarak sunduğu hizmetin özüdür — projeler, belgeler, konuşmalar ve analizlerin bir arada bulunduğu tek ve güvenli bir platform.

Araçlarınızı birleştirerek, takımlarınızın uygulamalar arasında geçiş yapmak ve işlerini yapmak için ihtiyaç duydukları bilgileri aramak için saatler harcadıklarında ortaya çıkan bağlam dağınıklığını ve parçalanmayı ortadan kaldırır.

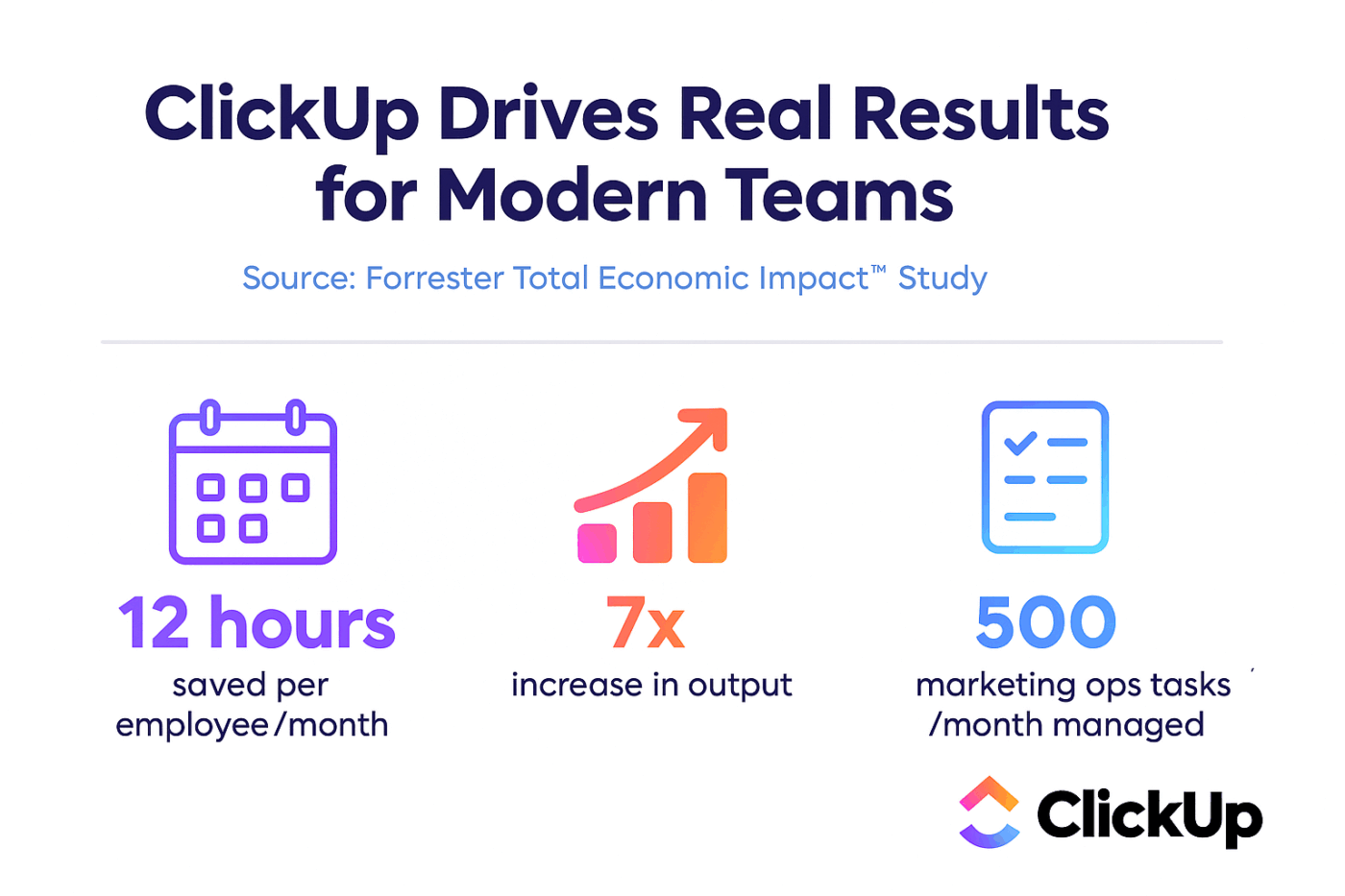

ClickUp + Bağlamsal Yapay Zeka = Ölçülebilir dönüşüm

Forrester Economic Impact™ araştırmasına göre, ClickUp kullanan takımlar %384 ROI elde etti ve 3. yılda 92.400 saat tasarruf sağladı.

Bağlam, ş Akışları ve zeka tek bir yerde bir araya geldiğinde, takımlar sadece çalışmakla kalmaz, aynı zamanda kazanır.

ClickUp ayrıca SOC 2 Tip II uyumluluğu, SSO entegrasyonu, SCIM provizyonu ve ayrıntılı izin kontrolleri ile kurumsal dağıtımların gerektirdiği güvenlik ve yönetim özelliklerini de sağlar.

ClickUp Brain MAX'ın çoklu LLM erişimi, arama arayüzünden doğrudan ChatGPT, Claude ve Gemini gibi premium modeller arasından seçim yapmanızı sağlar. Platform, sorgunuzu iş için en uygun modele otomatik olarak yönlendirir, böylece birden fazla aboneliği yönetmenize gerek kalmadan en iyi sonuçları elde edersiniz.

LLaMA ile AI katmanını sıfırdan oluşturmak yerine, ClickUp ile AI yetenekleri, proje yönetimi, dokümantasyon ve iletişim gibi tüm özellikleri tek bir yerde elde edin.

ClickUp ile Kurumsal Yapay Zeka ile İlerleyin

LLaMA, kurumsal takımlara kapalı AI API'lerine alternatif açık ağırlıklı bir seçenek sunarak önemli ölçüde kontrol, maliyet öngörülebilirliği ve özelleştirme imkanı sağlar. Ancak başarı sadece teknolojiye bağlı değildir. Doğru modeli doğru kullanım senaryosuyla eşleştirmek, yüksek kaliteli eğitim verilerine yatırım yapmak ve sağlam değerlendirme süreçleri oluşturmak gerekir.

"Oluşturmak mı, satın almak mı" kararı nihayetinde takımınızın teknik kapasitesine bağlıdır. Özel bir çözüm oluşturmak maksimum esneklik sağlarken, aynı zamanda önemli bir ek yük de getirir. Asıl zorluk sadece AI'ya erişmek değil, daha fazla AI yayılımı ve veri siloları oluşturmadan onu günlük ş akışlarınıza entegre etmektir.

ClickUp Brain ile LLM yeteneklerini doğrudan proje yönetiminize, belgelerinize ve takım iletişiminize taşıyın — altyapı kurma ve bakımının karmaşıklığı olmadan. ClickUp ile ücretsiz olarak başlayın ve AI yeteneklerini doğrudan mevcut ş akışlarına taşıyın. 🙌

Sık Sorulan Sorular (SSS)

Evet, Llama 3 Topluluk Lisansı çoğu kuruluş için ticari kullanıma izin verir. Yalnızca aylık 700 milyondan fazla aktif kullanıcısı olan şirketlerin Meta'dan ayrı bir lisans alması gerekir.

LLaMA, kendi kendine barındırma yoluyla daha fazla veri kontrolü ve öngörülebilir maliyetler sunarken, GPT-4 daha az kurulumla daha yüksek hazır performans sunar. Ancak verimlilik için, ClickUp Brain gibi entegre araçlar aracılığıyla temel modelleri yönetmeden yapay zeka yardımı alın.

LLaMA'yı kendi sunucunuzda barındırmak, verileri altyapınızda tutar, bu da veri yerleşimi açısından harikadır. Ancak, kendi erişim denetimlerinizi, denetim günlüklerinizi ve içerik filtrelerinizi uygulamaktan siz sorumlusunuz; bunlar genellikle yönetilen AI hizmetlerinde bulunan güvenlik özellikleridir.

LLaMA'yı doğrudan dağıtmak ve ince ayar yapmak için önemli ML mühendislik becerileri gerekir. Bu uzmanlığa sahip olmayan takımlar, model dağıtımı veya teknik yapılandırma gerektirmeden AI özellikleri sunan ClickUp Brain gibi yönetilen platformlar aracılığıyla LLaMA tabanlı özelliklere erişebilir.