De acordo com um estudo da Gallup, apenas 21% dos funcionários em todo o mundo se sentem engajados no trabalho, mas a maioria dos líderes só descobre problemas de moral quando as entrevistas de saída revelam padrões que eles não perceberam durante meses.

Este guia explica como o monitoramento da moral da equipe por IA usa processamento de linguagem natural e análise comportamental para detectar sinais precoces de desmotivação.

Você aprenderá as estruturas éticas necessárias para implementá-la sem prejudicar a confiança. E descobrirá como espaços de trabalho convergentes, como o ClickUp, fornecem o contexto unificado de que a IA precisa para oferecer insights precisos que ajudam você a apoiar sua equipe de forma proativa.

O que é o monitoramento da moral da equipe por IA?

Pesquisas anuais e reuniões individuais fornecem um panorama momentâneo, mas o moral da sua equipe muda diariamente, não trimestralmente. Isso significa que você está constantemente tentando recuperar o atraso, tentando resolver problemas que vêm se acumulando há meses. Quando um problema aparece em uma avaliação, seus melhores funcionários já podem estar pensando em sair.

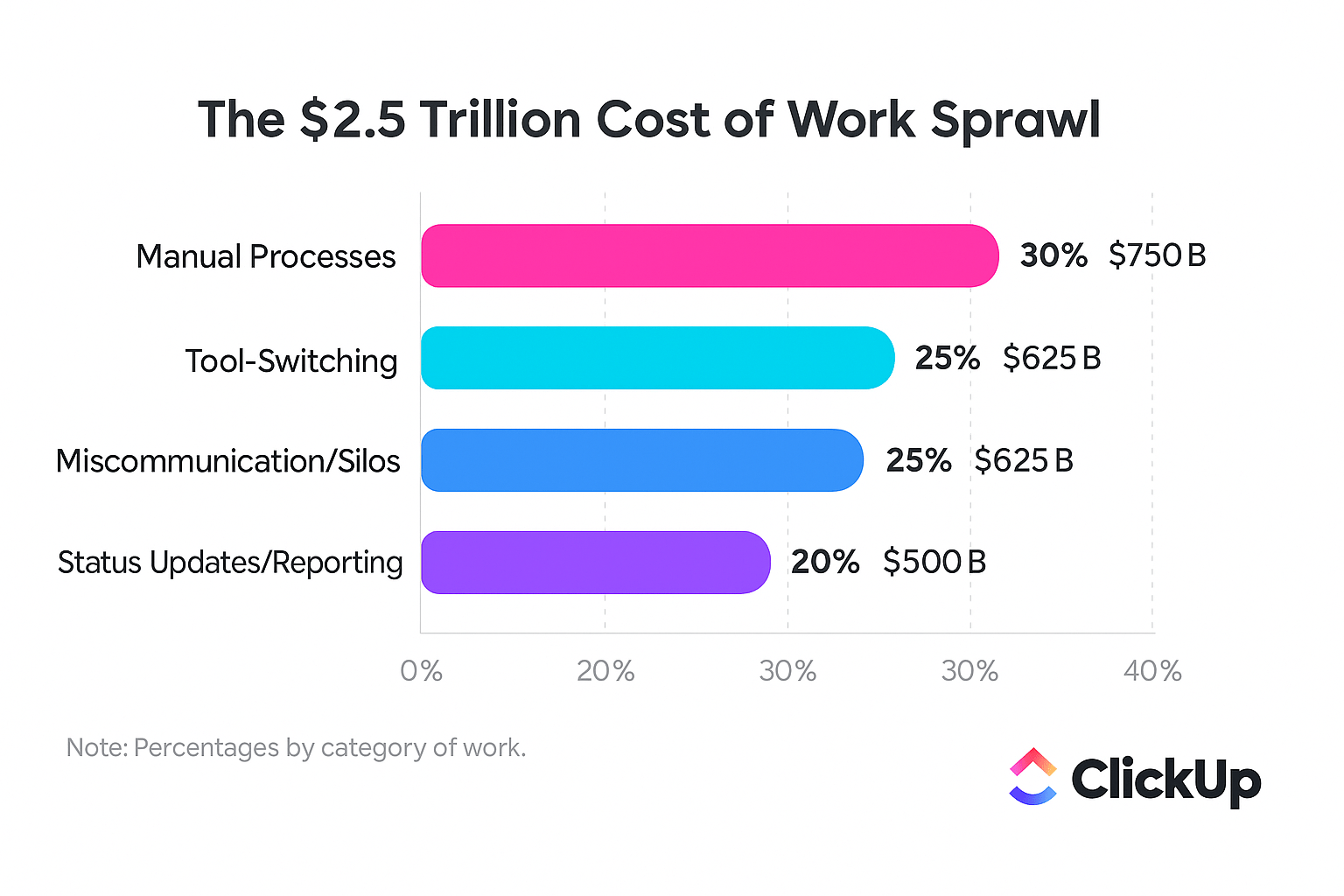

Você só fica sabendo da falta de engajamento quando alguém entrega sua carta de demissão e, nessa altura, já é tarde demais. Isso acontece devido à dispersão do contexto — o feedback da sua equipe, as atualizações do projeto e as conversas informais estão espalhados pelo Slack, e-mail e uma dúzia de outras ferramentas.

Atualmente, um trabalhador do conhecimento recebe, em média, 117 e-mails e 153 mensagens por dia. A dispersão de contexto ocorre quando as equipes perdem horas procurando informações em plataformas desconectadas que não se comunicam entre si. É impossível conectar os pontos e ter uma visão geral da saúde da sua equipe.

É aí que entra o monitoramento da moral da equipe por IA. Trata-se da prática de usar inteligência artificial para analisar continuamente os dados do local de trabalho — como mensagens, taxas de conclusão de tarefas e padrões de reuniões — para identificar mudanças no sentimento dos funcionários em tempo real. Não se trata de vigilância, mas de fornecer a você, como líder, o contexto acionável que, de outra forma, você perderia.

Em vez de ser pego de surpresa pela rotatividade, você recebe um aviso antecipado de que o engajamento de um membro da equipe está diminuindo. Isso lhe dá a chance de intervir e oferecer apoio antes que um pequeno problema se torne um grande problema.

Para fazer isso de forma eficaz, a IA precisa de uma visão completa, o que só é possível em um espaço de trabalho convergente que centraliza a comunicação, as tarefas e a documentação.

📮ClickUp Insight: 83% dos profissionais do conhecimento dependem principalmente de e-mail e chat para a comunicação da equipe. No entanto, quase 60% do seu dia de trabalho é perdido alternando entre essas ferramentas e procurando informações. Com um aplicativo completo para o trabalho como o ClickUp, seu gerenciamento de projetos, mensagens, e-mails e chats convergem em um só lugar! É hora de centralizar e energizar!

📮ClickUp Insight: 83% dos profissionais do conhecimento dependem principalmente de e-mail e chat para a comunicação da equipe. No entanto, quase 60% do seu dia de trabalho é perdido alternando entre essas ferramentas e procurando informações. Com um aplicativo completo para o trabalho como o ClickUp, seu gerenciamento de projetos, mensagens, e-mails e chats convergem em um só lugar! É hora de centralizar e energizar!

Para entender melhor o panorama geral das aplicações de IA em RH e como essas ferramentas estão transformando a gestão da força de trabalho, assista a esta visão geral das ferramentas de IA projetadas especificamente para profissionais de recursos humanos.

Como a IA detecta sinais precoces de declínio no moral da equipe

Sinais sutis, como uma energia diferente nas reuniões ou respostas mais curtas nas conversas, são difíceis de identificar. Você hesita em intervir porque não quer reagir exageradamente a um dia ruim, mas também não quer ignorar um problema real.

Esse atraso permite que pequenos problemas se agravem e se transformem em um desengajamento significativo — pesquisas mostram que mudanças na comunicação aparecem cinco meses antes que os gerentes realmente se demitam.

A questão central é que todos esses sinais sutis estão espalhados por muitos lugares — um comentário negativo aqui, um prazo perdido ali — e você não consegue conectar os pontos manualmente. O monitoramento do moral por IA atua como um mecanismo de detecção de padrões, analisando vários fluxos de dados ao mesmo tempo para fornecer um sinal mais claro. ✨

Esse processo faz com que você deixe de confiar na intuição e passe a ter hipóteses baseadas em dados. A IA não dá um veredicto, mas oferece um ponto de partida para uma conversa curiosa e encorajadora.

Análise de sentimentos em ferramentas de comunicação

Uma das principais maneiras pelas quais a IA detecta mudanças no moral é por meio da análise de sentimentos. Isso usa uma tecnologia chamada processamento de linguagem natural (NLP), que é essencialmente uma IA capaz de ler e compreender o tom emocional de um texto escrito. Ela analisa as mensagens nas plataformas de chat, e-mails e comentários de tarefas da sua equipe para identificar mudanças nos padrões de comunicação.

A IA procura por marcadores linguísticos que possam indicar um problema, tais como:

- Um aumento na linguagem negativa ou passiva

- Uma diminuição nas palavras entusiásticas ou positivas

- Respostas consistentemente mais curtas do que o normal

Um modelo sofisticado pode distinguir entre alguém que está apenas tendo um dia ruim e um padrão sustentado que aponta para um problema mais profundo.

No entanto, para que isso funcione, a IA precisa de precisão total no contexto organizacional. Sem saber o prazo do projeto ou a dificuldade da tarefa em discussão, a IA pode interpretar erroneamente o estresse normal do projeto como um problema de moral ou, pior ainda, deixar passar sinais de alerta genuínos ocultos em conversas casuais.

Padrões de engajamento e sinais de produtividade

Além do que os membros da sua equipe escrevem, a IA também rastreia como eles trabalham, analisando sua linguagem corporal digital, uma parte fundamental da análise comportamental. Não se trata de medir a produção para avaliações de desempenho, mas de detectar desvios em relação à linha de base pessoal de atividade de um indivíduo. Uma mudança repentina no comportamento costuma ser um indicador mais confiável de um problema do que um único comentário negativo.

As principais análises comportamentais incluem:

- Frequência de login: eles estão fazendo login mais tarde ou com menos frequência do que o normal?

- Velocidade de conclusão de tarefas: as tarefas estão demorando significativamente mais tempo para serem concluídas em comparação com a média?

- Frequência de colaboração: eles pararam de comentar, compartilhar arquivos ou trabalhar em conjunto com os colegas de equipe como costumavam fazer?

- Tempos de resposta: eles estão demorando muito mais para responder a mensagens e menções?

Um engenheiro de alto desempenho que de repente começa a perder prazos ou um designer normalmente ativo que fica quieto nos canais da equipe são sinais que valem a pena investigar. Esses padrões só se tornam significativos quando a IA pode ver todo o fluxo de trabalho, não apenas fragmentos isolados espalhados por aplicativos desconectados.

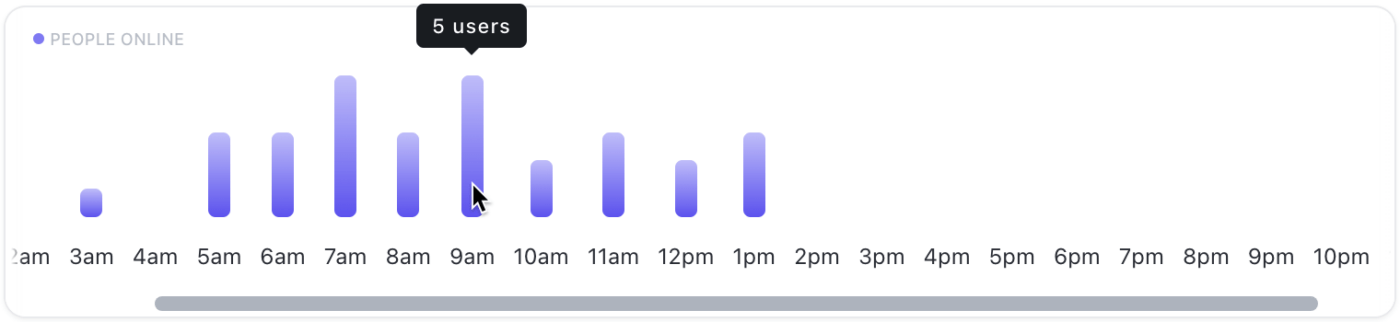

💡 Dica profissional: visualize o status online e a atividade de toda a equipe com o ClickUp Analytics.

Análise preditiva para risco de retenção

A análise preditiva leva o monitoramento do moral um passo adiante, combinando dados de sentimento e engajamento para prever a rotatividade potencial. O modelo de IA aprende com os padrões históricos da sua organização, analisando os sinais que precederam as saídas anteriores de funcionários. Em seguida, ele aplica esses aprendizados aos dados da sua equipe atual para identificar quem pode estar em risco elevado de desengajamento.

É importante lembrar que essas previsões não são certezas; elas são sugestões para que os gerentes tenham conversas proativas.

Esse processo gera uma pontuação de risco de retenção, que é um indicador importante de possível desgaste — os modelos modernos de IA podem atingir 92% de precisão nas previsões.

A precisão dessas previsões melhora drasticamente quando a IA tem acesso ao contexto completo. Isso inclui não apenas dados de comunicação e tarefas, mas também histórico do projeto, distribuição da carga de trabalho, interações entre colegas e até mesmo informações sobre progressão na carreira, tudo em um só lugar.

📚 Leia também: Principais ferramentas de software para gestão de pessoas

Benefícios e riscos do monitoramento do moral por IA

O monitoramento por IA levanta preocupações válidas sobre a vigilância dos funcionários ou a ação com base em informações incorretas. Esse receio pode levar à paralisia da análise, fazendo com que você continue usando métodos antigos e ineficazes, enquanto sua equipe permanece vulnerável ao esgotamento que você está tentando evitar.

Aborde a questão com uma perspectiva equilibrada. Compreender tanto as vantagens potenciais quanto as armadilhas permite que você crie uma estratégia que maximize os benefícios e, ao mesmo tempo, mitigue os riscos.

| Benefício | Risco |

|---|---|

| Intervenção proativa. Você pode identificar e resolver problemas antes que eles se transformem em rotatividade, economizando custos e evitando a interrupção causada pela perda de um membro valioso da equipe. | Interpretação errônea sem contexto. Se a IA não tiver uma visão completa do trabalho, ela pode sinalizar o estresse normal como uma crise, levando a intervenções desnecessárias. |

| Insights baseados em dados. A IA fornece dados objetivos para complementar a intuição do gerente, ajudando-o a tomar decisões mais confiantes e informadas. | Desconforto dos funcionários. Se o monitoramento parecer invasivo ou seu objetivo não for comunicado claramente, ele pode minar a confiança que você está tentando construir. |

| Identificação de tendências em toda a equipe. A IA pode identificar problemas sistêmicos, como o risco de esgotamento em todo o departamento, que podem passar despercebidos em reuniões individuais. | Confiança excessiva na automação. Confiar exclusivamente na IA, sem o julgamento humano, pode levar a uma cultura estéril e impessoal, na qual os gerentes deixam de ter conversas reais. |

Em última análise, os benefícios só se materializam quando a IA tem contexto suficiente e quando a sua organização combina suas percepções com um acompanhamento humano cuidadoso.

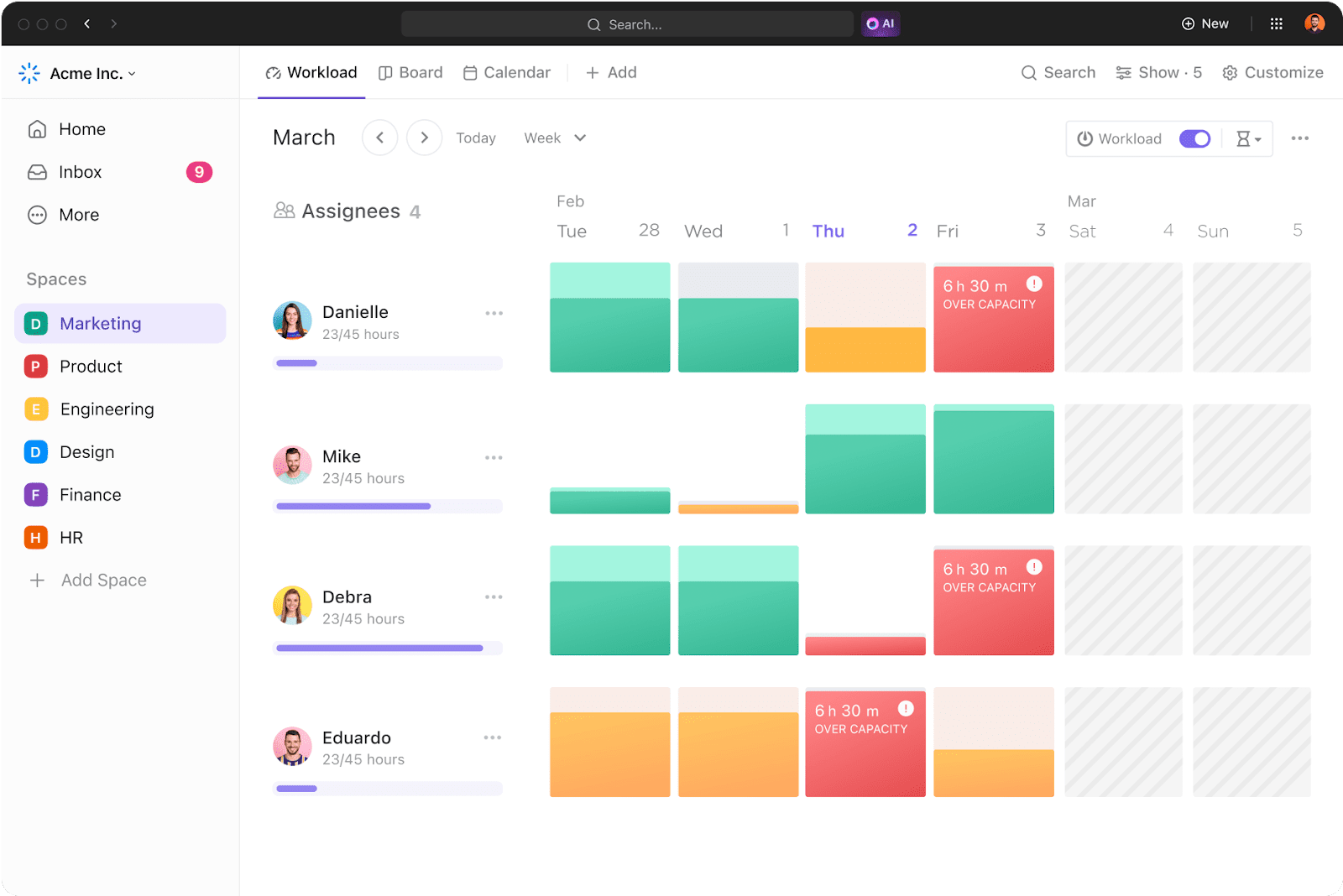

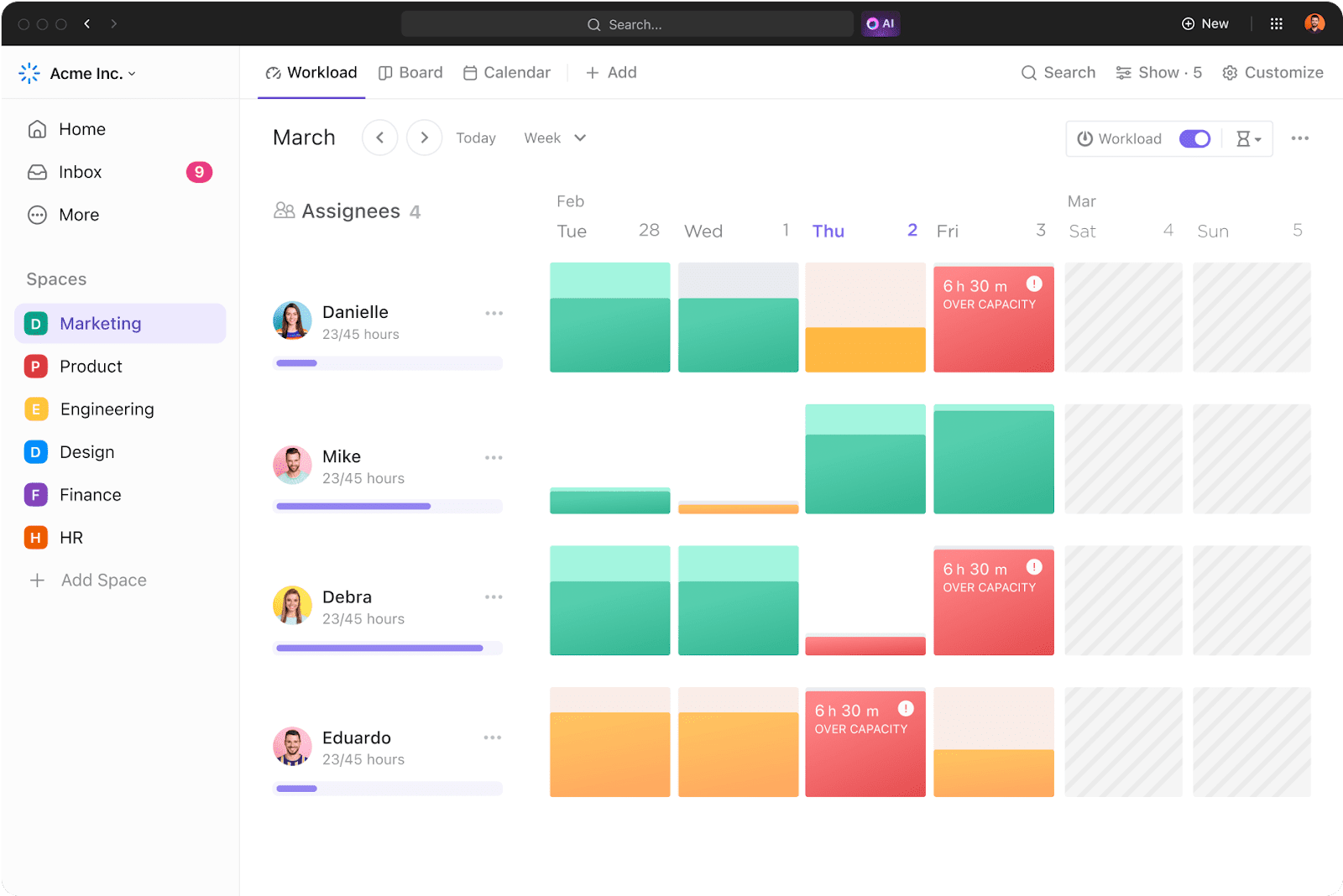

📮ClickUp Insight: Nossa pesquisa sobre equilíbrio entre vida profissional e pessoal descobriu que 46% dos trabalhadores dedicam de 40 a 60 horas por semana ao trabalho, enquanto impressionantes 17% excedem 80 horas! No entanto, a rotina não para por aí — 31% lutam para reservar tempo pessoal de forma consistente. É a receita perfeita para o esgotamento. 😰Mas sabe de uma coisa? O equilíbrio no trabalho começa com visibilidade! Os recursos integrados do ClickUp, como a Visualização da carga de trabalho e o Controle de tempo, facilitam a visualização da carga de trabalho, a distribuição justa das tarefas e o controle das horas reais trabalhadas — para que você sempre saiba como otimizar o trabalho e quando. 💫 Resultados reais: a Lulu Press economiza 1 hora por dia, por funcionário, usando as automações do ClickUp — o que leva a um aumento de 12% na eficiência do trabalho.

Considerações éticas para o monitoramento de equipes com tecnologia de IA

Implementar o monitoramento por IA de forma ética requer navegar por um cenário moral e jurídico complexo. Um passo em falso pode prejudicar a reputação da sua empresa e a segurança psicológica da sua equipe.

A ética não é uma barreira para o monitoramento da IA; ela é o plano para fazê-lo com sucesso. Uma estrutura ética baseada na transparência e em um compromisso genuíno com o benefício dos funcionários é inegociável. Quando você acerta, você cria um programa que os funcionários veem como um apoio, não como algo invasivo, o que fortalece a confiança em vez de enfraquecê-la.

Requisitos de privacidade e transparência

Seus funcionários devem saber quais dados estão sendo coletados, como estão sendo analisados e quais ações podem resultar dessas informações. Isso significa criar uma documentação clara e acessível sobre suas políticas de monitoramento e comunicá-las abertamente. Embora regulamentos de privacidade como o GDPR possam impor requisitos legais específicos, a transparência deve ir além da mera conformidade — ela é a base da confiança.

Se sua equipe sentir que está sendo vigiada em vez de apoiada, ela se desmotivará ainda mais, frustrando todo o objetivo da iniciativa. Sempre que possível, envolva os funcionários no desenvolvimento dessas políticas para obter adesão e sinalizar que você respeita a autonomia deles.

Evitar preconceitos na interpretação da IA

Os modelos de IA não são inerentemente objetivos; eles podem herdar e até mesmo amplificar preconceitos humanos se forem treinados com dados distorcidos ou sem contexto suficiente. Por exemplo, um modelo de IA pode erroneamente sinalizar um estilo de comunicação introvertido como um sinal de desengajamento ou interpretar erroneamente diferenças culturais na expressão como negatividade. Isso pode levar a julgamentos injustos e minar a credibilidade de todo o sistema.

Para evitar isso, você deve auditar regularmente os resultados da IA para verificar se há algum impacto desigual entre diferentes grupos demográficos. Mais importante ainda, uma filosofia de liderança forte, centrada na supervisão humana, deve permanecer no centro do processo. O papel da IA é revelar sinais potenciais, mas é tarefa do ser humano interpretá-los, investigar mais a fundo e tomar a decisão final.

📚 Leia também: Como melhorar a experiência das pessoas para aprimorar a cultura no local de trabalho

Melhores práticas para monitoramento do moral da equipe de IA

Sem uma estratégia de implementação clara, mesmo a melhor ferramenta pode se tornar obsoleta ou destruir o moral. A tecnologia é apenas uma peça do quebra-cabeça. Os processos e o treinamento que você cria em torno dela são o que realmente determinam o sucesso. As melhores implementações tratam a IA como um ponto de partida para conversas, não como um veredicto, transformando seus gerentes em melhores orientadores e fazendo com que sua equipe se sinta mais apoiada.

Comunique as políticas de monitoramento de forma transparente

Antes de implementar qualquer monitoramento de IA, você deve comunicar claramente o que está sendo rastreado, por que está rastreando e como as informações serão utilizadas. A maneira como você conduz essa conversa é extremamente importante.

- Boa formulação: “Estamos usando IA para ajudar nossos gerentes a oferecer um melhor suporte a você, identificando precocemente um possível esgotamento.”

- Má formulação: “Estamos implementando um novo sistema para monitorar suas mensagens com o objetivo de aumentar a produtividade.”

A primeira abordagem incentiva a colaboração e gera confiança, enquanto a segunda provoca defensividade e medo. Documente suas políticas em um local de fácil acesso, como um wiki para toda a empresa, e planeje revisá-las regularmente à medida que suas ferramentas e processos evoluem.

Use a IA para orientar em vez de controlar

Essa é a prática recomendada mais importante. As informações sobre o moral geradas pela IA devem sempre desencadear conversas de apoio, e não ações disciplinares. Há uma enorme diferença entre usar um sinalizador de risco de retenção para agendar uma conversa genuína e usá-lo para pressionar alguém sobre seu comprometimento.

Sua equipe aprenderá rapidamente se a IA está sendo usada para ajudá-la ou para vigiá-la, e reagirá de acordo. Invista no treinamento de seus gerentes sobre como agir com base nas informações da IA com empatia e curiosidade, em vez de suspeita. O objetivo é abrir um diálogo, não iniciar um interrogatório.

Equilibre a automação com o julgamento humano

A IA é excelente em detectar padrões em grandes quantidades de dados, mas carece da compreensão sutil que os seres humanos captam intuitivamente. O desengajamento repentino de um membro da equipe pode ser devido a uma crise pessoal, um conflito com um colega ou uma simples incompatibilidade em um projeto — a IA não consegue distinguir entre esses cenários sem uma investigação humana.

Você deve sempre tratar os resultados da IA como hipóteses a serem exploradas, não como conclusões a serem colocadas em prática. As implementações mais eficazes usam um modelo humano no ciclo, em que a IA garante que nada seja esquecido, mas o julgamento humano é preservado para todas as intervenções reais.

Como o ClickUp Brain apoia o monitoramento do moral da equipe

A maioria das ferramentas de monitoramento de IA são softwares de vigilância invasivos ou analisam apenas uma única fonte de dados, como mensagens de chat. Isso obriga você a reunir insights de vários painéis, criando mais trabalho e perpetuando a dispersão de contexto que você está tentando resolver. Essa fragmentação significa que os insights da sua IA são incompletos e, muitas vezes, imprecisos.

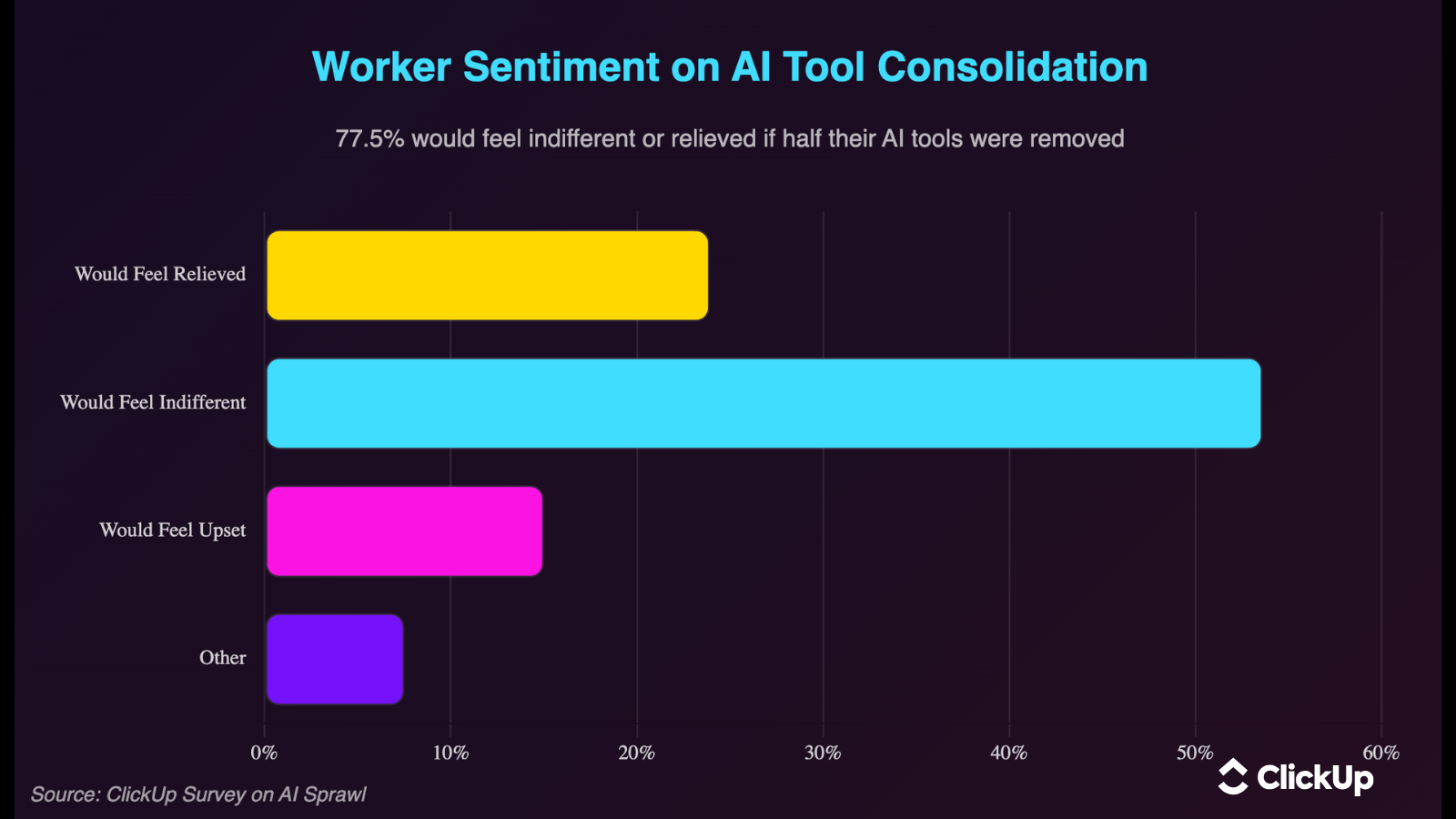

Elimine essa proliferação descontrolada de IA — a disseminação não planejada de ferramentas e plataformas de IA desconectadas, sem supervisão ou estratégia — com o ClickUp Brain, o recurso de IA integrado diretamente ao espaço de trabalho convergente do ClickUp.

Como suas tarefas, documentos e comunicação da equipe já estão reunidos em um só lugar, o ClickUp Brain tem o contexto nativo e unificado que outras ferramentas de IA não têm. Ele analisa o quadro completo de como sua equipe trabalha, não apenas fragmentos isolados. Isso lhe dá insights mais precisos e contextualizados, sem adicionar novas camadas invasivas de monitoramento. 🛠️

Veja como os recursos do ClickUp ajudam a monitorar o moral:

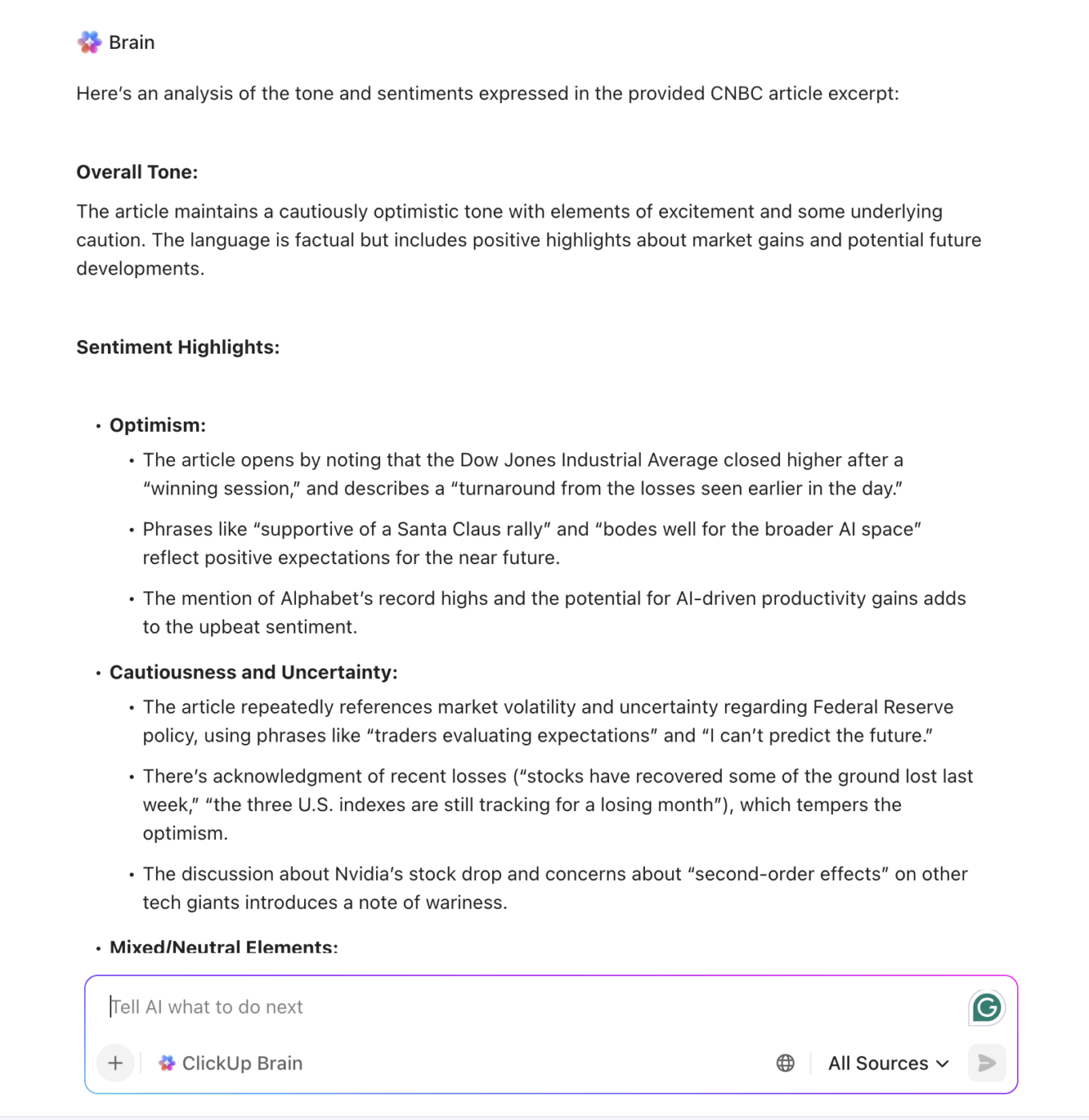

- Revele insights: revele possíveis mudanças de sentimento sem precisar passar horas vasculhando tópicos. Basta @mencionar o ClickUp Brain em uma tarefa ou chat e pedir para ele resumir as atividades recentes ou identificar temas recorrentes em comentários, atualizações e documentos que possam indicar mudanças no sentimento da equipe.

- Mantenha o trabalho distribuído: identifique distribuições desiguais ou sobrecargas de carga de trabalho antes que se tornem uma crise com a Visualização da Carga de Trabalho.

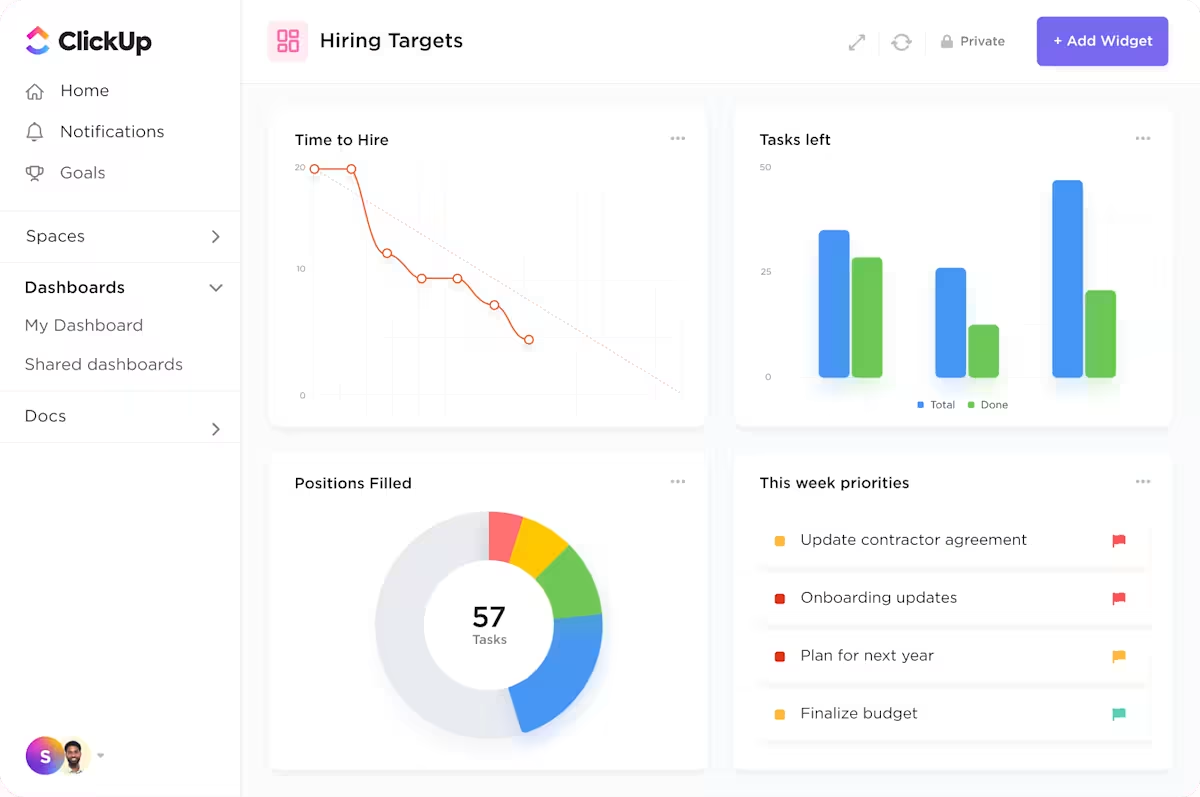

- Acompanhe a atividade da equipe: obtenha uma visão geral da produtividade da equipe sem precisar de atualizações regulares com os painéis do ClickUp. Crie cartões para acompanhar as tarefas por pessoa, estimativas de tempo e taxas de conclusão para obter uma visão geral e visual do trabalho da sua equipe.

- Automatize check-ins: garanta que conversas de apoio ocorram de forma consistente sem rastreamento manual, criando fluxos de trabalho com o ClickUp Automations. Por exemplo, acione perguntas ou lembretes regulares para que os gerentes se conectem com os membros da equipe que apresentam padrões alterados.

Com o ClickUp, você obtém as informações necessárias para ser um líder proativo, tudo na mesma plataforma em que sua equipe já realiza seu trabalho.

Passe de uma liderança reativa para uma proativa

Reagir à rotatividade é caro, perturbador e desmoralizante para todos os que ficam para trás. Manter métodos desatualizados, como pesquisas anuais, significa que você continuará perdendo bons profissionais por problemas que poderiam ser evitados.

A mudança para uma liderança proativa requer ter as informações certas no momento certo. O monitoramento do moral da equipe por IA, quando feito de forma ética e com todo o contexto de um espaço de trabalho convergente, fornece essa visibilidade. Ele permite que você pare de adivinhar como sua equipe se sente e oferece o contexto necessário para ser o líder que eles merecem.

Reúna o trabalho da sua equipe em um único lugar, onde a IA pode realmente ajudar você a se manter conectado ao desempenho deles. Comece a usar o ClickUp gratuitamente hoje mesmo.

Perguntas frequentes

O monitoramento do moral por IA analisa padrões agregados com o objetivo de ajudar os gerentes a apoiar suas equipes, enquanto a vigilância se concentra no rastreamento do comportamento individual para fins de conformidade. A principal diferença é o objetivo: um é para orientação e apoio, o outro é para controle.

A IA pode identificar padrões que se correlacionam com o esgotamento, como excesso de trabalho prolongado ou declínio no engajamento — o que é significativo, considerando que 77% já passaram por esgotamento em seu emprego atual —, mas essas são probabilidades, não certezas. Ela funciona melhor como um sistema de alerta precoce que estimula uma conversa humana.

Trate o sinalizador como um incentivo para uma conversa genuína, não como um veredicto. Faça perguntas abertas, ouça sem fazer suposições e concentre-se em compreender a perspectiva do membro da equipe para colaborar na busca de uma solução.