A Hugging Face construiu um ecossistema impressionante para desenvolvedores de ML, desde seu enorme hub de modelos até ferramentas de implantação integradas.

Mas, às vezes, seu projeto exige algo diferente. Talvez você precise de infraestrutura especializada, segurança de nível empresarial ou fluxos de trabalho personalizados que outras alternativas ao Hugging Face oferecem melhor.

Esteja você criando chatbots, ajustando LLMs ou executando pipelines de NLP que fariam seu cientista de dados chorar de alegria, há várias plataformas disponíveis para atender às suas necessidades de IA.

Neste blog, reunimos as principais alternativas ao Hugging Face, desde APIs de nuvem poderosas até kits de ferramentas de código aberto e plataformas de fluxo de trabalho de IA completas.

As principais alternativas ao Hugging Face em resumo

Aqui estão as principais alternativas ao Hugging Face comparadas. 📄

| Ferramenta | Ideal para | Melhores recursos | Preços* |

| ClickUp | Traga a IA diretamente para o gerenciamento do seu trabalho diário — de tarefas a documentos e automação. Tamanho da equipe: Ideal para indivíduos, startups e empresas. | AI Notetaker, Autopilot Agents, Brain MAX, Enterprise AI Search, geração de imagens em quadros brancos, acesso ao Claude/ChatGPT/Gemini, automação por meio de linguagem natural. | Gratuito para sempre, com personalizações disponíveis para empresas. |

| OpenAI | Criação com modelos de linguagem avançados e APIs para texto, imagens e incorporações Tamanho da equipe: Ideal para desenvolvedores de IA e startups que criam com LLMs | Ajuste fino, processamento de PDF/imagens, análise semântica de arquivos, painéis de custos, avisos de temperatura/sistema | Baseado no uso |

| Anthropic Claude | Criando conversas ricas em contexto, mais seguras e respostas LLM ponderadas Tamanho da equipe: Ideal para equipes que precisam de segurança, contexto longo e raciocínio ético | Pesquisa na web em tempo real, geração de resultados estruturados (JSON/XML), memória de alto contexto, suporte a matemática/estatística | Baseado no uso |

| Cohere | Projetando soluções de NLP multilíngues e seguras em escala empresarial Tamanho da equipe: Ideal para equipes orientadas para a conformidade com necessidades de NLP multilíngues | Ajuste fino em dados privados, suporte a mais de 100 idiomas, painéis de análise, inferência escalável, integração SSO/SAML/RBAC. | A partir de US$ 0,0375/1 milhão de tokens (Command R7B); preços personalizados |

| Replicar | Explore e execute modelos de código aberto sem se preocupar com configuração ou servidores. Tamanho da equipe: Ideal para desenvolvedores que testam modelos de IA ou criam MVPs. | Modelos bifurcáveis, controle de versão com testes A/B, previsão em lote e suporte a webhooks. | Pagamento por uso; os preços variam de acordo com o modelo |

| TensorFlow | Criação de sistemas de aprendizado de máquina totalmente personalizados com controle máximo Tamanho da equipe: Ideal para engenheiros de ML que precisam de controle total do modelo | Monitoramento TensorBoard, conversão ONNX/SavedModel, funções de perda personalizadas, treinamento de precisão mista | Gratuito (código aberto); uso de computação cobrado separadamente |

| Azure Machine Learning | Conectando modelos de ML ao ecossistema Microsoft com automação e escalabilidade Tamanho da equipe: Ideal para equipes empresariais no ecossistema Azure | AutoML, gatilhos de retreinamento, explicabilidade de modelos com SHAP/LIME, detecção de desvios, clusters de computação escaláveis | Preços personalizados |

| Google Gemini | Interaja com vários tipos de dados — texto, código, imagens e vídeo — por meio de um único modelo de IA. Tamanho da equipe: ideal para equipes de pesquisa e análise multimodal. | Compreensão de imagens/gráficos, execução Python em tempo real, resumo de vídeos, raciocínio entre entradas mistas | Gratuito; planos pagos disponíveis dependendo do acesso ao modelo |

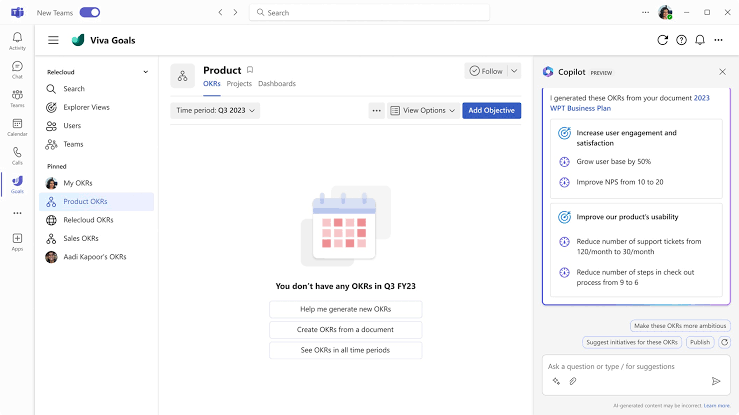

| Microsoft Copilot | Aumente a produtividade em aplicativos do Microsoft 365, como Word, Excel e Outlook. Tamanho da equipe: ideal para usuários empresariais no ecossistema do Microsoft 365. | Automação de funções do Excel, geração de slides PPT, elaboração de agendas/e-mails, vinculação de tarefas do Outlook | Gratuito; planos pagos a partir de US$ 20/mês |

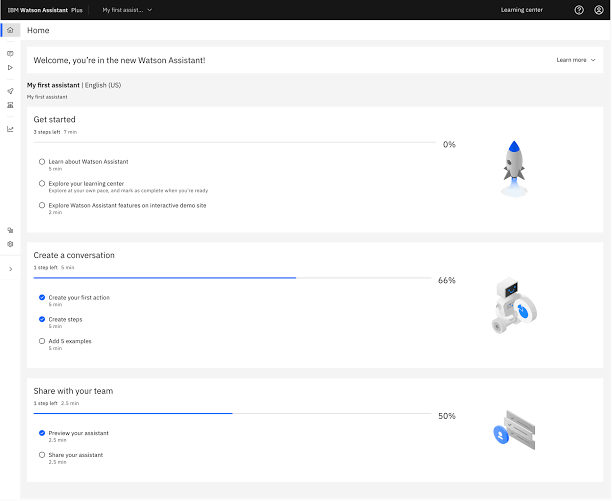

| IBM WatsonX | Operação de IA em setores altamente regulamentados com total auditabilidade e controle Tamanho da equipe: Ideal para bancos, organizações de saúde e do setor público | Detecção de viés, modelos de segurança imediata, testes de robustez adversária, fluxos de trabalho com intervenção humana | Gratuito; planos pagos a partir de US$ 1.050/mês |

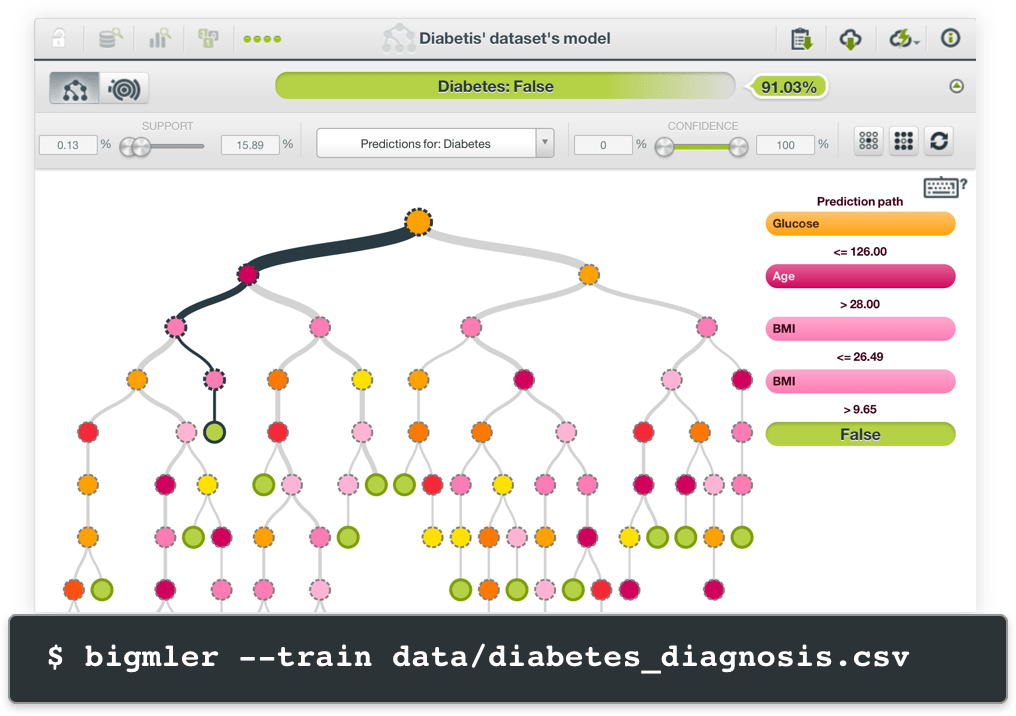

| BigML. com | Crie e explique modelos preditivos sem nenhum código ou conhecimento prévio em ML. Tamanho da equipe: Ideal para analistas e usuários sem conhecimento em programação. | Modelagem visual de arrastar e soltar, aprendizado conjunto, agrupamento, previsão de séries temporais | Avaliação gratuita por 14 dias; planos pagos a partir de US$ 30/mês. |

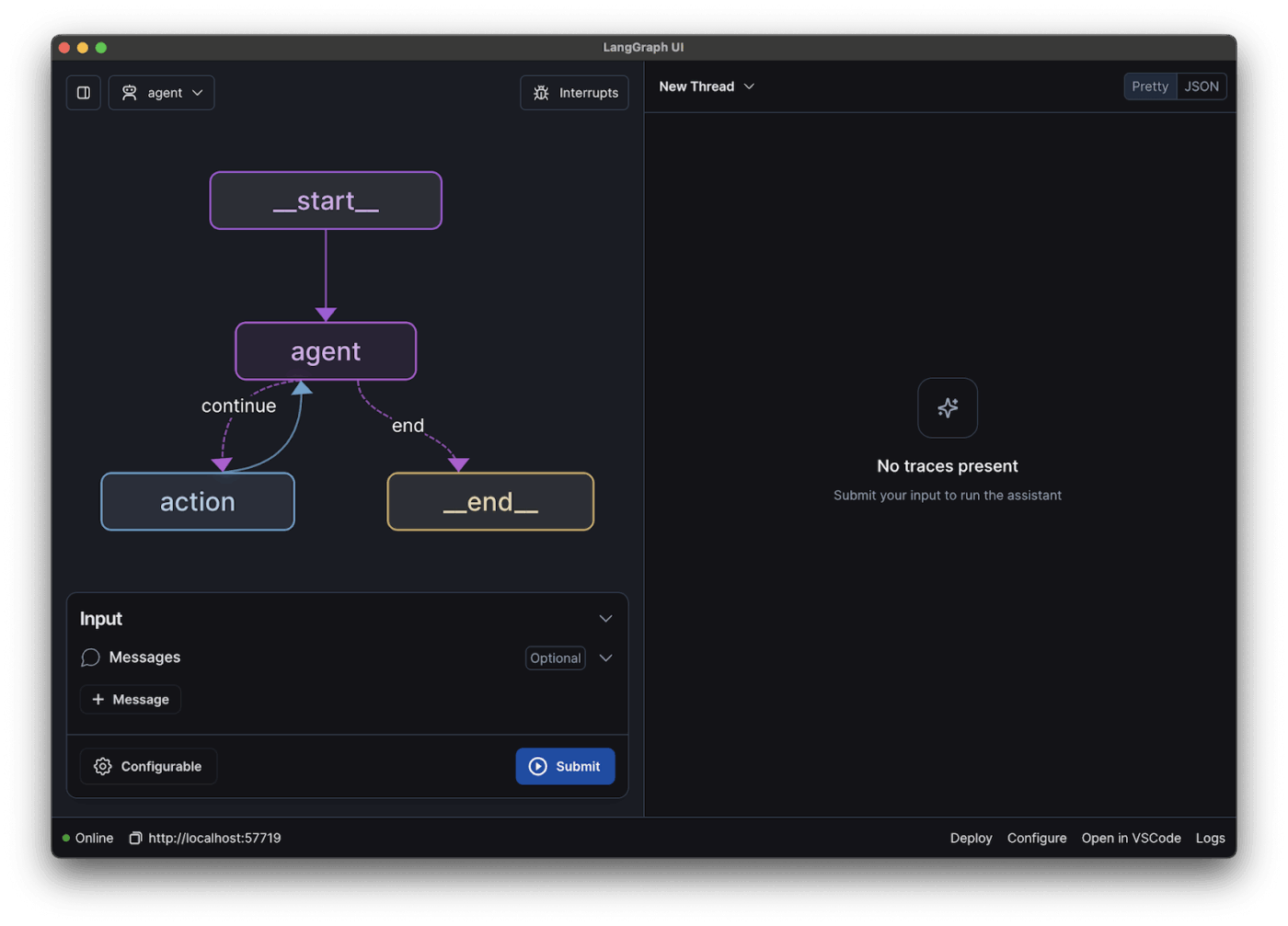

| LangChain | Criação de agentes de IA e fluxos de trabalho que combinam vários modelos, ferramentas e APIs Tamanho da equipe: Ideal para desenvolvedores de IA que criam ferramentas baseadas em agentes | Rastreamento e registro, cache de chamadas de API, lógica de fallback, respostas de streaming, estruturas de avaliação personalizadas | Gratuito; planos pagos a partir de US$ 39/mês |

| Weights & Biases | Mantenha as experiências de aprendizado de máquina organizadas, reproduzíveis e orientadas para o desempenho. Tamanho da equipe: ideal para equipes de pesquisa de ML e laboratórios de IA. | Varreduras de hiperparâmetros, painéis ao vivo, compartilhamento público de experimentos, perfilagem de GPU e controle de versão de experimentos. | Gratuito; planos pagos a partir de US$ 50/mês |

| ClearML | Gerenciamento de todo o ciclo de vida do MLOps, desde o rastreamento até a orquestração e implantação. Tamanho da equipe: ideal para equipes de ML com muitas operações e uso interno de infraestrutura. | Registro de auditoria, implantação azul-verde, integração CI/CD, programação fora do horário de pico, registro de modelos, ferramentas de reprodutibilidade | Gratuito; planos pagos a partir de US$ 15/mês por usuário |

| Amazon SageMaker | Executando, ajustando e dimensionando modelos de ML nativamente na infraestrutura da AWS Tamanho da equipe: Ideal para equipes baseadas na AWS que desenvolvem em escala | Rotulagem de dados Ground Truth, notebooks gerenciados, ajuste automático de hiperparâmetros, pontos de extremidade escaláveis, monitoramento CloudWatch. | Unified Studio: gratuito; outros preços dependem da computação e do uso |

Como avaliamos softwares na ClickUp

Nossa equipe editorial segue um processo transparente, baseado em pesquisas e neutro em relação aos fornecedores, para que você possa confiar que nossas recomendações são baseadas no valor real do produto.

Aqui está um resumo detalhado de como analisamos o software no ClickUp.

Por que escolher alternativas ao Hugging Face?

Veja por que vale a pena explorar alternativas ao Hugging Face:

- Recursos de IA personalizados: encontre plataformas com modelos de linguagem grandes especializados para tarefas específicas, como visão computacional ou NLP avançado.

- Fluxos de trabalho simplificados: escolha soluções com configuração mais fácil ou interfaces sem código para prototipagem mais rápida e maior eficiência operacional.

- Planos econômicos: descubra opções com níveis gratuitos ou preços mais baixos para gerenciamento de dados com orçamento limitado.

- Recursos de integração aprimorados: procure ferramentas que se sincronizem perfeitamente com sua pilha de tecnologia existente, como CRMs ou plataformas em nuvem.

- Desempenho escalável: opte por plataformas de IA que lidam com conjuntos de dados maiores ou oferecem processamento mais rápido para grandes projetos.

- Suporte empresarial mais forte: Selecione alternativas ao Hugging Face com suporte dedicado para equipes que precisam de soluções robustas e seguras.

- Treinamento de modelos personalizados: explore opções com ajustes avançados para modelos exclusivos e de alto desempenho.

- Opções de implantação inovadoras: escolha ferramentas com métodos exclusivos de hospedagem ou implantação para facilitar o dimensionamento.

🔍 Você sabia? Graças aos transformadores, ferramentas como GPT e BERT podem ler frases inteiras juntas. Elas captam o tom, a intenção e o contexto de uma forma que os modelos antigos nunca conseguiram. É por isso que a IA atual soa mais natural quando responde.

As melhores alternativas ao Hugging Face

Estas são as nossas escolhas para as melhores alternativas ao Hugging Face. 👇

1. ClickUp (ideal para integrar IA diretamente ao gerenciamento de projetos, documentos e fluxos de trabalho)

Todo mundo está usando IA, mas a maior parte dela fica isolada. Você tem uma ferramenta para escrever, outra para resumir e uma terceira para agendar, mas nenhuma delas se comunica com o seu trabalho. Isso cria mais dispersão de IA e caos desnecessário.

O ClickUp resolve isso incorporando IA onde ela ajuda: em suas tarefas, documentos e atualizações da equipe.

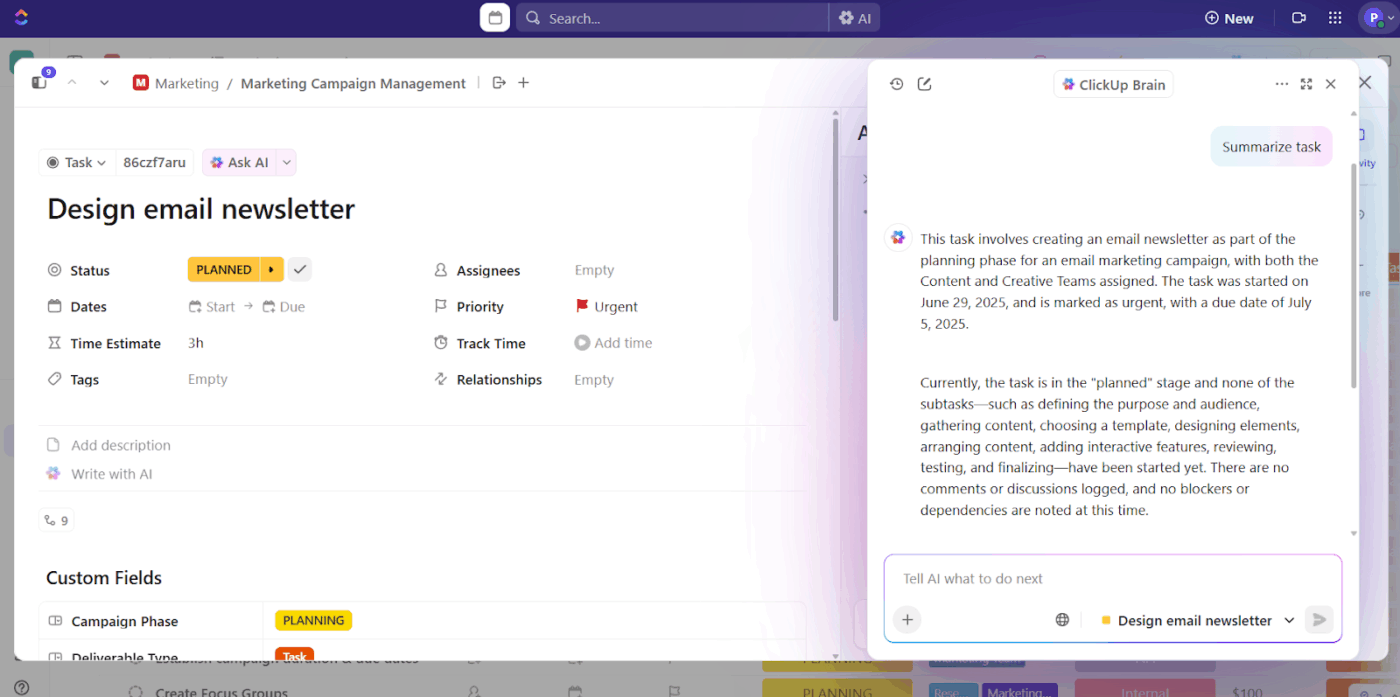

Escreva, resuma e automatize no contexto

O ClickUp Brain está integrado em todas as partes da plataforma. Ele escreve conteúdo, resume atualizações, gera relatórios e reescreve descrições de tarefas confusas — exatamente onde o trabalho é realizado.

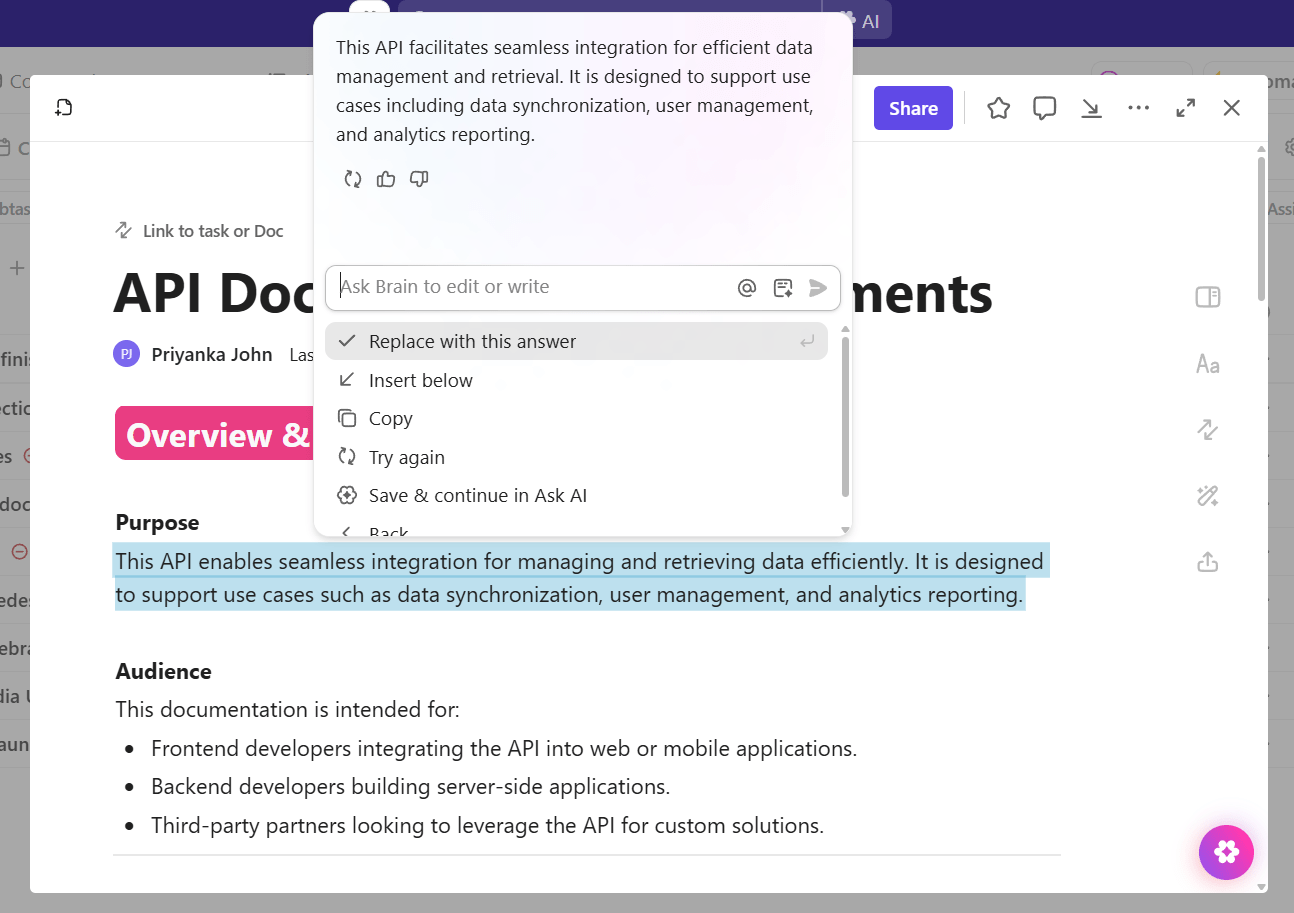

Digamos que você esteja documentando os requisitos de API para desenvolvedores.

Você cola as especificações técnicas em um documento do ClickUp, adiciona pontos importantes sobre autenticação e limites de taxa e, em seguida, solicita ao ClickUp Brain que crie uma documentação fácil de usar para desenvolvedores, com exemplos de código.

O assistente de IA conectado estrutura suas anotações preliminares em seções claras, mantendo-as no Doc, onde sua equipe poderá consultá-las.

Outros exemplos:

- Transforme um longo documento de reunião em um resumo do projeto para o líder da sua equipe.

- Reescreva descrições de tarefas vagas para tornar as próximas etapas mais claras.

- Elabore atualizações recorrentes para clientes usando as atividades da semana anterior.

- Resuma um tópico de planejamento e atribua acompanhamentos aos proprietários.

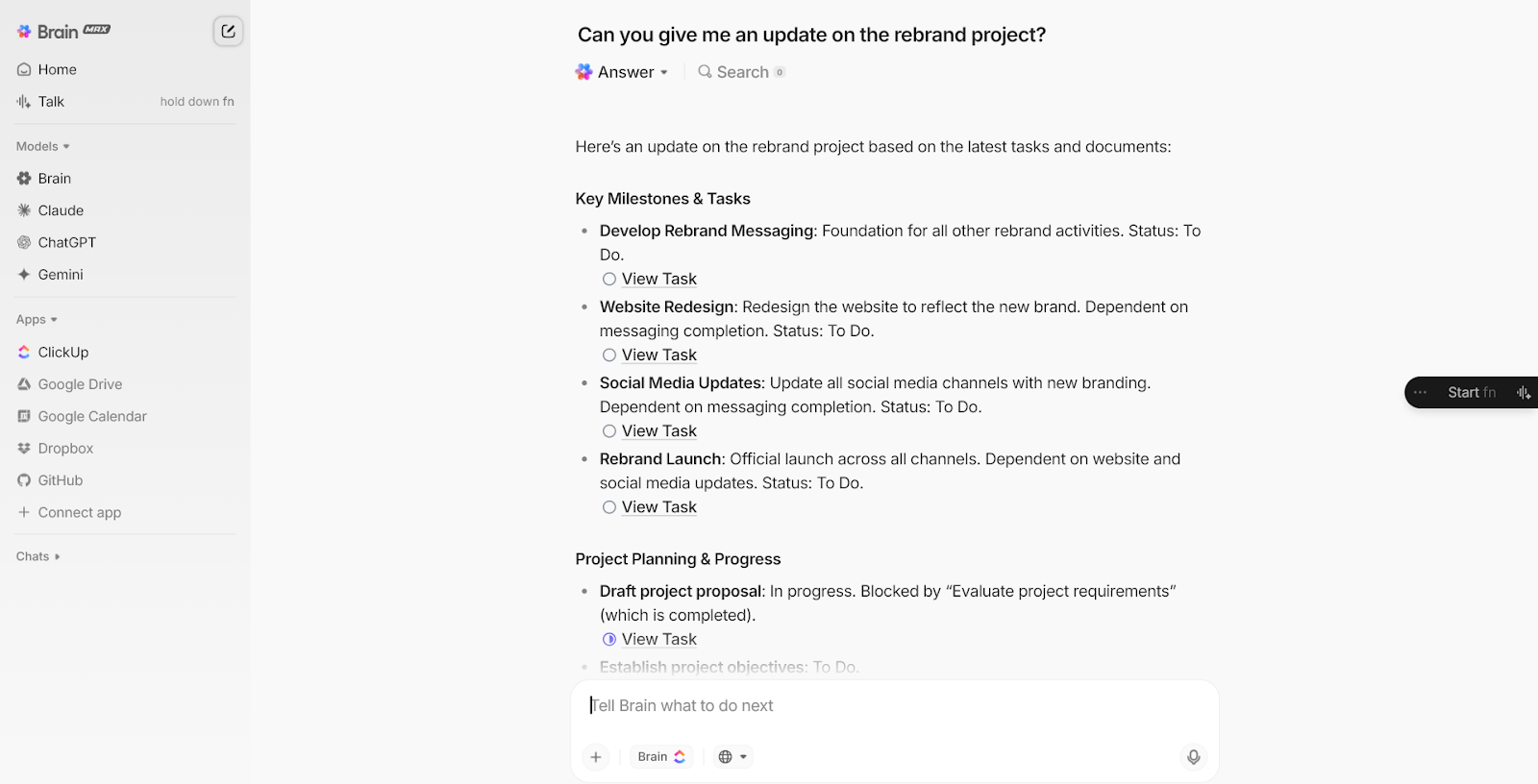

Encontre respostas, bloqueadores e relatórios em segundos

Sim, o ClickUp Brain ajuda você a trabalhar em tarefas e documentos. Mas, às vezes, você precisa dar um passo atrás: um espaço focado para fazer perguntas, obter clareza e agir rapidamente.

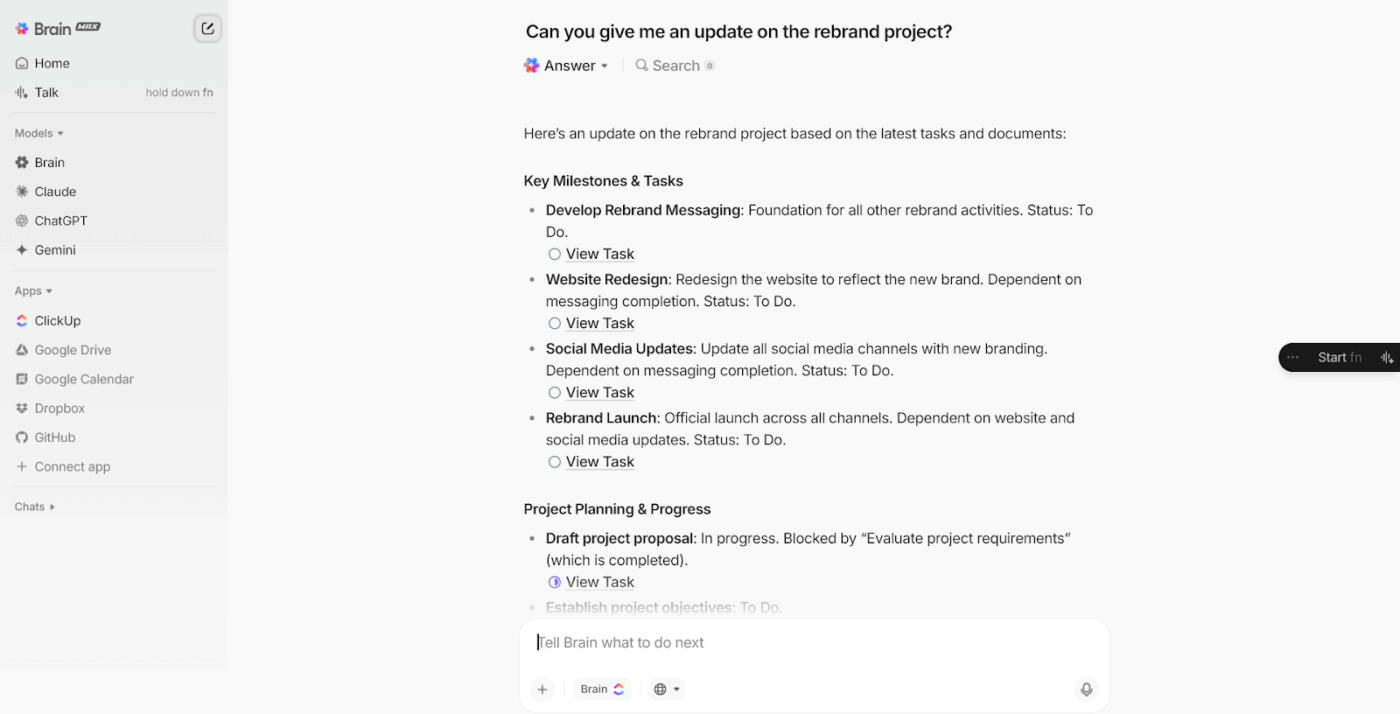

É exatamente para isso que o ClickUp Brain MAX foi criado.

Ele oferece um espaço dedicado para trabalhar com IA, separado de suas tarefas e documentos, mas totalmente conectado a eles. Como seu companheiro de IA no desktop, ele ajuda você a refletir sobre o trabalho, encontrar respostas e avançar mais rapidamente, sem precisar alternar entre ferramentas ou reexplicar o contexto.

Digite uma pergunta e ele extrai dados do espaço de trabalho em tempo real, não resultados isolados de IA. Ele entende o contexto do projeto, os níveis de prioridade e as atribuições dos proprietários. Você pode até mesmo falar sua pergunta em voz alta.

O ClickUp Brain MAX é voltado para a voz, está sempre ao seu alcance e foi criado para reduzir a carga mental do gerenciamento do trabalho.

Digamos que você esteja liderando um lançamento multifuncional. Você pergunta: “O que está bloqueando o lançamento da campanha?“ O Brain MAX mostra tarefas atrasadas, proprietários designados, documentos vinculados e comentários sinalizados prontos para ação.

Outros casos de uso reais:

- Solicite uma lista de tarefas vencidas agrupadas por responsável.

- Obtenha um resumo das metas concluídas neste trimestre.

- Obtenha uma visão em tempo real dos bloqueadores em todos os projetos ativos.

- Identifique os riscos antes que eles se agravem, com base na atividade das tarefas.

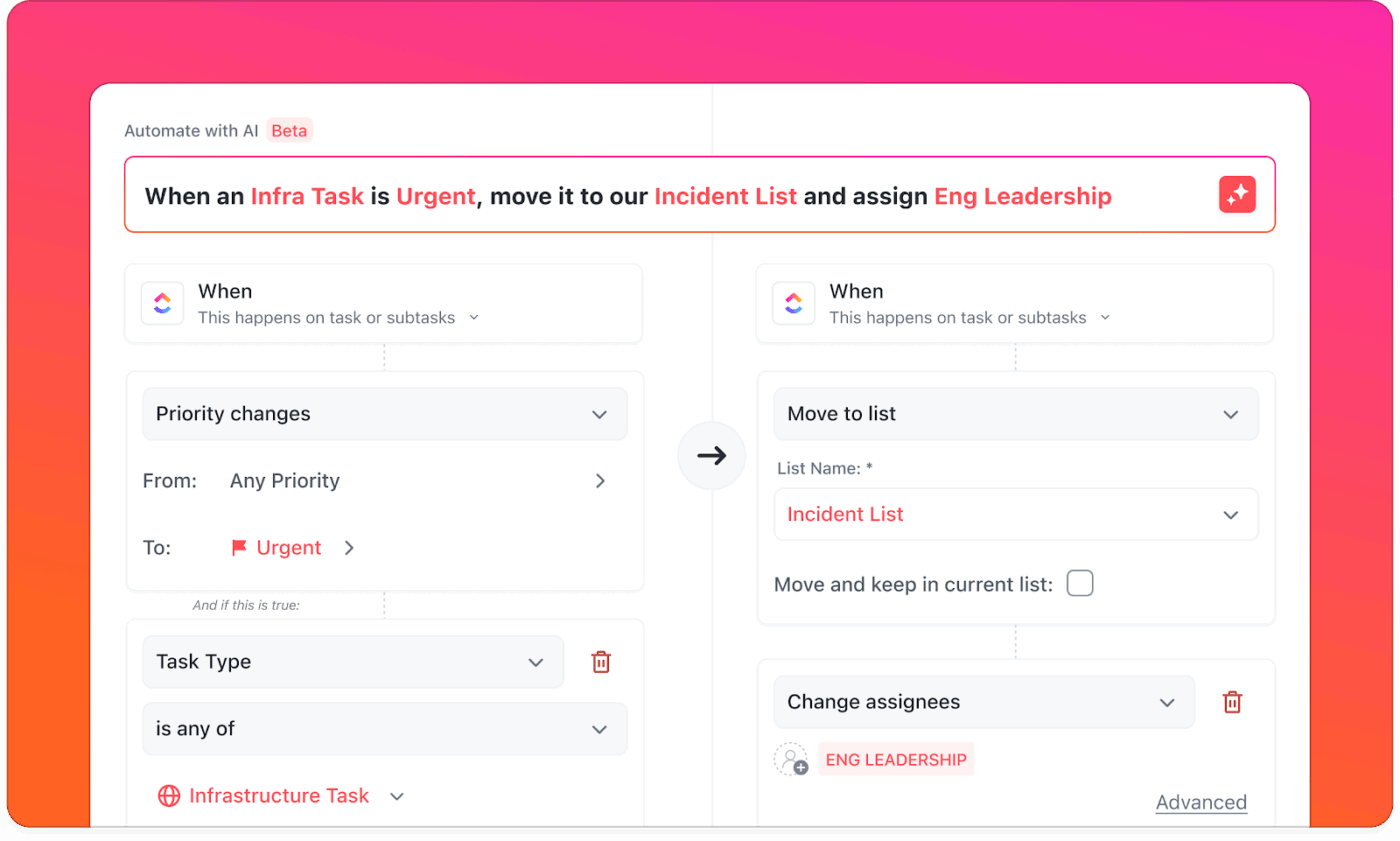

Automatize tarefas sem regras

Você não precisa mais se preocupar com gatilhos e ações. Basta descrever o que deseja em linguagem natural, e a IA criará a automação no ClickUp.

Por exemplo, sua equipe de sucesso do cliente lida com trabalhos repetitivos sempre que um cliente empresarial se inscreve. Você diz ao ClickUp Brain: Quando uma tarefa for marcada como “Integração empresarial”, crie subtarefas para a chamada inicial, o pacote de boas-vindas, a atribuição técnica e os lembretes de acompanhamento.

A IA cria essa automação de fluxo de trabalho em várias etapas e permite que você a teste antes de colocá-la em operação.

Melhores recursos do ClickUp

- Agentes de IA que funcionam: Implante agentes especializados do ClickUp AI Autopilot que lidam com tarefas recorrentes, como atualizações de projetos e relatórios de status, sem a necessidade de treinamento complexo de modelos.

- Evite a dependência de fornecedores: acesse Claude, GPT, Gemini e outros modelos de IA líderes por meio de uma interface intuitiva, sem precisar reconstruir fluxos de trabalho.

- Nunca perca o contexto: use o AI Notetaker do ClickUp para capturar e resumir automaticamente as reuniões com itens de ação que são sincronizados diretamente com suas tarefas.

- Encontre qualquer coisa: pesquise em todo o seu trabalho com a Pesquisa de IA Empresarial no ClickUp, que entende o contexto da sua equipe.

- Escala sem complexidade: obtenha recursos de IA de nível empresarial sem gerenciar infraestrutura ou chaves de API — tudo funciona imediatamente.

- Faça um brainstorming visual: gerencie imagens diretamente nos quadros brancos do ClickUp solicitando ao ClickUp Brain e, em seguida, transforme essas ideias em planos de projeto viáveis.

- Converse sem alternar: mantenha as conversas conectadas ao seu trabalho real usando o ClickUp Chat.

- Agende de forma mais inteligente: deixe o Calendário do ClickUp bloquear automaticamente o tempo de concentração e sugerir reuniões ideais com base nos prazos do projeto.

Limitações do ClickUp

- Você não pode modificar, bifurcar ou contribuir para a infraestrutura de IA subjacente como pode fazer com o Hugging Face.

Preços do ClickUp

Avaliações e comentários do ClickUp

- G2: 4,7/5 (mais de 10.385 avaliações)

- Capterra: 4,6/5 (mais de 4.000 avaliações)

O que os usuários reais estão dizendo sobre o ClickUp?

Esta avaliação do G2 diz tudo sobre esta plataforma de colaboração de IA:

O novo Brain MAX aumentou muito minha produtividade. A capacidade de usar vários modelos de IA, incluindo modelos de raciocínio avançado, por um preço acessível facilita a centralização de tudo em uma única plataforma. Recursos como conversão de voz em texto, automação de tarefas e integração com outros aplicativos tornam o fluxo de trabalho muito mais suave e inteligente.

O novo Brain MAX aumentou muito minha produtividade. A capacidade de usar vários modelos de IA, incluindo modelos de raciocínio avançado, por um preço acessível facilita a centralização de tudo em uma única plataforma. Recursos como conversão de voz em texto, automação de tarefas e integração com outros aplicativos tornam o fluxo de trabalho muito mais suave e inteligente.

📮 ClickUp Insight: 30% dos nossos entrevistados confiam em ferramentas de IA para pesquisa e coleta de informações. Mas existe uma IA que ajuda você a encontrar aquele arquivo perdido no trabalho ou aquela conversa importante no Slack que você esqueceu de salvar?

Sim! A Pesquisa Conectada com IA do ClickUp pode pesquisar instantaneamente todo o conteúdo do seu espaço de trabalho, incluindo aplicativos integrados de terceiros, obtendo insights, recursos e respostas. Economize até 5 horas por semana com a pesquisa avançada do ClickUp!

2. OpenAI (ideal para acessar modelos avançados de geração de linguagem e imagens)

via OpenAI

A OpenAI ganhou as manchetes quando o ChatGPT foi lançado e, de repente, todos voltaram a falar sobre IA. Seus modelos GPT lidam com tudo, desde escrever e-mails até depurar códigos, enquanto o DALL-E transforma suas sugestões de texto mais ousadas em imagens reais.

O que diferencia a OpenAI é a forma como eles organizaram a IA. Você tem acesso a modelos que antes estavam restritos aos laboratórios de pesquisa. É claro que você está pagando por essa conveniência, mas quando os prazos são apertados e os clientes estão pressionando, essa conveniência se torna inestimável.

Melhores recursos do OpenAI

- Ajuste os modelos em seus conjuntos de dados específicos para corresponder à voz da sua marca, estilo de redação ou experiência no domínio.

- Controle o comportamento do modelo usando prompts do sistema e configurações de temperatura para ajustar os níveis de criatividade e a formatação das respostas.

- Processe vários formatos de arquivo, incluindo PDFs, imagens e documentos, para uma análise e extração abrangente de conteúdo.

- Acompanhe os custos de uso e defina limites de gastos por meio de painéis de faturamento detalhados que dividem as despesas por modelo e projeto.

- Crie embeddings para aplicativos de pesquisa semântica que compreendem o significado, em vez de apenas corresponder palavras-chave.

Limitações da OpenAI

- Opções limitadas de personalização para arquitetura de modelos

- A dependência de chamadas de API externas afeta a funcionalidade offline.

- Os limites de taxa podem afetar aplicativos de alto volume em diversos setores.

- A OpenAI enfrentou vários processos judiciais e escrutínio sobre dados de treinamento coletados da web sem consentimento.

Preços da OpenAI

- GPT-4. 1 Entrada: US$ 2 por 1 milhão de tokens Entrada em cache: US$ 0,50 por 1 milhão de tokens Saída: US$ 8 por 1 milhão de tokens

- Entrada: US$ 2 por 1 milhão de tokens

- Entrada em cache: US$ 0,50 por 1 milhão de tokens

- Resultado: US$ 8 por 1 milhão de tokens

- GPT-4. 1 mini Entrada: $0,40 por 1 milhão de tokens Entrada em cache: $0,10 por 1 milhão de tokens Saída: $1,60 por 1 milhão de tokens

- Entrada: US$ 0,40 por 1 milhão de tokens

- Entrada em cache: US$ 0,10 por 1 milhão de tokens

- Resultado: $1,60 por 1 milhão de tokens

- GPT-4. 1 nano Entrada: $0,100 por 1 milhão de tokens Entrada em cache: $0,025 por 1 milhão de tokens Saída: $0,400 por 1 milhão de tokens

- Entrada: US$ 0,100 por 1 milhão de tokens

- Entrada em cache: US$ 0,025 por 1 milhão de tokens

- Resultado: US$ 0,400 por 1 milhão de tokens

- OpenAI o3 Entrada: US$ 2 por 1 milhão de tokens Entrada em cache: US$ 0,50 por 1 milhão de tokens Saída: US$ 8 por 1 milhão de tokens

- Entrada: US$ 2 por 1 milhão de tokens

- Entrada em cache: US$ 0,50 por 1 milhão de tokens

- Resultado: US$ 8 por 1 milhão de tokens

- OpenAI o4-mini Entrada: US$ 1,100 por 1 milhão de tokens Entrada em cache: US$ 0,275 por 1 milhão de tokens Saída: US$ 4,400 por 1 milhão de tokens

- Entrada: $1,100 por 1 milhão de tokens

- Entrada em cache: US$ 0,275 por 1 milhão de tokens

- Resultado: $4. 400 por 1 milhão de tokens

- Ajustes finos nos modelos GPT-4. 1 Entrada: US$ 3 por 1 milhão de tokens Entrada em cache: US$ 0,75 por 1 milhão de tokens Saída: US$ 12 por 1 milhão de tokens Treinamento: US$ 25 por 1 milhão de tokens GPT-4. 1 mini Entrada: $0,80 por 1 milhão de tokens Entrada em cache: $0,20 por 1 milhão de tokens Saída: $3,20 por 1 milhão de tokens Treinamento: $5 por 1 milhão de tokens GPT-4. 1 nano Entrada: $0,20 por 1 milhão de tokens Entrada em cache: $0,05 por 1 milhão de tokens Saída: $0,80 por 1 milhão de tokens Treinamento: $1,50 por 1 milhão de tokens o4-mini Entrada: $4 por 1 milhão de tokens Entrada em cache: $1 por 1 milhão de tokens Saída: $16 por 1 milhão de tokens Treinamento: $100 por hora de treinamento

- GPT-4. 1 Entrada: US$ 3 por 1 milhão de tokens Entrada em cache: US$ 0,75 por 1 milhão de tokens Saída: US$ 12 por 1 milhão de tokens Treinamento: US$ 25 por 1 milhão de tokens

- Entrada: US$ 3 por 1 milhão de tokens

- Entrada em cache: US$ 0,75 por 1 milhão de tokens

- Resultado: US$ 12 por 1 milhão de tokens

- Treinamento: US$ 25 por 1 milhão de tokens

- GPT-4. 1 mini Entrada: US$ 0,80 por 1 milhão de tokens Entrada em cache: US$ 0,20 por 1 milhão de tokens Saída: US$ 3,20 por 1 milhão de tokens Treinamento: US$ 5 por 1 milhão de tokens

- Entrada: US$ 0,80 por 1 milhão de tokens

- Entrada em cache: US$ 0,20 por 1 milhão de tokens

- Resultado: US$ 3,20 por 1 milhão de tokens

- Treinamento: US$ 5 por 1 milhão de tokens

- GPT-4. 1 nano Entrada: $0,20 por 1 milhão de tokens Entrada em cache: $0,05 por 1 milhão de tokens Saída: $0,80 por 1 milhão de tokens Treinamento: $1,50 por 1 milhão de tokens

- Entrada: US$ 0,20 por 1 milhão de tokens

- Entrada em cache: US$ 0,05 por 1 milhão de tokens

- Resultado: US$ 0,80 por 1 milhão de tokens

- Treinamento: US$ 1,50 por 1 milhão de tokens

- o4-mini Entrada: US$ 4 por 1 milhão de tokens Entrada em cache: US$ 1 por 1 milhão de tokens Saída: US$ 16 por 1 milhão de tokens Treinamento: US$ 100 por hora de treinamento

- Entrada: US$ 4 por 1 milhão de tokens

- Entrada em cache: US$ 1 por 1 milhão de tokens

- Resultado: US$ 16 por 1 milhão de tokens

- Treinamento: US$ 100 por hora de treinamento

- Entrada: US$ 2 por 1 milhão de tokens

- Entrada em cache: US$ 0,50 por 1 milhão de tokens

- Resultado: US$ 8 por 1 milhão de tokens

- Entrada: US$ 0,40 por 1 milhão de tokens

- Entrada em cache: US$ 0,10 por 1 milhão de tokens

- Resultado: $1,60 por 1 milhão de tokens

- Entrada: US$ 0,100 por 1 milhão de tokens

- Entrada em cache: US$ 0,025 por 1 milhão de tokens

- Resultado: US$ 0,400 por 1 milhão de tokens

- Entrada: US$ 2 por 1 milhão de tokens

- Entrada em cache: US$ 0,50 por 1 milhão de tokens

- Resultado: US$ 8 por 1 milhão de tokens

- Entrada: $1,100 por 1 milhão de tokens

- Entrada em cache: US$ 0,275 por 1 milhão de tokens

- Resultado: $4. 400 por 1 milhão de tokens

- GPT-4. 1 Entrada: US$ 3 por 1 milhão de tokens Entrada em cache: US$ 0,75 por 1 milhão de tokens Saída: US$ 12 por 1 milhão de tokens Treinamento: US$ 25 por 1 milhão de tokens

- Entrada: US$ 3 por 1 milhão de tokens

- Entrada em cache: US$ 0,75 por 1 milhão de tokens

- Resultado: US$ 12 por 1 milhão de tokens

- Treinamento: US$ 25 por 1 milhão de tokens

- GPT-4. 1 mini Entrada: US$ 0,80 por 1 milhão de tokens Entrada em cache: US$ 0,20 por 1 milhão de tokens Saída: US$ 3,20 por 1 milhão de tokens Treinamento: US$ 5 por 1 milhão de tokens

- Entrada: US$ 0,80 por 1 milhão de tokens

- Entrada em cache: US$ 0,20 por 1 milhão de tokens

- Resultado: US$ 3,20 por 1 milhão de tokens

- Treinamento: US$ 5 por 1 milhão de tokens

- GPT-4. 1 nano Entrada: $0,20 por 1 milhão de tokens Entrada em cache: $0,05 por 1 milhão de tokens Saída: $0,80 por 1 milhão de tokens Treinamento: $1,50 por 1 milhão de tokens

- Entrada: US$ 0,20 por 1 milhão de tokens

- Entrada em cache: US$ 0,05 por 1 milhão de tokens

- Resultado: US$ 0,80 por 1 milhão de tokens

- Treinamento: US$ 1,50 por 1 milhão de tokens

- o4-mini Entrada: US$ 4 por 1 milhão de tokens Entrada em cache: US$ 1 por 1 milhão de tokens Saída: US$ 16 por 1 milhão de tokens Treinamento: US$ 100 por hora de treinamento

- Entrada: US$ 4 por 1 milhão de tokens

- Entrada em cache: US$ 1 por 1 milhão de tokens

- Resultado: US$ 16 por 1 milhão de tokens

- Treinamento: US$ 100 por hora de treinamento

- Entrada: US$ 3 por 1 milhão de tokens

- Entrada em cache: US$ 0,75 por 1 milhão de tokens

- Resultado: US$ 12 por 1 milhão de tokens

- Treinamento: US$ 25 por 1 milhão de tokens

- Entrada: US$ 0,80 por 1 milhão de tokens

- Entrada em cache: US$ 0,20 por 1 milhão de tokens

- Resultado: US$ 3,20 por 1 milhão de tokens

- Treinamento: US$ 5 por 1 milhão de tokens

- Entrada: US$ 0,20 por 1 milhão de tokens

- Entrada em cache: US$ 0,05 por 1 milhão de tokens

- Resultado: US$ 0,80 por 1 milhão de tokens

- Treinamento: US$ 1,50 por 1 milhão de tokens

- Entrada: US$ 4 por 1 milhão de tokens

- Entrada em cache: US$ 1 por 1 milhão de tokens

- Resultado: US$ 16 por 1 milhão de tokens

- Treinamento: US$ 100 por hora de treinamento

Avaliações e comentários da OpenAI

- G2: 4,7/5 (mais de 830 avaliações)

- Capterra: 4,5/5 (mais de 220 avaliações)

O que os usuários reais estão dizendo sobre a OpenAI?

De uma avaliação do G2:

Sua API é incrível, com uma excelente interface de usuário, e não enfrentei nenhum problema ao usar o chatgpt. Adorei e recomendo fortemente que você experimente, baixe e tome suas decisões rapidamente.

Sua API é incrível, com uma excelente interface de usuário, e não enfrentei nenhum problema ao usar o chatgpt. Adorei e recomendo fortemente que você experimente, baixe e tome suas decisões rapidamente.

🎥 Assista: Como usar o ClickUp Brain como seu assistente pessoal, a qualquer hora, em qualquer lugar.

💡 Dica profissional: Não confie em uma única métrica. Divida a avaliação do LLM em como ele lida com entradas estruturadas (por exemplo, tabelas, listas) em comparação com prompts não estruturados (tarefas abertas). Você identificará padrões de falha mais rapidamente.

3. Anthropic Claude (ideal para conversas seguras e contextuais com IA)

via Anthropic

Claude adota uma abordagem diferente em relação à segurança da IA. Em vez de aplicar filtros de conteúdo, a Anthropic treinou-o para pensar cuidadosamente nos problemas. Você notará que Claude considera várias perspectivas antes de responder, o que o torna bom em discussões matizadas sobre tópicos complexos.

A janela de contexto é enorme, então você pode alimentá-la com documentos inteiros e ter conversas reais sobre o conteúdo.

Pense nas vezes em que você quis discutir um artigo científico ou analisar um relatório longo. O Claude lida com esses cenários naturalmente. Ele também se lembra de tudo o que foi dito anteriormente na conversa, para que você não precise se repetir constantemente.

Principais recursos do Anthropic Claude

- Escreva e depure código em dezenas de linguagens de programação, explicando a lógica e sugerindo melhorias ao longo do processo.

- Pesquise na web em tempo real para acessar informações atualizadas e verificar fatos durante conversas.

- Reflita sobre dilemas éticos complexos e tópicos delicados, apresentando perspectivas equilibradas em vez de respostas simplificadas demais.

- Realize cálculos matemáticos avançados e análises estatísticas com explicações passo a passo e verificação.

- Gere resultados estruturados como JSON, XML e YAML que seguem esquemas específicos para integrações de API.

Limitações do Anthropic Claude

- Ele tem uma seleção de modelos menor em comparação com as alternativas ao Claude.

- Menos flexibilidade para treinamento de modelos personalizados

- Maior latência para algumas tarefas especializadas

Preços do Anthropic Claude

- Claude Opus 4 Entrada: US$ 15 por 1 milhão de tokens Saída: US$ 75 por 1 milhão de tokens Cache de prompt: Gravação: US$ 18,75 por 1 milhão de tokens Leitura: US$ 1,50 por 1 milhão de tokens

- Entrada: US$ 15 por 1 milhão de tokens

- Resultado: US$ 75 por 1 milhão de tokens

- Cache de prompt: Gravação: US$ 18,75 por 1 milhão de tokens Leitura: US$ 1,50 por 1 milhão de tokens

- Escreva: US$ 18,75 por 1 milhão de tokens

- Leia: US$ 1,50 por 1 milhão de tokens

- Claude Sonnet 4 Entrada: US$ 3 por 1 milhão de tokens Saída: US$ 15 por 1 milhão de tokens Cache de prompt: Gravação: US$ 3,75 por 1 milhão de tokens Leitura: US$ 0,30 por 1 milhão de tokens

- Entrada: US$ 3 por 1 milhão de tokens

- Resultado: US$ 15 por 1 milhão de tokens

- Cache de prompt: Gravação: US$ 3,75 por 1 milhão de tokens Leitura: US$ 0,30 por 1 milhão de tokens

- Escreva: US$ 3,75 por 1 milhão de tokens

- Leia: US$ 0,30 por 1 milhão de tokens

- Claude Haiku 3. 5 Entrada: US$ 0,80 por 1 milhão de tokens Saída: US$ 4 por 1 milhão de tokens Cache de prompt: Gravação: US$ 1 por 1 milhão de tokens Leitura: US$ 0,08 por 1 milhão de tokens

- Entrada: US$ 0,80 por 1 milhão de tokens

- Resultado: US$ 4 por 1 milhão de tokens

- Cache de prompt: Gravação: US$ 1 por 1 milhão de tokens Leitura: US$ 0,08 por 1 milhão de tokens

- Escreva: US$ 1 por 1 milhão de tokens

- Leia: US$ 0,08 por 1 milhão de tokens

- Entrada: US$ 15 por 1 milhão de tokens

- Resultado: US$ 75 por 1 milhão de tokens

- Cache de prompt: Gravação: $18,75 por 1 milhão de tokens Leitura: $1,50 por 1 milhão de tokens

- Escreva: $18,75 por 1 milhão de tokens

- Leia: US$ 1,50 por 1 milhão de tokens

- Escreva: $18,75 por 1 milhão de tokens

- Leia: US$ 1,50 por 1 milhão de tokens

- Entrada: US$ 3 por 1 milhão de tokens

- Resultado: US$ 15 por 1 milhão de tokens

- Cache de prompt: Gravação: US$ 3,75 por 1 milhão de tokens Leitura: US$ 0,30 por 1 milhão de tokens

- Escreva: US$ 3,75 por 1 milhão de tokens

- Leia: US$ 0,30 por 1 milhão de tokens

- Escreva: US$ 3,75 por 1 milhão de tokens

- Leia: US$ 0,30 por 1 milhão de tokens

- Entrada: US$ 0,80 por 1 milhão de tokens

- Resultado: US$ 4 por 1 milhão de tokens

- Cache de prompt: Gravação: $1 por 1 milhão de tokens Leitura: $0,08 por 1 milhão de tokens

- Escreva: US$ 1 por 1 milhão de tokens

- Leia: US$ 0,08 por 1 milhão de tokens

- Escreva: US$ 1 por 1 milhão de tokens

- Leia: US$ 0,08 por 1 milhão de tokens

Avaliações e comentários sobre o Anthropic Claude

- G2: 4,4/5 (mais de 55 avaliações)

- Capterra: 4,5/5 (mais de 20 avaliações)

O que os usuários reais estão dizendo sobre o Anthropic Claude?

Baseado em um comentário do Reddit:

Honestamente? Claude parece ser uma boa “pessoa”. Ele leva em consideração o bem-estar humano em suas decisões com uma profundidade que não é vista em outros modelos. Se eu fosse forçado a escolher um LLM para ser o líder mundial, Claude seria minha primeira escolha. Eu não confiaria necessariamente nos outros da mesma forma sem um treinamento ético ou de constituição de personalidade.

Honestamente? Claude parece ser uma boa “pessoa”. Ele leva em consideração o bem-estar humano em suas decisões com uma profundidade que não é vista em outros modelos. Se eu fosse forçado a escolher um LLM para ser o líder mundial, Claude seria minha primeira escolha. Eu não confiaria necessariamente nos outros da mesma forma sem um treinamento ético ou de constituição de personalidade.

🧠 Curiosidade: Em 2012, um modelo chamado AlexNet superou os humanos no reconhecimento de imagens. Era mais rápido, mais preciso e não se cansava. Esse momento mudou a forma como as pessoas viam o potencial da IA em áreas como saúde, segurança e robótica.

📖 Leia também: Melhores alternativas e concorrentes da Anthropic AI

4. Cohere (ideal para criar soluções de processamento de linguagem natural de nível empresarial)

via Cohere

A Cohere criou sua plataforma especificamente para empresas que precisam de inteligência artificial, mas não podem comprometer a privacidade dos dados. Seus recursos multilíngues abrangem mais de 100 idiomas, o que é excelente se você lida com clientes globais ou mercados internacionais.

As incorporações funcionam particularmente bem para aplicativos de pesquisa em que você precisa entender o significado, em vez de apenas corresponder palavras-chave. Você também pode treinar seus próprios classificadores personalizados de IA, o que o torna prático para equipes que precisam de soluções de IA, mas não têm cientistas de dados dedicados.

Melhores recursos do Cohere

- Ajuste os modelos usando seus dados proprietários, mantendo controle total sobre os conjuntos de dados de treinamento e os pesos dos modelos.

- Dimensiona a capacidade de inferência automaticamente com base nos padrões de demanda, sem precisar gerenciar a infraestrutura de GPU subjacente.

- Implemente sistemas de geração aumentada por recuperação que podem citar fontes e fornecer atribuição para o conteúdo gerado.

- Monitore o desempenho do modelo e os padrões de uso por meio de painéis analíticos abrangentes e sistemas de alerta.

- Integre-se aos sistemas de autenticação existentes usando SSO, SAML e controles de acesso baseados em funções para acompanhar os experimentos.

Limitações do Cohere

- Comunidade menor e menos integrações de terceiros

- Recursos limitados de visão computacional em comparação com plataformas multimodais

- Há menos modelos pré-treinados disponíveis para domínios especializados.

- Documentação menos extensa para casos de uso avançados e configurações híbridas.

Preços do Cohere

- Comando A Entrada: $2,50 por 1 milhão de tokens Saída: $10 por 1 milhão de tokens

- Entrada: US$ 2,50 por 1 milhão de tokens

- Resultado: US$ 10 por 1 milhão de tokens

- Comando R Entrada: $0,15 por 1 milhão de tokens Saída: $0,60 por 1 milhão de tokens

- Entrada: US$ 0,15 por 1 milhão de tokens

- Resultado: US$ 0,60 por 1 milhão de tokens

- Comando R7B Entrada: $0,0375 por 1 milhão de tokens Saída: $0,15 por 1 milhão de tokens

- Entrada: US$ 0,0375 por 1 milhão de tokens

- Resultado: US$ 0,15 por 1 milhão de tokens

- Entrada: US$ 2,50 por 1 milhão de tokens

- Resultado: US$ 10 por 1 milhão de tokens

- Entrada: US$ 0,15 por 1 milhão de tokens

- Resultado: US$ 0,60 por 1 milhão de tokens

- Entrada: US$ 0,0375 por 1 milhão de tokens

- Resultado: US$ 0,15 por 1 milhão de tokens

Avaliações e comentários sobre o Cohere

- G2: Avaliações insuficientes

- Capterra: Não há avaliações suficientes

O que os usuários reais estão dizendo sobre o Cohere?

De acordo com uma análise da Capterra:

Configurar o Cohere foi muito fácil e a documentação era bastante simples de seguir. Poder ver como nossos usuários estão usando o aplicativo foi realmente útil e interessante para começar. [...] A versão gratuita do software tem um conjunto extremamente limitado de sessões e, à medida que nossa base de usuários cresceu, estamos achando o aplicativo menos útil, pois mais sessões estão ocultas atrás de um paywall.

Configurar o Cohere foi muito fácil e a documentação era bastante simples de seguir. Poder ver como nossos usuários estão usando o aplicativo foi realmente útil e interessante para começar. [...] A versão gratuita do software tem um conjunto extremamente limitado de sessões e, à medida que nossa base de usuários cresceu, estamos achando o aplicativo menos útil, pois mais sessões estão ocultas atrás de um paywall.

🔍 Você sabia? Modelos como GPT‑4 e Grok 4 mudaram suas respostas quando receberam críticas (mesmo que sua primeira resposta estivesse correta). Eles começaram a duvidar de si mesmos depois de verem feedbacks contraditórios. Isso é assustadoramente semelhante ao comportamento das pessoas sob estresse e levanta questões sobre a confiabilidade de suas respostas.

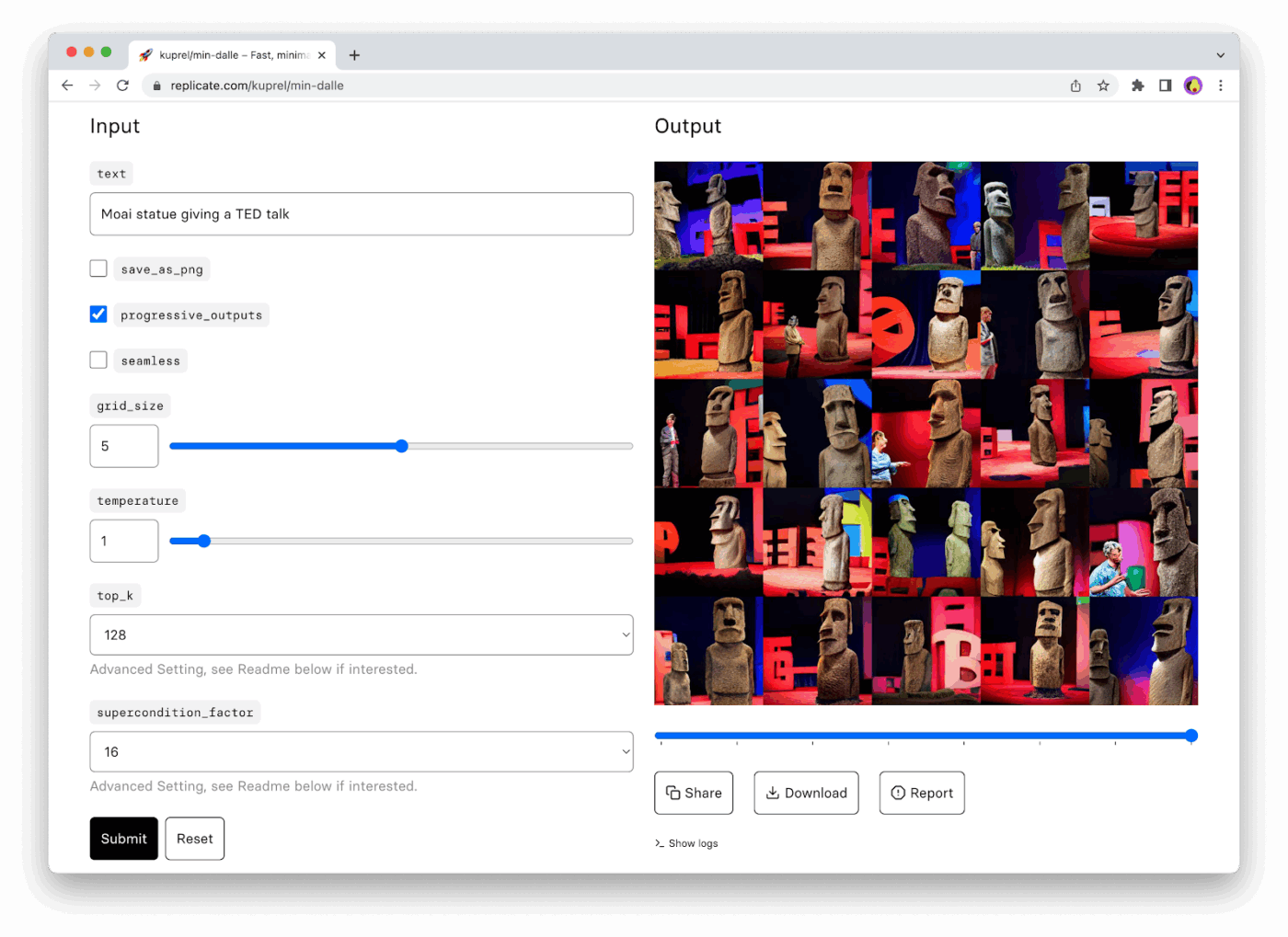

5. Replicate (ideal para executar modelos de IA de código aberto sem gerenciamento de infraestrutura)

via Replicate

O Replicate é como ter uma enorme biblioteca de modelos de IA sem a dor de cabeça de gerenciar servidores. Alguém criou um gerador de imagens incrível? Provavelmente está no Replicate. Quer experimentar aquele novo modelo de síntese de voz que todo mundo está comentando? Basta fazer uma chamada de API.

O aplicativo de IA lida com toda a complexidade da infraestrutura para que você possa experimentar dezenas de modelos diferentes sem se comprometer com um único. Você paga apenas quando usa algo, o que o torna perfeito para prototipagem.

Além disso, quando você encontrar um modelo que funcione, poderá até mesmo implantar suas próprias versões personalizadas usando o sistema de contêineres simples deles.

Replique os melhores recursos

- Controle a versão das implantações de seus modelos com recursos de reversão e testes A/B entre diferentes versões de modelos.

- Configure webhooks para receber notificações quando previsões de longa duração forem concluídas ou encontrarem erros.

- Processe vários inputs simultaneamente para reduzir os custos por previsão e melhorar a eficiência da produtividade.

- Faça um fork dos modelos existentes para criar versões personalizadas com diferentes parâmetros ou dados de treinamento.

Limitações da replicação

- Você tem menos controle sobre o ambiente de hospedagem do modelo e as configurações.

- Existem potenciais problemas de latência para aplicações em tempo real e necessidades empresariais.

- Opções limitadas para personalização e ajuste fino de modelos

- Dependência da disponibilidade e manutenção de modelos de terceiros

Preços da Replicate

- Os preços variam de acordo com cada modelo.

Replique avaliações e comentários

- G2: Avaliações insuficientes

- Capterra: Não há avaliações suficientes

O que os usuários reais estão dizendo sobre o Replicate?

Uma avaliação no Reddit observa:

De qualquer forma, na minha opinião, o Replicate é a opção mais fácil de usar para experimentar novos modelos de imagem ou vídeo. Duvido que seja a opção mais econômica se você tiver muitos usuários, mas para um MVP, ela pode economizar muito trabalho e dinheiro (em comparação com alugar uma GPU por hora).

De qualquer forma, na minha opinião, o Replicate é a opção mais fácil de usar para experimentar novos modelos de imagem ou vídeo. Duvido que seja a opção mais econômica se você tiver muitos usuários, mas para um MVP, ela pode economizar muito trabalho e dinheiro (em comparação com alugar uma GPU por hora).

💡 Dica profissional: Faça ajustes finos com moderação. Nem sempre é necessário ajustar um modelo para obter resultados específicos do domínio. Experimente primeiro a engenharia de prompts inteligentes + geração aumentada por recuperação (RAG). Invista em ajustes finos apenas se atingir consistentemente os limites máximos de precisão ou relevância.

6. TensorFlow (ideal para criar modelos personalizados de aprendizado de máquina do zero)

via TensorFlow

O TensorFlow oferece controle total sobre o seu destino no aprendizado de máquina (o que pode ser uma bênção e uma maldição). O Google tornou sua estrutura de ML de produção open source, o que significa que você tem acesso às mesmas ferramentas que eles usam internamente.

A flexibilidade é incrível; você pode construir qualquer coisa, desde uma simples regressão linear até arquiteturas complexas de transformadores.

O TensorFlow Hub fornece modelos pré-treinados que você pode ajustar, enquanto o TensorBoard oferece análises em tempo real sobre o desempenho do treinamento. No entanto, esse poder vem acompanhado de complexidade. Você vai gastar tempo aprendendo conceitos que plataformas de nível superior abstraem.

Melhores recursos do TensorFlow

- Analise o desempenho do modelo e identifique gargalos usando ferramentas avançadas de depuração que mostram o uso da memória e gráficos de computação.

- Converta modelos entre diferentes formatos, como SavedModel, TensorFlow Lite e ONNX, para compatibilidade entre plataformas.

- Implemente funções de perda personalizadas e algoritmos de otimização que não estão disponíveis nas bibliotecas padrão de aprendizado de máquina.

- Utilize o treinamento de precisão mista para reduzir o uso de memória e acelerar o treinamento em arquiteturas GPU modernas.

- Crie pipelines de dados personalizados com tf.data que lidam de forma eficiente com grandes conjuntos de dados com pré-processamento e aumento.

Limitações do TensorFlow

- Requer recursos computacionais significativos para o treinamento de modelos grandes.

- Processo de depuração complexo em comparação com alternativas de nível superior ao Hugging Face

- Configuração e ajuste demorados para casos de uso avançados

Preços do TensorFlow

- Preços personalizados

Avaliações e comentários sobre o TensorFlow

- G2: 4,5/5 (mais de 125 avaliações)

- Capterra: 4,6/5 (mais de 100 avaliações)

O que os usuários reais estão dizendo sobre o TensorFlow?

Um usuário do G2 destaca:

Adoro o quão poderoso e flexível o TensorFlow é para construir e treinar modelos de deep learning. O Keras torna isso um pouco mais fácil e os modelos pré-treinados economizam muito tempo. Além disso, a comunidade é ótima quando eu fico preso. [...] A curva de aprendizado é íngreme. Especialmente para iniciantes. Às vezes, as mensagens de erro são muito complicadas de entender e a depuração é frustrante. Além disso, requer muito poder de computação, o que pode ser um problema se você não tiver um hardware de ponta.

Adoro o quão poderoso e flexível o TensorFlow é para construir e treinar modelos de deep learning. O Keras torna isso um pouco mais fácil e os modelos pré-treinados economizam muito tempo. Além disso, a comunidade é ótima quando eu fico preso. [...] A curva de aprendizado é íngreme. Especialmente para iniciantes. Às vezes, as mensagens de erro são muito complicadas de entender e a depuração é frustrante. Além disso, requer muito poder de computação, o que pode ser um problema se você não tiver um hardware de ponta.

🧠 Curiosidade: Pesquisadores descobriram que os modelos de linguagem frequentemente sugerem pacotes de software que não existem. Cerca de 19,7% das amostras de código incluíam nomes inventados, o que pode levar a ataques de squatting.

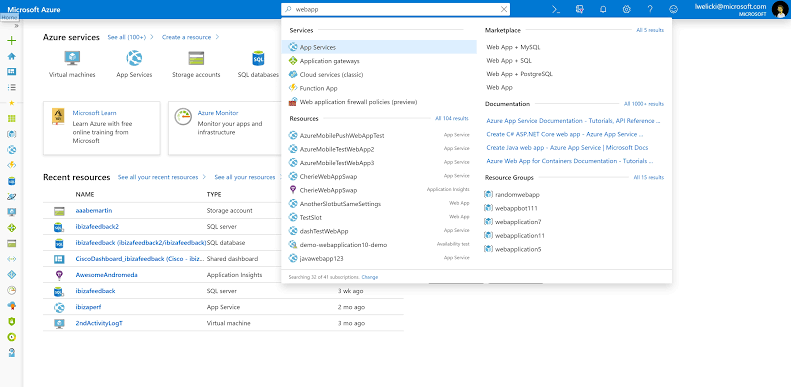

7. Azure Machine Learning (ideal para integrar fluxos de trabalho de ML com os serviços em nuvem da Microsoft)

via Microsoft Azure

O Azure ML é a escolha natural se sua organização já utiliza a Microsoft. A ferramenta oferece interfaces do tipo apontar e clicar para usuários empresariais e ambientes de programação completos para cientistas de dados.

O AutoML cuida do trabalho pesado quando você precisa de resultados rápidos, testando automaticamente diferentes algoritmos e hiperparâmetros. Enquanto isso, a integração com o Power BI significa que seus modelos podem ser alimentados diretamente em painéis executivos.

Você obtém um controle de versão robusto para modelos, pipelines de implantação automatizados e monitoramento que avisa quando o desempenho do modelo começa a se degradar.

Melhores recursos do Azure Machine Learning

- Programe pipelines de retreinamento automatizados que são acionados quando novos dados ficam disponíveis ou o desempenho do modelo diminui.

- Crie ambientes Docker personalizados para treinamento e implantação de modelos reproduzíveis em diferentes alvos de computação.

- Implemente recursos de interpretabilidade de modelos que explicam previsões usando LIME, SHAP e outras técnicas de explicabilidade.

- Configure o monitoramento de desvio de dados que o alerta quando os dados recebidos diferem significativamente dos conjuntos de dados de treinamento.

- Gerencie clusters de computação que se dimensionam automaticamente com base nas demandas de carga de trabalho, otimizando a eficiência de custos.

Limitações do Azure Machine Learning

- Existem preocupações com a dependência de fornecedores para organizações que utilizam estratégias multicloud.

- Flexibilidade limitada em comparação com alternativas de código aberto ao Hugging Face

Preços do Azure Machine Learning

- Preços personalizados

Avaliações e comentários do Azure Machine Learning

- G2: 4,3/5 (mais de 85 avaliações)

- Capterra: 4,5/5 (30 avaliações)

O que os usuários reais estão dizendo sobre o Azure Machine Learning?

Conforme compartilhado no G2:

O serviço é fácil de usar e tem muitos recursos interessantes para carregar dados e capturar padrões, a interface poderia ser melhor, mas atende às minhas necessidades. Se você tiver dúvidas sobre a implementação, há muitas informações na web ou você pode solicitar ajuda diretamente ao suporte da Microsoft.

O serviço é fácil de usar e tem muitos recursos interessantes para carregar dados e identificar padrões, a interface poderia ser melhor, mas atende às minhas necessidades. Se você tiver dúvidas sobre a implementação, há muitas informações na web ou você pode solicitar ajuda diretamente ao suporte da Microsoft.

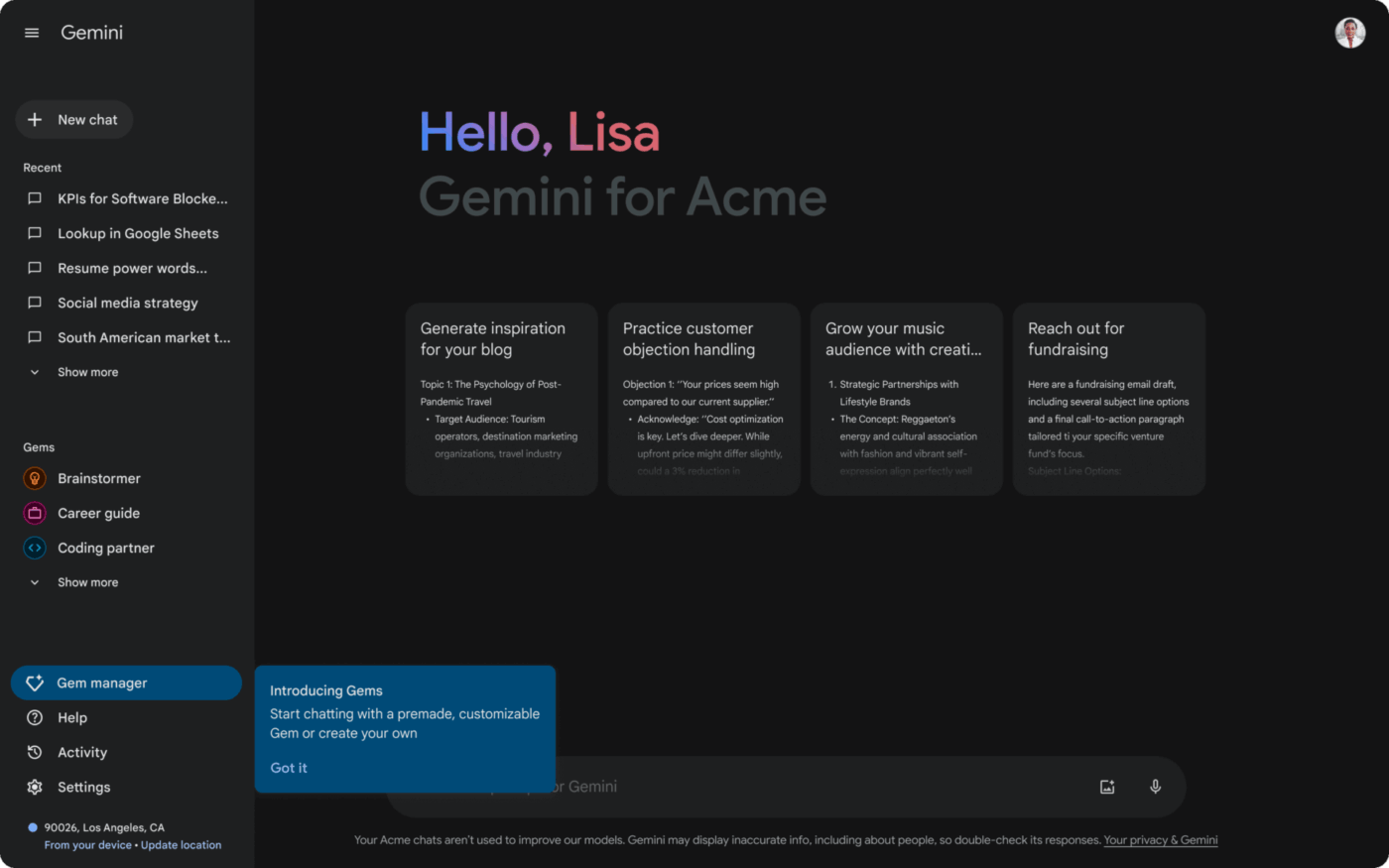

8. Google Gemini (ideal para processar vários tipos de conteúdo em uma única interação)

via Google Gemini

O Gemini do Google compreende vários tipos de conteúdo simultaneamente. Você pode mostrar um gráfico e fazer perguntas sobre os dados ou enviar imagens e conversar sobre o que está acontecendo nelas. Os recursos matemáticos e de codificação são particularmente fortes. Ele resolve equações complexas passo a passo e explica seu raciocínio.

A janela de contexto lida com grandes quantidades de texto, tornando-a útil para analisar trabalhos de pesquisa inteiros ou documentos longos. O interessante é como ela mantém o fluxo da conversa entre diferentes tipos de conteúdo sem perder o foco do que você está discutindo.

Melhores recursos do Google Gemini

- Traduza entre dezenas de idiomas, preservando o contexto e as nuances culturais do texto original.

- Gere e execute código Python diretamente nas conversas, mostrando resultados e depurando erros em tempo real.

- Extraia dados estruturados de fontes não estruturadas, como recibos, formulários e documentos manuscritos.

- Analise componentes visuais e de áudio simultaneamente para obter resumos detalhados do conteúdo de vídeo.

- Execute tarefas complexas de raciocínio que exigem a combinação de informações de várias fontes e tipos de conteúdo.

Limitações do Google Gemini

- Disponibilidade limitada em determinadas regiões e para casos de uso específicos.

- Opções de personalização de modelos menos abrangentes em comparação com alternativas estabelecidas

- Os usuários têm manifestado preocupações sobre a privacidade dos dados no ecossistema do Google.

Preços do Google Gemini

- Gratuito

- Nível pago: os preços variam para cada modelo.

Avaliações e comentários do Google Gemini

- G2: 4,4/5 (mais de 245 avaliações)

- Capterra: Avaliações insuficientes

🧠 Curiosidade: Você poderia pensar que modelos melhores cometeriam menos erros, mas o oposto pode acontecer. À medida que os LLMs ficam maiores e mais avançados, eles às vezes têm mais alucinações, especialmente quando solicitados a fornecer fatos. Mesmo as versões mais recentes apresentam erros mais confiantes, o que os torna mais difíceis de detectar.

9. Microsoft Copilot (ideal para aumentar a produtividade em aplicativos do Microsoft Office)

O Copilot está integrado aos aplicativos da Microsoft que você usa diariamente, o que muda a forma como a IA funciona na prática. Ele entende o contexto do seu trabalho — seu estilo de escrita, os dados que você está analisando e até mesmo seu histórico de reuniões.

Peça para ele criar uma apresentação e ele extrairá informações relevantes de seus documentos e e-mails recentes.

A integração com o Excel é particularmente inteligente, ajudando você a analisar dados usando linguagem natural em vez de fórmulas complexas. A melhor parte? Sua curva de aprendizado é mínima, pois a interface da ferramenta de colaboração de IA se baseia nas convenções familiares da Microsoft.

Melhores recursos do Microsoft Copilot

- Transforme dados brutos em apresentações atraentes do PowerPoint usando seus modelos existentes e diretrizes de marca.

- Automatize tarefas repetitivas do Excel, como tabelas dinâmicas, formatação condicional e criação de fórmulas, por meio de comandos conversacionais.

- Elabore agendas de reuniões e e-mails de acompanhamento com base em convites de calendário e notas de reuniões anteriores.

- Crie documentos com aparência profissional usando estilos integrados e sugestões de formatação que correspondem aos padrões da sua organização.

Limitações do Microsoft Copilot

- A ferramenta requer uma assinatura do Microsoft 365 e compromisso com o ecossistema, e tem funcionalidade limitada fora dos aplicativos da Microsoft.

- Desempenho inconsistente em diferentes aplicativos do Office

Preços do Microsoft Copilot

- Gratuito

- Copilot Pro: US$ 20/mês

- Copilot para Microsoft 365: US$ 30/mês por usuário (cobrado anualmente)

Avaliações e comentários do Microsoft Copilot

- G2: 4,4/5 (mais de 85 avaliações)

- Capterra: Não há avaliações suficientes

O que os usuários reais estão dizendo sobre o Microsoft Copilot?

Um usuário do Reddit diz:

Eu o uso todos os dias para me ajudar com funções mais complexas do Excel. Se eu tenho uma ideia conceitual de como quero manipular os dados, eu defino a situação e o copiloto quase sempre retorna uma solução prática e utilizável. Isso me ajudou a ficar muito mais familiarizado e confortável com as funções de matriz.

Eu o uso todos os dias para me ajudar com funções mais complexas do Excel. Se eu tenho uma ideia conceitual de como quero manipular os dados, eu defino a situação e o copiloto quase sempre retorna uma solução prática e utilizável. Isso me ajudou a ficar muito mais familiarizado e confortável com as funções de matriz.

📖 Leia também: As melhores alternativas ao Microsoft Copilot para facilitar sua vida e seus fluxos de trabalho

10. IBM WatsonX (ideal para implantar IA em ambientes de negócios altamente regulamentados)

via IBM WatsonX

A IBM projetou o WatsonX especificamente para organizações que não podem correr riscos com IA, como bancos, hospitais e órgãos governamentais. Todas as decisões do modelo são registradas, criando trilhas de auditoria que as equipes de conformidade apreciam.

A plataforma oferece soluções específicas para o setor, permitindo que organizações de saúde utilizem modelos treinados em literatura médica e organizações de serviços financeiros obtenham recursos de avaliação de risco.

Dependendo dos seus requisitos de sensibilidade de dados, você pode implantar modelos no local, na nuvem da IBM ou em configurações híbridas. Os recursos de governança permitem definir barreiras de proteção e monitorar os resultados da IA em busca de vieses ou comportamentos inesperados.

Melhores recursos do IBM WatsonX

- Implemente um monitoramento de imparcialidade que detecta e corrige automaticamente vieses nas previsões do modelo em diferentes grupos demográficos.

- Crie modelos personalizados de prompts de IA com proteções de segurança integradas que evitam respostas prejudiciais ou inadequadas da IA.

- Gere relatórios detalhados de conformidade mostrando as decisões do modelo e o uso de dados para auditorias regulatórias e documentação.

- Teste a robustez do modelo usando exemplos adversários e casos extremos para identificar possíveis vulnerabilidades antes da implantação.

- Estabeleça fluxos de trabalho com intervenção humana, nos quais decisões críticas exigem aprovação manual antes da execução.

Limitações do IBM WatsonX

- Custos mais elevados em comparação com alternativas nativas da nuvem ao Hugging Face

- Os requisitos de instalação e configuração são complexos.

- Ele tem um ciclo de inovação mais lento em comparação com plataformas de IA mais recentes.

- Suporte comunitário limitado e extensões de terceiros

Preços do IBM WatsonX

- Gratuito

- Essenciais: A partir de US$ 0/mês (modelo de pagamento conforme o uso)

- Padrão: a partir de US$ 1.050/mês (modelo de pagamento conforme o uso)

Avaliações e comentários do IBM WatsonX

- G2: 4,5/5 (mais de 84 avaliações)

- Capterra: Avaliações insuficientes

O que os usuários reais estão dizendo sobre o IBM WatsonX?

Com base em uma avaliação do G2:

Como desenvolvedor, aprecio como ele combina flexibilidade com estrutura, oferecendo uma ampla variedade de tipos de modelos, desde ML clássico até grandes modelos de linguagem. A interface do usuário é limpa e a integração com as estruturas de nuvem e segurança existentes é direta, o que ajuda a acelerar os ciclos de experimentação sem comprometer a governança. [...] Embora a plataforma seja poderosa, ela pode parecer um pouco complicada no início, especialmente ao configurar fluxos de trabalho mais personalizados. Além disso, os preços poderiam ser mais transparentes para usuários que ainda estão explorando opções antes de se comprometerem em nível empresarial. Tutoriais de integração aprimorados para desenvolvedores novos no ecossistema da IBM seriam uma adição bem-vinda.

Como desenvolvedor, aprecio como ele combina flexibilidade com estrutura, oferecendo uma ampla variedade de tipos de modelos, desde ML clássico até grandes modelos de linguagem. A interface do usuário é limpa e a integração com as estruturas de nuvem e segurança existentes é direta, o que ajuda a acelerar os ciclos de experimentação sem comprometer a governança. [...] Embora a plataforma seja poderosa, ela pode parecer um pouco complicada no início, especialmente ao configurar fluxos de trabalho mais personalizados. Além disso, os preços poderiam ser mais transparentes para usuários que ainda estão explorando opções antes de se comprometerem em nível empresarial. Tutoriais de integração aprimorados para desenvolvedores novos no ecossistema da IBM seriam uma adição bem-vinda.

🎥 Assista: Experimente seu primeiro agente de IA que responde contextualmente ao seu trabalho. Ouça diretamente de Zeb Evans, fundador e CEO da ClickUp:

11. BigML.com (ideal para criar modelos preditivos sem codificação ou conhecimento técnico)

via BigML

A interface visual do BigML permite que você crie modelos preditivos arrastando e soltando conjuntos de dados, em vez de escrever códigos complexos. Carregue um arquivo CSV com os dados dos clientes e o BigML ajudará você a prever quais clientes são mais propensos a cancelar seus serviços.

A plataforma lida automaticamente com o pré-processamento de dados, seleção de recursos e validação de modelos. O que torna o BigML confiável é a forma como ele explica suas previsões. Você obtém visualizações claras que mostram quais fatores influenciam as decisões do modelo, facilitando a apresentação dos resultados às partes interessadas que precisam entender o “porquê” por trás das recomendações de IA.

BigML.com: melhores recursos

- Gere insights e recomendações automatizadas a partir de seus dados usando explicações em linguagem natural que equipes não técnicas podem entender.

- Combine vários algoritmos para melhorar a precisão da previsão e reduzir os riscos de sobreajuste com modelos de conjunto.

- Realize análises de agrupamento para identificar padrões ocultos e segmentos de clientes em seus dados comerciais.

- Crie modelos de previsão de séries temporais para planejamento de estoque, previsão de demanda e projeções financeiras.

- Exporte a lógica de previsão como aplicativos independentes ou incorpore-a diretamente nos sistemas comerciais existentes.

Limitações do BigML.com

- Ele tem suporte limitado para deep learning e arquiteturas de redes neurais.

- Menos opções de personalização em comparação com plataformas baseadas em programação.

- Comunidade menor e ecossistema de ferramentas de terceiros

- Menos adequado para pesquisas de ponta e abordagens experimentais.

Preços do BigML.com

- Avaliação gratuita por 14 dias

- Standard Prime: US$ 30/mês

Avaliações e comentários do BigML.com

- G2: 4,7/5 (mais de 20 avaliações)

- Capterra: Avaliações insuficientes

12. LangChain (ideal para desenvolver aplicativos complexos de IA com vários componentes)

via LangChain

O LangChain resolve o problema de conectar modelos de IA a aplicativos do mundo real. Você pode criar sistemas que pesquisam informações em bancos de dados, chamam APIs externas e mantêm o histórico de conversas em várias interações.

A estrutura fornece componentes pré-construídos para padrões comuns como RAG, onde modelos de IA podem acessar e citar documentos específicos. Você pode encadear diferentes serviços de IA, talvez usando um modelo para entender a intenção do usuário e outro para gerar respostas.

Além disso, os recursos do agente LLM da LangChain são de código aberto e independentes de modelo, para que você não fique preso a nenhum provedor de IA específico.

Melhores recursos do LangChain

- Depure fluxos de trabalho complexos de IA usando ferramentas integradas de rastreamento e registro que mostram exatamente como os dados fluem entre os componentes.

- Armazene em cache chamadas de API caras e respostas de modelos para reduzir custos e melhorar o desempenho do aplicativo.

- Lide com erros de maneira elegante com lógica de repetição e mecanismos de fallback quando os serviços de IA estiverem indisponíveis.

- Crie estruturas de avaliação personalizadas para testar o desempenho de aplicativos de IA em diferentes cenários e conjuntos de dados.

- Implemente respostas de streaming para aplicativos em tempo real, nos quais os usuários precisam de feedback imediato durante processos de longa duração.

Limitações do LangChain

- Requer conhecimento de programação e compreensão dos conceitos de IA.

- O ritmo acelerado do desenvolvimento pode levar a mudanças radicais e instabilidade.

- Sobrecarga de desempenho das camadas de abstração em aplicativos complexos

- Ferramentas integradas limitadas de monitoramento e depuração para ambientes de produção

Preços do LangChain

- Desenvolvedor: a partir de US$ 0/mês (pague conforme o uso)

- Mais: A partir de US$ 39/mês (pague conforme o uso)

- Empresa: Preços personalizados

Avaliações e comentários do LangChain

- G2: Não há avaliações suficientes

- Capterra: Avaliações insuficientes

💡 Dica profissional: antes de investir recursos em um LLM massivo, crie um pipeline de recuperação de informações robusto que filtre o contexto com precisão. A maioria das alucinações começa com entradas ruidosas, não com limitações do modelo.

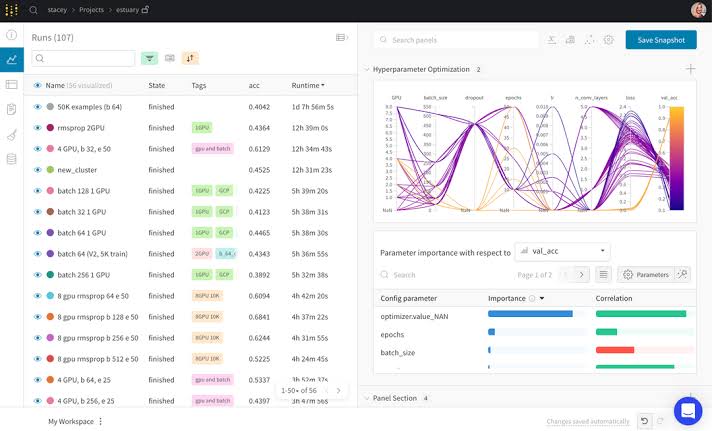

13. Weights & Biases (ideal para rastrear e comparar resultados de experimentos de aprendizado de máquina)

via Weights & Biases

O Weights & Biases evita que o ML se torne uma bagunça caótica de experimentos esquecidos e resultados perdidos. A plataforma captura automaticamente tudo sobre o treinamento do seu modelo: hiperparâmetros, métricas, versões de código e até mesmo o desempenho do sistema.

Quando algo funciona bem, você pode reproduzi-lo facilmente. Quando as experiências falham, você pode ver exatamente o que deu errado.

As ferramentas de visualização ajudam você a identificar tendências em centenas de execuções de treinamento, identificando quais abordagens produzem o melhor desempenho. As equipes adoram os recursos de colaboração porque todos podem ver o que os outros estão tentando fazer sem atrapalhar o trabalho uns dos outros.

Melhores recursos do Weights & Biases

- Configure varreduras automatizadas de hiperparâmetros que exploram diferentes combinações de parâmetros e identificam as configurações ideais.

- Crie painéis personalizados com gráficos interativos que são atualizados em tempo real à medida que os experimentos avançam.

- Marque e organize experimentos usando metadados personalizados para encontrar resultados relevantes em grandes projetos de pesquisa.

- Compartilhe os resultados dos experimentos externamente usando relatórios públicos que não expõem códigos ou dados confidenciais.

- Analise o desempenho do treinamento para identificar problemas de utilização da GPU e otimizar a alocação de recursos.

Limitações do Weights & Biases

- A ferramenta introduz complexidade adicional para projetos simples que não exigem rastreamento extensivo.

- Os custos podem se acumular rapidamente para equipes grandes e acompanhamento extensivo de experimentos.

- Houve críticas relativas à documentação técnica inadequada.

Preços do Weights & Biases

Hospedado na nuvem

- Gratuito

- Prós: A partir de US$ 50/mês

- Empresa: Preços personalizados

Hospedagem privada

- Gratuito para uso pessoal.

- Empresa avançada: Preços personalizados

Avaliações e comentários do Weights & Biases

- G2: 4,7/5 (mais de 40 avaliações)

- Capterra: Não há avaliações suficientes

O que os usuários reais estão dizendo sobre o Weights & Biases?

No Reddit, um usuário disse:

Eu uso o WandB no meu trabalho várias horas por dia. É o mais completo em termos de recursos para essa aplicação, mas seu desempenho é muuuuito ruim.

Eu uso o WandB no meu trabalho várias horas por dia. É o mais completo em termos de recursos para essa aplicação, mas seu desempenho é muuuuito ruim.

📮 ClickUp Insight: Apenas 12% dos participantes da nossa pesquisa utilizam recursos de IA incorporados em pacotes de produtividade. Essa baixa adoção sugere que as implementações atuais podem carecer da integração contextual perfeita que levaria os usuários a migrar de suas plataformas conversacionais independentes preferidas.

Por exemplo, a IA pode executar um fluxo de trabalho de automação com base em um prompt de texto simples do usuário? O ClickUp Brain pode ! A IA está profundamente integrada em todos os aspectos do ClickUp, incluindo, entre outros, resumir threads de bate-papo, redigir ou aperfeiçoar textos, extrair informações do espaço de trabalho, gerar imagens e muito mais!

Junte-se aos 40% dos clientes do ClickUp que substituíram mais de três aplicativos pelo nosso aplicativo completo para o trabalho!

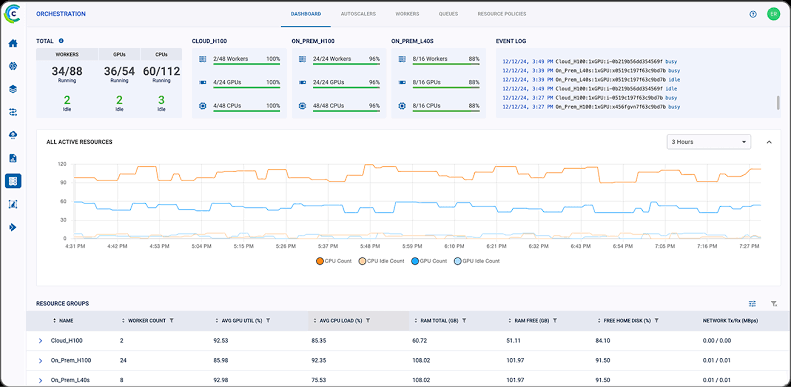

14. ClearML (ideal para automatizar fluxos de trabalho de operações de aprendizado de máquina de ponta a ponta)

via ClearML

O ClearML lida com o pesadelo operacional de gerenciar modelos de aprendizado de máquina em produção. A plataforma rastreia automaticamente todos os aspectos do seu fluxo de trabalho de ML, desde o pré-processamento de dados até a implantação de modelos, criando uma trilha de auditoria completa sem esforço manual.

Quando os modelos falham na produção, você pode rastrear os problemas até alterações específicas nos dados ou modificações no código. Os recursos de treinamento distribuído permitem dimensionar experimentos em várias máquinas e provedores de nuvem de maneira integrada.

Além disso, a orquestração do pipeline automatiza tarefas repetitivas, como validação de dados, retreinamento de modelos e aprovações de implantação.

Melhores recursos do ClearML

- Programe experimentos para serem executados automaticamente durante os horários de menor movimento para otimizar os custos de computação e a utilização de recursos.

- Compare o desempenho do modelo em diferentes conjuntos de dados e períodos de tempo usando métricas de avaliação padronizadas.

- Integre-se a pipelines de CI/CD e ferramentas de implantação existentes usando artefatos personalizados e registros de modelos.

- Implemente implantações blue-green para modelos de ML com recursos de reversão automatizada quando o desempenho cair.

- Gere automaticamente documentação de conformidade para setores regulamentados que exigem governança detalhada de modelos.

Limitações do ClearML

- Configuração inicial complexa e configuração para recursos avançados

- Curva de aprendizado para equipes em transição de um gerenciamento de fluxo de trabalho mais simples

- O monitoramento intensivo de recursos do ClearML pode afetar o desempenho do sistema.

- Integrações limitadas em comparação com alternativas mais estabelecidas ao Hugging Face.

Preços do ClearML

- Gratuito

- Prós: US$ 15/mês por usuário + uso (para equipes com até 10 membros)

- Escala: preços personalizados

- Empresa: Preços personalizados

Avaliações e comentários do ClearML

- G2: Não há avaliações suficientes

- Capterra: Não há avaliações suficientes

O que os usuários reais estão dizendo sobre o ClearML?

Conforme compartilhado no Reddit:

Usamos o ClearML exclusivamente para rastreamento de experimentos e hospedamos o ClearML Server e o ClearML Agent em nossa infraestrutura interna. Até agora, nossa experiência com o ClearML tem sido excelente, especialmente em relação ao gerenciamento de experimentos, reprodutibilidade e fluxo de trabalho de implantação.

Usamos o ClearML exclusivamente para rastreamento de experimentos e hospedamos o ClearML Server e o ClearML Agent em nossa infraestrutura interna. Até agora, nossa experiência com o ClearML tem sido excelente, especialmente em relação ao gerenciamento de experimentos, reprodutibilidade e fluxo de trabalho de implantação.

🔍 Você sabia? Os sistemas híbridos superam consistentemente a recuperação por método único. Integre as duas abordagens em seu mecanismo de pesquisa de IA para equilibrar a compreensão semântica com a precisão da correspondência exata.

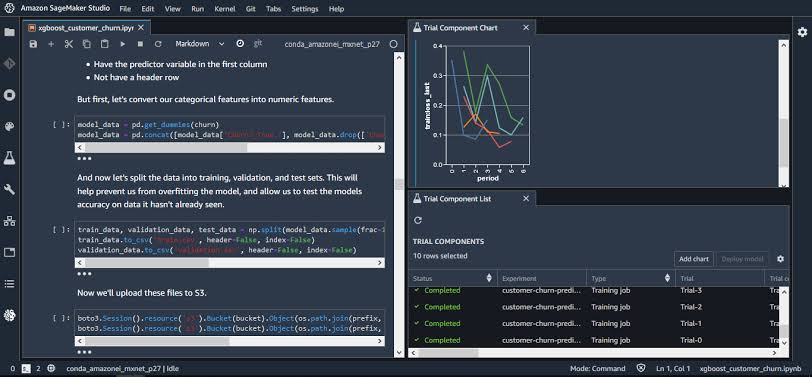

15. Amazon SageMaker (ideal para gerenciar ciclos de vida completos de ML na infraestrutura AWS)

via Amazon SageMaker

O SageMaker faz sentido se você já está no mundo da AWS e precisa de recursos de ML que funcionem perfeitamente com sua infraestrutura existente. Os notebooks gerenciados eliminam as dores de cabeça da configuração do servidor, enquanto os algoritmos integrados lidam com casos de uso comuns sem codificação personalizada.

O Ground Truth ajuda a criar conjuntos de dados de treinamento de alta qualidade por meio de fluxos de trabalho de anotação gerenciados, o que é particularmente valioso quando são necessários rotuladores humanos para dados de imagem ou texto.

Quando os modelos estão prontos para produção, o SageMaker lida com as complexidades da implantação, como balanceamento de carga e dimensionamento automático. Tudo é cobrado através da sua conta AWS existente, simplificando o gerenciamento de custos.

Melhores recursos do Amazon SageMaker

- Treine modelos usando uma infraestrutura gerenciada que provisiona recursos automaticamente com base no tamanho do conjunto de dados e nos requisitos computacionais.

- Implante modelos por meio de pontos de extremidade escaláveis que lidam com picos de tráfego e ajustam automaticamente a capacidade de computação com base na demanda.

- Otimize o desempenho do modelo usando o ajuste automático de hiperparâmetros, que testa milhares de combinações para encontrar as configurações ideais.

- Monitore modelos de produção usando a integração com o CloudWatch, que rastreia métricas de precisão de previsão, latência e qualidade de dados.

Limitações do Amazon SageMaker

- Sua estrutura de preços complexa pode levar a custos inesperados para uso em grande escala, uma vez que não é clara.

- Há uma curva de aprendizado envolvida para equipes que não estão familiarizadas com o ecossistema e os serviços da AWS.

- A interface da ferramenta pode ser lenta ou difícil de navegar devido a falhas.

- Usar o Amazon SageMaker dificulta a migração para outros provedores de nuvem.

Preços do Amazon SageMaker

- SageMaker Unified Studio: Gratuito

- Preços personalizados

Avaliações e comentários do Amazon SageMaker

- G2: 4,3/5 (45 avaliações)

- Capterra: Avaliações insuficientes

O que os usuários reais estão dizendo sobre o Amazon SageMaker?

De acordo com uma avaliação do G2:

O que mais gosto no Amazon SageMaker é sua capacidade de gerenciar todo o ciclo de vida do aprendizado de máquina em uma plataforma integrada. Ele simplifica a construção, o treinamento e a implantação de modelos, ao mesmo tempo em que oferece escalabilidade e ferramentas poderosas, como o SageMaker Studio e o ajuste automatizado de modelos.

O que mais gosto no Amazon SageMaker é sua capacidade de gerenciar todo o ciclo de vida do aprendizado de máquina em uma plataforma integrada. Ele simplifica a construção, o treinamento e a implantação de modelos, ao mesmo tempo em que oferece escalabilidade e ferramentas poderosas, como o SageMaker Studio e o ajuste automatizado de modelos.

💡 Dica profissional: Não treine o que você não pode estruturar. Antes de passar para o ajuste fino, pergunte: Isso pode ser resolvido com lógica estruturada e um modelo básico? Por exemplo, em vez de treinar um modelo para detectar tipos de faturas, adicione primeiro um classificador simples que filtre com base em metadados.

Otimize seu fluxo de trabalho com o ClickUp

Existem inúmeras alternativas ao Hugging Face, mas por que se limitar a modelos e APIs?

O ClickUp eleva o nível.

Com o ClickUp Brain e o Brain MAX, você pode escrever mais rápido, resumir coisas em segundos e executar automações que entendem você. Ele está integrado às suas tarefas, documentos e bate-papos, para que você nunca precise alternar entre ferramentas ou guias.

Inscreva-se no ClickUp e veja por que ele é a alternativa mais inteligente ao Hugging Face! ✅