Połączyłeś API, skonfigurowałeś boty Slacka i błagałeś ChatGPT, aby zachowywał się jak członek zespołu.

Jednak bez rzeczywistego kontekstu sztuczna inteligencja tylko zgaduje. Przestaje działać, gdy zmieniają się narzędzia, i generuje błędne wyniki, gdy dane nie są jasno zdefiniowane lub dostępne.

Protokół kontekstowy modelu (MCP) zmienia tę sytuację. Tworzy język udostępniany między modelem a stosem: ustrukturyzowany, kontekstowy i skalowalny. MCP pozwala zaprzestać dostarczania AI, która zachowuje się inteligentnie, i zacząć tworzyć AI, która jest inteligentna.

W tym wpisie na blogu szczegółowo omówimy protokół MCP i sposoby jego wdrożenia. Ponadto przyjrzymy się, w jaki sposób ClickUp może służyć jako alternatywa dla protokołów MCP. Zapraszamy do lektury! 🤖

Czym jest protokół kontekstowy modelu?

Protokół kontekstu modelu to struktura lub wytyczne służące do definiowania, organizowania i przekazywania kluczowych elementów/kontekstu (podpowiedzi, historii rozmów, stanów narzędzi, metadanych użytkowników itp. ) do dużych modeli językowych (LLM).

Przedstawiono w nim czynniki zewnętrzne wpływające na model, takie jak:

- Kto będzie korzystał z modelu (interesariusze)

- Dlaczego tworzony jest model (cele)

- Gdzie i jak zostanie zastosowany (przykłady zastosowań, środowiska)

- Jakie ograniczenia istnieją (techniczne, etyczne, czasowe itp.)?

- Jakie założenia przyjęto dotyczące rzeczywistego kontekstu

Mówiąc prościej, protokół ten przygotowuje scenę pod skuteczne działanie modelu i zapewnia, że jest on technicznie sprawny, odpowiedni i użyteczny w scenariuszu, dla którego został stworzony.

Kluczowe elementy MCP obejmują:

- Kryteria walidacji: Opisuje, w jaki sposób model będzie testowany lub oceniany pod kątem dokładności i użyteczności

- Cel: Jasno określa, co model ma reprezentować lub rozwiązywać

- Zakres: Określa granice modelu, np. co jest uwzględnione, a co wykluczone

- Kluczowe pojęcia i zmienne: Określa główne komponenty, jednostki lub zmienne, które uwzględnia model

- Powiązania i założenia: Wyjaśnia, w jaki sposób koncepcje oddziałują na siebie i jakie założenia leżą u podstaw modelu

- Struktura: Opisuje format modelu (np. diagram, równania matematyczne, symulacje)

MCP a LangChain

LangChain to przyjazna dla programistów platforma do tworzenia aplikacji wykorzystujących agenty LLM. Z kolei MCP to protokół, który standaryzuje sposób dostarczania kontekstu do modeli w różnych systemach.

LangChain pomaga w tworzeniu, a MCP ułatwia komunikację między systemami. Przyjrzyjmy się bliżej różnicom między nimi.

| Funkcja | LangChain | Modele MCP |

| Skup się | Tworzenie aplikacji z wykorzystaniem modeli LLM | Standaryzacja kontekstu LLM i interakcji narzędzi |

| Narzędzia | Łańcuchy, agenci, pamięć, moduły pobierające dane | Protokół umożliwiający modelom LLM dostęp do narzędzi, danych i kontekstu |

| Skalowalność | Modułowy, skalowalny dzięki komponentom | Stworzony z myślą o wdrożeniach na dużą skalę, obejmujących wielu agentów |

| Przykłady zastosowań | Chatboty, systemy generowania wspomaganego wyszukiwaniem (RAG), automatyzacja zadań | Koordynacja AI w Enterprise, systemy wielomodelowe |

| Interoperacyjność | Limitowane do narzędzi ekosystemu | Wysoka, umożliwia przełączanie modeli i narzędzi |

Chcesz zobaczyć, jak w praktyce wyglądają automatyzacje oparte na MCP?

Zapoznaj się z przewodnikiem ClickUp dotyczącym automatyzacji przepływu pracy AI, który pokazuje, w jaki sposób różne zespoły, od marketingu po inżynierię, konfigurują dynamiczne, złożone przepływy pracy, które odzwierciedlają zalety protokołu kontekstowego modelu w zakresie interakcji w czasie rzeczywistym.

MCP a RAG

Zarówno RAG, jak i MCP wzbogacają modele LLM o wiedzę zewnętrzną, ale różnią się pod względem czasu i interakcji.

Podczas gdy RAG pobiera informacje przed wygenerowaniem odpowiedzi przez model, MCP umożliwia modelowi żądanie danych lub wyzwalanie narzędzi podczas generowania poprzez standardowy interfejs. Porównajmy oba rozwiązania.

| Funkcja | RAG | MCP |

| Skup się | Wstępne pobieranie odpowiednich informacji w celu generowania odpowiedzi | Interakcja między narzędziami/danymi w czasie rzeczywistym, w trakcie procesu |

| Mechanizm | Najpierw pobiera dane zewnętrzne, a następnie generuje | Żądania kontekstu podczas generowania |

| Najlepsze dla | Statyczne lub częściowo ustrukturyzowane bazy wiedzy, systemy kontroli jakości | Narzędzia działające w czasie rzeczywistym, API, bazy danych zintegrowane z narzędziami |

| Ograniczenia | Ograniczone przez czas pobierania i okno kontekstowe | Opóźnienia spowodowane przeskokami protokołu |

| Integracja | Tak, wyniki RAG można osadzić w warstwach kontekstowych MCP | Tak, może on zawrzeć RAG w MCP, aby uzyskać bogatsze przepływy |

Jeśli tworzysz hybrydę RAG + MCP, zacznij od czystego systemu zarządzania wiedzą w ClickUp.

Możesz zastosować szablon bazy wiedzy ClickUp, aby konsekwentnie organizować swoją zawartość. Pomaga to agentom AI w uzyskiwaniu dokładnych, aktualnych informacji bez konieczności przeszukiwania nieuporządkowanych danych.

MCP a agenci AI

Podczas gdy MCP jest interfejsem, różne typy agentów AI pełnią rolę podmiotów.

Modele MCP standaryzują sposób, w jaki agenci uzyskują dostęp do narzędzi, danych i kontekstu, działając jak uniwersalne złącze. Agenci AI wykorzystują ten dostęp do podejmowania decyzji, wykonywania zadań i samodzielnego działania.

| Funkcja | MCP | Agenci AI |

| Rola | Standardowy interfejs dostępu do narzędzi/danych | Autonomiczne systemy wykonujące zadania |

| Funkcja | Działa jako pomost między modelami a systemami zewnętrznymi | Wykorzystuje serwery MCP do uzyskiwania dostępu do kontekstu, narzędzi i podejmowania decyzji |

| Przykład zastosowania | Połączenie systemów AI, baz danych, interfejsów API, kalkulatorów | Pisanie kodu, podsumowywanie danych, zarządzanie cyklem pracy |

| Zależność | Niezależna warstwa protokołu | Często polega na MCP w celu uzyskania dynamicznego dostępu do narzędzi |

| Powiązania | Umożliwia funkcję opartą na kontekście | Wykonuje zadania przy użyciu kontekstu i możliwości dostarczanych przez MCP |

❗️Jak wygląda posiadanie agenta AI, który rozumie całą Twoją pracę? Zobacz tutaj. 👇🏼

⚙️ Bonus: Potrzebujesz pomocy w ustaleniu, kiedy używać RAG, MCP lub połączenia obu tych rozwiązań? To szczegółowe porównanie RAG, MCP i agentów AI zawiera wszystkie niezbędne informacje wraz z diagramami i przykładami.

Dlaczego kontekst ma znaczenie w modelach AI

W nowoczesnych systemach AI kontekst ma fundamentalne znaczenie. Kontekst pozwala generatywnym modelom AI interpretować intencje użytkownika, wyjaśniać dane wejściowe i dostarczać wyniki, które są dokładne, trafne i przydatne. Bez niego modele mają halucynacje, błędnie interpretują podpowiedzi i generują niewiarygodne wyniki.

W rzeczywistości kontekst pochodzi z różnych źródeł: rekordów CRM, historii Git, logów czatów, wyników API i innych.

Przed wprowadzeniem MCP integracja tych danych z cyklami pracy AI wymagała pisania niestandardowych łączników dla każdego systemu [rozproszone, podatne na błąd i nieskalowalne podejście].

MCP rozwiązuje ten problem, umożliwiając modelom AI ustrukturyzowany, czytelny dla maszyn sposób uzyskiwania dostępu do informacji kontekstowych, niezależnie od tego, czy są to historia wpisów użytkownika, fragmenty kodu, dane biznesowe czy funkcjonalność narzędzia.

Ten znormalizowany dostęp ma kluczowe znaczenie dla rozumowania agenta, umożliwiając agentom AI planowanie i inteligentne działanie w oparciu o aktualne, istotne dane.

Ponadto, gdy kontekst jest skutecznie udostępniany, wydajność AI poprawia się we wszystkich obszarach:

- Bardziej trafne odpowiedzi w zadaniach językowych, kodowych i multimodalnych

- Mniej halucynacji i błędów dzięki ugruntowaniu danych w czasie rzeczywistym

- Lepsza pamięć i przepływ podczas długich rozmów lub wykonywania złożonych zadań

- Uproszczona integracja z narzędziami, dzięki czemu agenci mogą ponownie wykorzystywać dane i działania za pośrednictwem standardowych interfejsów

Oto przykład tego, jak ClickUp AI rozwiązuje tę lukę kontekstową, bez konieczności zajmowania się rozbudowanymi cyklami pracy MCP lub kodowaniem. Zajmiemy się tym!

💡 Wskazówka dla profesjonalistów: Aby pogłębić swoją wiedzę, dowiedz się , jak korzystać z agentów opartych na wiedzy w AI w celu pobierania i wykorzystywania danych dynamicznych.

Jak działa protokół kontekstu modelu?

MCP działa w architekturze klient-serwer, gdzie aplikacje AI (klienci) proszą o narzędzia, dane lub działania z zewnętrznych systemów (serwerów). Oto szczegółowy opis tego, jak MCP działa w praktyce. ⚒️

🧩 Nawiązywanie połączenia

Kiedy aplikacja AI (taka jak Claude lub Cursor) uruchamia się, inicjuje klientów MCP, którzy łączą się z jednym lub kilkoma serwerami MCP. Te wydarzenia wysyłane przez serwer mogą reprezentować wszystko, od API pogody po narzędzia wewnętrzne, takie jak systemy CRM.

🧠 Ciekawostka: Niektóre serwery MCP umożliwiają agentom odczytywanie sald tokenów, sprawdzanie NFT, a nawet wyzwalacze inteligentnych kontraktów w ponad 30 sieciach blockchain.

👀 Odkrywanie narzędzi i możliwości

Po nawiązaniu połączenia klient wykrywa możliwości, pytając każdy serwer: Jakie narzędzia, zasoby lub podpowiedzi udostępniasz?

Serwer odpowiada listą swoich możliwości, która jest rejestrowana i udostępniana modelowi AI do wykorzystania w razie potrzeby.

📮 ClickUp Insight: 13% respondentów naszej ankiety chce wykorzystywać AI do podejmowania trudnych decyzji i rozwiązywania złożonych problemów. Jednak tylko 28% twierdzi, że regularnie korzysta ze sztucznej inteligencji w pracy.

Możliwy powód: obawy dotyczące bezpieczeństwa! Użytkownicy mogą nie chcieć udostępniać poufnych danych dotyczących podejmowania decyzji zewnętrznej sztucznej inteligencji. ClickUp rozwiązuje ten problem, przenosząc rozwiązywanie problemów oparte na sztucznej inteligencji bezpośrednio do bezpiecznego obszaru roboczego. Od SOC 2 po normy ISO, ClickUp jest zgodny z najwyższymi standardami bezpieczeństwa danych i pomaga w bezpiecznym korzystaniu z generatywnej technologii sztucznej inteligencji w całym obszarze roboczym.

🧠 Rozpoznawanie potrzeby kontekstu zewnętrznego

Gdy użytkownik wprowadza dane (np. Jaka jest pogoda w Chicago?), model AI analizuje żądanie i zdaje sobie sprawę, że wymaga ono zewnętrznych danych w czasie rzeczywistym, które nie są dostępne w jego zestawie szkoleniowym.

Model wybiera odpowiednie narzędzie spośród dostępnych funkcji MCP, takich jak serwis pogodowy, a klient przygotowuje żądanie dla tego serwera.

🔍 Czy wiesz, że... MCP czerpie inspirację z protokołu Language Server Protocol (LSP), rozszerzając tę koncepcję na autonomiczne przepływy pracy AI. Takie podejście pozwala agentom AI dynamicznie odkrywać i łączyć narzędzia, promując elastyczność i skalowalność w środowiskach rozwoju systemów AI.

✅ Wykonywanie i obsługa odpowiedzi

Klient wysyła żądanie do serwera MCP, określając:

- Narzędzie do wywołania

- Parametry (np. lokalizacja, data)

Serwer MCP przetwarza żądanie, wykonuje wymaganą czynność (np. pobieranie danych pogodowych) i zwraca wynik w formacie nadającym się do odczytu maszynowego. Klient AI integruje zwrócone informacje.

Następnie model generuje odpowiedź na podstawie nowych danych i pierwotnej podpowiedzi.

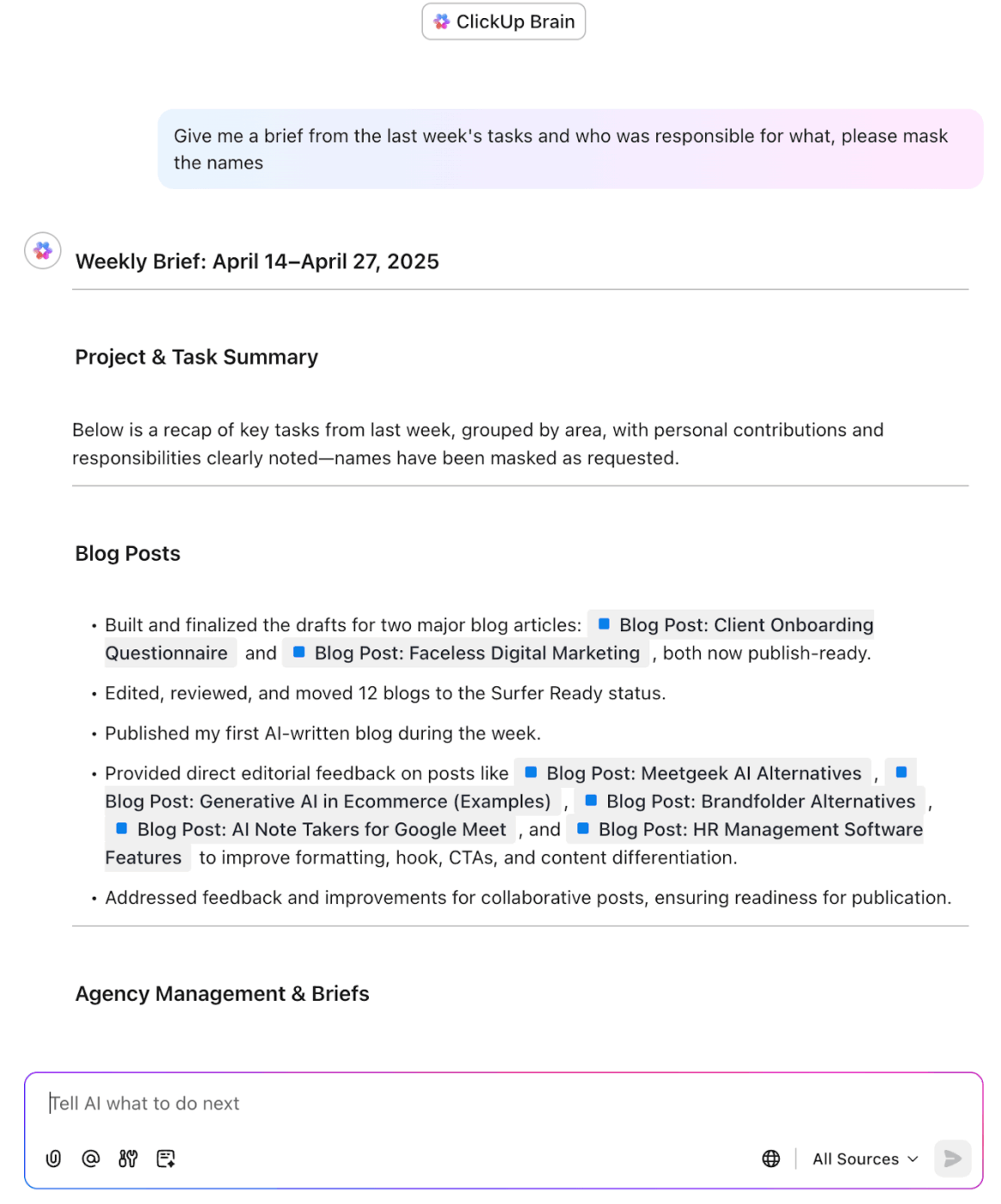

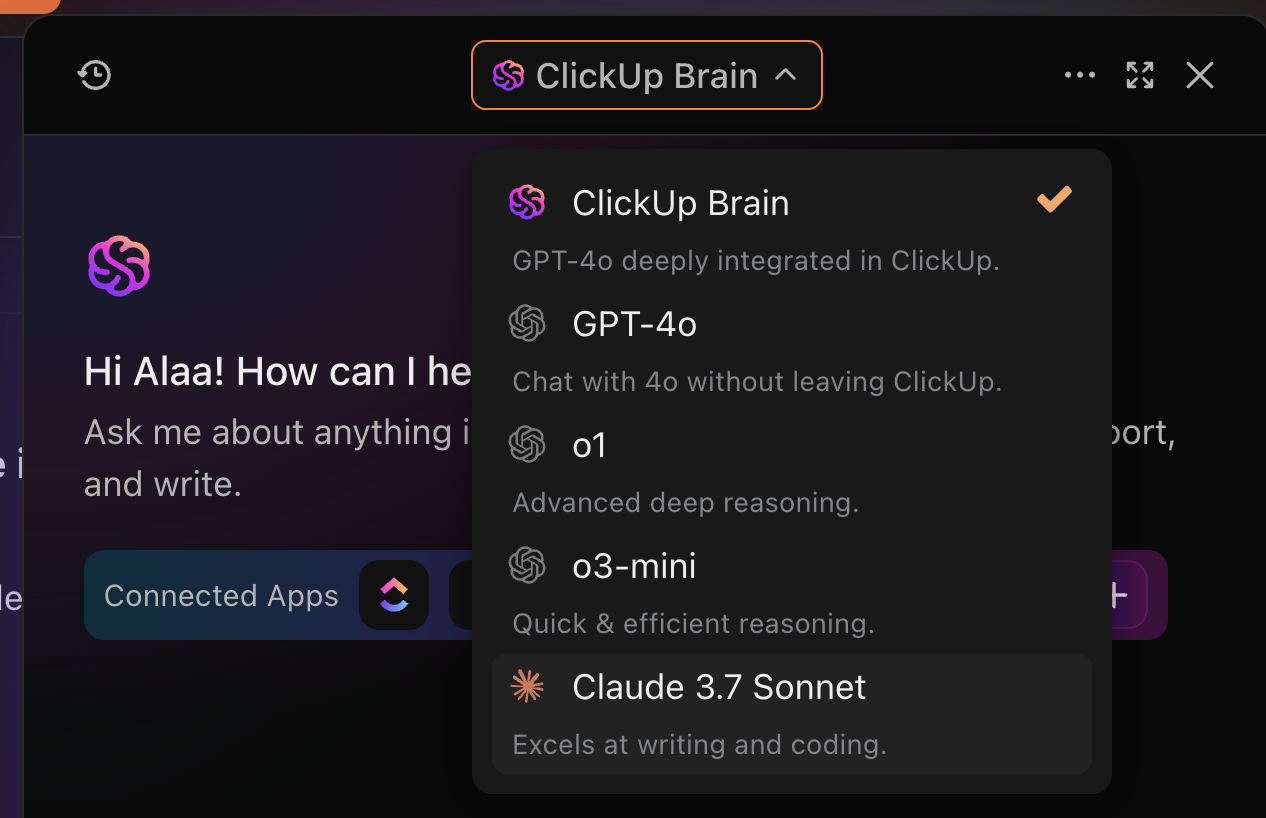

Pobieraj informacje ze swojego obszaru roboczego za pomocą ClickUp Brain

💟 Bonus: Spotkanie Brain MAX, samodzielny komputerowy towarzysz AI od ClickUp, który oszczędza Ci kłopotu tworzenia od podstaw własnych niestandardowych cykli pracy MCP. Zamiast łączyć dziesiątki narzędzi i integracji, Brain MAX jest wstępnie skonfigurowany i gotowy do użycia, łącząc całą Twoją pracę, aplikacje i modele AI w jednej potężnej platformie.

Dzięki głębokiej integracji z obszarem roboczym, funkcji zamiany głosu na tekst zapewniającej wydajność bez użycia rąk oraz wysoce trafnym, dostosowanym do roli odpowiedziom, Brain MAX zapewnia kontrolę, automatyzację i inteligencję, jakich można oczekiwać od rozwiązania tworzonego na zamówienie — bez konieczności ustawień lub konserwacji. To wszystko, czego potrzebujesz do zarządzania, automatyzacji i przyspieszenia pracy, bezpośrednio z pulpitu!

Typowe wyzwania związane z zarządzaniem kontekstem w AI

Zarządzanie kontekstem w systemach AI ma kluczowe znaczenie, ale nie jest to zadanie proste.

Większość modeli AI, niezależnie od architektury lub narzędzi, napotyka szereg typowych przeszkód, które limitują ich zdolność do dokładnego i spójnego rozumowania. Przeszkody te obejmują:

- limit tokenów i krótkie okna kontekstowe* ograniczają ilość istotnych informacji, które AI może uwzględnić jednocześnie, co często prowadzi do niekompletnych lub płytkich odpowiedzi

- Fragmentarne źródła danych utrudniają zebranie odpowiedniego kontekstu, zwłaszcza gdy informacje są rozproszone w różnych bazach danych, aplikacjach i formatach

- Brak pamięci długotrwałej między sesjami zmusza użytkowników do powtarzania informacji, co zakłóca ciągłość zadań wieloetapowych

- Niejasności w danych wprowadzanych przez użytkownika, zwłaszcza w rozmowach wieloetapowych, mogą dezorientować /AI/ bez jasnego kontekstu historycznego

- Opóźnienia i koszty stają się problemem podczas pobierania danych szkoleniowych w czasie rzeczywistym lub kontekstu z systemów zewnętrznych

- Brak standardowego sposobu udostępniania lub utrzymywania kontekstu między narzędziami i zespołami często prowadzi do powielania, niespójności i limitowanej współpracy

Problemy te wskazują na potrzebę standaryzacji i usprawnienia zarządzania kontekstem, co jest celem protokołów MCP.

🔍 Czy wiesz, że... Zamiast wysyłać komendy bezpośrednio, moduły subskrybują odpowiednie strumienie danych. Oznacza to, że noga robota może po prostu biernie nasłuchiwać aktualizacji dotyczących równowagi i wkraczać do akcji tylko wtedy, gdy jest to konieczne.

Protokół kontekstu modelu w praktyce

MCP ułatwia integrację różnych źródeł informacji, zapewniając precyzyjne i odpowiednie kontekstowo odpowiedzi /AI.

Poniżej znajduje się kilka praktycznych przykładów pokazujących, jak protokół MCP można zastosować w różnych scenariuszach. 👇

1. Współpilotzy oparci na AI

Jedną z najczęściej używanych aplikacji AI copilots jest GitHub Copilot, asystent AI, który pomaga programistom w pisaniu i debugowaniu kodu.

Kiedy programista pisze funkcję, Copilot potrzebuje dostępu do:

- Historia kodu: Sztuczna inteligencja pobiera kontekst bieżącego kodu, aby zasugerować odpowiednie zakończone kodu

- Biblioteki zewnętrzne: Copilot wysyła zapytanie dotyczące najnowszych wersji bibliotek lub frameworków, zapewniając zgodność kodu z najnowszymi wersjami

- Dane w czasie rzeczywistym: Jeśli programista poprosi o aktualizację konwencji kodowania lub praktyki obsługi błędów, Copilot pobierze najnowszą dokumentację

🧠 Ciekawostka: MCP Guardian działa jak bramkarz przy korzystaniu z narzędzi AI. Sprawdza tożsamość, blokuje podejrzane żądania i rejestruje wszystko. Ponieważ otwarty dostęp do narzędzi AI = chaos w zakresie bezpieczeństwa.

2. Wirtualni asystenci

Wirtualni asystenci, tacy jak Google Assistant lub Amazon Alexa, opierają się na kontekście, aby dostarczać sensowne odpowiedzi. Na przykład:

- Poprzednie rozmowy: Asystent Google zapamiętuje poprzednie zapytania, takie jak preferencje dotyczące podróży, i odpowiednio dostosowuje swoje odpowiedzi, gdy pytasz o opcje lotów lub rezerwacje hotelowe

- Narzędzia zewnętrzne: wysyła zapytania do zewnętrznych API (np. agregatorów lotów, takich jak Skyscanner) w celu uzyskania informacji w czasie rzeczywistym o dostępnych lotach

📖 Przeczytaj również: Jak korzystać z podpowiedzi łańcucha myśli (z przykładami)

3. Systemy zarządzania wiedzą

Narzędzia do zarządzania danymi oparte na AI, takie jak IBM Watson, pomagają organizacjom odzyskiwać kluczowe informacje z ogromnych baz danych lub repozytorium dokumentów:

- Kontekst wyszukiwania: IBM Watson wykorzystuje modele MCP do analizowania poprzednich zapytań wyszukiwania i dostosowywania wyników na podstawie preferencji użytkownika i historii wyszukiwania

- Repozytoria zewnętrzne: Watson może przeprowadzać zapytania w repozytoriach zewnętrznych (np. bazy wiedzy, prace badawcze lub dokumentację firmową) w celu uzyskania najdokładniejszych i najbardziej trafnych informacji

- Spersonalizowane rekomendacje: Na podstawie interakcji użytkownika Watson może sugerować odpowiednie dokumenty, często zadawane pytania lub materiały szkoleniowe dostosowane do roli użytkownika lub bieżących projektów

Organizuj, filtruj i przeszukuj wiedzę swojej firmy za pomocą ClickUp Enterprise Search

🪄 Zalety ClickUp: Stwórz zweryfikowaną, ustrukturyzowaną bazę wiedzy w ClickUp Dokumenty i udostępnij ją za pośrednictwem ClickUp Knowledge Management jako źródło kontekstu dla bramy MCP. Wzbogać dokumenty o bogatą zawartość i multimedia, aby uzyskać precyzyjne, spersonalizowane rekomendacje AI z centralnego źródła.

4. Opieka zdrowotna

W przestrzeni opieki zdrowotnej platformy takie jak Babylon Health zapewniają wirtualne konsultacje z pacjentami. Systemy AI w dużym stopniu opierają się na kontekście:

- *historia pacjenta: /AI musi mieć dostęp do dokumentacji pacjenta, objawów i poprzednich konsultacji, aby podejmować świadome decyzje

- Zewnętrzne dane medyczne: Może pobierać dane medyczne w czasie rzeczywistym (np. najnowsze badania dotyczące objawów lub metod leczenia), aby oferować dokładniejsze porady zdrowotne

- Dynamiczne reakcje: Jeśli objawy pacjenta ulegną zmianie, AI wykorzystuje protokół MCP do aktualizacji swojej bazy wiedzy i odpowiedniego dostosowania sugestii dotyczących leczenia

🔍 Czy wiesz, że... Większość protokołów MCP nie została zaprojektowana z myślą o bezpieczeństwie, co sprawia, że są one podatne na zagrożenia w scenariuszach, w których symulacje lub systemy robotyczne są połączone w sieć.

Jak wdrożyć protokół kontekstu modelu

Wdrożenie protokołu kontekstu modelu pozwala aplikacji AI na interakcję z zewnętrznymi narzędziami, usługami i źródłami danych w sposób modułowy i znormalizowany.

Oto przewodnik krok po kroku dotyczący ustawienia. 📋

Krok 1: Zdefiniuj narzędzia, zasoby i moduły obsługi

Zacznij od podjęcia decyzji, jakie narzędzia i zasoby będzie oferował Twój serwer MCP:

- Narzędzia to działania, które może wykonać serwer (np. wywołanie API pogody, uruchomienie zapytania SQL)

- Zasoby to dane statyczne lub dynamiczne (np. dokumenty, pliki konfiguracyjne, bazy danych)

- Dla każdego narzędzia zdefiniuj: Schemat danych wejściowych (np. wymagane pola, takie jak miasto, zapytanie itp.) Format danych wyjściowych (np. ustrukturyzowany JSON-RPC) Odpowiednią metodę gromadzenia danych wejściowych

- Schemat wprowadzania danych (np. wymagane pola, takie jak miasto, zapytanie itp.)

- Format wyjściowy (np. ustrukturyzowany JSON-RPC)

- Odpowiednia metoda gromadzenia danych w celu zebrania informacji wejściowych

- Schemat wprowadzania danych (np. wymagane pola, takie jak miasto, zapytanie itp.)

- Format wyjściowy (np. ustrukturyzowany JSON-RPC)

- Odpowiednia metoda gromadzenia danych w celu zebrania informacji wejściowych

Następnie wdroż handlery. Są to funkcje, które przetwarzają przychodzące żądania narzędzi od klienta:

- Sprawdź dane wejściowe, aby upewnić się, że są zgodne z oczekiwanym formatem

- Uruchom podstawową logikę (np. pobieranie danych z API, przetwarzanie danych)

- Formatuj i zwróć wyniki do wykorzystania przez klienta

📌 Przykład: Narzędzie do podsumowywania dokumentów może sprawdzić typ pliku wejściowego (np. PDF lub DOCX), wyodrębnić tekst za pomocą parsera plików, przekazać zawartość przez model lub usługę podsumowującą i zwrócić zwięzłe podsumowanie wraz z kluczowymi tematami.

💡 Porada dla profesjonalistów: Skonfiguruj detektory zdarzeń, które są wyzwalaczami określonych narzędzi po wykonaniu określonych czynności, takich jak przesłanie danych przez użytkownika lub aktualizacja bazy danych. Nie ma potrzeby, aby narzędzia działały w tle, gdy nic się nie dzieje.

Krok 2: Zbuduj lub skonfiguruj serwer MCP

Użyj frameworka takiego jak FastAPI, Flask lub Express, aby udostępnić swoje narzędzia i zasoby jako punkty końcowe HTTP lub usługi WebSocket.

Ważne jest, aby:

- Zastosuj spójną strukturę punktów końcowych dla wszystkich narzędzi (np. /invoke/summarize-document)

- Zwracaj odpowiedzi JSON o przewidywalnej strukturze, aby klienci mogli z łatwością z nich korzystać

- Zgrupuj funkcje pod punktem końcowym /capabilities, aby klienci mogli odkrywać dostępne narzędzia

💡 Porada dla profesjonalistów: Traktuj kontekst jak kod. Za każdym razem, gdy zmieniasz jego strukturę, twórz nową wersję. Używaj znaczników czasu lub skrótów commit, aby móc przywrócić poprzednią wersję bez problemów.

Krok 3: Skonfiguruj klienta MCP

Klient MCP jest częścią systemu AI (np. Claude, Cursor lub niestandardowy agent), który komunikuje się z serwerem.

Po uruchomieniu klient łączy się z serwerem MCP i pobiera dostępne funkcje (narzędzia/zasoby) za pośrednictwem punktu końcowego /capabilities. Następnie rejestruje te narzędzia do użytku wewnętrznego, aby model mógł zdecydować, które narzędzie wywołać podczas sesji.

💡 Wskazówka dla profesjonalistów: Wprowadź niewidoczne metadane do kontekstu, takie jak oceny wiarygodności narzędzi lub sygnatury czasowe. Narzędzia mogą wykorzystać te informacje do podejmowania mądrzejszych decyzji, np. pomijania nieaktualnych danych lub zwiększania wydajności wyników pochodzących z wiarygodnych źródeł.

Krok 4: Przeprowadź testy z klientem kompatybilnym z MCP

Przed uruchomieniem przetestuj zdalny serwer MCP z rzeczywistym klientem AI:

- Skorzystaj z narzędzia takiego jak Claude Pulpit, które oferuje wsparcie dla protokołu MCP od razu po uruchomieniu

- Wypróbuj typowe przypadki użycia (np. zapytaj Claude'a o dzisiejszą pogodę), aby potwierdzić, że: Dane wejściowe są prawidłowo weryfikowane Wywołane jest właściwe narzędzie Odpowiedzi są zwracane w odpowiednim formacie

- Dane wejściowe są prawidłowo weryfikowane

- Wywołane zostało właściwe narzędzie

- Odpowiedzi są zwracane w odpowiednim formacie

- Dane wejściowe są prawidłowo weryfikowane

- Wywołane zostało właściwe narzędzie

- Odpowiedzi są zwracane w odpowiednim formacie

Pomaga to zapewnić płynną integrację z narzędziami biznesowymi i zapobiega błędom wykonania w środowisku produkcyjnym.

Krok 5: Dodaj zabezpieczenia, uprawnienia i możliwość obserwacji

Aby chronić wrażliwe narzędzia lub dane:

- Zastosuj podpowiedzi o pozwolenie przed uzyskaniem dostępu do krytycznych narzędzi lub zasobów osobistych

- Dodaj rejestrowanie, monitorowanie i ograniczenie szybkości, aby umożliwić śledzenie wykorzystania i wykrywanie anomaliów

- Wykorzystaj zakresy lub role użytkowników, aby limitować dostęp do narzędzi

- Zbuduj warstwę pamięci lub stanu, aby przechowywać poprzednie wyniki i zachować ciągłość

- Przeprowadź testy pod obciążeniem i monitoruj wskaźniki wydajności (opóźnienia, wskaźnik powodzenia itp.)

W ten sposób można zbudować potężne, elastyczne systemy AI, które w sposób przejrzysty skalują dostęp do kontekstu bez konieczności pisania niestandardowych integracji dla każdego narzędzia lub przypadku użycia.

Ograniczenia modeli MCP

Chociaż protokoły kontekstowe modelu rozwiązują kluczowe wyzwania związane z udostępnianiem kontekstu, wiążą się one z pewnymi kompromisami:

- Zależność od narzędzi: MCP wymaga kompatybilnych serwerów i narzędzi. Trudno zintegrować starsze wersje systemów i niestandardowe interfejsy API

- złożoność ustawień: *Wstępne ustawienia, definiowanie narzędzi i pisanie procedur obsługi wymaga wysiłku technicznego, co stanowi wyzwanie dla nowych zespołów

- Opóźnienia: Każde zewnętrzne połączenie powoduje opóźnienia w odpowiedzi, zwłaszcza w przypadku łączenia wielu narzędzi

- Kwestie bezpieczeństwa: Ujawnianie narzędzi i źródeł danych zwiększa powierzchnię ataku. Precyzyjna kontrola dostępu i rejestrowanie audytowe pozostają niedopracowane

- Ograniczona koordynacja między wieloma serwerami: Łączenie kontekstu między serwerami nie jest płynne, co prowadzi do fragmentarycznych lub niespójnych wyników

Jak ClickUp AI może służyć jako alternatywa dla protokołów kontekstowych modeli

Protokoły kontekstowe modelu zapewniają systemom AI ustrukturyzowany sposób pobierania kontekstu zewnętrznego poprzez standardowe wywołania. Jednak budowanie i utrzymywanie tych systemów może być skomplikowane, zwłaszcza w środowiskach zespołów współpracujących.

ClickUp stosuje inne podejście. Osadza kontekst bezpośrednio w Twoim obszarze roboczym, gdzie faktycznie odbywa się praca. Dzięki temu ClickUp stanowi warstwę ulepszeń i głęboko zintegrowany system agencjalny zoptymalizowany dla zespołów.

Zrozumiemy to lepiej. 📝

Budowanie pamięci w obszarze roboczym

Sercem możliwości AI ClickUp jest ClickUp Brain, silnik rozpoznający kontekst, który działa jak wbudowany system pamięci.

W przeciwieństwie do tradycyjnych protokołów MCP, które opierają się na płytkiej historii podpowiedzi lub zewnętrznych bazach danych, Brain rozumie strukturę Twojego obszaru roboczego i zapamiętuje kluczowe informacje dotyczące zadań, komentarzy, osi czasu i dokumentów. Potrafi:

- Zidentyfikuj wąskie gardła na podstawie historycznych opóźnień i przeszkód

- Odpowiadaj na zapytania dotyczące konkretnych ról, takie jak „Kto jest właścicielem tego?” lub „Czy dział kontroli jakości to sprawdził?”

- Zamień notatki ze spotkań w uporządkowane zadania zakończone przypisanymi obowiązkami i terminami

📌 Przykład: Poproś Brain o „Podsumowanie postępów w kampaniach marketingowych w drugim kwartale”, a program odniesie się do powiązanych zadań, statusów i komentarzy w różnych projektach.

Automatyzacja odpowiedzi, przypisywania zadań i działań

Podczas gdy wdrożenia MCP wymagają ciągłego dostosowywania modelu, ClickUp, jako oprogramowanie do automatyzacji zadań, łączy proces podejmowania decyzji i ich realizacji w jednym systemie.

Dzięki ClickUp Automations możesz jako wyzwalacz używać zdarzeń, warunków i logiki bez pisania ani jednej linii kodu. Możesz również użyć ClickUp Brain do tworzenia niestandardowych automatyzacji wprowadzania danych za pomocą języka naturalnego, co ułatwia tworzenie spersonalizowanych przepływów pracy.

Wykorzystaj ClickUp Brain do tworzenia niestandardowych wyzwalaczy za pomocą ClickUp Automatyzacji

📌 Przykład: Przenieś zadania do W trakcie realizacji, gdy zmieni się ich status, przypisz kierownika zespołu, gdy zostaną oznaczone jako Wysoki priorytet, i powiadom właściciela projektu, jeśli termin zostanie przekroczony.

📖 Przeczytaj również: Przewodnik po automatyzacji w ClickUp (z przykładami zastosowań)

Opierając się na tych podstawach, agenci ClickUp Autopilot wprowadzają nowy poziom inteligentnej autonomii. Ci agenci oparci na sztucznej inteligencji działają w oparciu o:

- Wyzwalacze (np. aktualizacje zadań, wzmianki na czacie)

- Warunki (np. wiadomość zawiera słowo pilne)

- Działania (np. podsumowanie wątku, przypisanie zadania, wysłanie powiadomienia)

- Narzędzia (np. publikowanie postów w kanałach, aktualizowanie pól)

- Wiedza (np. wewnętrzne dokumenty, zadania, formularze i historia czatów)

Przekształcanie informacji w kontekst, który można wykorzystać w praktyce

ClickUp, jako agent AI, wykorzystuje istniejące dane z obszaru roboczego, aby działać inteligentniej bez konieczności ustawień. Oto jak można przekształcić wszystkie informacje z obszaru roboczego w kontekst gotowy do działania:

- Zadania i podzadania: Przypisuj działania następcze, generuj podsumowania lub dostosowuj priorytety w ramach zadań ClickUp. Sztuczna inteligencja pobiera informacje bezpośrednio od osób przypisanych do zadań, terminów wykonania i komentarzy

- *dokumenty i wiki: Poproś AI o odwołanie się do wiedzy zespołu, podsumowanie dokumentacji lub wyodrębnienie kluczowych punktów podczas planowania za pomocą dokumentów

- Pola niestandardowe: Używaj własnych tagów, kategorii lub ocen, aby spersonalizować odpowiedzi. Sztuczna inteligencja interpretuje metadane, aby dostosować wyniki do języka używanego przez Twój zespół

- Komentarze i czat: Kontynuuj rozmowy w wątkach lub generuj działania na podstawie dyskusji

Zobacz, jak działają pola niestandardowe oparte na AI. 👇🏼

Przyszłość protokołów kontekstowych modeli

W miarę jak AI przechodzi od statycznych chatbotów do dynamicznych systemów wieloagentowych, rola protokołów MCP będzie stawać się coraz bardziej istotna. Wspierane przez takie znane firmy jak OpenAI i Anthropic, protokoły MCP zapewniają interoperacyjność między złożonymi systemami.

Jednak ta obietnica rodzi poważne pytania. 🙋

Na początek należy pamiętać, że większość obecnych wdrożeń MCP ma charakter demonstracyjny, wykorzystuje podstawowy transport studyjny, nie oferuje wsparcia protokołu HTTP i nie oferuje wbudowanego uwierzytelniania ani autoryzacji. To sprawia, że nie nadają się one do zastosowań w przedsiębiorstwach. Rzeczywiste przypadki użycia wymagają bezpieczeństwa, obserwowalności, niezawodności i elastycznego skalowania.

Aby wypełnić tę lukę, pojawiła się koncepcja MCP Mesh. Wykorzystuje ona sprawdzone wzorce sieci usług (takie jak te stosowane w mikrousługach) w infrastrukturze MCP. MCP Mesh pomaga również w zapewnieniu bezpiecznego dostępu, komunikacji, zarządzania ruchem, odporności i wykrywania na wielu rozproszonych serwerach.

Jednocześnie platformy oparte na sztucznej inteligencji, takie jak ClickUp, pokazują, że głęboko osadzone modele kontekstowe w aplikacjach mogą stanowić bardziej praktyczną alternatywę w środowiskach zorientowanych na pracę zespołową.

W przyszłości możemy spodziewać się pojawienia się architektur hybrydowych, torujących drogę dla agentów /AI, którzy są zarówno świadomi, jak i zdolni do działania.

Wymień protokoły na wydajność dzięki ClickUp

Protokół kontekstowy modelu standaryzuje sposób, w jaki AI może uzyskać dostęp do systemów zewnętrznych, ale wymaga złożonych ustawień technicznych.

Chociaż MCP jest potężnym narzędziem, wymaga ono ustawień technicznych, co wydłuża czas rozwoju, zwiększa koszty i stwarza wyzwania związane z bieżącą konserwacją.

ClickUp oferuje praktyczną alternatywę dzięki ClickUp Brain i automatyzacji wbudowanym bezpośrednio w Twoje środowisko pracy.

Rozumie on automatycznie kontekst zadania, dane projektu i intencje użytkownika. Dzięki temu ClickUp jest idealnym rozwiązaniem typu low-code dla zespołów, które potrzebują skalowalnej, kontekstowej AI bez dodatkowych nakładów inżynieryjnych.

✅ Zarejestruj się w ClickUp już dziś!