يعتقد معظم الناس أنهم مضطرون للاختيار بين استخدام أدوات الذكاء الاصطناعي القوية أو الحفاظ على خصوصية بياناتهم. لكن في الواقع يمكنك الحصول على كليهما. يعني تشغيل الذكاء الاصطناعي محليًا أن البيانات لا تغادر أجهزتك أبدًا. يمكنك الحفاظ على السيطرة الكاملة على معلوماتك مع الاستمرار في أتمتة المهام الأكثر تكرارًا.

يوضح لك هذا الدليل كيفية استخدام الذكاء الاصطناعي المحلي لتأمين سير العمل باستخدام أدوات مثل Ollama. ستتعلم كيفية اختيار النماذج مفتوحة المصدر التي تتناسب مع مواصفات أجهزتك المحددة. وإنشاء سير عمل آلي لمعالجة المستندات الخاصة محليًا.

سننظر أيضًا في مركزية سير العمل في مساحة موحدة مثل ClickUp. 😎

ما هو الذكاء الاصطناعي المحلي؟

يعني الذكاء الاصطناعي المحلي أنك تقوم بتشغيل نماذج اللغة الكبيرة (LLMs) بالكامل على أجهزتك الخاصة — مثل الكمبيوتر المحمول أو الخادم المحلي — بدلاً من إرسال بياناتك إلى خدمات سحابية خارجية. وهذا مناسب لأي فريق يتعامل مع معلومات حساسة، بدءًا من الهندسة وتصميم المنتجات وصولاً إلى الأقسام القانونية والمالية.

مع معظم أدوات الذكاء الاصطناعي المستندة إلى السحابة، تنتقل المطالبات والوثائق والبيانات الخاصة بك إلى خوادم تابعة لجهات خارجية. وبذلك تفقد السيطرة على كيفية معالجة تلك المعلومات أو تخزينها أو استخدامها.

على العكس من ذلك، يحافظ الذكاء الاصطناعي المحلي على بياناتك داخل بيئتك. وتظل أنت المتحكم الكامل في الأمان وحماية البيانات لسير عملك.

وبالطبع، هناك مقايضة. يتطلب إعداد الذكاء الاصطناعي المحلي مجهودًا تقنيًا أكبر واستثمارًا مسبقًا في الأجهزة. ومع ذلك، فإنه يلغي تمامًا اعتمادك على المزودين الخارجيين. وبفضل الاستدلال على الجهاز، تظل معلوماتك في المكان الذي تريده بالضبط.

لماذا يعد الذكاء الاصطناعي المحلي مهمًا لضمان أمان سير عمل الفريق

🔎 هل تعلم؟ واحد فقط من كل 10 مستهلكين على استعداد لمشاركة المعلومات الحساسة، مثل البيانات المالية أو بيانات الاتصالات أو البيانات البيومترية، مع الأنظمة التي تعمل بالذكاء الاصطناعي.

يعكس هذا التردد واقعًا متزايدًا يواجه فرق B2B. مع الذكاء الاصطناعي القائم على السحابة، فإنك تسلم في الأساس الملكية الفكرية لشركتك إلى طرف ثالث. بالنسبة لفرق الشؤون القانونية أو المالية أو الموارد البشرية، يخلق هذا مسؤولية قانونية هائلة.

يغير الذكاء الاصطناعي المحلي هذه الديناميكية من خلال نقل الذكاء الاصطناعي إلى أجهزتك الخاصة. وإليك سبب أهمية ذلك لعملياتك اليومية:

- القضاء على تسرب البيانات: منع استخدام الكود الخاص أو عقود العملاء السرية لتدريب نموذج عام قد يستخدمه منافسوك

- الحفاظ على الامتثال التنظيمي: التزم بضوابط اللائحة العامة لحماية البيانات (GDPR) أو قانون نقل التأمين الصحي والمسؤولية (HIPAA)، لأن البيانات الحساسة لا تعبر أبدًا الحدود الدولية ولا تصل إلى خادم تابع لجهة خارجية

- تخلص من الاعتماد على الإنترنت: قم بتشغيل مهام تحليل البيانات المعقدة أو مهام الصياغة أثناء انقطاع الخدمة أو في بيئات عالية الأمان حيث يكون الوصول إلى السحابة مقيدًا

- إدارة التكاليف بشكل يمكن التنبؤ به: تجنب ارتفاع رسوم واجهة برمجة التطبيقات (API) مع توسع فريقك، حيث إن التكلفة الوحيدة التي تتحملها هي الأجهزة التي تمتلكها بالفعل

من خلال دمج الذكاء الاصطناعي المحلي مع أدواتك الحالية، يمكنك أتمتة عملك دون المساس بأمنك.

⚠️ ومع ذلك، من المهم أن تتذكر أن هذه المشكلة قد تتفاقم. فقد يرغب فريقك في اعتماد أدوات ذكاء اصطناعي متعددة، مما يؤدي إلى انتشار الذكاء الاصطناعي — أي تكاثر أدوات الذكاء الاصطناعي دون رقابة أو استراتيجية. وقد يؤدي ذلك إلى إهدار المال، وتكرار الجهود، والمخاطر الأمنية.

في النهاية، يوسع هذا نطاق نموذج التهديدات الأمنية ويجعل تتبع الأنشطة أكثر صعوبة.

📮ClickUp Insight: الفرق ذات الأداء المنخفض أكثر عرضة بـ 4 مرات للتعامل مع أكثر من 15 أداة، بينما تحافظ الفرق ذات الأداء العالي على كفاءتها من خلال قصر مجموعة أدواتها على 9 منصات أو أقل. ولكن ماذا عن استخدام منصة واحدة؟ باعتباره التطبيق الشامل للعمل، يجمع ClickUp مهامك ومشاريعك ووثائقك وويكيك والدردشة والمكالمات تحت منصة واحدة، مع سير عمل مدعوم بالذكاء الاصطناعي. هل أنت مستعد للعمل بشكل أكثر ذكاءً؟ يعمل ClickUp مع كل فريق، ويجعل العمل مرئيًا، ويسمح لك بالتركيز على ما يهم بينما يتولى الذكاء الاصطناعي الباقي.

ما الذي تحتاجه لتشغيل الذكاء الاصطناعي المحلي؟

لا تحتاج إلى حاسوب عملاق متخصص لتشغيل الذكاء الاصطناعي محليًا. تتيح لك التغييرات الحديثة في طريقة بناء النماذج البدء باستخدام الأجهزة التي تمتلكها بالفعل. كل ما عليك هو التأكد من استيفاء بعض المعايير المحددة.

متطلبات الأجهزة

تحدد أجهزتك حجم وسرعة نماذج الذكاء الاصطناعي التي يمكنك استخدامها. في حين تتيح لك الأجهزة القوية تشغيل نماذج استدلال أكثر تعقيدًا، أصبحت النماذج الأصغر حجمًا قادرة بشكل مدهش.

- وحدة معالجة الرسومات (GPU) المزودة بذاكرة VRAM: تعد بطاقة NVIDIA المخصصة التي تحتوي على 12 جيجابايت على الأقل من ذاكرة VRAM الخيار الأمثل حاليًا لمعظم الفرق. فهي تتيح لك تشغيل نماذج متوسطة الحجم مثل Llama 3.3 (8B) أو Mistral Small بسرعات عالية

- ذاكرة الوصول العشوائي (RAM) للنظام: إذا لم يكن لديك وحدة معالجة رسومات (GPU) متطورة، فإن ذاكرة الوصول العشوائي (RAM) لجهاز الكمبيوتر الخاص بك تتولى التعامل مع الحمل. توفر لك ذاكرة 32 جيجابايت مساحة كافية لتشغيل نموذج مع إبقاء المتصفح وأدوات إدارة المشاريع مفتوحة

- الذاكرة الموحدة (لمستخدمي Mac): إذا كنت تستخدم جهاز Mac مزودًا بشريحة من سلسلة M (M2 أو M3 أو M4)، فإن ذاكرة الوصول العشوائي (RAM) وذاكرة وحدة معالجة الرسومات (GPU) مشتركتان. وهذا يجعل أجهزة Mac فعالة بشكل خاص في استخدام الذكاء الاصطناعي المحلي لأن النموذج يمكنه الوصول إلى كامل سعة الذاكرة

- التخزين السريع: النماذج عبارة عن ملفات كبيرة الحجم، تتراوح أحجامها غالبًا بين 5 جيجابايت و50 جيجابايت. يعد استخدام محرك أقراص SSD من نوع NVMe أمرًا ضروريًا لتجنب فترات الانتظار الطويلة عند تحميل نموذج جديد

🔎 هل تعلم؟ أصبح تجميع جهاز كمبيوتر شخصي أكثر تكلفة بكثير مما كان عليه قبل بضعة أشهر فقط. في السابق، كانت مجموعة ذاكرة DDR5 سعة 32 جيجابايت تكلف أقل من 130 دولارًا، ولكن الآن، ارتفعت أسعار تلك المجموعات نفسها إلى ما يزيد عن 400 دولار. وقد جعل هذا التغيير سعة 32 جيجابايت الحد الأدنى الجديد لأي عمل جاد في مجال الذكاء الاصطناعي المحلي، حيث تحتاج إلى مساحة كافية لتشغيل النماذج دون أن ينهار أداء نظامك.

متطلبات البرامج

يعمل البرنامج كجسر بين أجهزتك والذكاء الاصطناعي. لم تعد بحاجة إلى أن تكون مطورًا لتشغيل هذا النظام.

- نظام التشغيل: على الرغم من أن Linux هو النظام الأصلي للذكاء الاصطناعي، إلا أن Windows و macOS أصبحا الآن يتمتعان بنفس القدرات. يمكن لمستخدمي Windows استخدام WSL2 للحصول على بيئة تشبه Linux، على الرغم من أن العديد من الأدوات تعمل الآن مباشرة على Windows

- مديرو النماذج: تعد أدوات مثل Ollama أو LM Studio أسهل نقطة انطلاق. فهي تتولى عملية التكمية — أي ضغط النموذج بحيث يتناسب مع أجهزتك تلقائيًا

- برامج التشغيل: ستحتاج إلى أحدث برامج التشغيل لأجهزتك، مثل أحدث برنامج تشغيل CUDA لبطاقات NVIDIA. ستتحقق معظم برامج التثبيت الحديثة من ذلك نيابة عنك أثناء الإعداد

خيارات نماذج اللغة الكبيرة (LLM) مفتوحة المصدر

نشهد انتشارًا هائلاً للنماذج مفتوحة المصدر التي يمكنك تنزيلها مجانًا. تم تطوير هذه النماذج بواسطة شركات مثل Meta (Llama) و Mistral و Alibaba (Qwen). على عكس الأنظمة المغلقة، تتيح لك هذه النماذج معرفة كيفية عملها بالضبط وأين تذهب بياناتك.

عند اختيار نموذج لغوي كبير، تحقق من ترخيص البرنامج. تستخدم معظمها ترخيص Apache 2.0 أو MIT، مما يسمح لك باستخدامها في العمليات التجارية دون رسوم اشتراك شهرية. ونظرًا لأن هذه النماذج تعمل على أجهزتك، فإنها تتكامل مباشرةً مع سير العمل الخاص بك.

على سبيل المثال، يمكنك استخدام نموذج محلي لصياغة رسائل البريد الإلكتروني الداخلية، أو تلخيص محاضر الاجتماعات، أو تحليل مجموعات البيانات الخاصة. وهذا يحافظ على بقاء تفاصيل مشروعك الأكثر حساسية وملاحظاتك الاستراتيجية على جهازك.

🧠 حقيقة ممتعة: توفر شرائح سلسلة M من Apple ميزة هندسية فريدة للفرق التي تركز على الخصوصية. تتيح الذاكرة الموحدة في أجهزة Mac للذكاء الاصطناعي استخدام كامل سعة ذاكرة الوصول العشوائي (RAM) للنظام كما لو كانت ذاكرة رسومات مخصصة.

وهذا يعني أن جهاز MacBook مزود بذاكرة وصول عشوائي (RAM) سعة 128 جيجابايت يمكنه تشغيل نماذج ضخمة ومتطورة للغاية تتطلب عادةً أجهزة مؤسسية متخصصة تكلفتها تزيد عن 10,000 دولار.

أفضل نماذج الذكاء الاصطناعي المحلية لسير عمل الفرق

للعثور على النموذج المناسب، قم بمطابقة نقاط قوة النموذج مع مهام فريقك وقدرات الأجهزة.

نماذج للأغراض العامة

هذه هي الأدوات الأساسية في إعداداتك المحلية. استخدمها لصياغة رسائل البريد الإلكتروني، أو تلخيص تحديثات المشاريع، أو طرح الأفكار الإبداعية.

- Llama 4 Scout (17B): يتميز بنافذة سياق تضم 10 ملايين رمز، مما يتيح لك معالجة آلاف الصفحات من النص في آن واحد

- Mistral Small 4: يستخدم بنية "مزيج الخبراء"، مما يعني أنه لا ينشط سوى جزء بسيط من معلماته لكل مهمة

- Qwen 3.5 (7B): يقدم أداءً متفوقًا باستمرار إذا كان فريقك يتعامل مع الوثائق الفنية بعدة لغات

نماذج للتفكير المنطقي واستخدام الأدوات

استخدم هذه العوامل عندما تحتاج إلى وكلاء LLM لحل مشكلات متعددة الخطوات، أو اتباع منطق معقد، أو العمل كوكيل مستقل ضمن سير عملك.

- Llama 4 Maverick: إنه متعدد الوسائط بطبيعته. وهذا يجعله مثاليًا للفرق التي تحتاج إلى تحليل المخططات المعقدة أو جداول البيانات المالية، حيث يكون السياق المرئي مهمًا بقدر أهمية النص

- Phi-4 (14B): مصمم خصيصًا لمجالات العلوم والتكنولوجيا والهندسة والرياضيات (STEM) والتفكير المنطقي. استخدمه للتحقق من صحة البيانات أو المهام الحسابية المعقدة التي تتطلب عادةً نماذج أكبر حجمًا وأكثر تكلفة

- DeepSeek-R1: يعرض سلسلة التفكير الداخلية الخاصة به، مما يساعدك على التحقق من منطقه في التحليلات ذات المخاطر العالية. مثالي للبحوث المتعمقة والتخطيط الاستراتيجي

نماذج مخصصة للمهام

في بعض الأحيان، تكون الأداة المتخصصة أكثر كفاءة من المساعد العام. تم تحسين هذه النماذج لتناسب جزءًا محددًا من سير عملك.

- Qwen 3-Coder-Next: يفهم منطق مستودع الكود، مما يتيح له اقتراح إصلاحات للأخطاء أو إعادة هيكلة الكود عبر ملفات متعددة. كل ذلك مع اتباع أدلة الأسلوب الخاصة بفريقك

- Voxtral Mini: يحدد المتحدثين المختلفين في التسجيل ويحول تسجيلات الاجتماعات الخاصة إلى نص قابل للبحث. يعمل بشكل كامل دون اتصال بالإنترنت، وهو أمر جيد لتجنب تسرب البيانات

- Nomic Embed v1. 5: يحول مستنداتك الخاصة إلى بيانات رياضية للبحث الدلالي. يتيح لك ذلك البحث في قاعدة المعرفة الداخلية لفريقك حسب المعنى بدلاً من الكلمات المفتاحية فقط

الأدوات الشائعة لتشغيل الذكاء الاصطناعي المحلي

لم تعد بحاجة إلى أن تكون مهندس برمجيات لتشغيل النماذج على جهازك الخاص. فهناك الآن العديد من التطبيقات سهلة الاستخدام التي تتولى الإعدادات الفنية نيابة عنك في غضون دقائق قليلة.

Ollama و OpenWebUI

يعد Ollama خيارًا مناسبًا إذا كنت تبحث عن السرعة والمرونة. فهو يعمل في الخلفية ويدير مكتبة النماذج الخاصة بك من خلال واجهة بسيطة.

على الرغم من أنه يبدأ كأداة أساسية، إلا أن معظم المستخدمين يقرنونه بـ OpenWebUI. يضيف هذا تجربة دردشة متطورة في متصفحك تشبه في الشكل والمظهر الأدوات المستندة إلى السحابة التي تعرفها بالفعل. كما أنه ينشئ جسرًا محليًا للتطبيقات الأخرى على جهاز الكمبيوتر الخاص بك للتواصل بأمان مع نماذج الذكاء الاصطناعي الخاصة بك.

LM Studio

إذا كنت تفضل تطبيق سطح المكتب التقليدي، فإن LM Studio يعد بديلاً ممتازًا. فهو يعمل كمتجر تطبيقات للذكاء الاصطناعي. يمكنك استخدامه للبحث عن نموذج جديد وتنزيله والتفاعل معه ببضع نقرات فقط.

يتضمن التطبيق ميزة مدمجة للكشف عن الأجهزة، لذا فهو يقوم تلقائيًا بتكوين إعداداتك لتتوافق مع وحدة معالجة الرسومات (GPU) أو ذاكرة الوصول العشوائي (RAM) الخاصة بك. وهذا يجعله نقطة انطلاق رائعة إذا كنت ترغب في تجربة نماذج مختلفة دون الحاجة إلى كتابة أي سطر من التعليمات البرمجية.

GPT4All

بالنسبة للفرق التي تركز حصريًا على الخصوصية وتحليل المستندات، يُعد GPT4All حلاً موثوقًا وبسيطًا. وهو يعمل على أي جهاز كمبيوتر تقريبًا، بما في ذلك أجهزة الكمبيوتر المحمولة القديمة التي قد لا تحتوي على بطاقة رسومات مخصصة.

أكثر ميزاته فائدة هي القدرة على التفاعل مع ملفاتك المحلية مباشرةً. يمكنك توجيه التطبيق إلى مجلد على محرك الأقراص الثابتة، وسيقوم الذكاء الاصطناعي بالإجابة عن الأسئلة المتعلقة بتلك المستندات المحددة. كل ذلك دون الحاجة إلى تحميلها على خادم تابع لجهة خارجية.

كيفية إعداد الذكاء الاصطناعي المحلي لضمان سير العمل الآمن

يستخدم هذا الدليل التفصيلي Ollama لأنها أداة مدعومة على نطاق واسع لإنشاء سير عمل آمن للذكاء الاصطناعي المحلي.

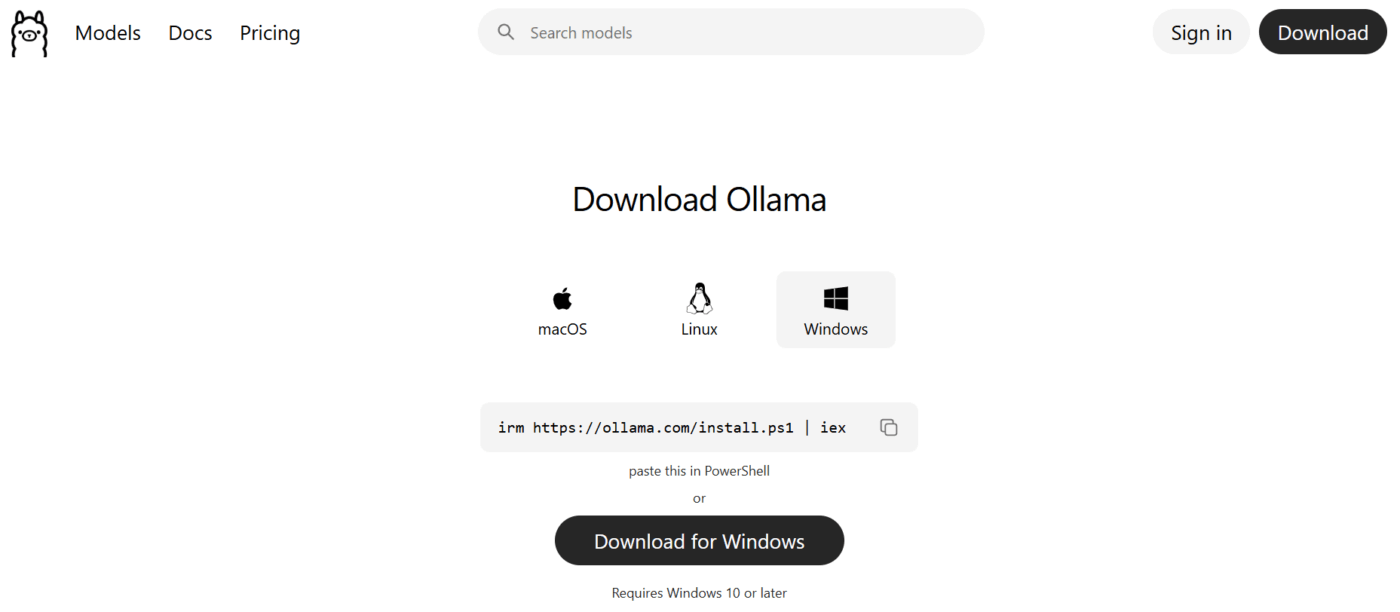

الخطوة 1: تثبيت Ollama

قم بتنزيل المثبت من الموقع الرسمي لنظام التشغيل الخاص بك. في حين أن الإصدارات السابقة من Windows كانت تتطلب الإعداد اليدوي لنظام Linux الفرعي، فإن الإصدار الحالي يتم تثبيته كتطبيق أصلي.

لن يستغرق التثبيت سوى بضع دقائق. بمجرد انتهاء التثبيت، افتح محطة العمل أو موجه الأوامر واكتب ollama --version للتأكد من أنه جاهز للعمل.

الخطوة 2: تنزيل نموذج وتشغيله

لبدء استخدام الذكاء الاصطناعي، تحتاج إلى نقل أوزانه إلى جهازك. في اختبارك الأول، جرب نموذجًا صغير الحجم لكنه قوي مثل Llama 3.2 (3B) أو أحدث إصدار من Mistral.

استخدم الأمر ollama run llama3.2 لبدء التنزيل.

اعتمادًا على سرعة الإنترنت لديك، يستغرق هذا عادةً بضع دقائق. بمجرد انتهاء التنزيل، يمكنك كتابة موجه مباشرةً في المحطة الطرفية للحصول على استجابة فورية من النموذج الموجود على محرك الأقراص الثابتة.

الخطوة 3: الاتصال بأداة سير العمل الخاصة بك

تكمن القيمة الحقيقية للذكاء الاصطناعي المحلي في دمجه في مهامك اليومية. عند تشغيل Ollama، يبدأ تلقائيًا خادمًا محليًا على http://localhost:11434. وهذا يخلق جسرًا آمنًا للتطبيقات الأخرى للتواصل مع نموذجك.

نظرًا لأن هذا الخادم متوافق مع بروتوكولات OpenAI القياسية، يمكنك توصيله بمنصات الأتمتة أو البرامج النصية الداخلية بمجرد تبديل عنوان واجهة برمجة التطبيقات (API). على سبيل المثال، يمكنك توجيه أداة بحث محلية عن المستندات إلى هذا العنوان. وهذا يتيح لها تلخيص الملفات الخاصة دون إرسال النص إلى السحابة مطلقًا.

📖 اقرأ أيضًا: كيفية تبسيط تنسيق سير العمل لتحقيق كفاءة أكبر

أفضل الممارسات الأمنية لسير عمل الذكاء الاصطناعي المحلي

يعد تشغيل الذكاء الاصطناعي محليًا خطوة كبيرة نحو تعزيز الخصوصية. ومع ذلك، فإن تخزين البيانات محليًا يعني أنك أصبحت الآن مسؤولاً عن حمايتها. ورغم أنك قد قضيت على مخاطر اختراق السحابة من قبل طرف ثالث، إلا أنك لا تزال بحاجة إلى تأمين أجهزتك والطريقة التي يتفاعل بها فريقك مع النماذج.

اتبع هذه الممارسات الفضلى:

- عزل الشبكة: قم بتقييد الوصول إلى واجهة برمجة التطبيقات (API) على الشبكات الداخلية الموثوقة حتى يظل خادم الذكاء الاصطناعي الخاص بك غير قابل للوصول من الإنترنت العام

- التحقق من صحة المدخلات: قم بتنقية جميع البيانات قبل إرسالها إلى النموذج. يؤدي ذلك إلى حجب التعليمات الخبيثة المخفية في المستندات أو رسائل البريد الإلكتروني

- ضوابط الوصول: قم بتنفيذ المصادقة على نقطة نهاية الذكاء الاصطناعي الخاصة بك للتحقق من أن المستخدمين المصرح لهم فقط هم من يمكنهم تشغيل إجراءات النموذج

- تسجيل التدقيق: احتفظ بسجل لجميع تفاعلات النموذج للمساعدة في تحقيقات الامتثال والأمن

- عزل الحاويات: قم بتشغيل نماذجك في بيئات معزولة مثل Docker. وهذا يمنع أي اختراق محتمل من الوصول إلى ملفات نظامك الأساسية

- تحديثات منتظمة: قم بتثبيت أحدث التصحيحات لأدوات مثل Ollama لتبقى محميًا من الثغرات الأمنية المكتشفة حديثًا

- تحديد معدل الاستخدام: لمنع مستخدم واحد أو برنامج نصي واحد من إرباك الخادم الخاص بك بالطلبات، قم بتطبيق تحديد معدل الاستخدام للتحكم في عدد الاستعلامات التي يمكن إجراؤها خلال فترة معينة

🔎 هل تعلم؟ لم تعد عمليات التلاعب القائمة على المطالبات مجرد تهديد نظري. فقد كشفت دراسة استقصائية حديثة أجرتها شركة Gartner أن 32% من المؤسسات تعرضت لهجوم خبيث عبر المطالبات على تطبيقات الذكاء الاصطناعي خلال العام الماضي. ويمكن لهذه الهجمات التلاعب بنموذجك المحلي لإنتاج مخرجات متحيزة أو غير مصرح بها.

كيفية إنشاء سير عمل آمن للذكاء الاصطناعي لفريقك

بمجرد تشغيل الخادم المحلي الخاص بك، يمكنك دمجه في عملك اليومي. وهذا يحول أداة بسيطة إلى محرك إنتاجية خاص. وأكثر الطرق فعالية للقيام بذلك هي من خلال التوليد المعزز بالاسترجاع (RAG).

تربط هذه العملية الذكاء الاصطناعي المحلي الخاص بك بقاعدة بيانات خاصة تحتوي على ملفاتك الخاصة. يمكنك الإجابة على الأسئلة باستخدام سياق شركتك المحدد دون تحميل أي بايت واحد إلى السحابة.

يمكنك أيضًا تصميم سير عمل يتضمن تدخلًا بشريًا، حيث يتم مراجعة عمل الذكاء الاصطناعي من قبل أعضاء الفريق البشريين. وهذا يضمن الدقة مع تسريع إنتاجك بشكل كبير.

فيما يلي بعض الأمثلة العملية:

- تحليل المستندات: قم بتلخيص التقارير الداخلية أو ملاحظات العملاء لاستخلاص الرؤى الرئيسية على الفور

- إنشاء المسودات: قم بإنشاء النسخ الأولى من رسائل البريد الإلكتروني أو تحديثات المشاريع ليقوم أعضاء الفريق بتحسينها

- تصنيف البيانات: قم بتصنيف المهام الواردة تلقائيًا بناءً على المحتوى المحدد للطلب

- التحضير للاجتماع: قم بإنشاء نقاط للنقاش من خلال تحليل ملفات المشروع ذات الصلة المخزنة على محرك الأقراص المحلي الخاص بك

- مراجعة الكود: احصل على تعليقات حول كود المصدر الخاص دون تعريض ملكيتك الفكرية لطرف ثالث

📮رؤية ClickUp: يُظهر استطلاعنا حول نضج الذكاء الاصطناعي أن الوصول إلى الذكاء الاصطناعي في العمل لا يزال محدودًا — 36% من الأشخاص لا يملكون أي وصول إليه على الإطلاق، و14% فقط يقولون إن معظم الموظفين يمكنهم فعليًا تجربته. عندما يكون الذكاء الاصطناعي محجوبًا بسبب أذونات أو أدوات إضافية أو إعدادات معقدة، لا تحصل الفرق حتى على فرصة لتجربته في العمل اليومي الفعلي.

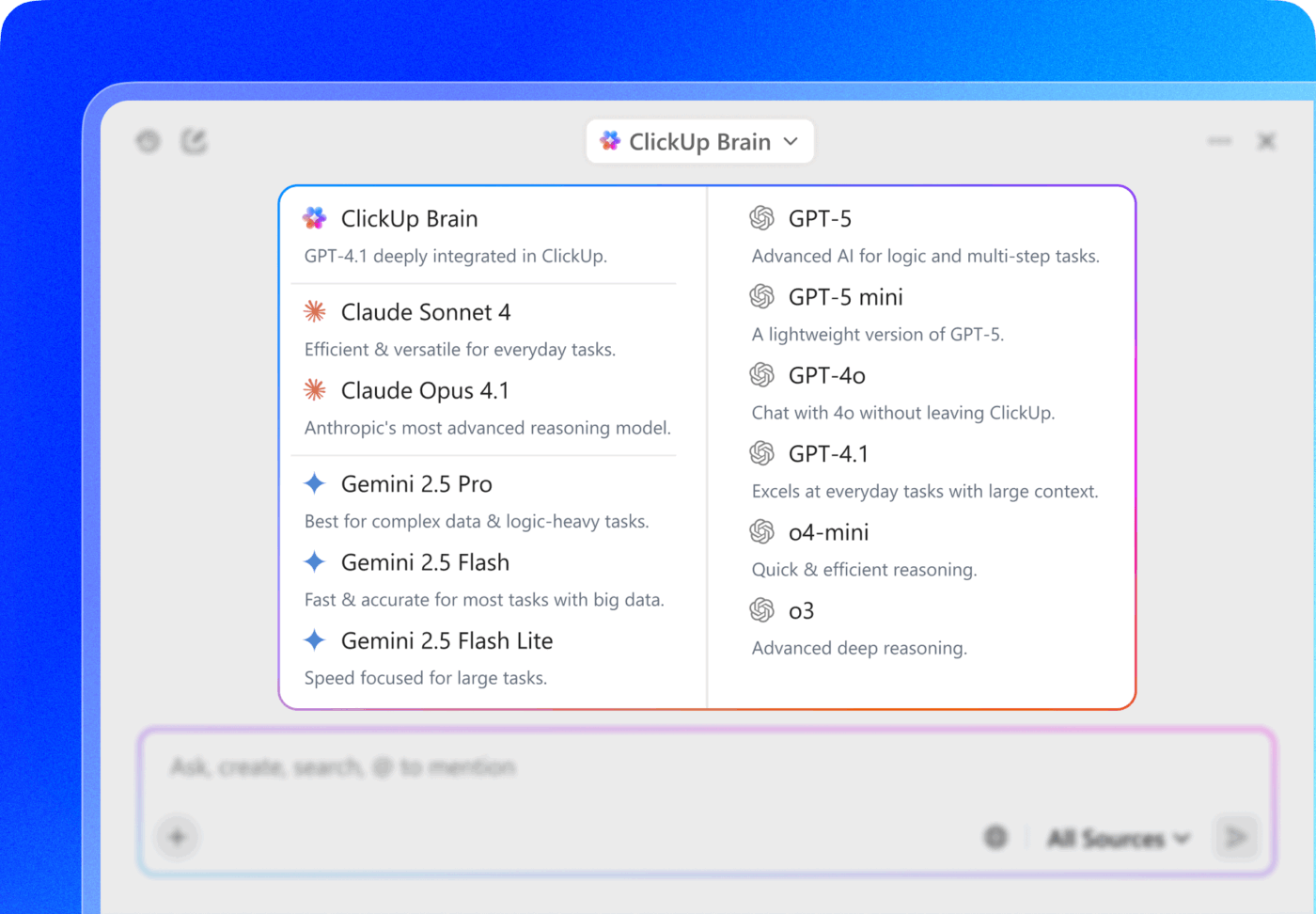

يزيل ClickUp Brain كل هذه العقبات من خلال وضع الذكاء الاصطناعي مباشرة داخل مساحة العمل التي تستخدمها بالفعل. يمكنك الاستفادة من نماذج متعددة للذكاء الاصطناعي، وإنشاء الصور، وكتابة أو تصحيح الأخطاء في الكود، والبحث على الويب، وتلخيص المستندات، والمزيد — دون الحاجة إلى تبديل الأدوات أو فقدان التركيز.

إنه شريكك في الذكاء الاصطناعي المحيط، سهل الاستخدام ومتاح لجميع أعضاء الفريق.

قيود استخدام الذكاء الاصطناعي المحلي في سير عمل الذكاء الاصطناعي

يعد الذكاء الاصطناعي المحلي أداة قوية، لكنه ليس حلاً سحرياً لكل مشكلة. ففهم قيوده يساعدك على تحديد متى تحتفظ بمهمة ما على أجهزتك الخاصة ومتى تستخدم السحابة. بالنسبة لبعض الفرق، قد تفوق التنازلات التقنية والمالية مزايا الخصوصية.

- حدود القدرات: لا تزال النماذج الاحتكارية من الدرجة الأولى تتمتع بميزة طفيفة في الاستدلال المعقد والفروق الدقيقة الإبداعية مقارنة بالإصدارات مفتوحة المصدر

- الاستثمار في الأجهزة: يتطلب الأداء السريع على النماذج الكبيرة وحدات معالجة رسومات (GPU) باهظة الثمن مزودة بذاكرة VRAM كبيرة. وقد يمثل هذا تكلفة أولية عالية للفرق الصغيرة

- تكاليف الصيانة: أنت مسؤول عن جميع تحديثات البرامج، واستكشاف أخطاء الأجهزة وإصلاحها، وتثبيت تصحيحات الأمان دون الحاجة إلى فريق دعم من المزود

- الخبرة الفنية: يتطلب تحسين البيئة المحلية معرفة عملية بتكمية النماذج وتكوين الخادم

- إدارة الأمان: على عكس الخدمات السحابية، لا تأتي النماذج المحلية مزودة بآليات مراقبة مدمجة. يجب عليك تطبيق مرشحات المحتوى الخاصة بك ووضع ضوابط الأمان الخاصة بك

- استهلاك الطاقة: قد يؤدي تشغيل نماذج الذكاء الاصطناعي واسعة النطاق على خوادمك أو محطات العمل الخاصة بك إلى زيادة كبيرة في استهلاك الكهرباء واحتياجات التبريد

تستخدم العديد من الفرق نهجًا مختلطًا: الذكاء الاصطناعي المحلي للبيانات الحساسة، والذكاء الاصطناعي السحابي للمهام الأقل حساسية التي تتطلب أقصى قدر من القدرات. فيما يلي نظرة عامة سريعة على المقارنة بين الاثنين:

| Factor | الذكاء الاصطناعي المحلي | الذكاء الاصطناعي السحابي |

|---|---|---|

| خصوصية البيانات | تحكم كامل | البيانات المرسلة إلى المزود |

| تعقيد الإعداد | أعلى | أقل |

| التكاليف المستمرة | الأجهزة + الكهرباء | رسوم لكل رمز |

| قدرات النماذج | جيد، في تحسن | أحدث ما توصلت إليه التكنولوجيا |

| الصيانة | إدارة ذاتية | يديرها المزود |

كيف يدعم ClickUp سير العمل الآمن المدعوم بالذكاء الاصطناعي

تواجه معظم الفرق اليوم معضلة: إما استخدام الذكاء الاصطناعي السحابي القوي والقلق بشأن مصير بياناتك، أو إعداد نماذج محلية والتعامل مع التكاليف الإضافية المستمرة. يتجنب ClickUp هذه المعضلة من خلال العمل كمساحة عمل متكاملة للذكاء الاصطناعي — حيث يوجد الذكاء الاصطناعي بالفعل داخل النظام الذي يعمل فيه عملك.

ClickUp Brain هي طبقة الذكاء الاصطناعي المدمجة مباشرة في مساحة عمل ClickUp، والمصممة لفهم مهامك ووثائقك واتصالات فريقك في مكان واحد. وهي توفر مساعدة الذكاء الاصطناعي مع السياق الكامل — بدون أدوات منفصلة، وبدون عمليات تكامل هشة.

بالنسبة للفرق التي تهدف إلى إنشاء سير عمل آمن للذكاء الاصطناعي، فإن هذا المزيج من السياق والتحكم هو الفارق بين التجريب والتطبيق الفعلي.

🌟 يتوافق ClickUp أيضًا مع معيار SOC 2 ويلتزم بمعايير ISO 42001 للإدارة المسؤولة للذكاء الاصطناعي. وهذا يضمن عدم استخدام بياناتك أبدًا لتدريب نماذج الجهات الخارجية، مما يتيح لك أتمتة عملك بنفس الثقة التي توفرها الإعدادات المحلية.

استخدم البحث وسير العمل المستقل مع ClickUp Brain

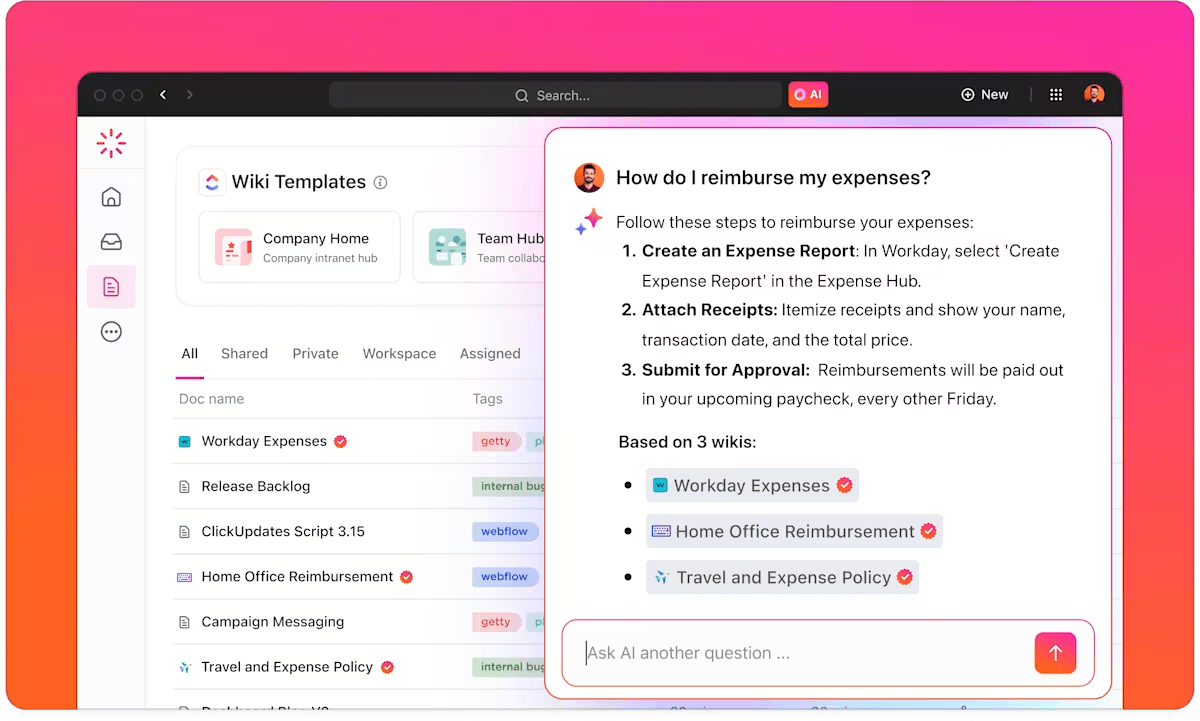

بمجرد تأمين بياناتك داخل مساحة العمل، يستخرج ClickUp Brain القيمة من مهامك ووثائقك في الوقت الفعلي.

ونظرًا لأن الذكاء الاصطناعي مدمج، فإنه يتجنب فجوة السياق التي تبطئ عمليات الإعداد المحلية. يمكنك طرح أسئلة عليه تتطلب رؤية كاملة لتاريخ مشروعك للإجابة عليها بدقة:

- تحديد القرارات النهائية من موجز تقني طويل دون الحاجة إلى التمرير بين الإصدارات

- صياغة تحديثات لأصحاب المصلحة من تعليقات المهام وتغييرات الحالة

يولد ClickUp Brain إجابات تستند إلى بيانات مساحة العمل الخاصة بك من خلال تحليل المحتوى المحدد داخل مستنداتك ومهامك ومحادثاتك. وهذا يضمن أن الذكاء الاصطناعي لديه دائمًا أحدث سياق مع تطور مشروعك.

يتيح ذلك لفريقك الاستفادة من الرؤى دون الحاجة إلى إعادة شرح تاريخ المشروع يدويًا أو نقل البيانات بين أدوات غير متصلة ببعضها.

💡نصيحة للمحترفين: يمكنك توسيع نطاق سياق مساحة العمل لديك بشكل أكبر باستخدام " Enterprise AI Search " لاستخراج المعلومات من جميع أدواتك الخارجية.

على سبيل المثال، اطرح سؤالاً عميقاً مثل "أرني جميع الصفقات المفتوحة في قائمة المهام"، وسيقوم ClickUp Brain بالبحث عبر تطبيقاتك المتصلة، بما في ذلك Slack وGoogle Drive وGmail، لتقديم إجابة موثوقة في الوقت الفعلي مع الاستشهادات.

وهذا يحول البيانات المجزأة عبر منصات متعددة إلى طبقة ذكاء واحدة قابلة للبحث، حيث يمكنك العثور على أي ملف أو رسالة أو مهمة دون مغادرة مساحة العمل الخاصة بك.

إدارة المهام بذكاء باستخدام الأتمتة والذكاء الاصطناعي

لا يقتصر دور ClickUp Brain على تقديم المساعدة بشكل سلبي فحسب، بل يعمل بشكل فعال ضمن نظام المهام الخاص بك. ويمكنه:

- إنشاء مهام من ملاحظات الاجتماعات أو مستندات Docs

- قسّم المهام الكبيرة إلى مهام فرعية

- اقتراح مالكي المهام بناءً على الأنشطة السابقة

- اقتراح المواعيد النهائية بناءً على سياق المشروع

كما يمكنه تحديث حالات المهام، وتلخيص سلاسل التعليقات الطويلة في خطوات تالية واضحة، والإبلاغ عن العوائق قبل أن تؤدي إلى إبطاء التنفيذ.

عند اقترانها بـ ClickUp Automation ، يصبح هذا نظامًا مغلقًا: يمكن للذكاء الاصطناعي تشغيل سير العمل (مثل تخصيص المهام، أو إخطار أصحاب المصلحة، أو تحديث الأولويات) بناءً على التغييرات داخل مساحة العمل الخاصة بك.

على سبيل المثال، عند الانتهاء من إعداد مستند، يمكن إنشاء المهام وتعيينها تلقائيًا دون الحاجة إلى نقل البيانات يدويًا بين الأدوات.

💟 مكافأة: حوّل ClickUp Brain MAX إلى "ذاكرة قراراتك".

استخدمه من أجل:

- لخص سلاسل التعليقات الطويلة في قرارات واضحة وخطوات تالية

- قم بتحديث المستندات بـ "ما الذي تغير ولماذا" بعد تحقيق المعالم الرئيسية

- قم بإنشاء سجلات قرارات أسبوعية من المهام والاجتماعات والتحديثات

بمرور الوقت، يؤدي هذا إلى تكوين طبقة حية من المعرفة المؤسسية التي يمكن لـ Brain MAX الرجوع إليها. لذا، بدلاً من الرد على المطالبات بشكل منفصل، يبدأ في الاستجابة مع إدراك القرارات والأولويات والأنماط السابقة.

وهنا يتحول الذكاء الاصطناعي من كونه مفيدًا إلى كونه موثوقًا—خاصة في سير عمل الذكاء الاصطناعي الآمن حيث يهم السياق وإمكانية التتبع.

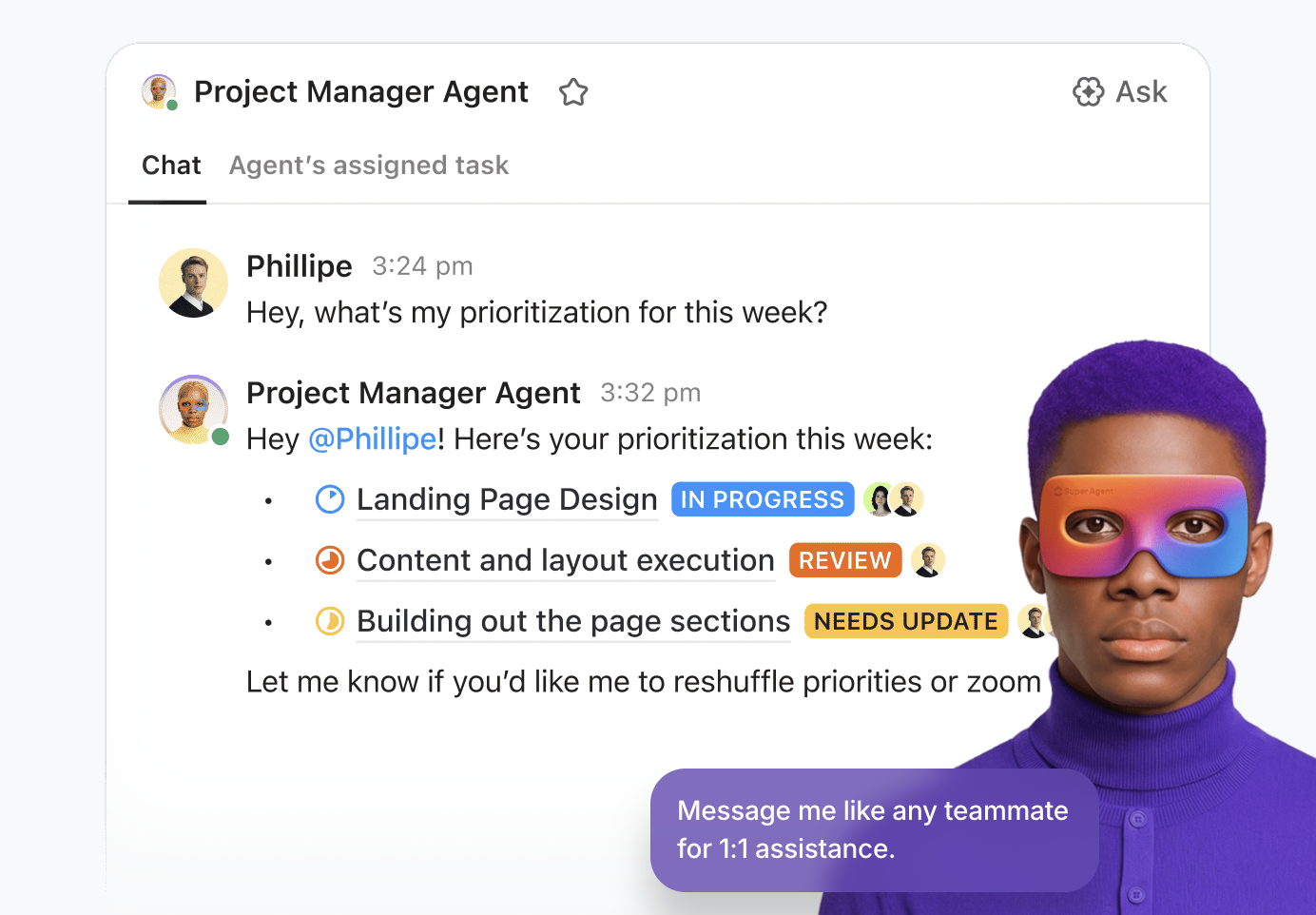

احصل على تنفيذ آمن ومراعي للسياق على نطاق واسع مع Super Agents

تأخذ "الوكلاء الفائقون" في ClickUp "ClickUp Brain" خطوة إلى الأمام — من المساعدة في العمل إلى دفعه بشكل فعال. يمكن تكوين هؤلاء الوكلاء لمراقبة سير العمل واتخاذ الإجراءات وتنسيق المهام عبر مساحة العمل الخاصة بك بناءً على قواعد محددة مسبقًا وسياق في الوقت الفعلي.

على سبيل المثال، يمكن لـ Super Agent:

- راقب الطلبات الواردة أو المستندات وقم بتحويلها تلقائيًا إلى مهام منظمة مع تحديد المسؤولين والمواعيد النهائية

- تتبع تقدم المشروع ووضع علامة على المخاطر أو التأخيرات قبل أن تتفاقم

- قم بتشغيل عمليات الأتمتة متعددة الخطوات عند استيفاء الشروط — مثل إخطار أصحاب المصلحة، أو تحديث الأولويات، أو إنشاء مهام متابعة

تعمل هذه العناصر بشكل كامل داخل مساحة العمل الموحدة لـ ClickUp، مع إدراك كامل لمهامك ووثائقك وهيكل الأذونات. وهذا يعني:

- لا تحتاج إلى تصدير البيانات إلى أنظمة الذكاء الاصطناعي الخارجية أو أدوات التنسيق

- لا يمكنهم الوصول إلا إلى البيانات المصرح لهم بالاطلاع عليها

- يعملون ضمن حدود الأذونات نفسها التي يعمل بها فريقك

تعرف على المزيد حول العمل مع Super Agents:

استفد من المساعدة التي يوفرها الذكاء الاصطناعي داخل مستنداتك

مع ClickUp Docs، يتم دمج المساعدة التي يوفرها الذكاء الاصطناعي مباشرةً في سير عمل الوثائق. يمكن للفرق صياغة موجزات المشاريع، أو تلخيص التقارير الطويلة، أو استخلاص بنود العمل، أو إعادة كتابة المحتوى لمختلف الفئات المستهدفة — كل ذلك دون مغادرة المنصة.

هذا أمر مهم لضمان أمان سير عمل الذكاء الاصطناعي لأن أحد أكبر المخاطر يأتي من نسخ المعلومات الحساسة ولصقها في أدوات خارجية. في ClickUp، يمكنك تقليل حركة البيانات والحفاظ على التحكم الكامل في الوصول من خلال الأذونات.

الحكم النهائي: بناء مجموعة الذكاء الاصطناعي الخاصة بك

تستفيد الذكاء الاصطناعي المحلي من تقنيات الذكاء الاصطناعي مع الحفاظ على التحكم الكامل في خصوصية البيانات والامتثال للمعايير. ومع ذلك، يتطلب هذا المسار استثمارًا كبيرًا في الأجهزة والإعدادات التقنية والصيانة المستمرة.

تظل ممارسات الأمان أمرًا بالغ الأهمية سواء كنت تستخدم الذكاء الاصطناعي المحلي أو السحابي. وغالبًا ما تتضمن الاستراتيجية الأكثر فعالية نهجًا مختلطًا: استخدام الذكاء الاصطناعي المحلي للعمليات الأكثر حساسية مع الاستفادة من الحلول المدارة والآمنة لتحقيق الإنتاجية اليومية.

من الضروري النظر في المقايضات — بالنسبة للعديد من الفرق، قد لا تكون التكاليف الإضافية لحلول "افعلها بنفسك" هي الخيار الصحيح.

بالنسبة لأولئك الذين يرغبون في إنتاجية قوية للذكاء الاصطناعي دون عبء البنية التحتية، توفر الحلول المُدارة مثل ClickUp Brain حلاً وسطًا جذابًا. فهي توفر أمانًا على مستوى المؤسسات دون أي تعقيدات في الإعداد.

ابدأ باستخدام ClickUp مجانًا واستكشف سير عمل آمنًا ومدعومًا بالذكاء الاصطناعي ومناسبًا لسياق فريقك.

الأسئلة الشائعة

ما الفرق بين الذكاء الاصطناعي المحلي والذكاء الاصطناعي القائم على السحابة فيما يتعلق بسير عمل الفريق؟

يعمل الذكاء الاصطناعي المحلي بالكامل على أجهزتك الخاصة، مما يضمن عدم خروج البيانات من شبكتك الداخلية أبدًا، بينما يرسل الذكاء الاصطناعي القائم على السحابة المطالبات إلى خوادم الجهات الخارجية للمعالجة. توفر الإعدادات المحلية سيادة كاملة على البيانات والوصول دون اتصال بالإنترنت، في حين توفر الخدمات السحابية قوة حاسوبية أعلى وسهولة في الاستخدام على حساب التحكم المباشر في البيانات.

كيف يمكن للفرق استخدام نماذج الذكاء الاصطناعي المحلية مع بيانات المشاريع السرية؟

يمكن للفرق استخدام الذكاء الاصطناعي المحلي لمعالجة المستندات الحساسة والرموز الخاصة والسجلات المالية عن طريق توجيه النموذج إلى الدلائل الخاصة داخل المؤسسة. ونظرًا لأن الاستدلال يحدث على الجهاز نفسه، يمكنك تنفيذ مهام مثل التلخيص الآلي واستخراج البيانات والبحث عن المعرفة الداخلية دون المخاطرة بالتعرض لمجموعات تدريب نماذج اللغة الكبيرة (LLM) العامة.

هل نماذج الذكاء الاصطناعي المحلية تتمتع بنفس قدرات ChatGPT في أداء مهام العمل؟

أصبحت العديد من النماذج المحلية مفتوحة المصدر، مثل Llama 3 و Mistral، قادرة الآن بشكل كبير على التعامل مع مهام العمل الروتينية مثل الصياغة والبرمجة والتلخيص. في حين أن النماذج السحابية من الدرجة الأولى مثل GPT-4o لا تزال رائدة في مجال الاستدلال فائق التعقيد، فإن النماذج المحلية تقدم أداءً مماثلاً في 90% من العمليات التجارية اليومية مع خصوصية أفضل بكثير.

ما هي المفاضلات بين تشغيل الذكاء الاصطناعي محليًا مقابل استخدام خدمات الذكاء الاصطناعي السحابية؟

المفاضلة الأساسية هي الاختيار بين خصوصية البيانات الكاملة مع الذكاء الاصطناعي المحلي مقابل قابلية التوسع التي لا تتطلب صيانة للذكاء الاصطناعي السحابي. يتطلب تشغيل الذكاء الاصطناعي محليًا استثمارًا مسبقًا في الأجهزة وخبرة تقنية، ولكنه يلغي رسوم واجهة برمجة التطبيقات (API) المتكررة ومخاطر تسرب البيانات. يعد الذكاء الاصطناعي السحابي أسرع في النشر ولكنه ينطوي على تكاليف اشتراك مستمرة واعتماد على بيانات الجهات الخارجية.