A maioria das pessoas presume que precisa escolher entre usar ferramentas poderosas de IA ou manter seus dados privados. Mas, na verdade, você pode ter os dois. Executar a IA localmente significa que os dados nunca saem do seu hardware. Você mantém controle total sobre suas informações e, ao mesmo tempo, automatiza suas tarefas mais repetitivas.

Este guia mostra como usar IA local para fluxos de trabalho seguros com ferramentas como o Ollama. Você aprenderá a selecionar modelos de código aberto adequados às especificações específicas do seu hardware e a criar fluxos de trabalho automatizados que processam documentos privados localmente.

Também vamos analisar a centralização de fluxos de trabalho em um espaço unificado como o ClickUp. 😎

O que é IA local?

IA local significa que você executa grandes modelos de linguagem (LLMs) inteiramente em seu próprio hardware — como seu laptop ou um servidor local — em vez de enviar seus dados para serviços externos na nuvem. Isso é adequado para qualquer equipe que lida com informações confidenciais, desde engenharia e design de produtos até departamentos jurídicos e financeiros.

Com a maioria das ferramentas de IA baseadas na nuvem, suas solicitações, documentos e dados são enviados para servidores de terceiros. Você perde o controle sobre como essas informações são processadas, armazenadas ou utilizadas.

Por outro lado, a IA local mantém seus dados dentro do seu ambiente. Você mantém controle total sobre a segurança e a proteção de dados dos seus fluxos de trabalho.

É claro que há uma contrapartida. A configuração da IA local exige mais esforço técnico e um investimento inicial em hardware. No entanto, ela elimina completamente sua dependência de provedores externos. Com a inferência no dispositivo, suas informações permanecem exatamente onde você deseja.

Por que a IA local é importante para fluxos de trabalho seguros em equipe

🔎 Você sabia? Apenas 1 em cada 10 consumidores está disposto a compartilhar informações confidenciais, como dados financeiros, de comunicação ou biométricos, com sistemas baseados em IA.

Essa hesitação reflete uma realidade cada vez mais comum para equipes B2B. Com a IA baseada na nuvem, você está, essencialmente, entregando a propriedade intelectual da sua empresa a terceiros. Para equipes jurídicas, financeiras ou de RH, isso cria um enorme risco de responsabilidade civil.

A IA local muda essa dinâmica ao transferir a IA para o seu próprio hardware. Veja por que isso é importante para suas operações diárias:

- Elimine o vazamento de dados: Evite que código proprietário ou contratos privados de clientes sejam usados para treinar um modelo público que seus concorrentes possam utilizar

- Mantenha a conformidade regulatória: permaneça dentro dos limites do GDPR ou da HIPAA, pois os dados confidenciais nunca cruzam fronteiras internacionais nem chegam a servidores de terceiros

- Elimine a dependência da internet: execute análises complexas de dados ou tarefas de elaboração de rascunhos durante uma interrupção de serviço ou em ambientes de alta segurança onde o acesso à nuvem é restrito

- Gerencie custos de forma previsível: Evite o aumento das taxas de API à medida que sua equipe cresce, já que seu único custo é o hardware que você já possui

Ao integrar a IA local às suas ferramentas existentes, você pode automatizar seu trabalho sem comprometer sua segurança.

⚠️ No entanto, é importante lembrar que esse problema pode se agravar. Sua equipe pode querer adotar várias ferramentas de IA, levando à proliferação descontrolada de IA — a disseminação de ferramentas de IA sem supervisão ou estratégia. Isso pode resultar em desperdício de dinheiro, duplicação de esforços e riscos de segurança.

Em última análise, isso amplia seu modelo de ameaças de segurança e torna o trabalho mais difícil de rastrear.

📮ClickUp Insight: Equipes de baixo desempenho têm 4 vezes mais chances de usar mais de 15 ferramentas, enquanto equipes de alto desempenho mantêm a eficiência limitando seu conjunto de ferramentas a 9 plataformas ou menos. Mas que tal usar uma única plataforma? Como o aplicativo que faz tudo para o trabalho, o ClickUp reúne suas tarefas, projetos, documentos, wikis, chat e chamadas em uma única plataforma, com fluxos de trabalho impulsionados por IA. Pronto para trabalhar de forma mais inteligente? O ClickUp funciona para todas as equipes, torna o trabalho visível e permite que você se concentre no que importa, enquanto a IA cuida do resto.

O que você precisa para executar IA local?

Você não precisa de um supercomputador especializado para executar IA localmente. Mudanças recentes na forma como os modelos são construídos permitem que você comece a usar o hardware que já possui. Basta que ele atenda a alguns critérios específicos.

Requisitos de hardware

Seu hardware determina o tamanho e a velocidade dos modelos de IA que você pode usar. Embora uma máquina potente permita executar modelos de raciocínio mais complexos, os modelos menores tornaram-se surpreendentemente capazes.

- GPU com VRAM: Uma placa NVIDIA dedicada com pelo menos 12 GB de VRAM é a opção ideal atualmente para a maioria das equipes. Ela permite executar modelos de tamanho médio, como o Llama 3.3 (8B) ou o Mistral Small, em alta velocidade

- Memória RAM do sistema: Se você não tiver uma GPU de ponta, a memória RAM do seu computador suporta a carga. 32 GB oferecem espaço suficiente para executar um modelo enquanto mantém seu navegador e suas ferramentas de gerenciamento de projetos abertos

- Memória unificada (para usuários de Mac): Se você estiver usando um Mac com um chip da série M (M2, M3 ou M4), sua RAM e a memória da GPU são compartilhadas. Isso torna os Macs particularmente eficientes para IA local, pois o modelo pode acessar todo o conjunto de memória

- Armazenamento rápido: Os modelos são arquivos grandes, geralmente variando de 5 GB a 50 GB. O uso de um SSD NVMe é essencial para evitar longos tempos de espera ao carregar um novo modelo

🔎 Você sabia? Montar um PC está significativamente mais caro do que há apenas alguns meses. Antes, um kit de memória DDR5 de 32 GB custava menos de US$ 130, mas agora esses mesmos kits ultrapassaram os US$ 400. Essa mudança tornou os 32 GB o novo mínimo indispensável para qualquer trabalho sério de IA local, já que você precisa de capacidade suficiente para executar modelos sem que o desempenho do sistema seja prejudicado.

Requisitos de software

O software atua como uma ponte entre o seu hardware e a IA. Você não precisa mais ser um desenvolvedor para colocar isso em funcionamento.

- Sistema operacional: Embora o Linux seja o ambiente nativo para IA, o Windows e o macOS agora são igualmente capazes. Os usuários do Windows podem usar o WSL2 para obter um ambiente semelhante ao Linux, embora muitas ferramentas agora sejam executadas diretamente no Windows

- Gerenciadores de modelos: Ferramentas como o Ollama ou o LM Studio são o ponto de partida mais fácil. Elas cuidam da quantização — comprimindo o modelo para que ele caiba no seu hardware automaticamente

- Drivers: Você precisará dos drivers mais recentes para o seu hardware, como o driver CUDA mais recente para placas NVIDIA. A maioria dos instaladores modernos verificará isso para você durante a configuração

Opções de LLM de código aberto

Estamos vendo uma explosão de modelos de peso aberto que você pode baixar gratuitamente. Eles são desenvolvidos por empresas como Meta (Llama), Mistral e Alibaba (Qwen). Ao contrário dos sistemas fechados, esses modelos permitem que você veja exatamente como funcionam e para onde seus dados estão indo.

Ao escolher um modelo de linguagem de grande porte, verifique a licença do software. A maioria usa a Apache 2.0 ou a MIT, o que permite utilizá-los para operações comerciais sem uma taxa de assinatura mensal. Como esses modelos residem no seu hardware, eles se integram diretamente aos seus fluxos de trabalho privados.

Por exemplo, você pode usar um modelo local para redigir e-mails internos, resumir transcrições de reuniões ou analisar conjuntos de dados proprietários. Isso mantém os detalhes mais confidenciais do seu projeto e suas anotações estratégicas na sua máquina.

🧠 Curiosidade: Os chips da série M da Apple oferecem uma vantagem arquitetônica única para equipes focadas em privacidade. A Memória Unificada do Mac permite que a IA utilize todo o pool de RAM do sistema como se fosse memória gráfica dedicada.

Isso significa que um MacBook equipado com 128 GB de RAM pode executar modelos enormes e altamente sofisticados que normalmente exigiriam hardware empresarial especializado , com custo superior a US$ 10.000.

Os melhores modelos de IA local para fluxos de trabalho em equipe

Para encontrar o modelo certo, compare os pontos fortes do modelo com as tarefas da sua equipe e os recursos de hardware disponíveis.

Modelos de uso geral

Essas são as ferramentas essenciais da sua configuração local. Use-as para redigir e-mails, resumir atualizações de projetos ou gerar ideias criativas.

- Llama 4 Scout (17B): Possui uma janela de contexto de 10 milhões de tokens, o que permite processar milhares de páginas de texto de uma só vez

- Mistral Small 4: Utiliza uma arquitetura de mistura de especialistas, o que significa que ativa apenas uma fração de seus parâmetros para cada tarefa

- Qwen 3.5 (7B): Apresenta desempenho superior de forma consistente se sua equipe lida com documentação técnica em vários idiomas

Modelos para raciocínio e uso de ferramentas

Use-os quando precisar que os agentes LLM resolvam problemas com várias etapas, sigam lógicas complexas ou atuem como agentes autônomos em seus fluxos de trabalho.

- Llama 4 Maverick: É multimodal por padrão. Isso o torna ideal para equipes que precisam analisar gráficos complexos ou planilhas financeiras, onde o contexto visual é tão importante quanto o texto

- Phi-4 (14B): Otimizado para STEM e raciocínio lógico. Use-o para validação de dados ou tarefas matemáticas complexas que geralmente exigem modelos muito maiores e mais caros

- DeepSeek-R1: Exibe sua cadeia de raciocínio interna, o que ajuda você a verificar sua lógica para análises de alto risco. Ideal para pesquisa aprofundada e planejamento estratégico

Modelos específicos para tarefas

Às vezes, uma ferramenta especializada é mais eficiente do que um assistente geral. Esses modelos são otimizados para uma parte específica do seu fluxo de trabalho.

- Qwen 3-Coder-Next: Compreende a lógica em escala de repositório, permitindo sugerir correções de bugs ou refatorar código em vários arquivos. Tudo isso seguindo os guias de estilo específicos da sua equipe

- Voxtral Mini: Identifica diferentes locutores em uma gravação e transforma gravações de reuniões privadas em texto pesquisável. Funciona totalmente offline, o que é ideal para evitar vazamentos de dados

- Nomic Embed v1.5: Transforma seus documentos privados em dados matemáticos para pesquisa semântica. Isso permite que você pesquise na base de conhecimento interna da sua equipe por significado, em vez de apenas por palavras-chave

Ferramentas populares para executar IA local

Você não precisa mais ser um engenheiro de software para executar modelos em sua própria máquina. Vários aplicativos fáceis de usar agora cuidam da configuração técnica para você em poucos minutos.

Ollama e OpenWebUI

O Ollama é ideal se você busca velocidade e flexibilidade. Ele é executado em segundo plano e gerencia sua biblioteca de modelos por meio de uma interface simples.

Embora comece como uma ferramenta básica, a maioria das pessoas a combina com o OpenWebUI. Isso adiciona uma experiência de chat sofisticada ao seu navegador, com aparência e funcionamento semelhantes às ferramentas baseadas na nuvem que você já conhece. Também cria uma ponte local para que outros aplicativos no seu computador se comuniquem com segurança com seus modelos de IA.

LM Studio

Se você prefere um aplicativo de desktop tradicional, o LM Studio é uma excelente alternativa. Ele funciona como uma loja de aplicativos para IA. Você pode usá-lo para pesquisar, baixar e interagir com um novo modelo com apenas alguns cliques.

O aplicativo inclui detecção de hardware integrada, por isso configura automaticamente suas definições para se adequarem à sua GPU ou RAM específica. Isso o torna um ótimo ponto de partida se você quiser experimentar diferentes modelos sem precisar mexer em uma única linha de código.

GPT4All

Para equipes focadas exclusivamente em privacidade e análise de documentos, o GPT4All é uma solução confiável e simples. Ele funciona em praticamente qualquer computador, incluindo laptops mais antigos que talvez não tenham uma placa de vídeo dedicada.

Seu recurso mais útil é a capacidade de interagir diretamente com seus arquivos locais. Você pode indicar ao aplicativo uma pasta no seu disco rígido, e a IA responderá a perguntas sobre esses documentos específicos. Tudo isso sem precisar enviá-los para um servidor de terceiros.

Como configurar a IA local para fluxos de trabalho seguros

Este passo a passo utiliza o Ollama, pois é uma ferramenta amplamente compatível para a criação de fluxos de trabalho de IA locais e seguros.

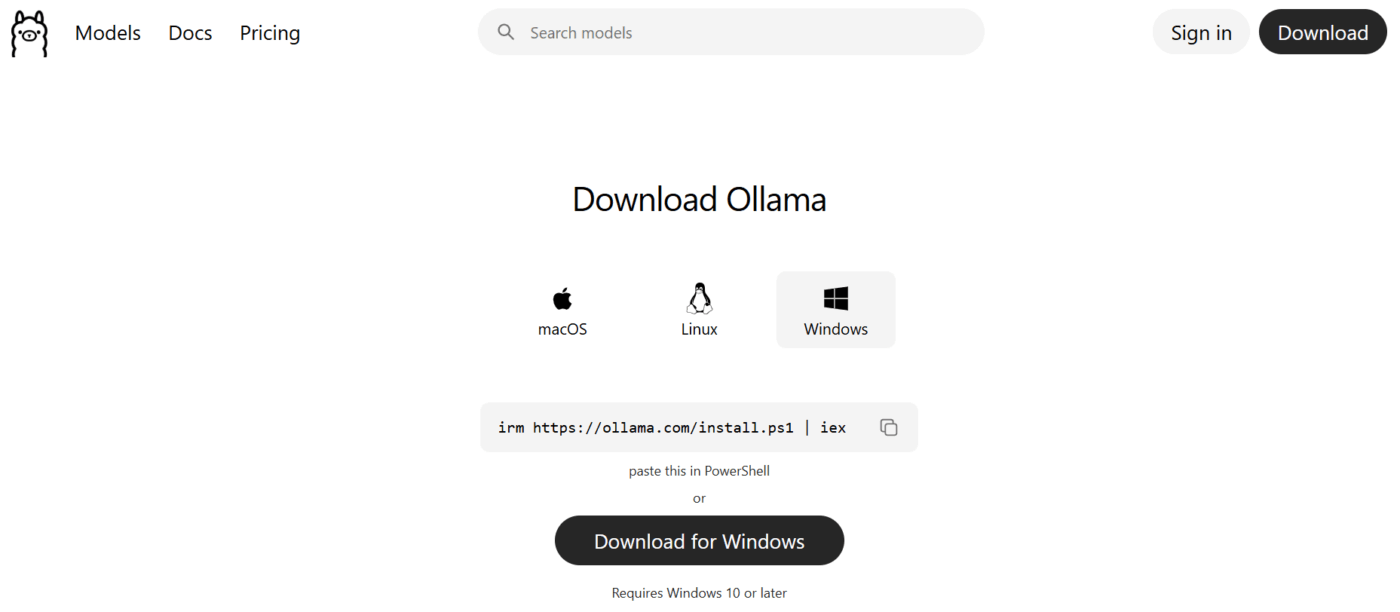

Passo 1: Instale o Ollama

Baixe o instalador do site oficial para o seu sistema operacional específico. Enquanto as versões anteriores do Windows exigiam a configuração manual do subsistema Linux, a versão atual é instalada como um aplicativo nativo.

A instalação deve levar apenas alguns minutos. Quando a instalação estiver concluída, abra seu terminal ou prompt de comando e digite ollama --version para confirmar se está tudo pronto.

Etapa 2: Baixe e execute um modelo

Para começar a usar uma IA, você precisa transferir seus pesos para sua máquina. Para seu primeiro teste, experimente um modelo compacto, mas poderoso, como o Llama 3.2 (3B) ou o mais recente Mistral.

Use o comando ollama run llama3.2 para iniciar o download.

Dependendo da velocidade da sua internet, isso geralmente leva alguns minutos. Assim que o download terminar, você pode digitar um comando diretamente no terminal para obter uma resposta imediata do modelo no seu disco rígido.

Etapa 3: Conecte-se à sua ferramenta de fluxo de trabalho

O verdadeiro valor da IA local vem de sua integração às suas tarefas diárias. Quando o Ollama está em execução, ele inicia automaticamente um servidor local em http://localhost:11434. Isso cria uma ponte segura para que outros aplicativos se comuniquem com o seu modelo.

Como este servidor é compatível com os protocolos padrão da OpenAI, você pode conectá-lo a plataformas de automação ou scripts internos simplesmente trocando o endereço da API. Por exemplo, você pode direcionar uma ferramenta de pesquisa de documentos local para este endereço. Isso permite que ela resuma arquivos privados sem nunca enviar esse texto para a nuvem.

Práticas recomendadas de segurança para fluxos de trabalho de IA local

Executar IA localmente é um grande passo à frente para a privacidade. No entanto, armazenar dados localmente significa que agora você é responsável por protegê-los. Embora você tenha eliminado o risco de uma violação de segurança na nuvem por terceiros, ainda precisa proteger seu hardware e a forma como sua equipe interage com os modelos.

Siga estas práticas recomendadas:

- Isolamento de rede: Restrinja o acesso à API a redes internas confiáveis para que seu servidor de IA permaneça inacessível a partir da internet pública

- Validação de entrada: Limpe todos os dados antes de enviá-los ao modelo. Isso bloqueia instruções maliciosas ocultas em documentos ou e-mails

- Controles de acesso: Implemente a autenticação em seu terminal de IA para garantir que apenas usuários autorizados possam acionar ações do modelo

- Registro de auditoria: Mantenha um registro de todas as interações do modelo para auxiliar nas investigações de conformidade e segurança

- Isolamento de contêineres: execute seus modelos em ambientes isolados, como o Docker. Isso impede que uma possível violação atinja os arquivos do seu sistema principal

- Atualizações regulares: Instale os patches mais recentes para ferramentas como o Ollama para se manter protegido contra vulnerabilidades recém-descobertas

- Limitação de taxa: Para evitar que um único usuário ou script sobrecarregue seu servidor com solicitações, implemente a limitação de taxa para controlar quantas consultas podem ser feitas em um determinado período

🔎 Você sabia? Manipulações baseadas em prompts não são mais uma ameaça teórica. Uma pesquisa recente da Gartner revelou que 32% das organizações sofreram um ataque malicioso por meio de prompts em aplicativos de IA no último ano. Esses ataques podem manipular seu modelo local para gerar resultados tendenciosos ou não autorizados.

Como criar fluxos de trabalho de IA seguros para sua equipe

Assim que seu servidor local estiver em funcionamento, você poderá integrá-lo ao seu trabalho diário. Isso transforma uma ferramenta simples em um mecanismo de produtividade privado. A maneira mais eficaz de fazer isso é por meio da Geração Aumentada por Recuperação (RAG).

Esse processo conecta sua IA local a um banco de dados privado com seus próprios arquivos. Você pode responder a perguntas usando o contexto específico da sua empresa sem precisar enviar nem um único byte para a nuvem.

Você também pode criar fluxos de trabalho com intervenção humana, nos quais o trabalho da IA é revisado por membros da equipe. Isso garante precisão e, ao mesmo tempo, acelera significativamente sua produção.

Aqui estão alguns exemplos práticos:

- Análise de documentos: resuma relatórios internos ou feedback de clientes para extrair insights importantes instantaneamente

- Geração de rascunhos: Crie primeiras versões de e-mails ou atualizações de projetos para que os membros da equipe possam aperfeiçoá-las

- Classificação de dados: categorize tarefas recebidas automaticamente com base no conteúdo específico da solicitação

- Preparação para a reunião: Gere pontos de discussão analisando arquivos de projetos relacionados armazenados em sua unidade local

- Revisão de código: Receba feedback sobre código-fonte proprietário sem expor sua propriedade intelectual a terceiros

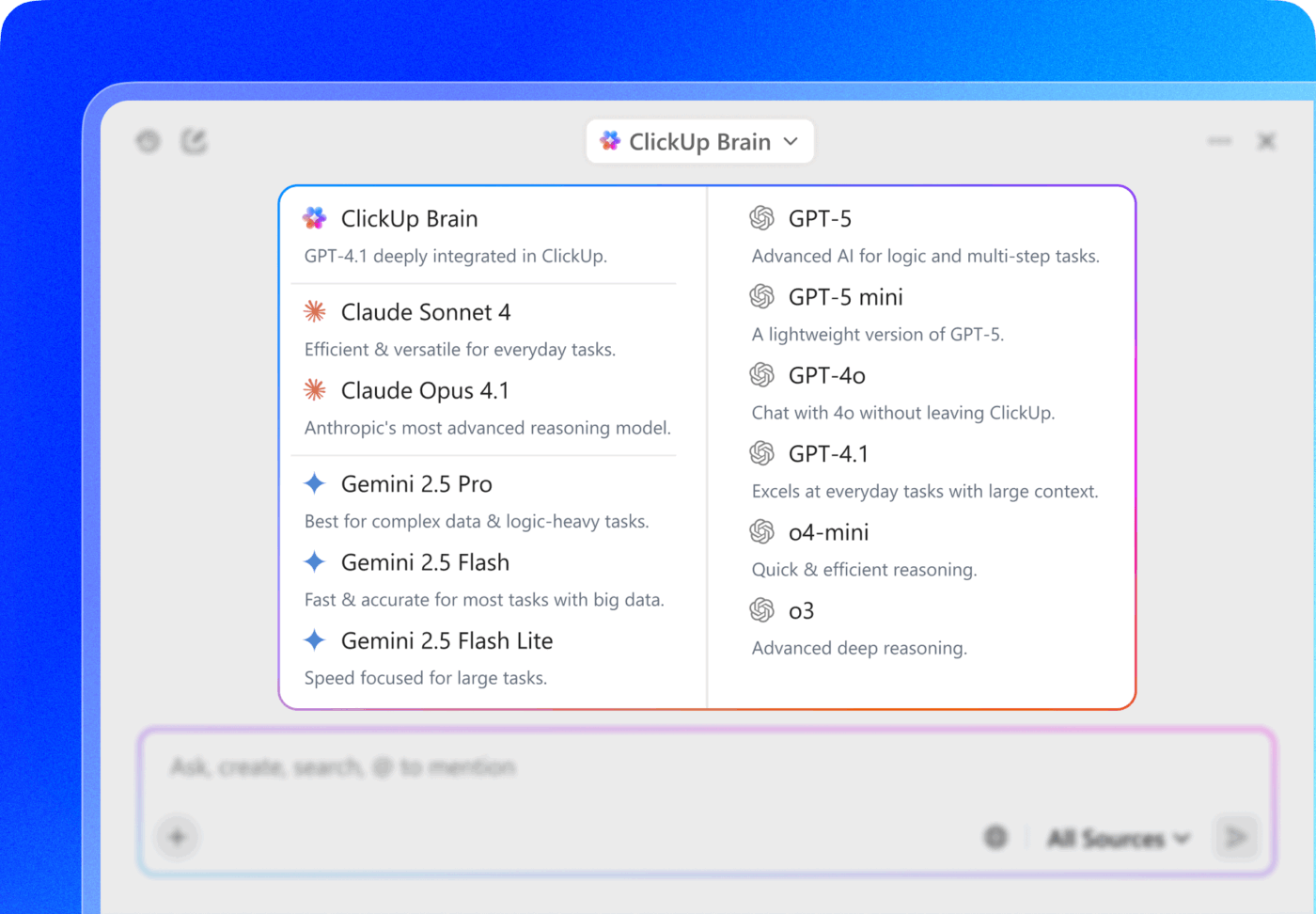

📮ClickUp Insight: Nossa pesquisa sobre maturidade em IA mostra que o acesso à IA no trabalho ainda é limitado — 36% das pessoas não têm acesso algum, e apenas 14% afirmam que a maioria dos funcionários pode realmente experimentá-la. Quando a IA fica restrita a permissões, ferramentas adicionais ou configurações complicadas, as equipes não têm a chance de nem mesmo experimentá-la no trabalho real do dia a dia.

O ClickUp Brain elimina todo esse atrito ao integrar a IA diretamente no espaço de trabalho que você já utiliza. Você pode acessar vários modelos de IA, gerar imagens, escrever ou depurar código, pesquisar na web, resumir documentos e muito mais — sem precisar trocar de ferramenta ou perder o foco.

É o seu parceiro de IA ambiental, fácil de usar e acessível a todos na equipe.

Limitações do uso de IA local para fluxos de trabalho de IA

A IA local é uma ferramenta poderosa, mas não é uma solução mágica para todos os problemas. Compreender suas limitações ajuda você a decidir quando manter uma tarefa no seu próprio hardware e quando usar a nuvem. Para algumas equipes, as desvantagens técnicas e financeiras podem superar os benefícios de privacidade.

- Limite de capacidade: Modelos proprietários de ponta ainda mantêm uma ligeira vantagem em raciocínio complexo e nuances criativas em comparação com versões de código aberto

- Investimento em hardware: O desempenho rápido em modelos de grande porte requer GPUs caras com VRAM significativa. Isso pode representar um alto custo inicial para equipes pequenas

- Custos de manutenção: Você é responsável por todas as atualizações de software, solução de problemas de hardware e aplicação de patches de segurança, sem o suporte da equipe de suporte do provedor

- Conhecimento técnico: A otimização de um ambiente local requer conhecimento prático sobre quantização de modelos e configuração de servidores

- Gerenciamento de segurança: Ao contrário dos serviços em nuvem, os modelos locais não vêm com moderação integrada. Você deve implementar seus próprios filtros de conteúdo e medidas de proteção

- Consumo de energia: Executar modelos de IA em grande escala em seus próprios servidores ou estações de trabalho pode aumentar significativamente o consumo de eletricidade e as necessidades de refrigeração

Muitas equipes utilizam uma abordagem híbrida: IA local para dados confidenciais e IA na nuvem para tarefas menos confidenciais que exigem capacidade máxima. Aqui está uma rápida visão geral da comparação entre as duas:

| Fator | IA local | IA na nuvem |

|---|---|---|

| Privacidade de dados | Controle total | Dados enviados ao provedor |

| Complexidade da configuração | Mais alto | Reduzir |

| Custos contínuos | Hardware + eletricidade | Taxas por token |

| Recursos do modelo | Bom, em evolução | Tecnologia de ponta |

| Manutenção | Autogerenciado | Gerenciado pelo provedor |

Como o ClickUp oferece suporte a fluxos de trabalho seguros com tecnologia de IA

Atualmente, a maioria das equipes se depara com um dilema: usar uma IA poderosa na nuvem e se preocupar com o destino dos dados, ou configurar modelos locais e lidar com os custos operacionais contínuos. O ClickUp contorna esse dilema ao atuar como um espaço de trabalho de IA convergente — onde a IA já está integrada ao sistema em que seu trabalho é realizado.

O ClickUp Brain é a camada de IA integrada diretamente ao espaço de trabalho do ClickUp, projetada para entender suas tarefas, documentos e comunicação da equipe em um único lugar. Ele oferece assistência de IA com contexto completo — sem ferramentas separadas, sem integrações frágeis.

Para equipes que buscam criar fluxos de trabalho de IA seguros, essa combinação de contexto e controle é o que distingue a experimentação da adoção real.

🌟 O ClickUp também está em conformidade com a norma SOC 2 e segue as normas ISO 42001 para o gerenciamento responsável de IA. Isso garante que seus dados nunca sejam usados para treinar modelos de terceiros, permitindo que você automatize seu trabalho com a mesma confiança de uma configuração local.

Acesse fluxos de trabalho de pesquisa e autônomos com o ClickUp Brain

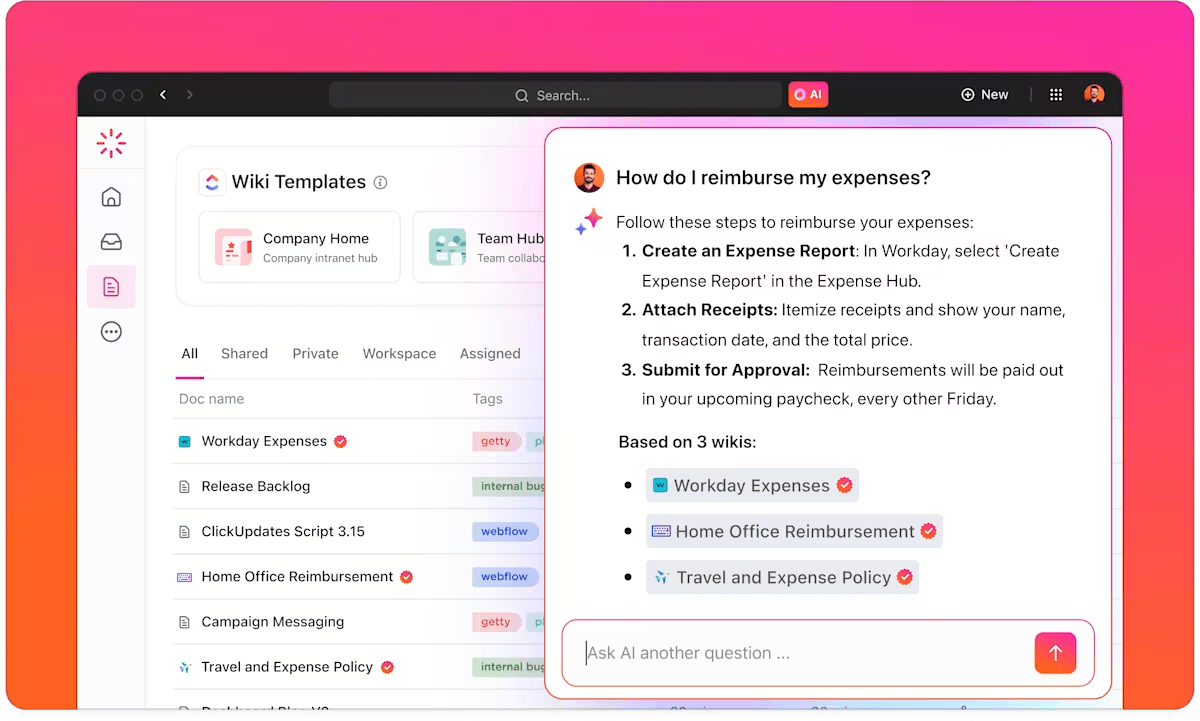

Assim que seus dados estiverem protegidos no espaço de trabalho, o ClickUp Brain extrai valor de suas tarefas e documentos em tempo real.

Como a IA está integrada, ela evita a lacuna de contexto que retarda as configurações locais. Você pode fazer perguntas que exigem uma visão completa do histórico do seu projeto para serem respondidas com precisão:

- Identifique as decisões finais a partir de um longo resumo técnico sem precisar percorrer as versões

- Elabore atualizações para as partes interessadas a partir de comentários de tarefas e alterações de status

O ClickUp Brain gera respostas baseadas nos dados do seu espaço de trabalho, analisando o conteúdo específico dos seus documentos, tarefas e chats. Isso garante que, à medida que seu projeto evolui, a IA sempre tenha o contexto mais recente.

Isso permite que sua equipe aproveite os insights sem precisar explicar manualmente o histórico do projeto ou transferir dados entre ferramentas desconectadas.

💡Dica profissional: Você pode ampliar ainda mais o contexto do seu espaço de trabalho usando a Pesquisa de IA Empresarial para extrair informações de todas as suas ferramentas externas.

Por exemplo, faça uma pergunta complexa como “Mostre-me todas as negociações em andamento no pipeline”, e o ClickUp Brain fará uma busca em seus aplicativos conectados, incluindo Slack, Google Drive e Gmail, para fornecer uma resposta confiável em tempo real com referências.

Isso transforma dados fragmentados em várias plataformas em uma única camada de inteligência pesquisável, na qual você pode encontrar qualquer arquivo, mensagem ou tarefa sem precisar sair do seu espaço de trabalho.

Gerencie tarefas de forma inteligente com automação e IA

O ClickUp Brain não se limita a ajudar passivamente — ele atua ativamente dentro do seu sistema de tarefas. Ele pode:

- Gere tarefas a partir de notas de reuniões ou do Docs

- Divida grandes entregas em subtarefas

- Sugira responsáveis pelas tarefas com base em atividades anteriores

- Recomende prazos com base no contexto do projeto

Ele também pode atualizar o status das tarefas, resumir longas sequências de comentários em próximas etapas claras e sinalizar bloqueadores antes que eles retardem a execução.

Quando combinado com o ClickUp Automation, isso se torna um sistema de ciclo fechado: a IA pode acionar fluxos de trabalho (como atribuir tarefas, notificar as partes interessadas ou atualizar prioridades) com base em mudanças dentro do seu espaço de trabalho.

Por exemplo, quando um documento é finalizado, tarefas podem ser criadas e atribuídas automaticamente, sem que ninguém precise transferir dados manualmente entre ferramentas.

💟 Bônus: Transforme o ClickUp Brain MAX na sua “memória de decisões”.

Use-o para:

- Resuma longas sequências de comentários em decisões claras e próximos passos

- Atualize a documentação com “o que mudou e por quê” após marcos importantes

- Gere registros semanais de decisões a partir de tarefas, reuniões e atualizações

Com o tempo, isso cria uma camada dinâmica de conhecimento institucional que o Brain MAX pode consultar. Assim, em vez de responder a solicitações de forma isolada, ele começa a responder com consciência das decisões, prioridades e padrões do passado.

É aí que a IA passa de útil a confiável — especialmente em fluxos de trabalho de IA seguros, onde o contexto e a rastreabilidade são importantes.

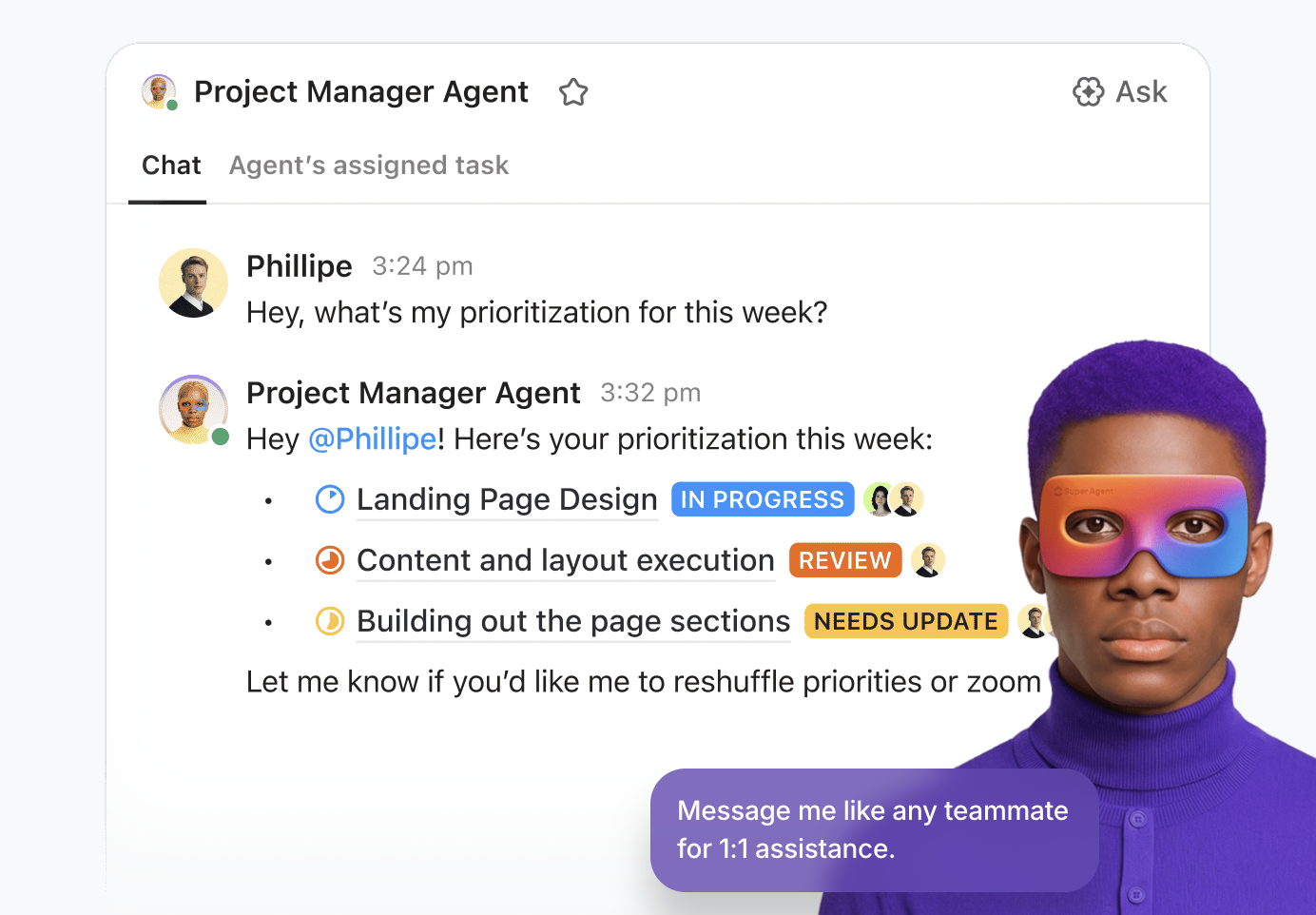

Obtenha execução segura e sensível ao contexto em escala com os Super Agents

Os Super Agentes do ClickUp levam o ClickUp Brain um passo adiante — passando da assistência ao trabalho para impulsioná-lo ativamente. Esses agentes podem ser configurados para monitorar fluxos de trabalho, realizar ações e orquestrar tarefas em todo o seu espaço de trabalho com base em regras predefinidas e no contexto em tempo real.

Por exemplo, um Super Agent pode:

- Monitore solicitações recebidas ou documentos e converta-os automaticamente em tarefas estruturadas com responsáveis e prazos

- Acompanhe o andamento do projeto e sinalize riscos ou atrasos antes que eles se agravem

- Acionar automações em várias etapas quando as condições forem atendidas — como notificar as partes interessadas, atualizar prioridades ou criar tarefas de acompanhamento

Esses agentes são executados inteiramente dentro do espaço de trabalho unificado do ClickUp, com total conhecimento de suas tarefas, documentos e estrutura de permissões. Isso significa que:

- Você não precisa exportar dados para sistemas de IA externos ou ferramentas de orquestração

- Eles acessam apenas os dados para os quais têm autorização

- Eles atuam dentro dos mesmos limites de permissão que sua equipe

Saiba mais sobre como trabalhar com Super Agents:

Aproveite os benefícios da assistência de IA em seus documentos

Com o ClickUp Docs, a assistência de IA é integrada diretamente aos seus fluxos de trabalho de documentação. As equipes podem elaborar resumos de projetos, sintetizar relatórios longos, extrair itens de ação ou reescrever conteúdo para diferentes públicos — tudo isso sem sair da plataforma.

Isso é importante para fluxos de trabalho seguros de IA porque um dos maiores riscos vem da cópia e colagem de informações confidenciais em ferramentas externas. No ClickUp, você minimiza a movimentação de dados e mantém controle total sobre o acesso por meio das Permissões.

Veredicto final: Construindo sua pilha de IA privada

A IA local aproveita a inteligência artificial, mantendo controle total sobre a privacidade e a conformidade dos dados. No entanto, esse caminho exige um investimento significativo em hardware, configuração técnica e manutenção contínua.

As práticas de segurança continuam sendo fundamentais, independentemente de você usar IA local ou na nuvem. A estratégia mais eficaz geralmente envolve uma abordagem híbrida: usar IA local para as operações mais sensíveis e, ao mesmo tempo, aproveitar soluções gerenciadas e seguras para a produtividade diária.

É fundamental considerar as vantagens e desvantagens — para muitas equipes, a sobrecarga de uma solução “faça você mesmo” pode não ser a escolha certa.

Para quem deseja uma produtividade de IA poderosa sem o peso da infraestrutura, soluções gerenciadas como o ClickUp Brain oferecem um meio-termo atraente. Ele oferece segurança de nível empresarial sem nenhuma complexidade de configuração.

Comece a usar o ClickUp gratuitamente e explore fluxos de trabalho seguros e contextuais, impulsionados por IA, para sua equipe.

Perguntas frequentes

Qual é a diferença entre IA local e IA baseada na nuvem para fluxos de trabalho em equipe?

A IA local é executada inteiramente em seu próprio hardware, garantindo que os dados nunca saiam da sua rede interna, enquanto a IA baseada na nuvem envia solicitações a servidores de terceiros para processamento. As configurações locais oferecem soberania total sobre os dados e acesso offline, ao passo que os serviços em nuvem oferecem maior poder computacional e facilidade de uso, mas sem o controle direto dos dados.

Como as equipes podem usar modelos de IA local com dados confidenciais de projetos?

As equipes podem usar IA local para processar documentos confidenciais, código proprietário e registros financeiros, direcionando o modelo para diretórios privados no local. Como a inferência ocorre no dispositivo, você pode realizar tarefas como resumo automatizado, extração de dados e pesquisas internas de conhecimento sem correr o risco de exposição a conjuntos de treinamento LLM públicos.

Os modelos de IA local são tão capazes quanto o ChatGPT para tarefas de trabalho?

Muitos modelos locais de código aberto, como o Llama 3 e o Mistral, são agora altamente capazes de lidar com tarefas rotineiras, como redação, programação e resumo. Embora modelos de nuvem de ponta, como o GPT-4o, ainda liderem em raciocínio ultracomplexo, os modelos locais oferecem desempenho comparável para 90% das operações comerciais diárias, com privacidade significativamente melhor.

Quais são as vantagens e desvantagens de executar IA localmente em comparação com o uso de serviços de IA na nuvem?

A principal escolha é entre a privacidade total dos dados com IA local e a escalabilidade sem manutenção da IA na nuvem. Executar IA localmente requer um investimento inicial em hardware e conhecimento técnico, mas elimina taxas recorrentes de API e riscos de vazamento de dados. A IA na nuvem é mais rápida de implantar, mas envolve custos contínuos de assinatura e dependências de dados de terceiros.