Kebijakan AI mungkin terlihat seperti masalah teknis. Namun, dampaknya memang muncul di dunia nyata dan seringkali dapat sangat merusak.

Ketika sistem AI condong ke arah yang salah, bahkan sedikit saja, hal itu dapat menyebabkan hasil yang tidak adil.

Dan seiring waktu, masalah-masalah kecil tersebut dapat berubah menjadi pelanggan yang kecewa, masalah reputasi, atau bahkan pertanyaan kepatuhan yang tidak Anda duga sebelumnya.

Sebagian besar tim tidak bermaksud membangun AI yang bias. Hal ini terjadi karena data yang tidak teratur, dunia nyata yang tidak merata, dan alat yang kita gunakan tidak selalu bekerja sesuai ekspektasi kita. Kabar baiknya, Anda tidak perlu menjadi ilmuwan data untuk memahami apa yang terjadi.

Dalam blog ini, kami akan memandu Anda memahami apa itu bias AI, mengapa hal itu terjadi, dan bagaimana bias tersebut dapat muncul dalam alat bisnis sehari-hari.

Apa Itu Bias AI?

Bias AI terjadi ketika sistem kecerdasan buatan menghasilkan hasil yang sistematis dan tidak adil yang secara konsisten menguntungkan atau merugikan kelompok tertentu. Ini bukan sekadar kesalahan acak; melainkan pola yang dapat diprediksi yang tertanam dalam cara AI mengambil keputusan. Penyebabnya? AI belajar dari data yang mencerminkan bias manusia yang sudah ada, bias tak sadar lainnya, dan ketidaksetaraan sosial.

Bayangkan seperti ini: jika Anda melatih algoritma perekrutan menggunakan data perusahaan selama sepuluh tahun di mana 90% manajer adalah pria, AI mungkin secara salah belajar bahwa menjadi pria adalah kualifikasi utama untuk peran manajerial. AI tidak bermaksud jahat; ia hanya mengidentifikasi dan mengulang pola yang ditunjukkan kepadanya.

Inilah yang membuat bias AI begitu rumit:

- Ini sistematis, bukan acak: Ketidakadilan bukanlah kesalahan tunggal, melainkan pola yang dapat diulang dalam output AI.

- Seringkali tidak terlihat: Hasil yang bias dapat tersembunyi di balik matematika kompleks dari algoritma yang tampaknya netral, sehingga sulit untuk dideteksi.

- Hal ini berakar pada data dan desain: Bias masuk ke dalam sistem melalui pilihan yang kita buat sebagai manusia saat membangun dan melatih AI.

⭐ Template Terpilih

Template Laporan Tanggap Insiden ClickUp menyediakan struktur siap pakai untuk mendokumentasikan, melacak, dan menyelesaikan insiden dari awal hingga akhir. Catat semua detail insiden yang relevan, pertahankan status yang dikategorikan dengan jelas, dan catat atribut penting seperti tingkat keparahan, kelompok yang terdampak, dan langkah-langkah pemulihan. Template ini mendukung Bidang Kustom untuk hal-hal seperti Disetujui oleh, Catatan insiden, dan Dokumen pendukung, yang membantu mengidentifikasi pertanggungjawaban dan bukti selama proses tinjauan.

📖 Baca Lebih Lanjut: Cara Melakukan Penilaian Risiko: Alat & Teknik

Mengapa Mengurangi Bias AI Penting

Ketika sistem AI Anda tidak adil, Anda berisiko merugikan kehidupan orang-orang nyata.

Hal ini, pada gilirannya, dapat menimbulkan tantangan bisnis yang serius bagi organisasi Anda dan bahkan menghancurkan kepercayaan yang telah Anda bangun dengan susah payah bersama pelanggan Anda.

AI yang bias yang menolak pinjaman seseorang, menolak lamaran kerja mereka, atau memberikan rekomendasi yang salah dapat menimbulkan konsekuensi serius di dunia nyata.

Standar dan kerangka kerja industri yang sedang berkembang kini mendorong organisasi untuk secara aktif mengidentifikasi dan menangani bias dalam sistem AI mereka. Risiko-risiko ini dapat menyerang organisasi Anda dari segala arah:

- Risiko regulasi: Tidak memenuhi standar AI baru dapat menyebabkan tantangan bisnis yang signifikan.

- Kerusakan reputasi: Setelah publik mengetahui bahwa AI Anda bias, sangat sulit untuk memenangkan kembali kepercayaan mereka.

- Ketidak efisienan operasional: Model yang bias menghasilkan hasil yang tidak dapat diandalkan atau halusinasi AI yang menyebabkan keputusan buruk dan memerlukan perbaikan yang mahal.

- Tanggung jawab etis: Organisasi Anda harus memastikan bahwa teknologi yang Anda terapkan memperlakukan semua pengguna secara adil.

Ketika Anda berhasil mengelola bias AI dengan benar, Anda akan membangun sistem AI yang dapat diandalkan oleh orang-orang. AI yang adil membuka pintu ke pasar baru, meningkatkan kualitas keputusan Anda, dan menunjukkan kepada semua orang bahwa Anda berkomitmen untuk menjalankan bisnis yang etis.

📮 ClickUp Insight: 22% responden kami masih waspada saat menggunakan AI di tempat kerja. Dari 22% tersebut, setengah di antaranya khawatir tentang privasi data mereka, sementara setengah lainnya tidak yakin dapat mempercayai apa yang dikatakan AI.

ClickUp menangani kedua masalah tersebut secara langsung dengan langkah-langkah keamanan yang kuat dan dengan menghasilkan tautan detail ke tugas dan sumber dengan setiap jawaban.

Ini berarti bahkan tim yang paling berhati-hati pun dapat mulai menikmati peningkatan produktivitas tanpa perlu khawatir apakah informasi mereka aman atau apakah hasil yang mereka dapatkan dapat diandalkan.

📖 Baca Lebih Lanjut: Asisten Kepatuhan AI: Bagaimana AI Mengubah Kepatuhan & Audit

Jenis dan Sumber Bias AI

Bias dapat masuk ke sistem AI Anda dari berbagai arah.

Dari saat Anda mulai mengumpulkan data hingga jauh setelah sistem diimplementasikan, elemen ini tetap relatif stabil. Namun, jika Anda tahu di mana harus mencari, Anda dapat mengarahkan upaya Anda dan menghentikan permainan tak berujung "whack-a-mole" dengan hasil yang tidak adil.

Kebijakan pengambilan sampel

Kebijakan sampel adalah kondisi yang terjadi ketika data yang digunakan untuk melatih AI tidak secara akurat mewakili dunia nyata di mana AI tersebut akan digunakan.

Misalnya, jika Anda membangun sistem pengenalan suara yang dilatih sebagian besar menggunakan data dari penutur bahasa Inggris Amerika, sistem tersebut secara alami akan kesulitan memahami orang dengan aksen Skotlandia atau India, mirip dengan cara LLMs lebih sering memilih nama yang terkait dengan orang kulit putih (85,1%) dalam proses penyaringan CV. Kurangnya representasi ini menciptakan titik buta yang besar, sehingga model Anda tidak siap melayani kelompok-kelompok tertentu.

Kebijakan algoritma

Kebijakan algoritmik terjadi ketika desain model atau proses matematisnya memperkuat pola yang tidak adil, meskipun data tampaknya netral.

Kode pos seseorang tidak seharusnya menentukan apakah mereka mendapatkan pinjaman, tetapi jika kode pos dalam data pelatihan Anda memiliki korelasi yang kuat dengan ras, algoritma mungkin belajar menggunakan lokasi sebagai proxy untuk diskriminasi.

Masalah ini menjadi lebih parah dengan adanya loop umpan balik—ketika prediksi yang bias (seperti penolakan pinjaman) dimasukkan kembali ke dalam sistem sebagai data baru, bias tersebut semakin memburuk seiring waktu.

Kebijakan keputusan manusia

Setiap keputusan yang diambil seseorang saat membangun sistem AI dapat memperkenalkan bias.

Hal ini meliputi keputusan tentang data apa yang akan dikumpulkan, cara memberi label pada data tersebut, dan cara mendefinisikan "kesuksesan" bagi model. Misalnya, sebuah tim mungkin secara tidak sadar lebih memilih data yang mendukung apa yang sudah mereka yakini (bias konfirmasi) atau memberikan bobot yang terlalu besar pada informasi pertama yang mereka lihat (bias penambatan).

Bahkan tim yang paling bermaksud baik pun dapat secara tidak sengaja memasukkan asumsi dan perspektif mereka sendiri ke dalam sistem AI.

📖 Baca Lebih Lanjut: 10 Template Tata Kelola Proyek untuk Mengelola Tugas

Contoh Bias AI di Dunia Nyata

Perusahaan-perusahaan nyata telah menghadapi konsekuensi serius ketika sistem AI mereka menunjukkan bias, mengakibatkan kerugian jutaan dolar dan hilangnya kepercayaan pelanggan. Berikut beberapa contoh yang tercatat:

1. Alat perekrutan yang bias

Salah satu kasus yang paling sering dikutip melibatkan sebuah perusahaan teknologi besar yang menghapus sistem perekrutan AI internalnya setelah sistem tersebut belajar untuk lebih memilih kandidat pria daripada wanita. Sistem tersebut dilatih menggunakan data resume selama satu dekade di mana sebagian besar pelamar yang berhasil adalah pria. Akibatnya, sistem mulai menghukum resume yang mengandung kata-kata seperti “wanita,” bahkan menurunkan peringkat lulusan dari perguruan tinggi wanita.

Hal ini menunjukkan bagaimana bias data historis, ketika pola masa lalu mencerminkan ketidaksetaraan yang sudah ada, dapat merembes ke dalam otomatisasi kecuali diaudit dengan cermat. Namun, seiring dengan semakin luasnya penggunaan perekrutan otomatis berbasis AI, skala masalah ini menjadi semakin besar.

🌼 Tahukah Anda: Data terbaru menunjukkan bahwa 37% organisasi kini "aktif mengintegrasikan" atau "menguji coba" alat Gen AI dalam perekrutan, naik dari 27% setahun yang lalu.

2. Pengenalan wajah yang tidak mengenali setengah populasi

Penelitian yang dipimpin oleh Joy Buolamwini dan didokumentasikan dalam studi Gender Shades mengungkapkan bahwa sistem pengenalan wajah komersial memiliki tingkat kesalahan hingga 34,7% untuk wanita berkulit gelap, dibandingkan dengan kurang dari 1% untuk pria berkulit terang.

Ini sekali lagi merupakan refleksi dari dataset pelatihan yang tidak seimbang. Bias dalam alat biometrik memiliki dampak yang lebih luas.

Kepolisian dan lembaga pemerintah juga menghadapi masalah dengan sistem pengenalan wajah yang bias. Penyelidikan dari The Washington Post menemukan bahwa beberapa sistem ini jauh lebih mungkin salah mengidentifikasi orang dari kelompok marjinal. Dalam beberapa kasus nyata, hal ini menyebabkan penangkapan yang salah, reaksi publik yang negatif, dan kekhawatiran besar tentang bagaimana alat-alat ini memengaruhi hak-hak warga.

📖 Baca Lebih Lanjut: AI di Tempat Kerja: Cara Meningkatkan Produktivitas dan Efisiensi

3. Algoritma kesehatan yang kurang memprioritaskan perawatan

Sistem AI kesehatan yang dirancang untuk memprediksi pasien mana yang membutuhkan perawatan ekstra juga menunjukkan bias.

Dalam satu kasus yang tercatat dengan baik, algoritma prediksi kesehatan yang banyak digunakan mengalami kesalahan signifikan. Algoritma tersebut seharusnya membantu menentukan pasien mana yang memerlukan perawatan tambahan, namun pada akhirnya secara sistematis memberikan prioritas lebih rendah kepada pasien kulit hitam, bahkan ketika mereka sama sakit atau lebih sakit daripada pasien kulit putih.

Hal itu terjadi karena model tersebut menggunakan pengeluaran kesehatan sebagai proxy untuk kebutuhan medis. Karena pasien kulit hitam secara historis memiliki pengeluaran kesehatan yang lebih rendah akibat akses yang tidak setara terhadap perawatan, algoritma tersebut menganggap mereka sebagai kurang membutuhkan. Akibatnya, algoritma tersebut mengalihkan sumber daya perawatan dari mereka yang sebenarnya paling membutuhkannya. Para peneliti menemukan bahwa hanya dengan memperbaiki proxy ini dapat secara signifikan meningkatkan akses ke program perawatan yang adil.

Kekhawatiran tentang isu-isu ini telah mendorong kelompok hak asasi manusia untuk mendesak penerapan standar "keadilan terlebih dahulu" dalam AI kesehatan. Pada Desember 2025, NAACP merilis panduan rinci yang menyerukan kepada rumah sakit, perusahaan teknologi, dan pembuat kebijakan untuk mengadopsi audit bias, praktik desain transparan, kerangka kerja inklusif, dan alat tata kelola AI guna mencegah memperburuk ketidaksetaraan kesehatan rasial.

4. Algoritma kredit dengan hasil yang tidak merata

AI dan pengambilan keputusan otomatis tidak hanya membentuk apa yang Anda lihat di media sosial, tetapi juga memengaruhi siapa yang mendapatkan akses ke dana dan dengan syarat apa.

Salah satu contoh nyata yang paling dibicarakan berasal dari Apple Card , kartu kredit digital yang diterbitkan oleh Goldman Sachs.

Pada tahun 2019, pelanggan di media sosial melaporkan bahwa algoritma batas kredit kartu memberikan batas kredit yang jauh lebih tinggi kepada beberapa pria dibandingkan dengan istri atau pasangan perempuan mereka. Hal ini terjadi meskipun pasangan tersebut melaporkan profil keuangan yang serupa. Seorang insinyur perangkat lunak mengatakan dia menerima batas kredit 20 kali lebih tinggi daripada istrinya, dan bahkan pendiri Apple Steve Wozniak mengonfirmasi pengalaman serupa yang melibatkan pasangannya.

Polanya ini memicu protes publik dan mendorong penyelidikan regulasi oleh Departemen Layanan Keuangan Negara Bagian New York mengenai apakah algoritma tersebut mendiskriminasi perempuan, menyoroti bagaimana alat keuangan otomatis dapat menghasilkan hasil yang tidak adil.

📖 Baca Lebih Lanjut: Cara Menggunakan AI untuk Tata Kelola Data (Kasus Penggunaan & Alat)

5. Teks otomatis dan pengenalan suara yang mengesampingkan suara-suara tertentu

Sistem pengenalan suara dan penulisan teks otomatis seringkali tidak mendengarkan semua orang secara setara. Beberapa studi menunjukkan bahwa alat-alat ini cenderung berfungsi lebih baik untuk beberapa penutur daripada yang lain, tergantung pada faktor seperti aksen, dialek, ras, dan apakah bahasa Inggris adalah bahasa pertama penutur.

Hal itu terjadi karena sistem komersial biasanya dilatih menggunakan dataset yang didominasi oleh pola ucapan tertentu—seringkali bahasa Inggris standar Barat—sehingga suara-suara lain menjadi kurang terwakili.

Misalnya, para peneliti di Stanford menguji lima sistem pengenalan suara ke teks terkemuka (dari Amazon, Google, Microsoft, IBM, dan Apple) dan menemukan bahwa sistem tersebut membuat hampir dua kali lipat kesalahan saat mentranskrip ucapan dari penutur kulit hitam dibandingkan dengan penutur kulit putih . Masalah ini terjadi bahkan ketika subjek mengucapkan kata-kata yang sama dalam kondisi yang sama.

Ketika teks terjemahan tidak akurat untuk pembicara tertentu, hal ini dapat menyebabkan pengalaman pengguna yang buruk dan ketidakaksesibilitas bagi orang yang bergantung pada teks terjemahan. Lebih parah lagi, hal ini dapat berkontribusi pada hasil yang bias dalam sistem yang menggunakan pengenalan suara dalam proses perekrutan, pendidikan, atau layanan kesehatan.

Setiap contoh ini menggambarkan cara berbeda bias dapat tertanam dalam sistem otomatis, melalui data pelatihan yang bias, proxy yang dipilih dengan buruk, atau pengujian yang tidak representatif. Dalam setiap kasus, hasilnya tidak hanya bersifat teknis—mereka membentuk peluang, merusak kepercayaan, dan membawa risiko bisnis dan etika yang nyata.

📖 Baca Lebih Lanjut: Risiko vs. Masalah – Apa Perbedaannya?

Ringkasan: Bagaimana bias AI muncul dan siapa yang dirugikan

| Di mana bias muncul | Siapa yang terpengaruh | Dampak nyata di dunia nyata |

|---|---|---|

| Algoritma perekrutan (alat perekrutan AI yang dihapus) | Perempuan | Curriculum vitae (CV) diturunkan peringkatnya berdasarkan kata kunci yang bermuatan gender, sehingga mengurangi akses ke wawancara dan peluang kerja. |

| Sistem pengenalan wajah (Gender Shades + kasus penangkapan yang salah) | Wanita berkulit gelap; kelompok ras yang terpinggirkan | Tingkat kesalahan identifikasi yang jauh lebih tinggi menyebabkan penangkapan yang tidak adil, kerusakan reputasi, dan masalah hak asasi manusia. |

| Algoritma prediksi risiko kesehatan (Studi Universitas Chicago) | Pasien kulit hitam | Pasien diprioritaskan lebih rendah untuk perawatan tambahan karena pengeluaran kesehatan digunakan sebagai proxy yang cacat untuk kebutuhan medis, yang memperburuk ketidaksetaraan kesehatan. |

| Algoritma batas kredit (penyelidikan Apple Card) | Perempuan | Pria menerima batas kredit yang jauh lebih tinggi daripada mitra perempuan yang memiliki kualifikasi sama, yang berdampak pada akses keuangan dan kemampuan pinjaman. |

| Pengenalan suara & teks otomatis (Studi Stanford ASR) | Pembicara dengan aksen non-standar; Pembicara kulit hitam | Tingkat kesalahan yang hampir dua kali lipat menciptakan hambatan aksesibilitas, kesalahpahaman, dan hasil yang bias dalam alat yang digunakan dalam perekrutan, pendidikan, dan akses digital sehari-hari. |

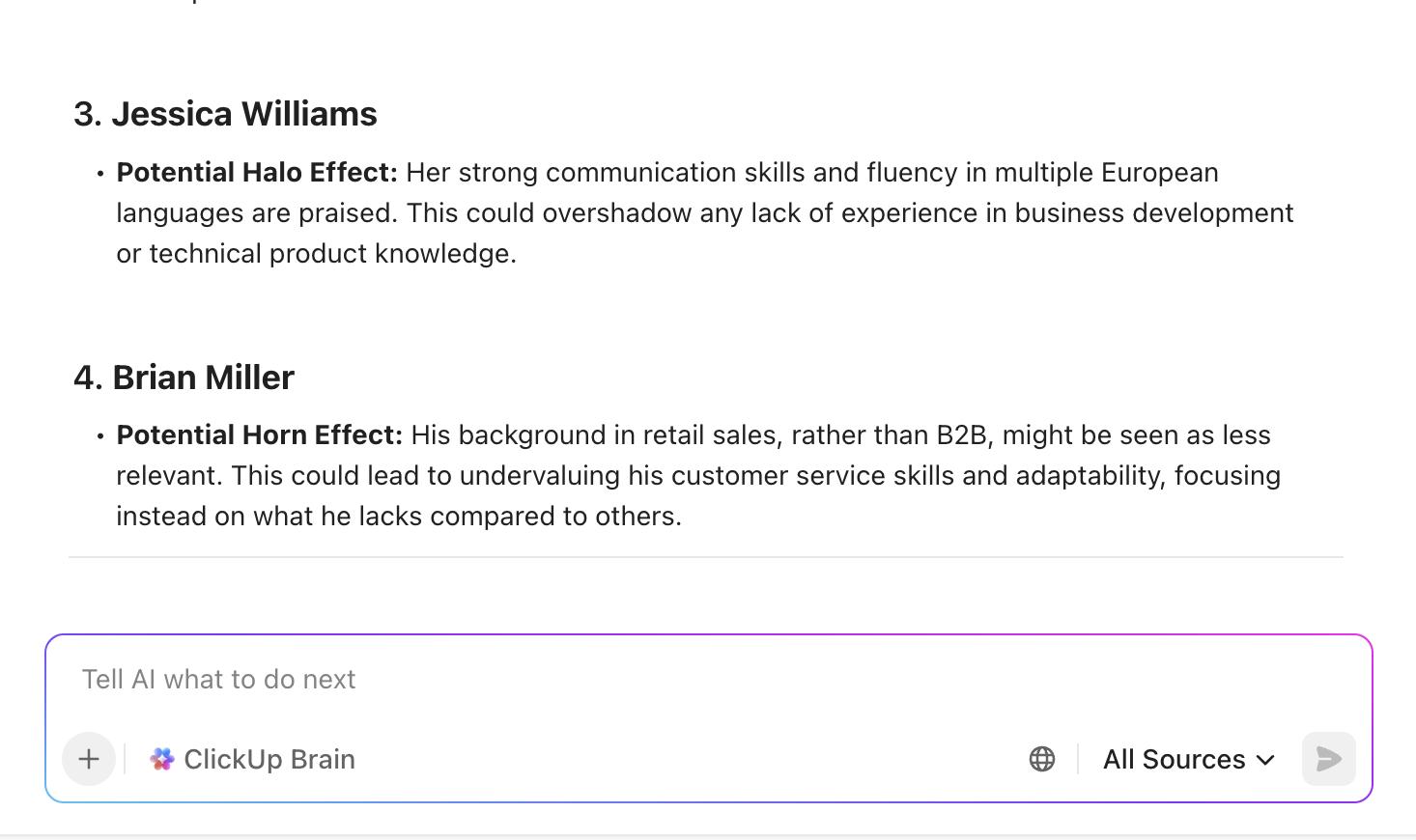

📖 Baca Lebih Lanjut: Cara Menghindari Efek Halo dan Horn untuk Mengurangi Bias

Strategi Mitigasi Bias yang Efektif

Tidak ada solusi ajaib tunggal untuk menghilangkan bias AI.

Mitigasi bias yang efektif memerlukan pertahanan berlapis yang diterapkan sepanjang siklus hidup AI. Dengan menggabungkan strategi-strategi yang telah teruji ini, Anda dapat secara signifikan mengurangi risiko hasil yang tidak adil.

Kumpulkan data pelatihan yang beragam

Data representatif adalah landasan mutlak untuk AI yang adil.

Model Anda tidak dapat belajar untuk melayani kelompok orang yang belum pernah dilihatnya dalam proses pelatihan. Mulailah dengan mengaudit dataset yang ada untuk menemukan celah demografis. Kemudian, lakukan upaya sadar untuk mengumpulkan data baru dari populasi yang kurang terwakili.

Ketika data dunia nyata sulit ditemukan, Anda dapat menggunakan teknik seperti augmentasi data (membuat salinan yang dimodifikasi dari data yang sudah ada) atau pembangkitan data sintetis untuk membantu mengisi celah.

🚧 Toolkit: Gunakan Template Daftar Periksa Audit Internal ClickUp untuk merencanakan proses audit Anda.

Uji model untuk bias

Anda harus melakukan pengujian bias secara sistematis untuk mendeteksinya sebelum menimbulkan dampak negatif yang nyata. Gunakan metrik keadilan untuk mengukur kinerja model Anda di berbagai kelompok.

Misalnya, pemeriksaan kesetaraan demografis memeriksa apakah model menghasilkan hasil positif (seperti persetujuan pinjaman) dengan tingkat yang sama di seluruh kelompok, sementara pemeriksaan peluang yang disetarakan memeriksa apakah tingkat kesalahan sama di seluruh kelompok.

Analisis kinerja model Anda berdasarkan setiap demografi yang mungkin—ras, jenis kelamin, usia, lokasi geografis—untuk mengidentifikasi di mana akurasi menurun atau ketidakadilan mulai muncul.

Tetap melibatkan manusia dalam proses (human-in-the-loop)

Sistem otomatis dapat melewatkan ketidakadilan yang halus dan spesifik konteks yang dapat langsung dikenali oleh manusia. Pendekatan "human-in-the-loop" sangat penting untuk keputusan berisiko tinggi, di mana AI dapat memberikan rekomendasi, tetapi manusia yang mengambil keputusan akhir.

Hal ini sangat penting dalam bidang seperti perekrutan, pemberian pinjaman, dan diagnosis medis. Agar hal ini berhasil, peninjau manusia Anda harus dilatih untuk mengenali bias dan memiliki wewenang untuk mengabaikan saran AI.

📖 Baca Lebih Lanjut: Cara Menggunakan AI Berorientasi Manusia di Tempat Kerja: Panduan Lengkap

Terapkan teknik keadilan algoritmik.

Anda juga dapat menggunakan metode teknis untuk secara langsung mengintervensi dan mengurangi bias. Teknik-teknik ini terbagi menjadi tiga kategori utama:

- Pra-pemrosesan: Ini melibatkan penyesuaian data pelatihan sebelum model melihatnya, seringkali dengan menyesuaikan bobot atau mengambil sampel ulang data untuk menciptakan representasi yang lebih seimbang dari berbagai kelompok.

- In-processing: Di sini, Anda menambahkan batasan keadilan langsung ke dalam proses pelatihan model, mengajarkannya untuk mengoptimalkan akurasi dan keadilan secara bersamaan.

- Pengolahan pasca: Ini berarti menyesuaikan prediksi akhir model setelah prediksi tersebut dibuat untuk memastikan hasilnya adil di antara kelompok-kelompok.

Teknik-teknik ini seringkali melibatkan kompromi, di mana penurunan kecil dalam akurasi keseluruhan mungkin diperlukan untuk mencapai peningkatan signifikan dalam keadilan.

💟 Bonus: BrainGPT adalah asisten desktop bertenaga AI yang membawa pengujian bias AI ke level berikutnya dengan memberikan akses ke berbagai model terkemuka—termasuk GPT-5, Claude, Gemini, dan lainnya—semua dalam satu tempat.

Ini berarti Anda dapat dengan mudah menjalankan prompt atau skenario yang sama di berbagai model, membandingkan kemampuan penalaran mereka, dan mengidentifikasi di mana respons berbeda atau menunjukkan bias. Aplikasi AI super ini juga memungkinkan Anda menggunakan fitur talk-to-text untuk menyiapkan kasus uji, mendokumentasikan temuan Anda, dan mengorganisir hasil untuk analisis berdampingan.

Alat pemikiran canggih dan alat yang sadar konteksnya membantu Anda mengatasi masalah, mengidentifikasi pola, dan memahami bagaimana setiap model menangani topik sensitif. Dengan mengonsolidasikan alur kerja Anda dan memfasilitasi pengujian multi-model yang transparan, Brain MAX memberdayakan Anda untuk mengaudit, membandingkan, dan menangani bias AI dengan keyakinan dan presisi.

Tingkatkan transparansi dan keterjelaskan.

Jika Anda tidak tahu bagaimana model Anda membuat keputusan, Anda tidak dapat memperbaikinya ketika model tersebut salah. Teknik AI yang dapat dijelaskan (XAI) membantu Anda melihat ke dalam "kotak hitam" dan mengetahui fitur data mana yang memengaruhi prediksi.

Anda juga dapat membuat kartu model, yang berfungsi seperti label nutrisi untuk AI Anda, mencatat tujuan penggunaannya, data kinerja, dan batasan yang diketahui.

📮ClickUp Insight: 13% responden survei kami ingin menggunakan AI untuk mengambil keputusan sulit dan menyelesaikan masalah kompleks. Namun, hanya 28% yang mengatakan mereka menggunakan AI secara rutin di tempat kerja. Alasan kemungkinan: Kekhawatiran keamanan!

Pengguna mungkin tidak ingin membagikan data pengambilan keputusan yang sensitif dengan AI eksternal.

ClickUp mengatasi hal ini dengan menghadirkan pemecahan masalah berbasis AI langsung ke ruang kerja aman Anda. Dari SOC 2 hingga standar ISO, ClickUp mematuhi standar keamanan data tertinggi dan membantu Anda menggunakan teknologi AI generatif secara aman di seluruh ruang kerja Anda.

Kebijakan Tata Kelola dan Akuntabilitas AI

Program tata kelola AI yang kuat menciptakan kepemilikan yang jelas dan standar yang konsisten yang dapat diikuti oleh semua anggota tim.

Organisasi Anda memerlukan struktur tata kelola yang jelas untuk memastikan selalu ada pihak yang bertanggung jawab atas pengembangan dan penerapan AI secara etis.

Berikut adalah unsur-unsur penting dari program tata kelola AI yang efektif:

| Elemen tata kelola | Apa artinya | Langkah-langkah tindakan untuk organisasi Anda |

|---|---|---|

| Kepemilikan yang jelas | Tim atau individu yang ditugaskan bertanggung jawab atas etika AI, pengawasan, dan kepatuhan. | • Tunjuk seorang pemimpin etika AI atau komite lintas fungsi• Tentukan tanggung jawab untuk data, kualitas model, kepatuhan, dan risiko• Libatkan suara dari tim hukum, teknik, produk, dan DEI dalam pengawasan |

| Kebijakan yang terdokumentasi | Pedoman tertulis yang mendefinisikan cara pengumpulan, penggunaan, dan pemantauan data sepanjang siklus hidup AI. | • Buat kebijakan internal untuk pengadaan data, penandaan, privasi, dan penyimpanan • Dokumen standar untuk pengembangan, validasi, dan implementasi model • Wajibkan tim untuk mengikuti daftar periksa sebelum meluncurkan sistem AI apa pun |

| Jejak audit | Catatan transparan tentang keputusan, versi model, dataset, dan perubahan. | • Terapkan kontrol versi untuk dataset dan model• Catat keputusan kunci, parameter model, dan hasil tinjauan • Simpan jejak audit di repositori pusat yang dapat diakses |

| Peninjauan rutin | Penilaian berkelanjutan terhadap sistem AI untuk memeriksa bias, pergeseran, dan celah kepatuhan. | • Jadwalkan penilaian bias triwulanan atau semesteran melalui evaluasi LLM yang andal • Latih ulang atau kalibrasi ulang model saat kinerja menurun atau perilaku berubah • Review model setelah pembaruan data besar atau perubahan produk |

| Rencana tanggap insiden | Protokol yang jelas untuk mengidentifikasi, melaporkan, dan memperbaiki bias atau dampak negatif AI. | • Buat alur kerja eskalasi bias internal• Tentukan cara masalah diinvestigasi dan siapa yang menyetujui perbaikan• Gambarkan langkah-langkah komunikasi untuk pengguna, pelanggan, atau regulator jika diperlukan |

💡Tips Pro: Kerangka kerja seperti NIST AI Risk Management Framework dan EU AI Act, yang menetapkan denda hingga 7% dari omzet tahunan, dapat menjadi panduan yang sangat baik untuk mengembangkan program tata kelola Anda sendiri.

Cara Menerapkan Mitigasi Bias dengan ClickUp

Lingkungan kerja AI terintegrasi ClickUp mengumpulkan semua komponen program tata kelola AI Anda ke dalam satu ruang kerja yang terorganisir.

Tim Anda dapat mengelola tugas, menyimpan kebijakan, meninjau temuan audit, mendiskusikan risiko, dan melacak insiden tanpa perlu berpindah antar alat atau kehilangan konteks. Setiap catatan model, log keputusan, dan rencana perbaikan tetap terhubung, sehingga Anda selalu tahu siapa yang melakukan apa dan mengapa.

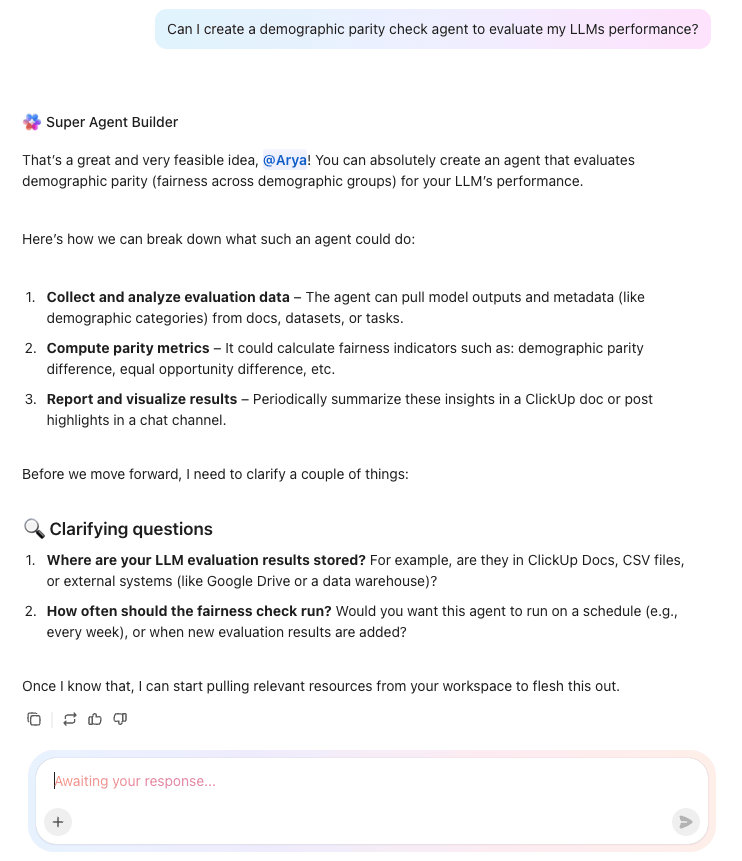

Dan karena AI ClickUp memahami pekerjaan di dalam ruang kerja Anda, ia dapat menampilkan penilaian sebelumnya, merangkum laporan panjang, dan membantu tim Anda tetap selaras seiring dengan perkembangan standar. Hasilnya adalah sistem tata kelola yang lebih mudah diikuti, lebih mudah diaudit, dan jauh lebih andal seiring dengan pertumbuhan jejak AI Anda.

Mari kita uraikan sebagai alur kerja!

Langkah 1: Siapkan ruang kerja tata kelola AI Anda

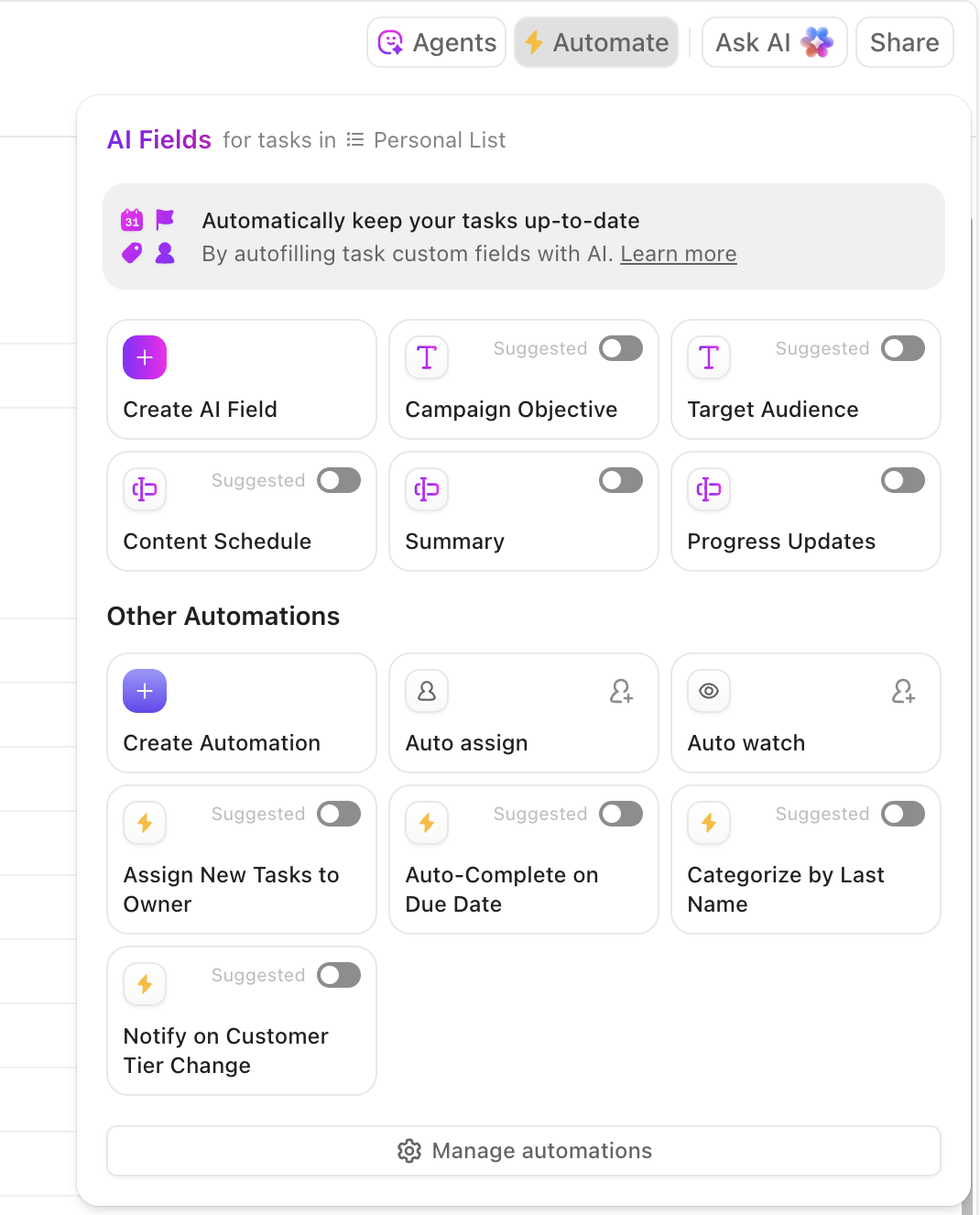

Mulailah dengan membuat ruang khusus di ClickUp untuk semua pekerjaan terkait tata kelola. Tambahkan daftar untuk inventaris model, penilaian bias, laporan insiden, dokumen kebijakan, dan tinjauan terjadwal sehingga setiap elemen program berada dalam satu lingkungan yang terkendali.

Konfigurasikan Bidang Kustom atau Bidang AI untuk melacak metrik keadilan, skor bias, versi model, status tinjauan, dan tingkat risiko. Gunakan izin berdasarkan peran untuk memastikan hanya peninjau yang berwenang, insinyur, dan pemimpin kepatuhan yang dapat mengakses pekerjaan AI yang sensitif. Hal ini menciptakan fondasi struktural yang tidak dapat ditawarkan oleh alat-alat titik pesaing atau platform proyek generik.

Langkah 2: Bangun kerangka kerja tata kelola Anda

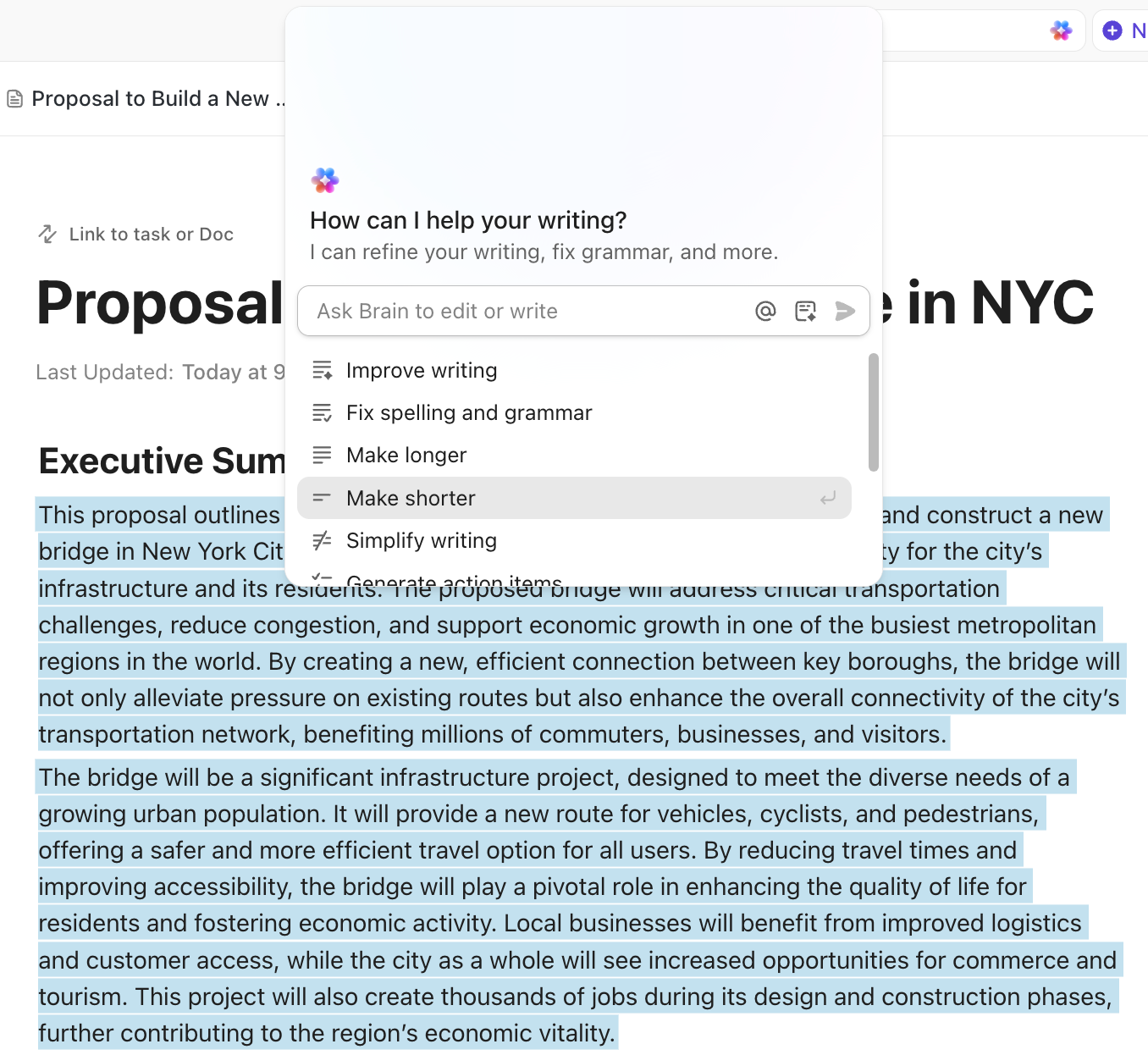

Selanjutnya, buat dokumen ClickUp sebagai panduan tata kelola yang dinamis. Di sini Anda dapat merinci prosedur evaluasi bias, ambang batas keadilan, pedoman dokumentasi model, langkah-langkah keterlibatan manusia, dan protokol eskalasi.

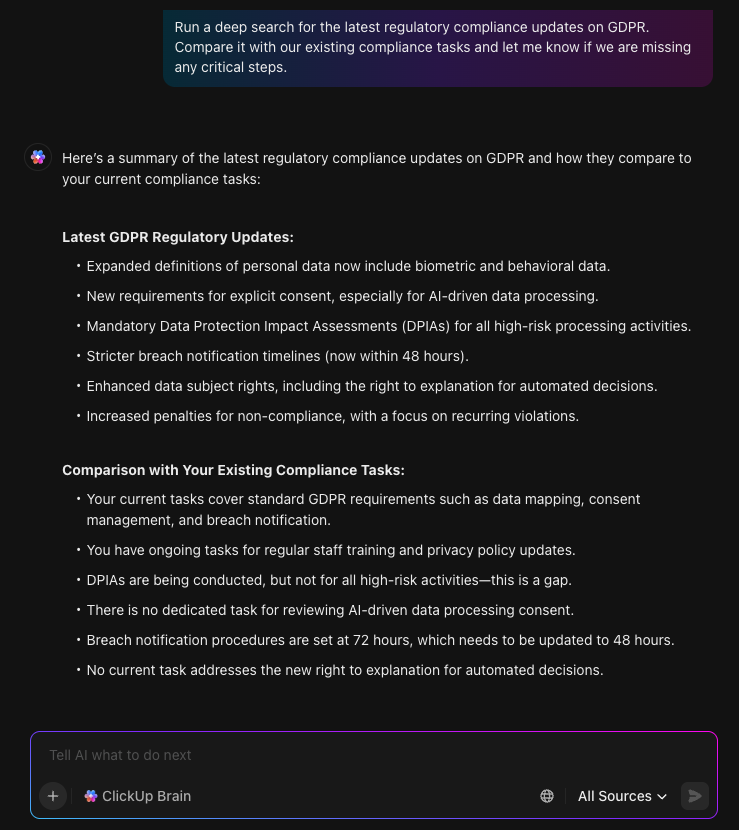

Karena Docs terhubung dengan tugas dan catatan model, tim Anda dapat berkolaborasi tanpa kehilangan riwayat versi atau menyebarkan file ke berbagai alat. Selanjutnya, ClickUp Brain dapat membantu merangkum peraturan eksternal, menyusun bahasa kebijakan baru, atau menampilkan temuan audit sebelumnya, sehingga pembuatan kebijakan menjadi lebih konsisten dan dapat dilacak.

Karena dapat mencari di web, beralih antara beberapa model AI, dan mensintesis informasi menjadi panduan yang jelas, tim Anda tetap up-to-date dengan standar dan perubahan industri terbaru tanpa harus meninggalkan ruang kerja. Semua yang Anda butuhkan, pembaruan kebijakan, wawasan regulasi, dan keputusan sebelumnya, terintegrasi dalam satu tempat, membuat sistem tata kelola Anda lebih stabil dan jauh lebih mudah untuk dikelola.

Langkah 3: Daftarkan setiap model

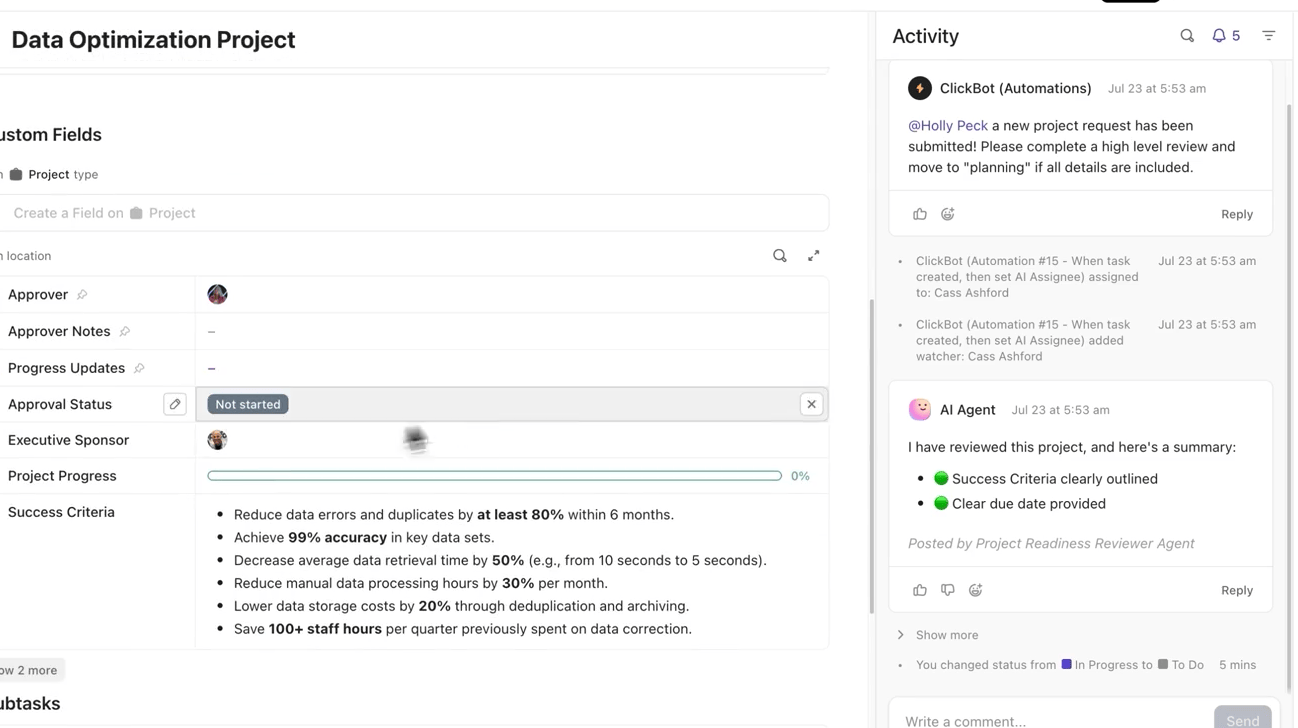

Setiap model harus memiliki tugasnya sendiri dalam daftar "Model inventory" agar kepemilikan dan pertanggungjawaban selalu jelas.

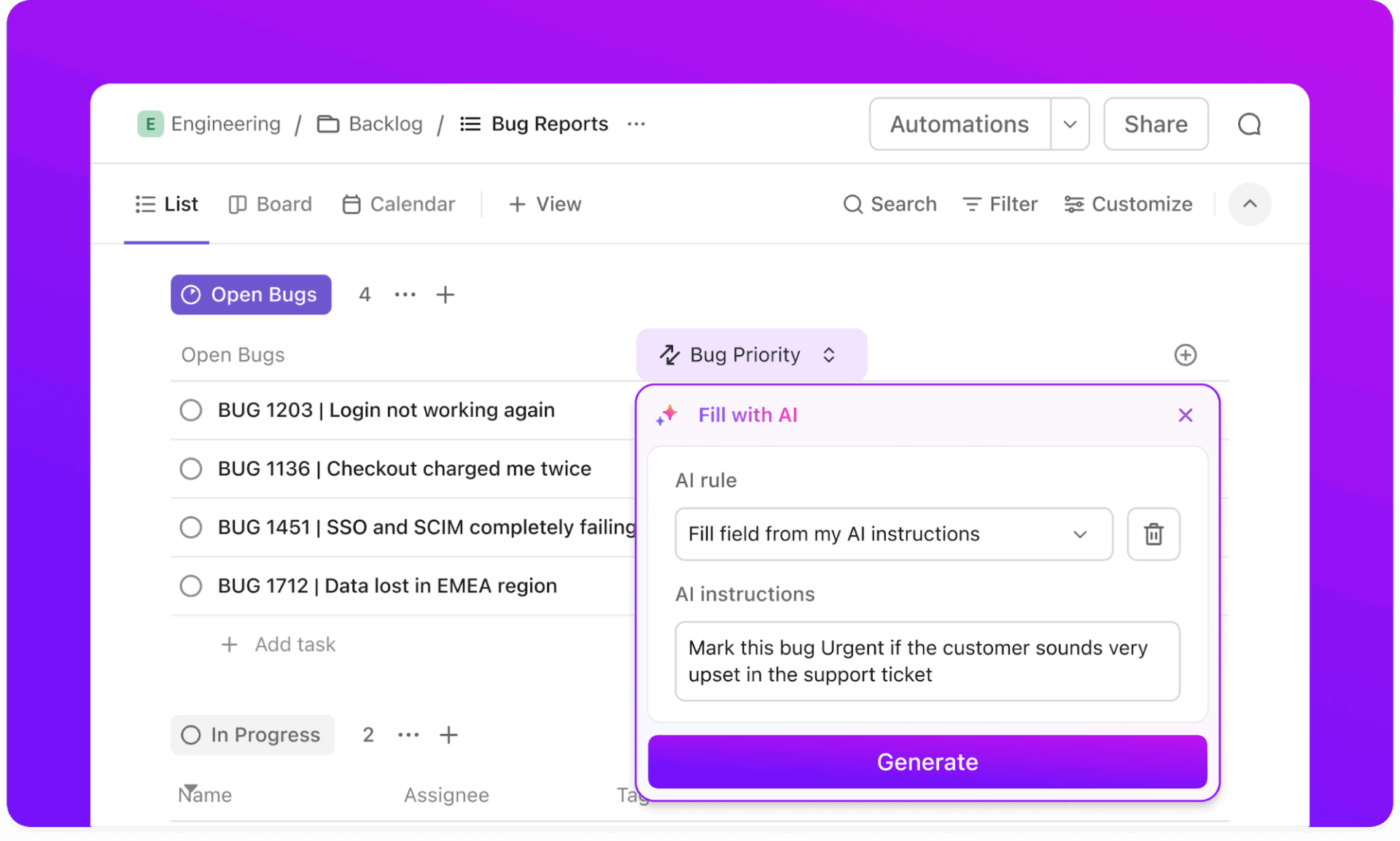

Dengan mudah lacak setiap insiden bias sebagai item yang dapat ditindaklanjuti dengan menggunakan ClickUp Tasks dan ClickUp Custom Fields untuk mengorganisir alur kerja penilaian bias Anda dan mencatat setiap detail penting.

Dengan cara ini, Anda dapat melacak jenis bias, tingkat keparahan, status perbaikan, anggota tim yang bertanggung jawab, dan tanggal tinjauan berikutnya, memastikan setiap masalah memiliki kepemilikan yang jelas dan batas waktu.

Lampirkan dataset, ringkasan evaluasi, dan catatan lineage sehingga semua informasi terpusat di satu tempat. Otomatisasi dapat memberi tahu peninjau setiap kali model dipindahkan ke lingkungan staging atau produksi.

Langkah 4: Lakukan audit bias terjadwal dan berbasis peristiwa

Audit bias harus dilakukan secara berkala dan sebagai respons terhadap pemicu spesifik.

Atur aturan sederhana melalui ClickUp Automations yang secara otomatis memicu tugas tinjauan setiap kali model mencapai tonggak penyebaran baru atau audit terjadwal akan dilakukan. Anda tidak akan pernah melewatkan penilaian bias triwulanan lagi, karena Automations dapat menugaskan peninjau yang tepat, menetapkan batas waktu yang benar, dan bahkan mengirim pengingat saat batas waktu mendekat.

Untuk audit berbasis peristiwa, ClickUp Forms memudahkan pengumpulan laporan insiden bias atau umpan balik manusia, sementara peninjau menggunakan Bidang Kustom untuk mencatat celah keadilan, hasil pengujian, dan rekomendasi. Setiap pengiriman formulir diarahkan ke tim Anda sebagai tugas, yang menciptakan jalur audit yang dapat diulang.

Langkah 5: Selidiki dan selesaikan insiden bias

Ketika masalah bias teridentifikasi, buat tugas insiden yang mencatat tingkat keparahan, kelompok yang terdampak, versi model, dan pekerjaan mitigasi yang diperlukan. Agen AI dapat menaikkan temuan berisiko tinggi ke pemimpin kepatuhan dan menugaskan peninjau dan insinyur yang tepat.

Setiap tindakan mitigasi, hasil pengujian, dan langkah validasi tetap terhubung dengan catatan insiden. ClickUp Brain dapat menghasilkan ringkasan untuk pimpinan atau membantu menyiapkan catatan perbaikan untuk dokumentasi tata kelola Anda, menjaga semuanya transparan dan dapat dilacak.

Langkah 6: Pantau kesehatan program tata kelola AI Anda

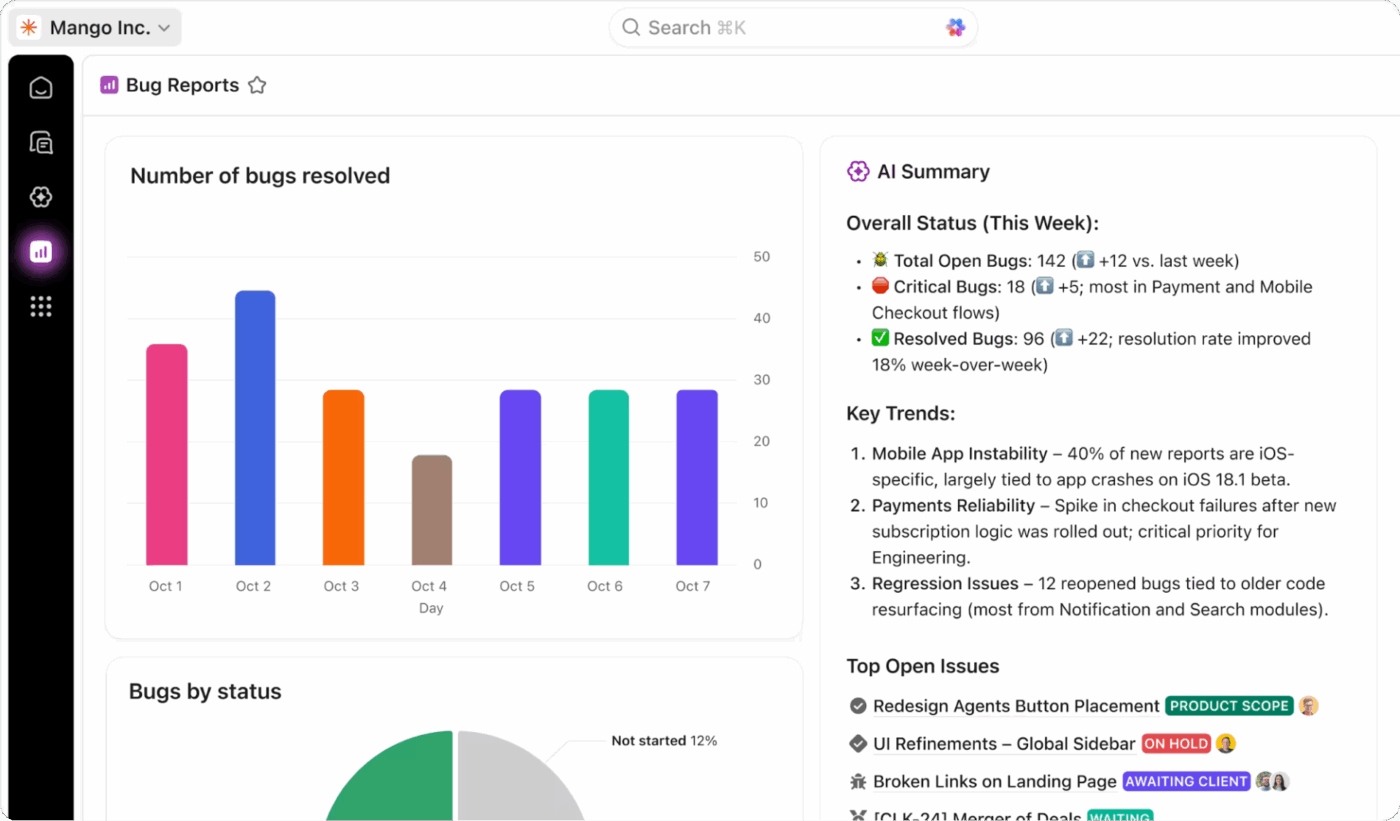

Akhirnya, bangun dasbor yang memberikan pemimpin pandangan real-time tentang program mitigasi bias Anda.

Sertakan panel yang menampilkan insiden terbuka, waktu penyelesaian, tingkat penyelesaian audit, metrik keadilan, dan status kepatuhan di seluruh model aktif. Dashboard tanpa kode di ClickUp dapat secara otomatis menarik data dan memperbarui tugas seiring berjalannya pekerjaan, dengan ringkasan AI yang terintegrasi dalam tampilan dashboard Anda.

📖 Baca Lebih Lanjut: Cara Mengatasi Tantangan AI yang Umum

Pemeriksaan Bias Pasca-Implementasi

Pekerjaan Anda belum selesai ketika model AI diluncurkan.

Sebenarnya, inilah saat ujian sesungguhnya dimulai. Model dapat "bergeser" dan mengembangkan bias baru seiring waktu seiring dengan perubahan data dunia nyata yang mereka lihat. Pemantauan berkelanjutan adalah satu-satunya cara untuk mendeteksi bias yang muncul ini sebelum menyebabkan kerusakan yang luas.

Inilah yang harus termasuk dalam pemantauan berkelanjutan Anda:

| Praktik | Apa yang dijamin |

|---|---|

| Pemantauan kinerja berdasarkan kelompok | Secara terus-menerus mengukur akurasi dan keadilan model di berbagai segmen demografis sehingga ketidaksetaraan dapat terdeteksi sejak dini. |

| Deteksi pergeseran data | Memantau perubahan pada data masukan yang dapat memperkenalkan bias baru atau melemahkan kinerja model seiring waktu. |

| Umpan balik pengguna | Menyediakan saluran yang jelas bagi pengguna untuk melaporkan output yang bias atau salah, sehingga meningkatkan pengawasan di dunia nyata. |

| Audit terjadwal | Menjamin tinjauan mendalam secara kuartalan atau semesteran terhadap perilaku model, metrik keadilan, dan persyaratan kepatuhan. |

| Tanggap insiden | Menentukan proses terstruktur untuk menyelidiki, memperbaiki, dan mendokumentasikan setiap peristiwa bias yang dilaporkan. |

💟 Bonus: Sistem AI generatif, khususnya, memerlukan pengawasan ekstra karena outputnya jauh lebih sulit diprediksi dibandingkan model pembelajaran mesin tradisional. Teknik yang sangat efektif untuk ini adalah red-teaming, di mana tim khusus secara aktif berusaha memicu respons bias atau berbahaya dari model untuk mengidentifikasi kelemahannya.

Misalnya, Proyek Lighthouse Airbnb merupakan studi kasus industri yang bagus tentang perusahaan yang menerapkan pemantauan bias sistematis setelah implementasi.

Ini adalah inisiatif penelitian yang mengkaji bagaimana persepsi ras dapat memengaruhi hasil pemesanan, membantu perusahaan mengidentifikasi dan mengurangi diskriminasi di platform. Inisiatif ini menggunakan metode yang aman privasi, berkolaborasi dengan kelompok hak asasi manusia, dan menerjemahkan temuan menjadi perubahan produk dan kebijakan, sehingga lebih banyak tamu dapat menggunakan platform tanpa menemui hambatan tersembunyi.

📖 Baca Lebih Lanjut: AI Generatif vs. AI Prediktif: Memahami Perbedaan dan Aplikasinya

Mengurangi Bias AI dengan ClickUp

Membangun AI yang adil dan akuntabel merupakan komitmen organisasi.

Ketika kebijakan, sumber daya manusia, proses, dan alat Anda bekerja secara harmonis, Anda menciptakan sistem tata kelola yang dapat beradaptasi dengan risiko baru, merespons insiden dengan cepat, dan memperoleh kepercayaan dari orang-orang yang bergantung pada produk Anda.

Dengan tinjauan terstruktur, dokumentasi yang jelas, dan alur kerja yang dapat diulang untuk menangani bias, tim tetap sejalan dan bertanggung jawab, daripada bereaksi dalam mode krisis.

Dengan mengonsolidasikan semua hal di dalam ClickUp, mulai dari catatan model hingga hasil audit hingga laporan insiden, Anda menciptakan lapisan operasional tunggal di mana keputusan transparan, tanggung jawab jelas, dan perbaikan tidak pernah terabaikan.

Tata kelola yang kuat tidak menghambat inovasi; justru menstabilkannya. Siap untuk mengintegrasikan mitigasi bias ke dalam alur kerja AI Anda? Mulailah secara gratis dengan ClickUp dan mulailah membangun program tata kelola AI Anda hari ini.

Pertanyaan yang Sering Diajukan

Langkah awal yang baik adalah melakukan audit bias pada sistem AI yang sudah ada. Penilaian dasar ini akan menunjukkan di mana ketidakadilan saat ini terjadi dan membantu Anda memprioritaskan upaya mitigasi Anda.

Tim menggunakan metrik keadilan spesifik, seperti kesetaraan demografis, peluang yang disamakan, dan rasio dampak yang tidak merata, untuk mengukur bias. Metrik yang tepat bergantung pada kasus penggunaan spesifik Anda dan jenis keadilan yang paling penting dalam konteks tersebut.

Anda harus selalu menambahkan langkah tinjauan manusia untuk keputusan berisiko tinggi yang secara signifikan memengaruhi kehidupan atau peluang seseorang, seperti dalam perekrutan, pemberian pinjaman, atau layanan kesehatan. Juga bijaksana untuk menggunakannya selama tahap awal penerapan model baru ketika perilakunya masih tidak dapat diprediksi.

Karena AI generatif dapat menghasilkan rentang respons yang hampir tak terbatas dan tidak dapat diprediksi, Anda tidak bisa hanya memeriksa akurasi. Anda perlu menggunakan teknik pengujian aktif seperti red-teaming dan pengambilan sampel output skala besar untuk mengetahui apakah model menghasilkan konten bias dalam kondisi yang berbeda.