Sie sind sich sicher, dass das Dokument existiert. Sie haben es letzte Woche gesehen.

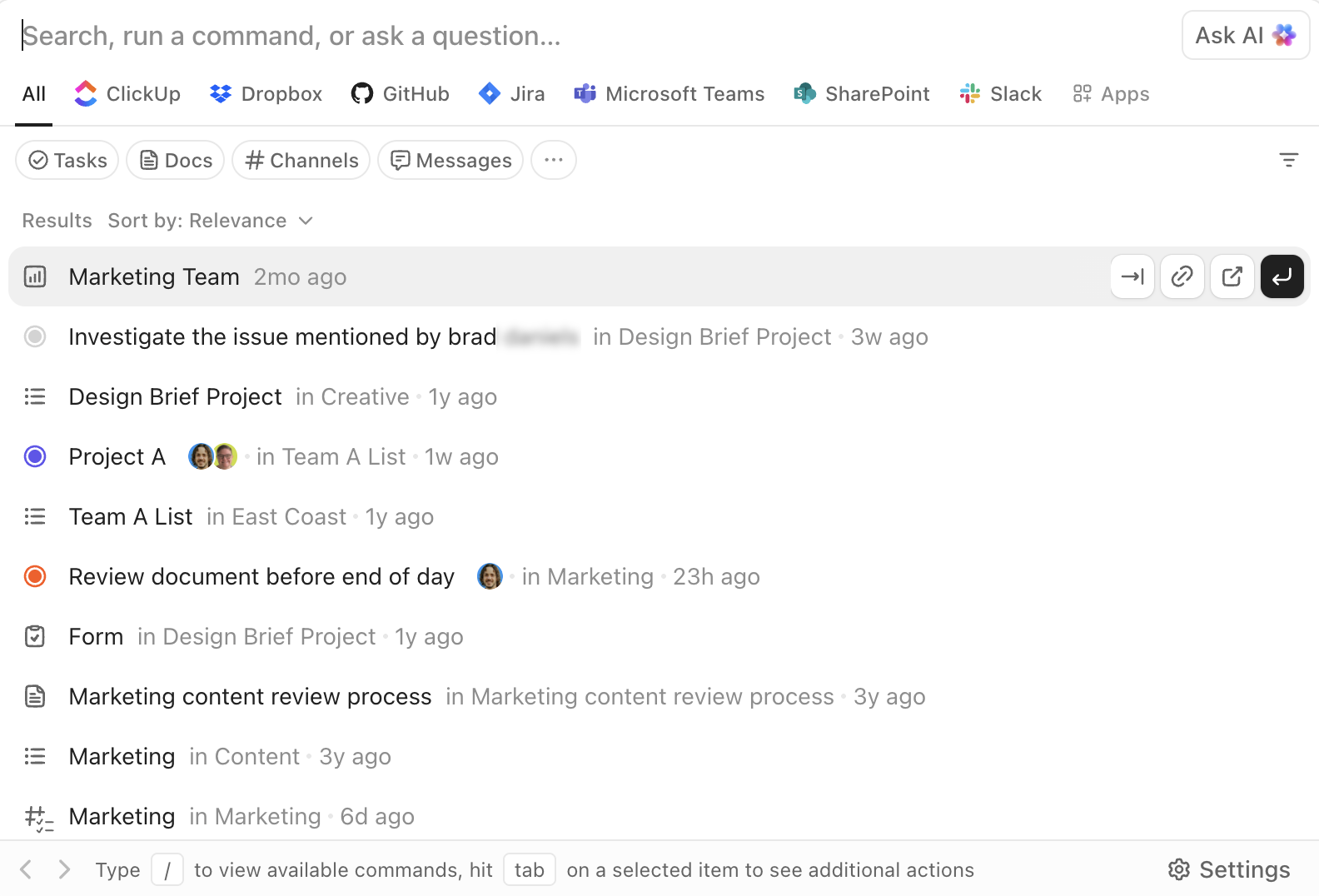

Aber nachdem Sie jede erdenkliche Keyword-Kombination ausprobiert haben – „Marketingergebnisse Q3“, „Leistung im dritten Quartal“, „Marketingbericht Oktober“ – bleibt die Suchleiste Ihres Unternehmens leer. Diese frustrierende Suche nach Informationen ist ein klassisches Anzeichen für eine veraltete Keyword-Suche.

Diese Systeme finden nur exakte Wortübereinstimmungen und übersehen dabei, was Sie eigentlich meinen. Cohere löst dieses Problem effektiv, indem es eine intelligente Suchschicht bereitstellt, die Ihre Systeme miteinander verbindet.

Wenn Sie also herausfinden möchten, wie Sie Cohere für die Suche im Unternehmen nutzen können, sind Sie hier genau richtig. In diesem Leitfaden wird alles erklärt.

Was ist Cohere KI und warum ist es für die Suche im Unternehmen wichtig?

Cohere ist eine KI-Plattform, die große Sprachmodelle (LLMs) speziell für den Einsatz in Unternehmen entwickelt. Für die interne Suche bedeutet dies, dass man über die keywordbasierte Suche hinausgeht und zu einer semantischen, intelligenten Suche übergeht, die Absicht, Kontext und Bedeutung versteht.

Die meisten Suchtools für Unternehmen basieren nach wie vor auf der wörtlichen Übereinstimmung von Schlüsselwörtern. Wenn die genauen Wörter nicht im Titel oder Text eines Dokuments vorkommen, wird das Ergebnis oft übersehen. Cohere ändert dies, indem es Suchsystemen ermöglicht, zu verstehen, wonach ein Benutzer tatsächlich sucht, und nicht nur, was er eingegeben hat.

Teams, die versuchen, selbst eine KI-gestützte Suche aufzubauen, verbringen in der Regel Monate damit, Vektordatenbanken zusammenzustellen, Pipelines einzubetten und Modelle neu zu ordnen. Selbst nach all dieser Arbeit ist die Suche oft nicht leistungsfähig genug, da sie in einem separaten System stattfindet, das von den eigentlichen Arbeitsabläufen, Aufgaben, Dokumenten und Workflows getrennt ist.

Ein leistungsstarkes Tool für die Enterprise-Suche wie Cohere nutzt Retrieval-Augmented Generation (RAG), um intelligente Suche mit KI zu kombinieren. Dieser Ansatz verwandelt Ihr internes Wissen in eine sofort zugängliche Ressource.

Im Fall von Cohere wandelt das tool Dokumente in Einbettungen um, also numerische Darstellungen von Bedeutungen. Wenn jemand nach „Quartalsumsatzbericht” sucht, ruft das System konzeptionell relevante Dokumente wie „Finanzergebnisse Q4” oder „Gewinnübersicht” ab, auch wenn diese genauen Schlüsselwörter nicht vorhanden sind.

Deshalb ist Cohere für die Suche im Unternehmen so wichtig. Es reduziert die Komplexität der Implementierung, verbessert die Genauigkeit der Ergebnisse und ermöglicht eine Suche, die so funktioniert, wie Mitarbeiter tatsächlich denken und Fragen in modernen Arbeitssystemen stellen.

📮ClickUp Insight: Mehr als die Hälfte aller Mitarbeiter (57 %) verschwenden Zeit damit, interne Dokumente oder die Wissensdatenbank des Unternehmens nach Informationen zur Arbeit zu durchsuchen.

Und wenn das nicht möglich ist? Jeder Sechste greift auf persönliche Workarounds zurück – das Durchsuchen alter E-Mails, Notizen oder Screenshots, nur um die Informationen zusammenzufügen.

ClickUp Brain macht die Suche überflüssig, indem es sofortige, KI-gestützte Antworten aus Ihrem gesamten Arbeitsbereich und integrierten Drittanbieter-Apps liefert, sodass Sie ohne Umwege das bekommen, was Sie brauchen.

Wichtige Cohere-Features für die Enterprise-Suche

Bei der Bewertung von /AI-Suchlösungen kann es aufgrund des Marketing-Hypes schwierig sein, zu erkennen, welche Funktionen tatsächlich Ihre Probleme lösen. Allgemeine Versprechungen einer „intelligenteren Suche” helfen Ihren Engineering- und Produktteams nicht dabei, fundierte Entscheidungen zu treffen.

In der Realität basiert ein zuverlässiges Suchsystem auf einer Pipeline aus verschiedenen KI-Modellen, die zusammenarbeiten.

Cohere bietet mehrere Modelle, die Sie unabhängig voneinander verwenden oder kombinieren können, um eine ausgeklügelte Sucharchitektur aufzubauen. Das Verständnis dieser Kern-Features ist der erste Schritt zur Entwicklung eines Systems, das den spezifischen Anforderungen Ihres Teams entspricht.

Einbetten für semantische Vektorsuche

Die größte Frustration bei alten Suchsystemen ist ihre Unfähigkeit, konzeptionell verwandte Informationen zu finden. Sie suchen nach „Einführungsleitfaden für Mitarbeiter” und übersehen das Dokument mit dem Titel „Checkliste für den ersten Tag neuer Mitarbeiter”. Dies geschieht, weil das System Wörter und nicht Bedeutungen abgleicht.

Das Embed-Modell mit neuronaler Suche löst dieses Problem, indem es Text in Vektoren umwandelt – lange Listen von Zahlen, die die semantische Bedeutung erfassen. Dieser als Einbettung bezeichnete Prozess ermöglicht es dem System, Dokumente zu identifizieren, die konzeptionell ähnlich sind, auch wenn sie keine gemeinsamen Schlüsselwörter haben. Im Wesentlichen versteht Ihr Suchtool automatisch Synonyme und verwandte Ideen.

Hier sind die Schlüsselaspekte des Embed-Modells von Cohere:

- Multimodale Unterstützung: Die neueste Version, Embed 4, kann sowohl Text als auch Bilder verarbeiten, sodass Sie verschiedene Arten von Inhalten gleichzeitig durchsuchen können.

- Mehrsprachige Funktionen: Sie können Informationen in Dokumenten in verschiedenen Sprachen suchen, ohne diese zuvor übersetzen zu müssen.

- Dimensionsoptionen: Sie können die Größe Ihrer Vektoren wählen. Höhere Dimensionen erfassen mehr Nuancen, erfordern jedoch mehr Speicher und Rechenleistung.

📖 Weiterlesen: Anwendungsfälle für KI-Enterprise-Suche

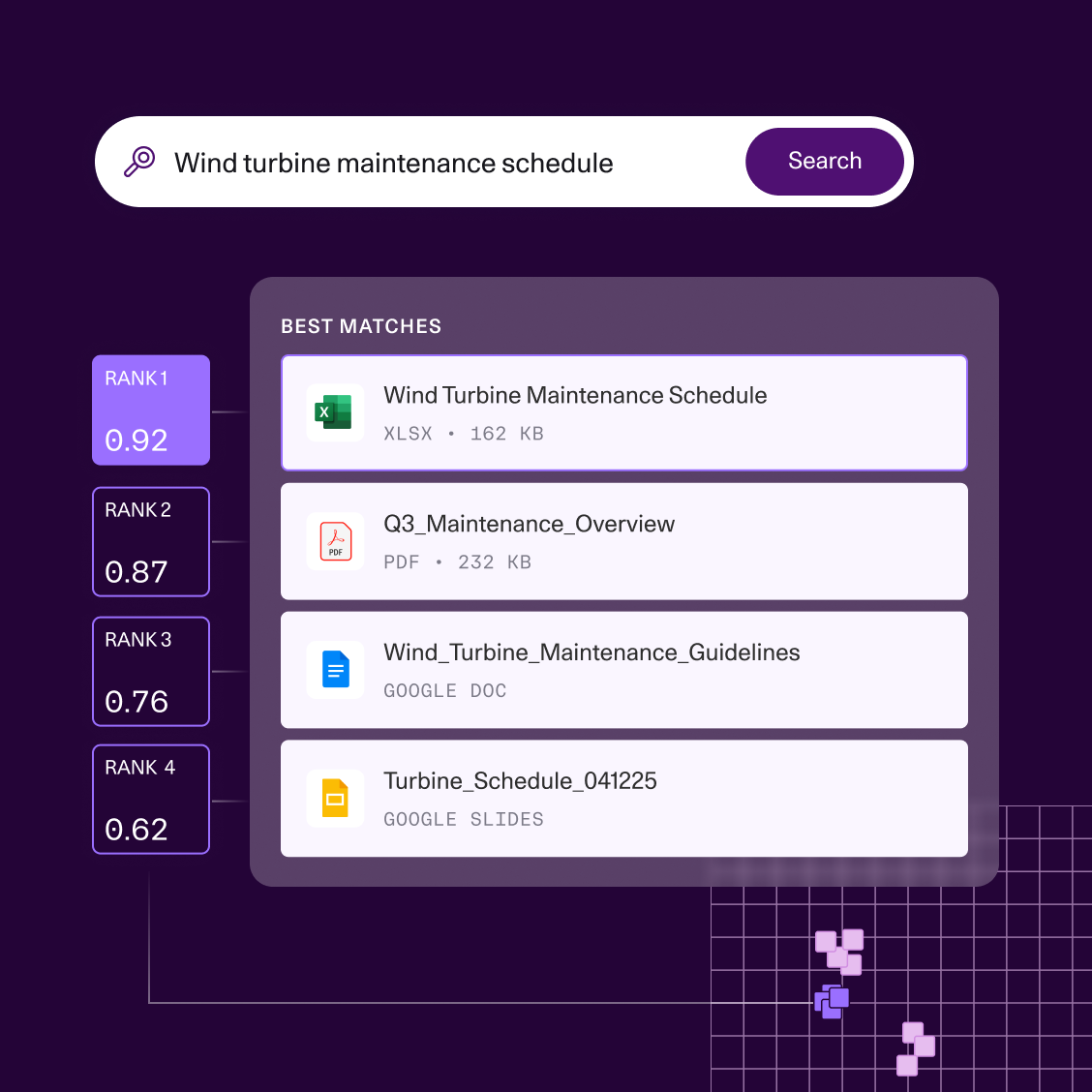

Neubewertung für verbesserte Relevanz der Ergebnisse

Manchmal liefert eine Suche eine Liste relevanter Dokumente, aber das wichtigste Dokument befindet sich auf der zweiten Seite. Dies zwingt die Benutzer dazu, die Ergebnisse zu durchsuchen, was Zeit kostet und dazu führt, dass sie das Vertrauen in das Suchsystem verlieren.

Dies ist ein Ranking-Problem. Das System hat die richtigen Informationen gefunden, konnte diese jedoch nicht richtig priorisieren.

Das Rerank-Modell von Cohere behebt dieses Problem mit einem zweistufigen Prozess. Zunächst verwenden Sie eine schnelle Abrufmethode (wie die semantische Suche), um eine große Menge potenziell relevanter Dokumente zu sammeln. Anschließend übergeben Sie diese Liste an das Rerank-Modell, das eine rechenintensivere Cross-Encoder-Architektur verwendet, um jedes Dokument anhand Ihrer spezifischen Abfrage zu analysieren und sie für maximale Relevanz neu zu ordnen.

Dies ist besonders nützlich in Situationen, in denen es auf Präzision ankommt, z. B. wenn ein Support-Mitarbeiter die richtige Antwort für einen Kunden findet oder ein Teammitglied nach einem bestimmten Abschnitt in einem Dokument sucht. Zwar verlängert sich dadurch die Verarbeitungszeit geringfügig, doch die Verbesserung der Qualität des Ergebnisses ist oft den Kompromiss wert.

Anwendungsfälle für Enterprise Search für Teams

Abstrakte KI-Fähigkeiten sind interessant, aber sie werden erst dann nützlich, wenn Sie sie zur Lösung realer Geschäftsprobleme einsetzen. Eine erfolgreiche Implementierung der Unternehmenssuche beginnt mit der Identifizierung dieser spezifischen Schwachstellen. 👀

Hier sind einige praktische Szenarien, in denen Teams die Cohere-basierte Suche anwenden können:

- Suche in der Wissensdatenbank: Helfen Sie Ihren Mitarbeitern , Antworten in internen Dokumentationen, Wikis, der Kundenservice-Wissensdatenbank und Standardarbeitsanweisungen (SOPs) zu finden .

- Kundensupport: Ermöglichen Sie Ihren Mitarbeitern, während eines Kundengesprächs schnell relevante Hilfeartikel und frühere Ticket-Lösungen zu finden – laut einer Analyse von McKinsey lässt sich durch den Einsatz generativer KI in Kundenservice-Workflows eine Produktivitätssteigerung von 30 bis 45 % erzielen.

- Recht und Compliance: Durchsuchen Sie Millionen von Verträgen, Richtlinien und regulatorischen Dokumenten mit semantischem Verständnis, um bestimmte Klauseln oder Präzedenzfälle zu finden.

- Forschung und Entwicklung: Ermöglichen Sie Ingenieuren, relevante frühere Arbeiten, Patente und technische Dokumentationen zu finden, um den Aufwand zu vermeiden.

- Personalwesen und Onboarding: Stellen Sie relevante Richtlinien, Schulungsmaterialien, Workflow-Beispiele und Verfahren für neue Mitarbeiter bereit, damit diese selbstständig Antworten finden können.

- Vertriebsunterstützung: Helfen Sie Vertriebsmitarbeitern, die richtigen Fallstudien, Wettbewerbsinformationen und Produktinformationen zu finden, um Geschäfte schneller zu schließen.

Der rote Faden dabei ist, dass eine effektive Unternehmenssuche in das bestehende Workflow-Management integriert sein muss. Eine eigenständige Suchleiste reicht nicht aus. Ihr Team muss in der Lage sein, Informationen zu finden und sofort darauf zu reagieren, ohne zwischen verschiedenen Tools wechseln zu müssen.

🛠️ Toolkit: Erstellen Sie einen internen hub, den Ihr Team tatsächlich nutzen wird. Die Wissensdatenbank-Vorlage von ClickUp sorgt dafür, dass alles – von Anleitungen bis hin zu SOPs – übersichtlich organisiert und leicht zu finden ist, sodass niemand mehr raten muss, wo sich die Info befindet.

So richten Sie Cohere für die Suche im Unternehmen ein

Der Schritt von der Bewertung der /AI-Suche zur tatsächlichen Implementierung kann entmutigend sein. Vor allem, wenn Ihr Team noch keine Erfahrung mit großen Sprachmodellen hat.

Die Komplexität Ihres Setups hängt zwar von Ihrer Größe und Ihrem bestehenden Tech-Stack ab, die grundlegenden Schritte zum Aufbau eines Cohere-basierten Suchsystems sind jedoch immer dieselben. Dieser Abschnitt enthält eine praktische Anleitung für Ihr technisches Team.

Voraussetzungen und API-Zugriff

Bevor Sie Code schreiben, müssen Sie Ihre Tools und Zugriffe einrichten. Dieses anfängliche Setup hilft, spätere Probleme der Sicherheit und Hindernisse zu vermeiden.

Das benötigen Sie, um loszulegen:

- Cohere-API-Konto: Registrieren Sie sich auf der Cohere-Website, um Ihre API-Schlüssel zu erhalten.

- Entwicklungsumgebung: Die meisten Teams verwenden Python, aber SDKs sind auch für andere Sprachen verfügbar.

- Vektordatenbank: Sie benötigen einen Speicherort für Ihre Dokument-Embeddings, z. B. Pinecone, Weaviate, Qdrant oder einen Managed Service wie Amazon OpenSearch.

- Dokumentenkorpus: Sammeln Sie die Inhalte, die Sie durchsuchbar machen möchten (z. B. PDFs, Textdateien, Datenbankdatensätze).

Sie können auch über Amazon Bedrock auf die Modelle von Cohere zugreifen, was die Abrechnung und Sicherheit vereinfachen kann, wenn Ihr Unternehmen bereits im AWS-Ökosystem arbeitet.

Generieren Sie Einbettungen mit Cohere Embed

Der nächste Schritt besteht darin, Ihre Dokumente in durchsuchbare Vektoren umzuwandeln. Dieser Prozess umfasst die Vorbereitung Ihrer Inhalte und deren Verarbeitung durch das Cohere Embed-Modell.

Die Art und Weise, wie Sie Ihre Dokumente vorbereiten, insbesondere wie Sie sie in kleinere Teile zerlegen, hat einen enormen Einfluss auf die Suchqualität. Dies wird als Chunking-Strategie bezeichnet.

Zu den gängigen Chunking-Strategien gehören:

- Festgelegte Chunks mit fixer Größe: Die einfachste Methode, die jedoch dazu führen kann, dass Sätze oder Ideen mitten im Satz ungeschickt geteilt werden.

- Semantisches Chunking: Eine fortgeschrittenere Methode, die die Dokumentstruktur berücksichtigt, z. B. durch Unterbrechungen am Ende von Absätzen oder Abschnitten.

- Überlappende Blöcke: Bei diesem Ansatz wird eine kleine Menge wiederholten Textes zwischen den Blöcken eingefügt, um den Kontext über Grenzen hinweg zu bewahren.

Sobald Ihre Dokumente in Blöcke unterteilt sind, senden Sie sie stapelweise an die Embed-API, um die Vektordarstellungen zu generieren. Dies ist in der Regel ein einmaliger Vorgang für Ihre vorhandenen Dokumente, wobei neue oder aktualisierte Dokumente bei ihrer Erstellung eingebettet werden.

Vektoren speichern und durchführen von Abfragen

Ihre neu erstellten Vektoren brauchen einen Speicherort. Eine Vektordatenbank ist eine spezielle Datenbank, die zum Speichern und für Abfragen von Einbettungen auf der Grundlage ihrer Ähnlichkeit entwickelt wurde.

Der Abfrageprozess funktioniert wie folgt:

- Ein Benutzer gibt eine Abfrage ein.

- Ihre Anwendung sendet diese Abfrage an dasselbe Cohere Embed-Modell, um sie in einen Vektor umzuwandeln.

- Dieser Abfragevektor wird an die Datenbank gesendet, die die ähnlichsten Dokumentvektoren findet.

- Die Datenbank gibt die passenden Dokumente zurück, die Sie dann dem Benutzer anzeigen können.

Bei der Auswahl einer Vektordatenbank sollten Sie auch überlegen, welche Ähnlichkeitsmetrik Sie verwenden möchten. Die Kosinusähnlichkeit ist die gängigste Methode für die textbasierte Suche, aber es gibt auch andere Optionen für verschiedene Anwendungsfälle.

| Ähnlichkeitsmetrik | Am besten geeignet für |

|---|---|

| Kosinusähnlichkeit | Allgemeine Textsuche |

| Skalarprodukt | Wenn die Größe der Vektoren wichtig ist |

| Euklidischer Abstand | Räumliche oder geografische Daten |

Implementieren Sie eine Neuanordnung für bessere Ergebnisse.

Für viele Anwendungen sind die Ergebnisse aus Ihrer Vektordatenbank ausreichend. Wenn Sie jedoch das absolut beste Ergebnis ganz oben benötigen, ist es sinnvoll, einen Neuanordnungsschritt hinzuzufügen.

Dies ist besonders wichtig, wenn Ihre Suche ein RAG-System unterstützt, da die Qualität der generierten Antwort stark von der Qualität des abgerufenen Kontexts abhängt.

Die Neuanordnung der Ergebnisse erfolgt ganz einfach:

- Rufen Sie eine größere Menge an ersten Kandidaten aus Ihrer Vektordatenbank ab (z. B. die 50 besten Ergebnisse).

- Leiten Sie die ursprüngliche Abfrage des Benutzers und diese Liste von Kandidaten an die Cohere Rerank API weiter.

- Die API gibt dieselbe Liste von Dokumenten zurück, jedoch neu sortiert auf der Grundlage einer präziseren Relevanzbewertung.

- Zeigen Sie dem Benutzer die besten Ergebnisse aus der neu sortierten Liste an.

Um die Auswirkungen der Neubewertung zu messen, können Sie die Nachverfolgung von Offline-Bewertungsmetriken wie nDCG (Normalized Discounted Cumulative Gain) und MRR (Mean Reciprocal Rank) durchführen.

💫 Eine visuelle Übersicht über die Implementierung von Suchfunktionen für Unternehmen finden Sie in dieser Anleitung, in der die wichtigsten Konzepte und praktischen Überlegungen vorgestellt werden:

Best Practices für die Enterprise-Suche mit Cohere

Der Aufbau eines Suchsystems ist nur der erste Schritt. Die langfristige Aufrechterhaltung und Verbesserung seiner Qualität ist das, was ein erfolgreiches Projekt von einem gescheiterten unterscheidet. Wenn Benutzer einige schlechte Erfahrungen machen, verlieren sie das Vertrauen und nutzen das Tool nicht mehr. 🛠️

Hier sind einige Erkenntnisse aus erfolgreichen Implementierungen der Enterprise-Suche:

- Beginnen Sie mit der hybriden Suche: Verlassen Sie sich nicht allein auf die semantische Suche. Kombinieren Sie sie mit einem traditionellen Keyword-Suchalgorithmus wie BM25. So profitieren Sie von den Vorteilen beider Methoden: Die semantische Suche findet konzeptionell verwandte Elemente, während die Keyword-Suche sicherstellt, dass Sie weiterhin exakte Übereinstimmungen für Produktcodes oder bestimmte Namen finden.

- Investieren Sie in Datenhygiene und -qualität: Ihre Suchergebnisse können nur so gut sein wie Ihre Daten. Saubere, gut strukturierte Dokumente mit klaren Überschriften und Absätzen liefern viel bessere Einbettungen.

- Sorgfältige Aufteilung: Die Aufteilung Ihrer Dokumente in Abschnitte ist entscheidend. Anstatt willkürliche Limite für Zeichen zu verwenden, sollten Sie versuchen, die Abschnitte an der logischen Struktur Ihrer Dokumente auszurichten, z. B. an Absätzen oder Abschnitten.

- Metadatenfilter hinzufügen: Die semantische Suche ist leistungsstark, aber manchmal wissen Benutzer bereits, wonach sie suchen. Ermöglichen Sie ihnen, die Ergebnisse nach Metadaten wie Datum, Abteilung oder Dokumenttyp zu filtern, bevor die semantische Suche startet.

- Überwachen und iterieren: Achten Sie genau darauf, wonach Ihre Benutzer suchen, auf welche Ergebnisse sie klicken und welche Abfragen keine Ergebnisse liefern. Diese Daten sind Gold wert, um Lücken im Inhalt zu identifizieren und Ihr System zu verbessern.

- Gehen Sie elegant mit Fehlern um: Kein Suchsystem ist perfekt. Wenn eine Suche schlechte Ergebnisse liefert, bieten Sie hilfreiche Alternativen an, z. B. alternative Abfragen oder die Benachrichtigung eines Experten.

Einschränkungen von Cohere für die Enterprise-Suche

Cohere ist zwar ein Anbieter von leistungsstarken KI-Modellen, aber keine Plug-and-Play-Lösung (nicht ganz).

Die Entwicklung einer produktionsreifen Enterprise-Suchlösung ist mit erheblichen Herausforderungen verbunden, die von Teams oft unterschätzt werden. Das Verständnis dieser Limite ist entscheidend, um fundierte Entscheidungen zu treffen und kostspielige Überraschungen zu vermeiden.

Das größte Problem besteht darin, dass Sie eine Reihe von Tools erhalten und kein fertiges Produkt. Dadurch ist Ihr Team für den Aufbau und die Wartung der gesamten Infrastruktur rund um die Suche als Dienstleistung verantwortlich.

Hier sind einige der wichtigsten Limite, die es zu beachten gilt:

| Herausforderung | Warum dies zu einem Problem wird |

|---|---|

| Erfordert spezielle Fachkenntnisse | Sie benötigen erfahrene KI- und Dateningenieure, um das System aufzubauen, zu betreiben und zu warten. Das ist nichts, was die meisten Teams einfach so einrichten oder besitzen können. |

| Benutzerdefinierte Integrationen erforderlich | Die Modelle bilden keine automatische Verbindung zu Ihren vorhandenen Tools ab. Jede Datenquelle muss manuell angeschlossen und gepflegt werden. |

| Hoher laufender Wartungsaufwand | Such-Indizes müssen ständig aktualisiert werden, wenn sich Inhalte ändern oder Modelle aktualisiert werden, was einen kontinuierlichen Arbeitsaufwand bedeutet. |

| Keine Verbindung zu Ihrem Workspace | Die KI versteht Sprache, aber sie ist nicht dort präsent, wo Ihr Team tatsächlich arbeitet, was zu einer Diskrepanz zwischen Suche und Ausführung führt. |

| Kontextwechsel sind unvermeidbar | Benutzer finden Informationen an einem Ort und wechseln dann zu anderen tools, um darauf zu reagieren, was die Produktivität und Akzeptanz beeinträchtigt. |

So verwenden Sie ClickUp als Alternative für die Suche im Unternehmen

Mittlerweile sollte der Kompromiss offensichtlich sein.

Die Enterprise-Suche ist leistungsstark, aber wenn Sie sie selbst aufbauen, müssen Sie sich um Ingestion-Pipelines, Chunking-Strategien, Embedding-Aktualisierungen, Neuanordnungslogik und laufende Wartung kümmern. Das ist eine langfristige Infrastrukturverpflichtung und keine einfache Feature-Einführung.

Als weltweit erster konvergierter KI-Workspace beseitigt ClickUp diese gesamte Ebene, indem es die KI-gestützte Suche in den Workspace selbst integriert.

Dies ist wichtig, da die meisten Suchprobleme gar keine Suchprobleme sind. Es handelt sich vielmehr um Probleme aufgrund von Arbeitsausbreitung . Wenn die Arbeit auf verschiedene, nicht miteinander verbundene Tools verteilt ist, müssen Teams ständig nach dem Kontext suchen. Das Ergebnis sind Zeitverlust, doppelter Aufwand und Entscheidungen, die ohne vollständige Sichtbarkeit getroffen werden.

ClickUp geht dieses Problem an der Wurzel an, indem es Arbeit, Kontext und Informationen in einem einzigen Workspace zusammenführt. Schauen wir uns einmal an, wie das in der Praxis funktioniert.

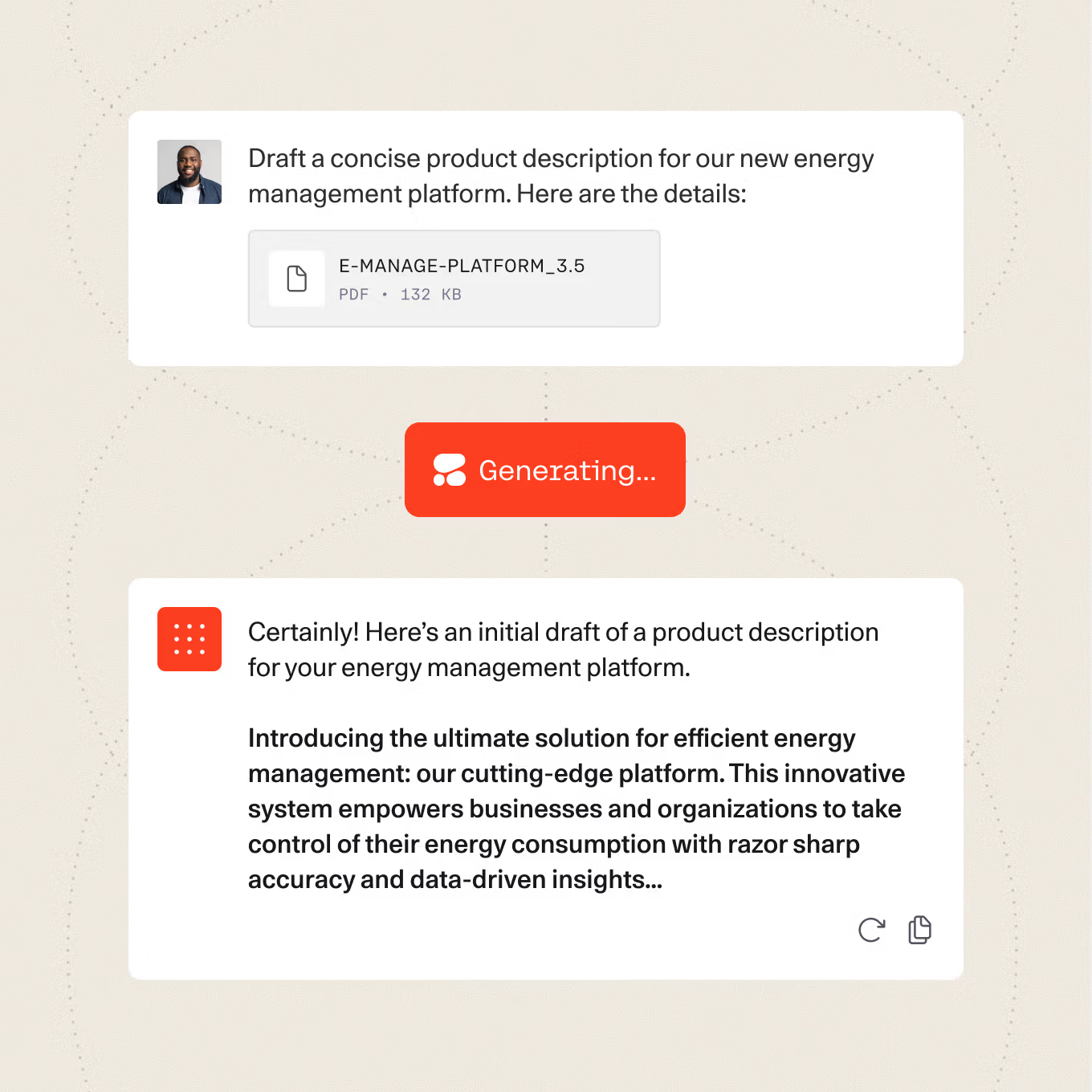

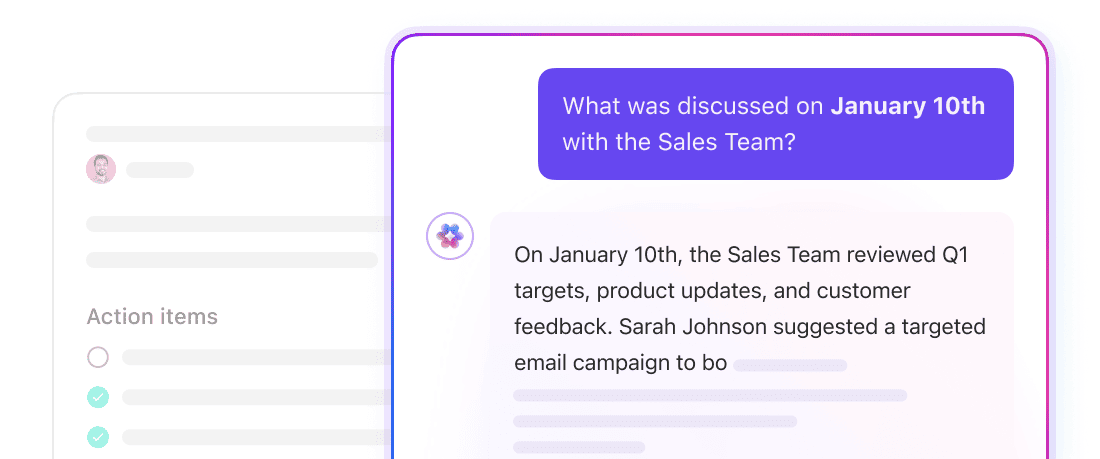

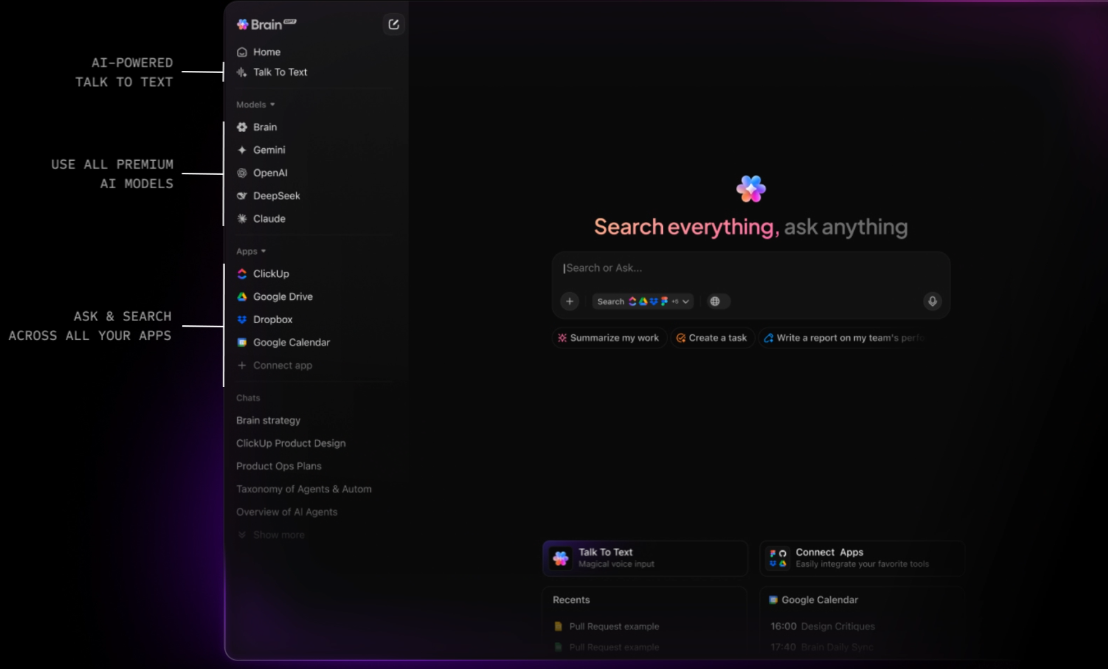

Erhalten Sie kontextbezogene Antworten aus dem gesamten Workspace mit ClickUp Brain.

ClickUp Brain ist eine kontextbezogene KI-Ebene, die in Ihrem gesamten Workspace funktioniert. Es kann Fragen beantworten, Informationen zusammenfassen und relevante Arbeiten anzeigen, da es bereits Zugriff auf die zugrunde liegende Struktur Ihres Workspaces hat: ClickUp-Aufgaben, ClickUp-Dokumente, ClickUp-Kommentare und mehr.

Hier müssen Sie keine Chunk-Größen definieren oder Einbettungen verwalten. Brain nutzt das native Datenmodell von ClickUp, um zu verstehen, wie Informationen miteinander verbunden sind. Stellen Sie eine Frage wie „Was blockiert den Start im vierten Quartal?“ und Brain kann den Kontext aus Aufgaben, Kommentaren und Dokumenten abrufen, die mit dieser Initiative verbunden sind.

ClickUp Brain unterstützt auch mehrere KI-Modelle im Hintergrund, sodass Sie verschiedene Anfragen an das für die Argumentation, Zusammenfassung oder Generierung am besten geeignete Modell weiterleiten können. Dadurch vermeiden Sie, dass Ihre Workflows an die Stärken oder Einschränkungen eines einzelnen Modells gebunden sind.

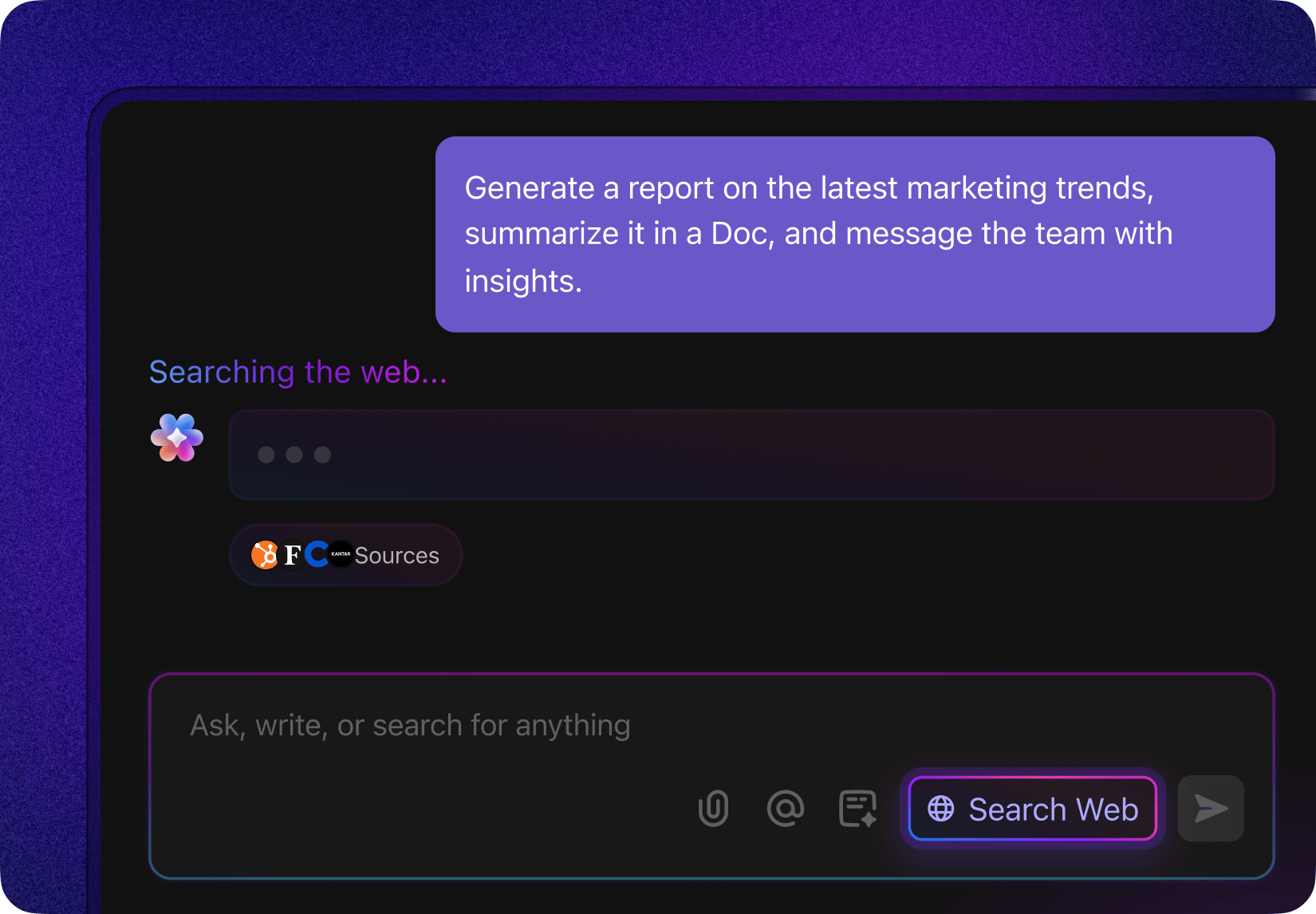

Wenn Sie externen Kontext benötigen, kann Brain direkt aus der ClickUp-Workspace heraus Websuchen durchführen und zusammengefasste Ergebnisse zurückgeben, ohne dass Sie ClickUp verlassen oder eine separate Browser-Registerkarte öffnen müssen.

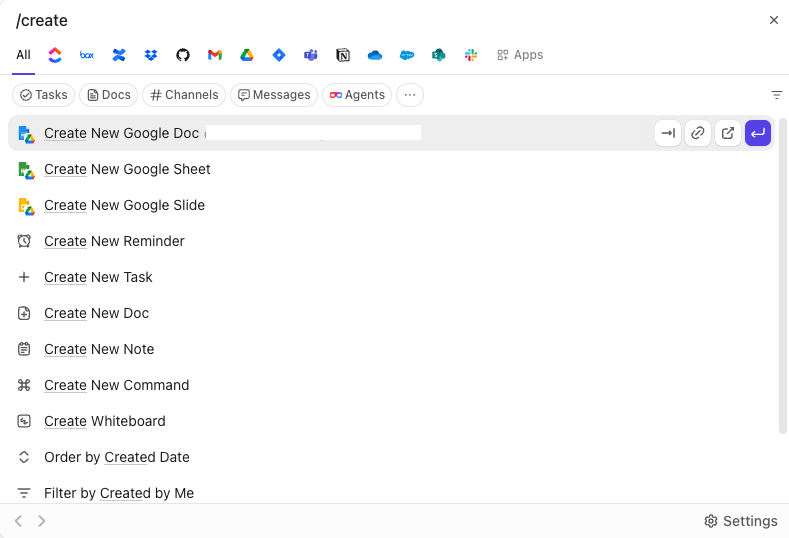

Suchen, navigieren und ausführen mit ClickUp Enterprise Search

Die Enterprise-Suche von ClickUp ist von überall im Arbeitsbereich zugänglich. Damit können Sie Aufgaben, Dokumente, Kommentare und Anhänge sowie verbundene Drittanbieter-Apps wie Google Drive, Slack, GitHub und mehr durchsuchen, je nach Ihren Integrationen.

Die KI-Befehlsleiste verwandelt die Suche in eine Ausführungsebene. Sie können direkt von derselben Oberfläche aus zu Elementen springen, Aufgaben erstellen, Status ändern, Eigentümer zuweisen oder bestimmte Ansichten öffnen. Es geht nicht nur um „Suchen und Lesen“, sondern um „Suchen und Handeln“.

Da die Suche in die Benutzeroberfläche des Workspace integriert ist, sind die Ergebnisse immer umsetzbar. Sie rufen Informationen nicht isoliert ab und wechseln dann zu einem anderen tool, um sie zu verwenden. Der Workflow wird an Ort und Stelle fortgesetzt.

Reduzieren Sie die Anzahl der tools mit ClickUp BrainGPT.

ClickUp BrainGPT erweitert die Suchfunktionen über den Browser hinaus und bietet eine eigenständige Desktop-App und eine Chrome-Erweiterung. Es verbindet sich direkt mit Ihrem Workspace und zeigt dieselben kontextbezogenen Informationen an, ohne dass Sie zuerst ClickUp oder eine Ihrer verbundenen Apps öffnen müssen.

Über eine einzige Oberfläche können Sie Aufgaben, Dokumente, Kommentare und verbundene Tools wie Gmail und andere Verbindungen durchsuchen. Mit der sprachbasierten Talk-to-Text-Funktion können Sie Suchanfragen stellen oder Fragen sofort erfassen, was besonders für schnelle Nachschlagearbeiten oder Arbeiten unterwegs nützlich ist.

Anstatt ein weiteres KI-Suchprodukt hinzuzufügen, das verwaltet werden muss, konsolidiert Brain GPT die Suche in einer Oberfläche, die Ihre Arbeit bereits versteht.

Das ist die eigentliche Veränderung. ClickUp verlangt von Ihnen nicht, eine Suche für Unternehmen aufzubauen. Dieser konvergierte Workspace bettet sie direkt in das System ein, in dem die Arbeit stattfindet, wodurch Infrastrukturkosten entfallen und gleichzeitig Leistung, Genauigkeit und Geschwindigkeit erhalten bleiben.

📖 Weiterlesen: Beispiele für die besten Wissensmanagementsysteme

Bonus: Strategischer Vergleich zwischen benutzerdefinierter und nativer Workspace-KI

| Kernwert | Maximale Flexibilität; proprietäre Kontrolle | Sofort einsatzbereit; Standard-Kontext-bezogen |

| Implementierung | Monate: Erfordert die Einrichtung von Pipelines durch Entwicklerteams. | Minuten: Ein-Klick-Umschaltung für den gesamten Workspace |

| Datenaufnahme | Handbuch: Sie müssen ETL und Vektordatenbank erstellen und pflegen. | Automatisch: Echtzeit-Zugriff auf Aufgaben, Dokumente und Chatten |

| Berechtigungslogik | Muss manuell Code eingegeben werden (hohes Risiko von Datenlecks) | Native übernommen aus Ihrer ClickUp-Hierarchie |

| Kontextuelle Tiefe | Semantisch (bedeutungsbasiert) | Operativ (weiß, wer wofür zuständig ist) |

| Benutzeroberfläche | Sie müssen die Suchleiste/den Chat entwerfen und erstellen. | Integriert (Suchleiste, Dokumente und Aufgabenansichten) |

| Workflow-Aktion | Keine: Der Benutzer findet Info und wechselt dann das Tool, um weiterzuarbeiten. | Hoch: Info finden und sofort in eine Aufgabe umwandeln |

| Am besten geeignet für | Technologieintensive Unternehmen, die proprietäre Software entwickeln | Teams, die „Tool-Wildwuchs” vermeiden und schnell handeln möchten |

Die Suche sollte Sie nicht aufhalten!

Die semantische Suche ist nicht mehr das Unterscheidungsmerkmal. Sie ist mittlerweile Standard.

Die tatsächlichen Kosten der Enterprise-Suche zeigen sich überall: in der Entwicklungszeit für den Aufbau und die Wartung, in der Infrastruktur, die für die Genauigkeit erforderlich ist, und in den Reibungsverlusten, die entstehen, wenn die Suche außerhalb der tools stattfindet, in denen tatsächlich die Arbeit getan wird. Das richtige Dokument zu finden, ist nicht besonders wichtig, wenn man dafür immer noch das System wechseln muss.

Deshalb geht es nicht nur um eine „bessere Suche”. Es geht darum, die Lücke zwischen Information und Ausführung zu schließen.

Wenn die Suche direkt in den Workspace eingebettet ist, bleibt der Kontext standardmäßig erhalten. Antworten werden nicht nur abgerufen, sondern sind sofort nutzbar. Aufgaben können aktualisiert, Entscheidungen dokumentiert und die Arbeit vorangetrieben werden, ohne dass eine weitere Übergabe erforderlich ist.

Für Teams, die nicht monatelang mit dem Aufbau und der Wartung einer benutzerdefinierten Suchinfrastruktur verbringen möchten, verändert die Arbeit in einem konvergenten KI-Arbeitsbereich die Situation grundlegend. ClickUp bietet eine KI-gestützte Suche auf Unternehmensniveau als Teil des Systems, das Ihr Team bereits für die Planung, Zusammenarbeit und Ausführung nutzt.

✅ Starten Sie kostenlos mit ClickUp.

Häufig gestellte Fragen

Cohere konzentriert sich speziell auf Anwendungsfälle in Unternehmen, wie z. B. die Suche, und bietet Modelle wie Embed und Rerank, die speziell für Abrufaufgaben entwickelt wurden. OpenAI bietet umfassendere, universell einsetzbare Modelle, die für die Suche angepasst werden können, aber möglicherweise mehr Feinabstimmung erfordern.

Ja, Cohere bietet APIs, die die Integration mit anderen Tools ermöglichen. Dies erfordert jedoch eine benutzerdefinierte Entwicklung und technische Ressourcen. Eine Alternative wie ClickUp bietet eine native KI-Suche, die sofort einsatzbereit ist und keine Integrationsarbeiten erfordert.

Branchen mit großen, unstrukturierten Repositorys – wie beispielsweise die Rechts-, Gesundheits-, Finanzdienstleistungs- und Technologiebranche – profitieren am meisten von der semantischen Suche. Jedes Unternehmen, das mit Wissensmanagement zu kämpfen hat, kann erhebliche Verbesserungen erzielen.