الخصوصية حق أساسي من حقوق الإنسان. وتنعكس هذه الخصوصية أيضًا على جميع جوانب الذكاء الاصطناعي في عصرنا الحالي. وفقًا لتقرير صادر عن شركة Cisco، يشعر 64% من الأشخاص بالقلق من احتمال مشاركة معلومات حساسة عن غير قصد عند استخدام أدوات الذكاء الاصطناعي.

هذا أحد الأسباب التي أدت إلى ارتفاع شعبية أدوات الذكاء الاصطناعي غير المتصلة بالإنترنت. عندما يعمل النموذج محليًا، يمكنك الكتابة والترميز والتلخيص والإبداع دون الحاجة إلى تحميل كل شيء على السحابة أو التعرض لمشاكل عند انقطاع اتصال Wi-Fi.

في هذه القائمة، سنغطي أفضل أدوات الذكاء الاصطناعي التي تعمل دون اتصال بالإنترنت، ومن بينها تطبيق فائق يساعدك على تنظيم ما تنتجه هذه الأدوات في نظام واحد متماسك وآمن للغاية.

ما هي أدوات الذكاء الاصطناعي غير المتصلة بالإنترنت؟

أدوات الذكاء الاصطناعي غير المتصلة بالإنترنت هي تطبيقات برمجية تعمل على تشغيل نماذج لغوية كبيرة (LLMs) على جهازك المحلي، دون الحاجة إلى اتصال بالإنترنت بعد تنزيل النموذج. يتم تخزين بيانات النموذج مباشرة على جهاز الكمبيوتر الخاص بك، لذلك تتم جميع عمليات المعالجة أو الاستدلال على وحدة المعالجة المركزية (CPU) أو وحدة معالجة الرسومات (GPU) الخاصة بك.

تتميز هذه المعالجة على الجهاز بعدة مزايا رئيسية:

- خصوصية كاملة للبيانات: معلوماتك الحساسة لا تغادر جهاز الكمبيوتر الخاص بك أبدًا

- لا توجد رسوم متكررة: بمجرد حصولك على الأداة والنموذج، لن تكون هناك أي تكاليف اشتراك.

- يعمل في أي مكان: يمكنك استخدامه في الطائرة أو في كوخ بعيد أو أثناء انقطاع الإنترنت

- تحكم كامل: يمكنك اختيار النماذج التي تريد استخدامها وكيفية تكوينها

أفضل أدوات الذكاء الاصطناعي غير المتصلة بالإنترنت في لمحة

فيما يلي ملخص سريع لأفضل أدوات الذكاء الاصطناعي المتاحة اليوم.

| اسم الأداة | الميزات الرئيسية | الأفضل لـ | الأسعار* |

| ClickUp | وضع عدم الاتصال بالإنترنت للمهام والتذكيرات، ClickUp Brain MAX الذي يتضمن Talk-to-Text، Enterprise Search عبر التطبيقات المتصلة، Docs and Knowledge Management، Automations، بالإضافة إلى Integrations و API | الفرق التي تحتاج إلى التقاط غير متصل بالإنترنت بالإضافة إلى التنفيذ عبر الإنترنت والحوكمة وسياق الذكاء الاصطناعي في مساحة عمل واحدة | مجاني إلى الأبد؛ التخصيص متاح للمؤسسات |

| GPT4All | دردشة محلية مع نماذج مفتوحة، LocalDocs للأسئلة والأجوبة الخاصة بالوثائق، اكتشاف النماذج وتنزيلها داخل التطبيق، خادم API محلي متوافق مع OpenAI | المستخدمون المهتمون بالخصوصية والذين يرغبون في روبوت دردشة سطح مكتب بسيط يعمل دون اتصال بالإنترنت مع مستندات محلية | تتوفر خطة مجانية؛ تبدأ الخطط المدفوعة من 40 دولارًا أمريكيًا للمستخدم شهريًا |

| استوديو LM | اكتشاف النماذج وتنزيلها، واجهة مستخدم الدردشة بالإضافة إلى RAG المحلي، خادم متوافق مع OpenAI أو REST API، الإعدادات المسبقة وضبط الأداء | المطورون والمستخدمون المتمرسون الذين يرغبون في الحصول على منصة عمل نموذجية متطورة تعمل دون اتصال بالإنترنت | مجاني |

| أولاما | نموذج أمر واحد، واجهة برمجة تطبيقات REST محلية مع البث المباشر، ملفات نماذج للتكوينات القابلة لإعادة الاستخدام، وتضمينات لخطوط أنابيب RAG | المطورون الذين يريدون وقت تشغيل محلي يعتمد على CLI أولاً مع طبقة API قوية | تتوفر خطة مجانية؛ تبدأ الخطط المدفوعة من 20 دولارًا شهريًا |

| يناير ai | واجهة مستخدم غير متصلة بالإنترنت على غرار ChatGPT، ومساعدون، ودعم MCP، وملحقات لإمكانيات إضافية، ومزودون اختياريون متوافقون مع OpenAI | المستخدمون غير التقنيين الذين يرغبون في مساعد نظيف يعمل دون اتصال بالإنترنت مع إمكانية التخصيص | مجاني ومفتوح المصدر |

| Llamafile | تعبئة نموذج قابل للتنفيذ واحد، توزيع محمول عبر أنظمة التشغيل، وضع الخادم المحلي مع واجهة مستخدم ويب وواجهة برمجة تطبيقات، وقت تشغيل باعتمادية قليلة | المستخدمون الذين يريدون ملف AI محمول لا يحتاج إلى تثبيت ويمكنهم تشغيله في أي مكان | مجاني ومفتوح المصدر |

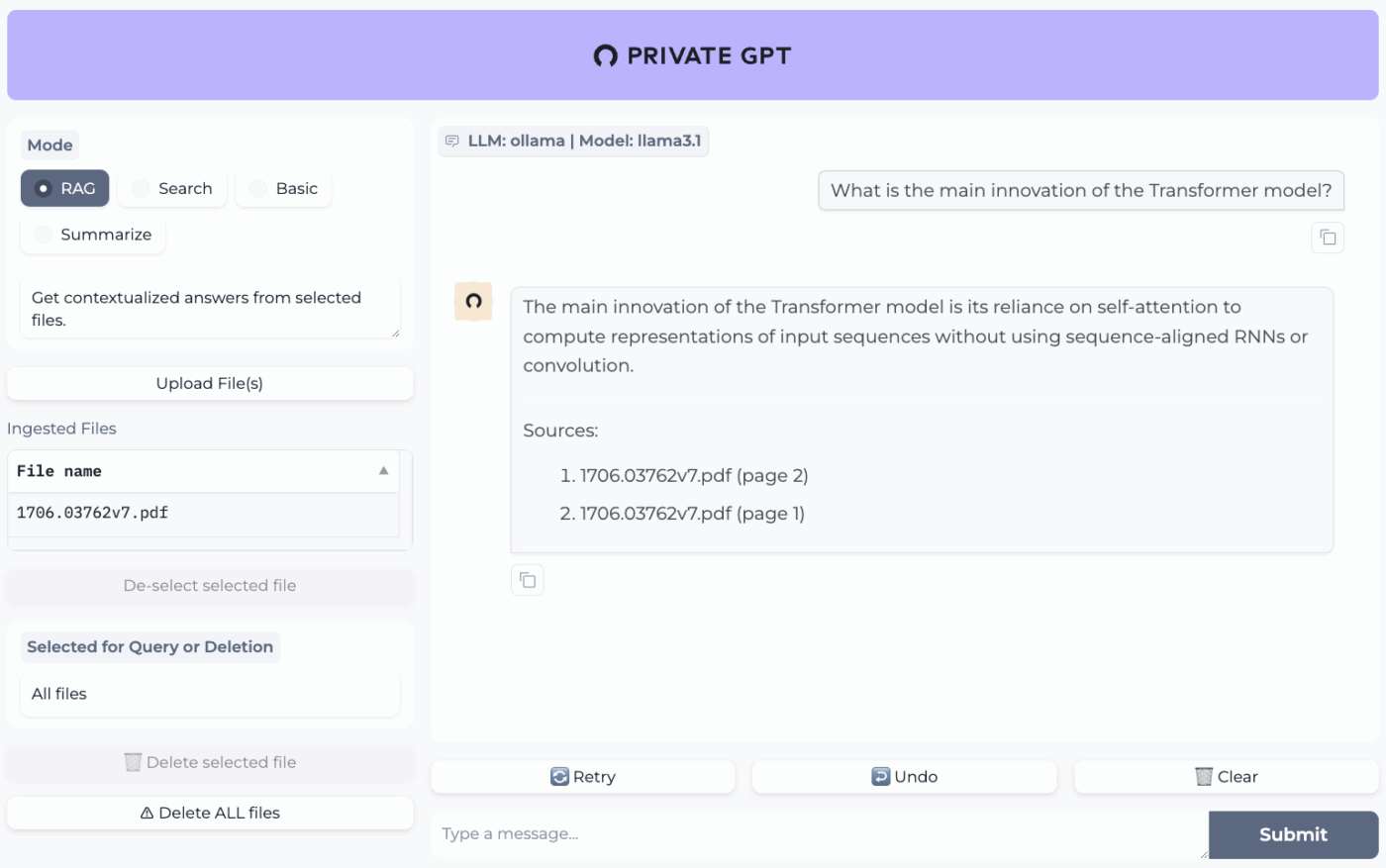

| PrivateGPT | استيعاب وفهرسة المستندات ذاتية الاستضافة، أسئلة وأجوبة RAG دون اتصال بالإنترنت، تصفية السياق حسب المستند، LLM معياري، ومكدس تخزين متجهات | الفرق التي تحتاج إلى أسئلة وأجوبة غير متصلة بالإنترنت حول الملفات الداخلية مع خط أنابيب RAG قابل للتحكم | مجاني ومفتوح المصدر |

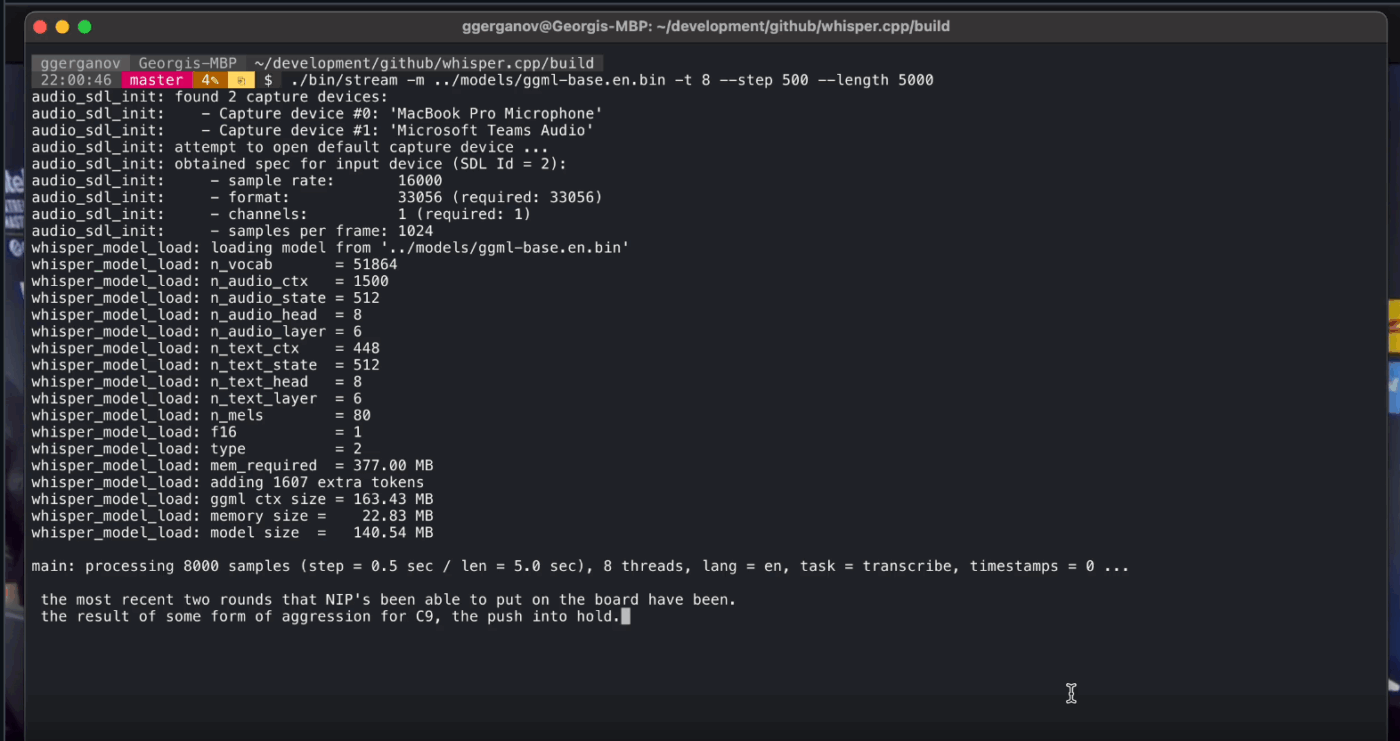

| Whisper. cpp | تحويل الكلام المحلي إلى نص، نماذج محددة لاستخدام موارد أقل، دعم VAD، معالجة FFmpeg اختيارية لمزيد من التنسيقات | المستخدمون الذين يحتاجون إلى نسخة مكتوبة بالكامل يمكنهم تضمينها في التطبيقات | مجاني ومفتوح المصدر |

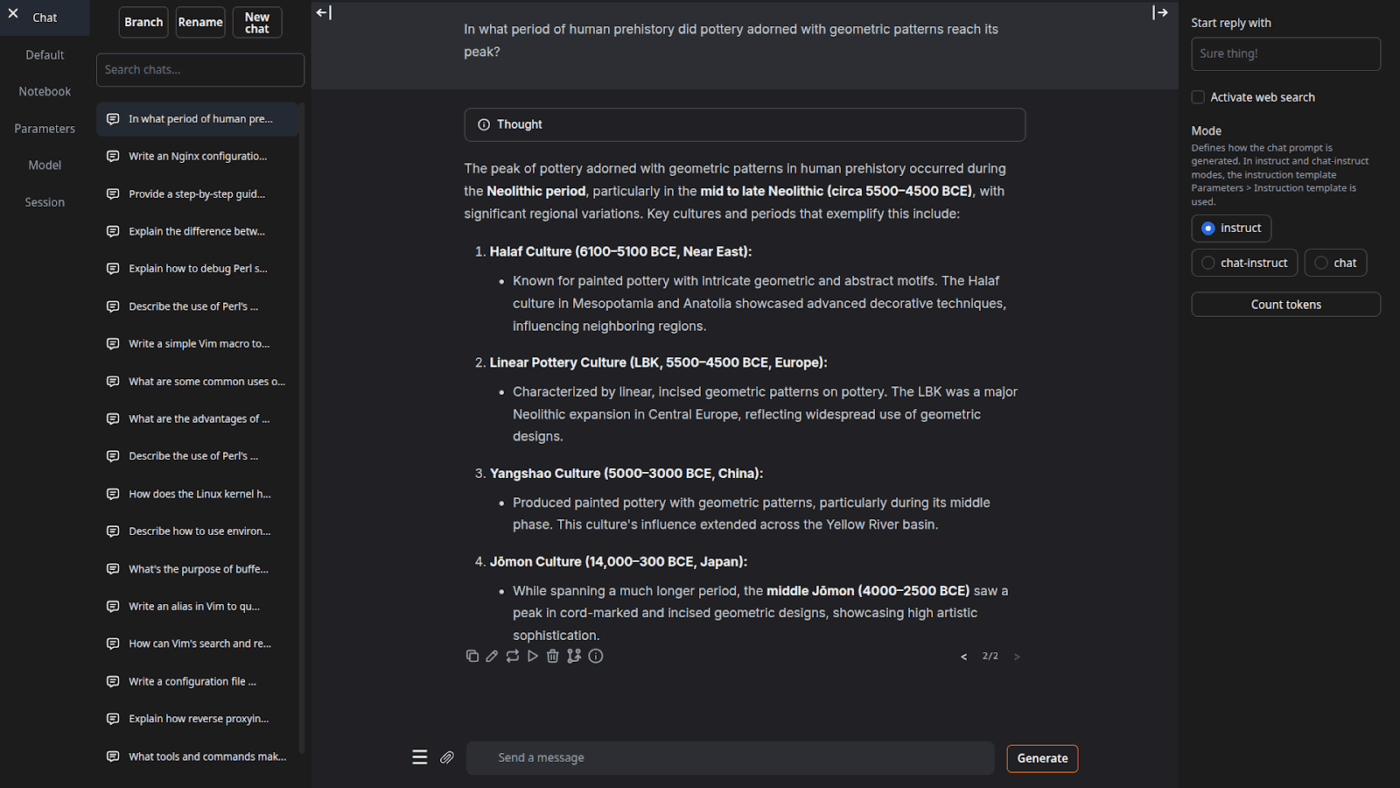

| واجهة المستخدم على الويب لتوليد النصوص | واجهة مستخدم قائمة على المتصفح للنماذج المحلية، وقوالب موجه Jinja2، وعناصر التحكم في الإنشاء، وتفرع الدردشة، وتحرير الرسائل | المستخدمون الذين يرغبون في أقصى قدر من التخصيص في واجهة ويب محلية | مجاني ومفتوح المصدر |

| llama. cpp | محرك استدلال عالي الأداء، دعم واسع للتكمية، خادم محلي مع نقاط نهاية على غرار OpenAI، تضمينات، ودعم إعادة الترتيب | المطورون الذين يقومون بإنشاء تطبيقات أو خلفيات مخصصة للذكاء الاصطناعي دون اتصال بالإنترنت | مجاني ومفتوح المصدر |

كيف نقوم بمراجعة البرامج في ClickUp

يتبع فريق التحرير لدينا عملية شفافة ومدعومة بالبحوث ومحايدة تجاه الموردين، لذا يمكنك الوثوق في أن توصياتنا تستند إلى القيمة الحقيقية للمنتج.

فيما يلي ملخص مفصل لكيفية مراجعة البرامج في ClickUp.

ما الذي يجب البحث عنه في أفضل أدوات الذكاء الاصطناعي التي تعمل دون اتصال بالإنترنت

قد يبدو تقييم أدوات الذكاء الاصطناعي غير المتصلة بالإنترنت أمراً تقنياً ومربكاً، مما قد يدفعك إلى اختيار أداة قد لا تعمل على جهاز الكمبيوتر الخاص بك. أهم شيء يجب أخذه في الاعتبار هو ما تريد تحقيقه. فالمطور الذي يعمل على إنشاء تطبيق يعمل بالذكاء الاصطناعي له احتياجات مختلفة تماماً عن شخص يريد فقط روبوت محادثة خاصاً وغير متصل بالإنترنت لمساعدته في الكتابة.

فيما يلي المعايير الرئيسية التي يجب تقييمها:

- سهولة الإعداد: هل يتطلب معرفة تقنية وعملًا على سطر الأوامر، أم أنه تثبيت بسيط بنقرة واحدة؟

- اختيار الطراز: هل يمكنك الاختيار بسهولة من بين مجموعة متنوعة من الطرازات، أم أنك مقيد بعدد قليل منها؟

- ضمانات الخصوصية: هل تعالج الأداة جميع البيانات محليًا أم أن هناك مكونات سحابية مخفية؟

- متطلبات الأجهزة: هل سيؤدي بشكل جيد على جهازك الحالي أم أنك بحاجة إلى ترقية؟

- قدرات التكامل: هل يمكنه الاتصال بأدواتك الأخرى، أم أنه تطبيق مستقل تمامًا؟

- ملاءمة حالة الاستخدام: هل تم تصميمه للدردشة العامة، أو لطرح أسئلة حول مستنداتك، أو لنسخ الصوت، أو لإنشاء رموز برمجية؟

أفضل 10 أدوات ذكاء اصطناعي تعمل دون اتصال بالإنترنت

فيما يلي نظرة عامة على أفضل أدوات الذكاء الاصطناعي غير المتصلة بالإنترنت 👇

1. ClickUp (الأفضل لحفظ المهام والمستندات وسياق الذكاء الاصطناعي في مكان واحد عبر العمل دون اتصال بالإنترنت وعبر الإنترنت)

ClickUp، أول مساحة عمل متكاملة للذكاء الاصطناعي في العالم، مبنية على أساس "الذكاء الاصطناعي غير المتصل بالإنترنت" الذي لا يقتصر على توليد إجابة. ذلك لأنك لا تزال بحاجة إلى مكان يتحول فيه هذا الناتج إلى قرار ومهمة وخطوة تالية لا تختفي في الملفات والمحادثات.

وعلى عكس العديد من الإعدادات غير المتصلة بالإنترنت التي تتطلب عمليات تثبيت طويلة وتجميع أدوات، يوفر لك ClickUp طبقة تنفيذ كاملة في مكان واحد، مع عمل الذكاء الاصطناعي في نفس سياق مساحة العمل.

بالنسبة للمبتدئين، لديك وضع ClickUp Offline Mode، الذي يتم تشغيله تلقائيًا ويحافظ على استمرار العمل عند وجود نشاط غير متصل بالإنترنت. وهذا يعني أن جميع مهامك وتذكيراتك وملاحظاتك تظل متاحة أثناء عدم الاتصال بالإنترنت، مع خيار إضافة المزيد إذا لزم الأمر. بمجرد إعادة الاتصال، تتم مزامنة المهام والتذكيرات الجديدة مع مساحة العمل الخاصة بك تلقائيًا (قل وداعًا لفقدان السياق 👋).

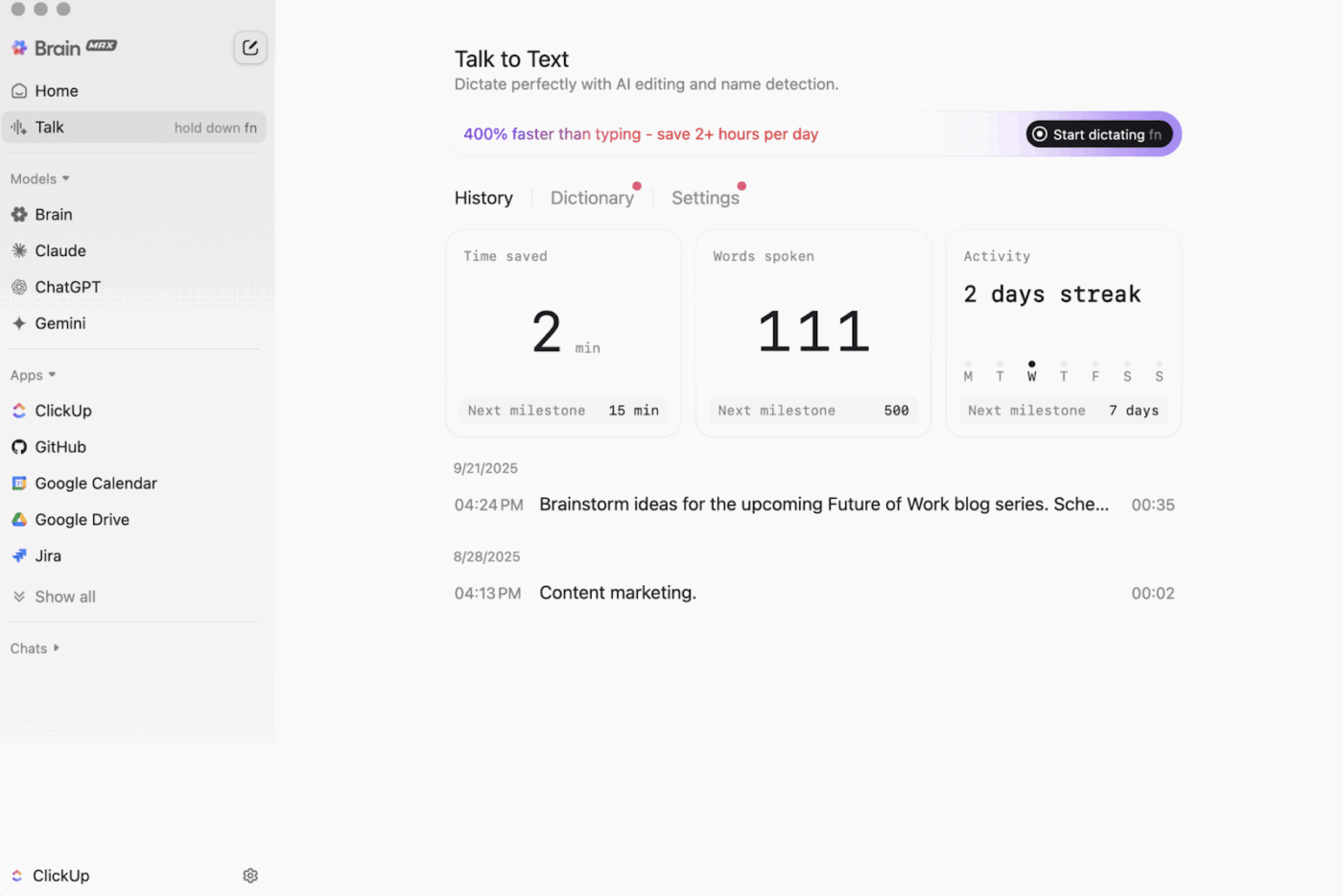

ثم هناك ClickUp Brain MAX ، الرفيق الذكي للكمبيوتر المكتبي الذي يضع الخصوصية في المقام الأول، والذي يمكنه تخزين البيانات والبحث في جميع أنحاء مساحة العمل الخاصة بك والتطبيقات المتصلة وحتى الويب.

بفضل ميزة Talk-to-Text ، يمكن لـ Brain MAX تحويل صوتك إلى نص دون استخدام اليدين. ويشمل ذلك صياغة رسالة بريد إلكتروني أو كتابة مستند أو تسجيل تحديث سريع أثناء تنقلك.

يوفر لك Brain MAX أيضًا الذكاء الاصطناعي الشامل، المصمم للدردشة مع أحدث نماذج الذكاء الاصطناعي للترميز والكتابة والتفكير المعقد وغير ذلك. وهذا يعني أنه يمكنك طرح الأسئلة على أفضل نماذج الذكاء الاصطناعي في مكان واحد، بما في ذلك ClickUp Brain بالإضافة إلى خيارات مثل OpenAI وClaude وGemini، دون الحاجة إلى التبديل بين الأدوات.

علاوة على ذلك، يضيف ClickUp Security حواجز حماية غالبًا ما تتجاهلها الأدوات غير المتصلة بالإنترنت. فكر في التشفير والأذونات الدقيقة وعناصر التحكم الإدارية مثل SSO والتزويد وسجلات التدقيق، وكلها مصممة للفرق التي تحتاج إلى أمان على مستوى المؤسسات.

تساعد إدارة المعرفة ClickUp AI بشكل كبير في عملية الانتقال من "الوضع غير المتصل بالإنترنت إلى الوضع المتصل بالإنترنت". فهي توفر لفريقك مركزًا لتخزين الموارد المختلفة في المستندات والويكي، ثم تستخدم ClickUp Brain للحصول على إجابات فورية من جميع أنحاء مساحة العمل الخاصة بك، بحيث يتوفر السياق الصحيح في اللحظة التي يتم فيها استئناف العمل.

🎬 الوكلاء في العمل: استخدم الوكلاء الخارقين لتحويل العمل المتزامن إلى خطوات تالية!

ClickUp Super Agents هي زملاء فريق مدعومون بالذكاء الاصطناعي يمكنك إنشاؤهم وتخصيصهم لتشغيل سير عمل متعدد الخطوات داخل مساحة عمل ClickUp الخاصة بك. يمكنك تكوين مشغلات وتعليمات ووصول إلى أدوات محددة لضمان عملهم ضمن الحدود التي تحددها.

على سبيل المثال، بعد مزامنة المهام غير المتصلة بالإنترنت، يمكن للوكيل الفائق فحص العناصر الجديدة، وتلخيص التغييرات، واستخراج خطوات العمل، وصياغة تحديث، وتوجيهه إلى المالك المناسب للمراجعة.

ونظرًا لأن Super Agents قابلة للتحكم، يمكنك التحكم في ما يمكنهم الوصول إليه من خلال الأذونات ومراجعة ما يفعلونه. 🔐

أفضل ميزات ClickUp

- ابحث عن أي شيء عبر أدواتك: قم بفرز وبحث في مساحة العمل بالكامل، بالإضافة إلى التطبيقات المتصلة، من مكان واحد باستخدام ClickUp Enterprise Search

- بناء قاعدة معرفية حقيقية: أنشئ مواقع ويكي ووثائق باستخدام ClickUp Docs باستخدام الصفحات المتداخلة والقوالب والمساعدة بالذكاء الاصطناعي والمزيد.

- حافظ على اتصال مجموعتك: قم بمزامنة العمل باستخدام أدوات مثل Slack و GitHub دون مغادرة ClickUp باستخدام تكاملات ClickUp

- إنشاء سير عمل مخصص: استخدم واجهة برمجة تطبيقات ClickUp مع الرموز الشخصية أو OAuth 2. 0 لتشغيل عمليات الأتمتة والتكامل المخصصة

- أتمتة مجموعتك: قم بتشغيل إجراءات مثل تعيين المالكين أو تحديث الحالات أو بدء عمليات التسليم بناءً على تغييرات المهام باستخدام ClickUp Automations.

قيود ClickUp

- نظرًا لتنوع الميزات، قد يواجه بعض المستخدمين صعوبة في التعلم

أسعار ClickUp

تقييمات ومراجعات ClickUp

- G2: 4. 7/5 (أكثر من 10,000 تقييم)

- Capterra: 4. 6/5 (أكثر من 4000 تقييم)

ماذا يقول المستخدمون الحقيقيون عن ClickUp؟

يقول أحد المراجعين في G2:

لوحات مرنة، وعمليات تكامل، وتخصيص. كما أنني أحب حقيقة أنه يمكنني ببساطة قطع الاتصال بالإنترنت والاستمرار في العمل على المهام. بالإضافة إلى ذلك، يمكنني إرسال رسائل بريد إلكتروني إلى أي من القوائم وإنشاء المهام تلقائيًا. محرر النصوص رائع، حيث يعمل في وضع MD ومع الاختصارات، مما يتيح لك معاينة المحتوى في السطر.

لوحات مرنة، وعمليات تكامل، وتخصيص. كما أنني أحب حقيقة أنه يمكنني ببساطة قطع الاتصال بالإنترنت والاستمرار في العمل على المهام. بالإضافة إلى ذلك، يمكنني إرسال رسائل بريد إلكتروني إلى أي من القوائم وإنشاء المهام تلقائيًا. محرر النصوص رائع، حيث يعمل في وضع MD ومع الاختصارات، مما يتيح لك معاينة المحتوى في السطر نفسه.

2. GPT4All (الأفضل للدردشة الخاصة غير المتصلة بالإنترنت مع نماذج اللغة الكبيرة المحلية)

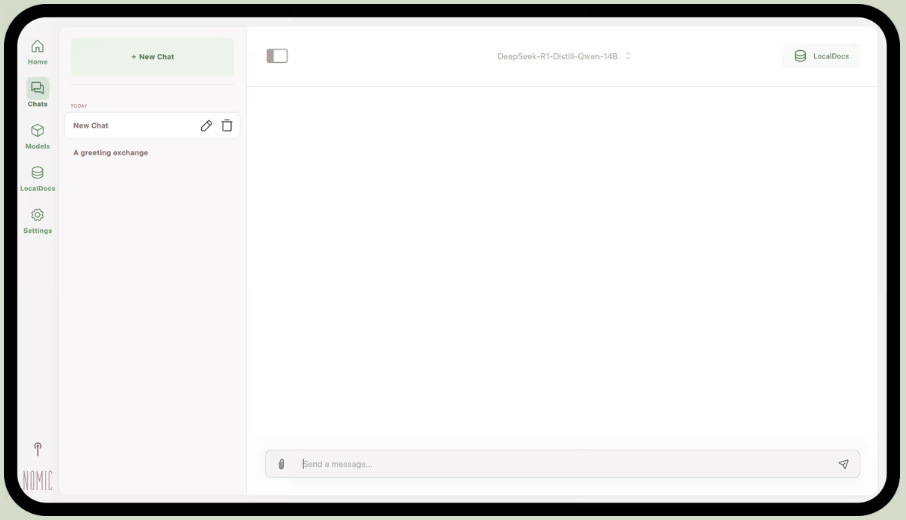

GPT4All هو جزء من Nomic.ai، وهو تطبيق سطح مكتب يتيح لك تشغيل نماذج لغوية كبيرة مفتوحة المصدر مباشرة على جهاز الكمبيوتر الخاص بك، بحيث يمكنك الدردشة مع مساعد الذكاء الاصطناعي دون الاعتماد على الوصول إلى الإنترنت أو استدعاءات واجهة برمجة التطبيقات السحابية. تم تصميمه للأشخاص الذين يرغبون في إعداد "محلي أولاً"، حيث تظل المطالبات والاستجابات والملفات على الجهاز.

أفضل ميزة فيه هي LocalDocs، التي تستخدم شكلاً من أشكال التوليد المعزز بالاسترجاع لتتيح لك الدردشة مع مستنداتك الخاصة بشكل خاص. يمكنك توجيه التطبيق إلى مجلد من ملفات PDF أو ملفات نصية، وسيقوم بإنشاء قاعدة معرفية محلية يمكنك طرح الأسئلة عليها.

يتضمن GPT4All أيضًا مكتبة مختارة من النماذج الشائعة مثل Llama و Mistral، والتي يمكنك تنزيلها مباشرة من خلال التطبيق.

أفضل ميزات GPT4All

- ابدأ تشغيل خادم API محلي (متوافق مع OpenAI) لاستخدام نماذج GPT4All داخل تطبيقات وأتمتة أخرى

- ابحث عن نماذج GGUF وقارنها وقم بتنزيلها من داخل التطبيق، مع خيارات فرز مثل الإعجابات والتنزيلات وتاريخ التحميل.

- اضبط طول السياق، والطول الأقصى للإخراج، و top-p، و top-k، وعقوبة التكرار، وخيوط وحدة المعالجة المركزية، وحتى تفريغ طبقة وحدة معالجة الرسومات (بالإضافة إلى دعم Metal على Apple Silicon)

قيود GPT4All

- يعتمد الأداء بشكل كبير على أجهزة الكمبيوتر الخاصة بك

- قد يكون فهرسة مجموعات كبيرة من المستندات عملية بطيئة

أسعار GPT4All

- تطبيق سطح مكتب مجاني

- الأعمال: 40 دولارًا أمريكيًا لكل مستخدم شهريًا (Nomic AI)

- المؤسسات: أسعار مخصصة (Nomic AI)

تقييمات ومراجعات GPT4All

- G2: عدد المراجعات غير كافٍ

- Capterra: عدد التقييمات غير كافٍ

ماذا يقول المستخدمون الحقيقيون عن GPT4All؟

يقول أحد مستخدمي Reddit:

هذا هو أفضل ما جربته مع RAG، يتفوق على كل شيء، وحتى LM Studio في البساطة. تعجبني طريقة تعيينه إلى مجلد، حيث يتتبع التغييرات ويتعامل معها نيابة عنك. لا يزال في مرحلة مبكرة من النضج، مثل البقية، ولكنه سيكون خياري الافتراضي على المدى القصير.

هذا هو أفضل ما جربته مع RAG، يتفوق على كل شيء، وحتى LM Studio في البساطة. تعجبني طريقة تعيينه إلى مجلد، حيث يتتبع التغييرات ويتعامل معها نيابة عنك. لا يزال في مرحلة مبكرة من النضج، مثل البقية، ولكنه سيكون خياري الافتراضي على المدى القصير.

📮 ClickUp Insight: 88٪ من المشاركين في استطلاعنا يستخدمون الذكاء الاصطناعي في مهامهم الشخصية، لكن أكثر من 50٪ يتجنبون استخدامه في العمل. ما هي العوائق الثلاثة الرئيسية؟ عدم التكامل السلس، والثغرات المعرفية، والمخاوف الأمنية. ولكن ماذا لو كان الذكاء الاصطناعي مدمجًا في مساحة عملك ومؤمنًا بالفعل؟ ClickUp Brain،

مساعد الذكاء الاصطناعي المدمج في ClickUp يجعل هذا الأمر حقيقة واقعة. فهو يفهم المطالبات بلغة بسيطة، ويحل جميع المخاوف الثلاثة المتعلقة بتبني الذكاء الاصطناعي، بينما يربط الدردشة والمهام والمستندات والمعرفة عبر مساحة العمل. اعثر على الإجابات والأفكار بنقرة واحدة!

3. LM Studio (الأفضل لطاولة عمل نموذجية مصقولة دون اتصال بالإنترنت مع ضبط الأداء)

عبر LM Studio

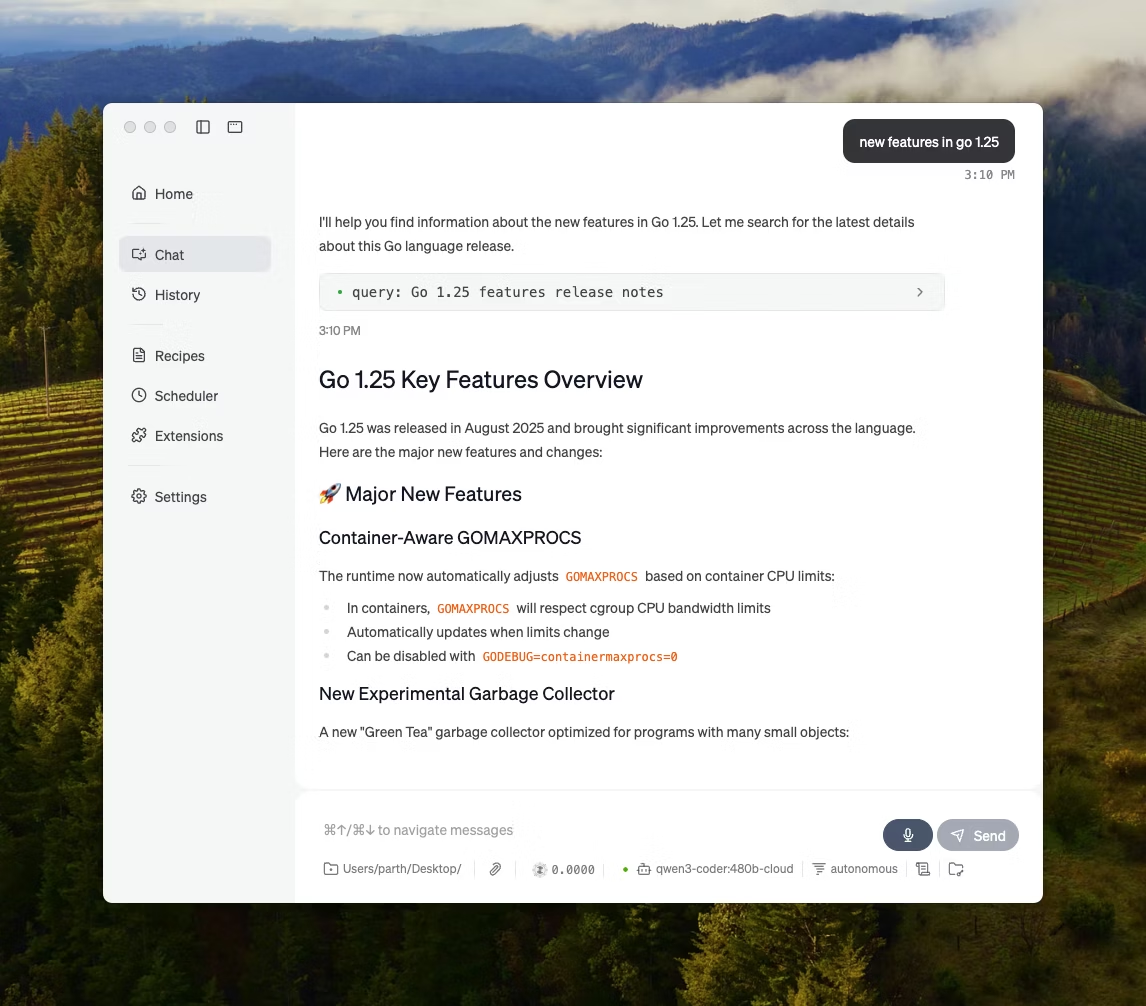

LM Studio هو تطبيق محلي للذكاء الاصطناعي يعمل على سطح المكتب ويتمحور حول البحث عن نماذج مفتوحة المصدر واختبارها وتشغيلها في واجهة مستخدم، دون الحاجة إلى الاعتماد على محطة طرفية. وهو موجه نحو التجريب، مثل اختيار نموذج وتشغيله محليًا وتكرار المطالبات والإعدادات مع حلقة تغذية مرتدة أكثر إحكامًا من معظم الإعدادات التي تعتمد على واجهة سطر الأوامر أولاً.

كما أنه يدعم الدردشة مع المستندات دون اتصال بالإنترنت تمامًا (RAG محلي)، حيث يمكنك إرفاق الملفات بالمحادثة والرجوع إليها أثناء الردود. وهذا يجعله مثاليًا للبحث دون اتصال بالإنترنت، أو ملاحظات الدراسة، أو سير عمل المستندات الداخلية حيث لا يتوفر خيار التحميل.

يمنحك LM Studio أيضًا تحكمًا دقيقًا في كيفية تشغيل الذكاء الاصطناعي، مع خيارات لضبط درجة الحرارة وطول السياق واستخدام وحدة معالجة الرسومات.

أفضل ميزات LM Studio

- استخدم وضع التوافق OpenAI أو واجهة برمجة التطبيقات REST الخاصة بـ LM Studio، حسب متطلبات تطبيقك.

- يوفر LM Studio خيارات JavaScript و Python SDK لإنشاء سير عمل محلي على نماذجك.

- احفظ موجه النظام + المعلمات كإعداد مسبق، ثم أعد استخدامه عبر الدردشات (يمكن أيضًا استيراد الإعدادات المسبقة من ملف/عنوان URL ونشرها للمشاركة عبر LM Studio Hub)

قيود LM Studio

- يمكن أن يتسبب LM Studio في تجميد الكمبيوتر أثناء تشغيل DeepSeek R1 32B

- بعض المستخدمين يشيرون إلى التطبيق على أنه يمثل مشكلة تتعلق بأمن البيانات والخصوصية بسبب عدم خضوعه للتدقيق وكونه مغلق المصدر.

أسعار LM Studio

- مجاني للاستخدام المنزلي والعمل

تقييمات ومراجعات LM Studio

- G2: عدد المراجعات غير كافٍ

- Capterra: عدد التقييمات غير كافٍ

ماذا يقول المستخدمون الحقيقيون عن LM Studio؟

يقول أحد مستخدمي Reddit:

إنه رائع. إنه يعمل ببساطة، وسهل الاستخدام للغاية. يتميز بواجهة مستخدم هي الأجمل من بين جميع المنافسين.

إنه رائع. إنه يعمل ببساطة، وسهل الاستخدام للغاية. يتميز بواجهة مستخدم هي الأجمل من بين جميع المنافسين.

4. Ollama (الأفضل لتشغيل نماذج اللغة الكبيرة المحلية باستخدام واجهة سطر أوامر بسيطة + خادم محلي)

Ollama هو مشغل نماذج محلي يعمل بشكل أشبه ببيئة تشغيل LLM أكثر من كونه تطبيق دردشة مستقل. وهو يعمل على أساس المحطة الطرفية أولاً، ومصمم لسحب وتشغيل النماذج المفتوحة باستخدام أوامر سريعة (مثل ollama run llama3)، ثم عرضها من خلال خدمة محلية يمكن أن تعمل عليها واجهات أخرى.

تكمن قوة Ollama في واجهة برمجة التطبيقات REST API. بمجرد تشغيل Ollama في الخلفية، يمكن لأي تطبيق التواصل معها من خلال طلبات HTTP بسيطة. وهذا يساعد في دمج ميزات الذكاء الاصطناعي في برامجك الخاصة.

يوفر Ollama أيضًا مكتبة من النماذج الشائعة التي يمكن تنزيلها بأمر واحد، ويمكنك إنشاء تكوينات نماذج مخصصة، والتي تشبه ملفات Dockerfiles الخاصة بالذكاء الاصطناعي.

أفضل ميزات Ollama

- إنشاء وصفات نماذج قابلة لإعادة الاستخدام وقابلة للتحديث (اختيار النموذج الأساسي، قوالب المطالبات، رسائل النظام، المعلمات، المحولات) باستخدام ملف نموذج

- قم بتشغيل النماذج من خلال نقاط النهاية مثل الدردشة/التوليد مع البث الاختياري لإخراج الرموز في الوقت الفعلي في التطبيقات والنصوص البرمجية

- إنشاء تضمينات لعمليات البحث والاسترجاع الدلالية باستخدام إمكانية التضمينات في Ollama ونماذج التضمين الموصى بها

قيود أولاما

- لا يحتوي على واجهة رسومية مدمجة، لذا سيحتاج المستخدمون غير التقنيين إلى أداة واجهة مستخدم منفصلة.

- قد يتعطل تطبيق Ollama لسطح المكتب macOS أثناء عدم الاتصال بالإنترنت، حتى في حالة تنزيل النماذج بالفعل، بينما يستمر CLI في العمل.

أسعار Ollama

- مجاني

- المزايا: 20 دولارًا شهريًا

- الحد الأقصى: 100 دولار شهريًا

تقييمات ومراجعات Ollama

- G2: عدد المراجعات غير كافٍ

- Capterra: عدد التقييمات غير كافٍ

ماذا يقول المستخدمون الحقيقيون عن Ollama؟

يقول أحد المراجعين في Producthunt:

سهل النشر والإدارة. يجعل Ollama تشغيل LLMs المحلية أمرًا سهلاً للغاية. قم بإقرانه مع OpenWebUI للحصول على أفضل تجربة.

سهل النشر والإدارة. يجعل Ollama تشغيل LLMs المحلية أمرًا سهلاً للغاية. قم بإقرانه مع OpenWebUI للحصول على أفضل تجربة.

🧠 حقيقة مثيرة للاهتمام: بدأ تحويل الكلام إلى نص كـ "أرقام فقط". كان نظام AUDREY (1952) من Bell Labs يتعرف على الأرقام من 0 إلى 9، وتشير إحدى الروايات إلى أنه كان يعمل بشكل أفضل عندما يتحدث به مخترعه.

5. يناير ai (الأفضل لمساعد على غرار ChatGPT يعمل دون اتصال بالإنترنت ويولي الأولوية للخصوصية)

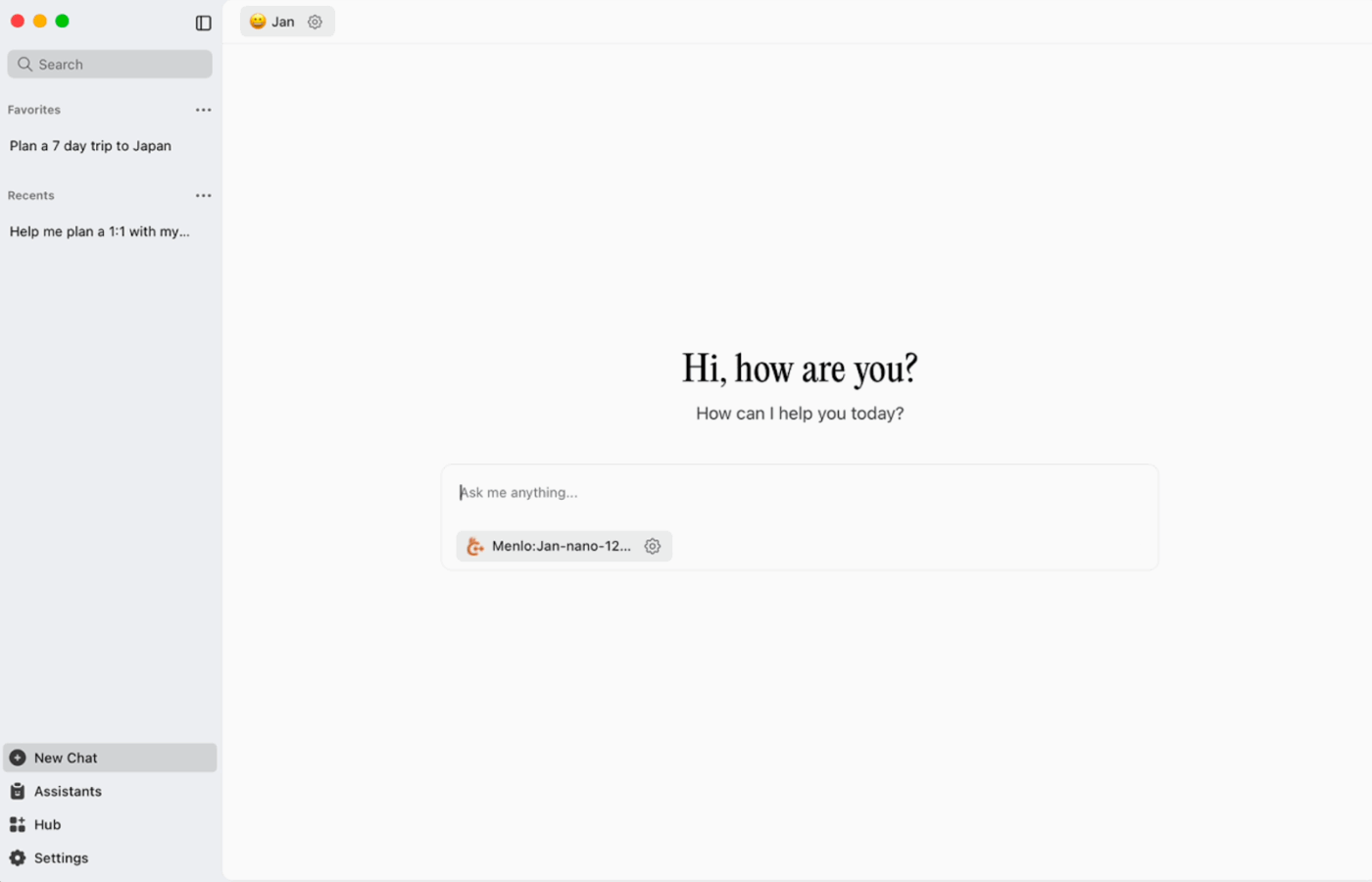

Jan. ai هو مساعد سطح مكتب مفتوح المصدر يوفر تجربة دردشة تشبه ChatGPT على أنظمة macOS و Windows و Linux، مع استخدام محلي أولاً كإعداد افتراضي. يعمل على الجهاز عندما تريد ذلك، بينما يتم تخزين سجل المحادثات وبيانات الاستخدام محليًا ولا تغادر جهاز الكمبيوتر الخاص بك.

وهو يدعم تشغيل نماذج مفتوحة المصدر محليًا ويسمح أيضًا باتصالات اختيارية بمزودي خدمات عن بُعد مثل واجهات برمجة التطبيقات المتوافقة مع OpenAI، مما يجعله مرنًا عندما يكون الاستخدام دون اتصال بالإنترنت هو الأولوية، ولكن في بعض الأحيان يكون الوصول إلى السحابة ضروريًا.

أفضل ميزات يناير ai

- قم بإنشاء مساعدين مع تعليماتهم وإعداداتهم الخاصة، ثم قم بالتبديل بينهم من علامة التبويب "المساعدون" بدلاً من إعادة كتابة المطالبات في كل مرة.

- قم بتوصيل Jan بأدوات MCP ومصادر البيانات باستخدام معيار مفتوح مصمم لعمليات سير العمل التي تعتمد على استخدام الأدوات.

- قم بتثبيت الإضافات لإضافة ميزات جديدة مثل البحث على الويب أو مترجم الأكواد. يتيح لك هذا النهج المعياري البدء ببساطة وإضافة المزيد من القوة مع تقدمك.

قيود يناير

- قد يسمح Jan بتحميل ملف نموذج لم يتم تنزيله بالكامل بعد، مما قد يؤدي إلى حدوث سلوك مربك أو غير متسق حتى اكتمال الملف.

- قد يؤدي تشغيل واجهة برمجة التطبيقات (API) إلى التداخل مع المحادثات المترابطة، وقد لا تعمل النقاط النهائية الأساسية مثل "الحصول على النموذج المحمّل" أو "تبديل النموذج" بشكل سلس.

يناير ai التسعير

- مفتوح المصدر

تقييمات ومراجعات يناير

- G2: عدد المراجعات غير كافٍ

- Capterra: عدد التقييمات غير كافٍ

ماذا يقول المستخدمون الحقيقيون عن Jan. ai؟

يقول أحد مستخدمي Reddit:

Jan. ai هو تطبيق LLM المحلي المفضل لدي. إنه رائع.

Jan. ai هو تطبيق LLM المحلي المفضل لدي. إنه رائع.

6. Llamafile (الأفضل لتعبئة LLM في ملف تنفيذي محمول)

Llamafile هو مشروع بقيادة Mozilla يجمع LLM مفتوح المصدر بالكامل في ملف واحد قابل للتنفيذ. بدلاً من تثبيت وقت تشغيل أو إدارة التبعيات أو توصيل واجهة مستخدم منفصلة، يمكنك تنزيل ملف واحد وتشغيله كأنه تطبيق.

الفكرة الأساسية هي التوزيع. يتضمن ملف "llamafile" أوزان النموذج بالإضافة إلى وقت تشغيل مجمع، مصمم للتشغيل عبر أنظمة تشغيل متعددة مع الحد الأدنى من الإعداد. وهو مفيد بشكل خاص عندما يلزم مشاركة أداة غير متصلة بالإنترنت مع زملاء الفريق أو الطلاب أو العملاء الذين لا يقومون باستكشاف أخطاء التثبيت وإصلاحها.

أفضل ميزات Llamafile

- يجمع Llamafile بين llama.cpp و Cosmopolitan Libc لدعم قابلية النقل الثنائية الواسعة، مما يقلل من أعمال التعبئة الخاصة بالمنصة.

- يوفر وضع الخادم واجهة مستخدم رسومية على الويب بالإضافة إلى نقطة نهاية إكمال متوافقة مع OpenAI API، وهي مفيدة لتطوير التطبيقات المحلية واستبدال المكالمات السحابية أثناء الاختبار.

- تم تصميم ملفات lama المعبأة لتعمل على أجهزة x86_64 و ARM64 الشائعة، مما يجعل التوزيع أسهل عبر الأساطيل المختلطة.

قيود Llamafile

- يقتصر اختيار النموذج على ما تم تجميعه في ملف Llamafile

- حجم الملفات كبير جدًا نظرًا لأن النموذج بأكمله مضمن

أسعار Llamafile

- مجاني ومفتوح المصدر

تقييمات ومراجعات Llamafile

- G2: عدد المراجعات غير كافٍ

- Capterra: عدد التقييمات غير كافٍ

🧠 حقيقة مثيرة للاهتمام: لا يزال من الممكن زيارة أول موقع إلكتروني. تستضيفه منظمة CERN على الرابط info.cern.ch، وتطلق عليه اسم "موطن أول موقع إلكتروني".

7. PrivateGPT (الأفضل للأسئلة والأجوبة غير المتصلة بالإنترنت حول ملفاتك باستخدام مكدس RAG مستضاف ذاتيًا)

PrivateGPT هو مشروع جاهز للإنتاج ومستضاف ذاتيًا تم إنشاؤه من أجل سير عمل "الدردشة مع مستنداتك". يقوم باستيعاب الملفات المحلية وفهرستها والإجابة على الأسئلة من خلال استرداد السياق ذي الصلة من المحتوى الخاص بك بدلاً من الاعتماد على ذاكرة روبوت الدردشة السحابي. تم تصميم المشروع ليعمل بشكل كامل دون اتصال بالإنترنت، مع ادعاء أن البيانات تبقى داخل بيئة التنفيذ الخاصة بك.

ما يميزه عن تطبيقات الدردشة غير المتصلة بالإنترنت ذات الأغراض العامة هو البنية المعيارية. بمعنى آخر، يمكنك مزج ومطابقة LLM ومزود التضمين ومخزن المتجهات بناءً على قيود الأجهزة والخصوصية الخاصة بك، ثم تشغيل كل شيء خلف واجهة برمجة تطبيقات محلية + واجهة مستخدم.

أفضل ميزات PrivateGPT

- استيعاب ملفات PDF و DOCX و PPT/PPTX/PPTM و CSV و EPUB و Markdown و JSON و MBOX و IPYNB والصور (JPG/PNG/JPEG) وحتى MP3/MP4 باستخدام خط أنابيب الاستيعاب المدمج

- تكوين ملفات تعريف الطبقات باستخدام PGPT_PROFILES (على سبيل المثال، local,cuda) لدمج ملفات إعدادات متعددة والتبديل بين عمليات النشر دون إعادة كتابة التكوين الأساسي

- تصفية الاستجابات لمجموعة فرعية محددة من المستندات التي تم استيعابها باستخدام context_filter عند استدعاء نقاط نهاية الإكمال السياقي

قيود PrivateGPT

- تتطلب متطلبات أجهزة أعلى بسبب تشغيل مكونات متعددة في وقت واحد

- يمكن أن يؤدي استيعاب مستندات متعددة من ملف واحد (على سبيل المثال، ملف PDF واحد يولد مستندًا واحدًا لكل صفحة) إلى زيادة حجم الفهرسة وتعقيدها عند إدارة عمليات التحميل الكبيرة.

أسعار PrivateGPT

- مفتوح المصدر

تقييمات ومراجعات PrivateGPT

- G2: عدد المراجعات غير كافٍ

- Capterra: عدد التقييمات غير كافٍ

8. Whisper. cpp (الأفضل لتحويل الكلام إلى نص دون اتصال بالإنترنت ويمكنك تضمينه في التطبيقات)

Whisper. cpp هو تطبيق C/C++ عالي الأداء لنموذج التعرف التلقائي على الكلام Whisper من OpenAI، تم تصميمه ليعمل محليًا دون اعتمادات ثقيلة على وقت التشغيل. وهو شائع الاستخدام في عمليات النسخ غير المتصلة بالإنترنت حيث تحتاج إلى مكتبة ثنائية صغيرة ومحمولة أو مكتبة على غرار C يمكنك شحنها داخل منتجك الخاص.

كما أنه مرن عبر البيئات المختلفة، مع دعم رسمي يشمل أجهزة الكمبيوتر المكتبية والمحمولة و WebAssembly و Docker وحتى أجهزة Raspberry Pi، مما يجعله مناسبًا للأدوات غير المتصلة بالإنترنت التي تحتاج إلى التشغيل في أكثر من مكان واحد.

يشير الحرف "cpp" في اسمه إلى تركيزه على الأداء. هذا التطبيق أسرع بكثير ويستهلك ذاكرة أقل من البدائل القائمة على لغة Python، مما يجعل النسخ في الوقت الفعلي ممكنًا على أجهزة الكمبيوتر الحديثة دون الحاجة إلى وحدة معالجة رسومات قوية.

Whisper. cpp أفضل الميزات

- قم بتشغيل ميزة الكشف عن النشاط الصوتي (VAD) كجزء من المشروع لتقسيم الكلام وتقليل النصوص الصوتية الفارغة والمليئة بالضوضاء في سير العمل بنمط البث المباشر.

- نماذج Quantize Whisper لتقليل متطلبات القرص والذاكرة، مع خيارات تكمية متعددة مصممة لاستنتاج محلي أسرع

- قم بالبناء باستخدام دعم FFmpeg الاختياري على نظام Linux للتعامل مع المزيد من تنسيقات الإدخال بخلاف المسار الأساسي الذي يعمل مع تنسيق WAV فقط.

Whisper. قيود cpp

- Whisper. cpp’s CLI يتوقع مدخلات WAV 16 بت بشكل افتراضي، مما يضيف خطوة تحويل إضافية عند العمل مع MP3 أو MP4 أو M4A أو غيرها من التنسيقات الشائعة.

- لا يقوم بتسمية المتحدثين بشكل أصلي (تقسيم الكلام)، مما يجعل من الصعب نسب الاقتباسات بشكل صحيح في التسجيلات متعددة المتحدثين.

Whisper. cpp التسعير

- مفتوح المصدر

Whisper. cpp التقييمات والمراجعات

- G2: عدد المراجعات غير كافٍ

- Capterra: عدد التقييمات غير كافٍ

9. واجهة المستخدم النصية لتوليد النصوص (الأفضل للمستخدمين الذين يرغبون في استخدام واجهة مستخدم قائمة على المتصفح لـ LLMs المحلية)

واجهة المستخدم النصية لتوليد النصوص (التي غالبًا ما يطلق عليها اسم "oobabooga") هي واجهة ويب قائمة على Gradio لتشغيل النماذج المحلية مع التركيز بشكل كبير على التحكم والتجريب. وهي تعمل بشكل أشبه بمكتب عمل كامل: خلفيات نماذج متعددة، وأنماط تفاعل متعددة، والعديد من الأزرار للتحكم في سلوك التوليد.

كما أنه يتكامل مع سير عمل "الكاتب/المطور" الذي تتجاهله العديد من الأدوات غير المتصلة بالإنترنت، مع ميزات مثل أتمتة تنسيق المطالبات، وإنشاء نمط دفتر الملاحظات، وتفرع المحادثات. بالنسبة للإعدادات غير المتصلة بالإنترنت التي لا تزال بحاجة إلى واجهة مستخدم ويب، فهي واحدة من أكثر الواجهات الأمامية قابلية للتكوين في هذه الفئة.

أفضل ميزات واجهة المستخدم على الويب لتوليد النصوص

- التنسيق التلقائي للمطالبات باستخدام قوالب Jinja2، مما يقلل من أخطاء تنسيق المطالبات عبر عائلات النماذج المختلفة

- اضبط العشرات من الإعدادات لضبط مخرجات الذكاء الاصطناعي وفقًا لاحتياجاتك الخاصة، سواء كان ذلك للكتابة الإبداعية أو البرمجة أو لعب الأدوار.

- تحرير الرسائل مع التنقل بين الإصدارات وتفرع المحادثات، مع الحفاظ على اتجاهات متعددة لنفس الدردشة دون الحاجة إلى البدء من جديد

قيود واجهة المستخدم على الويب لتوليد النصوص

- يتطلب المثبت بنقرة واحدة مساحة تخزين تبلغ حوالي 10 جيجابايت ويقوم بتنزيل PyTorch، مما يجعل الإعداد يبدو ثقيلاً على الأجهزة ذات سعة التخزين المحدودة.

- تستخدم نقطة نهاية التضمينات المتوافقة مع OpenAI محولات الجمل/all-mpnet-base-v2 مع تضمينات ذات 768 بُعدًا، والتي يمكن أن تكسر الافتراضات في خطوط الأنابيب المبنية حول الإعدادات الافتراضية لـ OpenAI ذات 1536 بُعدًا.

أسعار واجهة المستخدم على الويب لتوليد النصوص

- مفتوح المصدر

تقييمات ومراجعات واجهة المستخدم على الويب لتوليد النصوص

- G2: عدد المراجعات غير كافٍ

- Capterra: عدد التقييمات غير كافٍ

10. Llama. cpp (الأفضل للاستدلال LLM المحلي عالي الأداء عبر وحدة المعالجة المركزية ووحدة معالجة الرسومات)

Llama. cpp هو محرك استدلال C/C++ ومجموعة أدوات لتشغيل LLMs محليًا مع الحد الأدنى من التبعيات وأداء قوي عبر مجموعة واسعة من الأجهزة. إنه ليس "تطبيق دردشة" بقدر ما هو بيئة تشغيل محلية يمكنك من خلالها إنشاء سير عمل، سواء كان ذلك CLI أو خادم HTTP محلي أو مكتبة مدمجة داخل منتجك الخاص.

على الرغم من أن Llama.cpp ليس تطبيقًا للمستخدم النهائي في حد ذاته، إلا أنه المحرك الذي يدعم العديد من الأدوات الموجودة في هذه القائمة، بما في ذلك GPT4All و LM Studio. وقد أدخل تنسيق نموذج GGUF، الذي أصبح المعيار لتشغيل النماذج الكبيرة على الأجهزة الاستهلاكية من خلال تقليل حجمها بكفاءة.

كما أنه يوفر روابط للغات البرمجة الشائعة مثل Python و Rust، ويمكن أن يوفر وضع الخادم الخاص به واجهة برمجة تطبيقات متوافقة مع OpenAI.

أفضل ميزات Llama. cpp

- قم بتشغيل خادم محلي متوافق مع OpenAI API مع واجهة مستخدم ويب مدمجة ونقطة نهاية /v1/chat/completions باستخدام llama-server

- قم بتشغيل نموذج تضمين (وحتى نموذج إعادة ترتيب) من نفس الخادم لخطوط أنابيب RAG غير المتصلة بالإنترنت باستخدام /embedding و/reranking

- تقسيم النماذج إلى 1.5 بت إلى 8 بت لتقليل استخدام الذاكرة وتسريع الاستدلال المحلي، ثم تسريع التشغيل باستخدام CUDA/Metal بالإضافة إلى الخلفيات Vulkan/SYCL عند توفرها

قيود لاما. cpp

- Llama. cpp لا يتم توفيره كمساعد مكتبي متطور، مما يعني أن الاستخدام دون اتصال بالإنترنت غالبًا ما يتطلب استخدام أوامر CLI أو استضافة llama-server، ويعتمد العديد من المستخدمين على واجهات مستخدم تابعة لجهات خارجية للدردشة اليومية.

- لا تتوافق Llama. cpp دائمًا بنسبة 1:1 مع كل ميزة من ميزات عميل OpenAI، ويبلغ المستخدمون عن عدم تطابق حول معلمات الإخراج المنظمة مثل response_format في /v1/chat/completions.

أسعار Llama. cpp

- مفتوح المصدر

ماذا يقول المستخدمون الحقيقيون عن Llama. cpp؟

يقول أحد المراجعين في Sourceforge:

رائع. إتاحة الذكاء الاصطناعي للجميع. وهو يعمل بشكل رائع!

رائع. إتاحة الذكاء الاصطناعي للجميع. وهو يعمل بشكل رائع!

حوّل مخرجات الذكاء الاصطناعي غير المتصلة بالإنترنت إلى عمل حقيقي باستخدام ClickUp

اختيار أداة الذكاء الاصطناعي المناسبة غير المتصلة بالإنترنت يتعلق في الحقيقة بمطابقة الأداة مع المهمة.

إذا كنت هنا، فمن المحتمل أنك تبحث عن ثلاثة أشياء: الخصوصية، وعدم الاعتماد على الإنترنت، والتحرر من الالتزام باشتراك آخر.

تقدم الأدوات الواردة في هذه القائمة هذه الميزة بطرق مختلفة. بمعنى أن بعضها أفضل للكتابة والبرمجة، والبعض الآخر للبحث أو تدوين الملاحظات أو الأعمال الإبداعية.

ولكن بالنسبة للفرق، فإن التحدي الأكبر لا يقتصر على تشغيل الذكاء الاصطناعي محليًا فحسب، بل يتعدى ذلك إلى تحويل مخرجات الذكاء الاصطناعي إلى سير عمل حقيقي.

بفضل إمكانات الذكاء الاصطناعي التي توفرها ClickUp في مهامك ووثائقك ومعرفتك، يمكنك بسهولة عرض الخطوات التالية في نفس المكان الذي يتم فيه العمل (كل ذلك مع أمان على مستوى المؤسسات).

جرب ClickUp مجانًا وشاهد كيف يبدو الأمر عندما يتكامل الذكاء الاصطناعي والتنفيذ معًا. ✨

الأسئلة المتكررة حول أدوات الذكاء الاصطناعي غير المتصلة بالإنترنت

نعم، بعد التنزيل الأولي لملفات النموذج، يمكن تشغيل العديد من أدوات الذكاء الاصطناعي بالكامل على جهازك دون الحاجة إلى الإنترنت. وهذا يجعلها مثالية للتعامل مع البيانات الحساسة أو العمل في أماكن ذات اتصال ضعيف بالإنترنت.

تقوم برامج LLM المحلية بمعالجة جميع البيانات الموجودة على جهازك الشخصي، لذا لا تغادر معلوماتك جهازك أبدًا، بينما ترسل الذكاء الاصطناعي القائم على السحابة مطالباتك إلى خوادم بعيدة للمعالجة. عادةً ما تكون الأدوات المحلية مجانية للاستخدام بعد الإعداد، بينما غالبًا ما تتطلب الذكاء الاصطناعي القائم على السحابة رسوم اشتراك، ولكنها قد توفر نماذج أكثر قوة.

يمكن تشغيل النماذج الأصغر حجماً التي تحتوي على 1-3 مليارات معلمة على معظم أجهزة الكمبيوتر المحمولة الحديثة المزودة بذاكرة وصول عشوائي (RAM) سعة 8 جيجابايت. أما النماذج الأكبر حجماً والأكثر قدرة التي تحتوي على 7 مليارات معلمة أو أكثر، فتعمل بشكل أفضل مع ذاكرة وصول عشوائي (RAM) سعة 16 جيجابايت أو أكثر ووحدة معالجة رسومات (GPU) مخصصة، حيث توفر أجهزة Apple Silicon Macs ووحدات معالجة الرسومات (GPU) من NVIDIA تحسينات كبيرة في الأداء.

![أفضل 10 أدوات ذكاء اصطناعي تعمل دون اتصال بالإنترنت في [السنة]](https://clickup.com/blog/wp-content/uploads/2026/01/image-1298.png)