Il tuo modello di IA ha mai fornito una risposta sicura che i tuoi utenti hanno definito obsoleta? Questo è il tipo di esperienza che porta il tuo team a mettere in discussione ogni sua risposta.

Sembra l'incubo di ogni sviluppatore e appassionato di IA, vero?

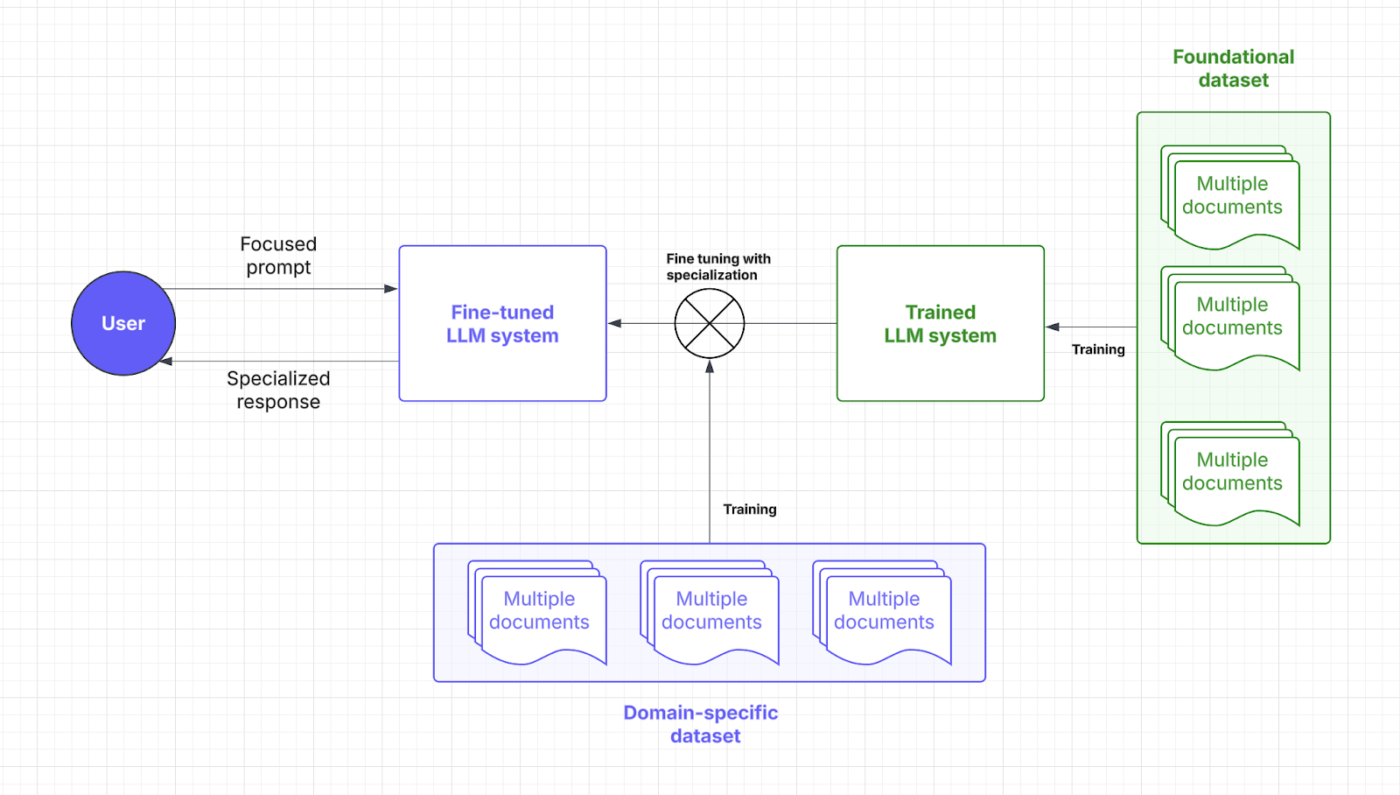

I modelli linguistici di grandi dimensioni (LLM) funzionano sulla base dei dati di addestramento, ma con il passare del tempo i dati diventano obsoleti e si insinuano delle imprecisioni. Poiché il riaddestramento costa milioni, l'ottimizzazione è la soluzione più intelligente.

Il Retrieval Augmented Generation (RAG) e il fine-tuning sono i principali framework per aumentare la precisione. Tuttavia, date le differenze tra i due approcci, sono ideali per applicazioni diverse. Il framework giusto è la chiave per migliorare efficacemente il tuo LLM.

Ma quale è quello giusto per te?

Questo articolo affronta il dilemma nella guida RAG vs. fine-tuning. Che tu stia lavorando con dati specifici di un determinato dominio o che tu stia cercando di creare soluzioni di recupero dati di alta qualità, qui troverai le risposte che cerchi!

⏰ Riepilogo/riassunto in 60 secondi

- Migliorare le prestazioni degli LLM e dei modelli di IA è una parte fondamentale di ogni attività aziendale e funzione di sviluppo. Sebbene RAG e fine-tuning siano approcci diffusi, è importante comprenderne le sfumature e l'impatto.

- Il RAG dota gli LLM di un sistema di recupero dati esterno in tempo reale, riducendo i costi di riqualificazione.

- Il Fine-Tuning ottimizza gli LLM attraverso l'addestramento su set di dati specializzati, migliorando l'accuratezza per attività specifiche di un determinato dominio.

- Il RAG è ideale per ambienti con dati in rapida evoluzione come la finanza, gli aggiornamenti legali e il supporto clienti.

- Il Fine-Tuning è ideale per l'IA specifica per il marchio, i settori con elevati requisiti di conformità e l'analisi del sentiment.

- ClickUp Brain combina entrambi, utilizzando RAG per approfondimenti contestuali e fine-tuning per l'automazione personalizzata e la generazione di contenuti.

- Gli strumenti di IA di ClickUp potenziano il recupero delle conoscenze, l'automazione del flusso di lavoro e il project management per garantire la massima efficienza.

Che cos'è la generazione aumentata dal recupero (RAG)?

Stai esaminando nuovi rapporti e sondaggi che il tuo LLM non ha utilizzato? È qui che ti serve il RAG. Per capire meglio, approfondiamo le basi di questo approccio.

Definizione di RAG

RAG è un framework di IA che prevede il recupero di informazioni aggiuntive per il tuo LLM al fine di migliorare la precisione delle risposte. Prima della generazione della risposta LLM, estrae i dati più rilevanti da fonti esterne, come fonti di conoscenza o database.

Consideralo come l'assistente di ricerca all'interno del modello LLM o dell'IA generativa.

👀 Lo sapevi? Gli LLM, in particolare i generatori di testo, possono generare informazioni false ma plausibili. Tutto a causa delle lacune nei dati di addestramento.

Vantaggi principali di RAG

Ormai dovrebbe essere chiaro. Il RAG è un ulteriore livello di IA connessa di cui il tuo processo aziendale ha bisogno. Per mettere in luce il suo potenziale, ecco i vantaggi che offre:

- Riduzione dei costi di formazione: elimina la necessità di frequenti riqualificazioni del modello grazie al recupero dinamico delle informazioni. Ciò porta a un'implementazione dell'IA più conveniente, soprattutto per i settori con dati in rapida evoluzione.

- Scalabilità: espande le conoscenze dell'LLM senza aumentare le dimensioni del sistema primario. Aiuta le aziende a scalare, gestire grandi set di dati ed eseguire più query senza costi di calcolo elevati.

- Aggiornamenti in tempo reale: riflettono le informazioni più recenti in ogni risposta e mantengono il modello pertinente. Dare priorità all'accuratezza attraverso aggiornamenti in tempo reale è fondamentale in molte operazioni, tra cui analisi finanziarie, assistenza sanitaria e audit di conformità.

📮 ClickUp Insight: La metà dei nostri intervistati ha difficoltà con l'adozione dell'IA; il 23% non sa da dove iniziare, mentre il 27% ha bisogno di più formazione per fare qualcosa di avanzato.

ClickUp risolve questo problema con un'interfaccia di chat familiare che ricorda quella dei messaggi di testo. I team possono iniziare subito con domande e richieste semplici, per poi scoprire naturalmente funzionalità di automazione e flussi di lavoro più potenti man mano che procedono, senza la curva di apprendimento intimidatoria che frena così tante persone.

Casi d'uso di RAG

Ti stai chiedendo dove eccelle il RAG? Considera questi casi d'uso chiave:

Chatbot e supporto clienti

Le query dei clienti richiedono spesso risposte aggiornate e contestualizzate. RAG potenzia le capacità dei chatbot recuperando gli articoli di supporto, le politiche e i passaggi di risoluzione dei problemi più recenti.

Ciò consente un'assistenza più accurata e in tempo reale senza un lungo pre-addestramento.

Recupero dinamico dei documenti

Il RAG ottimizza la ricerca dei documenti estraendo le sezioni più rilevanti da vasti repositories. Invece di riassunti generici, gli LLM possono fornire risposte precise da manuali aggiornati, documenti di ricerca o documenti legali.

L'adozione di LLM basati su RAG rende il recupero delle informazioni più veloce e preciso.

🧠 Curiosità: Meta, proprietaria di Facebook, Instagram, Threads e WhatsApp, ha introdotto il RAG nello sviluppo dell'LLM nel 2020.

Che cos'è il Fine-Tuning?

Vediamo cosa fa il fine-tuning.

Definizione di fine-tuning

Il Fine-Tuning comporta l'addestramento di un modello linguistico pre-addestrato. Sì, molto addestramento, che può essere spiegato tramite punto e focus.

🧠 Lo sapevi? Nell'addestramento dei modelli linguistici di grandi dimensioni (LLM), i "pesi" sono i parametri regolabili all'interno della rete neurale che determinano la forza delle connessioni tra i neuroni, essenzialmente memorizzando le informazioni apprese; il processo di addestramento ottimizza questi pesi per ridurre al minimo gli errori di previsione.

Il "Focus", invece, comprende diversi aspetti: comporta un'attenta cura dei dati per garantirne la qualità e la pertinenza, l'utilizzo di meccanismi di attenzione per dare priorità ai segmenti di input rilevanti e il fine-tuning mirato per specializzare il modello per attività specifiche.

Attraverso set di dati specializzati, il fine-tuning consente ai modelli di IA di restringere il campo all'esecuzione di attività specifiche del dominio. Regolando i pesi e il focus del modello, il tuo LLM acquisisce una maggiore comprensione contestuale e accuratezza.

Pensa al fine-tuning come al master di cui il tuo LLM ha bisogno per parlare la lingua del tuo settore. Esaminiamo dove questa strategia di IA entra nel processo di risposta rapida:

Vantaggi del fine-tuning

Le tecniche di fine-tuning sono semplicemente delle modifiche all'IA. È più simile alla possibilità di ingrandire dettagli predefiniti. Ecco i vantaggi che ne derivano:

- Ottimizzazione specifica per attività: set di dati specializzati affinano le risposte LLM per attività specifiche. Vuoi aiutare gli utenti a evitare il mal di testa causato da prompt complessi? Il fine-tuning aiuta gli sviluppatori a ottenere soluzioni IA su misura.

- Maggiore accuratezza per applicazioni di nicchia: la conoscenza del dominio riduce gli errori e migliora la precisione di ogni risposta. Il fine-tuning aumenta anche l'affidabilità dell'LLM, consentendo alle aziende di rilassarsi sulla microgestione e sulla supervisione manuale.

- Personalizzazione per la voce del marchio e la conformità: il Fine-Tuning insegna agli LLM i termini, lo stile e le normative aziendali. Ciò mantiene una voce del marchio coerente e una conformità specifica del settore.

Casi d'uso del Fine-Tuning

Il processo di fine-tuning consente di usufruire di un'efficienza mirata. Ecco i suoi punti di forza:

Sistemi di controllo qualità specifici per dominio

Settori come quello legale, sanitario e finanziario si affidano a risposte IA precise e specifiche per il settore. Il Fine-Tuning dota gli LLM di conoscenze specialistiche, garantendo risposte accurate alle domande (QA).

Un assistente legale basato sull'IA, ad esempio, può interpretare i contratti in modo più preciso, mentre un chatbot medico può fornire indicazioni basate sui sintomi utilizzando set di dati affidabili.

Analisi del sentiment e flussi di lavoro personalizzati

Le aziende utilizzano un modello ottimizzato per monitorare i marchi, analizzare il feedback dei clienti e automatizzare i flussi di lavoro personalizzati per esigenze operative specifiche. Uno strumento basato sull'IA è in grado di rilevare le sfumature di sentiment nelle recensioni dei prodotti, aiutando le aziende a perfezionare la propria offerta.

Nel settore delle risorse umane, combinare il fine-tuning con l'elaborazione del linguaggio naturale aiuta l'IA ad analizzare i sondaggi dei dipendenti e a segnalare le preoccupazioni sul posto di lavoro con una maggiore consapevolezza contestuale.

💡 Suggerimento professionale: il Fine-Tuning potrebbe comportare l'aggiunta di dati più diversificati per rimuovere potenziali distorsioni. Non è esattamente specifico per il dominio, ma è comunque un'applicazione cruciale.

Confronto: RAG vs. Fine-Tuning

È innegabile che entrambe le strategie di IA mirino a migliorare le prestazioni.

Ma la scelta sembra ancora piuttosto difficile, vero? Ecco un confronto tra fine-tuning e RAG per aiutarti a prendere la decisione giusta per i tuoi investimenti LLM.

| Aspetto | RAG (Generazione potenziata dal recupero) | Fine-tuning |

| Definizione | Consente all'LLM di recuperare dati rilevanti in tempo reale da origini dati esterne con il suo sistema dedicato. | Addestra un modello pre-addestrato con set di dati specializzati per attività specifiche del dominio. |

| Prestazioni e accuratezza | Ottimo per il recupero dei dati in tempo reale, ma l'accuratezza dipende dalla qualità dei dati esterni. | Migliora l'accuratezza contestuale e le risposte specifiche per ogni attività |

| Costi e risorse necessarie | Un approccio iniziale più conveniente si concentra sull'accesso ai dati in tempo reale. | Richiede più risorse per la formazione iniziale, ma è conveniente nel lungo termine. |

| Manutenzione e scalabilità | Altamente scalabile e flessibile, ma ha una dipendenza dalla frequenza degli aggiornamenti alle fonti esterne. | Richiede aggiornamenti e manutenzione frequenti, ma offre prestazioni stabili a lungo termine. |

| Casi d'uso | Chatbot, recupero dinamico dei documenti, analisi in tempo reale | Sistemi di controllo qualità specifici per dominio, analisi del sentiment e personalizzazione della voce del marchio |

| Quando scegliere | Dati in rapida evoluzione, aggiornamenti in tempo reale e priorità dei costi delle risorse | Segmenti di clientela di nicchia, logica specifica del dominio, personalizzazione specifica del marchio |

| Ideale per | I settori industriali necessitano di informazioni accurate e in tempo reale (finanza, legale, supporto clienti) | Settori che richiedono un linguaggio, una conformità o un contesto specifici (sanità, legale, risorse umane) |

Hai bisogno di un po' più di chiarezza per chiarire i tuoi dubbi? Ecco un confronto diretto sugli aspetti chiave che influiscono sulle tue esigenze.

Prestazioni e accuratezza

Quando si tratta di prestazioni, RAG svolge un ruolo chiave acquisendo nuovi dati da fonti esterne. La sua accuratezza e i tempi di risposta dipendono dalla qualità di questi dati. Questa dipendenza da database esterni consente a RAG di fornire informazioni aggiornate in modo efficace.

Il Fine-Tuning, invece, migliora il modo in cui il modello elabora e risponde attraverso un riaddestramento specializzato. Questo processo produce risposte più accurate dal punto di vista contestuale, soprattutto per applicazioni di nicchia. Gli LLM ottimizzati sono ideali per mantenere la coerenza in settori con requisiti rigorosi, come quello sanitario o finanziario.

Conclusione: RAG è ottimo per i dati in tempo reale e il fine-tuning per risposte contestualmente accurate.

Un utente di Reddit afferma:

Se utilizzi un modello di piccole dimensioni e un buon database nella pipeline RAG, puoi generare set di dati di alta qualità, migliori rispetto a quelli ottenuti con un'IA di alta qualità.

Se utilizzi un modello di piccole dimensioni e un buon database nella pipeline RAG, puoi generare set di dati di alta qualità, migliori rispetto a quelli ottenuti utilizzando gli output di un'IA di alta qualità.

💡 Suggerimento professionale: per guidare il tuo LLM verso un output specifico, concentrati su un'ingegnerizzazione efficace e tempestiva del prompt.

Costi e requisiti di risorse

Il RAG è in genere più conveniente in termini di costi iniziali, poiché aggiunge solo un livello per il recupero dei dati esterni. Evitando la necessità di riqualificare l'intero modello, si presenta come un'opzione molto più economica, soprattutto in ambienti dinamici. Tuttavia, i costi operativi per l'accesso e lo spazio di archiviazione dei dati in tempo reale possono aumentare.

Il fine-tuning richiede una maggiore preparazione dei set di dati e risorse di formazione, ma è un investimento a lungo termine. Una volta ottimizzati, gli LLM richiedono meno aggiornamenti, garantendo prestazioni prevedibili e risparmi sui costi. Gli sviluppatori dovrebbero valutare l'investimento iniziale rispetto alle spese operative correnti.

Conclusione: il RAG è conveniente, semplice da implementare e offre vantaggi immediati. Il fine-tuning richiede molte risorse iniziali, ma migliora la qualità dell'LLM e consente di risparmiare sui costi operativi a lungo termine.

💡 Suggerimento professionale: il tuo sistema RAG è intelligente solo quanto i dati da cui attinge. Mantieni pulite le tue origini dati e riempile con dati accurati e aggiornati!

Manutenzione e scalabilità

Il RAG offre un'eccellente scalabilità, poiché si concentra principalmente sull'espansione della fonte esterna. La sua flessibilità e adattabilità lo rendono perfetto per i settori in rapida evoluzione. Tuttavia, la manutenzione dipende dalla frequenza degli aggiornamenti dei database esterni.

Il Fine-Tuning richiede una manutenzione piuttosto frequente, soprattutto quando cambiano le informazioni specifiche del dominio. Sebbene richieda maggiori risorse, garantisce una maggiore coerenza nel tempo e richiede gradualmente meno aggiustamenti. Detto questo, la scalabilità per il Fine-Tuning è molto più complessa e coinvolge set di dati più estesi e diversificati.

Conclusione: RAG è la soluzione migliore per un rapido ridimensionamento e una messa a punto ottimale, con una manutenzione minima e prestazioni stabili.

Un utente di Reddit aggiunge:

Quando l’attività è di piccole dimensioni, spesso è più efficiente utilizzare un modello più grande piuttosto che ottimizzare uno più piccolo.

Quando l’attività è di piccole dimensioni, spesso è più efficiente utilizzare un modello più grande piuttosto che ottimizzare uno più piccolo.

👀 Lo sapevi? Esistono soluzioni IA in grado di percepire gli odori. Data la complessità delle fragranze, ciò richiede un fine-tuning regolare e un recupero dati complesso.

Qual è l'approccio più adatto al tuo caso d'uso?

Nonostante la comprensione delle sfumature, prendere una decisione può sembrare inutile senza un riferimento o un contesto evidente. Esaminiamo alcuni scenari aziendali che evidenziano come ciascun modello di IA funzioni meglio.

Quando scegliere RAG

Il RAG aiuta ad alimentare il tuo LLM con fatti e informazioni corretti, inclusi standard tecnici, registrazioni commerciali, feedback dei clienti e altro ancora.

Come puoi metterlo in pratica? Considera questi scenari per adottare il RAG nelle tue operazioni:

Caso d'uso n. 1: analisi in tempo reale

- Scenario: un'azienda fintech fornisce approfondimenti di mercato basati sull'IA per i trader. Gli utenti chiedono informazioni sulle tendenze dei titoli azionari e il sistema deve recuperare gli ultimi rapporti di mercato, i documenti depositati presso la SEC e le notizie.

- Perché RAG è vincente: i mercati azionari si muovono rapidamente, quindi il costante riaddestramento dei modelli di IA è costoso e inefficiente. RAG mantiene le cose aggiornate estraendo solo i dati finanziari più recenti, riducendo i costi e aumentando la precisione.

- Regola generale: il RAG dovrebbe essere la tua strategia di riferimento per l'IA che gestisce dati in rapida evoluzione. Le applicazioni più diffuse sono l'analisi dei dati dei social media, l'ottimizzazione energetica, il rilevamento delle minacce alla sicurezza informatica e il monitoraggio degli ordini.

Caso d'uso n. 2: Controlli dei dati e conformità normativa

- Scenario: un assistente legale basato sull'IA aiuta gli avvocati a redigere contratti e verificare la conformità alle leggi in evoluzione, attingendo alle ultime normative, ai precedenti e alle sentenze.

- Perché RAG è la scelta vincente: la verifica degli aspetti legali e commerciali non richiede aggiornamenti comportamentali approfonditi. RAG svolge egregiamente il proprio compito estraendo testi legali da un dataset centrale in tempo reale.

- Regola generale: il RAG eccelle nelle analisi basate su risorse e statistiche. Ottimi modi per massimizzarne l'efficacia sono l'uso di assistenti medici basati sull'IA per consigli terapeutici e chatbot per l'assistenza clienti per la risoluzione dei problemi e gli aggiornamenti delle politiche.

Ti stai ancora chiedendo se hai bisogno di RAG nel tuo LLM? Ecco una breve lista di controllo:

- Hai bisogno di nuovi dati di alta qualità senza modificare l'LLM stesso?

- Le tue informazioni cambiano spesso?

- Il tuo LLM deve lavorare con informazioni dinamiche invece che con dati di addestramento statici?

- Desideri evitare spese ingenti e lunghi tempi di riqualificazione dei modelli?

➡️ Leggi anche: I migliori strumenti di prompt engineering per l'IA generativa

Quando il Fine-tuning è più efficace

Come abbiamo detto prima, il fine-tuning è come una scuola di specializzazione per l'IA. Il tuo LLM può persino imparare il gergo del settore. Ecco un approfondimento settoriale su quando dà il meglio di sé:

Caso d'uso n. 1: aggiungere la voce e la tonalità del marchio

- Scenario: un marchio di lusso crea un concierge IA per interagire con i clienti con un tono raffinato ed esclusivo. Deve incarnare le tonalità, le espressioni e le sfumature emotive specifiche del marchio.

- Perché il fine-tuning è vincente: il fine-tuning aiuta il modello di IA a catturare e replicare la voce e il tono unici del marchio. Offre un'esperienza coerente in ogni interazione.

- Regola generale: Il Fine-Tuning è più efficace se i tuoi LLM devono adattarsi a una competenza specifica. È l'ideale per giochi immersivi orientati al genere, narrazioni tematiche ed empatiche o persino testi di marketing di marca.

🧠 Curiosità: gli LLM addestrati in tali competenze trasversali eccellono nell'analisi del sentiment e della soddisfazione dei dipendenti. Tuttavia, solo il 3% delle aziende utilizza attualmente l'IA generativa nelle risorse umane.

Caso d'uso n. 2: moderazione dei contenuti e approfondimenti basati sul contesto

- Scenario: una piattaforma di social media utilizza un modello di IA per rilevare contenuti dannosi. Si concentra sul riconoscimento del linguaggio specifico della piattaforma, del gergo emergente e delle violazioni sensibili al contesto.

- Perché il fine-tuning è vincente: le competenze trasversali come la formulazione delle frasi spesso esulano dall'ambito dei sistemi RAG. Il fine-tuning migliora la comprensione da parte dell'LLM delle sfumature specifiche della piattaforma e del gergo del settore, in particolare per quanto riguarda la moderazione dei contenuti rilevanti.

- Regola generale: scegliere il fine-tuning è consigliabile quando si ha a che fare con differenze culturali o regionali. Ciò vale anche per l'adattamento a termini specifici di settori quali quello medico, legale o tecnico.

Stai per ottimizzare il tuo LLM? Poniti queste domande chiave:

- Il tuo LLM deve rivolgersi a un segmento di clientela personalizzato o a un tema di marca specifico?

- Desideri aggiungere dati proprietari o specifici del dominio alla logica dell'LLM?

- Hai bisogno di risposte più rapide senza perdere in precisione?

- I tuoi LLM forniscono soluzioni offline?

- È possibile allocare risorse dedicate e potenza di calcolo per il retraining?

Migliorare l'esperienza utente è ottimo. Tuttavia, molte aziende hanno anche bisogno dell'IA come strumento per aumentare la produttività e giustificare gli elevati costi di investimento. Ecco perché l'adozione di un modello di IA pre-addestrato è spesso la scelta preferita da molti.

👀 Lo sapevi? La Gen IA ha il potenziale per automatizzare le attività di lavoro, consentendo ai dipendenti di risparmiare fino al 70% del loro tempo. Chiedere in modo efficace all'IA di fornire approfondimenti gioca un ruolo fondamentale in questo senso!

Come ClickUp sfrutta le tecniche avanzate di IA

La scelta tra RAG e fine-tuning è oggetto di un ampio dibattito.

Basta leggere qualche thread su Reddit per confondersi le idee. Ma chi ha detto che devi sceglierne solo uno?

Immagina di avere modelli di IA personalizzabili, automazione e gestione delle attività in un unico posto. Questo è ClickUp, l'app completa per il lavoro. Riunisce la project management, la documentazione e la comunicazione del team sotto lo stesso tetto ed è alimentato da un'IA di nuova generazione.

In breve, eccelle in tutto, soprattutto grazie alla sua soluzione IA completa: ClickUp Brain.

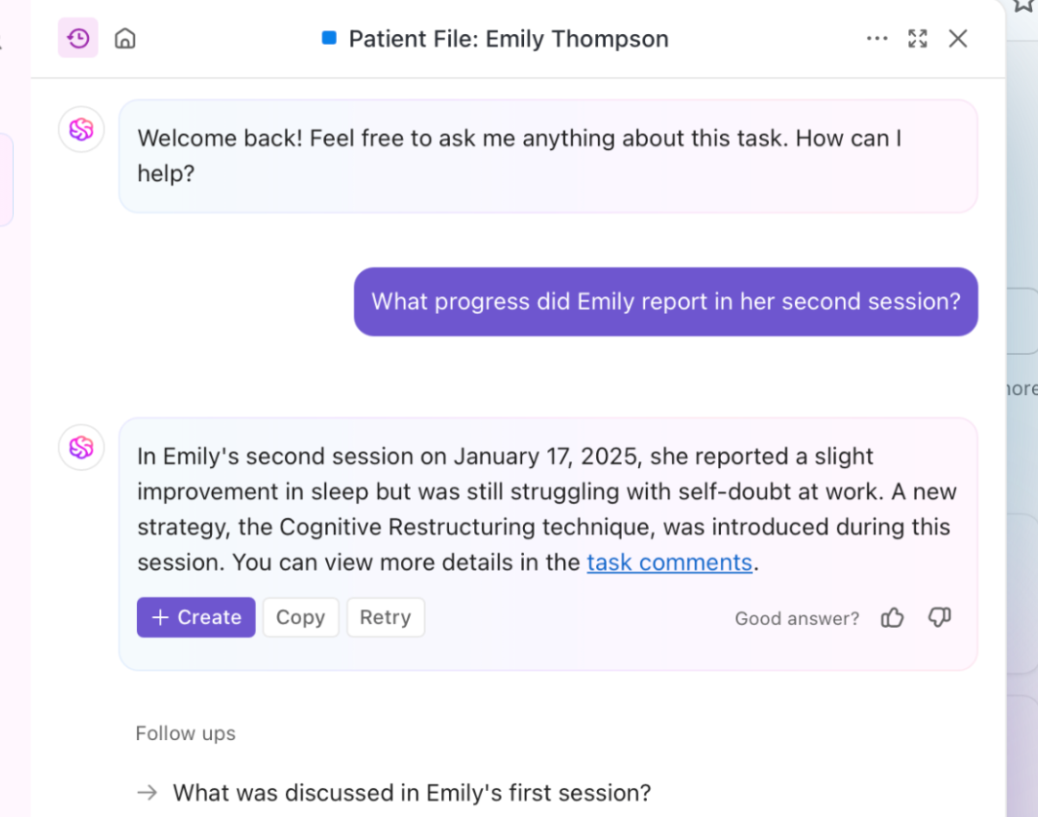

Hai bisogno di informazioni rapide e contestualizzate? Brain estrae informazioni in tempo reale dai tuoi documenti, attività e risorse. Questo è il RAG potenziato in azione. Inoltre, il suo LLM di base, Brain, è in grado di generare report e aggiornamenti di routine sui progetti.

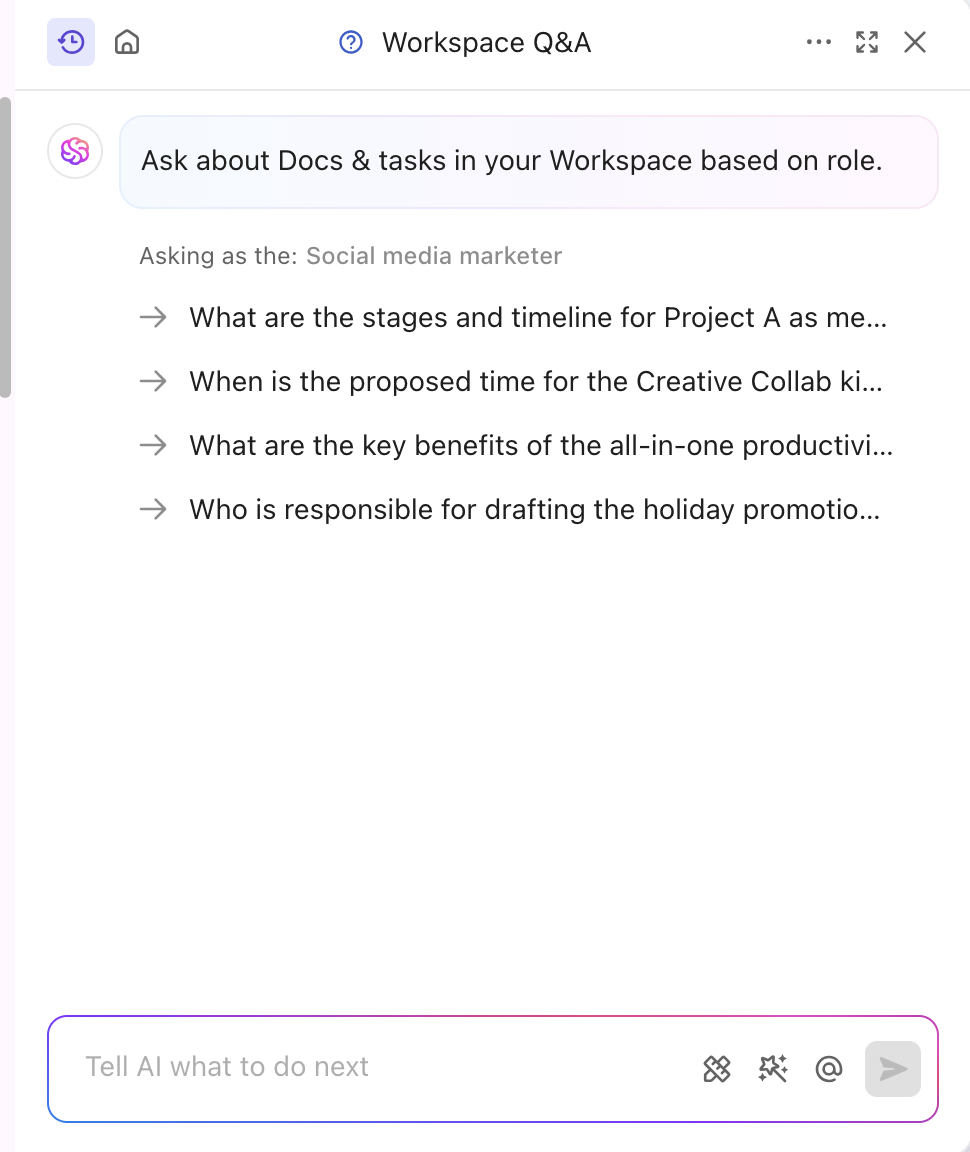

Lo strumento di IA è anche ottimizzato per adattarsi al tuo settore e segmento, fornendo approfondimenti professionali e creativi. Personalizza persino i contenuti in tempo reale senza alcuna formazione manuale. Brain combina fine-tuning e RAG per automatizzare gli aggiornamenti dei progetti, l'assegnazione delle attività e le notifiche sul flusso di lavoro. Desideri risposte su misura per il tuo ruolo? ClickUp Brain può farlo anche questo!

Oltre a essere specializzata nei contenuti, ClickUp potenzia la propria piattaforma con una potente funzionalità di IA basata sulla conoscenza.

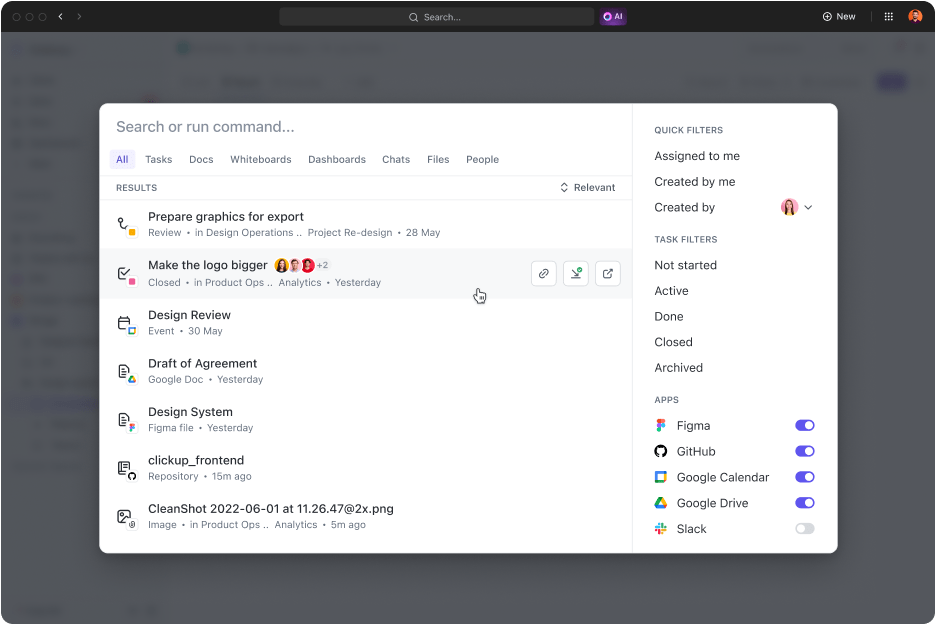

ClickUp Connected Search è uno strumento basato sull'intelligenza artificiale che recupera rapidamente qualsiasi risorsa dal tuo spazio integrato. Che tu abbia bisogno di documenti per la riunione di oggi o di risposte a qualsiasi attività, una semplice query ti fornirà link alle fonti, citazioni e approfondimenti dettagliati.

Inoltre, avvia le app, cerca nella cronologia degli appunti e crea snippet. La parte migliore? Tutto questo è accessibile con un solo clic dal tuo Centro di comando, dalla barra delle azioni o dal desktop.

Gli esperti di marketing digitale, il presidente di Hum JAM, affermano addirittura che

ClickUp è lo straordinario strumento "all-in-one" per l'automazione del lavoro di squadra che effettua il monitoraggio, l'automazione e la misurazione del successo del team. Credimi quando ti dico che il tuo team non potrà più fare a meno di questo strumento.

ClickUp è lo straordinario strumento "all-in-one" per l'automazione del team che effettua il monitoraggio, automatizza e misura il successo del team. Credimi quando ti dico che il tuo team non potrà più fare a meno di questo strumento.

➡️ Leggi anche: La differenza tra machine learning e intelligenza artificiale

Migliora la precisione di IA e LLM con ClickUp

Le risposte RAG, ottimizzate da dati esterni aggiornati e dal fine-tuning, vengono utilizzate per attività e comportamenti specifici. Entrambi migliorano le prestazioni dell'IA, ma l'approccio giusto definisce il tuo ritmo e la tua efficienza.

In settori dinamici, la decisione spesso si riduce a quale metodo adottare per primo. Una soluzione pre-addestrata potente è solitamente la scelta più saggia.

Se desideri migliorare la qualità del servizio e la produttività, ClickUp è un ottimo partner. Le sue funzionalità di IA guidano la generazione di contenuti, il recupero dei dati e le risposte analitiche. Inoltre, la piattaforma include oltre 30 strumenti che coprono tutto, dalla gestione delle attività alla generazione di immagini straordinarie.