El vídeo solía ser la prueba más fácil.

Ahora es lo más fácil de falsificar.

Los clips generados por IA están apareciendo en todas partes: redes sociales, anuncios de marketing, demostraciones internas e incluso vídeos «similares a noticias» compartidos en Slack. Y lo peligroso no es que existan, sino que la mayoría de los equipos no disponen de un método coherente para verificarlos antes de que se aprueben, publiquen o reenvíen.

Esta guía le ofrece formas prácticas de saber si un vídeo ha sido generado por IA, además de un sencillo flujo de trabajo para documentar lo que ha encontrado, de modo que la verificación no dependa de la intuición de una sola persona.

Vamos a ello. 👇

¿Qué es un vídeo generado por IA?

Un vídeo generado por IA es un vídeo creado, modificado o «interpretado» por IA en lugar de por una cámara real que captura eventos reales.

La mayoría de los vídeos de IA se clasifican en tres categorías:

- Totalmente sintético: creado desde cero (texto a vídeo, actores de IA, entornos de IA).

- Deepfake: imágenes reales en las que se cambia o manipula un rostro o una voz.

- Mejorado con IA: imágenes reales que han sido modificadas (limpieza, rejuvenecimiento, ediciones de fondo, mejora de la resolución).

Pistas visuales que aparecen fotograma a fotograma

Los vídeos falsos generados por IA suelen parecer convincentes en movimiento, pero se desmoronan cuando se pausan, se amplían y se analizan en busca de coherencia. Empieza por las áreas visuales de alta señal que se muestran a continuación y busca problemas que se repitan en varios fotogramas.

Comprueba los rostros, los ojos y las expresiones.

Los rostros son la parte del cuerpo más reveladora para la detección mediante IA, ya que nuestro cerebro está programado para detectar inconsistencias faciales. La IA aún tiene dificultades con los pequeños y rápidos movimientos musculares llamados microexpresiones, la asimetría natural y la forma en que los rasgos faciales interactúan durante el habla. Haga una pausa y amplíe los rostros, prestando atención a estos signos reveladores en varios fotogramas.

- Simetría facial: fíjese en los rasgos equilibrados de forma poco natural que rara vez aparecen en los rostros humanos reales.

- Dientes e interior de la boca: preste atención a los dientes borrosos, las rayas uniformes o las figuras y los espacios inconsistentes.

- Vello facial y cejas: comprueba si hay vello que parezca pintado, brillante o que se mueva de forma poco natural con el movimiento.

- Detalles de las orejas: inspeccione las orejas en busca de figuras malformadas o inconsistencias que cambian de un fotograma a otro.

Patrones de parpadeo poco naturales

Parpadear es un comportamiento sorprendentemente complejo que la IA a menudo interpreta erróneamente. Las personas reales parpadean cada pocos segundos con variaciones naturales en la velocidad y la duración. Sin embargo, los rostros generados por IA pueden parpadear con demasiada frecuencia, con muy poca frecuencia o con una uniformidad robótica.

Una señal inequívoca es cuando varias personas en un vídeo parpadean exactamente al mismo tiempo, un claro indicio de que se trata de una generación de IA. Además, fíjese en los ojos que permanecen abiertos durante un periodo incómodamente largo. Los primeros deepfakes solían olvidar incluir el parpadeo, y aunque han mejorado, sigue siendo un defecto común en los vídeos sintéticos de baja calidad.

Piel demasiado lisa o asimétrica

La IA tiende a hacer que la piel parezca demasiado perfecta al eliminar toda la textura natural, o bien se equivoca con la iluminación, creando extrañas asimetrías. Busque piel que parezca retocada con aerógrafo o plástica, especialmente en la frente, las mejillas y la línea de la mandíbula.

También debe prestar atención a los parches en los que la textura de la piel cambia repentinamente o en los que las sombras caen en direcciones que no coinciden con la fuente de luz principal. Estos fallos de renderización suelen ser más visibles alrededor de la línea del cabello y a lo largo de la mandíbula, donde la cara falsa se mezcla con una cabeza real.

Ojos muertos o desviados

Los ojos son increíblemente difíciles de renderizar de forma convincente para la IA, lo que los convierte en un punto clave para detectar falsificaciones. La expresión «ojos muertos» se utiliza a menudo porque los ojos generados por IA pueden carecer del brillo de la vida.

Esto es lo que debe buscar:

- Sin reflejos: los ojos reales reflejan las fuentes de luz, creando pequeños puntos brillantes llamados reflejos. Los ojos generados por IA a menudo carecen de ellos, lo que los hace parecer planos y sin vida.

- Mirada perdida: es posible que los ojos de la persona no realicen un seguimiento natural de los movimientos de la cabeza o que parezcan mirar «a través» de usted en lugar de fijarse en algo concreto.

- Detalles inconsistentes: los patrones del iris pueden ser borrosos, demasiado uniformes o diferentes entre los dos ojos.

Fíjese en las manos y los dedos

Las manos y los dedos son un punto débil notorio para los generadores de vídeo con IA. La gran complejidad de la anatomía de la mano, con sus numerosas articulaciones, dedos superpuestos y movimientos fluidos, hace que sea increíblemente difícil para la IA renderizarla con precisión. Presta mucha atención cada vez que aparezcan manos en pantalla, especialmente durante gestos o cuando interactúen con objetos.

Los indicadores clave a tener en cuenta incluyen:

- Recuento incorrecto de dedos: cuente los dedos para detectar dedos adicionales, dedos que faltan o cambios repentinos entre fotogramas.

- Articulaciones extrañas: observe cómo los dedos se doblan en ángulos imposibles o se mueven sin nudillos visibles.

- Combinar dedos: Observe si los dedos se combinan, se separan de forma antinatural o se desplazan durante el movimiento.

- Fallos en la interacción con objetos: comprueba si las manos atraviesan los objetos o los agarran de formas físicamente imposibles.

🔍 ¿Sabías que...? Las «huellas dactilares» de la IA se están convirtiendo en un nuevo método de detección. Algunas herramientas analizan pequeñas señales fisiológicas, como el flujo sanguíneo en la cara, que provocan sutiles cambios en los píxeles invisibles a simple vista para detectar falsificaciones con gran precisión.

Esté atento a los errores físicos y lógicos.

Los modelos de IA aprenden patrones a partir de los datos, pero no comprenden realmente la física del mundo real. Esto le ofrece una gran ventaja. Esté atento a los momentos en los que el vídeo se aleja de la realidad. Estos errores suelen ser sutiles, pero se vuelven evidentes una vez que los detecta.

Objetos que se atraviesan entre sí

Los vídeos generados por IA a menudo no mantienen los límites adecuados de los objetos, un fenómeno conocido como clipping. Presta atención al cabello o la ropa que atraviesa el cuerpo de la persona u otros objetos. Los accesorios como gafas o joyas pueden combinarse con la piel o desaparecer durante uno o dos fotogramas.

Esto también se aplica al entorno. Busque objetos en segundo plano que se crucen de forma imposible con elementos en primer plano. Estos errores se producen con mayor frecuencia en los bordes de los objetos en movimiento o durante movimientos rápidos.

💡 Consejo profesional: Un truco rápido consiste en ver un Clip sin sonido y luego con sonido: si los movimientos de la boca siguen pareciendo descoordinados o poco naturales, es posible que se trate de un Clip generado por IA.

Infracciones de gravedad e impulso

La IA también tiene dificultades con las simulaciones físicas realistas, como la gravedad y el impulso. Busque elementos en el vídeo que no se muevan de forma natural cuando la persona gira la cabeza o camina. Los objetos pueden caer demasiado lento, demasiado rápido o en un arco extraño y flotante.

Los movimientos corporales también pueden parecer incorrectos, careciendo de sensación de peso o inercia. Presta atención a los momentos en los que alguien se sienta, se levanta o interactúa con su entorno. Estas acciones revelan claramente errores físicos.

Interacciones causa-efecto poco naturales

Dado que la IA genera apariencias sin comprender la causalidad, a menudo no logra establecer una conexión entre una acción y sus consecuencias lógicas. Por ejemplo, una persona puede tocar una superficie sin provocar ninguna reacción esperada, como ondas en el agua o una abolladura en un cojín.

Otros indicios son hablar en un entorno frío sin que haya visibilidad del vapor del aliento o caminar sobre arena o nieve sin dejar huellas. Estos errores demuestran que la IA solo está pintando un cuadro, no simulando un mundo real e interactivo.

Indicios en el audio que revelan vídeos sintéticos o editados

Una vez que las imágenes pasan un escaneo rápido, el audio es donde se cuelan muchas falsificaciones de IA. Utilice las comprobaciones siguientes para validar si la voz, la sincronización y el entorno coinciden con lo que está viendo.

Presta atención a la sincronización labial.

La sincronización labial es un área crítica para la detección, ya que el habla humana es increíblemente compleja. La IA a menudo produce movimientos labiales que son similares, pero no del todo correctos, lo que crea una inquietante discrepancia que los sistemas de detección avanzados pueden identificar con una precisión del 99,73 %.

Los indicadores clave a tener en cuenta son:

- Problemas de sincronización: Observe que los labios se mueven ligeramente antes o después de que se reproduzca el audio.

- Figuras que faltan: Observe cómo los labios no se cierran completamente en sonidos como «M», «B» y «P».

- Movimiento incorrecto de la mandíbula: observe si la boca se abre demasiado o no lo suficiente para el sonido.

- Esquinas de la boca estáticas: Busque movimientos limitados al centro de los labios, mientras que las esquinas permanecen rígidas.

Presta atención a las irregularidades en el audio y la voz.

Las voces generadas por IA o clonadas suelen contener sutiles artefactos de audio que las delatan. Aunque la clonación de voces ha mejorado hasta alcanzar un nivel aterrador, si se escucha con atención aún se pueden detectar inconsistencias.

Estos son algunos indicadores clave de audio:

- Entonación robótica: el discurso tiene un tono plano y monótono y carece de las variaciones naturales de tono del habla humana.

- Sin sonidos respiratorios: las personas reales tienen que respirar. La IA a menudo olvida esto, lo que resulta en frases largas e ininterrumpidas sin inhalaciones ni exhalaciones audibles.

- Ritmo extraño: el ritmo del discurso es demasiado uniforme, sin las pausas naturales, las vacilaciones o las palabras de relleno («um», «uh») que utilizan las personas.

- Audio pegado: la voz suena como si se hubiera grabado en una cabina insonorizada y luego se hubiera superpuesto al ruido de fondo del vídeo, en lugar de estar en el mismo espacio acústico.

🔍 ¿Sabías que...? Tecnologías como SynthID de Google incrustan marcas de agua invisibles en vídeos generados por IA para que puedan verificarse posteriormente, incluso si se realizan ediciones o comprimen.

Tenga en cuenta la duración y la calidad del vídeo.

Las características técnicas de un vídeo pueden proporcionar pistas, pero no son una prueba por sí solas. Por ahora, los vídeos generados por IA tienen límites en cuanto a duración y resolución.

- Duración: producir vídeos largos y coherentes con IA sigue siendo muy costoso desde el punto de vista computacional, por lo que la mayoría de los clips sintéticos siguen siendo cortos, a menudo de menos de 30 segundos.

- Resolución: Las resoluciones más altas pueden revelar artefactos de IA, mientras que los vídeos inusualmente bajos o muy comprimidos pueden utilizarse para ocultar imperfecciones visuales.

- Velocidad de fotogramas: las velocidades de fotogramas inconsistentes pueden aparecer como movimientos entrecortados o poco naturales, un efecto secundario común de la generación de IA.

Verifique la fuente antes de confiar en el Clip.

Incluso un vídeo «perfecto» puede ser falso, y hasta un vídeo real puede ser engañoso cuando se vuelve a publicar fuera de contexto. Siga los pasos que se indican a continuación para validar su procedencia y el motivo por el que se realiza el uso compartido.

Verifique la fuente y el contexto

El análisis técnico es solo la mitad del trabajo. Debe combinarlo con la verificación de fuentes. Incluso un vídeo de IA perfectamente elaborado puede quedar al descubierto si se investiga su contexto.

Estos son los pasos de verificación que debe seguir:

- Compruebe la fuente: rastree el vídeo hasta su primera aparición en línea. Compruebe si fue publicado por una cuenta verificada, un medio de comunicación de confianza o una cuenta anónima con antecedentes de difusión de información errónea.

- Búsqueda inversa de imágenes: utilice herramientas para buscar fotogramas del vídeo. Esto puede ayudarle a encontrar la versión original, sin manipular, o a comprobar si ya ha sido verificada por otras personas.

- Evalúa la intención: pregúntate por qué aparece este vídeo ahora. ¿Parece diseñado para provocar una fuerte reacción emocional o influir en la opinión sobre un evento actual?

📮 ClickUp Insight: El 92 % de los trabajadores del conocimiento corren el riesgo de perder decisiones importantes dispersas en chats, correos electrónicos y hojas de cálculo. Sin un sistema unificado para capturar y realizar el seguimiento de las decisiones, la información empresarial crítica se pierde en el ruido digital. Con las funciones de gestión de tareas de ClickUp, nunca tendrá que preocuparse por esto. Cree tareas a partir de chats, comentarios de tareas, documentos y correos electrónicos con un solo clic.

Utilice herramientas de detección con IA.

Las herramientas de detección de IA pueden ayudar a detectar señales de alerta, pero rara vez ofrecen una respuesta definitiva. La mayoría de las probabilidades de retorno, puntuaciones de confianza o señales vagas siguen requiriendo el juicio humano. Ahí es donde los equipos tienden a atascarse, pero porque carecen de una forma clara de revisar, documentar y decidir.

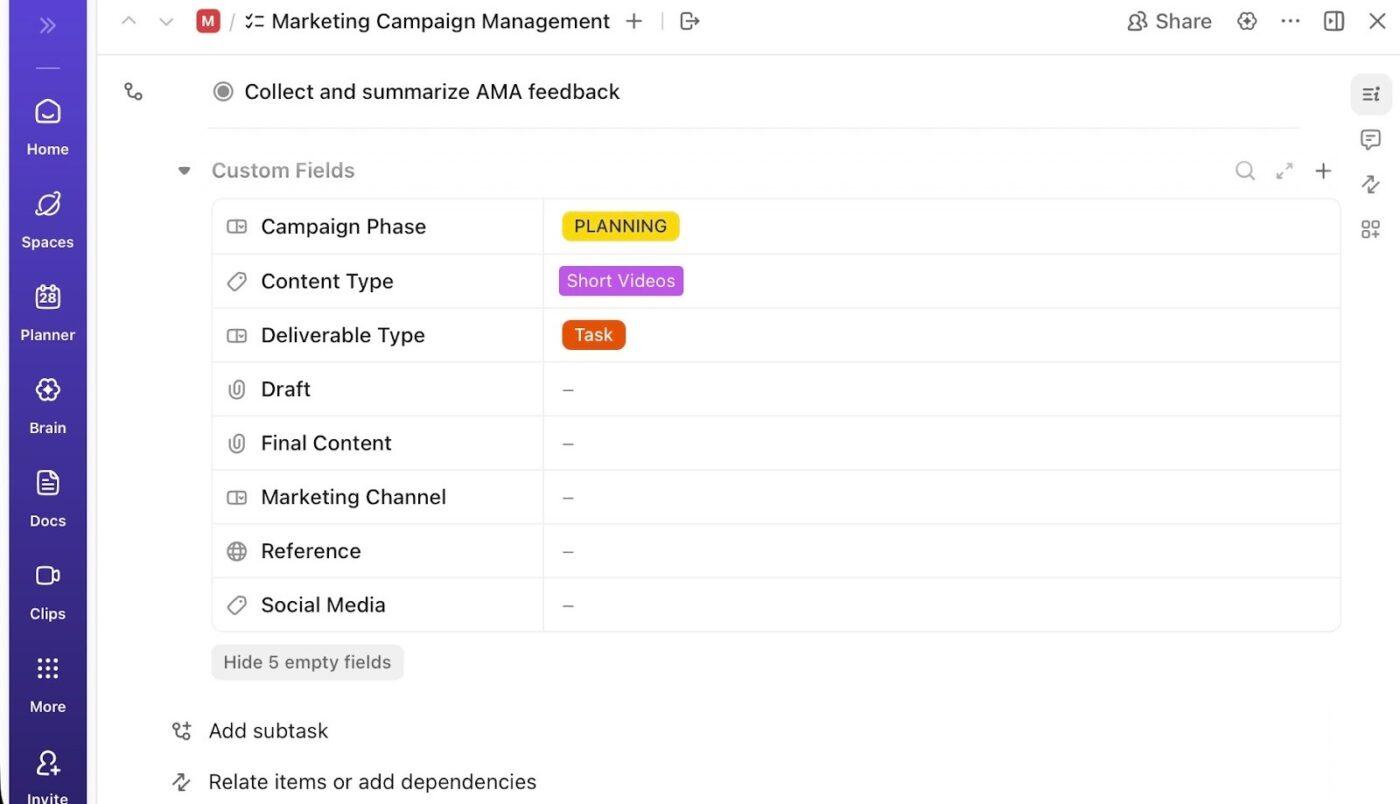

Convierta la verificación de vídeos en un flujo de trabajo repetible en ClickUp.

Detectar señales de alerta es solo la mitad del trabajo. El riesgo real aparece cuando las revisiones se realizan de forma inconsistente, las pruebas se encuentran en lugares aleatorios y las aprobaciones se realizan rápidamente sin un rastro claro. Aquí es donde ClickUp ayuda: puede estandarizar la lista de control, capturar pruebas y tomar decisiones auditables.

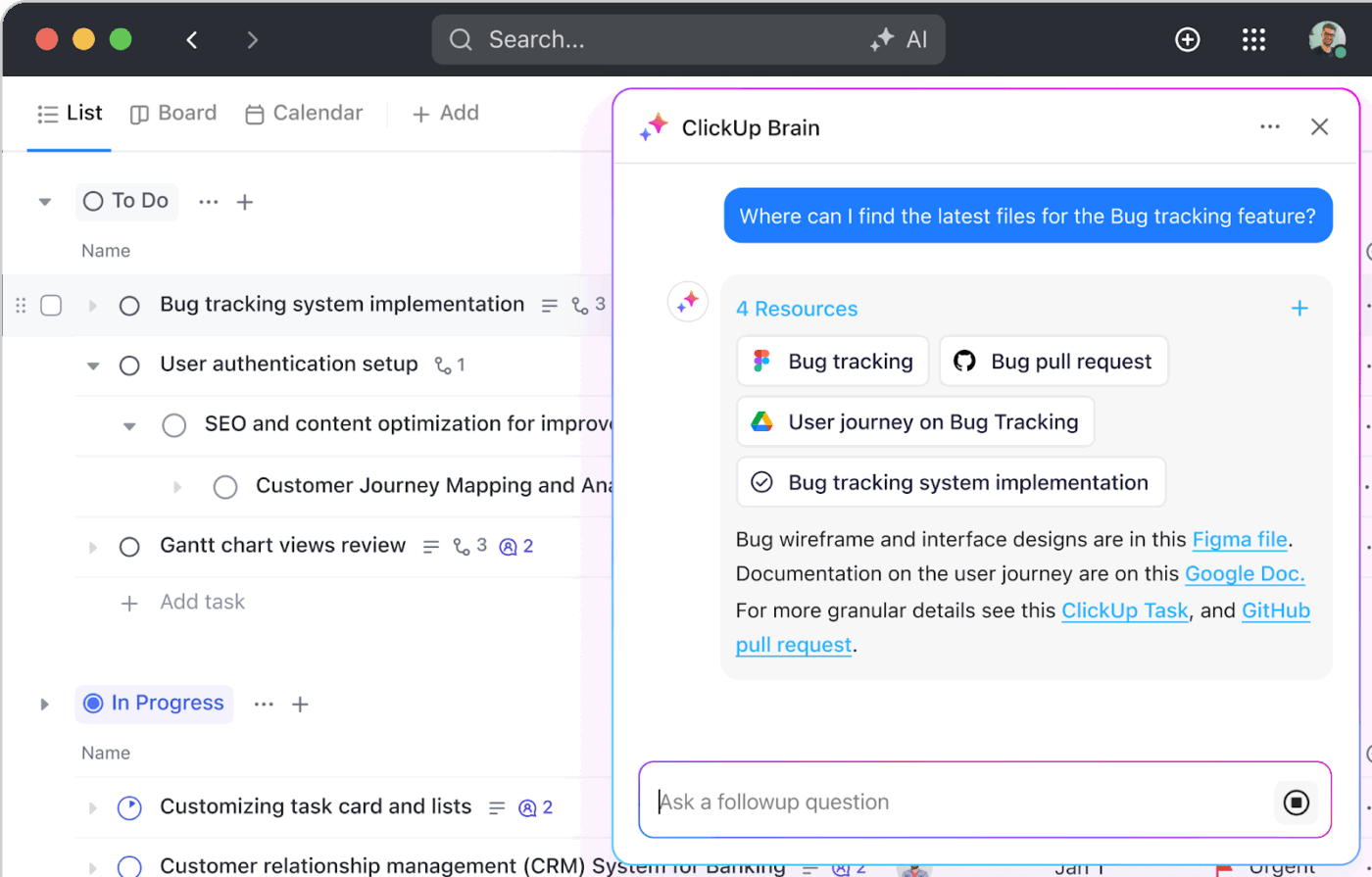

Encuentre rápidamente decisiones y normas anteriores

Cuando revisas un vídeo sospechoso, el contexto es importante. Con ClickUp Enterprise Search, no tienes que recordar dónde se discutió o documentó algo. Puedes realizar una búsqueda y obtener al instante las tareas de revisión relacionadas, las pruebas almacenadas en Docs, los comentarios de los revisores, las decisiones de verificación anteriores e incluso las notas de reuniones relacionadas con casos similares.

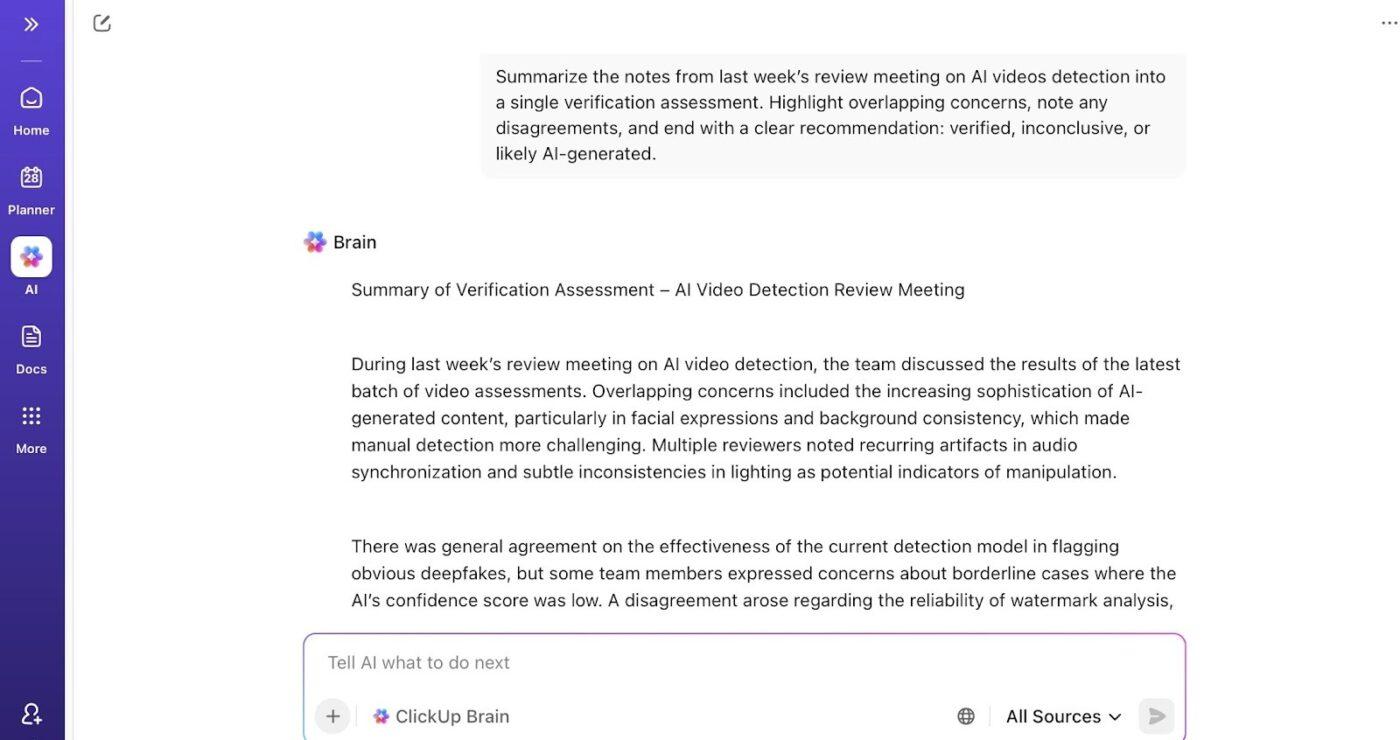

Estandarice lo que comprueban los revisores, para que las decisiones dejen de basarse en opiniones.

Uno de los mayores retos de la verificación de vídeos mediante IA es la inconsistencia. Cada revisor se fija en cosas diferentes y los criterios suelen variar en función de la urgencia, la familiaridad con el contenido o quién lo esté revisando.

ClickUp Brain es la IA sensible al contexto que genera y perfecciona listas de control de revisión de vídeos estructuradas utilizando la información que ya se encuentra en su entorno de trabajo. En lugar de producir orientaciones genéricas, extrae información de documentos, tareas, notas de reuniones, revisiones anteriores y decisiones relevantes para reflejar cómo evalúa realmente su equipo el contenido.

De esta manera, todos los revisores trabajan con el mismo marco de evaluación, basándose en un contexto compartido, lo que hace que las decisiones sean más coherentes y fáciles de defender.

También puede utilizar ClickUp Brain para:

- Convierta las directrices internas en listas de control paso a paso.

- Actualice los criterios a medida que evoluciona la calidad de los vídeos de IA, sin tener que reescribir todo desde cero.

- Redacte resúmenes de verificación adecuados para su revisión por parte de los departamentos jurídico, de cumplimiento normativo o directivo.

- Compare los resultados actuales con las decisiones de verificación anteriores almacenadas en el entorno de trabajo.

📌 Prueba estas indicaciones con ClickUp Brain

- Genere una lista de control paso a paso para la revisión de vídeos con IA utilizando documentos, tareas y revisiones anteriores existentes.

- Identifique indicadores recurrentes en revisiones anteriores que a menudo conducen a clasificaciones generadas por IA.

- Actualice los criterios de detección de vídeos con IA basándose en revisiones recientes y debates del equipo.

- Marque las señales débiles o poco fiables que suelen causar desacuerdos o falsos positivos.

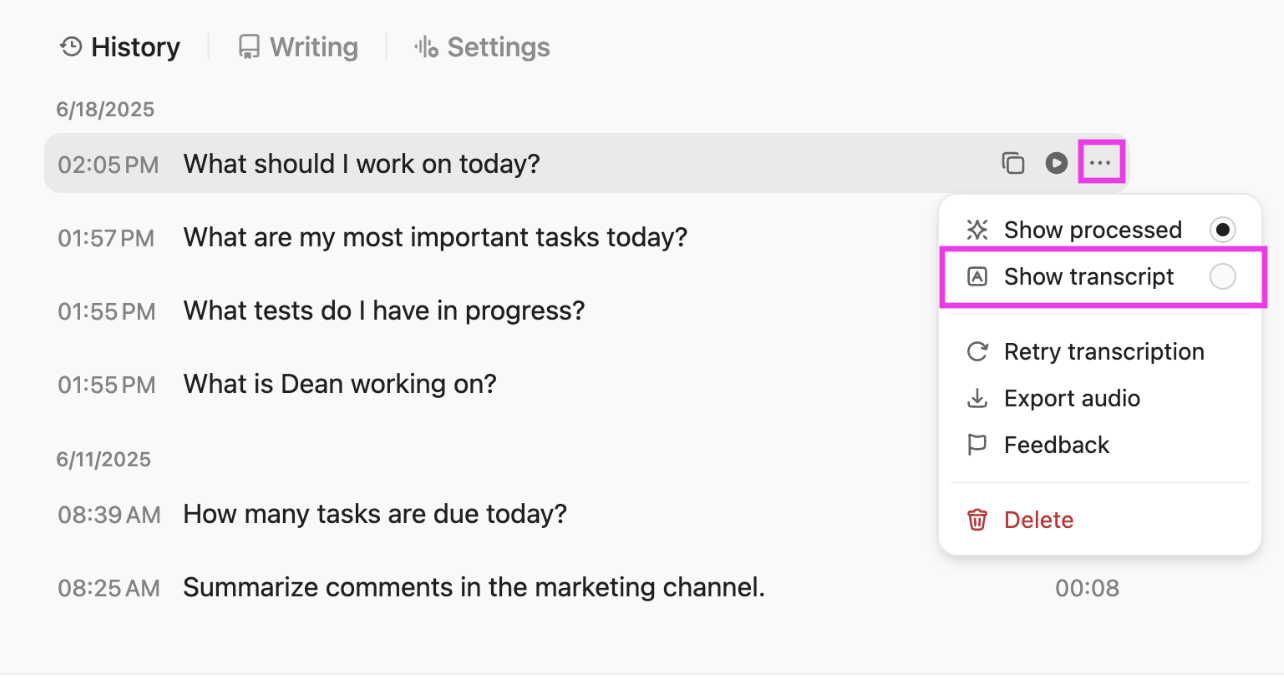

Captura información valiosa en el momento en que surge con ClickUp Brain MAX.

Durante la verificación de vídeos, a menudo surgen observaciones críticas mientras los revisores ven el Clip, discuten anomalías o toman decisiones. ClickUp BrainMAX ayuda a capturar esas ideas al instante para que no se pierdan entre herramientas o reuniones.

Con Talk-to-Text, los revisores pueden grabar verbalmente anomalías como discrepancias temporales, inconsistencias faciales o sospechas de manipulación. BrainGPT convierte estas notas en notas estructuradas, tareas enlazadas o actualizaciones de la lista de control en tiempo real.

Como todo permanece dentro del mismo entorno de trabajo de IA convergente, el flujo de información se realiza directamente en los registros de verificación, los criterios de revisión y las decisiones finales. Sin notas dispersas. Sin pérdida de contexto. Sin transcripción manual.

Esto garantiza que su proceso de verificación refleje lo que los revisores ven realmente, y no lo que recuerdan más tarde.

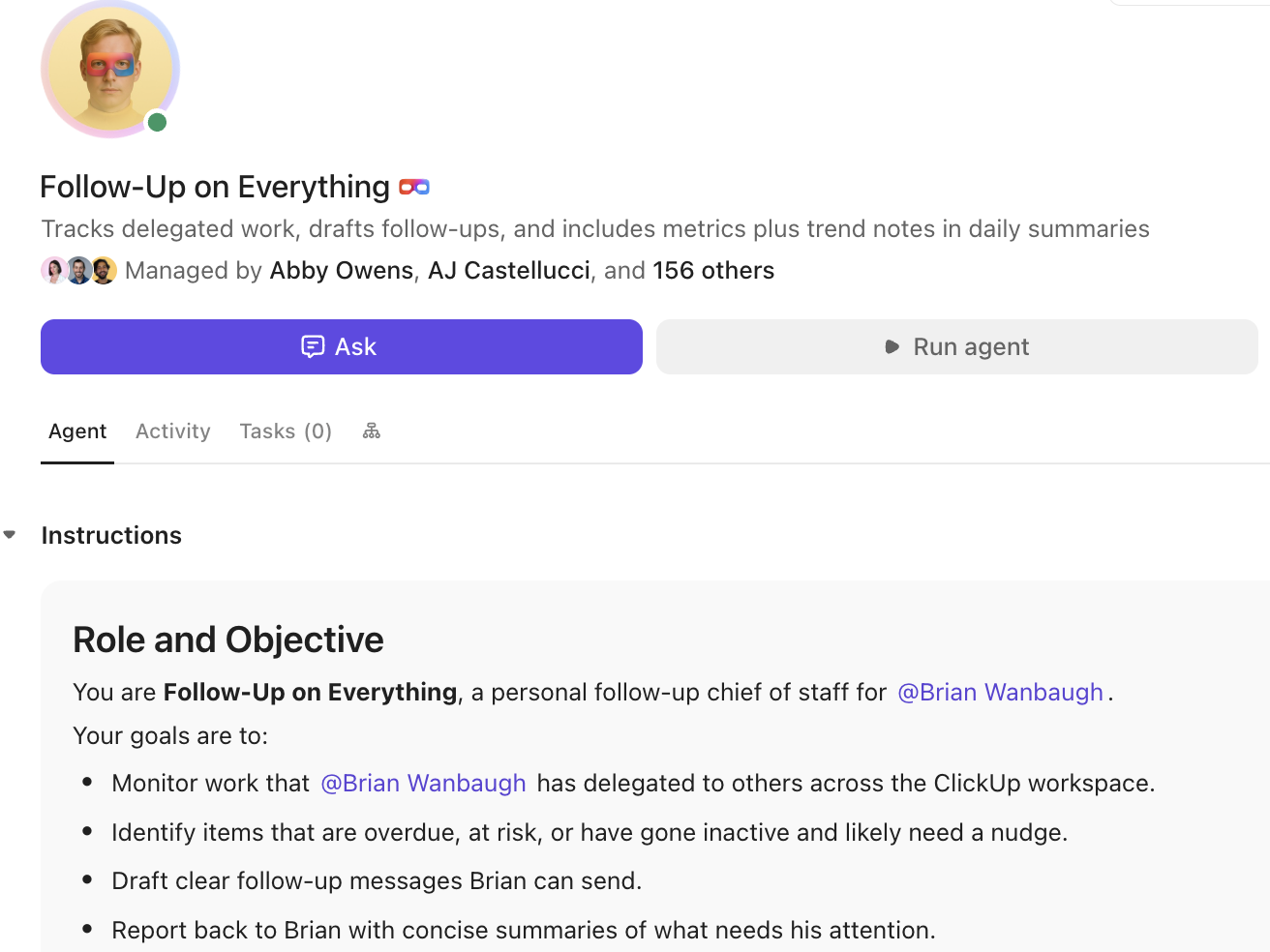

Amplíe la supervisión de la verificación con ClickUp Super Agents.

A medida que aumenta el volumen de verificación, el reto pasa de revisar un vídeo a mantener una supervisión constante de muchos. Los superagentes de ClickUp supervisan continuamente su flujo de trabajo de verificación y detectan los problemas antes de que se conviertan en riesgos.

Pueden marcar automáticamente las revisiones estancadas, detectar cuándo los vídeos de alto riesgo avanzan sin una validación secundaria, resaltar patrones en varios clips marcados y generar resúmenes de informes para el cumplimiento normativo o la dirección.

En lugar de depender de seguimientos manuales o de la búsqueda del estado, los Super Agents garantizan que el sistema de verificación se mantenga activo, coherente y auditable a medida que se amplía.

Esto hace que la verificación pase de ser una comprobación reactiva a una gestión proactiva.

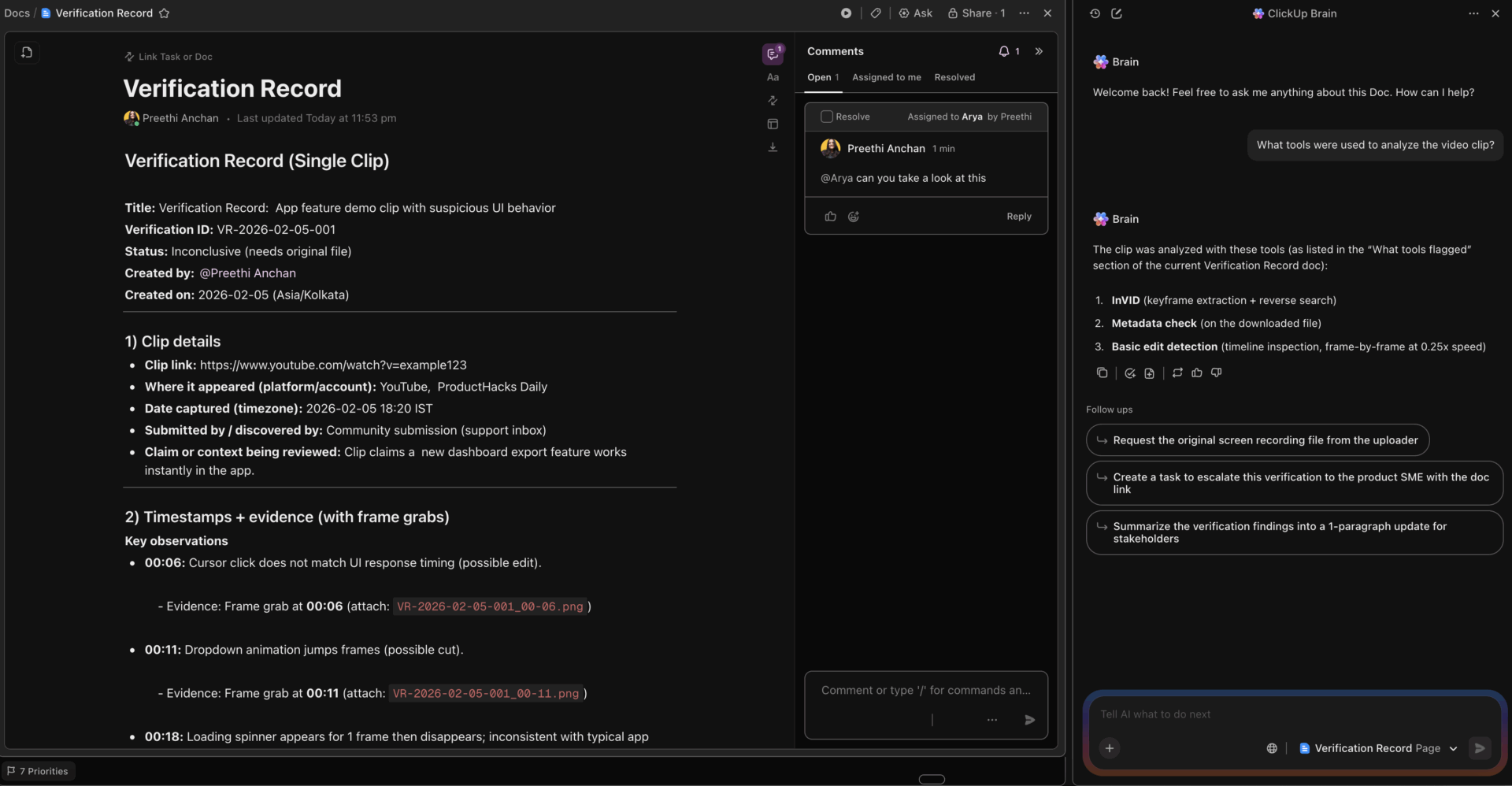

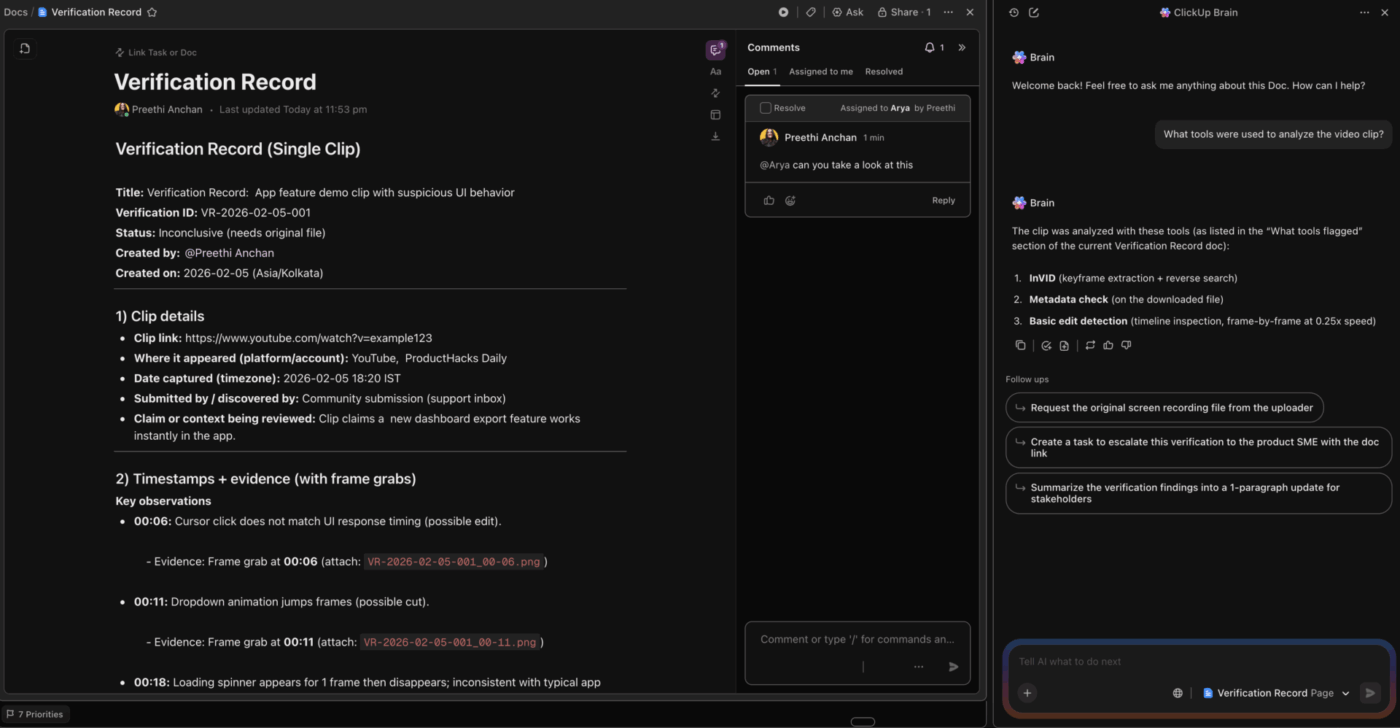

Almacene las pruebas y las decisiones en un único registro de verificación con ClickUp Docs.

Una revisión de vídeo solo es útil si otra persona puede auditarla más tarde y llegar a la misma conclusión. Utilice ClickUp Docs para mantener un registro de verificación por Clip, de modo que las capturas de pantalla, las marcas de tiempo, los resultados de las herramientas y la decisión final permanezcan juntos.

Incluye lo esencial en cada documento:

- Detalles del Clip: enlace, dónde apareció, fecha de captura.

- Marcas de tiempo + pruebas: «00:07 distorsión de la boca», «00:13 artefacto en la mano» con capturas de fotogramas.

- Qué herramientas lo han señalado: nombre de la herramienta, puntuación de confianza, ajustes utilizados.

- Verificación de fuentes: autor original de la publicación, cadena de reposts, enlaces relacionados para la verificación de datos.

- Decisión + justificación: aprobado/rechazado, por qué y quién lo aprobó.

- Siguiente acción: publicar, escalar, solicitar el archivo original o bloquear la distribución.

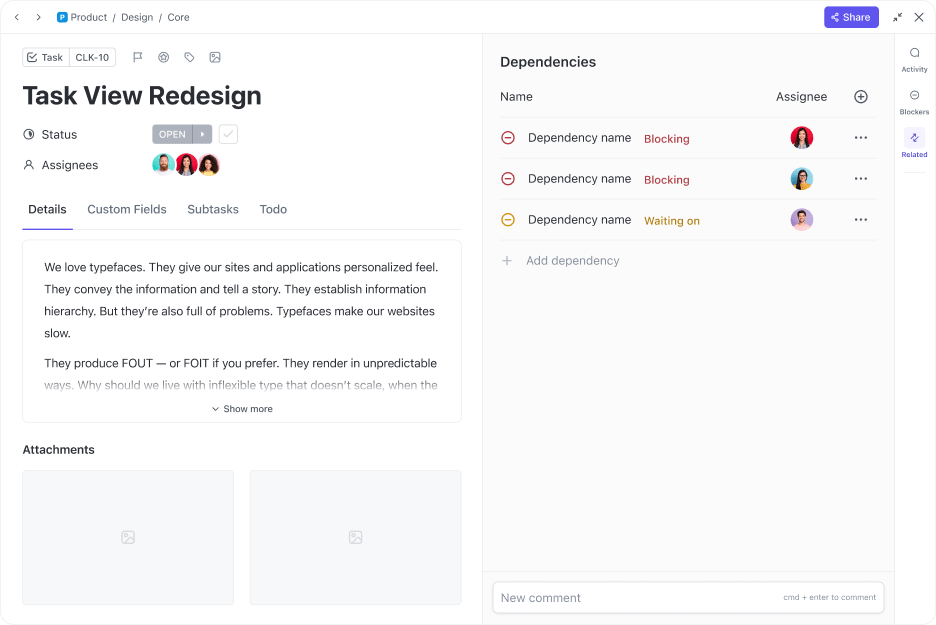

Haga que el estado de la revisión tenga visibilidad y sea procesable.

La verificación suele implicar varios pasos, como la revisión inicial, la confirmación secundaria, la aprobación legal o de la marca y la disposición final. Sin visibilidad, los vídeos se estancan o avanzan sin las comprobaciones adecuadas.

ClickUp Tasks proporciona una forma estructurada de gestionar el proceso de verificación de cada vídeo. Cada vídeo puede ser una tarea independiente, y puedes asignar revisores, vincular pruebas de apoyo, añadir comentarios y conectarlo con trabajos relacionados. Las tareas actúan como la unidad de trabajo que avanza a través de tu proceso de verificación.

Para estructurar mejor ese proceso, puede utilizar los Campos personalizados de ClickUp. Le ayudan a añadir metadatos significativos a cada tarea de verificación y a categorizar, filtrar y ordenar las tareas de verificación basándose exactamente en los criterios que le interesan a su equipo. Aparecen directamente en la tarea, por lo que puede ver al instante cuál es la situación y qué requiere atención.

Por ejemplo, puede utilizar los campos personalizados para:

- Estado de revisión (Pendiente de revisión, Necesita una segunda comprobación, Marcado para un análisis más profundo, Verificado como real o Aprobado/rechazado definitivamente).

- Puntuación de confianza (0-100): el revisor introduce un número basado en la probabilidad que cree que tiene la IA.

- Nivel de riesgo (riesgo bajo, riesgo medio o riesgo alto)

- Tipo de artefacto detectado (fallo en los detalles faciales, problema de sincronización de audio y vídeo, anomalía en las manos o inconsistencia en la iluminación)

📮 ClickUp Insight: 1 de cada 4 empleados utiliza cuatro o más herramientas solo para crear contexto en el trabajo. Un detalle clave puede estar oculto en un correo electrónico, ampliado en un hilo de Slack y documentado en una herramienta independiente, lo que obliga a los equipos a perder tiempo buscando información en lugar de realizar su trabajo.

ClickUp consolida todo su flujo de trabajo en una única plataforma. Con funciones como ClickUp Gestión de Proyectos por Correo Electrónico, ClickUp Chat, ClickUp Documentos y ClickUp Brain, todo permanece conectado, sincronizado y accesible al instante. Diga adiós al «trabajo sobre el trabajo» y recupere su tiempo de productividad.

💫 Resultados reales: los equipos pueden recuperar más de 5 horas cada semana utilizando ClickUp, lo que supone más de 250 horas al año por persona, al eliminar los procesos obsoletos de gestión del conocimiento. ¡Imagina lo que tu equipo podría crear con una semana extra de productividad cada trimestre!

Cree su flujo de trabajo de verificación en ClickUp

Detectar vídeos generados por IA no consiste en encontrar un único indicio revelador. Se trata de combinar señales, documentar decisiones y aplicar los mismos estándares en todo momento. A medida que los medios sintéticos siguen mejorando, las revisiones ad hoc y las comprobaciones intuitivas solo crearán más riesgos.

Los equipos que invierten ahora en un flujo de trabajo de verificación claro y repetible están mejor preparados para afrontar lo que venga después. Con ClickUp, puede reunir los criterios de revisión, las pruebas, las decisiones y las aprobaciones en un único sistema conectado, de modo que el trabajo de verificación sea coherente, auditable y fácil de escalar entre los equipos.

Si está listo para pasar de herramientas dispersas a un proceso estructurado de verificación de vídeos, ¡puede empezar a crear su flujo de trabajo en ClickUp hoy mismo!

Preguntas frecuentes (FAQ)

Busque los mismos indicadores que en el vídeo pregrabado, como parpadeos poco naturales o errores de sincronización labial. Si algo le parece extraño durante una llamada en directo, pida a la persona que haga un gesto inesperado, como girar rápidamente la cabeza hacia un lado, ya que los deepfakes en directo tienen dificultades con los movimientos no guionizados.

Las herramientas de detección utilizan algoritmos para encontrar artefactos técnicos, mientras que la verificación manual se basa en sus ojos y su pensamiento crítico. El mejor enfoque combina ambos. Deje que una herramienta señale los posibles problemas y, a continuación, utilice su criterio para evaluar la fuente y el contexto.

Ninguna herramienta por sí sola puede detectarlo todo. La tecnología es una carrera armamentística constante, en la que los métodos de nueva generación suelen superar a los de detección. Las herramientas son más fiables para detectar tipos de falsificaciones más antiguas o más comunes.

Establezca un protocolo claro. El primer paso es marcar el contenido y evitar su uso compartido hasta que se haya realizado la verificación. A continuación, documente la fuente, sométalo a su flujo de trabajo de verificación y remítalo a los miembros del equipo adecuados para que tomen una decisión final.