多くの人は、高性能なAIツールを利用するか、データのプライバシーを守るかのどちらかを選ばなければならないと考えています。しかし、実際にはその両方を手に入れることが可能です。AIをローカルで実行すれば、データがハードウェアの外に出ることはありません。最も反復的なタスクを自動化しつつ、情報に対する完全な管理権限を維持できるのです。

このガイドでは、Ollamaなどのツールを活用して、ローカルAIを用いたセキュリティのあるワークフローを構築する方法をご紹介します。ご自身のハードウェア仕様に合ったオープンソースモデルの選択方法や、プライベート文書をローカルで処理する自動化されたワークフローの構築方法を学べます。

また、ClickUpのような統合されたスペースでワークフローを一元化する方法についても解説します。😎

ローカルAIとは?

ローカルAIとは、データを外部のクラウドサービスに送信するのではなく、ノートパソコンやオンプレミスサーバーなどの自社ハードウェア上で大規模言語モデル(LLM)を完全に実行することを指します。これは、エンジニアリングやプロダクトデザインから法務・財務部門に至るまで、機密情報を扱うあらゆるチームに適しています。

多くのクラウドベースのAIツールでは、プロンプト、ドキュメント、データがサードパーティのサーバーに送信されます。その結果、その情報がどのように処理、保存、または使用されるかについて、制御できなくなってしまいます。

一方、ローカルAIならデータを自社環境内に留めることができます。ワークフローのセキュリティとデータ保護については、引き続き完全に自社で管理できます。

もちろん、それにはトレードオフがあります。ローカルAIの構築には、より多くの技術的な努力と初期のハードウェア投資が必要です。しかし、それによって外部プロバイダーへの依存関係を完全に排除できます。デバイス上での推論により、情報はまさにあなたが望む場所に留まります。

安全なチームワークフローにおいてローカルAIが重要な理由

🔎 ご存知でしたか?消費者の10人に1人しか、金融情報、通信情報、生体認証データなどの機密情報をAI駆動型システムと共有することに同意していません。

こうした躊躇は、B2Bチームにとって現実味を帯びつつある問題を表しています。クラウドベースのAIを利用することは、実質的に自社の知的財産を第三者に委ねることになります。法務、財務、人事の各チームにとって、これは重大な法的責任を招く恐れがあります。

ローカルAIは、AIを自社ハードウェア上で実行することで、この状況を一変させます。これが日々の業務において重要な理由を以下に説明します:

- データ漏洩を防止: 競合他社が利用する可能性のある公開モデルのトレーニングに、独自のコードやプライベートなクライアント契約が使用されるのを防ぎます

- 規制への準拠を維持: 機密データが国境を越えたり、サードパーティのサーバーに送信されたりすることはないため、GDPRやHIPAAの規制範囲内にとどまることができます

- インターネットとの依存関係を解消: 通信障害時や、クラウドへのアクセスが制限されている高度なセキュリティ環境下でも、複雑なデータ分析や図面作成タスクを実行できます

- コストを予測可能に管理: チームが拡大してもAPI利用料の値上げを回避できます。必要なコストは、すでに所有しているハードウェアのみだからです。

ローカルAIを既存のツールと統合することで、セキュリティを損なうことなく仕事を自動化できます。

⚠️ ただし、この問題はさらに深刻化する可能性があることを忘れてはなりません。チームが複数のAIツールを導入しようとした場合、「AIスプロール」——つまり、管理や戦略なしにAIツールが乱立する状態——に陥る恐れがあります。その結果、資金の無駄遣いや努力の重複、さらにはセキュリティリスクにつながる可能性があります。

結局のところ、これによりセキュリティ脅威モデルが拡大し、仕事が追跡困難になります。

📮ClickUpインサイト:パフォーマンスの低いチームは15以上のツールを併用している可能性が4倍高いのに対し、パフォーマンスの高いチームはツールセットを9つ以下のプラットフォームに限定することで効率を維持しています。では、1つのプラットフォームだけを使うのはどうでしょうか?仕事のためのオールインワンアプリであるClickUpなら、タスク、プロジェクト、ドキュメント、Wiki、チャット、通話などを単一のプラットフォームに集約し、AIを活用したワークフローも完備しています。 よりスマートに働く準備はできていますか?ClickUpはあらゆるチームに適しており、仕事を可視化し、AIが残りの作業を処理する間、あなたが本当に重要なことに集中できるようにします。

ローカルAIを実行するには何が必要ですか?

AIをローカルで実行するのに、専用のスーパーコンピュータは必要ありません。モデルの構築方法における最近の変化により、手持ちのハードウェアで今すぐ始めることができます。やることとは、いくつかの特定の条件を満たすことです。

ハードウェア要件

使用できるAIモデルのサイズや処理速度は、お使いのハードウェアによって決まります。高性能なマシンであればより複雑な推論モデルを実行できますが、小型のモデルも驚くほど高性能になってきています。

- VRAM搭載GPU: 12GB以上のVRAMを搭載したNVIDIA製専用グラフィックスカードは、現在、多くのチームにとって最適な選択肢です。これにより、Llama 3.3(80億パラメータ)やMistral Smallといった中規模のモデルを高速で実行できます。

- システムRAM: 高性能なGPUをお持ちでない場合、コンピュータのRAMが処理を担います。32GBあれば、ブラウザやプロジェクト管理ツールを開いたままでも、モデルを実行するのに十分な余裕があります

- ユニファイドメモリ(Macユーザー向け): Mシリーズチップ(M2、M3、またはM4)を搭載したMacを使用している場合、RAMとGPUメモリは共有されています。これにより、モデルがメモリ全体にアクセスできるため、MacはローカルAIに特に適しています

- 高速ストレージ: モデルは5GBから50GBの範囲に及ぶことも多い大容量ファイルです。新しいモデルを読み込む際の待ち時間を短縮するには、NVMe SSDの使用が不可欠です

🔎 ご存知でしたか?PCの自作にかかる費用は、ほんの数ヶ月前と比べて大幅に高騰しています。以前は32GBのDDR5メモリキットが130ドル未満でしたが、現在では同じキットが400ドルを超える価格に跳ね上がっています。この変化により、システムパフォーマンスが低下することなくモデルを実行するための十分な余裕が必要となるため、本格的なローカルAI仕事において32GBは新たな最低ラインとなっています。

ソフトウェア要件

ソフトウェアは、ハードウェアとAIをつなぐ架け橋となります。これを実現するために、もはや開発者である必要はありません。

- オペレーティングシステム: AIの本来の基盤はLinuxですが、現在ではWindowsやmacOSも同等の性能を発揮します。WindowsユーザーはWSL2を使用してLinuxのような環境を構築できますが、多くのツールは現在、Windows上で直接動作します

- モデル管理者の方へ:OllamaやLM Studioのようなツールが、最も手軽なスタート地点となります。これらのツールは、モデルを圧縮してハードウェアに収まるようにする「量子化」を自動的に処理してくれます。

- ドライバー: お使いのハードウェアに対応した最新のドライバー(NVIDIAカードの場合は最新のCUDAドライバーなど)が必要です。最近のインストーラーの多くは、セットアップ中にこれを自動的に確認します

オープンソースのLLMの選択肢

無料でダウンロードできるオープンソースのモデルが急増しています。これらはMeta(Llama)、Mistral、Alibaba(Qwen)などの企業によって開発されています。クローズドなシステムとは異なり、これらのモデルでは、その仕組みやデータの行き先を正確に把握することができます。

大規模言語モデルを選ぶ際は、ソフトウェアのライセンスを確認してください。その多くはApache 2.0またはMITライセンスを採用しており、月額サブスクリプション料なしでビジネス運用に活用できます。これらのモデルは自社のハードウェア上で動作するため、プライベートなワークフローに直接統合することが可能です。

例えば、ローカルモデルを使用して社内電子メールの下書きを作成したり、ミーティングの議事録を要約したり、独自のデータセットを分析したりすることができます。これにより、最も機密性の高いプロジェクトの詳細や戦略的なメモを、自社のマシン内に留めておくことができます。

🧠 豆知識:AppleのMシリーズチップは、プライバシー重視のチームにとって独自のアーキテクチャ上の利点を提供します。Macのユニファイドメモリにより、AIはシステムRAM全体を、あたかも専用のグラフィックスメモリであるかのように利用できます。

つまり、128GBのRAMを搭載したMacBookでも、通常なら1万ドル以上もする専用の企業向けハードウェアが必要となるような、大規模で高度に洗練されたモデルを実行できるということです。

チームワークフローに最適なローカルAIモデル

最適なモデルを見つけるには、モデルの強みをチームのタスクやハードウェアの性能と照らし合わせて検討してください。

汎用モデル

これらはローカルセットアップの主力ツールです。電子メールの下書き作成、プロジェクト進捗の要約、あるいはクリエイティブなアイデアのブレインストーミングなどに活用してください。

- Llama 4 Scout (17B): 1,000万トークンのコンテキストウィンドウの機能があり、数千ページに及ぶテキストを一度に処理することが可能です

- Mistral Small 4: ミックス・オブ・エキスパート(MiXe)アーキテクチャを採用しており、各タスクにおいてパラメーターのごく一部のみを活性化します

- Qwen 3.5 (7B): チームで多言語の技術文書を扱っている場合、一貫して優れたパフォーマンスを発揮します

推論とツール使用のためのモデル

LLMエージェントに多ステップの問題の解決、複雑なロジックの追跡、またはワークフロー内での自律的なエージェントとしての動作を必要とする場合に、これらを活用してください。

- Llama 4 Maverick: 本モデルはネイティブにマルチモーダルに対応しています。そのため、視覚的な文脈がテキストと同様に重要な、複雑なチャートや財務スプレッドシートの分析を必要とするチームに最適です。

- Phi-4 (14B): STEM分野や論理的推論に特化しています。通常はより大規模で高価なモデルを必要とするデータ検証や複雑な数学的タスクに活用してください。

- DeepSeek-R1: 内部の推論プロセスを可視化するため、重要な分析においてそのロジックを検証するのに役立ちます。詳細な調査や戦略的プランに最適です

タスク特化型モデル

場合によっては、汎用的なアシスタントよりも、特定の用途に特化したツールの方が効率的です。これらのモデルは、ワークフローの特定の1つの部分に最適化されています。

- Qwen 3-Coder-Next: リポジトリ規模のロジックを理解し、複数のファイルにわたるバグ修正やコードのリファクタリングを提案します。その際、チームの特定のスタイルガイドに従って処理を行います。

- Voxtral Mini: 録音内の話者を識別し、プライベートなミーティングの録音を検索可能なテキストに変換します。完全にオフラインで動作するため、データ漏洩の防止に最適です

- Nomic Embed v1.5: プライベートな文書を数学的データに変換し、セマンティック検索を可能にします。これにより、キーワードだけでなく意味に基づいてチームの内部ナレッジベースを検索できるようになります

📚 関連記事:LLM検索エンジン:AIを活用した情報検索

ローカルAIを実行するための人気ツール

もはや、自分のマシンでモデルを実行するためにソフトウェアエンジニアである必要はありません。現在では、数分で技術的なセットアップを代行してくれる使いやすいアプリケーションがいくつかあります。

OllamaとOpenWebUI

Ollamaは、スピードと柔軟性を求める方に最適です。バックグラウンドで動作し、シンプルなインターフェースを通じてモデルライブラリを管理します。

最初は基本的なツールとして始まりますが、多くのユーザーはOpenWebUIと組み合わせて使用しています。これにより、ブラウザ上で洗練されたチャット体験が実現され、使い慣れたクラウドベースのツールのような見た目と操作感を得られます。また、コンピュータ上の他のアプリがAIモデルと安全に通信するためのローカルブリッジも構築されます。

LM Studio

従来のデスクトップアプリをお好みの方には、LM Studioが最適な選択肢です。これはAI版のアプリストアのような役割を果たします。わずか数回のクリックで、新しいモデルを検索・ダウンロードし、チャットでやり取りすることができます。

このアプリにはハードウェア検出機能が組み込まれているため、お使いのGPUやRAMに合わせて設定が自動的に調整されます。これにより、コードを1行も書かずにさまざまなモデルを試してみたい方にとって、最適なスタート地点となります。

GPT4All

プライバシー保護と文書分析に特化したチームにとって、GPT4Allは信頼性が高くシンプルなソリューションです。専用グラフィックスカードを搭載していない古いノートパソコンを含め、ほぼすべてのコンピュータで動作します。

このアプリの最大の機能は、ローカルのファイルと直接チャットできることです。ハードドライブ上のフォルダを指定するだけで、AIがその特定のドキュメントに関する質問に答えてくれます。その際、ドキュメントをサードパーティのサーバーにアップロードする必要は一切ありません。

📚 こちらもご覧ください:ノーコードユーザーに最適なAIエージェント

安全なワークフローのためのローカルAIの設定方法

このチュートリアルでは、セキュリティが確保されたローカルなAIワークフローを構築するための広くサポートされているツールであるOllamaを使用します。

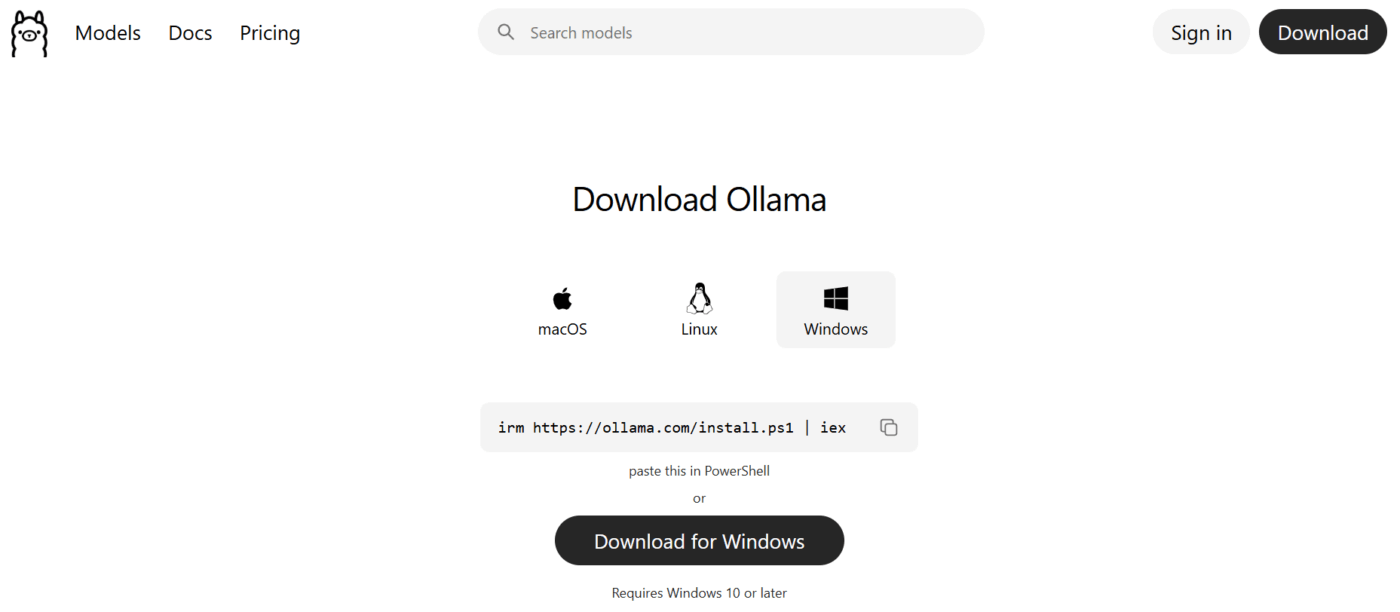

ステップ1:Ollamaをインストールする

お使いのOSに対応したインストーラーを公式サイトからダウンロードしてください。以前のWindowsバージョンではLinuxサブシステムの手動セットアップが必要でしたが、現在のバージョンではネイティブアプリケーションとしてインストールされます。

インストールには数分しかかかりません。インストールが完了したら、ターミナルまたはコマンドプロンプトを開き、ollama --バージョン と入力して、使用可能な状態になっていることを確認してください。

ステップ2:モデルをダウンロードして実行する

/AIを使い始めるには、その重みデータを自分のマシンにダウンロードする必要があります。最初のテストには、Llama 3.2 (3B) や最新のMistralのような、コンパクトでありながら高性能なモデルを試してみてください。

ollama run llama3.2 コマンドを使用して、ダウンロードを開始してください。

インターネットの通信速度にもよりますが、通常は数分で完了します。ダウンロードが完了したら、ターミナルにプロンプトを直接入力することで、ハードドライブ上のモデルから即座に回答を得ることができます。

ステップ3:ワークフローツールに接続する

ローカルAIの真の価値は、日々のタスクに組み込むことで発揮されます。Ollamaが実行されると、http://localhost:11434 でローカルサーバーが自動的に起動します。これにより、他のアプリケーションがモデルと通信するための安全なブリッジが構築されます。セキュリティを確保します。

このサーバーは標準的なOpenAIプロトコルに対応しているため、APIアドレスを変更するだけで、自動化プラットフォームや社内スクリプトに接続できます。例として、ローカルのドキュメント検索ツールをこのアドレスに設定することで、テキストをクラウドに送信することなく、プライベートファイルを要約できるようになります。

📖 こちらもご覧ください:ワークフローのオーケストレーションを効率化し、生産性を向上させる方法

ローカルAIワークフローのセキュリティに関するベストプラクティス

AIをローカルで実行することは、プライバシー保護において大きな前進です。しかし、データをローカルに保存するということは、その保護責任がユーザー自身にあることを意味します。サードパーティのクラウドサービスにおける情報漏洩のリスクは排除できましたが、ハードウェアのセキュリティ確保や、チームがモデルを操作する際のセキュリティ対策は依然として必要です。

以下のベストプラクティスに従ってください:

- ネットワークの分離: APIへのアクセスを信頼できる内部ネットワークに限定し、AIサーバーがパブリックインターネットからアクセスできないようにします

- 入力の検証: モデルに送信する前に、すべてのデータをサニタイズしてください。これにより、文書や電子メールに潜む悪意のある指示をブロックできます。

- アクセス制御: AIエンドポイントに認証機能を実装し、許可されたユーザーのみがモデルアクションを実行できるようにします

- 監査ログ: コンプライアンスやセキュリティ調査に役立てるため、モデルとのすべてのやり取りを記録します

- コンテナによる隔離: Dockerのようなサンドボックス環境でモデルを実行します。これにより、潜在的な侵害がコアシステムファイルに到達するのを防ぎます

- 定期的な更新: Ollamaなどのツールに最新のパッチを適用し、新たに発見された脆弱性からシステムを保護しましょう

- レートリミット: 単一のユーザーやスクリプトによるリクエストの集中でサーバーが過負荷になるのを防ぐため、一定期間内に実行できるクエリ数を制御するレートリミットを実装してください。

🔎 ご存知でしたか? プロンプトを用いた操作は、もはや理論上の脅威ではありません。ガートナーの最近のアンケートによると、過去1年間にAIアプリケーションに対する悪意のあるプロンプト攻撃を受けた組織は32%に上りました。こうした攻撃により、ローカルモデルが操作され、偏った出力や不正な出力が生成される可能性があります。

チームのための安全なAIワークフローの構築方法

ローカルサーバーが稼働し始めれば、それを日々の仕事に組み込むことができます。これにより、単なるツールが、プライベートな生産性向上エンジンへと変わります。これを実現する最も効果的な方法は、Retrieval-Augmented Generation(RAG)を活用することです。

このプロセスにより、ローカルAIを自社ファイルのプライベートデータベースに接続します。クラウドに1バイトもアップロードすることなく、自社固有のコンテキストに基づいて質問に回答できます。

また、AIの処理結果を人間のチームメンバーが確認する「ヒューマン・イン・ザ・ループ」型のワークフローを設計することも可能です。これにより、精度を確保しつつ、作業のスピードを大幅に向上させることができます。

以下に、いくつかの実用的な例をご紹介します:

- 文書分析: 社内レポートや顧客のフィードバックを要約し、重要な知見を即座に抽出します

- ドラフト作成: チームメンバーが内容を練り上げるための、電子メールやプロジェクト進捗報告の初バージョンを作成します

- データ分類: リクエストの具体的なコンテンツに基づいて、受信タスクを自動的に分類します

- ミーティングの準備: ローカルドライブに保存されている関連プロジェクトファイルを分析し、議論の要点をまとめましょう

- コードレビュー: 知的財産を第三者に開示することなく、自社開発のソースコードに対するフィードバックを得ることができます

📮ClickUpインサイト: 当社が実施したAI導入成熟度アンケートによると、職場でのAIへのアクセスは依然として限定的であることが明らかになりました。36%の人が全くアクセスできず、実際にほとんどの従業員がAIを試すことができると答えたのはわずか14%でした。AIが許可設定や追加ツール、複雑なセットアップの壁に阻まれていると、チームは実際の日常仕事でAIを試す機会さえ得られません。

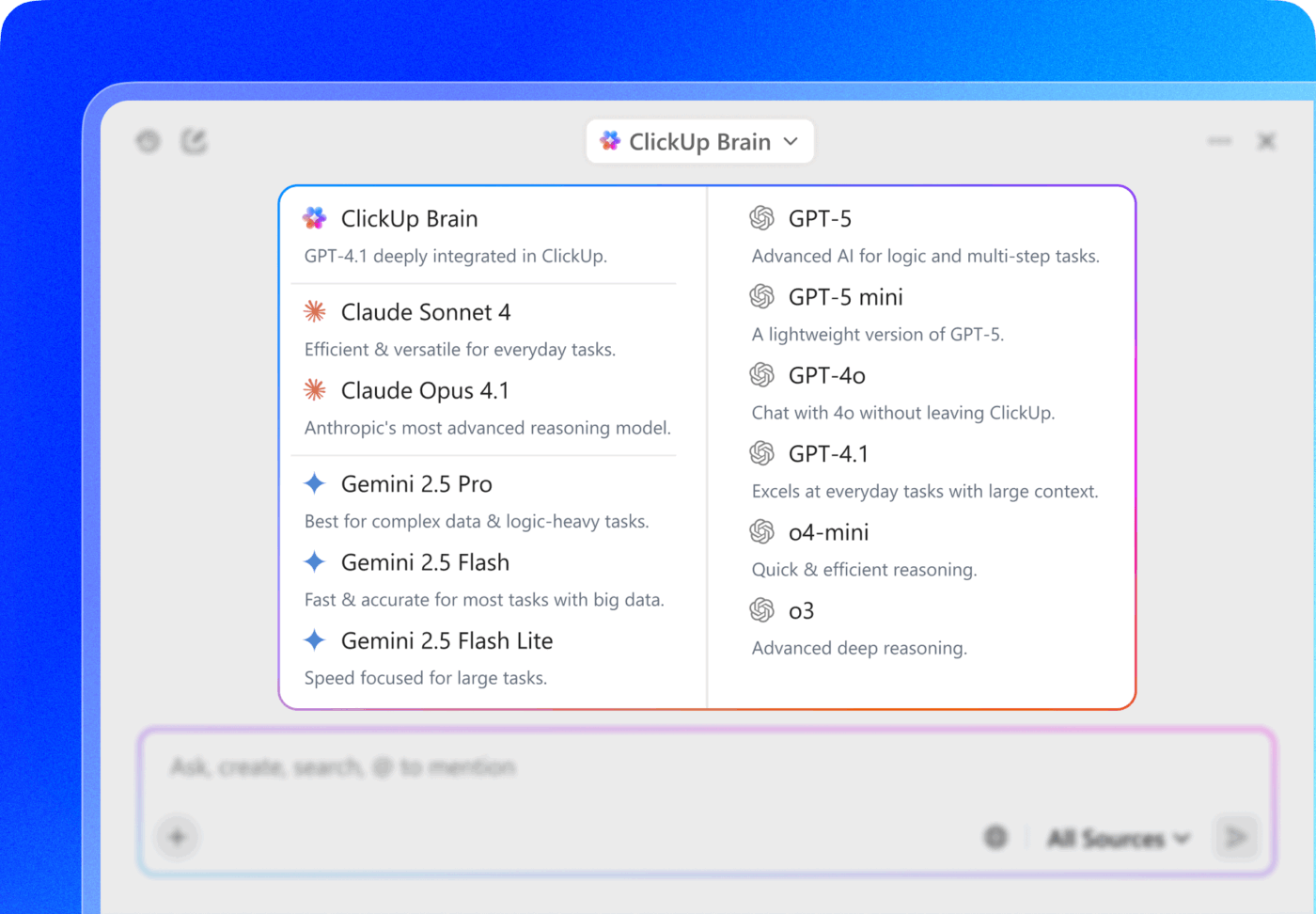

ClickUp Brainは、普段お使いのワークスペースにAIを直接組み込むことで、そうした煩わしさをすべて解消します。ツールを切り替えたり、作業の集中力を途切れさせたりすることなく、複数のAIモデルを活用したり、画像を生成したり、コードを記述・デバッグしたり、ウェブ検索を行ったり、ドキュメントを要約したりすることが可能です。

チームメンバーなら誰でも簡単に利用でき、身近なAIパートナーとして活用できます。

AIワークフローにおけるローカルAI利用の制限事項

ローカルAIは強力なツールですが、あらゆる問題に対する万能薬というわけではありません。その制約を理解することで、どのタスクを自社ハードウェアで処理し、どのタスクをクラウドで処理すべきかを判断できるようになります。チームによっては、技術的・経済的なトレードオフが、プライバシー上のメリットを上回る場合もあります。

- 性能の限界: オープンソースバージョンと比較して、最上位の独自開発モデルは、複雑な推論や創造的なニュアンスの表現において、依然としてわずかな優位性を保っています

- ハードウェアへの投資:大規模なモデルを高速に処理するには、大容量のVRAMを搭載した高価なGPUが必要です。小規模なチームにとっては、初期費用が高額になる可能性があります

- メンテナンスの負担: プロバイダーのサポートチームに頼ることなく、すべてのソフトウェアの更新、ハードウェアのトラブルシューティング、およびセキュリティパッチの適用を自ら行う必要があります。

- 技術的要件: ローカル環境を最適化するには、モデルの量子化やサーバー設定に関する実践的な知識が必要です

- セキュリティ管理: クラウドサービスとは異なり、ローカルモデルにはモデレーション機能が組み込まれていません。独自のコンテンツフィルターや安全対策を実装する必要があります。

- 消費電力: 自社のサーバーやワークステーションで大規模なAIモデルを実行すると、電力消費量や冷却ニーズが大幅に増加する可能性があります

多くのチームでは、機密性の高いデータにはローカルAIを、最大限の処理能力を必要とする機密性の低いタスクにはクラウドAIを活用するハイブリッドなアプローチを採用しています。以下に、両者の概要を簡単にまとめました:

| Factor | ローカルAI | クラウドAI |

|---|---|---|

| データプライバシー | 完全な制御 | プロバイダーに送信されるデータ |

| セットアップの複雑さ | Higher | 下へ |

| 継続的なコスト | ハードウェア + 電力 | トークンごとの料金 |

| モデルの機能 | 良好、改善中 | 最先端の |

| メンテナンス | セルフマネージド | プロバイダー管理型 |

ClickUpがAIを活用した安全なワークフローをどのようにサポートするか

今日の多くのチームは、強力なクラウドAIを利用するか(データの行方を懸念しつつ)、ローカルモデルを構築するか(継続的なオーバーヘッドに対処しつつ)というジレンマに直面しています。ClickUpは、業務が行われるシステム内にAIがすでに組み込まれている「統合型AIワークスペース」として機能することで、このジレンマを回避します。

ClickUp Brainは、ClickUpのワークスペースに直接組み込まれたAIレイヤーであり、タスク、ドキュメント、チーム間のコミュニケーションを1か所で把握できるように設計されています。コンテキストを完全に把握した上でAIによる支援を提供するため、別途ツールを導入したり、不安定な連携を行ったりする必要はありません。

安全なAIワークフローの構築を目指すチームにとって、コンテキストと制御のこの組み合わせこそが、単なる実験と本格的な導入を分ける鍵となります。

🌟 ClickUpはSOC 2に準拠しており、責任あるAI管理に関するISO 42001規格も遵守しています。これにより、お客様のデータがサードパーティのモデルトレーニングに使用されることは一切なく、オンプレミスセットアップと同様の安心感を持って仕事の自動化を進めることができます。

ClickUp Brainで検索機能と自律型ワークフローを活用しましょう

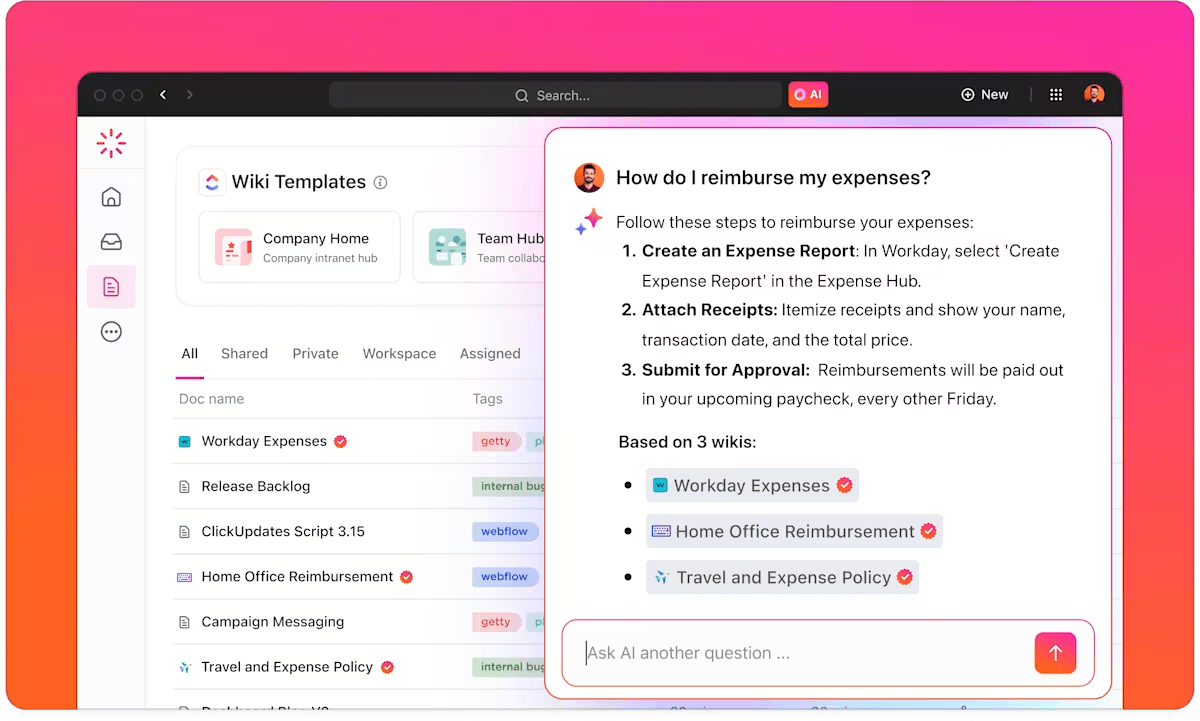

ワークスペース内でデータが保護されると、ClickUp Brainはタスクやドキュメントからリアルタイムで価値を抽出します。

AIが組み込まれているため、ローカル環境のセットアップを遅らせるコンテキストのギャップを回避できます。プロジェクトの履歴全体を把握する必要があるような質問でも、正確に回答してもらうことができます:

- 長い技術概要から最終的な決定事項を特定する――バージョンをスクロールして確認する必要はありません

- タスクへのコメントやステータスの変更から、ステークホルダー向け更新情報の草案を作成する

ClickUp Brainは、ドキュメント、タスク、チャット内の具体的なコンテンツを分析し、ワークスペースのデータに基づいた回答を生成します。これにより、プロジェクトが進化しても、AIは常に最新の状況を把握できるようになります。

これにより、プロジェクトの経緯を手動で説明し直したり、連携していないツール間でデータを移動させたりすることなく、チームは得られた知見を活かして業務を進めることができます。

💡プロのヒント:Enterprise AI Searchを活用して、すべての外部ツールから情報を取得することで、ワークスペースのコンテキストをさらに拡張できます。

例えば、「パイプライン内の未完了案件をすべて表示して」といった詳細な質問を投げかけると、ClickUp BrainはSlack、Google Drive、Gmailなどの接続アプリを横断的に検索し、出典を明記した信頼性の高い回答をリアルタイムで提供します。

これにより、複数のプラットフォームに分散したデータが、検索可能な単一のインテリジェンス層へと統合され、ワークスペースを離れることなく、あらゆるファイル、メッセージ、タスクを見つけることができます。

自動化とAIを活用してタスクをスマートに管理する

ClickUp Brainは、単に受動的に支援するだけでなく、タスク管理システム内で能動的に機能します。その機能は以下の通りです:

- ミーティングのメモやドキュメントからタスクを生成する

- 大規模な成果物をサブタスクに分割する

- 過去のアクティビティに基づいてタスクの所有者を提案する

- プロジェクトの状況を踏まえて、納期を提案する

また、タスクのステータスを更新したり、長いコメントスレッドを明確な次のステップに要約したり、実行の遅延につながる前に障害要因を特定したりすることも可能です。

ClickUp Automationと組み合わせることで、これは閉ループシステムとなります。AIは、ワークスペース内の変更に基づいて、タスクの割り当て、関係者への通知、優先度の更新などのワークフローをトリガーできます。

例えば、ドキュメントが完成すると、ツール間で手動でデータを移動させることなく、タスクが自動的に作成され、割り当てられます。

💟 特典:ClickUp Brain MAXを「意思決定の記憶」として活用しましょう。

活用方法:

- 長いコメントスレッドを要約し、明確な意思決定と次のステップに落とし込む

- 重要なマイルストーンの達成後、ドキュメントを「何が変更され、その理由」とともに更新する

- タスク、ミーティング、進捗報告から、毎週の意思決定ログを生成します

これにより、Brain MAXが参照できる組織の知見が蓄積されていきます。その結果、Brain MAXは単なるプロンプトへの応答にとどまらず、過去の意思決定、優先度、パターンを踏まえた上で応答するようになります。

そうして初めて、AIは「便利な存在」から「信頼できる存在」へと変わるのです。特に、コンテキストやトレーサビリティが重要なセキュリティのあるAIワークフローにおいてはなおさらです。

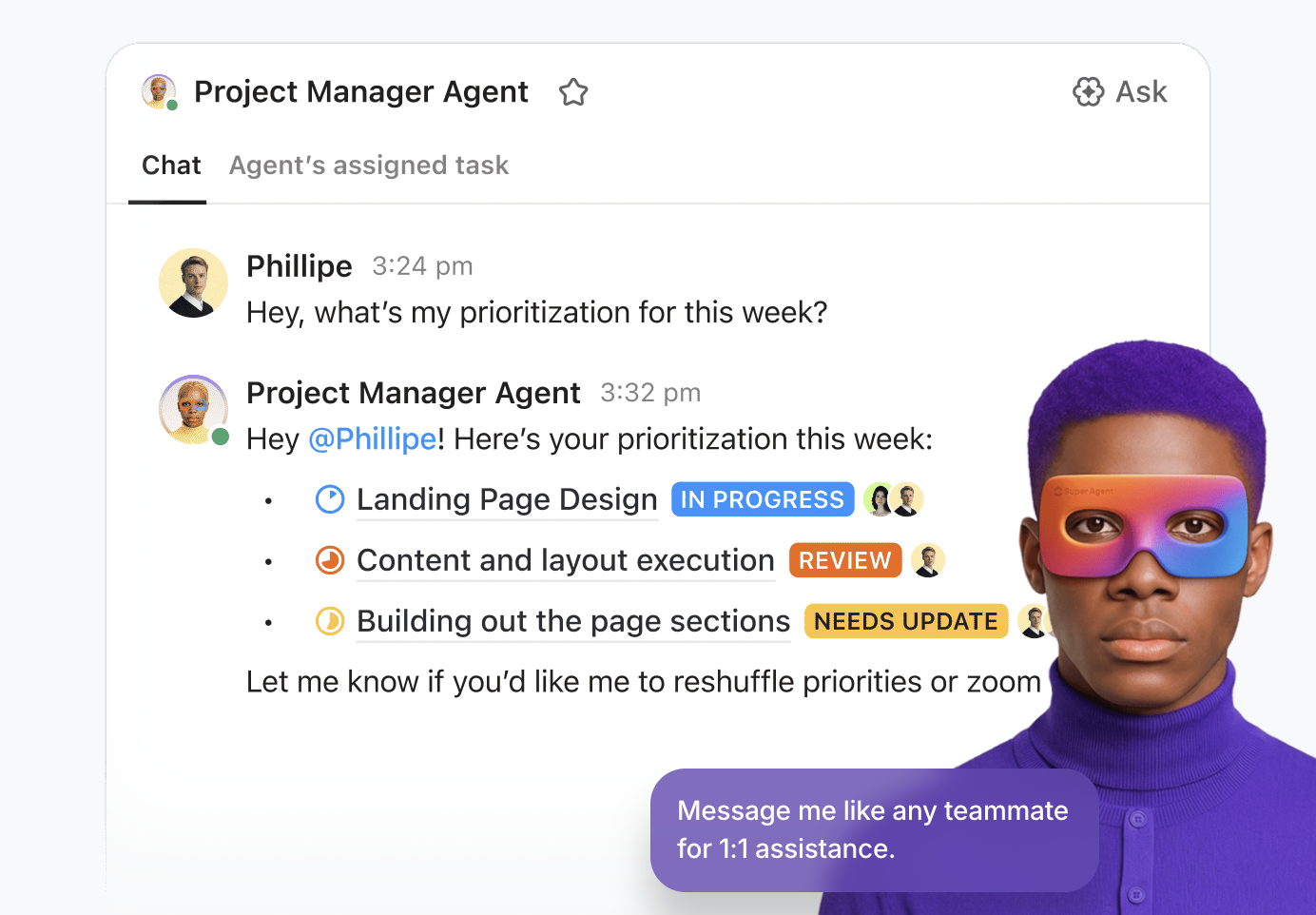

Super Agentsを活用して、大規模かつセキュリティを考慮したコンテキストに応じた実行を実現しましょう

ClickUpの「スーパーエージェント」は、ClickUp Brainの機能をさらに一歩進化させ、単なる作業の支援から、積極的に業務を推進する段階へと引き上げます。これらのエージェントは、あらかじめ定義されたルールやリアルタイムの状況に基づいて、ワークフローの監視、アクションの実行、ワークスペース全体でのタスクの調整を行うよう設定できます。

たとえば、Super Agentには次のような機能があります:

- 受信リクエストやドキュメントを監視し、所有者と期限を明記した構造化されたタスクに自動的に変換します

- プロジェクトの進捗状況を追跡し、リスクや遅延が深刻化する前に早期に特定する

- 条件が満たされた際に、ステークホルダーへの通知、優先度の更新、フォローアップタスクの作成など、多段階の自動化をトリガーします

これらのエージェントは、ClickUpの統合ワークスペース内で完全に動作し、タスク、ドキュメント、許可構造を完全に把握しています。つまり、

- データを外部のAIシステムやオーケストレーションツールにエクスポートする必要はありません

- アクセスできるのは、閲覧権限が与えられたデータのみです

- チームと同じ許可の範囲内で動作します

Super Agentsの活用について詳細はこちら:

ドキュメント内でのAIアシスタントを活用しましょう

ClickUp Docs を使えば、ドキュメント作成ワークフローに AI アシスタント機能が直接組み込まれます。チームは、プラットフォームを離れることなく、プロジェクト概要の作成、長文レポートの要約、アクション項目の抽出、あるいは対象読者に応じたコンテンツの書き換えを行うことができます。

これはセキュリティのあるAIワークフローにおいて重要なポイントです。なぜなら、機密情報を外部ツールにコピー&貼り付けすることこそが、最大のリスクの一つだからです。ClickUpでは、データの移動を最小限に抑え、許可設定を通じてアクセス権を完全に管理できます。

最終結論:プライベートAIスタックを構築する

ローカルAIは、データプライバシーとコンプライアンスを完全に管理しながら人工知能を活用します。しかし、このアプローチには、ハードウェア、技術的なセットアップ、および継続的なメンテナンスへの多額の投資が必要となります。

ローカルAIを使用する場合でもクラウドAIを使用する場合でも、セキュリティ対策は依然として極めて重要です。最も効果的な戦略は、多くの場合、ハイブリッドなアプローチを採用することです。つまり、機密性の高い業務にはローカルAIを活用し、日常的な生産性向上には管理された安全なソリューションを活用するという方法です。

トレードオフを考慮することは極めて重要です。多くのチームにとって、DIYソリューションに伴うオーバーヘッドは適切な選択ではないかもしれません。

インフラの負担なく強力なAIによる生産性を求める方にとって、ClickUp Brainのようなマネージドソリューションは魅力的な選択肢となります。セットアップの手間が一切かからず、企業レベルのセキュリティを提供します。

ClickUpを無料で始めて、チームのための安全で文脈に応じたAIを活用したワークフローを体験してください。

よくある質問

チームワークフローにおいて、ローカルAIとクラウドベースのAIにはどのような違いがあるのでしょうか?

ローカルAIは完全に自社ハードウェア上で動作するため、データが社内ネットワーク外に出ることはありません。一方、クラウドベースのAIは処理のためにサードパーティのサーバーにプロンプトを送信します。ローカルセットアップでは完全なデータ主権とオフラインアクセスが可能ですが、クラウドサービスは、データを直接制御できないという代償を払う代わりに、より高い計算能力と使いやすさを提供します。

チームは機密性の高いプロジェクトデータに対して、ローカルAIモデルをどのように活用できるでしょうか?

チームは、モデルをオンプレミスのプライベートディレクトリに指定することで、機密文書、独自開発コード、財務記録などをローカルAIで処理できます。推論がデバイス上で実行されるため、公開されているLLMのトレーニングデータセットにさらされるリスクを負うことなく、自動要約、データ抽出、社内ナレッジ検索などのタスクを実行できます。

仕事のタスクにおいて、ローカルAIモデルはChatGPTと同等の能力を持っているのでしょうか?

Llama 3やMistralといった多くのオープンソースのローカルモデルは、現在、起草、コーディング、要約といった日常的な仕事タスクを高度に処理できるようになっています。GPT-4oのような最先端のクラウドモデルが依然として極めて複雑な推論において優位性を保っている一方で、ローカルモデルは、日常的な仕事の90%において同等のパフォーマンスを発揮し、プライバシー保護の面でも格段に優れています。

AIをローカルで実行する場合とクラウドAIサービスを利用する場合、それぞれのメリットとデメリットは何でしょうか?

主なトレードオフは、ローカルAIによる完全なデータプライバシーと、クラウドAIのメンテナンス不要なスケーラビリティのどちらを選ぶかという点です。AIをローカルで実行するには、初期のハードウェア投資と技術的な専門知識が必要ですが、継続的なAPI利用料やデータ漏洩のリスクを排除できます。一方、クラウドAIは導入が迅速ですが、継続的なサブスクリプション費用やサードパーティのデータとの依存関係が生じます。