検索エンジンは常に情報を探す上で不可欠な存在でしたが、ユーザーの行動は進化しています。「スマートフォン」のような単純なキーワード検索ではなく、今では「ゲームに最適な低価格のスマートフォン」のような、より具体的でパーソナライズされたクエリが求められています。

一方、ChatGPTのような大規模言語モデル(LLM)は、インテリジェントな質問応答システムとして機能することで、検索を大きく変えています。

従来の検索エンジンと統合することで、検索結果の拡張生成(RAG)により情報検索が強化され、結果がより正確で文脈を意識したものになります。

LLMと検索エンジンは競合するのではなく、協力し合って複雑なクエリをより効果的に処理します。本記事では、この統合が検索の未来をどのように形作っているかを探ります。

⏰ 60秒でわかる要約

- 従来の検索エンジンは、大量のデータセットの管理、データ品質の維持、サイロの打破に苦労することが多い。

- また、セキュリティ、スケーラビリティ、文脈的に関連性の高い結果の提供に関する課題にも直面しています。

- ChatGPTのような大規模言語モデルは、検索精度を向上させ、意味検索を可能にし、自然言語クエリをサポートします。

- LLMはまた、マルチモーダル検索機能も向上させ、よりパーソナライズされた効率的な知識の発見を実現します。

- ClickUpの接続検索とAI機能は、これらの進歩を基に、お客様のデータを一元化することで、迅速かつ正確な情報検索を可能にします。

- ClickUpはさまざまなプラットフォームとシームレスに統合され、コンテンツへのリアルタイムアクセス、ワークフローの合理化、全体的な生産性の向上を実現します。

それでは、早速始めましょう!

LLMとは?

大規模言語モデル(LLM)は、人間の言語を処理し生成する高度な人工知能システムです。 広範なテキストデータセットで訓練され、翻訳、要約、会話などのタスクを処理する能力を備えています。

LLMの最も有名な例としては、複雑な言語関連のクエリを処理する能力で広く認知されているGPT-3やGPT-4などがあります。

キーワードに依存する従来の検索エンジンとは異なり、LLMベースの検索エンジンは表面的なクエリにとどまりません。質問の背景にある文脈や意図を理解し、直接的な詳細な回答を提供します。

👀 ご存知でしたか?71%のユーザーが、選択したブランドやビジネスからのパーソナライゼーションを好む。

LLM検索エンジンの機能

LLM検索エンジンは、インターネットユーザーが情報にアクセスし、情報をやり取りする方法を再定義する高度な機能を提供します。それでは、その鍵となる機能について見ていきましょう。

- 意味的なクエリ理解: LLM検索エンジンは、検索クエリに含まれるキーワードの意味を解釈し、ユーザーの意図や文脈を理解します。

- 自然言語処理(NLP):ユーザーは正確なキーワードを入力しなくても、会話形式でクエリを作成でき、より直感的な検索が可能になります。

- 文脈上の関連性: 検索結果は、過去のクエリややり取りに基づいてパーソナライズされ、より関連性が高く、最新の情報が保証されます。

- 回答の生成:これらのシステムは、要約、説明、さらにはストーリーやステップバイステップガイドのようなクリエイティブなフォーマットも含む包括的な回答を、検索結果内に直接提供します。

- 知識グラフの統合:LLM検索エンジンは、知識グラフを使用して関連する概念とエンティティを接続し、より深い洞察を提供します。

- 会話型検索:ユーザーは、よりインタラクティブな体験を得るために、フォローアップの質問をしたり、検索を絞り込んだりしながら、双方向の対話をすることができます。

- 適応型結果: 場所、興味、過去の検索履歴に基づいて結果が動的に調整され、よりパーソナライズされた体験を提供します。

- 情報統合:LLM検索エンジンは、単一のソースに頼るのではなく、複数のソースからデータを集約し、より幅広い視点を提供します。

👀 ご存知でしたか? スマートスピーカーや音声アシスタントの使用が増えるにつれ、検索全体の50%が音声によるものとなっています。 大規模な言語モデルがこれらのシステムに統合されることで、音声検索はさらに正確になり、ファイル、タスク、ミーティングメモなど、複数のプラットフォームにわたる情報へのアクセスがより迅速になります。

LLMによる高度な検索テクニック

検索テクノロジーが進化するにつれ、GPT-4、BERT、T5などのLLMが、検索エンジンによるクエリの処理、結果のパーソナライズ、ランキングの改善の方法を変化させています。これらのモデルが検索の未来をどのように再定義しているのかを見ていきましょう。

LLMが検索クエリを送信する方法

検索は、単純なキーワードクエリから意味ベクトル検索へと進化しました。「富士山」のような特定の用語を検索する代わりに、ユーザーは「日本の山々」と検索することができ、システムは意味に基づく結果を返します。

クエリを質問に言い換えることで、検索精度が向上します。例えば、「日本の有名な山は?」のような質問です。また、LLM(大規模言語モデル)は、FLAREのような技術を使用して信頼度が低い場合は追加のクエリをトリガーすることで、検索を強化します。

AutoGPTに見られるように、思考の連鎖を基にした推論により、タスクを論理的なステップに分割することで、検索がさらに改善されます。さらに、会話型検索により、LLMを搭載したアシスタントはリアルタイムでクエリを絞り込むことができ、やり取り全体を通じてより正確な結果を保証します。

パーソナライズされた検索と文脈の認識

文脈認識は、LLMの最も強力な機能の1つです。キーワードの一致度によって結果をランク付けする従来の検索エンジンとは異なり、LLMはユーザーの意図、場所、検索履歴、過去のやり取りを考慮します。

ドメイン固有のデータで微調整を行うことで、LLMは検索結果をパーソナライズし、パターンを認識して関連性の高いコンテンツを優先します。例えば、ビーガンレシピを頻繁に検索するユーザーは、「最高のディナーレシピ」を検索する際に、植物由来のオプションが表示されます。

LLMはまた、マルチモーダルクエリを解釈し、テキストと画像の両方を理解することで、より正確な結果を提供します。さらに、進行中のやり取りから学習し、関連性の高いクエリを積極的に提案するために、長期的な文脈を構築します。

検索結果の再ランク付けと改善を行うLLM

LLMは、ユーザーの意図をより正確に反映させるために結果を動的に再ランク付けすることで、検索エンジンを強化します。従来のキーワードベースのランキングとは異なり、LLMはアテンションメカニズムを使用してクエリのコンテキスト全体を分析し、関連性の高いコンテンツを優先します。

例えば、GoogleのBERT(Bidirectional Encoder Representations from Transformers)のアップデートは、「apple」(果物)と「Apple」(テクノロジー企業)という単語の背景にある文脈を理解することで、検索に革命をもたらしました。

LLMはまた、SERP(検索エンジン結果ページ)の効率性向上にも貢献します。CTR(クリック・スルー・レート)、直帰率、滞在時間などの要因を分析することで、LLMはリアルタイムでランキングを調整し、ユーザーエンゲージメントの高い結果を向上させることができます。

📖 こちらもどうぞ:PDFファイルを素早く検索する方法

人気のLLM検索エンジンツール

AI駆動型検索が進化するにつれ、いくつかの大規模な言語モデル検索エンジンが、その高度な機能により注目を集めています。Perplexity AIは、引用元とともに直接的な回答を提供し、検索をよりインタラクティブで有益なものにします。

You.comは、ユーザーがソースを優先順位付けし、AIが生成した要約を統合し、AIアシスタントと対話できる、カスタマイズ可能な体験を提供しています。

私たちは皆、情報を検索して素早く回答を得るために、これらの検索エンジンを利用できることは知っています。しかし、仕事で重要な1つのファイルの場所を探す場合はどうでしょうか?あるいは、次の重要なプレゼンテーションのためのデータポイントが満載の会話を見つける場合はどうでしょうか?

ここで、仕事のためのすべてが詰まったアプリであるClickUpが登場します!

📮 ClickUp Insight: 46%のナレッジワーカーは、仕事内容を追跡するだけでも、チャット、メモ、プロジェクト管理ツール、チームドキュメントを組み合わせて使用しています。 彼らにとって、仕事は接続されていないプラットフォームに分散しており、整理するのが難しくなっています。仕事のためのすべてを備えたアプリであるClickUpは、それらすべてを統合します。ClickUp電子メールプロジェクト管理、ClickUpメモ、ClickUpチャット、ClickUp Brainなどの機能により、すべての仕事が1か所に集約され、検索可能で、シームレスに接続されます。ツールの過剰使用にさよならを告げ、楽な生産性を歓迎しましょう。

ClickUp Brainは、高度な検索機能と包括的なプロジェクト管理機能を組み合わせ、タスク、ファイル、チームメンバー、プロジェクトをすべて1か所で接続します。 もうアプリを切り替えたり、断片的なツールや情報サイロを扱う必要はありません!

連携していないツールによる非効率性のコストは膨大です。

- 2. 5時間/日:ナレッジワーカーは、1日の仕事の約30%を情報検索に費やしている。

- 1日あたり3,600回のアプリ切り替え:従業員は1日に3,600回以上アプリとウィンドウを切り替えており、週に4時間、再調整に時間を費やしている。

- 23分間のロス:アプリを切り替えるたびに集中力が途切れ、元の作業に戻れるようになるまで約23分かかる

年間42万ドル:従業員100人の組織では、コミュニケーションのミスやツールの非連携により、毎年この額の損失が発生しています。

このような非効率性は、時間のロス、士気の低下、運用コストの増加につながります。幸いにも、Connected AIは、より賢明な意思決定、より迅速な情報検索、シームレスな実行を可能にする機会へと、これらの課題を変えることができます。

ClickUpの接続検索がコラボレーションをどのように変えるかを見てみましょう。

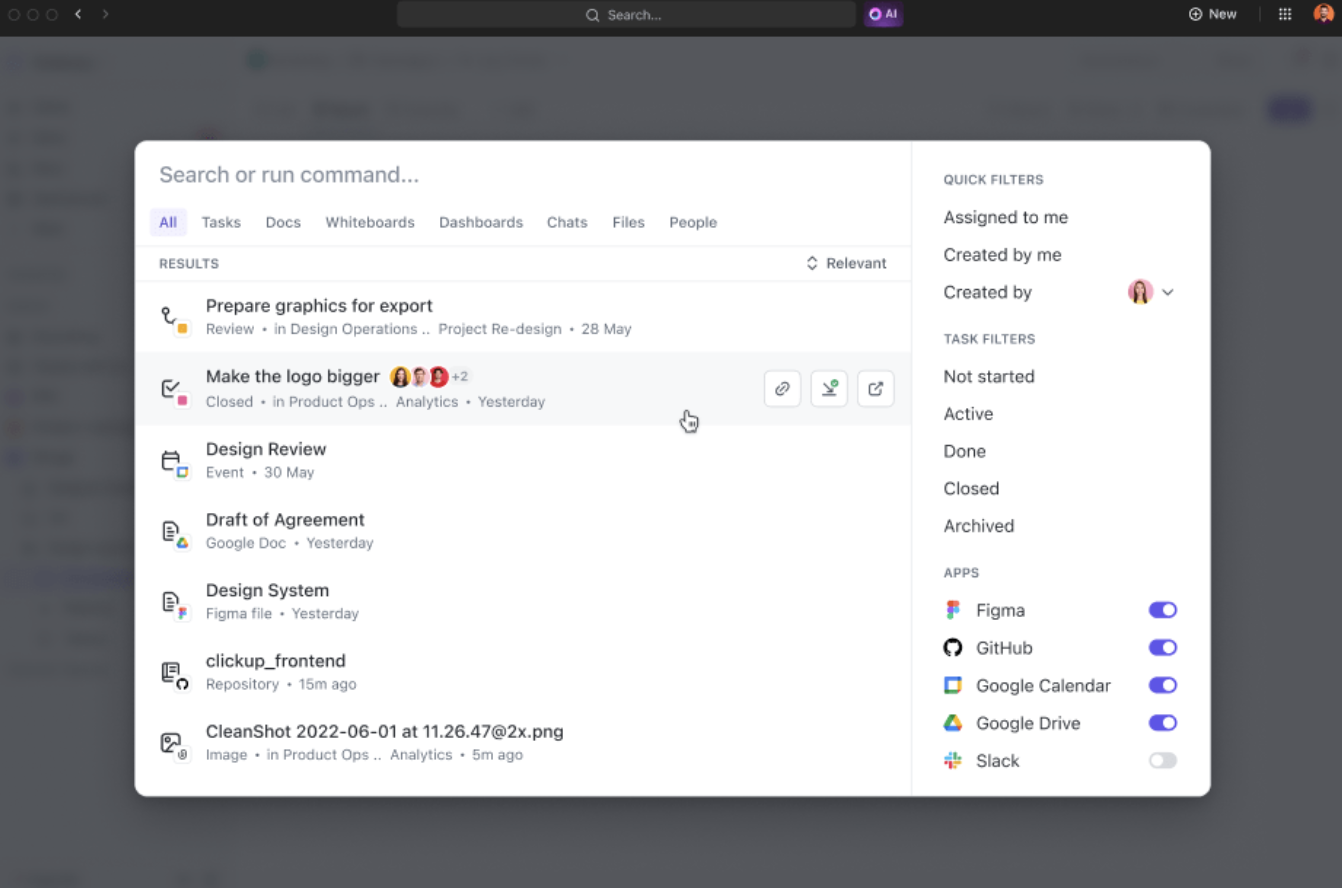

- 統合検索:単一のプラットフォームからすべての企業情報にアクセスし、アプリの切り替えを減らすことで、週あたり約4時間を節約

- AIによる関連性*:プロジェクトに合わせた、文脈を理解したパーソナライズされた検索結果が得られ、最も関連性の高い洞察に即座にアクセスできることで、意思決定が改善されます。

- 手間いらずのツール統合:Google Drive、SharePoint、Figma、Slackなどの既存のツールとシームレスに接続でき、複雑なセットアップは不要です。

例えば、休暇から戻った際に、ClickUp Brainにプロジェクトの最新情報を尋ねてみましょう。ClickUp Brainは、あなたが不在中に発生した重要なアクションアイテムや議論を、きれいに整理された箇条書きで提供します。

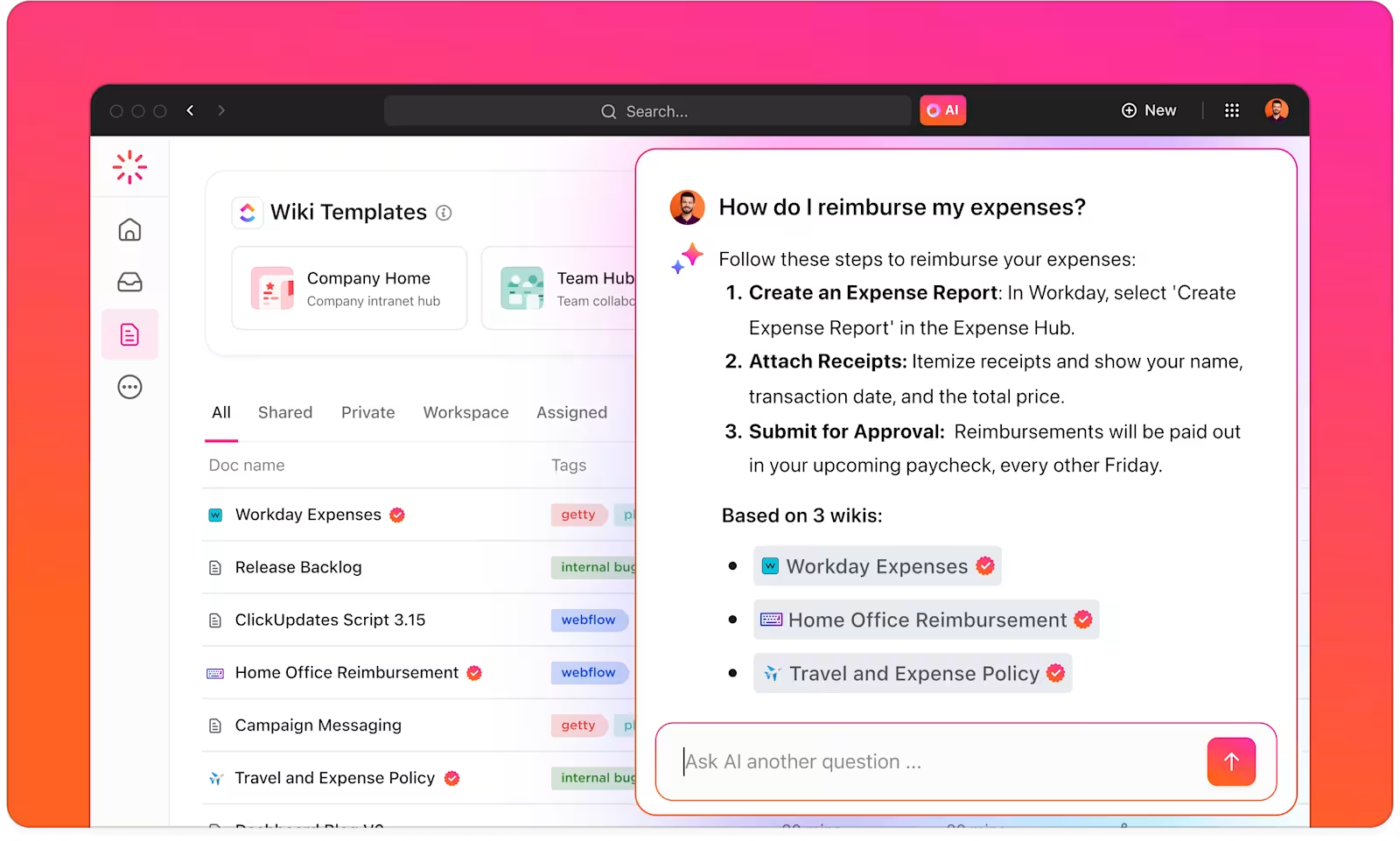

ClickUp Brainは、作業スペースと接続されたアプリ内のすべてを見つけるのに役立つインテリジェントなナレッジマネージャーです。

ClickUp Brainは、タスクのコンテキストを理解し、仕事の好みや主な活動に基づいて関連性の高い提案を行います。例えば、コンテンツ作成者に対しては、コンテンツ作成、ブレインストーミング、関連タスクに関する提案を行います。

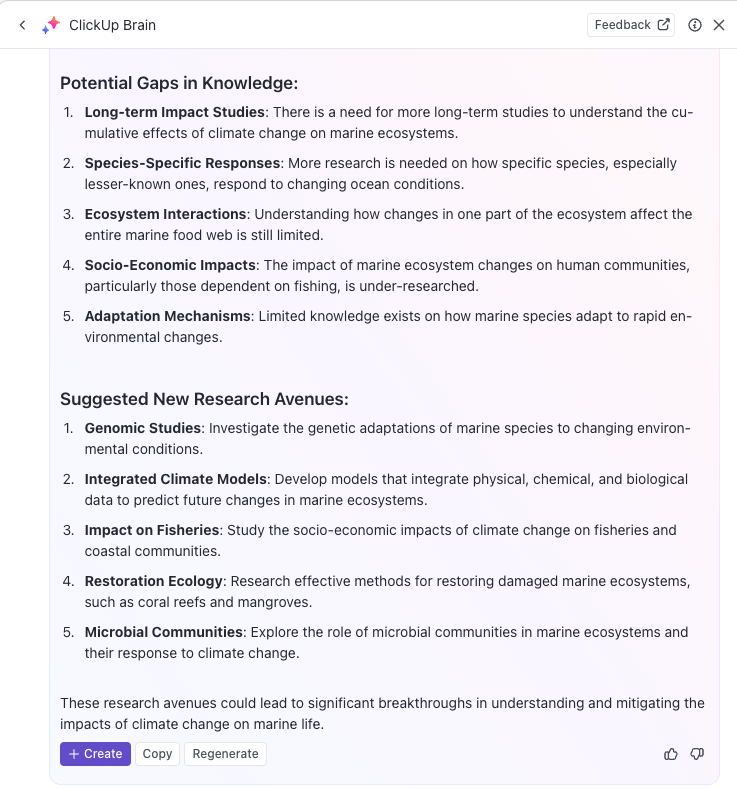

AIを使用して反復的なタスクを自動化したり、簡単なプロンプトでタスクのステータスを更新したりすることもでき、より深い仕事に集中することができます。生産性を向上させる強力なAI検索エンジンをお探しなら、ClickUp Brainが最適です。

ClickUp Brain を使用すると、関連するすべての情報を自動的に分類、タグ付け、整理することで、ナレッジベースを最適化できます。

例えば、研究チームはClickUpを使用して、すべての洞察、文書、研究結果を簡単にアクセスできるフォーマットで保存する集中型ナレッジマネジメントシステムを作成することができます。

さらに、ClickUpドキュメントの多機能性は、wiki、ドキュメントリポジトリ、および知識関連のタスク管理の作成をサポートします。

また、ClickUpのスペース、フォルダ、リストを使用してコンテンツを構造化し、素早く検索できるように情報をさまざまな方法で整理することもできます。 チームは、複数のプラットフォームを検索して時間を無駄にすることなく、必要なときに適切なデータを見つけ、簡単にアクセスすることができます。

さらに、LLM検索エンジンから得られた洞察に基づいて、ClickUpタスクを使用してタスクやプロジェクトの追跡を支援するプラットフォームです。AI搭載の検索結果を直接タスクやプロジェクトの追跡ワークフローに統合できるため、発見した知識を簡単に実装できます。

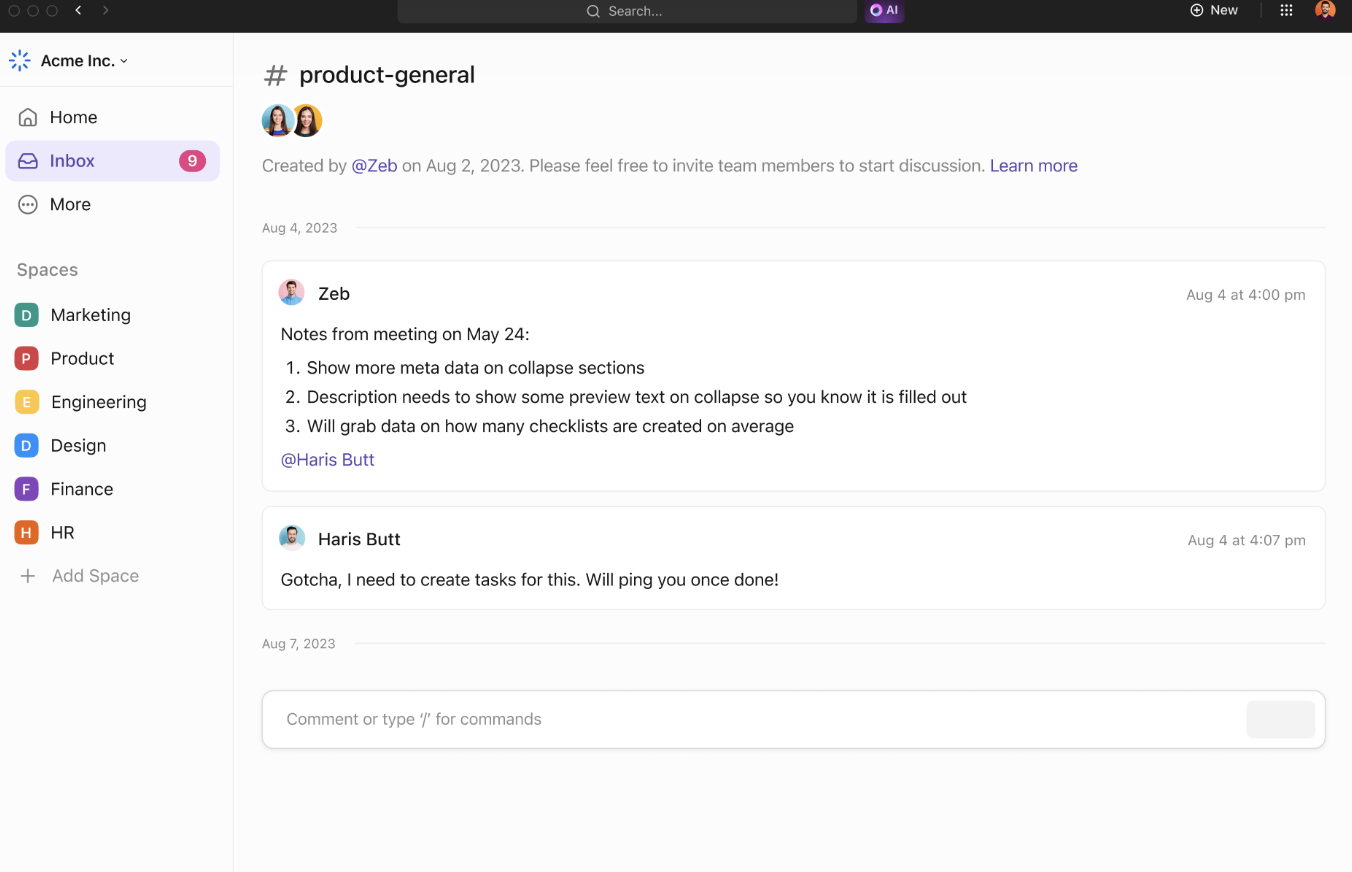

ClickUpのコラボレーションツールは、チームの効率性と情報共有をさらにサポートします。ClickUpチャットでは、チームメンバーがプロジェクトについて話し合ったり、洞察を共有したり、質問をしたりすることができます。

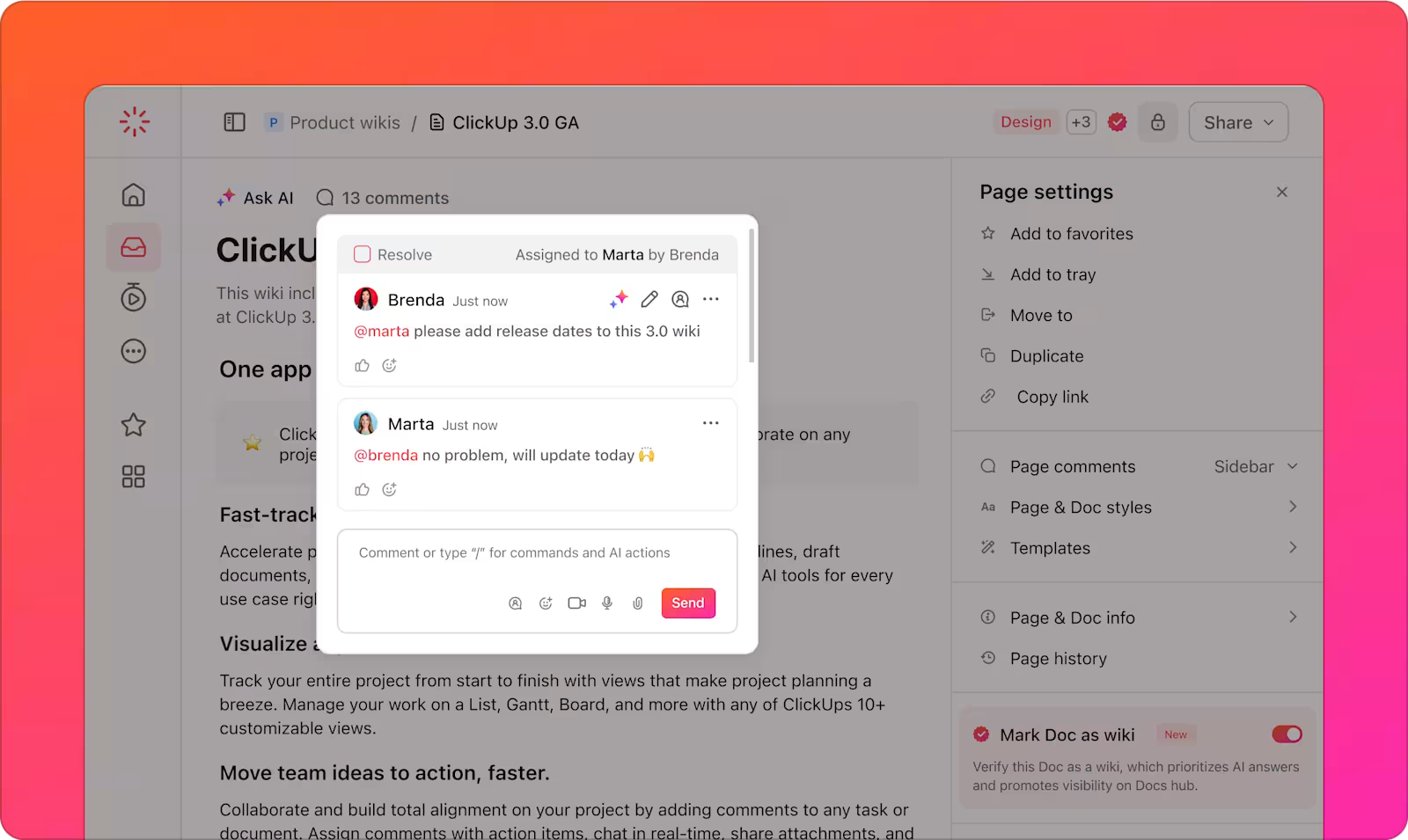

割り当てられたコメントは、特定のドキュメントやタスクに関するコミュニケーションを明確にする方法を提供し、プロジェクトの最新情報を全員が把握できるようにします。

チームはアイデアを共有し、コンセプトを視覚化することでコラボレーションできます。メモを追加したり、画像をアップロードしたり、リンクを埋め込んで、より適切なコンテクストを提供できます。コネクタを使用してアイデアをリンクし、それらの関係を強調表示できます。

アイデアがまとまったら、ClickUpホワイトボードから追跡可能なタスクに変換し、すべてをスケジュール通りに進めましょう。

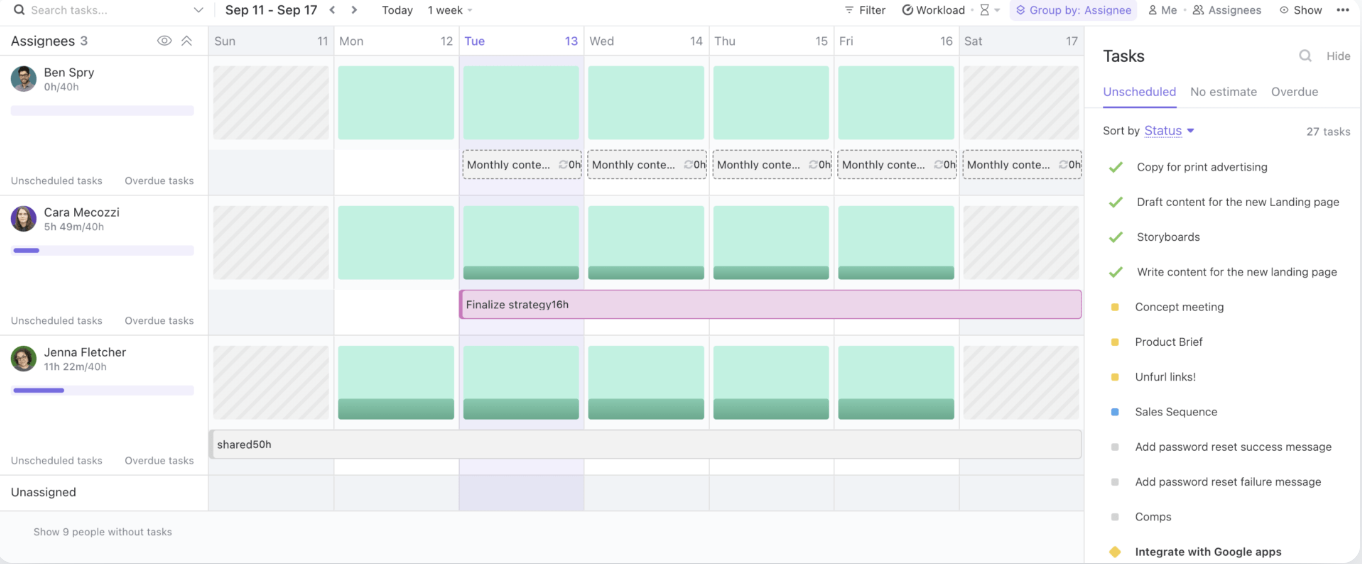

最後に、ClickUpのワークロードビューでは、チームのキャパシティ管理、進行中のタスクの追跡、リソースの効率的な割り当てが可能です。

知識の共有とコラボレーションのための集中ハブを提供することで、ClickUpはワークフローを合理化し、チームの効率を向上させます。

📖 こちらもどうぞ:整理整頓に最適な文書管理ソフトウェア

LLM検索エンジンの使用におけるベストプラクティス

LLM検索エンジンを使用する際には、リスクを管理しながらその潜在能力を最大限に引き出すベストプラクティスに従うことが不可欠です。

これらの戦略は、AI搭載ツールを最大限に活用し、スムーズな導入と長期的な成功を確実にするのに役立ちます。

- 明確なユースケースを定義する:ビジネスチームと技術チームが早期に協力し、具体的で測定可能なユースケースを確立する。 ソリューションが適切なニーズを満たし、進捗状況を簡単に評価できるように、目的を一致させる。

- 慎重な取り込みプロセスを確立する:ユースケースの優先順位付けを行う際には、データの機密性、潜在的なリスク、想定されるユーザーを考慮する。リスクのレベルに応じたアプローチを使用して、最小限のリスクで最大の価値をもたらすプロジェクトを評価する。

- データ収集、テスト、検証に重点を置く:収集、ラベル付け、ストレージ、処理の方法を改善することで、事実に基づく確かなデータを確保する

- 標準化されたテスト手順を実施する:プレイブックと事前定義された手順でサポートされた再現可能なテストプロセスを作成する。展開前に、一貫した結果、システムの信頼性、十分にテストされたAIモデルを確保する。

- 継続的なモニタリングの設定: 変化するデータ、ユーザーの行動、テクノロジーに適応しながら、システムのパフォーマンスを長期間にわたってモニタリングします。

- トレーニングとコミュニケーションキャンペーンを実施:AIツールを責任を持って効果的に使用するための知識をチームに提供します。AIの技術的側面と倫理的側面の両方をカバーするトレーニングとコミュニケーションプログラムを開始します。

LLM主導の検索における課題とソリューション

LLM駆動型検索エンジンは大きな可能性を秘めていますが、それには独自の課題も伴います。以下に、AIの一般的な課題と、それらを克服するための実用的なソリューションをいくつかご紹介します。

データの品質と関連性

LLM駆動型の検索エンジンは、処理するデータの質と関連性に大きく依存しています。質の悪いデータや古いデータは、不正確な結果や関連性の低い結果につながり、ユーザーエクスペリエンスに影響を及ぼす可能性があります。

✨ 高品質で最新の情報に焦点を当てることで、組織はLLM搭載の検索エンジンが関連性が高く信頼性の高い結果を返すことを保証できます。

透明性の欠如

LLMモデルはしばしば「ブラックボックス」とみなされ、その出力の根拠がユーザーに即座に明らかになることはありません。この透明性の欠如により、ユーザーは受け取った結果を信頼することが難しくなります。

検索エンジンに説明機能の機能を組み込むことで、組織はユーザーに特定の結果が返された理由を説明することができます。

偏見と倫理的な懸念

LLMは、学習に使用されたデータからバイアスを継承することがあり、その結果、偏った、または非倫理的な結果につながる可能性があります。学習データが多様でなく、また代表的なものでない場合、検索エンジンはこれらのバイアスを反映し、意思決定や公平性に影響を与える可能性があります。

✨ トレーニングデータの定期的な監査と更新は、こうしたバイアスを特定し、軽減するために不可欠です。さらに、多様なデータセットを取り入れ、出力を監視することで、検索エンジンがよりバランスの取れた、公平で倫理的な結果を生成することが保証されます。

システムの複雑性と統合

LLM駆動型の検索エンジンを既存のワークフローやアプリケーションと統合することは、主にレガシーシステムや複数のデータソースを扱う場合、困難を伴う可能性があります。これらの新しいツールを確立されたプラットフォームに接続する複雑性は、実装を遅らせる可能性があります。

ClickUpのConnected Searchを使えば、ClickUp、接続されたアプリ、ローカルドライブのどこに保存されているファイルでも、素早く見つけることができます。

幻覚の問題

幻覚とは、モデルが事実と異なる、でっちあげの、または無関係な情報を生成するインスタンスを指します。これは、モデルがインデックス化されたソースから直接情報を取得するのではなく、トレーニング中に学習したパターンに基づいてデータを「幻覚」することがあるためです。

✨プロンプトエンジニアリングや高品質なトレーニングデータなどの高度な技術により、LLMの信頼性が向上します。 ドメイン固有のデータで微調整を行うことで幻覚が減少し、ナレッジグラフの統合により事実に基づく正確な検索結果が保証されます。

📖 こちらもご一読ください:生産性を最大限に高めるコラボレーション作業スペースの作り方

LLMによる検索の未来

LLM駆動型次世代検索は、特に複雑かつ動的なユーザークエリへの対応において、さらに高い精度、適応性、応答性を実現します。これらのシステムは、進化するユーザーニーズに動的に適応し、過去のやり取りやリアルタイムのデータから学習します。

例えば、企業設定では、LLMは「前四半期の顧客離反分析を見つける」といったリクエストを解釈し、生のファイルだけでなく、統合された洞察、関連する傾向、実行可能な成果を返すことができます。

膨大かつ複雑なデータセットの管理に依存している業界が最も大きな利益を得られるでしょう。

- 医療分野では、大規模言語モデルが臨床メモ、画像診断結果、研究論文を数秒で分析および相互参照することで、診断精度のサポートが可能です。

- 法律の専門家は、膨大な判例を解析し、関連する判例をハイライトするツールを活用することができます。

- 財務チームは、リアルタイムの不正検出、予測市場分析、コンプライアンスチェックの自動化などのタスクにLLMを使用できます。

テキスト、音声、画像認識を組み合わせたマルチモーダル検索機能の統合により、LLMの有用性はさらに拡大するでしょう。

例えば、新製品発表に携わるチームが、画像を即座にアップロードし、音声入力で注釈を付け、関連文書やレポート作成に活用するといったことが可能です。このような適応性の高さにより、LLMは多様なデータフォーマットへのシームレスなアクセスを確保する上で不可欠なものとなっています。

LLMを搭載した検索と組み合わせたClickUpのようなプラットフォームは、ファイルの整理とアクセス、ワークフローの最適化、意思決定の効率化を実現する強力なソリューションを提供します。

LLM搭載の検索機能でワークフローを強化

LLMを搭載したAI駆動型検索エンジンは進化を続けており、ビジネスにおけるウェブページからの情報取得やデータ管理の方法に革命をもたらしています。

文脈を理解し、より正確な結果を提供し、企業のワークフローにシームレスに統合できるLLMは、よりスマートで迅速かつ効率的な業務の実現に道を開いています。

そして、ワークフローにシームレスに統合されたAI検索エンジンを見つけるなら、ClickUp Brainに勝るものはありません。ファイルやタスクの場所を素早く見つけたり、アイデアをブレインストーミングしたり、電子メールの下書きを作成したりする必要がある場合でも、ClickUp Brainの強力なAI機能がすべて処理できます。

ClickUpの包括的なプロジェクト管理ツールと統合することで、すべてが手の届く範囲に確保され、整理された状態を維持し、時間を節約し、データに基づく意思決定をより迅速に行うことができます。

さあ、何を待っているのですか?今すぐClickUpに登録して、ClickUpBrainでより多くの仕事を完了させましょう!