¿Alguna vez su modelo de IA ha dado una respuesta segura que sus usuarios han considerado obsoleta? Ese es el tipo de experiencia que hace que su equipo cuestione cada una de sus respuestas.

Parece la pesadilla de cualquier desarrollador y entusiasta de la IA, ¿verdad?

Los modelos de lenguaje grandes (LLM) funcionan con datos de entrenamiento, pero a medida que los datos envejecen, se cuelan imprecisiones. Dado que el reentrenamiento cuesta millones, la optimización es la opción más inteligente.

La generación aumentada por recuperación (RAG) y el ajuste fino son los principales marcos para aumentar la precisión. Sin embargo, dadas las diferencias entre cada enfoque, son ideales para diferentes aplicaciones. El marco adecuado es clave para mejorar su LLM de manera eficaz.

Pero, ¿cuál es el adecuado para usted?

Este artículo aborda el dilema en esta guía sobre RAG frente a ajuste fino. Tanto si realiza el trabajo con datos específicos de un dominio como si busca crear soluciones de recuperación de datos de alta calidad, ¡aquí encontrará las respuestas!

⏰Resumen de 60 segundos

- Mejorar el rendimiento de los LLM y los modelos de IA es una parte clave de todas las funciones empresariales y de desarrollo. Aunque RAG y el ajuste fino son enfoques populares, es importante comprender sus matices y su impacto.

- RAG dota a los LLM de recuperación de datos externos en tiempo real, lo que reduce los costes de reentrenamiento.

- El ajuste fino optimiza los LLM mediante el entrenamiento con conjuntos de datos especializados, lo que mejora la precisión para tareas específicas de cada dominio.

- RAG es la mejor opción para entornos de datos que cambian rápidamente, como las finanzas, las actualizaciones legales y el soporte al cliente.

- El ajuste fino es ideal para la IA específica de una marca, los sectores con estrictas normas de cumplimiento y el análisis de opiniones.

- ClickUp Brain combina ambos, utilizando RAG para obtener información contextual y el ajuste fino para la automatización personalizada y la generación de contenido.

- Las herramientas basadas en IA de ClickUp potencian la recuperación de conocimientos, la automatización de flujos de trabajo y la gestión de proyectos para alcanzar la máxima eficiencia.

¿Qué es la generación aumentada por recuperación (RAG)?

¿Está analizando informes y encuestas recientes que su LLM no ha tenido en cuenta? Ahí es donde necesita RAG. Para comprenderlo mejor, veamos los fundamentos de este enfoque.

Definición de RAG

RAG es un marco de IA que implica la recuperación de información adicional para su LLM con el fin de mejorar la precisión de las respuestas. Antes de generar la respuesta del LLM, extrae los datos más relevantes de fuentes externas, como fuentes de conocimiento o bases de datos.

Piense en ello como el asistente de investigación dentro del LLM o el modelo de IA generativa.

👀 ¿Sabías que...? Los LLM, especialmente los generadores de texto, pueden generar información falsa pero plausible. Todo ello debido a las lagunas en los datos de entrenamiento.

Ventajas clave de RAG

Probablemente ya lo tenga claro. RAG es una capa adicional de IA conectada que necesita su proceso empresarial. Para destacar su potencial, estas son las ventajas que ofrece:

- Reducción de los costes de formación: elimina la necesidad de volver a entrenar el modelo con frecuencia gracias a su recuperación dinámica de información. Esto conduce a una implementación de la IA más rentable, especialmente en ámbitos con datos que cambian rápidamente.

- Escalabilidad: amplía los conocimientos del LLM sin aumentar el tamaño del sistema principal. Ayudan a las empresas a escalar, gestionar grandes conjuntos de datos y ejecutar más consultas sin altos costes informáticos.

- Actualizaciones en tiempo real: refleja la información más reciente en cada respuesta y mantiene la relevancia del modelo. Dar prioridad a la precisión mediante actualizaciones en tiempo real es fundamental en muchas operaciones, como el análisis financiero, la asistencia sanitaria y las auditorías de cumplimiento normativo.

📮 ClickUp Insight: La mitad de nuestros encuestados tiene dificultades para adoptar la IA; el 23 % simplemente no sabe por dónde empezar, mientras que el 27 % necesita más formación para realizar tareas avanzadas.

ClickUp resuelve este problema con una interfaz de chat familiar que se parece mucho a los mensajes de texto. Los equipos pueden empezar directamente con preguntas y solicitudes sencillas y, a medida que avanzan, descubrir de forma natural funciones de automatización y flujos de trabajo más potentes, sin la intimidante curva de aprendizaje que frena a tanta gente.

Casos de uso de RAG

¿Se pregunta dónde destaca RAG? Considere estos casos de uso clave:

Chatbots y soporte al cliente

Las consultas de los clientes suelen requerir respuestas actualizadas y sensibles al contexto. RAG mejora las capacidades del chatbot al recuperar los últimos artículos de soporte, políticas y pasos para la resolución de problemas.

Esto permite una asistencia más precisa y en tiempo real sin necesidad de un entrenamiento previo exhaustivo.

Recuperación dinámica de documentos

RAG optimiza la búsqueda de documentos extrayendo las secciones más relevantes de vastos repositorios. En lugar de resúmenes genéricos, los LLM pueden proporcionar respuestas precisas a partir de manuales actualizados, trabajos de investigación o documentos legales.

La adopción de LLM con tecnología RAG hace que la recuperación de información sea más rápida y precisa.

🧠 Dato curioso: Meta, propietaria de Facebook, Instagram, Threads y WhatsApp, introdujo RAG en el desarrollo de LLM en 2020.

¿Qué es el ajuste fino?

Veamos qué hace el ajuste fino.

Definición de ajuste fino

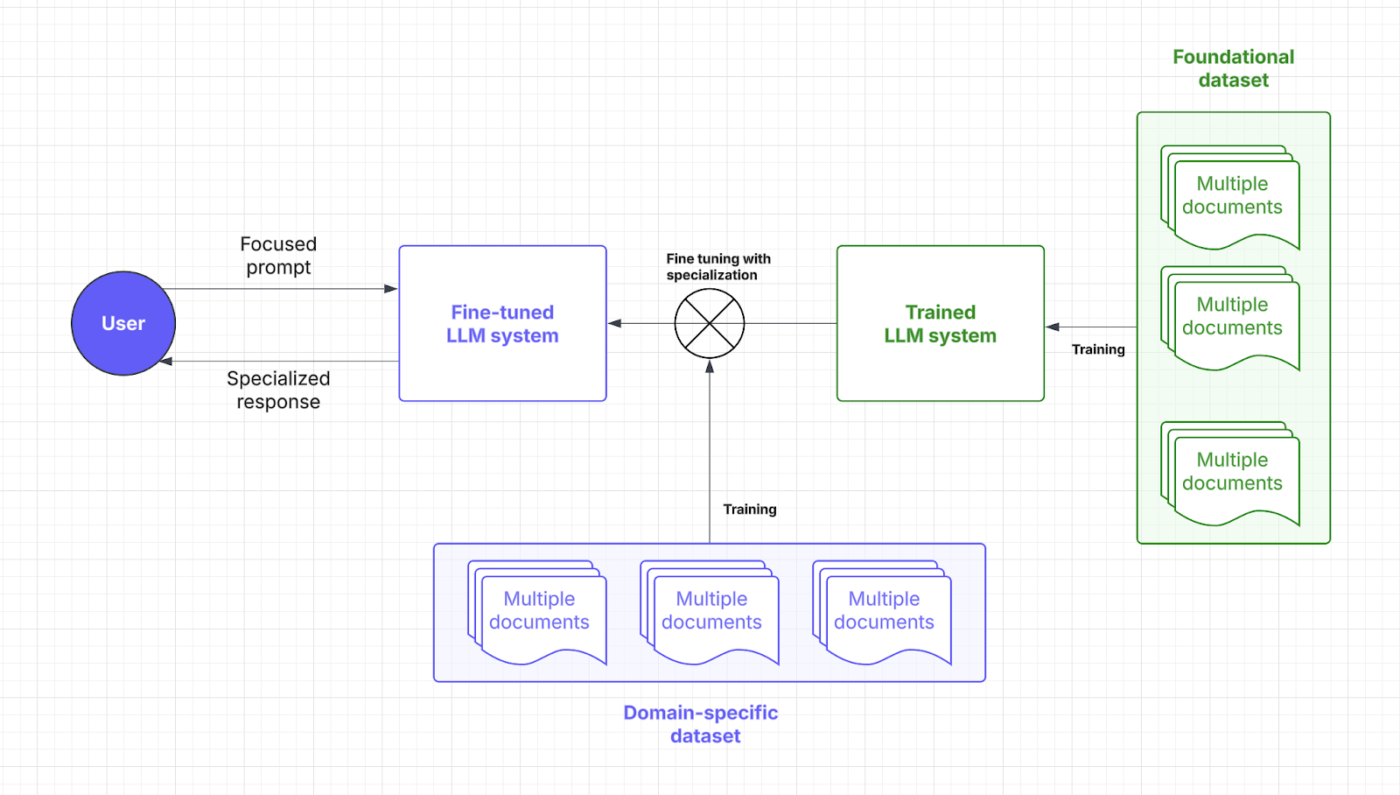

El ajuste fino implica entrenar un modelo de lenguaje preentrenado. Sí, mucho entrenamiento, lo que se puede explicar mediante puntos y enfoques.

🧠 ¿Sabías que: En el entrenamiento de modelos de lenguaje grandes (LLM), los «pesos» son los parámetros ajustables dentro de la red neuronal que determinan la fuerza de las conexiones entre las neuronas, almacenando esencialmente la información aprendida; el proceso de entrenamiento optimiza estos pesos para minimizar los errores de predicción.

Por otro lado, el «enfoque» abarca varios aspectos: implica una cuidadosa curación de datos para garantizar la calidad y la relevancia, la utilización de mecanismos de atención para priorizar los segmentos de entrada relevantes y el ajuste fino específico como objetivo para especializar el modelo en tareas concretas.

A través de conjuntos de datos especializados, el ajuste fino permite a los modelos de IA centrarse en la ejecución de tareas específicas de un dominio. Al ajustar los pesos y el enfoque del modelo, su LLM gana en comprensión contextual y precisión.

Piense en el ajuste fino como el máster que su LLM necesita para hablar el idioma de su sector. Repasemos dónde entra esta estrategia de IA en el proceso de indicación rápida:

Ventajas del ajuste fino

Las técnicas de ajuste fino son simplemente ajustes de IA. Es más como poder ampliar detalles predefinidos. Estas son las ventajas que ofrece:

- Optimización específica para cada tarea: los conjuntos de datos especializados perfeccionan las respuestas del LLM para tareas específicas. ¿Quiere ayudar a los usuarios a evitar el dolor de cabeza que suponen las indicaciones complejas? El ajuste fino ayuda a los desarrolladores a obtener soluciones de IA personalizadas.

- Mayor precisión para aplicaciones especializadas: el conocimiento del dominio reduce los errores y mejora la precisión de cada respuesta. El ajuste fino también aumenta la fiabilidad del LLM, lo que permite a las empresas relajarse en cuanto a la microgestión y la supervisión manual.

- Personalización para la voz de la marca y el cumplimiento normativo: el ajuste fino enseña a los LLM los términos, el estilo y las normativas de la empresa. Esto mantiene una voz de marca coherente y el cumplimiento normativo específico del sector.

➡️ Lea también: Técnicas de IA: dominar el aprendizaje automático, el aprendizaje profundo y el procesamiento del lenguaje natural (NLP).

Casos de uso del ajuste fino

Su proceso de ajuste fino le permite alcanzar un objetivo de eficiencia. Estas son sus ventajas:

Sistemas de control de calidad específicos para cada dominio

Sectores como el jurídico, el sanitario y el financiero dependen de respuestas precisas de IA que conozcan el ámbito. El ajuste fino dota a los LLM de conocimientos especializados, lo que garantiza la precisión en las respuestas a las preguntas (QA).

Por ejemplo, un asistente legal con IA puede interpretar contratos con mayor precisión, mientras que un chatbot médico puede proporcionar orientación basada en los síntomas utilizando conjuntos de datos fiables.

Análisis de sentimientos y flujos de trabajo personalizados

Las empresas utilizan un modelo ajustado para supervisar las marcas, analizar los comentarios de los clientes y automatizar los flujos de trabajo adaptados a necesidades operativas únicas. Una herramienta basada en IA puede detectar matices en las opiniones sobre los productos, lo que ayuda a las empresas a perfeccionar sus ofertas.

En RR. HH., combinar el ajuste fino con el procesamiento del lenguaje natural ayuda a la IA a analizar las encuestas de los empleados y señalar las preocupaciones en el lugar de trabajo con una mayor conciencia contextual.

💡 Consejo profesional: el ajuste fino podría implicar añadir datos más diversos para eliminar posibles sesgos. No es exactamente específico del dominio, pero sigue siendo una aplicación crucial.

Comparación: RAG frente a ajuste fino

No se puede negar que ambas estrategias de IA tienen como objetivo mejorar el rendimiento.

Pero la elección sigue pareciendo bastante complicada, ¿verdad? A continuación, le ofrecemos un desglose de Fine-Tuning frente a RAG para ayudarle a tomar la decisión correcta para sus inversiones en LLM.

| Aspecto | RAG (Generación aumentada por recuperación) | Ajuste fino |

| Definición | Permite a LLM recuperar datos relevantes en tiempo real de fuentes de datos externas con su sistema dedicado. | Entrena un modelo preentrenado con conjuntos de datos especializados para tareas específicas del dominio. |

| Rendimiento y precisión | Ideal para la recuperación de datos en tiempo real, pero la precisión depende de la calidad de los datos externos. | Mejora la precisión contextual y las respuestas específicas para cada tarea. |

| Requisitos de coste y recursos | Una inversión inicial más rentable se centra en el acceso a datos en tiempo real. | Requiere más recursos para el entrenamiento inicial, pero es rentable a largo plazo. |

| Mantenimiento y escalabilidad | Altamente escalable y flexible, pero tiene una dependencia de la frecuencia de las actualizaciones de fuentes externas. | Requiere actualizaciones y mantenimiento frecuentes, pero ofrece un rendimiento estable a largo plazo. |

| Casos de uso | Chatbots, recuperación dinámica de documentos, análisis en tiempo real. | Sistemas de control de calidad específicos para cada dominio, análisis de opiniones y personalización de la voz de la marca. |

| Cuándo elegir | Datos que cambian rápidamente, actualizaciones en tiempo real y priorización de los costes de los recursos. | Segmentos de clientes nicho, lógica específica del dominio, personalización personalizada de la marca. |

| Ideal para | Las industrias necesitan información precisa y en tiempo real (finanzas, legal, soporte al cliente). | Sectores que requieren un lenguaje, un cumplimiento normativo o un contexto específicos (sanidad, jurídico, recursos humanos). |

¿Necesita un poco más de claridad para resolver sus dudas? Aquí tiene una comparación directa de los aspectos clave que afectan a sus necesidades.

Rendimiento y precisión

En lo que respecta al rendimiento, RAG desempeña un rol clave al extraer nuevos datos de fuentes externas. Su precisión y tiempos de respuesta dependen de la calidad de estos datos. Esta dependencia de bases de datos externas permite a RAG proporcionar información actualizada de forma eficaz.

Por otro lado, el ajuste fino mejora la forma en que el modelo procesa y responde mediante un reentrenamiento especializado. Este proceso produce respuestas más precisas desde el punto de vista contextual, especialmente para aplicaciones especializadas. Los LLM ajustados son ideales para mantener la coherencia en sectores con requisitos estrictos, como la sanidad o las finanzas.

Conclusión: RAG es ideal para datos en tiempo real y el ajuste fino para obtener respuestas contextualmente precisas.

Un usuario de Reddit dice:

Si utiliza un modelo pequeño y una buena base de datos en el proceso RAG, puede generar conjuntos de datos de alta calidad, mejores que los que se obtienen con una IA de alta calidad.

Si utiliza un modelo pequeño y una buena base de datos en el proceso RAG, puede generar conjuntos de datos de alta calidad, mejores que los que se obtienen con una IA de alta calidad.

💡 Consejo profesional: para orientar su LLM hacia un resultado específico, céntrese en una ingeniería eficaz y rápida con indicaciones claras.

Requisitos de coste y recursos

RAG suele ser más rentable inicialmente, ya que solo añade una capa para la recuperación de datos externos. Al evitar la necesidad de volver a entrenar todo el modelo, se perfila como una opción mucho más económica, especialmente en entornos dinámicos. Sin embargo, los costes operativos del acceso y almacenamiento de datos en tiempo real pueden acumularse.

El ajuste fino requiere más preparación de conjuntos de datos y recursos de formación, pero es una inversión a largo plazo. Una vez ajustados, los LLM necesitan menos actualizaciones, lo que se traduce en un rendimiento predecible y un ahorro de costes. Los desarrolladores deben sopesar la inversión inicial frente a los gastos operativos continuos.

Conclusión: RAG es rentable, fácil de implementar y ofrece beneficios rápidos. El ajuste fino requiere muchos recursos iniciales, pero mejora la calidad del LLM y ahorra costes operativos a largo plazo.

💡 Consejo profesional: su sistema RAG es tan inteligente como los datos de los que se nutre. Mantenga sus fuentes de datos limpias y llénelas de datos precisos y actualizados.

Mantenimiento y escalabilidad

RAG ofrece una excelente escalabilidad, ya que se centra principalmente en ampliar la fuente externa. Su flexibilidad y adaptabilidad lo hacen perfecto para sectores en rápida evolución. Sin embargo, su mantenimiento depende de la frecuencia de las actualizaciones de las bases de datos externas.

El ajuste fino requiere un mantenimiento bastante frecuente, especialmente cuando cambia la información específica del dominio. Aunque exige más recursos, proporciona una mayor coherencia a lo largo del tiempo y requiere cada vez menos ajustes. Dicho esto, la escalabilidad del ajuste fino es mucho más compleja, ya que implica conjuntos de datos más amplios y diversos.

Conclusión: RAG es la mejor opción para un escalado rápido y un ajuste fino que garantice un mantenimiento mínimo y un rendimiento estable.

Un usuario de Reddit añade:

Cuando la tarea es pequeña, a menudo es más eficiente utilizar un modelo más grande en lugar de ajustar uno más pequeño.

Cuando la tarea es pequeña, a menudo es más eficiente utilizar un modelo más grande en lugar de ajustar uno más pequeño.

👀 ¿Sabías que hay soluciones de IA que ahora pueden oler? Dada la complejidad de las fragancias, eso supone un gran trabajo de ajuste fino y recuperación de datos complejos.

¿Qué enfoque es el adecuado para su caso de uso?

A pesar de comprender los matices, tomar la decisión puede parecer vacío sin una referencia o un contexto aparentes. Analicemos algunos escenarios empresariales que destacan cómo funciona mejor cada modelo de IA.

Cuándo elegir RAG

RAG ayuda a alimentar su LLM con los datos y la información adecuados, incluyendo normas técnicas, registros de ventas, comentarios de los clientes y mucho más.

¿Cómo se puede aplicar esto? Considere estos escenarios para adoptar RAG en sus operaciones:

Caso de uso n.º 1: análisis en tiempo real

- Escenario: Una empresa de tecnología financiera es el proveedor de información sobre el mercado basada en IA para los operadores bursátiles. Los usuarios preguntan sobre las tendencias bursátiles y el sistema debe capturar los últimos informes de mercado, documentos presentados ante la SEC y noticias.

- Por qué gana RAG: Los mercados bursátiles se mueven rápidamente, por lo que volver a entrenar constantemente los modelos de IA es caro e ineficaz. RAG mantiene la precisión extrayendo solo los datos financieros más recientes, lo que reduce los costes y aumenta la precisión.

- Regla general: RAG debería ser su estrategia preferida para el manejo de datos que cambian rápidamente por parte de la IA. Las aplicaciones más populares son el análisis de datos de redes sociales, la optimización energética, la detección de amenazas de ciberseguridad y el seguimiento de pedidos.

Caso de uso n.º 2: Comprobación de datos y cumplimiento normativo

- Escenario: Un asistente legal de IA ayuda a los abogados a redactar contratos y verificar el cumplimiento de las leyes en constante evolución, recopilando los últimos estatutos, precedentes y sentencias.

- Por qué gana RAG: La verificación de aspectos legales y comerciales no justifica actualizaciones de comportamiento en profundidad. RAG hace muy bien su trabajo al extraer textos legales de un conjunto de datos central en tiempo real.

- Regla general: RAG destaca en la obtención de información basada en recursos y estadísticas. Una forma excelente de sacar el máximo partido a esta herramienta sería utilizar asistentes médicos con IA para recomendaciones de tratamiento y chatbots de atención al cliente para la resolución de problemas y actualizaciones de políticas.

¿Todavía se pregunta si necesita RAG en su LLM? Aquí tiene una lista de control rápida:

- ¿Necesita datos nuevos y de alta calidad sin cambiar el propio LLM?

- ¿Tu información cambia con frecuencia?

- ¿Su LLM necesita trabajar con información dinámica en lugar de datos de entrenamiento estáticos?

- ¿Le gustaría evitar grandes gastos y el reentrenamiento de modelos, que requiere mucho tiempo?

Cuándo es más eficaz el ajuste fino

Como mencionamos anteriormente, el ajuste fino es como una escuela de posgrado en IA. Su LLM puede incluso aprender la jerga del sector. A continuación, le mostramos un resumen por sectores en los que realmente destaca:

Caso de uso n.º 1: añadir la voz y la tonalidad de la marca

- Escenario: Una marca de lujo crea un asistente de IA para interactuar con los clientes en un tono refinado y exclusivo. Debe incorporar las tonalidades, expresiones y matices emocionales específicos de la marca.

- Por qué gana el ajuste fino: el ajuste fino ayuda al modelo de IA a capturar y replicar la voz y el tono únicos de la marca. Ofrece una experiencia coherente en todas las interacciones.

- Regla general: el ajuste fino es más eficaz si sus LLM deben adaptarse a un conocimiento específico. Esto es ideal para juegos inmersivos orientados a un género, narraciones temáticas y empáticas, o incluso textos de marketing de marca.

🧠 Dato curioso: los LLM entrenados en estas habilidades sociales destacan en el análisis del estado de ánimo y la satisfacción de los empleados. Sin embargo, solo el 3 % de las empresas utilizan actualmente la IA generativa en RR. HH.

Caso de uso n.º 2: moderación de contenidos e información basada en el contexto.

- Escenario: Una plataforma de redes sociales utiliza un modelo de IA para detectar contenido perjudicial. Se centra en reconocer el lenguaje específico de la plataforma, la jerga emergente y las infracciones sensibles al contexto.

- Por qué gana el ajuste fino: Las habilidades sociales, como la redacción de frases, suelen quedar fuera del alcance de los sistemas RAG. El ajuste fino mejora la comprensión de un LLM de los matices específicos de la plataforma y la jerga del sector, especialmente relevante en la moderación de contenidos.

- Regla general: es aconsejable elegir el ajuste fino cuando se trata de diferencias culturales o regionales. Esto también se extiende a la adaptación a términos específicos de la industria, como la jerga médica, legal o técnica.

¿Está a punto de ajustar su LLM? Plantéese estas cuestiones clave:

- ¿Su LLM debe dirigirse a un segmento de clientes o tema de marca específicos?

- ¿Le gustaría añadir datos propios o específicos del dominio a la lógica del LLM?

- ¿Necesita respuestas más rápidas sin perder precisión?

- ¿Sus LLM ofrecen soluciones sin conexión?

- ¿Puede asignar recursos y potencia informática específicos para el reentrenamiento?

Mejorar la experiencia del usuario es fantástico. Sin embargo, muchas empresas también necesitan la IA como impulso a la productividad para justificar los elevados costes de inversión. Por eso, adoptar un modelo de IA preentrenado suele ser la opción preferida por muchos.

👀 ¿Sabías que...? La IA genérica tiene el potencial de automatizar actividades de trabajo que ahorran hasta un 70 % del tiempo de los empleados. ¡Pedir información a la IA de forma eficaz juega un rol muy importante en este sentido!

Cómo ClickUp aprovecha las técnicas avanzadas de IA

Elegir entre RAG y el ajuste fino es un gran debate.

Incluso leer unos cuantos hilos de Reddit es suficiente para confundirte. Pero, ¿quién ha dicho que tengas que elegir solo uno?

Imagine disponer de modelos de IA personalizables, automatización y gestión de tareas, todo en un solo lugar. Eso es ClickUp, la aplicación que lo tiene todo para el trabajo. Reúne la gestión de proyectos, la documentación y la comunicación del equipo bajo un mismo techo y cuenta con la tecnología de IA de última generación.

En resumen, destaca en todo, especialmente con su solución integral de IA: ClickUp Brain.

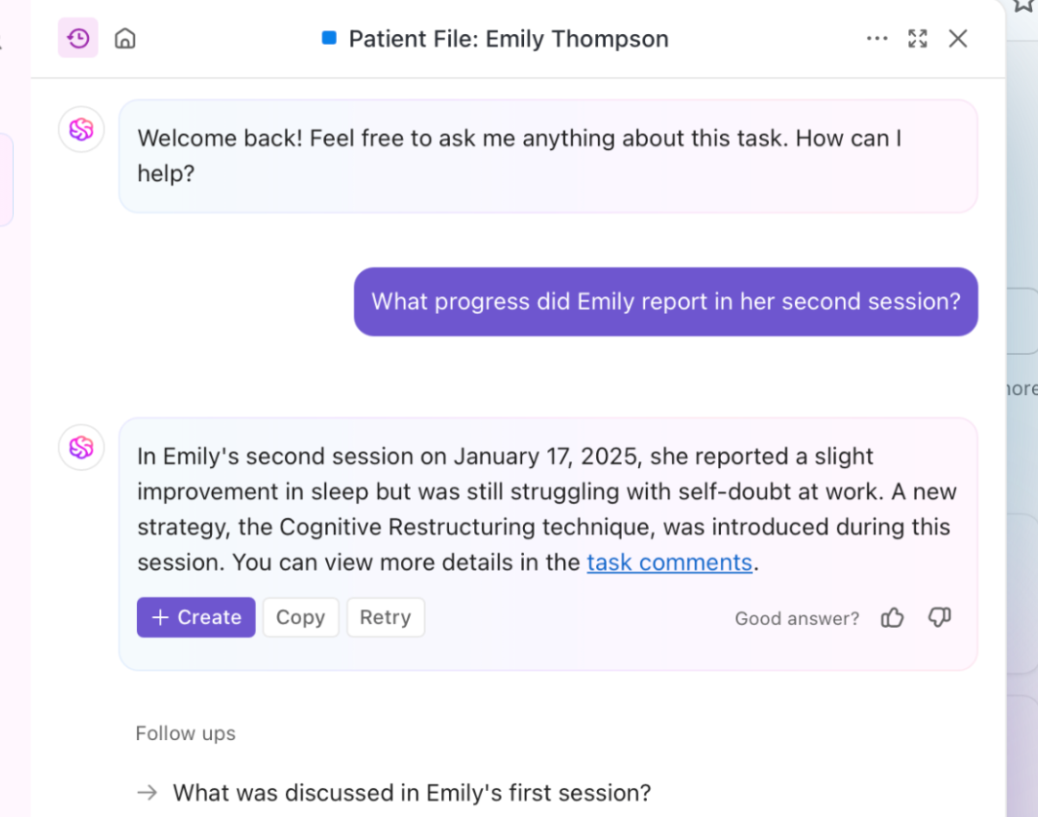

¿Necesita información rápida y contextualizada? Brain extrae información en tiempo real de sus documentos, tareas y recursos. Así es como funciona el RAG mejorado. Además, su LLM fundamental, Brain, puede generar informes y actualizaciones rutinarias de proyectos.

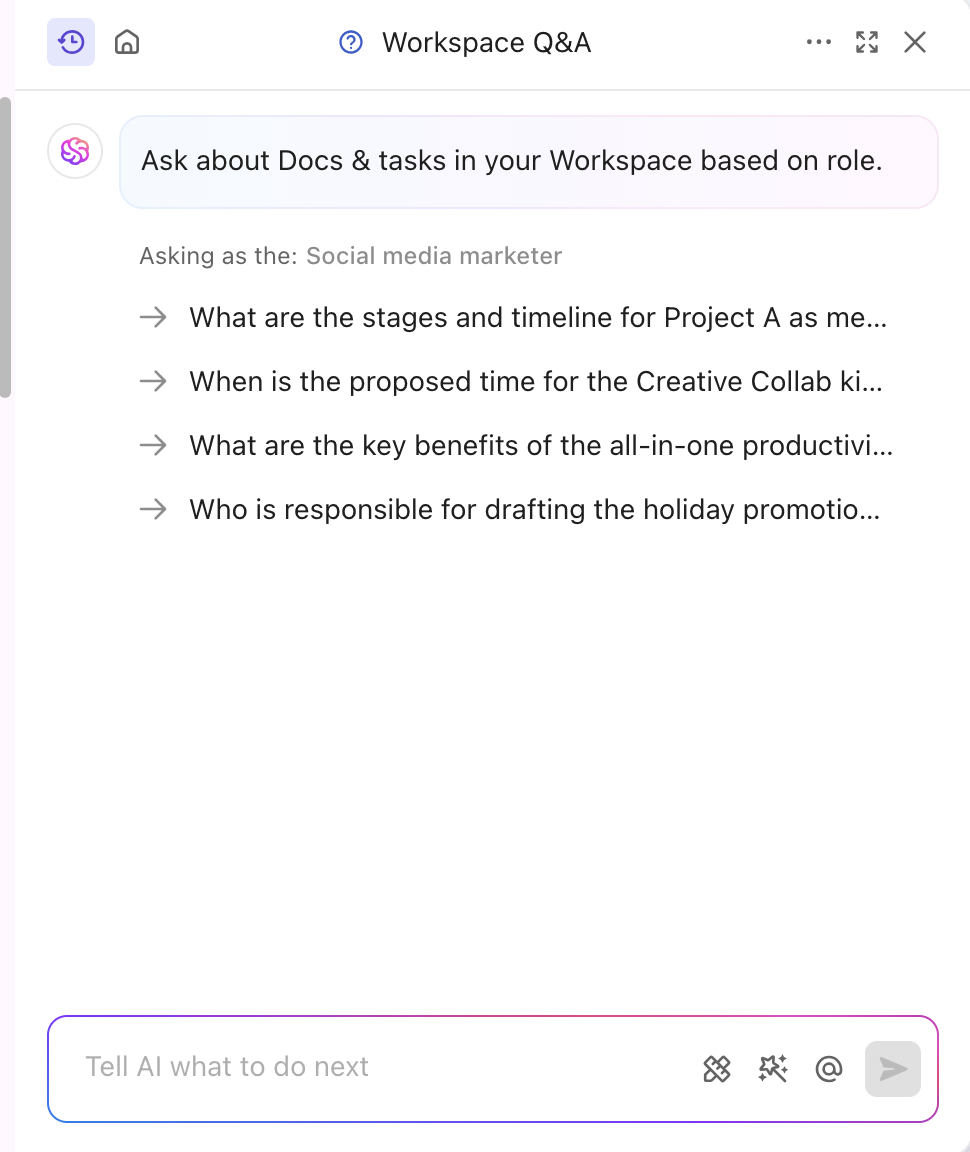

La herramienta de IA también se ajusta a su sector y segmento, proporcionando información profesional y creativa. Incluso personaliza el contenido en tiempo real sin necesidad de formación manual. Brain combina el ajuste fino y RAG para automatizar las actualizaciones de proyectos, la asignación de tareas y las notificaciones del flujo de trabajo. ¿Quiere respuestas adaptadas a su rol? ¡ClickUp Brain también puede hacerlo!

Además de especializarse en contenido, ClickUp también potencia su plataforma con una potente función de IA basada en el conocimiento.

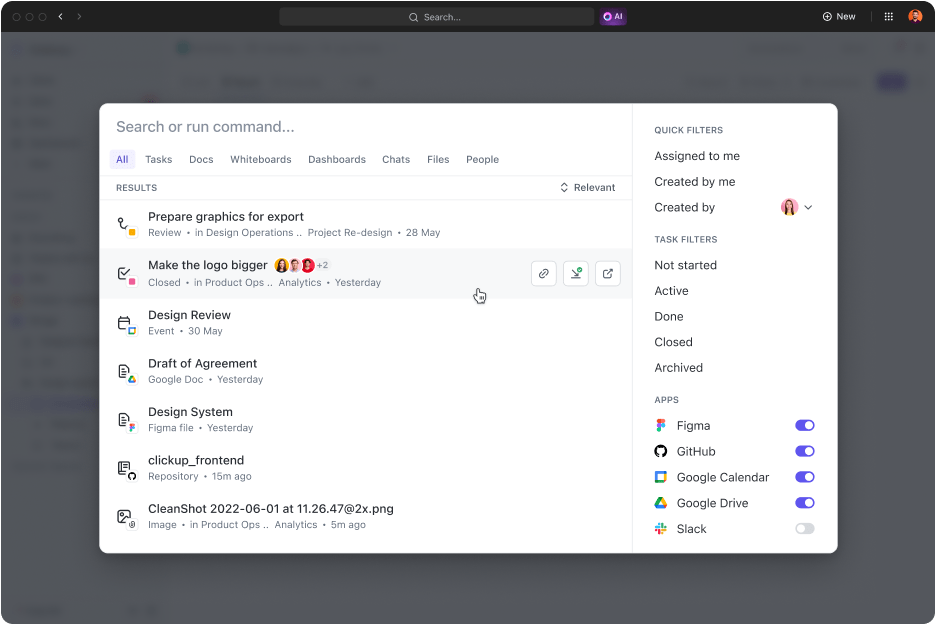

ClickUp Connected Search es una herramienta basada en IA que recupera rápidamente cualquier recurso de su espacio integrado. Tanto si necesita documentos para la reunión de hoy como respuestas a cualquier tarea, una simple consulta le proporcionará enlaces a fuentes, citas y información detallada.

También inicia aplicaciones, busca en el historial del portapapeles y crea fragmentos. ¿Lo mejor de todo? Se puede acceder a todo ello con un solo clic desde el centro de comandos, la barra de acciones o el escritorio.

Los expertos en marketing digital, incluso el presidente de Hum JAM, afirman que

ClickUp es la herramienta de automatización de equipos «todo en uno» más increíble que existe, capaz de realizar un seguimiento, automatizar y medir el éxito de tu equipo. Créeme cuando te digo que tu equipo no podrá prescindir de esta herramienta.

ClickUp es la herramienta de automatización de equipos «todo en uno» más increíble que existe, capaz de realizar un seguimiento, automatizar y medir el éxito de tu equipo. Créeme cuando te digo que tu equipo no podrá prescindir de esta herramienta.

Potencia la precisión de Gen IA y LLM con ClickUp.

Las respuestas potentes de RAG, perfeccionadas con datos externos actualizados y ajuste fino, se utilizan para tareas y comportamientos específicos. Ambos mejoran el rendimiento de la IA, pero el enfoque adecuado define su ritmo y eficiencia.

En sectores dinámicos, la decisión suele reducirse a qué método adoptar primero. Una solución potente preentrenada suele ser la opción más acertada.

Si desea mejorar la calidad del servicio y la productividad, ClickUp es un gran aliado. Sus capacidades de IA impulsan la generación de contenido, la recuperación de datos y las respuestas analíticas. Además, la plataforma incluye más de 30 herramientas que abarcan desde la gestión de tareas hasta la generación de impresionantes imágenes.

¡Regístrese hoy mismo en ClickUp!