Die Auswahl eines KI-Modells für Ihren Entwicklungs-Workflow mag wie eine einfache Frage klingen: Welches sollen wir verwenden?

Dahinter verbirgt sich jedoch eine weitreichendere Entscheidung darüber, wie Sie KI in Ihrem Stack aufbauen und betreiben möchten.

Entscheiden Sie sich für Mixtral, das Open-Weight-Modell von Mistral AI, das Teams mehr Kontrolle über die Bereitstellung und Benutzerdefinierung bietet? Oder für ChatGPT, den weit verbreiteten KI-Assistenten von OpenAI, der für leistungsstarke proprietäre Modelle und ein benutzerfreundliches Ökosystem bekannt ist?

Diese Entscheidung hat Auswirkungen auf Alles – von der Kontrolle, die Sie über die Infrastruktur haben, bis hin zur Geschwindigkeit, mit der Sie KI-Features bereitstellen können.

In diesem Leitfaden vergleichen wir Mixtral und ChatGPT hinsichtlich Architektur, Leistung, benutzerdefinierten Anpassungsmöglichkeiten, Kosten und Datenschutz – damit Sie entscheiden können, was am besten zu Ihrem Team passt. Wir zeigen Ihnen auch, wie viele Entwickler die Entweder-oder-Debatte umgehen, indem sie mehrere Modelle parallel in ihrem Workflow mit All-in-One-Tools wie ClickUp nutzen. ⚒️

Sind Sie bereit? Dann lassen Sie uns loslegen.

Mixtral vs. ChatGPT auf einen Blick

Mixtral und ChatGPT sind hervorragende tools für Entwickler, doch jedes zeichnet sich in unterschiedlichen Bereichen aus. Bevor wir auf diese Details eingehen, hier eine kurze Zusammenfassung ihrer Features:

| Feature/Kategorie | Mixtral | ChatGPT | ClickUp Brain |

|---|---|---|---|

| Modellarchitektur | Mixture-of-Experts mit offenen Gewichten (8x7B); durch spärliche Aktivierung ist pro Token nur eine Teilmenge der Parameter aktiv, was die Inferenzkosten senkt | Proprietäre Transformer-Architektur; ein dichtes Modell, bei dem alle Parameter während der Inferenz aktiv sind | Zugriff auf mehrere LLM-Modelle, darunter Claude, GPT, Gemini und DeepSeek, in einem einheitlichen Workspace |

| Verfügbarkeit als Open Source | Vollständig offene Gewichte unter der Apache 2.0-Lizenz; Sie können es frei herunterladen und ändern | Geschlossen; Sie haben keinen Zugriff auf die Modellgewichte oder Details zur Architektur | Eine SaaS-Plattform, die auf mehrere Anbieter von Modellen zugreift |

| Kontextfenster | Bis zu 32.000 Token nativ; erweiterter Kontext ist in einigen Bereitstellungen verfügbar | 8K–128K Token, je nach Version (GPT-4 Turbo unterstützt 128K) | Workspace-orientierter Kontext, der automatisch Informationen aus Ihren Aufgaben, Dokumenten und Unterhaltungen abruft |

| Option zum Selbsthosting | Ja, Sie können es lokal oder auf einer privaten Cloud-Infrastruktur ausführen. | Nein; es ist nur über die API über OpenAI-Server zugänglich. | Cloud-basiert mit Sicherheitskontrollen für Unternehmen |

| Support bei der Feinabstimmung | Vollständige Feinabstimmung und LoRA/QLoRA-Adapter werden unterstützt | Für ausgewählte Modelle ist eine begrenzte Feinabstimmung über die API verfügbar | Verwendet Basismodelle; die benutzerdefinierte Anpassung wird über Eingabeaufforderungen und den Workspace-Kontext erledigt |

| Teamgröße | Von Einzelentwicklern bis hin zu großen Teams mit MLOps-Kapazitäten | Teams jeder Größe, die mit API-basierten Workflows vertraut sind | Teams jeder Größe in allen Abteilungen |

| Preise | Kostenlos (bei Selbsthosting); API-Kosten variieren je nach Anbieter | Abonnement- und nutzungsbasierte API-Preise | Ein Free Forever-Plan ist verfügbar |

Wie wir Software bei ClickUp bewerten

Unser Redaktionsteam folgt einem transparenten, wissenschaftlich fundierten und herstellerneutralen Prozess, sodass Sie darauf vertrauen können, dass unsere Empfehlungen auf dem tatsächlichen Wert des Produkts basieren.

Hier finden Sie eine detaillierte Übersicht darüber, wie wir bei ClickUp Software bewerten.

Mixtral Übersicht

Mixtral ist ein Open-Weight-Modell von Mistral KI, das auf einer Mixture-of-Experts (MoE)-Architektur basiert. Stellen Sie sich das wie ein Team aus acht Fachberatern vor. Anstatt dass jeder an jeder Aufgabe arbeitet, zieht das Modell nur die Experten hinzu, die es benötigt.

Für jede Eingabe führt Mixtral eine Auswahl der beiden relevantesten Experten durch, um die Antwort zu generieren, während die anderen inaktiv bleiben. Das Ergebnis: Sie erhalten eine Leistung, die der eines viel größeren Modells entspricht, jedoch mit deutlich geringerem Rechenaufwand pro Anfrage.

Vorteile von Mixtral

- Offene Gewichte unter Apache 2.0: Sie erhalten vollen Zugriff auf die Gewichte des Modells, sodass Sie es ohne einschränkende Lizenzbedingungen selbst hosten, feinabstimmen und modifizieren können. Dies ist ein großer Vorteil, wenn Ihr Team unter strengen IP- oder Compliance-Anforderungen arbeitet.

- Effizienz durch Mixture-of-Experts: Obwohl das Modell 47 Milliarden Parameter hat, werden pro Token nur etwa 13 Milliarden aktiviert, sodass Sie die Leistungsfähigkeit eines viel größeren Modells bei geringeren Rechenkosten und schnelleren Antworten erhalten.

- Starke mehrsprachige Leistung: Es verarbeitet Code und natürliche Sprache in vielen verschiedenen Programmiersprachen und menschlichen Sprachen effektiv.

- Flexibilität durch Eigenhosting: Sie können es auf Ihrer eigenen Infrastruktur betreiben, wodurch Sie die volle Kontrolle über Ihre Daten haben und die Kosten mit steigender Nutzung besser vorhersehbar sind

- Aktive Open-Source-Community: Sie profitieren von einem wachsenden Ökosystem aus Tools, von der Community optimierten Modellvarianten und hilfreichen Bereitstellungsanleitungen

Nachteile von Mixtral

- Infrastruktur-Overhead: Selbsthosting ist kein Plug-and-Play. Es erfordert MLOps-Fachwissen, dedizierte GPU-Ressourcen und laufende Wartung

- Kleinere Ökosystem: Es verfügt über weniger vorgefertigte Integrationen, Plugins und Tools von Drittanbietern im Vergleich zum umfangreichen und ausgereiften Ökosystem von ChatGPT

- Unterschiedliche Qualität bei den Anbietern: Wenn Sie eine API eines Drittanbieters nutzen, können Preisgestaltung, Ratenlimits und Zuverlässigkeit variieren.

- Weniger ausgereift für Aufgaben der Unterhaltung: Während es bei der Generierung von Code stark ist, werden Sie vielleicht feststellen, dass seine Fähigkeiten zur Unterhaltung im Vergleich zu ChatGPT, das speziell für das Chatten umfassend optimiert wurde, weniger ausgefeilt wirken.

Preise für Mixtral (Kosten pro 1 Mio. Token)

- Free

- Eingabe: 0,70 $ pro 1 Mio. Token

- Ergebnis: 0,70 $ pro 1 Mio. Token

ChatGPT-Übersicht

ChatGPT ist das Flaggschiff unter den dialogorientierten KI-Systemen von OpenAI und steht Entwicklern über APIs wie GPT-4, GPT-4 Turbo und GPT-4o zur Verfügung. Seine größte Stärke liegt im umfangreichen Reinforcement Learning from Human Feedback (RLHF), bei dem menschliche Prüfer die Antworten bewerten und eine Bewertung abgeben, um das Modell hilfreicher, genauer und sicherer zu machen.

Für Sie als Entwickler bedeutet das, dass die Antworten, die Sie erhalten, in der Regel von Anfang an ausgefeilt und gut strukturiert sind, insbesondere bei Anwendungsfällen im Bereich der Unterhaltung.

Vorteile von ChatGPT

- Ausgereifte, ausgefeilte Antworten: Dank RLHF generiert ChatGPT selbst bei minimaler Eingabeaufforderung durchweg hilfreichen, gut kommentierten Code und klare Dokumentation.

- Umfangreiches Ökosystem: Es wird von Tausenden von Plugins, Integrationen und Tools unterstützt und bietet starke Unterstützung in gängigen IDEs und Frameworks.

- Zuverlässige API-Infrastruktur: Sie profitieren von einer Verfügbarkeit auf Unternehmensniveau und einem Support, der von einem finanzstarken Unternehmen mit starkem Fokus auf Entwicklerbeziehungen unterstützt wird.

- Multimodale Fähigkeiten: Die neuesten GPT-4-Modelle können Bilder, Sprache und Dateien verarbeiten – ideal, wenn Sie beispielsweise eine Benutzeroberfläche anhand eines Screenshots analysieren oder verschiedene Arten von Workflows zur Entwicklung nutzen möchten.

- Niedrige Einstiegshürde: Es ist kein Setup der Infrastruktur erforderlich. Mit nur einem API-Schlüssel können Sie sofort mit der Entwicklung beginnen.

Nachteile von ChatGPT

- Geschlossenes und proprietäres Modell: Sie haben keinen Zugriff auf die Modellgewichte, was bedeutet, dass Sie das Modell nicht selbst hosten, frei feinabstimmen oder sein Verhalten eingehend prüfen können

- Datenschutzbedenken: Alle Ihre Eingaben werden auf den Servern von OpenAI verarbeitet, was ein Problem darstellen kann, wenn Sie in regulierten Branchen mit Compliance-Vorschriften oder sensiblen Codebasen arbeiten.

- Unvorhersehbare Kosten bei großem Umfang: Wenn Sie Anwendungen mit hohem Datenaufkommen betreiben, sollten Sie bedenken, dass sich die Token-basierten Nutzungskosten schnell summieren können, denn je mehr Sie nutzen, desto höher sind die Kosten.

- Risiko der Anbieterabhängigkeit: Wenn Sie alles auf eine Karte setzen und sich auf einen einzigen Anbieter verlassen, riskieren Sie eine Anbieterabhängigkeit. Jede API-Änderung oder Serviceaktualisierung auf deren Seite kann Ihren Workflow stören.

Preise für ChatGPT

- Free

- Go: 8 $/Monat pro Benutzer

- Plus: 20 $/Monat pro Benutzer

- Pro: 200 $/Monat pro Benutzer

Mixtral vs. ChatGPT: Vergleich der wichtigsten Features

Schauen wir uns einmal genauer an, wie Mixtral und ChatGPT in den für Sie wichtigen Features im Vergleich abschneiden.

Feature Nr. 1: Benchmarks für Programmierung und Code-Generierung

ChatGPT, insbesondere GPT-4, neigt dazu, Code wie ein umsichtiger Teamkollege zu schreiben. Selbst wenn Sie einfache Eingabeaufforderungen verwenden, erzeugt es detaillierten Code, fügt Kommentare hinzu und behandelt Fehler sofort. Dadurch eignet es sich hervorragend für die Generierung von produktionsreifem Code.

Mixtral hingegen kann zwar mit der Leistung mithalten, ist aber im Standard prägnanter, was bedeutet, dass Sie zusätzliche Zeit für das Prompt Engineering aufwenden müssten, um das gleiche Maß an Perfektion zu erreichen.

Für einfachen Standard-Code eignet sich jedes der beiden Modelle gut. Wenn es jedoch komplexer wird, hat ChatGPT dank seiner klareren und ausgefeilteren Ergebnisse oft die Nase vorn.

🏆 Fazit: ChatGPT überzeugt durch einen ausgefeilteren, produktionsreifen Code.

💡 Profi-Tipp: Vergleichen Sie Modelle nicht nur im Allgemeinen – testen Sie sie innerhalb Ihres Workflows. Prüfen Sie, wie sich die Ergebnisse von Mixtral und ChatGPT in Ihren tatsächlichen Entwicklungsprozess integrieren lassen, und nicht nur anhand isolierter Eingabeaufforderungen. Das spart Zeit und erspart Ihnen später das Hin- und Herwechseln zwischen verschiedenen Registerkarten.

Feature Nr. 2: Kontextfenster und Verarbeitung langer Texte

Die Arbeit an einer großen, komplexen Codebasis ist schwierig, wenn Ihr KI-Assistent vergisst, worüber Sie vor drei Eingaben gesprochen haben. Deshalb ist das Kontextfenster – also die Textmenge, die sich ein Modell auf einmal merken kann – für Sie als Entwickler sehr wichtig. Beide tools gehen dies unterschiedlich an:

- Mixtral-8x7B: Bietet ein natives Kontextfenster von 32.000 Tokens, was für große Dateien und lange Unterhaltungen von Bedeutung ist

- ChatGPT: Kann zwischen 8.000 und 128.000 Token verarbeiten . Mit dem riesigen 128K-Fenster von GPT-4 Turbo könnten Sie dem Modell theoretisch ein kleines Code-Repository in einer einzigen Eingabe übermitteln. Beachten Sie jedoch, dass größere Fenster teurer werden können.

🏆 Fazit: GPT-4 Turbo gewinnt dank seiner enormen Kapazität, mit der es riesige Codebasen bewältigen kann, aber Mixtral schneidet innerhalb seines 32K-Token-Fensters immer noch sehr gut ab, was es für die meisten Projekte effizient macht.

📮 ClickUp Insight: Nur 12 % unserer Umfrageteilnehmer nutzen KI-Features, die in Produktivitätssuiten integriert sind. Diese geringe Akzeptanz deutet darauf hin, dass es den aktuellen Implementierungen möglicherweise an der nahtlosen, kontextbezogenen Integration mangelt, die Benutzer dazu bewegen würde, von ihren bevorzugten eigenständigen Konversationsplattformen zu wechseln.

Kann die KI beispielsweise einen Automatisierungs-Workflow auf Basis einer Nur-Text-Anweisung des Benutzers ausführen? ClickUp Brain kann das! Die KI ist tief in jeden Aspekt von ClickUp integriert, unter anderem in die Zusammenfassung von Chat-Verläufen, das Verfassen oder Überarbeiten von Texten, das Abrufen von Informationen aus dem Arbeitsbereich, das Erstellen von Bildern und vieles mehr! Schließen Sie sich den 40 % der ClickUp-Kunden an, die mehr als drei Apps durch unsere All-in-One-App für die Arbeit ersetzt haben!

Feature Nr. 3: API-Zugriff und Entwicklerintegrationen

Die Qualität eines KI-Modells spielt keine Rolle, wenn die Integration in Ihren Workflow ein mühsamer und zeitaufwändiger Prozess ist. Mangelhafte Dokumentation, fehlende SDKs und eine unzuverlässige API können ein Projekt zum Scheitern bringen, noch bevor es überhaupt begonnen hat.

OpenAI bietet eine ausgereifte Entwicklerintegration mit gut dokumentierten APIs, SDKs für gängige Sprachen und erweiterten Features wie Funktionsaufrufen.

Im Gegensatz dazu ist der API-Zugriff auf Mixtral auf mehrere Anbieter verteilt (wie die eigene Plattform von Mixtral, Together /AI oder Fireworks), von denen jeder seine eigene Dokumentation und Zuverlässigkeit aufweist. Dies bietet verständlicherweise Auswahlmöglichkeiten, bedeutet aber auch, dass Sie sich mit unterschiedlichen Dokumentationen, Zuverlässigkeitsgraden und Setups auseinandersetzen müssen, was zu Inkonsistenzen führen kann.

🏆 Fazit: Unentschieden, da die API von OpenAI eine hervorragende Entwicklererfahrung für eine schnelle Integration bietet, während Mixtral Teams mit spezifischen Infrastrukturanforderungen mehr Flexibilität bei der Wahl des Anbieters bietet.

Feature Nr. 4: Benutzerdefinierte Anpassungs- und Selbsthosting-Optionen

Standard -KI-Modelle sind großartig, aber benutzerdefinierte Anpassungen machen einen großen Unterschied, wenn Ihr Team einen einzigartigen Programmierstil, eine proprietäre Codebasis oder einen spezialisierten Fachbereich hat. Wenn Sie das Modell nicht an Ihre spezifischen Anforderungen anpassen können, entgehen Sie einem großen Wert.

Das ist die größte Stärke von Mixtral. Da es sich um offene Gewichte handelt, können Sie:

- Feinabstimmung: Trainieren Sie das Modell mit Ihrem eigenen Code, damit es zu einem Experten in Ihrem spezifischen Fachgebiet wird.

- Verwenden Sie Adapter: Wenden Sie effiziente Techniken wie LoRA und QLoRA an, um das Modell benutzerdefiniert anzupassen, ohne es von Grund auf neu trainieren zu müssen.

- Quantisieren: Verkleinern Sie die Größe des Modells für den Einsatz auf kleinerer, kostengünstigerer Hardware

ChatGPT hingegen bietet über seine API nur begrenzte benutzerdefinierte Einstellungen, und Sie haben keinen Zugriff auf die zugrunde liegenden Modellgewichte. Sie sind grundsätzlich durch die Vorgaben von OpenAI eingeschränkt.

🏆 Fazit: Mixtral ist die erste Wahl in Sachen benutzerdefinierte Anpassbarkeit und Selbsthosting und damit die ideale Lösung für Teams mit speziellen Anforderungen oder strengen Datenschutzbestimmungen.

Feature Nr. 5: Datenschutz und Sicherheit der Daten für Entwicklerteams

Für viele Entwicklerteams kommt es gar nicht in Frage, proprietären Code oder sensible Kundendaten an eine API eines Drittanbieters zu senden.

Die Self-Hosting-Option von Mixtral bietet Ihnen vollständige Kontrolle über Ihre Daten – ein Grundprinzip für hohen Datenschutz und Sicherheit –, da Ihre Eingaben und Ihr Code Ihre eigene Infrastruktur nie verlassen. Dies ist ideal für Teams in regulierten Branchen wie dem Finanzwesen oder dem Gesundheitswesen.

ChatGPT Enterprise bietet zudem zuverlässige Compliance-Features wie SOC 2- und HIPAA-Konformität, doch Sie müssen Ihre Daten weiterhin einem Drittanbieter anvertrauen.

🏆 Fazit: Mixtral gewinnt, da seine Self-Hosting-Funktionen Ihnen die besten Garantien im Bereich des Datenschutzes bieten.

Sollten Sie sich für Mixtral oder ChatGPT entscheiden?

Die kurze Antwort lautet: Es hängt davon ab, welche Anforderungen Sie haben. Hier ist ein einfacher Leitfaden, der Ihnen bei der Entscheidung helfen soll:

- Entscheiden Sie sich für Mixtral, wenn: Ihr Team über MLOps-Know-how verfügt, ein Modell für eine spezielle Aufgabe feinabstimmen muss oder strenge Datenschutzvorschriften hat, die ein Selbsthosting erfordern

- Entscheiden Sie sich für ChatGPT, wenn: Ihr Team Wert auf schnelle Integration, eine ausgefeilte Out-of-the-Box-Erfahrung und ein umfangreiches Ökosystem an Tools legt

Die bessere Antwort lautet: Sie müssen sich nicht für nur eines entscheiden. Viele Teams nutzen einen hybriden Ansatz und setzen ChatGPT für allgemeine Unterstützung sowie ein selbst gehostetes Mixtral für sensible, interne Aufgaben ein.

Und mit Tools wie ClickUp können Sie echte Steigerungen der Produktivität erzielen, indem Sie beide Modelle in einem einzigen Converged AI Workspace nutzen und deren Ergebnisse direkt mit Ihren Aufgaben, Dokumenten und Projekten verknüpfen – so werden die mit KI gewonnenen Erkenntnisse sofort Teil Ihrer eigentlichen Arbeit, ganz gleich, welches Modell Sie verwenden.

Lernen Sie ClickUp kennen: Der beste Weg, ChatGPT und Mixtral in KI-EntwicklungsWorkflows einzusetzen

Die Entscheidung zwischen Mixtral und ChatGPT ist meist eine Abwägung verschiedener Faktoren.

Mixtral bietet Ihnen Flexibilität bei der Gewichtung und Kontrolle über die Bereitstellung. ChatGPT liefert Ihnen hochpräzise Ergebnisse und eine ausgefeilte Optimierung der Unterhaltung.

Es gibt jedoch ein praktisches Problem, mit dem Sie als Entwickler wahrscheinlich stoßen werden: Beide tools befinden sich in der Regel außerhalb Ihres eigentlichen Entwicklungs-Workflows.

Sie geben auf einer Registerkarte eine Eingabe in ein KI-Modell ein, kopieren das Ergebnis, fügen es an anderer Stelle ein und wandeln es dann manuell in Aufgaben, Dokumentation oder Aktionspunkte um.

Mit der Zeit führt dies zu einer Tool-Flut: Sie nutzen KI zur Ideenfindung, ein anderes tool zur Verwaltung der Arbeit, ein weiteres für die Dokumentation und noch ein anderes für die Automatisierung.

ClickUp geht das anders an.

Anstatt KI-Modelle als separate Assistenten zu behandeln, bindet ClickUp sie direkt in einen Workspace ein, in dem Ihre Code-Diskussionen, Dokumentationen, Aufgaben und Automatisierungen bereits vorhanden sind.

Das bedeutet, dass Ihre KI-Ergebnisse nicht nur Ideen generieren – sie lassen sich sofort in die Arbeit integrieren, die Sie und Ihr Team zu erledigen haben.

So funktioniert die Arbeit.

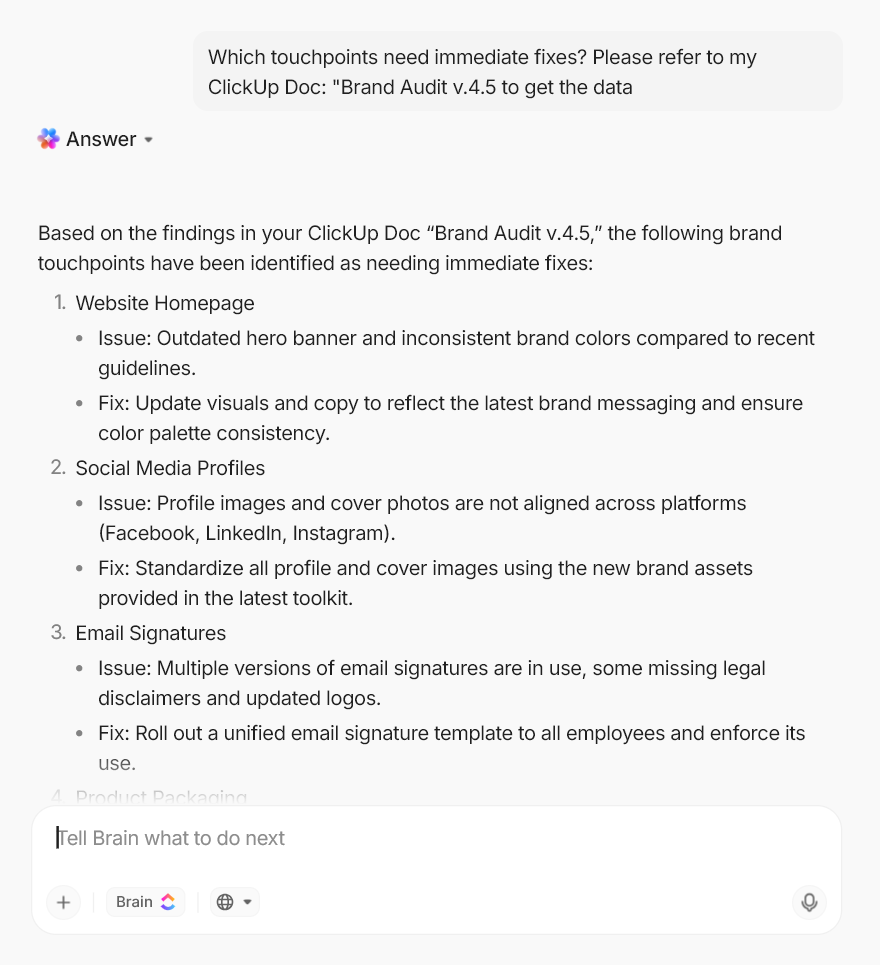

Vorteil Nr. 1 von ClickUp: Zugriff auf mehrere KI-Modelle in einem Workspace

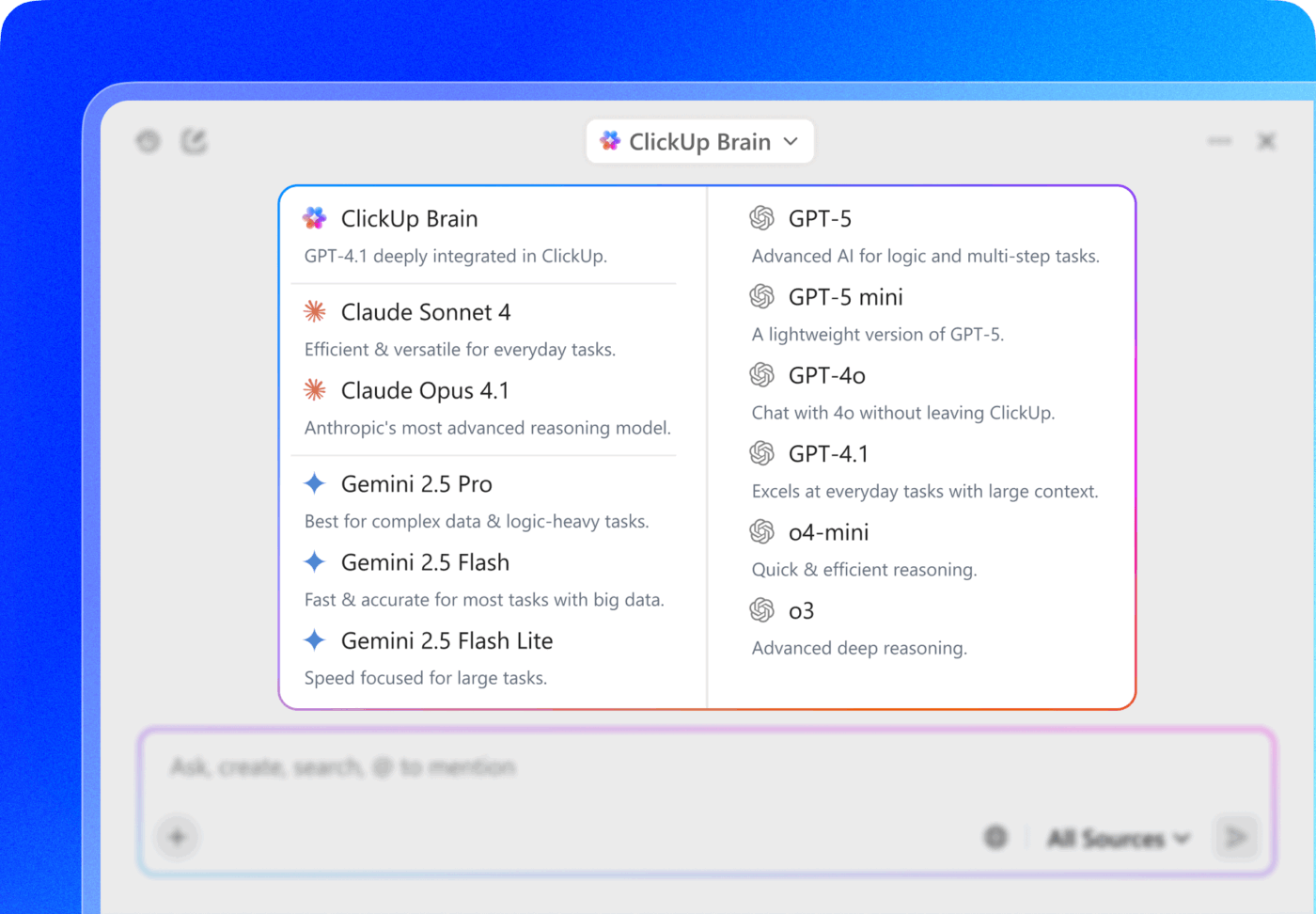

Mit ClickUp Brain sind Sie nicht auf ein einziges KI-Modell beschränkt. Sie können direkt in Ihrem Workspace auf ChatGPT, Gemini, Claude und andere führende Modelle zugreifen und je nach Aufgabe zwischen ihnen wechseln.

Noch besser: Dank Verbindungen über Zapier können Sie Modelle wie Mixtral in Ihren Workspace einbinden, sodass Sie und Ihr Team mit Open-Weight-Modellen experimentieren können, während Ihre Arbeit weiterhin an einem Ort organisiert bleibt.

Für Sie als Entwickler ist diese Flexibilität entscheidend.

Sie könnten ChatGPT für strukturierte Dokumentationen nutzen, ein anderes Tool für das Brainstorming von Architekturideen und Mixtral für die Zusammenfassung von Code-Reviews. Anstatt also zwischen Registerkarten hin- und herzuwechseln, um mehrere KI-Tools zu öffnen, können Sie Antworten direkt dort generieren, wo Ihre Projektdaten bereits gespeichert sind.

💡 Profi-Tipp: Probieren Sie aus, denselben Befehl in Mixtral und ChatGPT innerhalb von ClickUp Brain auszuführen. Vergleichen Sie die Ergebnisse, entscheiden Sie dann, welches produktionsreif ist, und verknüpfen Sie das bevorzugte Ergebnis mit Ihrer Aufgabe – ideal für kritische Features, bei denen es auf Genauigkeit ankommt.

Vorteil Nr. 2 von ClickUp: Setzen Sie KI-Coding-Agenten parallel zu Ihren Aufgaben ein

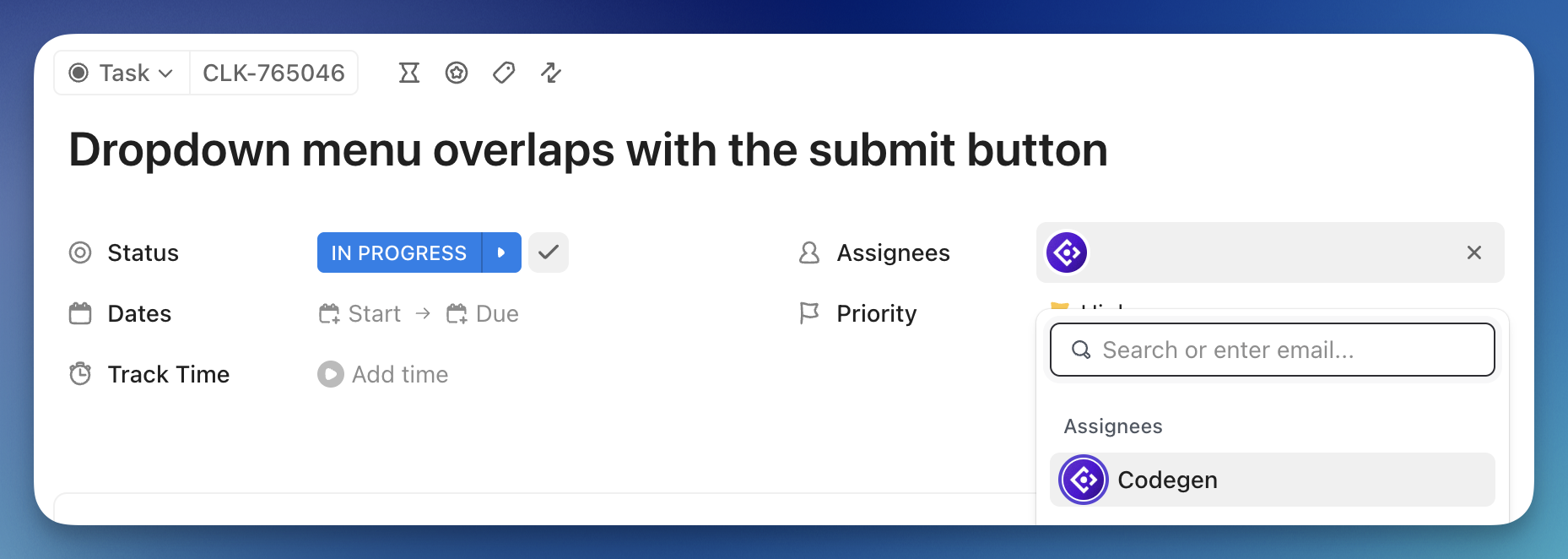

Als Entwickler nutzen Sie vielleicht bereits Tools wie Cursor-AI-Agenten oder Codegen-AI-Agenten, um Code zu generieren, Funktionen zu überprüfen oder Logik umzugestalten.

Mit ClickUp können Sie diese Workflows in dieselbe Umgebung integrieren, in der die Nachverfolgung Ihrer Entwicklungsarbeit erfolgt.

Sie können Cursor- oder Codegen-KI-Agenten per @mention erwähnnen, als würden Sie einen Teamkollegen erwähnnen, ihnen eine ClickUp-Aufgabe zuweisen, und sie arbeiten im Hintergrund, sodass Sie sich auf wichtigere Aufgaben konzentrieren können. Sobald die Aufgabe abgeschlossen ist, informiert Sie der Agent automatisch.

An diesem Punkt entscheiden Sie, ob Sie die Korrektur implementieren, sie einem anderen Entwickler zuweisen oder sie in den nächsten Sprint verschieben.

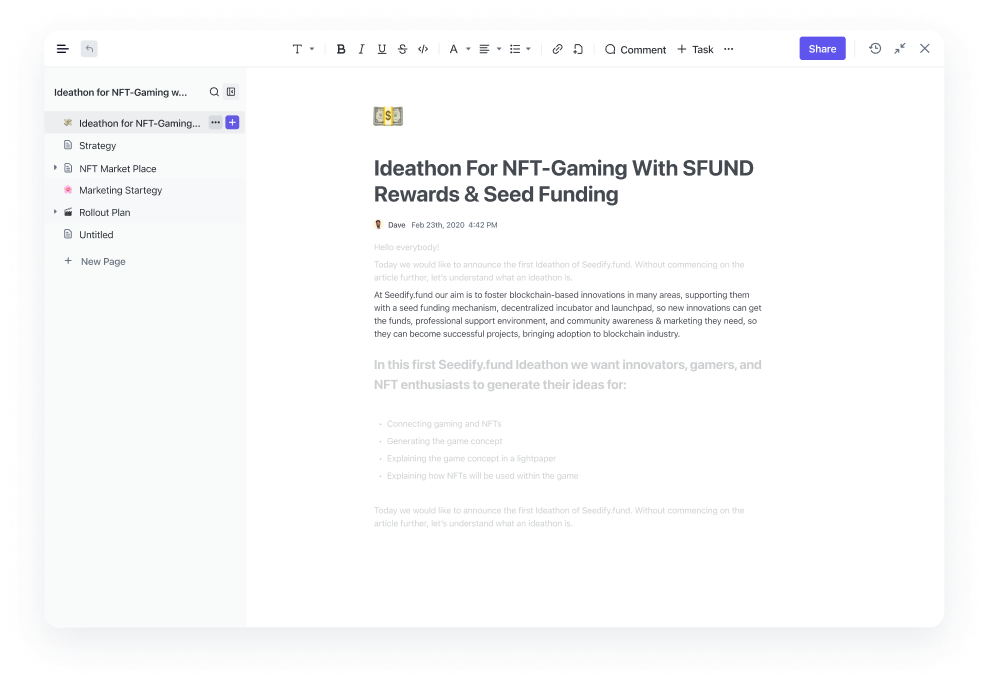

Vorteil Nr. 3 von ClickUp: Zentralisierte Dokumentation mit ClickUp Docs

Entwicklungsprozesse sind in der Regel mit einem hohen Dokumentationsaufwand verbunden: API-Referenzen, Architektur-Notizen, Einführungsanleitungen und Dokumentationen zur Fehlerbehebung.

Ohne ein zentrales System sind diese Ressourcen am Ende über Google Docs, interne Wikis oder Notion-Seiten verstreut.

Mit ClickUp Docs können Sie Ihre gesamte technische Dokumentation direkt neben den Aufgaben und Projekten speichern, die sie in ClickUp Aufgaben unterstützen.

Wenn Sie ein neues System für die Authentifizierung dokumentieren, können Sie in ClickUp Docs eine technische Spezifikation erstellen, diese mit den Entwicklungsaufgaben verknüpfen, die sie in ClickUp Aufgaben umsetzen, und die Dokumentation aktualisieren, während sich das Feature weiterentwickelt.

Und wenn Sie Einblicke in den Fortschritt der Aufgaben während des gesamten Projekts benötigen, fragen Sie einfach ClickUp Brain, die in Ihren Workspace integrierte Intelligenz-Ebene, und diese zieht die Antworten direkt aus diesen Dokumenten, mit dem vollständigen Kontext Ihrer Projektdaten.

Das bedeutet, dass Ihre Dokumentation nicht einfach in einer separaten Wissensdatenbank verbleibt, sondern Teil des aktiven Workflows des Projekts wird.

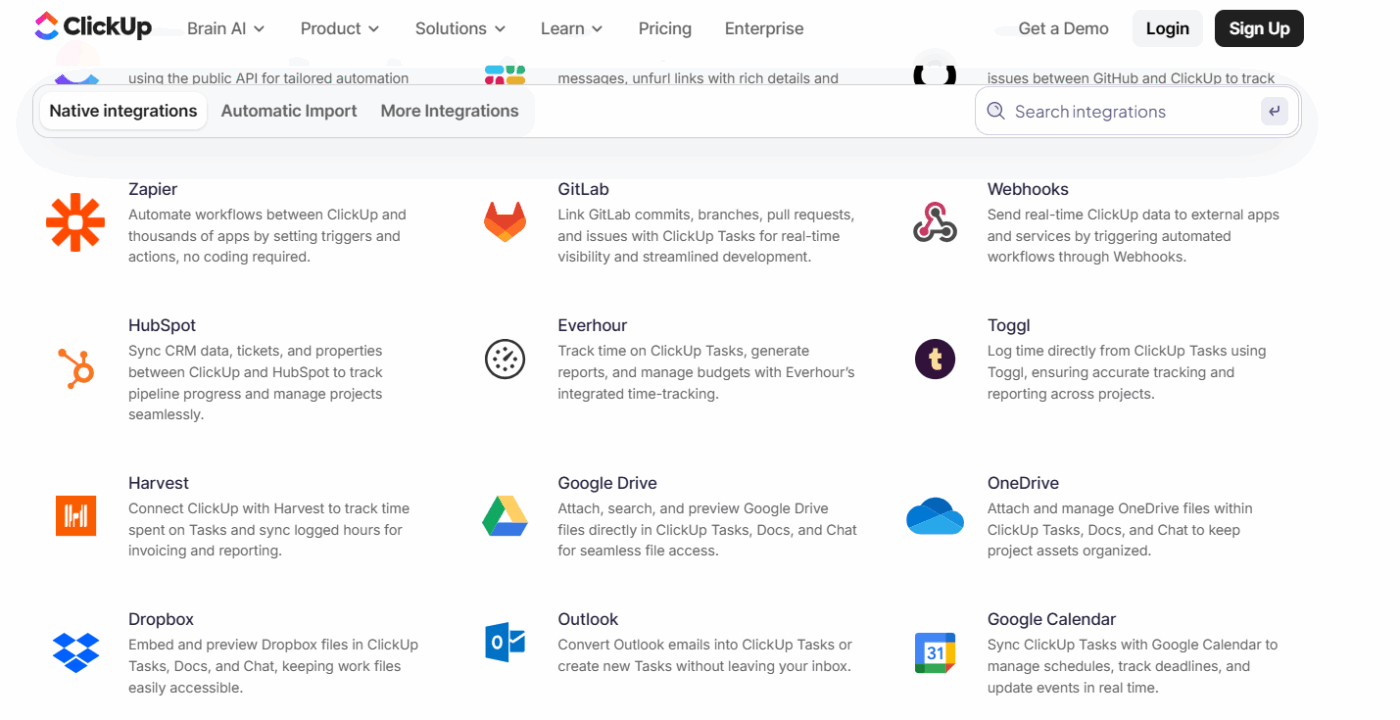

Vorteil Nr. 4 von ClickUp: Externe Entwicklertools mit ClickUp verbinden

ClickUp-Integrationen schaffen Verbindungen zwischen externen Plattformen und machen es einfach, historisches Wissen und Aktualisierungen in den Workspace zu integrieren, egal ob es sich um GitHub, Slack, Figma oder andere verbundene Apps handelt.

Dokumentation oder Code-Referenzen von GitHub können direkt mit entsprechenden Aufgaben verknüpft werden. Updates oder Diskussionen aus Slack können in umsetzbare Aufgaben umgewandelt werden. Sogar Dateien oder Projekt-Assets aus anderen tools können in denselben Workspace integriert werden.

Profi-Tipp: Mit ClickUp Chat können Sie das Hin- und Herwechseln zwischen Slack und Projekt-Aufgaben komplett vermeiden – halten Sie alle Team-Diskussionen und Entwickler-Workflows direkt in ClickUp.

Markieren Sie Teamkollegen sofort und fügen Sie Kommentare direkt aus Chat-Nachrichten in Aufgaben ein, ohne den Workspace verlassen zu müssen, damit nichts in den Unterhaltungen untergeht. Alle Ihre Aktualisierungen, Entscheidungen und Nachfassaktionen bleiben im Kontext des Projekts, was die Zusammenarbeit schneller und wesentlich übersichtlicher macht.

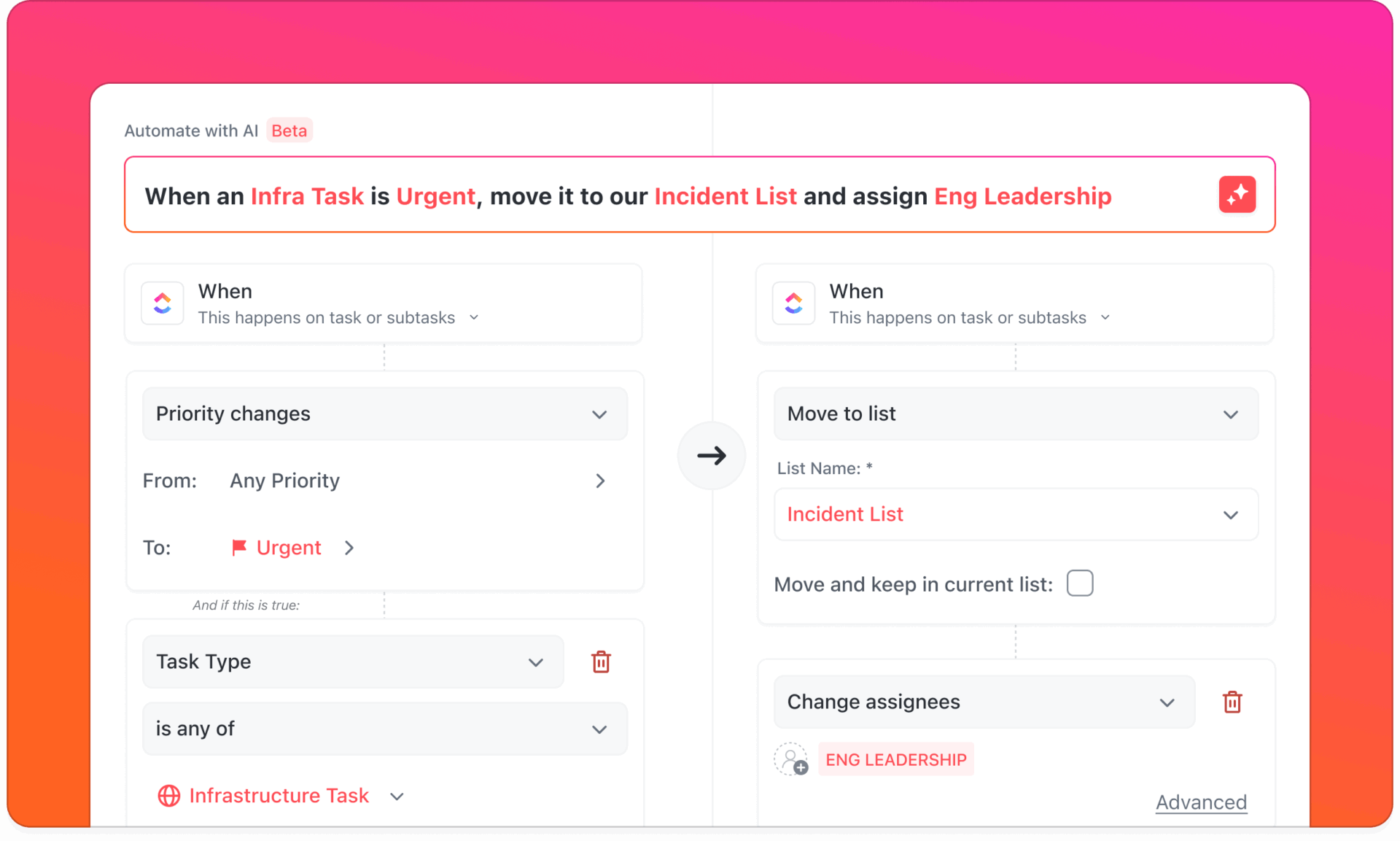

Vorteil Nr. 5 von ClickUp: Automatisieren Sie wiederholende EntwicklungsWorkflows

ClickUp Automatisierungen eliminieren die manuellen Schritte, die Entwicklungsteams oft ausbremsen. Sie können Aktionen basierend auf dem Status der Aufgabe, Terminen oder benutzerdefinierten Feldern auslösen.

Wenn ein Feature den Status „Bereit für die Qualitätssicherung“ erreicht, kann ClickUp die Aufgabe automatisch einem Tester zuweisen und das QA-Team benachrichtigen.

Wenn der Tester einen Fehler meldet, kann die Automatisierung die Aufgabe erneut öffnen, den zuständigen Entwickler taggen und das Problem zurück in das Sprint-Backlog verschieben. So läuft Ihr Workflow in jeder beliebigen Phase automatisch weiter.

Starten Sie mit Ihrer KI bei Clicking-Up

Damit KI wirklich für Sie arbeitet, wählen Sie nicht nur ein Modell, sondern einen Workspace, der Ihre Modelle mit Ihrer Arbeit verbindet. Mixtral bietet Flexibilität, offene Gewichte und Kontrolle. ChatGPT liefert ausgefeilte Ergebnisse und ein riesiges Ökosystem. Beide sind hervorragend, aber für sich allein? Sie existieren außerhalb Ihres Workflows, sodass Sie zwischen Registerkarten hin- und herwechseln, Ergebnisse kopieren und einfügen und Erkenntnisse manuell in Aufgaben oder Dokumentation umsetzen müssen.

Durch die direkte Einbettung von KI in Ihren Workspace können Sie mehrere Modelle parallel nutzen, Ergebnisse mit Aufgaben und Dokumenten verknüpfen, mit Teammitgliedern zusammenarbeiten, Wissen zentralisieren und wiederholende Workflows automatisieren. So bleiben die Erkenntnisse, die Sie mit Mixtral, ChatGPT oder einer anderen KI gewinnen, nicht in einem separaten Tool verborgen, sondern werden sofort Teil Ihrer laufenden Arbeit.

Sind Sie bereit, es in Aktion zu sehen? Starten Sie kostenlos mit ClickUp ✨.

Häufig gestellte Fragen (FAQ)

Mixtral-8x7B nutzt eine „Mixture-of-Experts“-Architektur, was so viel bedeutet, als hätte man acht Spezialmodelle in einem, während Standardmodelle wie Mistral 7B einzelne, dichte Modelle sind. Dadurch kann Mixtral die Leistung eines viel größeren Modells mit höherer Effizienz liefern.

Ja, dank der Open-Weight-Lizenz von Mixtral können Sie das Modell auf Ihrer eigenen Hardware ausführen und so die vollständige Kontrolle über Ihre Daten behalten. Dies erfordert eine leistungsstarke GPU, aber quantisierte Versionen des Modells können auch auf handelsüblicher Hardware ausgeführt werden.

Wenn Sie KI täglich für das Programmieren, Debuggen und die Dokumentation nutzen, lohnen sich die schnelleren Antwortzeiten und die Priorität von ChatGPT Plus wahrscheinlich trotz der Kosten für das Abonnement. Für Gelegenheitsbenutzer könnte es wirtschaftlicher sein, bei der nutzungsbasierten API zu bleiben.

Sie können eine Plattform nutzen, die mehrere KI-Modelle in einer einzigen Oberfläche zusammenfasst. ClickUp Brain bietet beispielsweise Zugriff auf Modelle von OpenAI, Anthropic und Google, sodass Sie für jede Aufgabe die beste KI nutzen können, ohne Ihren Workspace verlassen zu müssen.