Escolher um modelo de IA para o seu fluxo de trabalho de desenvolvimento pode parecer uma questão simples: Qual devemos usar?

Mas, por trás disso, há uma decisão mais importante sobre como você deseja construir e executar a IA em sua pilha de tecnologias.

Você prefere o Mixtral, o modelo de peso aberto da Mistral AI que oferece às equipes mais controle sobre a implantação e a personalização? Ou o ChatGPT, o assistente de IA amplamente utilizado da OpenAI, conhecido por seus poderosos modelos proprietários e um ecossistema fácil de usar?

Essa escolha afeta tudo — desde o nível de controle que você tem sobre a infraestrutura até a rapidez com que você pode lançar recursos de IA.

Neste guia, vamos comparar o Mixtral e o ChatGPT em termos de arquitetura, desempenho, personalização, custo e privacidade — para que você possa decidir o que melhor se adapta à sua equipe. Também mostraremos como muitos desenvolvedores estão evitando o dilema ou um ou outro ao usar vários modelos lado a lado em seu fluxo de trabalho com ferramentas completas como o ClickUp. ⚒️

Pronto? Vamos começar.

Mixtral vs. ChatGPT em resumo

O Mixtral e o ChatGPT são excelentes ferramentas para desenvolvedores, mas cada um se destaca em áreas diferentes. Antes de entrarmos em detalhes, aqui está um breve resumo de seus recursos:

| Recurso/Categoria | Mixtral | ChatGPT | ClickUp Brain |

|---|---|---|---|

| Arquitetura do modelo | Mistura de especialistas com pesos abertos (8x7B); a ativação esparsa significa que apenas um subconjunto de parâmetros está ativo por token, reduzindo o custo de inferência | Arquitetura de transformador proprietária; um modelo denso com todos os parâmetros ativos durante a inferência | Acesso a múltiplos modelos LLM, incluindo Claude, GPT, Gemini e DeepSeek, em um espaço de trabalho convergente |

| Disponibilidade em código aberto | Pesos totalmente abertos sob a licença Apache 2.0; você pode baixá-lo e modificá-lo livremente | Código fechado; você não tem acesso aos pesos do modelo nem aos detalhes da arquitetura | Uma plataforma SaaS que acessa vários provedores de modelos |

| Janela de contexto | Até 32 mil tokens nativos; contexto estendido disponível em algumas implantações | 8K-128K tokens, dependendo da versão do modelo (o GPT-4 Turbo suporta 128K) | Contexto sensível ao ambiente de trabalho que extrai automaticamente informações de suas tarefas, documentos e conversas |

| Opção de hospedagem própria | Sim; você pode executá-lo localmente ou em uma infraestrutura de nuvem privada | Não; ele só é acessível via API através dos servidores da OpenAI | Baseado na nuvem com controles de segurança corporativos |

| Suporte ao ajuste fino | O ajuste fino completo e os adaptadores LoRA/QLoRA são suportados | O ajuste fino está disponível de forma limitada em modelos selecionados por meio da API | Utiliza modelos de base; a personalização é feita por meio de prompts e do contexto do espaço de trabalho |

| Tamanho da equipe | De desenvolvedores independentes a grandes equipes de engenharia com capacidade de MLOps | Equipes de qualquer tamanho que se sintam à vontade com fluxos de trabalho baseados em API | Equipes de todos os tamanhos em todos os departamentos |

| Preços | Gratuito (se hospedado localmente); os custos da API variam de acordo com o provedor | Preços de API baseados em assinatura e uso | Está disponível um plano gratuito para sempre |

Como avaliamos softwares na ClickUp

Nossa equipe editorial segue um processo transparente, baseado em pesquisas e independente de fornecedores, para que você possa confiar que nossas recomendações se baseiam no valor real do produto.

Aqui está um resumo detalhado de como avaliamos softwares na ClickUp.

Visão geral do Mixtral

O Mixtral é um modelo de peso aberto da Mistral AI, construído em torno de uma arquitetura mixture-of-experts (MoE). Pense nisso como uma equipe de oito consultores especializados. Em vez de todos trabalharem em todas as tarefas, o modelo recorre apenas aos especialistas de que precisa.

Para cada solicitação, o Mixtral seleciona os dois especialistas mais relevantes para gerar a resposta, enquanto os demais permanecem inativos. O resultado: você obtém um desempenho semelhante ao de um modelo muito maior, mas com muito menos recursos de computação utilizados por solicitação.

Prós do Mixtral

- Peso aberto sob a licença Apache 2.0: Você tem acesso total aos pesos do modelo, o que permite hospedá-lo por conta própria, ajustá-lo e modificá-lo sem restrições de licenciamento. Isso é uma grande vantagem se sua equipe trabalha sob rigorosas exigências de propriedade intelectual ou conformidade

- Eficiência da mistura de especialistas: Embora o modelo tenha 47 bilhões de parâmetros, ele ativa apenas cerca de 13 bilhões por token, permitindo que você obtenha o poder de um modelo muito maior com menores custos de computação e respostas mais rápidas

- Excelente desempenho multilíngue: lida com eficácia com código e linguagem natural em diversas linguagens de programação e idiomas humanos

- Flexibilidade de hospedagem própria: você pode executá-lo em sua própria infraestrutura, o que lhe dá controle total sobre seus dados e custos mais previsíveis à medida que o uso cresce

- Comunidade de código aberto ativa: você se beneficia de um ecossistema crescente de ferramentas, variantes de modelos otimizadas pela comunidade e guias úteis de implantação

Contras do Mixtral

- Custos de infraestrutura: A hospedagem própria não é plug-and-play. Ela requer conhecimento em MLOps, recursos de GPU dedicados e manutenção contínua

- Ecossistema menor: possui menos integrações pré-configuradas, plug-ins e ferramentas de terceiros em comparação com o ecossistema extenso e maduro do ChatGPT

- Qualidade variável entre os provedores: Se você usar uma API de terceiros, poderá encontrar preços, limites de taxa e confiabilidade inconsistentes

- Menos refinado para tarefas de conversação: Embora seja forte na geração de código, você pode perceber que suas habilidades de conversação parecem menos refinadas em comparação com o ChatGPT, que passou por um extenso ajuste específico para chat.

Preços do Mixtral (custo por 1 milhão de tokens)

- Gratuito

- Custo: US$ 0,70 por 1 milhão de tokens

- Resultado: US$ 0,70 por 1 milhão de tokens

Visão geral do ChatGPT

O ChatGPT é a IA conversacional carro-chefe da OpenAI, disponível para desenvolvedores por meio de APIs como GPT-4, GPT-4 Turbo e GPT-4o. Seu maior ponto forte vem do extenso Reinforcement Learning from Human Feedback (RLHF), em que revisores humanos avaliam e classificam as respostas para tornar o modelo mais útil, preciso e seguro.

Para você, como desenvolvedor, isso significa que as respostas obtidas geralmente são refinadas e bem estruturadas desde o início, especialmente para casos de uso conversacionais.

Prós do ChatGPT

- Respostas maduras e refinadas: Graças ao RLHF, o ChatGPT gera consistentemente código útil e bem comentado, além de documentação clara, mesmo com prompts mínimos

- Ecossistema abrangente: É compatível com milhares de plug-ins, integrações e ferramentas, com forte suporte em IDEs e frameworks populares

- Infraestrutura de API confiável: você se beneficiará de um tempo de atividade de nível empresarial e de suporte oferecido por uma organização bem financiada, com forte foco nas relações com desenvolvedores

- Recursos multimodais: Os modelos GPT-4 mais recentes são capazes de processar imagens, voz e arquivos, o que é perfeito se você quiser, por exemplo, analisar uma interface de usuário a partir de uma captura de tela ou trabalhar com diferentes tipos de fluxos de trabalho de desenvolvimento

- Baixa barreira de entrada: Não é necessária nenhuma configuração de infraestrutura. Você pode começar a desenvolver imediatamente com apenas uma chave de API

Contras do ChatGPT

- Código fechado e proprietário: você não tem acesso aos pesos do modelo, o que significa que não pode hospedá-lo por conta própria, ajustá-lo livremente ou auditar detalhadamente seu comportamento

- Preocupações com a privacidade dos dados: Todas as suas solicitações são processadas nos servidores da OpenAI, o que pode ser um problema se você estiver trabalhando em setores regulamentados com regras de conformidade ou bases de código confidenciais

- Imprevisibilidade de custos em escala: Se você estiver executando aplicativos de alto volume, lembre-se de que o uso baseado em tokens pode aumentar rapidamente, pois quanto mais você usa, mais custa

- Risco de dependência de fornecedor: Se você apostar tudo em um único fornecedor, corre o risco de ficar preso a ele. Quaisquer alterações na API ou atualizações de serviço por parte deles podem interromper seu fluxo de trabalho

Preços do ChatGPT

- Gratuito

- Go: US$ 8/mês por usuário

- Mais: US$ 20/mês por usuário

- Pro: US$ 200/mês por usuário

Mixtral x ChatGPT: comparação das principais funcionalidades

Vamos analisar como o Mixtral e o ChatGPT se comparam em relação aos recursos que são importantes para você.

Recurso nº 1: Benchmarks de codificação e geração de código

O ChatGPT, especialmente o GPT-4, tende a escrever código como um colega de equipe atencioso. Mesmo quando você usa prompts básicos, ele produz um código detalhado, adiciona comentários e lida com erros de forma imediata. Isso o torna excelente para gerar código pronto para produção.

O Mixtral, por outro lado, consegue igualar o desempenho, mas é mais conciso por padrão, o que significa que você precisaria dedicar tempo extra à engenharia de prompts para obter o mesmo nível de refinamento.

E para código básico e padronizado, qualquer um dos modelos funciona bem. Mas quando as coisas ficam complexas, a saída mais clara e refinada do ChatGPT geralmente lhe dá uma vantagem.

🏆 Veredicto: O ChatGPT leva a melhor por oferecer um código mais refinado e pronto para produção.

💡 Dica profissional: Não se limite a comparar modelos — compare-os dentro do seu fluxo de trabalho. Teste como as saídas do Mixtral e do ChatGPT se integram ao seu processo de desenvolvimento real, e não apenas a comandos isolados. Isso economiza tempo e evita ter que alternar entre abas mais tarde.

Recurso nº 2: Janela de contexto e tratamento de textos longos

Trabalhar em uma base de código grande e complexa é difícil quando seu assistente de IA esquece do que você estava falando há três comandos atrás. É por isso que a janela de contexto — a quantidade de texto que um modelo consegue lembrar de uma só vez — é muito importante para você como desenvolvedor. Ambas as ferramentas abordam isso de maneira diferente:

- Mixtral-8x7B: Oferece uma janela de contexto nativa de 32.000 tokens, o que é substancial para arquivos grandes e conversas longas

- ChatGPT: Pode processar de 8.000 a 128.000 tokens. Com a enorme janela de 128K do GPT-4 Turbo, você poderia, teoricamente, alimentar o sistema com um pequeno repositório de código em um único prompt. Mas lembre-se: janelas maiores podem sair mais caras

🏆 Veredicto: O GPT-4 Turbo leva a melhor, graças à sua enorme capacidade de lidar com bases de código gigantescas, mas o Mixtral ainda tem um ótimo desempenho dentro de sua janela de 32 mil tokens, o que o torna eficiente para a maioria dos projetos.

📮 ClickUp Insight: Apenas 12% dos participantes da nossa pesquisa utilizam recursos de IA integrados em pacotes de produtividade. Essa baixa adoção sugere que as implementações atuais podem carecer da integração contextual e perfeita que levaria os usuários a migrar de suas plataformas conversacionais independentes preferidas.

Por exemplo, a IA consegue executar um fluxo de trabalho automatizado com base em um comando de texto simples do usuário? O ClickUp Brain consegue! A IA está profundamente integrada a todos os aspectos do ClickUp, incluindo, entre outras coisas, resumir conversas no chat, redigir ou revisar textos, extrair informações da área de trabalho, gerar imagens e muito mais! Junte-se aos 40% dos clientes do ClickUp que substituíram mais de três aplicativos pelo nosso aplicativo completo para o trabalho!

Recurso nº 3: Acesso à API e integrações para desenvolvedores

A qualidade de um modelo de IA não importa se integrá-lo ao seu fluxo de trabalho for um processo complicado e demorado. Documentação deficiente, falta de SDKs e uma API pouco confiável podem acabar com um projeto antes mesmo de ele começar.

A OpenAI oferece uma experiência de integração para desenvolvedores altamente refinada, com APIs bem documentadas, SDKs para as principais linguagens de programação e recursos avançados, como chamada de funções.

Em contrapartida, o acesso à API do Mixtral está fragmentado entre vários provedores (como a própria plataforma do Mixtral, a Together AI ou a Fireworks), cada um com sua própria documentação e nível de confiabilidade. Isso, compreensivelmente, oferece opções, mas também significa que você precisa lidar com diferentes documentações, níveis de confiabilidade e configurações, o que pode gerar inconsistências.

🏆 Veredicto: Empate, pois a API da OpenAI oferece uma excelente experiência de desenvolvimento para integração rápida, enquanto o Mixtral proporciona mais flexibilidade na escolha do provedor para equipes com necessidades específicas de infraestrutura.

Recurso nº 4: Opções de personalização e hospedagem própria

Modelos de IA prontos para uso são ótimos, mas a personalização faz uma grande diferença quando sua equipe tem um estilo de codificação único, uma base de código proprietária ou um domínio especializado. Se você não puder adaptar o modelo às suas necessidades específicas, estará perdendo muito valor.

Esse é o maior ponto forte do Mixtral. Como ele possui pesos abertos, você pode:

- Ajuste-o: Treine o modelo com seu próprio código para torná-lo um especialista em seu domínio específico

- Use adaptadores: aplique técnicas eficientes como LoRA e QLoRA para personalizar o modelo sem precisar treiná-lo novamente do zero

- Quantize: Reduza o tamanho do modelo para implantação em hardware menor e mais acessível

O ChatGPT, por outro lado, oferece personalização limitada por meio de sua API, mas você não pode acessar os pesos do modelo subjacente. Você está fundamentalmente limitado ao que a OpenAI permite.

🏆 Veredicto: O Mixtral se destaca como a melhor opção em termos de personalização e hospedagem própria, tornando-se a escolha ideal para equipes com necessidades específicas ou requisitos rigorosos de dados.

Recurso nº 5: Privacidade e segurança de dados para equipes de desenvolvimento

Para muitas equipes de engenharia, enviar código proprietário ou dados confidenciais de clientes para uma API de terceiros nem sequer é uma opção.

A opção de auto-hospedagem do Mixtral oferece controle total sobre os dados, um princípio fundamental para uma privacidade e segurança de dados robustas, já que suas solicitações e seu código nunca saem da sua própria infraestrutura. Isso é ideal para equipes em setores regulamentados, como finanças ou saúde.

O ChatGPT Enterprise também oferece recursos robustos de conformidade, como certificação SOC 2 e HIPAA, mas você ainda precisa confiar seus dados a um terceiro.

🏆 Veredicto: O Mixtral vence, pois seus recursos de auto-hospedagem oferecem as melhores garantias de privacidade.

Você deve escolher o Mixtral ou o ChatGPT?

A resposta curta é: depende das suas necessidades. Aqui está uma estrutura simples para orientar sua decisão:

- Escolha o Mixtral se: Sua equipe tiver experiência em MLOps, precisar ajustar um modelo para uma tarefa especializada ou tiver regras rígidas de privacidade de dados que exijam hospedagem própria

- Escolha o ChatGPT se: Sua equipe prioriza integração rápida, uma experiência pronta para uso e um vasto ecossistema de ferramentas

A resposta mais adequada é: você não precisa escolher apenas um. Muitas equipes utilizam uma abordagem híbrida, aproveitando o ChatGPT para assistência geral e um Mixtral auto-hospedado para tarefas internas e confidenciais.

E com ferramentas como o ClickUp, você pode obter ganhos reais de produtividade usando ambos os modelos dentro de um único Espaço de Trabalho de IA Convergente, conectando seus resultados diretamente às suas tarefas, documentos e projetos — assim, os insights gerados com a IA passam a fazer parte imediatamente do trabalho que você está realizando, independentemente do modelo utilizado.

Conheça o ClickUp: a melhor maneira de usar o ChatGPT e o Mixtral em fluxos de trabalho de desenvolvimento de IA

A escolha entre o Mixtral e o ChatGPT geralmente se resume a uma questão de compromissos.

O Mixtral oferece flexibilidade de pesos abertos e controle de implantação. O ChatGPT oferece resultados altamente refinados e um ajuste conversacional robusto.

Mas há uma questão prática com a qual você provavelmente se deparará como desenvolvedor: ambas as ferramentas geralmente ficam fora do seu fluxo de trabalho de desenvolvimento propriamente dito.

Você aciona um modelo de IA em uma aba, copia o resultado, cola em outro lugar e, em seguida, transforma-o manualmente em tarefas, documentação ou itens de ação.

Com o tempo, isso gera uma proliferação de ferramentas: você usa IA para gerar ideias, outra ferramenta para gerenciar o trabalho, outra para documentação e mais outra para automação.

O ClickUp aborda isso de maneira diferente.

Em vez de tratar os modelos de IA como assistentes separados, o ClickUp os integra diretamente em um espaço de trabalho onde suas discussões sobre código, documentação, tarefas e automação já estão presentes.

Isso significa que os resultados da IA não se limitam a gerar ideias — eles se integram imediatamente ao trabalho que você e sua equipe estão realizando.

Veja como isso funciona.

Vantagem nº 1 do ClickUp: acesse vários modelos de IA em um único espaço de trabalho

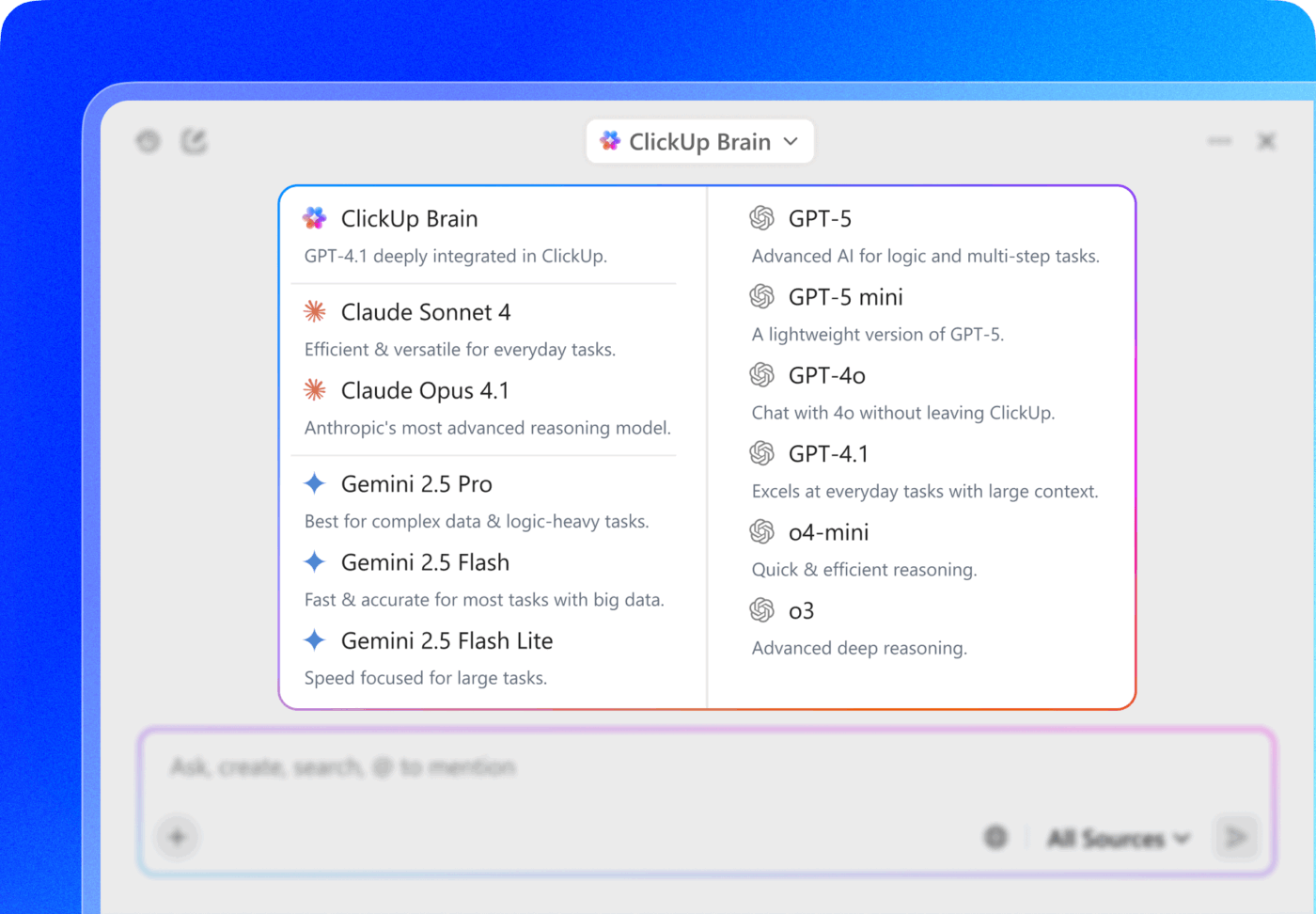

Com o ClickUp Brain, você não fica limitado a um único modelo de IA. Você pode acessar o ChatGPT, o Gemini, o Claude e outros modelos líderes diretamente dentro do seu espaço de trabalho e alternar entre eles dependendo da tarefa.

Melhor ainda, as integrações via Zapier permitem que você conecte modelos como o Mixtral ao seu espaço de trabalho, para que você e sua equipe possam experimentar modelos de peso aberto enquanto mantêm seu trabalho organizado em um único lugar.

Para você, como desenvolvedor, essa flexibilidade é importante.

Você pode usar o ChatGPT para documentação estruturada, outro para debater ideias de arquitetura e o Mixtral para resumir revisões de código. Assim, em vez de alternar entre abas para abrir várias ferramentas de IA, você pode gerar respostas diretamente onde os dados do seu projeto já estão armazenados.

💡 Dica profissional: Experimente executar o mesmo prompt no Mixtral e no ChatGPT dentro do ClickUp Brain. Compare os resultados, decida qual está pronto para produção e vincule o resultado preferido à sua tarefa — perfeito para recursos críticos em que a precisão é fundamental.

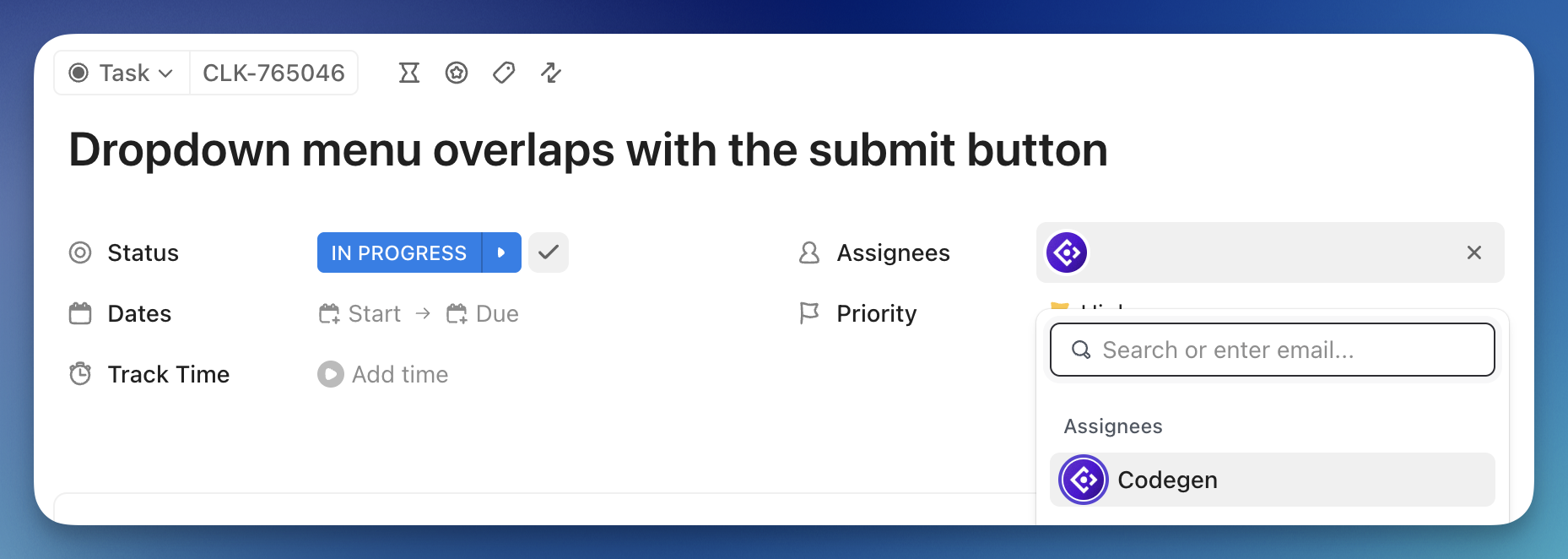

Vantagem nº 2 do ClickUp: use agentes de codificação com IA junto com suas tarefas

Como desenvolvedor, você talvez já utilize ferramentas como os agentes de IA do Cursor ou do Codegen para gerar código, revisar funções ou refatorar lógica.

O ClickUp permite que você incorpore esses fluxos de trabalho no mesmo ambiente em que seu trabalho de desenvolvimento é acompanhado.

Você pode @mencionar os agentes Cursor ou Codegen AI como se estivesse chamando um colega de equipe, atribuir uma tarefa do ClickUp a eles, e eles trabalharão em segundo plano, liberando você para se concentrar em tarefas mais importantes. Assim que a tarefa for concluída, o agente irá atualizá-lo automaticamente.

Nesse momento, você decide se vai implementar a correção, atribuí-la a outro desenvolvedor ou adiá-la para o próximo sprint.

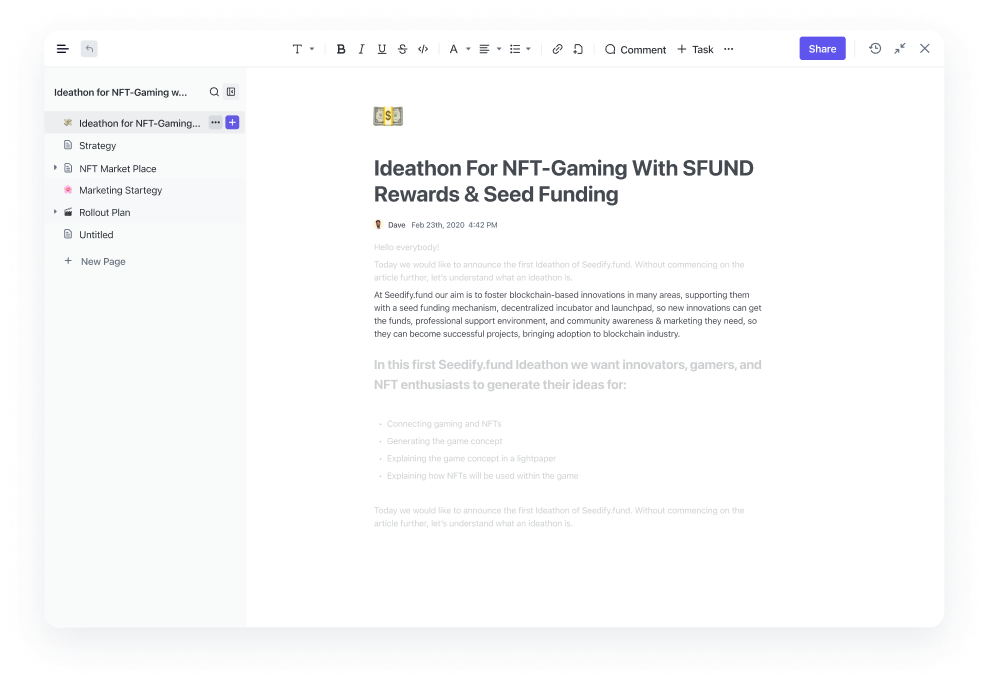

Vantagem nº 3 do ClickUp: documentação centralizada com o ClickUp Docs

Os processos de desenvolvimento geralmente envolvem muita documentação: referências de API, notas de arquitetura, guias de integração e documentação de solução de problemas.

Sem um sistema centralizado, esses recursos acabam espalhados pelo Google Docs, wikis internas ou páginas do Notion.

Com o ClickUp Docs, você pode armazenar toda a sua documentação técnica junto às tarefas e projetos que ela apoia no ClickUp Tasks.

Se você estiver documentando um novo sistema de autenticação, pode criar uma especificação técnica no ClickUp Docs, vinculá-la às tarefas de desenvolvimento que a implementam no ClickUp Tasks e atualizar a documentação à medida que o recurso evolui.

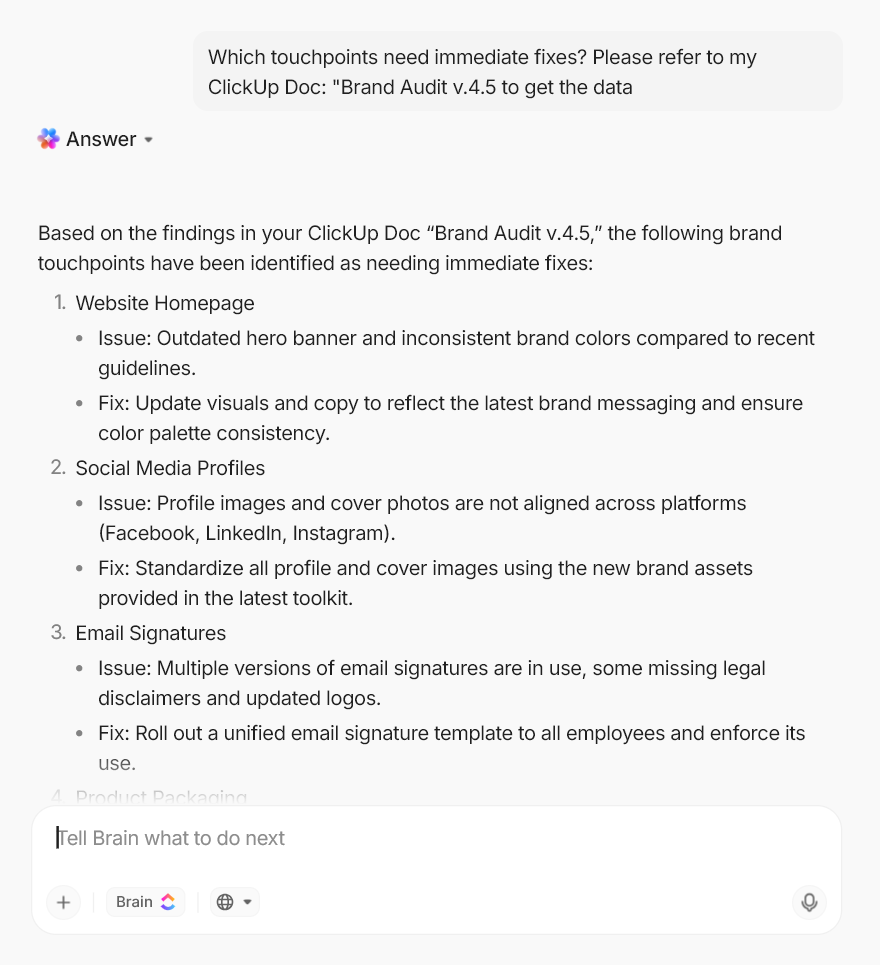

E quando você precisar de insights sobre o andamento das tarefas ao longo do projeto, basta perguntar ao ClickUp Brain, a camada de inteligência integrada ao seu espaço de trabalho, e ele extrairá respostas diretamente desses documentos, com contexto completo sobre os dados do seu projeto.

Isso significa que sua documentação não fica apenas em uma base de conhecimento separada — ela se torna parte do fluxo de trabalho ativo do projeto.

Vantagem nº 4 do ClickUp: conecte ferramentas externas de desenvolvimento ao ClickUp

As integrações do ClickUp mantêm as plataformas externas conectadas, facilitando a incorporação de conhecimento histórico e atualizações no espaço de trabalho, seja no GitHub, Slack, Figma ou outros aplicativos conectados.

Documentação ou referências de código do GitHub podem ser vinculadas diretamente a tarefas relacionadas. Atualizações ou discussões do Slack podem ser convertidas em tarefas executáveis. Até mesmo arquivos ou ativos de projeto de outras ferramentas podem ser integrados ao mesmo espaço de trabalho.

Dica profissional: Com o ClickUp Chat, você pode acabar de vez com a troca constante de mensagens entre o Slack e as tarefas do projeto — mantenha todas as discussões da equipe e os fluxos de trabalho dos desenvolvedores diretamente no ClickUp.

Marque colegas de equipe instantaneamente e atribua comentários diretamente às tarefas a partir de mensagens de chat, sem precisar sair do espaço de trabalho, para que nada se perca nas conversas. Todas as suas atualizações, decisões e acompanhamentos permanecem no contexto do projeto, tornando a colaboração mais rápida e muito menos confusa.

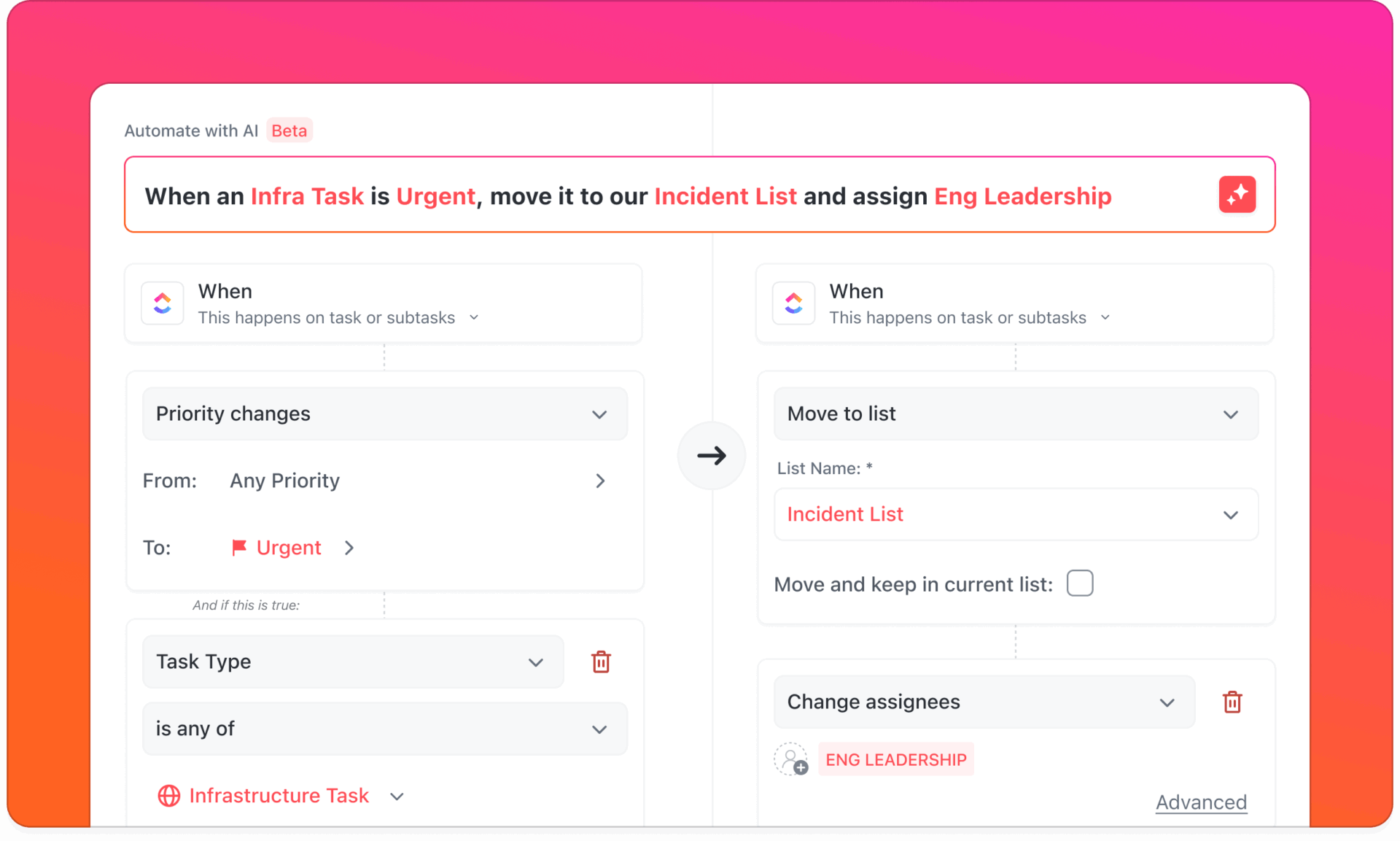

Vantagem nº 5 do ClickUp: Automatize fluxos de trabalho de desenvolvimento repetitivos

O ClickUp Automations elimina as etapas manuais que muitas vezes atrasam as equipes de desenvolvimento. Elas podem acionar ações com base no status da tarefa, prazos ou campos personalizados.

Quando um recurso passa para “Pronto para QA”, o ClickUp pode atribuir automaticamente a tarefa a um testador e notificar a equipe de QA.

Se o testador sinalizar um bug, a automação pode reabrir a tarefa, marcar o desenvolvedor responsável e mover a questão de volta para o backlog do sprint. Assim, em qualquer etapa de sua escolha, seu fluxo de trabalho continua automaticamente.

Comece a usar o Clicking-Up com sua IA

Para que a IA realmente trabalhe a seu favor, não basta escolher um modelo; escolha um espaço de trabalho que conecte seus modelos ao seu trabalho. O Mixtral oferece flexibilidade, pesos abertos e controle. O ChatGPT oferece resultados refinados e um ecossistema robusto. Ambos são excelentes, mas por si só? Eles ficam fora do seu fluxo de trabalho, obrigando você a alternar entre abas, copiar e colar resultados e transformar manualmente insights em tarefas ou documentação.

Ao integrar a IA diretamente em seu espaço de trabalho, você pode usar vários modelos simultaneamente, conectar resultados a tarefas e documentos, colaborar com membros da equipe, centralizar o conhecimento e automatizar fluxos de trabalho repetitivos, para que as percepções geradas com o Mixtral, o ChatGPT ou qualquer outra IA não fiquem restritas a uma ferramenta separada — elas se tornam imediatamente parte do trabalho que você já está realizando.

Pronto para ver em ação? Comece gratuitamente com o ClickUp ✨.

Perguntas frequentes (FAQ)

O Mixtral-8x7B utiliza uma arquitetura de mistura de especialistas, o que equivale a ter oito modelos especializados em um, enquanto modelos padrão como o Mistral 7B são modelos únicos e densos. Isso permite que o Mixtral ofereça o desempenho de um modelo muito maior com maior eficiência.

Sim, a licença de peso aberto do Mixtral permite que você o execute em seu próprio hardware para ter controle total sobre os dados. Isso requer uma GPU potente, mas versões quantizadas do modelo podem ser executadas em equipamentos mais comuns.

Se você usa IA diariamente para programação, depuração e documentação, os tempos de resposta mais rápidos e o acesso prioritário do ChatGPT Plus provavelmente valem o custo da assinatura. Para usuários ocasionais, continuar com a API baseada no uso pode ser mais econômico.

Você pode usar uma plataforma que agrega vários modelos de IA em uma única interface. O ClickUp Brain, por exemplo, oferece acesso a modelos da OpenAI, Anthropic e Google, permitindo que você use a melhor IA para qualquer tarefa sem sair do seu espaço de trabalho.