Sebagian besar tim perusahaan yang menjelajahi LLaMA terjebak pada titik yang sama: mereka mengunduh bobot model, menatap jendela terminal, dan menyadari bahwa mereka tidak tahu apa yang harus dilakukan selanjutnya.

Masalah ini umum terjadi—meskipun 88% perusahaan menggunakan AI dalam setidaknya satu fungsi, hanya 7% yang telah mengimplementasikannya secara menyeluruh di seluruh organisasi.

Panduan ini akan memandu Anda melalui seluruh proses, mulai dari memilih ukuran model yang tepat untuk kasus penggunaan Anda hingga menyesuaikannya dengan data perusahaan Anda, sehingga Anda dapat mengimplementasikan solusi AI yang berfungsi dan benar-benar memahami konteks bisnis Anda.

Apa Itu LLaMA dan Mengapa Penting untuk AI Perusahaan?

LLaMA (singkatan dari Large Language Model Meta AI) adalah keluarga model bahasa terbuka yang dikembangkan oleh Meta. Secara umum, model ini melakukan hal-hal inti yang sama dengan model seperti GPT atau Gemini: memahami bahasa, menghasilkan teks, dan dapat berlogika berdasarkan informasi. Perbedaan besarnya adalah bagaimana perusahaan dapat menggunakannya.

Karena LLaMA bersifat open-source, perusahaan tidak dibatasi untuk berinteraksi dengannya hanya melalui antarmuka API black-box. Mereka dapat menjalankannya di infrastruktur mereka sendiri, menyesuaikannya dengan data internal, dan mengontrol cara dan tempat penerapannya.

Bagi perusahaan, ini adalah hal yang sangat penting—terutama ketika privasi data, kepatuhan, dan prediktabilitas biaya lebih diutamakan daripada inovasi.

Fleksibilitas ini membuat LLaMA sangat menarik bagi tim yang ingin mengintegrasikan AI secara mendalam ke dalam alur kerja mereka, bukan hanya sebagai chatbot mandiri. Bayangkan asisten pengetahuan internal, otomatisasi dukungan pelanggan, alat pengembangan, atau fitur AI yang terintegrasi langsung ke dalam produk—tanpa mengirimkan data sensitif ke luar organisasi.

Singkatnya, LLaMA penting untuk AI perusahaan karena memberikan tim pilihan dalam hal implementasi, penyesuaian, dan integrasi AI ke dalam sistem bisnis nyata. Dan seiring AI beralih dari tahap eksperimen ke operasi sehari-hari, tingkat kontrol tersebut menjadi lebih dari sekadar "hal yang baik untuk dimiliki" dan lebih menjadi suatu keharusan.

Cara Memulai dengan LLaMA untuk Aplikasi Perusahaan

1. Tentukan kasus penggunaan perusahaan Anda

Sebelum mengunduh apa pun, tentukan alur kerja spesifik di mana AI dapat memberikan dampak nyata. Menyesuaikan kasus penggunaan AI dengan ukuran model sangat penting—model 8B yang lebih kecil efisien untuk tugas sederhana, sementara model 70B+ yang lebih besar lebih cocok untuk penalaran kompleks.

Untuk membantu Anda mengidentifikasi aplikasi AI yang tepat untuk bisnis Anda, tonton ringkasan ini tentang kasus penggunaan AI praktis di berbagai fungsi perusahaan dan industri:

Titik awal yang umum meliputi:

- Pengolahan dokumen: Merangkum laporan panjang atau mengekstrak informasi kunci dari kontrak.

- Bantuan kode: Membuat kode boilerplate, menjelaskan sistem warisan, atau menyarankan optimasi.

- Pencarian pengetahuan: Menjawab pertanyaan karyawan dengan mencari dokumen internal menggunakan teknik yang disebut Retrieval-Augmented Generation (RAG)

- Pembuatan konten: Menyusun draf awal komunikasi atau salinan pemasaran.

2. Siapkan prasyarat dan ketergantungan

Selanjutnya, pastikan perangkat keras dan perangkat lunak Anda siap. Ukuran model menentukan kebutuhan Anda; model LLaMA 8B memerlukan GPU dengan sekitar 15GB VRAM, sementara model 70B membutuhkan 131GB atau lebih.

Struktur perangkat lunak Anda harus mencakup Python 3.8+, PyTorch, driver CUDA, dan ekosistem Hugging Face (transformers, accelerate, dan bitsandbytes).

3. Akses dan unduh bobot model LLaMA

Anda dapat mengunduh bobot model dari halaman unduhan resmi Llama Meta atau pusat model Hugging Face. Anda perlu menerima Lisensi Komunitas Llama 3, yang memungkinkan penggunaan komersial. Tergantung pada konfigurasi Anda, Anda akan mengunduh bobot model dalam format safetensors atau GGUF.

4. Konfigurasikan lingkungan pengembangan Anda

Setelah bobot model diunduh, saatnya menyiapkan lingkungan kerja Anda. Instal perpustakaan Python yang diperlukan, termasuk transformers, accelerate, dan bitsandbytes untuk kuantisasi—proses yang mengurangi jejak memori model.

Muat model dengan pengaturan yang tepat dan jalankan prompt uji sederhana untuk memastikan semuanya berfungsi dengan benar sebelum melanjutkan ke tahap penyesuaian.

💡Jika Anda tidak memiliki tim infrastruktur ML khusus, proses ini bisa menjadi hal yang tidak mungkin dilakukan. Lewati kompleksitas implementasi sepenuhnya dengan ClickUp Brain. Platform ini menyediakan kemampuan AI seperti bantuan penulisan dan otomatisasi tugas langsung di ruang kerja tempat tim Anda sudah beroperasi—tanpa perlu mengunduh model atau menyiapkan GPU.

Cara Menyesuaikan LLaMA untuk Data Perusahaan Anda

Menggunakan model dasar LLaMA adalah langkah awal yang baik, tetapi model ini tidak akan memahami akronim unik perusahaan Anda, nama proyek, atau proses internal. Hal ini menyebabkan respons generik yang tidak membantu dan gagal menyelesaikan masalah bisnis yang sebenarnya.

AI Perusahaan menjadi berguna melalui penyesuaian—melatih model menggunakan terminologi dan basis pengetahuan spesifik Anda.

Siapkan data pelatihan yang spesifik untuk domain Anda.

Kesuksesan AI kustom Anda lebih bergantung pada kualitas data pelatihan daripada ukuran model atau daya komputasi. Mulailah dengan mengumpulkan dan membersihkan informasi internal Anda.

- Dokumentasi internal: Kumpulkan spesifikasi produk, panduan proses, dan dokumen kebijakan.

- Komunikasi historis: Kumpulkan templat email, tanggapan tiket dukungan, dan ringkasan rapat.

- Istilah domain: Kumpulkan glosarium, definisi akronim, dan bahasa khusus industri.

Setelah dikumpulkan, format informasi ini menjadi pasangan instruksi-respons untuk penyempurnaan yang diawasi. Misalnya, instruksi dapat berupa “Ringkas tiket dukungan ini,” dan responsnya adalah ringkasan yang bersih dan ringkas. Langkah ini sangat penting untuk mengajarkan model cara melakukan tugas spesifik dengan data Anda.

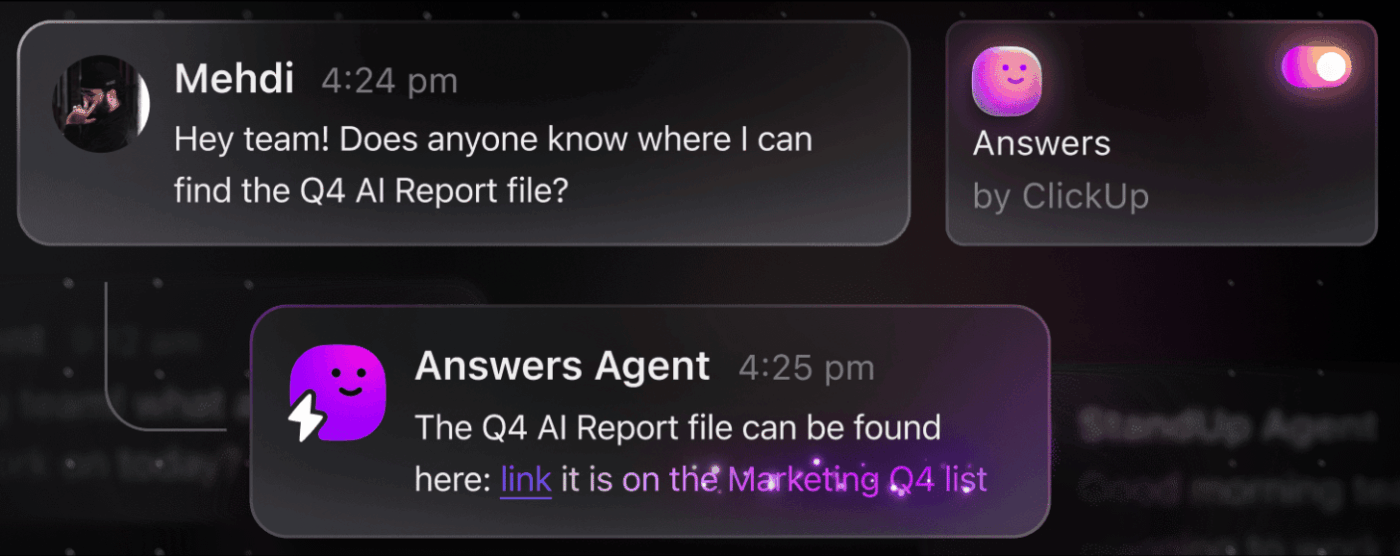

📮 ClickUp Insight: Seorang profesional rata-rata menghabiskan lebih dari 30 menit sehari untuk mencari informasi terkait pekerjaan—itu berarti lebih dari 120 jam per tahun terbuang untuk menggali email, obrolan Slack, dan file yang tersebar. Asisten AI cerdas yang terintegrasi dalam ruang kerja Anda dapat mengubah hal itu.

Kenalkan ClickUp Brain. Ia memberikan wawasan dan jawaban instan dengan menampilkan dokumen, percakapan, dan detail tugas yang tepat dalam hitungan detik—sehingga Anda bisa berhenti mencari dan mulai bekerja.

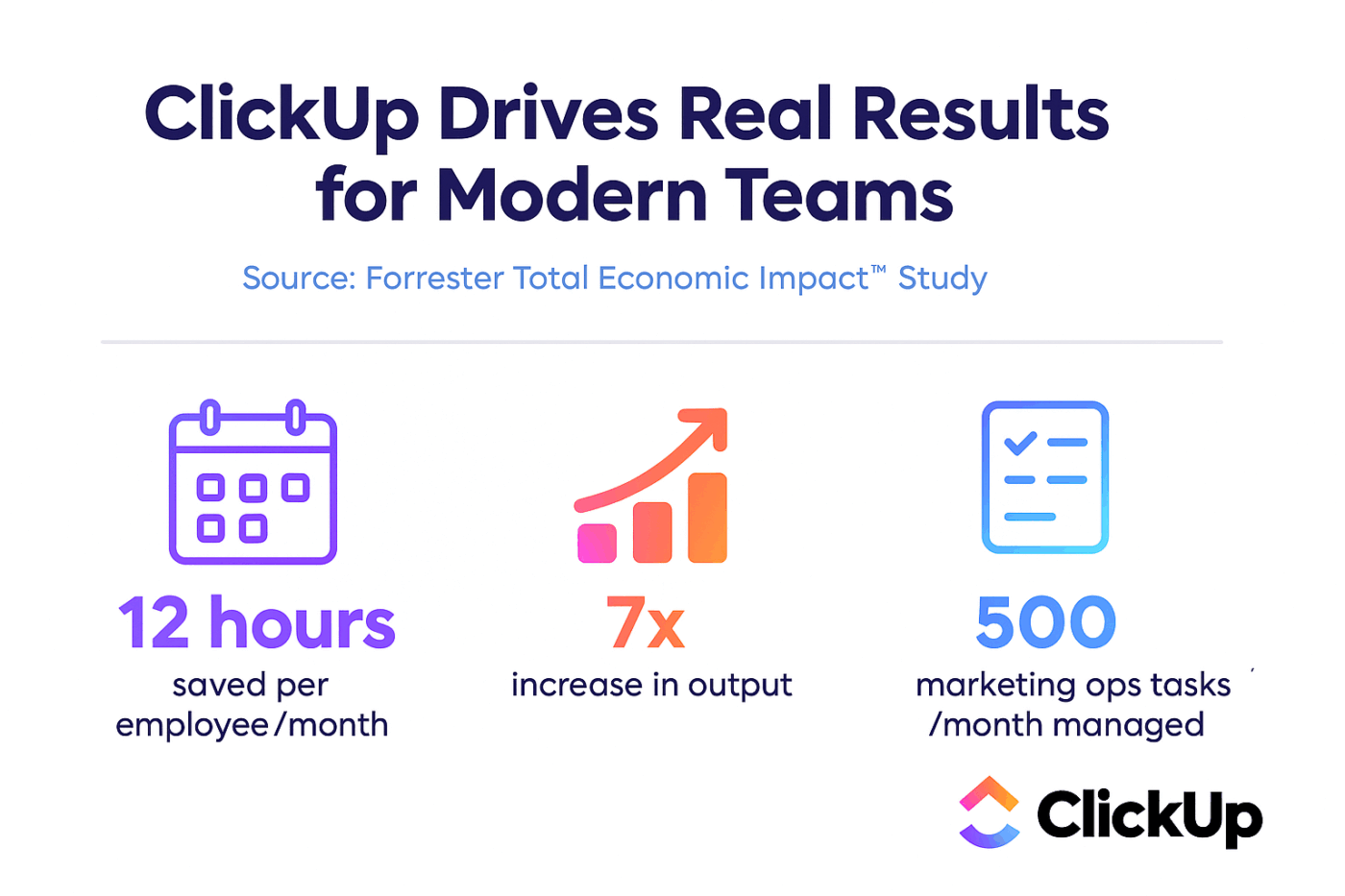

💫 Hasil Nyata: Tim seperti QubicaAMF menghemat lebih dari 5 jam per minggu dengan menggunakan ClickUp—itu setara dengan lebih dari 250 jam per tahun per orang—dengan menghilangkan proses manajemen pengetahuan yang usang. Bayangkan apa yang dapat diciptakan tim Anda dengan tambahan satu minggu produktivitas setiap kuartal!

Menyesuaikan LLaMA dengan konteks bisnis Anda

Penyesuaian model adalah proses menyesuaikan pengetahuan yang sudah ada pada LLaMA dengan kasus penggunaan spesifik Anda, yang secara signifikan meningkatkan akurasi model pada tugas-tugas spesifik domain. Alih-alih melatih model dari awal, Anda dapat menggunakan metode yang efisien dalam hal parameter, yang hanya memperbarui sebagian kecil parameter model, sehingga menghemat waktu dan sumber daya komputasi.

Metode penyempurnaan yang populer meliputi:

- LoRA (Low-Rank Adaptation): Metode ini melatih matriks "adapter" kecil alih-alih seluruh model, sehingga sangat efisien.

- QLoRA: Ini menggabungkan LoRA dengan kuantisasi untuk memungkinkan penyempurnaan pada satu GPU 48GB sambil tetap mencapai kinerja penyempurnaan penuh.

- Penyesuaian penuh: Ini memperbarui semua parameter model, menawarkan tingkat penyesuaian yang paling mendalam tetapi memerlukan daya komputasi yang signifikan.

Evaluasi dan perbaiki kinerja model.

Bagaimana Anda tahu jika model kustom Anda benar-benar berfungsi? Evaluasi AI harus melampaui skor akurasi sederhana dan mengukur kegunaan di dunia nyata. Buat dataset evaluasi yang mencerminkan kasus penggunaan produksi Anda dan lacak metrik yang penting bagi bisnis Anda, seperti kualitas respons, akurasi fakta, dan latensi.

- Evaluasi kualitatif: Mintalah penilai manusia untuk mengevaluasi output berdasarkan nada, kegunaan, dan keakuratan.

- Metrik kuantitatif: Gunakan skor otomatis seperti BLEU atau perplexity untuk memantau kinerja pada skala besar.

- Pemantauan produksi: Setelah diterapkan, pantau umpan balik pengguna dan tingkat kesalahan untuk mengidentifikasi area yang perlu ditingkatkan.

💡Proses iteratif pelatihan dan evaluasi ini dapat menjadi proyek tersendiri. Kelola siklus hidup pengembangan AI Anda langsung di ClickUp daripada tersesat dalam spreadsheet.

Sentralisasikan metrik kinerja dan hasil evaluasi dalam satu tampilan menggunakan Dashboard ClickUp. Pantau versi model, parameter pelatihan, dan skor evaluasi bersamaan dengan pekerjaan produk lainnya menggunakan Bidang Kustom ClickUp, menjaga semuanya terorganisir dan terlihat. 🛠️

Kasus Penggunaan Utama LLaMA untuk Perusahaan

Tim sering terjebak dalam kebingungan analisis, tidak mampu beralih dari antusiasme abstrak tentang AI ke aplikasi konkret. Fleksibilitas LLaMA menjadikannya cocok untuk berbagai alur kerja perusahaan, membantu Anda mengotomatisasi tugas dan bekerja lebih efisien.

Berikut adalah beberapa kasus penggunaan utama untuk model LLaMA yang disesuaikan:

- Asisten pengetahuan internal: Hentikan pemborosan waktu mencari informasi. Deploy LLaMA dengan RAG untuk membuat chatbot yang dapat menjawab pertanyaan karyawan secara instan dengan mencari informasi dari wiki internal, dokumen kebijakan, dan komunikasi proyek sebelumnya.

- Otomatisasi dukungan pelanggan: Sesuaikan model berdasarkan riwayat tiket Anda untuk secara otomatis menyusun tanggapan, mengkategorikan pertanyaan, dan meneruskan masalah kompleks ke agen manusia yang tepat.

- Pembangkitan dan tinjauan kode: Bantu tim teknik Anda bekerja lebih efisien. Gunakan LLaMA untuk membangkitkan kode boilerplate, menjelaskan sistem warisan yang kompleks, dan bahkan mengidentifikasi potensi bug dalam permintaan pull sebelum menjadi masalah.

- Pengolahan dokumen: Ubah volume besar teks menjadi informasi yang berguna. Ringkas laporan yang panjang, ekstrak istilah kunci dari kontrak hukum, atau buat catatan rapat yang ringkas dari transkrip mentah dalam hitungan detik.

- Alur kerja pembuatan konten: Atasi kebuntuan menulis. Buat draf salinan pemasaran, deskripsi produk, dan pengumuman internal yang dapat disempurnakan oleh editor manusia.

💡Akses banyak kasus penggunaan ini secara langsung dengan ClickUp Brain.

- Ringkas thread tugas, buat draf pembaruan proyek, dan generate konten dengan bantuan penulisan AI dari ClickUp.

- Temukan jawaban dari seluruh ruang kerja Anda secara instan dengan Pencarian Perusahaan ClickUp dan agen Ambient Answers yang sudah siap pakai.

- Bangun alur kerja cerdas yang menangani pekerjaan rutin untuk Anda dengan ClickUp Automations

Batasan Penggunaan LLaMA untuk AI Perusahaan

Meskipun menghosting LLaMA sendiri memberikan kontrol yang signifikan, hal ini tidak tanpa tantangan. Tim sering kali meremehkan beban operasional, terjebak dalam pemeliharaan daripada inovasi. Sebelum memutuskan untuk memilih jalur "build", penting untuk memahami hambatan potensial yang mungkin dihadapi.

Berikut adalah beberapa batasan utama yang perlu dipertimbangkan:

- Persyaratan infrastruktur: Menjalankan model besar membutuhkan biaya tinggi dan memerlukan GPU berdaya tinggi yang sesuai untuk perusahaan, yang banyak organisasi tidak memilikinya.

- Keahlian teknis yang diperlukan: Deploying, fine-tuning, dan memelihara model bahasa besar memerlukan keahlian teknik ML khusus yang sangat diminati.

- Beban pemeliharaan berkelanjutan: Ini bukan solusi "set it and forget it". Model memerlukan pemantauan terus-menerus, pembaruan keamanan, dan pelatihan ulang seiring perkembangan bisnis Anda.

- Risiko halusinasi: Seperti semua model bahasa besar (LLM), LLaMA terkadang dapat menghasilkan informasi yang terdengar masuk akal tetapi salah. Aplikasi perusahaan memerlukan batasan yang kuat dan pengawasan manusia untuk memitigasi risiko ini.

- Tidak ada fitur perusahaan bawaan: Fitur kritis seperti kontrol akses, pencatatan audit, dan alat kepatuhan harus dibangun dan dikelola secara terpisah, menambah lapisan kompleksitas lainnya.

💡Anda dapat menghindari batasan ini dengan menggunakan ClickUp Brain. Ini menyediakan AI yang dikelola di dalam ruang kerja Anda yang sudah ada, memberikan kemampuan AI perusahaan tanpa beban operasional. Dapatkan keamanan tingkat perusahaan dan hilangkan pemeliharaan infrastruktur dengan ClickUp, sehingga tim Anda dapat fokus pada pekerjaan inti mereka.

📮ClickUp Insight: 88% responden survei kami menggunakan AI untuk tugas pribadi mereka, namun lebih dari 50% enggan menggunakannya di tempat kerja. Tiga hambatan utama? Kurangnya integrasi yang mulus, kesenjangan pengetahuan, atau kekhawatiran keamanan.

Tapi bagaimana jika AI sudah terintegrasi ke dalam ruang kerja Anda dan sudah aman? ClickUp Brain, asisten AI bawaan ClickUp, menjadikan hal ini kenyataan. Ia memahami perintah dalam bahasa alami, mengatasi ketiga kekhawatiran adopsi AI sambil menghubungkan obrolan, tugas, dokumen, dan pengetahuan Anda di seluruh ruang kerja. Temukan jawaban dan wawasan dengan satu klik!

Alat AI Alternatif untuk Kasus Penggunaan Perusahaan

Memilih alat AI yang tepat dari berbagai opsi yang tersedia merupakan tantangan bagi setiap tim. Anda berusaha memahami trade-off antara berbagai model, tetapi khawatir memilih yang salah dan membuang-buang sumber daya.

Hal ini seringkali menyebabkan AI Sprawl —penyebaran tak terencana dari alat dan platform AI tanpa pengawasan atau strategi—di mana tim berlangganan layanan yang terputus-putus, menciptakan lebih banyak pekerjaan daripada mengurangi beban kerja.

Berikut ini ringkasan singkat tentang pemain utama dan peran mereka:

| Alat | Terbaik untuk | Pertimbangan Utama |

|---|---|---|

| LLaMA (self-hosted) | Kontrol penuh, kedaulatan data | Membutuhkan infrastruktur ML dan keahlian. |

| OpenAI GPT-4 | Kemampuan tertinggi, pengaturan minimal | Data meninggalkan lingkungan Anda, penagihan berdasarkan penggunaan. |

| Claude (Anthropic) | Tugas dengan konteks panjang, fokus pada keamanan | Pertimbangan serupa dengan GPT-4 |

| Mistral | Kewarganegaraan data Eropa, efisiensi | Ekosistem yang lebih kecil daripada LLaMA |

| ClickUp Brain | AI ruang kerja terintegrasi, tanpa perlu implementasi. | Terbaik untuk tim yang ingin mengintegrasikan AI ke dalam alur kerja yang sudah ada. |

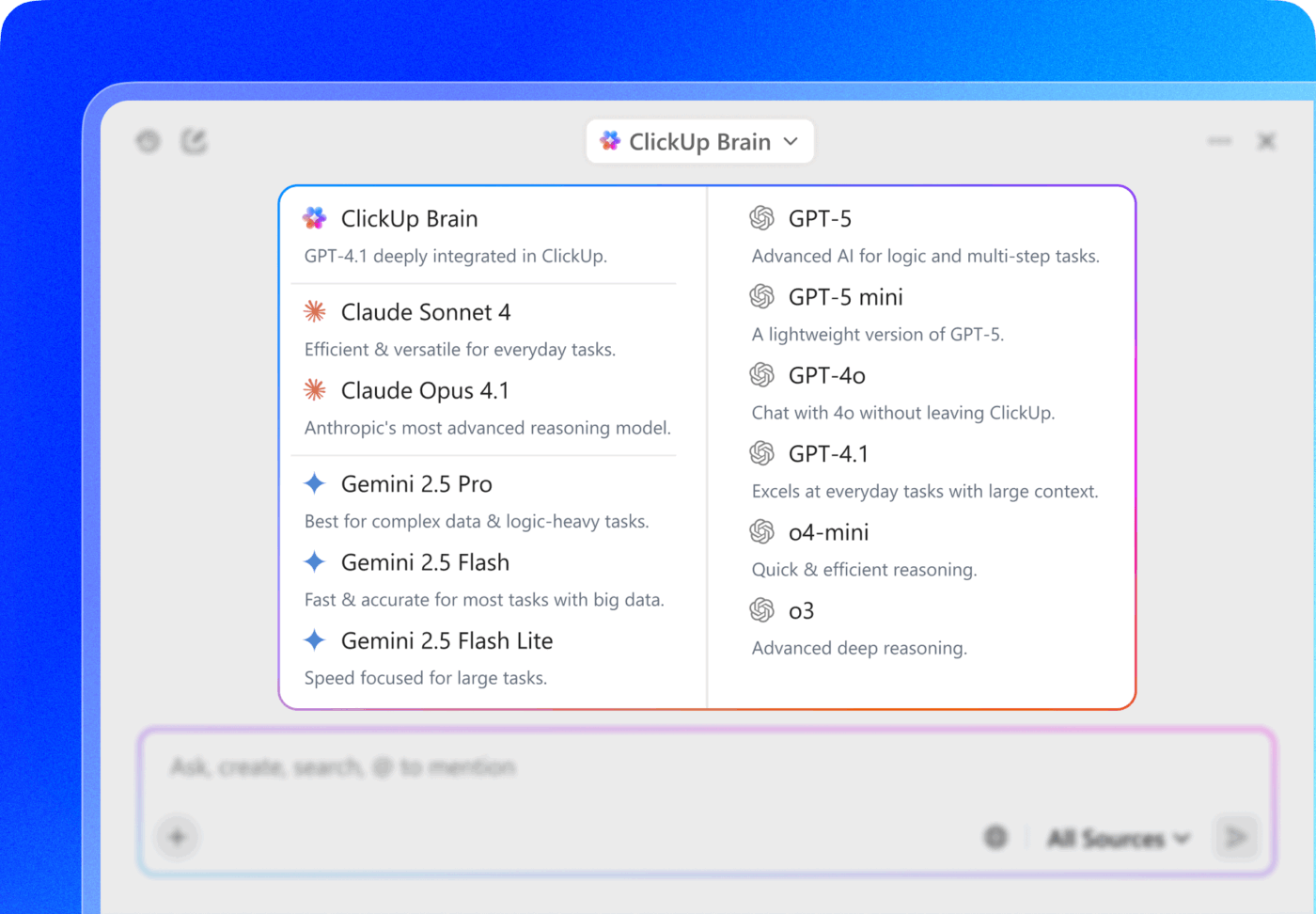

Daripada menghubungkan berbagai alat untuk memenuhi kebutuhan Anda, mengapa tidak mengakses AI yang terintegrasi langsung di tempat Anda bekerja? Inilah inti dari apa yang ditawarkan ClickUp sebagai Converged AI Workspace pertama di dunia — platform tunggal dan aman di mana proyek, dokumen, percakapan, dan analisis berada dalam satu tempat.

Ini mengintegrasikan alat-alat Anda untuk menghilangkan penyebaran konteks, fragmentasi yang terjadi ketika tim membuang-buang waktu berpindah antar aplikasi dan mencari informasi yang mereka butuhkan untuk menjalankan tugas mereka.

ClickUp + AI Kontekstual = Transformasi yang Terukur

Menurut studi Forrester Economic Impact™, tim yang menggunakan ClickUp mengalami ROI sebesar 384% dan menghemat 92.400 jam pada tahun ketiga.

Ketika konteks, alur kerja, dan kecerdasan berada dalam satu tempat, tim tidak hanya bekerja. Mereka berhasil.

ClickUp juga menyediakan fitur keamanan dan administrasi yang dibutuhkan untuk implementasi perusahaan, termasuk kepatuhan SOC 2 Type II, integrasi SSO, penyediaan SCIM, dan kontrol izin yang detail.

Akses multi-LLM ClickUp Brain MAX memungkinkan Anda memilih antara model premium seperti ChatGPT, Claude, dan Gemini langsung dari antarmuka pencarian. Platform ini secara otomatis mengarahkan permintaan Anda ke model terbaik untuk tugas tersebut, sehingga Anda mendapatkan yang terbaik dari semua model tanpa perlu mengelola langganan ganda.

Dapatkan seluruh ekosistem—kemampuan AI, manajemen proyek, dokumentasi, dan komunikasi—semua dalam satu platform dengan ClickUp, daripada membangun lapisan AI dari nol menggunakan LLaMA.

Majukan AI Perusahaan Anda dengan ClickUp

LLaMA memberikan tim perusahaan alternatif terbuka yang lebih fleksibel dibandingkan API AI tertutup, menawarkan kontrol yang signifikan, prediktabilitas biaya, dan kustomisasi. Namun, kesuksesan tidak hanya bergantung pada teknologi. Hal ini memerlukan pemilihan model yang tepat untuk kasus penggunaan yang tepat, investasi dalam data pelatihan berkualitas tinggi, dan pembangunan proses evaluasi yang kokoh.

Keputusan "bangun vs. beli" pada akhirnya bergantung pada kemampuan teknis tim Anda. Meskipun membangun solusi kustom menawarkan fleksibilitas maksimal, hal ini juga disertai dengan beban kerja yang signifikan. Tantangan sesungguhnya bukan hanya mengakses AI—tetapi mengintegrasikannya ke dalam alur kerja harian Anda tanpa menimbulkan lebih banyak AI Sprawl dan silo data.

Bawa kemampuan LLM langsung ke dalam manajemen proyek, dokumentasi, dan komunikasi tim Anda dengan ClickUp Brain—tanpa kerumitan membangun dan memelihara infrastruktur. Mulailah secara gratis dengan ClickUp dan bawa kemampuan AI langsung ke dalam alur kerja yang sudah ada. 🙌

Pertanyaan yang Sering Diajukan (FAQ)

Ya, Lisensi Komunitas Llama 3 mengizinkan penggunaan komersial untuk sebagian besar organisasi. Hanya perusahaan dengan lebih dari 700 juta pengguna aktif bulanan yang perlu memperoleh lisensi terpisah dari Meta.

LLaMA menawarkan kontrol data yang lebih besar dan biaya yang dapat diprediksi melalui hosting mandiri, sementara GPT-4 menawarkan kinerja yang lebih tinggi secara langsung dengan pengaturan yang lebih sedikit. Untuk produktivitas, however, dapatkan bantuan AI tanpa perlu mengelola model dasar melalui alat terintegrasi seperti ClickUp Brain.

Menjalankan LLaMA secara mandiri (self-hosting) memungkinkan data tetap berada di infrastruktur Anda, yang sangat baik untuk kepatuhan data. Namun, Anda bertanggung jawab untuk mengimplementasikan kontrol akses, log audit, dan filter konten sendiri—fitur keamanan yang biasanya disertakan dalam layanan AI yang dikelola.

Menerapkan dan menyesuaikan LLaMA secara langsung memerlukan keterampilan teknik ML yang signifikan. Tim yang tidak memiliki keahlian ini dapat mengakses kemampuan berbasis LLaMA melalui platform terkelola seperti ClickUp Brain, yang menyediakan fitur AI tanpa perlu mengimplementasikan model atau konfigurasi teknis.