La vidéo était autrefois une preuve facile à obtenir.

C'est désormais la chose la plus facile à falsifier.

Les clips générés par l'IA sont omniprésents : flux sociaux, publicités marketing, démos internes, voire vidéos « de type actualités » partagées sur Slack. Le risque ne réside pas dans leur existence, mais dans le fait que la plupart des équipes ne disposent pas d'un moyen cohérent de les vérifier avant leur approbation, leur publication ou leur transfert.

Ce guide vous propose des moyens pratiques pour déterminer si une vidéo a été générée par l'IA, ainsi qu'un flux de travail simple pour documenter vos conclusions, afin que la vérification ne repose pas uniquement sur l'intuition d'une seule personne.

C'est parti ! 👇

Qu'est-ce qu'une vidéo générée par l'IA ?

Une vidéo générée par IA est une vidéo créée, modifiée ou « interprétée » par une IA plutôt que par une caméra réelle capturant des évènements réels.

La plupart des vidéos générées par l'IA se répartissent en trois catégories :

- Entièrement synthétique : créé à partir de zéro (texte-vidéo, acteurs IA, environnements IA)

- Deepfake : séquence réelle dans laquelle un visage ou une voix est remplacé ou manipulé.

- Amélioré par l'IA : images réelles qui ont été modifiées (nettoyage, rajeunissement, modifications de l'arrière-plan, amélioration de la qualité).

Indices visuels qui apparaissent image par image

Les vidéos falsifiées à l'aide de l'IA semblent souvent convaincantes en mouvement, mais leur authenticité est mise à mal lorsque vous les mettez en pause, zoomez et vérifiez leur cohérence. Commencez par les zones visuelles à fort signal ci-dessous et recherchez les problèmes qui se répètent sur plusieurs images.

Vérifiez les visages, les yeux et les expressions.

Le visage est la partie du corps la plus révélatrice pour la détection par l'IA, car notre cerveau est programmé pour remarquer les incohérences faciales. L'IA a encore du mal à détecter les mouvements musculaires minuscules et rapides appelés micro-expressions, l'asymétrie naturelle et la façon dont les fonctionnalités du visage interagissent pendant la parole. Mettez en pause et zoomez sur les visages, en recherchant ces signes révélateurs sur plusieurs images.

- Symétrie faciale : remarquez les traits anormalement symétriques qui apparaissent rarement sur les visages humains réels.

- Dents et intérieur de la bouche : surveillez les dents floues, les bandes uniformes ou les formes et espaces incohérents.

- Poils faciaux et sourcils : vérifiez si les poils semblent avoir été peints, brillent ou bougent de manière non naturelle.

- Détails des oreilles : inspectez les oreilles à la recherche de formes malformées ou d'incohérences qui changent d'une image à l'autre.

Clignements des yeux non naturels

Le clignement des yeux est un comportement étonnamment complexe que l'IA interprète souvent de manière erronée. Les personnes réelles clignent des yeux toutes les quelques secondes, avec des variations naturelles en termes de vitesse et de durée. Les visages générés par l'IA, en revanche, peuvent cligner des yeux trop souvent, trop rarement ou avec une uniformité robotique.

Un indice révélateur est lorsque plusieurs personnes dans une vidéo clignent des yeux exactement au même moment, ce qui est un signe évident de génération par IA. Faites également attention aux yeux qui restent ouverts pendant une période inconfortablement longue. Les premiers deepfakes oubliaient souvent d'inclure le clignement des yeux, et bien qu'ils se soient améliorés, cela reste un défaut courant dans les vidéos synthétiques de moindre qualité.

Peau trop lisse ou asymétrique

/IA a tendance soit à rendre la peau trop parfaite en supprimant toute texture naturelle, soit à mal gérer l'éclairage, créant ainsi d'étranges asymétries. Recherchez les peaux qui semblent avoir été retouchées ou qui ont un aspect plastique, en particulier au niveau du front, des joues et de la mâchoire.

Vous devez également être attentif aux zones où la texture de la peau change soudainement ou où les ombres tombent dans des directions qui ne correspondent pas à la source lumineuse principale. Ces défauts de rendu sont souvent plus visibles autour de la racine des cheveux et le long de la mâchoire, là où le faux visage est fusionné avec une tête réelle.

Regard vide ou errant

Les yeux sont extrêmement difficiles à rendre de manière convaincante pour l'IA, ce qui en fait un élément clé à vérifier pour détecter les contrefaçons. L'expression « yeux morts » est souvent utilisée, car les yeux générés par l'IA peuvent manquer d'éclat.

Voici ce qu'il faut rechercher :

- Absence de reflets lumineux : les yeux réels reflètent les sources lumineuses, créant de petits points brillants appelés reflets lumineux. Les yeux générés par l'IA en sont souvent dépourvus, ce qui leur donne un aspect plat et sans vie.

- Regard errant : les yeux de la personne peuvent ne pas être suivis naturellement par les mouvements de sa tête ou sembler vous « traverser » plutôt que de regarder quelque chose en particulier.

- Détails incohérents : les motifs de l'iris peuvent être flous, trop uniformes ou différents entre les deux yeux.

Regardez les mains et les doigts

Les mains et les doigts sont un point faible notoire des générateurs de vidéos IA. La complexité même de l'anatomie de la main, avec ses nombreuses articulations, ses doigts qui se chevauchent et ses mouvements fluides, rend son rendu extrêmement difficile pour l'IA. Soyez particulièrement attentif lorsque des mains apparaissent à l'écran, notamment lorsqu'elles font des gestes ou interagissent avec des objets.

Les indicateurs clés à surveiller sont les suivants :

- Nombre de doigts incorrect : comptez les doigts pour repérer les doigts en trop, les doigts manquants ou les changements soudains entre les images.

- Articulations étranges : observez les doigts se plier à des angles impossibles ou bouger sans articulations visibles.

- Doigts fusionnés : remarquez les doigts qui fusionnent, se séparent de manière non naturelle ou bougent pendant le mouvement.

- Échecs d'interaction avec les objets : vérifiez si les mains traversent les objets ou les saisissent d'une manière physiquement impossible.

🔍 Le saviez-vous ? Les « empreintes digitales » IA sont en train de devenir une nouvelle méthode de détection. Certains outils analysent de minuscules indices physiologiques, tels que le flux sanguin dans le visage, qui provoquent des changements subtils de pixels invisibles à l'œil nu, afin de détecter les contrefaçons avec une grande précision.

Soyez attentif aux erreurs physiques et logiques

Les modèles d'IA apprennent des modèles à partir de données, mais ils ne comprennent pas vraiment la physique du monde réel. Cela vous donne un énorme avantage. Soyez attentif aux moments où la vidéo rompt avec la réalité. Ces erreurs sont souvent subtiles, mais deviennent flagrantes une fois que vous les avez repérées.

Objets qui se traversent

Les vidéos générées par l'IA ne parviennent souvent pas à maintenir les contours corrects des objets, un phénomène connu sous le nom de clipping. Soyez attentif aux cheveux ou aux vêtements qui traversent le corps de la personne ou d'autres objets. Les accessoires tels que les lunettes ou les bijoux peuvent fusionner avec la peau ou disparaître pendant une ou deux images.

Cela s'applique également à l'environnement. Recherchez les objets en arrière-plan qui se croisent de manière impossible avec les éléments au premier plan. Ces erreurs se produisent le plus souvent aux bords des objets en mouvement ou lors de mouvements rapides.

💡 Conseil de pro : une astuce rapide consiste à regarder un Clip sans le son, puis avec le son : si les mouvements de la bouche semblent toujours décalés ou peu naturels, il peut s'agir d'un Clip généré par l'IA.

Violations de la gravité et de la dynamique

L'IA a également du mal à simuler de manière réaliste les phénomènes physiques tels que la gravité et l'élan. Recherchez dans la vidéo les éléments qui ne bougent pas naturellement lorsque la personne tourne la tête ou marche. Les objets peuvent tomber trop lentement, trop rapidement ou suivre une trajectoire étrange et flottante.

Les mouvements du corps peuvent également sembler incorrects, manquant de poids ou d'inertie. Observez les moments où une personne s'assoit, se lève ou interagit avec son environnement. Ces actions révèlent clairement des erreurs physiques.

Interactions cause-effet non naturelles

Comme l'IA génère des apparences sans comprendre la causalité, elle ne parvient souvent pas à établir une connexion entre une action et ses conséquences logiques. Par exemple, une personne peut toucher une surface sans provoquer la réaction attendue, comme des ondulations dans l'eau ou une bosse dans un coussin.

D'autres indices révélateurs incluent le fait de parler dans un environnement froid sans que la vapeur de la respiration ne soit en vue ou de marcher sur le sable ou la neige sans laisser d'empreintes. Ces erreurs montrent que l'IA se contente de peindre un tableau, sans simuler un monde réel et interactif.

Des indices audio qui révèlent les vidéos synthétiques ou modifiées

Une fois que les éléments visuels ont passé un scan rapide, c'est au niveau de l'audio que de nombreux faux créés par l'IA sont détectés. Utilisez les vérifications ci-dessous pour valider si la voix, le timing et l'environnement correspondent à ce que vous voyez.

Faites attention à la synchronisation labiale

La synchronisation labiale est un domaine critique pour la détection, car la parole humaine est incroyablement complexe. L'IA produit souvent des mouvements labiaux qui sont proches mais pas tout à fait corrects, créant un décalage dérangeant que les systèmes de détection avancés peuvent identifier avec une précision de 99,73 %.

Les indicateurs clés à surveiller sont les suivants :

- Problèmes de synchronisation : remarquez que les lèvres bougent légèrement avant ou après la lecture du son.

- Formes manquantes : observez les lèvres qui ne se ferment pas complètement sur des sons tels que « M », « B » et « P ».

- Mouvement incorrect de la mâchoire : observez si la bouche s'ouvre trop ou pas assez pour produire le son.

- Coins de la bouche statiques : recherchez les mouvements limités au centre des lèvres tandis que les coins restent rigides.

Soyez attentif aux irrégularités audio et vocales

Les voix générées par IA ou clonées contiennent souvent de subtils artefacts audio qui les trahissent. Même si le clonage vocal est devenu incroyablement performant, une écoute attentive permet encore de détecter des incohérences.

Voici quelques indicateurs audio clés :

- Intonation robotique : le discours est plat, monotone et ne présente pas les variations de ton naturelles de la parole humaine.

- Absence de bruits respiratoires : les personnes réelles doivent respirer. L'IA oublie souvent cet aspect, ce qui a pour résultat des phrases longues et ininterrompues, sans aucune inspiration ou expiration audible.

- Rythme étrange : le rythme du discours est trop uniforme, sans les pauses naturelles, les hésitations ou les mots de remplissage (« euh », « hum ») que les gens utilisent.

- Audio collé : la voix semble avoir été enregistrée dans une cabine insonorisée, puis superposée au bruit de fond de la vidéo, plutôt que d'avoir été enregistrée dans le même espace acoustique.

🔍 Le saviez-vous ? Des technologies telles que SynthID de Google intègrent des filigranes invisibles dans les vidéos générées par l'IA afin qu'elles puissent être vérifiées ultérieurement, même si elles ont été modifiées ou compressées.

Tenez compte de la durée et de la qualité de la vidéo

Les caractéristiques techniques d'une vidéo peuvent fournir des indices, mais elles ne constituent pas une preuve en soi. Pour l'instant, les vidéos générées par l'IA sont limitées en termes de durée et de résolution.

- Durée : la production de vidéos longues et cohérentes à l'aide de l'IA reste coûteuse en termes de calcul, c'est pourquoi la plupart des clips synthétiques restent courts, souvent moins de 30 secondes.

- Résolution : les résolutions élevées peuvent révéler les artefacts de l'IA, tandis que les vidéos inhabituellement basses ou fortement compressées peuvent être utilisées pour masquer les imperfections visuelles.

- Fréquence d'images : des fréquences d'images incohérentes peuvent se traduire par des mouvements saccadés ou peu naturels, un effet secondaire courant de la génération par IA.

Vérifiez la source avant de faire confiance au Clip

Même une vidéo « parfaite » peut être fausse, et même une vidéo authentique peut être trompeuse lorsqu'elle est republiée hors contexte. Suivez les étapes ci-dessous pour vérifier d'où elle provient et pourquoi elle est partagée.

Vérifiez la source et le contexte

L'analyse technique ne représente que la moitié du travail. Vous devez l'associer à la vérification des sources. Même une vidéo IA parfaitement réalisée peut être démasquée en examinant son contexte.

Voici les étapes de vérification à suivre :

- Vérifiez la source : remontez jusqu'à la première apparition de la vidéo en ligne. Vérifiez si elle a été publiée par un compte vérifié, un média réputé ou un compte anonyme connu pour diffuser des informations erronées.

- Recherche d'image inversée : utilisez des outils pour rechercher des images tirées de la vidéo. Cela peut vous aider à trouver la version originale non manipulée ou à vérifier si elle a déjà été vérifiée par d'autres personnes.

- Évaluez l'intention : demandez-vous pourquoi cette vidéo apparaît maintenant. Semble-t-elle conçue pour provoquer une forte réaction émotionnelle ou influencer une opinion sur un évènement d'actualité ?

📮 ClickUp Insight : 92 % des travailleurs du savoir risquent de perdre des décisions importantes dispersées dans des chats, des e-mails et des feuilles de calcul. Sans un système unifié pour saisir et suivre les décisions, les informations commerciales essentielles se perdent dans le bruit numérique. Grâce aux fonctionnalités de gestion des tâches de ClickUp, vous n'avez plus à vous en soucier. Créez des tâches à partir de chats, de commentaires sur les tâches, de documents et d'e-mails en un seul clic !

Utilisez des outils de détection basés sur l'IA

Les outils de détection basés sur l'IA peuvent aider à mettre en évidence les signaux d'alerte, mais ils fournissent rarement une réponse définitive. La plupart des probabilités de retour, des scores de confiance ou des signaux vagues nécessitent encore un jugement humain. C'est là que les équipes ont tendance à se retrouver bloquées, car elles ne disposent pas d'une méthode claire pour examiner, documenter et prendre des décisions.

Transformez la vérification vidéo en un flux de travail reproductible dans ClickUp.

Repérer les signaux d'alerte n'est que la moitié du travail. Le véritable risque apparaît lorsque les examens sont effectués de manière incohérente, que les preuves se trouvent à des endroits aléatoires et que les approbations sont accordées rapidement sans laisser de traces claires. C'est là que ClickUp intervient : vous pouvez standardiser la checklist, recueillir des preuves et rendre les décisions vérifiables.

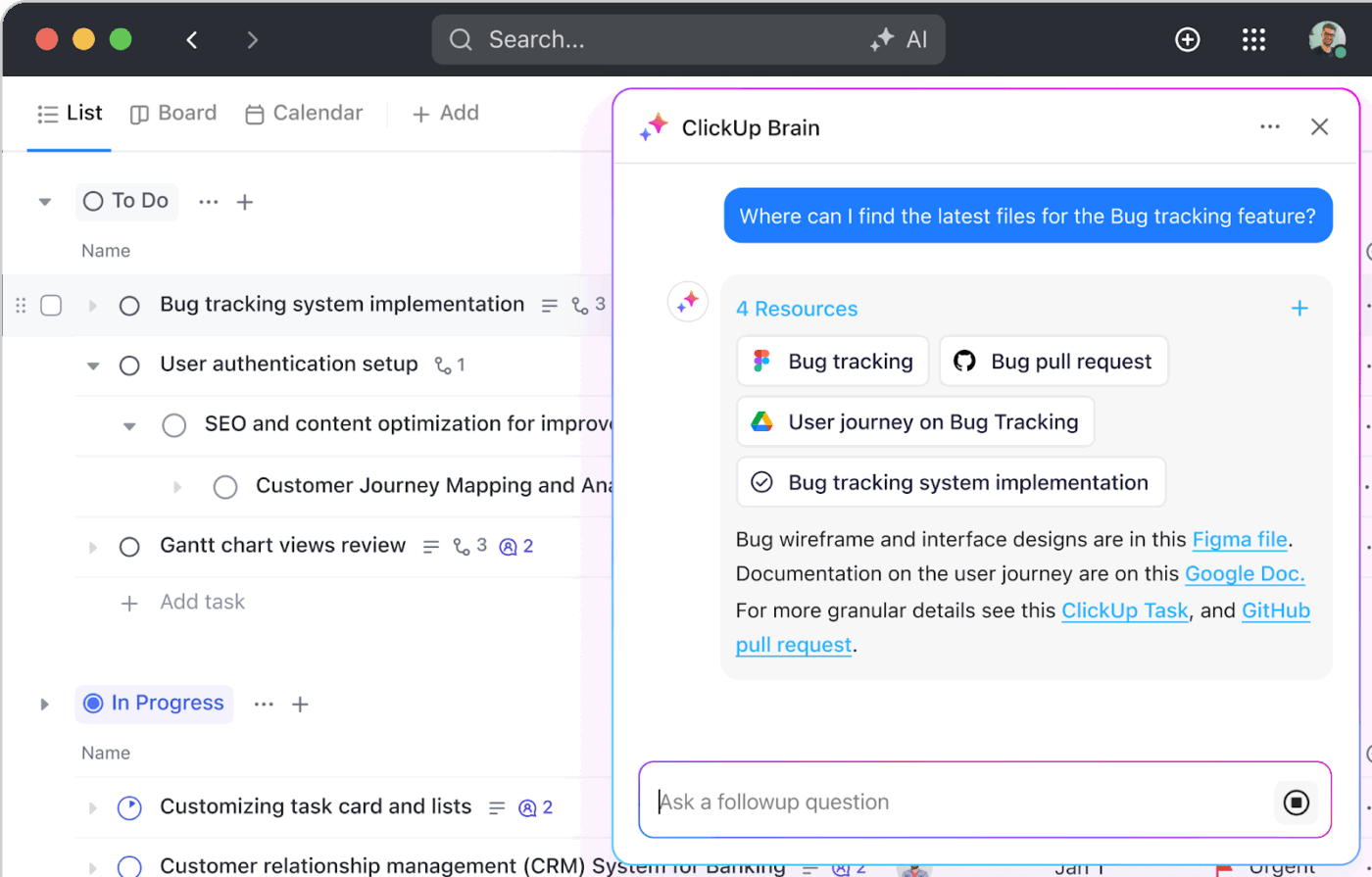

Retrouvez rapidement les décisions et normes antérieures

Lorsque vous examinez une vidéo suspecte, le contexte est important. Avec ClickUp Enterprise Search, vous n'avez pas besoin de vous souvenir où quelque chose a été discuté ou documenté. Vous pouvez effectuer une seule recherche et afficher instantanément les tâches d'examen connexes, les preuves stockées dans Docs, les commentaires des examinateurs, les décisions de vérification antérieures et même les notes de réunion liées à des cas similaires.

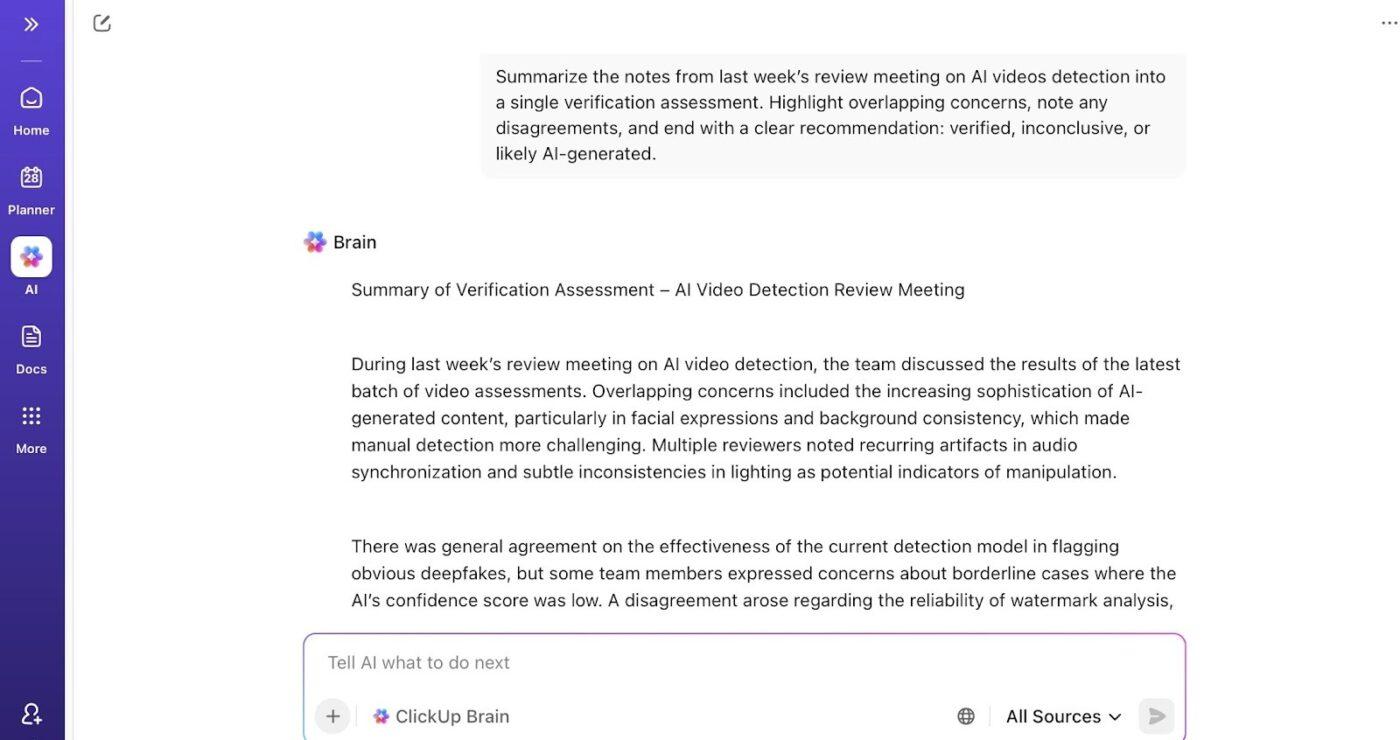

Standardisez les vérifications effectuées par les réviseurs afin que les décisions ne reposent plus sur des opinions.

L'un des plus grands défis de la vérification vidéo par IA est le manque de cohérence. Les différents évaluateurs remarquent des choses différentes, et les critères changent souvent en fonction de l'urgence, de la familiarité avec le contenu ou de la personne qui effectue l'évaluation.

ClickUp Brain est une IA contextuelle qui génère et affine des checklists structurées pour l'examen des vidéos à partir des informations déjà présentes dans votre environnement de travail. Au lieu de produire des conseils génériques, elle s'appuie sur les documents, les tâches, les notes de réunion, les examens antérieurs et les décisions pertinents pour refléter la manière dont votre équipe évalue réellement le contenu.

De cette manière, tous les évaluateurs travaillent à partir du même cadre d'évaluation, éclairés par un contexte de partage, ce qui rend les décisions plus cohérentes et plus faciles à défendre.

Vous pouvez également utiliser ClickUp Brain pour :

- Transformez vos directives internes en checklists d’étapes.

- Mettez à jour les critères à mesure que la qualité des vidéos IA évolue, sans tout réécrire à partir de zéro.

- Rédigez des résumés de vérification adaptés à un examen juridique, de conformité ou par la direction.

- Comparez les résultats actuels aux décisions de vérification passées stockées dans l'environnement de travail.

📌 Essayez ces invites avec ClickUp Brain

- Générez une checklist étape par étape pour l'examen des vidéos par IA à partir des documents, tâches et examens antérieurs existants.

- Identifiez les indicateurs récurrents dans les examens passés qui conduisent souvent à des classifications générées par l'IA.

- Mettez à jour les critères de détection vidéo par IA en fonction des récentes évaluations et des discussions de l'équipe.

- Signalez les signaux faibles ou peu fiables qui provoquent fréquemment des désaccords ou des faux positifs.

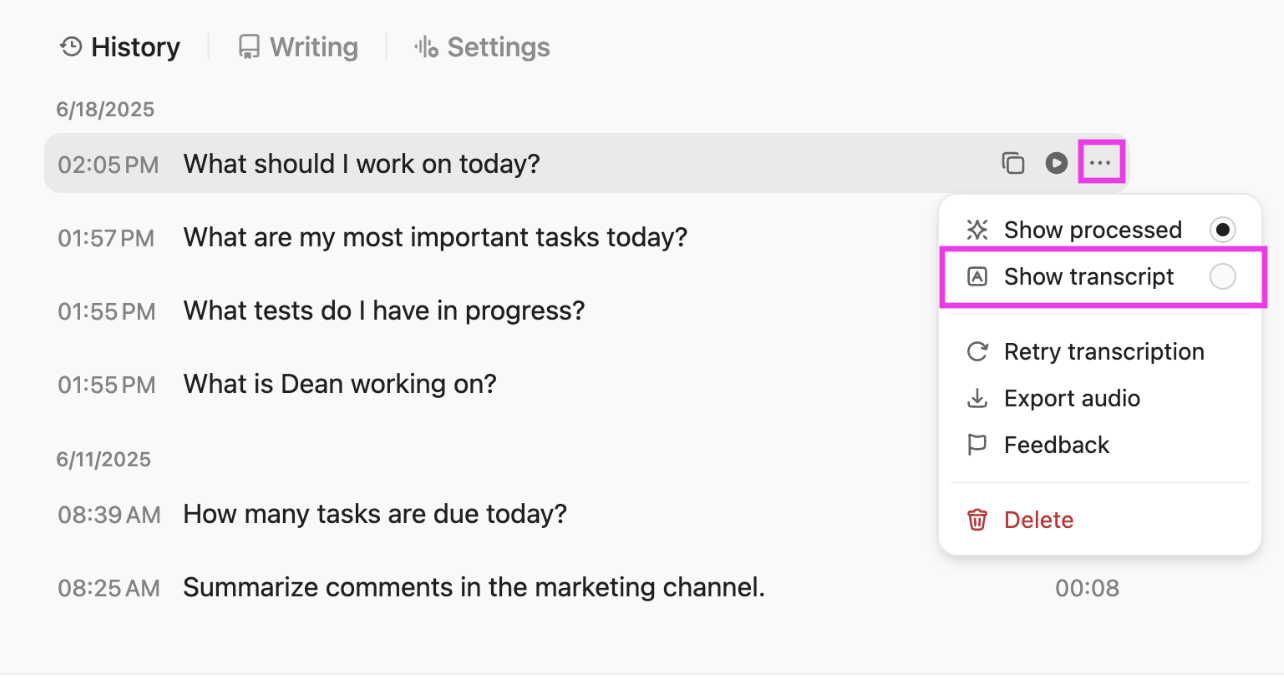

Capturez les informations dès qu'elles apparaissent avec ClickUp Brain MAX

Lors de la vérification vidéo, des observations critiques apparaissent souvent pendant que les examinateurs regardent le Clip, discutent des anomalies ou prennent des décisions. ClickUp BrainMAX permet de saisir instantanément ces informations afin qu'elles ne se perdent pas entre les outils ou les réunions.

Grâce à Talk-to-Text, les réviseurs peuvent enregistrer verbalement les anomalies telles que les incohérences temporelles, les incohérences faciales ou les manipulations suspectées. BrainGPT les convertit en notes structurées, en tâches liées ou en mises à jour de la checklist en temps réel.

Comme tout reste dans le même environnement de travail IA convergé, les informations sont directement intégrées aux dossiers de vérification, aux critères d'examen et aux décisions finales. Pas de notes éparpillées. Pas de contexte perdu. Pas de transcription manuelle.

Cela garantit que votre processus de vérification reflète ce que les évaluateurs voient réellement, et non ce dont ils se souviennent plus tard.

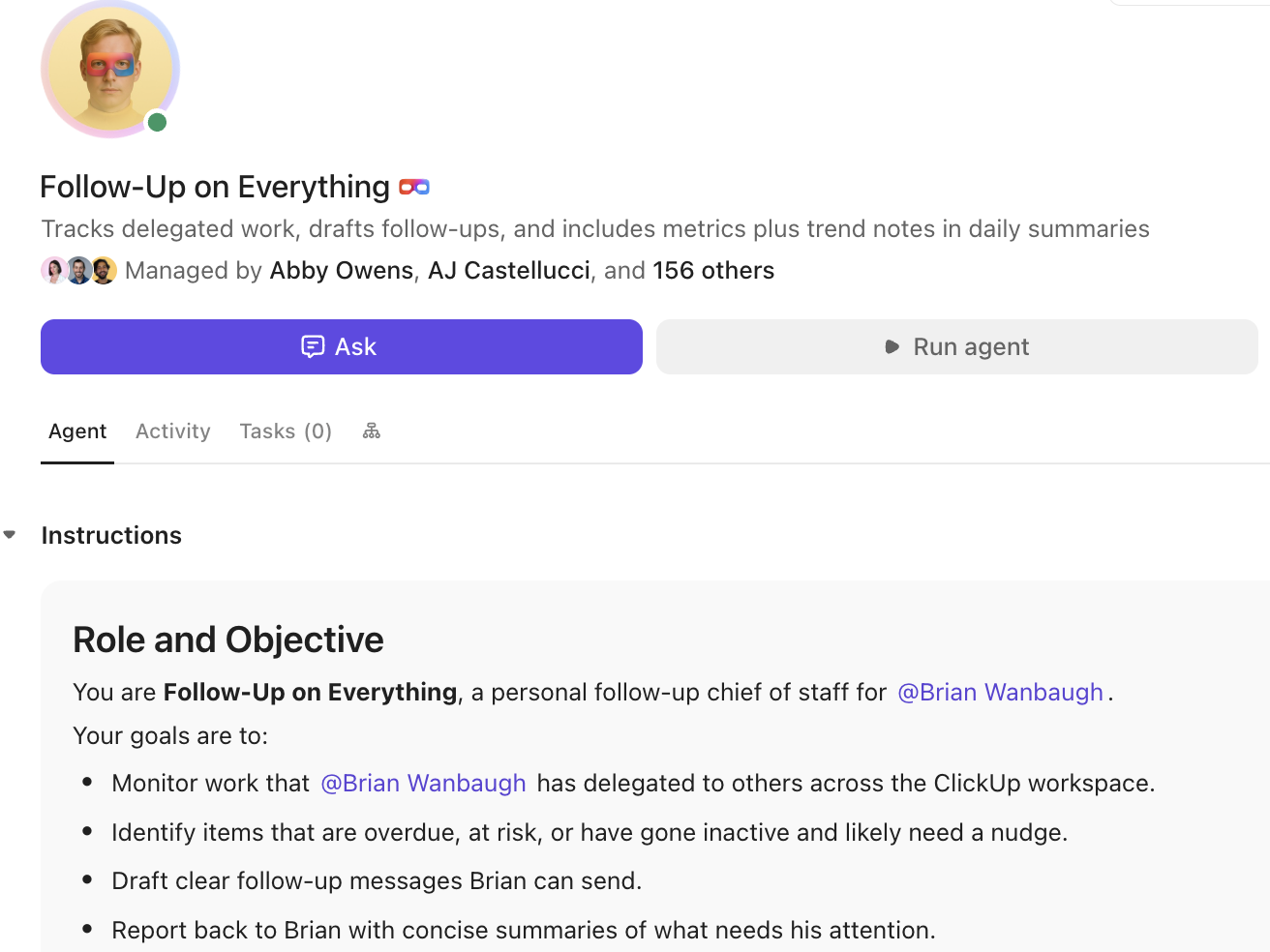

Renforcez la supervision de la vérification grâce aux super agents ClickUp

À mesure que le volume de vérifications augmente, le défi passe de l'examen d'une seule vidéo à la supervision cohérente de nombreuses vidéos. Les super agents ClickUp surveillent en permanence votre flux de travail de vérification et signalent les problèmes avant qu'ils ne deviennent des risques.

Ils peuvent automatiquement signaler les examens bloqués, détecter lorsque des vidéos à haut risque passent sans validation secondaire, mettre en évidence des schémas récurrents dans plusieurs Clips signalés et générer des résumés de rapports à des fins de conformité ou de gestion.

Au lieu de s'appuyer sur des suivis manuels ou des recherches de statut, les Super Agents garantissent que le système de vérification reste actif, cohérent et vérifiable à mesure qu'il évolue.

Cela permet de passer d'une vérification réactive à une gouvernance proactive.

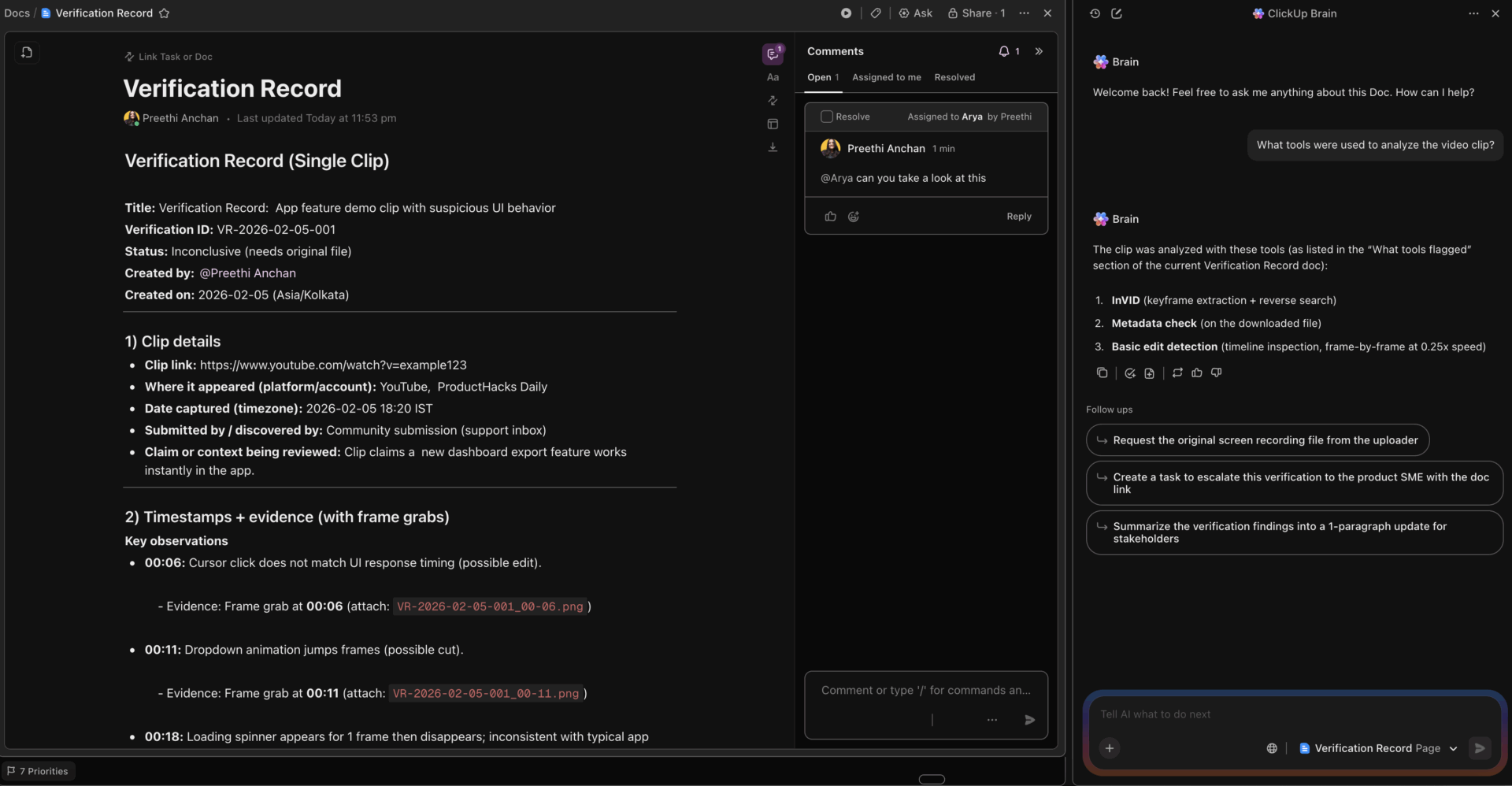

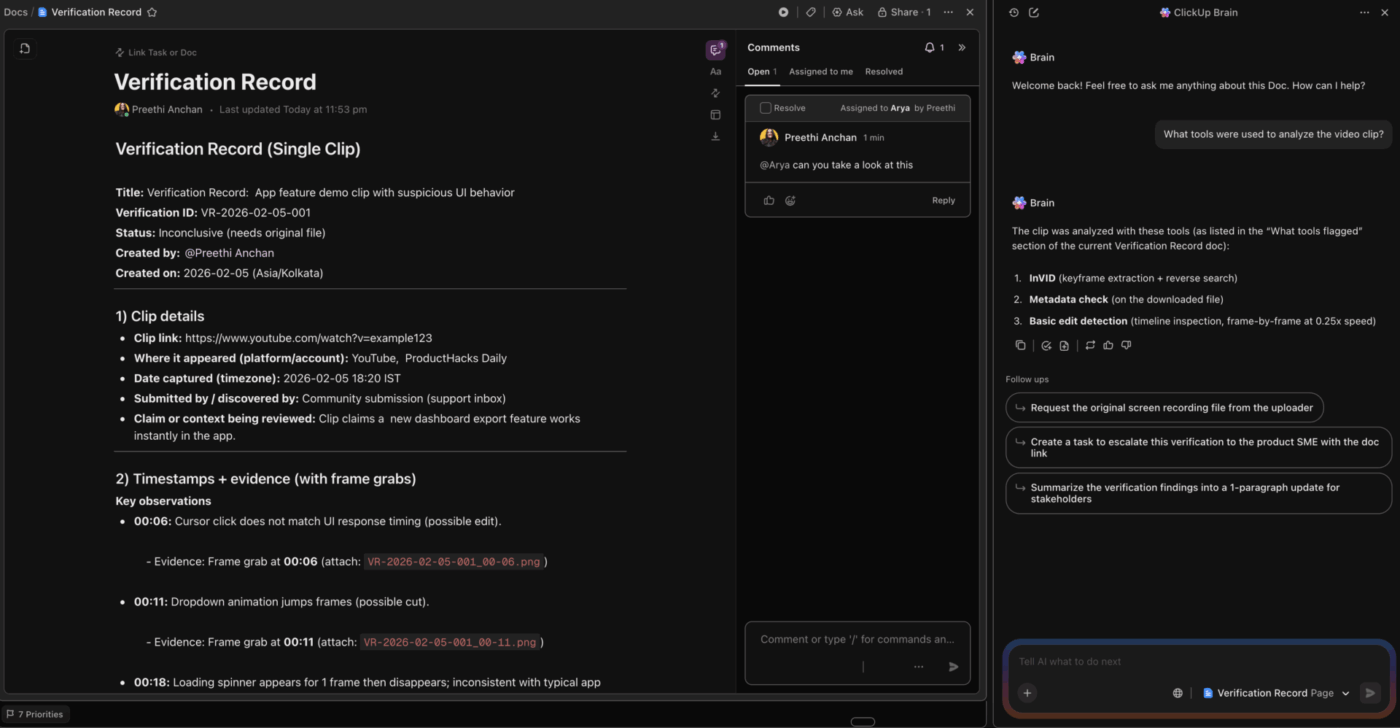

Conservez les preuves et les décisions dans un seul document de vérification avec ClickUp Docs

Une révision vidéo n'est utile que si quelqu'un d'autre peut la vérifier ultérieurement et parvenir à la même conclusion. Utilisez ClickUp Docs pour conserver un enregistrement de vérification par Clip, afin que les captures d'écran, les horodatages, les résultats des outils et la décision finale restent ensemble.

Incluez les éléments essentiels dans chaque document :

- Détails du Clip : lien, où il est apparu, date de capture

- Horodatages + preuves : « 00:07 distorsion de la bouche », « 00:13 artefact de la main » avec captures d'images

- Quels outils ont signalé : nom de l'outil, score de confiance, paramètres utilisés

- Vérification des sources : auteur original, chaîne de republication, liens vers des vérifications des faits connexes.

- Décision + justification : effacées/refusées, pourquoi et qui a approuvé

- Action suivante : publier, escalader, demander le fichier original ou bloquer la distribution.

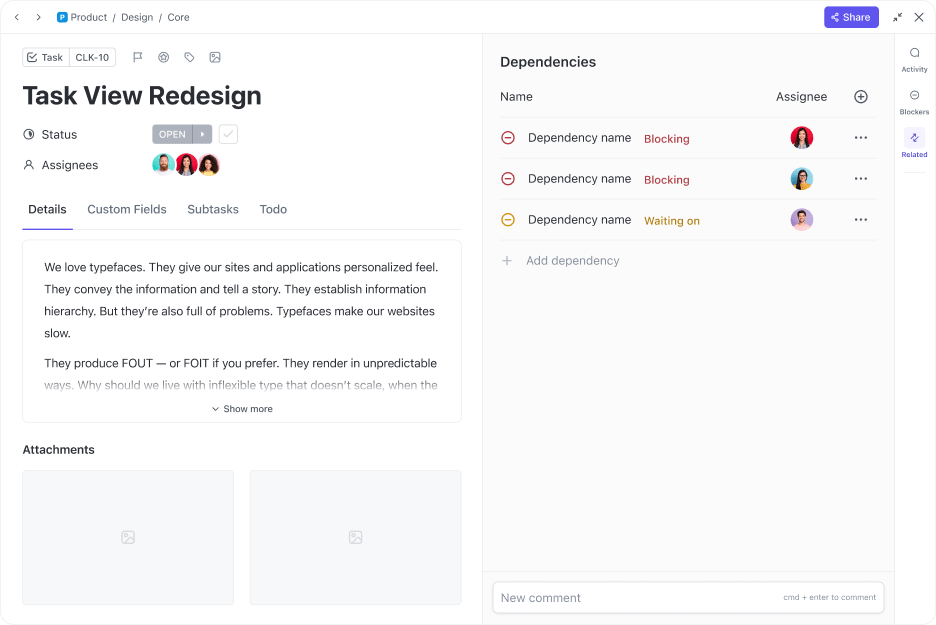

Rendez le statut de révision visible et exploitable

La vérification implique souvent plusieurs étapes, telles que l'examen initial, la confirmation secondaire, l'approbation juridique ou de la marque et la décision finale. Sans visibilité, les vidéos sont soit bloquées, soit diffusées sans avoir été correctement vérifiées.

ClickUp Tasks offre un moyen structuré de gérer le processus de vérification de chaque vidéo. Chaque vidéo peut constituer une tâche distincte, et vous pouvez assigner des réviseurs, joindre des preuves à l'appui, ajouter des commentaires et la relier à des tâches connexes. Les tâches constituent l'unité de travail qui vous permet d'avancer dans votre processus de vérification.

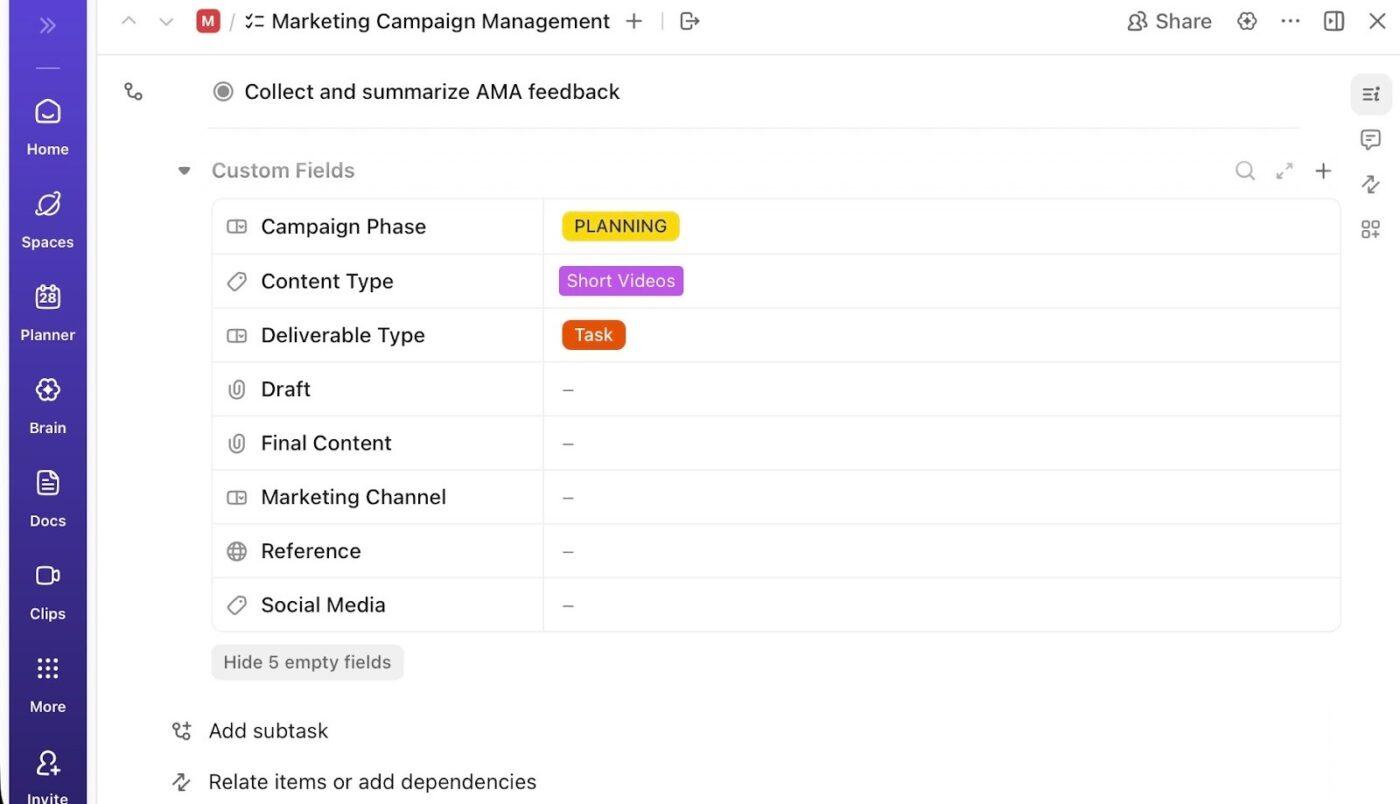

Pour mieux structurer ce processus, vous pouvez utiliser les champs personnalisés ClickUp. Ils vous aident à ajouter des métadonnées pertinentes à chaque tâche de vérification et à classer, filtrer et trier les tâches de vérification en fonction des critères qui importent à votre équipe. Ils s'affichent directement sur la tâche, ce qui vous permet de voir instantanément où en sont les choses et ce qui nécessite votre attention.

Par exemple, vous pouvez utiliser les champs personnalisés pour :

- Statut de l'examen (En attente d'examen, Nécessite une vérification secondaire, Signalé pour une analyse plus approfondie, Vérifié comme authentique ou Finalement approuvé/rejeté)

- Score de confiance (0-100) : l'évaluateur saisit un nombre en fonction de la probabilité qu'il estime être celle d'une IA.

- Niveau de risque (risque faible, risque moyen ou risque élevé)

- Type d'artefact détecté (problème de détail facial, problème de synchronisation audio-vidéo, anomalie des mains ou incohérence de l'éclairage)

📮 ClickUp Insight : 1 employé sur 4 utilise au moins quatre outils différents pour créer un contexte de travail. Un détail important peut être enfoui dans un e-mail, développé dans un fil de discussion Slack et documenté dans un outil distinct, ce qui oblige les équipes à perdre du temps à rechercher des informations au lieu de se concentrer sur leur travail.

ClickUp regroupe l'ensemble de votre flux de travail sur une seule plateforme. Grâce à des fonctionnalités telles que ClickUp Email gestion de projet, ClickUp Chat, ClickUp Docs et ClickUp Brain, tout reste connecté, synchronisé et instantanément accessible. Dites adieu au « travail autour du travail » et récupérez votre temps de productivité.

💫 Résultats concrets : grâce à ClickUp, les équipes gagnent plus de 5 heures par semaine, soit plus de 250 heures par an et par personne, en éliminant les processus de gestion des connaissances obsolètes. Imaginez ce que votre équipe pourrait accomplir avec une semaine supplémentaire de productivité chaque trimestre !

Créez votre flux de travail de vérification dans ClickUp

Détecter une vidéo générée par l'IA ne consiste pas à trouver un seul indice révélateur. Il s'agit de combiner des signaux, de documenter les décisions et d'appliquer les mêmes normes à chaque fois. À mesure que les médias synthétiques continuent de s'améliorer, les examens ad hoc et les vérifications intuitives ne feront qu'accroître les risques.

Les équipes qui investissent dès maintenant dans un flux de travail de vérification clair et reproductible sont mieux équipées pour faire face à l'avenir. Avec ClickUp, vous pouvez regrouper les critères d'évaluation, les preuves, les décisions et les validations dans un seul système connecté, afin que le travail de vérification soit cohérent, vérifiable et facile à adapter à toutes les équipes.

Si vous êtes prêt à passer d'outils dispersés à un processus structuré pour la vérification vidéo, vous pouvez commencer dès aujourd'hui à créer votre flux de travail dans ClickUp!

Foire aux questions (FAQ)

Recherchez les mêmes indicateurs que dans la vidéo préenregistrée, tels que des clignements d'yeux peu naturels ou des erreurs de synchronisation labiale. Si quelque chose vous semble anormal pendant un appel en direct, demandez à la personne de faire un geste inattendu, comme tourner rapidement la tête sur le côté, car les deepfakes en direct ont du mal à reproduire des mouvements non scriptés.

Les outils de détection utilisent des algorithmes pour trouver des artefacts techniques, tandis que la vérification manuelle repose sur votre regard et votre esprit critique. La meilleure approche combine les deux. Laissez un outil signaler les problèmes potentiels, puis utilisez votre jugement pour évaluer la source et le contexte.

Aucun outil ne peut détecter tout. La technologie est en constante évolution, les nouvelles méthodes de génération surpassant souvent les méthodes de détection. Les outils sont plus fiables pour repérer les types de contrefaçons plus anciens ou plus courants.

Établissez un protocole clair. La première étape consiste à signaler le contenu et à éviter le partage tant qu'il n'a pas été vérifié. Ensuite, documentez la source, soumettez-la à votre flux de travail de vérification et transmettez-la aux membres de l'équipe concernés pour qu'ils prennent une décision finale.