Najważniejsze wnioski

- Sztuczna inteligencja OpenAI automatyzuje wieloetapowe zadania za pomocą zintegrowanych narzędzi.

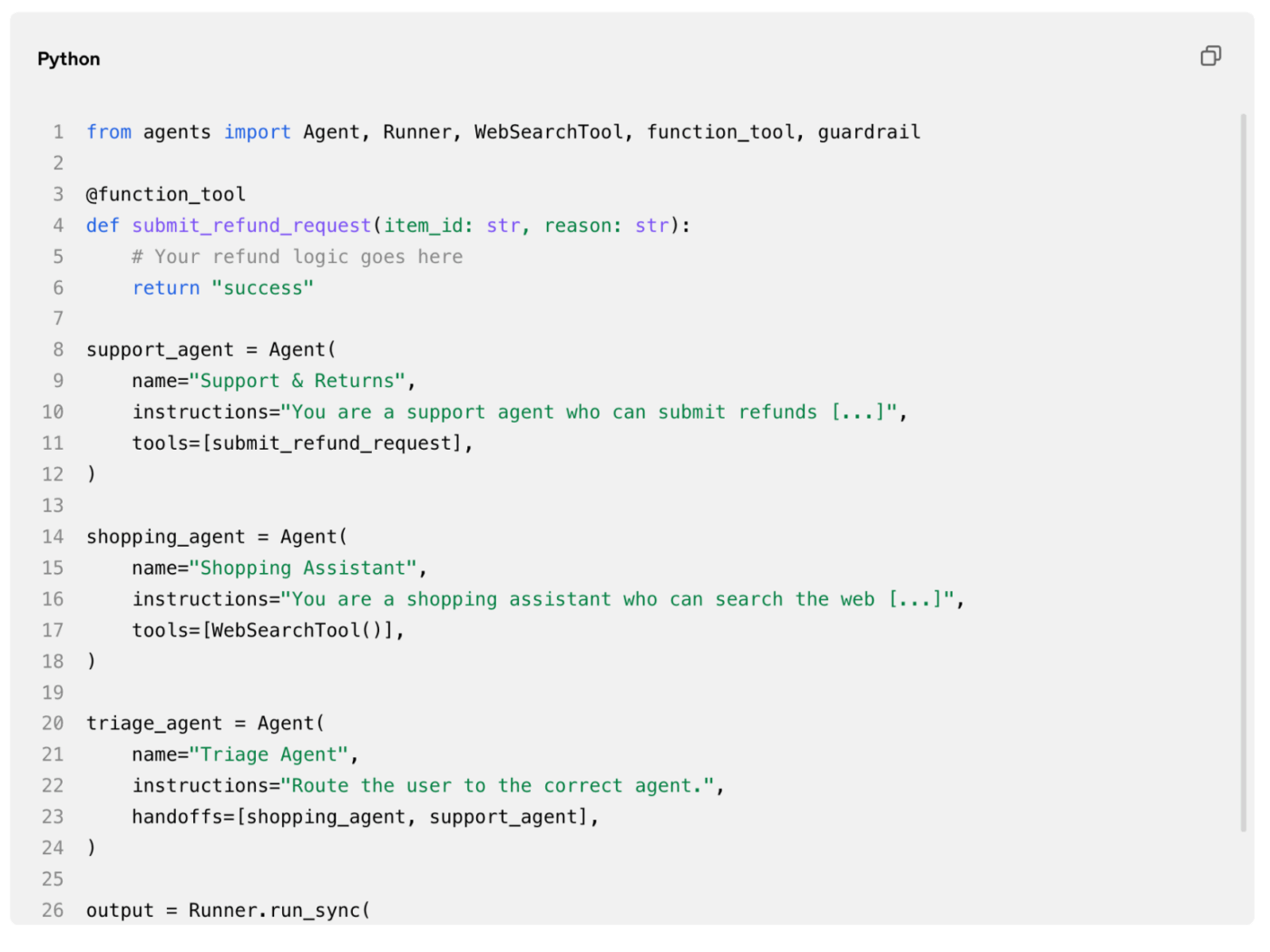

- AgentKit umożliwia programistom tworzenie niestandardowych agentów przy użyciu niskokodowej orkiestracji.

- Agenci mają bezpieczny dostęp do aplikacji innych firm dzięki uprawnieniom użytkowników i zabezpieczeniom.

- Wdrożenia działają najlepiej, gdy najpierw przeprowadza się je w ramach wąskich zadań o wysokiej wartości.

Czy OpenAI oferuje agentyczną sztuczną inteligencję?

Tak, OpenAI oferuje w pełni funkcjonalny produkt oparty na sztucznej inteligencji agentowej.

17 lipca 2025 r. firma uruchomiła tryb agenta ChatGPT, umożliwiający platformie zakończone wieloetapowe zadania przy użyciu zintegrowanych narzędzi, takich jak przeglądanie stron internetowych i wykonywanie kodu.

Trzy miesiące później firma OpenAI wypuściła AgentKit, kompleksowy zestaw narzędzi programistycznych przeznaczonych do tworzenia, wdrażania i optymalizacji agentów AI od początku do końca.

Te wydania dają OpenAI pozycję lidera na rynku sztucznej inteligencji agentowej. Firma kieruje swoją ofertę do liderów biznesowych i produktowych, którzy chcą inteligentnej automatyzacji bez konieczności przebudowywania całego swojego stosu technologicznego.

Po przetestowaniu platformy przez ostatnie kilka miesięcy stwierdziłem, że jej ustawienia są zaskakująco proste, chociaż agent czasami miał trudności z zadaniem wymagającym subtelnej oceny sytuacji w konkretnej dziedzinie.

Jak to właściwie działa?

Sztuczna inteligencja OpenAI działa w ramach zunifikowanego systemu, który łączy możliwości rozumowania ChatGPT z możliwością przeglądania stron internetowych, uruchamiania kodu i wywoływania API na komputerze wirtualnym.

Po przypisaniu zadania agent ocenia cel, wybiera odpowiednie narzędzia i wykonuje sekwencję działań, aż do zakończonego celu lub napotkania przeszkody.

Agent może korzystać z łączników do Gmaila, GitHub, Slacka i innych aplikacji, uzyskując bezpieczny dostęp do danych użytkownika dopiero po podpowiedzi. Ta warstwa uprawnień gwarantuje, że żadne wrażliwe działania nie zostaną podjęte bez wyraźnej zgody.

| Komponent | Funkcja biznesowa |

|---|---|

| Przeglądanie stron internetowych | Badania rynku, analiza konkurencji, pobieranie danych w czasie rzeczywistym |

| Wykonanie kodu | Transformacja danych, automatyzacja skryptów, generowanie raportów |

| Wywołania API | Aktualizacje CRM, przetwarzanie zamówień, integracja usług stron trzecich |

| Dostęp do łączników | Tworzenie wiadomości e-mail, planowanie kalendarza, wyszukiwanie dokumentów |

Podczas moich własnych testów zauważyłem, że agent zatrzymywał się przed wysłaniem wiadomości e-mail lub modyfikacją plików, co budowało zaufanie do jego procesu decyzyjnego.

Ta architektura pozwala agentowi wykonywać zadania, które wcześniej wymagały wielu narzędzi i ręcznego przekazywania danych. Na przykład może pobierać dane dotyczące sprzedaży z systemu CRM, analizować trendy w arkuszu kalkulacyjnym i tworzyć szkic e-maila z podsumowaniem bez konieczności zmiany kontekstu.

Ta różnica ma znaczenie, ponieważ szybkość zakończenia zadań wzrasta, gdy jeden system koordynuje cały cykl pracy. Jak to wygląda w praktyce, gdy prawdziwy użytkownik zaczyna z niego korzystać?

Jak to wygląda w praktyce?

Wyobraź sobie menedżera produktu, który musi zebrać informacje o konkurencji na potrzeby zbliżającej się sesji planowania sprintu.

Zamiast ręcznie odwiedzać strony konkurencji, kopiować listy funkcji i sporządzać notatki, aktywuje tryb agenta ChatGPT za pomocą jednej podpowiedzi: „Zbadaj trzy najlepsze platformy CRM, porównaj ich funkcje AI i podsumuj wyniki w tabeli”.

Agent podąża jasną ścieżką od problemu do wyniku:

- Określa zakres zadania i potwierdza trzy platformy CRM do zbadania.

- Przegląda strony internetowe i dokumentację każdego dostawcy, aby wyodrębnić szczegóły dotyczące funkcji AI.

- Zestawia wyniki w uporządkowanej tabeli porównawczej.

- Sprawdza dokładność wyników i sygnalizuje wszelkie brakujące informacje.

W ciągu 10 minut kierownik produktu otrzymuje gotowy do udostępniania dokument. Ta szybkość i autonomia stanowią wyraźny kontrast w stosunku do tradycyjnych asystentów badawczych, którzy wymagają szczegółowych kroków instrukcji lub ręcznej weryfikacji na każdym etapie.

Konkurencyjne rozwiązania często nie zapewniają ścisłej integracji między wnioskowaniem, przeglądaniem i manipulowaniem danymi, którą OpenAI łączy w jednym interfejsie. To prowadzi nas do szerszego pytania o to, co wyróżnia OpenAI na tle konkurencji w tym zatłoczonym polu.

Co wyróżnia OpenAI?

OpenAI wyrobiło sobie wyjątkową pozycję wśród czołowych firm tworzących agentów, opracowując w ciągu jednego roku tryb agenta skierowany do konsumentów oraz kompletny zestaw narzędzi dla programistów.

Podczas gdy inni dostawcy koncentrują się na wąskiej automatyzacji lub wymagają rozbudowanego kodowania niestandardowego, OpenAI oferuje użytkownikom nietechnicznym rozwiązanie typu „plug-and-play” oraz zaawansowane opcje dostosowywania dla zespołów inżynierów.

Firma priorytetowo traktuje również bezpieczeństwo i zarządzanie. OpenAI wypuściło Guardrails, modułową warstwę bezpieczeństwa typu open source, która może automatycznie maskować dane osobowe, wykrywać próby jailbreakowania i egzekwować zgodność z polityką.

Gwarantuje to, że wdrożone agenty działają w ramach zaufanych granic, co ma kluczowe znaczenie dla przedsiębiorstw zajmujących się przetwarzaniem poufnych informacji.

Oto kluczowe zalety i wady platformy:

- AgentKit zapewnia wizualne środowisko typu „przeciągnij i upuść” do koordynowania cykli pracy wielu agentów bez konieczności pisania kodu koordynacyjnego.

- Wbudowane narzędzia, takie jak wyszukiwanie w Internecie, wyszukiwanie plików i sterowanie komputerem, zmniejszają potrzebę stosowania niestandardowych integracji.

- Pierwsi użytkownicy dokonują raportowania sporadycznych problemów z dokładnością i powolnym działaniem w przypadku złożonych, wieloetapowych zadań.

- Ograniczenie dostępu do usług w świecie rzeczywistym oznacza, że niektóre zadania nadal wymagają ręcznej kontroli.

Jeden z użytkowników Reddita dobrze uchwycił mieszane odczucia: „W ciągu tygodnia opracowałem złożone aplikacje, które wcześniej zajęłyby mi miesiące”, podczas gdy inny zauważył, że agent „rutynowo nie radzi sobie z podstawowymi zadaniami” i brakuje mu przejrzystości niezbędnej do automatyzacji procesów robotycznych w przedsiębiorstwie.

Te kontrastujące doświadczenia podkreślają, że platforma wciąż się rozwija, ale już teraz widać jej potencjał transformacyjny.

Mając to na uwadze, przyjrzyjmy się, jak agenci OpenAI wpisują się w istniejące ekosystemy technologiczne przedsiębiorstw.

Integracja i dopasowanie do ekosystemu

Sztuczna inteligencja OpenAI łączy się z otaczającymi systemami poprzez scentralizowany rejestr łączników, który oferuje gotowe integracje dla popularnych aplikacji korporacyjnych.

Administratorzy zarządzają tymi łącznikami z jednej konsoli, przyznając lub ograniczając dostęp w oparciu o role zespołów i wymagania dotyczące zgodności.

Agents SDK i Responses API zapewniają wbudowane narzędzia, takie jak wyszukiwanie w Internecie, wyszukiwanie plików i sterowanie komputerem, umożliwiając programistom tworzenie agentów, którzy pobierają informacje na żywo i wykonują działania bez konieczności stosowania niestandardowego kodu integracyjnego. Zmniejsza to tarcia związane z wdrażaniem i przyspiesza osiągnięcie wartości.

Oto, jak główne platformy wpisują się w ekosystem agentów OpenAI:

| Platforma | Rola integracji |

|---|---|

| Dropbox, Google Drive, SharePoint | Bezpieczny dostęp do dokumentów i ich pobieranie na potrzeby badań i raportowania |

| Microsoft Teams, Slack | Wiadomości w czasie rzeczywistym, powiadomienia i koordynacja cyklu pracy |

| Gmail, Outlook | Tworzenie wiadomości e-mail, planowanie i zarządzanie skrzynką odbiorczą |

| GitHub | Dostęp do repozytorium kodu, automatyzacja pull requestów, kontrola wersji |

Wsparcie integracji modeli innych producentów jest również dostępne. Platforma nie ma limitu co do modeli OpenAI; programiści mogą oceniać inne modele w ramach platformy i wywoływać zewnętrzne API za pośrednictwem standardowych interfejsów.

Ta rozszerzalność sprawia, że agenci OpenAI mogą być dostosowywani do heterogenicznych stosów technologicznych, w których współistnieje wielu dostawców AI.

Oś czasu wdrożenia i zarządzanie zmianami

Wdrożenie sztucznej inteligencji agentowej działa najlepiej, gdy organizacje przygotowują scenę dla wdrożenia, zamiast wdrażać ją jednocześnie w całej firmie.

Zacznij od wąskiego pilotażowego projektu, który ma na celu przepływ pracy o wysokiej wartości i niskim ryzyku, takim jak automatyzacja segregacji zgłoszeń do obsługi klienta lub generowanie cotygodniowych podsumowań sprzedaży. Dzięki temu zespoły mogą poznać mocne strony i ograniczenia platformy w kontrolowanym środowisku.

Oto sprawdzona sekwencja wdrożeniowa:

- Uruchom program pilotażowy z jednym zespołem i jednym, dobrze zdefiniowanym zadaniem.

- Oceniaj wskaźniki wydajności, takie jak wskaźnik zakończenia zadań i zadowolenie użytkowników.

- Udoskonalaj podpowiedzi, łączniki i zabezpieczenia w oparciu o opinie uczestników programu pilotażowego.

- Rozszerz działalność na sąsiednie zespoły o podobnych cyklach pracy.

- Po wdrożeniu zasad zarządzania i szkolenia można przejść do pełnego wdrożenia.

Wśród interesariuszy powinni znaleźć się specjaliści ds. bezpieczeństwa IT, którzy będą weryfikować zasady dostępu do danych, specjaliści ds. zgodności, którzy będą dbać o zgodność z przepisami, oraz użytkownicy końcowi, którzy będą zbierać praktyczne opinie. Ogólne etykiety ról zapewniają elastyczność procesu, ponieważ struktury organizacyjne są różne.

Zarządzanie zmianami ma tutaj znaczenie, ponieważ agentyczna AI przenosi proces podejmowania decyzji z ludzi na algorytmy w określonych kontekstach.

Przejrzysta komunikacja na temat tego, co agent może, a czego nie może zrobić, zapobiega nierealistycznym oczekiwaniom i buduje zaufanie do technologii.

Posłuchajmy teraz, co pierwsi użytkownicy mają do powiedzenia na temat swoich praktycznych doświadczeń.

Opinie społeczności i wczesne opinie użytkowników

Wstępne opinie są bardzo podzielone. Niektórzy programiści są zachwyceni wzrostem szybkości, podczas gdy inni uważają, że obecne możliwości są niewystarczające do zastosowań produkcyjnych.

- „W ciągu tygodnia opracowałem złożone aplikacje, które wcześniej zajęłyby mi miesiące” ( użytkownik Reddit, r/aipromptprogramming ).

- „Agent OpenAI jest fajną sztuczką, ale niczym więcej” ( użytkownik Reddit, r/ChatGPT ).

- „To zakończone zniszczy rynek RPA” ( użytkownik Reddit, r/wydajność ).

- „Rutynowo nie radzi sobie z podstawowymi zadaniami i nie ma dostępu do większości rzeczywistych usług” ( użytkownik Reddit, r/ChatGPT ).

Jeśli jesteś zainteresowany, możesz przeczytać wszystkie ponad 500 komentarzy na temat tej funkcji tutaj, aby zrozumieć, o czym mówię:

Wprowadzenie AgentKit wywołało również dyskusję, że zewnętrzni twórcy agentów AI mogą mieć trudności z konkurowaniem, chyba że się wyspecjalizują lub dodadzą unikalną wartość.

Jeden z obserwatorów zauważył, że „większość start-upów oferujących cykle pracy AI bez kodowania nagle stała się zbędna”, ponieważ OpenAI zapewnia teraz natywny kreator agentów.

Pomimo obecnych limitów część społeczności pozostaje optymistyczna. Panuje przekonanie, że sztuczna inteligencja typu agentowego może zrewolucjonizować automatyzację, gdy tylko zostaną wyeliminowane luki w zakresie niezawodności i zgodności.

Wykonanie rutynowych zadań, takich jak wypełnianie formularzy, zakupy lub monitorowanie danych, stanowi coś, co niektórzy nazywają „największą zmianą paradygmatu technologicznego w naszym życiu”.

Te skrajne widoki ustawiają scenę dla zrozumienia, w jakim kierunku OpenAI planuje rozwijać swoją platformę.

Plan działania i perspektywy ekosystemu

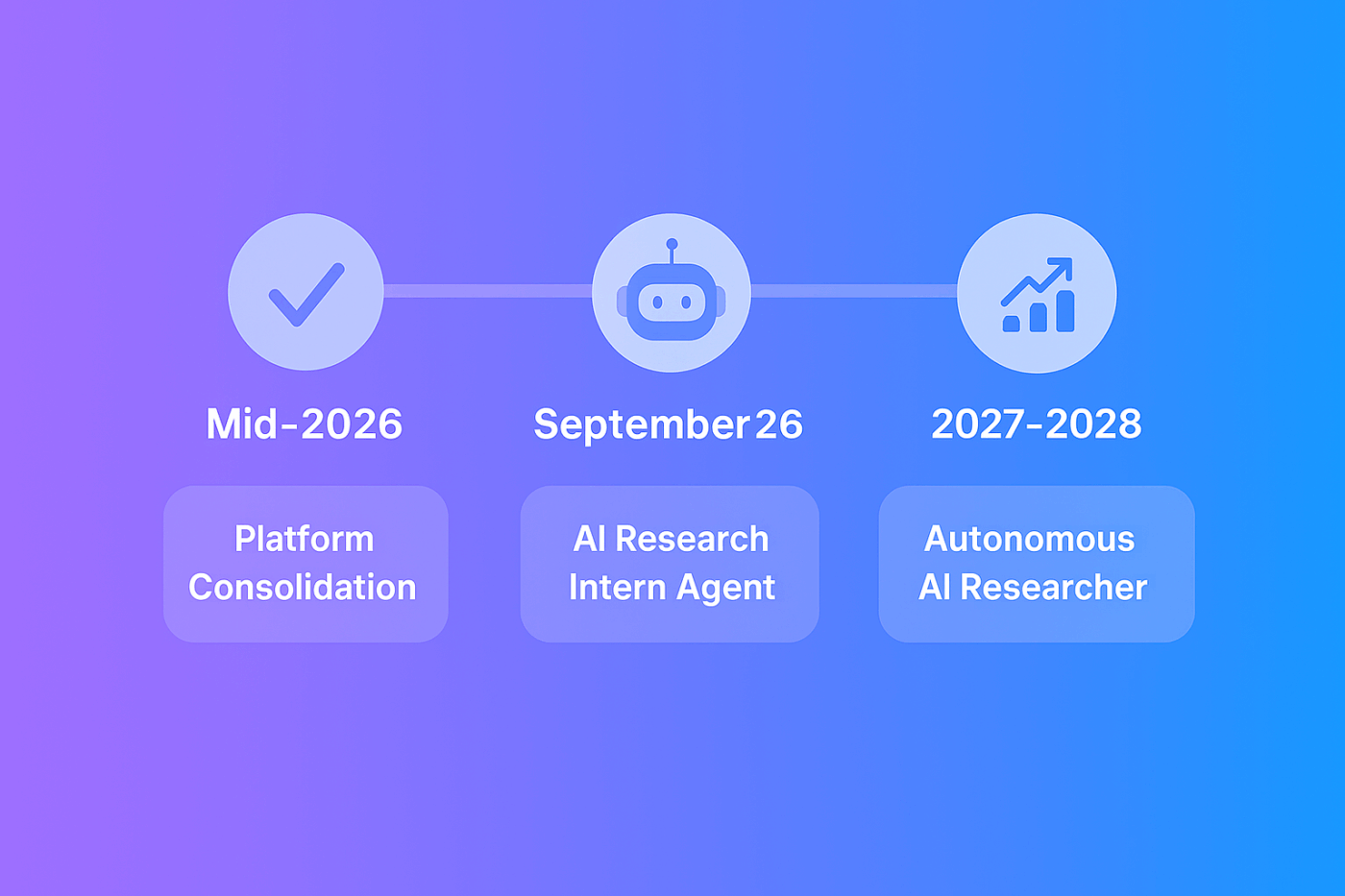

OpenAI nakreśliło ambitną oś czasu, która obejmuje przejście od konsolidacji platformy do autonomicznych możliwości badawczych.

Do połowy 2026 r. OpenAI planuje wycofać starszą wersję API Assistants, gdy API Responses i Agent SDK osiągną pełną równoważność funkcji.

Dzięki temu programiści będą mogli korzystać z jednej, ulepszonej platformy agentów. W miarę zbliżania się terminu przejścia należy spodziewać się oficjalnych ogłoszeń o wycofaniu i narzędzi migracyjnych.

Pod koniec 2026 r. OpenAI zamierza dostarczyć agenta AI zdolnego do samodzielnego prowadzenia badań na poziomie „stażysty”. Dyrektor generalny Sam Altman opisał ten cel jako stworzenie systemu, który potrafi czytać literaturę, generować hipotezy, przeprowadzać eksperymenty i analizować wyniki przy minimalnym udziale człowieka.

Patrząc dalej w przyszłość, OpenAI ma na cel 2028 r. stworzenie „prawdziwego badacza AI”, który będzie w stanie rozwiązywać złożone problemy naukowe od początku do końca.

Osiągnięcie tego kamienia milowego wymagałoby skalowania infrastruktury obliczeniowej, rozszerzenia okien kontekstowych poza obecny pięciogodzinny limit efektywnego rozumowania oraz rozwoju innowacji algorytmicznych w zakresie rozumowania.

W najbliższym czasie planowane są ulepszenia, takie jak API cyklu pracy do programowego wdrażania i zarządzania cyklem pracy agentów oraz wprowadzenie większej liczby funkcji agentów do aplikacji konsumenckiej ChatGPT. Regularne ulepszenia modelu jeszcze bardziej poprawią rozumowanie agentów i zmniejszą liczbę błędów.

Mając przed sobą perspektywiczny plan działania, liderzy muszą zrozumieć, jakie zobowiązania finansowe wiążą się z wdrożeniem tej technologii.

Ile kosztuje sztuczna inteligencja OpenAI Agentic AI?

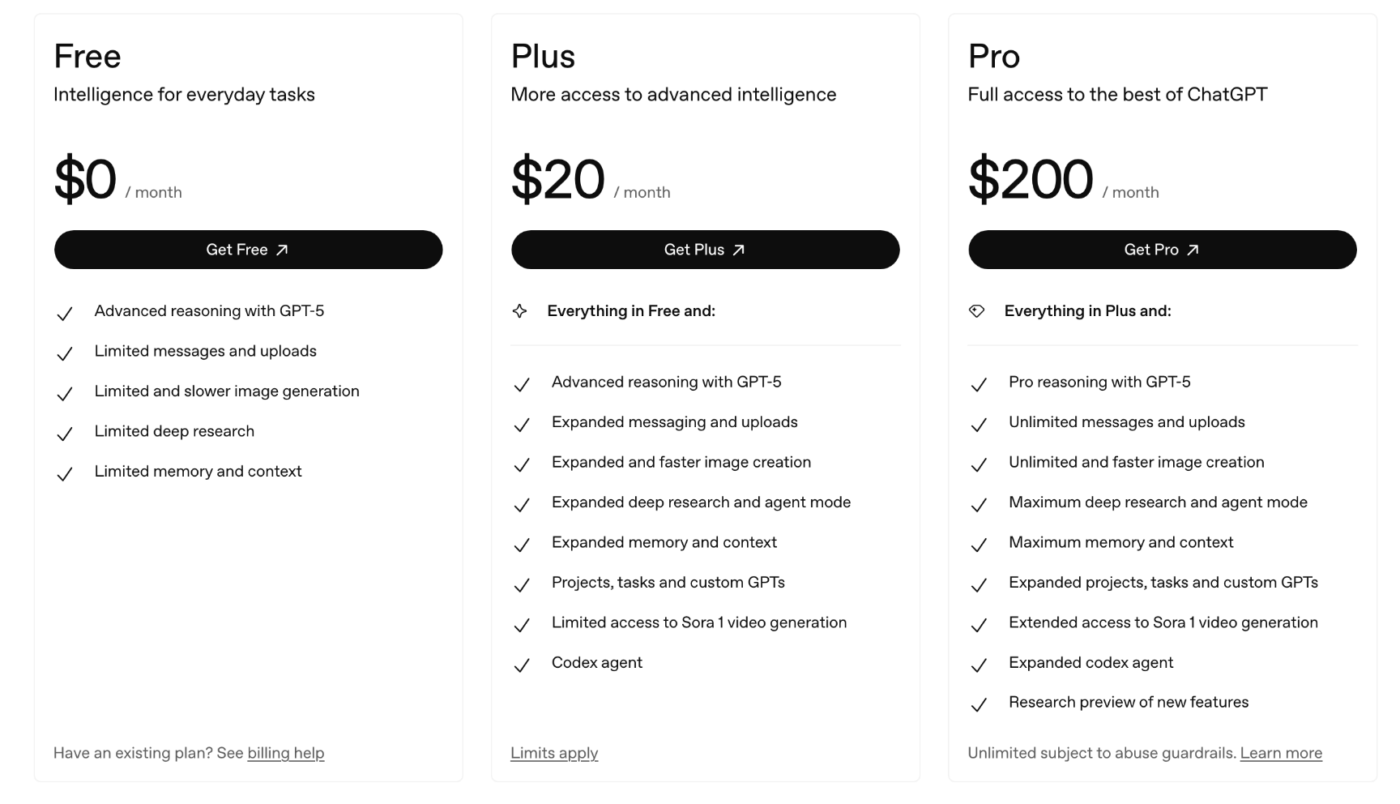

OpenAI stosuje wielopoziomowy model subskrypcji dostępu do agenta ChatGPT i pobiera oddzielne opłaty za narzędzia programistyczne API.

ChatGPT Plus kosztuje 20 USD miesięcznie dla jednego użytkownika i obejmuje około 40 działań agenta miesięcznie, z możliwością dokupienia dodatkowych kredytów w systemie pay-as-you-go.

ChatGPT Pro, w cenie 200 USD miesięcznie, oferuje dostęp z priorytetem i zasadniczo nieograniczone korzystanie z agentów, zapewniając początkowo około 400 działań agentów miesięcznie w trybie domyślnym.

W przypadku zespołów ChatGPT Team kosztuje 25 USD miesięcznie za użytkownika w ramach umowy rocznej lub 30 USD miesięcznie za użytkownika. Ten poziom obejmuje wszystkie funkcje Plus dla każdego użytkownika, konsolę administratora udostępnianą i wyższe łączne limity użytkowania.

Programiści korzystający z API płacą tylko za tokeny modelu bazowego i wszelkie dodatkowe wywołania API. Nie ma oddzielnej opłaty za korzystanie z Agents SDK, narzędzi AgentKit lub wbudowanych funkcji.

Jednak zapytania w wyszukiwarce internetowej wiążą się z dodatkowymi kosztami: 30 USD za 1000 zapytań w przypadku GPT-4o search-preview i 25 USD za 1000 zapytań w przypadku GPT-4o-mini. Inne wbudowane narzędzia, takie jak wyszukiwanie plików lub wykonywanie kodu, są rozliczane wyłącznie na podstawie zużytych tokenów modelu.

Ukryte koszty mogą wynikać z zadań wymagających dużej mocy obliczeniowej lub integracji na dużą skalę, które wymagają rozbudowanych wywołań API. Organizacje powinny dokładnie monitorować wykorzystanie podczas pilotażowych wdrożeń, aby dokładnie sporządzić prognozę miesięcznych wydatków. Jeśli nie ma publicznych cen dla konkretnej funkcji, zapoznaj się ze stroną danych biznesowych OpenAI lub skontaktuj się bezpośrednio z zespołem sprzedaży.

Końcowe przemyślenia

Tryb agenta OpenAI jest naprawdę obiecujący, ale nie jest jeszcze gotowy do użycia we wszystkich przypadkach. Widziałem, jak świetnie radzi sobie z badaniami i syntezą, ale ma problemy z cyklami pracy wymagającymi subtelnej oceny.

Rozsądnym posunięciem jest traktowanie tego narzędzia jako eksperymentalnego, a nie pełnego zamiennika automatyzacji. Zacznij od jednego powtarzalnego zadania, które ma jasne kryteria powodzenia, monitoruj je uważnie, a następnie dostosuj podpowiedzi i uprawnienia, aż wyniki będą spójne.

Pierwsi użytkownicy, którzy będą ostrożnie wprowadzać zmiany, zbudują cenną wiedzę instytucjonalną w miarę dojrzewania platformy. Ci, którzy będą czekać na perfekcję, będą patrzeć, jak konkurenci wykorzystują przewagę wynikającą z krzywej uczenia się.